読み取り時間: 5 分

スマート コントラクト監査における chatGPT の有効性の調査

ChatGPT が開始されたのは 30 年 2022 月 XNUMX 日でした。 世界を席巻するのにそれほど時間はかかりませんでした。 どのソーシャル メディアを使用していても、chatGPT には投稿、ミーム、有益な記事などがあります。 それだけでなく、chatGPT は主流メディアの話題になりました。 誰もがchatGPTとその力について話し合ったと言っても過言ではありません.

このブログでは、chatGPT がスマート コントラクト監査または Web3 サイバー セキュリティでどのように使用されているか、または使用できるかについて説明します。 まず最初に、chatGPT とは正確には何かから始めましょう。

ChatGPTとは?

AI言語モデルを活用してコードのデバッグからデータの異常検出まで、 プロンプトを受け取り、トレーニングされたデータに基づいて回答を返すインタラクティブなチャットボットです。 会話型の会話でコミュニケーションを取り、驚くほど人間らしい応答を返す驚くべき能力を備えています。

それとは別に、それをよりスマートにするものの XNUMX つは、ユーザーの入力データから学習し続ける独自の機能です。 これは、人間のフィードバックによる強化学習 (RLHF) の層に実装されており、人間に満足のいく答えを返すのに役立ちます。

トレーニングデータ

すべての AI モデルは、トレーニング データからの学習と発見に基づいて答えを出す、トレーニングされたマシンに他なりません。 トレーニング データは、ビデオからテキストまで、このデータについて学習するモデルに供給されるものであれば何でもかまいません。このモデルに問題が提案されると、トレーニング データからの学習に基づいて、答えが返されます。

chatGPT は、Reddit ディスカッションなどのソースを含むインターネットから収集されたデータでトレーニングされ、ChatGPT が対話を学習し、人間のような応答スタイルを実現できるようにしました。 chatGPT は、人間のフィードバックについてもトレーニングされています。 この手法は人間のフィードバックによる強化学習と呼ばれ、AI が質問をするときに人々が期待することを学習します。

ChatGPT は脆弱性を見つけることができます

リリースからかなり経ってから、人々はさまざまなユース ケースやシナリオで chatGPT の機能を試し始めました。 この実験は、スマート コントラクト セキュリティでも行われました。

そして、chatGPT は確かに失敗しませんでした。 ただし、まだ改善の余地がありますが、監査人やスマートコントラクトを扱う人々にとって有用であり、非常に役立つことが証明されています. よく知られているハッキングや、かなり前からシステムに存在するいくつかのハックについては、それらを見つけるのに非常に役立ちます。

chatGPT が少し正確に検出する一般的な脆弱性のいくつかは次のとおりです。

- レンタランシー攻撃: これは、前の実行が完了する前に攻撃者がスマート コントラクト内の関数を繰り返し呼び出すことができる一般的な脆弱性であり、予期しない、または悪意のある動作につながります。

- 整数のオーバーフロー/アンダーフロー: スマート コントラクトは多くの場合、整数計算に依存しており、これらの計算が適切にチェックされていない場合、予期しない、または正しくない動作が発生する可能性があります。

- 未チェックの戻り値: コントラクトは、外部呼び出しからの予期しない戻り値を適切に処理しない可能性があり、潜在的な脆弱性につながり、害を及ぼす可能性があります。

- 保護されていない関数: コントラクトに適切なアクセス制御がなく、機密機能への不正アクセスにつながる可能性があります。 これは大きな損失につながる可能性があります。

chatGPT がスマート コントラクトで特定できる脆弱性や問題は他にもいくつかあります。 それでも、私たちのテストを通じて、誤報を受け取ることが多く、重大なバグを見逃す可能性が非常に高いことがわかりました.

chatGPT はすべての脆弱性を検出できますか?

chatGPT は便利なツールであり、大衆にとって AI のブレークスルーですが、まだ完全にはほど遠いものであり、スマート コントラクトを完全に保護するために放置することはできません。

私たちのテストでは、chatGPT が 再突入攻撃、すでに保護され、テストされています。 それとは別に、いくつかの誤報がありました。最も重要なことは、私たちのチームが発見した重大なバグが、chatGPT によって完全に無視されたことです。 chatGPT が見逃す可能性のあるいくつかのことについて説明しましょう。

- プロジェクト固有のロジック:- プロジェクトのバックボーンはそのロジックと相互接続方法ですが、chatGPT はそれを見逃しているようです。 テスト中に、chatGPT はロジック固有の重大なバグを検出できないことが多いことがわかりました。 プロトコルの基盤となるインフラストラクチャが複雑であるため、chatGPT はプロジェクトの論理的要件を満たすためのコントラクトの相互接続によって発生する重大な脆弱性を見逃しています。

- 不正確な数学計算と統計モデル:- プロジェクトに関して言えば、それがゲーム プロジェクトであろうと、DeFi プロジェクトであろうと、何でもかまいません。ほとんどの場合、数学的計算と関係が関係します。 これらの数式は、chatGPT によってチェックも監視もされないことが多く、潜在的なバグが見逃されています。

- 意図した設計と実装の不規則性:- 多くの場合、開発者による実装は本来あるべきほど正確ではなく、セキュリティの問題につながります。 これは過去に悪用されており、改善可能な重要なセクターの XNUMX つであり続けています。chatGPT はこの点についても少し無知です。

まとめ

Web3 のセキュリティと監査に関しては、AI ツールが役立ちます。それについては疑いの余地はありませんが、問題は、それだけで十分でしょうか? 答えは大きな「NO」です。 説明したように、重大な脆弱性の一部は簡単に取り残され、誤報が発生する可能性が非常に高くなります。 これらの誤警報は、chatGPT がすべてのバグを特定し、ユーザーにそれを信じさせることができるという誤った感覚を生み出しますが、現実は異なり、AI ツールのみに依存するようになると厳しいものになる可能性があります。

AI は非常に効果的になるかもしれませんが、まだまだ先は長いです。 セキュリティを向上させる最善の方法は、スマート コントラクトのセキュリティ面を AI と手動でカバーすることです。

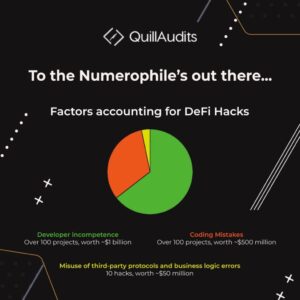

について スマートコントラクトセキュリティ、監査に代わるものはありません。 監査に行くことは絶対に必要であり、監査レポートは非常に重要であるため、監査なしではユーザー間の信頼はあり得ません。 多くのユーザーは、プロジェクトを信頼する前に監査レポートを探します。 監査サービスの主要企業の 700 つに QuillAudits があります。 XNUMX 以上のプロジェクトが保護されており、さらに多くのプロジェクトが予定されているため、プロトコルの完全な安全性を保証します。 今すぐ当社の Web サイトをチェックして、プロジェクトの監査を受けてください。

20 ビュー

- SEO を活用したコンテンツと PR 配信。 今日増幅されます。

- Platoblockchain。 Web3メタバースインテリジェンス。 知識の増幅。 こちらからアクセスしてください。

- 情報源: https://blog.quillhash.com/2023/04/03/beyond-the-hype-chatgpt-and-smart-contract-auditing/

- :は

- 2022

- a

- 能力

- 私たちについて

- アクセス

- 精度

- 達成する

- 後

- AI

- アラーム

- すべて

- 既に

- 間で

- および

- 回答

- 回答

- 離れて

- です

- 物品

- AS

- 側面

- 攻撃

- 監査

- 監査された

- 監査

- 監査役

- 監査

- バックボーン

- ベース

- BE

- になる

- 信じる

- BEST

- 越えて

- ビッグ

- ビット

- ブログ

- 画期的な

- バグ

- バグ

- by

- 計算

- コール

- 呼ばれます

- コール

- 缶

- 機能

- 例

- 原因となる

- チャットボット

- AI言語モデルを活用してコードのデバッグからデータの異常検出まで、

- チェック

- 到来

- コマンドと

- 伝える

- コンプリート

- 記入済みの

- 完全に

- 複雑さ

- 続ける

- 縮小することはできません。

- 契約

- コントロール

- 会話

- カバレッジ

- 作ります

- 重大な

- 重大な

- サイバー

- サイバーセキュリティ

- データ

- 取引

- DeFi

- 依存

- 設計

- 開発者

- 対話

- DID

- 異なります

- 発見

- 話し合います

- 議論する

- 議論

- 疑い

- 間に

- 簡単に

- 効果的な

- 有効

- 十分な

- 確保

- 本質的な

- 誰も

- 正確に

- 実行

- 期待する

- 搾取

- 外部

- フェイル

- FRBは

- フィードバック

- もう完成させ、ワークスペースに掲示しましたか?

- 発見

- 企業

- 名

- 発見

- から

- フロント

- function

- 機能

- 賭博

- 取得する

- 与える

- Go

- ハック

- ハンドル

- 持ってる

- ヘビー

- 助けます

- ことができます

- 認定条件

- しかしながら

- HTTPS

- 巨大な

- 人間

- 人間

- 誇大広告

- i

- 識別する

- 実装

- 実装

- 改善します

- 改善されました

- 改善

- in

- 含めて

- 有益な

- インフラ関連事業

- 相互作用的

- 相互接続

- インターネット

- 問題

- IT

- ITS

- キープ

- 打ち上げ

- 層

- つながる

- 主要な

- LEARN

- 学習

- 可能性が高い

- 論理的な

- 長い

- 見て

- 損失

- たくさん

- 機械

- 主流

- 主流メディア

- make

- マニュアル

- 多くの

- 大衆

- math

- 数学的

- 問題

- メディア

- ミーム

- ミス

- 他には?

- 最も

- 11月

- of

- on

- ONE

- その他

- 過去

- のワークプ

- 完璧

- プラトン

- プラトンデータインテリジェンス

- プラトデータ

- 可能性

- 投稿

- 潜在的な

- 電力

- 前

- 問題

- プロジェクト

- プロジェクト(実績作品)

- 適切な

- 正しく

- 提案された

- プロトコル

- 証明

- 提供します

- 質問

- クイルハッシュ

- 隆起した

- 現実

- 受け取ります

- 関係

- リリース

- 顕著

- 繰り返し

- レポート

- レポート

- 要件

- 応答

- 結果

- return

- 収益

- ルーム

- 安全性

- シナリオ

- 二番

- セクター

- 安全に

- セキュア

- セキュリティ

- と思われる

- センス

- 敏感な

- サービス

- すべき

- 重要

- スマート

- スマート契約

- スマートコントラクトセキュリティ

- スマート契約

- 賢い

- So

- 社会

- ソーシャルメディア

- 一部

- ソース

- 特定の

- start

- 開始

- 統計的

- まだ

- ストーム

- そのような

- 確かに

- 驚きました

- 取る

- 取り

- Talk

- チーム

- test

- テスト

- それ

- プロジェクト

- 世界

- それら

- ボーマン

- 物事

- 介して

- 時間

- <font style="vertical-align: inherit;">回数</font>

- 〜へ

- ツール

- 豊富なツール群

- 訓練された

- トレーニング

- 信頼

- 根本的な

- 予期しない

- ユニーク

- us

- つかいます

- ユーザー

- users

- 価値観

- さまざまな

- 動画

- 脆弱性

- 脆弱性

- 仕方..

- Web3

- ウェブサイト

- WELL

- 周知

- この試験は

- かどうか

- which

- 意志

- 以内

- 無し

- 世界

- でしょう

- You

- あなたの

- ゼファーネット