ユーザーデータ: LLM の重要な食品

はい! RT @ブライス この言葉が大好きです。「お金を払わないなら、あなたは顧客ではありません。お金を払わないのなら、あなたは顧客ではありません。」あなたは販売されている商品なのです。」 http://bit.ly/93JYCJ

— ティム・オライリー (@timoreilly) 2010 年 9 月 2 日

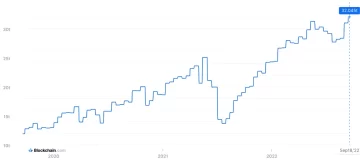

暗号ニュースを常に把握し、受信トレイで毎日更新を入手してください。

- SEO を活用したコンテンツと PR 配信。 今日増幅されます。

- PlatoData.Network 垂直生成 Ai。 自分自身に力を与えましょう。 こちらからアクセスしてください。

- プラトアイストリーム。 Web3 インテリジェンス。 知識増幅。 こちらからアクセスしてください。

- プラトンESG。 カーボン、 クリーンテック、 エネルギー、 環境、 太陽、 廃棄物管理。 こちらからアクセスしてください。

- プラトンヘルス。 バイオテクノロジーと臨床試験のインテリジェンス。 こちらからアクセスしてください。

- 情報源: https://decrypt.co/211846/anthropic-says-it-wont-use-your-private-data-to-train-its-ai

- :持っている

- :は

- :not

- 7

- 8

- a

- 能力

- 絶対の

- 従った

- 正確な

- 適応する

- アドレッシング

- 追加

- 高度な

- 前

- 同意する

- AI

- AIサービス

- AIシステム

- 目指して

- アレクサ

- 整列

- すべて

- ことができます

- また

- 常に

- Amazon

- an

- および

- 人間原理

- 予想する

- どれか

- 適用可能な

- です

- AS

- 引き受けます

- At

- 利用できます

- 回避

- 知って

- ベース

- BE

- なぜなら

- さ

- 信じて

- 有益な

- より良いです

- の間に

- by

- 缶

- クレーム

- クライアント

- コマーシャル

- コミットメント

- コミットする

- 企業

- 会社

- 競争力のある

- コンセプト

- 懸念事項

- 絶えず

- コンテンツ

- コンテキスト

- 継続的に

- コントロール

- 便利

- 会話

- 著作権

- 可能性

- 重大な

- クリプト

- 暗号ニュース

- 電流プローブ

- 顧客

- Customers

- daily

- 暗いです

- データ

- データプライバシー

- 議論

- 数十年

- 解読する

- 深いです

- 深い学習

- デフォルト

- ディフェンディング

- 配信する

- 依存

- 否認する

- 紛争

- 多様性

- do

- ドキュメント

- ありません

- ドル

- ドント

- 間に

- 収益

- エッジ(Edge)

- 有効

- どちら

- 婚約

- 強化

- 確実に

- 本質的な

- 倫理的な

- 倫理

- 例

- 交換

- 体験

- 広範囲

- エクステント

- 外部

- 向い

- 前者

- 設立

- 無料版

- から

- 獲得

- 生成する

- 生成された

- 生成

- 生々しい

- 生成AI

- 取得する

- 受け

- 巨人

- 与える

- Go

- 助成金

- 把握

- 育ちます

- 重く

- 正直な

- 名誉

- しかしながら

- HTTP

- HTTPS

- 人間

- 理想

- if

- 改善します

- in

- 個人

- 情報

- 知的

- 知的財産

- 意図

- 相互作用

- 内部

- IP

- IT

- ITS

- 自体

- キー

- 言語

- 大

- 最新の

- 法律

- つながる

- LEARN

- 学習

- リーガルポリシー

- 活用します

- ような

- ラマ

- LLM

- 愛

- make

- 作成

- 五月..

- メディア

- Meta

- 何百万

- モデル

- 他には?

- 最も

- ネットワーク

- ニューラル

- ニューラルネットワーク

- 新作

- ニュース

- 入手

- of

- on

- OpenAI

- or

- 表向き

- さもないと

- 私たちの

- でる

- outputs

- が

- 自分の

- 所有する

- 支払われた

- パーティー

- パーティー

- パターン

- 支払う

- 支払い

- 個人的な

- 個人化

- カスタマイズ

- 写真

- プラトン

- プラトンデータインテリジェンス

- プラトデータ

- 方針

- 潜在的な

- 電力

- 強力な

- プラクティス

- 予測する

- 予測

- プ

- 流行している

- プライバシー

- プライベート

- 生産された

- プロダクト

- プロンプト

- 財産

- 提供します

- は、大阪で

- 公共

- 公共の信頼

- 公然と

- 率

- レーシング

- RE

- 現実の世界

- 受け取り

- リファイン

- 見なす

- 相対

- リリース

- 関連した

- 報告

- リクエスト

- 研究者

- 責任

- 明らかに

- 権利

- ライバル

- rt

- Ryan Tan

- s

- 言う

- 言う

- シーン

- サービス

- サービス

- セッションに

- シェアする

- すべき

- 懐疑

- So

- 社会

- ソーシャルメディア

- 売ら

- スペル

- スポークスパーソン

- スタートアップ

- ステートメント

- 滞在

- 手順

- システム

- タンデム

- テク

- ハイテク巨人

- テクニック

- 条件

- 클라우드 기반 AI/ML및 고성능 컴퓨팅을 통한 디지털 트윈의 기초 – Edward Hsu, Rescale CPO 많은 엔지니어링 중심 기업에게 클라우드는 R&D디지털 전환의 첫 단계일 뿐입니다. 클라우드 자원을 활용해 엔지니어링 팀의 제약을 해결하는 단계를 넘어, 시뮬레이션 운영을 통합하고 최적화하며, 궁극적으로는 모델 기반의 협업과 의사 결정을 지원하여 신제품을 결정할 때 데이터 기반 엔지니어링을 적용하고자 합니다. Rescale은 이러한 혁신을 돕기 위해 컴퓨팅 추천 엔진, 통합 데이터 패브릭, 메타데이터 관리 등을 개발하고 있습니다. 이번 자리를 빌려 비즈니스 경쟁력 제고를 위한 디지털 트윈 및 디지털 스레드 전략 개발 방법에 대한 인사이트를 나누고자 합니다.

- それ

- アプリ環境に合わせて

- それら

- ボーマン

- 彼ら

- この

- ティム

- 〜へ

- 今日

- top

- トレーニング

- 訓練された

- トレーニング

- 透明性

- トレンド

- 信頼

- 下

- わかる

- 理解する

- 今後の

- 更新しました

- 更新版

- アップグレード

- アップロード

- つかいます

- 中古

- ユーザー

- users

- 貴重な

- さまざまな

- バージョン

- 動画

- 極めて重要な

- ボイス

- ボリューム

- ました

- we

- した

- いつ

- かどうか

- which

- なぜ

- 意志

- Word

- でしょう

- You

- あなたの

- ゼファーネット