バッチ推論は、予測リクエストが入力時にまとめてバッチ処理され、ジョブが実行されてトレーニング済みモデルに対してそれらのリクエストを処理し、出力にバッチ予測レスポンスが含まれており、それを他のアプリケーションやビジネス機能で使用できる一般的なパターンです。 本番環境でバッチ ユース ケースを実行するには、モデルの再トレーニングとバッチ推論のための反復可能なプロセスが必要です。 そのプロセスには、そのモデルを監視して、時間の経過に伴うパフォーマンスを測定することも含まれる必要があります。

この投稿では、バッチ ユース ケース用に反復可能なパイプラインを作成する方法を示します。 AmazonSageMakerパイプライン, Amazon SageMaker モデルレジストリ, SageMakerバッチ変換ジョブ, Amazon SageMakerモデルモニター. このソリューションは、完全に管理された機能を使用する機能を強調しています SageMaker MLOps 完全に管理され統合された機能により、運用上のオーバーヘッドを削減します。

ソリューションの概要

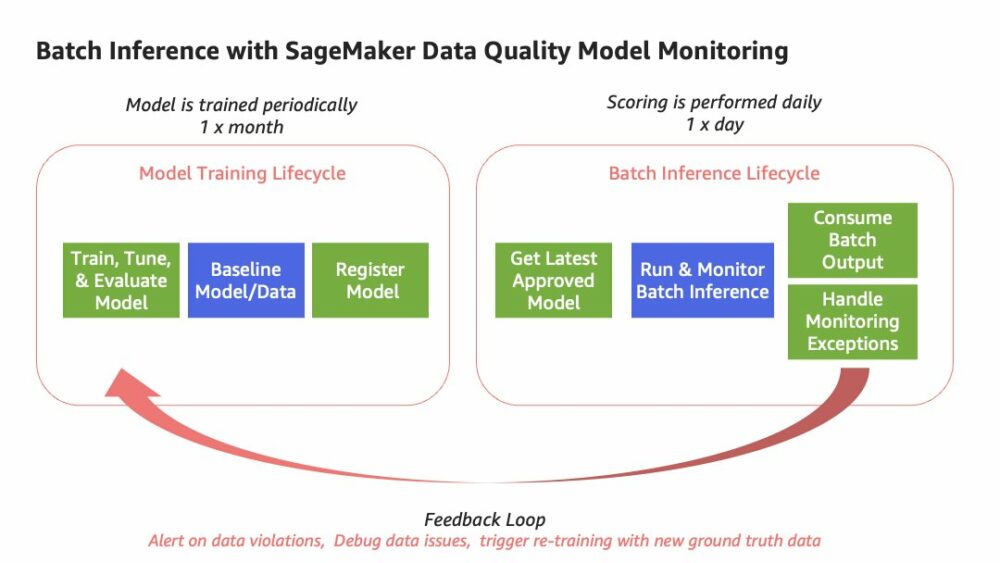

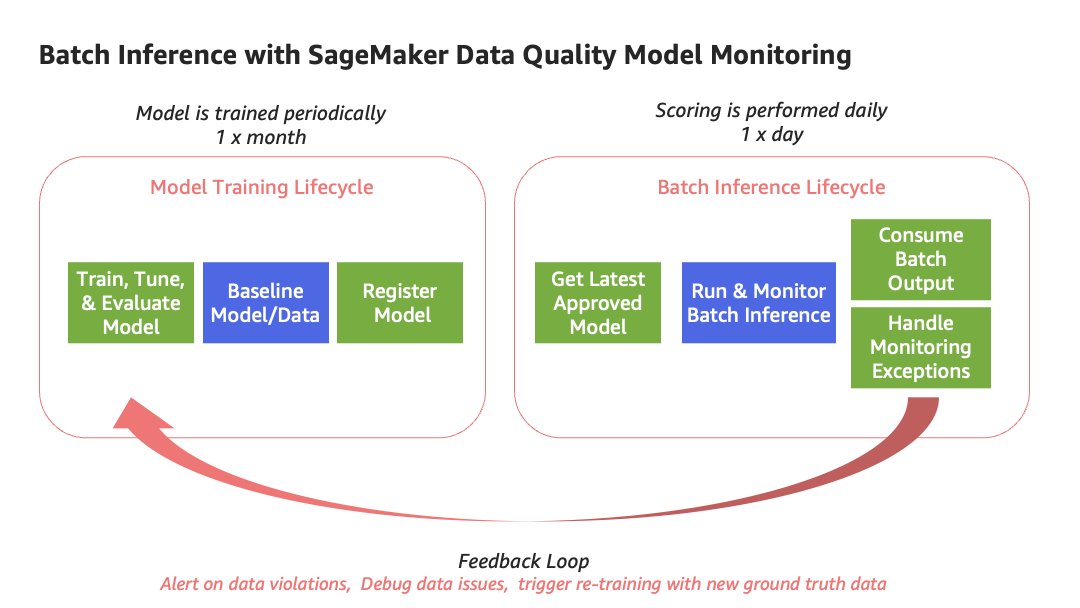

バッチ推論を実行するシナリオは複数あります。 場合によっては、バッチ推論を実行するたびにモデルを再トレーニングすることがあります。 または、バッチ推論を実行するよりもモデルをトレーニングする頻度が低い場合があります。 この投稿では、XNUMX 番目のシナリオに焦点を当てます。 この例では、月に約 XNUMX 回、定期的にトレーニングされるモデルがあるとします。 ただし、バッチ推論は、最新のモデル バージョンに対して毎日実行されます。 これは、モデル トレーニングのライフサイクルがバッチ推論のライフサイクルとは異なる一般的なシナリオです。

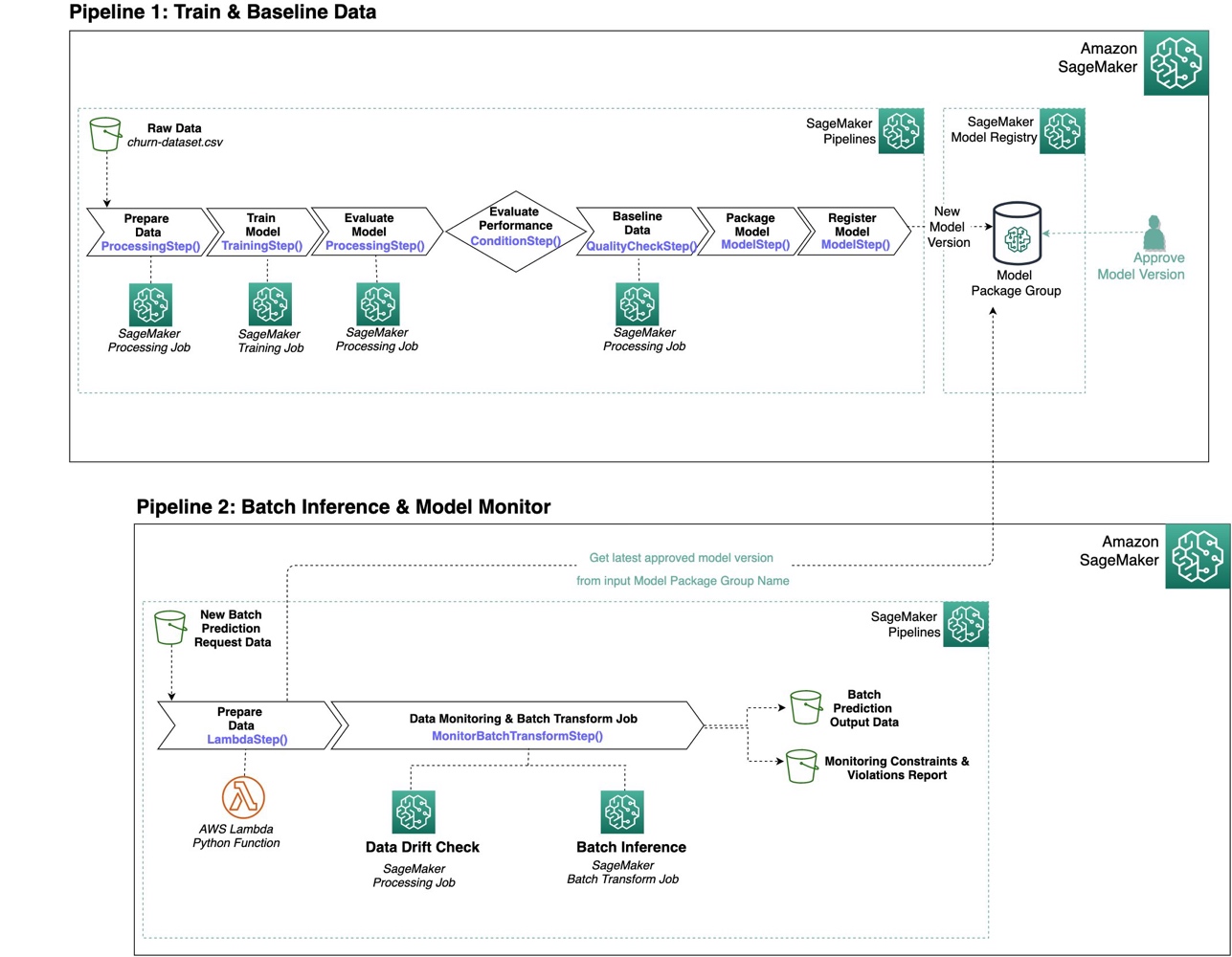

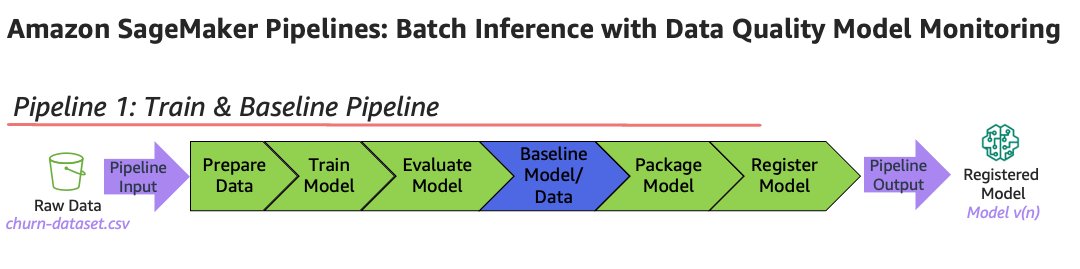

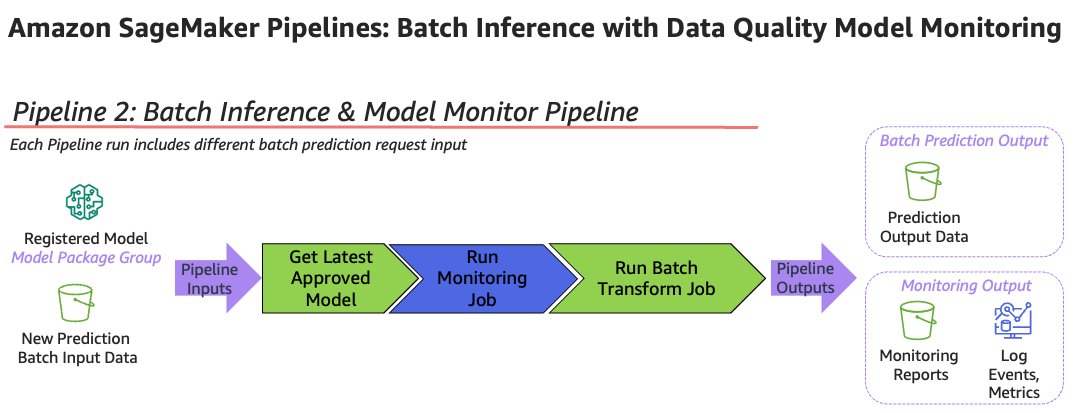

導入されたバッチ シナリオをサポートするアーキテクチャには、次の図に示すように、XNUMX つの個別の SageMaker パイプラインが含まれています。

最初のパイプラインを使用してモデルをトレーニングし、トレーニング データのベースラインを作成します。 生成されたベースラインは、XNUMX 番目のパイプラインでの継続的な監視に使用されます。 最初のパイプラインには、データの準備、モデルのトレーニング、モデルのパフォーマンスの評価に必要な手順が含まれています。 モデルが評価基準に従って適切に機能する場合、パイプラインは、組み込みの SageMaker Pipelines ステップを使用してデータのベースラインを作成するステップに進みます。 のために データドリフト モデルモニター ベースライン作成ステップでは、SageMaker が管理するコンテナ イメージを使用して、トレーニング データに基づいて統計と制約を生成します。 このベースラインは、バッチ推論中のデータ ドリフトのシグナルを監視するために使用されます。 最後に、新しいモデル バージョンが SageMaker モデル レジストリに登録されると、最初のパイプラインが完了します。 この時点で、モデルは自動的に承認されるか、またはモデル パフォーマンスのピア レビューおよびその他の特定された基準に基づいて手動で二次承認が必要になる場合があります。

XNUMX 番目のパイプラインでは、最初のステップでモデル レジストリに最新の承認済みモデル バージョンのクエリを実行し、データ監視ジョブを実行します。これにより、最初のパイプラインから生成されたデータ ベースラインが現在の入力データと比較されます。 パイプラインの最後のステップは、最新の承認済みモデルに対してバッチ推論を実行することです。

次の図は、各パイプラインのソリューション アーキテクチャを示しています。

データセットには、 合成データセット 通信事業者からこのサンプル データセットには 5,000 レコードが含まれており、各レコードは 21 の属性を使用して顧客プロファイルを記述しています。 最後の属性、 Churn、ML モデルに予測させたい属性です。 ターゲット属性はバイナリです。つまり、モデルは出力を XNUMX つのカテゴリのいずれかとして予測します (True or False).

以下 GitHubレポ 各パイプラインで実行されるステップを示すコードが含まれています。 初期セットアップの実行、モデル トレーニングとベースライン パイプラインの作成、バッチ推論とモデル モニター パイプラインの作成の XNUMX つのノートブックが含まれています。 リポジトリには、必要なアクセス許可を設定するために、セットアップ ノートブックで使用されるヘルパー関数を含む追加の Python ソース コードも含まれています。

前提条件

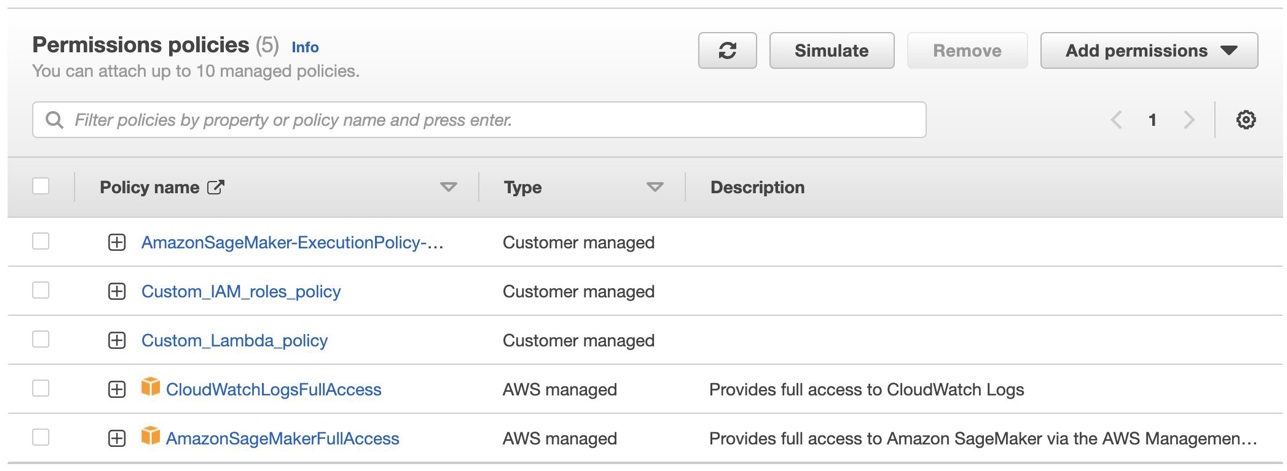

次のスクリーンショットは、ワークフローの SageMaker 実行ロールに必要ないくつかのアクセス許可ポリシーを示しています。 これらのアクセス許可ポリシーを有効にするには、 AWS IDおよびアクセス管理 (IAM) ロールのアクセス許可。

AmazonSageMaker-ExecutionPolicy-<...> SageMaker ユーザーに関連付けられた実行ロールであり、必要な Amazon シンプル ストレージ サービス (Amazon S3) バケット ポリシー。 Custom_IAM_roles_policy および Custom_Lambda_policy に必要なアクションをサポートするために作成された XNUMX つのカスタム ポリシーです。 AWSラムダ 関数。 XNUMX つのカスタム ポリシーを追加するには、IAM で適切なロール (SageMaker ユーザーに関連付けられている) に移動し、[ 権限を追加 その後 インラインポリシーを作成する。 Then, choose次に、 JSONの 内部 ポリシーを作成するで、最初のカスタム ポリシーのポリシー コードを追加し、ポリシーを保存します。 XNUMX 番目のカスタム ポリシーについても同じことを繰り返します。

0.セットアップ.ipynb は、ノートブック 1 および 2 を実行する前に必要な前提条件のノートブックです。コードは、パイプラインの入力、出力、およびモデル アーティファクトの S3 パスを設定し、パイプライン ステップ内で使用されるスクリプトをアップロードします。 このノートブックは、提供されているヘルパー関数の XNUMX つも使用します。 create_lambda_role、ノートブック 2 で使用される Lambda ロールを作成するには、 2.SageMakerPipeline-ModelMonitoring-DataQuality-BatchTransform.ipynb。 次のコードを参照してください。

セットアップ ノートブックのすべてのタスクを正常に完了したら、最初のパイプラインを構築して、モデルをトレーニングおよびベースライン化する準備が整います。

パイプライン 1: トレーニングとベースライン パイプライン

このセクションでは、モデルのトレーニングとベースライン化に使用される SageMaker パイプラインについて深く掘り下げます。 必要な手順とコードは 1.SageMakerPipeline-BaselineData-Train.ipynb ノート。 このパイプラインは、生の顧客離れデータを入力として受け取り、データの準備、モデルのトレーニング、モデルの評価、モデルのベースライン、モデル レジストリへのモデルの登録に必要な手順を実行します。

SageMaker パイプラインを構築するには、基礎となるジョブ (SageMaker Processing など) を構成し、ジョブを実行するパイプラインのステップを構成してから、パイプラインを構成して実行します。 次の手順を完了します。

- モデル ビルド パイプラインを構成して、データを準備し、モデルをトレーニングし、モデルを評価します。

- Model Monitor を使用して、データ ドリフトのベースライン ステップを構成します。

- モデルをパッケージ化し、モデル バージョンを登録する手順を構成します。

- モデルのパフォーマンスを評価する条件付きステップを構成します。

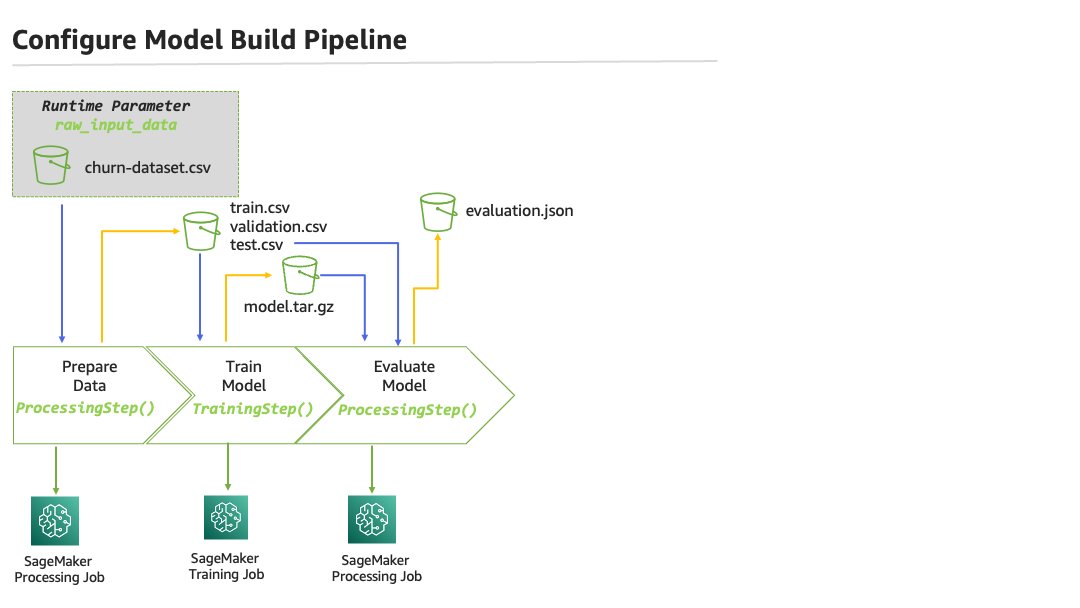

モデル ビルド パイプラインを構成する

モデル ビルド パイプラインは、次の XNUMX ステップのプロセスです。

- データを準備します。

- モデルをトレーニングします。

- モデルを評価します。

データを準備するには、データ処理ステップを構成します。 このステップでは、組み込みの 処理ステップ、トレーニングと評価のために入力に関する生データを準備します。

モデルをトレーニングするために、トレーニング ジョブ ステップを構成します。 このステップでは、組み込みの トレーニングステップ. このユース ケースでは、XGBoost を使用してバイナリ分類を実行します。 このステップの出力は、モデル アーティファクトです。 model.tar.gz、Amazon S3 に保存されます。

最後のステップでは、テスト ホールドアウト データセットを使用してモデルのパフォーマンスを評価します。 このステップでは組み込みの ProcessingStep 提供されたコードで、 evaluation.py、パフォーマンス指標 (精度、曲線下面積) を評価します。

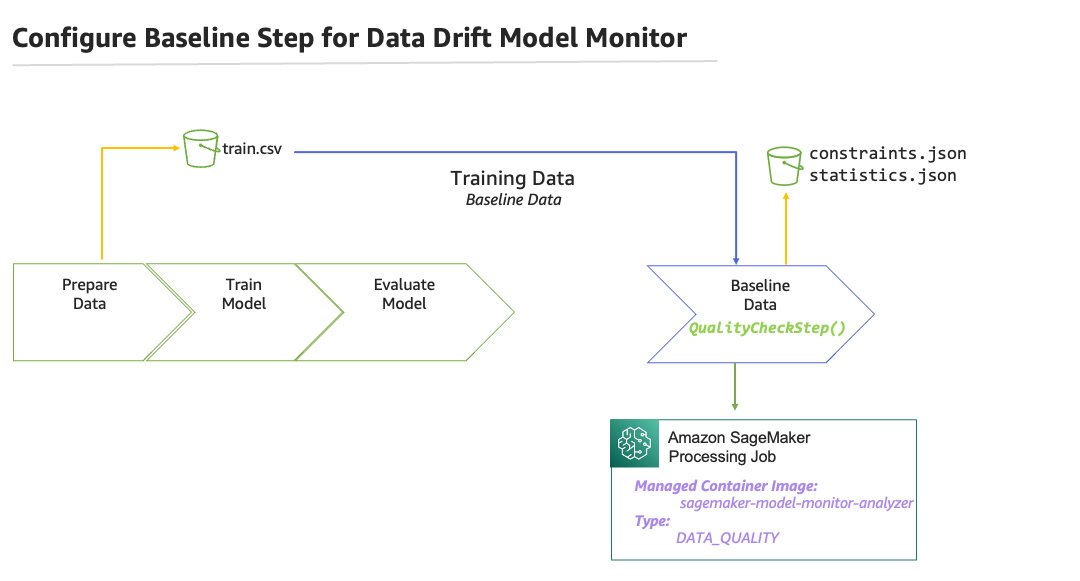

ベースライン ステップの構成

モデルとデータを監視するには、ベースラインが必要です。

データのドリフトを監視するには、トレーニング データのベースラインが必要です。 ベースライン ステップでは Pipelines のビルトインを使用 品質チェックステップ. このステップでは、Model Monitor のビルド済みコンテナ イメージを使用する SageMaker Processing ジョブが自動的に実行されます。 この同じコンテナー イメージをベースラインとモデルの監視に使用します。 ただし、このステップの構成中に使用されるパラメーターは、適切な動作を指示します。 この場合、データのベースラインを作成しているため、次のことを確認する必要があります。 quality_check_config パラメータが使用されています DataQualityCheckConfig、S3 の入力パスと出力パスを識別します。 設定も行っております register_new_baseline および skip_check 〜へ true. これらの値が両方とも true、SageMaker にこのステップをベースライン ジョブとして実行し、新しいベースラインを作成するように指示します。 SageMaker ビルド済みコンテナ イメージの動作を制御するパラメータをよりよく理解するには、以下を参照してください。 Amazon SageMaker モデル構築パイプラインの ClarifyCheck および QualityCheck ステップによるベースライン計算、ドリフト検出、およびライフサイクル.

次のコードを参照してください。

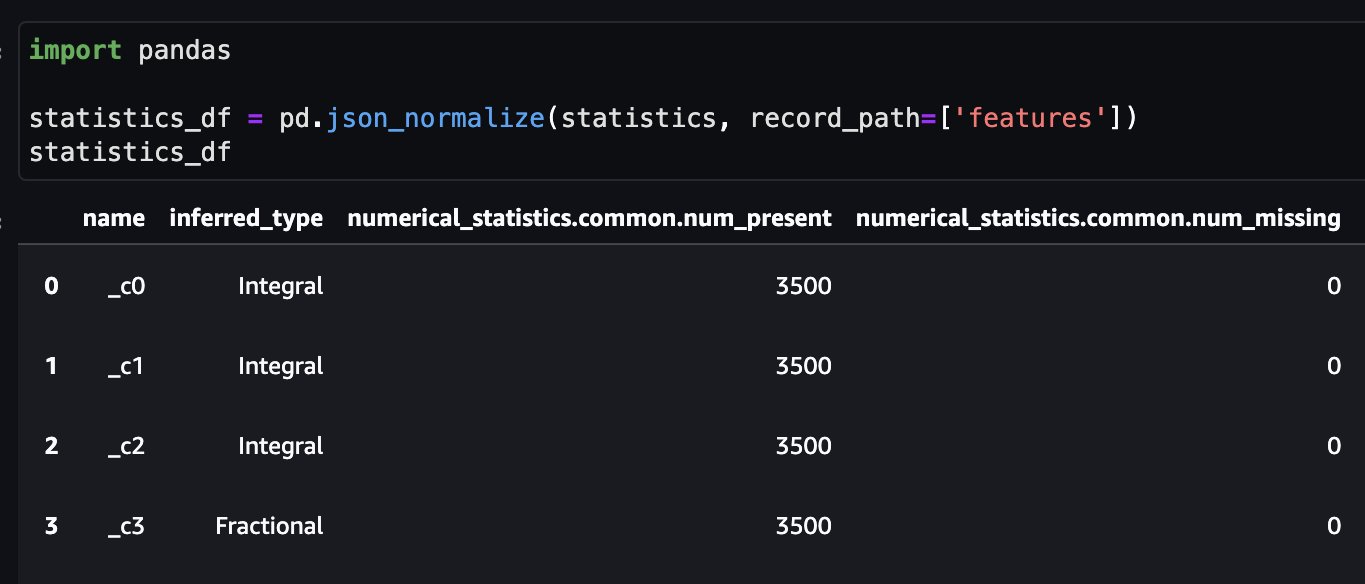

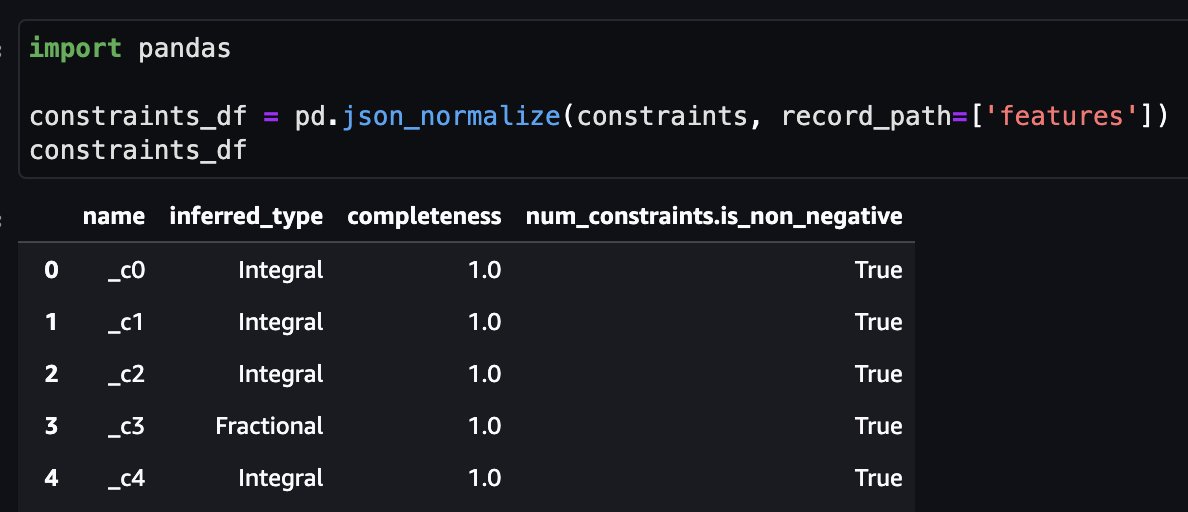

この手順により、出力として XNUMX つの JSON ファイルが生成されます。

- 統計.json – トレーニング データセットの各機能について計算された統計が含まれています

- constraint.json – 収集された統計に基づいてデータ制約を提案

これらの制約は変更することもでき、モデルの監視中にドリフトの信号を検出するために使用されます。

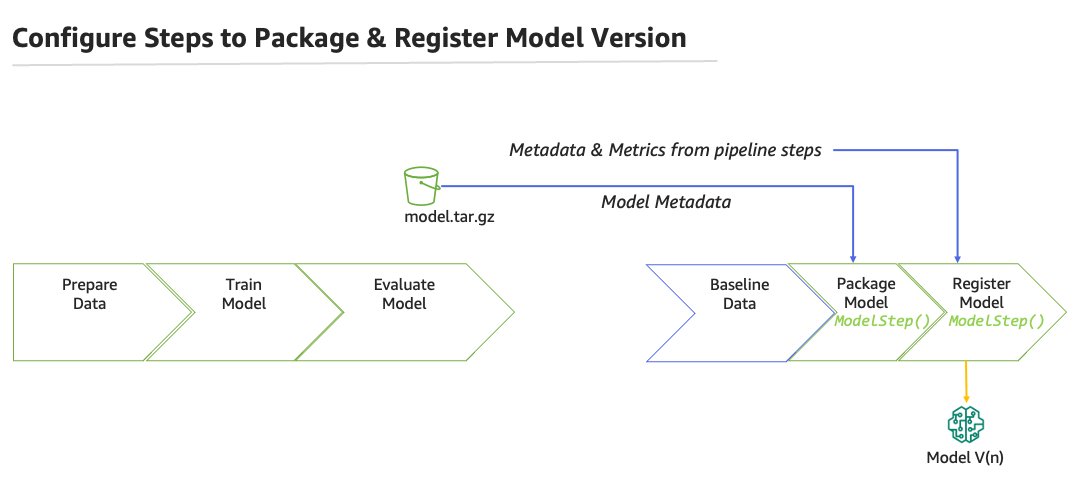

モデル バージョンをパッケージ化して登録する手順を構成する

次に、デプロイ用にパッケージ化するステップを構成し、XNUMX つの追加のパイプライン ステップを使用してモデル レジストリにモデルを登録します。

モデルのパッケージ化ステップは、SageMaker バッチ変換デプロイ オプションで使用するモデルをパッケージ化します。 model.create() モデル エンティティを作成します。これは、このモデル バージョン用に登録されたカスタム メタデータに含まれ、後でバッチ推論とモデル監視のために XNUMX 番目のパイプラインで使用されます。 次のコードを参照してください。

モデルの登録ステップでは、モデルのバージョンと関連するメタデータを SageMaker モデルレジストリに登録します。 これには、モデル パフォーマンス メトリクスとデータ ドリフト ベースラインのメタデータが含まれます。これには、ベースライン作成ステップで生成された統計および制約ファイルの Amazon S3 の場所が含まれます。 また、追加のカスタム メタデータが記載されていることにも気付くでしょう。 customer_metadata_properties 後で推論パイプラインで使用されるモデル エンティティ情報をプルします。 モデルレジストリ内でカスタムメタデータを提供する機能は、ネイティブの SageMaker パラメータで明示的に定義されていない、収集する必要がある追加のメタデータを組み込む優れた方法です。 次のコードを参照してください。

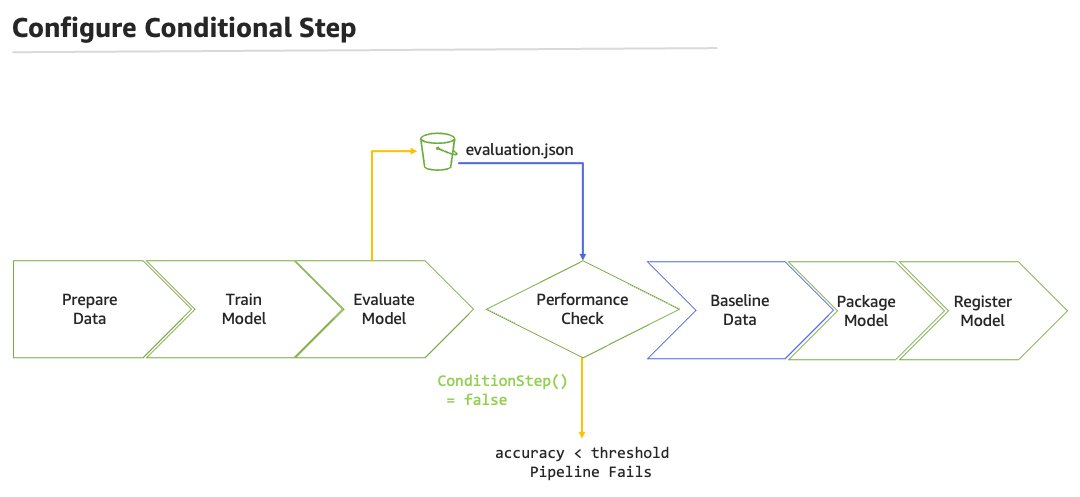

モデルのパフォーマンスを評価するための条件付きステップを構成する

条件付きステップ、 条件ステップ、モデルの精度を識別されたしきい値と比較し、トレーニング済みモデルの品質をチェックします。

それは、 evaluation.json ファイルを作成し、モデルの精度、または最適化する目的の指標が、定義した基準を満たしているかどうかを確認します。 この場合、基準は次のいずれかを使用して定義されます。 組み込み条件, ConditionGreaterThanOrEqualTo. 条件が満たされた場合、パイプラインは引き続きデータのベースラインを作成し、パイプラインで後続のステップを実行します。 条件が満たされない場合、パイプラインは停止します。 条件はパイプラインの次のステップを明示的に呼び出すため、条件付きステップを構成する前に、これらのステップが構成されていることを確認する必要があります。 次のコードを参照してください。

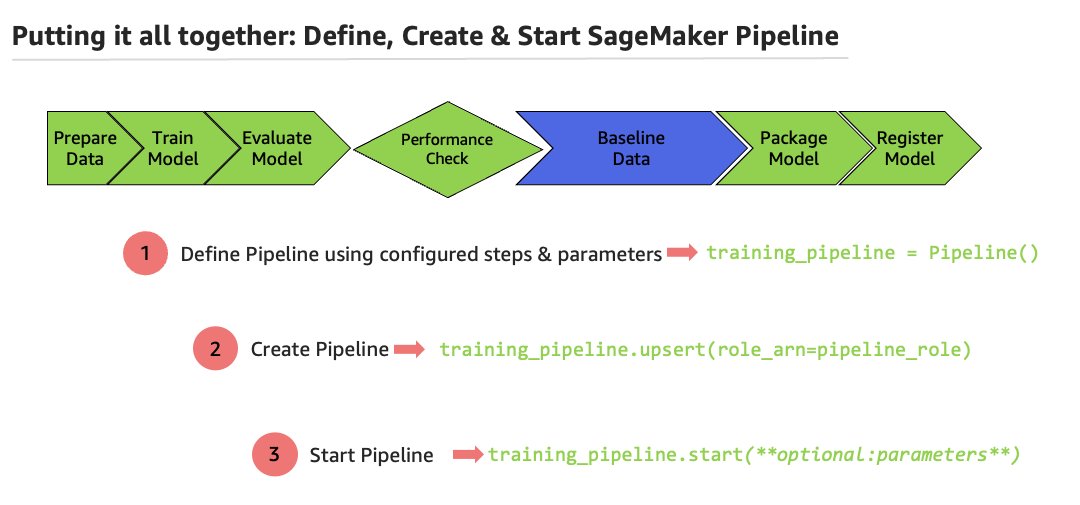

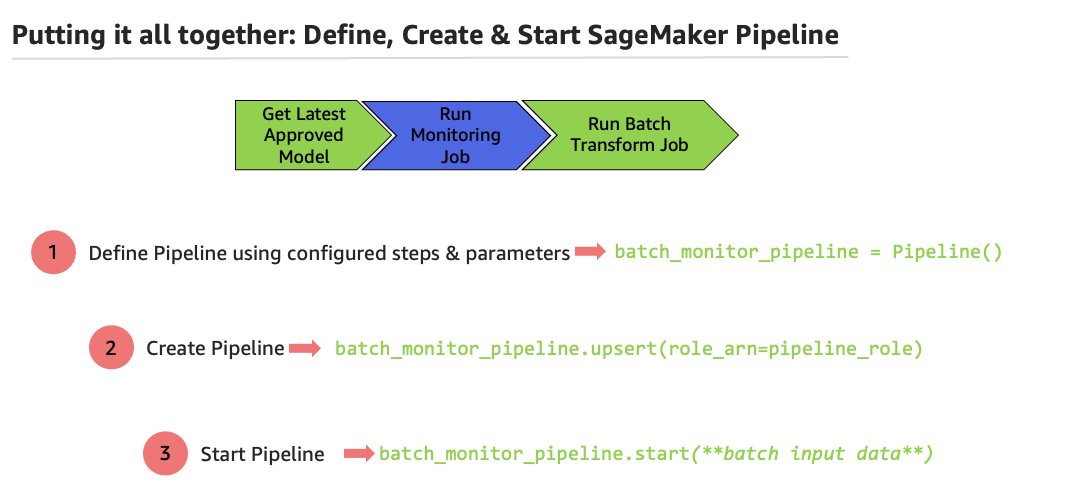

SageMaker パイプラインを定義、作成、開始する

この時点で、トレーニングとベースライン パイプラインのすべてのステップが定義され、構成されています。 次に、パイプラインを定義、作成、および開始します。

まず、パイプラインを定義します。 パイプライン()、パイプライン名と、パイプラインに含めるように以前に構成されたステップのリストを提供します。 次に、パイプラインを作成します training_pipeline.upsert(). 最後に、パイプラインを開始します training_pipeline.start()。 次のコードを参照してください。

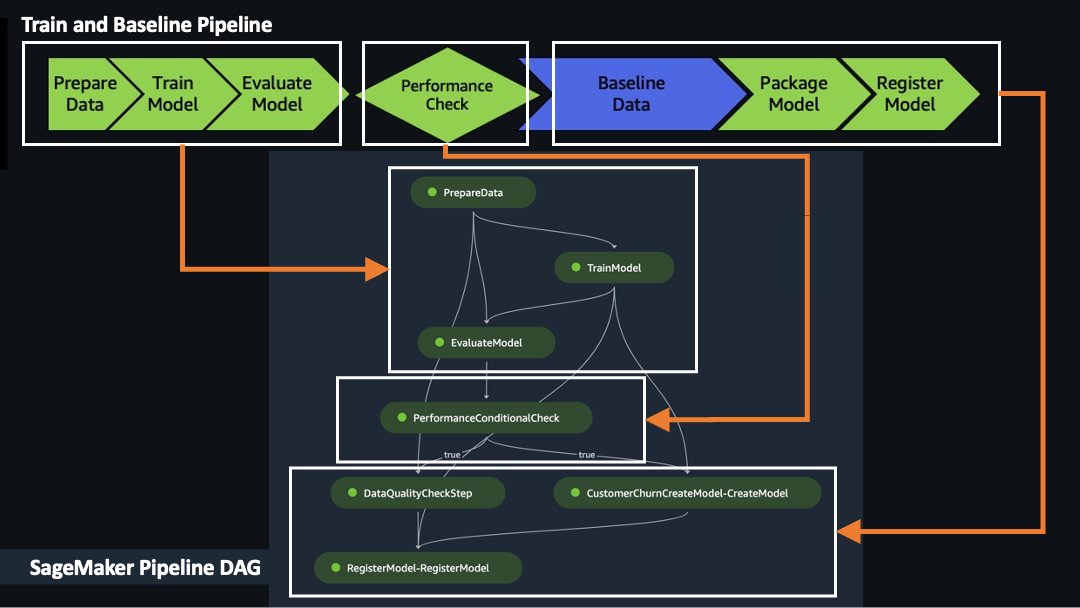

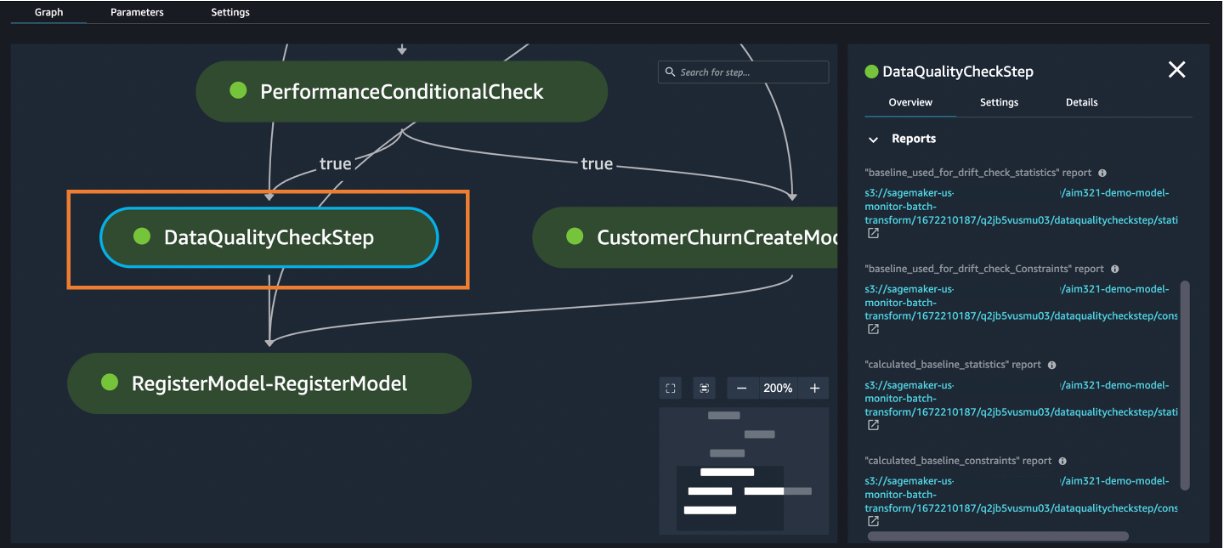

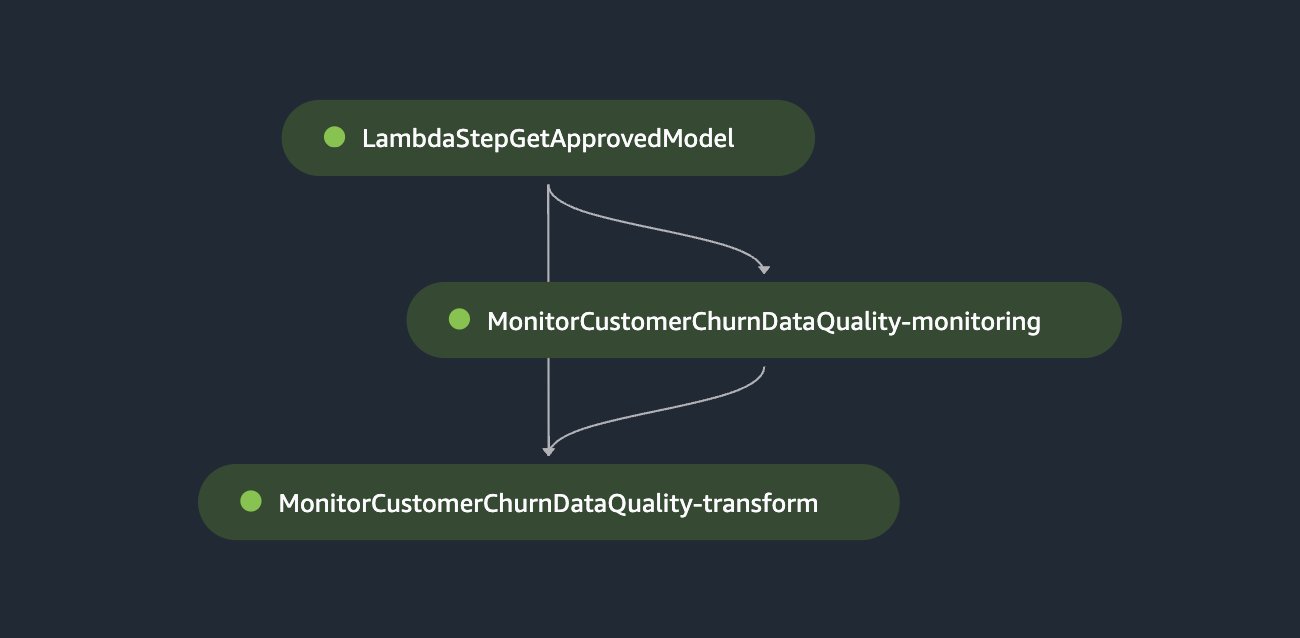

パイプラインの実行が開始されると、Studio でそのステータスを視覚化できます。 次の図は、パイプライン プロセスのどのステップが、パイプライン有向非巡回グラフ (DAG) のステップに関連しているかを示しています。 トレーニングとベースライン パイプラインが正常に実行されると、トレーニング済みのモデルがモデル グループの一部としてモデル レジストリに登録されます。 パイプラインは現在、手動承認が必要な保留状態でモデルを登録するように設定されています。 必要に応じて、モデル登録ステップを構成して、モデル レジストリでモデルを自動的に承認することができます。 XNUMX 番目のパイプラインは、推論のためにレジストリから最新の承認済みモデルをプルします。

Studio では、任意のステップを選択して、その主要なメタデータを表示できます。 例として、パイプライン DAG 内のデータ品質チェック ステップ (ベースライン ステップ) は、 statistics.json および constraints.json セクションに レポート セクション。 これらは、ベースラインとして使用される生データから計算された主要なファイルです。

パイプラインが実行された後、次のスクリーンショットに示すように、データ品質監視のベースライン (統計と制約) を調べることができます。

パイプライン 2: バッチ推論とモデル モニター パイプライン

このセクションでは、SageMaker Pipelines を使用して、新しいバッチ入力データのデータ ドリフトのシグナルを監視し、バッチ推論を実行するために使用される XNUMX 番目のパイプラインについて詳しく説明します。 必要な手順とコードは次のとおりです。 2.SageMakerPipeline-ModelMonitoring-DataQuality-BatchTransform.ipynb. このパイプラインには、次の手順が含まれます。

- モデル レジストリから最新の承認されたモデル バージョンと関連するメタデータを取得する Lambda ステップ。

- 新しい入力データとパイプライン 1 からのベースラインを使用して、データ ドリフトの信号を検出するモデル モニターのステップ。

- 最新の承認済みモデルに対してバッチ入力データを処理するためのバッチ変換ステップ。

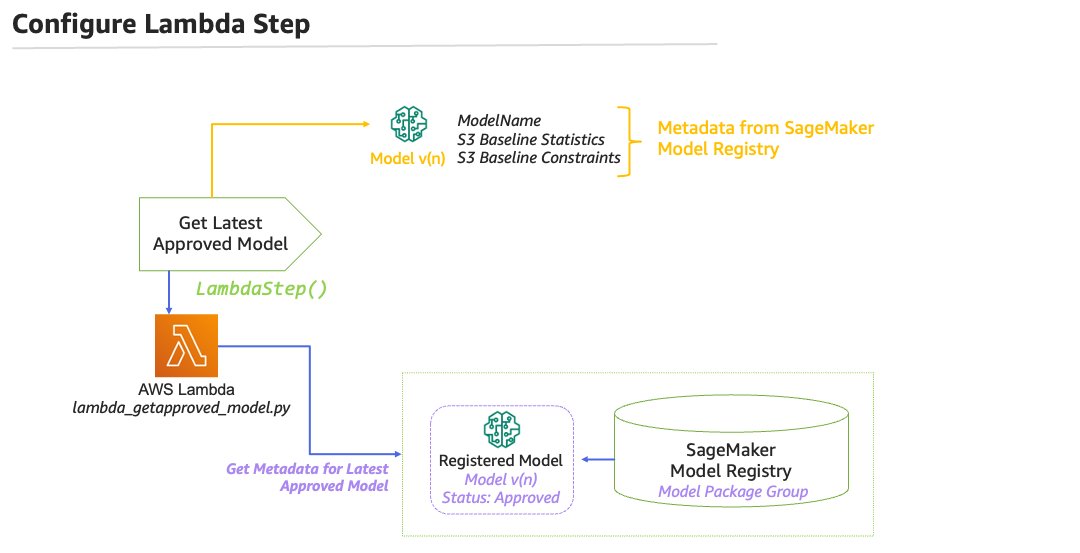

Lambda ステップを設定する

モデルの監視とバッチ変換ジョブを開始する前に、モデル レジストリにクエリを実行して、バッチ推論に使用する最新の承認済みモデルを取得する必要があります。

これを行うには、パイプライン内にカスタム ロジックを含めることができる Lambda ステップを使用します。 の lambda_getapproved_model.py Lambda 関数は、入力で提供された特定のモデル パッケージ グループについて SageMaker モデル レジストリにクエリを実行し、承認された最新のモデル バージョンを識別し、関連するメタデータを返します。 出力には、最初のパイプラインから作成されたメタデータが含まれます。

- モデルパッケージ ARN

- 同梱品名

- 統計ベースラインの S3 URI

- 制約ベースラインの S3 URI

出力はパイプラインの次のステップで入力として使用され、最新の承認済みモデルを使用してバッチ監視とスコアリングが実行されます。

SageMaker パイプラインの一部として Lambda 関数を作成して実行するには、関数を ラムダステップ パイプライン内:

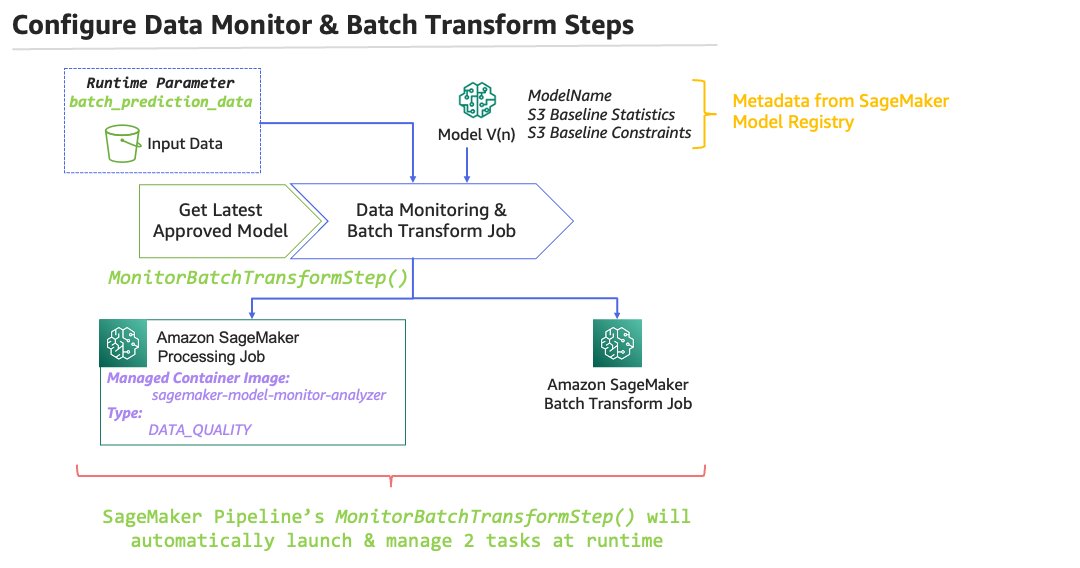

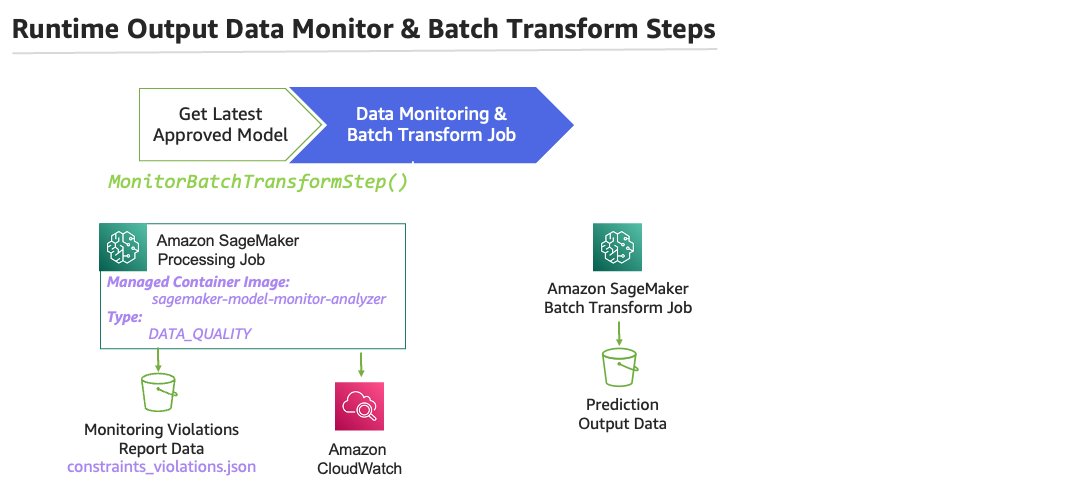

データ モニターとバッチ変換の手順を構成する

最新の承認済みモデルを取得するための Lambda ステップを作成したら、次を作成できます。 モニターバッチ変換ステップ. このネイティブ ステップは、連続して実行される 1 つの子タスクを調整および管理します。 最初のタスクには、バッチ入力データを監視し、パイプライン XNUMX から以前に生成されたベースラインの制約と比較するために使用される組み込みコンテナー イメージを使用して処理ジョブを実行するモデル モニター ジョブが含まれます。モデル レジストリで承認された最新のモデルに対して入力データを処理するバッチ変換ジョブ。

このバッチ展開とデータ品質モニタリングのステップでは、入力時にバッチ予測入力データの S3 URI を取得します。 これは、パイプラインの実行ごとに新しい入力データセットを含めることができるようにパラメーター化されています。 次のコードを参照してください。

次に、バッチ予測リクエストを処理するバッチ変換ジョブのトランスフォーマーを構成する必要があります。 次のコードでは、モデル レジストリのカスタム メタデータから取得したモデル名と、その他の必須パラメーターを渡します。

データ品質モニターは、パイプラインの実行中にデータ品質監視ジョブを実行するために、モデル レジストリから最新の承認されたモデル バージョンのベースライン統計と制約の S3 URI を受け入れます。 このジョブは、バッチ予測入力データをベースライン データと比較して、潜在的なデータ ドリフトを示す違反を特定します。 次のコードを参照してください。

次に、 モニターバッチ変換ステップ 変換ジョブを実行および監視します。 このステップでは、構成したトランスフォーマー オブジェクトを使用してバッチ変換ジョブを実行し、ジョブを実行する前にトランスフォーマーに渡されたデータを監視します。

必要に応じて、データ品質に対する違反が見つかった場合に失敗するようにステップを構成できます。 fail_on_violation フラグを立てる False.

次のコードを参照してください。

パイプラインを定義、作成、開始する

を定義した後、 LambdaStep および MonitorBatchTransformStep、SageMaker パイプラインを作成できます。

次のコードを参照してください。

これで、 upsert() このメソッドは、指定した構成で SageMaker パイプラインを作成または更新します。

SageMaker パイプラインを開始するには複数の方法がありますが、パイプラインが作成されたら、 start() 方法。

の順序であることに注意してください。 LambdaStep 承認済みモデルを正常に取得するには、パイプライン 1 の一部として登録されたモデルが承認済みステータスである必要があります。 これは Studio または Boto3 を使用して実行できます。 参照する モデルの承認ステータスを更新する 。

スケジュールに従って、またはイベントに基づいて SageMaker パイプラインを実行するには、以下を参照してください。 Amazon EventBridge でパイプラインをスケジュールします。

モデル モニター レポートを確認する

Model Monitor は、以下を実行する SageMaker Processing ジョブを使用します。 DataQuality ベースラインの統計と制約を使用してチェックします。 の DataQuality 処理ジョブは違反レポートを Amazon S3 に送信し、ログ データも送信します。 Amazon CloudWatchログ 対応する処理ジョブのログ グループの下。 クエリのサンプル コード アマゾンクラウドウォッチ ログはノートブックで提供されます。

モデルのトレーニングとベースラインを作成するための最初のパイプラインと、バッチ推論とモデルの監視を実行するための XNUMX 番目のパイプラインを作成する方法について説明しました。 これにより、トレーニングと推論の間の異なるライフサイクルを組み込みながら、両方のパイプラインを自動化できます。

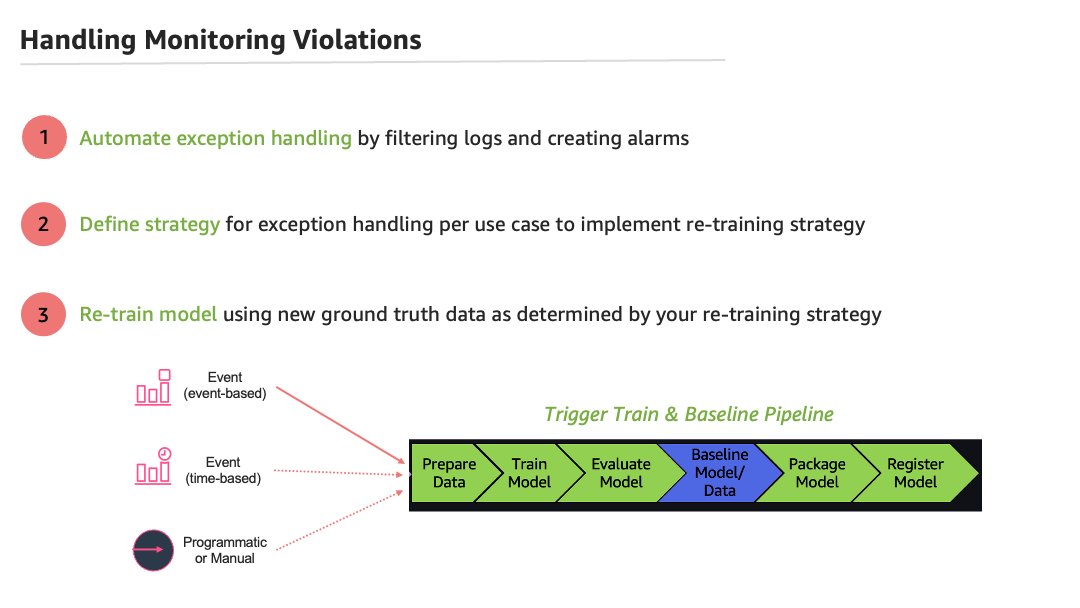

この参照パターンをさらに成熟させるには、フィードバック ループの戦略を特定し、主要な関係者間でドリフトの潜在的なシグナルを認識して可視化することができます。 少なくとも、ログをフィルタリングしてアラームを作成することにより、例外処理を自動化することをお勧めします。 これらのアラームには、データ サイエンティストによる追加の分析が必要になる場合があります。または、モデル トレーニングとベースライン パイプラインを アマゾンイベントブリッジ。 詳細については、を参照してください。 Amazon EventBridge の統合.

クリーンアップ

ベースラインおよびバッチ監視パイプラインを実行した後、SageMaker コンソールを介してプログラムで、または Studio を介して、使用されないリソースを必ずクリーンアップしてください。 さらに、Amazon S3 のデータを削除し、追加料金が発生しないように Studio ノートブック インスタンスを停止してください。

まとめ

この投稿では、パイプライン、モデルレジストリ、モデルモニターなどの SageMaker MLOps 機能を使用して、トレーニングされたモデルに対してバッチ推論が実行される頻度よりも少ない頻度でトレーニングされるバッチモデルのソリューションを作成する方法を学びました。 このソリューションを拡張するには、標準化された MLOps テンプレートを使用して、CI/CD と自動トリガーも組み込んだカスタム SageMaker プロジェクトにこれを組み込むことができます。 このデモで示されているソリューションとコードをさらに深く掘り下げるには、 GitHubレポ. また、参照してください。 MLOps用のAmazonSageMaker SageMaker を使用した MLOps プラクティスの実装に関連する例については、

著者について

シェルビーアイゲンブロード アマゾンウェブサービス(AWS)のプリンシパルAIおよび機械学習スペシャリストソリューションアーキテクトです。 彼女は24年間、複数の業界、テクノロジー、および役割にまたがるテクノロジーに携わってきました。 彼女は現在、DevOpsとMLのバックグラウンドをMLOpsのドメインに組み合わせて、顧客がMLワークロードを大規模に提供および管理できるようにすることに注力しています。 さまざまなテクノロジードメインで35を超える特許が付与されており、継続的なイノベーションとデータを使用してビジネスの成果を推進することに情熱を注いでいます。 Shelbeeは、Courseraの実用的なデータサイエンス専門分野の共同作成者およびインストラクターです。 彼女はまた、デンバー支部のビッグデータ(WiBD)の女性の共同ディレクターでもあります。 暇なときは、家族や友達、過激な犬と過ごすのが好きです。

シェルビーアイゲンブロード アマゾンウェブサービス(AWS)のプリンシパルAIおよび機械学習スペシャリストソリューションアーキテクトです。 彼女は24年間、複数の業界、テクノロジー、および役割にまたがるテクノロジーに携わってきました。 彼女は現在、DevOpsとMLのバックグラウンドをMLOpsのドメインに組み合わせて、顧客がMLワークロードを大規模に提供および管理できるようにすることに注力しています。 さまざまなテクノロジードメインで35を超える特許が付与されており、継続的なイノベーションとデータを使用してビジネスの成果を推進することに情熱を注いでいます。 Shelbeeは、Courseraの実用的なデータサイエンス専門分野の共同作成者およびインストラクターです。 彼女はまた、デンバー支部のビッグデータ(WiBD)の女性の共同ディレクターでもあります。 暇なときは、家族や友達、過激な犬と過ごすのが好きです。

ソビック・クマール・ナス AWS の AI/ML ソリューション アーキテクトです。 彼は、機械学習、財務分析、運用分析、およびマーケティング分析におけるビジネス分析の設計とソリューションの経験があります。 健康管理; サプライチェーン; そしてIoT。 仕事以外では、Sovik は旅行や映画鑑賞を楽しんでいます。

ソビック・クマール・ナス AWS の AI/ML ソリューション アーキテクトです。 彼は、機械学習、財務分析、運用分析、およびマーケティング分析におけるビジネス分析の設計とソリューションの経験があります。 健康管理; サプライチェーン; そしてIoT。 仕事以外では、Sovik は旅行や映画鑑賞を楽しんでいます。

マーク・カープ Amazon SageMaker Service チームの ML アーキテクトです。 彼は、お客様が大規模な ML ワークロードを設計、デプロイ、管理できるよう支援することに重点を置いています。 余暇には、旅行や新しい場所の探索を楽しんでいます。

マーク・カープ Amazon SageMaker Service チームの ML アーキテクトです。 彼は、お客様が大規模な ML ワークロードを設計、デプロイ、管理できるよう支援することに重点を置いています。 余暇には、旅行や新しい場所の探索を楽しんでいます。

- SEO を活用したコンテンツと PR 配信。 今日増幅されます。

- Platoblockchain。 Web3メタバースインテリジェンス。 知識の増幅。 こちらからアクセスしてください。

- 未来を鋳造する w エイドリエン・アシュリー。 こちらからアクセスしてください。

- 情報源: https://aws.amazon.com/blogs/machine-learning/create-sagemaker-pipelines-for-training-consuming-and-monitoring-your-batch-use-cases/

- :持っている

- :は

- :not

- $UP

- 000

- 1

- 10

- 100

- 20

- 7

- a

- 能力

- 受け入れる

- アクセス

- 従った

- 精度

- 越えて

- 行動

- 非周期的

- 添加

- NEW

- 後

- に対して

- AI

- AI / ML

- すべて

- ことができます

- 沿って

- また

- Amazon

- アマゾンセージメーカー

- Amazon Webサービス

- Amazon Webサービス(AWS)

- an

- 分析

- 分析論

- および

- どれか

- 適切な

- 承認

- 承認する

- 承認された

- 建築

- です

- AREA

- AS

- 関連する

- At

- 属性

- 自動化する

- 自動化

- オートマチック

- 自動的に

- オートメーション

- 認知度

- AWS

- 背景

- ベース

- ベースライン

- 基礎

- BE

- なぜなら

- き

- より良いです

- の間に

- ビッグ

- ビッグデータ

- 両言語で

- ビルド

- 建物

- 内蔵

- ビジネス

- ビジネス機能

- by

- 計算された

- コール

- 缶

- 機能

- 場合

- 例

- カテゴリ

- チェーン

- 章

- 課金

- チェック

- 小切手

- 子

- 選択する

- 分類

- クリック

- コード

- 結合

- コマンドと

- 比較します

- コンプリート

- 記入済みの

- 完了

- 計算

- 条件

- 領事

- 制約

- 消費

- コンテナ

- 含まれています

- 続ける

- 続ける

- 連続的な

- コントロール

- 対応する

- 可能性

- 作ります

- 作成した

- 作成します。

- 作成

- 基準

- 電流プローブ

- 現在

- 曲線

- カスタム

- 顧客

- Customers

- DAG

- daily

- データ

- データ処理

- データサイエンス

- データサイエンティスト

- 深いです

- ディープダイブ

- より深い

- 定義済みの

- 配信する

- デモ

- デンバー

- 展開します

- 展開

- 説明する

- 設計

- デザイン

- 検出された

- 検出

- 異なります

- 直接

- ドメイン

- ドメイン

- ドライブ

- 間に

- 各

- どちら

- enable

- 確保

- エンティティ

- 環境

- 環境

- 評価する

- 評価します

- 評価

- イベント

- あらゆる

- 例

- 例

- 例外

- 実行

- 詳細

- 体験

- 探る

- フェイル

- 家族

- 特徴

- 特徴

- フィードバック

- File

- フィルタリング

- ファイナル

- 最後に

- ファイナンシャル

- 名

- フォーカス

- 焦点を当てて

- 焦点

- フォロー中

- 形式でアーカイブしたプロジェクトを保存します.

- 発見

- 頻繁に

- 友達

- から

- 完全に

- function

- 機能

- さらに

- 生成する

- 生成された

- 生成

- 取得する

- Go

- 付与された

- グラフ

- 素晴らしい

- 陸上

- グループ

- ハンドリング

- 持ってる

- he

- ヘルスケア

- 助けます

- 助け

- ハイライト

- 認定条件

- How To

- しかしながら

- HTML

- HTTP

- HTTPS

- 特定され

- 識別する

- 識別する

- アイデンティティ

- 画像

- 実装する

- 実装

- import

- in

- include

- 含まれました

- 含ま

- 含めて

- 組み込む

- 組み込む

- を示し

- 産業

- 情報

- 初期

- 革新的手法

- 統合された

- 統合

- に

- 導入

- IOT

- IT

- ITS

- ジョブ

- JPG

- JSON

- キー

- キック

- 大

- 姓

- 最新の

- 学んだ

- 学習

- wifecycwe

- ライフサイクル

- LINE

- リスト

- リスト

- 場所

- 機械

- 機械学習

- make

- 管理します

- マネージド

- 管理する

- マニュアル

- マーケティング

- 成熟した

- 五月..

- 意味

- だけど

- ミディアム

- ミーツ

- 方法

- メトリック

- メトリック

- 最小

- ML

- MLOps

- モバイル

- 携帯電話

- 修正されました

- モニター

- モニタリング

- モニター

- 月

- 他には?

- 動画

- の試合に

- 名

- ネイティブ

- 必要

- 必要

- 必要とされる

- ニーズ

- 新作

- 次の

- ノート

- 注意

- 今

- オブジェクト

- 客観

- of

- on

- ONE

- 継続

- オペレーショナル

- 最適化

- オプション

- or

- 注文

- その他

- 私たちの

- 出力

- 外側

- が

- パッケージ

- パッケージ

- パラメーター

- パラメータ

- 部

- パス

- 渡された

- 情熱

- 特許

- path

- パターン

- ピア

- ペンディング

- 実行する

- パフォーマンス

- 実行

- 実行する

- 許可

- パーミッション

- 電話

- パイプライン

- 場所

- プラトン

- プラトンデータインテリジェンス

- プラトデータ

- ポイント

- ポリシー

- 方針

- ポスト

- 潜在的な

- 実用的

- プラクティス

- 予測する

- 予測

- 予測

- 準備

- 前に

- 校長

- 事前の

- プロセス

- ラボレーション

- 処理

- 生産された

- 生産

- プロフィール

- プロジェクト

- プロパティ

- 提供します

- 提供

- 提供

- 引き

- Python

- 品質

- クエリ

- Raw

- 準備

- 推奨される

- 記録

- 記録

- 減らします

- 登録

- 登録された

- レジスタ

- 参加申し込み

- レジストリ

- 関連する

- 繰り返す

- 繰り返し可能

- レポート

- 倉庫

- リクエスト

- の提出が必要です

- 必要

- リソース

- 責任

- return

- レビュー

- 職種

- 役割

- 大体

- ラン

- ランニング

- セージメーカー

- SageMakerパイプライン

- 同じ

- サンプル データセット

- 満足

- Save

- 規模

- シナリオ

- シナリオ

- スケジュール

- 科学

- 科学者

- 得点

- スクリーンショット

- スクリプト

- 二番

- 二次

- セクション

- 別

- サービス

- サービス

- セッションに

- セット

- 設定

- すべき

- 表示する

- 示す

- 作品

- 信号

- 簡単な拡張で

- So

- 溶液

- ソリューション

- 一部

- ソース

- ソースコード

- 専門家

- 特定の

- 指定の

- 過ごす

- ステークホルダー

- start

- 開始

- 都道府県

- 統計

- Status:

- 手順

- ステップ

- Force Stop

- 停止する

- ストレージ利用料

- 保存され

- 戦略

- 研究

- それに続きます

- 首尾よく

- そのような

- 提案する

- 供給

- サプライチェーン

- サポート

- 支援する

- 取る

- 取り

- ターゲット

- 仕事

- タスク

- チーム

- テクノロジー

- テクノロジー

- 電気通信

- 伝える

- テンプレート

- test

- より

- それ

- そこ。

- ボーマン

- この

- それらの

- 三

- 3段階

- しきい値

- 介して

- 時間

- 〜へ

- 一緒に

- トレーニング

- 訓練された

- トレーニング

- 最適化の適用

- 旅行

- 真実

- 下

- 根本的な

- 理解する

- アップデイト

- us

- つかいます

- 使用事例

- 中古

- ユーザー

- 利用された

- 価値観

- さまざまな

- バージョン

- 、

- 違反

- 違反

- 視認性

- walked

- ました

- 見ている

- 仕方..

- 方法

- we

- ウェブ

- Webサービス

- WELL

- which

- while

- 意志

- 以内

- レディース

- 仕事

- XGブースト

- 年

- You

- あなたの

- ゼファーネット