この投稿では、自然災害による被害をトレーニング、デプロイ、予測する方法を示します。 地理空間機能を備えた Amazon SageMaker. 新しい SageMaker 地理空間機能を使用して、モデルをテストするための新しい推論データを生成します。 多くの政府機関や人道支援団体は、災害発生時に迅速かつ正確な状況認識を必要としています。 損傷の深刻度、原因、および場所を知ることは、最初の対応者の対応戦略と意思決定に役立ちます。 正確でタイムリーな情報が不足していると、救援活動が不完全または誤った方向に進む可能性があります。

自然災害の頻度と深刻度が増すにつれて、意思決定者と最初の対応者に迅速かつ正確な損害評価を提供することが重要です。 この例では、地理空間画像を使用して自然災害の被害を予測します。 地理空間データは、自然災害の直後に建物、道路、またはその他の重要なインフラストラクチャへの損傷を迅速に特定するために使用できます。 この投稿では、災害被害の分類に使用する地理空間セグメンテーション モデルをトレーニングしてデプロイする方法を紹介します。 アプリケーションを、モデルのトレーニング、モデルのデプロイ、および推論の XNUMX つのトピックに分類します。

モデルトレーニング

このユース ケースでは、以下を使用してカスタム PyTorch モデルを構築しました。 アマゾンセージメーカー 建物の損傷の画像セグメンテーション用。 SageMaker の地理空間機能には、利用できるトレーニング済みモデルが含まれています。 これらの組み込みモデルには、雲のセグメンテーションと除去、および土地被覆のセグメンテーションが含まれます。 この投稿では、損傷セグメンテーション用のカスタム モデルをトレーニングします。 最初に、xView2 コンペティションのデータで SegFormer モデルをトレーニングしました。 SegFormer は、2021 年の論文で紹介されたトランスフォーマー ベースのアーキテクチャです。 SegFormer: トランスフォーマーによるセマンティック セグメンテーションのためのシンプルで効率的な設計. これは、自然言語処理のワークロードで非常に人気のあるトランスフォーマー アーキテクチャに基づいています。 ただし、SegFormer アーキテクチャはセマンティック セグメンテーション用に構築されています。 トランスフォーマーベースのエンコーダーと軽量のデコーダーの両方を組み合わせています。 これにより、以前の方法よりも大幅に小さいモデル サイズを提供しながら、以前の方法よりもパフォーマンスが向上します。 事前トレーニング済みおよび未トレーニングの SegFormer モデルの両方が、人気のある Hugging Face Transformer ライブラリから入手できます。 このユース ケースでは、事前トレーニング済みの SegFormer アーキテクチャをダウンロードし、新しいデータセットでトレーニングします。

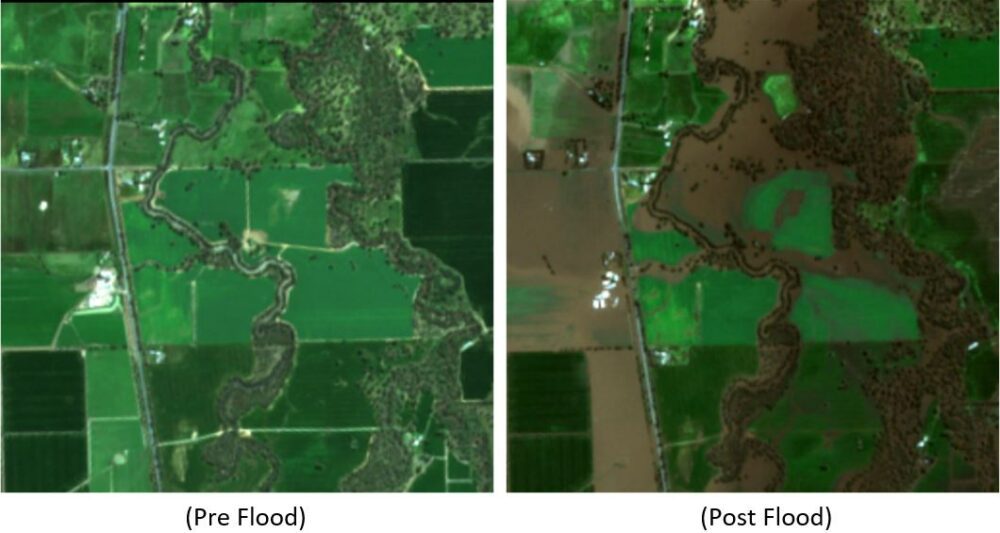

この例で使用されるデータセットは、 xView2 データ サイエンス コンテスト. この大会で発表された、 xBD データセットは、自然災害前後の建物の位置と被害スコア (クラス) で注釈が付けられた、高解像度の衛星画像の公開されている最大かつ最高品質のデータセットの 15 つです。 このデータセットには、6 種類の災害 (地震/津波、洪水、火山噴火、山火事、風) を含む 850,736 か国のデータと、45,362 km^2 の画像にわたる XNUMX の建物の注釈を含む地理空間データが含まれています。 次の図は、データセットの例を示しています。 この画像は、建物の損傷セグメンテーション マスクがオーバーレイされた災害後の画像を示しています。 各画像には、災害前の衛星画像、災害前の建物セグメンテーション マスク、災害後の衛星画像、および被害クラスを含む災害後の建物セグメンテーション マスクが含まれます。

この例では、災害前後の画像のみを使用して、災害後の被害分類 (セグメンテーション マスク) を予測します。 災害前の建物セグメンテーション マスクは使用しません。 このアプローチは、単純化のために選択されました。 このデータセットにアプローチするための他のオプションがあります。 xView2 コンペティションで優勝した多くのアプローチでは、XNUMX 段階のソリューションが使用されました。まず、災害前の建物のアウトライン セグメンテーション マスクを予測します。 建物の輪郭と損傷後の画像は、損傷の分類を予測するための入力として使用されます。 分類と検出のパフォーマンスを改善するための他のモデリング アプローチについては、読者に任せます。

事前トレーニング済みの SegFormer アーキテクチャは、2 つの 1024 色チャネル画像を入力として受け取り、セグメンテーション マスクを出力するように構築されています。 モデルを変更して、衛星前と後の両方の画像を入力として受け入れる方法はいくつかありますが、単純なスタッキング手法を使用して、両方の画像を 512 色チャネル画像にスタックしました。 xView3.2 トレーニング データセットで標準的な拡張技術を使用してモデルをトレーニングし、災害後のセグメンテーション マスクを予測しました。 すべての入力画像のサイズを XNUMX から XNUMX ピクセルに変更したことに注意してください。 これは、トレーニング データの空間解像度をさらに下げるためでした。 モデルは、単一の pXNUMXxlarge GPU ベースのインスタンスを使用して SageMaker でトレーニングされました。 トレーニング済みモデルの出力の例を次の図に示します。 画像の最初のセットは、検証セットからの損傷前後の画像です。

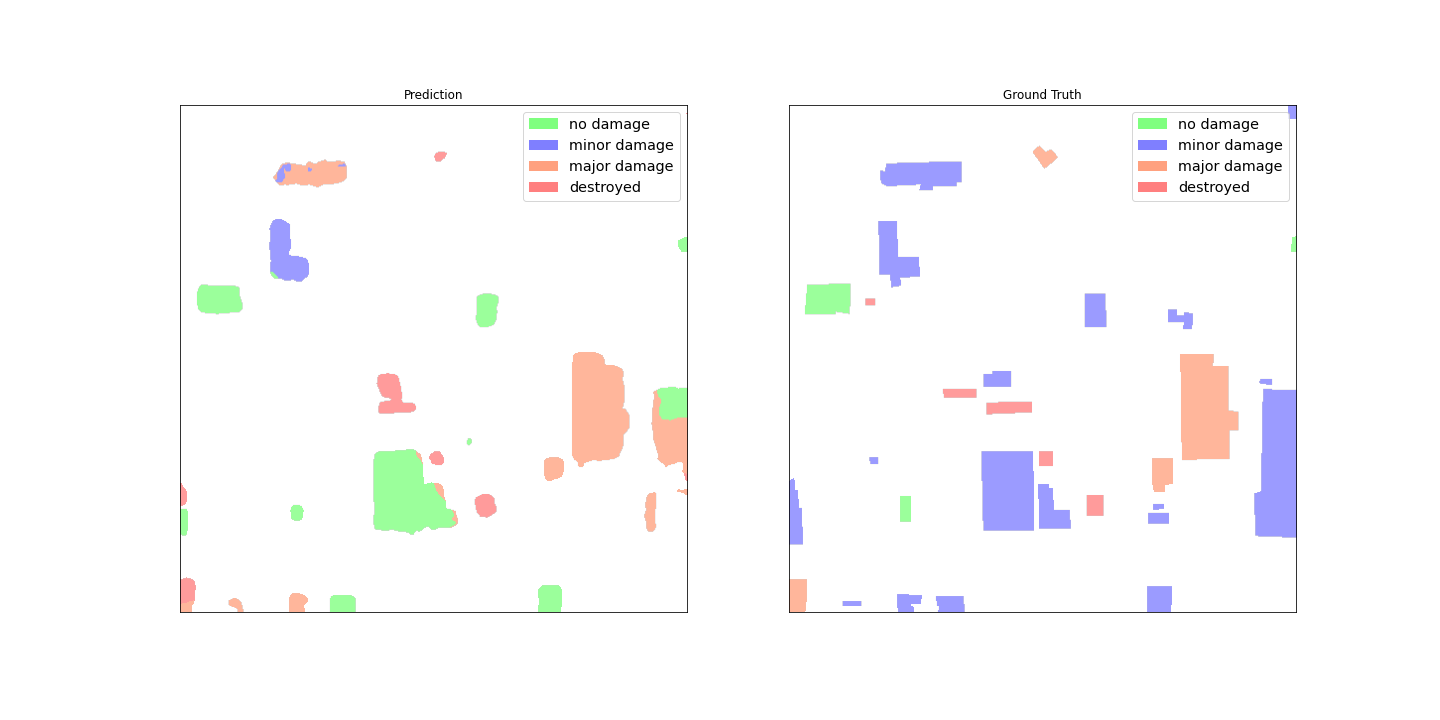

次の図は、予測されるダメージ マスクとグラウンド トゥルース ダメージ マスクを示しています。

一見すると、モデルはグラウンド トゥルース データと比較してうまく機能していないように見えます。 建物の多くは誤って分類されており、小さな損傷と損傷がないことを混同し、XNUMX つの建物の輪郭に対して複数の分類を示しています。 ただし、モデルのパフォーマンスを確認したときの興味深い発見の XNUMX つは、建物の損傷分類をローカライズすることを学習したように見えることです。 各建物は次のように分類できます。 No Damage, Minor Damage, Major Damageまたは Destroyed. 予測された損傷マスクは、モデルが中央の大きな建物を大部分に分類したことを示しています。 No Damage、しかし右上隅は次のように分類されます Destroyed. このサブビルディングの損傷のローカリゼーションは、建物ごとのローカライズされた損傷を表示することで、レスポンダーをさらに支援できます。

モデルの展開

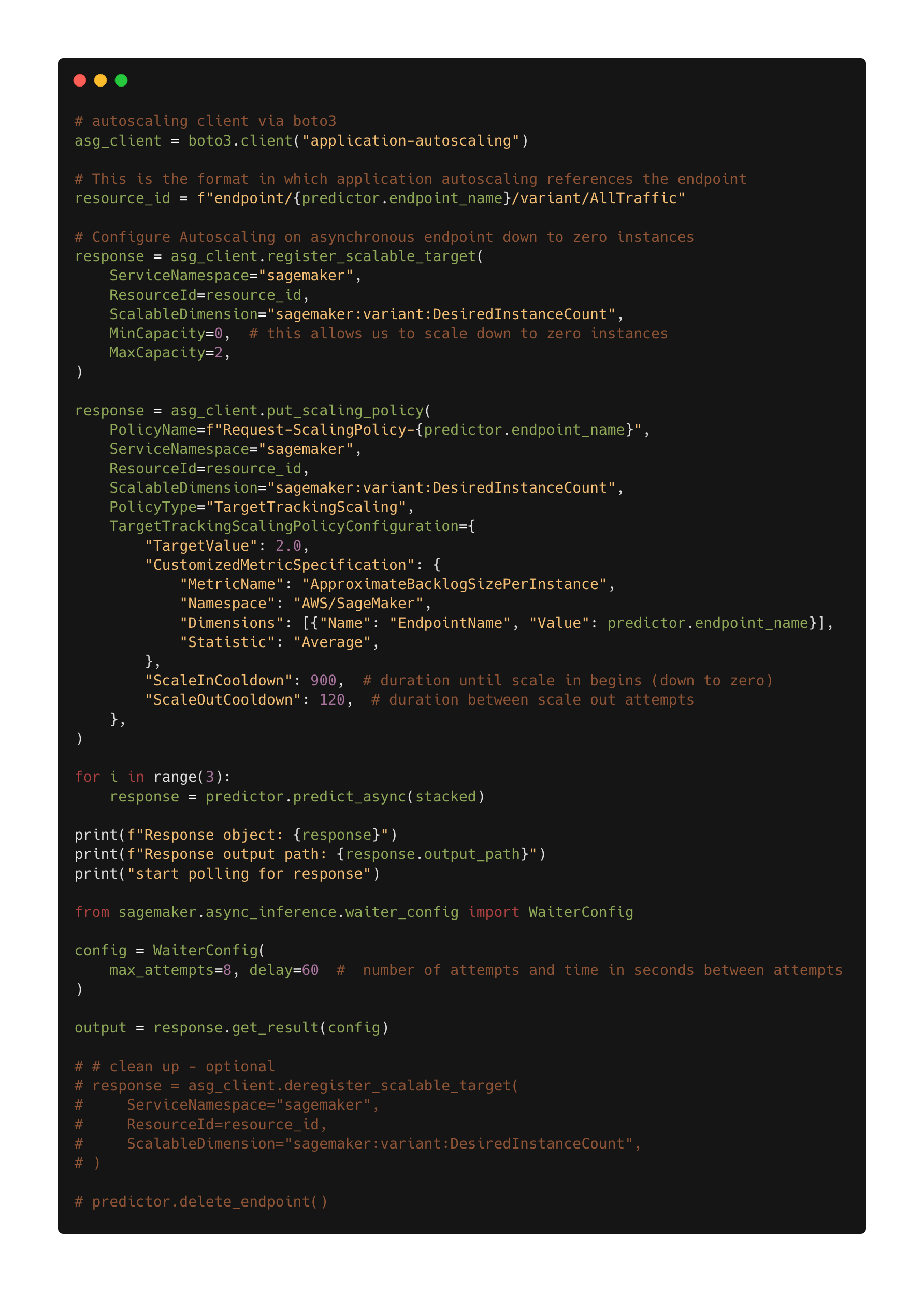

トレーニングされたモデルは、非同期の SageMaker 推論エンドポイントにデプロイされました。 より長い推論時間、より大きなペイロード入力サイズ、および使用されていないときにエンドポイントをゼロ インスタンス (料金なし) にスケールダウンする機能を可能にするために、非同期エンドポイントを選択したことに注意してください。 次の図は、非同期エンドポイント展開のコードの概要を示しています。 最初に、保存された PyTorch 状態辞書を圧縮し、圧縮されたモデル アーティファクトを Amazon シンプル ストレージ サービス (アマゾン S3)。 推論コードとモデル成果物を指す SageMaker PyTorch モデルを作成します。 モデルを読み込んで提供するには、推論コードが必要です。 SageMaker PyTorch モデルに必要なカスタム推論コードの詳細については、次を参照してください。 SageMaker PythonSDKでPyTorchを使用する.

次の図は、非同期推論エンドポイントの自動スケーリング ポリシーのコードを示しています。

アプリケーションに使用できる、リアルタイム、バッチ、サーバーレスなど、他のエンドポイント オプションがあることに注意してください。 ユースケースに最適なオプションを選択し、それを思い出してください。 AmazonSageMaker推論レコメンダー 機械学習 (ML) エンドポイント構成の推奨に役立てることができます。

モデル推論

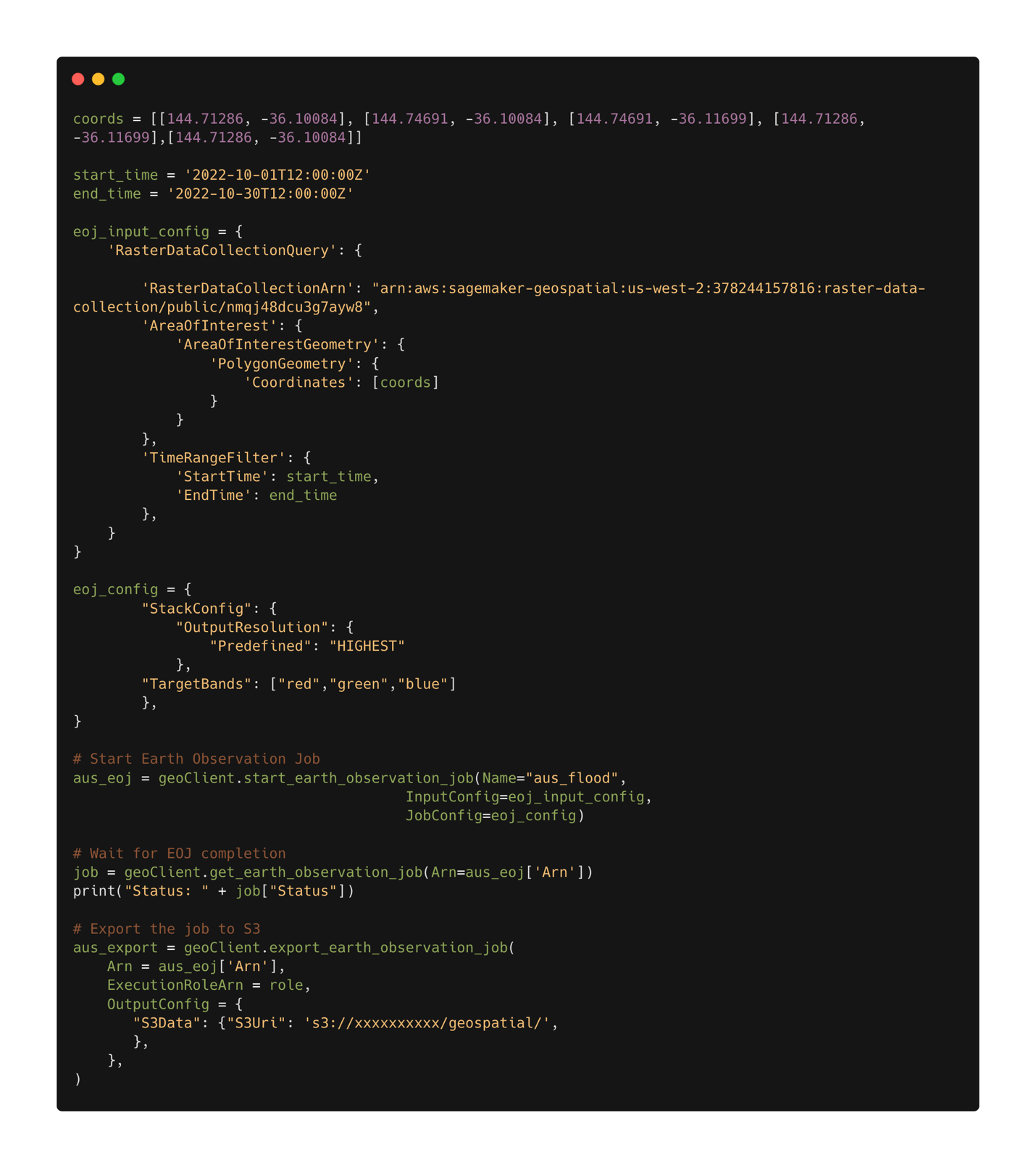

トレーニング済みのモデルがデプロイされたので、次を使用できます SageMaker の地理空間機能 推論のためのデータを収集します。 SageMaker の地理空間機能を使用すると、いくつかの組み込みモデルをすぐに使用できます。 この例では、バンド スタッキング操作を使用して、地球観測ジョブの赤、緑、および青のカラー チャネルをスタッキングします。 このジョブは、Sentinel-2 データセットからデータを収集します。 地球観測ジョブを構成するには、まず対象の場所の座標が必要です。 次に、観測の時間範囲が必要です。 これで、スタッキング機能を使用して地球観測ジョブを送信できるようになりました。 ここでは、赤、緑、青のバンドを重ねてカラー イメージを生成します。 次の図は、2022 年 XNUMX 月中旬にオーストラリアのロチェスターで発生した洪水からデータを生成するために使用されたジョブ構成を示しています。災害の前後の画像を、トレーニング済みの ML モデルへの入力として使用します。

ジョブ構成が定義されたら、ジョブを送信できます。 ジョブが完了すると、結果が Amazon S3 にエクスポートされます。 ジョブが完了した後にのみ結果をエクスポートできることに注意してください。 ジョブの結果は、エクスポート ジョブ設定でユーザーが指定した Amazon S3 の場所にエクスポートできます。 Amazon S3 の新しいデータを使用して、デプロイされたモデルを使用して損害予測を取得できます。 まず、データをメモリに読み込み、災害前と災害後の画像をスタックします。

ロチェスター洪水のセグメンテーション マスクの結果を次の図に示します。 ここでは、モデルが浸水地域内の場所を被害の可能性が高い場所として特定したことがわかります。 また、推論イメージの空間解像度はトレーニング データとは異なることに注意してください。 空間解像度を上げると、モデルのパフォーマンスが向上する可能性があります。 ただし、これは、マルチスケール モデル アーキテクチャにより、他のモデルと同様に、SegFormer モデルではあまり問題になりません。

まとめ

この投稿では、自然災害による被害をトレーニング、デプロイ、予測する方法を示しました。 地理空間機能を備えた SageMaker. 新しい SageMaker 地理空間機能を使用して、モデルをテストするための新しい推論データを生成しました。 この投稿のコードは現在リリース中です。この投稿は、完全なトレーニング、デプロイ、および推論コードへのリンクで更新されます。 このアプリケーションにより、ファーストレスポンダー、政府、および人道支援組織は、自然災害の直後に重要な状況認識を提供して、対応を最適化できます。 このアプリケーションは、SageMaker などの最新の ML ツールで可能なことの一例にすぎません。

独自のモデルを使用して、SageMaker の地理空間機能を今すぐお試しください。 あなたが次に何を構築するかを楽しみにしています。

著者,

アーロン・センスタッケン アマゾン ウェブ サービスの機械学習スペシャリスト ソリューション アーキテクトです。 Aaron は、あらゆる規模の公共部門の顧客と緊密に連携して、実稼働機械学習アプリケーションを開発および展開しています。 彼は、機械学習、テクノロジー、宇宙探査のすべてに興味を持っています。

アーロン・センスタッケン アマゾン ウェブ サービスの機械学習スペシャリスト ソリューション アーキテクトです。 Aaron は、あらゆる規模の公共部門の顧客と緊密に連携して、実稼働機械学習アプリケーションを開発および展開しています。 彼は、機械学習、テクノロジー、宇宙探査のすべてに興味を持っています。