Googleはサービスを一時停止した ジェミニAI 歪んだ人種表現をめぐる騒動を受けて「人物」のイメージを生成することから。

たとえ歴史的に不正確な文脈であっても、AIが主に有色人種を描写する傾向があることをユーザーが指摘したことを受け、このテクノロジー企業は行動を起こした。この動きは、Gemini の機能を改良して、より正確で多様な描写を保証することを目的としています。

また、お読みください。 それは冗談だ!ユーザーはGoogleのGeminiを見逃していると嘲笑する

反発の起源

論争の核心は、AIが画像出力に人種の多様性を正確に反映できていないことにある。ソーシャルメディアは戦場となり、歴史的、文化的正確さから逸脱した双子座が生成した画像をユーザーが共有しました。注目すべき例には、ナチスの軍服を着た非白人スウェーデン人女性や有色人種の描写が含まれます。

Google Gemini に白人の存在を認めさせるのは恥ずかしいほど難しい pic.twitter.com/4lkhD7p5nR

—Deedy (@debarghya_das) 2024 年 2 月 20 日

このような不正確さは、ソーシャル メディア上で議論を引き起こしただけでなく、Google 内での従業員の厳しい内省にもつながりました。 表現する AIの欠点に対する当惑。批評家は、これらの不正確さは単なる技術的な欠陥ではなく、AI プログラミングにおけるより深刻なバイアスを反映していると主張しています。

Google ARVR の研究エンジニア、St. Ratej 氏は、X への投稿で「会社で働くことがこれほど恥ずかしいことはありませんでした」と語った。

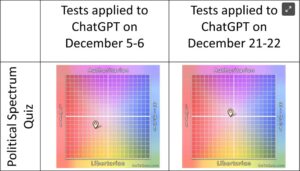

ただし、反発は Google だけにとどまらず、一部のユーザーは、次のような他の AI プラットフォームでも同様のバイアスがあることに気づきました。 OpenAI の ChatGPT。その結果、AI テクノロジー全体にわたる精査の一貫性について疑問が生じ、公平な AI 表現を確保するという広範な業界全体の課題が浮き彫りになりました。

えーっと…chatGPT にも同様の道徳的問題が起きているようです。

なぜ彼らはフリーパスを手に入れるのでしょうか? pic.twitter.com/a1ZBz69iZw

— リヴ・ボリー (@Liv_Boeree) 2024 年 2 月 21 日

リップル効果

この事件は同社のイメージを傷つけただけでなく、AIの倫理と表現に関する広範な議論を引き起こした。イーロン・マスクはグーグルの方法論を「人種差別的」で「反文明的」だと批判した。ムスクさんの 注釈 さらに、AI テクノロジーの倫理的境界に対する懸念の高まりと、AI によって生成されたコンテンツのより多様で正確な描写の必要性も反映されています。

「グーグルがAI画像生成で大げさに手を尽くしてくれたことをうれしく思う。なぜなら、グーグルの狂気の人種差別的で反文明的なプログラムが誰の目にも明らかだからだ。」

この論争に応えて、マスク氏は自身の AI モデル Grok について、さらなるバージョンをリリースする予定であると表明しました。このテクノロジーは AI 開発における競争力を実証しており、Gemini などの既存モデルの限界を克服するのに役立つ可能性があります。さらに、AI 市場が急速なイノベーションと激しい競争を特徴とする中、Grok と Groq LPU チップの偶然の名前の類似性が注目を集めました。

おそらく今ではその理由が明らかになっています @xAIのGrokはとても重要です。

現時点では完璧には程遠いですが、急速に改善されるでしょう。 V1.5 は 2 週間以内にリリースされます。

批判を気にせず、真実を徹底的に追求することが、これまで以上に重要になっています。

- エロン・ムスク(@ elonmusk) 2024 年 2 月 22 日

改善への道

Google はこの問題を認識し、Gemini の描画機能を改良するつもりでした。同社は、AIが生成した画像の多様性の重要性を強調したが、すべての人口統計を正確に表現するには現在のモデルの欠点を認めた。

私たちはすでに、Gemini の画像生成機能に関する最近の問題に対処するために取り組んでいます。これを行っている間、人物の画像生成を一時停止し、改善されたバージョンを近日中に再リリースする予定です。 https://t.co/SLxYPGoqOZ

— Googleコミュニケーション(@Google_Comms) 2024 年 2 月 22 日

同様に、Googleの広報担当者Krawczyk氏もモデルの欠陥を認め、歴史的な正確さを損なうことなく世界の多様性を反映する、よりバランスの取れた描写の必要性を強調した。こうした懸念に対処するため、GoogleはGeminiの人体画像生成機能を一時停止し、ユーザーベースの世界的な多様性をより適切に反映する強化版を発表した。

「私たちはすでに、Gemini の画像生成機能に関する最近の問題に対処するために取り組んでいます。これを行っている間、人物の画像生成を一時停止し、改善されたバージョンをすぐに再リリースする予定です。」

- SEO を活用したコンテンツと PR 配信。 今日増幅されます。

- PlatoData.Network 垂直生成 Ai。 自分自身に力を与えましょう。 こちらからアクセスしてください。

- プラトアイストリーム。 Web3 インテリジェンス。 知識増幅。 こちらからアクセスしてください。

- プラトンESG。 カーボン、 クリーンテック、 エネルギー、 環境、 太陽、 廃棄物管理。 こちらからアクセスしてください。

- プラトンヘルス。 バイオテクノロジーと臨床試験のインテリジェンス。 こちらからアクセスしてください。

- 情報源: https://metanews.com/google-halts-gemini-ai-amid-backlash-over-woke-image-controversies/

- :持っている

- :は

- :not

- 13

- 20

- 22

- 7

- 8

- 9

- a

- 私たちについて

- 精度

- 正確な

- 正確にデジタル化

- 認める

- 越えて

- Action

- 住所

- 認められた

- 後

- AI

- 目指して

- すべて

- 既に

- また

- an

- および

- です

- 主張する

- AS

- At

- ベース

- 戦場

- になりました

- き

- より良いです

- の間に

- バイアス

- バイアス

- 境界

- より広い

- 焙煎が極度に未発達や過発達のコーヒーにて、クロロゲン酸の味わいへの影響は強くなり、金属を思わせる味わいと乾いたマウスフィールを感じさせます。

- by

- 呼び出し

- 機能

- 挑戦する

- AI言語モデルを活用してコードのデバッグからデータの異常検出まで、

- チップ

- クリア

- カラー

- 通信部

- 会社

- 会社の

- コンペ

- 競争力のある

- 妥協する

- 懸念

- 懸念事項

- その結果

- コンテンツ

- 文脈

- 論争

- 基本

- 批判

- 批評

- 文化的な

- 電流プローブ

- 議論

- 討論会

- 人口動態

- 実証

- 開発

- DID

- 異なる

- 多様性

- do

- echo

- エッジ(Edge)

- エロン

- イーロン·マスク

- 強調

- 強調

- 社員

- エンジニア

- 強化された

- 確保

- 確保する

- 本質的な

- 倫理的な

- 倫理

- さらに

- 例

- 存在する

- 既存の

- 表現

- 不良解析

- 遠く

- スピーディー

- 特徴

- 会社

- フォロー中

- 無料版

- から

- さらに

- さらに

- 双子座

- 生成

- 世代

- 創世記

- 取得する

- 受け

- グローバル

- 行く

- でログイン

- Googleの

- 成長

- ハンド

- ハード

- 持ってる

- he

- 助けます

- 強調表示された

- 強調表示

- 彼の

- 歴史的

- 歴史的に

- しかしながら

- HTTPS

- 人間

- 画像

- 画像

- 重要性

- 重要

- 改善します

- 改善されました

- in

- その他の

- 不正確

- 事件

- include

- 革新的手法

- INSANE

- 意図された

- 関心

- 内観

- 問題

- 問題

- IT

- ITS

- ただ

- ツェッペリン

- ある

- ような

- 制限

- LIV

- LOOKS

- 製

- マークされた

- 市場

- メディア

- 単なる

- 方法論

- かもしれない

- 行方不明

- モデル

- 他には?

- 麝香

- 名

- ナチス

- 必要

- 決して

- 注目すべき

- 今

- of

- on

- の

- その他

- outputs

- が

- 克服する

- パス

- path

- 一時停止

- 一時停止

- のワークプ

- 完璧

- プラットフォーム

- プラトン

- プラトンデータインテリジェンス

- プラトデータ

- ポスト

- 主に

- 深遠な

- プログラミング

- 追求

- 質問

- 人種差別主義者

- 急速に

- RE

- 読む

- 最近

- リファイン

- 反映する

- 反映

- 見なす

- リリース

- リリース

- 表現

- 表します

- 研究

- 応答

- 右

- Ripple

- s

- 前記

- 同じ

- 精査

- 厳しい

- シェアリング

- 欠点

- 不足

- So

- 社会

- ソーシャルメディア

- 一部

- すぐに

- 火花

- スポークスパーソン

- Force Stop

- スウェーデン語

- テク

- 技術的

- テクノロジー

- テクノロジー

- それ

- アプリ環境に合わせて

- ボーマン

- 彼ら

- この

- 〜へ

- 取った

- true

- 真実

- さえずり

- 不偏

- ユーザー

- users

- v1

- バージョン

- バージョン

- we

- ウィークス

- which

- while

- 白

- なぜ

- 意志

- 以内

- 無し

- レディース

- 仕事

- ワーキング

- X

- ゼファーネット