アマゾンセージメーカー は、開発者やデータ サイエンティストが、あらゆる規模の機械学習 (ML) モデルを迅速かつ簡単に構築、トレーニング、デプロイできるようにするフルマネージド サービスです。 SageMaker を使用すると、サービスへの API 呼び出しを通じてモデルを実稼働環境に直接デプロイすることが簡単になります。 モデルはコンテナにパッケージ化されており、堅牢でスケーラブルな展開が可能です。 SageMaker Python SDK、AWS SDK、SageMaker コンソール、 Amazon SageMakerスタジオ ノートブックを使用して ML モデルを大規模にトレーニングおよびデプロイするプロセスを簡素化できますが、顧客は依然として、プレイグラウンド テスト用にモデルをデプロイし、運用環境のデプロイを最適化するためのより良い方法を探しています。

私たちは、SageMaker を使用してモデルをパッケージ化およびデプロイするプロセスを簡素化する XNUMX つの新しい方法を開始します。

この投稿では、新しい SageMaker Python SDK を紹介します。 ModelBuilder このエクスペリエンスは、データ サイエンティストなどの新しい SageMaker ユーザーの学習曲線を最小限に抑えることを目的としていると同時に、経験豊富な MLOps エンジニアが SageMaker ホスティング サービスを最大限に活用できるように支援します。 これは、SageMaker の全機能を活用するためのベスト プラクティスに関するガイダンスを提供することにより、初期セットアップと展開の複雑さを軽減します。 この新しい SageMaker 機能に関する詳細情報と GitHub の例を提供します。

もう 2 つの新しい機能は、SageMaker Studio の新しいインタラクティブなデプロイメント エクスペリエンスを使用することです。 これについてはパート XNUMX で説明します。

モデルを SageMaker エンドポイントにデプロイするには、モデルを SageMaker エンドポイントでホストできるようにするための一連の手順が必要です。 これには、モデル アーティファクトを正しい形式と構造で取得し、推論コードを作成し、モデル画像の URL などの重要な詳細を指定することが含まれます。 Amazon シンプル ストレージ サービス (Amazon S3) モデルアーティファクトの場所、シリアル化と逆シリアル化の手順、および必要な AWS IDおよびアクセス管理 (IAM) ロールを使用して、適切なアクセス許可を促進します。 これに続いて、エンドポイント構成では、推論タイプを決定し、インスタンス タイプ、数、モデル バリアント間のトラフィック分散などの各パラメーターを構成する必要があります。

SageMaker ホスティングを使用する際にお客様をさらに支援するために、新しい機能を導入しました。 ModelBuilder SageMaker Python SDK のクラス。これにより、モデルを SageMaker エンドポイントにデプロイするときに次のような重要な利点が得られます。

- フレームワーク間で導入エクスペリエンスを統合します – 新しいエクスペリエンスは、PyTorch、TensorFlow、XGBoost などのさまざまなフレームワークを使用して構築されたモデルをデプロイするための一貫したワークフローを提供します。 これにより、展開プロセスが簡素化されます。

- モデルのデプロイメントを自動化する – 適切なコンテナの選択、依存関係の取得、シリアル化/逆シリアル化の処理などのタスクが自動化され、展開に必要な手動の労力が軽減されます。

- ローカルから SageMaker でホストされるエンドポイントへのスムーズな移行を実現します。 – 最小限のコード変更で、モデルをローカル テストから SageMaker エンドポイントでのデプロイメントに簡単に移行できます。 ライブ ログにより、デバッグがシームレスになります。

全体として、SageMaker ModelBuilder 低レベルの詳細を処理することで SageMaker 推論のモデル パッケージ化プロセスを簡素化および合理化し、エンドポイントのテスト、検証、最適化のためのツールを提供します。 これにより、開発者の生産性が向上し、エラーが減少します。

次のセクションでは、この新機能の詳細を詳しく説明します。 また、次を使用してモデルを SageMaker ホスティングにデプロイする方法についても説明します。 ModelBuilder、プロセスが簡素化されます。 次に、従来の ML モデルと生成 AI ユースケースを強化する基盤モデルの両方をデプロイするためのさまざまなフレームワークの例をいくつか紹介します。

SageMaker ModelBuilder について知る

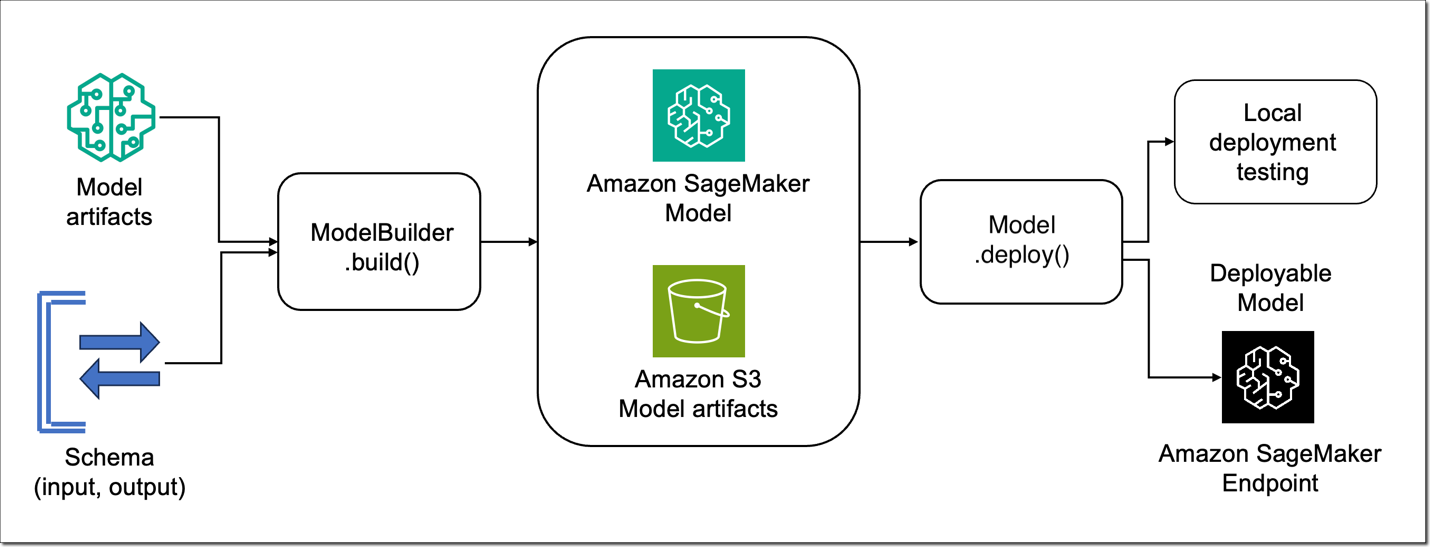

新しい ModelBuilder は、XGBoost や PyTorch などのフレームワークを使用して構築された ML モデルを取得し、それらを SageMaker にデプロイできるモデルに変換することに重点を置いた Python クラスです。 ModelBuilder 提供 build() モデルサーバーに従ってアーティファクトを生成する関数と、 deploy() ローカルまたは SageMaker エンドポイントにデプロイする機能。 この機能の導入により、モデルと SageMaker 環境の統合が簡素化され、パフォーマンスとスケーラビリティが最適化されます。 次の図は、その方法を示しています。 ModelBuilder 高いレベルで取り組んでいます。

ModelBuilder クラス

モデルビルダー クラスには、カスタマイズのためのさまざまなオプションが用意されています。 ただし、フレームワーク モデルをデプロイするために、モデル ビルダーはモデル、入力、出力、およびロールを期待するだけです。

スキーマビルダー

スキーマビルダー クラスを使用すると、エンドポイントの入力と出力を定義できます。 これにより、スキーマ ビルダーは、入力と出力をシリアル化および逆シリアル化するための対応するマーシャリング関数を生成できるようになります。 次のクラス ファイルは、カスタマイズのためのすべてのオプションを提供します。

ただし、ほとんどの場合、サンプルの入出力だけで機能します。 例えば:

サンプルの入出力を提供することで、 SchemaBuilder 必要な変換を自動的に決定できるため、統合プロセスがより簡単になります。 より高度な使用例では、入力と出力の両方にカスタム変換関数を提供できる柔軟性があり、より複雑なデータ構造も効率的に処理できるようになります。 次のセクションでは、次のセクションを使用して、さまざまなフレームワークを使用してさまざまなモデルをデプロイすることで、これを実証します。 ModelBuilder.

ローカルモード体験

この例では、 ModelBuilder XGBoost モデルをローカルにデプロイします。 Mode を使用して、ローカル テストと SageMaker エンドポイントへのデプロイを切り替えることができます。 最初に XGBoost モデルを (ローカルまたは SageMaker で) トレーニングし、モデル アーティファクトを作業ディレクトリに保存します。

次に、実際のモデル オブジェクトを渡して ModelBuilder オブジェクトを作成します。 SchemaBuilder これは、サンプル テストの入力オブジェクトと出力オブジェクト (モデルのトレーニングとテスト時に使用したのと同じ入力と出力) を使用して、必要なシリアル化を推測します。 使用することに注意してください Mode.LOCAL_CONTAINER ローカル展開を指定します。 その後、 ビルド サポートされているフレームワーク コンテナ イメージを自動的に識別し、依存関係をスキャンする機能。 次のコードを参照してください。

最後に、 deploy モデル オブジェクト内の関数。これにより、デバッグを容易にするためのライブ ログも提供されます。 モデルはローカルにデプロイされるため、インスタンスのタイプや数を指定する必要はありません。 これらのパラメータを指定した場合、それらは無視されます。 この関数は、テスト データを使用して予測を行うために使用できる予測子オブジェクトを返します。

オプションで、次を使用してモデルの読み込みと前処理および後処理を制御することもできます。 InferenceSpec。 詳細については、この投稿の後半で説明します。 使用する LOCAL_CONTAINER これは、SageMaker エンドポイントにデプロイする前にスクリプトをローカルでテストするための優れた方法です。

Job Status ページの下部にある モデルビルダー-xgboost.ipynb を使用してローカルと SageMaker エンドポイントの両方にデプロイをテストする例 ModelBuilder.

従来のモデルを SageMaker エンドポイントにデプロイする

次の例では、使用方法を紹介します。 ModelBuilder 従来の ML モデルをデプロイします。

XGBoostモデル

前のセクションと同様に、XGBoost モデルを SageMaker エンドポイントにデプロイするには、 mode 作成時のパラメータ ModelBuilder オブジェクト:

SageMaker エンドポイントにデプロイする場合、呼び出し時にインスタンス タイプとインスタンス数を指定する必要があることに注意してください。 deploy 機能。

Job Status ページの下部にある モデルビルダー-xgboost.ipynb XGBoost モデルをデプロイする例。

トリトンモデル

あなたが使用することができます ModelBuilder PyTorch モデルを提供するには Triton推論サーバー。 そのためには、 model_server パラメータとして ModelServer.TRITON、モデルを渡し、 SchemaBuilder オブジェクトには、モデルからのサンプル入力と出力が必要です。 残りの部分は ModelBuilder が処理します。

参照する モデルビルダー-triton.ipynb Triton を使用してモデルをデプロイします。

ハグフェイスモデル

この例では、Hugging Face によって提供される事前トレーニング済みのトランスフォーマー モデルを SageMaker にデプロイする方法を示します。 ハグフェイスを使いたい pipeline モデルをロードするため、カスタム推論仕様を作成します。 ModelBuilder:

また、推論ワークロードの入力と出力も定義します。 SchemaBuilder モデルの入力と出力に基づくオブジェクト:

次に、 ModelBuilder オブジェクトを作成し、他の例で示したものと同じロジックに従ってモデルを SageMaker エンドポイントにデプロイします。

参照する モデルビルダー-ハギングフェイス.ipynb ハグフェイスパイプラインモデルをデプロイします。

基盤モデルを SageMaker エンドポイントにデプロイする

次の例では、使用方法を紹介します。 ModelBuilder 基礎モデルを展開します。 前述のモデルと同様に、必要なのはモデル ID だけです。

フェイスハブを抱き締める

基盤モデルをデプロイする場合は、 フェイスハブを抱き締める、必要なのは、事前トレーニングされたモデル ID を渡すことだけです。 たとえば、次のコード スニペットは、 メタラマ/ラマ-2-7b-hf 現地でモデルを作ります。 モードを次のように変更できます。 Mode.SAGEMAKER_ENDPOINT SageMaker エンドポイントにデプロイします。

Hugging Face Hub 上のゲート付きモデルの場合、Hugging Face Hub 経由でアクセスをリクエストし、関連するキーを環境変数として渡して使用する必要があります。 HUGGING_FACE_HUB_TOKEN。 一部のハグフェイスモデルでは、リモートコードを信頼する必要がある場合があります。 次を使用して環境変数としても設定できます HF_TRUST_REMOTE_CODE。 デフォルトでは、 ModelBuilder ハグ顔テキスト生成推論を使用します (T.G.I.) コンテナを、Hugging Face モデルの基礎となるコンテナとして使用します。 AWS 大規模モデル推論を使用したい場合 (LMI) コンテナを設定できます。 model_server パラメータとして ModelServer.DJL_SERVING を設定するとき ModelBuilder オブジェクト。

のすっきりとした機能 ModelBuilder を使用するときにコンテナパラメータのローカルチューニングを実行する機能です。 LOCAL_CONTAINER モード。 この機能は、次のコマンドを実行するだけで使用できます。 tuned_model = model.tune().

参照する デモ-モデル-ビルダー-ハギングフェイス-llama2.ipynb ハグフェイスハブモデルを展開します。

SageMaker ジャンプスタート

Amazon SageMaker ジャンプスタート 事前トレーニングされた基礎モデルも多数提供しています。 Hugging Face Hub からモデルをデプロイするプロセスと同様に、モデル ID が必要です。 SageMaker JumpStart モデルを SageMaker エンドポイントにデプロイするのは、次のコードを実行するのと同じくらい簡単です。

利用可能なすべての SageMaker JumpStart モデル ID については、以下を参照してください。 事前トレーニング済みのモデル テーブルを使用した組み込みアルゴリズム。 参照する モデルビルダー-ジャンプスタート-falcon.ipynb SageMaker JumpStart モデルをデプロイします。

推論コンポーネント

ModelBulder SageMaker の新しい推論コンポーネント機能を使用してモデルをデプロイできるようになります。 推論コンポーネントの詳細については、を参照してください。 SageMaker の最新機能を使用してモデルの導入コストを平均 50% 削減。 推論コンポーネントをデプロイメントに使用するには、 ModelBuilder 指定することにより endpoint_type=EndpointType.INFERENCE_COMPONENT_BASED セクションに deploy() 方法。 を使用することもできます。 tune() メソッドを使用してアクセラレータの最適な数を取得し、必要に応じて変更します。

参照する モデルビルダー推論コンポーネント.ipynb モデルを推論コンポーネントとしてデプロイします。

ModelBuilder クラスをカスタマイズする

ModelBuilder クラスを使用すると、モデルの読み込みをカスタマイズできます。 InferenceSpec.

さらに、ペイロードと応答のシリアル化と逆シリアル化を制御し、次を使用して前処理と後処理をカスタマイズできます。 CustomPayloadTranslator。 さらに、SageMaker でモデルをデプロイするために事前に構築されたコンテナを拡張する必要がある場合は、次のように使用できます。 ModelBuilder モデルのパッケージ化プロセスを処理します。 次のセクションでは、これらの機能について詳しく説明します。

推論仕様

推論仕様 追加のカスタマイズ層を提供します。 これにより、モデルがどのようにロードされるか、および受信した推論リクエストをどのように処理するかを定義できます。 を通して InferenceSpecを使用すると、デフォルトの読み込みメカニズムをバイパスして、モデルのカスタム読み込みプロシージャを定義できます。 この柔軟性は、非標準モデルまたはカスタム推論パイプラインを操作する場合に特に有益です。 呼び出しメソッドはカスタマイズでき、モデルが受信リクエストを処理する方法 (前処理と後処理) を調整できるようになります。 このカスタマイズは、推論プロセスがモデルの特定のニーズに確実に適合するようにするために不可欠です。 次のコードを参照してください。

次のコードは、このクラスの使用例を示しています。

CustomPayloadTranslator

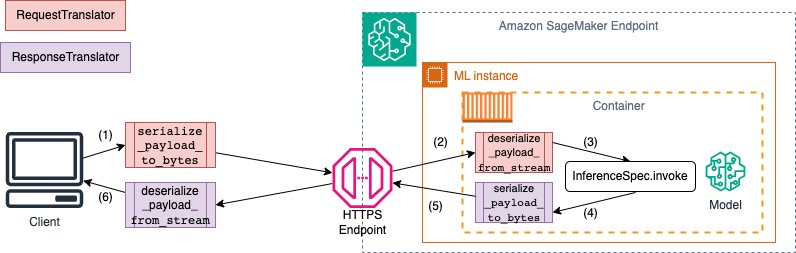

SageMaker エンドポイントを呼び出すと、データはさまざまな MIME タイプの HTTP ペイロードを通じて送信されます。 たとえば、推論のためにエンドポイントに送信された画像は、クライアント側でバイトに変換され、HTTP ペイロードを通じてエンドポイントに送信される必要があります。 エンドポイントがペイロードを受信すると、バイト文字列をモデルが予期するデータ型 (別名) に逆シリアル化する必要があります。 サーバー側の逆シリアル化)。 モデルが予測を完了した後、結果をバイトにシリアル化し、HTTP ペイロードを通じてユーザーまたはクライアントに送り返す必要があります。 クライアントが応答バイト データを受信すると、クライアント側で逆シリアル化を実行して、バイト データを JSON などの予期されるデータ形式に変換し直す必要があります。 最低でも、 次のデータを変換する必要があります (次の図に番号が付けられています):

- 推論リクエストのシリアル化 (クライアントによって処理される)

- 推論リクエストの逆シリアル化 (サーバーまたはアルゴリズムによって処理される)

- ペイロードに対してモデルを呼び出す

- 応答ペイロードを送り返す

- 推論応答のシリアル化 (サーバーまたはアルゴリズムによって処理)

- 推論応答の逆シリアル化 (クライアントによって処理される)

次の図は、呼び出しプロセス中のシリアル化と逆シリアル化のプロセスを示しています。

次のコード スニペットでは、次の例を示します。 CustomPayloadTranslator クライアント側とサーバー側でそれぞれシリアル化と逆シリアル化の両方を処理するために追加のカスタマイズが必要な場合:

デモモデルビルダー-pytorch.ipynb ノートブックでは、次を使用して PyTorch モデルを SageMaker エンドポイントに簡単にデプロイする方法を示します。 ModelBuilder CustomPayloadTranslator と InferenceSpec とに提供されます。

導入のためのステージモデル

モデルを推論用にステージングするか、モデル レジストリにステージングする場合は、次を使用できます。 model.create() or model.register()。 有効なモデルがサービス上に作成され、後でデプロイできます。 次のコードを参照してください。

カスタムコンテナを使用する

SageMaker が提供する 事前に構築された Docker イメージ 組み込みアルゴリズムと、トレーニングと推論に使用されるサポートされている深層学習フレームワークについて。 事前に構築された SageMaker コンテナがすべての要件を満たしていない場合は、ニーズに合わせて既存のイメージを拡張できます。 事前に構築されたイメージを拡張することで、イメージを最初から作成しなくても、含まれている深層学習ライブラリと設定を使用できます。 事前に構築されたコンテナを拡張する方法の詳細については、SageMaker ドキュメントを参照してください。 ModelBuilder は、事前に構築された Docker コンテナーから拡張された独自のコンテナーを導入する場合のユースケースをサポートします。

この場合、独自のコンテナ イメージを使用するには、フィールドを設定する必要があります。 image_uri および model_server 定義するとき ModelBuilder:

ここで、 image_uri アカウントのに保存されているコンテナ イメージ ARN になります。 Amazon エラスティック コンテナ レジストリ (Amazon ECR) リポジトリ。 一例を次に示します。

時 image_uri が設定されている間、 ModelBuilder ビルド プロセスでは、イメージ URI が指定されているため、イメージの自動検出はスキップされます。 もし model_server ModelBuilder に設定されていない場合は、次のような検証エラー メッセージが表示されます。

この投稿の公開時点では、 ModelBuilder 当社のコンテナを拡張した独自のコンテナの持ち込みをサポートします。 事前に構築された DLC コンテナ イメージ または、次のようなモデルサーバーで構築されたコンテナー ディープJavaライブラリ(DJL), テキスト生成推論 (TGI), トーチサーブ, Triton 推論サーバー.

カスタム依存関係

実行時 ModelBuilder.build()、デフォルトでは、Python 環境を自動的にキャプチャします。 requirements.txt ファイルを作成し、同じ依存関係をコンテナーにインストールします。 ただし、ローカルの Python 環境がコンテナ内の環境と競合する場合があります。 ModelBuilder は、カスタム構成を ModelBuilder。 これは、TorchServe と Triton のみに適用されることに注意してください。 InferenceSpec。 たとえば、次のように ModelBuilder で Python ディクショナリである入力パラメータの依存関係を指定できます。

次のフィールドを定義します。

- オート – 環境内の依存関係を自動キャプチャするかどうか。

- 必要条件 – 自分自身へのパスの文字列

requirements.txtファイル。 (これはオプションです。) - カスタム – 追加または変更するその他のカスタム依存関係のリスト。 (これはオプションです。)

同じモジュールを複数箇所で指定した場合、 custom が最も優先されます。 requirements, auto の優先度は最も低くなります。 たとえば、自動検出中に次のようになったとします。 ModelBuilder 検出 numpy==1.25、と requirements.txt を指定するファイルが提供されます numpy>=1.24,<1.26。 さらに、カスタムの依存関係があります。 custom = ["numpy==1.26.1"]。 この場合、 numpy==1.26.1 コンテナに依存関係をインストールするときに選択されます。

クリーンアップ

モデルのテストが完了したら、ベスト プラクティスとして、エンドポイントが不要になった場合はコストを節約するためにエンドポイントを削除します。 フォローすることができます クリーンアップ 各デモ ノートブックのセクションを削除するか、次のコードを使用して、デモによって作成されたモデルとエンドポイントを削除します。

まとめ

新しい SageMaker ModelBuilder 機能により、ML モデルを SageMaker の実稼働環境にデプロイするプロセスが簡素化されます。 ModelBuilder は、多くの複雑な詳細を舞台裏で処理することにより、新規ユーザーの学習曲線を短縮し、経験豊富なユーザーの利用率を最大化します。 わずか数行のコードで、XGBoost、PyTorch、Triton、Hugging Face などの組み込みフレームワークを備えたモデルや、SageMaker JumpStart によって提供されるモデルを、SageMaker 上の堅牢でスケーラブルなエンドポイントにデプロイできます。

すべての SageMaker ユーザーが、以下を参照してこの新しい機能を試してみることをお勧めします。 モデルビルダー ドキュメントページ。 ModelBuilder は現在、すべての SageMaker ユーザーが追加料金なしで利用できます。 この簡素化されたワークフローを利用して、モデルをより迅速にデプロイします。 ModelBuilder がどのようにモデル開発ライフサイクルを加速するかについてお聞きすることを楽しみにしています。

Sirisha Upadhyayala 氏、Raymond Liu 氏、Gary Wang 氏、Dhawal Patel 氏、Deepak Garg 氏、Ram Vegiraju 氏に心より感謝いたします。

著者について

メラニー・リー博士号は、オーストラリアのシドニーに拠点を置く AWS のシニア AI/ML スペシャリスト TAM です。 彼女は、企業顧客が AWS 上の最先端の AI/ML ツールを使用してソリューションを構築できるよう支援し、ベストプラクティスを使用した ML ソリューションの設計と実装に関するガイダンスを提供します。 余暇には、自然を探索したり、家族や友人と時間を過ごすのが大好きです。

メラニー・リー博士号は、オーストラリアのシドニーに拠点を置く AWS のシニア AI/ML スペシャリスト TAM です。 彼女は、企業顧客が AWS 上の最先端の AI/ML ツールを使用してソリューションを構築できるよう支援し、ベストプラクティスを使用した ML ソリューションの設計と実装に関するガイダンスを提供します。 余暇には、自然を探索したり、家族や友人と時間を過ごすのが大好きです。

マーク・カープ Amazon SageMaker Service チームの ML アーキテクトです。 彼は、お客様が大規模な ML ワークロードを設計、デプロイ、管理できるよう支援することに重点を置いています。 余暇には、旅行や新しい場所の探索を楽しんでいます。

マーク・カープ Amazon SageMaker Service チームの ML アーキテクトです。 彼は、お客様が大規模な ML ワークロードを設計、デプロイ、管理できるよう支援することに重点を置いています。 余暇には、旅行や新しい場所の探索を楽しんでいます。

サム・エドワーズは、機械学習と Amazon SageMaker を専門とする AWS シドニーのクラウド エンジニア (AI/ML) です。 彼は、顧客が機械学習ワークフローに関連する問題を解決できるよう支援し、顧客向けの新しいソリューションを作成することに情熱を注いでいます。 仕事以外では、ラケット スポーツをすることと旅行を楽しんでいます。

サム・エドワーズは、機械学習と Amazon SageMaker を専門とする AWS シドニーのクラウド エンジニア (AI/ML) です。 彼は、顧客が機械学習ワークフローに関連する問題を解決できるよう支援し、顧客向けの新しいソリューションを作成することに情熱を注いでいます。 仕事以外では、ラケット スポーツをすることと旅行を楽しんでいます。

ラグーラメシャ Amazon SageMaker サービスチームのシニア ML ソリューションアーキテクトです。 彼は、顧客が ML 本番ワークロードを大規模に構築、デプロイ、SageMaker に移行できるよう支援することに重点を置いています。 彼は機械学習、AI、コンピューター ビジョンの分野を専門とし、テキサス大学ダラス校でコンピューター サイエンスの修士号を取得しています。 自由時間には、旅行や写真撮影を楽しんでいます。

ラグーラメシャ Amazon SageMaker サービスチームのシニア ML ソリューションアーキテクトです。 彼は、顧客が ML 本番ワークロードを大規模に構築、デプロイ、SageMaker に移行できるよう支援することに重点を置いています。 彼は機械学習、AI、コンピューター ビジョンの分野を専門とし、テキサス大学ダラス校でコンピューター サイエンスの修士号を取得しています。 自由時間には、旅行や写真撮影を楽しんでいます。

シヴァ ラージ コティニ Amazon SageMaker 推論製品ポートフォリオのプリンシパルプロダクトマネージャーとして働いています。 彼は、推論のための SageMaker でのモデルのデプロイ、パフォーマンス チューニング、最適化に重点を置いています。

シヴァ ラージ コティニ Amazon SageMaker 推論製品ポートフォリオのプリンシパルプロダクトマネージャーとして働いています。 彼は、推論のための SageMaker でのモデルのデプロイ、パフォーマンス チューニング、最適化に重点を置いています。

モハンガンディー AWS のシニア ソフトウェア エンジニアです。 彼は過去 10 年間 AWS に勤務しており、EMR、EFA、RDS などのさまざまな AWS サービスに取り組んできました。 現在、彼は SageMaker Inference Experience の改善に重点を置いています。 余暇には、ハイキングやマラソンを楽しんでいます。

モハンガンディー AWS のシニア ソフトウェア エンジニアです。 彼は過去 10 年間 AWS に勤務しており、EMR、EFA、RDS などのさまざまな AWS サービスに取り組んできました。 現在、彼は SageMaker Inference Experience の改善に重点を置いています。 余暇には、ハイキングやマラソンを楽しんでいます。

- SEO を活用したコンテンツと PR 配信。 今日増幅されます。

- PlatoData.Network 垂直生成 Ai。 自分自身に力を与えましょう。 こちらからアクセスしてください。

- プラトアイストリーム。 Web3 インテリジェンス。 知識増幅。 こちらからアクセスしてください。

- プラトンESG。 カーボン、 クリーンテック、 エネルギー、 環境、 太陽、 廃棄物管理。 こちらからアクセスしてください。

- プラトンヘルス。 バイオテクノロジーと臨床試験のインテリジェンス。 こちらからアクセスしてください。

- 情報源: https://aws.amazon.com/blogs/machine-learning/package-and-deploy-classical-ml-and-llms-easily-with-amazon-sagemaker-part-1-pysdk-improvements/

- :持っている

- :は

- :not

- :どこ

- $UP

- 1

- 10

- 100

- 11

- 114

- 12

- 125

- 13

- 14

- 視聴者の38%が

- 16

- 17

- 20

- 24

- 視聴者の38%が

- 7

- 8

- 9

- a

- ABC

- 能力

- 私たちについて

- 加速する

- 加速器

- アクセス

- 対応する

- 従った

- 越えて

- 実際の

- 加えます

- 添加

- NEW

- さらに

- 高度な

- 利点

- 後

- に対して

- AI

- aiのユースケース

- AI / ML

- 目指して

- アルゴリズム

- アルゴリズム

- 整列

- すべて

- 許可

- ことができます

- また

- しかし

- Amazon

- アマゾンセージメーカー

- Amazon Webサービス

- 間で

- an

- および

- どれか

- API

- 適切な

- です

- AS

- 関連する

- At

- オーストラリア

- オート

- 自動化

- 自動的に

- 利用できます

- 平均

- AWS

- バック

- ベース

- BE

- なぜなら

- き

- 背後に

- 舞台裏で

- 有益な

- 利点

- BEST

- ベストプラクティス

- より良いです

- の間に

- 両言語で

- 持参

- もたらす

- ビルド

- ビルダー

- 内蔵

- 内蔵

- by

- コール

- 呼び出し

- コール

- 缶

- 機能

- 機能

- キャプチャー

- 捕捉した

- キャプチャ

- キャプチャ

- これ

- 場合

- 例

- 変化する

- 変更

- 変化

- チャージ

- 選択

- class

- クライアント

- クラウド

- コード

- コメント

- 複雑な

- 複雑さ

- コンポーネント

- コンポーネント

- コンピュータ

- コンピュータサイエンス

- Computer Vision

- 構成する

- 紛争

- 競合

- 整合性のある

- 領事

- コンテナ

- コンテナ

- コントロール

- 変換

- 変換

- 変換

- 正しい

- 対応する

- コスト

- 作ります

- 作成した

- 作成

- 現在

- 曲線

- カスタム

- Customers

- カスタム化

- カスタマイズ

- カスタマイズ

- ダラス

- データ

- 深いです

- ディープダイブ

- 深い学習

- ディーパック

- デフォルト

- 定義します

- 定義する

- 定義

- 度

- デモ

- 実証します

- 依存関係

- 依存関係

- 展開します

- 展開

- 展開する

- 展開

- 配備

- 配備する

- 設計

- 詳細な

- 細部

- 検出

- 決定する

- 決定

- Developer

- 開発者

- 開発

- 異なります

- 直接に

- 話し合います

- ディストリビューション

- ダイビング

- do

- デッカー

- ドキュメント

- ドキュメント

- そうではありません

- ドメイン

- 行われ

- ドント

- 間に

- 各

- 前

- 容易

- 簡単に

- 効率良く

- 努力

- 楽

- 使用可能

- 可能

- 奨励する

- エンドポイント

- エンジニア

- エンジニア

- 確保

- 確保する

- Enterprise

- エントリ

- 環境

- エラー

- エラー

- 本質的な

- 例

- 例

- 既存の

- 予想される

- 期待する

- 体験

- 経験豊かな

- 探る

- 探る

- 伸ばす

- 延伸

- 顔

- 容易にする

- 家族

- 速いです

- 特徴

- 少数の

- フィールズ

- File

- 名

- 修正する

- 柔軟性

- 焦点を当て

- 焦点を当てて

- フォロー中

- 次

- 形式でアーカイブしたプロジェクトを保存します.

- フォワード

- Foundation

- フレームワーク

- フレームワーク

- 無料版

- 友達

- から

- 満たす

- フル

- 完全に

- function

- 機能

- さらに

- ガーグ

- ゲーリー

- ゲイリー・ワン

- ゲット

- 生成する

- 生成

- 世代

- 生々しい

- 生成AI

- 取得する

- 受け

- GitHubの

- 行く

- 素晴らしい

- ガイダンス

- ハンドル

- ハンドリング

- 起こります

- 持ってる

- 持って

- he

- 耳

- 助けます

- 助け

- ことができます

- 彼女の

- ハイレベル

- 最高

- 彼の

- 保持している

- 主催

- ホスティング

- ホスティングサービス

- 認定条件

- How To

- しかしながら

- HTML

- HTTP

- HTTPS

- ハブ

- ID

- 識別する

- アイデンティティ

- イド

- if

- 画像

- 実装

- import

- 改善

- 向上させる

- 改善

- in

- 含まれました

- 入ってくる

- 情報

- 初期

- 入力

- install

- 統合

- 相互作用的

- に

- 紹介する

- 導入

- 概要

- 呼び出された

- 問題

- IT

- ITS

- Java

- JPG

- JSON

- ただ

- キー

- 知っている

- 既知の

- 大

- 姓

- 後で

- 最新の

- 起動する

- 発射

- 層

- 学習

- ライブラリ

- 図書館

- ような

- ライン

- リスト

- ライブ

- ラマ

- 負荷

- ローディング

- ローカル

- 局部的に

- 場所

- ロギング

- ロジック

- より長いです

- 見て

- 探して

- で

- 最低

- 機械

- 機械学習

- make

- 作る

- 作成

- 管理します

- マネージド

- マネージャー

- マニュアル

- 多くの

- マスターの

- 最大化します

- 最大化する

- 五月..

- メカニズム

- メモリ

- 言及した

- メッセージ

- 方法

- 移動します

- 最小限の

- 最小

- ML

- MLOps

- モード

- モデル

- 修正する

- モジュール

- 他には?

- 最も

- の試合に

- しなければなりません

- 自然

- 必要

- 必要

- 必要とされる

- ニーズ

- 新作

- 新しい利用者

- いいえ

- なし

- 注意

- ノート

- 今

- 数

- 数の

- オブジェクト

- オブジェクト

- of

- オファー

- on

- ONE

- の

- 〜に

- 最適な

- 最適化

- 最適化

- 最適化

- オプション

- or

- その他

- 私たちの

- でる

- 出力

- outputs

- 外側

- 自分の

- パッケージ

- パッケージ化された

- 包装

- ページ

- パラメーター

- パラメータ

- 部

- 特に

- パス

- 通過

- 情熱的な

- path

- 実行する

- パフォーマンス

- パーミッション

- 個人的な

- 博士号

- 写真撮影

- ピックアップ

- パイプライン

- 場所

- プラトン

- プラトンデータインテリジェンス

- プラトデータ

- 遊び場

- 再生

- ポイント

- ポートフォリオ

- ポスト

- 電力

- 練習

- プラクティス

- 予測する

- 予測

- Predictor

- 前

- 校長

- 優先順位

- 手続き

- プロセス

- ラボレーション

- プロダクト

- プロダクトマネージャー

- 生産

- 生産性

- 提供します

- 提供

- は、大阪で

- 提供

- 出版

- プッシュ

- Python

- パイトーチ

- すぐに

- RAM

- 準備

- 受け取ります

- 受け取り

- 軽減

- 縮小

- 参照する

- レジストリ

- 関連する

- リモート

- 倉庫

- 要求

- リクエスト

- 必要とする

- の提出が必要です

- 要件

- 必要

- それらの

- それぞれ

- 応答

- REST

- 結果

- return

- 堅牢な

- 職種

- 役割

- ラン

- ランニング

- セージメーカー

- SageMaker の推論

- 同じ

- Save

- 保存されました

- 言う

- スケーラビリティ

- ド電源のデ

- 規模

- スキャン

- シーン

- 科学

- 科学者たち

- スクラッチ

- スクリプト

- SDDK

- SDK

- シームレス

- セクション

- セクション

- select

- 選択

- 自己

- シニア

- 送信

- シリーズ

- 役立つ

- サーバー

- サービス

- サービス

- セッションに

- 設定

- 彼女

- 表示する

- ショーケース

- 示す

- 作品

- 側

- 簡単な拡張で

- 簡略化されました

- 簡素化する

- 簡素化する

- 単に

- スムーズ

- スニペット

- So

- ソフトウェア

- ソフトウェアエンジニア

- ソリューション

- 解決する

- 一部

- 時々

- 専門家

- 専門の

- 専門にする

- 特定の

- 指定の

- 過ごす

- スポーツ

- ステージ

- 最先端の

- ステップ

- まだ

- ストレージ利用料

- 店舗

- 保存され

- 簡単な

- 流れ

- 流線

- 文字列

- 構造

- 構造

- 研究

- そのような

- サポート

- サポート

- スイッチ

- シドニー

- テーラー

- 取る

- 取得

- タスク

- チーム

- テンソルフロー

- test

- テスト

- 클라우드 기반 AI/ML및 고성능 컴퓨팅을 통한 디지털 트윈의 기초 – Edward Hsu, Rescale CPO 많은 엔지니어링 중심 기업에게 클라우드는 R&D디지털 전환의 첫 단계일 뿐입니다. 클라우드 자원을 활용해 엔지니어링 팀의 제약을 해결하는 단계를 넘어, 시뮬레이션 운영을 통합하고 최적화하며, 궁극적으로는 모델 기반의 협업과 의사 결정을 지원하여 신제품을 결정할 때 데이터 기반 엔지니어링을 적용하고자 합니다. Rescale은 이러한 혁신을 돕기 위해 컴퓨팅 추천 엔진, 통합 데이터 패브릭, 메타데이터 관리 등을 개발하고 있습니다. 이번 자리를 빌려 비즈니스 경쟁력 제고를 위한 디지털 트윈 및 디지털 스레드 전략 개발 방법에 대한 인사이트를 나누고자 합니다.

- 感謝

- それ

- アプリ環境に合わせて

- それら

- その後

- そこ。

- ボーマン

- 彼ら

- この

- 介して

- 時間

- 〜へ

- トークン

- 豊富なツール群

- 伝統的な

- トラフィック

- トレーニング

- トレーニング

- 変換

- トランス

- 遷移

- 移行した

- インタビュー

- 旅行

- トリトン

- true

- 信頼

- 試します

- チューニング

- 2

- type

- 根本的な

- URL

- つかいます

- 中古

- ユーザー

- users

- 使用されます

- 値

- 変数

- さまざまな

- 、

- ビジョン

- 歩く

- 欲しいです

- 仕方..

- 方法

- we

- ウェブ

- Webサービス

- WELL

- いつ

- かどうか

- which

- while

- 意志

- 無し

- 仕事

- 働いていました

- ワークフロー

- ワークフロー

- ワーキング

- 作品

- でしょう

- XGブースト

- 年

- You

- あなたの

- ゼファーネット