アマゾンセージメーカー マルチモデルエンドポイント (MME) これは、SageMaker 推論のフルマネージド機能であり、単一のエンドポイントに数千のモデルをデプロイできるようになります。以前は、MME は、モデルのトラフィック負荷に関係なく、モデルに CPU コンピューティング能力を事前に決定して静的に割り当てていました。 マルチモデルサーバー (MMS) そのモデルサーバーとして。この投稿では、MME がモデルのトラフィック パターンに基づいて各モデルに割り当てられた計算能力を動的に調整できるソリューションについて説明します。このソリューションにより、MME の基盤となるコンピューティングをより効率的に使用し、コストを節約できます。

MME は、エンドポイントへの受信トラフィックに基づいてモデルを動的にロードおよびアンロードします。 MMS をモデル サーバーとして利用する場合、MME はモデルごとに固定数のモデル ワーカーを割り当てます。詳細については、以下を参照してください。 Amazon SageMaker のモデルホスティングパターン、パート 3: Amazon SageMaker マルチモデルエンドポイントを使用してマルチモデル推論を実行および最適化する.

ただし、トラフィック パターンが変化する場合、これによりいくつかの問題が発生する可能性があります。大量のトラフィックを受信する単一または少数のモデルがあるとします。これらのモデルに多数のワーカーを割り当てるように MMS を構成できますが、これは静的な構成であるため、MME の背後にあるすべてのモデルに割り当てられます。これにより、アイドル状態のモデルも含め、多数のワーカーがハードウェア コンピューティングを使用することになります。ワーカー数に小さい値を設定すると、逆の問題が発生する可能性があります。一般的なモデルには、モデル サーバー レベルでこれらのモデルのエンドポイントの背後に十分なハードウェアを適切に割り当てるのに十分なワーカーがありません。主な問題は、モデル サーバー レベルでワーカーを動的に拡張して必要なコンピューティング量を割り当てることができない場合、トラフィック パターンに依存しない状態を維持するのが難しいことです。

この投稿で説明するソリューションでは、 DJLサービング これは、説明した問題の一部を軽減し、モデルごとのスケーリングを可能にし、MME がトラフィック パターンに依存しないようにするのに役立ちます。

MME アーキテクチャ

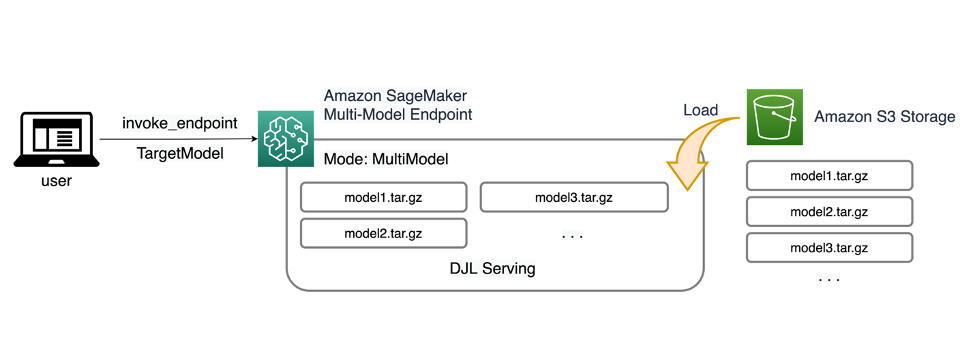

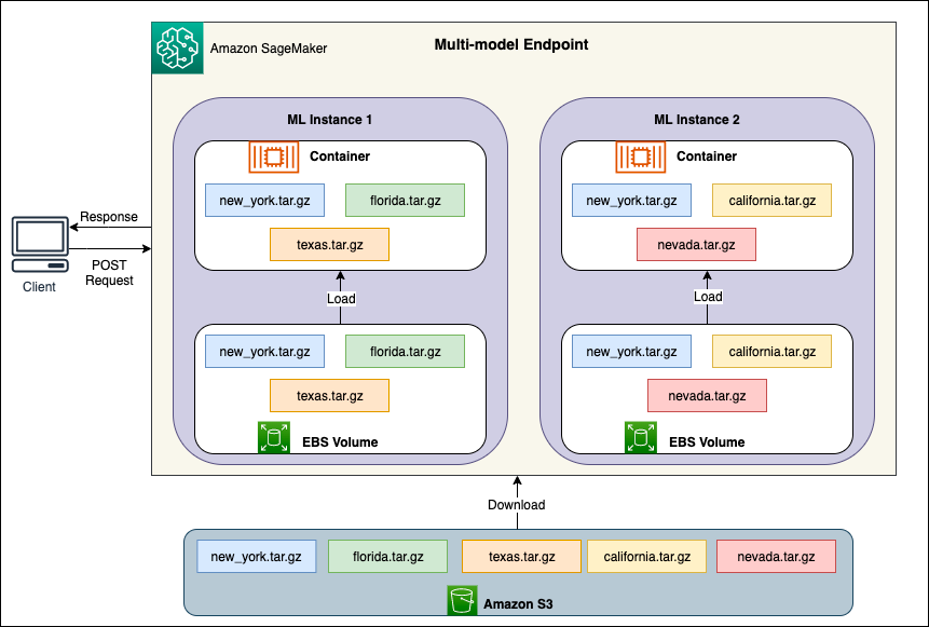

SageMaker MME を使用すると、1 つ以上のインスタンスを含む単一の推論エンドポイントの背後に複数のモデルをデプロイできます。各インスタンスは、メモリと CPU/GPU の容量まで複数のモデルをロードして提供するように設計されています。このアーキテクチャを使用すると、SaaS (Software as a Service) ビジネスは、複数のモデルをホスティングするために直線的に増加するコストを打破し、アプリケーション スタックの他の場所に適用されるマルチテナント モデルと一致するインフラストラクチャの再利用を実現できます。次の図は、このアーキテクチャを示しています。

SageMaker MME はモデルを動的にロードします。 Amazon シンプル ストレージ サービス (Amazon S3) エンドポイントが最初に作成されたときにすべてのモデルをダウンロードするのではなく、呼び出されたときに。その結果、モデルへの最初の呼び出しでは、低レイテンシで完了する後続の推論よりも長い推論レイテンシが発生する可能性があります。モデルが呼び出されたときにすでにコンテナーにロードされている場合、ダウンロード手順はスキップされ、モデルは低レイテンシーで推論を返します。たとえば、XNUMX 日に数回しか使用されないモデルがあるとします。オンデマンドで自動的にロードされますが、頻繁にアクセスされるモデルはメモリに保持され、一貫して低い待機時間で呼び出されます。

次の図に示すように、各 MME の背後にはモデル ホスティング インスタンスがあります。これらのインスタンスは、モデルへのトラフィック パターンに基づいて、複数のモデルをメモリに読み込み、メモリから削除します。

SageMaker は、キャッシュされたモデルのコピーからリクエストが提供されるように、モデルの推論リクエストをモデルがすでにロードされているインスタンスにルーティングし続けます (次の図を参照してください。最初の予測リクエストとキャッシュされた予測のリクエスト パスを示しています)リクエストパス)。ただし、モデルが多くの呼び出しリクエストを受信し、MME に追加のインスタンスがある場合、SageMaker は増加に対応するために一部のリクエストを別のインスタンスにルーティングします。 SageMaker で自動モデル スケーリングを利用するには、次の条件が揃っていることを確認してください。 インスタンスの自動スケーリングの設定 追加のインスタンス容量をプロビジョニングします。 カスタムパラメーターまたはXNUMX分あたりの呼び出し数(推奨)を使用してエンドポイントレベルのスケーリングポリシーを設定し、エンドポイントフリートにインスタンスを追加します。

モデルサーバーの概要

モデル サーバーは、機械学習 (ML) モデルをデプロイおよび提供するためのランタイム環境を提供するソフトウェア コンポーネントです。これは、トレーニングされたモデルと、それらのモデルを使用して予測を行うクライアント アプリケーションの間のインターフェイスとして機能します。

モデル サーバーの主な目的は、ML モデルを実稼働システムに簡単に統合し、効率的にデプロイできるようにすることです。モデル サーバーは、モデルをアプリケーションや特定のフレームワークに直接埋め込むのではなく、複数のモデルを展開、管理、提供できる集中プラットフォームを提供します。

モデル サーバーは通常、次の機能を提供します。

- モデルの読み込み – サーバーはトレーニングされた ML モデルをメモリにロードし、予測を提供できるようにします。

- 推論API – サーバーは、クライアント アプリケーションが入力データを送信し、デプロイされたモデルから予測を受信できるようにする API を公開します。

- スケーリング – モデル サーバーは、複数のクライアントからの同時リクエストを処理するように設計されています。これらは、並列処理とリソースの効率的な管理のためのメカニズムを提供し、高スループットと低遅延を確保します。

- バックエンドエンジンとの統合 – モデル サーバーは、DeepSpeed や FasterTransformer などのバックエンド フレームワークと統合されており、大規模なモデルを分割し、高度に最適化された推論を実行します。

DJL アーキテクチャ

DJLサービング は、オープンソース、高性能、ユニバーサル モデルのサーバーです。 DJL Serving は、 Djl、Java プログラミング言語で書かれた深層学習ライブラリ。深層学習モデル、複数のモデル、またはワークフローを取得し、HTTP エンドポイントを通じて利用できるようにします。 DJL Serving は、PyTorch、TensorFlow、Apache MXNet、ONNX、TensorRT、Hugging Face Transformers、DeepSpeed、FasterTransformer などの複数のフレームワークからのモデルのデプロイをサポートしています。

DJL Serving は、モデルを高パフォーマンスでデプロイできるようにする多くの機能を提供します。

- 使いやすさ – DJL Serving は、ほとんどのモデルをそのまま使用できます。モデル アーティファクトを持ち込むだけで、DJL Serving がそれらをホストできます。

- 複数のデバイスとアクセラレータのサポート – DJL Serving は、CPU、GPU、および AWSインフェレンティア.

- 性能 – DJL Serving は単一の JVM でマルチスレッド推論を実行し、スループットを向上させます。

- 動的バッチ処理 – DJL Serving は、スループットを向上させるための動的バッチ処理をサポートしています。

- 自動スケーリング – DJL Serving は、トラフィック負荷に基づいてワーカーを自動的にスケールアップおよびスケールダウンします。

- マルチエンジンのサポート – DJL Serving は、異なるフレームワーク (PyTorch や TensorFlow など) を使用してモデルを同時にホストできます。

- アンサンブルとワークフローのモデル – DJL Serving は、複数のモデルで構成される複雑なワークフローの展開をサポートし、ワークフローの一部を CPU で実行し、一部を GPU で実行します。ワークフロー内のモデルはさまざまなフレームワークを使用できます。

特に、DJL Serving の自動スケーリング機能を使用すると、受信トラフィックに合わせてモデルが適切にスケーリングされるようにすることが簡単になります。デフォルトでは、DJL Serving は、使用可能なハードウェア (CPU コア、GPU デバイス) に基づいて、サポートできるモデルのワーカーの最大数を決定します。モデルごとに下限と上限を設定して、常に最小トラフィック レベルが提供され、単一のモデルが利用可能なリソースをすべて消費しないようにすることができます。

DJL サービングでは、 ネッティー バックエンド ワーカー スレッド プールの上にフロントエンドを配置します。フロントエンドは、複数の Netty セットアップを 1 つ使用します。 HttpRequestHandlers。さまざまなリクエスト ハンドラーがサポートを提供します。 推論API, 管理API、またはさまざまなプラグインから利用できるその他の API。

バックエンドは以下をベースにしています ワークロードマネージャー (WLM) モジュール。 WLM は、各モデルの複数のワーカー スレッドをバッチ処理およびそれらへのリクエスト ルーティングとともに処理します。複数のモデルが提供される場合、WLM は最初に各モデルの推論リクエスト キュー サイズをチェックします。キュー サイズがモデルのバッチ サイズの 2 倍を超える場合、WLM はそのモデルに割り当てられるワーカーの数をスケールアップします。

ソリューションの概要

MME を使用した DJL の実装は、デフォルトの MMS セットアップとは異なります。 MME を使用した DJL Serving の場合、SageMaker Inference が期待する model.tar.gz 形式で次のファイルを圧縮します。

- モデル.ジョブライブラリ – この実装では、モデルのメタデータを tarball に直接プッシュします。この場合、私たちは、

.joblibファイルがあるため、推論スクリプトが読み取るためにそのファイルを tarball に提供します。アーティファクトが大きすぎる場合は、それを Amazon S3 にプッシュし、DJL 用に定義したサービス設定でそのアーティファクトを指すようにすることもできます。 - サービング.プロパティ – ここでは、サーバー関連のモデルを設定できます。 環境変数。ここでの DJL の強みは、次のような設定ができることです。

minWorkersおよびmaxWorkers各モデルのtarball。これにより、各モデルをモデル サーバー レベルでスケールアップおよびスケールダウンできるようになります。たとえば、単一のモデルが MME のトラフィックの大部分を受信している場合、モデル サーバーはワーカーを動的にスケールアップします。この例では、これらの変数を構成せず、トラフィック パターンに応じて必要なワーカーの数を DJL に決定させます。 - モデル.py – これは、実装するカスタムの前処理または後処理の推論スクリプトです。 model.py は、デフォルトでロジックがハンドル メソッドにカプセル化されることを期待します。

- 要件.txt (オプション) – デフォルトでは、DJL は PyTorch とともにインストールされますが、必要な追加の依存関係はここにプッシュできます。

この例では、サンプル SKLearn モデルを使用して、MME を使用した DJL の機能を紹介します。このモデルを使用してトレーニング ジョブを実行し、MME をサポートするためにこのモデル アーティファクトのコピーを 1,000 個作成します。次に、MME が受信する可能性のあるあらゆる種類のトラフィック パターンを処理するために DJL がどのように動的に拡張できるかを紹介します。これには、すべてのモデルにわたるトラフィックの均等な分散、またはトラフィックの大部分を受信するいくつかの人気のあるモデルが含まれる場合があります。すべてのコードは次の場所にあります。 GitHubレポ.

前提条件

この例では、conda_python3 カーネルと ml.c5.xlarge インスタンスを持つ SageMaker ノートブック インスタンスを使用します。負荷テストを実行するには、 アマゾン エラスティック コンピューティング クラウド (Amazon EC2) インスタンスまたはより大きな SageMaker ノートブック インスタンス。この例では、2 秒あたり 5.18 トランザクション (TPS) を超えるまでスケールするため、より多くのコンピューティングを使用できるように、ml.cXNUMXxlarge などのより重い ECXNUMX インスタンスでテストすることをお勧めします。

モデルアーティファクトを作成する

まず、この例で使用するモデル アーティファクトとデータを作成する必要があります。このケースでは、NumPy で人工データを生成し、次のコード スニペットで SKLearn 線形回帰モデルを使用してトレーニングします。

上記のコードを実行すると、次のようになります。 model.joblib ローカル環境で作成されたファイル。

DJL Docker イメージをプルする

Docker イメージ djl-inference:0.23.0-cpu-full-v1.0 は、この例で使用される DJL サービング コンテナーです。お住まいの地域に応じて、次の URL を調整できます。

inference_image_uri = "474422712127.dkr.ecr.us-east-1.amazonaws.com/djl-serving-cpu:latest"

オプションで、このイメージを基本イメージとして使用し、それを拡張して独自の Docker イメージを構築することもできます。 Amazon エラスティック コンテナ レジストリ (Amazon ECR) と必要な他の依存関係を追加します。

モデルファイルを作成する

まず、というファイルを作成します。 serving.properties。これにより、DJLServing に Python エンジンを使用するように指示されます。また、 max_idle_time ワーカーの時間は 600 秒になります。これにより、モデルごとのワーカー数をスケールダウンするのにかかる時間が長くなります。私たちは調整しません minWorkers および maxWorkers これを定義し、各モデルが受信しているトラフィックに応じて必要なワーカーの数を DJL に動的に計算させます。 serving.properties は次のように示されます。構成オプションの完全なリストを確認するには、次を参照してください。 エンジン構成.

次に、モデルの読み込みと推論ロジックを定義する model.py ファイルを作成します。 MME の場合、各 model.py ファイルはモデルに固有です。モデルは、モデル ストアの下の独自のパスに保存されます (通常は /opt/ml/model/)。モデルをロードするとき、モデルは独自のディレクトリのモデル ストア パスの下にロードされます。このデモの完全な model.py サンプルは、次の場所にあります。 GitHubレポ.

作成します model.tar.gz モデルを含むファイル (model.joblib), model.py, serving.properties:

デモンストレーションの目的で、同じものを 1,000 部作成します。 model.tar.gz ファイルを使用して、ホストされる多数のモデルを表現します。運用環境では、 model.tar.gz 各モデルのファイルを作成します。

最後に、これらのモデルを Amazon S3 にアップロードします。

SageMaker モデルを作成する

ここで、 SageMakerモデル。前に定義した ECR イメージと前のステップのモデル アーティファクトを使用して、SageMaker モデルを作成します。モデルのセットアップでは、モードを MultiModel として構成します。これにより、MME を作成していることが DJLServing に伝えられます。

SageMakerエンドポイントを作成する

このデモでは、20 個の ml.c5d.18xlarge インスタンスを使用して、数千の範囲の TPS にスケールします。目標とする TPS を達成するために、必要に応じてインスタンス タイプの制限を引き上げてください。

負荷テスト

執筆時点では、SageMaker 社内負荷テスト ツール AmazonSageMaker推論レコメンダー MME のテストはネイティブにサポートされていません。したがって、オープンソースのPythonツールを使用します イナゴ。 Locust はセットアップが簡単で、TPS やエンドツーエンドの遅延などの指標を追跡できます。 SageMaker を使用してセットアップする方法を完全に理解するには、次を参照してください。 Amazon SageMaker リアルタイム推論エンドポイントの負荷テストのベストプラクティス.

この使用例では、MME でシミュレートしたい 3 つの異なるトラフィック パターンがあるため、各パターンに合わせた次の 3 つの Python スクリプトがあります。ここでの目標は、トラフィック パターンに関係なく、同じ目標 TPS を達成し、適切に拡張できることを証明することです。

Locust スクリプトで重みを指定して、モデルのさまざまな部分にトラフィックを割り当てることができます。たとえば、単一のホット モデルでは、次の 2 つのメソッドを実装します。

次に、各メソッドに特定の重みを割り当てることができます。これは、特定のメソッドが特定の割合のトラフィックを受信する場合に当てはまります。

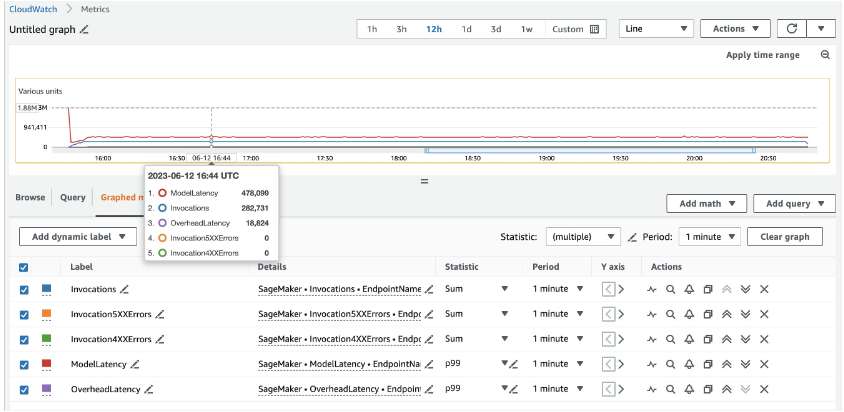

20 個の ml.c5d.18xlarge インスタンスの場合、 アマゾンクラウドウォッチ コンソール。これらの値は、3 つのトラフィック パターンすべてにわたってほぼ一貫しています。 SageMaker リアルタイム推論と MME の CloudWatch メトリクスをよりよく理解するには、以下を参照してください。 SageMakerエンドポイント呼び出しメトリクス.

残りの Locust スクリプトは次の場所にあります。 locust-utils ディレクトリ GitHub リポジトリ内。

まとめ

この投稿では、MME がモデルのトラフィック パターンに基づいて各モデルに割り当てられた計算能力を動的に調整する方法について説明しました。この新しく開始された機能は、SageMaker が利用可能なすべての AWS リージョンで利用できます。発表時点では、CPU インスタンスのみがサポートされていることに注意してください。詳細については、を参照してください。 サポートされているアルゴリズム、フレームワーク、およびインスタンス.

著者について

ラム・ベギラージュ SageMaker サービスチームの ML アーキテクトです。 彼は、お客様が Amazon SageMaker で AI/ML ソリューションを構築および最適化するのを支援することに重点を置いています。 余暇には、旅行と執筆が大好きです。

ラム・ベギラージュ SageMaker サービスチームの ML アーキテクトです。 彼は、お客様が Amazon SageMaker で AI/ML ソリューションを構築および最適化するのを支援することに重点を置いています。 余暇には、旅行と執筆が大好きです。

チンウェイ・リー アマゾンウェブサービスの機械学習スペシャリストです。 彼は博士号を取得しました。 アドバイザーの研究助成金口座を破り、約束したノーベル賞を授与できなかった後、オペレーションズリサーチで。 現在、彼は金融サービスおよび保険業界の顧客がAWSで機械学習ソリューションを構築するのを支援しています。 暇なときは、読書と教育が好きです。

チンウェイ・リー アマゾンウェブサービスの機械学習スペシャリストです。 彼は博士号を取得しました。 アドバイザーの研究助成金口座を破り、約束したノーベル賞を授与できなかった後、オペレーションズリサーチで。 現在、彼は金融サービスおよび保険業界の顧客がAWSで機械学習ソリューションを構築するのを支援しています。 暇なときは、読書と教育が好きです。

ジェームズ・ウー AWSのシニアAI/MLスペシャリストソリューションアーキテクトです。 お客様がAI/MLソリューションを設計および構築するのを支援します。 Jamesの仕事は、コンピュータビジョン、ディープラーニング、企業全体でのMLのスケーリングに主な関心を持って、幅広いMLユースケースをカバーしています。 AWSに入社する前、Jamesは、エンジニアリングで10年間、マーケティングおよび広告業界で6年間を含む、4年以上にわたってアーキテクト、開発者、およびテクノロジーのリーダーでした。

ジェームズ・ウー AWSのシニアAI/MLスペシャリストソリューションアーキテクトです。 お客様がAI/MLソリューションを設計および構築するのを支援します。 Jamesの仕事は、コンピュータビジョン、ディープラーニング、企業全体でのMLのスケーリングに主な関心を持って、幅広いMLユースケースをカバーしています。 AWSに入社する前、Jamesは、エンジニアリングで10年間、マーケティングおよび広告業界で6年間を含む、4年以上にわたってアーキテクト、開発者、およびテクノロジーのリーダーでした。

サウラブ・トリカンデ Amazon SageMaker Inference のシニア プロダクト マネージャーです。 彼は顧客と協力することに情熱を傾けており、機械学習を民主化するという目標に動機付けられています。 彼は、複雑な ML アプリケーションのデプロイ、マルチテナント ML モデル、コストの最適化、およびディープ ラーニング モデルのデプロイをよりアクセスしやすくすることに関連する主要な課題に焦点を当てています。 余暇には、Saurabh はハイキングを楽しんだり、革新的なテクノロジーについて学んだり、TechCrunch をフォローしたり、家族と過ごしたりしています。

サウラブ・トリカンデ Amazon SageMaker Inference のシニア プロダクト マネージャーです。 彼は顧客と協力することに情熱を傾けており、機械学習を民主化するという目標に動機付けられています。 彼は、複雑な ML アプリケーションのデプロイ、マルチテナント ML モデル、コストの最適化、およびディープ ラーニング モデルのデプロイをよりアクセスしやすくすることに関連する主要な課題に焦点を当てています。 余暇には、Saurabh はハイキングを楽しんだり、革新的なテクノロジーについて学んだり、TechCrunch をフォローしたり、家族と過ごしたりしています。

シュー・デン SageMaker チームのソフトウェア エンジニア マネージャーです。彼は、顧客が Amazon SageMaker で AI/ML 推論エクスペリエンスを構築および最適化できるよう支援することに重点を置いています。余暇には、旅行とスノーボードが大好きです。

シュー・デン SageMaker チームのソフトウェア エンジニア マネージャーです。彼は、顧客が Amazon SageMaker で AI/ML 推論エクスペリエンスを構築および最適化できるよう支援することに重点を置いています。余暇には、旅行とスノーボードが大好きです。

シッダールス・ベンカテサン は、AWS 深層学習のソフトウェア エンジニアです。 彼は現在、大規模なモデルの推論のためのソリューションの構築に注力しています。 AWS に入社する前は、Amazon Grocery 組織で働き、世界中の顧客向けに新しい支払い機能を構築していました。 仕事以外では、スキー、アウトドア、スポーツ観戦を楽しんでいます。

シッダールス・ベンカテサン は、AWS 深層学習のソフトウェア エンジニアです。 彼は現在、大規模なモデルの推論のためのソリューションの構築に注力しています。 AWS に入社する前は、Amazon Grocery 組織で働き、世界中の顧客向けに新しい支払い機能を構築していました。 仕事以外では、スキー、アウトドア、スポーツ観戦を楽しんでいます。

ロヒト・ナラマディ AWS のソフトウェア開発エンジニアです。 彼は、GPU でのディープ ラーニング ワークロードの最適化、高性能 ML 推論の構築、ソリューションの提供に取り組んでいます。 それ以前は、Amazon F3 ビジネス向けの AWS ベースのマイクロサービスの構築に取り組んでいました。 仕事以外では、スポーツをしたり観戦したりしています。

ロヒト・ナラマディ AWS のソフトウェア開発エンジニアです。 彼は、GPU でのディープ ラーニング ワークロードの最適化、高性能 ML 推論の構築、ソリューションの提供に取り組んでいます。 それ以前は、Amazon F3 ビジネス向けの AWS ベースのマイクロサービスの構築に取り組んでいました。 仕事以外では、スポーツをしたり観戦したりしています。

- SEO を活用したコンテンツと PR 配信。 今日増幅されます。

- PlatoData.Network 垂直生成 Ai。 自分自身に力を与えましょう。 こちらからアクセスしてください。

- プラトアイストリーム。 Web3 インテリジェンス。 知識増幅。 こちらからアクセスしてください。

- プラトンESG。 カーボン、 クリーンテック、 エネルギー、 環境、 太陽、 廃棄物管理。 こちらからアクセスしてください。

- プラトンヘルス。 バイオテクノロジーと臨床試験のインテリジェンス。 こちらからアクセスしてください。

- 情報源: https://aws.amazon.com/blogs/machine-learning/run-ml-inference-on-unplanned-and-spiky-traffic-using-amazon-sagemaker-multi-model-endpoints/

- :は

- :どこ

- $UP

- 000

- 1

- 10

- 100

- 116

- 118

- 12

- 16

- 17

- 20

- 23

- 31

- 600

- 7

- 9

- a

- 私たちについて

- 加速器

- アクセス

- アクセス可能な

- 対応する

- 達成する

- 越えて

- 使徒行伝

- 加えます

- NEW

- 利点

- 広告運用

- 後

- AI / ML

- アルゴリズム

- 整列する

- すべて

- 割り当てる

- 割り当てられました

- 許す

- ことができます

- 沿って

- 既に

- また

- 常に

- Amazon

- Amazon EC2

- アマゾンセージメーカー

- Amazon Webサービス

- 量

- an

- および

- お知らせ

- 別の

- どれか

- アパッチ

- API

- API

- 申し込み

- 適用された

- 適切に

- 建築

- です

- 周りに

- 人工の

- AS

- 割り当てられた

- 引き受けます

- At

- オート

- 自動化

- 自動的に

- 利用できます

- AWS

- バック

- バックエンド

- ベース

- ベース

- バッチング

- BE

- なぜなら

- 背後に

- より良いです

- の間に

- ボディ

- ブースト

- 境界

- ボックス

- ブレーク

- 持って来る

- 壊れた

- ビルド

- 建物

- 内蔵

- ビジネス

- 焙煎が極度に未発達や過発達のコーヒーにて、クロロゲン酸の味わいへの影響は強くなり、金属を思わせる味わいと乾いたマウスフィールを感じさせます。

- by

- 呼ばれます

- 缶

- 機能

- 容量

- これ

- 場合

- 例

- セル

- 集中型の

- 一定

- 課題

- 小切手

- class

- クライアント

- クライアント

- コード

- comes

- コンプリート

- 記入済みの

- 複雑な

- コンポーネント

- 構成

- 計算

- コンピュータ

- Computer Vision

- コンピューティング

- コンピューティングパワー

- 同時

- 整合性のある

- 一貫して

- 領事

- 消費する

- 含む

- コンテナ

- コンテキスト

- 続ける

- 基本

- 費用

- コスト

- カバー

- 作ります

- 作成した

- 作成

- 現在

- カスタム

- Customers

- データ

- 中

- 深いです

- 深い学習

- デフォルト

- 定義します

- 定義済みの

- 定義する

- 配信する

- 需要

- デモ

- 民主化

- 依存関係

- によっては

- 描かれた

- 展開します

- 展開

- 展開する

- 展開

- 設計

- 設計

- 決定する

- 決定する

- Developer

- 開発

- デバイス

- Devices

- ダイアグラム

- 異なります

- 難しい

- 直接に

- ディレクトリにジョブを開始します。

- 話し合います

- 議論する

- ディストリビューション

- デッカー

- そうではありません

- ドント

- ダウン

- ダウンロード

- ダウンロード

- ダイナミック

- 動的に

- 各

- 前

- 効率的な

- 効率良く

- 楽な

- どちら

- 他の場所で

- 埋め込み

- enable

- 可能

- カプセル化

- 端から端まで

- エンドポイント

- エンジン

- エンジニア

- エンジニアリング

- 十分な

- 確保

- Enterprise

- 環境

- エラー

- さらに

- 例

- 例外

- 期待して

- 期待する

- 体験

- 伸ばす

- 顔

- Failed:

- かなり

- 家族

- 特徴

- 特徴

- 少数の

- File

- ファイナンシャル

- 金融サービス

- もう完成させ、ワークスペースに掲示しましたか?

- 名

- 固定の

- 艦隊

- 焦点を当てて

- フォロー中

- 次

- 形式でアーカイブしたプロジェクトを保存します.

- フレームワーク

- フレームワーク

- 頻繁に

- から

- フロントエンド

- フル

- 完全に

- 機能性

- 生成する

- 取得する

- を取得

- GitHubの

- 目標

- GPU

- GPU

- 助成金

- 大きい

- ハンドル

- 起こる

- Hardware

- 持ってる

- he

- 助けます

- 助け

- ことができます

- こちら

- ハイ

- より高い

- 非常に

- 彼の

- host

- 主催

- ホスティング

- HOT

- 認定条件

- How To

- しかしながら

- HTML

- HTTP

- HTTPS

- アイドル

- if

- 説明する

- 画像

- 実装する

- 実装

- import

- in

- include

- 含ま

- 含めて

- 入ってくる

- 増える

- の増加

- 産業

- 産業を変えます

- 情報

- インフラ関連事業

- 初期

- 革新的な

- 革新的な技術

- インストール

- を取得する必要がある者

- 保険

- 統合

- 統合

- 関心

- インタフェース

- に

- 呼び出された

- 問題

- 問題

- IT

- ITS

- ジェームズ

- Java

- ジョブ

- 参加

- JPG

- ただ

- 言語

- 大

- より大きい

- レイテンシ

- 最新の

- 打ち上げ

- つながる

- リーダー

- リード

- LEARN

- 学習

- う

- レベル

- 図書館

- ような

- 好き

- LIMIT

- 線形

- リスト

- 負荷

- ローディング

- 負荷

- ローカル

- ロジック

- より長いです

- で

- ロー

- 下側

- 機械

- 機械学習

- メイン

- 大多数

- make

- 作る

- 作成

- マネージド

- マネージャー

- 管理する

- 多くの

- マーケティング

- マーケティングと広告

- 五月..

- メカニズム

- メモリ

- 方法

- メソッド

- メトリック

- マイクロサービス

- かもしれない

- 最小

- 分

- 軽減する

- ML

- モード

- モデル

- モジュール

- 他には?

- 最も

- やる気

- の試合に

- 名

- ネイティブに

- 必要

- 必要

- 必要とされる

- 新作

- 新しく

- ノーベル賞

- なし

- 注意

- ノート

- 今

- 数

- numpy

- of

- 提供

- オファー

- on

- ONE

- の

- 開いた

- オープンソース

- 業務執行統括

- 反対

- 最適化

- 最適化

- 最適化

- 最適化

- オプション

- or

- その他

- 私たちの

- でる

- 屋外で

- 出力

- 外側

- が

- 自分の

- 並列シミュレーションの設定

- パラメータ

- 部

- 特定の

- 部品

- 情熱的な

- path

- パス

- パターン

- パターン

- 支払い

- 以下のために

- 割合

- 実行する

- パフォーマンス

- パイプ

- プラットフォーム

- プラトン

- プラトンデータインテリジェンス

- プラトデータ

- 再生

- プラグイン

- ポイント

- 方針

- プール

- 人気

- ポスト

- 電力

- プラクティス

- 先行

- 予測

- 予測

- 前

- 前に

- 主要な

- 事前の

- 賞

- 問題

- プロセス

- 処理

- プロダクト

- プロダクトマネージャー

- 生産

- プログラミング

- 約束された

- 正しく

- プロパティ

- 受験する

- 提供します

- は、大阪で

- 準備

- 目的

- 目的

- プッシュ

- プッシュ

- Python

- パイトーチ

- ランダム

- 範囲

- 読む

- リーディング

- 準備

- への

- 受け取ります

- 受け

- 受け取り

- 受け入れ

- 推奨される

- 参照する

- 関係なく

- 地域

- 地域

- 関連する

- 残る

- replace

- 倉庫

- 表す

- 要求

- リクエスト

- 要件

- 研究

- リソース

- 応答

- REST

- 結果

- 収益

- 再利用

- ルート

- ルート

- ルーティング

- ラン

- runs

- ランタイム

- SaaSの

- セージメーカー

- SageMaker の推論

- 同じ

- サンプル

- Save

- 言う

- 規模

- 縮尺

- 秤

- スケーリング

- スクリプト

- スクリプト

- 二番

- 秒

- 見て

- 自己

- 送信

- シニア

- 役立つ

- サービスを提供

- サーバー

- サービス

- サービス

- サービング

- セッションに

- セット

- いくつかの

- すべき

- ショーケース

- 示す

- 作品

- 簡単な拡張で

- シミュレートする

- 同時に

- 単数

- サイズ

- 小さい

- スニペット

- So

- ソフトウェア

- サービスとしてのソフトウェア

- ソフトウェア開発

- ソフトウェアエンジニア

- 溶液

- ソリューション

- 一部

- ソース

- 専門家

- 特定の

- 支出

- split

- スポーツ

- スタック

- 静的な

- 手順

- ストレージ利用料

- 店舗

- 保存され

- 簡単な

- それに続きます

- そのような

- 示唆する

- サポート

- サポート

- サポート

- 確か

- システム

- 取る

- 取り

- 取得

- ターゲット

- ターゲット

- ティーチング

- チーム

- TechCrunchの

- テクノロジー

- テクノロジー

- 伝える

- テンソルフロー

- テスト

- テスト

- より

- それ

- アプリ環境に合わせて

- それら

- その後

- そこ。

- したがって、

- ボーマン

- 彼ら

- この

- それらの

- 千

- 数千

- 三

- 介して

- スループット

- 時間

- <font style="vertical-align: inherit;">回数</font>

- 〜へ

- あまりに

- ツール

- top

- に向かって

- TPS

- 追跡する

- トラフィック

- トレーニング

- 訓練された

- トレーニング

- 取引

- トランスフォーマー

- 旅行

- 試します

- 2

- type

- 一般的に

- 下

- 根本的な

- わかる

- 理解する

- ユニバーサル

- URL

- つかいます

- 使用事例

- 中古

- 使用されます

- 通常

- 活用

- 値

- 価値観

- 変数

- さまざまな

- ビジョン

- vs

- 欲しいです

- ました

- 見ている

- we

- ウェブ

- Webサービス

- 重量

- この試験は

- いつ

- 一方

- which

- ワイド

- 広い範囲

- 意志

- 以内

- 仕事

- 働いていました

- ワーカー

- 労働者

- ワークフロー

- ワークフロー

- ワーキング

- 作品

- でしょう

- 書き込み

- 書かれた

- X

- 年

- You

- あなたの

- ゼファーネット