はい.. AI アプリケーションについて話しています。私たちの無数の AI アプリケーションと、何をすべきかについて人間にささやいている今後の AI アプリケーションです。 どうやってそれを行うか…しかし、AIチャットボットとやり取りするささやく人についてではありません.

による IDC 予測によると、世界の AI 市場は 500 年までに 2024 億ドル以上に達する可能性があり、これは 50 年から 2021% 以上の増加です。これは、私たちがビジネス実験から、あらゆる規模の企業戦略の不可欠な部分であることを受け入れるようになったことを示しています。 データをインサイトに変換して、より良い意思決定に基づいて行動を起こすために必要なツールです。 ビジネス リスクを軽減し、イノベーションによって ROI を拡大するという AI のメリットについては誰も議論していません。 しかし、いつものように、…しかし…偏見のない AI は、言うは易く行うは難しです。

ビジネスに不可欠なこれらの AI モデルは、可視性と説明責任を持って確実に動作する必要があります。 そうしないと、この場合の失敗は、企業のキャッシュフローに影響を与え、法的問題につながる可能性さえある悲惨な結果をもたらします. これを回避する唯一の方法は、「この AI アプリケーション/ワークロードが倫理的に構築されていることを証明できますか?」という XNUMX つの質問に答える自動化と透明性です。 別名…どのように統治しますか? そして、それが継続的に管理されていることを証明できますか?

これは企業が好きなところです IBM AI ガバナンスに投資して、組織の AI 活動を指揮、管理、監視する全体的なプロセスを調整しています。 主な仕事は、すべての事業部門が積極的に取り組み、ガバナンスの枠組みをイニシアチブに注入して、倫理原則と規制を満たす能力を強化することです。 特に、銀行や金融サービスなどの規制された業界は、規制当局を満足させるための証拠を提供することが法的に義務付けられています。

デジタル トランスフォーメーションの多大な圧力により、AI の影響は金融サービス部門で指数関数的に増大しています。 前述のように、次の理由により、言うは易く行うは難しです。

1. AI アプリを自信を持って運用可能にします。

場合によっては、明確性とカタログ化なしでモデルが構築されます。 言うまでもなく、エンドツーエンドのライフ サイクルを追跡するために、監視はすべての真っ只中に消えていきます。 銀行がレガシー アプリケーションに苦戦している一方で、プロセスを自動化して透明性と説明可能性を実現することは困難になり、ブラック ボックス化しています。 なぜ/どのように決定が下されたかは誰にもわかりません。 レガシー アプリと絡み合った新しいアプリは日の目を見ることはありませんが、品質と認識されていないリスクのために莫大な ROI が関連付けられています。

これが、レピュテーション リスクの管理という XNUMX 番目のポイントにつながります。

2.全体的なリスクとともに評判リスクを管理する

私は尋ねました #chatGPT および #吟遊詩人 – パドマ・チュッカです。 #ChatGPT 質問を複数の方法で変更しても、回答を拒否しました。 それでも、Bard は私の LinkedIn プロフィールを含む詳細な回答をくれました…しかし、データはさまざまなサイトからのもので、スピーカーの略歴の一部として私の古いプロフィールがまだ存在しています。 その時点から、私はまだ吟遊詩人を開けていません。 すぐに、私はオフになりました。つまり、評判のリスクです。 データに一貫性がない可能性があることに気付いたときに、単純なチャットボットをオフにできるとします。 重要なビジネスを遂行するために AI を取り入れたアプリケーションを購入することを決定する前に、どうして確信を持てなかったのでしょうか? 評判リスクは、企業が忘れがちな重要な要素です。 レピュテーション リスクを定量化すると、プロアクティブでない場合にビジネスに多大な影響が及ぶことがわかります。

複雑さに加えて、XNUMX つ目は…

3. 企業は、変化する AI 規制にどのように対応できますか?

評判のリスクを回避するために、成功した責任ある AI チームは、すべてのローカルおよびグローバルな規制を認識し、一瞬の通知でチクタク ビデオのように削除する必要があります。 そして、コンプライアンス違反は、最終的に、提案された EU AI 法などの作業に関連して、組織に数百万ドルの罰金を科す可能性があります。 最大で 30 万ユーロ、または会社のグローバル収益の 6% になる可能性があります – OUCH。

まあ、すべてが最初からバラ色である必要はありません...恐ろしい状況からバラ色の状況に変身させる方法を知っている限り.

当然のことながら、それは常に人、プロセス、テクノロジーです。 そのため、まず、目的に基づいてイニシアチブを教育、指示、および監視するための機能横断的な統治機関を作成します。 次に、現在の AI テクノロジとプロセスをベンチマークし、ギャップを理解してから、将来の証明のために修正します。 次に、コンプライアンス要件に沿った一連の自動化されたガバナンス ワークフローに頼ります。 最後に、許容可能なしきい値が近づいている場合に所有者に警告する監視システムを設定します。技術面から見ると、適切に設計され、適切に実行され、適切に接続された AI には、複数のビルディング ブロックが必要です。 また、一部またはすべての機能があることを確認してください。

· 多様な展開にわたるデータの整合性

・AIガバナンスに準拠したオープンで柔軟な既存のツールを使用する

· プライバシー コントロールを備えたセルフサービス アクセスを提供することを確認してください – 追跡する方法

· 自動化と AI ガバナンスを考慮した設計

・カスタマイズ可能なワークフローを通じて、複数の利害関係者に接続してカスタマイズ可能

アプリを怖いものから Rosy に変身させたら…次の問題は、それをどのように証明するかです…

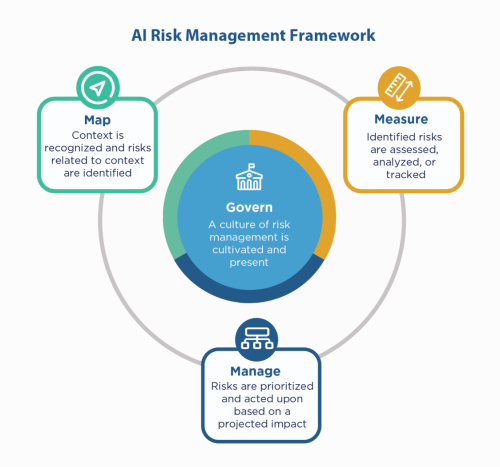

まず、会社の AI 原則に頼って構築します。ただし、特に金融サービスのような規制環境では、準拠していることを「示す」必要があります。 金融サービスは NIST 800-53 に準拠する必要があるため、 NIST AI リスク管理フレームワーク (AI RMF). NIST は、管理、マップ、測定、および管理の XNUMX つのファミリのコントロールを提案しました。 それを指針として使用し、アプリケーションのストレス テストを行って、修復および監視すべきギャップを特定します。

IBM は、モデルを実稼働に投入する前に検証し、公平性、品質、ドリフトを監視できます。 また、モデルの動作と予測を説明するドキュメントを提供して、規制当局と監査人の要件を満たすこともできます。 これらの説明は、可視性を提供し、監査の苦痛を軽減し、透明性を高め、潜在的なリスクを判断する能力を高めます。

AIのささやきを自信を持って聞いてください!

- SEO を活用したコンテンツと PR 配信。 今日増幅されます。

- Platoblockchain。 Web3メタバースインテリジェンス。 知識の増幅。 こちらからアクセスしてください。

- 未来を鋳造する w エイドリエン・アシュリー。 こちらからアクセスしてください。

- 情報源: https://www.finextra.com/blogposting/24053/the-costly-consequences-of-unethical-ai-whisperer?utm_medium=rssfinextra&utm_source=finextrablogs

- :は

- $UP

- 2021

- 2024

- 7

- a

- 能力

- 私たちについて

- ことができます。

- アクセス

- 説明責任

- 越えて

- 行為

- Action

- 活動

- 付着します

- AI

- AI法

- AIガバナンス

- 別名

- 警告

- すべて

- 常に

- および

- 回答

- アプリ

- 申し込み

- アプリ

- です

- 周りに

- AS

- 関連する

- At

- 監査

- 監査役

- 自動化

- 自動化する

- オートメーション

- バック

- バンキング

- 銀行

- ベース

- BE

- なぜなら

- さ

- ベンチマーク

- 利点

- より良いです

- 10億

- ブラック

- ブロック

- ボディ

- ボックス

- もたらす

- ビルド

- 建物

- 内蔵

- ビジネス

- 購入

- by

- 缶

- 機能

- 場合

- 例

- 現金

- 現金流量

- 変化

- チャットボット

- チャットボット

- 明瞭

- 閉鎖

- 企業

- 会社

- 複雑さ

- コンプライアンス

- 準拠した

- プロフェッショナルな方法で

- 自信を持って

- お問合せ

- 結果

- 連続的に

- controls

- 費用

- 可能性

- 作ります

- 重大な

- 電流プローブ

- カスタマイズ可能な

- サイクル

- データ

- 議論する

- 決定する

- 決定

- 減少

- 設計

- 詳細な

- 決定する

- デジタル

- 悲惨な

- 直接

- 演出

- 異なる

- ドキュメント

- ドル

- 落ちる

- 容易

- 教育します

- 端から端まで

- 確保

- Enterprise

- 環境

- 特に

- 本質的な

- 倫理的な

- EU

- ユーロ

- さらに

- あらゆる

- すべてのもの

- 証拠

- 既存の

- 存在

- 説明

- 指数関数的に

- 不良解析

- 公平

- 秋

- 家族

- 最後に

- ファイナンシャル

- 金融業務

- Finextra

- 名

- フレキシブル

- フロー

- フレームワーク

- から

- 2021から

- 未来

- 与える

- グローバル

- ガバナンス

- 成長

- 持ってる

- 認定条件

- How To

- HTTPS

- 巨大な

- 人間

- i

- 識別する

- 影響

- in

- 含めて

- 増える

- を示し

- 産業

- 影響

- イニシアチブ

- 革新的手法

- 洞察

- インテグラル

- 整合性

- 対話

- 投資

- IT

- ITS

- ジョブ

- 知っている

- Legacy

- リーガルポリシー

- 法的な問題

- 生活

- ような

- LINE

- ローカル

- 長い

- 見て

- 製

- make

- 管理します

- 管理

- 管理する

- 地図

- 市場

- 事態

- 五月..

- だけど

- 大会

- かもしれない

- 百万

- 何百万

- モデル

- 瞬間

- モニター

- 監視対象

- モニタリング

- 他には?

- の試合に

- 必要

- 必要

- いらない

- 新作

- 次の

- ニスト

- 目的

- of

- 提供

- 古い

- on

- ONE

- 開いた

- 操作する

- 組織

- さもないと

- 全体

- 所有者

- 痛み

- 部

- のワークプ

- プラトン

- プラトンデータインテリジェンス

- プラトデータ

- ポイント

- 可能

- 予測

- 圧力

- 主要な

- 原則

- プライバシー

- 先を見越した

- プロセス

- ラボレーション

- 生産

- プロフィール

- 証明

- 提案された

- 受験する

- 提供します

- 置きます

- 品質

- 質問

- すぐに

- リーチ

- 実現する

- 規制

- 規制産業

- 規制

- 規制

- レギュレータ

- 評判

- の提出が必要です

- 要件

- 必要

- 反応します

- 責任

- 結果

- 収入

- リスク

- リスク管理

- リスク

- ROI

- ロージー

- s

- 前記

- 二番

- セクター

- セルフサービス

- サービス

- セッションに

- すべき

- 表示する

- 側

- 簡単な拡張で

- から

- サイト

- 状況

- サイズ

- So

- 一部

- スパーク

- スピーカー

- ステークホルダー

- 滞在

- まだ

- 戦略

- 強化する

- ストレス

- 苦労して

- 成功した

- 会話

- チーム

- テクノロジー

- test

- それ

- それら

- ボーマン

- 三番

- しきい値

- 介して

- 〜へ

- ツール

- 豊富なツール群

- 追跡する

- 変換

- 透明性

- すばらしい

- 順番

- オン

- 最終的に

- わかる

- ユニット

- 今後の

- us

- つかいます

- 検証

- さまざまな

- ビデオ

- 視認性

- 仕方..

- 方法

- この試験は

- while

- 誰

- 無し

- 仕事

- ワークフロー

- You

- あなたの

- ゼファーネット