사기 탐지는 금융 서비스, 소셜 미디어, 전자 상거래, 게임 및 기타 산업에 적용되는 중요한 문제입니다. 이 포스트는 RGCN(Relational Graph Convolutional Network) 모델을 사용하여 트랜잭션이 사기일 확률을 변환 및 유도 추론 모드를 통해 예측하는 사기 탐지 솔루션의 구현을 제시합니다. 우리의 구현을 아마존 세이지 메이커 외부 그래프 저장 또는 오케스트레이션이 필요하지 않은 실시간 사기 탐지 솔루션으로서 엔드포인트를 사용하여 모델의 배포 비용을 크게 절감합니다.

사기 탐지를 위한 완전 관리형 AWS AI 서비스를 찾는 기업도 다음을 사용할 수 있습니다. 아마존 사기 탐지기, 의심스러운 온라인 지불을 식별하고, 새로운 계정 사기를 감지하고, 평가판 및 로열티 프로그램 남용을 방지하거나, 계정 탈취 감지를 개선하는 데 사용할 수 있습니다.

솔루션 개요

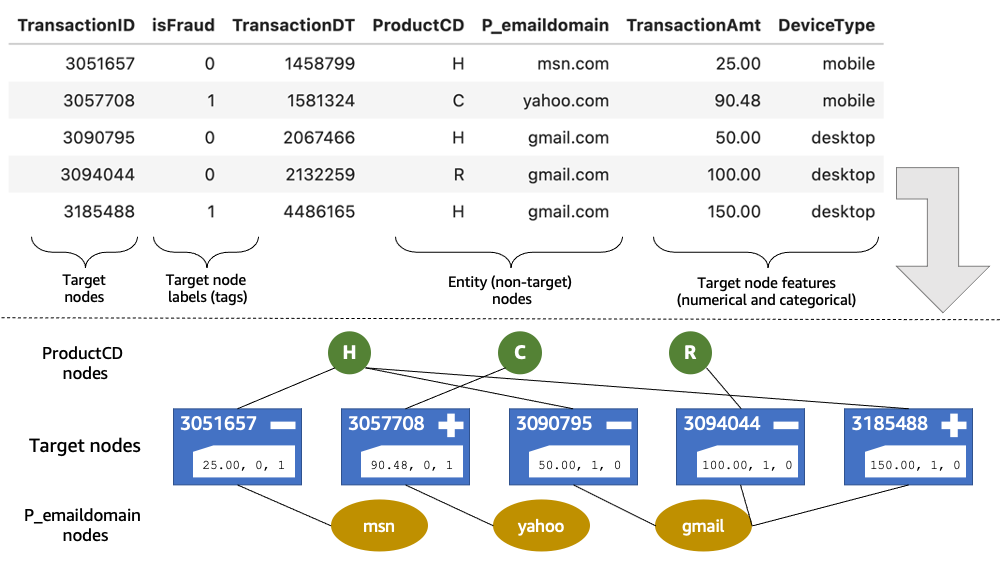

다음 다이어그램은 다양한 유형의 정보를 포함하는 예시적인 금융 거래 네트워크를 설명합니다. 각 거래에는 기기 식별자, Wi-Fi ID, IP 주소, 물리적 위치, 전화번호 등과 같은 정보가 포함됩니다. 다양한 유형의 노드와 에지를 포함하는 이기종 그래프를 통해 트랜잭션 데이터 세트를 나타냅니다. 그런 다음 사기 탐지 문제는 이 이기종 그래프에서 노드 분류 작업으로 처리됩니다.

그래프 신경망(GNN)은 사기 탐지 문제를 해결하는 데 있어 그레디언트 부스트 결정 트리 또는 벤치마킹 데이터 세트에서 완전히 연결된 피드포워드 네트워크와 같은 널리 사용되는 지도 학습 방법을 능가하는 큰 가능성을 보여주었습니다. 일반적인 사기 탐지 설정에서 훈련 단계 동안 GNN 모델은 일련의 레이블이 지정된 트랜잭션에 대해 훈련됩니다. 각 교육 트랜잭션에는 사기 여부를 나타내는 이진 레이블이 제공됩니다. 그런 다음 이 훈련된 모델을 사용하여 추론 단계에서 레이블이 지정되지 않은 트랜잭션 집합 중에서 사기 트랜잭션을 탐지할 수 있습니다. 두 가지 다른 추론 모드가 존재합니다: 변환적 추론과 귀납적 추론(이 게시물의 뒷부분에서 자세히 설명).

RGCN과 같은 GNN 기반 모델은 그래프 구조와 노드 및 에지의 기능을 결합하여 토폴로지 정보를 활용하여 악의적인 트랜잭션과 합법적인 트랜잭션을 구별하는 의미 있는 표현을 학습할 수 있습니다. RGCN은 이기종 그래프 임베딩을 통해 서로 다른 유형의 노드 및 에지(관계)를 나타내는 방법을 효과적으로 학습할 수 있습니다. 이전 다이어그램에서 각 트랜잭션은 대상 노드로 모델링되고 각 트랜잭션과 관련된 여러 엔터티는 다음과 같이 비대상 노드 유형으로 모델링됩니다. ProductCD 및 P_emaildomain. 대상 노드에는 숫자 및 범주 기능이 할당된 반면 다른 노드 유형에는 기능이 없습니다. RGCN 모델은 각 비대상 노드 유형에 대한 임베딩을 학습합니다. 대상 노드의 임베딩을 위해 컨볼루션 연산을 사용하여 해당 기능과 이웃 임베딩을 사용하여 임베딩을 계산합니다. 게시물의 나머지 부분에서는 GNN과 RGCN이라는 용어를 같은 의미로 사용합니다.

대상이 아닌 엔터티를 기능으로 취급하고 이를 원-핫 인코딩하는 것과 같은 대체 전략은 이러한 엔터티의 큰 카디널리티로 인해 종종 실행 불가능할 수 있다는 점에 주목할 가치가 있습니다. 반대로 그래프 엔터티로 인코딩하면 GNN 모델이 엔터티 관계에서 암시적 토폴로지를 활용할 수 있습니다. 예를 들어 알려진 사기 거래와 전화번호를 공유하는 거래도 사기일 가능성이 더 높습니다.

GNN에서 사용하는 그래프 표현은 구현에 약간의 복잡성을 야기합니다. 이는 모델 교육 중에 알려지지 않은 엔터티에 해당하는 새로 추가된 노드를 사용하여 추론 중에 그래프 표현이 증가할 수 있는 사기 탐지와 같은 애플리케이션의 경우 특히 그렇습니다. 이 추론 시나리오는 일반적으로 유도 모드. 대조적으로, 변환 모드 모델 교육 중에 구성된 그래프 표현이 추론 중에 변경되지 않는다고 가정하는 시나리오입니다. GNN 모델은 역전파 중에 테스트 레이블을 마스킹하면서 결합된 교육 및 테스트 예제 세트에서 그래프 표현을 구성하여 변환 모드에서 평가되는 경우가 많습니다. 이렇게 하면 그래프 표현이 정적이며 GNN 모델은 추론 중에 새 노드로 그래프를 확장하기 위한 작업 구현이 필요하지 않습니다. 안타깝게도 실제 환경에서 사기 거래를 감지할 때 정적 그래프 표현을 가정할 수 없습니다. 따라서 사기 탐지를 위한 GNN 모델을 프로덕션 환경에 배포할 때 귀납적 추론에 대한 지원이 필요합니다.

또한 실시간으로 사기 거래를 탐지하는 것이 중요합니다. 특히 불법 활동을 중단할 기회가 단 한 번뿐인 비즈니스 사례에서 더욱 그렇습니다. 예를 들어 사기성 사용자는 계정을 사용하여 한 번만 악의적으로 행동하고 동일한 계정을 다시 사용하지 않을 수 있습니다. GNN 모델에 대한 실시간 추론은 구현에 추가 복잡성을 도입합니다. 실시간 추론을 지원하기 위해 하위 그래프 추출 작업을 구현해야 하는 경우가 많습니다. 하위 그래프 추출 작업은 그래프 표현이 크고 전체 그래프에 대한 추론을 수행하는 데 엄청난 비용이 드는 경우 추론 대기 시간을 줄이기 위해 필요합니다. RGCN 모델을 사용한 실시간 유도 추론 알고리즘은 다음과 같이 실행됩니다.

- 트랜잭션 배치와 훈련된 RGCN 모델이 주어지면 배치의 엔터티로 그래프 표현을 확장합니다.

- 새 비대상 노드의 임베딩 벡터를 각 노드 유형의 평균 임베딩 벡터로 할당합니다.

- 다음에 의해 유도된 하위 그래프 추출 k-배치에서 대상 노드의 이웃을 뛰어 넘습니다.

- 하위 그래프에 대한 추론을 수행하고 배치의 대상 노드에 대한 예측 점수를 반환합니다.

- 새로 추가된 노드를 제거하여 그래프 표현을 정리합니다(이 단계는 모델 추론을 위한 메모리 요구 사항이 일정하게 유지되도록 합니다).

이 게시물의 주요 기여는 실시간 유도 추론 알고리즘을 구현하는 RGCN 모델을 제시하는 것입니다. 실시간 사기 탐지 솔루션으로 SageMaker 엔드포인트에 RGCN 구현을 배포할 수 있습니다. 당사의 솔루션은 외부 그래프 스토리지 또는 오케스트레이션이 필요하지 않으며 사기 탐지 작업을 위한 RGCN 모델의 배포 비용을 크게 줄입니다. 이 모델은 또한 변환 추론 모드를 구현하여 유도 및 변환 모드에서 모델 성능을 비교하는 실험을 수행할 수 있습니다. 실험이 포함된 모델 코드 및 노트북은 다음에서 액세스할 수 있습니다. AWS 예제 GitHub 리포지토리.

이 게시물은 게시물을 기반으로 작성되었습니다. Amazon SageMaker, Amazon Neptune 및 Deep Graph Library를 사용하여 GNN 기반 실시간 사기 탐지 솔루션 구축. 이전 게시물은 SageMaker를 사용하여 RGCN 기반 실시간 사기 탐지 솔루션을 구축했으며, 아마존 해왕성및 딥 그래프 라이브러리 (DGL). 이전 솔루션은 Neptune 데이터베이스를 외부 그래프 스토리지로 사용했습니다. AWS 람다 실시간 추론을 위한 오케스트레이션을 위해 변환 모드의 실험만 포함했습니다.

본 포스트에서 소개하는 RGCN 모델은 DGL만을 의존성으로 사용하여 실시간 귀납적 추론 알고리즘의 모든 연산을 구현하며, 배포를 위한 외부 그래프 스토리지나 오케스트레이션이 필요하지 않습니다.

먼저 벤치마크 데이터 세트에서 변환 및 유도 모드에서 RGCN 모델의 성능을 평가합니다. 예상대로 유도 모드의 모델 성능은 변환 모드보다 약간 낮습니다. 하이퍼파라미터의 효과도 연구합니다. k 모델 성능에. 하이퍼파라미터 k 실시간 추론 알고리즘의 3단계에서 하위 그래프를 추출하기 위해 수행되는 홉 수를 제어합니다. 더 높은 값 k 더 큰 하위 그래프를 생성하고 더 높은 지연 시간을 희생하여 더 나은 추론 성능으로 이어질 수 있습니다. 이와 같이 실시간 응용 프로그램에 대한 RGCN 모델의 타당성을 평가하기 위해 타이밍 실험도 수행합니다.

데이터 세트

우리는을 사용하여 IEEE-CIS 사기 데이터 세트, 이전에 사용된 동일한 데이터 세트 게시. 이 데이터 세트에는 이진 사기 레이블이 있는 590,000개 이상의 트랜잭션 레코드가 포함되어 있습니다( isFraud 열). 데이터는 트랜잭션과 ID의 두 테이블로 나뉩니다. 그러나 모든 트랜잭션 레코드에 해당 ID 정보가 있는 것은 아닙니다. 우리는 두 테이블을 조인합니다. TransactionID 총 144,233개의 트랜잭션 레코드가 남습니다. 우리는 트랜잭션 타임스탬프를 기준으로 테이블을 정렬합니다( TransactionDT 열) 시간별로 80/20 비율 분할을 생성하여 교육 및 테스트를 위해 각각 115,386개 및 28,847개의 트랜잭션을 생성합니다.

데이터 세트에 대한 자세한 내용과 DGL의 입력 요구 사항에 맞게 형식을 지정하는 방법은 다음을 참조하세요. Amazon SageMaker 및 Deep Graph Library를 사용하여 이기종 네트워크의 사기 탐지.

그래프 구성

우리는을 사용하여 TransactionID 대상 노드를 생성하는 열입니다. 다음 열을 사용하여 11가지 유형의 비대상 노드를 생성합니다.

card1을 통하여card6ProductCDaddr1및addr2P_emaildomain및R_emaildomain

대상 노드의 범주 기능으로 38개의 열을 사용합니다.

M1을 통하여M9DeviceType및DeviceInfoid_12을 통하여id_38

대상 노드의 숫자 기능으로 382개의 열을 사용합니다.

TransactionAmtdist1및dist2id_01을 통하여id_11C1을 통하여C14D1을 통하여D15V1을 통하여V339

학습 트랜잭션으로 구성된 그래프에는 217,935개의 노드와 2,653,878개의 에지가 포함되어 있습니다.

하이퍼 파라미터

다른 매개변수는 이전에 보고된 매개변수와 일치하도록 설정됩니다. 게시. 다음 스니펫은 변환 및 유도 모드에서 RGCN 모델을 교육하는 방법을 보여줍니다.

유도 대 변환 모드

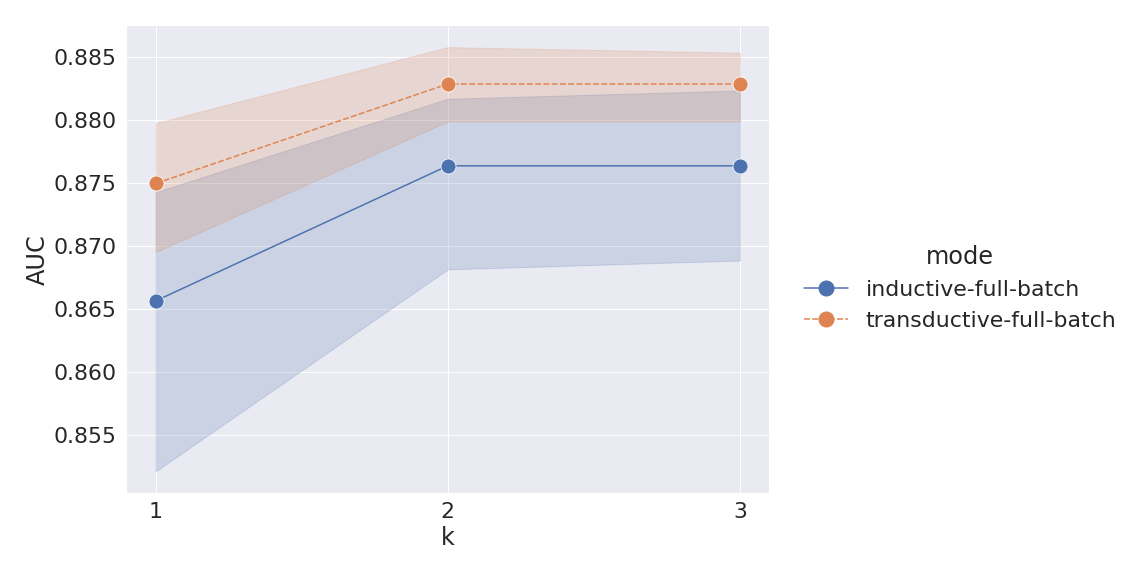

우리는 귀납적 방식에 대해 10번의 시도와 변환적 방식에 대해 XNUMX번의 시도를 수행합니다. 각 시도에 대해 RGCN 모델을 교육하고 디스크에 저장하여 XNUMX개의 모델을 얻습니다. 홉 수를 늘리면서 테스트 예제에서 각 모델을 평가합니다(파라미터 k) 추론을 위한 하위 그래프 추출, 설정에 사용 k 1, 2, 3으로. 모든 테스트 예를 한 번에 예측하고 각 시도에 대한 ROC AUC 점수를 계산합니다. 다음 플롯은 AUC 점수의 평균 및 95% 신뢰 구간을 보여줍니다.

변환 모드의 성능이 유도 모드보다 약간 더 높다는 것을 알 수 있습니다. 을 위한 k=2, 유도 및 변환 모드에 대한 평균 AUC 점수는 각각 0.876 및 0.883입니다. 이는 RGCN 모델이 테스트 세트의 항목을 포함하여 변환 모드에서 모든 엔티티 노드의 임베딩을 학습할 수 있기 때문에 예상됩니다. 반대로 귀납 모드에서는 모델이 교육 예제에 있는 엔터티 노드의 임베딩만 학습할 수 있으므로 일부 노드는 추론 중에 평균을 채워야 합니다. 동시에 transductive 모드와 inductive 모드 사이의 성능 저하가 크지 않으며 inductive 모드에서도 RGCN 모델은 0.876의 AUC로 좋은 성능을 달성합니다. 또한 모델 성능이 k>2. 이것은 설정을 의미합니다 k=2는 추론 중에 충분히 큰 하위 그래프를 추출하여 최적의 성능을 제공합니다. 이 관찰은 다음 실험에서도 확인됩니다.

변환 모드의 경우 모델의 AUC 0.883이 이전에 보고된 해당 AUC 0.870보다 높다는 점도 주목할 가치가 있습니다. 게시. 더 높은 AUC 점수를 설명할 수 있는 대상 노드의 숫자 및 범주 기능으로 더 많은 열을 사용합니다. 또한 이전 게시물의 실험은 단일 시도만 수행했습니다.

작은 배치에 대한 추론

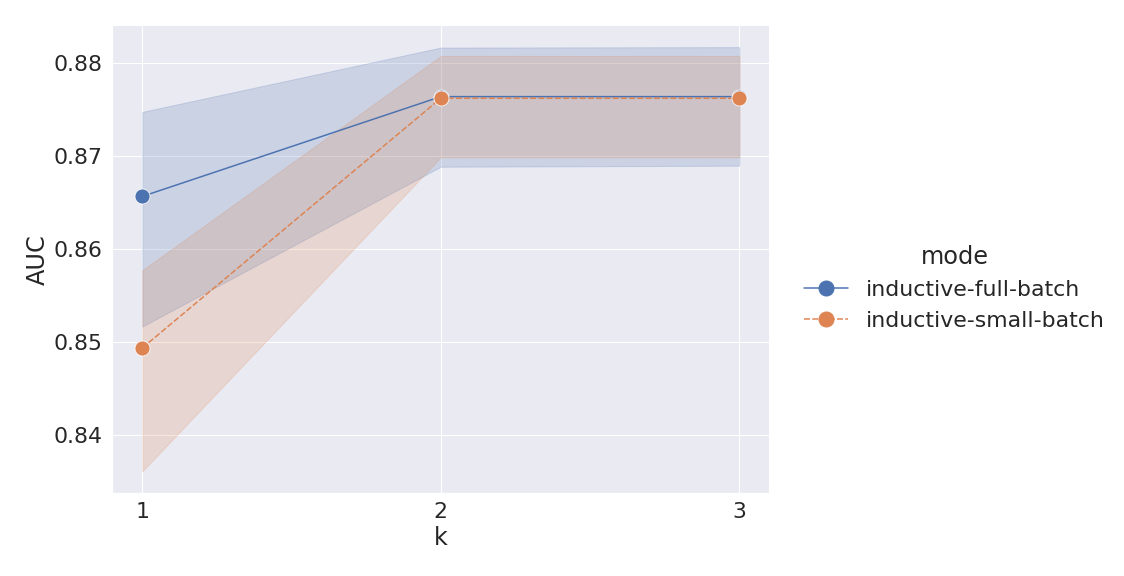

이 실험에서는 소규모 배치 추론 설정에서 RGCN 모델을 평가합니다. 우리는 이전 실험에서 유도 모드로 훈련된 28개의 모델을 사용합니다. 전체 및 소규모 배치 추론의 두 가지 설정에서 예측할 때 이러한 모델의 성능을 비교합니다. 전체 배치 추론의 경우 이전 실험에서 수행한 것처럼 전체 테스트 세트에 대해 예측합니다. 작은 배치 추론의 경우 테스트 세트를 각 배치에서 약 1,000개의 트랜잭션이 있는 동일한 크기의 XNUMX개 배치로 분할하여 작은 배치로 예측합니다. 서로 다른 값을 사용하여 두 설정에 대한 AUC 점수를 계산합니다. k. 다음 플롯은 전체 및 소규모 배치 추론 설정에 대한 평균 및 95% 신뢰 구간을 보여줍니다.

작은 배치 추론에 대한 성능은 다음과 같은 경우에 관찰됩니다. k=1은 전체 배치보다 낮습니다. 그러나 작은 배치 추론 성능은 다음과 같은 경우 전체 배치와 일치합니다. k>1. 이는 작은 배치에 대해 훨씬 더 작은 하위 그래프가 추출되기 때문일 수 있습니다. 학습 트랜잭션으로 구성된 전체 그래프의 크기와 하위 그래프 크기를 비교하여 이를 확인합니다. 노드 수 측면에서 그래프 크기를 비교합니다. 을 위한 k=1, 작은 배치 추론의 평균 하위 그래프 크기는 훈련 그래프의 2% 미만입니다. 그리고 전체 배치 추론의 경우 k=1, 하위 그래프 크기는 22%입니다. 언제 k=2, 소형 및 전체 배치 추론의 하위 그래프 크기는 각각 54% 및 64%입니다. 마지막으로, 두 추론 설정의 하위 그래프 크기는 다음에 대해 100%에 도달합니다. k=3. 다시 말해, 언제 k>1이면 작은 배치의 하위 그래프가 충분히 커지므로 작은 배치 추론이 전체 배치 추론과 동일한 성능에 도달할 수 있습니다.

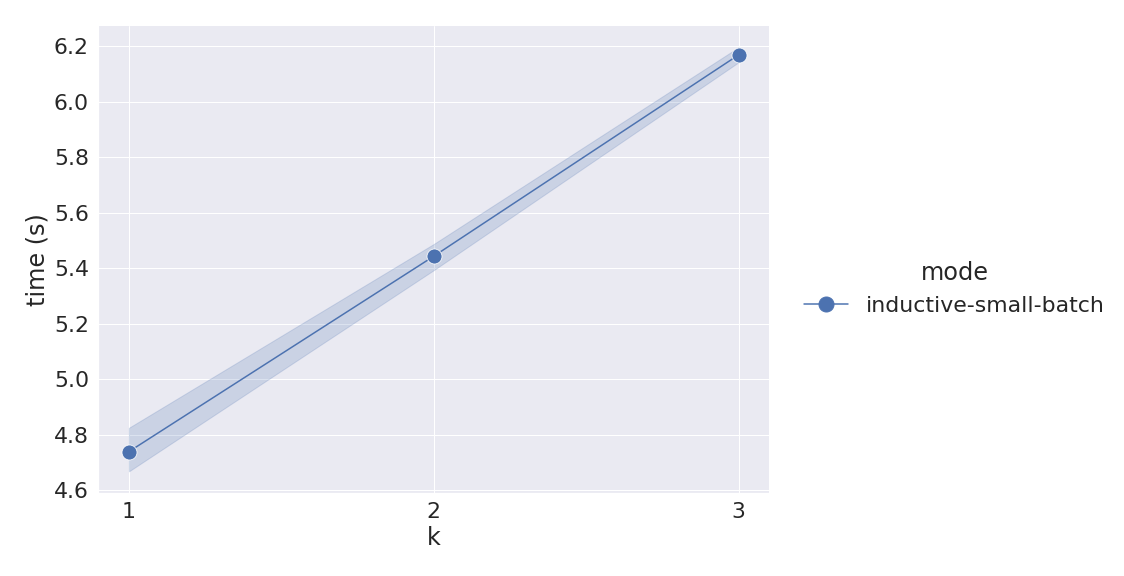

또한 모든 배치에 대한 예측 지연 시간을 기록합니다. 우리는 ml.r5.12xlarge 인스턴스에서 실험을 수행하지만 64G 메모리가 있는 더 작은 인스턴스를 사용하여 동일한 실험을 실행할 수 있습니다. 다음 플롯은 다양한 값에 대한 소규모 배치 예측 대기 시간의 평균 및 95% 신뢰 구간을 보여줍니다. k.

대기 시간에는 실시간 귀납적 추론 알고리즘의 XNUMX단계가 모두 포함됩니다. 우리는 그것을 볼 때 k=2, 1,030개의 트랜잭션을 예측하는 데 평균 5.4초가 걸리므로 초당 190개의 트랜잭션 처리량이 발생합니다. 이를 통해 RGCN 모델 구현이 실시간 사기 탐지에 적합하다는 것을 확인할 수 있습니다. 우리는 또한 이전 게시 구현을 위한 하드 대기 시간 값을 제공하지 않았습니다.

결론

이 게시물과 함께 공개된 RGCN 모델은 실시간 귀납적 추론을 위한 알고리즘을 구현하며 외부 그래프 스토리지 또는 오케스트레이션이 필요하지 않습니다. 매개변수 k 알고리즘의 3단계에서 추론을 위해 하위 그래프를 추출하기 위해 수행되는 홉 수를 지정하고 모델 정확도와 예측 대기 시간 간의 절충을 초래합니다. 우리는 IEEE-CIS 사기 데이터 세트 우리의 실험에서 최적의 매개 변수 값을 경험적으로 검증했습니다. k 이 데이터 세트의 경우 2이고 AUC 점수 0.876과 6건의 트랜잭션당 1,000초 미만의 예측 대기 시간을 달성했습니다.

이 게시물에서는 실시간 사기 탐지를 위한 RGCN 모델을 교육하고 평가하는 단계별 프로세스를 제공했습니다. 포함된 모델 클래스는 직렬화 및 역직렬화 메서드를 포함하여 전체 모델 수명 주기에 대한 메서드를 구현합니다. 이를 통해 모델을 실시간 사기 탐지에 사용할 수 있습니다. 다음을 사용하여 모델을 PyTorch SageMaker 추정기로 교육한 후 SageMaker 엔드포인트에 배포할 수 있습니다. 수첩 템플릿으로. 엔드포인트는 소량의 원시 거래 배치에 대한 사기를 실시간으로 예측할 수 있습니다. 당신은 또한 사용할 수 있습니다 Amazon SageMaker 추론 추천자 워크로드를 기반으로 추론 엔드포인트에 가장 적합한 인스턴스 유형 및 구성을 선택합니다.

이 주제 및 구현에 대한 자세한 내용은 스크립트를 직접 탐색하고 테스트하는 것이 좋습니다. 다음에서 노트북 및 관련 모델 클래스 코드에 액세스할 수 있습니다. AWS 예제 GitHub 리포지토리.

저자에 관하여

드미트리 베스팔로프 Amazon Machine Learning Solutions Lab의 선임 응용 과학자로서 다양한 산업 분야의 AWS 고객이 AI 및 클라우드 채택을 가속화하도록 돕습니다.

드미트리 베스팔로프 Amazon Machine Learning Solutions Lab의 선임 응용 과학자로서 다양한 산업 분야의 AWS 고객이 AI 및 클라우드 채택을 가속화하도록 돕습니다.

라이언 브랜드 Amazon Machine Learning Solutions Lab의 응용 과학자입니다. 그는 의료 및 생명 과학 문제에 기계 학습을 적용한 구체적인 경험이 있습니다. 여가 시간에는 역사와 공상 과학 소설을 즐겨 읽습니다.

라이언 브랜드 Amazon Machine Learning Solutions Lab의 응용 과학자입니다. 그는 의료 및 생명 과학 문제에 기계 학습을 적용한 구체적인 경험이 있습니다. 여가 시간에는 역사와 공상 과학 소설을 즐겨 읽습니다.

치 얀준 Amazon Machine Learning Solution Lab의 수석 응용 과학 관리자입니다. 그녀는 AWS 고객이 AI 및 클라우드 채택 속도를 높일 수 있도록 기계 학습을 혁신하고 적용합니다.

치 얀준 Amazon Machine Learning Solution Lab의 수석 응용 과학 관리자입니다. 그녀는 AWS 고객이 AI 및 클라우드 채택 속도를 높일 수 있도록 기계 학습을 혁신하고 적용합니다.

- SEO 기반 콘텐츠 및 PR 배포. 오늘 증폭하십시오.

- 플라토 블록체인. Web3 메타버스 인텔리전스. 지식 증폭. 여기에서 액세스하십시오.

- 출처: https://aws.amazon.com/blogs/machine-learning/build-a-gnn-based-real-time-fraud-detection-solution-using-the-deep-graph-library-without-using-external-graph-storage/

- 000

- 1

- 10

- 100

- 11

- 2%

- 28

- 7

- 95%

- a

- 할 수 있는

- 소개

- 남용

- 가속

- ACCESS

- 액세스

- 계정

- 달성하다

- 달성

- 가로질러

- 방과 후 액티비티

- 추가

- 또한

- 추가

- 구애

- 양자

- 이점

- AI

- 연산

- All

- 수

- 대안

- 아마존

- 아마존 머신 러닝

- 아마존 해왕성

- 아마존 세이지 메이커

- 중

- 및

- 어플리케이션

- 어플리케이션

- 적용된

- 적용

- 대략

- 배열

- 할당 된

- 관련

- 꾸민

- 증강 된

- 평균

- AWS

- 기반으로

- 때문에

- 된다

- 존재

- 기준

- 벤치마킹

- BEST

- 더 나은

- 사이에

- 상표

- 빌드

- 빌드

- 내장

- 사업

- 나르다

- 가지 경우

- 기회

- 이전 단계로 돌아가기

- 수업

- 분류

- 클라우드

- 클라우드 채택

- 암호

- 단

- 열

- 결합 된

- 결합

- 비교

- 비교

- 복잡성

- 계산

- 행위

- 자신

- 구성

- 확인하기

- 확인 됨

- 연결

- 상수

- 건설 중의

- 구조

- 이 포함되어 있습니다

- 대조

- 기부

- 컨트롤

- 동

- 비용

- 만들

- 생성

- 결정적인

- 고객

- 데이터

- 데이터베이스

- 데이터 세트

- 결정

- 깊은

- 태만

- 한정된

- 의존

- 배포

- 배치

- 전개

- 세부설명

- Detection System

- 장치

- dgl

- DID

- 다른

- 토론

- 하지 않습니다

- 드롭

- ...동안

- 마다

- 전자 상거래

- 효과

- 효과적으로

- 수

- 가능

- 격려

- 종점

- 보장

- 전체의

- 엔티티

- 실재

- 환경

- 특히

- 평가

- 평가

- 평가

- 조차

- 모든

- 예

- 예

- 기대하는

- 비싼

- 경험

- 실험

- 설명

- 탐험

- 확장

- 외부

- 추출물

- 특징

- 소설

- 최종적으로

- 금융

- 금융 서비스

- 먼저,

- 수행원

- 다음

- 체재

- 사기

- 사기 탐지

- 사기의

- 무료

- 에

- 가득 찬

- 충분히

- 노름

- 생성

- 얻을

- GitHub의

- 좋은

- 그래프

- 큰

- 하드

- 건강 관리

- 도움

- 도움이

- 더 높은

- history

- 방법

- How To

- 그러나

- HTML

- HTTPS

- 확인

- 통합 인증

- 불법

- 구현

- 이행

- 구현

- 구현하다

- import

- 중대한

- 개선

- in

- 기타의

- 포함

- 포함

- 포함

- 증가

- 산업

- 정보

- 입력

- 예

- 소개

- 소개합니다

- IP

- IP 주소

- IT

- 어울리다

- 키

- 알려진

- 실험실

- 라벨

- 레이블

- 넓은

- 큰

- 숨어 있음

- 리드

- 배우다

- 배우기

- 도서관

- 생활

- 생명과학

- wifecycwe

- 아마도

- 하중

- 위치

- 찾고

- 충성도

- 로열티 프로그램

- 기계

- 기계 학습

- 매니저

- 경기

- 의미있는

- 미디어

- 메모리

- 방법

- ML

- 모드

- 모델

- 모델

- 모드

- 배우기

- 필요한

- Neptune

- 네트워크

- 네트워크

- 신경망

- 신제품

- 다음 것

- 노드

- 노드

- 번호

- 숫자

- 관찰

- 획득

- ONE

- 온라인

- 온라인 지불

- 조작

- 행정부

- 최적의

- 오케스트레이션

- 기타

- 실적이 좋은

- 자신의

- 팬더

- 매개 변수

- 매개 변수

- 합격

- 결제

- tỷ lệ phần trăm

- 수행

- 성능

- 실행할 수 있는

- 상

- 전화

- 물리적

- 플라톤

- 플라톤 데이터 인텔리전스

- 플라토데이터

- 인기 문서

- 게시하다

- 예측

- 예측

- 예측

- 제시

- 선물

- 예방

- 너무 이른

- 이전에

- 문제

- 문제

- 방법

- 생산

- 생산

- 프로그램

- 약속

- 제공

- 제공

- 파이 토치

- Qi

- 살갗이 벗어 진

- 도달

- 읽기

- 현실

- 현실 세계

- 실시간

- 기록

- 기록

- 감소

- 감소

- 감소

- 참조

- 관련

- 관계

- 관계

- 출시

- 제거

- 보고

- 대표

- 대표

- 필요

- 필수

- 요구 사항

- 그

- REST

- 결과

- 결과

- return

- 달리기

- 라이언

- 현자

- SageMaker 추론

- 같은

- 찜하기

- 대본

- 과학

- 공상 과학 소설

- 과학

- 과학자

- 스크립트

- 둘째

- 초

- 연장자

- 서비스

- 서비스

- 세트

- 설정

- 설정

- 설치

- 몇몇의

- 공유

- 표시

- 쇼

- 상당한

- 크게

- 단일

- 크기

- 크기

- 작은

- 작은

- So

- 사회적

- 소셜 미디어

- 해결책

- 솔루션

- 일부

- 구체적인

- 속도

- 분열

- 스플릿

- 단계

- 단계

- 멎는

- 저장

- 전략들

- 구조

- 교육과정

- 하위 그래프

- 하위 그래프

- 이러한

- 소송

- 적당한

- SUPPORT

- 의심 많은

- 테이블

- 받아

- 인계

- 소요

- 목표

- 태스크

- 작업

- 이 템플릿

- 조건

- test

- 지원

- XNUMXD덴탈의

- 그래프

- 그들의

- 그것에 의하여

- 따라서

- 을 통하여

- 처리량

- 시간

- 따라서 오른쪽 하단에

- 타이밍

- 에

- 너무

- 화제

- 금액

- Train

- 훈련 된

- 트레이닝

- 거래

- 거래 내역

- 치료

- 나무

- 시도

- 시련

- 참된

- 유형

- 전형적인

- us

- 사용

- 사용자

- 보통

- 검증 된

- 가치

- 마케팅은:

- 를 통해

- 어느

- 동안

- Wi-Fi 접속 설비

- 의지

- 없이

- 말

- 가치

- 겠지

- 자신의

- 너의

- 제퍼 넷