콘텐츠 조정은 온라인 안전을 유지하고 웹사이트와 소셜 미디어 플랫폼의 가치와 표준을 유지하는 데 중추적인 역할을 합니다. 그 중요성은 사용자가 부적절한 콘텐츠에 노출되지 않도록 보호하고 디지털 공간에서 사용자의 안녕을 보호한다는 점에서 강조됩니다. 예를 들어, 광고 업계에서 콘텐츠 조정은 불리한 연관성으로부터 브랜드를 보호함으로써 브랜드 상승과 수익 성장에 기여합니다. 광고주는 브랜드의 평판을 유지하고 부정적인 평판을 피하기 위해 적절한 콘텐츠와 브랜드의 연계를 우선시합니다. 콘텐츠 조정은 다양한 기능을 수행하는 금융 및 의료 부문에서도 매우 중요합니다. 이는 민감한 개인 식별 정보 및 건강 정보(PII, PHI)를 식별하고 보호하는 데 중요한 역할을 합니다. 내부 표준 및 관행을 준수하고 외부 규정을 준수함으로써 콘텐츠 조정은 사용자를 위한 디지털 보안을 강화합니다. 이러한 방식으로 공개 플랫폼에서 기밀 데이터가 실수로 공유되는 것을 방지하여 사용자 개인 정보 보호 및 데이터 보안을 보장합니다.

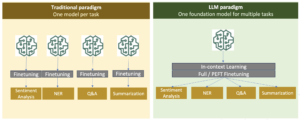

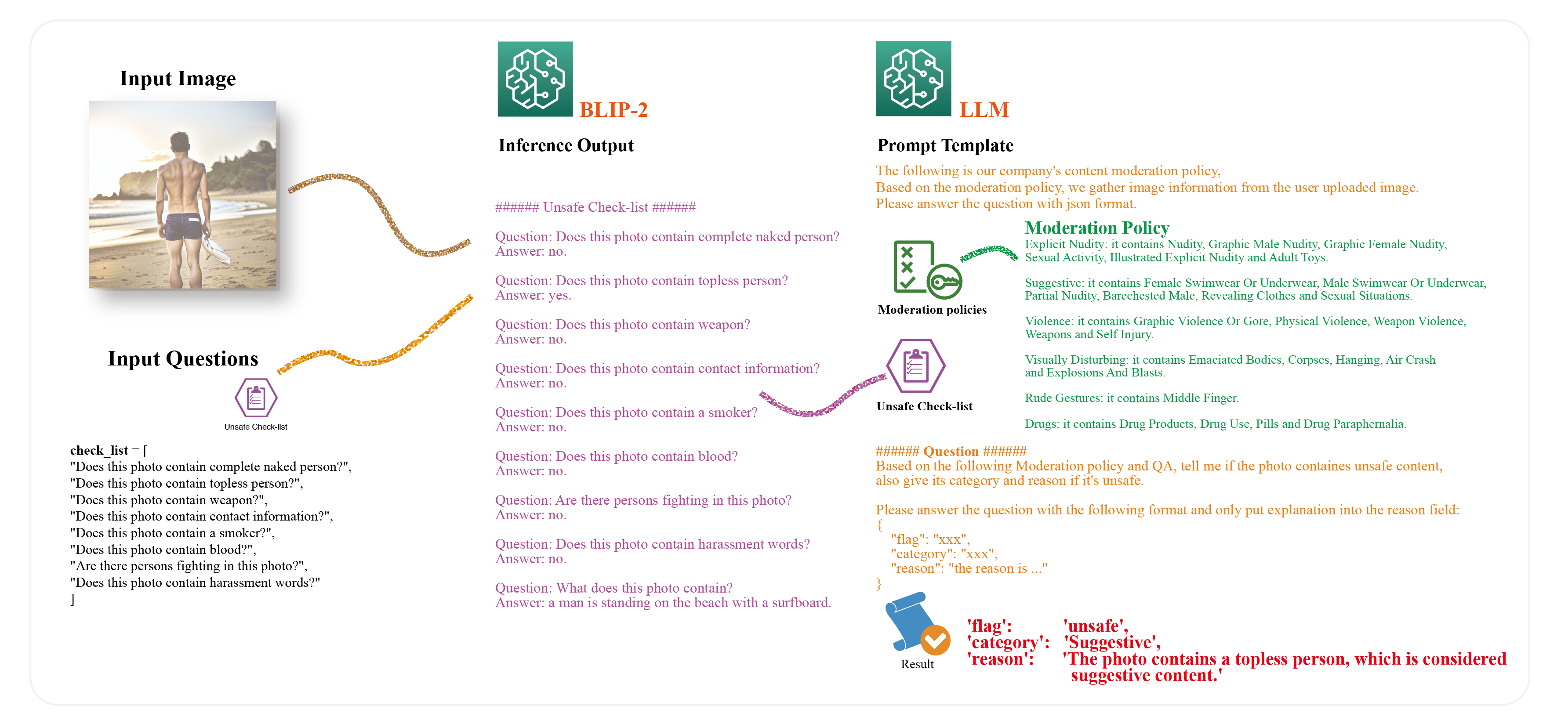

이 게시물에서는 다중 모드 사전 학습 및 LLM(대형 언어 모델)을 사용하여 이미지 데이터에 대한 콘텐츠 조정을 수행하는 새로운 방법을 소개합니다. 다중 모드 사전 학습을 통해 관심 있는 질문 세트를 기반으로 이미지 콘텐츠를 직접 쿼리할 수 있으며 모델은 이러한 질문에 답할 수 있습니다. 이를 통해 사용자는 이미지와 채팅하여 조직의 정책을 위반하는 부적절한 콘텐츠가 포함되어 있는지 확인할 수 있습니다. 우리는 LLM의 강력한 생성 기능을 사용하여 안전/안전하지 않은 라벨 및 카테고리 유형을 포함한 최종 결정을 내립니다. 또한 프롬프트를 디자인하여 LLM이 JSON 형식과 같은 정의된 출력 형식을 생성하도록 할 수 있습니다. 설계된 프롬프트 템플릿을 통해 LLM은 이미지가 조정 정책을 위반하는지 확인하고, 위반 범주를 식별하고, 이유를 설명하고, 구조화된 JSON 형식으로 출력을 제공할 수 있습니다.

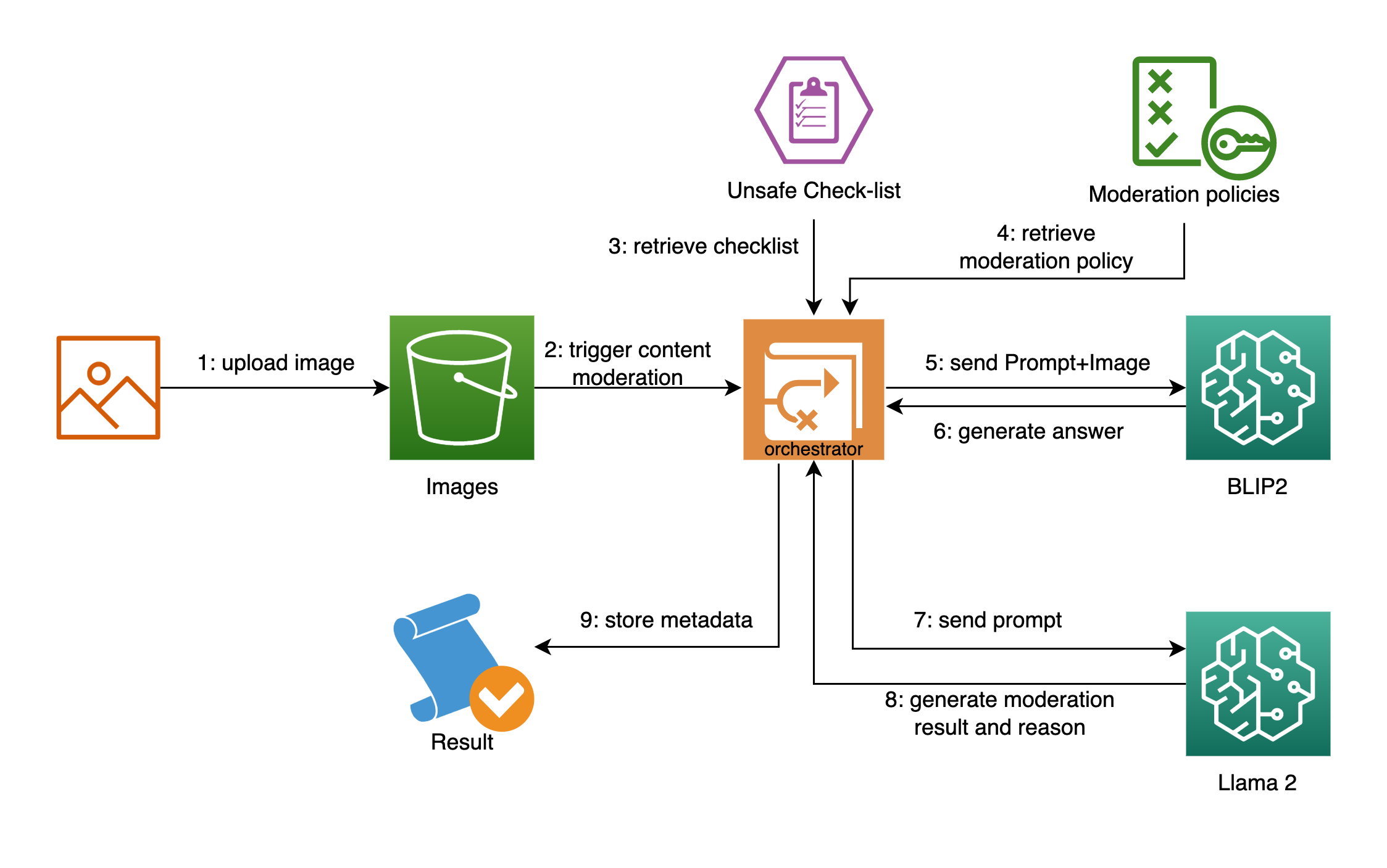

우리는 사용 블립-2 다중 모달 사전 훈련 방법으로. BLIP-2는 다중 모드 사전 훈련의 최첨단 모델 중 하나이며 시각적 질문 답변, 이미지 캡션 작성 및 이미지 텍스트 검색에서 기존 방법 대부분을 능가합니다. LLM의 경우 다음을 사용합니다. 라마 2, 차세대 오픈 소스 LLM, 추론, 코딩, 숙련도, 지식 테스트를 포함한 많은 벤치마크에서 기존 오픈 소스 언어 모델을 능가합니다.. 다음 다이어그램은 솔루션 구성 요소를 보여줍니다.

콘텐츠 조정의 과제

인간 기반 조정과 같은 기존 콘텐츠 조정 방법으로는 사용자 생성 콘텐츠(UGC)의 증가하는 볼륨을 따라잡을 수 없습니다. UGC의 양이 증가함에 따라 인간 중재자는 압도당하고 콘텐츠를 효과적으로 중재하는 데 어려움을 겪을 수 있습니다. 이로 인해 사용자 경험이 저하되고 조정 비용이 높아지며 브랜드 위험이 발생합니다. 사람을 기반으로 한 조정은 오류가 발생하기 쉬우며, 이로 인해 일관되지 않은 조정과 편향된 결정이 발생할 수 있습니다. 이러한 문제를 해결하기 위해 기계 학습(ML)을 기반으로 하는 콘텐츠 조정이 솔루션으로 등장했습니다. ML 알고리즘은 대량의 UGC를 분석하고 조직의 정책을 위반하는 콘텐츠를 식별할 수 있습니다. ML 모델은 패턴을 인식하고 증오심 표현, 스팸, 부적절한 자료 등 문제가 있는 콘텐츠를 식별하도록 훈련될 수 있습니다. 연구에 따르면 AI 기반 콘텐츠 조정으로 사용자, 브랜드, 예산을 보호하세요., ML 기반 콘텐츠 조정을 통해 조직은 팀이 수동으로 콘텐츠를 조정하는 데 소비하는 시간의 최대 95%를 회수할 수 있습니다. 이를 통해 조직은 커뮤니티 구축 및 콘텐츠 제작과 같은 보다 전략적인 작업에 리소스를 집중할 수 있습니다. ML 기반 콘텐츠 조정은 인간 기반 조정보다 효율적이므로 조정 비용을 줄일 수도 있습니다.

ML 기반 콘텐츠 조정의 장점에도 불구하고 여전히 추가 개선 여지가 있습니다. ML 알고리즘의 효율성은 학습된 데이터의 품질에 크게 좌우됩니다. 편향되거나 불완전한 데이터를 사용하여 모델을 훈련하면 잘못된 조정 결정을 내릴 수 있으며, 이로 인해 조직이 브랜드 위험과 잠재적인 법적 책임에 노출될 수 있습니다. 콘텐츠 조정을 위해 ML 기반 접근 방식을 채택하면 신중한 고려가 필요한 몇 가지 과제가 발생합니다. 이러한 과제에는 다음이 포함됩니다.

- 레이블이 지정된 데이터 획득 – 이는 특히 라벨러 교육이 필요한 복잡한 콘텐츠 조정 작업의 경우 비용이 많이 드는 프로세스일 수 있습니다. 이러한 비용으로 인해 감독되는 ML 모델을 쉽게 교육할 만큼 충분히 큰 데이터 세트를 수집하는 것이 어려울 수 있습니다. 또한 모델의 정확성은 훈련 데이터의 품질에 크게 좌우되며, 편향되거나 불완전한 데이터는 부정확한 조정 결정으로 이어질 수 있으며 이는 브랜드 위험 및 법적 책임으로 이어질 수 있습니다.

- 모델 일반화 – 이는 ML 기반 접근 방식을 채택하는 데 중요합니다. 한 데이터 세트에 대해 훈련된 모델은 특히 데이터 세트의 분포가 다른 경우 다른 데이터 세트에 잘 일반화되지 않을 수 있습니다. 따라서 모델이 새로운 데이터에 잘 일반화되도록 하려면 다양하고 대표적인 데이터 세트에 대해 모델을 훈련시키는 것이 중요합니다.

- 운영 효율성 – 이는 콘텐츠 조정을 위해 기존 ML 기반 접근 방식을 사용할 때 또 다른 과제입니다. 지속적으로 새 레이블을 추가하고 새 클래스가 추가될 때 모델을 재교육하는 데는 시간과 비용이 많이 소요될 수 있습니다. 또한 조정되는 콘텐츠의 변경 사항을 따라잡기 위해 모델을 정기적으로 업데이트하는 것이 중요합니다.

- 설명 가능성 – 콘텐츠가 정당하지 않게 표시되거나 제거되면 최종 사용자는 플랫폼이 편향되거나 부당하다고 인식하여 사용자 경험이 저하될 수 있습니다. 마찬가지로 명확한 설명이 없으면 콘텐츠 조정 프로세스가 비효율적이고 시간 소모적이며 조정자에게 비용이 많이 들 수 있습니다.

- 적대적인 성격 – 이미지 기반 콘텐츠 조정의 적대적인 특성은 기존 ML 기반 접근 방식에 고유한 과제를 제시합니다. 악의적인 행위자는 이미지 동의어를 사용하거나 문제가 되지 않는 더 큰 콘텐츠에 실제 콘텐츠를 삽입하는 등 다양한 방식으로 콘텐츠를 변경하여 콘텐츠 조정 메커니즘을 회피하려고 시도할 수 있습니다. 이를 위해서는 그러한 적대적 전술을 탐지하고 대응하기 위해 모델을 지속적으로 모니터링하고 업데이트해야 합니다.

BLIP-2를 사용한 다중 모드 추론

다중 양식 ML 모델은 이미지, 텍스트, 오디오, 비디오 및 기타 형태의 정형 또는 비정형 데이터와 같은 여러 소스 또는 양식의 데이터를 처리하고 통합할 수 있는 모델을 의미합니다. 널리 사용되는 다중 양식 모델 중 하나는 컴퓨터 비전과 자연어 처리(NLP)를 결합하여 시각적 정보와 텍스트 정보를 모두 이해하고 생성하는 BLIP-2와 같은 시각적 언어 모델입니다. 이러한 모델을 통해 컴퓨터는 인간의 이해를 모방하는 방식으로 이미지와 텍스트의 의미를 해석할 수 있습니다. 비전 언어 모델은 이미지 캡션, 이미지 텍스트 검색, 시각적 질문 응답 등을 포함한 다양한 작업을 처리할 수 있습니다. 예를 들어, 이미지 캡션 모델은 이미지의 자연어 설명을 생성할 수 있고, 이미지 텍스트 검색 모델은 텍스트 쿼리를 기반으로 이미지를 검색할 수 있습니다. 시각적 질문 응답 모델은 이미지에 대한 자연어 질문에 응답할 수 있으며, 다중 모드 챗봇은 시각적 및 텍스트 입력을 사용하여 응답을 생성할 수 있습니다. 콘텐츠 조정 측면에서 이 기능을 사용하여 질문 목록에 대해 쿼리할 수 있습니다.

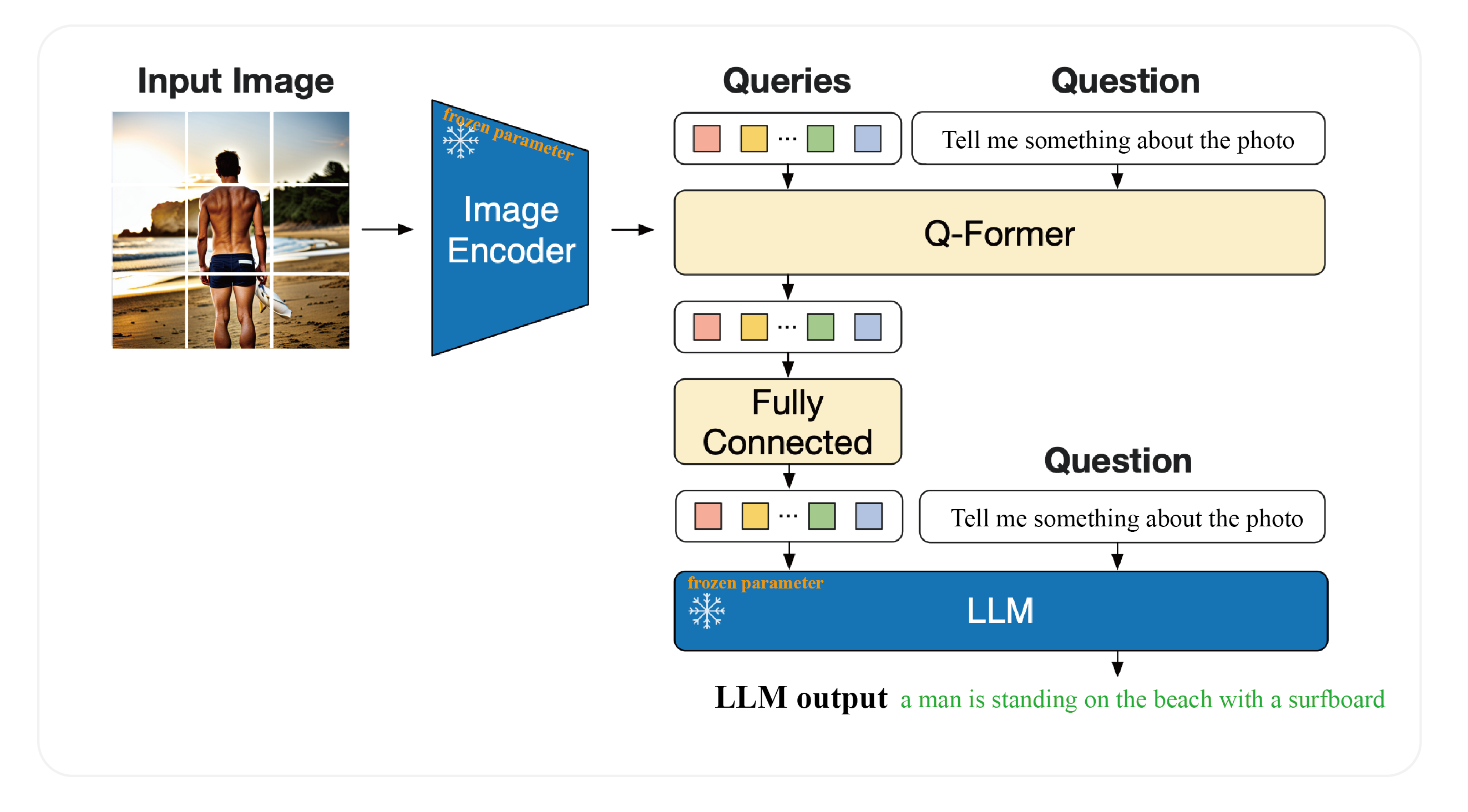

BLIP-2는 세 부분으로 구성됩니다. 첫 번째 구성 요소는 이미지 데이터를 입력으로 사용하는 CLIP의 고정 이미지 인코더 ViT-L/14입니다. 두 번째 구성 요소는 텍스트를 출력하는 고정 LLM인 FlanT5입니다. 세 번째 구성 요소는 고정 이미지 인코더와 고정 LLM을 연결하는 경량 변환기인 Q-Former라는 훈련 가능한 모듈입니다. Q-Former는 학습 가능한 쿼리 벡터를 사용하여 고정 이미지 인코더에서 시각적 특징을 추출하고 가장 유용한 시각적 특징을 LLM에 공급하여 원하는 텍스트를 출력합니다.

사전 훈련 과정은 두 단계로 구성됩니다. 첫 번째 단계에서는 Q-Former가 텍스트에 가장 관련성이 높은 시각적 표현을 학습하도록 비전 언어 표현 학습을 수행합니다. 두 번째 단계에서는 Q-Former의 출력을 고정된 LLM에 연결하고 Q-Former를 교육하여 LLM에서 해석할 수 있는 시각적 표현을 출력함으로써 비전-언어 생성 학습이 수행됩니다.

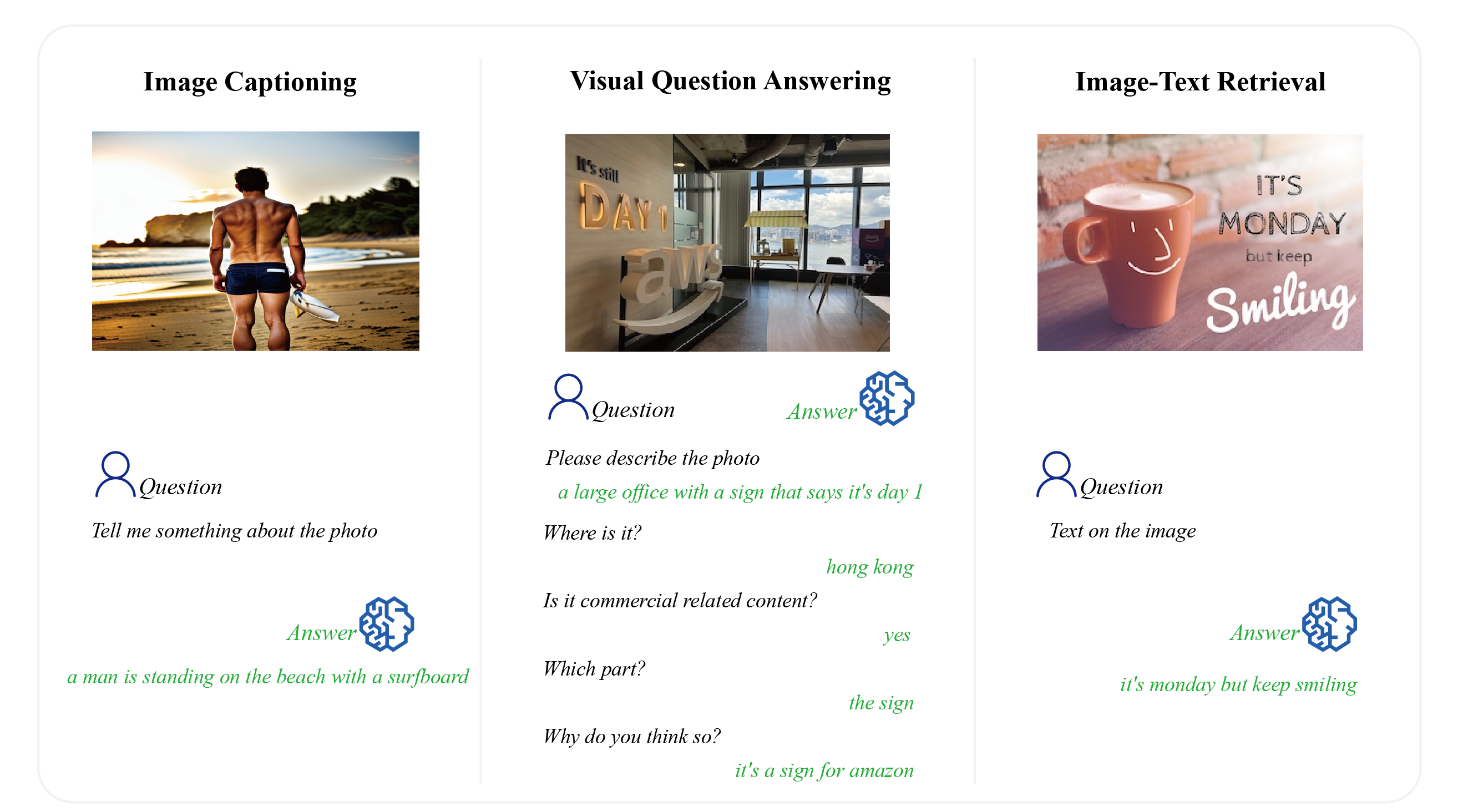

BLIP-2는 기존 방법보다 훈련 가능한 매개변수가 훨씬 적음에도 불구하고 다양한 비전 언어 작업에서 최첨단 성능을 달성합니다. 또한 이 모델은 자연어 지침을 따를 수 있는 제로샷 이미지-텍스트 생성의 새로운 기능을 보여줍니다. 다음 그림은 원본 연구 논문.

솔루션 개요

다음 다이어그램은 솔루션 아키텍처를 보여줍니다.

다음 섹션에서는 BLIP-2를 배포하는 방법을 보여줍니다. 아마존 세이지 메이커 엔드포인트를 사용하고 콘텐츠 조정을 위해 BLIP-2 및 LLM을 사용합니다.

사전 조건

다음과 같은 AWS 계정이 필요합니다. AWS 자격 증명 및 액세스 관리 솔루션의 일부로 생성된 리소스를 관리할 권한이 있는 (IAM) 역할. 자세한 내용은 다음을 참조하십시오. 독립형 AWS 계정 생성.

처음으로 작업하는 경우 아마존 세이지 메이커 스튜디오, 먼저 SageMaker 도메인. 또한 해당 SageMaker 호스팅 인스턴스에 대한 서비스 할당량 증가를 요청해야 할 수도 있습니다. BLIP-2 모델의 경우 ml.g5.2xlarge SageMaker 호스팅 인스턴스. Llama 2 13B 모델의 경우 ml.g5.12xlarge SageMaker 호스팅 인스턴스.

SageMaker 엔드포인트에 BLIP-2 배포

다음을 사용하여 SageMaker에서 LLM을 호스팅할 수 있습니다. 대형 모델 추론 (LMI) DJLServing을 사용하여 대규모 모델을 호스팅하는 데 최적화된 컨테이너입니다. DJLServing은 프로그래밍 언어에 구애받지 않는 DJL(Deep Java Library)을 기반으로 하는 고성능 범용 모델 제공 솔루션입니다. DJL 및 DJLServing에 대해 자세히 알아보려면 다음을 참조하세요. DJLServing 및 DeepSpeed 모델 병렬 추론을 사용하여 Amazon SageMaker에 대규모 모델 배포. SageMaker LMI 컨테이너의 도움으로 BLIP-2 모델은 Hugging Face 라이브러리로 쉽게 구현되고 SageMaker에서 호스팅될 수 있습니다. 당신은 실행할 수 있습니다 blip2-sagemaker.ipynb 이 단계를 위해.

Docker 이미지와 모델 파일을 준비하려면 DJLServing의 Docker 이미지를 가져와서 추론 스크립트와 구성 파일을 패키지로 패키징해야 합니다. model.tar.gz 파일을 업로드하고 아마존 단순 스토리지 서비스 (Amazon S3) 버킷. 당신은 추론 스크립트 및 구성 파일 자세한 내용은.

inference_image_uri = image_uris.retrieve( framework="djl-deepspeed", region=sess.boto_session.region_name, version="0.22.1"

)

! tar czvf model.tar.gz blip2/

s3_code_artifact = sess.upload_data("model.tar.gz", bucket, s3_code_prefix)Docker 이미지 및 추론 관련 파일이 준비되면 모델, 엔드포인트 구성 및 엔드포인트를 생성합니다.

from sagemaker.utils import name_from_base

blip_model_version = "blip2-flan-t5-xl"

model_name = name_from_base(blip_model_version)

model = Model( image_uri=inference_image_uri, model_data=s3_code_artifact, role=role, name=model_name,

)

model.deploy( initial_instance_count=1, instance_type="ml.g5.2xlarge", endpoint_name=model_name

)엔드포인트 상태가 서비스 상태가 되면 이미지 캡션 작성 및 지시된 제로샷 비전-언어 생성 작업을 위해 엔드포인트를 호출할 수 있습니다. 이미지 캡션 작업의 경우 이미지를 엔드포인트에 전달하기만 하면 됩니다.

import base64

import json

from PIL import Image smr_client = boto3.client("sagemaker-runtime") def encode_image(img_file): with open(img_file, "rb") as image_file: img_str = base64.b64encode(image_file.read()) base64_string = img_str.decode("latin1") return base64_string def run_inference(endpoint_name, inputs): response = smr_client.invoke_endpoint( EndpointName=endpoint_name, Body=json.dumps(inputs) ) print(response["Body"].read()) test_image = "carcrash-ai.jpeg"

base64_string = encode_image(test_image)

inputs = {"image": base64_string}

run_inference(endpoint_name, inputs)지시된 제로샷 비전-언어 생성 작업의 경우 입력 이미지 외에도 질문을 프롬프트로 정의해야 합니다.

base64_string = encode_image(test_image)

inputs = {"prompt": "Question: what happened in this photo? Answer:", "image": base64_string}

run_inference(endpoint_name, inputs)콘텐츠 조정을 위해 BLIP-2 및 LLM 사용

이 단계에서는 주어진 이미지에 대해 쿼리를 수행하고 숨겨진 정보를 검색할 수 있습니다. LLM을 사용하면 쿼리를 구성하고 정보를 검색하여 JSON 형식 결과를 생성할 수 있습니다. 이 작업은 대략 다음 두 가지 하위 작업으로 나눌 수 있습니다.

- BLIP-2 모델을 사용하여 이미지에서 정보를 추출합니다.

- LLM을 사용하여 최종 결과와 설명을 생성합니다.

BLIP-2 모델을 사용하여 이미지에서 정보 추출

주어진 이미지에서 유용한 숨겨진 정보를 충분히 검색하려면 쿼리를 정의해야 합니다. 각 쿼리는 엔드포인트를 한 번 호출하므로 많은 쿼리로 인해 처리 시간이 길어집니다. 따라서 쿼리 품질을 높이고 모든 정책을 다루되 중복되지 않도록 하는 것이 좋습니다. 샘플 코드에서는 쿼리를 다음과 같이 정의합니다.

check_list = [ "Does this photo contain complete naked person?", "Does this photo contain topless person?", "Does this photo contain weapon?", "Does this photo contain contact information?", "Does this photo contain a smoker?", "Does this photo contain blood?", "Are there persons fighting in this photo?", "Does this photo contain harassment words?"

]이전 쿼리를 사용하여 BLIP-2의 끝점을 호출하여 다음 코드로 정보를 검색합니다.

test_image = "./surf_swimwear.png"

raw_image = Image.open(test_image).convert('RGB') base64_string = encode_image(test_image)

conversations = """"""

for question in check_list: inputs = {"prompt": f"Question: {question}? Answer:", "image": base64_string} response = run_inference(endpoint_name, inputs) conversations += f"""

Question: {question}

Answer: {response}. """쿼리로 검색된 정보 외에도 엔드포인트를 호출하여 이미지 캡션 작업으로 정보를 얻을 수 있습니다. prompt 페이로드의 필드:

inputs = {"image": base64_string}

response = smr_client.invoke_endpoint(

EndpointName=endpoint_name, Body=json.dumps(inputs)

)

image_caption = response["Body"].read().decode('utf-8')쿼리 및 답변 내용을 이미지 캡션과 결합하고 검색된 정보를 아래의 다음 섹션에 설명된 다운스트림 작업에 사용할 수 있습니다.

LLM을 사용하여 최종 결과 및 설명 생성

Llama 2와 같은 LLM(대규모 언어 모델)은 올바른 프롬프트 템플릿을 사용하여 고품질 결과를 생성할 수 있습니다. 사용 Amazon SageMaker 점프스타트, ML 실무자는 공개적으로 사용 가능한 다양한 기초 모델 중에서 선택할 수 있습니다. 이제 SageMaker Studio에서 몇 번의 클릭만으로 다음을 수행할 수 있습니다. Llama 2를 발견하고 배포하세요.

최종 결과는 특정 프롬프트 템플릿이 있는 LLM에 의존합니다. 이러한 프롬프트는 다음과 같이 구성됩니다. 부적절하거나 공격적인 카테고리에 따른 조정 정책 중재 카테고리; BLIP-2에서 추출된 이미지 정보; 사진에 안전하지 않은 콘텐츠가 포함되어 있는지 묻고 안전하지 않은 경우 해당 카테고리와 이유를 요청하는 LLM에 대한 질문 템플릿 결과를 JSON 형식으로 출력하는 방법에 대한 지침입니다. 설계된 프롬프트 템플릿을 통해 LLM은 이미지가 조정 정책을 위반하는지 확인하고, 위반 범주를 식별하고, 이유를 설명하고, 구조화된 JSON 형식으로 출력을 제공할 수 있습니다.

핵심 소스코드는 다음과 같습니다.

prompt_template = f"""

The following is our company's content moderation policy, based on the moderation policy, we gather image information from the user uploaded image. Please answer the question with json format. ###### moderation policy ######

{moderation_policy} ###### Image information ######

{conversations} ###### Question ######

Based on the following Moderation policy and QA, tell me if the photo containes unsafe content, also give its category and reason if it's unsafe. Please anwser the question with the following format and only put explanation into the reason field: """ prompt_template += """

{ "flag": "xxx", "category": "xxx", "reason": "the reason is ..."

} """ dialog = [ {"role": "user", "content": prompt_template}

]자신의 사용 사례에 따라 프롬프트를 사용자 정의할 수 있습니다. 다음을 참조하세요. 수첩 상세 사항은. 프롬프트가 준비되면 LLM 엔드포인트를 호출하여 결과를 생성할 수 있습니다.

endpoint_name = "jumpstart-dft-meta-textgeneration-llama-2-70b-f" def query_endpoint(payload): client = boto3.client("sagemaker-runtime") response = client.invoke_endpoint( EndpointName=endpoint_name, ContentType="application/json", Body=json.dumps(payload), CustomAttributes="accept_eula=true", ) response = response["Body"].read().decode("utf8") response = json.loads(response) return response payload = { "inputs": [dialog], "parameters": {"max_new_tokens": 256, "top_p": 0.9, "temperature": 0.5}

}

result = query_endpoint(payload)[0]생성된 출력의 일부는 다음과 같습니다.

가끔 라마2에서는 보조자의 답변 외에 추가 설명을 첨부하기도 합니다. 구문 분석 코드를 사용하여 원래 생성된 결과에서 JSON 데이터를 추출할 수 있습니다.

answer = result['generation']['content'].split('}')[0]+'}'

json.loads(answer)

생성적 접근 방식의 장점

이전 섹션에서는 모델 추론의 핵심 부분을 구현하는 방법을 보여주었습니다. 이 섹션에서는 기존 접근 방식 및 관점과의 비교를 포함하여 생성적 접근 방식의 다양한 측면을 다룹니다.

다음 표에서는 각 접근 방식을 비교합니다.

| . | 생성적 접근 방식 | 분류 접근법 |

| 레이블이 지정된 데이터 획득 | 다수의 이미지에 대해 사전 훈련된 모델, 제로샷 추론 | 모든 유형의 카테고리에 대한 데이터가 필요합니다. |

| 모델 일반화 | 다양한 유형의 이미지로 사전 학습된 모델 | 모델 일반화를 개선하려면 대량의 콘텐츠 조정 관련 데이터가 필요합니다. |

| 운영 효율성 | 제로샷 기능 | 다양한 패턴을 인식하기 위해 모델을 훈련하고 라벨이 추가될 때 재훈련이 필요합니다. |

| 설명 가능성 | 텍스트 출력으로서의 추론, 뛰어난 사용자 경험 | 추론이 어렵고, 설명하고 해석하기가 어렵습니다. |

| 적대적인 성격 | Robust | 고주파 재훈련 |

콘텐츠 조정을 넘어서는 다중 모드 추론의 잠재적 사용 사례

BLIP-2 모델은 다음을 포함하여 미세 조정 여부에 관계없이 다양한 목적에 맞게 적용할 수 있습니다.

- 이미지 캡션 – 모델에 이미지의 시각적 콘텐츠에 대한 텍스트 설명을 생성하도록 요청합니다. 다음 예시 이미지(왼쪽)에서 볼 수 있듯이, “한 남자가 서핑보드를 들고 해변에 서 있습니다.” 이미지 설명대로.

- 시각적 질문 답변 – 중앙의 예시 이미지에서 볼 수 있듯이, 우리는 다음과 같이 질문할 수 있습니다. “상업관련 내용인가” 우리는 "예" 대답으로. 또한 BLIP-2는 다단계 대화를 지원하며 다음과 같은 질문을 출력합니다. "왜 그렇게 생각하세요?" 시각적 단서 및 LLM 기능을 기반으로 BLIP-2 출력 "아마존을 향한 신호입니다."

- 이미지 텍스트 검색 – 다음과 같은 질문이 주어졌습니다. “이미지의 텍스트”, 이미지 텍스트를 추출할 수 있습니다 “월요일이지만 계속 웃으세요” 오른쪽 이미지에 설명된 대로.

다음 이미지는 시각적 지식 추론의 제로샷 이미지-텍스트 기능을 보여주는 예를 보여줍니다.

위의 다양한 예에서 볼 수 있듯이 다중 양식 모델은 기존 단일 양식 모델이 해결하기 힘든 복잡한 문제를 해결할 수 있는 새로운 기회를 열어줍니다.

정리

향후 요금이 발생하지 않도록 하려면 이 게시물의 일부로 생성된 리소스를 삭제하세요. 노트북 정리 섹션의 지침에 따라 이를 수행하거나 SageMaker 콘솔 및 S3 버킷에 저장된 리소스를 통해 생성된 엔드포인트를 삭제할 수 있습니다.

결론

이 게시물에서 우리는 디지털 세계에서 콘텐츠 조정의 중요성에 대해 논의하고 그 과제를 강조했습니다. 우리는 이미지 데이터로 콘텐츠 조정을 개선하고 이미지에 대한 질문 답변을 수행하여 유용한 정보를 자동으로 추출하는 새로운 방법을 제안했습니다. 또한 기존 분류 기반 접근 방식과 비교하여 생성적 AI 기반 접근 방식을 사용할 때의 이점에 대해 추가 논의를 제공했습니다. 마지막으로 콘텐츠 조정을 넘어 시각적 언어 모델의 잠재적인 사용 사례를 설명했습니다.

SageMaker를 살펴보고 이 게시물에 제공된 다중 양식 솔루션과 비즈니스와 관련된 데이터 세트를 사용하여 솔루션을 구축하여 자세히 알아보는 것이 좋습니다.

저자에 관하여

고든 왕 AWS의 수석 AI/ML 전문가 TAM입니다. 그는 다양한 산업 분야에 걸쳐 AI/ML 모범 사례를 통해 전략적 고객을 지원합니다. 그는 컴퓨터 비전, NLP, 생성 AI 및 MLOps에 열정을 갖고 있습니다. 여가 시간에는 달리기와 하이킹을 좋아합니다.

고든 왕 AWS의 수석 AI/ML 전문가 TAM입니다. 그는 다양한 산업 분야에 걸쳐 AI/ML 모범 사례를 통해 전략적 고객을 지원합니다. 그는 컴퓨터 비전, NLP, 생성 AI 및 MLOps에 열정을 갖고 있습니다. 여가 시간에는 달리기와 하이킹을 좋아합니다.

얀웨이 추이, PhD는 AWS의 수석 기계 학습 전문가 솔루션 아키텍트입니다. 그는 IRISA(컴퓨터 과학 및 랜덤 시스템 연구소)에서 기계 학습 연구를 시작했으며 컴퓨터 비전, 자연어 처리 및 온라인 사용자 행동 예측 분야에서 AI 기반 산업 애플리케이션을 구축한 수년 간의 경험을 보유하고 있습니다. AWS에서 그는 자신의 분야 전문 지식을 공유하고 고객이 대규모 기계 학습을 통해 비즈니스 잠재력을 발휘하고 실행 가능한 결과를 도출하도록 돕습니다. 업무 외에는 독서와 여행을 즐깁니다.

얀웨이 추이, PhD는 AWS의 수석 기계 학습 전문가 솔루션 아키텍트입니다. 그는 IRISA(컴퓨터 과학 및 랜덤 시스템 연구소)에서 기계 학습 연구를 시작했으며 컴퓨터 비전, 자연어 처리 및 온라인 사용자 행동 예측 분야에서 AI 기반 산업 애플리케이션을 구축한 수년 간의 경험을 보유하고 있습니다. AWS에서 그는 자신의 분야 전문 지식을 공유하고 고객이 대규모 기계 학습을 통해 비즈니스 잠재력을 발휘하고 실행 가능한 결과를 도출하도록 돕습니다. 업무 외에는 독서와 여행을 즐깁니다.

멜라니 리, PhD는 호주 시드니에 본사를 둔 AWS의 수석 AI/ML 전문가 TAM입니다. 그녀는 기업 고객이 AWS에서 최신 AI/ML 도구를 사용하여 솔루션을 구축하도록 돕고 모범 사례로 ML 솔루션을 설계하고 구현하는 방법에 대한 지침을 제공합니다. 여가 시간에는 자연을 탐험하고 가족 및 친구들과 시간을 보내는 것을 좋아합니다.

멜라니 리, PhD는 호주 시드니에 본사를 둔 AWS의 수석 AI/ML 전문가 TAM입니다. 그녀는 기업 고객이 AWS에서 최신 AI/ML 도구를 사용하여 솔루션을 구축하도록 돕고 모범 사례로 ML 솔루션을 설계하고 구현하는 방법에 대한 지침을 제공합니다. 여가 시간에는 자연을 탐험하고 가족 및 친구들과 시간을 보내는 것을 좋아합니다.

- SEO 기반 콘텐츠 및 PR 배포. 오늘 증폭하십시오.

- PlatoData.Network 수직 생성 Ai. 자신에게 권한을 부여하십시오. 여기에서 액세스하십시오.

- PlatoAiStream. 웹3 인텔리전스. 지식 증폭. 여기에서 액세스하십시오.

- 플라톤ESG. 자동차 / EV, 탄소, 클린테크, 에너지, 환경, 태양광, 폐기물 관리. 여기에서 액세스하십시오.

- PlatoHealth. 생명 공학 및 임상 시험 인텔리전스. 여기에서 액세스하십시오.

- 차트프라임. ChartPrime으로 트레이딩 게임을 향상시키십시오. 여기에서 액세스하십시오.

- BlockOffsets. 환경 오프셋 소유권 현대화. 여기에서 액세스하십시오.

- 출처: https://aws.amazon.com/blogs/machine-learning/build-a-generative-ai-based-content-moderation-solution-on-amazon-sagemaker-jumpstart/

- :있다

- :이다

- :아니

- :어디

- $UP

- 1

- 10

- 100

- 20

- 22

- 7

- 9

- 95%

- a

- 할 수 있는

- 소개

- 위의

- ACCESS

- 에 따르면

- 계정

- 달성

- 달성하다

- 배우

- 실제

- 추가

- 첨가

- 또한

- 추가

- 또한

- 주소

- 고착

- 채택

- 양자

- 장점

- 적의

- 광고주

- 광고

- 반대

- AI

- AI 기반

- AI / ML

- 알고리즘

- 조정

- All

- 수

- 또한

- 아마존

- 아마존 세이지 메이커

- Amazon SageMaker 점프스타트

- Amazon Web Services

- an

- 분석하다

- 및

- 다른

- 답변

- 답변

- 어떤

- 어플리케이션

- 적용된

- 접근

- 구혼

- 적당한

- 아키텍처

- 있군요

- AS

- 문의

- 측면

- 조수

- 협회

- 가정하다

- At

- 오디오

- 호주

- 자동적으로

- 가능

- 피하기

- AWS

- 나쁜

- 기반으로

- BE

- 바닷가

- 때문에

- 가

- 된다

- 행동

- 존재

- 이하

- 벤치 마크

- 게다가

- BEST

- 모범 사례

- 그 너머

- 치우친

- 피

- 몸

- 두

- 상표

- 브랜드

- 돋보이게

- 넓은

- 예산

- 빌드

- 건물

- 사업

- 비자 면제 프로그램에 해당하는 국가의 시민권을 가지고 있지만

- by

- 라는

- CAN

- 얻을 수 있습니다

- 기능

- 능력

- 주의

- 케이스

- 가지 경우

- 카테고리

- 범주

- 도전

- 과제

- 도전

- 변경

- 요금

- 잡담

- 왼쪽 메뉴에서

- 수업

- 선명한

- 클라이언트

- 천

- 암호

- 코딩

- 결합

- 결합

- 상업

- 커뮤니티

- 공동체 건설

- 회사

- 비교

- 완전한

- 복잡한

- 구성 요소

- 구성 요소들

- 컴퓨터

- 컴퓨터 과학

- 컴퓨터 비전

- 컴퓨터

- 구성

- 확인하기

- 연결

- 커넥트

- 고려

- 고려

- 구성

- 콘솔에서

- 상수

- 끊임없이

- CONTACT

- 포함하는

- 컨테이너

- 이 포함되어 있습니다

- 함유량

- 콘텐츠 제작

- 내용

- 기여

- 전통적인

- 대화

- 대화

- 핵심

- 동

- 비용

- 값 비싼

- 비용

- 수

- 엄호

- 만들

- 만든

- 창조

- 임계

- Cross

- 고객

- 사용자 정의

- 데이터

- 데이터 보안

- 데이터 세트

- 결정

- 결정

- 깊은

- 밝히다

- 한정된

- 보여

- 시연

- 보여줍니다

- 배포

- 기술 된

- 설명

- 설계

- 설계

- 원하는

- 무례

- 세부설명

- 검색

- 결정

- 다이얼로그

- 다른

- 디지털

- 디지털 세계

- 직접

- 논의 된

- 토론

- 배포

- 몇몇의

- do

- 도커

- 하지

- 도메인

- 드라이브

- 마다

- 완화

- 용이하게

- 효과적으로

- 유효성

- 효율적인

- 임베딩

- 등장

- 신흥

- 고용하다

- 가능

- 수

- 격려

- end

- 종점

- 강화

- 충분히

- 확인

- 보장

- Enterprise

- 오류

- 특히

- 필수

- 예

- 예

- 현존하는

- 경험

- 전문적 지식

- 설명

- 설명

- 탐험

- 탐색

- 노출 시간

- 외부

- 추출물

- 페이스메이크업

- 폭포

- 가족

- 특색

- 특징

- 여자

- 를

- 적은

- 들

- 싸움

- 입양 부모로서의 귀하의 적합성을 결정하기 위해 미국 이민국에

- 파일

- 최후의

- 재원

- 먼저,

- 처음으로

- 맞게

- 신고 된

- 초점

- 따라

- 수행원

- 다음

- 럭셔리

- 체재

- 양식

- Foundation

- 진동수

- 친구

- 에

- 겨울 왕국

- 기능

- 추가

- 미래

- 수집

- 생성

- 생성

- 생성

- 세대

- 생성적인

- 제너레이티브 AI

- 얻을

- 주기

- 주어진

- 큰

- 성장하는

- 성장

- 지도

- 핸들

- 일이

- 하드

- 있다

- 데

- he

- 건강

- 건강 정보

- 건강 관리

- 무겁게

- 도움

- 도움이

- 그녀의

- 숨겨진

- 높은

- 고성능

- 높은 품질의

- 강조

- 그의

- 주인

- 호스팅

- 호스팅

- 방법

- How To

- HTML

- HTTP

- HTTPS

- 사람의

- 확인

- 식별

- 통합 인증

- if

- 설명하다

- 영상

- 형상

- 구현

- 구현

- 구현

- import

- 중요성

- 중대한

- 개선

- 개량

- in

- 부정확 한

- 포함

- 포함

- 포함

- 증가

- 증가

- 산업

- 산업

- 산업

- 비효율적

- 정보

- 입력

- 입력

- 예

- 학회

- 명령

- 통합

- 관심

- 내부의

- 으로

- 소개

- IT

- 그

- 자바

- JPG

- JSON

- 다만

- 유지

- 지식

- 레이블

- 언어

- 넓은

- 큰

- 리드

- 지도

- 배우다

- 배우기

- 왼쪽 (left)

- 이용약관

- 부채

- 도서관

- 경량의

- 명부

- 야마

- LLM

- 이상

- loves

- 기계

- 기계 학습

- 유지 보수

- 확인

- 유튜브 영상을 만드는 것은

- 사람

- 관리

- 수동으로

- .

- 자료

- XNUMX월..

- me

- 의미

- 메커니즘

- 미디어

- 메타

- 방법

- 방법

- 중간

- ML

- MLOps

- 모델

- 모델

- 절도

- 수정

- 모듈

- 월요일

- 모니터링

- 배우기

- 보다 효율적으로

- 가장

- 여러

- 자연의

- 자연 언어 처리

- 자연

- 필요

- 부정

- 신제품

- 다음 것

- nlp

- 수첩

- 소설

- 지금

- 번호

- of

- 공격

- on

- 일단

- ONE

- 온라인

- 만

- 열 수

- 오픈 소스

- 기회

- 최적화

- or

- 조직

- 실물

- 기타

- 우리의

- 우리 회사

- 결과

- 초과 수익률

- 출력

- 외부

- 압도

- 자신의

- 꾸러미

- 평행

- 매개 변수

- 부품

- 특별히

- 부품

- 패스

- 열렬한

- 패턴

- 수행

- 성능

- 수행

- 권한

- 사람

- 확인

- 명

- 전망

- 박사 학위

- 사진

- 추축의

- 플랫폼

- 플랫폼

- 플라톤

- 플라톤 데이터 인텔리전스

- 플라토데이터

- 재생

- 부디

- 정책

- 정책

- 가난한

- 인기 문서

- 게시하다

- 가능성

- 잠재력

- powered

- 강한

- 사례

- 예측

- Prepare

- 선물

- 보존

- 방지

- 우선 순위

- 개인 정보 보호

- 문제

- 방법

- 처리

- 프로그램 작성

- 제안 된

- 보호

- 제공

- 제공

- 제공

- 공개

- 널리 알려짐

- 공개적으로

- 목적

- 놓다

- 질문 게시판

- 품질

- 쿼리

- 문제

- 문의

- 닥치는대로의

- 읽기

- 준비

- 이유

- 인식

- 인식하는

- 감소

- 규칙적으로

- 규정

- 관련

- 관련된

- 의지하다

- 제거됨

- 대표

- 대리인

- 평판

- 의뢰

- 필요

- 필요

- 연구

- 제품 자료

- 응답

- 응답

- 응답

- 결과

- 결과

- 결과

- return

- 공개

- 수익

- 매출 성장

- RGB

- 연락해주세요

- 위험

- 위험

- 직위별

- 거칠게

- 통치

- 달리기

- 달리는

- s

- 보호

- 안전

- 현자

- 규모

- 과학

- 검색

- 둘째

- 섹션

- 섹션

- 부문

- 보안

- 참조

- 선택

- 연장자

- 민감한

- 봉사하다

- 서비스

- 서비스

- 피복재

- 세트

- 몇몇의

- 성적

- 공유

- 공유

- 그녀

- 방패

- 표시

- 보여

- 쇼

- 기호

- 의미

- 크게

- 비슷하게

- 단순, 간단, 편리

- 상황

- So

- 사회적

- 소셜 미디어

- 소셜 미디어 플랫폼

- 해결책

- 솔루션

- 해결

- 출처

- 소스 코드

- 지우면 좋을거같음 . SM

- 스페이스 버튼

- 공간

- 스팸

- 전문가

- 구체적인

- 연설

- 지출

- 분열

- 단계

- 단계

- 독립

- 기준

- 시작

- 최첨단

- 미국

- Status

- 단계

- 아직도

- 저장

- 저장

- 전략의

- 구조화

- 노력

- 스튜디오

- 교육과정

- 이러한

- 제안

- 지원

- 시드니

- 시스템은

- 테이블

- 태클

- 전술

- 소요

- 태스크

- 작업

- 팀

- 이야기

- 이 템플릿

- 조건

- 본문

- 텍스트

- 보다

- 그

- XNUMXD덴탈의

- 정보

- 그들의

- 그곳에.

- 그것에 의하여

- 따라서

- Bowman의

- 그들

- 생각

- 제삼

- 이

- 세

- 시간

- 시간이 많이 걸리는

- 에

- 검색을

- 전통적인

- Train

- 훈련 된

- 트레이닝

- 변압기

- 여행

- 두

- 유형

- 유형

- 아래에

- 이해

- 이해

- 유일한

- 보편적 인

- 잠금을 해제

- 업데이트

- 업데이트

- 받치다

- 업로드

- 사용

- 유스 케이스

- 사용자

- 사용자 경험

- 사용자 개인 정보

- 사용자

- 사용

- 마케팅은:

- 종류

- 여러

- 를 통해

- Video

- 위반

- 시력

- 음량

- 볼륨

- 방법..

- 방법

- we

- 웹

- 웹 서비스

- 웹 사이트

- 잘

- 뭐

- 언제

- 어느

- why

- 의지

- 과

- 이내

- 없이

- 말

- 작업

- 일하는

- 세계

- 겠지

- 년

- 자신의

- 너의

- 제퍼 넷