인공 지능(AI) 및 기계 학습(ML)의 세계는 인간과 유사한 텍스트, 이미지, 코드 및 오디오를 생성할 수 있는 생성 AI 모델의 등장으로 패러다임 전환을 목격하고 있습니다. 기존 ML 모델에 비해 생성 AI 모델은 훨씬 더 크고 복잡합니다. 그러나 복잡성이 증가함에 따라 추론 비용이 높아지고 강력한 컴퓨팅 리소스에 대한 요구가 증가합니다. 제너레이티브 AI 모델에 대한 높은 추론 비용은 리소스가 제한적인 기업 및 연구원에게 진입 장벽이 될 수 있으므로 보다 효율적이고 비용 효율적인 솔루션이 필요합니다. 또한 대부분의 생성 AI 사용 사례는 인간 상호 작용 또는 실제 시나리오와 관련되어 지연 시간이 짧은 성능을 제공할 수 있는 하드웨어가 필요합니다. AWS는 강력하고 효율적이며 비용 효율적인 컴퓨팅 하드웨어에 대한 증가하는 요구를 해결하기 위해 특별히 제작된 칩으로 혁신을 거듭해 왔습니다.

오늘 우리는 아마존 세이지 메이커 지원 AWS 인퍼렌시아2 (ml.inf2) 및 AWS 트레이닝 (ml.trn1) 기반 SageMaker 인스턴스는 실시간 및 비동기 추론을 위한 생성 AI 모델을 호스팅합니다. ml.inf2 인스턴스는 미국 동부(오하이오)의 SageMaker 및 미국 동부(버지니아 북부)의 ml.trn1 인스턴스에서 모델 배포에 사용할 수 있습니다.

SageMaker에서 이러한 인스턴스를 사용하여 LLM(Large Language Model), Stable Diffusion 및 비전 변환기를 포함한 생성 AI 모델에 대해 저렴한 비용으로 고성능을 달성할 수 있습니다. 또한 다음을 사용할 수 있습니다. Amazon SageMaker 추론 추천자 로드 테스트를 실행하고 이러한 인스턴스에 모델을 배포할 때의 가격 대비 성능 이점을 평가하는 데 도움이 됩니다.

ml.inf2 및 ml.trn1 인스턴스를 사용하여 텍스트 요약, 코드 생성, 비디오 및 이미지 생성, 음성 인식, 개인화, 사기 탐지 등을 위해 SageMaker에서 ML 애플리케이션을 실행할 수 있습니다. SageMaker 엔드포인트를 구성할 때 ml.trn1 또는 ml.inf2 인스턴스를 지정하여 쉽게 시작할 수 있습니다. PyTorch, TensorFlow, Hugging Face 및 대형 모델 추론(LMI)용 ml.trn1 및 ml.inf2 호환 AWS Deep Learning Containers(DLC)를 사용하여 쉽게 시작할 수 있습니다. 버전이 포함된 전체 목록은 다음을 참조하세요. 사용 가능한 딥 러닝 컨테이너 이미지.

이 게시물에서는 LMI 컨테이너를 활용하여 추가 코딩 없이 SageMaker를 사용하여 AWS Inferentia2에 대규모 언어 모델을 배포하는 프로세스를 보여줍니다. 우리는 GPT4ALL-J, 챗봇 스타일 상호작용을 제공하는 미세 조정된 GPT-J 7B 모델.

ml.trn1 및 ml.inf2 인스턴스 개요

ml.trn1 인스턴스는 주로 LLM을 포함한 생성 AI 모델의 고성능 딥 러닝 교육용으로 특별히 제작된 Trainium 액셀러레이터로 구동됩니다. 그러나 이러한 인스턴스는 Inf2에 맞는 것보다 훨씬 더 큰 모델에 대한 추론 워크로드도 지원합니다. 가장 큰 인스턴스 크기인 trn1.32xlarge 인스턴스는 16개를 제공합니다. Trainium 가속기 최대 512페타플롭의 FP3.4/BF16 컴퓨팅 성능을 제공하는 단일 인스턴스에서 16GB의 가속기 메모리를 사용합니다. 16개의 Trainium 가속기가 초고속 NeuronLinkv2와 연결되어 간소화된 집단 통신이 가능합니다.

ml.Inf2 인스턴스는 AWS Inferentia2 가속기, 추론을 위해 특별히 제작된 가속기. 10세대 AWS Inferentia에 비해 2.48배 더 높은 컴퓨팅 성능, 최대 12배 더 높은 처리량, 최대 2배 더 짧은 지연 시간을 제공합니다. 가장 큰 인스턴스 크기인 Inf384xlarge는 BF2.3/FP16에 대해 16페타플롭의 통합 컴퓨팅 성능을 위해 단일 인스턴스에 175GB의 가속기 메모리가 있는 2개의 AWS Inferentia2 가속기를 제공합니다. 이를 통해 단일 인스턴스에서 최대 XNUMX억 개의 매개변수 모델을 배포할 수 있습니다. InfXNUMX는 더 비싼 교육 인스턴스에서만 사용할 수 있는 기능인 이 상호 연결을 제공하는 유일한 추론 최적화 인스턴스입니다. 단일 가속기에 맞지 않는 초대형 모델의 경우 데이터가 CPU를 완전히 우회하여 NeuronLink를 사용하여 가속기 간에 직접 흐릅니다. NeuronLink를 통해 InfXNUMX는 더 빠른 분산 추론을 지원하고 처리량과 지연 시간을 개선합니다.

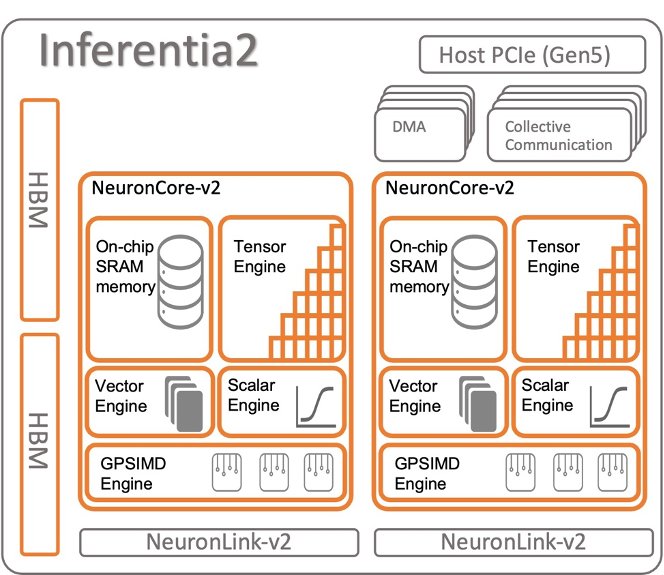

AWS Inferentia2 및 Trainium 액셀러레이터 모두 두 가지 NeuronCores-v2, 32GB HBM 메모리 스택 및 다중 가속기 추론을 수행할 때 계산과 통신을 중첩하여 런타임을 자동으로 최적화하는 전용 집합 컴퓨팅 엔진. 아키텍처에 대한 자세한 내용은 다음을 참조하십시오. Trainium 및 Inferentia 장치.

다음 다이어그램은 AWS Inferentia2를 사용하는 예제 아키텍처를 보여줍니다.

AWS 뉴런 SDK

AWS 뉴런 AWS Inferentia 및 Trainium 기반 인스턴스에서 딥 러닝 워크로드를 실행하는 데 사용되는 SDK입니다. AWS Neuron에는 TensorFlow 및 PyTorch에 기본적으로 통합되는 딥 러닝 컴파일러, 런타임 및 도구가 포함되어 있습니다. Neuron을 사용하면 ml.trn1 및 ml.inf2에서 고성능 ML 워크로드를 개발, 프로파일링 및 배포할 수 있습니다.

XNUMXD덴탈의 뉴런 컴파일러 다양한 형식(TensorFlow, PyTorch, XLA HLO)의 ML 모델을 수용하고 Neuron 장치에서 실행되도록 최적화합니다. Neuron 컴파일러는 ML 프레임워크 내에서 호출되며 여기서 ML 모델은 Neuron 프레임워크 플러그인에 의해 컴파일러로 전송됩니다. 결과 컴파일러 아티팩트는 NEFF 파일(Neuron Executable File Format)이라고 하며, 이는 Neuron 런타임에 의해 Neuron 장치로 로드됩니다.

XNUMXD덴탈의 뉴런 런타임 AWS Inferentia 및 Trainium Neuron 장치에 액세스하기 위한 API를 제공하는 커널 드라이버 및 C/C++ 라이브러리로 구성됩니다. TensorFlow 및 PyTorch용 Neuron ML 프레임워크 플러그인은 Neuron 런타임을 사용하여 NeuronCore에서 모델을 로드하고 실행합니다. Neuron 런타임은 컴파일된 딥 러닝 모델(NEFF)을 Neuron 장치에 로드하고 높은 처리량과 짧은 대기 시간에 최적화되어 있습니다.

SageMaker ml.inf2 인스턴스를 사용하여 NLP 모델 호스팅

LLM 서비스에 대해 자세히 알아보기 전에 변압기-neuronx모델의 큰 가중치 매트릭스를 여러 NeuronCore로 샤딩하는 오픈 소스 라이브러리인 에서 단일 NeuronCore에 맞출 수 있는 모델의 일반적인 배포 흐름을 간략하게 살펴보겠습니다.

확인 지원되는 모델 목록 모델이 AWS Inferentia2에서 지원되는지 확인합니다. 다음으로 모델은 Neuron Compiler에 의해 미리 컴파일되어야 합니다. SageMaker 노트북 또는 아마존 엘라스틱 컴퓨트 클라우드 (Amazon EC2) 인스턴스를 사용하여 모델을 컴파일합니다. 다음 코드와 같이 SageMaker Python SDK를 사용하여 PyTorch와 같은 널리 사용되는 딥 러닝 프레임워크를 사용하여 모델을 배포할 수 있습니다. 모델을 SageMaker 호스팅 서비스에 배포하고 추론에 사용할 수 있는 엔드포인트를 얻을 수 있습니다. 이러한 엔드포인트는 완전 관리형이며 Auto Scaling을 지원합니다.

인용하다 개발자 흐름 샘플 스크립트를 사용하여 SageMaker에서 Inf2의 일반적인 개발 흐름에 대한 자세한 내용을 확인하십시오.

SageMaker ml.inf2 인스턴스를 사용하여 LLM 호스팅

수십억 개의 매개변수가 있는 대규모 언어 모델은 단일 가속기에 맞추기에는 너무 큰 경우가 많습니다. 이를 위해서는 여러 가속기에서 LLM을 호스팅하기 위해 모델 병렬 기술을 사용해야 합니다. LLM을 호스팅하기 위한 또 다른 중요한 요구 사항은 고성능 모델 제공 솔루션의 구현입니다. 이 솔루션은 효율적으로 모델을 로드하고 파티셔닝을 관리하며 HTTP 끝점을 통해 요청을 원활하게 처리해야 합니다.

SageMaker에는 모델 병렬 처리 및 대규모 모델 추론을 위한 특수 딥 러닝 컨테이너(DLC), 라이브러리 및 도구가 포함되어 있습니다. SageMaker에서 LMI를 시작하기 위한 리소스는 다음을 참조하십시오. 모델 병렬화 및 대규모 모델 추론. SageMaker는 AWS 인프라에서 GPT, T5, OPT, BLOOM 및 Stable Diffusion과 같은 대규모 모델을 호스팅하기 위해 널리 사용되는 오픈 소스 라이브러리로 DLC를 유지 관리합니다. 이러한 특수 DLC를 SageMaker LMI 컨테이너라고 합니다.

SageMaker LMI 컨테이너 NeuronCore에서 텐서 병렬 처리를 지원하기 위해 Transformers-neuronx 라이브러리와 통합된 모델 서버인 DJLServing을 사용합니다. DJLServing 작동 방식에 대한 자세한 내용은 다음을 참조하십시오. DJLServing 및 DeepSpeed 모델 병렬 추론을 사용하여 Amazon SageMaker에 대규모 모델 배포. DJL 모델 서버 및 Transformers-neuronx 라이브러리는 Neuron SDK도 포함하는 컨테이너의 핵심 구성 요소 역할을 합니다. 이 설정은 AWS Inferentia2 액셀러레이터에 모델을 쉽게 로드하고 여러 NeuronCore에서 모델을 병렬화하며 HTTP 엔드포인트를 통해 제공할 수 있도록 합니다.

LMI 컨테이너는 다음에서 모델 로드를 지원합니다. 아마존 단순 스토리지 서비스 (Amazon S3) 버킷 또는 Hugging Face Hub. 기본 처리기 스크립트는 모델을 로드하고, 컴파일하고, Neuron 최적화 형식으로 변환하고, 로드합니다. LMI 컨테이너를 사용하여 LLM을 호스팅하기 위한 두 가지 옵션이 있습니다.

- 코드 없음(선호) – LMI 컨테이너를 사용하여 LLM을 배포하는 가장 쉬운 방법입니다. 이 방법에서는 제공된 기본 핸들러 에 필요한 모델 이름과 매개변수를 전달하기만 하면 됩니다.

serving.properties파일을 로드하고 모델을 호스팅합니다. 기본 핸들러를 사용하기 위해 다음을 제공합니다.entryPoint매개 변수djl_python.transformers-neuronx. - 나만의 스크립트 가져오기 – 이 접근 방식에서는 모델을 로드하고 제공하는 데 필요한 코드가 포함된 고유한 model.py 파일을 생성할 수 있는 옵션이 있습니다. 이 파일은 중개자 역할을 합니다.

DJLServingAPI 및transformers-neuronx아피스. 모델 로드 프로세스를 사용자 지정하려면 다음을 제공할 수 있습니다.serving.properties구성 가능한 매개변수 포함. 사용 가능한 구성 가능한 매개변수의 전체 목록은 다음을 참조하십시오. 모든 DJL 구성 옵션. 다음은 모델.py 파일.

런타임 아키텍처

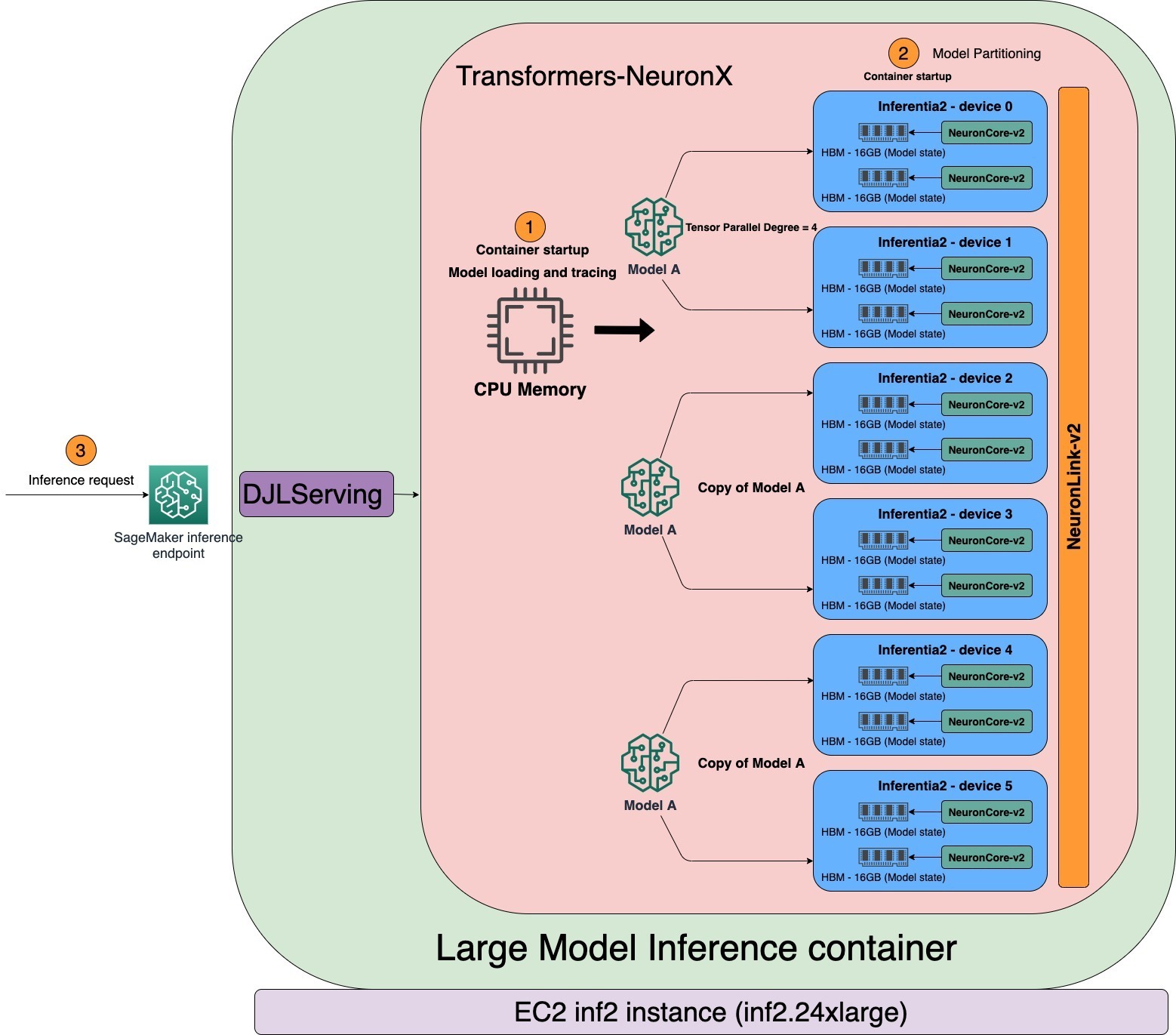

XNUMXD덴탈의 tensor_parallel_degree 속성 값은 여러 NeuronCore에서 텐서 병렬 모듈의 분포를 결정합니다. 예를 들어 inf2.24xlarge에는 2개의 AWS Inferentia2 액셀러레이터가 있습니다. 각 AWS Inferentia16 액셀러레이터에는 4개의 NeuronCore가 있습니다. 각 NeuronCore에는 텐서 병렬 모듈을 저장하는 XNUMXGB의 전용 고대역폭 메모리(HBM)가 있습니다. XNUMX의 텐서 병렬도를 사용하여 LMI는 각각 XNUMX개의 NeuronCore를 활용하는 동일한 모델의 XNUMX개 모델 사본을 할당합니다. 다음 다이어그램에 표시된 것처럼 LMI 컨테이너가 시작되면 모델이 CPU 주소 지정 가능 메모리에서 먼저 로드되고 추적됩니다. 추적이 완료되면 모델은 텐서 병렬도를 기반으로 NeuronCore에 걸쳐 분할됩니다.

LMI는 모델 제공 스택으로 DJLServing을 사용합니다. 컨테이너의 상태 확인이 SageMaker에서 통과되면 컨테이너는 추론 요청을 처리할 준비가 된 것입니다. DJLServing은 다음과 같은 여러 Python 프로세스를 시작합니다. TOTAL NUMBER OF NEURON CORES/TENSOR_PARALLEL_DEGREE. 각 Python 프로세스에는 다음과 같은 C++ 스레드가 포함되어 있습니다. TENSOR_PARALLEL_DEGREE. 각 C++ 스레드는 하나의 NeuronCore에서 모델의 하나의 샤드를 보유합니다.

많은 실무자(Python 프로세스)는 서버가 여러 개의 독립적인 요청으로 호출될 때 순차적으로 추론을 실행하는 경향이 있습니다. 설정하기는 더 쉽지만 일반적으로 가속기의 컴퓨팅 성능을 활용하는 것이 모범 사례는 아닙니다. 이 문제를 해결하기 위해 DJLServing은 서버 측에서 이러한 독립적인 추론 요청을 결합하여 더 큰 배치를 동적으로 형성하여 처리량을 증가시키는 동적 배치의 내장된 최적화를 제공합니다. 모든 요청은 추론을 대기하기 위해 실제 작업 대기열에 들어가기 전에 먼저 동적 배처에 도달합니다. 다음을 사용하여 동적 일괄 처리를 위해 선호하는 일괄 처리 크기를 설정할 수 있습니다. batch_size 설정 serving.properties. 구성할 수도 있습니다. max_batch_delay 대기 시간 요구 사항에 따라 일괄 처리에 참여하는 다른 요청을 기다리는 최대 지연 시간을 지정합니다. 처리량은 모델 복사본의 수와 컨테이너에서 시작된 Python 프로세스 그룹에 따라 달라집니다. 다음 다이어그램에 표시된 것처럼 텐서 병렬도가 4로 설정된 상태에서 LMI 컨테이너는 각각 모델의 전체 복사본을 보유하는 XNUMX개의 Python 프로세스 그룹을 시작합니다. 이를 통해 배치 크기를 늘리고 더 높은 처리량을 얻을 수 있습니다.

LLM 배포를 위한 SageMaker 노트북

이 섹션에서는 FP4에서 6GB인 24억 매개변수 모델인 GPT32All-J를 배포하는 단계별 연습을 제공합니다. GPT4All-J는 단어 문제, 대화, 코드, 시, 노래 및 이야기와 같은 다양한 상호 작용 콘텐츠에 대해 훈련된 인기 있는 챗봇입니다. GPT4all-J는 인간의 상호 작용과 유사한 응답을 생성하는 미세 조정된 GPT-J 모델입니다.

이 예제의 전체 노트북은 다음에서 제공됩니다. GitHub의. SageMaker Python SDK를 사용하여 모델을 Inf2 인스턴스에 배포할 수 있습니다. 우리는 제공된 것을 사용합니다 기본 핸들러 모델을 로드합니다. 이를 통해 우리는 서빙.속성 파일. 이 파일에는 DJL 모델 서버가 모델을 다운로드하고 호스팅하는 데 필요한 구성이 있습니다. 다음을 사용하여 Hugging Face 모델의 이름을 지정할 수 있습니다. model_id Hugging Face 저장소에서 직접 모델을 다운로드하는 매개변수입니다. 또는 다음을 제공하여 Amazon S3에서 모델을 다운로드할 수 있습니다. s3url 매개 변수. 그만큼 entryPoint 매개변수는 모델을 로드할 라이브러리를 가리키도록 구성됩니다. 자세한 내용은 djl_python.fastertransformer, GitHub 코드.

XNUMXD덴탈의 tensor_parallel_degree 속성 값은 여러 장치에서 텐서 병렬 모듈의 분포를 결정합니다. 예를 들어, 12개의 NeuronCore와 4의 텐서 병렬도에서 LMI는 각각 XNUMX개의 NeuronCore를 활용하는 XNUMX개의 모델 복사본을 할당합니다. 속성을 사용하여 정밀도 유형을 정의할 수도 있습니다. dtype. n_position 매개변수는 모델의 최대 입력 및 출력 시퀀스 길이의 합을 정의합니다. 다음 코드를 참조하십시오.

건설 tarball 포함 serving.properties S3 버킷에 업로드합니다. 이 예제에서는 기본 핸들러를 사용하지만 다음을 개발할 수 있습니다. model.py 로드 및 제공 프로세스를 맞춤설정하기 위한 파일입니다. 설치가 필요한 패키지가 있으면 패키지에 포함시키십시오. requirements.txt 파일. 다음 코드를 참조하십시오.

DJL 컨테이너 이미지를 검색하고 SageMaker 모델을 생성합니다.

다음으로 앞서 정의한 모델 구성으로 SageMaker 엔드포인트를 생성합니다. 컨테이너는 모델을 /tmp SageMaker가 /tmp 에 아마존 엘라스틱 블록 스토어 (아마존 EBS). 우리는 추가해야 volume_size 다음을 보장하기 위한 매개변수 /tmp 디렉토리에는 모델을 다운로드하고 컴파일할 충분한 공간이 있습니다. 세트 container_startup_health_check_timeout 모델이 준비된 후 상태 확인이 시작되도록 하려면 최대 3,600초입니다. 우리는 ml.inf2.8xlarge 인스턴스를 사용합니다. 다음 코드를 참조하십시오.

SageMaker 엔드포인트가 생성된 후 다음을 사용하여 SageMaker 엔드포인트에 대한 실시간 예측을 수행할 수 있습니다. Predictor 목적:

정리

테스트를 마친 후 엔드포인트를 삭제하여 비용을 절감하십시오.

결론

이 게시물에서는 이제 생성 AI 모델 호스팅을 위해 ml.inf2 및 ml.trn1 인스턴스를 지원하는 SageMaker의 새로 출시된 기능을 소개했습니다. 코드를 작성하지 않고 SageMaker 및 LMI 컨테이너를 사용하여 AWS Inferentia4에서 생성 AI 모델인 GPT2ALL-J를 배포하는 방법을 시연했습니다. 또한 DJLServing을 사용하는 방법과 transformers-neuronx 모델을 로드하고 분할하고 제공합니다.

Inf2 인스턴스는 AWS에서 생성 AI 모델을 실행하는 가장 비용 효율적인 방법을 제공합니다. 성능에 대한 자세한 내용은 다음을 참조하십시오. Inf2 성능.

확인 GitHub의 예제 노트북의 저장소. 사용해 보고 궁금한 점이 있으면 알려주세요!

저자에 관하여

비벡 강가사니 Amazon Web Services의 선임 기계 학습 솔루션 아키텍트입니다. 그는 기계 학습 스타트업과 협력하여 AWS에서 AI/ML 애플리케이션을 구축하고 배포합니다. 그는 현재 MLOps, ML 추론 및 로우 코드 ML을 위한 솔루션 제공에 주력하고 있습니다. 그는 자연어 처리 및 컴퓨터 비전을 포함한 다양한 영역의 프로젝트에 참여했습니다.

비벡 강가사니 Amazon Web Services의 선임 기계 학습 솔루션 아키텍트입니다. 그는 기계 학습 스타트업과 협력하여 AWS에서 AI/ML 애플리케이션을 구축하고 배포합니다. 그는 현재 MLOps, ML 추론 및 로우 코드 ML을 위한 솔루션 제공에 주력하고 있습니다. 그는 자연어 처리 및 컴퓨터 비전을 포함한 다양한 영역의 프로젝트에 참여했습니다.

토코요 히로시 AWS Annapurna Labs의 솔루션 아키텍트입니다. 일본에 기반을 둔 그는 AWS가 인수하기 전부터 Annapurna Labs에 합류했으며 Annapurna Labs 기술로 고객을 지속적으로 도왔습니다. 그의 최근 초점은 특별히 제작된 실리콘, AWS Inferentia 및 Trainium을 기반으로 하는 기계 학습 솔루션입니다.

토코요 히로시 AWS Annapurna Labs의 솔루션 아키텍트입니다. 일본에 기반을 둔 그는 AWS가 인수하기 전부터 Annapurna Labs에 합류했으며 Annapurna Labs 기술로 고객을 지속적으로 도왔습니다. 그의 최근 초점은 특별히 제작된 실리콘, AWS Inferentia 및 Trainium을 기반으로 하는 기계 학습 솔루션입니다.

다왈 파텔 AWS의 수석 기계 학습 설계자입니다. 그는 분산 컴퓨팅 및 인공 지능과 관련된 문제에 대해 대기업에서 중견 스타트업에 이르는 다양한 조직과 협력했습니다. 그는 NLP 및 Computer Vision 도메인을 포함한 딥 러닝에 중점을 둡니다. 그는 고객이 SageMaker에서 고성능 모델 추론을 달성하도록 돕습니다.

다왈 파텔 AWS의 수석 기계 학습 설계자입니다. 그는 분산 컴퓨팅 및 인공 지능과 관련된 문제에 대해 대기업에서 중견 스타트업에 이르는 다양한 조직과 협력했습니다. 그는 NLP 및 Computer Vision 도메인을 포함한 딥 러닝에 중점을 둡니다. 그는 고객이 SageMaker에서 고성능 모델 추론을 달성하도록 돕습니다.

칭란 AWS의 소프트웨어 개발 엔지니어입니다. 그는 고성능 ML 추론 솔루션 및 고성능 로깅 시스템을 포함하여 Amazon에서 여러 도전적인 제품을 작업해 왔습니다. Qing의 팀은 요구되는 매우 짧은 지연 시간으로 Amazon Advertising에서 첫 번째 XNUMX억 매개변수 모델을 성공적으로 출시했습니다. Qing은 인프라 최적화 및 딥 러닝 가속화에 대한 심층 지식을 보유하고 있습니다.

칭란 AWS의 소프트웨어 개발 엔지니어입니다. 그는 고성능 ML 추론 솔루션 및 고성능 로깅 시스템을 포함하여 Amazon에서 여러 도전적인 제품을 작업해 왔습니다. Qing의 팀은 요구되는 매우 짧은 지연 시간으로 Amazon Advertising에서 첫 번째 XNUMX억 매개변수 모델을 성공적으로 출시했습니다. Qing은 인프라 최적화 및 딥 러닝 가속화에 대한 심층 지식을 보유하고 있습니다.

칭 웨이 리 Amazon Web Services의 기계 학습 전문가입니다. 그는 박사 학위를 받았습니다. 그는 고문의 연구 보조금 계좌를 깨고 그가 약속 한 노벨상을 전달하지 못한 후 Operations Research에서 현재 그는 금융 서비스 및 보험 업계의 고객이 AWS에서 기계 학습 솔루션을 구축하도록 돕습니다. 여가 시간에는 읽기와 가르치기를 좋아합니다.

칭 웨이 리 Amazon Web Services의 기계 학습 전문가입니다. 그는 박사 학위를 받았습니다. 그는 고문의 연구 보조금 계좌를 깨고 그가 약속 한 노벨상을 전달하지 못한 후 Operations Research에서 현재 그는 금융 서비스 및 보험 업계의 고객이 AWS에서 기계 학습 솔루션을 구축하도록 돕습니다. 여가 시간에는 읽기와 가르치기를 좋아합니다.

앨런 탄 SageMaker의 수석 제품 관리자로 대규모 모델 추론을 주도하고 있습니다. 그는 분석 영역에 기계 학습을 적용하는 데 열정적입니다. 그는 일 외에는 야외 활동을 즐깁니다.

앨런 탄 SageMaker의 수석 제품 관리자로 대규모 모델 추론을 주도하고 있습니다. 그는 분석 영역에 기계 학습을 적용하는 데 열정적입니다. 그는 일 외에는 야외 활동을 즐깁니다.

바룬 시알 ML Inference 플랫폼의 중요한 고객 대면 기능을 담당하는 AWS Sagemaker의 소프트웨어 개발 엔지니어입니다. 그는 분산 시스템 및 AI 분야에서 일하는 데 열정적입니다. 여가 시간에는 독서와 정원 가꾸기를 좋아합니다.

바룬 시알 ML Inference 플랫폼의 중요한 고객 대면 기능을 담당하는 AWS Sagemaker의 소프트웨어 개발 엔지니어입니다. 그는 분산 시스템 및 AI 분야에서 일하는 데 열정적입니다. 여가 시간에는 독서와 정원 가꾸기를 좋아합니다.

- SEO 기반 콘텐츠 및 PR 배포. 오늘 증폭하십시오.

- PlatoAiStream. Web3 데이터 인텔리전스. 지식 증폭. 여기에서 액세스하십시오.

- 미래 만들기 w Adryenn Ashley. 여기에서 액세스하십시오.

- PREIPO®로 PRE-IPO 회사의 주식을 사고 팔 수 있습니다. 여기에서 액세스하십시오.

- 출처: https://aws.amazon.com/blogs/machine-learning/achieve-high-performance-with-lowest-cost-for-generative-ai-inference-using-aws-inferentia2-and-aws-trainium-on-amazon-sagemaker/

- :있다

- :이다

- :아니

- :어디

- $UP

- 10

- 100

- 12

- 13

- 14

- 15%

- 22

- 24

- 7

- 8

- 9

- a

- 소개

- 가속 자

- 가속기

- 수락

- ACCESS

- 계정

- 달성

- 취득

- 가로질러

- 행위

- 더하다

- 또한

- 주소

- 주소 지정 가능

- 이점

- 광고

- 후

- 반대

- AI

- 인공 지능 사용 사례

- AI / ML

- All

- 수

- 또한

- 이기는하지만

- 아마존

- Amazon EC2

- 아마존 세이지 메이커

- Amazon Web Services

- an

- 분석

- 및

- 알리다

- 다른

- 어떤

- API

- 어플리케이션

- 적용

- 접근

- 아키텍처

- 있군요

- 지역

- 인조의

- 인공 지능

- 인공 지능(AI)

- AS

- At

- 오디오

- 자동

- 자동적으로

- 가능

- AWS

- AWS 인 페렌 시아

- 공

- 대역폭

- 장벽

- 기반으로

- BE

- 때문에

- 된

- 전에

- 혜택

- BEST

- 사이에

- 큰

- 더 큰

- 수십억

- 블록

- 블로그

- 꽃

- 간단히

- 파산

- 빌드

- 내장

- 내장

- 사업

- by

- C + +

- 라는

- CAN

- 가지 경우

- 도전

- 채팅 봇

- 검사

- 칩

- 암호

- 코딩

- 집단적인

- 결합

- 결합 된

- 제공

- 의사 소통

- 커뮤니케이션

- 비교

- 호환

- 완전한

- 완전히

- 복잡한

- 복잡성

- 구성 요소들

- 포괄적 인

- 계산

- 계산

- 컴퓨터

- 컴퓨터 비전

- 컴퓨팅

- 구성

- 연결

- 컨테이너

- 용기

- 이 포함되어 있습니다

- 함유량

- 핵심

- 비용

- 비용 효율적인

- 비용

- 만들

- 만든

- 임계

- 결정적인

- 현재

- 고객

- 고객

- 사용자 정의

- 데이터

- 전용

- 깊은

- 깊은 학습

- 태만

- 한정된

- 정의

- 도

- 지연

- 배달하다

- 배달

- 제공

- 시연

- 따라

- 배포

- 배치

- 전개

- 세부설명

- Detection System

- 결정하다

- 개발

- 개발

- 장치

- 디바이스

- 다른

- 방송

- 직접

- 분산

- 분산 컴퓨팅

- 분산 시스템

- 분포

- 하기

- 도메인

- 말라

- 다운로드

- 다운로드

- 운전사

- 동적

- 역동적 인

- 마다

- 이전

- 쉽게

- 가장 쉬운

- 용이하게

- 동쪽

- 효율적인

- 효율적으로

- 노력

- 수

- end

- 종점

- 기사

- 엔진

- 충분히

- 확인

- 입력

- 기업

- 항목

- 동등한

- 평가

- 조차

- 예

- 흥분한

- 비싼

- 여분의

- 페이스메이크업

- 을 용이하게

- 마주보고

- 실패한

- 빠른

- 특색

- 특징

- 입양 부모로서의 귀하의 적합성을 결정하기 위해 미국 이민국에

- 금융

- 금융 서비스

- 마무리

- 먼저,

- 맞게

- 흐름

- 흐름

- 초점

- 집중

- 집중

- 수행원

- 럭셔리

- 형태

- 체재

- 사

- 뼈대

- 프레임 워크

- 사기

- 사기 탐지

- 에

- 가득 찬

- 충분히

- 게다가

- 생성

- 세대

- 생성적인

- 제너레이티브 AI

- 얻을

- Go

- 부여

- 여러 떼

- 성장하는

- 하드웨어

- 있다

- he

- 건강

- 도움

- 도움

- 도움이

- 여기에서 지금 확인해 보세요.

- 높은

- 고성능

- 더 높은

- 그의

- 보유

- 보유

- 주인

- 호스팅

- 호스팅 서비스

- 집

- 방법

- How To

- 그러나

- HTML

- HTTP

- HTTPS

- 허브

- 사람의

- if

- 영상

- 형상

- 이행

- import

- in

- 심도

- 포함

- 포함

- 포함

- 증가

- 증가

- 독립

- 산업

- 인프라

- 혁신

- 입력

- 입력

- 설치

- 예

- 보험

- 통합 된

- 인텔리전스

- 상호 작용

- 상호 작용

- 중개인

- 으로

- 호출

- 감다

- IT

- 그

- 일본

- 일

- 어울리다

- 합류 한

- JPG

- JSON

- 다만

- 알아

- 지식

- 실험실

- 언어

- 넓은

- 대기업

- 큰

- 가장 큰

- 숨어 있음

- 시작

- 시작

- 지도

- 배우다

- 배우기

- 길이

- 하자

- 도서관

- 도서관

- 처럼

- 좋아하는

- 제한된

- 명부

- LLM

- 하중

- 로드

- 잔뜩

- 로깅

- 낮은

- 절감

- 가장 낮은

- 기계

- 기계 학습

- 주로

- 유지

- 과반수

- 확인

- 관리

- 관리

- 매니저

- 지도

- 최대

- 최고

- 메모리

- 방법

- ML

- MLOps

- 모델

- 모델

- 모듈

- 배우기

- 보다 효율적으로

- 가장

- 여러

- name

- 자연의

- 자연 언어 처리

- 필요한

- 필요

- 요구

- 신제품

- 뉴욕

- 다음 것

- nlp

- nobel prize

- 수첩

- 지금

- 번호

- 대상

- of

- 제공

- 제공

- 자주

- 오하이오

- on

- ONE

- 만

- 오픈 소스

- 행정부

- 최적화

- 최적화

- 최적화

- 최적화

- 선택권

- 옵션

- or

- 조직

- 기타

- 우리의

- 아웃

- 야외에서

- 출력

- 외부

- 자신의

- 패키지

- 패러다임

- 평행

- 매개 변수

- 매개 변수

- 패스

- 패스

- 열렬한

- 성능

- 개인

- 플랫폼

- 플라톤

- 플라톤 데이터 인텔리전스

- 플라토데이터

- 플러그인

- 플러그인

- 포인트 적립

- 인기 문서

- 게시하다

- 힘

- powered

- 강한

- 연습

- Precision

- 예측

- Predictor

- 선호하는

- 교장

- 상

- 문제

- 방법

- 프로세스

- 처리

- 프로덕트

- 제품 관리자

- 제품

- 프로필

- 프로젝트

- 약속 한

- 속성

- 재산

- 제공

- 제공

- 제공

- 제공

- 목적

- Python

- 파이 토치

- 이르기까지

- 도달

- 읽기

- 준비

- 현실 세계

- 실시간

- 접수

- 최근

- 인식

- 참조

- 관련

- 의뢰

- 요청

- 필수

- 요구 사항

- 요구조건 니즈

- 연구

- 연구원

- 제품 자료

- 응답

- 결과

- 상승

- 달리기

- 현자

- SageMaker 추론

- 같은

- 찜하기

- 스케일링

- 시나리오

- 스크립트

- SDK

- 완벽하게

- 초

- 섹션

- 참조

- 연장자

- 순서

- 서브

- 서비스

- 서비스

- 피복재

- 세트

- 설정

- 설치

- 몇몇의

- 변화

- 영상을

- 표시

- 전시

- 표시

- 쇼

- 측면

- 크게

- 규소

- 비슷한

- 단순, 간단, 편리

- 단일

- SIX

- 크기

- 크기

- So

- 소프트웨어

- 소프트웨어 개발

- 해결책

- 솔루션

- 스페이스 버튼

- 전문가

- 전문

- 연설

- 음성 인식

- 안정된

- 스택

- 스택

- 스타트

- 시작

- 시작

- 신생

- 저장

- 이야기

- 저장

- 간소화 된

- 스타일

- 성공적으로

- 이러한

- SUPPORT

- 지원

- 지원

- 체계

- 시스템은

- 복용

- 교육

- 팀

- 기법

- Technology

- 텐서 흐름

- 테스트

- 보다

- 그

- XNUMXD덴탈의

- 지역

- 그들의

- 그들

- 그곳에.

- Bowman의

- 이

- 세

- 을 통하여

- 처리량

- 시간

- 시대

- 에

- 너무

- 검색을

- 트레이싱

- 훈련 된

- 트레이닝

- 변압기

- 회전

- 두

- 유형

- 전형적인

- 업로드

- us

- 사용

- 익숙한

- 사용

- 보통

- 활용

- 활용

- 가치

- 종류

- 여러

- 거대한

- 대단히

- 를 통해

- Video

- 버지니아의

- 시력

- 기다리다

- 연습

- 방법..

- we

- 웹

- 웹 서비스

- 무게

- 뭐

- 언제

- 어느

- 의지

- 과

- 이내

- 없이

- 목도

- 워드

- 작업

- 일

- 일하는

- 일

- 세계

- 쓰다

- 쓰기

- 요크

- 자신의

- 너의

- 제퍼 넷