이 블로그 게시물은 deepset의 Tuana Çelik과 공동으로 작성되었습니다.

엔터프라이즈 검색은 문서 디지털화 및 지식 관리를 통한 조직 효율성의 중요한 구성 요소입니다. 엔터프라이즈 검색에는 디지털 파일과 같은 문서 저장, 검색을 위한 문서 색인 생성, 사용자 쿼리를 기반으로 관련 결과 제공이 포함됩니다. 대규모 언어 모델(LLM)의 출현으로 사용자에게 결과를 제공하는 대화형 경험을 구현할 수 있습니다. 그러나 LLM이 회사 데이터에 대한 응답을 제한하여 모델 환각을 완화하도록 해야 합니다.

이 게시물에서는 Haystack 파이프라인과 Amazon SageMaker 점프스타트 및 아마존 오픈서치 서비스. 이 게시물에 표시된 샘플의 소스 코드는 다음에서 사용할 수 있습니다. GitHub 저장소

솔루션 개요

생성 AI 애플리케이션 응답을 회사 데이터로만 제한하려면 RAG(Retrieval Augmented Generation)라는 기술을 사용해야 합니다. RAG 접근 방식을 사용하는 애플리케이션은 엔터프라이즈 지식 기반 또는 콘텐츠에서 사용자의 요청과 가장 관련성이 높은 정보를 검색하고 프롬프트로 사용자의 요청과 함께 컨텍스트로 묶은 다음 응답을 받기 위해 LLM으로 보냅니다. LLM에는 입력 프롬프트의 최대 단어 수에 대한 제한이 있으므로 기업에서 수천 또는 수백만 개의 문서 중에서 올바른 구절을 선택하는 것은 LLM의 정확도에 직접적인 영향을 미칩니다.

RAG 기술은 엔터프라이즈 검색에서 점점 더 중요해지고 있습니다. 이 게시물에서는 SageMaker JumpStart를 활용하여 Falcon-40b-instruct 모델을 배포하고 Haystack을 사용하여 검색 증강 질문 답변 파이프라인을 설계 및 실행하는 워크플로를 보여줍니다. 최종 검색 확대 작업 흐름은 다음과 같은 상위 수준 단계를 다룹니다.

- 사용자 쿼리는 데이터베이스에서 가장 관련성이 높은 컨텍스트를 검색하기 위해 벡터 검색을 수행하는 검색기 구성 요소에 사용됩니다.

- 이 컨텍스트는 제공된 컨텍스트에서만 답변을 생성하도록 LLM에 지시하도록 설계된 프롬프트에 포함됩니다.

- LLM은 수신한 프롬프트에 포함된 컨텍스트만 고려하여 원래 쿼리에 대한 응답을 생성합니다.

세이지메이커 점프스타트

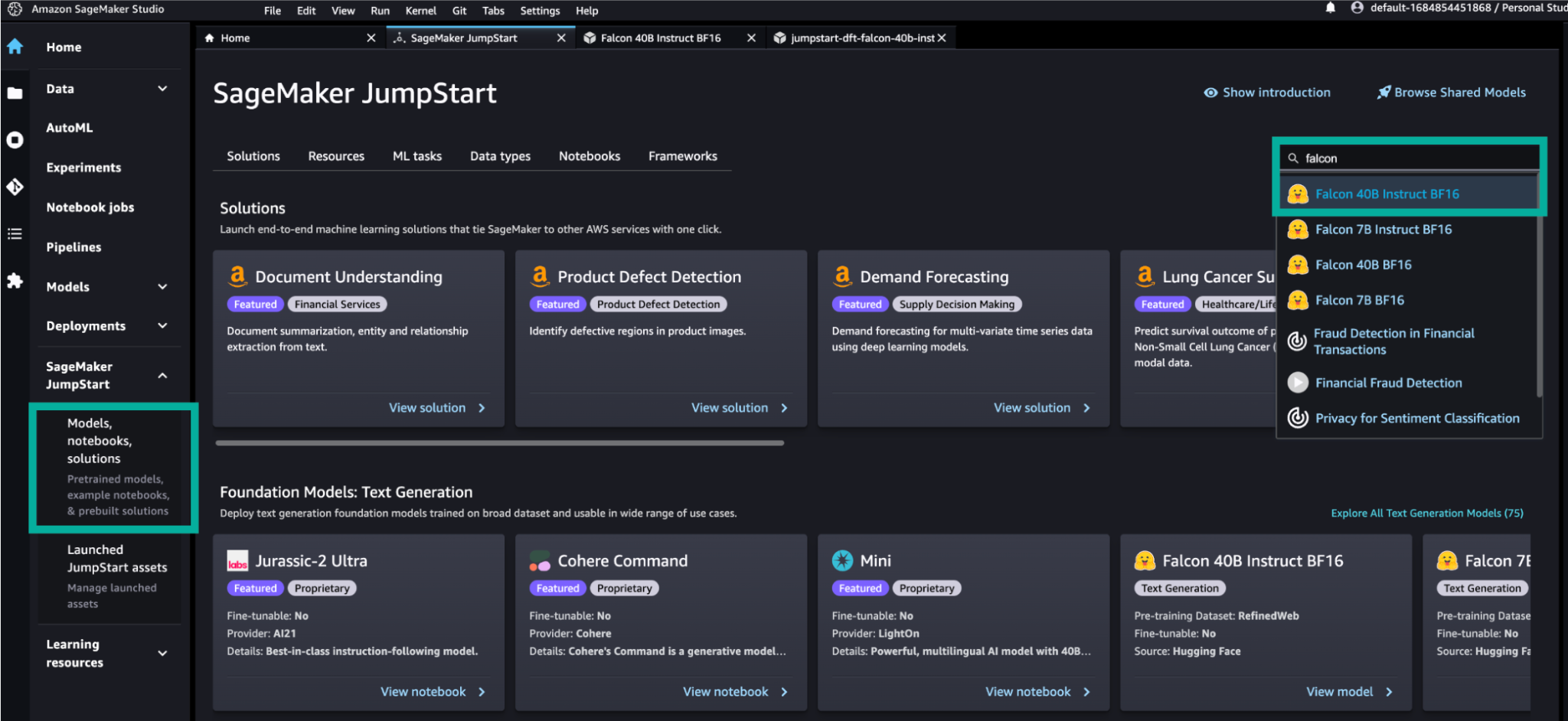

SageMaker JumpStart는 텍스트, 비전, 오디오 및 임베딩 사용 사례를 위한 광범위한 딥 러닝 모델을 캡슐화하는 모델 허브 역할을 합니다. 500개 이상의 모델이 있는 모델 허브는 AI21, Stability AI, Cohere 및 LightOn과 같은 AWS 파트너의 공개 및 독점 모델로 구성됩니다. 또한 AlexaTM과 같이 Amazon에서 단독으로 개발한 기반 모델도 호스팅합니다. 일부 모델은 자신의 데이터로 미세 조정할 수 있는 기능을 제공합니다. SageMaker JumpStart는 일반적인 사용 사례를 위한 인프라를 설정하는 솔루션 템플릿과 SageMaker를 사용한 기계 학습(ML)을 위한 실행 가능한 예제 노트북도 제공합니다.

커다란 건초 더미

커다란 건초 더미 개발자가 모델, 벡터 DB, 파일 변환기 및 수많은 기타 모듈과 같은 다양한 구성 요소로 구성된 LLM 애플리케이션을 오케스트레이션할 수 있도록 하는 deepset의 오픈 소스 프레임워크입니다. 건초 더미 제공 파이프 라인 및 에이전트, 검색, 질문 응답 및 대화형 AI를 포함한 다양한 사용 사례를 위한 LLM 애플리케이션을 설계하기 위한 두 가지 강력한 구조입니다. 최첨단 검색 방법과 견고한 평가 메트릭에 중점을 두고 신뢰할 수 있고 신뢰할 수 있는 애플리케이션을 제공하는 데 필요한 모든 것을 제공합니다. 다음으로 파이프라인을 직렬화할 수 있습니다. YAML 파일, a를 통해 노출 REST API, 워크로드에 따라 유연하게 확장하여 애플리케이션을 프로토타입 단계에서 생산 단계로 쉽게 이동할 수 있습니다.

아마존 오픈서치

OpenSearch Service는 AWS 클라우드에서 OpenSearch를 간단하게 배포, 확장 및 운영할 수 있게 해주는 완전 관리형 서비스입니다. OpenSearch는 Apache 2.0 라이선스에 따라 라이선스가 부여된 검색, 분석, 보안 모니터링 및 관찰 가능성 애플리케이션을 위한 확장 가능하고 유연하며 확장 가능한 오픈 소스 소프트웨어 제품군입니다.

최근 몇 년 동안 ML 기술은 검색을 향상시키기 위해 점점 더 대중화되었습니다. 그 중에는 다음을 사용하는 것이 있습니다. 임베딩 모델, 큰 데이터 본문을 n차원 공간으로 인코딩할 수 있는 모델의 한 유형으로, 각 엔터티는 벡터, 해당 공간의 데이터 포인트이며 유사한 엔터티가 더 가깝게 구성되도록 구성됩니다. 벡터 데이터베이스는 k-NN 인덱스와 같은 특수 인덱스를 제공하여 효율적인 벡터 유사성 검색을 제공합니다.

OpenSearch Service의 벡터 데이터베이스 기능을 사용하여 시맨틱 검색, LLM을 사용한 RAG, 추천 엔진 및 검색 리치 미디어를 구현할 수 있습니다. 이 게시물에서는 RAG를 사용하여 일반적으로 벡터 인코딩 지식 문서로 수화된 벡터 데이터베이스를 사용하여 구축되는 외부 지식 기반으로 생성 LLM을 보완할 수 있습니다.

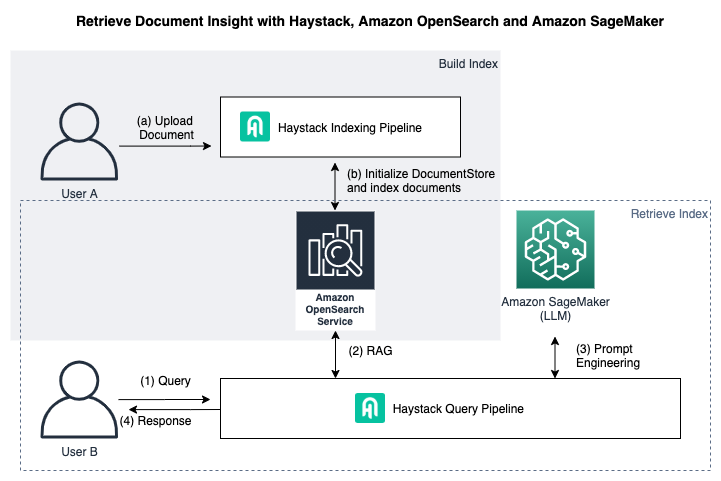

응용 프로그램 개요

다음 다이어그램은 최종 애플리케이션의 구조를 보여줍니다.

이 애플리케이션에서는 Haystack 인덱싱 파이프라인을 사용하여 업로드된 문서와 인덱스 문서를 관리하고 Haystack 쿼리 파이프라인을 사용하여 인덱스 문서에서 지식 검색을 수행합니다.

Haystack 인덱싱 파이프라인에는 다음과 같은 상위 단계가 포함됩니다.

- 문서를 업로드합니다.

- 초기화

DocumentStore및 인덱스 문서.

우리는 OpenSearch를 문서 저장소 그리고 건초더미 인덱싱 파이프라인 파일을 OpenSearch로 전처리하고 인덱싱합니다. 커다란 건초 더미 파일 변환기 및 전처리기 자연어 처리(NLP) 파이프라인 및 선택한 언어 모델이 처리할 수 있는 모양과 형식으로 원시 파일을 정리하고 준비할 수 있습니다. 여기서 사용한 인덱싱 파이프라인도 다음을 사용합니다. sentence-transformers/all-MiniLM-L12-v2 효율적인 검색을 위해 사용하는 각 문서에 대한 임베딩을 생성합니다.

Haystack 쿼리 파이프라인에는 다음과 같은 상위 수준 단계가 포함됩니다.

- RAG 파이프라인에 쿼리를 보냅니다.

- An 임베딩 리트리버 구성 요소는 가장 관련성이 높은 항목을 검색하는 필터 역할을 합니다.

top_kOpenSearch에서 색인이 생성된 문서의 문서. 이를 달성하기 위해 선택한 임베딩 모델을 사용하여 쿼리와 문서(인덱싱 시)를 임베드합니다. - 검색된 문서는 Falcon-40b-instruct 모델에 대한 프롬프트에 포함됩니다.

- LLM은 검색된 문서를 기반으로 하는 응답과 함께 반환됩니다.

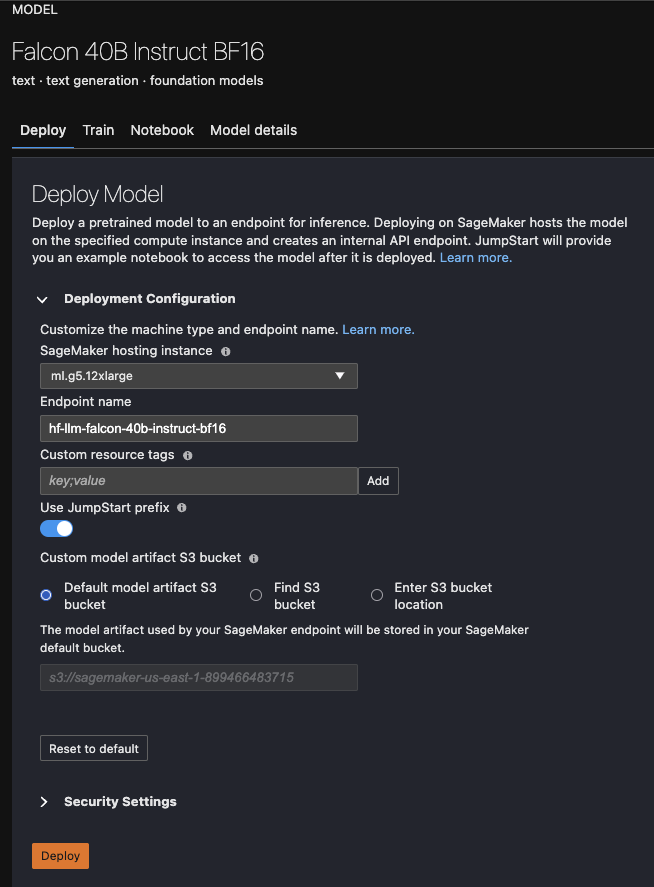

모델 배포의 경우 버튼 하나만 누르면 모델 배포가 간소화되는 SageMaker JumpStart를 사용합니다. 이 예제에서는 Falcon-40b-instruct를 사용하고 테스트했지만 SageMaker에서 사용 가능한 Hugging Face 모델을 사용할 수 있습니다.

최종 솔루션은 다음에서 사용할 수 있습니다. 건초 더미 현자 리포지토리에 저장하고 OpenSearch 웹 사이트 및 설명서(OpenSearch 2.7용)를 예시 데이터로 사용하여 검색 증강 질문 답변을 수행합니다.

사전 조건

AWS 서비스를 사용하기 전에 가장 먼저 해야 할 일은 AWS 계정에 가입하고 생성했는지 확인하는 것입니다. 그런 다음 관리 사용자 및 그룹을 생성해야 합니다. 두 단계에 대한 지침은 다음을 참조하십시오. Amazon SageMaker 사전 조건 설정.

Haystack을 사용하려면 다음을 설치해야 합니다. farm-haystack 필요한 종속성이 있는 패키지. 이를 수행하려면 다음을 사용하십시오. requirements.txt 에 파일을 GitHub 저장소 실행하여 pip install requirements.txt.

OpenSearch에 문서 인덱싱

Haystack은 다음과 같은 데이터베이스에 대한 여러 커넥터를 제공합니다. DocumentStores. 이 RAG 워크플로우에서는 다음을 사용합니다. OpenSearchDocumentStore. 예 저장소 인덱싱 파이프라인을 포함하고 AWS 클라우드 포메이션 이 템플릿 설정하려면 OpenSearchDocumentStore OpenSearch 웹 사이트 및 설명서 페이지에서 크롤링된 문서와 함께.

종종 프로덕션 사용 사례에서 작동하는 NLP 애플리케이션을 얻으려면 데이터 준비 및 정리에 대해 생각해야 합니다. 이것은 다음과 같이 덮여 있습니다. Haystack 인덱싱 파이프라인, 궁극적으로 선택한 데이터베이스에 문서를 작성하는 고유한 데이터 준비 단계를 설계할 수 있습니다.

인덱싱 파이프라인에는 문서에 대한 임베딩을 생성하는 단계도 포함될 수 있습니다. 이는 검색 단계에서 매우 중요합니다. 이 예에서는 다음을 사용합니다. 문장 변환기/all-MiniLM-L12-v2 임베딩 모델로. 이 모델은 색인이 생성된 모든 문서에 대한 임베딩을 생성하는 데 사용되지만 쿼리 시 사용자의 쿼리도 생성합니다.

문서를 OpenSearchDocumentStore, 자세한 지침과 함께 두 가지 옵션을 제공합니다. README 예제 저장소의. 여기에서는 AWS에 배포된 OpenSearch 서비스에 대한 인덱싱 단계를 안내합니다.

OpenSearch 서비스 시작

제공된 사용 CloudFormation 템플릿 AWS에서 OpenSearch 서비스를 설정합니다. 다음 명령을 실행하면 빈 OpenSearch 서비스가 생성됩니다. 그런 다음 제공한 예제 데이터를 색인화하거나 자신의 데이터를 사용하도록 선택할 수 있습니다. Haystack 인덱싱 파이프라인. 이렇게 하면 인터넷에 개방된 인스턴스가 생성되므로 프로덕션 용도로는 권장되지 않습니다.

스택 시작이 완료될 때까지 약 30분 정도 기다립니다. 다음으로 이동하여 AWS CloudFormation 콘솔에서 진행 상황을 확인할 수 있습니다. 스택 페이지에서 이름이 지정된 스택을 찾습니다. HaystackOpensearch.

OpenSearch에 문서 인덱싱

실행 중인 OpenSearch 서비스가 있으므로 OpenSearchDocumentStore 클래스를 사용하여 서비스에 연결하고 문서를 작성할 수 있습니다.

OpenSearch의 호스트 이름을 얻으려면 다음 명령을 실행하십시오.

먼저 다음을 내보냅니다.

그런 다음 opensearch_indexing_pipeline.py 제공된 데모 데이터를 사전 처리하고 인덱싱하는 스크립트입니다.

자신의 데이터를 사용하려면 다음에서 인덱싱 파이프라인을 수정하십시오. opensearch_indexing_pipeline.py 를 포함 시키려면 파일 변환기 및 전처리기 필요한 설정 단계.

검색 증강 질문 답변 파이프라인 구현

이제 OpenSearch에서 데이터를 인덱싱했으므로 이러한 문서에 대한 질문 답변을 수행할 수 있습니다. 이 RAG 파이프라인의 경우 SageMaker JumpStart에 배포한 Falcon-40b-instruct 모델을 사용합니다.

Jupyter 노트북에서 프로그래밍 방식으로 모델을 배포하는 옵션도 있습니다. 지침은 다음을 참조하십시오. GitHub 레포.

- SageMaker JumpStart에서 Falcon-40b-instruct 모델을 검색합니다.

- SageMaker JumpStart에 모델을 배포하고 엔드포인트 이름을 기록해 둡니다.

- 다음 값을 내보냅니다.

- 달리기

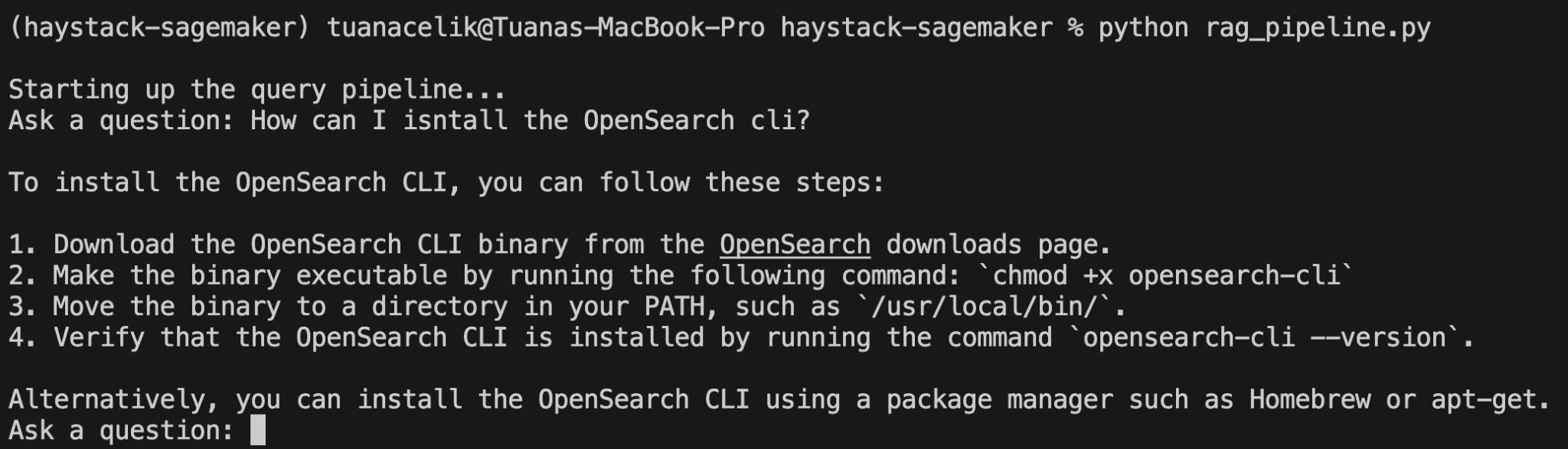

python rag_pipeline.py.

이렇게 하면 사용자의 질문을 기다리는 명령줄 유틸리티가 시작됩니다. 예를 들어 "OpenSearch CLI를 어떻게 설치하나요?"라고 물어봅시다.

이 결과는 프롬프트에서 프롬프트를 정의했기 때문에 달성됩니다. Haystack 프롬프트 템플릿 다음과 같아야 합니다.

추가 사용자 정의

다음과 같이 솔루션의 다양한 요소에 대한 추가 사용자 지정을 수행할 수 있습니다.

- 데이터 – OpenSearch를 제공했습니다. 선적 서류 비치 및 웹 사이트 데이터를 예시 데이터로. 수정해야 함을 기억하십시오.

opensearch_indexing_pipeline.py자신의 데이터를 사용하기로 선택한 경우 필요에 맞게 스크립트를 작성하십시오. - 모델 – 이 예에서는 Falcon-40b-instruct 모델을 사용했습니다. SageMaker에서 다른 Hugging Face 모델을 자유롭게 배포하고 사용할 수 있습니다. 모델을 변경한다는 것은 프롬프트를 처리하도록 설계된 것에 맞게 조정해야 함을 의미할 수 있습니다.

- 프롬프트 – 이 게시물을 위해 우리는 우리 자신을 만들었습니다.

PromptTemplate제공된 컨텍스트를 기반으로 질문에 답하고 컨텍스트에 관련 정보가 포함되지 않은 경우 "모르겠습니다"라고 대답하도록 모델에 지시합니다. 이 프롬프트를 변경하여 Falcon-40b-instruct로 다른 프롬프트를 실험할 수 있습니다. 또한 프롬프트허브. - 임베딩 모델 – 검색 단계에서는 경량 임베딩 모델을 사용합니다. 문장 변환기/all-MiniLM-L12-v2. 그러나 이를 필요에 따라 변경할 수도 있습니다. 예상 임베딩 크기를 수정해야 합니다.

DocumentStore따라서. - 검색된 문서 수 – 요청하는 문서의 수를 가지고 놀도록 선택할 수도 있습니다.

EmbeddingRetriever각 쿼리에 대해 검색합니다. 설정에서 이것은 다음과 같이 설정됩니다. top_k=5. 이 수치를 변경하여 더 많은 컨텍스트를 제공하면 결과의 정확도가 향상되는지 확인할 수 있습니다.

생산 준비

이 게시물에서 제안된 솔루션은 프로젝트 개발 프로세스의 가치 실현 시간을 단축할 수 있습니다. AWS Cloud의 보안 및 개인 정보 보호 환경으로 확장하기 쉬운 프로젝트를 구축할 수 있습니다.

보안 및 개인 정보 보호를 위해 OpenSearch Service는 다음을 통해 데이터 보호를 제공합니다. 신원 및 액세스 관리 및 교차 서비스 혼동 프록시 방지. 세분화된 사용자 액세스 제어를 사용하여 사용자가 액세스 권한이 있는 데이터에만 액세스할 수 있도록 할 수 있습니다. 또한 SageMaker는 다음에 대해 구성 가능한 보안 설정을 제공합니다. 컨트롤에 액세스, 데이터 보호및 로깅 및 모니터링. 저장 및 전송 중인 데이터를 보호할 수 있습니다. AWS 키 관리 서비스 (AWS KMS) 키. 다음을 사용하여 SageMaker 모델 배포 또는 엔드포인트 액세스의 로그를 추적할 수도 있습니다. 아마존 클라우드 워치. 자세한 내용은 다음을 참조하십시오. Amazon CloudWatch로 Amazon SageMaker 모니터링.

OpenSearch Service의 높은 확장성을 위해 다음과 같이 조정할 수 있습니다. OpenSearch 서비스 도메인 크기 조정 그리고 고용 운영 모범 사례. SageMaker 엔드포인트 자동 조정을 활용할 수도 있습니다. SageMaker 모델을 자동으로 확장 트래픽이 증가하거나 리소스가 사용되지 않을 때 엔드포인트를 조정합니다.

정리

비용을 절약하려면 이 게시물의 일부로 배포한 리소스를 모두 삭제하세요. CloudFormation 스택을 시작한 경우 AWS CloudFormation 콘솔을 통해 삭제할 수 있습니다. 마찬가지로 SageMaker 콘솔을 통해 생성한 모든 SageMaker 엔드포인트를 삭제할 수 있습니다.

결론

이 게시물에서는 Haystack 파이프라인과 SageMaker JumpStart 및 OpenSearch Service의 Falcon-40b-instruct 모델을 사용하여 RAG로 엔터프라이즈 검색을 위한 종단 간 생성 AI 애플리케이션을 구축하는 방법을 보여주었습니다. RAG 접근 방식은 생성된 응답이 도메인 내에서 발생하도록 하여 환각을 완화하기 때문에 엔터프라이즈 검색에서 매우 중요합니다. Haystack 파이프라인을 사용하여 모델 및 벡터 데이터베이스와 같은 다양한 구성 요소로 구성된 LLM 애플리케이션을 오케스트레이션할 수 있습니다. SageMaker JumpStart는 LLM 배포를 위한 원클릭 솔루션을 제공하며 우리는 OpenSearch Service를 인덱싱된 데이터의 벡터 데이터베이스로 사용했습니다. 이 게시물에 설명된 단계와 GitHub 저장소.

저자에 관하여

투아나 셀릭 Deepset의 Lead Developer Advocate로서 Haystack의 오픈 소스 커뮤니티에 집중하고 있습니다. 그녀는 개발자 관계 기능을 이끌고 NLP에 관한 행사에서 정기적으로 연설하며 커뮤니티를 위한 학습 자료를 만듭니다.

투아나 셀릭 Deepset의 Lead Developer Advocate로서 Haystack의 오픈 소스 커뮤니티에 집중하고 있습니다. 그녀는 개발자 관계 기능을 이끌고 NLP에 관한 행사에서 정기적으로 연설하며 커뮤니티를 위한 학습 자료를 만듭니다.

로이 알렐라 독일 뮌헨에 본사를 둔 AWS의 선임 AI/ML 전문가 솔루션 아키텍트입니다. Roy는 소규모 스타트업에서 대기업에 이르기까지 AWS 고객이 AWS에서 대규모 언어 모델을 효율적으로 교육하고 배포할 수 있도록 지원합니다. Roy는 컴퓨팅 최적화 문제와 AI 워크로드의 성능 개선에 열정적입니다.

로이 알렐라 독일 뮌헨에 본사를 둔 AWS의 선임 AI/ML 전문가 솔루션 아키텍트입니다. Roy는 소규모 스타트업에서 대기업에 이르기까지 AWS 고객이 AWS에서 대규모 언어 모델을 효율적으로 교육하고 배포할 수 있도록 지원합니다. Roy는 컴퓨팅 최적화 문제와 AI 워크로드의 성능 개선에 열정적입니다.

장미아 Amazon Web Services의 ML 전문가 솔루션 아키텍트입니다. 그녀는 EMEA 고객과 협력하고 응용 수학, 컴퓨터 과학 및 AI/ML에 대한 배경 지식을 바탕으로 클라우드에서 AI/ML 워크로드를 실행하기 위한 모범 사례를 공유합니다. 그녀는 NLP 관련 워크로드에 중점을 두고 컨퍼런스 연사 및 책 저자로서의 경험을 공유합니다. 여가 시간에는 하이킹, 보드 게임, 커피 끓이기를 즐깁니다.

장미아 Amazon Web Services의 ML 전문가 솔루션 아키텍트입니다. 그녀는 EMEA 고객과 협력하고 응용 수학, 컴퓨터 과학 및 AI/ML에 대한 배경 지식을 바탕으로 클라우드에서 AI/ML 워크로드를 실행하기 위한 모범 사례를 공유합니다. 그녀는 NLP 관련 워크로드에 중점을 두고 컨퍼런스 연사 및 책 저자로서의 경험을 공유합니다. 여가 시간에는 하이킹, 보드 게임, 커피 끓이기를 즐깁니다.

이나암 사이에드 B2B 및 SaaS 스타트업의 확장 및 성장 달성을 지원하는 데 중점을 둔 AWS의 스타트업 솔루션 아키텍트입니다. 그는 서버리스 아키텍처와 AI/ML에 대한 깊은 열정을 가지고 있습니다. 여가 시간에 Inaam은 가족과 함께 좋은 시간을 보내고 자전거 타기와 배드민턴에 대한 사랑에 빠져 있습니다.

이나암 사이에드 B2B 및 SaaS 스타트업의 확장 및 성장 달성을 지원하는 데 중점을 둔 AWS의 스타트업 솔루션 아키텍트입니다. 그는 서버리스 아키텍처와 AI/ML에 대한 깊은 열정을 가지고 있습니다. 여가 시간에 Inaam은 가족과 함께 좋은 시간을 보내고 자전거 타기와 배드민턴에 대한 사랑에 빠져 있습니다.

데이비드 티펫 AWS에서 오픈 소스 OpenSearch를 담당하는 Senior Developer Advocate입니다. 그의 작업은 검색 및 관련성에서 관찰 가능성 및 보안 분석에 이르기까지 OpenSearch의 모든 영역을 포함합니다.

데이비드 티펫 AWS에서 오픈 소스 OpenSearch를 담당하는 Senior Developer Advocate입니다. 그의 작업은 검색 및 관련성에서 관찰 가능성 및 보안 분석에 이르기까지 OpenSearch의 모든 영역을 포함합니다.

- SEO 기반 콘텐츠 및 PR 배포. 오늘 증폭하십시오.

- PlatoData.Network 수직 생성 Ai. 자신에게 권한을 부여하십시오. 여기에서 액세스하십시오.

- PlatoAiStream. 웹3 인텔리전스. 지식 증폭. 여기에서 액세스하십시오.

- 플라톤ESG. 자동차 / EV, 탄소, 클린테크, 에너지, 환경, 태양광, 폐기물 관리. 여기에서 액세스하십시오.

- PlatoHealth. 생명 공학 및 임상 시험 인텔리전스. 여기에서 액세스하십시오.

- 차트프라임. ChartPrime으로 트레이딩 게임을 향상시키십시오. 여기에서 액세스하십시오.

- BlockOffsets. 환경 오프셋 소유권 현대화. 여기에서 액세스하십시오.

- 출처: https://aws.amazon.com/blogs/machine-learning/build-production-ready-generative-ai-applications-for-enterprise-search-using-haystack-pipelines-and-amazon-sagemaker-jumpstart-with-llms/

- :있다

- :이다

- :아니

- :어디

- $UP

- 100

- 12

- 13

- 30

- 500

- 7

- 8

- a

- 할 수 있는

- 소개

- 가속

- ACCESS

- 달성

- 따라서

- 계정

- 달성

- 달성

- 달성

- 행위

- 각색하다

- 추가

- 또한

- 관리

- 이점

- 출현

- 변호사

- AI

- AI / ML

- All

- 수

- 수

- 따라

- 또한

- 이기는하지만

- 아마존

- 아마존 세이지 메이커

- Amazon SageMaker 점프스타트

- Amazon Web Services

- 중

- an

- 분석

- 및

- 답변

- 어떤

- 아파치

- 어플리케이션

- 어플리케이션

- 적용된

- 접근

- 대략

- 있군요

- 지역

- 약

- 배열

- 미술

- 기사

- AS

- 돕는

- At

- 오디오

- 증강 된

- 저자

- 허가

- 자동

- 가능

- AWS

- AWS 클라우드 포메이션

- B2B

- 배경

- 기지

- 기반으로

- BE

- 때문에

- 가

- 전에

- 존재

- 이하

- BEST

- 모범 사례

- 큰

- 블로그

- 판

- 보드 게임

- 몸

- 책

- 두

- 넓은

- 빌드

- 건물

- 내장

- 묶음

- 비자 면제 프로그램에 해당하는 국가의 시민권을 가지고 있지만

- 단추

- by

- 라는

- CAN

- 기능

- 가지 경우

- 이전 단계로 돌아가기

- 변화

- 검사

- 선택

- 왼쪽 메뉴에서

- 선택

- 선택

- 수업

- 청소관련

- 자세히

- 클라우드

- 암호

- 커피

- 공통의

- 커뮤니티

- 회사

- 보어

- 완전한

- 구성 요소

- 구성 요소들

- 구성

- 컴퓨터

- 컴퓨터 과학

- 개념

- 컨퍼런스

- 혼란스러운

- 연결하기

- 치고는

- 콘솔에서

- 포함

- 함유량

- 문맥

- 제어

- 이야기 잘하는

- 대화 형 AI

- 비용

- 적용

- 커버

- 만들

- 만든

- 생성

- 임계

- 고객

- 데이터

- 데이터 준비

- 데이터 보호

- 데이터베이스

- 데이터베이스

- DBS

- 거래

- 깊은

- 깊은 학습

- 한정된

- 데모

- 의존성

- 배포

- 배포

- 배치

- 전개

- 디자인

- 설계

- 설계

- 상세한

- 개발

- 개발자

- 개발자

- 개발

- 다른

- 디지털

- 디지털화

- 치수

- 곧장

- do

- 문서

- 선적 서류 비치

- 서류

- 하지

- 하지 않습니다

- 돈

- 말라

- 마다

- 쉽게

- 효율성

- 효율적인

- 효율적으로

- 중

- 요소

- 포함

- 임베디드

- 임베딩

- EMEA

- 가능

- end

- 끝으로 종료

- 종점

- 엔진

- 강화

- 확인

- 보장

- Enterprise

- 엔티티

- 실재

- 환경

- 평가

- 이벤트

- 모두

- 예

- 기대하는

- 경험

- 체험

- 실험

- 수출

- 외부

- 페이스메이크업

- 가족

- 그림

- 입양 부모로서의 귀하의 적합성을 결정하기 위해 미국 이민국에

- 파일

- 필터링

- 최후의

- 먼저,

- 맞게

- 융통성있는

- 유연하게

- 초점

- 집중

- 수행원

- 럭셔리

- 체재

- Foundation

- 뼈대

- 무료

- 에

- 충분히

- 기능

- Games

- 생성

- 생성

- 생성

- 세대

- 생성적인

- 제너레이티브 AI

- 독일

- 얻을

- 주어진

- 그룹

- 성장

- 핸들

- 있다

- 데

- he

- 도움이

- 그녀의

- 여기에서 지금 확인해 보세요.

- 높은

- 고수준

- 고도로

- 그의

- 호스트

- 방법

- How To

- 그러나

- HTML

- HTTP

- HTTPS

- 허브

- i

- 통합 인증

- if

- 영향

- 구현

- 중대한

- 개선

- in

- 포함

- 포함

- 포함

- 증가

- 더욱 더

- 색인

- 색인

- 색인

- 정보

- 인프라

- 입력

- 설치

- 예

- 명령

- 인터넷

- 으로

- IT

- 그

- JPG

- 키

- 키

- 알아

- 지식

- 지식 관리

- 언어

- 넓은

- 시작

- 시작

- 리드

- 오퍼

- 배우기

- 특허

- 라이센스

- 경량의

- 처럼

- 아마도

- 제한

- 한계

- 라인

- LLM

- 기록

- 로깅

- 찾고

- 애정

- 기계

- 기계 학습

- 만든

- 확인

- 제작

- 유튜브 영상을 만드는 것은

- 관리

- 관리

- 구축

- 재료

- 수학

- 최고

- XNUMX월..

- 평균

- 미디어

- 방법

- 통계

- 수백만

- 회의록

- 완화시키는

- ML

- 모델

- 모델

- 수정

- 모듈

- 순간

- 모니터링

- 배우기

- 가장

- 움직임

- name

- 이름

- 자연의

- 자연 언어 처리

- 탐색

- 필요

- 요구

- nlp

- 수첩

- 번호

- of

- 제공

- 제공

- on

- 만

- 열 수

- 오픈 소스

- 오픈 소스 소프트웨어

- 운영

- 최적화

- 선택권

- 옵션

- or

- 조직

- 최

- 실물

- 기타

- 우리의

- 설명

- 위에

- 자신의

- 꾸러미

- 페이지

- 페이지

- 부품

- 파트너

- 열정

- 열렬한

- 수행

- 성능

- 관로

- 플라톤

- 플라톤 데이터 인텔리전스

- 플라토데이터

- 연극

- 부디

- 포인트 적립

- 인기 문서

- 게시하다

- 강한

- 사례

- 준비

- Prepare

- 개인 정보 보호

- 문제

- 방법

- 처리

- 생산

- 진행

- 프로젝트

- 증명

- 제안 된

- 소유권

- 보호

- 보호

- 프로토 타입

- 제공

- 제공

- 제공

- 제공

- 대리

- 공개

- 푸시

- 품질

- 쿼리

- 문제

- 문의

- 살갗이 벗어 진

- 접수

- 최근

- 추천

- 추천

- 규칙적으로

- 관계

- 관련성

- 관련된

- 신뢰할 수있는

- 기억

- 저장소

- 의뢰

- 필요

- 필수

- 요구조건 니즈

- 제품 자료

- 응답

- 응답

- REST

- 얽매다

- 결과

- 결과

- 반품

- 풍부한

- 연락해주세요

- 로이

- 달리기

- 달리는

- SaaS는

- 현자

- 찜하기

- 라고

- 확장성

- 확장성

- 규모

- 스케일링

- 과학

- 검색

- 보안

- 참조

- 보내다

- 전송

- 연장자

- 서버리스

- 봉사하다

- 서비스

- 서비스

- 세트

- 설정

- 설치

- 셰이프

- 공유

- 그녀

- 배

- 영상을

- 표시

- 소개

- 전시

- 서명

- 비슷한

- 비슷하게

- 단순, 간단, 편리

- 간단히

- 작은

- So

- 소프트웨어

- 혼자서

- 고체

- 해결책

- 솔루션

- 일부

- 무언가

- 출처

- 소스 코드

- 스페이스 버튼

- Speaker

- 언어

- 전문가

- 전문

- 안정

- 스택

- 단계

- 스타트

- 시작

- 신생

- 단계

- 단계

- 저장

- 강한

- 구조

- 이러한

- 스위트

- 확인

- 받아

- 소요

- 기법

- 템플릿

- 테스트

- 그

- XNUMXD덴탈의

- 소스

- 그들

- 그때

- 그것에 의하여

- 따라서

- Bowman의

- 그들

- 맡은 일

- 생각

- 이

- 수천

- 을 통하여

- 시간

- 에

- 함께

- 선로

- 교통

- 운송

- 신뢰할 수있는

- 두

- 유형

- 일반적으로

- 궁극적으로

- 아래에

- 업로드

- us

- 사용

- 익숙한

- 사용자

- 사용자

- 사용

- 사용

- 유틸리티

- 가치

- 마케팅은:

- 여러

- 를 통해

- 시력

- 기다리다

- we

- 웹

- 웹 서비스

- 웹 사이트

- 언제

- 어느

- 의지

- 과

- 이내

- 워드

- 작업

- 워크플로우

- 일하는

- 일

- 겠지

- 쓰다

- 얌

- 년

- 자신의

- 너의

- 제퍼 넷