오늘날의 정보화 시대에 수많은 문서에 담긴 방대한 양의 데이터는 기업에게 도전이자 기회를 제공합니다. 기존의 문서 처리 방법은 효율성과 정확성이 부족하여 혁신, 비용 효율성 및 최적화의 여지가 남아 있는 경우가 많습니다. 지능형 문서 처리(IDP)의 출현으로 문서 처리가 크게 발전했습니다. IDP를 통해 기업은 다양한 문서 유형의 비정형 데이터를 구조화되고 실행 가능한 통찰력으로 변환하여 효율성을 대폭 향상하고 수동 작업을 줄일 수 있습니다. 그러나 잠재력은 여기서 끝나지 않습니다. 생성적 인공지능(AI)을 프로세스에 통합함으로써 IDP 역량을 더욱 향상시킬 수 있습니다. Generative AI는 문서 처리에 향상된 기능을 제공할 뿐만 아니라 변화하는 데이터 패턴에 대한 동적 적응성을 제공합니다. 이 게시물에서는 IDP와 생성 AI의 시너지 효과를 소개하고 이들이 문서 처리의 차세대 개척지를 어떻게 대표하는지 공개합니다.

AWS AI 서비스를 사용한 지능형 문서 처리 시리즈(파트 1 및 파트 2). 이 게시물에서는 LLM(대형 언어 모델)을 사용하여 신규 또는 기존 IDP 아키텍처를 확장하는 방법에 대해 논의합니다. 보다 구체적으로 어떻게 통합할 수 있는지 논의합니다. 아마존 텍사스 과 랭체인 문서 로더로서 아마존 기반암 문서에서 데이터를 추출하고 다양한 IDP 단계 내에서 생성적 AI 기능을 사용합니다.

Amazon Textract는 스캔한 문서에서 텍스트, 필기체 및 데이터를 자동으로 추출하는 기계 학습(ML) 서비스입니다. Amazon Bedrock은 사용하기 쉬운 API를 통해 다양한 고성능 기초 모델(FM)을 제공하는 완전 관리형 서비스입니다.

다음 다이어그램은 기초 모델을 사용하여 IDP 워크플로를 더욱 향상할 수 있는 방법을 설명하는 상위 수준 참조 아키텍처입니다. 사용 사례와 원하는 결과에 따라 IDP의 하나 또는 모든 단계에서 LLM을 사용할 수 있습니다.

다음 섹션에서는 Amazon Textract가 LangChain을 사용하여 생성적 AI 워크플로에 통합되어 이러한 각 작업에 대한 문서를 처리하는 방법을 자세히 살펴봅니다. 여기에 제공된 코드 블록은 간결성을 위해 정리되었습니다. 우리의 GitHub 저장소 자세한 Python 노트북과 단계별 연습을 확인하세요.

문서에서 텍스트 추출은 LLM을 사용하여 문서를 처리할 때 중요한 측면입니다. Amazon Textract를 사용하면 문서에서 구조화되지 않은 원시 텍스트를 추출하고 문서에 있는 키-값 쌍 및 테이블과 같은 원래의 반구조적 또는 구조화된 객체를 보존할 수 있습니다. 의료, 보험 청구 또는 모기지와 같은 문서 패키지는 구조화된 형식, 반구조화된 형식, 비구조화된 형식에 걸쳐 많은 정보를 포함하는 복잡한 형식으로 구성됩니다. 여기서 문서 추출은 중요한 단계입니다. 왜냐하면 LLM은 풍부한 콘텐츠의 이점을 활용하여 더욱 정확하고 관련성이 높은 응답을 생성하고, 그렇지 않으면 LLM의 출력 품질에 영향을 미칠 수 있기 때문입니다.

LangChain은 LLM과 통합하기 위한 강력한 오픈 소스 프레임워크입니다. 일반적으로 LLM은 다재다능하지만 더 깊은 맥락과 미묘한 응답이 필요한 도메인별 작업에는 어려움을 겪을 수 있습니다. LangChain은 이러한 시나리오에서 개발자가 복잡한 작업을 더 작은 하위 작업으로 나눌 수 있는 에이전트를 구축할 수 있도록 지원합니다. 그런 다음 하위 작업은 LLM 프롬프트를 연결하고 연결하여 LLM에 컨텍스트와 메모리를 도입할 수 있습니다.

LangChain 제안 문서 로더 문서에서 데이터를 로드하고 변환할 수 있습니다. 이를 사용하여 LLM에서 처리할 수 있는 기본 형식으로 문서를 구성할 수 있습니다. 그만큼 AmazonTextractPDFLoader LangChain과 함께 Amazon Textract를 사용하여 문서 처리를 자동화하는 빠른 방법을 제공하는 서비스 로더 유형의 문서 로더입니다. 자세한 내용은 AmazonTextractPDFLoader, 랭체인 선적 서류 비치. Amazon Textract 문서 로더를 사용하려면 먼저 LangChain 라이브러리에서 가져와야 합니다.

from langchain.document_loaders import AmazonTextractPDFLoaderhttps_loader = AmazonTextractPDFLoader("https://sample-website.com/sample-doc.pdf")

https_document = https_loader.load() s3_loader = AmazonTextractPDFLoader("s3://sample-bucket/sample-doc.pdf")

s3_document = s3_loader.load()또한 Amazon S3에 문서를 저장하고 에 설명된 대로 s3:// URL 패턴을 사용하여 참조할 수도 있습니다. S3://를 사용하여 버킷에 액세스을 클릭하고 이 S3 경로를 Amazon Textract PDF 로더에 전달합니다.

import boto3

textract_client = boto3.client('textract', region_name='us-east-2') file_path = "s3://amazon-textract-public-content/langchain/layout-parser-paper.pdf"

loader = AmazonTextractPDFLoader(file_path, client=textract_client)

documents = loader.load()여러 페이지로 구성된 문서에는 여러 페이지의 텍스트가 포함되며, 페이지 목록인 문서 개체를 통해 액세스할 수 있습니다. 다음 코드는 문서 개체의 페이지를 반복하고 다음을 통해 사용할 수 있는 문서 텍스트를 인쇄합니다. page_content 속성:

print(len(documents)) for document in documents: print(document.page_content)Amazon Comprehend와 LLM을 문서 분류에 효과적으로 활용할 수 있습니다. Amazon Comprehend는 ML을 사용하여 텍스트에서 통찰력을 추출하는 자연어 처리(NLP) 서비스입니다. Amazon Comprehend는 PDF, Word 및 이미지 형식과 같은 문서에 대한 레이아웃 인식을 통해 사용자 지정 분류 모델 교육도 지원합니다. Amazon Comprehend 문서 분류기 사용에 대한 자세한 내용은 다음을 참조하십시오. Amazon Comprehend 문서 분류자는 더 높은 정확도를 위해 레이아웃 지원을 추가합니다..

LLM과 결합하면 문서 분류는 대량의 문서를 관리하기 위한 강력한 접근 방식이 됩니다. LLM은 자연어 이해를 사용하여 문서의 텍스트, 패턴 및 문맥 요소를 분석할 수 있기 때문에 문서 분류에 도움이 됩니다. 특정 문서 클래스에 맞게 세부 조정할 수도 있습니다. IDP 파이프라인에 도입된 새로운 문서 유형에 분류가 필요한 경우 LLM은 텍스트를 처리하고 주어진 클래스 집합에 따라 문서를 분류할 수 있습니다. 다음은 Amazon Textract에서 제공하는 LangChain 문서 로더를 사용하여 문서에서 텍스트를 추출하고 이를 문서 분류에 사용하는 샘플 코드입니다. 우리는 인류 클로드 v2 Amazon Bedrock을 통해 모델을 만들어 분류를 수행합니다.

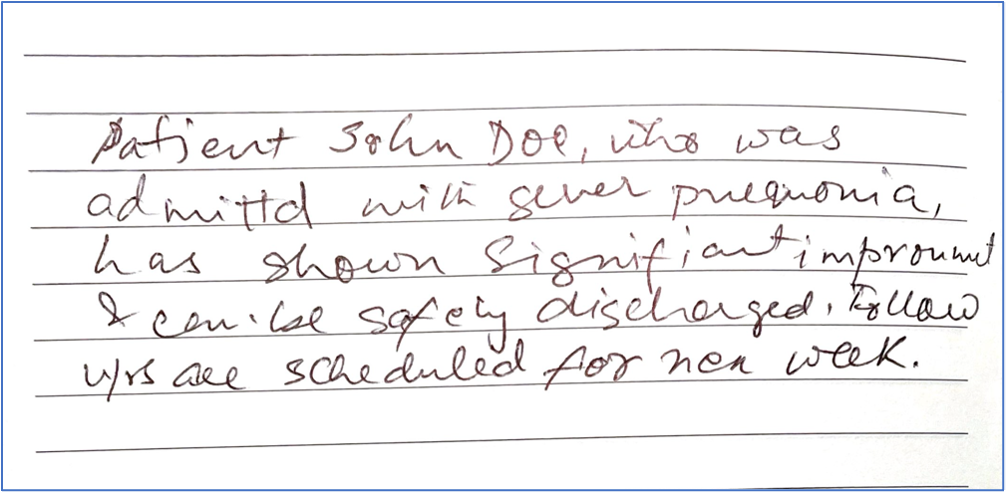

다음 예에서는 먼저 환자 퇴원 보고서에서 텍스트를 추출하고 LLM을 사용하여 세 가지 문서 유형 목록을 바탕으로 이를 분류합니다.DISCHARGE_SUMMARY, RECEIPT및 PRESCRIPTION. 다음 스크린샷은 보고서를 보여줍니다.

from langchain.document_loaders import AmazonTextractPDFLoader

from langchain.llms import Bedrock

from langchain.prompts import PromptTemplate

from langchain.chains import LLMChain loader = AmazonTextractPDFLoader("./samples/document.png")

document = loader.load() template = """ Given a list of classes, classify the document into one of these classes. Skip any preamble text and just give the class name. <classes>DISCHARGE_SUMMARY, RECEIPT, PRESCRIPTION</classes>

<document>{doc_text}<document>

<classification>""" prompt = PromptTemplate(template=template, input_variables=["doc_text"])

bedrock_llm = Bedrock(client=bedrock, model_id="anthropic.claude-v2") llm_chain = LLMChain(prompt=prompt, llm=bedrock_llm)

class_name = llm_chain.run(document[0].page_content) print(f"The provided document is = {class_name}")

요약에는 주요 정보를 유지하면서 특정 텍스트나 문서를 더 짧은 버전으로 압축하는 작업이 포함됩니다. 이 기술은 사용자가 전체 내용을 읽지 않고도 문서의 핵심 사항을 빠르게 파악할 수 있어 효율적인 정보 검색에 유용합니다. Amazon Textract는 텍스트 요약을 직접 수행하지는 않지만 문서에서 전체 텍스트를 추출하는 기본 기능을 제공합니다. 이렇게 추출된 텍스트는 텍스트 요약 작업을 수행하기 위한 LLM 모델에 대한 입력 역할을 합니다.

동일한 샘플 배출 보고서를 사용하여 다음을 사용합니다. AmazonTextractPDFLoader 이 문서에서 텍스트를 추출합니다. 이전과 마찬가지로 Amazon Bedrock을 통해 Claude v2 모델을 사용하고 텍스트로 수행할 작업(이 경우 요약)에 대한 지침이 포함된 프롬프트로 초기화합니다. 마지막으로 문서 로더에서 추출된 텍스트를 전달하여 LLM 체인을 실행합니다. 그러면 요약할 지침과 다음으로 표시된 문서 텍스트로 구성된 프롬프트를 사용하여 LLM에서 추론 작업이 실행됩니다. Document. 다음 코드를 참조하십시오.

코드는 환자 퇴원 요약 보고서의 요약을 생성합니다.

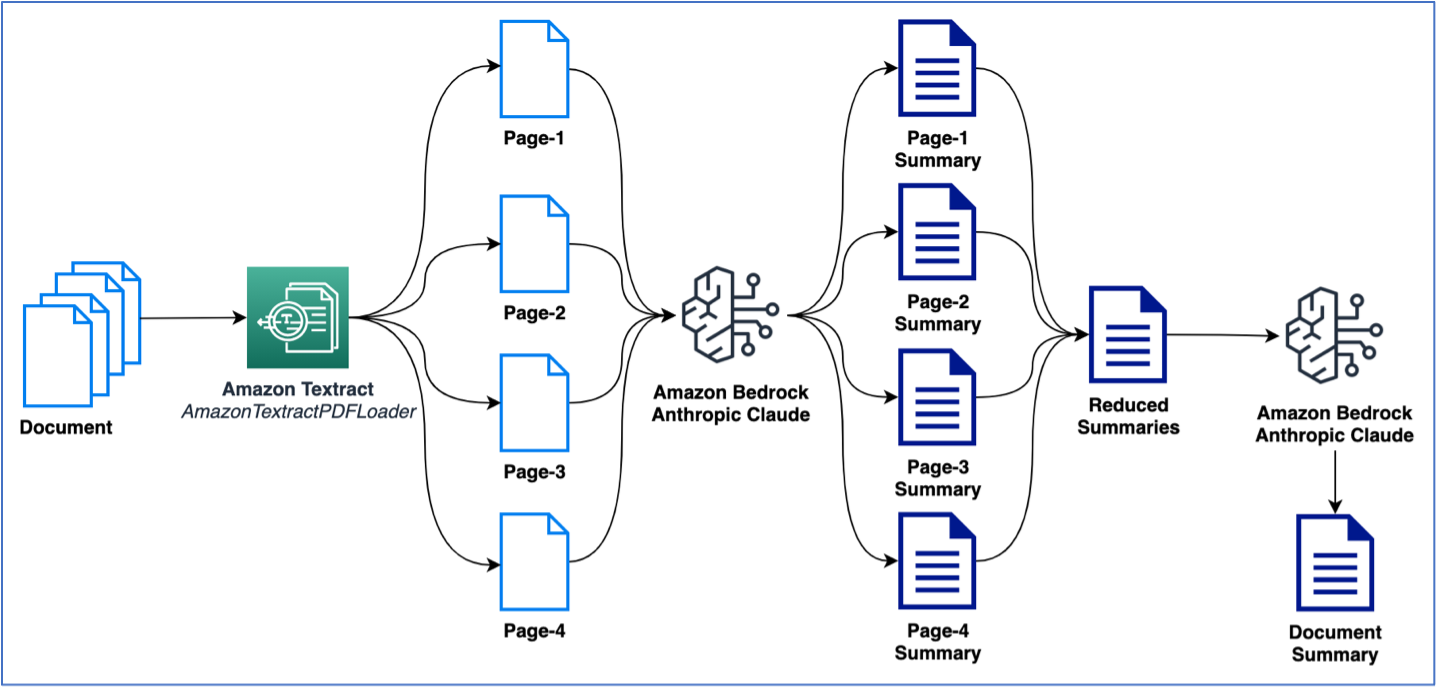

앞의 예에서는 단일 페이지 문서를 사용하여 요약을 수행했습니다. 그러나 요약이 필요한 여러 페이지가 포함된 문서를 처리하게 될 가능성이 높습니다. 여러 페이지에서 요약을 수행하는 일반적인 방법은 먼저 작은 텍스트 덩어리에 대한 요약을 생성한 다음 더 작은 요약을 결합하여 문서의 최종 요약을 얻는 것입니다. 이 방법을 사용하려면 LLM을 여러 번 호출해야 합니다. 이에 대한 논리는 쉽게 만들 수 있습니다. 그러나 LangChain은 (여러 페이지 문서의) 큰 텍스트를 요약할 수 있는 내장된 요약 체인을 제공합니다. 요약은 다음 중 하나를 통해 이루어질 수 있습니다. map_reduce 또는 stuff LLM에 대한 여러 호출을 관리하기 위한 옵션으로 사용할 수 있는 옵션입니다. 다음 예에서는 map_reduce 여러 페이지로 구성된 문서를 요약합니다. 다음 그림은 우리의 작업 흐름을 보여줍니다.

먼저 문서를 추출하여 페이지당 총 토큰 수와 총 페이지 수를 살펴보겠습니다.

다음으로 LangChain의 내장 기능을 사용합니다. load_summarize_chain 전체 문서를 요약하려면:

from langchain.chains.summarize import load_summarize_chain summary_chain = load_summarize_chain(llm=bedrock_llm, chain_type='map_reduce')

output = summary_chain.run(document)

print(output.strip())표준화 및 Q&A

이 섹션에서는 표준화 및 Q&A 작업에 대해 설명합니다.

표준화

출력 표준화는 LLM을 사용하여 출력 텍스트의 일관된 형식을 제공하는 텍스트 생성 작업입니다. 이 작업은 출력을 원하는 형식에 맞춰 정렬해야 하는 주요 엔터티 추출 자동화에 특히 유용합니다. 예를 들어, 프롬프트 엔지니어링 모범 사례에 따라 LLM을 미세 조정하여 날짜 형식을 데이터베이스 DATE 열과 호환될 수 있는 MM/DD/YYYY 형식으로 지정할 수 있습니다. 다음 코드 블록은 LLM 및 프롬프트 엔지니어링을 사용하여 이를 수행하는 방법의 예를 보여줍니다. 날짜 값의 출력 형식을 표준화할 뿐만 아니라 모델이 최종 출력을 JSON 형식으로 생성하여 다운스트림 애플리케이션에서 쉽게 사용할 수 있도록 유도합니다. 우리는 사용 LangChain 표현 언어 (LCEL) 두 가지 작업을 함께 연결합니다. 첫 번째 작업은 LLM이 문서의 날짜만 포함하는 JSON 형식 출력을 생성하도록 요청합니다. 두 번째 작업은 JSON 출력을 사용하고 날짜 형식을 표준화합니다. 이 XNUMX단계 작업은 정규화 및 템플릿에서 볼 수 있듯이 적절한 프롬프트 엔지니어링을 통해 단일 단계로 수행될 수도 있습니다.

이전 코드 샘플의 출력은 날짜가 07/09/2020 및 08/09/2020인 JSON 구조입니다. 날짜는 DD/MM/YYYY 형식이고 각각 환자의 병원 입원 날짜와 퇴원 날짜입니다. 퇴원 요약 보고서에.

검색 증강 생성에 대한 Q&A

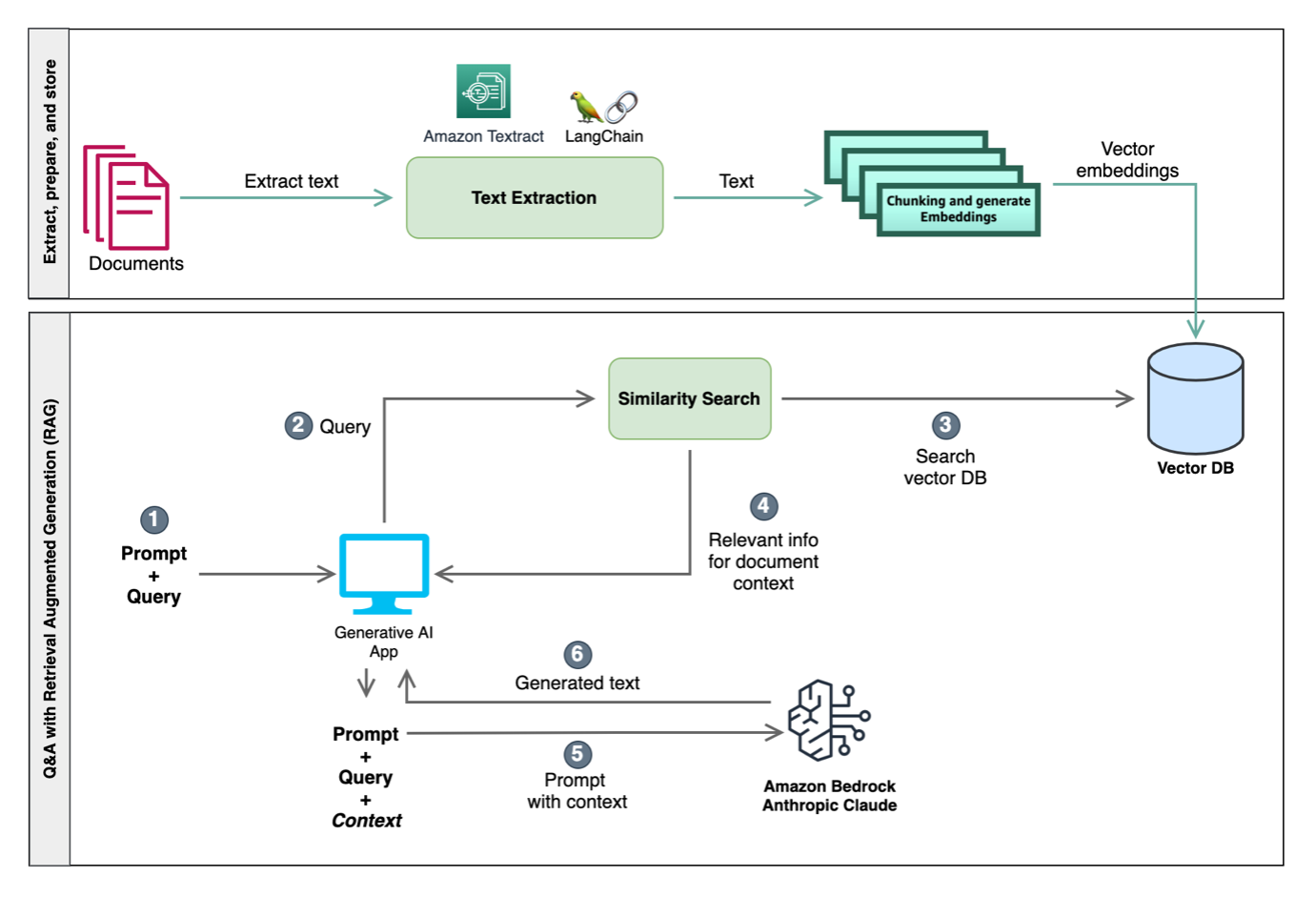

LLM은 종종 세계 지식이나 세계관이라고 불리는 사실 정보를 보유하는 것으로 알려져 있습니다. 미세 조정하면 최첨단 결과를 얻을 수 있습니다. 그러나 LLM이 이 지식에 얼마나 효과적으로 접근하고 조작할 수 있는지에 대한 제약이 있습니다. 결과적으로 특정 지식에 크게 의존하는 작업에서는 성능이 특정 사용 사례에 적합하지 않을 수 있습니다. 예를 들어, Q&A 시나리오에서는 모델이 전 세계 지식에만 의존하지 않고 문서에 제공된 컨텍스트를 엄격하게 준수하는 것이 중요합니다. 이를 벗어나면 허위 진술, 부정확성, 심지어 부정확한 응답이 발생할 수 있습니다. 이 문제를 해결하기 위해 가장 일반적으로 사용되는 방법은 다음과 같습니다. 검색 증강 생성 (조각). 이 접근 방식은 검색 모델과 언어 모델의 장점을 모두 활용하여 생성된 응답의 정확성과 품질을 향상시킵니다.

LLM은 메모리 제약과 실행되는 하드웨어의 제한으로 인해 토큰 제한을 적용할 수도 있습니다. 이 문제를 해결하기 위해 청크와 같은 기술을 사용하여 큰 문서를 LLM의 토큰 한도에 맞는 작은 부분으로 나눕니다. 반면, 임베딩은 NLP에서 주로 단어의 의미론적 의미와 고차원 공간에서 다른 단어와의 관계를 포착하기 위해 사용됩니다. 이러한 임베딩은 단어를 벡터로 변환하여 모델이 텍스트 데이터를 효율적으로 처리하고 이해할 수 있도록 합니다. 단어와 구문 사이의 의미적 뉘앙스를 이해함으로써 임베딩을 통해 LLM은 일관되고 상황에 맞는 출력을 생성할 수 있습니다. 다음 주요 용어에 유의하세요.

- 청킹 – 이 프로세스는 문서의 많은 양의 텍스트를 더 작고 의미 있는 텍스트 덩어리로 나눕니다.

- 임베딩 – 이는 청크의 의미 정보를 유지하는 각 청크의 고정 차원 벡터 변환입니다. 이러한 임베딩은 이후 벡터 데이터베이스에 로드됩니다.

- 벡터 데이터베이스 – 단어의 맥락을 나타내는 단어 임베딩 또는 벡터의 데이터베이스입니다. 문서 처리 파이프라인에서 NLP 작업을 지원하는 지식 소스 역할을 합니다. 여기서 벡터 데이터베이스의 이점은 다음 섹션에서 설명하는 것처럼 텍스트 생성 중에 필요한 컨텍스트만 LLM에 제공할 수 있다는 것입니다.

RAG는 임베딩 기능을 사용하여 검색 단계에서 관련 문서 세그먼트를 이해하고 가져옵니다. 이를 통해 RAG는 LLM의 토큰 제한 내에서 작동하여 생성을 위해 가장 관련성이 높은 정보를 선택하여 보다 정확하고 상황에 맞게 관련성이 높은 출력을 생성할 수 있습니다.

다음 다이어그램은 이러한 기술을 통합하여 LLM에 대한 입력을 작성하고 상황에 대한 이해를 강화하며 보다 관련성이 높은 상황 내 응답을 가능하게 하는 방법을 보여줍니다. 한 가지 접근 방식에는 벡터 데이터베이스와 청킹을 모두 활용하는 유사성 검색이 포함됩니다. 벡터 데이터베이스는 의미 정보를 나타내는 임베딩을 저장하고 청킹은 텍스트를 관리 가능한 섹션으로 나눕니다. 유사성 검색의 이러한 컨텍스트를 사용하여 LLM은 질문 답변과 같은 작업과 분류 및 강화와 같은 도메인별 작업을 실행할 수 있습니다.

이 게시물에서는 RAG 기반 접근 방식을 사용하여 문서에 대한 컨텍스트 내 Q&A를 수행합니다. 다음 코드 샘플에서는 문서에서 텍스트를 추출한 다음 문서를 더 작은 텍스트 덩어리로 분할합니다. 여러 페이지로 구성된 대규모 문서가 있을 수 있고 LLM에 토큰 제한이 있을 수 있으므로 청킹이 필요합니다. 그런 다음 이러한 청크는 후속 단계에서 유사성 검색을 수행하기 위해 벡터 데이터베이스에 로드됩니다. 다음 예에서는 문서 청크의 벡터 임베딩을 수행하는 Amazon Titan Embed Text v1 모델을 사용합니다.

코드는 벡터 데이터베이스의 유사성 검색 작업에 의해 반환된 텍스트 덩어리를 사용하여 LLM에 대한 관련 컨텍스트를 생성합니다. 이 예에서는 오픈 소스를 사용합니다. FAISS 벡터 스토어 각 텍스트 덩어리의 벡터 임베딩을 저장하는 샘플 벡터 데이터베이스입니다. 그런 다음 벡터 데이터베이스를 다음과 같이 정의합니다. 랭체인 리트리버, 이는 RetrievalQA 체인. 이는 내부적으로 질문과 관련된 상위 n개(여기서 n=3) 텍스트 덩어리를 반환하는 벡터 데이터베이스에서 유사성 검색 쿼리를 실행합니다. 마지막으로, LLM 체인은 관련 컨텍스트(관련 텍스트 덩어리 그룹)와 LLM이 대답할 질문과 함께 실행됩니다. RAG에 대한 Q&A의 단계별 코드 연습은 Python 노트북을 참조하세요. GitHub의.

FAISS의 대안으로 다음을 사용할 수도 있습니다. Amazon OpenSearch Service 벡터 데이터베이스 기능, PostgreSQL용 Amazon Relational Database Service(Amazon RDS) 와 더불어 pg벡터 벡터 데이터베이스 또는 오픈 소스 Chroma 데이터베이스로 확장됩니다.

표 형식 데이터에 대한 Q&A

문서 내의 표 형식 데이터는 구조적 복잡성으로 인해 LLM이 처리하기 어려울 수 있습니다. Amazon Textract는 페이지, 테이블, 셀과 같은 요소의 중첩 형식으로 문서에서 테이블을 추출할 수 있으므로 LLM으로 확장될 수 있습니다. 표 형식 데이터로 Q&A를 수행하는 것은 다단계 프로세스이며 다음을 통해 수행할 수 있습니다. 자체 쿼리. 다음은 단계에 대한 개요입니다.

- Amazon Textract를 사용하여 문서에서 테이블을 추출합니다. Amazon Textract를 사용하면 문서에서 테이블 형식 구조(행, 열, 헤더)를 추출할 수 있습니다.

- 헤더 이름 및 각 헤더에 대한 설명과 같은 메타데이터 정보와 함께 표 형식 데이터를 벡터 데이터베이스에 저장합니다.

- 프롬프트를 사용하여 LLM을 사용하여 구조화된 쿼리를 구성하고 테이블에서 데이터를 파생시킵니다.

- 쿼리를 사용하여 벡터 데이터베이스에서 관련 테이블 데이터를 추출합니다.

예를 들어, 은행 명세서에서 "예금이 $1000 이상인 거래는 무엇입니까?"라는 메시지가 있는 경우 LLM은 다음 단계를 완료합니다.

- 다음과 같은 쿼리를 작성합니다.

“Query: transactions” , “filter: greater than (Deposit$)”. - 쿼리를 구조화된 쿼리로 변환합니다.

- 테이블 데이터가 저장된 벡터 데이터베이스에 구조화된 쿼리를 적용합니다.

표 형식의 Q&A에 대한 단계별 샘플 코드 연습은 Python 노트북을 참조하세요. GitHub의.

템플릿화 및 정규화

이 섹션에서는 프롬프트 엔지니어링 기술과 LangChain에 내장된 메커니즘을 사용하여 지정된 스키마의 문서에서 추출한 내용으로 출력을 생성하는 방법을 살펴봅니다. 또한 앞서 설명한 기술을 사용하여 추출된 데이터에 대해 일부 표준화를 수행합니다. 원하는 출력에 대한 템플릿을 정의하는 것부터 시작합니다. 이는 스키마 역할을 하며 문서 텍스트에서 추출하려는 각 엔터티에 대한 세부 정보를 캡슐화합니다.

각 엔터티에 대해 설명을 사용하여 해당 엔터티가 무엇인지 설명함으로써 LLM이 문서 텍스트에서 값을 추출하는 데 도움을 줍니다. 다음 샘플 코드에서는 이 템플릿을 사용하여 문서에서 추출된 텍스트와 함께 LLM에 대한 프롬프트를 만듭니다. AmazonTextractPDFLoader 그런 다음 모델을 사용하여 추론을 수행합니다.

당신이 볼 수 있듯이, {keys} 프롬프트의 일부는 템플릿의 키이고 {details} 설명과 함께 키입니다. 이 경우 JSON 형식으로 출력을 생성하도록 명령에 지정하는 것 외에 출력 형식을 사용하여 모델에 명시적으로 메시지를 표시하지 않습니다. 이것은 대부분의 경우 작동합니다. 그러나 LLM의 출력은 비결정적 텍스트 생성이므로 프롬프트 지침의 일부로 형식을 명시적으로 지정하려고 합니다. 이 문제를 해결하기 위해 LangChain의 구조화된 출력 파서 템플릿을 형식 지침 프롬프트로 변환하는 데 도움이 되는 자동화된 프롬프트 엔지니어링을 활용하는 모듈입니다. 이전에 정의한 템플릿을 사용하여 다음과 같이 형식 지침 프롬프트를 생성합니다.

그런 다음 원래 프롬프트 내에서 이 변수를 LLM에 대한 지침으로 사용하여 프롬프트를 약간 수정하여 원하는 스키마로 출력을 추출하고 형식을 지정합니다.

지금까지 우리는 원하는 스키마의 문서에서 데이터만 추출했습니다. 그러나 여전히 표준화가 필요합니다. 예를 들어, 환자의 입원 날짜와 퇴원 날짜를 DD/MM/YYYY 형식으로 추출하려고 합니다. 이 경우, 우리는 description 형식 지정 지침이 포함된 키:

Python 노트북을 참조하세요. GitHub의 전체 단계별 연습 및 설명을 보려면

맞춤법 검사 및 수정

LLM은 인간과 유사한 텍스트를 이해하고 생성하는 데 놀라운 능력을 보여주었습니다. 덜 논의되었지만 매우 유용한 LLM 응용 프로그램 중 하나는 문서의 문법 확인 및 문장 수정에 대한 잠재력입니다. 사전 정의된 규칙 집합에 의존하는 기존 문법 검사기와 달리 LLM은 방대한 양의 텍스트 데이터에서 식별한 패턴을 사용하여 무엇이 정확하거나 유창한 언어인지 결정합니다. 이는 규칙 기반 시스템이 놓칠 수 있는 뉘앙스, 맥락 및 미묘함을 감지할 수 있음을 의미합니다.

“중증 폐렴으로 입원한 Jon Doe 환자가 상당한 호전을 보여 안전하게 퇴원할 수 있습니다.”라는 환자 퇴원 요약에서 추출된 텍스트를 상상해 보십시오. 후속 조치는 다음 주에 예정되어 있습니다.” 기존의 맞춤법 검사기는 'admittd', 'pneumonia', 'improvement' 및 'nex'를 오류로 인식할 수 있습니다. 그러나 이러한 오류의 맥락으로 인해 추가 실수나 일반적인 제안이 발생할 수 있습니다. 광범위한 교육을 받은 LLM은 다음과 같이 제안할 수 있습니다. “심각한 폐렴으로 입원한 환자 John Doe는 상당한 호전을 보였으며 안전하게 퇴원할 수 있습니다. 후속 조치는 다음 주에 예정되어 있습니다.”

다음은 이전에 설명한 것과 동일한 텍스트가 포함된 서투른 손글씨 샘플 문서입니다.

Amazon Textract 문서 로더를 사용하여 문서를 추출한 다음 프롬프트 엔지니어링을 통해 LLM에 지시하여 추출된 텍스트를 수정하여 철자 및/또는 문법 오류를 수정하도록 합니다.

이전 코드의 출력에는 문서 로더에서 추출한 원본 텍스트와 LLM에서 생성된 수정된 텍스트가 표시됩니다.

LLM만큼 강력하기 때문에 제안을 제안으로 보는 것이 중요합니다. 언어의 복잡함을 인상적으로 잘 포착하지만, 오류가 없는 것은 아닙니다. 일부 제안 사항은 원본 텍스트의 의도된 의미나 어조를 변경할 수 있습니다. 따라서 인간 검토자가 LLM에서 생성된 수정 사항을 절대값이 아닌 가이드로 사용하는 것이 중요합니다. 인간의 직관과 LLM 기능의 협력은 서면 의사소통이 오류가 없을 뿐만 아니라 더욱 풍부하고 미묘한 미래를 약속합니다.

결론

Generative AI는 IDP로 문서를 처리하여 통찰력을 얻는 방법을 변화시키고 있습니다. 게시물에서 생성 AI를 통해 AWS 지능형 문서 처리 향상에서 파이프라인의 다양한 단계와 AWS 고객인 Ricoh가 LLM을 통해 IDP 파이프라인을 어떻게 강화하고 있는지 논의했습니다. 이 게시물에서는 Amazon Bedrock, Amazon Textract 및 널리 사용되는 LangChain 프레임워크를 통해 LLM으로 IDP 워크플로를 강화하는 다양한 메커니즘에 대해 논의했습니다. 지금 바로 LangChain에서 제공되는 샘플 노트북을 사용하여 새로운 Amazon Textract 문서 로더를 시작할 수 있습니다. GitHub 저장소. AWS에서 생성적 AI 작업에 대한 자세한 내용은 다음을 참조하십시오. AWS에서 생성 AI로 구축하기 위한 새로운 도구 발표.

저자에 관하여

소날리 사후 AWS의 AI/ML 서비스 팀과 함께 지능형 문서 처리를 주도하고 있습니다. 그녀는 작가이자 사상가이자 열정적인 기술자입니다. 그녀의 핵심 초점 영역은 AI 및 ML이며 전 세계의 AI 및 ML 컨퍼런스 및 모임에서 자주 연설합니다. 그녀는 의료, 금융 부문 및 보험에 대한 업계 전문 지식과 함께 기술 및 기술 산업에서 광범위하고 깊이 있는 경험을 가지고 있습니다.

소날리 사후 AWS의 AI/ML 서비스 팀과 함께 지능형 문서 처리를 주도하고 있습니다. 그녀는 작가이자 사상가이자 열정적인 기술자입니다. 그녀의 핵심 초점 영역은 AI 및 ML이며 전 세계의 AI 및 ML 컨퍼런스 및 모임에서 자주 연설합니다. 그녀는 의료, 금융 부문 및 보험에 대한 업계 전문 지식과 함께 기술 및 기술 산업에서 광범위하고 깊이 있는 경험을 가지고 있습니다.

안잔 비스와스 AI/ML 및 데이터 분석에 중점을 둔 선임 AI 서비스 솔루션 설계자입니다. Anjan은 전 세계 AI 서비스 팀의 일원이며 고객과 협력하여 고객이 AI 및 ML을 통해 비즈니스 문제에 대한 솔루션을 이해하고 개발하도록 돕습니다. Anjan은 글로벌 공급망, 제조 및 소매 조직에서 14년 이상 일한 경험이 있으며 고객이 AWS AI 서비스를 시작하고 확장할 수 있도록 적극적으로 돕고 있습니다.

안잔 비스와스 AI/ML 및 데이터 분석에 중점을 둔 선임 AI 서비스 솔루션 설계자입니다. Anjan은 전 세계 AI 서비스 팀의 일원이며 고객과 협력하여 고객이 AI 및 ML을 통해 비즈니스 문제에 대한 솔루션을 이해하고 개발하도록 돕습니다. Anjan은 글로벌 공급망, 제조 및 소매 조직에서 14년 이상 일한 경험이 있으며 고객이 AWS AI 서비스를 시작하고 확장할 수 있도록 적극적으로 돕고 있습니다.

친마이 레인 Amazon Web Services의 AI/ML 전문가 솔루션 아키텍트입니다. 그녀는 응용 수학과 기계 학습에 열정을 갖고 있습니다. 그녀는 AWS 고객을 위한 지능형 문서 처리 및 생성 AI 솔루션을 설계하는 데 중점을 두고 있습니다. 업무 외에는 살사와 바차타 댄스를 즐깁니다.

친마이 레인 Amazon Web Services의 AI/ML 전문가 솔루션 아키텍트입니다. 그녀는 응용 수학과 기계 학습에 열정을 갖고 있습니다. 그녀는 AWS 고객을 위한 지능형 문서 처리 및 생성 AI 솔루션을 설계하는 데 중점을 두고 있습니다. 업무 외에는 살사와 바차타 댄스를 즐깁니다.

- SEO 기반 콘텐츠 및 PR 배포. 오늘 증폭하십시오.

- PlatoData.Network 수직 생성 Ai. 자신에게 권한을 부여하십시오. 여기에서 액세스하십시오.

- PlatoAiStream. 웹3 인텔리전스. 지식 증폭. 여기에서 액세스하십시오.

- 플라톤ESG. 탄소, 클린테크, 에너지, 환경, 태양광, 폐기물 관리. 여기에서 액세스하십시오.

- PlatoHealth. 생명 공학 및 임상 시험 인텔리전스. 여기에서 액세스하십시오.

- 출처: https://aws.amazon.com/blogs/machine-learning/intelligent-document-processing-with-amazon-textract-amazon-bedrock-and-langchain/

- :있다

- :이다

- :아니

- :어디

- .nex

- $1000

- $UP

- 1

- 10

- 100

- 11

- 12

- 13

- 14

- 15%

- 16

- 22

- 23

- 33

- 35%

- 7

- 9

- a

- 능력

- 소개

- 절대

- ACCESS

- 액세스

- 에 따르면

- 정확한

- 달성

- 가로질러

- 동작

- 행위

- 활발히

- 활동

- 행위

- Ad

- 주소

- 추가

- 가입 한

- 들이다

- 인정 된

- 발전

- 이점

- 출현

- 나이

- 자치령 대표

- AI

- AI 서비스

- AI / ML

- 정렬 된

- All

- 허용

- 수

- 따라

- 또한

- 대안

- 이기는하지만

- 아마존

- 아마존 이해

- 아마존 RDS

- 아마존 텍사스

- Amazon Web Services

- 금액

- an

- 분석

- 분석하다

- 및

- 답변

- 인류

- 어떤

- API

- 어플리케이션

- 적용된

- 설비

- 접근

- 아키텍처

- 있군요

- 지역

- 약

- 미술

- 인조의

- 인공 지능

- 인공 지능(AI)

- AS

- 양상

- 지원

- 조수

- At

- 증가하다

- 증강 된

- 저자

- 자동화

- 자동화

- 자동적으로

- 자동화

- 가능

- 인식

- AWS

- AWS 고객

- 은행

- BE

- 때문에

- 된다

- 된

- 전에

- 유익한

- 이익

- BEST

- 모범 사례

- 사이에

- 블록

- 블록

- 두

- 폭

- 흩어져

- 휴식

- 빌드

- 건물

- 내장

- 사업

- 사업

- 비자 면제 프로그램에 해당하는 국가의 시민권을 가지고 있지만

- by

- 통화

- CAN

- 얻을 수 있습니다

- 기능

- 포착

- 케이스

- 가지 경우

- 셀

- 어떤

- 체인

- 쇠사슬

- 도전

- 도전

- 이전 단계로 돌아가기

- 변경

- 변화

- 확인하는 것이 좋다.

- 선택

- 주장

- 수업

- 수업

- 분류

- 분류

- 암호

- 일관성

- 협동

- 단

- 열

- 결합

- 결합

- 제공

- 공통의

- 일반적으로

- 의사 소통

- 호환

- 완전한

- 복잡한

- 복잡성

- 이해하다

- 간결한

- 회의

- 연결

- 일관된

- 구성

- 제약

- 구축

- 포함하는

- 포함

- 이 포함되어 있습니다

- 함유량

- 문맥

- 문맥

- 변하게 하다

- 핵심

- 수정

- 수정

- 수정

- 수

- 내기

- 만들어진

- 생성

- 결정적인

- 관습

- 고객

- 고객

- 댄스

- 데이터

- 데이터 분석

- 데이터베이스

- 데이터베이스

- 날짜

- 날짜

- 거래

- 깊은

- 깊이

- 밝히다

- 한정된

- 정의

- 시연

- 의존

- 매장

- 깊이

- 기술 된

- 설명

- 설계

- 원하는

- 세부 묘사

- 상세한

- 세부설명

- 검색

- 결정

- 개발

- 개발자

- 다이어트

- 다른

- 직접

- 토론

- 논의 된

- 잠수

- 나누다

- 나누다

- do

- 의사

- 문서

- 선적 서류 비치

- 서류

- 암사슴

- 하지 않습니다

- 하기

- 돈

- 한

- 말라

- 아래 (down)

- 극적으로

- 두

- ...동안

- 동적

- e

- 마다

- 이전

- 용이하게

- 사용하기 쉬운

- 효과적으로

- 효율성

- 효율적인

- 효율적으로

- 노력

- 중

- 요소

- 포함

- 고용 된

- 힘을 실어

- 가능

- 수

- 가능

- end

- 엔지니어링

- 강화

- 강화

- 강화

- 확인

- 보장

- 전체의

- 엔티티

- 실재

- 갖추어 준

- 오류

- 필수

- 조차

- 예

- 외

- 예외

- 현존하는

- 경험

- 전문적 지식

- 설명

- 설명

- 설명

- 설명

- 명시 적으로

- 표현

- 확장

- 확장자

- 광대 한

- 추출물

- 추출

- 추출물

- 떨어지다

- 그릇된

- 멀리

- 피로

- Fields

- 그림

- 최후의

- 최종적으로

- 금융

- 금융 부문

- 먼저,

- 맞게

- 초점

- 집중

- 따라

- 다음에

- 수행원

- 다음

- 럭셔리

- 체재

- 양식

- 발견

- Foundation

- 뼈대

- 무료

- 자주

- 에

- 변경

- 가득 찬

- 충분히

- 추가

- 미래

- 일반

- 생성

- 생성

- 생성

- 생성

- 세대

- 생성적인

- 제너레이티브 AI

- 얻을

- 주기

- 주어진

- 글로벌

- 문법

- 파악

- 큰

- 그룹

- 안내

- 손

- 핸들

- 발생

- 무슨 일이

- 하드웨어

- 있다

- 헤더

- 건강 관리

- 무겁게

- 도움

- 도움이

- 도움이

- 도움이

- 그녀의

- 여기에서 지금 확인해 보세요.

- 고수준

- 고성능

- 더 높은

- 보유

- 병원

- 방법

- How To

- 그러나

- HTML

- HTTPS

- 사람의

- i

- ID

- 확인

- if

- 설명하다

- 영상

- 엄청나게

- 영향

- import

- 중대한

- 가져 오기

- 두다

- 개량

- in

- 포함

- 색인

- 산업

- 정보

- 정보화 시대

- 혁신

- 입력

- 통찰력

- 예

- 명령

- 보험

- 통합

- 통합 된

- 통합

- 완성

- 인텔리전스

- 지능형

- 지능형 문서 처리

- 예정된

- 내부로

- 으로

- 복잡한

- 소개

- 소개

- 소개합니다

- IT

- 그

- 잭슨

- 요한 복음

- 존 데

- 존

- JPG

- JSON

- 다만

- 키

- 키

- 알아

- 지식

- 알려진

- 언어

- 넓은

- 레이아웃

- 리드

- 리더

- 지도

- 배우기

- 출발

- 도서관

- 처럼

- 아마도

- 한계

- 제한

- 명부

- LLM

- 하중

- 짐을 싣는 사람

- 논리

- 보기

- 롯

- 기계

- 기계 학습

- 유튜브 영상을 만드는 것은

- 관리

- 다루기 쉬운

- 관리

- 관리

- 조작

- 제조

- 두드러진

- 수학

- XNUMX월..

- me

- 의미

- 의미있는

- 방법

- 기구

- 메커니즘

- Meetups

- 메모리

- 메타

- 메타 데이터

- 방법

- 방법

- 수도

- 신경

- 미스...

- 실수

- ML

- 모델

- 모델

- 모듈

- 배우기

- 대출

- 가장

- 여러

- name

- 이름

- 자연의

- 자연 언어 처리

- 필요한

- 필요

- 필요

- 요구

- 신제품

- 다음 것

- 다음주

- nlp

- 수첩

- 지금

- 뉘앙스

- 번호

- 대상

- 사물

- of

- 제공

- 자주

- on

- ONE

- 만

- 오픈 소스

- 행정부

- 기회

- 최적의

- 옵션

- or

- 조직

- 실물

- 기타

- 그렇지 않으면

- 우리의

- 아웃

- 결과

- 출력

- 출력

- 외부

- 위에

- 개요

- 패키지

- 페이지

- 페이지

- 고통

- 쌍을 이루는

- 쌍

- 부품

- 특별히

- 패스

- 합격

- 통과

- 열렬한

- 통로

- 환자

- 무늬

- 패턴

- 용

- 수행

- 성능

- 수행

- 실행할 수 있는

- 수행하다

- 상

- 박사 학위

- 구문

- 관로

- 계획

- 플라톤

- 플라톤 데이터 인텔리전스

- 플라토데이터

- 부디

- 폐렴

- 전철기

- 인기 문서

- 가능한

- 게시하다

- 가능성

- 힘

- powered

- 강한

- 사례

- 정밀하게

- Precision

- 선호하는

- 제시

- 이전에

- 주로

- 인쇄

- 인쇄물

- 문제

- 문제

- 방법

- 처리됨

- 처리

- 생산

- 약속

- 적절한

- 제공

- 제공

- 공급자

- 제공

- Python

- 질문 게시판

- 품질

- 문제

- 빠른

- 빨리

- 살갗이 벗어 진

- 읽기

- 인식

- 감소

- 참조

- 참고

- 참조

- 관계

- 관련된

- 의지하다

- 의지

- 주목할 만한

- 신고

- 대표

- 대표

- 필수

- 필요

- 각기

- 응답

- 제한

- 결과

- 결과

- 결과

- 소매

- 유지

- 유지

- 반품

- 풍부한

- 방

- 규칙

- 달리기

- 실행

- s

- 안전하게

- 같은

- 라고

- 규모

- 시나리오

- 예약

- 검색

- 둘째

- 섹션

- 섹션

- 부문

- 참조

- 세그먼트

- 선택된

- 연장자

- 문장

- 연속

- 서브

- 봉사하다

- 서비스

- 서비스

- 세트

- 심한

- 그녀

- 짧은

- 영상을

- 표시

- 쇼

- 상당한

- 단일

- 작은

- 작은

- 단편

- So

- 혼자서

- 솔루션

- 풀다

- 일부

- 출처

- 스페이스 버튼

- 언어

- 전문가

- 구체적인

- 구체적으로

- 지정

- 철자

- 분열

- 단계

- 표준화

- 스타트

- 시작

- 최첨단

- 성명서

- 단계

- 단계

- 아직도

- 저장

- 저장

- 상점

- 강점

- 끈

- 구조상의

- 구조

- 구조화

- 노력

- 후속의

- 그후

- 이러한

- 제안

- 요약

- 개요

- 공급

- 공급망

- SUPPORT

- 지원

- 시너지

- 시스템은

- 테이블

- 받아

- 소요

- 태스크

- 작업

- 팀

- 기술

- 기법

- 과학 기술자

- Technology

- 이 템플릿

- 조건

- 본문

- 텍스트

- 보다

- 그

- XNUMXD덴탈의

- 세계

- 그들의

- 그들

- 그때

- 그곳에.

- 따라서

- Bowman의

- 그들

- 이

- 생각

- 세

- 을 통하여

- 타이탄

- 에

- 오늘

- 오늘의

- 함께

- 토큰

- 토큰

- TONE

- 검색을

- 상단

- 금액

- 전통적인

- 후행

- 트레이닝

- 거래 내역

- 변환

- 변환

- 참된

- 시도

- 두

- 유형

- 유형

- 이해

- 이해

- 같지 않은

- 발표

- URL

- 사용

- 유스 케이스

- 익숙한

- 사용자

- 사용

- 사용

- 사용

- 활용

- v1

- 가치

- 마케팅은:

- 변수

- 여러

- 거대한

- 다양한

- 버전

- 를 통해

- 관측

- 볼륨

- 연습

- 필요

- 였다

- 방법..

- we

- 웹

- 웹 서비스

- 주

- 잘

- 뭐

- 언제

- 어느

- 동안

- 누구

- 의지

- 과

- 이내

- 없이

- 목격

- 워드

- 말

- 작업

- 워크플로우

- 워크 플로우

- 일하는

- 일

- 세계

- 겠지

- 쓴

- X

- 년

- 자신의

- 제퍼 넷