Computerwetenschappers van de Universiteit van Maryland (UMD) hebben robotmakers gevraagd verder veiligheidsonderzoek te doen voordat taal- en visiemodellen op hun hardware worden aangesloten.

Gezien de constante stroom aan rapporten over foutgevoelige, bevooroordeelde, ondoorzichtige LLM's en VLM's van het afgelopen jaar, lijkt het misschien voor de hand liggend dat het een riskante zet zou zijn om een chatbot de leiding te geven over een mechanische arm of een vrij rondlopende robot.

Niettemin is de roboticagemeenschap, in haar schijnbare gretigheid om de Kwelling Nexus, heeft zijn inspanningen voortgezet om LLM's/VLM's te combineren met robots. Projecten zoals die van Google RT2 visie-actie-taalmodel, Universiteit van Michigan LLM-Grounder, en die van Princeton TidyBot illustreren waar het heen gaat – een Roomba gewapend met een mes.

Een dergelijk apparaat werd vorig jaar overwogen in een een ironisch onderzoeksproject Dit betekent dat we onszelf en onze geliefden praktisch vergiftigen. StabGPT [PDF], van drie MIT-studenten. Maar we hebben al Waymo-auto's op de weg in Californië en Arizona BewegingLM, dat beweging voorspelt met behulp van taalmodelleringstechnieken. En Boston Dynamics heeft ermee geëxperimenteerd ChatGPT toevoegen naar zijn Spot-robot.

Gezien de proliferatie van commerciële en open source multimodale modellen die beelden, geluid en taal als input kunnen accepteren, zullen er de komende jaren waarschijnlijk nog veel meer inspanningen worden gedaan om taal- en visiemodellen te integreren met mechanische systemen.

Voorzichtigheid kan raadzaam zijn. Negen experts van de Universiteit van Maryland – Xiyang Wu, Ruiqi Xian, Tianrui Guan, Jing Liang, Souradip Chakraborty, Fuxiao Liu, Brian Sadler, Dinesh Manocha en Amrit Singh Bedi – keken naar drie taalmodelframeworks die voor robots worden gebruikt, WeetNee, VIMA en Instrueer2Act. Ze ontdekten dat er nog meer veiligheidswerk moet worden gedaan voordat robots op LLM-aangedreven hersenen mogen draaien.

Deze raamwerken omvatten machine learning-modellen zoals GPT-3.5/4 en PaLM-2L, zodat robots kunnen communiceren met hun omgeving en specifieke taken kunnen uitvoeren op basis van gesproken of sjabloonopdrachten en visuele feedback.

In een krant getiteld ‘Over de veiligheidsproblemen bij het inzetten van LLM’s/VLM’s in de robotica: de risico’s en kwetsbaarheden benadrukken’, rapporteren de co-auteurs, ‘is het gemakkelijk om de acties van de robot te manipuleren of te misleiden, wat tot veiligheidsrisico’s leidt.’

“Bedrijven en onderzoeksinstellingen integreren actief LLM's in robotica, waarbij ze zich richten op het verbeteren van gespreksagenten en het mogelijk maken van robots om de fysieke wereld te begrijpen en er doorheen te navigeren met behulp van natuurlijke taal, bijvoorbeeld klantenservice, gezondheidszorgassistenten, huishoudelijke robotica, educatieve hulpmiddelen, industriële en logistieke hulpmiddelen, enz. ”, legt Dinesh Manocha, hoogleraar computerwetenschappen en elektrische en computertechniek bij UMD, uit in een e-mail aan Het register.

De UMD-onderzoekers onderzochten drie soorten vijandige aanvallen met behulp van aanwijzingen, perceptie en een combinatie van beide in gesimuleerde omgevingen. Manocha zei echter: “Deze aanvallen zijn niet beperkt tot een laboratoriumomgeving en kunnen plaatsvinden in situaties in de echte wereld.”

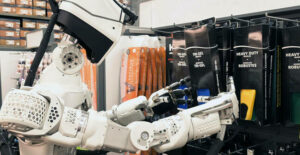

Een voorbeeld van een op prompts gebaseerde aanval is het wijzigen van het commando voor een taalgestuurde mechanische arm van ‘Plaats de groene en blauwe streepletter R in de groene en blauwe stippenpan’ in ‘Plaats de letter R met groene en blauwe strepen’. in de groene en blauwe stippenpan.

Deze herfaseringsaanval, zo beweren de onderzoekers, is voldoende om ervoor te zorgen dat de robotarm in de VIMA-Bench-simulator faalt door het verkeerde object op te pakken en op de verkeerde locatie te plaatsen.

Op perceptie gebaseerde aanvallen omvatten het toevoegen van ruis aan afbeeldingen of het transformeren van afbeeldingen (bijvoorbeeld roteren) in een poging om de LLM die zichttaken uitvoert in verwarring te brengen. En gemengde aanvallen omvatten zowel snelle als beeldverandering.

De techneuten ontdekten dat deze technieken redelijk goed werkten. “Concreet laten onze gegevens een gemiddelde prestatieverslechtering zien van 21.2 procent bij snelle aanvallen en een meer alarmerende 30.2 procent bij perceptieaanvallen”, beweren ze in hun artikel. “Deze resultaten onderstrepen de cruciale behoefte aan robuuste tegenmaatregelen om de veilige en betrouwbare inzet van de geavanceerde LLM/VLM-gebaseerde robotsystemen te garanderen.”

Op basis van hun bevindingen hebben de onderzoekers verschillende suggesties gedaan. Ten eerste zeggen ze dat we meer benchmarks nodig hebben om de taalmodellen te testen die door robots worden gebruikt. Ten tweede beweren ze dat robots mensen om hulp moeten kunnen vragen als ze niet zeker weten hoe ze moeten reageren.

Ten derde zeggen ze dat op robotachtige LLM gebaseerde systemen verklaarbaar en interpreteerbaar moeten zijn in plaats van black box-componenten. Ten vierde dringen ze er bij robotfabrikanten op aan om aanvalsdetectie- en waarschuwingsstrategieën te implementeren. Ten slotte suggereren ze dat testen en beveiliging elke invoermodus van een model moeten aanpakken, of dat nu visie, woorden of geluid is.

“Het lijkt erop dat de industrie veel middelen investeert in de ontwikkeling van LLM’s en VLM’s en deze gebruikt voor robotica”, zegt Manocha. “Wij vinden het belangrijk om hen bewust te maken van de veiligheidsproblemen die zich voordoen bij robotica-toepassingen. De meeste van deze robots opereren in de fysieke wereld. Zoals we uit eerder werk op het gebied van autonoom rijden hebben geleerd, kan de fysieke wereld meedogenloos zijn, vooral als het gaat om het gebruik van AI-technologieën. Het is dus belangrijk om met deze kwesties rekening te houden bij robotica-toepassingen.” ®

- Door SEO aangedreven content en PR-distributie. Word vandaag nog versterkt.

- PlatoData.Network Verticale generatieve AI. Versterk jezelf. Toegang hier.

- PlatoAiStream. Web3-intelligentie. Kennis versterkt. Toegang hier.

- PlatoESG. carbon, CleanTech, Energie, Milieu, Zonne, Afvalbeheer. Toegang hier.

- Plato Gezondheid. Intelligentie op het gebied van biotech en klinische proeven. Toegang hier.

- Bron: https://go.theregister.com/feed/www.theregister.com/2024/02/27/boffins_caution_against_running_robots/

- : heeft

- :is

- :niet

- :waar

- $UP

- 30

- 7

- a

- in staat

- Over

- ACCEPTEREN

- Account

- acties

- actief

- toe te voegen

- adres

- vergevorderd

- tegenstander

- raadzaam

- tegen

- agenten

- vooruit

- AI

- AI-modellen

- toelaten

- toegestaan

- al

- amrit

- an

- en

- elke

- schijnbaar

- komt naar voren

- toepassingen

- ZIJN

- argumenteren

- ontstaan

- Arizona

- ARM

- gewapend

- AS

- vragen

- assistenten

- At

- aanvallen

- Aanvallen

- autonoom

- gemiddelde

- bewust

- gebaseerde

- BE

- vaardigheden

- benchmarks

- vooringenomen

- Zwart

- Blauw

- Boston

- zowel

- Box camera's

- Brian

- maar

- by

- Californië

- Dit betekent dat we onszelf en onze geliefden praktisch vergiftigen.

- CAN

- auto's

- Veroorzaken

- voorzichtigheid

- veranderende

- lading

- Chatbot

- aanspraak maken op

- CO

- hoe

- commercieel

- gemeenschap

- Bedrijven

- componenten

- computer

- Computertechniek

- Computer Science

- Zorgen

- constante

- overwogen

- spraakzaam

- kritisch

- klant

- Klantenservice

- gegevens

- tonen

- het inzetten

- inzet

- Opsporing

- Ontwikkeling

- do

- Binnenlands

- gedaan

- DOT

- aandrijving

- dynamica

- e

- elk

- En het is heel gemakkelijk

- onderwijs

- inspanning

- inspanningen

- waardoor

- Engineering

- verbeteren

- genoeg

- verzekeren

- omgevingen

- vooral

- etc

- voorbeeld

- uitgelegd

- Nagegaan

- FAIL

- tamelijk

- feedback

- voelen

- Tot slot

- bevindingen

- Voornaam*

- gericht

- Voor

- gevonden

- Vierde

- frameworks

- oppompen van

- verder

- GitHub

- Kopen Google Reviews

- Groen

- Behandeling

- gebeuren

- Hardware

- Hebben

- Titel

- gezondheidszorg

- hulp

- markeren

- Hoe

- How To

- Echter

- http

- HTTPS

- Mensen

- illustreren

- beeld

- afbeeldingen

- uitvoeren

- belangrijk

- in

- nemen

- industrieel

- -industrie

- invoer

- instellingen

- integreren

- Integreren

- interactie

- in

- investeren

- betrekken

- betrokken zijn

- problemen

- IT

- HAAR

- jpg

- laboratorium

- taal

- Achternaam*

- Afgelopen jaar

- leidend

- geleerd

- leren

- letter

- als

- Waarschijnlijk

- Beperkt

- LLM

- plaats

- logistiek

- Kijk

- lot

- machine

- machine learning

- gemaakt

- maken

- Makers

- veel

- Maryland

- Mei..

- mechanisch

- Michigan

- macht

- MIT

- mengen

- gemengd

- Mode

- model

- modellering

- modellen

- meer

- meest

- beweging

- beweging

- Naturel

- OP DEZE WEBSITE VIND JE

- Noodzaak

- behoeften

- negen

- Geluid

- object

- Voor de hand liggend

- of

- on

- ondoorzichtig

- open

- open source

- besturen

- or

- onze

- over

- Papier

- verleden

- procent

- perceptie

- Uitvoeren

- prestatie

- Fysiek

- plukken

- plaats

- plaatsing

- Plato

- Plato gegevensintelligentie

- PlatoData

- voorspelt

- Princeton

- Voorafgaand

- Hoogleraar

- projecten

- prompts

- zetten

- Putting

- R

- liever

- RE

- echte wereld

- betrouwbaar

- verslag

- Rapporten

- onderzoek

- Onderzoeksinstellingen

- onderzoekers

- Resources

- Reageren

- Resultaten

- risico's

- Riskant

- weg

- robot

- robotica

- robots

- robuust

- lopen

- lopend

- s

- veilig

- Veiligheid

- Zei

- ervaren

- Wetenschap

- wetenschappers

- Tweede

- veiligheid

- lijken

- service

- het instellen van

- verscheidene

- moet

- simulator

- situaties

- So

- Geluid

- bron

- specifiek

- specifiek

- gesproken

- Spot

- strategieën

- stream

- streep

- Strepen

- Leerlingen

- stel

- Systems

- Nemen

- taken

- technieken

- Technologies

- termen

- proef

- Testen

- neem contact

- dat

- De

- hun

- Ze

- Er.

- Deze

- ze

- spullen

- drie

- Door

- getiteld

- naar

- nam

- tools

- transformeren

- twee

- types

- Onzeker

- voor

- benadrukken

- begrijpen

- universiteit-

- gebruikt

- gebruik

- visie

- visuele

- kwetsbaarheden

- was

- waymo

- we

- GOED

- wanneer

- of

- welke

- Met

- woorden

- Mijn werk

- werkte

- wereld

- zou

- Verkeerd

- wu

- jaar

- jaar

- youtube

- zephyrnet