In 2021 de De farmaceutische industrie genereerde $550 miljard aan Amerikaanse inkomsten. Farmaceutische bedrijven verkopen een verscheidenheid aan verschillende, vaak nieuwe, medicijnen op de markt, waarbij soms onbedoelde maar ernstige bijwerkingen kunnen optreden.

Deze gebeurtenissen kunnen overal worden gemeld, vanuit ziekenhuizen of thuis, en moeten op verantwoorde en efficiënte wijze worden gemonitord. De traditionele handmatige verwerking van bijwerkingen wordt lastig gemaakt door de toenemende hoeveelheid gezondheidsgegevens en kosten. In totaal wordt tegen 384 verwacht dat de kosten van geneesmiddelenbewakingsactiviteiten voor de gehele gezondheidszorgsector 2022 miljard dollar zullen kosten. Ter ondersteuning van de overkoepelende geneesmiddelenbewakingsactiviteiten willen onze farmaceutische klanten de kracht van machine learning (ML) gebruiken om de detectie van bijwerkingen uit verschillende gegevensbronnen te automatiseren. , zoals feeds op sociale media, telefoontjes, e-mails en handgeschreven notities, en leiden tot passende acties.

In dit bericht laten we zien hoe u een ML-gestuurde oplossing kunt ontwikkelen met behulp van Amazon Sage Maker voor het detecteren van bijwerkingen met behulp van de openbaar beschikbare gegevensset over bijwerkingen van knuffels op Hugging Face. In deze oplossing verfijnen we een verscheidenheid aan modellen op Hugging Face die vooraf zijn getraind op medische gegevens en gebruiken we het BioBERT-model, dat vooraf is getraind op de Pubmed-gegevensset en presteert het beste van degenen die het hebben geprobeerd.

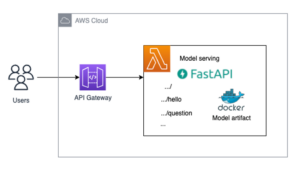

We hebben de oplossing geïmplementeerd met behulp van de AWS Cloud-ontwikkelingskit (AWSCDK). We bespreken echter niet de details van het bouwen van de oplossing in dit bericht. Voor meer informatie over de implementatie van deze oplossing, zie Bouw een systeem om ongunstige gebeurtenissen in realtime op te vangen met behulp van Amazon SageMaker en Amazon QuickSight.

Dit bericht gaat dieper in op verschillende belangrijke gebieden en biedt een uitgebreide verkenning van de volgende onderwerpen:

- De data-uitdagingen waarmee AWS Professional Services wordt geconfronteerd

- Het landschap en de toepassing van grote taalmodellen (LLM's):

- Transformers, BERT en GPT

- Gezicht knuffelen

- De verfijnde LLM-oplossing en zijn componenten:

- Data voorbereiding

- Modeltraining

Data uitdaging

Het scheeftrekken van gegevens is vaak een probleem bij het bedenken van classificatietaken. Idealiter zou je een gebalanceerde dataset willen hebben, en deze use case vormt daarop geen uitzondering.

We pakken deze scheefheid aan met generatieve AI modellen (Falcon-7B en Falcon-40B), die werden gevraagd om gebeurtenisvoorbeelden te genereren op basis van vijf voorbeelden uit de trainingsset om de semantische diversiteit te vergroten en de steekproefomvang van gelabelde bijwerkingen te vergroten. Het is voordelig voor ons om de Falcon-modellen hier te gebruiken, omdat Falcon, in tegenstelling tot sommige LLM's op Hugging Face, u de trainingsdataset geeft die ze gebruiken, zodat u er zeker van kunt zijn dat geen van uw testsetvoorbeelden in de Falcon-trainingsset voorkomt en gegevens vermijdt besmetting.

De andere data-uitdaging voor klanten in de gezondheidszorg zijn de HIPAA-compliancevereisten. Encryptie in rust en onderweg moet in de oplossing worden opgenomen om aan deze vereisten te voldoen.

Transformers, BERT en GPT

De transformatorarchitectuur is een neurale netwerkarchitectuur die wordt gebruikt voor taken op het gebied van natuurlijke taalverwerking (NLP). Het werd voor het eerst geïntroduceerd in de krant “Aandacht is alles wat je nodig hebt” door Vaswani et al. (2017). De transformatorarchitectuur is gebaseerd op het aandachtsmechanisme, waardoor het model langeafstandsafhankelijkheden tussen woorden kan leren. Transformatoren bestaan, zoals uiteengezet in het originele artikel, uit twee hoofdcomponenten: de encoder en de decoder. De encoder neemt de invoerreeks als invoer en produceert een reeks verborgen toestanden. De decoder neemt vervolgens deze verborgen toestanden als invoer en produceert de uitvoerreeks. Het attentiemechanisme wordt zowel in de encoder als in de decoder gebruikt. Dankzij het aandachtsmechanisme kan het model aandacht besteden aan specifieke woorden in de invoerreeks bij het genereren van de uitvoerreeks. Hierdoor kan het model langeafstandsafhankelijkheden tussen woorden leren, wat essentieel is voor veel NLP-taken, zoals automatische vertaling en tekstsamenvatting.

Een van de meer populaire en bruikbare transformatorarchitecturen, Bidirectionele Encoder Representations from Transformers (BERT), is een taalrepresentatiemodel dat geïntroduceerd in 2018. BERT is getraind in reeksen waarin sommige woorden in een zin zijn gemaskeerd, en het moet die woorden invullen, rekening houdend met zowel de woorden vóór als na de gemaskeerde woorden. BERT kan worden verfijnd voor een verscheidenheid aan NLP-taken, waaronder het beantwoorden van vragen, gevolgtrekkingen uit natuurlijke taal en sentimentanalyse.

De andere populaire transformatorarchitectuur die de wereld stormenderhand heeft veroverd, is Genative Pre-trained Transformer (GPT). Het eerste GPT-model was geïntroduceerd in 2018 door OpenAI. Het werkt doordat u getraind bent om het volgende woord in een reeks strikt te voorspellen, waarbij u zich alleen bewust bent van de context vóór het woord. GPT-modellen zijn getraind op een enorme dataset van tekst en code, en kunnen worden verfijnd voor een reeks NLP-taken, waaronder het genereren van tekst, het beantwoorden van vragen en het samenvatten ervan.

Over het algemeen is BERT beter in taken die een dieper begrip van de context van woorden vereisen GPT is beter geschikt voor taken waarbij tekst moet worden gegenereerd.

Gezicht knuffelen

Hugging Face is een kunstmatige-intelligentiebedrijf dat gespecialiseerd is in NLP. Het biedt een platform met tools en bronnen waarmee ontwikkelaars ML-modellen kunnen bouwen, trainen en implementeren die gericht zijn op NLP-taken. Een van de belangrijkste aanbiedingen van Hugging Face is de bibliotheek, transformers, dat vooraf getrainde modellen bevat die kunnen worden verfijnd voor verschillende taaltaken, zoals tekstclassificatie, vertaling, samenvatting en het beantwoorden van vragen.

Hugging Face kan naadloos worden geïntegreerd met SageMaker, een volledig beheerde service waarmee ontwikkelaars en datawetenschappers ML-modellen op schaal kunnen bouwen, trainen en implementeren. Deze synergie komt ten goede aan gebruikers door het bieden van een robuuste en schaalbare infrastructuur om NLP-taken uit te voeren met de ultramoderne modellen die Hugging Face biedt, gecombineerd met de krachtige en flexibele ML-diensten van AWS. U kunt ook rechtstreeks toegang krijgen tot Hugging Face-modellen Amazon SageMaker JumpStart, waardoor het handig is om te beginnen met kant-en-klare oplossingen.

Overzicht oplossingen

We hebben de Hugging Face Transformers-bibliotheek gebruikt om transformatormodellen op SageMaker te verfijnen voor de taak van classificatie van bijwerkingen. De trainingstaak wordt gebouwd met behulp van de SageMaker PyTorch-schatter. SageMaker JumpStart heeft ook enkele aanvullende integraties met Hugging Face, waardoor de implementatie eenvoudig is. In deze sectie beschrijven we de belangrijkste stappen die betrokken zijn bij gegevensvoorbereiding en modeltraining.

Data voorbereiding

We gebruikten de gegevens over bijwerkingen van geneesmiddelen (ade_corpus_v2) binnen de Hugging Face-gegevensset met een 80/20 training/test-verdeling. De vereiste gegevensstructuur voor onze modeltraining en gevolgtrekking heeft twee kolommen:

- Eén kolom voor tekstinhoud als modelinvoergegevens.

- Nog een kolom voor de labelklasse. We hebben twee mogelijke klassen voor een tekst:

Not_AEenAdverse_Event.

Modeltraining en experimenten

Om efficiënt de ruimte van mogelijke Hugging Face-modellen te verkennen om onze gecombineerde gegevens over bijwerkingen te verfijnen, hebben we een SageMaker hyperparameteroptimalisatie (HPO)-taak geconstrueerd en verschillende Hugging Face-modellen doorgegeven als een hyperparameter, samen met andere belangrijke hyperparameters zoals de batchgrootte van de training, de lengte van de reeks, modellen en leersnelheid. De trainingstaken maakten gebruik van een ml.p3dn.24xlarge-instantie en namen met dat instantietype gemiddeld 30 minuten per taak in beslag. Trainingsstatistieken werden vastgelegd via de Amazon SageMaker-experimenten tool, en elke trainingstaak doorliep 10 tijdperken.

We specificeren het volgende in onze code:

- Grootte van trainingsbatch – Aantal monsters dat samen wordt verwerkt voordat de modelgewichten worden bijgewerkt

- Sequentielengte: – Maximale lengte van de invoerreeks die BERT kan verwerken

- Leren tarief – Hoe snel het model zijn gewichten bijwerkt tijdens de training

- Modellen – Hugging Face voorgetrainde modellen

Resultaten

Het model dat het beste presteerde in onze use case was de monologg/biobert_v1.1_pubmed model gehost op Hugging Face, een versie van de BERT-architectuur die vooraf is getraind op de Pubmed-dataset, die uit 19,717 wetenschappelijke publicaties bestaat. Het vooraf trainen van BERT op deze dataset geeft dit model extra expertise als het gaat om het identificeren van context rond medisch gerelateerde wetenschappelijke termen. Dit verbetert de prestaties van het model voor de detectietaak van ongewenste voorvallen, omdat het vooraf is getraind in medisch specifieke syntaxis die vaak in onze dataset voorkomt.

De volgende tabel vat onze evaluatiestatistieken samen.

| Model | precisie | Terugroepen | F1 |

| Basis BERT | 0.87 | 0.95 | 0.91 |

| BioBert | 0.89 | 0.95 | 0.92 |

| BioBERT met HPO | 0.89 | 0.96 | 0.929 |

| BioBERT met HPO en synthetisch gegenereerde bijwerkingen | 0.90 | 0.96 | 0.933 |

Hoewel dit relatief kleine en stapsgewijze verbeteringen zijn ten opzichte van het basis-BERT-model, demonstreert dit niettemin enkele haalbare strategieën om de modelprestaties via deze methoden te verbeteren. Het genereren van synthetische gegevens met Falcon lijkt veel belofte en potentieel voor prestatieverbeteringen te bieden, vooral omdat deze generatieve AI-modellen in de loop van de tijd beter worden.

Opruimen

Om toekomstige kosten te voorkomen, verwijdert u alle bronnen die zijn gemaakt zoals het model en de modeleindpunten die u met de volgende code hebt gemaakt:

Conclusie

Veel farmaceutische bedrijven willen tegenwoordig het proces van het identificeren van bijwerkingen uit hun klantinteracties op een systematische manier automatiseren om de klantveiligheid en -resultaten te helpen verbeteren. Zoals we in dit bericht hebben laten zien, classificeert de verfijnde LLM BioBERT met synthetisch gegenereerde bijwerkingen toegevoegd aan de gegevens de bijwerkingen met hoge F1-scores en kan deze worden gebruikt om een HIPAA-conforme oplossing voor onze klanten te bouwen.

Zoals altijd verwelkomt AWS uw feedback. Laat uw mening en vragen achter in het opmerkingengedeelte.

Over de auteurs

Zack Peterson is een datawetenschapper bij AWS Professional Services. Hij levert al vele jaren machine learning-oplossingen aan klanten en heeft een masterdiploma in economie.

Zack Peterson is een datawetenschapper bij AWS Professional Services. Hij levert al vele jaren machine learning-oplossingen aan klanten en heeft een masterdiploma in economie.

Dr. Adewale Akinfaderin is een senior datawetenschapper in de gezondheidszorg en levenswetenschappen bij AWS. Zijn expertise ligt op het gebied van reproduceerbare en end-to-end AI/ML-methoden, praktische implementaties en het helpen van wereldwijde zorgklanten bij het formuleren en ontwikkelen van schaalbare oplossingen voor interdisciplinaire problemen. Hij heeft twee diploma's in natuurkunde en een doctoraat in techniek.

Dr. Adewale Akinfaderin is een senior datawetenschapper in de gezondheidszorg en levenswetenschappen bij AWS. Zijn expertise ligt op het gebied van reproduceerbare en end-to-end AI/ML-methoden, praktische implementaties en het helpen van wereldwijde zorgklanten bij het formuleren en ontwikkelen van schaalbare oplossingen voor interdisciplinaire problemen. Hij heeft twee diploma's in natuurkunde en een doctoraat in techniek.

Ekta Walia Bhullar, PhD, is een senior AI/ML-consultant bij de businessunit AWS Healthcare and Life Sciences (HCLS) Professional Services. Ze heeft ruime ervaring met de toepassing van AI/ML binnen het gezondheidszorgdomein, vooral in de radiologie. Buiten haar werk, als ze het niet over AI in de radiologie heeft, houdt ze van hardlopen en wandelen.

Ekta Walia Bhullar, PhD, is een senior AI/ML-consultant bij de businessunit AWS Healthcare and Life Sciences (HCLS) Professional Services. Ze heeft ruime ervaring met de toepassing van AI/ML binnen het gezondheidszorgdomein, vooral in de radiologie. Buiten haar werk, als ze het niet over AI in de radiologie heeft, houdt ze van hardlopen en wandelen.

Han man is een Senior Data Science & Machine Learning Manager bij AWS Professional Services, gevestigd in San Diego, CA. Hij heeft een PhD in Engineering van de Northwestern University en heeft een aantal jaren ervaring als managementconsultant in het adviseren van klanten op het gebied van productie, financiële dienstverlening en energie. Tegenwoordig werkt hij gepassioneerd samen met belangrijke klanten uit verschillende branches in de sector om ML- en generatieve AI-oplossingen op AWS te ontwikkelen en te implementeren.

Han man is een Senior Data Science & Machine Learning Manager bij AWS Professional Services, gevestigd in San Diego, CA. Hij heeft een PhD in Engineering van de Northwestern University en heeft een aantal jaren ervaring als managementconsultant in het adviseren van klanten op het gebied van productie, financiële dienstverlening en energie. Tegenwoordig werkt hij gepassioneerd samen met belangrijke klanten uit verschillende branches in de sector om ML- en generatieve AI-oplossingen op AWS te ontwikkelen en te implementeren.

- Door SEO aangedreven content en PR-distributie. Word vandaag nog versterkt.

- PlatoData.Network Verticale generatieve AI. Versterk jezelf. Toegang hier.

- PlatoAiStream. Web3-intelligentie. Kennis versterkt. Toegang hier.

- PlatoESG. carbon, CleanTech, Energie, Milieu, Zonne, Afvalbeheer. Toegang hier.

- Plato Gezondheid. Intelligentie op het gebied van biotech en klinische proeven. Toegang hier.

- Bron: https://aws.amazon.com/blogs/machine-learning/deploy-large-language-models-for-a-healthtech-use-case-on-amazon-sagemaker/

- : heeft

- :is

- :niet

- :waar

- $UP

- 1

- 10

- 100

- 16

- 19

- 2017

- 2018

- 2021

- 2022

- 30

- 32

- 7

- a

- toegang

- Account

- ACM

- acties

- activiteiten

- toegevoegd

- adres

- voordelig

- nadelige

- adviseren

- Na

- AI

- AI-modellen

- AI / ML

- AL

- Alles

- toestaat

- langs

- ook

- altijd

- Amazone

- Amazon Sage Maker

- Amazon Web Services

- bedragen

- an

- analyse

- en

- beantwoorden

- elke

- overal

- Aanvraag

- passend

- architectuur

- architecturen

- ZIJN

- gebieden

- rond

- kunstmatig

- kunstmatige intelligentie

- AS

- At

- bijwonen

- aandacht

- automatiseren

- Beschikbaar

- gemiddelde

- vermijd

- bewust

- AWS

- AWS professionele services

- evenwichtige

- baseren

- gebaseerde

- BE

- omdat

- geweest

- vaardigheden

- wezen

- betekent

- BEST

- Betere

- tussen

- bidirectionele

- Miljard

- boosts

- zowel

- grenzen

- bouw

- Gebouw

- bebouwd

- bedrijfsdeskundigen

- maar

- by

- CA

- oproepen

- CAN

- gevangen

- geval

- uitdagen

- uitdagingen

- uitdagend

- lasten

- klasse

- klassen

- classificatie

- klanten

- Cloud

- code

- Kolom

- columns

- gecombineerde

- komt

- komst

- opmerkingen

- Bedrijven

- afstand

- complementair

- nakoming

- componenten

- uitgebreid

- bestaat uit

- gebouwd

- consultant

- bevatte

- content

- verband

- gemakkelijk

- Kosten

- Kosten

- deksel

- en je merk te creëren

- aangemaakt

- klant

- Klanten

- gegevens

- Data voorbereiding

- data science

- data scientist

- Gegevensstructuur

- diepere

- bepalen

- Mate

- het leveren van

- duikt

- demonstreert

- afhankelijkheden

- implementeren

- beschrijven

- Opsporing

- ontwikkelen

- ontwikkelaars

- Ontwikkeling

- Diego

- anders

- direct

- bespreken

- Verscheidenheid

- domein

- Dont

- drug

- Drugs

- gedurende

- E & T

- elk

- Economie

- efficiënt

- e-mails

- in staat stellen

- maakt

- encryptie

- eind tot eind

- energie-niveau

- Engineering

- tijdperken

- vooral

- essentieel

- evaluatie

- Event

- EVENTS

- voorbeelden

- uitzondering

- ervaring

- expertise

- exploratie

- Verken

- uitgebreid

- Uitgebreide ervaring

- extra

- f1

- Gezicht

- feedback

- vullen

- financieel

- financiële diensten

- Voornaam*

- vijf

- flexibel

- gericht

- volgend

- Voor

- oppompen van

- geheel

- toekomst

- Algemeen

- voortbrengen

- gegenereerde

- het genereren van

- generatie

- generatief

- generatieve AI

- krijgen

- geeft

- Globaal

- afstuderen

- handvat

- handen

- Hebben

- he

- Gezondheid

- gezondheidszorg

- gezondheidszorg

- Gezondheidstechnologie

- hulp

- het helpen van

- hier

- verborgen

- Hoge

- Wandeling

- zijn

- houden

- Home

- ziekenhuizen

- gehost

- Hoe

- How To

- Echter

- HTTPS

- Optimalisatie van hyperparameters

- ideaal

- het identificeren van

- uitvoeren

- uitvoering

- implementaties

- geïmplementeerd

- importeren

- belangrijk

- verbeteren

- verbeteringen

- in

- omvat

- Inclusief

- Incorporated

- Laat uw omzet

- meer

- incrementele

- -industrie

- informatie

- Infrastructuur

- invoer

- instantie

- integreert

- integraties

- Intelligentie

- interacties

- in

- geïntroduceerd

- betrokken zijn

- IT

- HAAR

- Jobomschrijving:

- Vacatures

- jpg

- sleutel

- Sleutelgebieden

- label

- laid

- Landschap

- taal

- Groot

- LEARN

- leren

- Verlof

- Lengte

- Bibliotheek

- Life

- Bio

- als

- sympathieën

- LLM

- lot

- machine

- machine learning

- gemaakt

- Hoofd

- groot

- MERKEN

- maken

- man

- beheerd

- management

- manager

- handboek

- productie

- veel

- Markt

- massief

- master's

- Maximaliseren

- maximaal

- mechanisme

- Media

- medisch

- medische gegevens

- Maak kennis met

- methoden

- Metriek

- minuten

- ML

- model

- modellen

- bewaakt

- meer

- Dan moet je

- naam

- Naturel

- Natural Language Processing

- netwerk

- neurale

- neuraal netwerk

- niettemin

- volgende

- nlp

- geen

- Geen

- Opmerkingen

- roman

- aantal

- zich voordoen

- of

- aanbod

- Aanbod

- vaak

- on

- EEN

- Slechts

- optimalisatie

- or

- bestellen

- origineel

- Overige

- onze

- uit

- resultaten

- uitgang

- buiten

- over

- totaal

- overkoepelende

- Papier

- voorbij

- voor

- prestatie

- uitgevoerd

- presteert

- Farmaceutisch

- phd

- phone

- telefoongesprekken

- Fysica

- platform

- Plato

- Plato gegevensintelligentie

- PlatoData

- dan

- Populair

- mogelijk

- Post

- potentieel

- energie

- krachtige

- PRAKTISCH

- voorspellen

- voorbereiding

- probleem

- problemen

- Verwerkt

- verwerking

- produceert

- professioneel

- geprojecteerde

- belofte

- biedt

- het verstrekken van

- publicaties

- in het openbaar

- pytorch

- vraag

- Contact

- snel

- reeks

- tarief

- reactie

- real-time

- verwijzen

- regex

- verwant

- relatief

- gemeld

- vertegenwoordiging

- vereisen

- nodig

- Voorwaarden

- Resources

- verantwoorde

- REST

- robuust

- lopen

- Veiligheid

- sagemaker

- monster

- heilige

- San Diego

- schaalbare

- Scale

- Wetenschap

- WETENSCHAPPEN

- wetenschappelijk

- Wetenschapper

- wetenschappers

- naadloos

- sectie

- lijkt

- verkopen

- semantisch

- senior

- zin

- sentiment

- Volgorde

- ernstig

- service

- Diensten

- reeks

- verscheidene

- ze

- tonen

- vertoonde

- Shows

- Maat

- scheef

- Klein

- So

- Social

- social media

- oplossing

- Oplossingen

- sommige

- soms

- bronnen

- Tussenruimte

- specialiseert

- specifiek

- bijzonderheden

- spleet

- begin

- state-of-the-art

- Staten

- Stappen

- Storm

- eenvoudig

- strategieën

- structuur

- dergelijk

- ondersteuning

- zeker

- synergie

- syntaxis

- synthetisch

- synthetische gegevens

- synthetisch

- system

- tafel

- ingenomen

- neemt

- het nemen

- Taak

- taken

- termen

- proef

- tekst

- Tekstclassificatie

- dat

- De

- de wereld

- hun

- harte

- Deze

- ze

- dit

- die

- toch?

- Door

- niet de tijd of

- naar

- vandaag

- samen

- nam

- tools

- tools

- onderwerpen

- traditioneel

- Trainen

- getraind

- Trainingen

- transformator

- transformers

- doorvoer

- Vertaling

- probeerden

- leiden

- twee

- type dan:

- begrip

- eenheid

- universiteit-

- anders

- updates

- us

- .

- use case

- gebruikt

- nuttig

- gebruikers

- gebruik

- variëteit

- divers

- versie

- verticals

- rendabel

- willen

- was

- Manier..

- we

- web

- webservices

- Welkom

- waren

- wanneer

- terwijl

- welke

- Met

- binnen

- Woord

- woorden

- Mijn werk

- werkzaam

- Bedrijven

- wereld

- zou

- jaar

- You

- Your

- zephyrnet