Moderne chatbots kunnen dienen als digitale agenten en bieden een nieuwe mogelijkheid voor het leveren van 24/7 klantenservice en ondersteuning in veel sectoren. Hun populariteit komt voort uit de mogelijkheid om in realtime op vragen van klanten te reageren en meerdere vragen tegelijkertijd in verschillende talen af te handelen. Chatbots bieden ook waardevolle datagestuurde inzichten in klantgedrag, terwijl ze moeiteloos kunnen worden geschaald naarmate het gebruikersbestand groeit; daarom bieden ze een kosteneffectieve oplossing om klanten te betrekken. Chatbots gebruiken de geavanceerde natuurlijke taalmogelijkheden van grote taalmodellen (LLM's) om te reageren op vragen van klanten. Ze kunnen gesprekstaal begrijpen en op een natuurlijke manier reageren. Chatbots die alleen maar basisvragen beantwoorden, hebben echter een beperkt nut. Om vertrouwde adviseurs te worden, moeten chatbots doordachte, op maat gemaakte antwoorden bieden.

Eén manier om meer contextuele gesprekken mogelijk te maken is door de chatbot te koppelen aan interne kennisbanken en informatiesystemen. Door bedrijfseigen bedrijfsgegevens uit interne kennisbanken te integreren, kunnen chatbots hun reacties op de individuele behoeften en interesses van elke gebruiker contextualiseren. Een chatbot kan bijvoorbeeld producten voorstellen die overeenkomen met de voorkeuren van een klant en eerdere aankopen, details uitleggen in een taal die is aangepast aan het expertiseniveau van de gebruiker, of accountondersteuning bieden door toegang te krijgen tot de specifieke gegevens van de klant. Dankzij de mogelijkheid om op intelligente wijze informatie op te nemen, natuurlijke taal te begrijpen en aangepaste antwoorden te geven in een conversatiestroom, kunnen chatbots echte bedrijfswaarde leveren in verschillende gebruiksscenario's.

Het populaire architectuurpatroon van Ophalen Augmented Generation (RAG) wordt vaak gebruikt om de context en antwoorden van gebruikersquery's te vergroten. RAG combineert de mogelijkheden van LLM's met de basis in feiten en praktijkkennis die voortkomt uit het ophalen van relevante teksten en passages uit het datacorpus. Deze opgehaalde teksten worden vervolgens gebruikt om de output te informeren en te onderbouwen, waardoor hallucinaties worden verminderd en de relevantie wordt verbeterd.

In dit bericht illustreren we het contextueel verbeteren van een chatbot door gebruik te maken van Kennisbanken voor Amazon Bedrock, een volledig beheerde serverloze service. Dankzij de Knowledge Bases voor Amazon Bedrock-integratie kan onze chatbot relevantere, gepersonaliseerde antwoorden bieden door gebruikersvragen te koppelen aan gerelateerde informatiedatapunten. Intern, Amazonebodem maakt gebruik van insluitingen die zijn opgeslagen in een vectordatabase om de context van gebruikersquery's tijdens runtime te vergroten en een beheerde RAG-architectuuroplossing mogelijk te maken. Wij gebruiken de Brieven van Amazon aan aandeelhouders dataset om deze oplossing te ontwikkelen.

Ophalen Augmented Generation

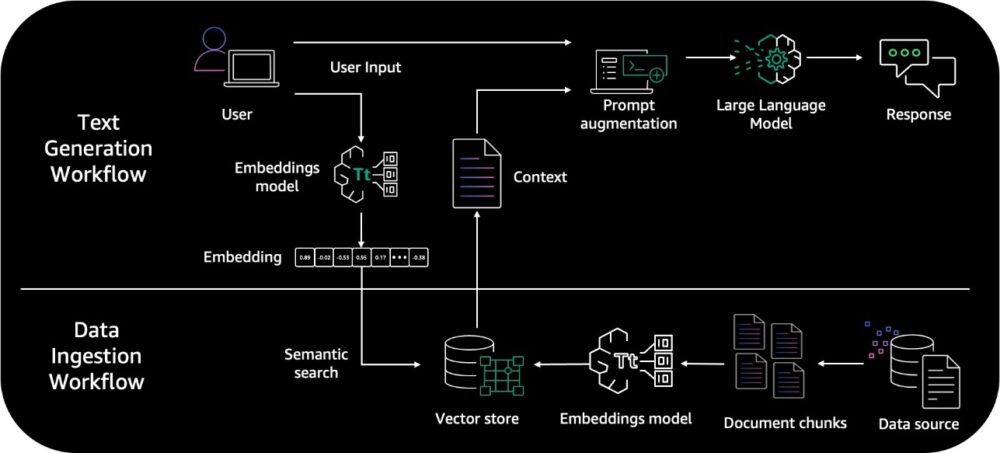

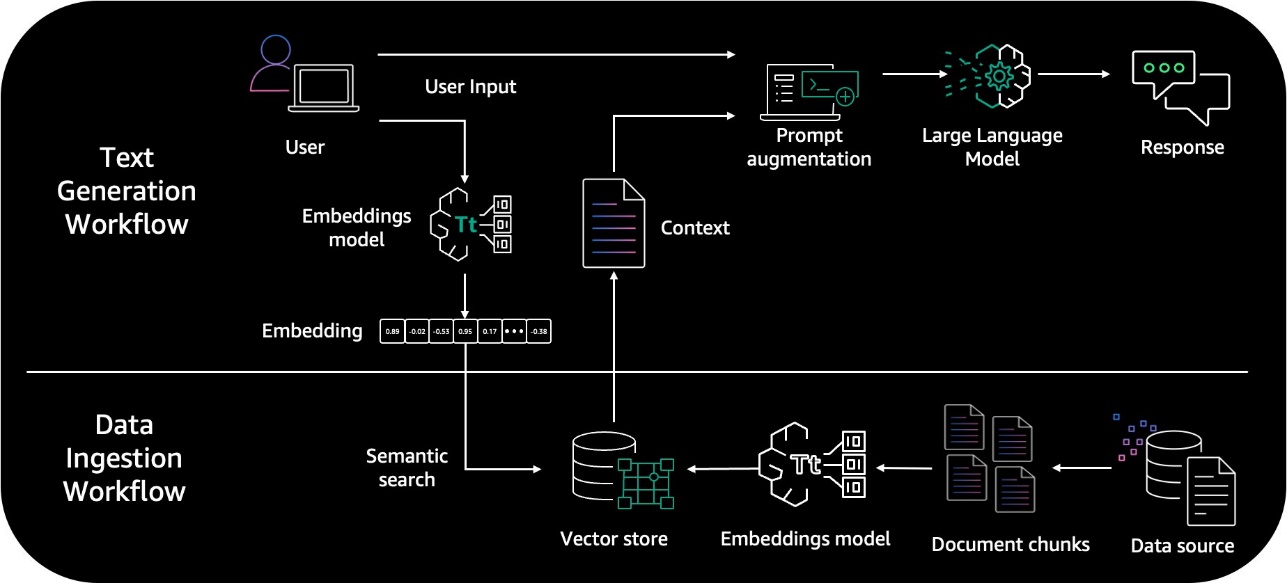

RAG is een benadering voor het genereren van natuurlijke taal waarbij het ophalen van informatie wordt geïntegreerd in het generatieproces. De RAG-architectuur omvat twee belangrijke workflows: gegevensvoorverwerking via opname, en tekstgeneratie met behulp van verbeterde context.

De workflow voor gegevensopname maakt gebruik van LLM's om inbeddingsvectoren te creëren die de semantische betekenis van teksten vertegenwoordigen. Er worden insluitingen gemaakt voor documenten en gebruikersvragen. De documentinsluitingen worden in delen opgesplitst en opgeslagen als indexen in een vectordatabase. De workflow voor het genereren van tekst neemt vervolgens de insluitvector van een vraag en gebruikt deze om de meest vergelijkbare documentfragmenten op te halen op basis van vectorovereenkomst. Het breidt aanwijzingen uit met deze relevante stukjes om een antwoord te genereren met behulp van de LLM. Voor meer details, zie de Inleiding over het ophalen van verbeterde generatie, insluitingen en vectordatabases sectie in Preview – Verbind Foundation-modellen met uw bedrijfsgegevensbronnen met Agents voor Amazon Bedrock.

Het volgende diagram illustreert de RAG-architectuur op hoog niveau.

Hoewel de RAG-architectuur veel voordelen heeft, omvat deze meerdere componenten, waaronder een database, een ophaalmechanisme, een prompt en een generatief model. Het beheren van deze onderling afhankelijke onderdelen kan voor complexiteit zorgen bij de systeemontwikkeling en -implementatie. De integratie van ophalen en genereren vereist ook extra technische inspanningen en computerbronnen. Sommige open source-bibliotheken bieden wrappers om deze overhead te verminderen; Wijzigingen in bibliotheken kunnen echter fouten introduceren en extra overhead van versiebeheer toevoegen. Zelfs met open source-bibliotheken zijn er aanzienlijke inspanningen nodig om code te schrijven, de optimale chunkgrootte te bepalen, insluitingen te genereren en meer. Alleen al dit installatiewerk kan weken duren, afhankelijk van het datavolume.

Daarom zou een beheerde oplossing die deze ongedifferentieerde taken afhandelt, het proces van het implementeren en beheren van RAG-applicaties kunnen stroomlijnen en versnellen.

Kennisbanken voor Amazon Bedrock

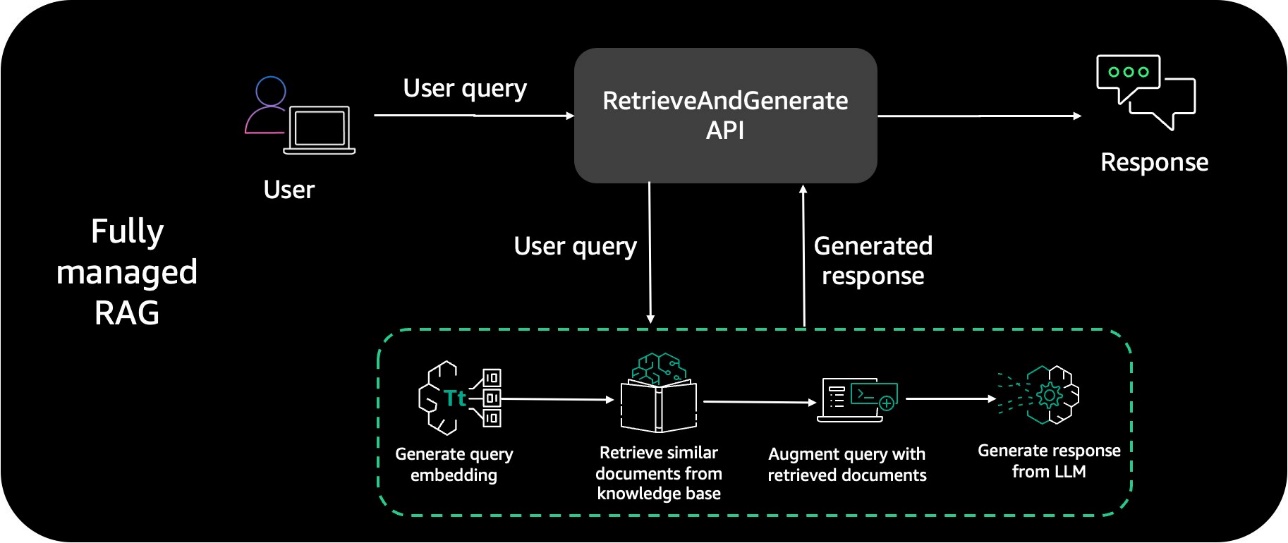

Knowledge Bases voor Amazon Bedrock is een serverloze optie om krachtige conversatie-AI-systemen te bouwen met behulp van RAG. Het biedt volledig beheerde workflows voor gegevensopname en tekstgeneratie.

Voor gegevensopname zorgt het automatisch voor het maken, opslaan, beheren en bijwerken van tekstinsluitingen van documentgegevens in de vectordatabase. Het verdeelt de documenten in beheersbare stukken, zodat u ze efficiënt kunt terugvinden. De chunks worden vervolgens geconverteerd naar inbedding en naar een vectorindex geschreven, terwijl u de brondocumenten kunt zien bij het beantwoorden van een vraag.

Voor het genereren van tekst biedt Amazon Bedrock de Ophalen en genereren API om inbedding van gebruikersquery's te creëren en relevante delen uit de vectordatabase op te halen om nauwkeurige antwoorden te genereren. Het ondersteunt ook brontoewijzing en kortetermijngeheugen dat nodig is voor RAG-toepassingen.

Hierdoor kunt u zich concentreren op uw kernactiviteiten en hoeft u zich geen zorgen meer te maken over het ongedifferentieerde zware werk.

Overzicht oplossingen

De oplossing die in dit bericht wordt gepresenteerd, maakt gebruik van een chatbot die is gemaakt met behulp van een Gestroomlijnd applicatie en omvat de volgende AWS-services:

Het volgende diagram is een veelvoorkomend oplossingsarchitectuurpatroon dat u kunt gebruiken om elke chatbottoepassing te integreren in Knowledge Bases voor Amazon Bedrock.

Deze architectuur omvat de volgende stappen:

- Een gebruiker communiceert met de Streamlit-chatbotinterface en verzendt een vraag in natuurlijke taal

- Dit activeert een Lambda-functie, die de kennisbanken aanroept

RetrieveAndGenerateAPI. Intern maakt Knowledge Bases gebruik van een Amazone Titan inbeddingsmodel en converteert de gebruikersquery naar een vector en vindt brokken die semantisch vergelijkbaar zijn met de gebruikersquery. De gebruikersprompt wordt dan aangevuld met de chunks die uit de kennisbank worden opgehaald. De prompt naast de aanvullende context wordt vervolgens naar een LLM gestuurd voor het genereren van antwoorden. In deze oplossing gebruiken we Antropische Claude Instant als onze LLM om gebruikersreacties te genereren met behulp van aanvullende context. Houd er rekening mee dat deze oplossing wordt ondersteund in regio's waar Anthropic Claude op Amazon Bedrock zich bevindt Beschikbaar. - Een contextueel relevant antwoord wordt teruggestuurd naar de chatbotapplicatie en gebruiker.

Voorwaarden

Amazon Bedrock-gebruikers moeten toegang tot funderingsmodellen aanvragen voordat ze beschikbaar zijn voor gebruik. Dit is een eenmalige actie en duurt minder dan een minuut. Voor deze oplossing moet je toegang inschakelen tot het Titan Embeddings G1 – Text en Claude Instant – v1.2-model in Amazon Bedrock. Voor meer informatie, zie Toegang tot modellen.

Kloon de GitHub-opslagplaats

De oplossing die in dit bericht wordt gepresenteerd, is als volgt beschikbaar GitHub repo. U moet de GitHub-repository naar uw lokale machine klonen. Open een terminalvenster en voer de volgende opdracht uit. Merk op dat dit één enkel git clone-commando is.

Upload uw kennisdataset naar Amazon S3

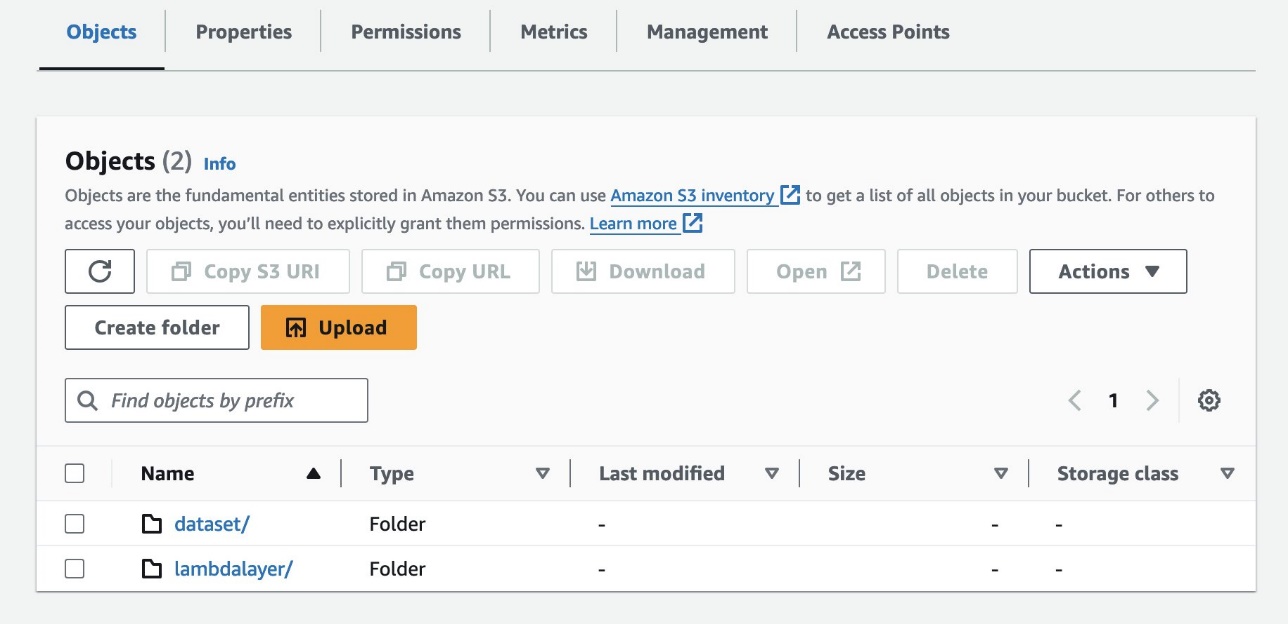

We downloaden de dataset voor onze kennisbank en uploaden deze naar een S3-bucket. Deze dataset zal de kennisbank voeden en versterken. Voer de volgende stappen uit:

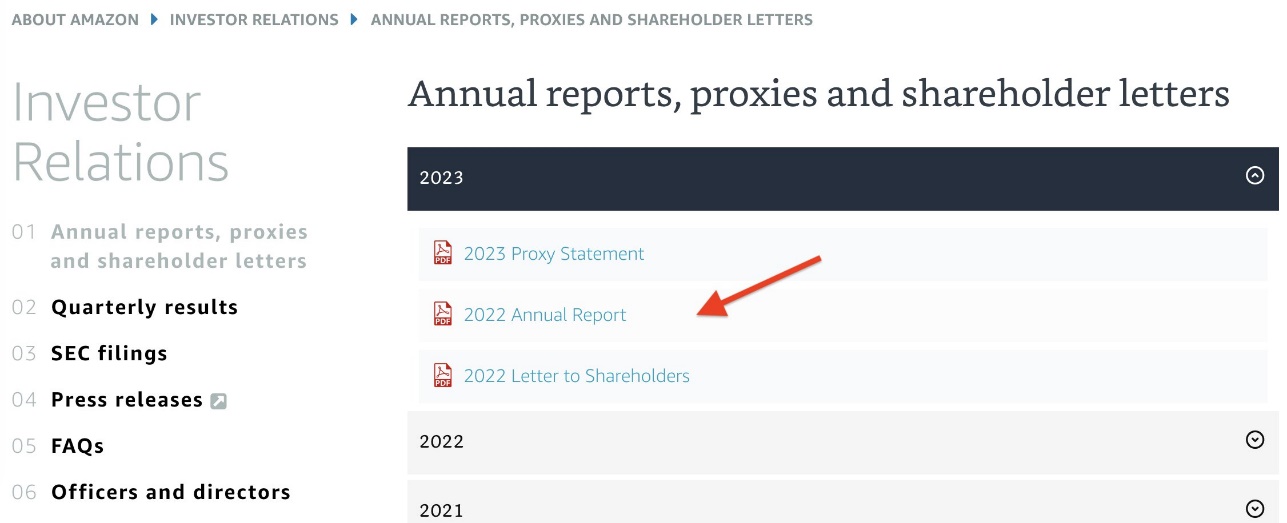

- Navigeer naar de Jaarverslagen, volmachten en aandeelhoudersbrieven gegevensopslagplaats en download de laatste paar jaar aandeelhoudersbrieven van Amazon.

- Kies op de Amazon S3-console Emmers in het navigatievenster.

- Kies Maak een bucket.

- Geef de emmer een naam

knowledgebase-<your-awsaccount-number>. - Laat alle overige bucketinstellingen op standaard staan en kies creëren.

- Navigeer naar de

knowledgebase-<your-awsaccount-number>emmer. - Kies Maak een map en noem deze dataset.

- Laat alle overige mapinstellingen op standaard staan en kies creëren.

- Navigeer terug naar het buckethuis en kies Maak een map om een nieuwe map te maken en deze een naam te geven

lambdalayer. - Laat alle andere instellingen als standaard en kies creëren.

- Navigeer naar de

datasetmap. - Upload de jaarverslagen, volmachten en gegevenssetbestanden van aandeelhouders die u eerder hebt gedownload naar deze bucket en kies Uploaden.

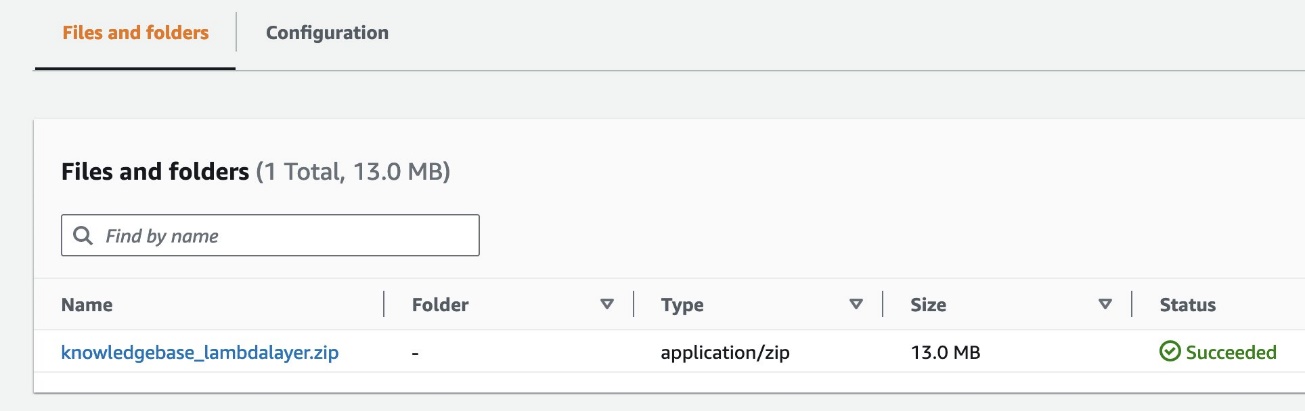

- Navigeer naar de

lambdalayermap. - Upload de

knowledgebase-lambdalayer.zipbestand beschikbaar onder de/lambda/layermap in de GitHub-repository die u eerder hebt gekloond en kies Uploaden. U zult deze Lambda-laagcode later gebruiken om de Lambda-functie te maken.

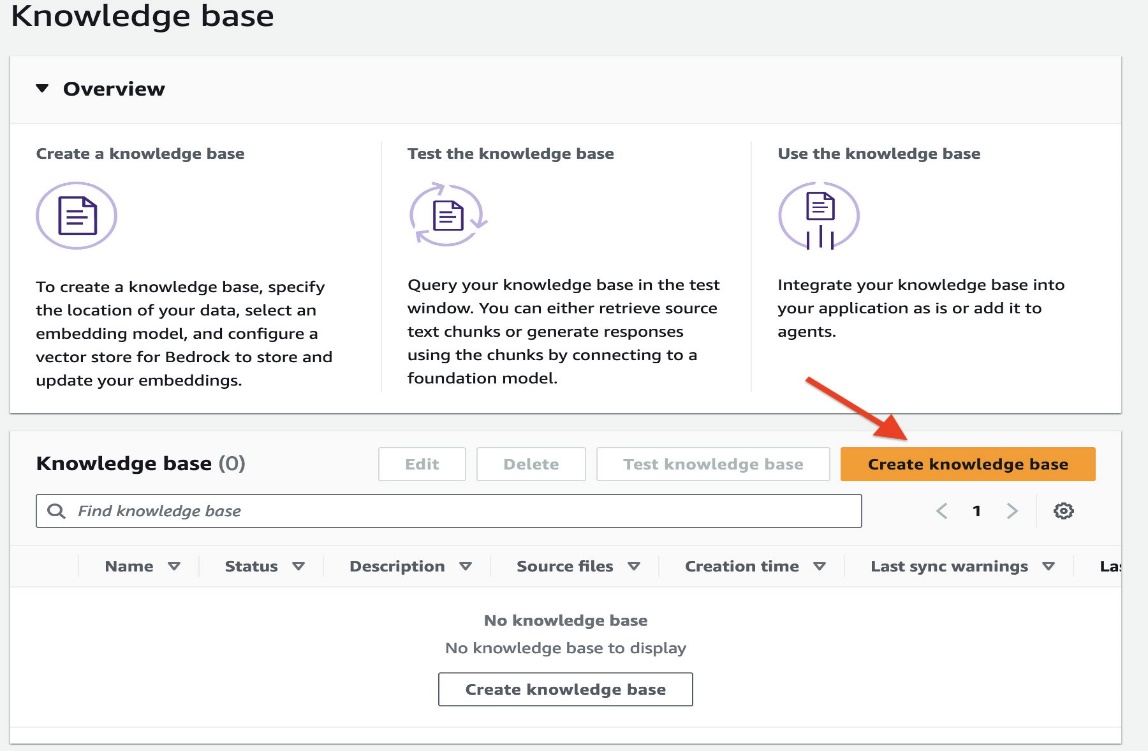

Creëer een kennisbank

In deze stap creëren we een kennisbank met behulp van de Amazon-gegevensset voor aandeelhoudersbrieven die we in de vorige stap naar onze S3-bucket hebben geüpload.

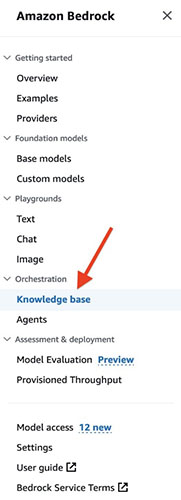

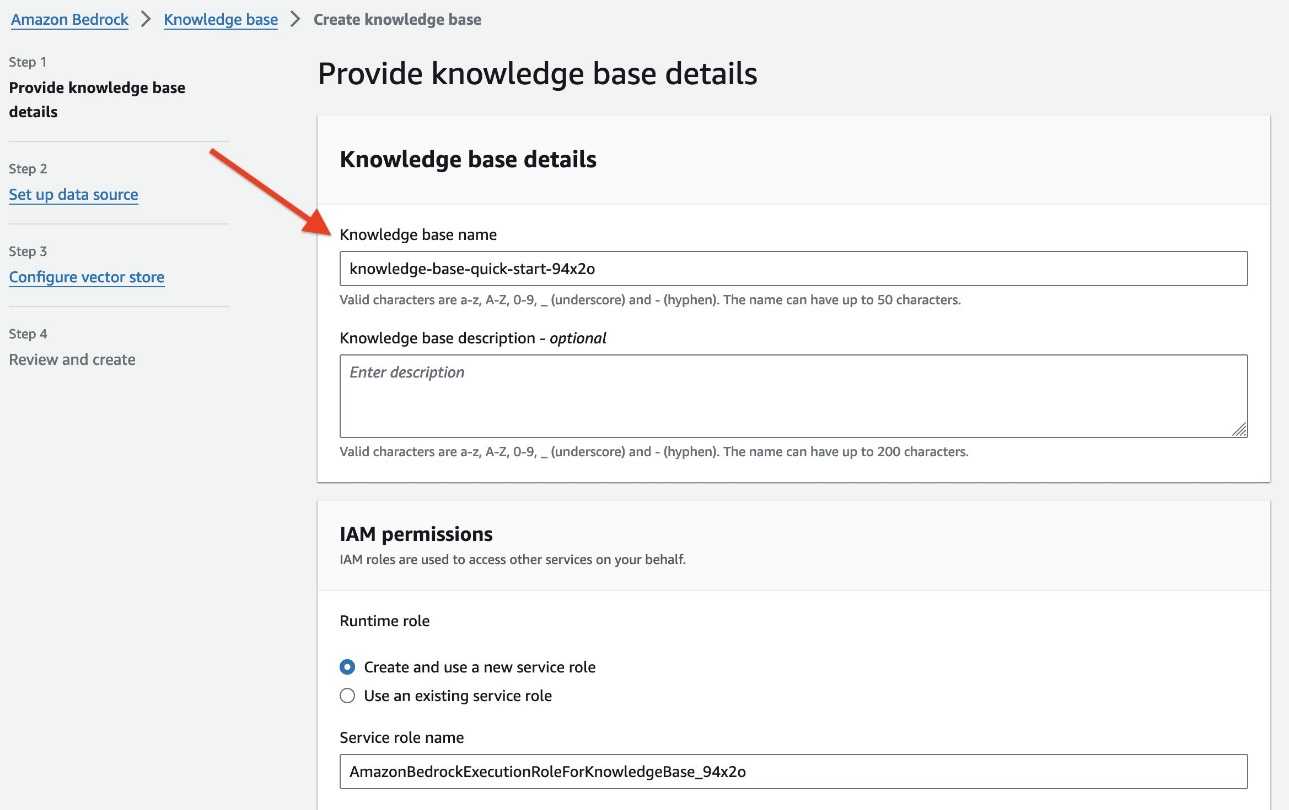

- Op de Amazon Bedrock-console, onder orkestratie in het navigatievenster, kies Kennisbank.

- Kies Creëer kennisbasis.

- In het Details van de kennisbank sectie, voer een naam en optionele beschrijving in.

- In het IAM-machtigingen sectie, selecteer Maak en gebruik een nieuwe servicerol en voer een naam in voor de rol.

- Voeg indien nodig tags toe.

- Kies Volgende.

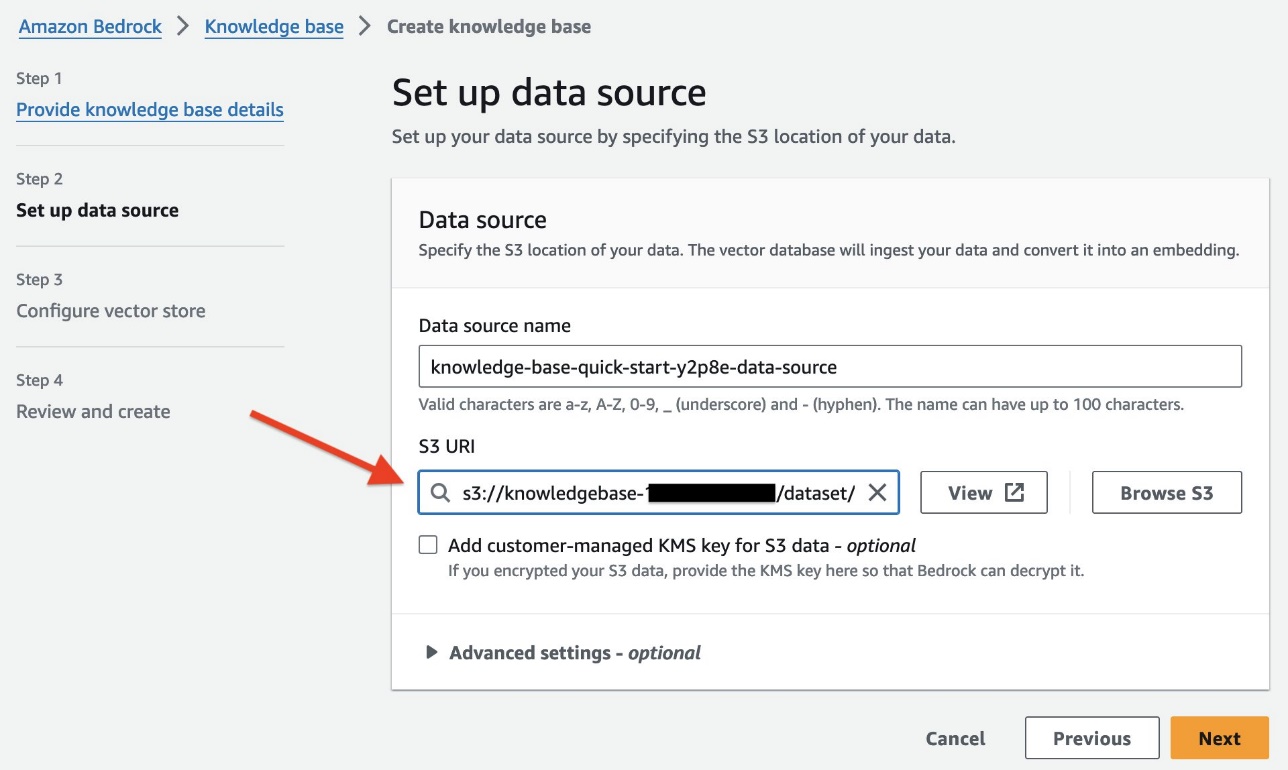

- Verlof Naam gegevensbron als standaardnaam.

- Voor S3-URI, kiezen Blader door S3 om de S3-bak te kiezen

knowledgebase-<your-account-number>/dataset/U moet naar de bucket- en gegevenssetmap verwijzen die u in de vorige stappen hebt gemaakt. - In het geavanceerde instellingen sectie laat u de standaardwaarden staan (als u wilt, kunt u de standaard chunkingstrategie wijzigen en de chunkgrootte en overlay in percentage opgeven).

- Kies Volgende.

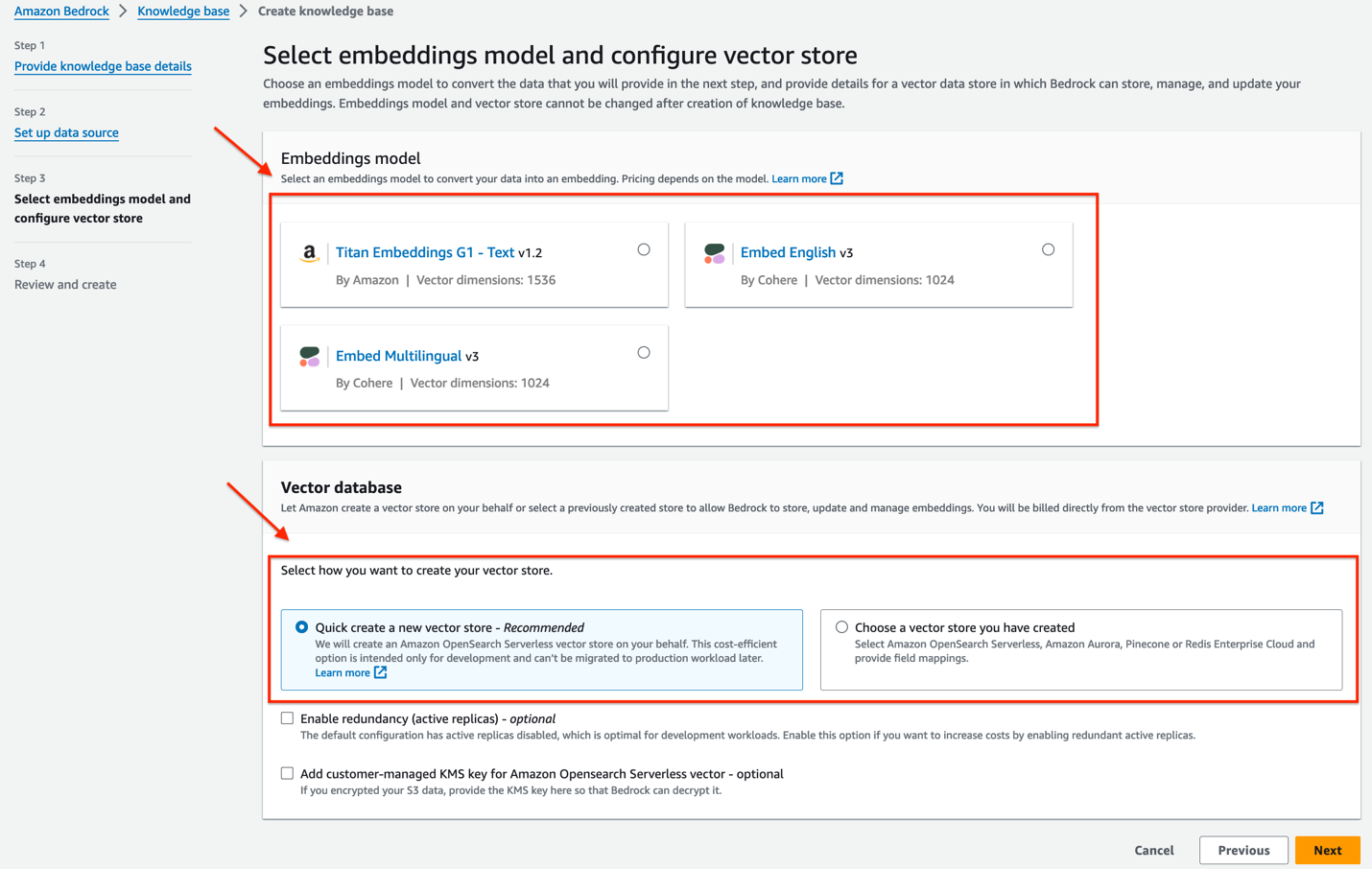

- Voor Inbeddingsmodelselecteer Titan Embedding G1 – Tekst.

- Voor Vector-database, u kunt beide selecteren Maak snel een nieuwe vectorwinkel or Kies een vectorwinkel die u hebt gemaakt. Houd er rekening mee dat u, om de vectoropslag van uw keuze te kunnen gebruiken, een vooraf geconfigureerde vectoropslag nodig heeft. We ondersteunen momenteel vier vector-engine-typen: de vector-engine voor Amazon OpenSearch Serverless, Amazon Aurora, Pinecone en Redis Enterprise Cloud. Voor dit bericht selecteren we Snel een nieuwe vectorwinkel maken, waarmee standaard een nieuwe OpenSearch Serverloze vectorwinkel in uw account wordt gemaakt.

- Kies Volgende.

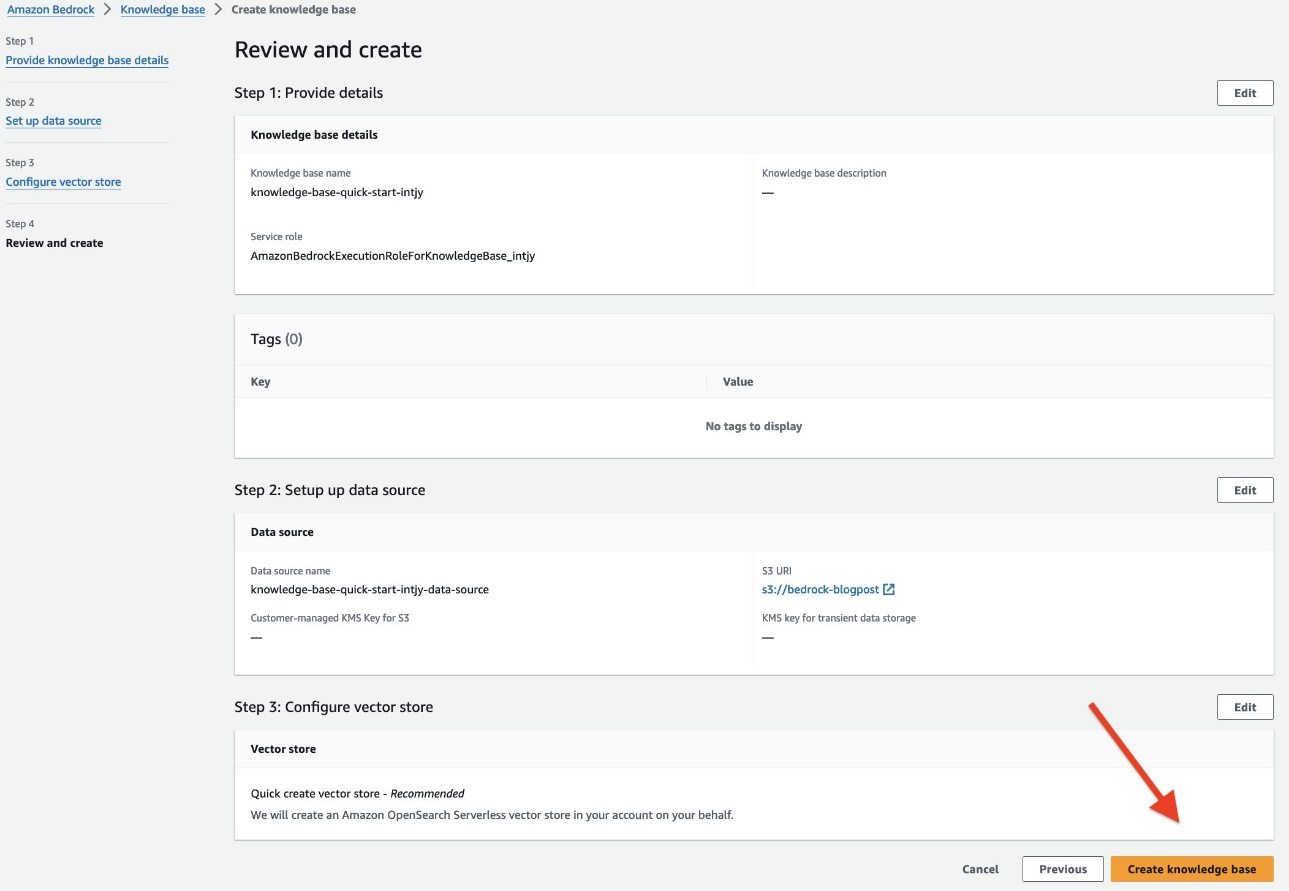

- Op de Bekijk en creëer pagina, bekijk alle informatie of kies Vorige om eventuele opties te wijzigen.

- Kies Creëer kennisbasis.

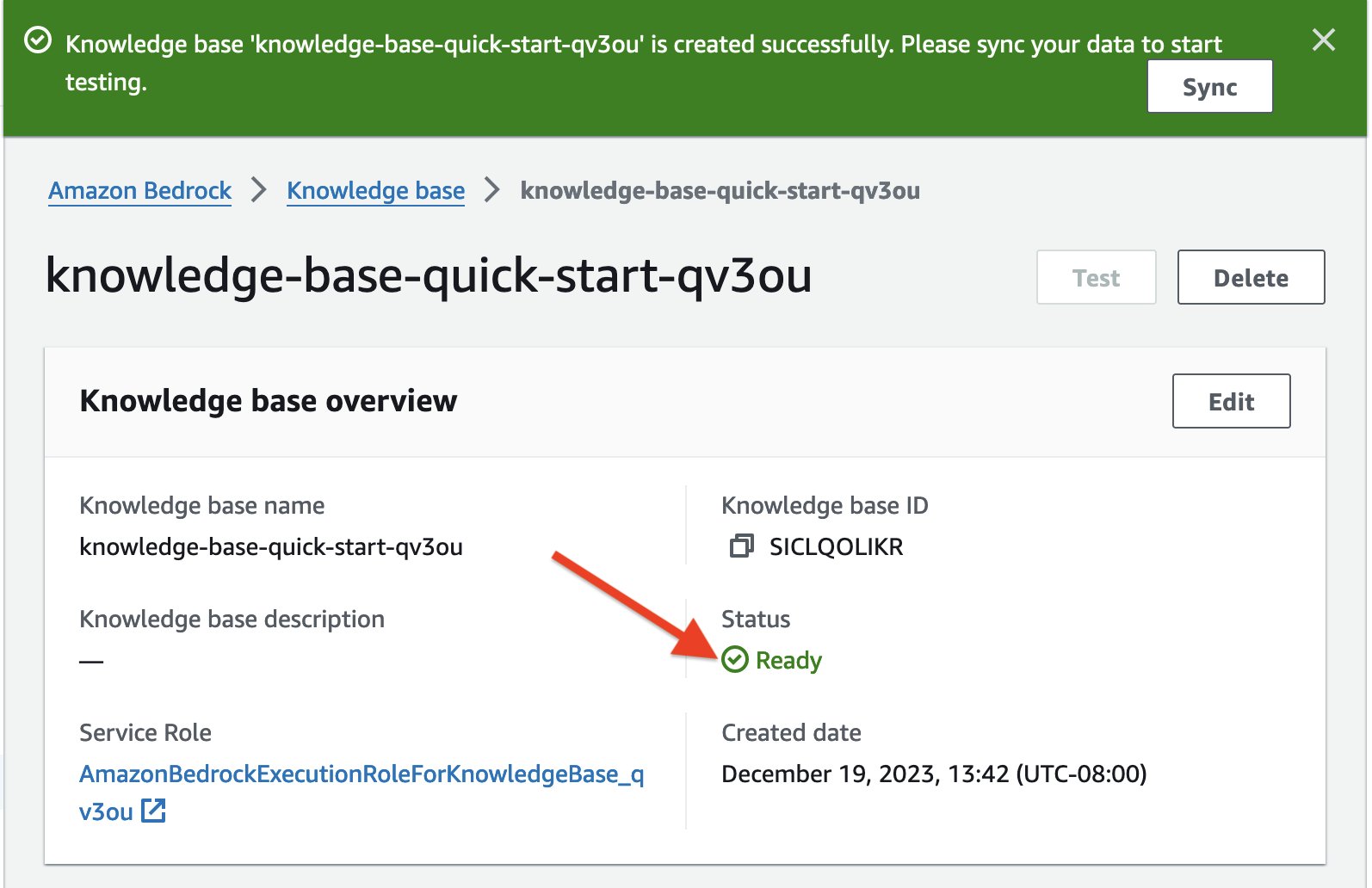

Let op: het proces voor het maken van de kennisbank begint en de status is In uitvoering. Het duurt een paar minuten om de vectoropslag en kennisbank te maken. Navigeer niet weg van de pagina, anders mislukt het maken.

Let op: het proces voor het maken van de kennisbank begint en de status is In uitvoering. Het duurt een paar minuten om de vectoropslag en kennisbank te maken. Navigeer niet weg van de pagina, anders mislukt het maken. - Wanneer de status van de kennisbank de status

Readystatus, noteer de kennisbank-ID. U gebruikt het in de volgende stappen om de Lambda-functie te configureren.

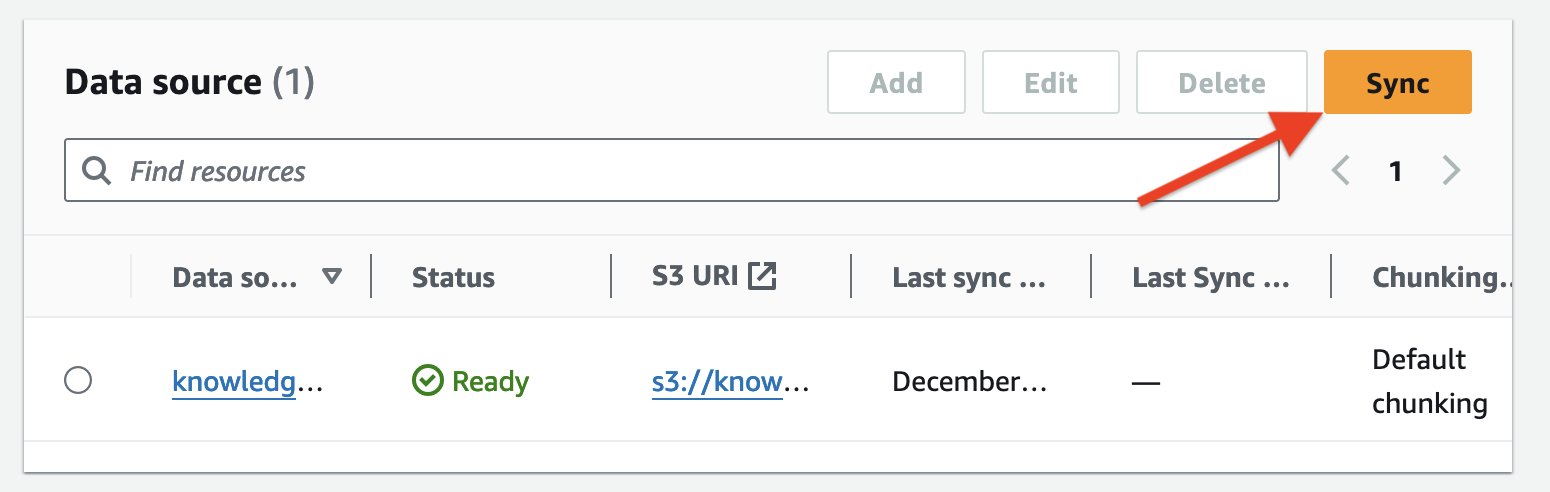

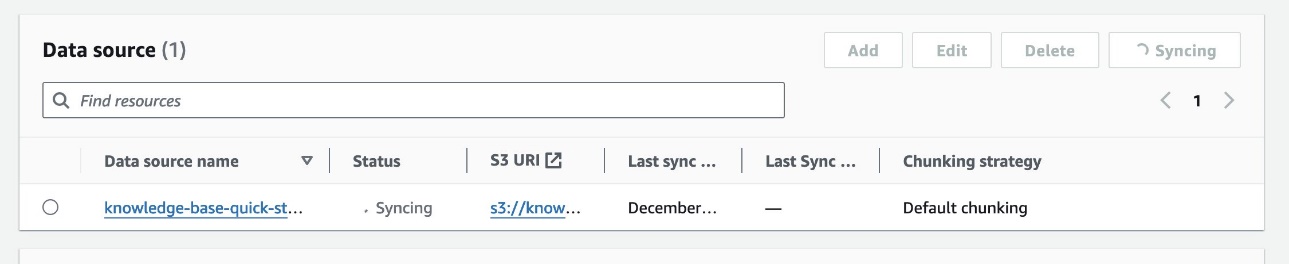

- Nu die kennisbank klaar is, moeten we de gegevens van onze Amazon-aandeelhoudersbrieven ermee synchroniseren. In de Databron sectie van de kennisbankdetailpagina, kies Synchroniseren om het gegevensopnameproces van de S3-bucket naar de kennisbank te activeren.

Dit synchronisatieproces splitst de documentbestanden op in kleinere stukken van de eerder gespecificeerde blokgrootte, genereert vectorinsluitingen met behulp van het geselecteerde tekstinsluitingsmodel en slaat ze op in de vectoropslag die wordt beheerd door Knowledge Bases voor Amazon Bedrock.

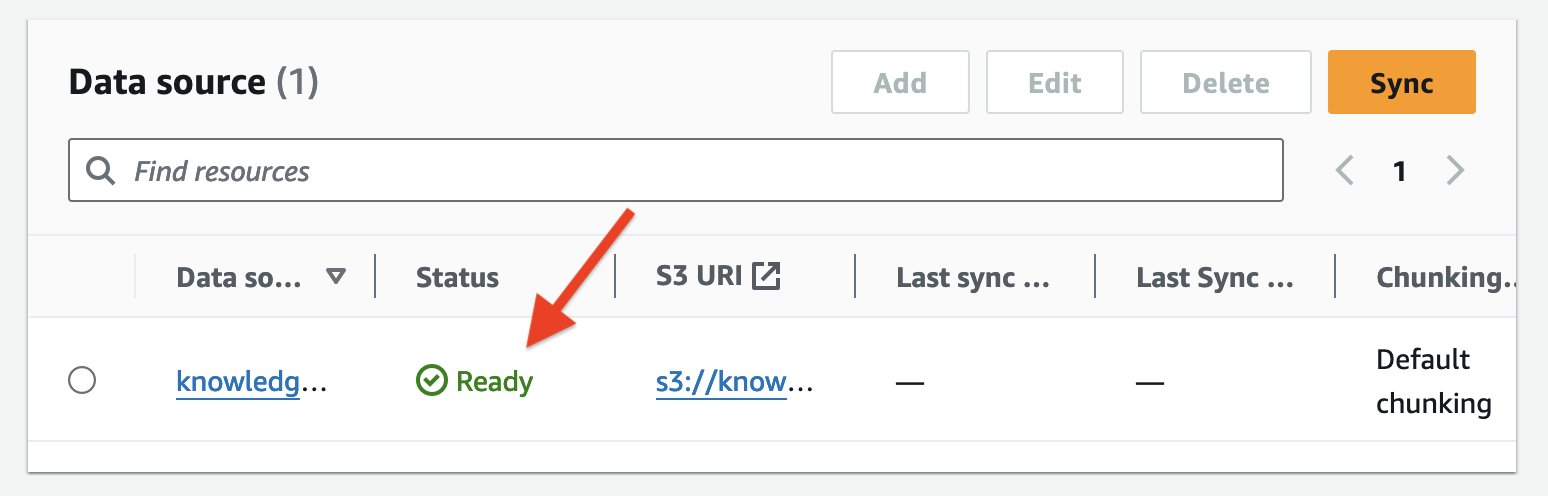

Wanneer de synchronisatie van de gegevensset is voltooid, verandert de status van de gegevensbron in Ready staat. Houd er rekening mee dat als u extra documenten toevoegt aan de S3-gegevensmap, u de kennisbank opnieuw moet synchroniseren.

Gefeliciteerd, uw kennisbank is gereed.

Houd er rekening mee dat u ook Knowledge Bases kunt gebruiken voor Amazon Bedrock-service-API's en de AWS-opdrachtregelinterface (AWS CLI) om programmatisch een kennisbank te creëren. U moet verschillende secties van de Jupyter-notebook uitvoeren die onder de /notebook map in de GitHub-repository.

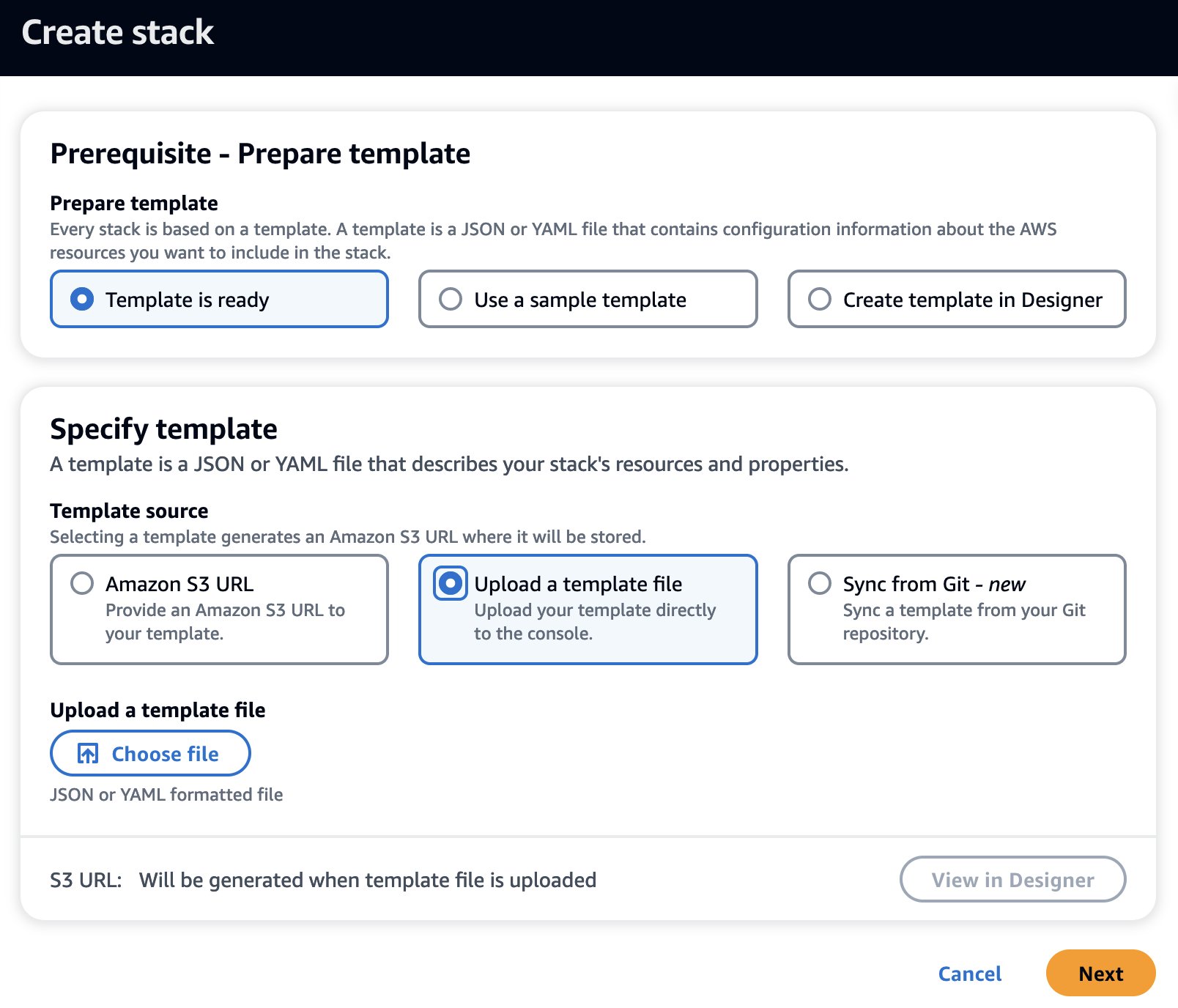

Maak een Lambda-functie

Deze Lambda-functie wordt geïmplementeerd met behulp van een AWS CloudFormatie sjabloon beschikbaar in de GitHub-repository onder de /cfn map. Voor de sjabloon zijn twee parameters vereist: de S3-bucketnaam en de kennisbank-ID.

- Kies op de startpagina van de AWS CloudFormation-service Maak een stapel om een nieuwe stapel te maken.

- kies Sjabloon is klaar For Bereid sjabloon voor.

- kies Upload het sjabloonbestand For Sjabloonbron.

- Kies Kies bestand, navigeer naar de GitHub-opslagplaats die u eerder hebt gekloond en kies het .yaml-bestand onder de

/cfnmap. - Kies Volgende.

- Voor Stack naam, voer een naam in.

- In het parameters sectie, voer de kennisbank-ID en de S3-bucketnaam in die u eerder hebt genoteerd.

- Kies Volgende.

- Laat alle standaardopties zoals ze zijn, kies Volgendeen kies Verzenden.

- Controleer of de CloudFormation-sjabloon met succes is uitgevoerd en dat er geen fouten zijn.

Gefeliciteerd, u hebt met succes een Lambda-functie, gerelateerde rollen en beleid gemaakt.

Test de contextuele chatbot-applicatie

Om uw chatbot-applicatie te testen, voert u de volgende stappen uit:

- Open een nieuwe terminal of een opdrachtregelvenster op uw machine.

- Voer de volgende opdracht uit om het AWS SDK voor Python (Boto3). Boto3 maakt het eenvoudig om een Python-applicatie, -bibliotheek of -script te integreren met AWS-services.

- Voer de volgende opdracht uit om een lokale Python-ontwikkelomgeving te installeren en in te stellen om de Streamlit-toepassing uit te voeren:

- Navigeer naar de

/streamlitmap in de GitHub-repositorymap die u eerder hebt gekloond. - Voer de volgende opdracht uit om de chatbot-applicatie te instantiëren:

Hierdoor zou een webgebaseerde chattoepassing, mogelijk gemaakt door Streamlit, in uw standaardwebbrowser moeten worden geopend.

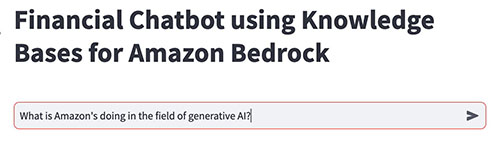

- Gebruik deze Streamlit-chatbotapplicatie om vragen in natuurlijke taal te posten om de gesprekken te starten, mogelijk gemaakt door Knowledge Bases voor Amazon Bedrock.

Wanneer u een prompt verzendt, activeert de Streamlit-app de Lambda-functie, die de kennisbanken aanroept RetrieveAndGenerate API om antwoorden te zoeken en te genereren.

De volgende tabel bevat enkele voorbeeldvragen en gerelateerde antwoorden op de Knowledge Base. Probeer enkele van deze vragen uit met behulp van aanwijzingen.

| Contact | antwoorden |

| Wat doet Amazon op het gebied van generatieve AI? | Amazon heeft gewerkt aan zijn eigen grote taalmodellen (LLM's) voor generatieve AI en gelooft dat dit elke klantervaring zal transformeren en verbeteren. Ze zijn van plan substantieel te blijven investeren in deze modellen voor al hun consumenten-, verkopers-, merk- en makerervaringen. |

| Wat is de jaar-op-jaaromzet van AWS in 2022? | De omzet van AWS groeide in 29 met 2022% op jaarbasis op een omzetbasis van $62 miljard. |

| Hoeveel dagen heeft Amazon werknemers gevraagd om op kantoor te komen werken? | Amazon heeft bedrijfsmedewerkers gevraagd om vanaf mei 2022 minstens drie dagen per week weer naar kantoor te komen. |

| Met welk percentage is de omzet van AWS in 2022 jaar-op-jaar gegroeid? | AWS had in 29 een omzet van 2022% op jaarbasis ('Jaarlijk'). |

| Welke prestatieverbetering leverden de Graviton2-chips volgens de passage op in vergelijking met Graviton3-processors? | In 2022 leverde AWS hun Graviton3-chips, die 25% betere prestaties leverden dan de Graviton2-processors. |

| Wat was volgens de passage de eerste inferentiechip die door AWS werd gelanceerd? | AWS lanceerde hun eerste inferentiechips (“Inferentia”) in 2019 en ze hebben bedrijven als Amazon meer dan honderd miljoen dollar aan kapitaaluitgaven bespaard. |

| In welk jaar steeg de jaaromzet van Amazon, gezien de context, van $245 miljard naar $434 miljard? | De jaaromzet van Amazon steeg van 245 miljard dollar in 2019 naar 434 miljard dollar in 2022. |

| Vertel me nog eens, wat waren de opbrengsten in 2019? | De omzet van Amazon in 2019 bedroeg $245 miljard. |

| en, 2021? | De omzet van Amazon in 2021 bedroeg 469.8 miljard dollar, een stijging van 22% ten opzichte van 2020. |

| En herinner me er nog eens aan wanneer de eerste inferentie-chip werd gelanceerd? | De eerste inferentiechip van Amazon was Inferentia, die in 2019 werd gelanceerd. |

Tijdens de eerste oproep naar de Lambda-functie wordt de RetrieveAndGenerate API retourneert een sessionId, die vervolgens door de Streamlit-app samen met de daaropvolgende gebruikersprompt wordt doorgegeven als invoer voor de RetrieveAndGenerate API om het gesprek in dezelfde sessie voort te zetten. De RetrieveAndGenerate API beheert het kortetermijngeheugen en gebruikt de chatgeschiedenis zolang dezelfde sessionId wordt doorgegeven als invoer in de opeenvolgende oproepen.

Gefeliciteerd, je hebt met succes een chatbot-applicatie gemaakt en getest met behulp van Knowledge Bases voor Amazon Bedrock.

Opruimen

Als u er niet in slaagt bronnen zoals de S3-bucket, de OpenSearch Serverless-verzameling en de kennisbank te verwijderen, worden er kosten in rekening gebracht. Om deze bronnen op te schonen, verwijdert u de CloudFormation-stack, verwijdert u de S3-bucket (inclusief alle documentmappen en bestanden die in die bucket zijn opgeslagen), verwijdert u de OpenSearch Serverless-verzameling, verwijdert u de kennisbank en verwijdert u alle rollen, beleidsregels en machtigingen die u hebt opgeslagen. eerder gemaakt.

Conclusie

In dit bericht hebben we een overzicht gegeven van contextuele chatbots en uitgelegd waarom ze belangrijk zijn. We hebben de complexiteit beschreven die gepaard gaat met workflows voor gegevensopname en tekstgeneratie voor een RAG-architectuur. Vervolgens hebben we geïntroduceerd hoe Knowledge Bases voor Amazon Bedrock een volledig beheerd serverloos RAG-systeem creëert, inclusief een vectorwinkel. Ten slotte hebben we een oplossingsarchitectuur en voorbeeldcode geleverd in een GitHub repo om contextuele antwoorden voor een chatbottoepassing op te halen en te genereren met behulp van een kennisbank.

Door de waarde van contextuele chatbots, de uitdagingen van RAG-systemen en hoe Knowledge Bases voor Amazon Bedrock deze uitdagingen aanpakt, uit te leggen, wilde dit bericht laten zien hoe Amazon Bedrock je in staat stelt om met minimale inspanning geavanceerde conversatie-AI-applicaties te bouwen.

Voor meer informatie, zie de Amazon Bedrock-ontwikkelaarsgids en Knowledge Base-API's.

Over de auteurs

Manish Chugh is een Principal Solutions Architect bij AWS, gevestigd in San Francisco, CA. Hij is gespecialiseerd in machine learning en generatieve AI. Hij werkt met organisaties variërend van grote ondernemingen tot beginnende startups aan problemen die verband houden met machine learning. Zijn rol bestaat uit het helpen van deze organisaties bij het ontwerpen van schaalbare, veilige en kosteneffectieve workloads op AWS. Hij presenteert regelmatig op AWS-conferenties en andere partnerevenementen. Buiten zijn werk houdt hij van wandelen over de East Bay-paden, wielrennen en cricket kijken (en spelen).

Manish Chugh is een Principal Solutions Architect bij AWS, gevestigd in San Francisco, CA. Hij is gespecialiseerd in machine learning en generatieve AI. Hij werkt met organisaties variërend van grote ondernemingen tot beginnende startups aan problemen die verband houden met machine learning. Zijn rol bestaat uit het helpen van deze organisaties bij het ontwerpen van schaalbare, veilige en kosteneffectieve workloads op AWS. Hij presenteert regelmatig op AWS-conferenties en andere partnerevenementen. Buiten zijn werk houdt hij van wandelen over de East Bay-paden, wielrennen en cricket kijken (en spelen).

Mani Khanuja is een Tech Lead – Generative AI Specialists, auteur van het boek Applied Machine Learning and High Performance Computing on AWS, en lid van de Raad van Bestuur van Women in Manufacturing Education Foundation Board. Ze leidt machine learning-projecten in verschillende domeinen, zoals computer vision, natuurlijke taalverwerking en generatieve AI. Ze spreekt op interne en externe conferenties zoals AWS re:Invent, Women in Manufacturing West, YouTube-webinars en GHC 23. In haar vrije tijd maakt ze graag lange runs langs het strand.

Mani Khanuja is een Tech Lead – Generative AI Specialists, auteur van het boek Applied Machine Learning and High Performance Computing on AWS, en lid van de Raad van Bestuur van Women in Manufacturing Education Foundation Board. Ze leidt machine learning-projecten in verschillende domeinen, zoals computer vision, natuurlijke taalverwerking en generatieve AI. Ze spreekt op interne en externe conferenties zoals AWS re:Invent, Women in Manufacturing West, YouTube-webinars en GHC 23. In haar vrije tijd maakt ze graag lange runs langs het strand.

Pallavi Nargund is een Principal Solutions Architect bij AWS. In haar rol als cloudtechnologie-enabler werkt ze samen met klanten om hun doelen en uitdagingen te begrijpen en geeft ze voorgeschreven begeleiding om hun doel te bereiken met AWS-aanbiedingen. Ze heeft een passie voor vrouwen in de technologie en is kernlid van Women in AI/ML bij Amazon. Ze spreekt op interne en externe conferenties zoals AWS re:Invent, AWS Summits en webinars. Buiten haar werk doet ze graag vrijwilligerswerk, tuinieren, fietsen en wandelen.

Pallavi Nargund is een Principal Solutions Architect bij AWS. In haar rol als cloudtechnologie-enabler werkt ze samen met klanten om hun doelen en uitdagingen te begrijpen en geeft ze voorgeschreven begeleiding om hun doel te bereiken met AWS-aanbiedingen. Ze heeft een passie voor vrouwen in de technologie en is kernlid van Women in AI/ML bij Amazon. Ze spreekt op interne en externe conferenties zoals AWS re:Invent, AWS Summits en webinars. Buiten haar werk doet ze graag vrijwilligerswerk, tuinieren, fietsen en wandelen.

- Door SEO aangedreven content en PR-distributie. Word vandaag nog versterkt.

- PlatoData.Network Verticale generatieve AI. Versterk jezelf. Toegang hier.

- PlatoAiStream. Web3-intelligentie. Kennis versterkt. Toegang hier.

- PlatoESG. carbon, CleanTech, Energie, Milieu, Zonne, Afvalbeheer. Toegang hier.

- Plato Gezondheid. Intelligentie op het gebied van biotech en klinische proeven. Toegang hier.

- Bron: https://aws.amazon.com/blogs/machine-learning/build-a-contextual-chatbot-application-using-knowledge-bases-for-amazon-bedrock/

- : heeft

- :is

- :waar

- $UP

- 100

- 125

- 2019

- 2020

- 2021

- 2022

- 23

- 27

- 500

- 7

- 8

- 9

- a

- vermogen

- Over

- versnellen

- toegang

- toegang

- Volgens

- Account

- accuraat

- Bereiken

- over

- Actie

- toevoegen

- Extra

- adressen

- vergevorderd

- voordelen

- adviseurs

- weer

- agenten

- AI

- AI-systemen

- AI / ML

- Gericht

- Alles

- Het toestaan

- toestaat

- alleen

- langs

- naast

- ook

- Amazone

- Amazon Web Services

- an

- en

- jaar-

- JAARLIJKSE OMZET

- beantwoorden

- beantwoorden

- antropisch

- elke

- api

- APIs

- gebruiken

- Aanvraag

- toepassingen

- toegepast

- nadering

- architectuur

- ZIJN

- AS

- At

- vergroten

- aangevuld

- augments

- Aurora

- auteur

- webmaster.

- Beschikbaar

- Laan

- weg

- AWS

- AWS CloudFormatie

- AWS re: Invent

- terug

- baseren

- gebaseerde

- basis-

- Baai

- Beach

- worden

- geweest

- vaardigheden

- Begin

- begint

- gedrag

- gelooft

- Betere

- Miljard

- boord

- raad van bestuur

- boek

- merk

- browser

- bouw

- bedrijfsdeskundigen

- Business Applications

- by

- CA

- Bellen

- oproepen

- CAN

- mogelijkheden

- hoofdstad

- gevallen

- CD

- uitdagingen

- verandering

- Wijzigingen

- lasten

- de chat

- Chatbot

- chatbots

- Afrekenen

- spaander

- chips

- keuze

- Kies

- schoon

- cli

- Cloud

- CLOUD-TECHNOLOGIE

- code

- Collectie

- combines

- hoe

- komt

- Gemeen

- Bedrijven

- afstand

- compleet

- complexiteit

- componenten

- computationeel

- computer

- Computer visie

- computergebruik

- conferenties

- Verbinden

- troosten

- consument

- verband

- contextual

- contextualiseren

- voortzetten

- Gesprek

- spraakzaam

- conversatie AI

- conversaties

- geconverteerd

- Kern

- Bedrijfs-

- kostenefficient

- kon

- en je merk te creëren

- aangemaakt

- creëert

- Wij creëren

- het aanmaken

- schepper

- krekel

- Op dit moment

- klant

- Klant gedrag

- klantervaring

- Klantenservice

- Klanten

- aangepaste

- gegevens

- data punten

- Gegevensgestuurde

- Database

- dagen

- Standaard

- leveren

- geleverd

- het leveren van

- Afhankelijk

- ingezet

- inzet

- beschreven

- beschrijving

- gegevens

- Bepalen

- ontwikkelen

- Ontwikkelaar

- Ontwikkeling

- diagram

- DEED

- anders

- digitaal

- Raad van bestuur

- diversen

- document

- documenten

- doen

- dollar

- domeinen

- Dont

- beneden

- Download

- elk

- Vroeger

- vroege fase

- oosten

- Onderwijs

- doeltreffend

- inspanning

- moeiteloos

- beide

- inbedding

- medewerkers

- in staat stellen

- enabler

- maakt

- boeiende

- Motor

- Engineering

- verbeterde

- verbeteren

- Enter

- Enterprise

- bedrijven

- Milieu

- fouten

- Zelfs

- EVENTS

- Alle

- voorbeeld

- ervaring

- Ervaringen

- expertise

- Verklaren

- uitgelegd

- uitleggen

- extern

- feiten

- FAIL

- weinig

- veld-

- Dien in

- Bestanden

- Tot slot

- vondsten

- Voornaam*

- stroom

- Focus

- volgend

- Voor

- Foundation

- vier

- Francisco

- Gratis

- oppompen van

- geheel

- functie

- g1

- voortbrengen

- genereert

- generatie

- generatief

- generatieve AI

- Git

- GitHub

- Geven

- Go

- Doelen

- groeide

- Ground

- Groeien

- Groeit

- leiding

- HAD

- handvat

- Handvaten

- Hebben

- he

- zwaar

- zwaar tillen

- het helpen van

- haar

- Hoge

- high-level

- zijn

- geschiedenis

- Home

- Hoe

- Echter

- HTML

- http

- HTTPS

- honderd

- ID

- if

- illustreren

- illustreert

- uitvoering

- belangrijk

- verbeteren

- verbetering

- het verbeteren van

- in

- omvat

- Inclusief

- nemen

- omvat

- Laat uw omzet

- meer

- index

- indexen

- individueel

- industrieën

- informeren

- informatie

- Informatie Systemen

- invoer

- vragen

- inzichten

- installeren

- moment

- integreren

- Integreren

- integratie

- wisselwerking

- belangen

- Interface

- intern

- inwendig

- in

- voorstellen

- geïntroduceerd

- investeren

- oproept

- betrokken zijn

- gaat

- IT

- jpg

- sleutel

- kennis

- taal

- Talen

- Groot

- Grote ondernemingen

- Achternaam*

- later

- gelanceerd

- lagen

- leiden

- Leads

- leren

- minst

- Verlof

- minder

- letter

- Niveau

- bibliotheken

- Bibliotheek

- facelift

- als

- sympathieën

- Beperkt

- Lijn

- Koppeling

- LLM

- lokaal

- lang

- machine

- machine learning

- Hoofd

- MERKEN

- handelbaar

- beheerd

- beheert

- beheren

- productie

- veel

- Match

- Mei..

- me

- betekenis

- mechanisme

- lid

- Geheugen

- alleen

- miljoen

- miljoen dollar

- minimaal

- minuut

- minuten

- model

- modellen

- wijzigen

- meer

- meest

- meervoudig

- naam

- Naturel

- Natural Language Processing

- OP DEZE WEBSITE VIND JE

- Navigatie

- Noodzaak

- nodig

- behoeften

- New

- volgende

- geen

- Geen

- nota

- notitieboekje

- bekend

- doel van de persoon

- of

- bieden

- aanbod

- Aanbod

- Kantoor

- vaak

- on

- EEN

- open

- open source

- optimale

- Keuze

- Opties

- or

- organisaties

- Overige

- anders-

- onze

- uit

- uitgang

- buiten

- over

- boven het hoofd

- overzicht

- het te bezitten.

- pagina

- brood

- parameters

- partner

- onderdelen

- passage

- passages

- voorbij

- hartstochtelijk

- verleden

- Patronen

- percentage

- prestatie

- permissies

- Gepersonaliseerde

- plan

- Plato

- Plato gegevensintelligentie

- PlatoData

- spelen

- punt

- punten

- beleidsmaatregelen door te lezen.

- Populair

- populariteit

- Post

- energie

- aangedreven

- krachtige

- voorkeuren

- presenteren

- gepresenteerd

- cadeautjes

- vorig

- Principal

- problemen

- verwerking

- processors

- Producten

- Voortgang

- projecten

- prompts

- gepatenteerd

- zorgen voor

- mits

- biedt

- het verstrekken van

- aankopen

- Python

- queries

- vraag

- vraag

- Contact

- Quick

- doek

- variërend

- RE

- klaar

- vast

- echte wereld

- real-time

- archief

- verminderen

- vermindering

- verwijzen

- regio

- regelmatig

- verwant

- relevantie

- relevante

- verwijdert

- Rapporten

- bewaarplaats

- vertegenwoordigen

- te vragen

- nodig

- vereist

- Resources

- Reageren

- antwoord

- reacties

- ophalen

- Retourneren

- inkomsten

- beoordelen

- weg

- Rol

- rollen

- lopen

- loopt

- runtime

- dezelfde

- monster

- heilige

- San Francisco

- gered

- schaalbare

- scaling

- script

- sdk

- Ontdek

- sectie

- secties

- beveiligen

- zien

- kiezen

- gekozen

- semantisch

- verzonden

- dienen

- Serverless

- service

- Diensten

- Sessie

- reeks

- settings

- setup

- aandeelhouder

- Aandeelhouders

- ze

- korte termijn

- moet

- showcase

- aanzienlijke

- gelijk

- gelijktijdig

- single

- Maat

- kleinere

- oplossing

- Oplossingen

- sommige

- geraffineerd

- bron

- bronnen

- spreekt

- specialisten

- specialiseert

- specifiek

- gespecificeerd

- spleet

- splits

- stack

- begin

- Startups

- Land

- Status

- stengels

- Stap voor

- Stappen

- shop

- opgeslagen

- winkels

- bewaartemperatuur

- eenvoudig

- Strategie

- gestroomlijnd

- voorleggen

- volgend

- wezenlijk

- Met goed gevolg

- dergelijk

- stel

- Toppen

- ondersteuning

- ondersteunde

- steunen

- synchroniseren.

- system

- Systems

- tafel

- op maat gemaakt

- Nemen

- neemt

- taken

- tech

- Technologie

- sjabloon

- terminal

- proef

- getest

- tekst

- neem contact

- dat

- De

- de informatie

- De Bron

- hun

- Ze

- harte

- Er.

- daarom

- Deze

- ze

- dit

- die

- drie

- Door

- niet de tijd of

- Titan

- naar

- Transformeren

- leiden

- vertrouwde

- proberen

- twee

- types

- voor

- begrijpen

- bijwerken

- geüpload

- .

- gebruikt

- Gebruiker

- gebruikers

- toepassingen

- gebruik

- utility

- v1

- waardevol

- waarde

- Values

- divers

- visie

- volume

- willen

- was

- kijken

- Manier..

- we

- web

- web browser

- webservices

- Web-based

- Webinars

- week

- weken

- West

- Wat

- wanneer

- welke

- en

- Waarom

- wil

- venster

- Met

- Dames

- vrouwen in de technologie

- Mijn werk

- workflow

- workflows

- werkzaam

- Bedrijven

- schrijven

- code schrijven

- geschreven

- YAML

- jaar

- jaar

- You

- Your

- youtube

- zephyrnet