Vandaag zijn we verheugd aan te kondigen dat de Bladknop model is nu beschikbaar voor klanten die het gebruiken Amazon SageMaker JumpStart. Gemma is een familie van taalmodellen gebaseerd op de Gemini-modellen van Google, getraind op maximaal 6 biljoen tokens aan tekst. De Gemma-familie bestaat uit twee maten: een model van 7 miljard parameters en een model van 2 miljard parameters. Nu kunt u de voorgetrainde en op instructies afgestemde modellen van Gemma 2B en Gemma 7B gebruiken SageMaker JumpStart. JumpStart is de machine learning (ML) hub van SageMaker die toegang biedt tot basismodellen naast ingebouwde algoritmen en end-to-end oplossingssjablonen om u te helpen snel aan de slag te gaan met ML.

In dit bericht laten we zien hoe u het Gemma-model kunt implementeren en afstemmen op uw gebruiksscenario's in SageMaker JumpStart. Het volledige notitieboekje is verkrijgbaar op GitHub.

Gemma-model

Bladknop is een familie van lichtgewicht, state-of-the-art modellen gebouwd op basis van hetzelfde onderzoek en dezelfde technologie die zijn gebruikt om de Gemini modellen. Gemma is ontwikkeld door Google DeepMind en andere teams van Google en is geïnspireerd door Gemini. Gemma vertoont sterke generalistische capaciteiten in tekstdomeinen en state-of-the-art begrip- en redeneervaardigheden op grote schaal. Het levert betere prestaties in vergelijking met andere openbaar beschikbare modellen van vergelijkbare of grotere schaal in verschillende domeinen, waaronder het beantwoorden van vragen, redeneren met gezond verstand, wiskunde en wetenschap, en codering. Gemma heeft de modelgewichten vrijgegeven om ontwikkelaarsinnovatie met behulp van Gemma-modellen te ondersteunen. Gemma werd gelanceerd met een nieuwe Verantwoorde generatieve AI-toolkit dat begeleiding en essentiële hulpmiddelen biedt voor het creëren van veiligere AI-toepassingen met Gemma.

Funderingsmodellen in SageMaker

JumpStart biedt toegang tot een reeks modellen van populaire modelhubs, waaronder Hugging Face, PyTorch Hub en TensorFlow Hub, die u kunt gebruiken binnen uw ML-ontwikkelingsworkflow in SageMaker. Recente ontwikkelingen in ML hebben geleid tot een nieuwe klasse modellen die bekend staat als funderingsmodellen, die typisch zijn getraind op miljarden parameters en kunnen worden aangepast aan een brede categorie van gebruiksscenario's, zoals tekstsamenvatting, het genereren van digitale kunst en taalvertaling. Omdat het trainen van deze modellen duur is, willen klanten bestaande vooraf getrainde basismodellen gebruiken en deze zo nodig verfijnen, in plaats van deze modellen zelf te trainen. SageMaker biedt een samengestelde lijst met modellen waaruit u kunt kiezen op de SageMaker-console.

Binnen JumpStart vindt u nu funderingsmodellen van verschillende modelaanbieders, waardoor u snel aan de slag kunt met funderingsmodellen. U kunt funderingsmodellen vinden op basis van verschillende taken of modelaanbieders, en modelkenmerken en gebruiksvoorwaarden bekijken. U kunt deze modellen ook uitproberen met behulp van een test-UI-widget. Als u een basismodel op schaal wilt gebruiken, kunt u dit doen zonder SageMaker te verlaten door kant-en-klare notebooks van modelaanbieders te gebruiken. Omdat de modellen worden gehost en geïmplementeerd op AWS, worden uw gegevens, of deze nu worden gebruikt voor het evalueren van het model of voor het gebruik ervan op schaal, nooit gedeeld met derden.

Laten we eens kijken hoe u het Llama Guard-model in JumpStart kunt gebruiken.

Ontdek het Gemma-model in Jumpstart

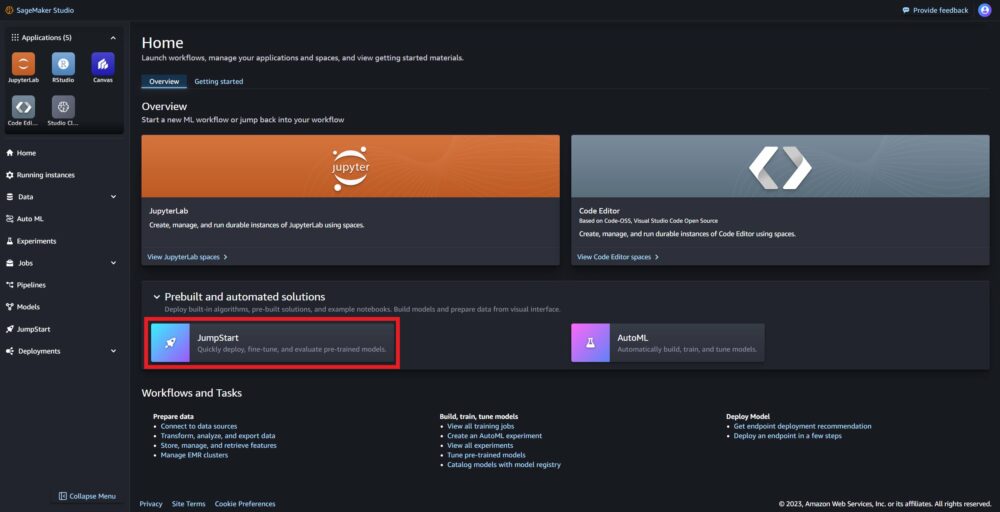

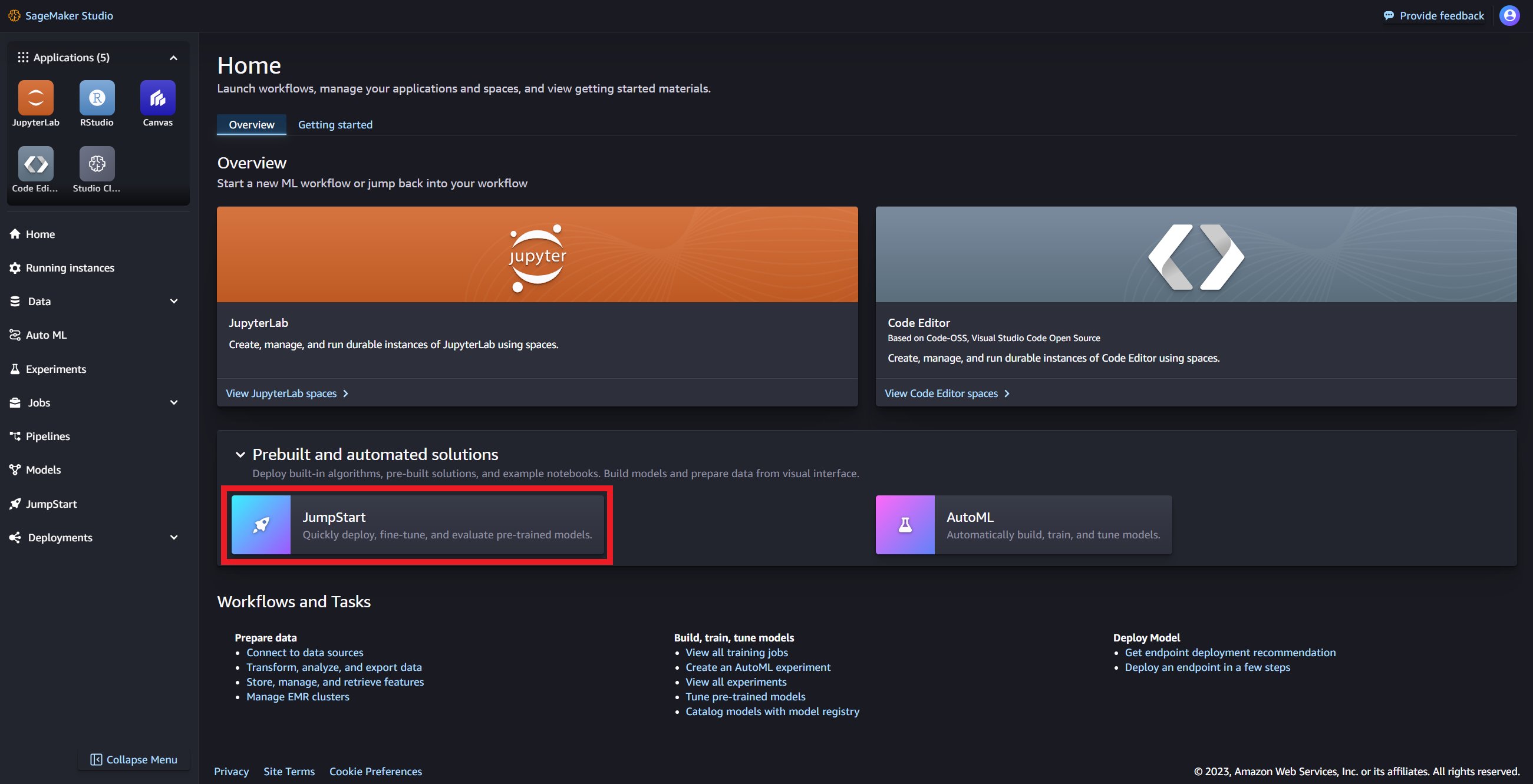

U hebt toegang tot Gemma-basismodellen via SageMaker JumpStart in de gebruikersinterface van SageMaker Studio en de SageMaker Python SDK. In deze sectie bespreken we hoe u de modellen in SageMaker Studio kunt ontdekken.

SageMaker Studio is een geïntegreerde ontwikkelomgeving (IDE) die één enkele webgebaseerde visuele interface biedt waar u toegang hebt tot speciaal gebouwde tools om alle ML-ontwikkelingsstappen uit te voeren, van het voorbereiden van gegevens tot het bouwen, trainen en implementeren van uw ML-modellen. Voor meer informatie over hoe u aan de slag gaat en SageMaker Studio instelt, zie Amazon SageMaker Studio.

Ga in de AWS Management Console voor SageMaker Studio naar SageMaker JumpStart onder Kant-en-klare en geautomatiseerde oplossingen. Jumpstart bevat vooraf getrainde modellen, notebooks en vooraf gebouwde oplossingen.

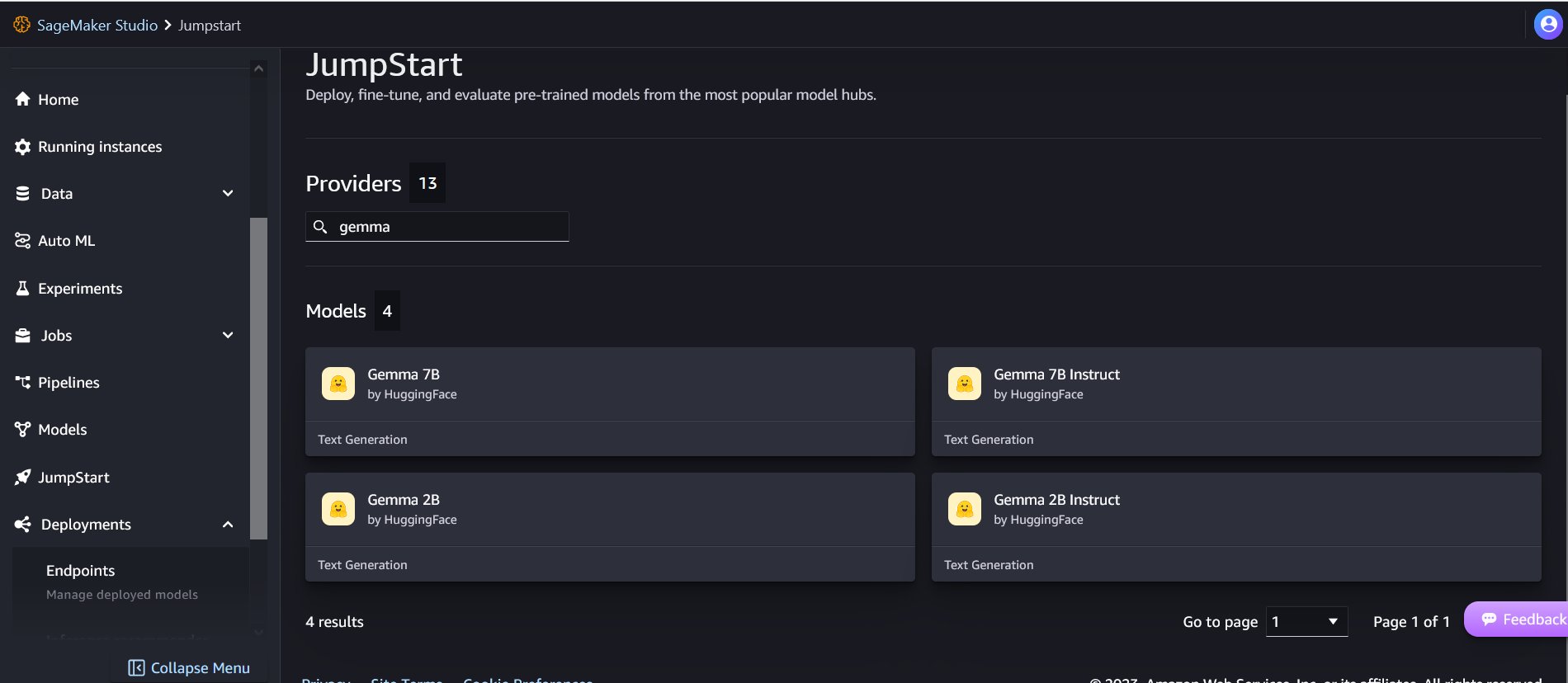

Op de startpagina van SageMaker JumpStart kunt u het Gemma-model vinden door naar Gemma te zoeken.

U kunt vervolgens kiezen uit verschillende Gemma-modelvarianten, waaronder Gemma 2B, Gemma 7B, Gemma 2B instruct en Gemma 7B instruct.

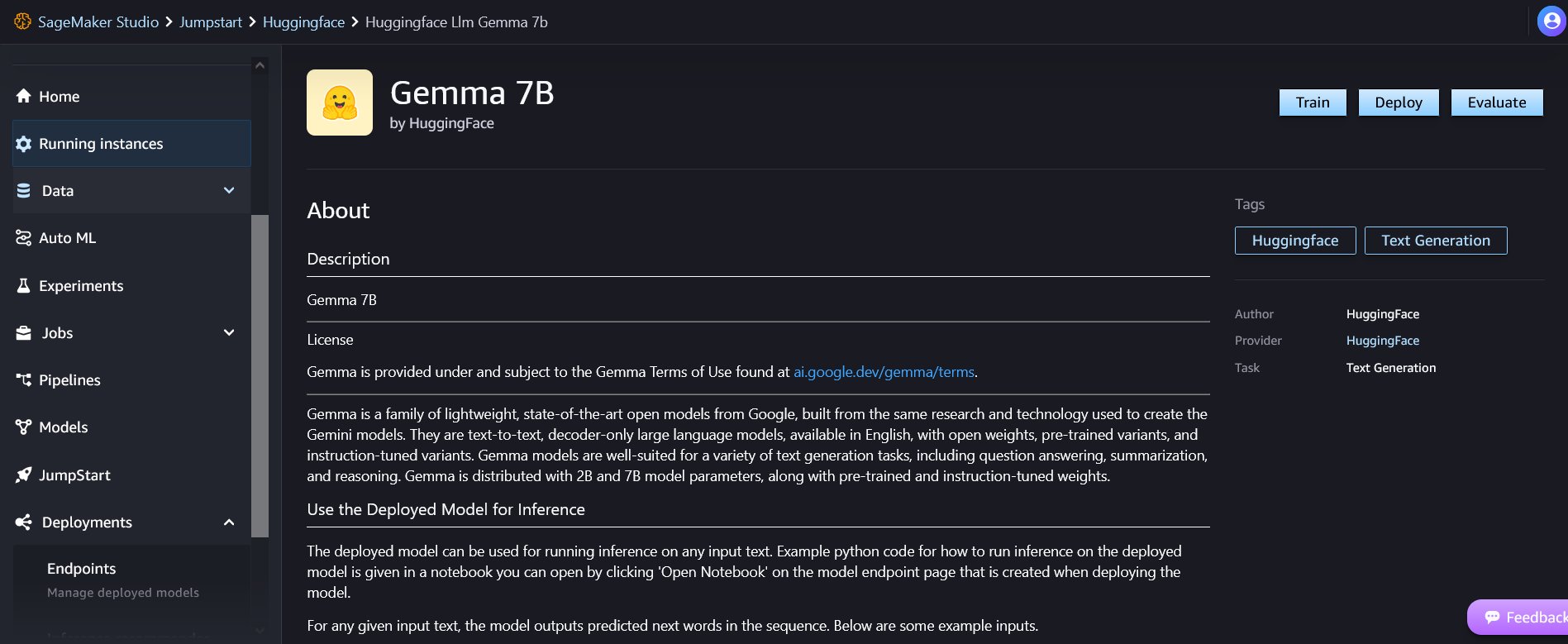

Kies de modelkaart om details over het model te bekijken, zoals de licentie, gegevens die worden gebruikt om te trainen en hoe u het model kunt gebruiken. Ook vindt u een Implementeren knop, waarmee u naar een landingspagina gaat waar u de gevolgtrekking kunt testen met een voorbeeldpayload.

Implementeer Gemma met SageMaker Python SDK

U kunt de code vinden die de implementatie van Gemma op JumpStart laat zien en een voorbeeld van hoe u het geïmplementeerde model kunt gebruiken in dit GitHub-notebook.

Begin met het selecteren van de SageMaker Model Hub-model-ID en modelversie die u wilt gebruiken bij het implementeren van Gemma.

Kies een model-ID uit de volgende tabel, waarin de standaardconfiguratieopties voor de JumpStart-implementatie worden beschreven. Vanwege de grote woordenschatgrootte van 256 tokens past Gemma 7B alleen op een enkele A10G GPU bij ondersteuning van een contextlengte van 1. Om deze reden gebruikt JumpStart een grotere standaardinstantie voor Gemma 7B.

| Model ID | Standaard gevolgtrekkingsinstantie | Tensor parallelle graad | Ondersteunde context Lengte |

| knuffelgezicht-llm-gemma-2b | ml.g5.xgroot | 1 | 8k |

| knuffelgezicht-llm-gemma-2b-instruct | ml.g5.xgroot | 1 | 8k |

| knuffelgezicht-llm-gemma-7b | ml.g5.12xgroot | 4 | 8k |

| knuffelgezicht-llm-gemma-7b-instruct | ml.g5.12xgroot | 4 | 8k |

U kunt het model nu implementeren met SageMaker JumpStart. De volgende code gebruikt het standaardexemplaar ml.g5.12xlarge voor het inferentie-eindpunt U kunt het model op andere instantietypen implementeren door het door te geven instance_type in de JumpStartModel klas. De implementatie kan 5-10 minuten duren.

Voor een succesvolle implementatie moet u handmatig de accept_eula argument in de implementatiemethode van het model True. Dit model wordt geïmplementeerd met behulp van de deep learning-container text-generation-inference (TGI).

Eindpunt aanroepen

U kunt voorbeeldpayloads programmatisch ophalen uit de JumpStartModel voorwerp. Dit zal u helpen aan de slag te gaan door vooraf opgemaakte instructieaanwijzingen te observeren die Gemma kan innemen.

Voordat we naar specifieke aanwijzingen kijken, bekijken we eerst de chatsjabloon voor Gemma Instruct-modellen.

Hier plaatst u uw prompt in het [USER_PROMPT] plaats. Er is geen ondersteuning voor een systeeminstructie; in plaats daarvan kunt u de gewenste instructie vóór de gebruikersprompt plaatsen. Als u bovendien een gesprek met meerdere beurten voert, kan de modelprompt indien nodig wisselen tussen gebruiker en assistent.

Overweeg nu een paar instructievoorbeelden. Hier vraag je Gemma om een Hello World-programma te schrijven.

Het volgende is de verwachte output:

Roep vervolgens Gemma aan voor de creatieve taak van het schrijven van een gedicht.

Het volgende is de uitvoer:

Dit ziet er best goed uit!

Laten we nu eens kijken naar de benchmarking van latentie- en doorvoerprestaties voor modellevering met de standaard JumpStart-implementatieconfiguratie. Hier laten we zien hoe de modelprestaties kunnen verschillen voor uw typische eindpuntwerkbelasting. In de volgende tabellen kunt u zien dat kleine zoekopdrachten (256 invoerwoorden en 256 uitvoertokens) behoorlijk presteren onder een groot aantal gelijktijdige gebruikers, waarbij de tokendoorvoer wordt bereikt in de orde van grootte van duizend tot tweeduizend tokens per seconde. Naarmate het aantal invoerwoorden echter Gemma's maximaal ondersteunde contextlengte van achtduizend tokens nadert, verzadigt het eindpunt zijn batchcapaciteit (het aantal gelijktijdige verzoeken dat tegelijkertijd mag worden verwerkt) vanwege geheugengebonden beperkingen van de instantie.

Zie voor meer informatie over hoe u deze informatie kunt overwegen en hoe u implementatieconfiguraties kunt aanpassen voor uw specifieke gebruiksscenario Benchmark en optimaliseer de implementatie van eindpunten in Amazon SageMaker JumpStart.

| . | Doorvoer (tokens/s) | ||||||||||

| Gelijktijdige gebruikers | 1 | 2 | 4 | 8 | 16 | 32 | 64 | 128 | |||

| model | Instantietype | Voer woorden in | Uitvoertokens | . | . | . | . | . | . | . | . |

| gemma-2b-instrueren | ml.g5.xgroot | 256 | 256 | 73 | 137 | 262 | 486 | 829 | 1330 | 1849 | 1834 |

| 2048 | 256 | 69 | 126 | 227 | 373 | 537 | 704 | 764 | - | ||

| 7936 | 256 | 60 | 100 | 147 | 195 | 226 | 230 | - | - | ||

| gemma-7b-instrueren | ml.g5.12xgroot | 256 | 256 | 62 | 119 | 227 | 413 | 601 | 811 | 937 | 962 |

| 2048 | 256 | 56 | 100 | 172 | 245 | 267 | 273 | - | - | ||

| 7936 | 256 | 44 | 67 | 77 | 77 | 78 | - | - | - | ||

| . | P50-latentie (ms/token) | ||||||||||

| Gelijktijdige gebruikers | 1 | 2 | 4 | 8 | 16 | 32 | 64 | 128 | |||

| model | Instantietype | Voer woorden in | Uitvoertokens | . | . | . | . | . | . | . | . |

| gemma-2b-instrueren | ml.g5.xgroot | 256 | 256 | 13 | 14 | 15 | 16 | 19 | 23 | 33 | 49 |

| 2048 | 256 | 14 | 15 | 17 | 20 | 28 | 43 | 79 | - | ||

| 7936 | 256 | 16 | 19 | 26 | 39 | 68 | 136 | - | - | ||

| Gemma-7b-instrueren | ml.g5.12xgroot | 256 | 256 | 16 | 16 | 17 | 19 | 26 | 38 | 57 | 110 |

| 2048 | 256 | 17 | 19 | 23 | 32 | 52 | 119 | - | - | ||

| 7936 | 256 | 22 | 29 | 45 | 105 | 197 | - | - | - | ||

Verfijn Gemma met de SageMaker Python SDK

Vervolgens laten we u zien hoe u het Gemma 7B-instructiemodel kunt verfijnen op een dataset met conversatieindeling met behulp van QLoRA techniek. Zoals eerder vermeld, biedt JumpStart, vanwege de grote woordenschatgrootte van 256 en de contextlengte van 8, de volgende standaardconfiguraties voor QLoRA-fijnafstemming.

| Model ID | Standaard trainingsexemplaar | Maximale invoerreekslengte | Trainingsbatchgrootte per apparaat | Stappen voor accumulatie van gradiënten |

| knuffelgezicht-llm-gemma-2b | ml.g5.2xgroot | 1024 | 1 | 4 |

| knuffelgezicht-llm-gemma-2b-instruct | ml.g5.2xgroot | 1024 | 1 | 4 |

| knuffelgezicht-llm-gemma-7b | ml.g5.12xgroot | 2048 | 1 | 4 |

| knuffelgezicht-llm-gemma-7b-instruct | ml.g5.12xgroot | 2048 | 1 | 4 |

Laten we de dataset in conversatieformaat laden en verwerken. De voorbeeldgegevensset voor deze demonstratie is De TOP-1 gespreksthreads van OpenAssistant.

De trainingsgegevens moeten worden geformuleerd in JSON-regels (.jsonl)-indeling, waarbij elke regel een woordenboek is dat een reeks gesprekken vertegenwoordigt. Hieronder ziet u een voorbeeld binnen het JSON-regelsbestand. Voor meer informatie over het verwerken van de gegevensset raadpleegt u het notitieblok in GitHub.

Als basis voor de trainingsscripts maakt JumpStart gebruik van HuggingFace SFTTrainer Met QLoRA en FlashAandacht. Flash Attention maakt schaalefficiëntie mogelijk, wat leidt tot snellere training en gevolgtrekking. Naast op chat gebaseerde verfijning ondersteunt JumpStart ook de verfijning van instructies en domeinaanpassing met QLoRA. Voor details, zie het notitieboekje in GitHub.

Na de verfijning kunt u het verfijnde model implementeren op een SageMaker-eindpunt.

U kunt ervoor kiezen om het model te implementeren dat is afgestemd op gespreksgegevens in het SageMaker-eindpunt HuggingFace-berichten API-functie als alternatieve aanpak. Het voordeel van het gebruik van de Message API-functie is dat gebruikers hiermee de queryvoorbeelden in onbewerkte indeling kunnen doorgeven, zoals weergegeven in de volgende tabel, en dat chat_template binnen het eindpunt de queryvoorbeelden naar de juiste indeling zal converteren voordat ze naar het model worden verzonden. Zie voor meer informatie de implementatiesectie na het afstemmen in de notitieboekje.

Nadat u het verfijnde model op een eindpunt hebt geïmplementeerd, kunt u de uitvoerreacties van vooraf getrainde en verfijnde Gemma-modellen vergelijken. De voorbeelden zijn verzameld uit testgegevens, wat een uithoudingsset is uit de trainingsgegevens. De gevolgtrekkingsparameters zijn max_tokens als 512, top_p als 0.9, temperature als 0.4, en top_k als 50.

Zoals u kunt zien aan de resultaten van de fijnafstemming, zijn de antwoorden van de agenten nauwkeuriger.

Om uw verfijnde modellen verder te evalueren, kunt u verkennen FM-evaluatie met Amazon SageMaker Clarify om te zien hoe uw verfijnde model presteert in vergelijking met het basismodel.

| Ingangen | Grond waarheid | Antwoord van baseren model | Reactie van verfijnd model | |

| 1 |

Gebruiker: Ik wil aan mijn woordenschat werken. Kunt u mij enkele eenvoudige manieren geven waarop ik nieuwe woorden kan vinden die ik kan gebruiken om de diversiteit van mijn zinnen te vergroten? Assistent: Zeker! Het verbeteren van je woordenschat is een continu proces, maar hier zijn enkele eenvoudige manieren om nieuwe woorden te vinden en de diversiteit van je zinnen te vergroten: 1. Veel lezen: Door boeken, artikelen en blogs uit verschillende genres en onderwerpen te lezen, maak je kennis met nieuwe woorden en zinsneden. Noteer alle onbekende woorden die je tegenkomt en zoek de betekenis ervan op. 2. Gebruik een thesaurus: Wanneer u schrijft of leest, gebruik dan een thesaurus om synoniemen voor veelgebruikte woorden te vinden. Dit helpt je niet alleen nieuwe woorden te leren, maar vergroot ook je begrip van hun subtiele verschillen in betekenis. 3. Woord-per-dag-kalenders of -apps: Abonneer u op een woord-per-dag-e-mail of download een app voor het opbouwen van woordenschat. Met deze hulpmiddelen maakt u elke dag kennis met een nieuw woord, samen met de betekenis, uitspraak en gebruiksvoorbeelden. 4. Word lid van een boekenclub of discussiegroep: Door deel te nemen aan gesprekken en discussies over boeken, artikelen of welk ander onderwerp dan ook, wordt u blootgesteld aan verschillende perspectieven en nieuwe woordenschat. Luister aandachtig naar anderen en probeer nieuwe woorden in hun context te gebruiken. 5. Speel woordspelletjes: Spellen als Scrabble, Boggle en kruiswoordpuzzels dagen je woordenschat uit en helpen je op een leuke manier nieuwe woorden te leren. 6. Bekijk films, tv-programma's of documentaires: Visuele media gebruiken vaak uiteenlopende taal, jargon en jargon. Door films, tv-programma's of documentaires met ondertiteling te bekijken, kunt u nieuwe woorden beter begrijpen en onthouden. 7. Oefen met schrijven: Regelmatig schrijven van verhalen, essays of dagboekaantekeningen moedigt je aan om nieuwe woorden en zinsneden te gebruiken. Experimenteer met verschillende schrijfstijlen en genres om je woordenschat uit te breiden. 8. Leer de etymologie van een nieuw woord: Als u de oorsprong en geschiedenis van een woord begrijpt, kan het gemakkelijker worden onthouden en correct worden gebruikt. Onderzoek naar de etymologie stelt je ook bloot aan verwante woorden en concepten. 9. Gebruik flashcards of software voor herhaalde herhaling: Maak flashcards met nieuwe woorden, hun betekenis en voorbeeldzinnen. Bekijk ze regelmatig of gebruik gespreide herhalingssoftware zoals Anki om uw leerproces te optimaliseren. 10. Stel persoonlijke doelen: Stel haalbare doelen, zoals het leren van vijf nieuwe woorden per week. Houd uw voortgang bij en beloon uzelf voor het behalen van uw doelen. Door deze strategieën consequent in uw dagelijkse routine op te nemen, bouwt u geleidelijk aan een divers en robuust vocabulaire op. Gebruiker: Hm, ik vind het idee van lezen erg leuk. Kun je mij een coole sciencefictionthriller aanbevelen die ik kan lezen? |

Assistent: Zeker! Hier zijn een paar aanbevelingen voor sciencefictionthrillers die je misschien leuk vindt: 1. “The Three-Body Problem” door Liu Cixin – Deze bekroonde roman onderzoekt het eerste contact tussen de mensheid en een buitenaardse beschaving, en de politieke en persoonlijke gevolgen die daaruit voortvloeien. Het is een aangrijpend en tot nadenken stemmend boek dat dieper ingaat op vragen over de aard van het bestaan en het universum. 2. “Annihilation” door Jeff Vandermeer – Deze roman volgt een groep wetenschappers terwijl ze zich begeven in een mysterieus gebied dat bekend staat als “Area X”, waar ze vreemde en verontrustende verschijnselen tegenkomen. Terwijl ze dieper het gebied induiken, beginnen ze duistere geheimen te ontdekken over de aard van de werkelijkheid en de wereld om hen heen. 3. “Dark Matter” door Blake Crouch – Deze roman volgt een briljante natuurkundige genaamd Jason Dessen, die wordt ontvoerd en getransporteerd naar een parallel universum. Terwijl hij de weg terug probeert te vinden naar zijn eigen realiteit, moet hij zijn eigen keuzes en de gevolgen van zijn daden onder ogen zien. 4. “The Andromeda Strain” door Michael Crichton – Deze klassieke roman volgt een team van wetenschappers terwijl ze proberen een dodelijke buitenaardse microbe die op aarde is geland, in bedwang te houden en te bestuderen. Terwijl ze tegen de klok racen om een manier te vinden om de microbe te neutraliseren, krijgen ze ook te maken met politieke intriges en persoonlijke conflicten. 5. “Ready Player One” door Ernest Cline – Deze roman speelt zich af in een dystopische toekomst waarin de meerderheid van de bevolking hun tijd doorbrengt in een virtual reality-wereld die bekend staat als de OASIS. Wanneer de maker van de OASIS sterft en een uitdaging achter zich laat om een verborgen paasei te vinden, begint een jonge hoofdpersoon aan een spannende zoektocht die zijn leven voor altijd zal veranderen. Ik hoop dat een van deze aanbevelingen uw interesse wekt! |

Assistent: De tekst bevat geen informatie over uw leesvoorkeuren of interesses, daarom kan ik geen boekaanbeveling geven. |

Assistent: Natuurlijk, hier zijn een paar aanbevelingen voor sciencefictionthrillers die je misschien leuk vindt: – “Dune” door Frank Herbert: Deze epische sciencefictionroman speelt zich af op de woestijnplaneet Arrakis, waar een jonge prins genaamd Paul Atreides de uitdagingen van een vijandige omgeving en een verraderlijk politiek landschap onder ogen moet zien. – “The Martian” door Andy Weir: Deze aangrijpende sciencefictionthriller volgt het verhaal van Mark Watney, een astronaut die op Mars is gestrand na een stofstorm, terwijl hij zijn vindingrijkheid en vindingrijkheid gebruikt om te overleven en uiteindelijk terug te keren naar de aarde. – “The Time Machine” door HG Wells: Deze klassieke sciencefictionroman hanteert een filosofische benadering van het concept van tijdreizen en onderzoekt de gevolgen van het veranderen van het verleden en de toekomst. – “The Blade Runner” door Philip K. Dick: Deze neo-noir sciencefictionroman, die zich afspeelt in het futuristische Los Angeles, onderzoekt het snijvlak van menselijke en kunstmatige intelligentie, en de invloed ervan op de samenleving en de aard van de werkelijkheid. – “The Androids” door Isaac Asimov: Deze sciencefictionroman onderzoekt het concept van kunstmatige intelligentie en de mogelijke gevolgen ervan, vooral wanneer mensen geavanceerde androïden ontwikkelen die traditionele menselijke waarden en overtuigingen uitdagen. Dit zijn slechts een paar suggesties, en uiteindelijk hangt het beste boek voor jou af van je persoonlijke voorkeuren en wat voor soort ervaring je zoekt in een sciencefictionthriller. Maar ik hoop dat deze aanbevelingen je een goed startpunt geven om het genre te verkennen. Laat het me weten als u nog vragen heeft of als ik u ergens mee kan helpen. |

| 2 |

Gebruiker: Schrijf een Hello World-programma in VB.NET Assistent: Alsjeblieft: “`vbnet Gebruiker: Zorg ervoor dat er invoer nodig is van de $ en zeg dan “Hallo, $” in plaats van “Hallo, Wereld!” |

Assistent: Publieke Module HelloWorld Openbare subhoofd() System.Console.WriteLine(“Wat is uw naam?”) Dim-naam As String = System.Console.ReadLine() System.Console.WriteLine(“Hallo, ” & naam & “!”) End Sub Eindmodule |

Assistent: “`vbnet Publieke module HelloWorld Openbare subhoofd() Dim-naam As String = Console.ReadLine() Console.WriteLine(“Hallo, ” & naam) End Sub Eindmodule |

Assistent: Zeker! Hier is een voorbeeld: “`vbnet |

| 3 |

Gebruiker: Geef me een lijst met taken die ik moet doen bij het starten van een project om een groot taalmodel te trainen dat menselijke vragen kan begrijpen en erop kan reageren Assistent: De volgende stappen zijn een verkorte lijst met stappen die u moet nemen bij het starten van een project om een groot taalmodel te trainen dat menselijke vragen kan begrijpen en erop kan reageren: 1. Bepaal de reikwijdte en doelstellingen van het project en de doelgroep. Dit zou u een basisidee moeten geven van wat de vereiste stappen zijn. Moet ik op een van de punten dieper ingaan? Gebruiker: Deze taken moeten verder worden uitgesplitst. Kunt u een bijgewerkte takenlijst verstrekken met een gedetailleerder overzicht van de komende taken? |

Assistent: Hier is een gedetailleerder overzicht van elke stap: 1. Stel de reikwijdte en doelstellingen van het project vast: Het is belangrijk om de doelstellingen van het project duidelijk te definiëren en wat de doelgroep is. Dit zal u helpen beslissingen te nemen over welk type gegevens u wilt verzamelen en welke modelarchitectuur geschikt is. 2. Gegevens verzamelen en voorbewerken: Dit is een belangrijke stap omdat de kwaliteit en diversiteit van de gegevens rechtstreeks van invloed zullen zijn op de prestaties van het model. Bij de voorverwerking kan het gaan om het opschonen van de gegevens, het tokeniseren van tekst en het omzetten van woorden in numerieke representaties. 3. Modelarchitectuur selecteren: Er zijn veel verschillende soorten modellen waaruit u kunt kiezen, waaronder terugkerende neurale netwerken (RNN's), transformatormodellen en convolutionele neurale netwerken (CNN's). De keuze zal afhangen van de specifieke vereisten van het project en de hoeveelheid beschikbare gegevens. 4. Verdeel de dataset en implementeer gegevensvergroting: het opsplitsen van de gegevens in trainings-, validatie- en testsubsets is belangrijk voor het monitoren van de prestaties van het model tijdens de training. Gegevensvergroting kan worden gebruikt om de omvang van de dataset kunstmatig te vergroten en de robuustheid van het model te verbeteren. 5. Model trainen en voortgang bewaken: Deze stap omvat het trainen van het model op basis van de trainingsgegevens, waarbij de validatieset wordt gebruikt om de voortgang te bewaken en indien nodig hyperparameters aan te passen. Het kan nodig zijn om dit proces meerdere keren te herhalen totdat het model goed presteert op de validatieset. 6. Evalueer het model op een testset: Zodra het model is getraind, is het belangrijk om de prestaties ervan op een afzonderlijke testset te evalueren om een idee te krijgen van het generalisatievermogen ervan. Dit kan worden gedaan door de voorspellingen van het model te vergelijken met de werkelijke uitkomsten en de fouten te analyseren. 7. Verfijnen voor specifieke taken of domeinen: Deze stap omvat het verder trainen van het model op taakspecifieke gegevens om de prestaties voor een bepaald domein te verbeteren. Dit kan worden gedaan door middel van transfer learning, waarbij een vooraf getraind model wordt verfijnd op basis van nieuwe gegevens, of door middel van verfijning, waarbij het model helemaal opnieuw wordt getraind op de nieuwe gegevens. 8. Creëer een interface voor gebruikersinvoer: Dit omvat het ontwerpen van een interface waarmee gebruikers vragen of verzoeken kunnen invoeren en antwoorden van het model kunnen ontvangen. 9. Testen in een gecontroleerde omgeving: Voordat u het model in een echte omgeving implementeert, is het belangrijk om het in een gecontroleerde omgeving te testen en feedback van gebruikers te verzamelen. Dit zal helpen eventuele fouten of vertekeningen in het model te identificeren en mogelijkheden voor verbetering te bieden. 10. Prestaties voortdurend monitoren en verbeteren: Ten slotte is het belangrijk om de prestaties van het model voortdurend te monitoren en indien nodig updates en verbeteringen aan te brengen. Dit kan inhouden dat het model opnieuw moet worden getraind op basis van nieuwe gegevens, hyperparameters moet worden verfijnd of de architectuur moet worden bijgewerkt. |

Assistent: ## Takenlijst voor het trainen van een groot taalmodel voor het beantwoorden van vragen **1. Projectomvang en doelstellingen:** * Definiëren van projectdoelen en gewenste functionaliteiten. **2. Gegevensverzameling en voorverwerking:** * Identificeer bronnen voor trainingsgegevens en verzamel een gevarieerde tekstdataset. **3. Modelselectie en configuratie:** * Selecteer een geschikte modelarchitectuur op basis van de taakcomplexiteit en gewenste prestaties. **4. Training & Evaluatie:** * Verdeel de trainingsgegevens in subsets voor training, validatie en testen. **5. Verfijning en interface-ontwikkeling:** * Verfijn het model voor specifieke taken of domeinen door middel van transferleren. **6. Testen & Verbeteren:** * Test het model in een gecontroleerde omgeving met verschillende invoerscenario's. **Aanvullende overwegingen:** * Stel een tijdlijn en budget in voor het project. **Opmerking:** Deze lijst is niet uitputtend en moet mogelijk worden aangepast op basis van de specifieke projectvereisten. |

Assistent: Natuurlijk, hier is een gedetailleerder overzicht van de taken die betrokken zijn bij het trainen van een groot taalmodel om menselijke vragen te begrijpen en erop te reageren: **1. Bepaal de reikwijdte en doelstellingen van het project** **2. Verzamel en voorbewerk een uitgebreide/gediversifieerde tekstdataset** **3. Selecteer een geschikte modelarchitectuur, pas hyperparameters aan voor nauwkeurigheid/snelheid** **4. Verdeel de dataset in training, validatie, testen van subsets, implementeer data-augmentatie** **5. Treinmodel, voortgang bewaken op validatieset, aanpassen indien nodig** **6. Evalueer het model op de testset, vergelijk het met benchmarks, analyseer fouten en vooroordelen** **7. Verfijn uw specifieke taken of domeinen door middel van transferleren of verfijning** **8. Creëer een interface voor gebruikersinvoer en modelreactie** **9. Test in een gecontroleerde omgeving, verzamel feedback voor verbetering** **10. Prestaties voortdurend monitoren en verbeteren door middel van omscholing en verfijning** Dit zijn de stappen die betrokken zijn bij het trainen van een groot taalmodel om menselijke vragen te begrijpen en erop te reageren. Laat het me weten als je vragen hebt. |

Opruimen

Nadat u de eindpunten hebt getest, verwijdert u de SageMaker-inferentie-eindpunten en het model om te voorkomen dat er kosten in rekening worden gebracht.

Conclusie

In dit bericht hebben we u laten zien hoe u aan de slag kunt gaan met Gemma in SageMaker Studio en het model voor gevolgtrekking kunt inzetten. We hebben u ook laten zien hoe u Gemma-modellen kunt verfijnen op SageMaker Jumpstart.

Omdat basismodellen vooraf zijn getraind, kunnen ze de training- en infrastructuurkosten helpen verlagen en maatwerk voor uw gebruiksscenario mogelijk maken. Bezoek nu SageMaker JumpStart in SageMaker Studio om aan de slag te gaan.

Deze handleiding is alleen voor informatieve doeleinden. U dient nog steeds uw eigen onafhankelijke beoordeling uit te voeren en maatregelen te nemen om ervoor te zorgen dat u voldoet aan uw eigen specifieke praktijken en normen voor kwaliteitscontrole, en aan de lokale regels, wetten, voorschriften, licenties en gebruiksvoorwaarden die van toepassing zijn op u, uw inhoud en het model van derden waarnaar in deze leidraad wordt verwezen. AWS heeft geen controle over of autoriteit over het model van derden waarnaar in deze handleiding wordt verwezen, en geeft geen verklaringen of garanties dat het model van derden veilig, virusvrij, operationeel of compatibel met uw productieomgeving en standaarden is. AWS geeft geen verklaringen, garanties of garanties dat enige informatie in deze handleiding zal resulteren in een bepaald resultaat of resultaat.

Over de auteurs

Dr Kyle Ulrich is een Applied Scientist met de Ingebouwde algoritmen van Amazon SageMaker team. Zijn onderzoeksinteresses omvatten schaalbare machine learning-algoritmen, computervisie, tijdreeksen, Bayesiaanse niet-parametrische gegevens en Gaussiaanse processen. Zijn PhD is van Duke University en hij heeft artikelen gepubliceerd in NeurIPS, Cell en Neuron.

Dr Kyle Ulrich is een Applied Scientist met de Ingebouwde algoritmen van Amazon SageMaker team. Zijn onderzoeksinteresses omvatten schaalbare machine learning-algoritmen, computervisie, tijdreeksen, Bayesiaanse niet-parametrische gegevens en Gaussiaanse processen. Zijn PhD is van Duke University en hij heeft artikelen gepubliceerd in NeurIPS, Cell en Neuron.

Dr Xin Huang is een Senior Applied Scientist voor Amazon SageMaker JumpStart en Amazon SageMaker ingebouwde algoritmen. Hij richt zich op het ontwikkelen van schaalbare machine learning-algoritmen. Zijn onderzoeksinteresses liggen op het gebied van natuurlijke taalverwerking, verklaarbaar diep leren op tabelgegevens en robuuste analyse van niet-parametrische ruimte-tijd clustering. Hij heeft veel artikelen gepubliceerd in ACL-, ICDM-, KDD-conferenties en Royal Statistical Society: Series A.

Dr Xin Huang is een Senior Applied Scientist voor Amazon SageMaker JumpStart en Amazon SageMaker ingebouwde algoritmen. Hij richt zich op het ontwikkelen van schaalbare machine learning-algoritmen. Zijn onderzoeksinteresses liggen op het gebied van natuurlijke taalverwerking, verklaarbaar diep leren op tabelgegevens en robuuste analyse van niet-parametrische ruimte-tijd clustering. Hij heeft veel artikelen gepubliceerd in ACL-, ICDM-, KDD-conferenties en Royal Statistical Society: Series A.

Rachna Chadha is een Principal Solution Architect AI/ML in Strategic Accounts bij AWS. Rachna is een optimist die gelooft dat ethisch en verantwoord gebruik van AI de samenleving in de toekomst kan verbeteren en economische en sociale welvaart kan brengen. In haar vrije tijd brengt Rachna graag tijd door met haar familie, wandelen en luisteren naar muziek.

Rachna Chadha is een Principal Solution Architect AI/ML in Strategic Accounts bij AWS. Rachna is een optimist die gelooft dat ethisch en verantwoord gebruik van AI de samenleving in de toekomst kan verbeteren en economische en sociale welvaart kan brengen. In haar vrije tijd brengt Rachna graag tijd door met haar familie, wandelen en luisteren naar muziek.

Evan Kravitz is een software-engineer bij Amazon Web Services en werkt aan SageMaker JumpStart. Hij houdt van koken en hardlopen in New York City.

Evan Kravitz is een software-engineer bij Amazon Web Services en werkt aan SageMaker JumpStart. Hij houdt van koken en hardlopen in New York City.

Dr Ashish Khetan is een Senior Applied Scientist met ingebouwde algoritmen van Amazon SageMaker en helpt bij het ontwikkelen van algoritmen voor machine learning. Hij promoveerde aan de Universiteit van Illinois in Urbana-Champaign. Hij is een actief onderzoeker op het gebied van machine learning en statistische inferentie, en heeft veel artikelen gepubliceerd op NeurIPS-, ICML-, ICLR-, JMLR-, ACL- en EMNLP-conferenties.

Dr Ashish Khetan is een Senior Applied Scientist met ingebouwde algoritmen van Amazon SageMaker en helpt bij het ontwikkelen van algoritmen voor machine learning. Hij promoveerde aan de Universiteit van Illinois in Urbana-Champaign. Hij is een actief onderzoeker op het gebied van machine learning en statistische inferentie, en heeft veel artikelen gepubliceerd op NeurIPS-, ICML-, ICLR-, JMLR-, ACL- en EMNLP-conferenties.

- Door SEO aangedreven content en PR-distributie. Word vandaag nog versterkt.

- PlatoData.Network Verticale generatieve AI. Versterk jezelf. Toegang hier.

- PlatoAiStream. Web3-intelligentie. Kennis versterkt. Toegang hier.

- PlatoESG. carbon, CleanTech, Energie, Milieu, Zonne, Afvalbeheer. Toegang hier.

- Plato Gezondheid. Intelligentie op het gebied van biotech en klinische proeven. Toegang hier.

- Bron: https://aws.amazon.com/blogs/machine-learning/gemma-is-now-available-in-amazon-sagemaker-jumpstart/

- : heeft

- :is

- :niet

- :waar

- $UP

- 1

- 10

- 100

- 11

- 13

- 135

- 17

- 19

- 1900

- 250

- 28

- 29

- 31

- 39

- 41

- 50

- 7

- 8

- 9

- a

- vermogen

- Over

- boven

- ACCEPTEREN

- toegang

- de toegankelijkheid

- Account

- accounts

- ophoping

- nauwkeurigheid

- accuraat

- haalbare

- Bereikt

- acquisitie

- over

- acties

- actieve

- daadwerkelijk

- aanpassing

- toevoeging

- Daarnaast

- aanpassen

- vergevorderd

- voorschotten

- Na

- tegen

- Agent

- AI

- AI / ML

- vliegtuig

- algoritmen

- vreemd

- Alles

- toelaten

- toegestaan

- toestaat

- langs

- ook

- alternatief

- Amazone

- Amazon Sage Maker

- Amazon SageMaker JumpStart

- Amazon Web Services

- bedragen

- an

- analyse

- analyseren

- analyseert

- het analyseren van

- en

- en infrastructuur

- Andromeda

- Angeles

- aankondigen

- beantwoorden

- beantwoorden

- antwoorden

- elke

- iets

- api

- gebruiken

- toepassingen

- toegepast

- Solliciteer

- nadering

- benaderingen

- passend

- apps

- architectuur

- ZIJN

- GEBIED

- gebieden

- argument

- rond

- Kunst

- artikelen

- kunstmatig

- kunstmatige intelligentie

- AS

- vragen

- beoordeling

- Assistent

- astronaut

- At

- gehoor

- autoriteit

- geautomatiseerde

- Beschikbaar

- vermijd

- bekroonde

- AWS

- AWS-beheerconsole

- terug

- evenwichtige

- baseren

- gebaseerde

- basis-

- groeperen

- Bayesian

- BE

- omdat

- vaardigheden

- beginnen

- achter

- wezen

- overtuigingen

- gelooft

- onder

- benchmarking

- benchmarks

- voordeel

- behalve

- BEST

- Betere

- tussen

- vooringenomenheid

- vooroordelen

- Miljard

- miljarden

- BLAD

- Blok

- Blog

- blogs

- Bloeien

- lichaam

- boek

- Boeken

- Storing

- briljant

- brengen

- Bringing

- Brengt

- Kapot

- begroting

- bouw

- Gebouw

- bebouwd

- ingebouwd

- maar

- by

- kalenders

- Bellen

- Dit betekent dat we onszelf en onze geliefden praktisch vergiftigen.

- CAN

- kan niet

- canvas

- mogelijkheden

- in staat

- kaart

- geval

- gevallen

- Categorie

- voorzichtigheid

- cel

- uitdagen

- uitdagingen

- verandering

- kenmerken

- lasten

- de chat

- Controles

- keuze

- keuzes

- Kies

- Plaats

- Beschaving

- klasse

- klassiek

- schoon

- Schoonmaak

- duidelijk

- Klik

- club

- clustering

- code

- codering

- samenwerking

- komt

- algemeen

- vergelijken

- vergeleken

- vergelijken

- vergelijking

- verenigbaar

- compleet

- complexiteit

- ingewikkeldheid

- voldoen

- computer

- Computer visie

- concept

- concepten

- gelijktijdig

- conferenties

- Configuratie

- conflicten

- Gevolgen

- Overwegen

- overwegingen

- aangezien

- consistent

- bestaat uit

- troosten

- constante

- beperkingen

- contact

- bevatten

- Containers

- bevat

- strijden

- content

- verband

- doorlopend

- onder controle te houden

- gecontroleerd

- Gesprek

- spraakzaam

- conversaties

- converteren

- het omzetten van

- Coole

- correct

- Kosten

- kon

- en je merk te creëren

- Wij creëren

- Creatieve

- schepper

- kruiswoordraadsel

- curated

- nieuwsgierig

- Actueel

- Klanten

- maatwerk

- dagelijks

- dansen

- Donker

- gegevens

- datasets

- dag

- beslissingen

- deep

- diepgaand leren

- diepere

- DeepMind

- Standaard

- bepalen

- definieert

- delven

- duikt

- demonstratie

- afhangen

- implementeren

- ingezet

- het inzetten

- inzet

- WOESTIJN

- Design

- ontwerpen

- gewenste

- detail

- gedetailleerd

- gegevens

- Bepalen

- ontwikkelen

- ontwikkelde

- Ontwikkelaar

- het ontwikkelen van

- Ontwikkeling

- apparaat

- diagnose stellen

- Dialoog

- verschillen

- verschillen

- anders

- digitaal

- digitale kunst

- direct

- directory

- Onthul Nu

- discussie

- discussies

- ziekten

- duiken

- diversen

- Verscheidenheid

- verdelen

- do

- document

- documentaires

- doet

- domein

- domeinen

- gedaan

- beneden

- Download

- twee

- Hertog

- Duke universiteit

- gedurende

- Stof

- dystopische

- elk

- aarde

- gemakkelijker

- doeltreffendheid

- acht

- Empire

- in staat stellen

- maakt

- waardoor

- ontmoeting

- moedigt

- eind tot eind

- Endpoint

- boeiende

- ingenieur

- Verbetert

- en geniet van

- aangenaam

- verzekeren

- Milieu

- EPIC

- fouten

- essentieel

- oprichten

- ethisch

- schatten

- evalueren

- evaluatie

- uiteindelijk

- Alle

- voorbeeld

- voorbeelden

- opgewonden

- grondig

- vertoont

- bestaan

- bestaand

- Uitvouwen

- verwacht

- duur

- ervaring

- experiment

- deskundigen

- Verken

- verkent

- Verkennen

- Gezicht

- eerlijkheid

- vals

- familie

- sneller

- Kenmerk

- feedback

- Voeten

- weinig

- veld-

- vechten

- Dien in

- Tot slot

- VIND DE PLEK DIE PERFECT VOOR JOU IS

- bevindingen

- einde

- Voornaam*

- eerste contact

- geschikt

- vijf

- flash

- vlucht

- richt

- volgend

- volgt

- Voor

- altijd

- formaat

- Foundation

- Achtergrond

- openhartig

- oppompen van

- functie

- functionaliteiten

- functionaliteit

- functionerende

- verder

- toekomst

- futuristische

- Spellen

- verzamelen

- Gemini

- het genereren van

- generatief

- generatieve AI

- genre

- genres

- krijgen

- GitHub

- Geven

- gegeven

- Go

- Doelen

- gaan

- goed

- Kopen Google Reviews

- kreeg

- GPU

- genade

- geleidelijk

- groot

- geweldige kracht

- Groep

- garanties

- bewaker

- leiding

- gids

- leidend

- hand

- harnas

- Hebben

- he

- Hoogte

- hallo

- hulp

- helpt

- haar

- hier

- verborgen

- zijn

- geschiedenis

- hoop

- gehost

- Hoe

- How To

- Echter

- HTML

- HTTPS

- Naaf

- hubs

- KnuffelenGezicht

- menselijk

- Mensheid

- Mensen

- i

- ID

- idee

- identificeren

- if

- Illinois

- afbeeldingen

- Impact

- uitvoeren

- uitvoering

- importeren

- belangrijk

- verbeteren

- verbetering

- verbeteringen

- het verbeteren van

- in

- omvatten

- Inclusief

- opnemen

- Laat uw omzet

- onafhankelijk

- -industrie

- industriestandaarden

- beïnvloeden

- informatie

- Informatieve

- Infrastructuur

- vindingrijkheid

- Innovatie

- invoer

- ingangen

- vragen

- inzichten

- geinspireerd

- instantie

- verkrijgen in plaats daarvan

- integreren

- geïntegreerde

- Intelligentie

- aandachtig

- wisselwerking

- belangen

- Interface

- kruispunt

- in

- voorstellen

- intuïtief

- betrekken

- betrokken zijn

- gaat

- IT

- artikelen

- HAAR

- jargon

- mee

- tijdschrift

- jpg

- json

- voor slechts

- Houden

- Soort

- blijven

- kennis

- bekend

- kyle

- landing

- Landschap

- taal

- Groot

- groter

- Wachttijd

- gelanceerd

- Wetten

- leidend

- LEARN

- leren

- leert

- verlaten

- Lengte

- laten

- Niveau

- Hefboomwerking

- Vergunning

- licenties

- Life

- bliksem

- Bliksemsnel

- lichtgewicht

- als

- sympathieën

- Lijn

- lijnen

- Lijst

- luisteren

- Het luisteren

- luistert

- Lama

- laden

- lokaal

- plaats

- Kijk

- op zoek

- LOOKS

- de

- Los Angeles

- te verlagen

- machine

- machine learning

- Meerderheid

- maken

- kwaadaardig

- management

- handmatig

- veel

- Mark

- maart

- wiskunde

- maximaal

- Mei..

- me

- betekenis

- betekenissen

- maatregelen

- Media

- geneeskunde

- vergadering

- vermeld

- Bericht

- berichten

- methode

- Michael

- macht

- denken

- minuten

- ML

- model

- modellen

- Module

- monitor

- Grensverkeer

- meer

- meest

- Films

- Muziek

- Dan moet je

- my

- mysterieus

- naam

- Genoemd

- Naturel

- Natural Language Processing

- NATUUR

- noodzakelijk

- Noodzaak

- nodig

- behoeften

- netwerken

- neurale

- neurale netwerken

- nooit

- New

- New York

- new york city

- nacht

- geen

- nota

- notitieboekje

- roman

- nu

- aantal

- Oase

- object

- doelstellingen

- waarnemen

- of

- Aanbod

- vaak

- on

- eens

- EEN

- lopend

- Slechts

- operationele

- Kansen

- optimalisatie

- Optimaliseer

- Opties

- or

- bestellen

- herkomst

- OS

- Overige

- Overig

- uit

- Resultaat

- resultaten

- uitgang

- over

- het te bezitten.

- pagina

- papieren

- Parallel

- parameter

- parameters

- bijzonder

- vooral

- partijen

- passeren

- Voorbijgaand

- verleden

- pad

- patronen

- Paul

- Mensen

- voor

- Uitvoeren

- prestatie

- uitvoerend

- presteert

- persoonlijk

- perspectieven

- phd

- zinnen

- natuurkundige

- piloot

- plaats

- vliegtuig

- plannen

- Plato

- Plato gegevensintelligentie

- PlatoData

- Spelen

- speler

- dan

- punt

- punten

- politiek

- Populair

- bevolking

- Post

- potentieel

- energie

- praktijk

- praktijken

- Voorspellingen

- predictor

- voorkeuren

- voorbereiding

- mooi

- die eerder

- Prins

- Principal

- prints

- Verwerkt

- processen

- verwerking

- productie

- Programma

- Voortgang

- project

- prompts

- gepast

- welvaart

- zorgen voor

- providers

- biedt

- publiek

- in het openbaar

- gepubliceerde

- doeleinden

- puzzels

- Python

- pytorch

- kwaliteit

- queries

- vraag

- zoektocht

- vraag

- Contact

- snel

- heel

- Race

- gevolgen

- reeks

- liever

- Rauw

- het bereiken van

- Lees

- lezing

- echte wereld

- Realiteit

- werkelijk

- rijk

- reden

- ontvangen

- recent

- Aanbeveling

- aanbevelingen

- bevelen

- terugkerend

- referentie

- waarnaar wordt verwezen

- weerspiegelt

- regelmatig

- reglement

- verwant

- uitgebracht

- relevante

- niet vergeten

- herhaling

- vertegenwoordigen

- verzoeken

- nodig

- Voorwaarden

- onderzoek

- onderzoeker

- Reageren

- reageert

- antwoord

- reacties

- verantwoordelijkheid

- verantwoordelijk

- resultaat

- Resultaten

- beoordelen

- Belonen

- Stijgen

- robuust

- robuustheid

- Rol

- routine

- koninklijk

- reglement

- lopen

- loopt

- s

- veiliger

- sagemaker

- SageMaker Inferentie

- dezelfde

- Bespaar

- ervaren

- schaalbare

- Scale

- balans

- scaling

- scenario's

- sci-fi

- Wetenschap

- Wetenschapper

- wetenschappers

- omvang

- krassen

- script

- scripts

- sdk

- naadloos

- zoeken

- Tweede

- geheimen

- sectie

- beveiligen

- zien

- kiezen

- gekozen

- selecteren

- selectie

- verzending

- senior

- apart

- Volgorde

- -Series

- Serie A

- Diensten

- serveer-

- Sessie

- reeks

- Sets

- het instellen van

- verscheidene

- gedeeld

- moet

- tonen

- vertoonde

- tonen

- getoond

- Shows

- kant

- gelijk

- Eenvoudig

- single

- Maat

- maten

- vaardigheden

- So

- Social

- Maatschappij

- Software

- Software Engineer

- oplossing

- Oplossingen

- sommige

- bronnen

- Sparks

- specifiek

- snelheid

- Uitgaven

- besteedt

- staan

- normen

- gestart

- Start

- Land

- state-of-the-art

- Statement

- statistisch

- Stap voor

- Stappen

- Still

- Blog

- Storm

- Verhaal

- vreemd

- strategisch

- strategieën

- Draad

- sterke

- studio

- Studie

- abonneren

- ondertitels

- geslaagd

- dergelijk

- geschikt

- ondersteuning

- ondersteunde

- Ondersteuning

- steunen

- zeker

- te overleven

- system

- tafel

- Nemen

- neemt

- verhaal

- doelwit

- doelen

- Taak

- taken

- team

- teams

- techniek

- technieken

- Technologie

- sjabloon

- templates

- tensorflow

- termen

- proef

- getest

- Testen

- tekst

- neem contact

- dat

- De

- De omgeving

- De toekomst

- de wereld

- hun

- Ze

- zich

- harte

- Er.

- daarom

- Deze

- ze

- Derde

- derden

- van derden

- dit

- die

- gedachte

- tot nadenken stemmend

- duizend

- opwindend

- Door

- doorvoer

- niet de tijd of

- Tijdreeksen

- Tijdreizen

- tijdlijn

- keer

- naar

- teken

- tokenizing

- tokens

- vertelde

- tools

- tools

- onderwerp

- Totaal

- spoor

- traditioneel

- Trainen

- getraind

- Trainingen

- overdracht

- Overbrengen

- transformator

- Vertaling

- reizen

- Triljoen

- waar

- proberen

- toon

- tuned

- stemming

- tv

- twee

- type dan:

- types

- typisch

- typisch

- ui

- Tenslotte

- ontdekken

- voor

- begrijpen

- begrip

- onbekend

- Universum

- universiteit-

- ongeëvenaard

- tot

- onthulling

- bijgewerkt

- updates

- bijwerken

- us

- bruikbaarheid

- Gebruik

- .

- use case

- gebruikt

- Gebruiker

- gebruiksvriendelijke

- gebruikers

- toepassingen

- gebruik

- bevestiging

- Values

- variëteit

- divers

- onderneming

- versie

- Bekijk

- Virtueel

- Virtuele realiteit

- visie

- Bezoek

- visuele

- visuele media

- volume

- lopen

- willen

- garanties

- was

- Bekijk de introductievideo

- kijken

- Manier..

- manieren

- we

- web

- webservices

- Web-based

- week

- GOED

- Wells

- Wat

- Wat is

- wanneer

- telkens als

- of

- welke

- WIE

- breed

- wijd

- widget

- wil

- wijsheid

- Met

- binnen

- zonder

- Woord

- woorden

- Mijn werk

- workflow

- werkzaam

- wereld

- schrijven

- het schrijven van

- X

- york

- You

- jong

- Your

- jezelf

- zephyrnet