Dit bericht is mede geschreven door Jyoti Sharma en Sharmo Sarkar van Vericast.

Voor elk machine learning (ML)-probleem begint de datawetenschapper met het werken met data. Dit omvat het verzamelen, onderzoeken en begrijpen van de zakelijke en technische aspecten van de gegevens, samen met de evaluatie van eventuele manipulaties die nodig kunnen zijn voor het modelbouwproces. Eén aspect van deze gegevensvoorbereiding is feature-engineering.

Functie-engineering verwijst naar het proces waarbij relevante variabelen worden geïdentificeerd, geselecteerd en gemanipuleerd om de ruwe gegevens om te zetten in nuttiger en bruikbaardere vormen voor gebruik met het ML-algoritme dat wordt gebruikt om een model te trainen en er gevolgtrekkingen op te maken. Het doel van dit proces is om de prestaties van het algoritme en het resulterende voorspellende model te verbeteren. Het feature-engineeringproces omvat verschillende fasen, waaronder het maken van features, datatransformatie, feature-extractie en feature-selectie.

Het bouwen van een platform voor gegeneraliseerde feature-engineering is een veel voorkomende taak voor klanten die veel ML-modellen met verschillende datasets moeten produceren. Dit soort platform omvat de creatie van een programmatisch gestuurd proces om gefinaliseerde, feature-engineered data te produceren die klaar zijn voor modeltraining met weinig menselijke tussenkomst. Het generaliseren van feature-engineering is echter een uitdaging. Elk bedrijfsprobleem is anders, elke dataset is anders, de datavolumes variëren enorm van klant tot klant, en de datakwaliteit en vaak de kardinaliteit van een bepaalde kolom (in het geval van gestructureerde data) kunnen een belangrijke rol spelen in de complexiteit van de feature-engineering. proces. Bovendien kan de dynamische aard van de gegevens van een klant ook resulteren in een grote variatie in de verwerkingstijd en middelen die nodig zijn om de feature-engineering optimaal te voltooien.

AWS-klant Vericast is een bedrijf voor marketingoplossingen dat datagestuurde beslissingen neemt om de marketing-ROI voor zijn klanten te vergroten. Het interne cloudgebaseerde Machine Learning Platform van Vericast, gebouwd rond het CRISP-ML(Q)-proces, maakt gebruik van verschillende AWS-services, waaronder Amazon Sage Maker, Amazon SageMaker-verwerking, AWS Lambda en AWS Stap Functies, om de best mogelijke modellen te produceren die zijn afgestemd op de gegevens van de specifieke klant. Dit platform is gericht op het vastleggen van de herhaalbaarheid van de stappen die nodig zijn voor het bouwen van verschillende ML-workflows en het bundelen ervan in standaard generaliseerbare workflowmodules binnen het platform.

In dit bericht delen we hoe Vericast feature-engineering heeft geoptimaliseerd met behulp van SageMaker Processing.

Overzicht oplossingen

Het Machine Learning Platform van Vericast helpt bij de snellere implementatie van nieuwe bedrijfsmodellen op basis van bestaande workflows of snellere activering van bestaande modellen voor nieuwe klanten. Een model dat de neiging tot direct mail voorspelt, is bijvoorbeeld heel anders dan een model dat de gevoeligheid van kortingsbonnen voorspelt van de klanten van een Vericast-klant. Ze lossen verschillende bedrijfsproblemen op en hebben daarom verschillende gebruiksscenario's in een marketingcampagne-ontwerp. Maar vanuit een ML-standpunt kunnen beide worden opgevat als binaire classificatiemodellen, en zouden daarom veel gemeenschappelijke stappen kunnen delen vanuit een ML-workflowperspectief, inclusief modelafstemming en -training, evaluatie, interpreteerbaarheid, implementatie en gevolgtrekking.

Omdat deze modellen binaire classificatieproblemen zijn (in ML-termen), verdelen we de klanten van een bedrijf in twee klassen (binair): degenen die positief op de campagne zouden reageren en degenen die dat niet zouden doen. Bovendien worden deze voorbeelden als een onevenwichtige classificatie beschouwd, omdat de gegevens die worden gebruikt om het model te trainen niet een gelijk aantal klanten zouden bevatten die wel en niet positief zouden reageren.

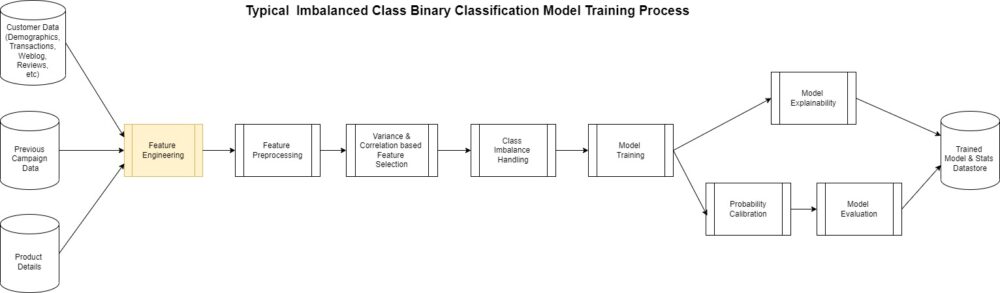

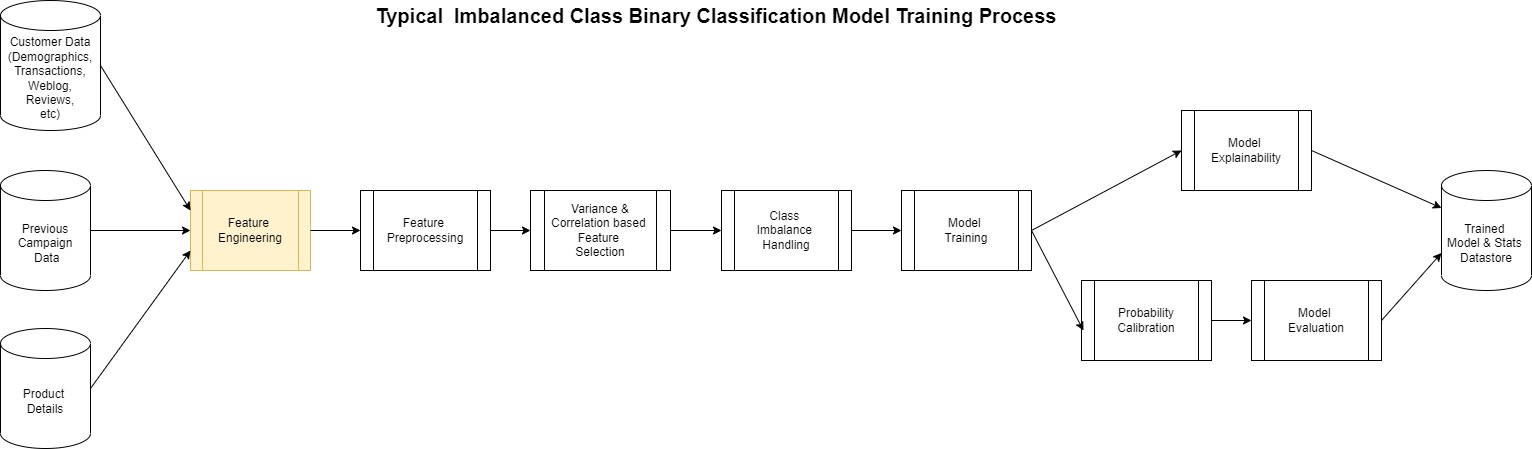

De daadwerkelijke creatie van een model als dit volgt het algemene patroon dat wordt weergegeven in het volgende diagram.

Het grootste deel van dit proces is hetzelfde voor elke binaire classificatie, met uitzondering van de feature engineering-stap. Dit is misschien wel de meest ingewikkelde maar soms over het hoofd geziene stap in het proces. ML-modellen zijn grotendeels afhankelijk van de functies die zijn gebruikt om ze te maken.

Het cloud-native Machine Learning Platform van Vericast heeft tot doel de functie-engineeringstappen voor verschillende ML-workflows te generaliseren en te automatiseren en de prestaties ervan te optimaliseren op basis van kosten versus tijd door gebruik te maken van de volgende functies:

- De technische bibliotheek met functies van het platform – Dit bestaat uit een steeds evoluerende reeks transformaties die zijn getest om generaliseerbare kenmerken van hoge kwaliteit op te leveren op basis van specifieke klantconcepten (bijvoorbeeld demografische gegevens van klanten, productdetails, transactiedetails, enzovoort).

- Intelligente resource-optimalisaties – Het platform maakt gebruik van de on-demand infrastructuurcapaciteit van AWS om het meest optimale type verwerkingsbronnen voor de specifieke functie-engineeringtaak op te zetten, op basis van de verwachte complexiteit van de stap en de hoeveelheid gegevens die nodig is om er doorheen te werken.

- Dynamische schaalvergroting van functie-engineeringtaken – Hiervoor wordt een combinatie van verschillende AWS-diensten gebruikt, maar met name SageMaker Processing. Dit zorgt ervoor dat het platform hoogwaardige functies op een kostenefficiënte en tijdige manier produceert.

Dit bericht concentreert zich op het derde punt in deze lijst en laat zien hoe u een dynamische schaalvergroting van SageMaker Processing-taken kunt bereiken om een beter beheerd, performant en kosteneffectief raamwerk voor gegevensverwerking voor grote datavolumes te realiseren.

SageMaker Processing maakt workloads mogelijk die stappen uitvoeren voor het voor- of nabewerken van gegevens, feature-engineering, gegevensvalidatie en modelevaluatie op SageMaker. Het biedt ook een beheerde omgeving en elimineert de complexiteit van ongedifferentieerd zwaar werk dat nodig is om de infrastructuur op te zetten en te onderhouden die nodig is om de werklasten uit te voeren. Bovendien biedt SageMaker Processing een API-interface voor het uitvoeren, monitoren en evalueren van de werklast.

Het uitvoeren van SageMaker-verwerkingstaken vinden volledig plaats binnen een beheerd SageMaker-cluster, waarbij individuele taken tijdens runtime in instancecontainers worden geplaatst. Het beheerde cluster, de instanties en de containers rapporteren metrische gegevens aan Amazon Cloud Watch, inclusief gebruik van GPU, CPU, geheugen, GPU-geheugen, schijfstatistieken en gebeurtenisregistratie.

Deze functies bieden voordelen voor de data-ingenieurs en wetenschappers van Vericast door te helpen bij de ontwikkeling van algemene preprocessing-workflows en door de moeilijkheid van het onderhouden van gegenereerde omgevingen waarin deze kunnen worden uitgevoerd, te abstraheren. Er kunnen zich echter technische problemen voordoen, gezien de dynamische aard van de gegevens en de gevarieerde kenmerken ervan die in een dergelijke algemene oplossing kunnen worden opgenomen. Het systeem moet een weloverwogen eerste inschatting maken van de grootte van het cluster en de instanties waaruit het bestaat. Deze gok moet de criteria van de gegevens evalueren en de CPU-, geheugen- en schijfvereisten afleiden. Deze gok kan volkomen passend zijn en adequaat presteren voor de taak, maar in andere gevallen is dit misschien niet het geval. Voor een bepaalde dataset en voorbewerkingstaak kan de CPU te klein zijn, wat resulteert in maximale verwerkingsprestaties en lange doorlooptijden. Erger nog, het geheugen kan een probleem worden, wat resulteert in slechte prestaties of onvoldoende geheugen, waardoor de hele taak mislukt.

Met deze technische hindernissen in het achterhoofd ging Vericast op zoek naar een oplossing. Ze moesten algemeen van aard blijven en passen in het grotere beeld van de voorverwerkingsworkflow, die flexibel was in de betrokken stappen. Het was ook belangrijk om een oplossing te bieden voor zowel de potentiële noodzaak om de omgeving op te schalen in gevallen waarin de prestaties in het gedrang kwamen, als om op een elegante manier te herstellen van een dergelijke gebeurtenis of wanneer een taak om welke reden dan ook voortijdig werd voltooid.

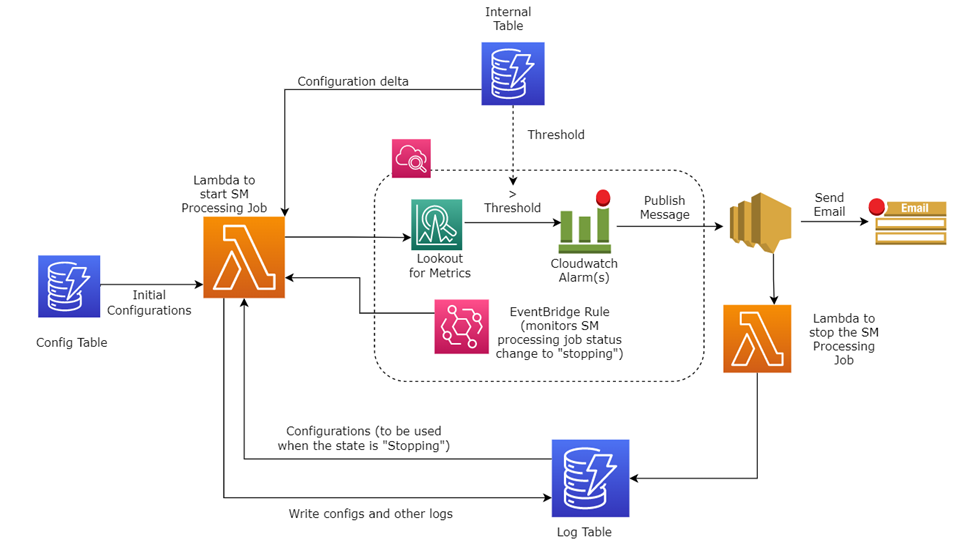

De oplossing die Vericast heeft gebouwd om dit probleem op te lossen, maakt gebruik van verschillende AWS-services die samenwerken om hun zakelijke doelstellingen te bereiken. Het is ontworpen om het SageMaker Processing-cluster opnieuw op te starten en op te schalen op basis van prestatiestatistieken die zijn waargenomen met behulp van Lambda-functies die de taken monitoren. Om geen werk te verliezen als er een schaalgebeurtenis plaatsvindt of om te herstellen van een taak die onverwachts stopt, is er een op checkpoints gebaseerde service geïmplementeerd die gebruikmaakt van Amazon DynamoDB en slaat de gedeeltelijk verwerkte gegevens op Amazon eenvoudige opslagservice (Amazon S3) bakken zodra de stappen zijn voltooid. Het uiteindelijke resultaat is een automatisch schaalbare, robuuste en dynamisch bewaakte oplossing.

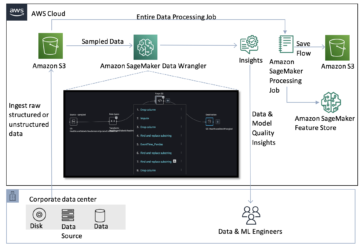

Het volgende diagram toont een overzicht op hoog niveau van hoe het systeem werkt.

In de volgende secties bespreken we de oplossingscomponenten in meer detail.

Initialiseren van de oplossing

Het systeem gaat ervan uit dat een afzonderlijk proces de oplossing initieert. Omgekeerd is dit ontwerp niet ontworpen om op zichzelf te werken, omdat het geen artefacten of output oplevert, maar eerder fungeert als een zijspanimplementatie voor een van de systemen die SageMaker Processing-taken gebruiken. In het geval van Vericast wordt de oplossing geïnitieerd door middel van een aanroep vanuit een Step Functions-stap die is gestart in een andere module van het grotere systeem.

Zodra de oplossing is gestart en een eerste run is geactiveerd, wordt een basisstandaardconfiguratie gelezen uit een DynamoDB-tabel. Deze configuratie wordt gebruikt om parameters in te stellen voor de SageMaker Processing-taak en heeft de initiële aannames van infrastructuurbehoeften. De taak SageMaker Processing is nu gestart.

Monitoring van metadata en output

Wanneer de taak start, schrijft een Lambda-functie de metagegevens van de taakverwerking (de huidige taakconfiguratie en andere loginformatie) naar de DynamoDB-logtabel. Deze metagegevens en loginformatie houden de geschiedenis van de taak bij, de initiële en doorlopende configuratie ervan, en andere belangrijke gegevens.

Op bepaalde punten, wanneer de stappen in de taak zijn voltooid, worden controlepuntgegevens toegevoegd aan de DynamoDB-logboektabel. Verwerkte uitvoergegevens worden indien nodig verplaatst naar Amazon S3 voor snel herstel.

Deze Lambda-functie stelt ook een Amazon EventBridge regel die de status van de actieve taak controleert. Met name houdt deze regel de taak in de gaten om te zien of de taakstatus verandert in stopping of bevindt zich in een stopped staat. Deze EventBridge-regel speelt een belangrijke rol bij het opnieuw starten van een taak als er een fout optreedt of als er een geplande automatische schalingsgebeurtenis plaatsvindt.

CloudWatch-statistieken monitoren

De Lambda-functie stelt ook een CloudWatch-alarm in op basis van een metrische wiskundige uitdrukking op de verwerkingstaak, die de statistieken van alle instanties controleert op CPU-gebruik, geheugengebruik en schijfgebruik. Dit type alarm (metrisch) maakt gebruik van CloudWatch-alarmdrempels. Het alarm genereert gebeurtenissen op basis van de waarde van de metriek of uitdrukking ten opzichte van de drempelwaarden over een aantal tijdsperioden.

In het gebruiksscenario van Vericast is de drempelexpressie ontworpen om de driver- en de executor-instanties als afzonderlijk te beschouwen, waarbij de statistieken voor elk afzonderlijk worden gecontroleerd. Door ze gescheiden te houden, weet Vericast waardoor het alarm wordt veroorzaakt. Dit is belangrijk om te beslissen hoe u dienovereenkomstig kunt schalen:

- Als de statistieken van de uitvoerder de drempel overschrijden, is het goed om horizontaal te schalen

- Als de driverstatistieken de drempel overschrijden, zal horizontaal schalen waarschijnlijk niet helpen, dus moeten we verticaal schalen

Expressie voor alarmstatistieken

Vericast heeft toegang tot de volgende statistieken bij de evaluatie van schaling en mislukking:

- CPU-gebruik – De som van het gebruik van elke individuele CPU-kern

- Geheugengebruik – Het percentage geheugen dat wordt gebruikt door de containers op een exemplaar

- Schijfgebruik – Het percentage schijfruimte dat wordt gebruikt door de containers op een exemplaar

- GPUGebruik – Het percentage GPU-eenheden dat door de containers op een exemplaar wordt gebruikt

- GPUGeheugengebruik – Het percentage GPU-geheugen dat door de containers in een exemplaar wordt gebruikt

Op het moment van schrijven denkt Vericast alleen na CPUUtilization, MemoryUtilization en DiskUtilization. In de toekomst willen ze nadenken GPUUtilization en GPUMemoryUtilization .

De volgende code is een voorbeeld van een CloudWatch-alarm op basis van een metrische wiskundige uitdrukking voor automatisch schalen van Vericast:

Deze uitdrukking illustreert dat het CloudWatch-alarm overweegt DriverMemoryUtilization (memoryDriver), CPUUtilization (cpuDriver), DiskUtilization (diskDriver), ExecutorMemoryUtilization (memoryExec), CPUUtilization (cpuExec) en DiskUtilization (diskExec) als monitoringstatistieken. Het getal 80 in de voorgaande uitdrukking staat voor de drempelwaarde.

Hier IF((cpuDriver) > 80, 1, 0 houdt in dat als het CPU-gebruik van het stuurprogramma de 80% overschrijdt, 1 wordt toegewezen als drempelwaarde, anders 0. IF(AVG(METRICS("memoryExec")) > 80, 1, 0 impliceert dat alle statistieken met string memoryExec daarin wordt gekeken en daarover wordt een gemiddelde berekend. Als dat gemiddelde geheugengebruikspercentage de 80 overschrijdt, wordt 1 toegewezen als drempelwaarde, anders 0.

De logische operator OR wordt in de expressie gebruikt om alle toepassingen in de expressie te verenigen; als een van de toepassingen de drempelwaarde bereikt, wordt het alarm geactiveerd.

Voor meer informatie over het gebruik van metrische alarmen van CloudWatch op basis van metrische wiskundige uitdrukkingen, raadpleegt u Een CloudWatch-alarm maken op basis van een metrische wiskundige uitdrukking.

CloudWatch-alarmbeperkingen

CloudWatch beperkt het aantal statistieken per alarm tot 10. Dit kan beperkingen veroorzaken als u met meer statistieken rekening moet houden.

Om deze beperking te ondervangen heeft Vericast alarmen ingesteld op basis van de totale clustergrootte. Per drie instanties wordt één alarm aangemaakt (voor drie instanties is er één alarm, omdat dat in totaal negen statistieken zou opleveren). Ervan uitgaande dat de bestuurdersinstantie afzonderlijk moet worden beschouwd, wordt er nog een afzonderlijk alarm aangemaakt voor de bestuurdersinstantie. Daarom is het totale aantal gegenereerde alarmen grofweg gelijk aan een derde van het aantal uitvoerende knooppunten en nog een extra voor de driverinstantie. In elk geval ligt het aantal statistieken per alarm onder de limiet van 10 metrische gegevens.

Wat gebeurt er bij een alarmstatus?

Als een vooraf bepaalde drempel wordt bereikt, gaat het alarm naar een alarm staat, die gebruikt Amazon eenvoudige meldingsservice (Amazon SNS) om meldingen te verzenden. In dit geval stuurt het een e-mailmelding naar alle abonnees met de details over het alarm in het bericht.

Amazon SNS wordt ook gebruikt als trigger voor een Lambda-functie die de momenteel actieve SageMaker Processing-taak stopt, omdat we weten dat de taak waarschijnlijk zal mislukken. Deze functie registreert ook logboeken in de logboektabel die betrekking hebben op de gebeurtenis.

De EventBridge-regel die bij het starten van de taak is ingesteld, merkt dat de taak in een stopping enkele seconden later aangeven. Deze regel voert vervolgens de eerste Lambda-functie opnieuw uit om de taak opnieuw te starten.

Het dynamische schaalproces

De eerste Lambda-functie na twee of meer keren draaien weet dat een vorige taak al was gestart en nu is gestopt. De functie doorloopt een soortgelijk proces waarbij de basisconfiguratie van de oorspronkelijke taak in de log DynamoDB-tabel wordt opgehaald en haalt ook de bijgewerkte configuratie op uit de interne tabel. Deze bijgewerkte configuratie is een resource delta-configuratie die is ingesteld op basis van het schaaltype. Het schaaltype wordt bepaald op basis van de alarmmetagegevens, zoals eerder beschreven.

De oorspronkelijke configuratie plus de bronnendelta worden gebruikt omdat een nieuwe configuratie en een nieuwe SageMaker Processing-taak worden gestart met de verhoogde bronnen.

Dit proces gaat door totdat de taak met succes is voltooid en kan indien nodig resulteren in meerdere herstarts, waarbij elke keer meer bronnen worden toegevoegd.

Het resultaat van Vericast

Deze op maat gemaakte oplossing voor automatisch schalen heeft een belangrijke rol gespeeld bij het robuuster en fouttoleranter maken van het Machine Learning Platform van Vericast. Het platform kan nu op een elegante manier workloads van verschillende datavolumes verwerken, met minimale menselijke tussenkomst.

Voordat deze oplossing werd geïmplementeerd, was het schatten van de resourcevereisten voor alle op Spark gebaseerde modules in de pijplijn een van de grootste knelpunten in het onboardingproces van nieuwe klanten. Workflows zouden mislukken als het datavolume van de klant zou toenemen, of de kosten zouden niet te rechtvaardigen zijn als het datavolume tijdens de productie zou afnemen.

Met deze nieuwe module zijn het aantal workflowfouten als gevolg van beperkte middelen met bijna 80% verminderd. De weinige resterende fouten zijn grotendeels te wijten aan AWS-accountbeperkingen en buiten het automatische schaalproces. De grootste overwinning van Vericast met deze oplossing is het gemak waarmee ze nieuwe klanten en workflows kunnen onboarden. Vericast verwacht het proces met minstens 60-70% te versnellen, waarbij er nog gegevens moeten worden verzameld voor een definitief getal.

Hoewel dit door Vericast als een succes wordt beschouwd, zijn er kosten aan verbonden. Gebaseerd op de aard van deze module en het concept van dynamisch schalen als geheel, duren de workflows doorgaans ongeveer 30% langer (gemiddeld) dan een workflow met een op maat afgestemd cluster voor elke module in de workflow. Vericast blijft zich op dit gebied optimaliseren en probeert de oplossing te verbeteren door op heuristiek gebaseerde broninitialisatie voor elke clientmodule op te nemen.

Sharmo Sarkar, Senior Manager, Machine Learning Platform bij Vericast, zegt: “Terwijl we ons gebruik van AWS en SageMaker blijven uitbreiden, wilde ik even de tijd nemen om het ongelooflijke werk van ons AWS Client Services Team, toegewijde AWS Solutions Architects, onder de aandacht te brengen. en AWS Professional Services waarmee we samenwerken. Hun diepgaande kennis van AWS en SageMaker stelde ons in staat een oplossing te ontwerpen die aan al onze behoeften voldeed en ons de flexibiliteit en schaalbaarheid bood die we nodig hadden. We zijn zo dankbaar dat we zo’n getalenteerd en deskundig ondersteuningsteam aan onze zijde hebben.”

Conclusie

In dit bericht hebben we gedeeld hoe SageMaker en SageMaker Processing Vericast in staat hebben gesteld een beheerd, performant en kosteneffectief dataverwerkingsframework voor grote datavolumes te bouwen. Door de kracht en flexibiliteit van SageMaker Processing te combineren met andere AWS-services, kunnen ze het algemene feature-engineeringproces eenvoudig monitoren. Ze kunnen automatisch potentiële problemen detecteren die worden veroorzaakt door een gebrek aan rekenkracht, geheugen en andere factoren, en indien nodig automatisch verticaal en horizontaal schalen implementeren.

SageMaker en zijn tools kunnen uw team ook helpen zijn ML-doelen te bereiken. Voor meer informatie over SageMaker Processing en hoe dit kan helpen bij uw gegevensverwerkingstaken, raadpleegt u Data verwerken. Als u net begint met ML en op zoek bent naar voorbeelden en begeleiding, Amazon SageMaker JumpStart kan u op weg helpen. JumpStart is een ML-hub van waaruit u toegang hebt tot ingebouwde algoritmen met vooraf getrainde basismodellen om u te helpen taken uit te voeren zoals het samenvatten van artikelen en het genereren van afbeeldingen, en vooraf gebouwde oplossingen om veelvoorkomende gebruiksscenario's op te lossen.

Tot slot: als dit bericht je helpt of inspireert om een probleem op te lossen, horen we dat graag! Deel uw opmerkingen en feedback.

Over de auteurs

Anthony McClure is een Senior Partner Solutions Architect bij het AWS SaaS Factory-team. Anthony heeft ook een sterke interesse in machine learning en kunstmatige intelligentie en werkt samen met de AWS ML/AI Technical Field Community om klanten te helpen bij het realiseren van hun machine learning-oplossingen.

Anthony McClure is een Senior Partner Solutions Architect bij het AWS SaaS Factory-team. Anthony heeft ook een sterke interesse in machine learning en kunstmatige intelligentie en werkt samen met de AWS ML/AI Technical Field Community om klanten te helpen bij het realiseren van hun machine learning-oplossingen.

Jyoti Sharma is een Data Science Engineer bij het machine learning platformteam van Vericast. Ze heeft een passie voor alle aspecten van datawetenschap en richt zich op het ontwerpen en implementeren van een zeer schaalbaar en gedistribueerd Machine Learning Platform.

Jyoti Sharma is een Data Science Engineer bij het machine learning platformteam van Vericast. Ze heeft een passie voor alle aspecten van datawetenschap en richt zich op het ontwerpen en implementeren van een zeer schaalbaar en gedistribueerd Machine Learning Platform.

Sharmo Sarkar is senior manager bij Vericast. Hij leidt het Cloud Machine Learning Platform en het Marketing Platform ML R&D-teams bij Vericast. Hij heeft uitgebreide ervaring met Big Data Analytics, Distributed Computing en Natural Language Processing. Buiten zijn werk houdt hij van motorrijden, wandelen en fietsen op bergpaden.

Sharmo Sarkar is senior manager bij Vericast. Hij leidt het Cloud Machine Learning Platform en het Marketing Platform ML R&D-teams bij Vericast. Hij heeft uitgebreide ervaring met Big Data Analytics, Distributed Computing en Natural Language Processing. Buiten zijn werk houdt hij van motorrijden, wandelen en fietsen op bergpaden.

- Door SEO aangedreven content en PR-distributie. Word vandaag nog versterkt.

- PlatoAiStream. Web3 gegevensintelligentie. Kennis versterkt. Toegang hier.

- De toekomst slaan met Adryenn Ashley. Toegang hier.

- Koop en verkoop aandelen in PRE-IPO-bedrijven met PREIPO®. Toegang hier.

- Bron: https://aws.amazon.com/blogs/machine-learning/how-vericast-optimized-feature-engineering-using-amazon-sagemaker-processing/

- : heeft

- :is

- :niet

- :waar

- $UP

- 1

- 10

- 100

- 15%

- 7

- a

- Over

- toegang

- dienovereenkomstig

- Account

- Bereiken

- Activering

- Handelingen

- toevoegen

- toegevoegd

- toe te voegen

- Extra

- voldoende

- Na

- tegen

- AIDS

- wil

- alarm

- algoritme

- algoritmen

- Alles

- alleen

- langs

- al

- ook

- Amazone

- Amazon Sage Maker

- bedragen

- an

- analytics

- en

- Nog een

- Anthony

- elke

- api

- passend

- architectuur

- ZIJN

- GEBIED

- rond

- dit artikel

- kunstmatig

- kunstmatige intelligentie

- AS

- verschijning

- aspecten

- toegewezen

- helpen

- At

- auto

- automatiseren

- webmaster.

- gemiddelde

- AWS

- AWS professionele services

- baseren

- gebaseerde

- BE

- omdat

- worden

- geweest

- wezen

- betekent

- BEST

- Verder

- Groot

- Big data

- Grootste

- boost

- zowel

- Bringing

- bouw

- Gebouw

- bebouwd

- ingebouwd

- bedrijfsdeskundigen

- maar

- by

- berekend

- Bellen

- Campagne

- CAN

- Kan krijgen

- Het vastleggen

- geval

- gevallen

- Veroorzaken

- veroorzakend

- zeker

- uitdagend

- Wijzigingen

- klasse

- klassen

- classificatie

- klant

- onboarding van de klant

- klanten

- Cloud

- TROS

- code

- Kolom

- combinatie van

- combineren

- komt

- opmerkingen

- Gemeen

- gemeenschap

- afstand

- compleet

- voltooit

- ingewikkeldheid

- ingewikkeld

- componenten

- Aangetast

- Berekenen

- computergebruik

- concept

- concepten

- Configuratie

- Overwegen

- beschouwd

- aangezien

- beschouwt

- beperkingen

- bevatten

- containers

- voortzetten

- blijft

- Kosten

- kostenefficient

- kon

- coupon

- en je merk te creëren

- aangemaakt

- het aanmaken

- criteria

- Cross

- Actueel

- Op dit moment

- gewoonte

- klant

- Klanten

- gegevens

- gegevens Analytics

- Data voorbereiding

- gegevensverwerking

- data science

- data scientist

- Gegevensgestuurde

- datasets

- beslissen

- beslissingen

- toegewijd aan

- deep

- Delta

- Demografie

- afhankelijk

- inzet

- beschreven

- Design

- ontworpen

- ontwerpen

- detail

- gegevens

- vastbesloten

- Ontwikkeling

- anders

- verschillend

- Moeilijkheid

- directe

- Korting

- bespreken

- verdeeld

- distributed computing

- gedreven

- bestuurder

- twee

- dynamisch

- dynamisch

- elk

- Vroeger

- gemak

- gemakkelijk

- beide

- ingeschakeld

- maakt

- ingenieur

- Engineering

- Ingenieurs

- waarborgt

- Geheel

- Milieu

- omgevingen

- gelijk

- Gelijkwaardig

- schatten

- evalueren

- evaluatie

- Event

- EVENTS

- voorbeeld

- voorbeelden

- Behalve

- bestaand

- Uitvouwen

- verwacht

- verwacht

- ervaring

- Verkennen

- uitdrukkingen

- uitgebreid

- Uitgebreide ervaring

- factoren

- fabriek

- FAIL

- Storing

- Kenmerk

- Voordelen

- Fed

- feedback

- weinig

- veld-

- finale

- afgerond

- Voornaam*

- geschikt

- Flexibiliteit

- flexibel

- gericht

- volgend

- volgt

- Voor

- formulieren

- Foundation

- Achtergrond

- oppompen van

- geheel

- functie

- functies

- Bovendien

- toekomst

- verzameling

- Algemeen

- gegenereerde

- genereert

- generatie

- krijgen

- het krijgen van

- gegeven

- Go

- doel

- Doelen

- Goes

- goed

- GPU

- dankbaar

- leiding

- HAD

- handvat

- gebeurt

- Hebben

- met

- he

- horen

- zwaar

- zwaar tillen

- hulp

- helpt

- high-level

- hoogwaardige

- Markeer

- zeer

- geschiedenis

- Horizontaal

- horizontaal

- Hoe

- How To

- Echter

- HTML

- http

- HTTPS

- Naaf

- menselijk

- Horden

- i

- geïdentificeerd

- if

- illustreert

- beeld

- uitvoeren

- uitvoering

- uitvoering

- belangrijk

- verbeteren

- in

- Anders

- omvat

- Inclusief

- opnemen

- Laat uw omzet

- meer

- ongelooflijk

- individueel

- individueel

- informatie

- Infrastructuur

- eerste

- ingewijden

- instantie

- instrumentaal

- Intelligentie

- voornemens zijn

- belang

- Interface

- intern

- tussenkomst

- in

- betrokken zijn

- kwestie

- problemen

- IT

- HAAR

- Jobomschrijving:

- Vacatures

- jpg

- voor slechts

- Soort

- blijven

- Gebrek

- taal

- Groot

- grotendeels

- groter

- later

- Leads

- LEARN

- leren

- minst

- Bibliotheek

- facelift

- beperking

- beperkingen

- grenzen

- Lijst

- Elke kleine stap levert grote resultaten op!

- inloggen

- logging

- logisch

- langer

- op zoek

- verliezen

- liefde

- machine

- machine learning

- onderhouden

- Het handhaven

- onderhoudt

- maken

- MERKEN

- maken

- beheerd

- manager

- gemanipuleerd

- manier

- veel

- Marketing

- wiskunde

- Mei..

- Maak kennis met

- Geheugen

- Bericht

- Metadata

- metriek

- Metriek

- macht

- denken

- minimaal

- ML

- model

- modellen

- Module

- Modules

- moment

- monitor

- bewaakt

- Grensverkeer

- monitors

- meer

- meest

- meestal

- Berg

- meervoudig

- Dan moet je

- Naturel

- Natural Language Processing

- NATUUR

- Noodzaak

- nodig

- nodig

- behoeften

- New

- knooppunten

- in het bijzonder

- Merk op..

- notificatie

- meldingen

- nu

- aantal

- doelstellingen

- waarnemen

- of

- vaak

- on

- On-Demand

- Aan boord

- Onboarding

- EEN

- lopend

- Slechts

- operator

- optimale

- Optimaliseer

- geoptimaliseerde

- or

- origineel

- Overige

- onze

- uit

- Resultaat

- uitgang

- buiten

- over

- totaal

- Overwinnen

- overzicht

- parameters

- deel

- bijzonder

- partner

- Voorbijgaand

- hartstochtelijk

- Patronen

- percentage

- Uitvoeren

- prestatie

- misschien

- periodes

- perspectief

- beeld

- pijpleiding

- plaats

- gepland

- platform

- platforms

- Plato

- Plato gegevensintelligentie

- PlatoData

- Spelen

- speelt

- dan

- plus

- punt

- punten

- arm

- mogelijk

- Post

- potentieel

- energie

- het voorspellen van

- vorig

- waarschijnlijk

- probleem

- problemen

- Verwerkt

- verwerking

- produceren

- Product

- productie

- professioneel

- zorgen voor

- mits

- biedt

- zetten

- kwaliteit

- Quick

- sneller

- R & D

- liever

- Rauw

- bereiken

- Lees

- klaar

- Realiteit

- reden

- archief

- Herstellen

- na een training

- Gereduceerd

- verwijst

- verwant

- relevante

- blijven

- resterende

- verslag

- nodig

- Voorwaarden

- hulpbron

- Resources

- Reageren

- resultaat

- verkregen

- robuust

- Rol

- ruw

- Regel

- lopen

- lopend

- SaaS

- sagemaker

- dezelfde

- zegt

- Schaalbaarheid

- schaalbare

- Scale

- scaling

- Schaaloplossing

- scenario's

- Wetenschap

- Wetenschapper

- wetenschappers

- seconden

- secties

- gekozen

- selectie

- sturen

- verzendt

- senior

- Gevoeligheid

- apart

- scheiden

- service

- Diensten

- reeks

- Sets

- verscheidene

- Delen

- gedeeld

- Sharma

- ze

- getoond

- Shows

- kant

- aanzienlijke

- gelijk

- Eenvoudig

- Maat

- So

- oplossing

- Oplossingen

- OPLOSSEN

- Tussenruimte

- specifiek

- specifiek

- snelheid

- spinnen

- stadia

- standaard

- staat

- begin

- gestart

- starts

- Land

- Status

- Stap voor

- Stappen

- Still

- gestopt

- stoppen

- Stopt

- mediaopslag

- winkels

- Draad

- sterke

- gestructureerde

- abonnees

- succes

- Met goed gevolg

- dergelijk

- ondersteuning

- system

- Systems

- tafel

- op maat gemaakt

- Nemen

- neemt

- getalenteerd

- Taak

- taken

- team

- teams

- Technisch

- termen

- neem contact

- dat

- De

- De toekomst

- hun

- Ze

- harte

- Er.

- daarom

- Deze

- ze

- Derde

- dit

- die

- drie

- drempel

- Door

- niet de tijd of

- keer

- naar

- samen

- tools

- Totaal

- Trainen

- Trainingen

- transactie

- transactie details

- Transformeren

- Transformatie

- transformaties

- leiden

- veroorzaakt

- twee

- type dan:

- typisch

- voor

- begrip

- eenheden

- tot

- bijgewerkt

- us

- bruikbaar

- Gebruik

- .

- use case

- gebruikt

- gebruik

- bevestiging

- waarde

- divers

- verticaal

- volume

- volumes

- vs

- gezocht

- was

- kijken

- Manier..

- we

- GOED

- wanneer

- welke

- WIE

- geheel

- geheel

- wil

- winnen

- Met

- binnen

- Mijn werk

- workflows

- werkzaam

- Bedrijven

- erger

- zou

- het schrijven van

- nog

- Opbrengst

- You

- Your

- zephyrnet