In het snel evoluerende gezondheidszorglandschap van vandaag worden artsen geconfronteerd met enorme hoeveelheden klinische gegevens uit verschillende bronnen, zoals notities van zorgverleners, elektronische medische dossiers en beeldvormingsrapporten. Hoewel deze schat aan informatie essentieel is voor de patiëntenzorg, kan het ook overweldigend en tijdrovend zijn voor medische professionals om ze te doorzoeken en te analyseren. Efficiënt samenvatten en inzichten uit deze gegevens halen is cruciaal voor betere patiëntenzorg en besluitvorming. Samengevatte patiëntinformatie kan nuttig zijn voor een aantal stroomafwaartse processen, zoals gegevensaggregatie, het effectief coderen van patiënten of het groeperen van patiënten met vergelijkbare diagnoses voor beoordeling.

Kunstmatige intelligentie (AI) en machine learning (ML) modellen zijn veelbelovend gebleken bij het aanpakken van deze uitdagingen. Modellen kunnen worden getraind om grote hoeveelheden tekstgegevens te analyseren en te interpreteren, waardoor informatie effectief wordt samengevat in beknopte samenvattingen. Door het samenvattingsproces te automatiseren, kunnen artsen snel toegang krijgen tot relevante informatie, waardoor ze zich kunnen concentreren op de patiëntenzorg en beter geïnformeerde beslissingen kunnen nemen. Zie het volgende case study voor meer informatie over een real-world use case.

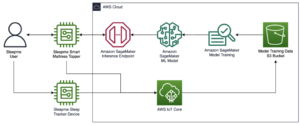

Amazon Sage Maker, een volledig beheerde ML-service, biedt een ideaal platform voor het hosten en implementeren van verschillende op AI/ML gebaseerde samenvattingsmodellen en benaderingen. In dit bericht onderzoeken we verschillende opties voor het implementeren van samenvattingstechnieken op SageMaker, inclusief het gebruik Amazon SageMaker JumpStart basismodellen, het verfijnen van vooraf getrainde modellen van Hugging Face en het bouwen van aangepaste samenvattingsmodellen. We bespreken ook de voor- en nadelen van elke benadering, zodat zorgprofessionals de meest geschikte oplossing kunnen kiezen voor het genereren van beknopte en nauwkeurige samenvattingen van complexe klinische gegevens.

Twee belangrijke termen om te weten voordat we beginnen: vooraf opgeleid en scherpstellen. Een vooraf getraind of basismodel is een model dat is gebouwd en getraind op een groot corpus aan gegevens, meestal voor algemene taalkennis. Fine-tuning is het proces waarbij een vooraf getraind model een andere, meer domeinspecifieke dataset krijgt om de prestaties voor een specifieke taak te verbeteren. In een gezondheidszorgomgeving zou dit betekenen dat het model enkele gegevens moet krijgen, waaronder uitdrukkingen en terminologie die specifiek betrekking hebben op patiëntenzorg.

Bouw aangepaste samenvattingsmodellen op SageMaker

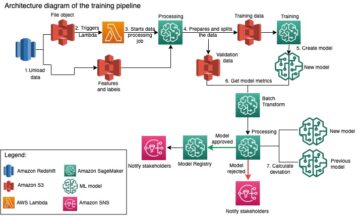

Hoewel dit de meest tijdrovende aanpak is, geven sommige organisaties er misschien de voorkeur aan om vanuit het niets aangepaste samenvattingsmodellen op SageMaker te bouwen. Deze benadering vereist meer diepgaande kennis van AI/ML-modellen en kan inhouden dat een geheel nieuwe modelarchitectuur moet worden gecreëerd of dat bestaande modellen moeten worden aangepast aan specifieke behoeften. Het bouwen van aangepaste modellen kan meer flexibiliteit en controle over het samenvattingsproces bieden, maar vereist ook meer tijd en middelen in vergelijking met benaderingen die uitgaan van vooraf getrainde modellen. Het is essentieel om de voor- en nadelen van deze optie zorgvuldig af te wegen voordat u doorgaat, omdat deze mogelijk niet geschikt is voor alle gebruikssituaties.

SageMaker JumpStart-basismodellen

Een geweldige optie voor het implementeren van samenvatting op SageMaker is het gebruik van JumpStart-basismodellen. Deze modellen, ontwikkeld door toonaangevende AI-onderzoeksorganisaties, bieden een reeks vooraf getrainde taalmodellen die zijn geoptimaliseerd voor verschillende taken, waaronder het samenvatten van teksten. SageMaker JumpStart biedt twee soorten basismodellen: propriëtaire modellen en open-sourcemodellen. SageMaker JumpStart biedt ook HIPAA-geschiktheid, waardoor het nuttig is voor werklasten in de gezondheidszorg. Het is uiteindelijk aan de klant om te zorgen voor naleving, dus zorg ervoor dat u de juiste stappen onderneemt. Zien Architectuur voor HIPAA-beveiliging en naleving op Amazon Web Services voor meer details.

Gepatenteerde funderingsmodellen

Eigen modellen, zoals Jurassic-modellen van AI21 en het Cohere Generate-model van Cohere, kunnen worden ontdekt via SageMaker JumpStart op de AWS-beheerconsole en zijn momenteel in preview. Het gebruik van bedrijfseigen modellen voor samenvatting is ideaal wanneer u uw model niet hoeft af te stemmen op aangepaste gegevens. Dit biedt een gebruiksvriendelijke, kant-en-klare oplossing die met minimale configuratie aan uw samenvattingsvereisten kan voldoen. Door de mogelijkheden van deze vooraf getrainde modellen te gebruiken, kunt u tijd en middelen besparen die anders zouden worden besteed aan het trainen en verfijnen van een aangepast model. Bovendien worden propriëtaire modellen doorgaans geleverd met gebruiksvriendelijke API's en SDK's, waardoor het integratieproces met uw bestaande systemen en applicaties wordt gestroomlijnd. Als aan uw samenvattingsbehoeften kan worden voldaan door vooraf getrainde eigen modellen zonder dat specifieke aanpassingen of fijnafstemming nodig zijn, bieden ze een handige, kosteneffectieve en efficiënte oplossing voor uw tekstsamenvattingstaken. Omdat deze modellen niet specifiek zijn getraind voor gebruikssituaties in de gezondheidszorg, kan de kwaliteit van medische taal out-of-the-box niet worden gegarandeerd zonder fijnafstemming.

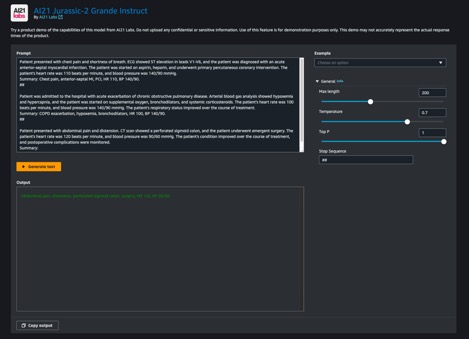

Jurassic-2 Grande Instruct is een groot taalmodel (LLM) van AI21 Labs, geoptimaliseerd voor instructies in natuurlijke taal en toepasbaar op verschillende taaltaken. Het biedt een gebruiksvriendelijke API en Python SDK, die kwaliteit en betaalbaarheid in evenwicht houden. Populaire toepassingen zijn onder meer het genereren van marketingteksten, het aansturen van chatbots en het samenvatten van tekst.

Navigeer op de SageMaker-console naar SageMaker JumpStart, zoek het AI21 Jurassic-2 Grande Instruct-model en kies Proefmodel.

Als u het model wilt implementeren op een SageMaker-eindpunt dat u beheert, kunt u de stappen in dit voorbeeld volgen notitieboekje, die u laat zien hoe u Jurassic-2 Large kunt implementeren met SageMaker.

Open-source basismodellen

Open-sourcemodellen omvatten FLAN T5-, Bloom- en GPT-2-modellen die kunnen worden ontdekt via SageMaker JumpStart in de Amazon SageMaker Studio UI, SageMaker JumpStart op de SageMaker-console en SageMaker JumpStart API's. Deze modellen kunnen worden verfijnd en ingezet op eindpunten onder uw AWS-account, waardoor u volledig eigenaar wordt van modelgewichten en scriptcodes.

Flan-T5 XL is een krachtig en veelzijdig model dat is ontworpen voor een breed scala aan taaltaken. Door het model af te stemmen op uw domeinspecifieke gegevens, kunt u de prestaties optimaliseren voor uw specifieke gebruikssituatie, zoals tekstsamenvatting of een andere NLP-taak. Voor meer informatie over het fijn afstellen van Flan-T5 XL met behulp van de gebruikersinterface van SageMaker Studio, raadpleegt u Instructie fijnafstemming voor FLAN T5 XL met Amazon SageMaker Jumpstart.

Vooraf getrainde modellen verfijnen met Hugging Face op SageMaker

Een van de meest populaire opties voor het implementeren van samenvattingen op SageMaker is het verfijnen van vooraf getrainde modellen met behulp van de Hugging Face transformers bibliotheek. Hugging Face biedt een breed scala aan vooraf getrainde transformatormodellen die speciaal zijn ontworpen voor verschillende taken op het gebied van natuurlijke taalverwerking (NLP), waaronder het samenvatten van tekst. Met de Hugging Face Transformers-bibliotheek kunt u deze vooraf getrainde modellen eenvoudig afstemmen op uw domeinspecifieke gegevens met behulp van SageMaker. Deze aanpak heeft verschillende voordelen, zoals snellere trainingstijden, betere prestaties op specifieke domeinen en eenvoudiger modelverpakking en implementatie met behulp van ingebouwde SageMaker-tools en -services. Als u geen geschikt model kunt vinden in SageMaker JumpStart, kunt u elk model kiezen dat wordt aangeboden door Hugging Face en het verfijnen met behulp van SageMaker.

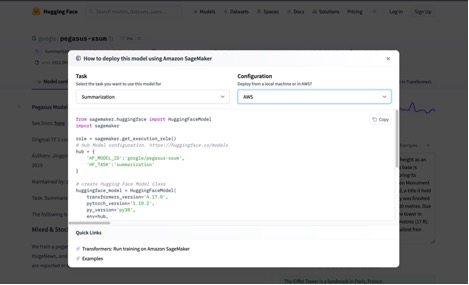

Om met een model te gaan werken om meer te weten te komen over de mogelijkheden van ML, hoeft u alleen maar SageMaker Studio te openen, een vooraf getraind model te zoeken dat u wilt gebruiken in de Knuffelen Gezicht Model Huben kies SageMaker als uw implementatiemethode. Hugging Face geeft je de code om te kopiëren, plakken en uitvoeren in je notitieblok. Zo eenvoudig is het! Geen ervaring met ML-engineering vereist.

De Hugging Face Transformers-bibliotheek stelt bouwers in staat om te werken met de vooraf getrainde modellen en geavanceerde taken uit te voeren, zoals fijnafstelling, die we in de volgende secties onderzoeken.

Voorzieningsbronnen

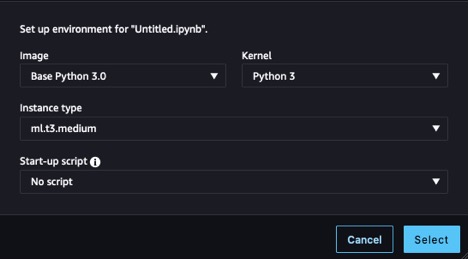

Voordat we kunnen beginnen, moeten we een notebook inrichten. Raadpleeg stap 1 en 2 in voor instructies Bouw en train lokaal een machine learning-model. Voor dit voorbeeld hebben we de instellingen gebruikt die worden weergegeven in de volgende schermafbeelding.

We moeten ook een Amazon eenvoudige opslagservice (Amazon S3) bucket om de trainingsgegevens en trainingsartefacten op te slaan. Raadpleeg voor instructies Een bucket maken.

De dataset voorbereiden

Om ons model te verfijnen om betere domeinkennis te hebben, moeten we gegevens verzamelen die geschikt zijn voor de taak. Wanneer u traint voor een enterprise use case, moet u een aantal data-engineeringtaken doorlopen om uw eigen gegevens voor te bereiden om klaar te zijn voor training. Deze taken vallen buiten het bestek van deze functie. Voor dit voorbeeld hebben we enkele synthetische gegevens gegenereerd om verpleegnotities na te bootsen en deze opgeslagen in Amazon S3. Door onze gegevens op te slaan in Amazon S3 kunnen we dat ontwerp onze workloads voor HIPAA-compliance. We beginnen met het ophalen van die notities en laden ze op de instantie waarop onze notebook wordt uitgevoerd:

De notities zijn samengesteld uit een kolom met het volledige item, notitie, en een kolom met een verkorte versie die illustreert wat onze gewenste output zou moeten zijn, samenvatting. Het doel van het gebruik van deze dataset is om het biologische en medische vocabulaire van ons model te verbeteren, zodat het beter is afgestemd op samenvatten in een gezondheidszorgcontext, genaamd domein fijnafstemming, en laat ons model zien hoe de samengevatte uitvoer moet worden gestructureerd. In sommige samenvattingsgevallen willen we misschien een samenvatting maken van een artikel of een samenvatting van één regel van een recensie, maar in dit geval proberen we ons model een verkorte versie van de symptomen en ondernomen acties te laten uitvoeren voor een patiënt tot nu toe.

Laad het model

Het model dat we gebruiken als onze basis is een versie van Google's Pegasus, beschikbaar gemaakt in de Hugging Face Hub, genaamd pegasus-xsum. Het is al vooraf getraind voor samenvatting, dus ons proces voor fijnafstemming kan zich richten op het uitbreiden van zijn domeinkennis. Het wijzigen van de taak die ons model uitvoert, is een ander type fijnafstemming dat niet in dit bericht wordt behandeld. De Transformer-bibliotheek levert ons een klasse om de modeldefinitie van ons te laden model_checkpoint: google/pegasus-xsum. Hierdoor wordt het model van de hub geladen en in ons notitieblok geconcretiseerd, zodat we het later kunnen gebruiken. Omdat pegasus-xsum is een sequentie-naar-sequentie-model, we willen het Seq2Seq-type van de gebruiken AutoModel klasse:

Nu we ons model hebben, is het tijd om onze aandacht te richten op de andere componenten waarmee we onze trainingslus kunnen uitvoeren.

Maak een tokenizer

De eerste van deze componenten is de tokenizer. tokenization is het proces waarbij woorden uit de invoergegevens worden omgezet in numerieke representaties die ons model kan begrijpen. Nogmaals, de Transformer-bibliotheek biedt ons een klasse om een tokenizer-definitie te laden vanaf hetzelfde controlepunt dat we gebruikten om het model te instantiëren:

Met dit tokenizer-object kunnen we een preprocessing-functie maken en deze toewijzen aan onze dataset om ons tokens te geven die klaar zijn om in het model te worden ingevoerd. Ten slotte formatteren we de getokeniseerde uitvoer en verwijderen we de kolommen met onze originele tekst, omdat het model deze niet kan interpreteren. Nu hebben we een tokenized input die klaar is om in het model te worden ingevoerd. Zie de volgende code:

Nu onze gegevens zijn getokeniseerd en ons model is geïnstantieerd, zijn we bijna klaar om een trainingslus uit te voeren. De volgende componenten die we willen maken zijn de data collator en de optimizer. De gegevensverzamelaar is een andere klasse die wordt aangeboden door Hugging Face via de Transformers-bibliotheek, die we gebruiken om batches van onze getokeniseerde gegevens voor training te maken. We kunnen dit eenvoudig bouwen met behulp van de tokenizer- en modelobjecten die we al hebben, gewoon door het overeenkomstige klassetype te vinden dat we eerder voor ons model (Seq2Seq) voor de sorteerklasse hebben gebruikt. De functie van de optimizer is om de trainingsstatus te behouden en de parameters bij te werken op basis van ons trainingsverlies terwijl we door de lus werken. Om een optimizer te maken, kunnen we het optim pakket van de toortsmodule, waar een aantal optimalisatie-algoritmen beschikbaar zijn. Enkele veel voorkomende die u eerder bent tegengekomen, zijn Stochastic Gradient Descent en Adam, waarvan de laatste in ons voorbeeld wordt toegepast. De constructor van Adam neemt de modelparameters en de geparametriseerde leersnelheid voor de gegeven trainingsrun in. Zie de volgende code:

De laatste stappen voordat we kunnen beginnen met trainen, zijn het bouwen van de accelerator en de learning rate scheduler. De accelerator komt uit een andere bibliotheek (we gebruiken voornamelijk Transformers) geproduceerd door Hugging Face, toepasselijk Accelerate genoemd, en abstraheert de logica die nodig is om apparaten tijdens training te beheren (bijvoorbeeld met behulp van meerdere GPU's). Voor het laatste onderdeel gaan we terug naar de altijd bruikbare Transformers-bibliotheek om onze leersnelheidsplanner te implementeren. Door het type planner, het totale aantal trainingsstappen in onze lus en de eerder gemaakte optimizer op te geven, wordt de get_scheduler functie retourneert een object waarmee we onze initiële leersnelheid tijdens het trainingsproces kunnen aanpassen:

We zijn nu helemaal klaar voor de training! Laten we een trainingstaak opzetten, beginnend met het instantiëren van de training_args de Transformers-bibliotheek gebruiken en parameterwaarden kiezen. We kunnen deze, samen met onze andere voorbereide componenten en dataset, rechtstreeks doorgeven aan de trainer en begin met trainen, zoals weergegeven in de volgende code. Afhankelijk van de grootte van uw dataset en de gekozen parameters kan dit een aanzienlijke hoeveelheid tijd in beslag nemen.

Verpak het model voor gevolgtrekking

Nadat de training is uitgevoerd, is het modelobject klaar om te worden gebruikt voor gevolgtrekkingen. Laten we als best practice ons werk opslaan voor toekomstig gebruik. We moeten onze modelartefacten maken, ze samenritsen en onze tarball uploaden naar Amazon S3 voor opslag. Om ons model voor te bereiden op zippen, moeten we het nu verfijnde model uitpakken en vervolgens het binaire model en de bijbehorende configuratiebestanden opslaan. We moeten onze tokenizer ook opslaan in dezelfde map waarin we onze modelartefacten hebben opgeslagen, zodat deze beschikbaar is wanneer we het model gebruiken voor gevolgtrekking. Ons model_dir map zou er nu ongeveer zo uit moeten zien als de volgende code:

Het enige dat overblijft is om een tar-opdracht uit te voeren om onze directory te zippen en het tar.gz-bestand naar Amazon S3 te uploaden:

Ons nieuw verfijnde model is nu klaar en beschikbaar om te worden gebruikt voor gevolgtrekkingen.

Gevolgtrekking uitvoeren

Om dit modelartefact voor gevolgtrekkingen te gebruiken, opent u een nieuw bestand en gebruikt u de volgende code, waarbij u de model_data parameter die past bij uw locatie voor het opslaan van artefacten in Amazon S3. De HuggingFaceModel constructor zal ons model herbouwen vanaf het controlepunt waarnaar we hebben opgeslagen model.tar.gz, die we vervolgens kunnen inzetten voor gevolgtrekking met behulp van de deploy-methode. Het implementeren van het eindpunt duurt enkele minuten.

Nadat het eindpunt is geïmplementeerd, kunnen we de voorspelling gebruiken die we hebben gemaakt om het te testen. Geef de predict methode een data-payload en voer de cel uit, en je krijgt het antwoord van je verfijnde model:

Laten we een snelle test doen om het voordeel te zien van het verfijnen van een model. De volgende tabel bevat een prompt en de resultaten van het doorgeven van die prompt aan het model voor en na fijnafstelling.

| prompt | Reactie zonder fijnafstelling | Respons met fijnafstelling |

| Vat de symptomen samen die de patiënt ervaart. Patiënt is een 45-jarige man met klachten van substernale pijn op de borst die uitstraalt naar de linkerarm. Pijn treedt plotseling op terwijl hij in de tuin aan het werk was, geassocieerd met milde kortademigheid en zweten. Bij aankomst was de hartslag van de patiënt 120, de ademhalingsfrequentie 24, de bloeddruk 170/95. 12 lead elektrocardiogram gedaan bij aankomst op de afdeling spoedeisende hulp en drie sublinguale nitroglycerine toegediend zonder verlichting van pijn op de borst. Elektrocardiogram toont ST-elevatie in anterieure afleidingen die een acuut anterieur myocardinfarct aantonen. We hebben contact opgenomen met het laboratorium voor hartkatheterisatie en voorbereidingen getroffen voor hartkatheterisatie door een cardioloog. | We presenteren een casus van een acuut myocardinfarct. | Pijn op de borst, anterieure MI, PCI. |

Zoals u kunt zien, gebruikt ons verfijnde model gezondheidsterminologie op een andere manier en hebben we de structuur van de reactie kunnen aanpassen aan onze doeleinden. Houd er rekening mee dat de resultaten afhankelijk zijn van uw dataset en de ontwerpkeuzes die tijdens de training zijn gemaakt. Uw versie van het model kan heel andere resultaten opleveren.

Opruimen

Wanneer u klaar bent met uw SageMaker-notebook, moet u deze afsluiten om kosten van langlopende resources te voorkomen. Houd er rekening mee dat het afsluiten van de instantie ervoor zorgt dat alle gegevens die zijn opgeslagen in het kortstondige geheugen van de instantie verloren gaan, dus u moet al uw werk opslaan in permanente opslag voordat u gaat opruimen. Je moet ook naar de Eindpunten pagina op de SageMaker-console en verwijder alle eindpunten die zijn ingezet voor inferentie. Om alle artefacten te verwijderen, moet je ook naar de Amazon S3-console gaan om bestanden te verwijderen die naar je bucket zijn geüpload.

Conclusie

In dit bericht hebben we verschillende opties onderzocht voor het implementeren van tekstsamenvattingstechnieken op SageMaker om zorgprofessionals te helpen bij het efficiënt verwerken en extraheren van inzichten uit enorme hoeveelheden klinische gegevens. We bespraken het gebruik van SageMaker Jumpstart-basismodellen, het verfijnen van vooraf getrainde modellen van Hugging Face en het bouwen van aangepaste samenvattingsmodellen. Elke aanpak heeft zijn eigen voor- en nadelen, en komt tegemoet aan verschillende behoeften en vereisten.

Het bouwen van aangepaste samenvattingsmodellen op SageMaker zorgt voor veel flexibiliteit en controle, maar vereist meer tijd en middelen dan het gebruik van vooraf getrainde modellen. SageMaker Jumpstart-basismodellen bieden een gebruiksvriendelijke en kosteneffectieve oplossing voor organisaties die geen specifieke aanpassingen of fijnafstemming nodig hebben, evenals enkele opties voor vereenvoudigde fijnafstemming. Het nauwkeurig afstemmen van vooraf getrainde modellen van Hugging Face biedt snellere trainingstijden, betere domeinspecifieke prestaties en naadloze integratie met SageMaker-tools en -services in een brede catalogus van modellen, maar het vereist enige implementatie-inspanning. Op het moment van schrijven van dit bericht heeft Amazon een andere optie aangekondigd, Amazonebodem, die samenvattingsmogelijkheden biedt in een nog beter beheerde omgeving.

Door de voor- en nadelen van elke aanpak te begrijpen, kunnen zorgprofessionals en organisaties weloverwogen beslissingen nemen over de meest geschikte oplossing voor het genereren van beknopte en nauwkeurige samenvattingen van complexe klinische gegevens. Uiteindelijk kan het gebruik van op AI/ML gebaseerde samenvattingsmodellen op SageMaker de patiëntenzorg en besluitvorming aanzienlijk verbeteren door medische professionals in staat te stellen snel toegang te krijgen tot relevante informatie en zich te concentreren op het leveren van kwaliteitszorg.

Resources

Raadpleeg voor het volledige script dat in dit bericht wordt besproken en enkele voorbeeldgegevens de GitHub repo. Zie de volgende bronnen voor meer informatie over het uitvoeren van ML-workloads op AWS:

Over de auteurs

Cody Collins is een in New York gevestigde Solutions Architect bij Amazon Web Services. Hij werkt samen met ISV-klanten om toonaangevende oplossingen in de cloud te bouwen. Hij heeft met succes complexe projecten opgeleverd voor diverse industrieën, waarbij hij de efficiëntie en schaalbaarheid heeft geoptimaliseerd. In zijn vrije tijd houdt hij van lezen, reizen en jiu jitsu trainen.

Cody Collins is een in New York gevestigde Solutions Architect bij Amazon Web Services. Hij werkt samen met ISV-klanten om toonaangevende oplossingen in de cloud te bouwen. Hij heeft met succes complexe projecten opgeleverd voor diverse industrieën, waarbij hij de efficiëntie en schaalbaarheid heeft geoptimaliseerd. In zijn vrije tijd houdt hij van lezen, reizen en jiu jitsu trainen.

Ameer Hakme is een AWS Solutions Architect die in Pennsylvania woont. Zijn professionele focus omvat het samenwerken met onafhankelijke softwareleveranciers in het noordoosten en hen begeleiden bij het ontwerpen en bouwen van schaalbare, ultramoderne platforms op de AWS Cloud.

Ameer Hakme is een AWS Solutions Architect die in Pennsylvania woont. Zijn professionele focus omvat het samenwerken met onafhankelijke softwareleveranciers in het noordoosten en hen begeleiden bij het ontwerpen en bouwen van schaalbare, ultramoderne platforms op de AWS Cloud.

- Door SEO aangedreven content en PR-distributie. Word vandaag nog versterkt.

- PlatoData.Network Verticale generatieve AI. Versterk jezelf. Toegang hier.

- PlatoAiStream. Web3-intelligentie. Kennis versterkt. Toegang hier.

- PlatoESG. Automotive / EV's, carbon, CleanTech, Energie, Milieu, Zonne, Afvalbeheer. Toegang hier.

- BlockOffsets. Eigendom voor milieucompensatie moderniseren. Toegang hier.

- Bron: https://aws.amazon.com/blogs/machine-learning/exploring-summarization-options-for-healthcare-with-amazon-sagemaker/

- : heeft

- :is

- :niet

- :waar

- $UP

- 1

- 10

- 100

- 12

- 14

- 15%

- 24

- 33

- 7

- 8

- 9

- a

- in staat

- Over

- SAMENVATTING

- versnellen

- versneller

- toegang

- Account

- accuraat

- over

- acties

- Adam

- aanpakken

- toegediend

- vergevorderd

- voordelen

- Na

- weer

- aggregatie

- AI

- ai onderzoek

- AI / ML

- algoritmen

- Alles

- Het toestaan

- toestaat

- langs

- al

- ook

- Amazone

- Amazon Sage Maker

- Amazon Web Services

- bedragen

- hoeveelheden

- an

- analyseren

- en

- aangekondigd

- Nog een

- elke

- api

- APIs

- toepasselijk

- toepassingen

- toegepast

- nadering

- benaderingen

- passend

- architectuur

- ZIJN

- ARM

- aankomst

- dit artikel

- AS

- geassocieerd

- At

- aandacht

- automatiseren

- Beschikbaar

- vermijd

- weg

- AWS

- balancing

- gebaseerde

- BE

- omdat

- geweest

- vaardigheden

- beginnen

- voordeel

- betekent

- BEST

- Betere

- BIN

- bloed

- Bloeddruk

- Bloeien

- Box camera's

- Adem

- breed

- bouw

- bouwers

- Gebouw

- bebouwd

- ingebouwd

- maar

- by

- Bellen

- Dit betekent dat we onszelf en onze geliefden praktisch vergiftigen.

- CAN

- mogelijkheden

- verzorging

- voorzichtig

- geval

- gevallen

- catalogus

- Veroorzaken

- uitdagingen

- verandering

- chatbots

- keuzes

- Kies

- het kiezen van

- uitgekozen

- klasse

- Klinisch

- Cloud

- code

- codes

- codering

- samenwerken

- Kolom

- columns

- hoe

- komt

- Gemeen

- vergeleken

- klachten

- complex

- nakoming

- bestanddeel

- componenten

- samengesteld

- beknopt

- Configuratie

- NADELEN

- troosten

- construeren

- verband

- onder controle te houden

- gemakkelijk

- Overeenkomend

- kostenefficient

- Kosten

- kon

- bedekt

- en je merk te creëren

- aangemaakt

- Wij creëren

- cruciaal

- Op dit moment

- gewoonte

- klant

- Klanten

- maatwerk

- gegevens

- datasets

- Besluitvorming

- beslissingen

- definitie

- geleverd

- demonstrating

- afdeling

- afhankelijk

- Afhankelijk

- implementeren

- ingezet

- het inzetten

- inzet

- Design

- ontworpen

- ontwerpen

- gewenste

- gegevens

- ontwikkelde

- systemen

- anders

- direct

- ontdekt

- bespreken

- besproken

- diversen

- do

- Artsen

- doen

- domein

- domeinen

- gedaan

- Dont

- beneden

- nadelen

- gedurende

- elk

- gemakkelijker

- gemakkelijk

- En het is heel gemakkelijk

- gemakkelijk te gebruiken

- effectief

- doeltreffendheid

- doeltreffend

- efficiënt

- inspanning

- elektronisch

- Elektronische gezondheidsdossiers

- verkiesbaarheid

- noodgeval

- in staat stellen

- maakt

- waardoor

- Endpoint

- Engineering

- verhogen

- verzekeren

- Enterprise

- toegang

- Milieu

- tijdperk

- essentieel

- Zelfs

- evoluerende

- voorbeeld

- bestaand

- ervaring

- het ervaren van

- Verken

- Nagegaan

- Verkennen

- verlenging

- extract

- Gezicht

- geconfronteerd

- ver

- sneller

- Fed

- weinig

- Dien in

- Bestanden

- finale

- Tot slot

- VIND DE PLEK DIE PERFECT VOOR JOU IS

- het vinden van

- Voornaam*

- geschikt

- Flexibiliteit

- Focus

- volgen

- volgend

- Voor

- formaat

- Foundation

- oppompen van

- vol

- geheel

- functie

- Bovendien

- toekomst

- Krijgen

- Algemeen

- voortbrengen

- gegenereerde

- het genereren van

- krijgen

- het krijgen van

- Geven

- gegeven

- Vrijgevigheid

- Go

- GPU's

- groot

- meer

- gegarandeerde

- Hebben

- he

- Gezondheid

- gezondheidszorg

- Hart

- hulp

- zijn

- Hosting

- Hoe

- How To

- HTML

- http

- HTTPS

- Naaf

- KnuffelenGezicht

- ideaal

- if

- Imaging

- uitvoeren

- uitvoering

- uitvoering

- importeren

- belangrijk

- verbeteren

- in

- diepgaande

- omvatten

- omvat

- Inclusief

- onafhankelijk

- industrieën

- -industrie

- informatie

- op de hoogte

- eerste

- invoer

- ingangen

- inzichten

- instantie

- instructies

- integratie

- Intelligentie

- in

- betrekken

- IT

- HAAR

- Jobomschrijving:

- json

- voor slechts

- blijven

- kennis

- laboratorium

- Labs

- Landschap

- taal

- Groot

- Achternaam*

- later

- leiden

- leidend

- Leads

- LEARN

- leren

- links

- Bibliotheek

- als

- LLM

- laden

- het laden

- plaats

- logica

- Kijk

- verliezen

- uit

- machine

- machine learning

- gemaakt

- onderhouden

- maken

- maken

- beheer

- beheerd

- management

- kaart

- Marketing

- Mei..

- gemiddelde

- medisch

- Maak kennis met

- Geheugen

- voldaan

- methode

- macht

- minimaal

- minuten

- ML

- model

- modellen

- Module

- meer

- meest

- Meest populair

- meervoudig

- Genoemd

- Naturel

- Natural Language Processing

- OP DEZE WEBSITE VIND JE

- Noodzaak

- behoeften

- New

- New York

- onlangs

- volgende

- nlp

- geen

- notitieboekje

- Opmerkingen

- nu

- aantal

- object

- objecten

- of

- bieden

- aangeboden

- Aanbod

- Oud

- on

- EEN

- degenen

- begin

- naar

- open

- open source

- besturen

- optimalisatie

- Optimaliseer

- geoptimaliseerde

- optimaliseren

- Keuze

- Opties

- or

- bestellen

- organisaties

- origineel

- Overige

- anders-

- onze

- uit

- uitgang

- buiten

- over

- het te bezitten.

- ownership

- pakket

- verpakking

- pagina

- Pijn

- parameter

- parameters

- bijzonder

- passeren

- Voorbijgaand

- patiënt

- patiënten

- Pegasus

- Pennsylvania

- prestatie

- Behorend

- zinnen

- platform

- platforms

- Plato

- Plato gegevensintelligentie

- PlatoData

- punt

- Populair

- Post

- krachtige

- Powering

- praktijk

- predictor

- de voorkeur geven

- Voorbereiden

- bereid

- presenteren

- druk

- Voorbeschouwing

- die eerder

- in de eerste plaats

- processen

- verwerking

- geproduceerd

- professioneel

- professionals

- projecten

- belofte

- gepatenteerd

- PROS

- zorgen voor

- mits

- biedt

- het verstrekken van

- voorziening

- doel

- doeleinden

- zetten

- Python

- kwaliteit

- Quick

- snel

- reeks

- snel

- tarief

- lezing

- klaar

- echte wereld

- archief

- relevante

- verlichting

- verwijderen

- Rapporten

- vereisen

- nodig

- Voorwaarden

- vereist

- onderzoek

- Resources

- antwoord

- Resultaten

- Retourneren

- beoordelen

- Rol

- lopen

- lopend

- loopt

- sagemaker

- dezelfde

- Bespaar

- Schaalbaarheid

- schaalbare

- omvang

- krassen

- sdk

- SDK's

- naadloos

- secties

- veiligheid

- zien

- apart

- service

- Diensten

- reeks

- het instellen van

- settings

- verscheidene

- verkort

- moet

- tonen

- getoond

- Shows

- het afsluiten van

- Ziften

- aanzienlijke

- aanzienlijk

- gelijk

- Eenvoudig

- vereenvoudigd

- Maat

- So

- dusver

- Software

- oplossing

- Oplossingen

- sommige

- iets

- bronnen

- specifiek

- specifiek

- besteed

- begin

- Start

- Land

- state-of-the-art

- Stappen

- mediaopslag

- shop

- opgeslagen

- bewaartemperatuur

- stroomlijnen

- structuur

- studio

- sublinguale

- Met goed gevolg

- dergelijk

- plotseling

- Pak

- geschikt

- OVERZICHT

- zeker

- Symptomen

- korte inhoud

- synthetisch

- synthetische gegevens

- Systems

- tafel

- Nemen

- ingenomen

- neemt

- Taak

- taken

- technieken

- terminologie

- termen

- proef

- neem contact

- dat

- De

- de hub

- Ze

- harte

- Deze

- ze

- dit

- die

- drie

- Door

- overal

- niet de tijd of

- tijdrovend

- keer

- naar

- vandaag

- samen

- getokeniseerd

- tokens

- tools

- fakkel

- Totaal

- Trainen

- getraind

- Trainingen

- getransformeerd

- transformator

- transformers

- Reizend

- twee

- type dan:

- types

- typisch

- ui

- Tenslotte

- niet in staat

- voor

- begrijpen

- begrip

- bijwerken

- geüpload

- us

- .

- use case

- gebruikt

- gebruiksvriendelijke

- toepassingen

- gebruik

- Gebruik makend

- bevestiging

- Values

- divers

- groot

- vendors

- veelzijdig

- versie

- zeer

- volumes

- willen

- was

- we

- Rijkdom

- web

- webservices

- wegen

- GOED

- Wat

- wanneer

- welke

- en

- breed

- Grote range

- wil

- Met

- zonder

- woorden

- Mijn werk

- werkzaam

- Bedrijven

- zou

- het schrijven van

- jaar

- york

- You

- Your

- zephyrnet

- Postcode