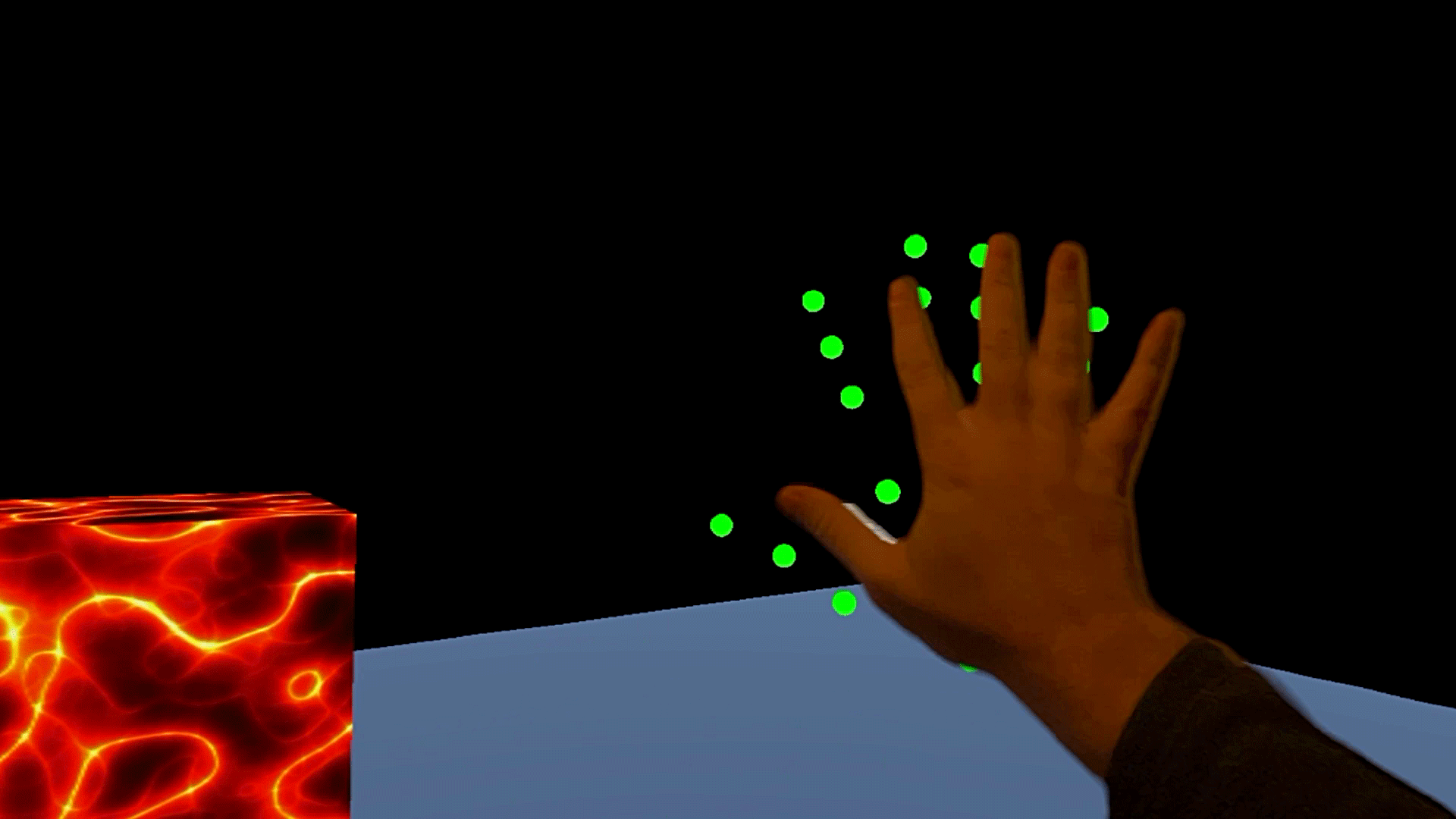

Een video die is geplaatst door een Vision Pro-ontwikkelaar lijkt de huidige niveaus van handtracking en occlusieprestaties te laten zien waartoe de nieuwe headset van Apple in staat is.

Apple Visie Pro, zal naar verwachting in de komende maanden van start gaan, zal handtracking gebruiken als primaire invoermethode. Terwijl interacties op systeemniveau handtracking combineren met eye-tracking voor een ‘kijk en tik’-modaliteit, kunnen ontwikkelaars ook applicaties bouwen waarmee gebruikers rechtstreeks met applicaties kunnen communiceren met behulp van hun handen.

Handtracking op Vision Pro kan worden onderverdeeld in twee verschillende mogelijkheden: ‘handtracking’ en ‘handocclusie’.

Handtracking is het geschatte 3D-model van de hand, de gewrichten en de positie van de vingertoppen. Dit model wordt gebruikt om te bepalen wanneer objecten worden aangeraakt, vastgegrepen en gebruikt.

Handocclusie gaat over hoe het systeem uw echte hand over virtuele inhoud legt. In plaats van een 3D-model van een virtuele hand in de scène te tekenen, snijdt Vision Pro het beeld van uw echte handen uit om ze in de scène te laten zien. Hierdoor wordt een extra laag realisme aan de virtuele inhoud toegevoegd, omdat u uw eigen, unieke handen kunt zien.

Een ontwikkelaar die voor Vision Pro bouwde en Unity gebruikte, plaatste een video die een duidelijk beeld geeft van zowel handtracking als occlusie.

In de video hierboven laten de echte handen het occlusiesysteem in actie zien, terwijl de groene stippen de geschatte 3D-positie van de hand weergeven.

We kunnen zien dat handocclusie heel goed is, maar niet perfect; wanneer je volledig omringd bent door virtuele inhoud en snel beweegt, kun je wat clipping rond de randen van de hand zien.

Ondertussen blijft de feitelijke handvolgpositie verder achter bij de handocclusie, ergens rond de 100-200 ms achter. We kunnen de werkelijke latentie van de handtracking van Vision Pro echter niet helemaal bepalen, omdat we alleen een beeld hebben van de occlusie-trackinghanden om deze mee te vergelijken (die zelf enige latentie zullen hebben met betrekking tot de echte handen).

In deze context komt de video uit een gesprek met Unity-ontwikkelaars waarin werd gezegd dat hun vroege experimenten met Vision Pro een zeer hoge latentie voor handtracking vertoonden, blijkbaar in vergelijking met de nieuwste handtrackingmogelijkheden van Quest. Andere Unity-ontwikkelaars waren het erover eens dat ze een vergelijkbare latentie zagen op hun eigen Vision Pro-apparaten.

De video in kwestie is echter een handtracking-integratie binnen een Unity-app, wat betekent dat de handtrackingprestaties en latentie mogelijk extra factoren met betrekking tot Unity hebben die niet aanwezig zijn bij het gebruik van de eigen Vision Pro-ontwikkeltools van Apple. En aangezien de headset nog niet is gelanceerd en deze tools nog in ontwikkeling zijn, kunnen we aanvullende verbeteringen zien tegen de tijd dat de headset daadwerkelijk in de winkels ligt.

- Door SEO aangedreven content en PR-distributie. Word vandaag nog versterkt.

- PlatoData.Network Verticale generatieve AI. Versterk jezelf. Toegang hier.

- PlatoAiStream. Web3-intelligentie. Kennis versterkt. Toegang hier.

- PlatoESG. carbon, CleanTech, Energie, Milieu, Zonne, Afvalbeheer. Toegang hier.

- Plato Gezondheid. Intelligentie op het gebied van biotech en klinische proeven. Toegang hier.

- Bron: https://www.roadtovr.com/apple-vision-pro-unity-hand-tracking-occlusion/

- :is

- :niet

- 3d

- a

- boven

- Actie

- daadwerkelijk

- werkelijk

- Extra

- Voegt

- afgesproken

- toelaten

- ook

- en

- Nog een

- gebruiken

- komt naar voren

- Apple

- toepassingen

- ZIJN

- rond

- AS

- At

- BE

- omdat

- achter

- zowel

- Kapot

- bouw

- Gebouw

- maar

- by

- CAN

- mogelijkheden

- in staat

- duidelijk

- combineren

- komt

- vergelijken

- vergelijking

- aangezien

- content

- verband

- Gesprek

- Actueel

- bezuinigingen

- Deals

- Bepalen

- Ontwikkelaar

- ontwikkelaars

- Ontwikkeling

- Ontwikkelingshulpmiddelen

- systemen

- direct

- onderscheiden

- doen

- tekening

- Vroeg

- geheel

- geschat

- experimenten

- factoren

- weinig

- vingertoppen

- Voor

- oppompen van

- verder

- geeft

- Glimp

- goed

- Groen

- hand

- handen

- Hebben

- Hoofdtelefoon

- Hoge

- Hoe

- Echter

- HTTPS

- beeld

- verbeteringen

- in

- invoer

- binnen

- verkrijgen in plaats daarvan

- integratie

- interactie

- interacties

- in

- IT

- HAAR

- Wachttijd

- laatste

- lancering

- gelanceerd

- lagen

- niveaus

- Kijk

- Mei..

- middel

- methode

- model

- bewegend

- New

- nieuwe headset

- volgende

- objecten

- of

- Aanbod

- on

- Slechts

- naar

- Overige

- uit

- het te bezitten.

- prestatie

- Plato

- Plato gegevensintelligentie

- PlatoData

- positie

- geplaatst

- presenteren

- primair

- Pro

- zoektocht

- handvolging van zoekopdrachten

- vraag

- snel

- heel

- liever

- Bereikt

- vast

- realisme

- Beschouwen

- gezegde

- scène

- zien

- te zien

- tonen

- vertoonde

- gelijk

- So

- sommige

- ergens

- Still

- winkels

- omgeven

- system

- neem contact

- dat

- De

- hun

- Ze

- zich

- Deze

- ze

- dit

- niet de tijd of

- naar

- tools

- aangeraakt

- waar

- twee

- unieke

- eenheid

- .

- gebruikt

- gebruikers

- gebruik

- zeer

- Video

- Bekijk

- Virtueel

- visie

- we

- waren

- wanneer

- welke

- en

- wil

- Met

- nog

- You

- Your

- zephyrnet