We hebben onlangs een nieuwe mogelijkheid geïntroduceerd in de Amazon SageMaker Python-SDK waarmee datawetenschappers hun machine learning-code (ML) kunnen uitvoeren die is geschreven in hun favoriete geïntegreerde ontwikkelaarsomgeving (IDE) en notebooks, samen met de bijbehorende runtime-afhankelijkheden als Amazon Sage Maker trainingstaken met minimale codewijzigingen in de lokaal uitgevoerde experimenten. Datawetenschappers voeren doorgaans verschillende iteraties van experimenten uit in gegevensverwerking en trainingsmodellen terwijl ze aan een ML-probleem werken. Ze willen deze ML-code uitvoeren en experimenteren met gebruiksgemak en minimale codewijziging. Amazon SageMaker-modeltraining helpt datawetenschappers bij het uitvoeren van volledig beheerde grootschalige trainingstaken op de computerinfrastructuur van AWS. SageMaker Training helpt datawetenschappers ook met geavanceerde tools zoals Amazon SageMaker-foutopsporing en Profiler om hun grootschalige trainingstaken te debuggen en te analyseren.

Voor klanten met kleine budgetten, kleine teams en strakke tijdlijnen, maakt elk nieuw concept en elke regel code die is herschreven om op SageMaker te draaien, hen minder productief voor hun kerntaken, namelijk gegevensverwerking en het trainen van ML-modellen. Ze willen één keer code schrijven in het raamwerk van hun keuze en naadloos kunnen overstappen van het uitvoeren van code op hun notebooks of laptops naar het uitvoeren van code op schaal met behulp van SageMaker-mogelijkheden.

Met deze nieuwe mogelijkheid van de SageMaker Python SDK kunnen datawetenschappers hun ML-code binnen enkele minuten onboarden op het SageMaker-trainingsplatform. U hoeft slechts één regel code aan uw ML-code toe te voegen, en SageMaker begrijpt op intelligente wijze uw code samen met de datasets en de instellingen van de werkruimteomgeving en voert deze uit als een SageMaker-trainingstaak. U kunt dan profiteren van de belangrijkste mogelijkheden van het SageMaker-trainingsplatform, zoals de mogelijkheid om taken eenvoudig op te schalen, en andere bijbehorende tools zoals Debugger en Profiler. In deze release kunt u uw lokale machine learning (ML) Python-code uitvoeren als een Amazon SageMaker-trainingstaak met één knooppunt of meerdere parallelle taken. Gedistribueerde trainingstaken (over meerdere knooppunten) worden niet ondersteund door functies op afstand.

In dit bericht laten we u zien hoe u deze nieuwe mogelijkheid kunt gebruiken om lokale ML-code uit te voeren als een SageMaker-trainingstaak.

Overzicht oplossingen

U kunt nu uw ML-code die in uw IDE of notebook is geschreven, uitvoeren als een SageMaker-trainingstaak door de functie, die fungeert als toegangspunt tot de codebasis van de gebruiker, te annoteren met een eenvoudige decorateur. Bij aanroepen maakt deze mogelijkheid automatisch een momentopname van alle bijbehorende variabelen, functies, pakketten, omgevingsvariabelen en andere runtimevereisten van uw ML-code, rangschikt ze en verzendt ze als een SageMaker-trainingstaak. Het integreert met de onlangs aangekondigde SageMaker Python SDK-functie voor het instellen van standaardwaarden voor parameters. Deze mogelijkheid vereenvoudigt de SageMaker-constructies die u moet leren om code te kunnen uitvoeren met behulp van SageMaker Training. Datawetenschappers kunnen hun code schrijven, debuggen en itereren in elke gewenste IDE (zoals Amazon SageMaker Studio, notebooks, VS Code of PyCharm). Als u klaar bent, kunt u uw Python-functie annoteren met de @remote decorateur en voer het uit als een SageMaker-taak op schaal.

Deze mogelijkheid gebruikt bekende open-source Python-objecten als argumenten en uitvoer. Bovendien hoeft u geen verstand te hebben van het beheer van de levenscyclus van containers en kunt u uw workloads eenvoudig uitvoeren in verschillende rekencontexten (zoals een lokale IDE, Studio of trainingstaken) met minimale configuratie-overheads. Om elke lokale code uit te voeren als een SageMaker Training-taak, leidt deze mogelijkheid de configuraties af die nodig zijn om taken uit te voeren, zoals de AWS Identiteits- en toegangsbeheer (IAM)-rol, coderingssleutel en netwerkconfiguratie, vanuit de Studio- of IDE-instellingen (dit kunnen de standaardinstellingen) en geeft ze standaard door aan het platform. U hebt de flexibiliteit om uw runtime in de door SageMaker beheerde infrastructuur aan te passen met behulp van de afgeleide configuratie of ze te overschrijven op SDK-niveau door ze als argumenten door te geven aan de binnenhuisarchitect.

Deze nieuwe mogelijkheid van de SageMaker Python SDK transformeert uw ML-code in een bestaande werkruimteomgeving en alle bijbehorende gegevensverwerkingscode en datasets in een SageMaker-trainingstaak. Deze mogelijkheid zoekt naar ML-code verpakt in een @remote decorateur en vertaalt het automatisch naar een taak die wordt uitgevoerd in Studio of een lokale IDE zoals PyCharm.

In de volgende secties lopen we door de functies van deze nieuwe mogelijkheid en hoe python-functies kunnen worden gestart als SageMaker-trainingstaken.

Voorwaarden

Om deze nieuwe SageMaker Python SDK-mogelijkheid te gebruiken en de code uit te voeren die aan dit bericht is gekoppeld, hebt u de volgende vereisten nodig:

- Een AWS-account dat al uw AWS-bronnen bevat

- Een IAM-rol om toegang te krijgen tot SageMaker

- Toegang tot Studio of een SageMaker-notebookinstantie of een IDE zoals PyCharm

Gebruik de SDK van Studio- en SageMaker-notebooks

U kunt deze mogelijkheid vanuit Studio gebruiken door een notebook te starten en uw code te verpakken in een @remote decorateur in de notebook. U moet eerst de externe functie importeren met behulp van de volgende code:

from sagemaker.remote_function import remoteWanneer u de decorateurfunctie gebruikt, interpreteert deze mogelijkheid automatisch de functie van uw code en voert deze uit als een SageMaker-trainingstaak.

U kunt deze mogelijkheid ook gebruiken vanuit een SageMaker-notebookinstantie. U moet eerst een notebookinstantie starten, Jupyter of Jupyter Lab erop openen en een notebook starten. Importeer vervolgens de externe functie zoals weergegeven in de voorgaande code en verpak uw code met de @remote decorateur. We voegen later in dit bericht een voorbeeld toe van het gebruik van de decorateurfunctie en de bijbehorende instellingen.

Gebruik de SDK uit uw lokale omgeving

U kunt deze mogelijkheid ook gebruiken vanuit uw lokale IDE. Voorwaarde is dat je beschikt over de AWS-opdrachtregelinterface (AWS CLI), SageMaker Python SDK en AWS SDK voor Python (Boto3) geïnstalleerd in uw lokale omgeving. U moet deze bibliotheken in uw code importeren, de SageMaker-sessie instellen, instellingen specificeren en uw functie decoreren met de @remote decorateur. In de volgende voorbeeldcode voeren we een eenvoudige deelfunctie uit als een SageMaker-trainingstaak:

import boto3

import sagemaker

from sagemaker.remote_function import remote sm_session = sagemaker.Session(boto_session=boto3.session.Session(region_name="us-west-2"))

settings = dict(

sagemaker_session=sm_session,

role=<IAM_ROLE_NAME>

instance_type="ml.m5.xlarge",

)

@remote(**settings)

def divide(x, y):

return x / y

if __name__ == "__main__":

print(divide(2, 3.0))We kunnen een vergelijkbare methodologie gebruiken om geavanceerde functies uit te voeren als trainingstaken, zoals weergegeven in de volgende sectie.

Start Python-functies als SageMaker-taken

Met de nieuwe SageMaker Python SDK-functie kunt u Python-functies uitvoeren als SageMaker Training banen. Elke Python-code, ML-trainingscode ontwikkeld door datawetenschappers met behulp van hun favoriete lokale IDE's (PyCharm, VS Code), SageMaker-notebooks of Studio-notebooks kunnen worden gestart als een beheerde SageMaker-taak.

In ML-workloads die deze mogelijkheid gebruiken, worden gekoppelde datasets, afhankelijkheden en instellingen van de werkruimteomgeving geserialiseerd met behulp van de ML-code en uitgevoerd als een SageMaker-taak, synchroon en asynchroon.

U kunt een toevoegen @remote decorateur-annotatie aan elke Python-code inclusief een lokale ML-verwerkings- of trainingsfunctie om deze te starten als een beheerde SageMaker-trainingstaak, waarbij u profiteert van de schaal-, prestatie- en kostenvoordelen van SageMaker. Dit kan worden bereikt met minimale codewijzigingen door een decorateur toe te voegen aan de Python-functiecode. Het aanroepen van de gedecoreerde functie wordt synchroon uitgevoerd en de functie-uitvoering wacht tot de SageMaker-taak is voltooid.

In het volgende voorbeeld gebruiken we de @remote decorateur om SageMaker-taken in decorateurmodus te starten met behulp van een ml.m5.large-instantie. SageMaker gebruikt trainingstaken om deze functie als een beheerde taak te starten.

from sagemaker.remote_function import remote

from numpy as np @remote(instance_type="ml.m5.large")

def matrix_multiply(a, b): return np.matmul(a, b) a = np.array([[1, 0], [0, 1]])

b = np.array([1, 2]) assert matrix_multiply(a, b) == np.array([1,2])U kunt ook de decoratiemodus gebruiken om SageMaker-taken, Python-pakketten en afhankelijkheden te starten. U kunt omgevingsvariabelen zoals VPC, subnetten en beveiligingsgroepen opnemen om SageMaker-trainingstaken in de environment.yml bestand. Hierdoor kunnen ML-engineers en -beheerders deze omgevingsvariabelen configureren, zodat datawetenschappers zich kunnen concentreren op het bouwen van ML-modellen en sneller kunnen itereren. Zie de volgende code:

from sagemaker.remote_function import remote @remote(instance_type="ml.g4dn.xlarge",dependencies = "./environment.yml")

def train_hf_model(

train_input_path,test_input_path,s3_output_path = None,

*,epochs = 1, train_batch_size = 32, eval_batch_size = 64,

warmup_steps = 500,learning_rate = 5e-5

):

model_name = "distilbert-base-uncased"

model = AutoModelForSequenceClassification.from_pretrained(model_name)

... <TRUCNATED>

return os.path.join(s3_output_path, model_dir), eval_resultJe kunt gebruiken RemoteExecutor om Python-functies als SageMaker-taken asynchroon te starten. De uitvoerder peilt asynchroon SageMaker Training-taken om de status van de taak bij te werken. De RemoteExecutor class is een implementatie van de gelijktijdige.futures.Uitvoerder, die wordt gebruikt om SageMaker-trainingstaken asynchroon in te dienen. Zie de volgende code:

from sagemaker.remote_function import RemoteExecutor def train_hf_model(

train_input_path,test_input_path,s3_output_path = None,

*,epochs = 1, train_batch_size = 32, eval_batch_size = 64,

warmup_steps = 500,learning_rate = 5e-5

):

model_name = "distilbert-base-uncased"

model = AutoModelForSequenceClassification.from_pretrained(model_name)

...<TRUNCATED>

return os.path.join(s3_output_path, model_dir), eval_result with RemoteExecutor(instance_type="ml.g4dn.xlarge", dependencies = './requirements.txt') as e:

future = e.submit(train_hf_model, train_input_path,test_input_path,s3_output_path,

epochs, train_batch_size, eval_batch_size,warmup_steps,learning_rate)Pas de runtime-omgeving aan

Decorateurmodus en RemoteExecutor kunt u de runtime-omgevingen voor de SageMaker-taak definiëren en aanpassen. De runtime-afhankelijkheden, inclusief Python-pakketten en omgevingsvariabelen voor SageMaker-taken, kunnen worden opgegeven om de runtime aan te passen. Om lokale Python-code uit te voeren als door SageMaker beheerde taken, moeten het Python-pakket en de afhankelijkheden beschikbaar worden gemaakt voor SageMaker. ML-engineers of data science-beheerders kunnen netwerk- en beveiligingsconfiguraties configureren, zoals VPC, subnetten en beveiligingsgroepen voor SageMaker-taken, zodat datawetenschappers deze centraal beheerde configuraties kunnen gebruiken bij het starten van SageMaker-taken. U kunt ofwel een requirements.txt bestand of een Conda environment.yaml bestand.

Wanneer afhankelijkheden zijn gedefinieerd met requirements.txt, worden de pakketten geïnstalleerd met behulp van pip tijdens de runtime van de taak. Als de afbeelding die wordt gebruikt voor het uitvoeren van de taak wordt geleverd met Conda-omgevingen, worden pakketten geïnstalleerd in de Conda-omgeving die is opgegeven voor gebruik voor taken. De volgende code toont een voorbeeld requirements.txt file:

datasets

transformers

torch

scikit-learn

s3fs==0.4.2

sagemaker>=2.148.0U kunt uw Conda environment.yaml bestand om de Conda-omgeving te maken waarin u uw code wilt laten uitvoeren tijdens de trainingstaak. Als de afbeelding die wordt gebruikt voor het uitvoeren van de taak een Conda-omgeving declareert om de code uit te voeren, werken we de gedeclareerde Conda-omgeving bij met de gegeven specificatie. De volgende code is een voorbeeld van een Conda environment.yaml file:

name: sagemaker_example

channels: - conda-forge

dependencies: - python=3.10 - pandas - pip: - sagemakerAls alternatief kunt u instellen: dependencies=”auto_capture” om de SageMaker Python SDK de geïnstalleerde afhankelijkheden in de actieve Conda-omgeving te laten vastleggen. U moet hiervoor een actieve Conda-omgeving hebben auto_capture werken. Merk op dat er vereisten zijn voor auto_capture werken; we raden u aan uw afhankelijkheden door te geven als een requirement.txt or Conda environment.yml bestand zoals beschreven in de vorige sectie.

Raadpleeg voor meer informatie Voer uw lokale code uit als een SageMaker-trainingstaak.

Configuraties voor SageMaker-taken

Infrastructuurgerelateerde instellingen kunnen worden overgebracht naar een configuratiebestand dat beheerders kunnen helpen bij het instellen. Je hoeft het maar één keer in te stellen. Infrastructuurinstellingen hebben betrekking op de netwerkconfiguratie, IAM-rollen, Amazon eenvoudige opslagservice (Amazon S3) map voor invoer, uitvoergegevens en tags. Verwijzen naar Standaardinstellingen configureren en gebruiken met de SageMaker Python SDK voor meer details.

SchemaVersion: '1.0'

SageMaker:

PythonSDK:

Modules:

RemoteFunction:

Dependencies: path/to/requirements.txt

EnvironmentVariables: {"EnvVarKey": "EnvVarValue"}

ImageUri: 366666666666.dkr.ecr.us-west-2.amazonaws.com/my-image:latest

InstanceType: ml.m5.large

RoleArn: arn:aws:iam::366666666666:role/MyRole

S3KmsKeyId: somekmskeyid

S3RootUri: s3://my-bucket/my-project

SecurityGroupIds:

- sg123

Subnets:

- subnet-1234

Tags:

- {"Key": "someTagKey", "Value": "someTagValue"}

VolumeKmsKeyId: somekmskeyidImplementatie

Deep learning-modellen zoals PyTorch of TensorFlow kunnen ook binnen Studio worden uitgevoerd door de code als trainingstaak binnen de notebook uit te voeren. Om deze mogelijkheid in Studio te demonstreren, kunt u deze repo naar uw Studio klonen en de notebook in de GitHub repository.

Dit voorbeeld demonstreert een use-case van end-to-end binaire tekstclassificatie. We gebruiken de Hugging Face-transformatoren en datasets-bibliotheek om een vooraf getrainde transformator af te stemmen op binaire tekstclassificatie. Met name het vooraf getrainde model zal worden verfijnd met behulp van de IMDb-gegevensset.

Wanneer u de repository kloont, zou u de volgende bestanden moeten vinden:

- config.yaml - De meeste decorateurargumenten kunnen worden overgebracht naar het configuratiebestand om de infrastructuurgerelateerde instellingen te scheiden van de codebasis

- knuffelgezicht.ipynb - Dit bevat de code om een vooraf getraind HuggingFace-model te trainen, dat zal worden verfijnd met behulp van de IMDB-dataset

- requirements.txt - Dit bestand bevat alle afhankelijkheden om de functie uit te voeren die in deze notebook wordt gebruikt voor het uitvoeren van de code en het op afstand uitvoeren van de training in een GPU-instantie als een trainingstaak

Wanneer u de notebook opent, wordt u gevraagd om de notebookomgeving in te stellen. U kunt de Data Science 3.0-image met de Python 3-kernel en ml.m5.large selecteren als snelstartinstantietype voor het uitvoeren van de notebookcode. Dit instantietype is aanzienlijk sneller in het opstarten van een omgeving.

De trainingstaak wordt uitgevoerd in een ml.g4dn.xlarge-instantie zoals gedefinieerd in de config.yaml file:

SchemaVersion: '1.0'

SageMaker:

PythonSDK:

Modules:

RemoteFunction:

# role arn is not required if in SageMaker Notebook instance or SageMaker Studio

# Uncomment the following line and replace with the right execution role if in a local IDE

# RoleArn: <IAM_ROLE_ARN>

InstanceType: ml.g4dn.xlarge

Dependencies: ./requirements.txtDe requirements.txt bestandsafhankelijkheden om de functie voor het trainen van het Hugging Face-model uit te voeren, zijn onder andere:

datasets

transformers

torch

scikit-learn

# lock s3fs to this specific version as more recent ones introduce dependency on aiobotocore, which is not compatible with botocore

s3fs==0.4.2

sagemaker>=2.148.0,<3Het Hugging Face-notebook laat zien hoe je de training op afstand kunt uitvoeren via de @remote functie, die synchroon wordt uitgevoerd. Daarom zal de functierun voor het trainen van het model wachten tot de SageMaker-trainingstaak is voltooid. De training wordt op afstand uitgevoerd met een GPU-instantie waarbij het instantietype is gedefinieerd in het voorgaande configuratiebestand.

Nadat u de trainingstaak hebt uitgevoerd, kunt u de rest van de cellen in het notitieblok uitvoeren om de evaluatiestatistieken te inspecteren en de tekst op ons getrainde model te classificeren.

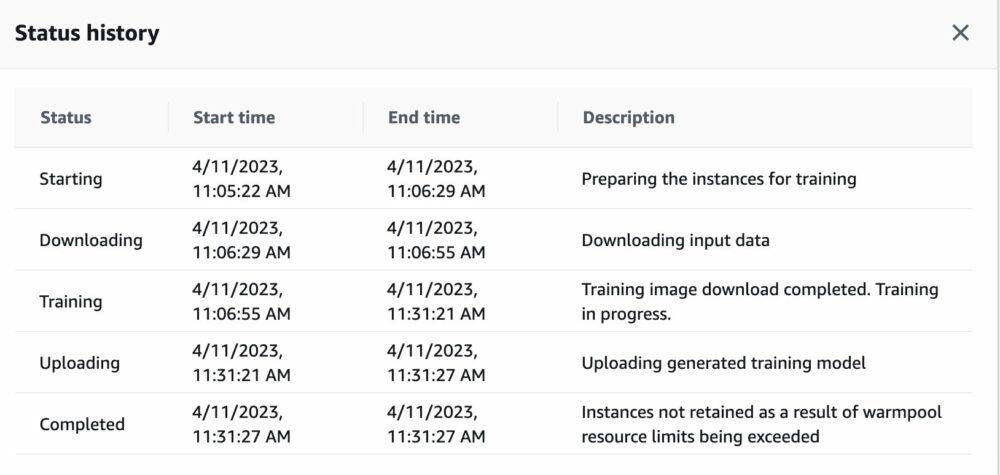

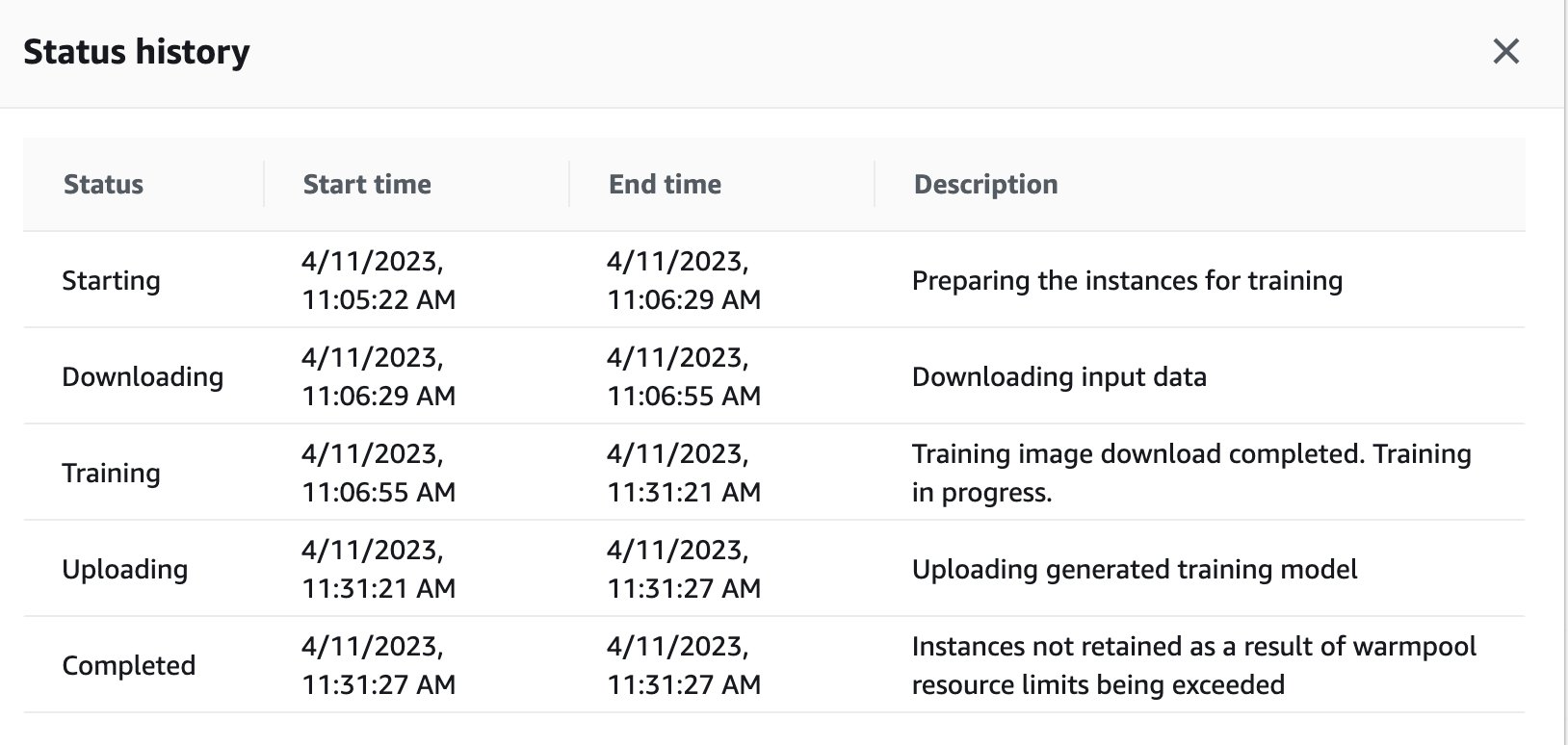

U kunt ook de status van de trainingstaak bekijken die op afstand is geactiveerd in de GPU-instantie op het SageMaker-dashboard door terug te gaan naar de SageMaker-console.

Zodra de trainingstaak is voltooid, worden de instructies in het notitieboek verder uitgevoerd voor evaluatie en classificatie. Soortgelijke taken kunnen worden getraind en uitgevoerd via de externe uitvoerderfunctie die is ingebed in Studio-notebooks om de runs asynchroon uit te voeren.

Integratie met SageMaker-experimenten binnen een @remote-functie

U kunt uw experimentnaam, runnaam en andere parameters doorgeven aan uw externe functie om een SageMaker-experimentenrun te maken. Het volgende codevoorbeeld importeert de experimentnaam, de naam van de uitvoering en de parameters die voor elke uitvoering moeten worden vastgelegd:

from sagemaker.remote_function import remote

from sagemaker.experiments.run import Run

# Define your remote function

@remote

def train(value_1, value_2, exp_name, run_name):

...

...

#Creates the experiment

with Run( experiment_name=exp_name, run_name=run_name, sagemaker_session=sagemaker_session

) as run:

...

...

#Define values for the parameters to log

run.log_parameter("param_1", value_1)

run.log_parameter("param_2", value_2)

...

...

#Define metrics to log

run.log_metric("metric_a", 0.5)

run.log_metric("metric_b", 0.1) # Invoke your remote function

train(1.0, 2.0, "my-exp-name", "my-run-name") In het voorgaande voorbeeld zijn de parameters p1 en p2 worden in de loop van de tijd vastgelegd in een trainingslus. Gemeenschappelijke parameters kunnen batchgrootte of tijdperken zijn. In het voorbeeld de statistieken A en B worden gelogd voor een run-over-tijd binnen een trainingslus. Gemeenschappelijke statistieken kunnen nauwkeurigheid of verlies omvatten. Voor meer informatie, zie Maak een Amazon SageMaker-experiment.

Conclusie

In dit bericht hebben we een nieuwe SageMaker Python SDK-mogelijkheid geïntroduceerd waarmee datawetenschappers hun ML-code in hun favoriete IDE kunnen uitvoeren als SageMaker-trainingstaken. We hebben de vereisten besproken die nodig zijn om deze mogelijkheid samen met de functies ervan te gebruiken. We hebben ook laten zien hoe u deze mogelijkheid kunt gebruiken in Studio, SageMaker-notebookinstanties en uw lokale IDE. Daarnaast hebben we voorbeeldcodevoorbeelden gegeven om te demonstreren hoe u deze mogelijkheid kunt gebruiken. Als volgende stap raden we aan deze mogelijkheid in uw IDE of SageMaker uit te proberen door de code voorbeelden waarnaar in dit bericht wordt verwezen.

Over de auteurs

Dipankar Patro is Software Development Engineer bij AWS SageMaker, innoveert en bouwt MLOps-oplossingen om klanten te helpen AI/ML-oplossingen op grote schaal te implementeren. Hij heeft een MS in computerwetenschappen en zijn interessegebieden zijn computerbeveiliging, gedistribueerde systemen en AI/ML.

Dipankar Patro is Software Development Engineer bij AWS SageMaker, innoveert en bouwt MLOps-oplossingen om klanten te helpen AI/ML-oplossingen op grote schaal te implementeren. Hij heeft een MS in computerwetenschappen en zijn interessegebieden zijn computerbeveiliging, gedistribueerde systemen en AI/ML.

Farooq Sabir is een Senior Artificial Intelligence en Machine Learning Specialist Solutions Architect bij AWS. Hij heeft een doctoraat en een MS-graad in Electrical Engineering van de Universiteit van Texas in Austin en een MS in Computer Science van het Georgia Institute of Technology. Hij heeft meer dan 15 jaar werkervaring en geeft ook graag les en begeleidt studenten. Bij AWS helpt hij klanten bij het formuleren en oplossen van hun zakelijke problemen op het gebied van datawetenschap, machine learning, computervisie, kunstmatige intelligentie, numerieke optimalisatie en aanverwante domeinen. Gevestigd in Dallas, Texas, houden hij en zijn gezin van reizen en lange roadtrips maken.

Farooq Sabir is een Senior Artificial Intelligence en Machine Learning Specialist Solutions Architect bij AWS. Hij heeft een doctoraat en een MS-graad in Electrical Engineering van de Universiteit van Texas in Austin en een MS in Computer Science van het Georgia Institute of Technology. Hij heeft meer dan 15 jaar werkervaring en geeft ook graag les en begeleidt studenten. Bij AWS helpt hij klanten bij het formuleren en oplossen van hun zakelijke problemen op het gebied van datawetenschap, machine learning, computervisie, kunstmatige intelligentie, numerieke optimalisatie en aanverwante domeinen. Gevestigd in Dallas, Texas, houden hij en zijn gezin van reizen en lange roadtrips maken.

Manoj Ravi is Senior Product Manager voor Amazon SageMaker. Hij is gepassioneerd door het bouwen van next-gen AI-producten en werkt aan software en tools om grootschalige machine learning makkelijker te maken voor klanten. Hij heeft een MBA van de Haas School of Business en een Master in Information Systems Management van de Carnegie Mellon University. In zijn vrije tijd speelt Manoj graag tennis en houdt hij zich bezig met landschapsfotografie.

Manoj Ravi is Senior Product Manager voor Amazon SageMaker. Hij is gepassioneerd door het bouwen van next-gen AI-producten en werkt aan software en tools om grootschalige machine learning makkelijker te maken voor klanten. Hij heeft een MBA van de Haas School of Business en een Master in Information Systems Management van de Carnegie Mellon University. In zijn vrije tijd speelt Manoj graag tennis en houdt hij zich bezig met landschapsfotografie.

Shikhar Kwatra is een AI/ML Specialist Solutions Architect bij Amazon Web Services en werkt samen met een toonaangevende Global System Integrator. Hij heeft de titel verdiend van een van de jongste Indiase meester-uitvinders met meer dan 500 patenten op het gebied van AI/ML en IoT. Shikhar helpt bij het ontwerpen, bouwen en onderhouden van kostenefficiënte, schaalbare cloudomgevingen voor de organisatie, en ondersteunt de GSI-partner bij het bouwen van strategische brancheoplossingen op AWS. Shikhar speelt graag gitaar, componeert muziek en beoefent in zijn vrije tijd mindfulness.

Shikhar Kwatra is een AI/ML Specialist Solutions Architect bij Amazon Web Services en werkt samen met een toonaangevende Global System Integrator. Hij heeft de titel verdiend van een van de jongste Indiase meester-uitvinders met meer dan 500 patenten op het gebied van AI/ML en IoT. Shikhar helpt bij het ontwerpen, bouwen en onderhouden van kostenefficiënte, schaalbare cloudomgevingen voor de organisatie, en ondersteunt de GSI-partner bij het bouwen van strategische brancheoplossingen op AWS. Shikhar speelt graag gitaar, componeert muziek en beoefent in zijn vrije tijd mindfulness.

Vikram Elango is Sr. AI/ML Specialist Solutions Architect bij AWS, gevestigd in Virginia, VS. Hij richt zich momenteel op generatieve AI, LLM's, prompt engineering, optimalisatie van grote modellen en het opschalen van ML binnen ondernemingen. Vikram helpt klanten uit de financiële en verzekeringssector met ontwerp en leiderschap om machine learning-applicaties op schaal te bouwen en te implementeren. In zijn vrije tijd houdt hij van reizen, wandelen, koken en kamperen.

Vikram Elango is Sr. AI/ML Specialist Solutions Architect bij AWS, gevestigd in Virginia, VS. Hij richt zich momenteel op generatieve AI, LLM's, prompt engineering, optimalisatie van grote modellen en het opschalen van ML binnen ondernemingen. Vikram helpt klanten uit de financiële en verzekeringssector met ontwerp en leiderschap om machine learning-applicaties op schaal te bouwen en te implementeren. In zijn vrije tijd houdt hij van reizen, wandelen, koken en kamperen.

- Door SEO aangedreven content en PR-distributie. Word vandaag nog versterkt.

- PlatoAiStream. Web3 gegevensintelligentie. Kennis versterkt. Toegang hier.

- De toekomst slaan met Adryenn Ashley. Toegang hier.

- Bron: https://aws.amazon.com/blogs/machine-learning/run-your-local-machine-learning-code-as-amazon-sagemaker-training-jobs-with-minimal-code-changes/

- : heeft

- :is

- :niet

- $UP

- 1

- 10

- 100

- 15 jaar

- 500

- 7

- a

- vermogen

- in staat

- Over

- toegang

- Account

- nauwkeurigheid

- bereikt

- over

- actieve

- Handelingen

- toevoegen

- toe te voegen

- toevoeging

- beheerder

- beheerders

- adopteren

- vergevorderd

- Voordeel

- AI

- AI / ML

- AIDS

- Alles

- toestaat

- langs

- ook

- Amazone

- Amazon Sage Maker

- Amazon Web Services

- an

- analyseren

- en

- aangekondigd

- elke

- toepassingen

- ZIJN

- gebieden

- argumenten

- kunstmatig

- kunstmatige intelligentie

- Kunstmatige intelligentie en machine learning

- AS

- geassocieerd

- At

- austin

- webmaster.

- Beschikbaar

- AWS

- terug

- baseren

- gebaseerde

- BE

- betekent

- Begrotingen

- bouw

- Gebouw

- bedrijfsdeskundigen

- by

- CAN

- mogelijkheden

- vangen

- Carnegie Mellon

- dragen

- geval

- Cellen

- verandering

- Wijzigingen

- kanalen

- keuze

- klasse

- classificatie

- classificeren

- Cloud

- code

- codebasis

- College

- komt

- Gemeen

- verenigbaar

- compleet

- Berekenen

- computer

- Computer Science

- Computer beveiliging

- Computer visie

- concept

- Configuratie

- troosten

- bevatten

- Containers

- bevat

- contexten

- blijft

- Kern

- Kosten

- kon

- deksel

- en je merk te creëren

- Op dit moment

- Klanten

- aan te passen

- Dallas

- dashboards

- gegevens

- gegevensverwerking

- data science

- datasets

- verklaart

- Standaard

- defaults

- gedefinieerd

- tonen

- demonstreert

- Afhankelijkheid

- implementeren

- beschreven

- Design

- gegevens

- ontwikkelde

- Ontwikkelaar

- Ontwikkeling

- anders

- besproken

- verdeeld

- gedistribueerde systemen

- gedistribueerde training

- domeinen

- gedaan

- Dont

- gedurende

- e

- elk

- verdiend

- makkelijk te gebruiken

- gemakkelijker

- gemakkelijk

- beide

- ingebed

- maakt

- encryptie

- eind tot eind

- ingenieur

- Engineering

- Ingenieurs

- bedrijven

- toegang

- Milieu

- omgevingen

- tijdperk

- tijdperken

- evaluatie

- Alle

- voorbeeld

- voorbeelden

- uitvoering

- bestaand

- ervaring

- experiment

- Gezicht

- vertrouwd

- familie

- SNELLE

- sneller

- Kenmerk

- Voordelen

- weinig

- Dien in

- Bestanden

- financieel

- Voornaam*

- Flexibiliteit

- Focus

- gericht

- volgend

- Voor

- Achtergrond

- oppompen van

- geheel

- functie

- functies

- Bovendien

- toekomst

- Futures

- generatief

- generatieve AI

- gegeven

- Globaal

- Go

- GPU

- Groep

- Hebben

- he

- hulp

- helpt

- zijn

- houdt

- Hoe

- How To

- HTML

- http

- HTTPS

- KnuffelenGezicht

- Identiteit

- if

- beeld

- uitvoering

- importeren

- invoer

- in

- omvatten

- Inclusief

- Indian

- -industrie

- informatie

- Informatie Systemen

- Infrastructuur

- innoveren

- invoer

- geïnstalleerd

- instantie

- Instituut

- instructies

- verzekering

- geïntegreerde

- integreert

- Intelligentie

- belang

- in

- voorstellen

- geïntroduceerd

- Uitvinders

- iot

- IT

- iteraties

- HAAR

- Jobomschrijving:

- Vacatures

- jpg

- voor slechts

- sleutel

- laboratorium

- Landschap

- laptops

- Groot

- grootschalig

- laatste

- lancering

- gelanceerd

- lancering

- Leadership

- leidend

- LEARN

- leren

- laten

- Laten we

- bibliotheken

- Bibliotheek

- levenscyclus van uw product

- als

- sympathieën

- Lijn

- lokaal

- plaatselijk

- gelegen

- inloggen

- ingelogd

- lang

- LOOKS

- uit

- liefde

- machine

- machine learning

- gemaakt

- Het handhaven

- maken

- MERKEN

- beheerd

- management

- manager

- meester

- Mei..

- Mellon

- Methodologie

- Metriek

- Mindfulness

- minimaal

- minuten

- ML

- MLops

- Mode

- model

- modellen

- Modules

- meer

- meest

- beweging

- MS

- meervoudig

- Muziek

- naam

- namelijk

- navigeren

- Noodzaak

- nodig

- netwerk

- netwerken

- New

- volgende

- knooppunten

- notitieboekje

- nu

- numpy

- objecten

- of

- on

- Aan boord

- eens

- EEN

- Slechts

- open

- open source

- optimalisatie

- or

- bestellen

- organisatie

- OS

- Overige

- onze

- uit

- uitgang

- over

- override

- pakket

- Paketten

- panda's

- Parallel

- parameters

- bijzonder

- partner

- passeren

- passes

- Voorbijgaand

- hartstochtelijk

- Octrooien

- pad

- prestatie

- fotografie

- platform

- Plato

- Plato gegevensintelligentie

- PlatoData

- spelen

- punt

- Post

- bij voorkeur

- vereisten

- vorig

- probleem

- problemen

- verwerking

- Product

- product manager

- productief

- Producten

- mits

- Python

- pytorch

- klaar

- recent

- onlangs

- adviseren

- verwant

- los

- vanop

- vervangen

- bewaarplaats

- nodig

- Voorwaarden

- REST

- terugkeer

- weg

- Rol

- rollen

- lopen

- lopend

- sagemaker

- schaalbare

- Scale

- scaling

- School

- Wetenschap

- wetenschappers

- scikit-leren

- sdk

- naadloos

- sectie

- secties

- veiligheid

- zien

- senior

- apart

- Diensten

- Sessie

- reeks

- het instellen van

- settings

- setup

- verscheidene

- moet

- tonen

- showcase

- getoond

- Shows

- aanzienlijk

- gelijk

- Eenvoudig

- eenvoudigweg

- single

- Maat

- Klein

- Momentopname

- So

- Software

- software development

- Oplossingen

- OPLOSSEN

- specialist

- specifiek

- specificatie

- gespecificeerd

- begin

- Start

- Status

- Stap voor

- mediaopslag

- strategisch

- Leerlingen

- studio

- voorleggen

- subnetten

- dergelijk

- ondersteunde

- steunen

- system

- Systems

- Nemen

- neemt

- het nemen

- taken

- teams

- Technologie

- tensorflow

- Texas

- Tekstclassificatie

- dat

- De

- hun

- Ze

- harte

- Er.

- daarbij

- daarom

- Deze

- ze

- dit

- gedachte

- thought leadership

- Door

- niet de tijd of

- Titel

- naar

- tools

- fakkel

- in de richting van

- Trainen

- getraind

- Trainingen

- transformers

- reizen

- Reizend

- veroorzaakt

- type dan:

- typisch

- voor

- begrijpen

- universiteit-

- bijwerken

- us

- .

- use case

- gebruikt

- gebruikers

- gebruik

- waarde

- Values

- versie

- via

- Bekijk

- Virginia

- visie

- vs

- versus codes

- wachten

- willen

- we

- web

- webservices

- wanneer

- welke

- en

- wil

- Met

- binnen

- Mijn werk

- werkzaam

- Bedrijven

- zou

- wikkel

- Wrapped

- schrijven

- code schrijven

- geschreven

- X

- jaar

- You

- jongste

- Your

- zephyrnet