Wij geloven dat generatieve AI op termijn het potentieel heeft om vrijwel elke klantervaring die we kennen te transformeren. Het aantal bedrijven dat generatieve AI-toepassingen op AWS lanceert is aanzienlijk en groeit snel, waaronder adidas, Booking.com, Bridgewater Associates, Clariant, Cox Automotive, GoDaddy en LexisNexis Legal & Professional, om er maar een paar te noemen. Innovatieve startups zoals Perplexity AI gaan all-in op AWS voor generatieve AI. Toonaangevende AI-bedrijven zoals Anthropic hebben AWS geselecteerd als hun primaire cloudprovider voor missiekritieke workloads en de plek om hun toekomstige modellen te trainen. En mondiale aanbieders van diensten en oplossingen zoals Accenture plukken de vruchten van op maat gemaakte generatieve AI-applicaties, omdat ze hun interne ontwikkelaars de mogelijkheid bieden Amazon Code Whisperer.

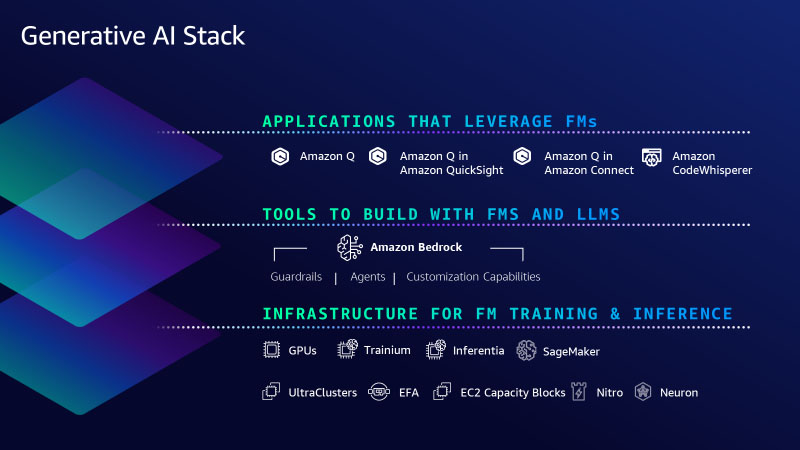

Deze klanten kiezen voor AWS omdat we gefocust zijn op doen wat we altijd hebben gedaan: complexe en dure technologie gebruiken die klantervaringen en bedrijven kan transformeren en deze democratiseren voor klanten van elke omvang en met technische capaciteiten. Om dit te doen, investeren en innoveren we snel om de meest uitgebreide reeks mogelijkheden te bieden over de drie lagen van de generatieve AI-stack. De onderste laag is de infrastructuur om Large Language Models (LLM's) en andere Foundation Models (FM's) te trainen en gevolgtrekkingen of voorspellingen te produceren. De middelste laag biedt gemakkelijke toegang tot alle modellen en tools die klanten nodig hebben om generatieve AI-applicaties te bouwen en te schalen met dezelfde beveiliging, toegangscontrole en andere functies die klanten van een AWS-service verwachten. En op de bovenste laag hebben we geïnvesteerd in baanbrekende toepassingen op belangrijke gebieden zoals generatieve, op AI gebaseerde codering. Klanten bieden hen niet alleen keuze en – zoals ze van ons verwachten – breedte en diepte van mogelijkheden over alle lagen heen, maar vertellen ons ook dat ze onze data-first-aanpak waarderen en erop vertrouwen dat we alles vanaf de grond af aan hebben opgebouwd met enterprise-oplossingen. hoogwaardige beveiliging en privacy.

Deze week hebben we een grote stap voorwaarts gezet door veel belangrijke nieuwe mogelijkheden in alle drie de lagen van de stapel aan te kondigen, zodat het voor onze klanten gemakkelijk en praktisch wordt om generatieve AI alomtegenwoordig in hun bedrijf te gebruiken.

Onderste laag van de stapel: AWS Trainium2 is de nieuwste toevoeging die de meest geavanceerde cloudinfrastructuur voor generatieve AI levert

De onderste laag van de stapel is de infrastructuur – rekenkracht, netwerken, frameworks, services – die nodig is om LLM’s en andere FM’s te trainen en te runnen. AWS innoveert om de meest geavanceerde infrastructuur voor ML te bieden. Dankzij onze langdurige samenwerking met NVIDIA was AWS ruim twaalf jaar geleden de eerste die GPU's naar de cloud bracht, en recentelijk waren we de eerste grote cloudprovider die NVIDIA H12 GPU's beschikbaar maakte met onze P100-instances. We blijven investeren in unieke innovaties die van AWS de beste cloud maken om GPU’s te draaien, inclusief de prijs-prestatievoordelen van het meest geavanceerde virtualisatiesysteem (AWS Nitro), krachtige netwerken op petabit-schaal met Elastic Fabric Adapter (EFA) en hyper- schaalclustering met Amazon EC5 UltraClusters (duizenden versnelde instances gelokaliseerd in een Availability Zone en onderling verbonden in een niet-blokkerend netwerk dat tot 2 Gbps kan leveren voor grootschalige ML-training). We maken het voor elke klant ook gemakkelijker om toegang te krijgen tot de zeer gewilde GPU-rekencapaciteit voor generatieve AI met Amazon EC3,200 Capacity Blocks for ML – het eerste en enige consumptiemodel in de branche waarmee klanten GPU’s kunnen reserveren voor toekomstig gebruik (tot 2 geïmplementeerd in EC500 UltraClusters) voor ML-workloads van korte duur.

Een aantal jaren geleden realiseerden we ons dat we, als we de grenzen op het gebied van prijs-prestatie willen blijven verleggen, moesten innoveren tot aan het silicium, en we begonnen te investeren in onze eigen chips. Specifiek voor ML zijn we begonnen met AWS Inferentia, onze speciaal gebouwde inferentiechip. Vandaag zijn we bezig met onze tweede generatie AWS Inferentia met Amazon EC2 Inf2-instanties die specifiek zijn geoptimaliseerd voor grootschalige generatieve AI-toepassingen met modellen die honderden miljarden parameters bevatten. Inf2-instances bieden de laagste kosten voor inferentie in de cloud en leveren tegelijkertijd een tot vier keer hogere doorvoer en tot tien keer lagere latentie vergeleken met Inf1-instances. Inf12 wordt aangedreven door maximaal twaalf Inferentia2-chips en is de enige voor inferentie geoptimaliseerde EC2-instances met snelle connectiviteit tussen versnellers, zodat klanten sneller en efficiënter (tegen lagere kosten) inferentie kunnen uitvoeren zonder dat dit ten koste gaat van de prestaties of latentie door het distribueren van ultragrote modellen over meerdere versnellers. Klanten als Adobe, Deutsche Telekom en Leonardo.ai hebben geweldige eerste resultaten gezien en zijn enthousiast om hun modellen op schaal in te zetten op Inf2.

Aan de trainingskant zijn Trn1-instanties, mogelijk gemaakt door AWS's speciaal gebouwde ML-trainingschip, AWS Trainium, geoptimaliseerd om training te distribueren over meerdere servers die zijn verbonden met EFA-netwerken. Klanten zoals Ricoh hebben in slechts enkele dagen een Japanse LLM getraind met miljarden parameters. Databricks krijgt tot 40% betere prijs-prestaties met op Trainium gebaseerde instanties om grootschalige deep learning-modellen te trainen. Maar nu er vrijwel elke week nieuwe, krachtigere modellen uitkomen, blijven we de grenzen op het gebied van prestaties en schaal verleggen, en we zijn verheugd om aan te kondigen AWS Trainium2, ontworpen om nog betere prijs-prestaties te leveren voor trainingsmodellen met honderden miljarden tot biljoenen parameters. Trainium2 zou tot vier keer snellere trainingsprestaties moeten leveren dan Trainium van de eerste generatie, en bij gebruik in EC2 zouden UltraClusters tot 65 exaflops aan geaggregeerde rekenkracht moeten leveren. Dit betekent dat klanten in weken in plaats van maanden een LLM met 300 miljard parameters kunnen trainen. De prestaties, schaal en energie-efficiëntie van Trainium2 zijn enkele van de redenen waarom Anthropic ervoor heeft gekozen zijn modellen op AWS te trainen en Trainium2 voor zijn toekomstige modellen zal gebruiken. En we werken samen met Anthropic aan voortdurende innovatie met zowel Trainium als Inferentia. We verwachten dat onze eerste Trainium2-instanties in 2024 beschikbaar zullen zijn voor klanten.

We hebben ook de softwaretoolketen voor ons ML-silicium verdubbeld, met name bij het bevorderen van AWS Neuron, de software development kit (SDK) die klanten helpt de maximale prestaties uit Trainium en Inferentia te halen. Sinds de introductie van Neuron in 2019 hebben we substantieel geïnvesteerd in compiler- en raamwerktechnologieën, en vandaag de dag ondersteunt Neuron veel van de meest populaire publiekelijk verkrijgbare modellen, waaronder Llama 2 van Meta, MPT van Databricks en Stable Diffusion van Stability AI, evenals 93 van de top 100 modellen in de populaire modellenrepository Hugging Face. Neuron kan worden aangesloten op populaire ML-frameworks zoals PyTorch en TensorFlow, en ondersteuning voor JAX komt begin volgend jaar. Klanten vertellen ons dat Neuron het voor hen gemakkelijk heeft gemaakt om hun bestaande modeltraining- en inferentiepijplijnen met slechts een paar regels code over te zetten naar Trainium en Inferentia.

Niemand anders biedt dezelfde combinatie van keuze uit de beste ML-chips, supersnelle netwerken, virtualisatie en hyperscale clusters. En dus is het niet verrassend dat enkele van de meest bekende generatieve AI-startups zoals AI21 Labs, Anthropic, Hugging Face, Perplexity AI, Runway en Stability AI op AWS draaien. Maar u hebt nog steeds de juiste tools nodig om deze rekenkracht effectief te kunnen inzetten om LLM's en andere FM's efficiënt en kosteneffectief te bouwen, trainen en runnen. En voor veel van deze startups is Amazon Sage Maker is het antwoord. Of het nu gaat om het bouwen en trainen van een nieuw, eigen model vanaf nul of om te beginnen met een van de vele populaire, openbaar beschikbare modellen, training is een complexe en dure onderneming. Het is ook niet eenvoudig om deze modellen kosteneffectief te gebruiken. Klanten moeten grote hoeveelheden data verzamelen en voorbereiden. Meestal gaat dit gepaard met veel handmatig werk: het opschonen van gegevens, het verwijderen van duplicaten, het verrijken en transformeren ervan. Vervolgens moeten ze grote clusters van GPU's/versnellers creëren en onderhouden, code schrijven om de modeltraining efficiënt over clusters te verdelen, het model regelmatig controleren, pauzeren, inspecteren en optimaliseren, en handmatig ingrijpen en hardwareproblemen in het cluster oplossen. Veel van deze uitdagingen zijn niet nieuw; het zijn enkele van de redenen waarom we SageMaker zes jaar geleden lanceerden – om de vele barrières die betrokken zijn bij modeltraining en -implementatie te slechten en ontwikkelaars een veel eenvoudiger manier te bieden. Tienduizenden klanten gebruiken Amazon SageMaker, en een toenemend aantal van hen, zoals LG AI Research, Perplexity AI, AI21, Hugging Face en Stability AI, traint LLM's en andere FM's op SageMaker. Onlangs heeft het Technology Innovation Institute (makers van de populaire Falcon LLM’s) het grootste publiekelijk beschikbare model – Falcon 180B – getraind op SageMaker. Naarmate de omvang en complexiteit van modellen zijn toegenomen, groeit ook de reikwijdte van SageMaker.

In de loop der jaren hebben we meer dan 380 baanbrekende functies en mogelijkheden aan Amazon SageMaker toegevoegd, zoals automatische modelafstemming, gedistribueerde training, flexibele modelimplementatieopties, tools voor ML OP's, tools voor gegevensvoorbereiding, featurestores, notebooks, naadloze integratie met human-in-the-loop evaluaties gedurende de gehele ML-levenscyclus, en ingebouwde functies voor verantwoorde AI. We blijven snel innoveren om ervoor te zorgen dat klanten van SageMaker inferentie kunnen blijven bouwen, trainen en uitvoeren voor alle modellen, inclusief LLM's en andere FM's. En we maken het voor klanten nog eenvoudiger en kosteneffectiever om grote modellen te trainen en te implementeren met twee nieuwe mogelijkheden. Ten eerste willen we de training vereenvoudigen de invoering Amazon SageMaker HyperPod waarmee meer van de processen worden geautomatiseerd die nodig zijn voor grootschalige fouttolerante gedistribueerde training (bijvoorbeeld het configureren van gedistribueerde trainingsbibliotheken, het opschalen van de trainingsbelasting over duizenden accelerators, het detecteren en repareren van defecte instances), waardoor de training met maar liefst 40% kan worden versneld. Als gevolg hiervan gebruiken klanten zoals Perplexity AI, Hugging Face, Stability, Hippocratic, Alkaid en anderen SageMaker HyperPod om modellen te bouwen, trainen of ontwikkelen. Seconde, we introduceren nieuwe mogelijkheden om inferentie kosteneffectiever te maken en tegelijkertijd de latentie te verminderen. SageMaker helpt klanten nu meerdere modellen op dezelfde instantie te implementeren, zodat ze computerbronnen kunnen delen, waardoor de gevolgtrekkingskosten (gemiddeld) met 50% worden verlaagd. SageMaker bewaakt ook actief instanties die inferentieverzoeken verwerken en routeert verzoeken op intelligente wijze op basis van welke instanties beschikbaar zijn, waardoor (gemiddeld) een 20% lagere inferentielatentie wordt bereikt. Conjecture, Salesforce en Slack gebruiken SageMaker al voor het hosten van modellen vanwege deze gevolgtrekkingsoptimalisaties.

Middelste laag van de stapel: Amazon Bedrock voegt nieuwe modellen toe en een golf aan nieuwe mogelijkheden maakt het voor klanten nog eenvoudiger om generatieve AI-applicaties veilig te bouwen en te schalen

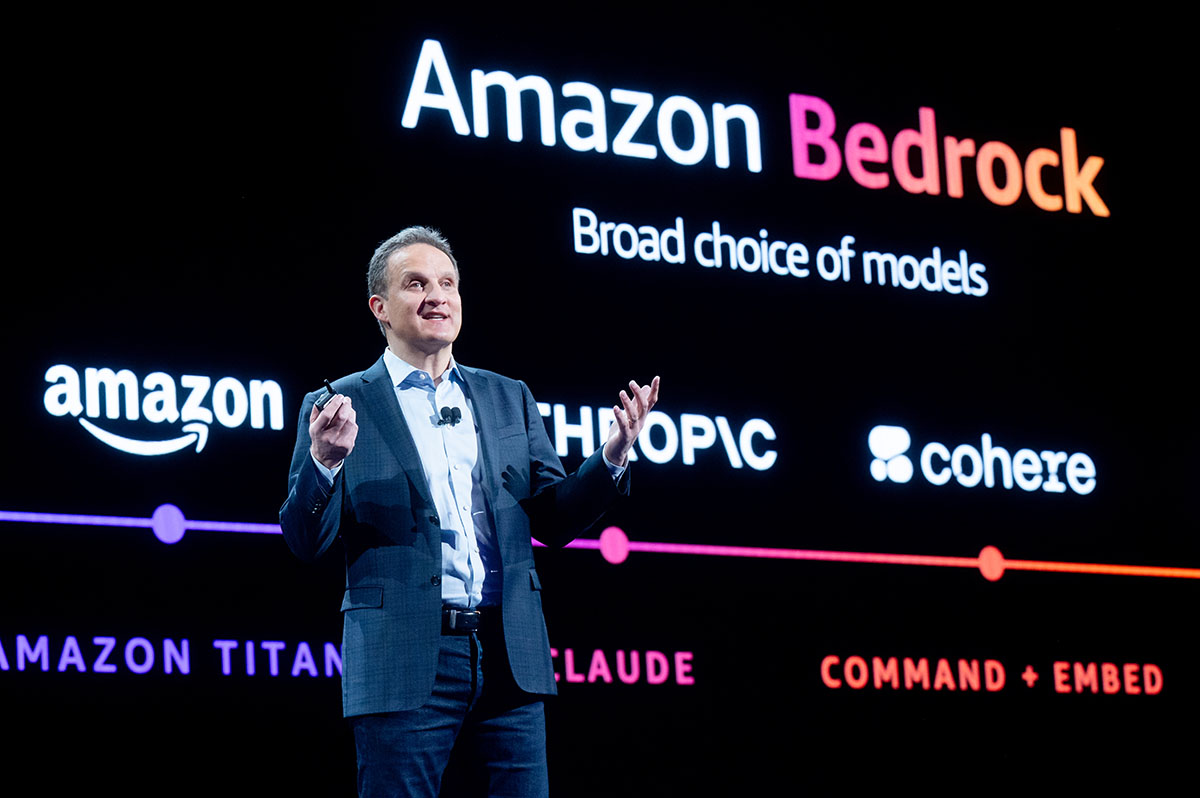

Hoewel een aantal klanten hun eigen LLM's en andere FM's zullen bouwen, of een aantal van de openbaar beschikbare opties zullen ontwikkelen, zullen velen de middelen en tijd niet willen besteden om dit te doen. Voor hen biedt de middelste laag van de stapel deze modellen als service aan. Onze oplossing hier, Amazonebodem, stelt klanten in staat te kiezen uit toonaangevende modellen van Anthropic, Stability AI, Meta, Cohere, AI21 en Amazon, deze aan te passen met hun eigen gegevens en gebruik te maken van dezelfde toonaangevende beveiliging, toegangscontroles en functies die ze gewend zijn in AWS – allemaal via een beheerde service. Eind september hebben we Amazon Bedrock algemeen beschikbaar gemaakt en de reacties van klanten waren overweldigend positief. Klanten van over de hele wereld en uit vrijwel elke branche zijn enthousiast over het gebruik van Amazon Bedrock. Adidas stelt ontwikkelaars in staat snel antwoord te krijgen op alles, van ‘aan de slag’-informatie tot diepere technische vragen. Booking.com is van plan generatieve AI te gebruiken om reisaanbevelingen op maat voor elke klant te schrijven. Bridgewater Associates ontwikkelt een LLM-aangedreven Investment Analyst Assistant om grafieken te helpen genereren, financiële indicatoren te berekenen en resultaten samen te vatten. Carrier maakt nauwkeurigere energieanalyses en -inzichten toegankelijk voor klanten, zodat zij het energieverbruik kunnen verminderen en de COXNUMX-uitstoot kunnen terugdringen. Clariant geeft zijn teamleden de beschikking over een interne generatieve AI-chatbot om R&D-processen te versnellen, verkoopteams te ondersteunen bij het voorbereiden van vergaderingen en om e-mails van klanten te automatiseren. GoDaddy helpt klanten hun bedrijf eenvoudig online op te zetten door generatieve AI te gebruiken om hun websites te bouwen, leveranciers te vinden, contact te leggen met klanten en meer. Lexis Nexis Legal & Professional transformeert het juridische werk voor advocaten en verhoogt hun productiviteit met Lexis+ AI-mogelijkheden voor het zoeken naar gesprekken, het samenvatten en het opstellen en analyseren van documenten. Nasdaq helpt onderzoeksworkflows voor verdachte transacties te automatiseren en hun anti-financiële misdaad- en surveillancecapaciteiten te versterken. Al deze – en nog veel meer – diverse generatieve AI-applicaties draaien op AWS.

We zijn enthousiast over het momentum voor Amazon Bedrock, maar het staat nog in de kinderschoenen. Wat we hebben gezien tijdens onze samenwerking met klanten is dat iedereen snel beweegt, maar dat de evolutie van generatieve AI zich in een hoog tempo voortzet, waarbij nieuwe opties en innovaties vrijwel dagelijks plaatsvinden. Klanten ontdekken dat er verschillende modellen zijn die beter werken voor verschillende gebruiksscenario's of op verschillende datasets. Sommige modellen zijn geweldig voor samenvattingen, andere zijn geweldig voor redeneren en integreren, en weer andere hebben echt geweldige taalondersteuning. En dan is er nog het genereren van afbeeldingen, gebruiksscenario's voor zoeken en meer, allemaal afkomstig van zowel bedrijfseigen modellen als van modellen die voor iedereen openbaar beschikbaar zijn. En in tijden waarin er zoveel onkenbaar is, is het aanpassingsvermogen misschien wel het meest waardevolle instrument van allemaal. Er zal niet één model zijn dat ze allemaal regeert. En zeker niet slechts één technologiebedrijf dat de modellen levert die iedereen gebruikt. Klanten moeten verschillende modellen uitproberen. Ze moeten tussen beide kunnen schakelen of ze kunnen combineren binnen dezelfde use case. Dit betekent dat ze een echte keuze aan modelaanbieders nodig hebben (wat de gebeurtenissen van de afgelopen tien dagen nog duidelijker hebben gemaakt). Dit is de reden waarom we Amazon Bedrock hebben uitgevonden, waarom het zo diep aanslaat bij klanten, en waarom we blijven innoveren en snel herhalen om het bouwen met (en schakelen tussen) een reeks modellen net zo eenvoudig te maken als een API-aanroep, met de nieuwste technieken voor modelaanpassing in handen van alle ontwikkelaars, en om klanten veilig te houden en hun gegevens privé. We zijn verheugd om verschillende nieuwe mogelijkheden te introduceren die het voor klanten nog eenvoudiger zullen maken om generatieve AI-applicaties te bouwen en te schalen:

- Uitbreiding van de modelkeuze met Anthropic Claude 2.1, Meta Llama 2 70B en toevoegingen aan de Amazon Titan-familie. In deze begindagen leren en experimenteren klanten nog steeds met verschillende modellen om te bepalen welke ze voor verschillende doeleinden willen gebruiken. Ze willen gemakkelijk de nieuwste modellen kunnen uitproberen, en ook testen om te zien welke mogelijkheden en functies hen de beste resultaten en kostenkenmerken zullen opleveren voor hun gebruiksscenario's. Met Amazon Bedrock zijn klanten slechts één API-oproep verwijderd van een nieuw model. Enkele van de meest indrukwekkende resultaten die klanten de afgelopen maanden hebben ervaren, zijn afkomstig van bijvoorbeeld LLM's Het Claude-model van Anthropic, dat uitblinkt in een breed scala aan taken, van geavanceerde dialogen en het genereren van inhoud tot complexe redeneringen, terwijl een hoge mate van betrouwbaarheid en voorspelbaarheid behouden blijft. Klanten melden dat het veel minder waarschijnlijk is dat Claude schadelijke resultaten produceert, gemakkelijker om mee te praten en beter bestuurbaar is in vergelijking met andere FM's, zodat ontwikkelaars met minder moeite de gewenste output kunnen krijgen. Het ultramoderne model van Anthropic, Claude 2, scoort boven het 90e percentiel op de GRE-examens lezen en schrijven, en eveneens op kwantitatief redeneren. En nu is het onlangs uitgebrachte Claude 2.1-model beschikbaar in Amazon Bedrock. Claude 2.1 levert belangrijke mogelijkheden voor bedrijven, zoals een toonaangevend 200K token-contextvenster (2x de context van Claude 2.0), lagere hallucinaties en aanzienlijke verbeteringen in nauwkeurigheid, zelfs bij zeer lange contextlengtes. Claude 2.1 bevat ook verbeterde systeemprompts – dit zijn modelinstructies die eindgebruikers een betere ervaring bieden – terwijl ook de kosten van prompts en voltooiingen met 25% worden verlaagd.

Voor een groeiend aantal klanten die een beheerde versie van Meta's publiekelijk verkrijgbare Llama 2-model willen gebruiken, biedt Amazon Bedrock Llama 2 13B, en we voegen Llama 2 70B toe. Llama 2 70B is geschikt voor grootschalige taken zoals taalmodellering, tekstgeneratie en dialoogsystemen. De publiekelijk beschikbare Llama-modellen zijn meer dan 30 miljoen keer gedownload en klanten vinden het geweldig dat Amazon Bedrock ze aanbiedt als onderdeel van een beheerde service waarbij ze zich geen zorgen hoeven te maken over de infrastructuur of diepgaande ML-expertise in hun teams hebben. Bovendien biedt Stability AI voor het genereren van afbeeldingen een reeks populaire tekst-naar-afbeelding-modellen. Stable Diffusion XL 1.0 (SDXL 1.0) is de meest geavanceerde hiervan en is nu algemeen beschikbaar in Amazon Bedrock. De nieuwste editie van dit populaire beeldmodel heeft een grotere nauwkeurigheid, beter fotorealisme en een hogere resolutie.

Klanten maken er ook gebruik van Amazone Titan modellen, die zijn gemaakt en voorgetraind door AWS om krachtige mogelijkheden te bieden met grote economische voordelen voor een verscheidenheid aan gebruiksscenario's. Amazon heeft een trackrecord van 25 jaar op het gebied van ML en AI (technologie die we in al onze bedrijven gebruiken) en we hebben veel geleerd over het bouwen en implementeren van modellen. We hebben zorgvuldig gekozen hoe we onze modellen trainen en de data die we daarvoor gebruiken. Wij vrijwaren klanten tegen claims dat onze modellen of hun output inbreuk maken op iemands auteursrecht. In april van dit jaar introduceerden we onze eerste Titan-modellen. Titan Tekst Lite-nu algemeen verkrijgbaar– is een beknopt, kosteneffectief model voor gebruiksscenario's zoals chatbots, tekstsamenvatting of copywriting, en het is ook aantrekkelijk om het te verfijnen. Titan Text Express – nu ook algemeen beschikbaar—is uitgebreider en kan worden gebruikt voor een breder scala aan op tekst gebaseerde taken, zoals het genereren van open tekst en conversatiechat. We bieden deze tekstmodelopties aan om klanten de mogelijkheid te bieden de nauwkeurigheid, prestaties en kosten te optimaliseren, afhankelijk van hun gebruiksscenario en zakelijke vereisten. Klanten als Nexxiot, PGA Tour en Ryanair gebruiken onze twee Titan Text-modellen. We hebben ook een insluitingsmodel, Titan Text Embeddings, voor zoekgebruik en personalisatie. Klanten zoals Nasdaq zien geweldige resultaten met het gebruik van Titan Text Embeddings om de mogelijkheden van Nasdaq IR Insight te verbeteren om inzichten te genereren uit de documenten van meer dan 9,000 wereldwijde bedrijven voor duurzaamheids-, juridische en boekhoudkundige teams. En we zullen in de loop van de tijd meer modellen aan de Titan-familie blijven toevoegen. We introduceren een nieuw inbeddingsmodel, Titan Multimodal Embeddings, om multimodale zoek- en aanbevelingservaringen mogelijk te maken voor gebruikers die afbeeldingen en tekst (of een combinatie van beide) als invoer gebruiken. En wij zijn introductie van een nieuw tekst-naar-afbeelding-model, Amazon Titan Image Generator. Met Titan Image Generator kunnen klanten uit verschillende sectoren, zoals de reclame, e-commerce en media en entertainment, tekstinvoer gebruiken om realistische afbeeldingen van studiokwaliteit te genereren in grote volumes en tegen lage kosten. We zijn enthousiast over hoe klanten reageren op Titan Models, en je kunt verwachten dat we hier zullen blijven innoveren.

- Nieuwe mogelijkheden om uw generatieve AI-applicatie veilig aan te passen met uw bedrijfseigen gegevens: Een van de belangrijkste mogelijkheden van Amazon Bedrock is hoe gemakkelijk het is om een model aan te passen. Dit wordt echt spannend voor klanten, omdat generatieve AI daar hun belangrijkste onderscheidende factor ontmoet: hun data. Het is echter heel belangrijk dat hun gegevens veilig blijven, dat ze er onderweg controle over hebben en dat modelverbeteringen privé voor hen zijn. Er zijn een paar manieren waarop je dit kunt doen, en Amazon Bedrock biedt de breedste selectie aanpassingsopties voor meerdere modellen). De eerste is fijnafstemming. Het verfijnen van een model in Amazon Bedrock is eenvoudig. Je selecteert eenvoudig het model en Amazon Bedrock maakt er een kopie van. Vervolgens wijs je naar een paar gelabelde voorbeelden (bijvoorbeeld een reeks goede vraag-antwoordparen) die je opslaat in Amazon Simple Storage Service (Amazon S3), en Amazon Bedrock traint stapsgewijs (het gekopieerde model wordt aangevuld met de nieuwe informatie). op basis van deze voorbeelden, en het resultaat is een persoonlijk, nauwkeuriger afgestemd model dat relevantere, op maat gemaakte antwoorden oplevert. We zijn verheugd om aan te kondigen dat fijnafstemming algemeen beschikbaar is voor Cohere Command, Meta Llama 2, Amazon Titan Text (Lite en Express), Amazon Titan Multimodal Embeddings, en in preview voor Amazon Titan Image Generator. En door onze samenwerking met Anthropic zullen we AWS-klanten binnenkort vroegtijdige toegang bieden tot unieke functies voor het aanpassen van modellen en het verfijnen van het ultramoderne model Claude.

Een tweede techniek voor het aanpassen van LLM's en andere FM's voor uw bedrijf is Retrieval Augmented Generation (RAG), waarmee u de reacties van een model kunt aanpassen door uw aanwijzingen uit te breiden met gegevens uit meerdere bronnen, waaronder documentopslagplaatsen, databases en API's. In september hebben we een RAG-functie geïntroduceerd, Knowledge Bases voor Amazon Bedrock, die modellen veilig verbindt met uw eigen gegevensbronnen om uw aanwijzingen aan te vullen met meer informatie, zodat uw applicaties relevantere, contextuele en nauwkeurigere antwoorden kunnen leveren. kennisbanken is nu algemeen beschikbaar met een API die de volledige RAG-workflow uitvoert van het ophalen van tekst die nodig is om een prompt aan te vullen, tot het verzenden van de prompt naar het model, tot het retourneren van het antwoord. Knowledge Bases ondersteunt databases met vectormogelijkheden die numerieke representaties van uw gegevens opslaan (inbedding) die modellen gebruiken om toegang te krijgen tot deze gegevens voor RAG, inclusief Amazon OpenSearch Service en andere populaire databases zoals Pinecone en Redis Enterprise Cloud (Amazon Aurora en MongoDB vectorondersteuning komt eraan spoedig).

De derde manier waarop je modellen in Amazon Bedrock kunt aanpassen is door voortdurende voortraining. Met deze methode bouwt het model voort op de oorspronkelijke vooropleiding voor algemeen taalbegrip om domeinspecifieke taal en terminologie te leren. Deze aanpak is bedoeld voor klanten die over grote hoeveelheden ongelabelde, domeinspecifieke informatie beschikken en hun LLM's in staat willen stellen de taal, zinsdelen, afkortingen, concepten, definities en jargon te begrijpen die uniek zijn voor hun wereld (en bedrijf). Anders dan bij fijnafstemming, waarbij een vrij kleine hoeveelheid gegevens nodig is, wordt voortdurende voortraining uitgevoerd op grote gegevenssets (bijvoorbeeld duizenden tekstdocumenten). Nu zijn er pre-trainingsmogelijkheden beschikbaar in Amazon Bedrock voor Titan Text Lite en Titan Text Express.

- Algemene beschikbaarheid van Agenten voor Amazon Bedrock om taken uit meerdere stappen uit te voeren met behulp van systemen, gegevensbronnen en bedrijfskennis. LLM's zijn geweldig in het voeren van gesprekken en het genereren van inhoud, maar klanten willen dat hun applicaties dat ook kunnen do nog meer, zoals actie ondernemen, problemen oplossen en communiceren met een reeks systemen om taken uit meerdere stappen uit te voeren, zoals het boeken van reizen, het indienen van verzekeringsclaims of het bestellen van vervangende onderdelen. En Amazon Bedrock kan helpen met deze uitdaging. Met agenten selecteren ontwikkelaars een model, schrijven een paar basisinstructies zoals 'je bent een vrolijke klantenservicemedewerker' en 'controleer de beschikbaarheid van producten in het voorraadsysteem', en verwijzen het geselecteerde model naar de juiste gegevensbronnen en bedrijfssystemen (bijvoorbeeld CRM of ERP-applicaties) en schrijf een paar AWS Lambda-functies om de API's uit te voeren (controleer bijvoorbeeld de beschikbaarheid van een item in de ERP-inventaris). Amazon Bedrock analyseert het verzoek automatisch en verdeelt het in een logische volgorde, waarbij gebruik wordt gemaakt van de redeneermogelijkheden van het geselecteerde model om te bepalen welke informatie nodig is, welke API's moeten worden aangeroepen en wanneer deze moeten worden aangeroepen om een stap te voltooien of een taak op te lossen. Nu algemeen beschikbaar, kunnen agenten de meeste zakelijke taken plannen en uitvoeren (van het beantwoorden van vragen van klanten over de beschikbaarheid van uw producten tot het opnemen van hun bestellingen) en hoeven ontwikkelaars niet bekend te zijn met machine learning, engineer-prompts, treinmodellen of het handmatig verbinden van systemen. En Bedrock doet dit allemaal veilig en privé, en klanten als Druva en Athene gebruiken ze al om de nauwkeurigheid en snelheid van de ontwikkeling van hun generatieve AI-applicaties te verbeteren.

- Introductie van Vangrails voor Amazon Bedrock zodat u veiligheidsmaatregelen kunt toepassen op basis van uw gebruiksvereisten en verantwoord AI-beleid. Klanten willen er zeker van zijn dat interacties met hun AI-toepassingen veilig zijn, giftige of aanstootgevende taal vermijden, relevant blijven voor hun bedrijf en aansluiten bij hun verantwoordelijke AI-beleid. Met vangrails kunnen klanten onderwerpen opgeven die ze moeten vermijden, en Amazon Bedrock zal gebruikers alleen goedgekeurde antwoorden geven op vragen die in die beperkte categorieën vallen. Er kan bijvoorbeeld een applicatie voor online bankieren worden opgezet om het verstrekken van beleggingsadvies te vermijden en ongepaste inhoud (zoals haatzaaiende uitlatingen en geweld) te verwijderen. Begin 2024 zullen klanten ook persoonlijk identificeerbare informatie (PII) in modelreacties kunnen redigeren. Nadat een klant bijvoorbeeld interactie heeft gehad met een callcenteragent, wordt het klantenservicegesprek vaak samengevat voor het bijhouden van gegevens, en vangrails kunnen PII uit die samenvattingen verwijderen. Guardrails kunnen worden gebruikt voor alle modellen in Amazon Bedrock (inclusief verfijnde modellen) en met Agents voor Amazon Bedrock, zodat klanten een consistent beschermingsniveau kunnen bieden voor al hun generatieve AI-applicaties.

Bovenste laag van de stapel: voortdurende innovatie maakt generatieve AI toegankelijk voor meer gebruikers

Op de bovenste laag van de stapel bevinden zich applicaties die gebruik maken van LLM's en andere FM's, zodat u kunt profiteren van generatieve AI op het werk. Eén gebied waarop generatieve AI het spel al verandert, is coderen. Vorig jaar hebben we Amazon CodeWhisperer geïntroduceerd, waarmee je sneller en veiliger applicaties kunt bouwen door codesuggesties en aanbevelingen vrijwel in realtime te genereren. Klanten als Accenture, Boeing, Bundesliga, The Cigna Group, Kone en Warner Music Group gebruiken CodeWhisperer om de productiviteit van ontwikkelaars te verhogen – en Accenture maakt tot 50,000 van hun softwareontwikkelaars en IT-professionals mogelijk met Amazon CodeWhisperer. We willen dat zoveel mogelijk ontwikkelaars de productiviteitsvoordelen van generatieve AI kunnen benutten. Daarom biedt CodeWhisperer gratis aanbevelingen aan alle individuen.

Hoewel AI-coderingstools veel doen om het leven van ontwikkelaars gemakkelijker te maken, worden hun productiviteitsvoordelen beperkt door hun gebrek aan kennis van interne codebases, interne API's, bibliotheken, pakketten en klassen. Eén manier om hierover na te denken is dat als u een nieuwe ontwikkelaar inhuurt, zelfs als deze van wereldklasse is, deze niet zo productief zal zijn binnen uw bedrijf totdat hij uw best practices en code begrijpt. De huidige AI-aangedreven codeertools zijn net als die nieuwe ontwikkelaar. Om hierbij te helpen, hebben we onlangs een voorbeeld van een nieuwe bekeken aanpassingsvermogen in Amazon CodeWhisperer die op veilige wijze gebruik maakt van de interne codebasis van een klant om relevantere en bruikbare code-aanbevelingen te bieden. Met deze mogelijkheid is CodeWhisperer een expert op het gebied van jouw code en biedt aanbevelingen die relevanter zijn om nog meer tijd te besparen. In een onderzoek dat we deden met Persistent, een wereldwijd bedrijf voor digitale engineering en bedrijfsmodernisering, ontdekten we dat aanpassingen ontwikkelaars helpen taken tot 28% sneller uit te voeren dan met de algemene mogelijkheden van CodeWhisperer. Nu kan een ontwikkelaar bij een technologiebedrijf in de gezondheidszorg CodeWhisperer vragen om “MRI-beelden te importeren die aan de klant-ID zijn gekoppeld en deze door de beeldclassificator te laten lopen” om afwijkingen op te sporen. Omdat CodeWhisperer toegang heeft tot de codebasis, kan het veel relevantere suggesties geven, waaronder de importlocaties van de MRI-beelden en klant-ID's. CodeWhisperer houdt aanpassingen volledig privé en de onderliggende FM gebruikt ze niet voor training, waardoor het waardevolle intellectuele eigendom van klanten wordt beschermd. AWS is de enige grote cloudprovider die iedereen deze mogelijkheid biedt.

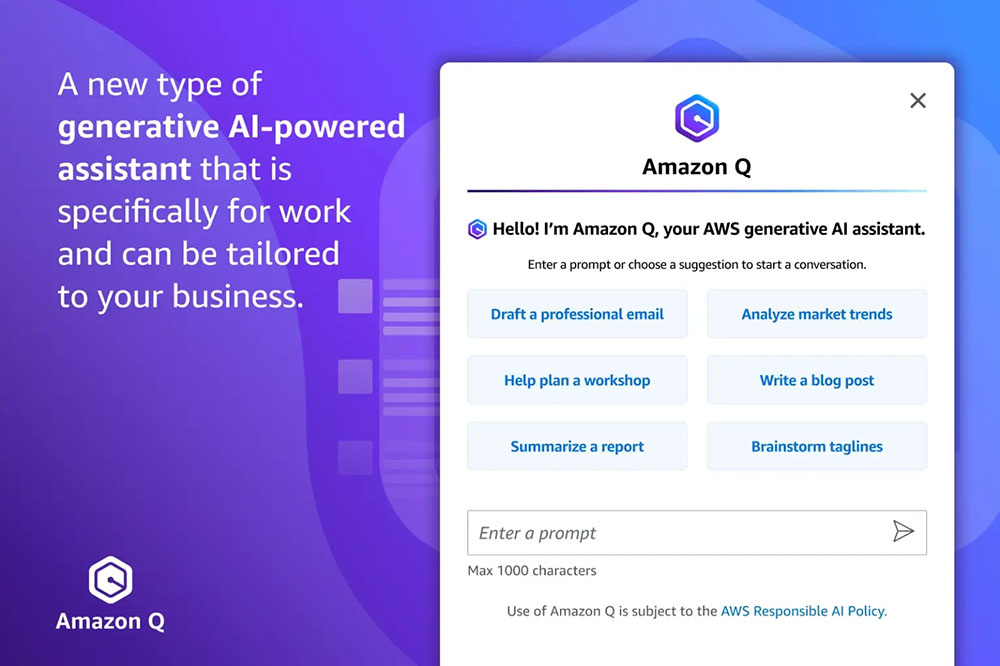

Introductie van Amazon Q, de generatieve AI-aangedreven assistent, op maat gemaakt voor werk

Ontwikkelaars zijn zeker niet de enigen die met generatieve AI aan de slag gaan: miljoenen mensen gebruiken generatieve AI-chatapplicaties. Wat de eerste aanbieders op dit gebied hebben gedaan, is opwindend en superhandig voor consumenten, maar in veel opzichten 'werken' ze niet helemaal op het werk. Hun algemene kennis en capaciteiten zijn groot, maar ze kennen uw bedrijf, uw gegevens, uw klanten, uw activiteiten of uw bedrijf niet. Dat beperkt hoeveel ze u kunnen helpen. Ze weten ook niet veel over uw rol: welk werk u doet, met wie u samenwerkt, welke informatie u gebruikt en waartoe u toegang heeft. Deze beperkingen zijn begrijpelijk omdat deze assistenten geen toegang hebben tot de privégegevens van uw bedrijf en niet zijn ontworpen om te voldoen aan de gegevensprivacy- en beveiligingsvereisten die bedrijven nodig hebben om hen deze toegang te geven. Het is moeilijk om de beveiliging achteraf vast te leggen en te verwachten dat deze goed werkt. Wij denken dat we een betere manier hebben, waardoor iedereen in elke organisatie generatieve AI veilig kan gebruiken in zijn dagelijkse werk.

WWe zijn enthousiast om te introduceren Amazon Q, een nieuw type generatieve AI-aangedreven assistent die specifiek voor werk is en kan worden afgestemd op uw bedrijf. Q kan u helpen snelle, relevante antwoorden te krijgen op prangende vragen, problemen op te lossen, inhoud te genereren en actie te ondernemen met behulp van de gegevens en expertise die u vindt in de informatieopslagplaatsen, code en bedrijfssystemen van uw bedrijf. Wanneer je met Amazon Q chat, krijg je onmiddellijk relevante informatie en advies om taken te stroomlijnen, de besluitvorming te versnellen en creativiteit en innovatie op het werk te stimuleren. We hebben Amazon Q gebouwd om veilig en privé te zijn, en het kan uw bestaande identiteiten, rollen en machtigingen begrijpen en respecteren en deze informatie gebruiken om zijn interacties te personaliseren. Als een gebruiker zonder Q geen toestemming heeft om toegang te krijgen tot bepaalde gegevens, kan hij deze ook niet openen met Q. We hebben Amazon Q ontworpen om vanaf dag één te voldoen aan de strenge eisen van zakelijke klanten: geen enkele inhoud wordt gebruikt om de onderliggende modellen te verbeteren.

Amazon Q is uw deskundige assistent om voort te bouwen op AWS: We hebben Amazon Q getraind op 17 jaar aan AWS-kennis en -ervaring, zodat het de manier kan transformeren waarop u applicaties en workloads op AWS bouwt, implementeert en exploiteert. Amazon Q heeft een chatinterface in de AWS Management Console en documentatie, uw IDE (via CodeWhisperer) en uw teamchatrooms op Slack of andere chat-apps. Amazon Q kan je helpen nieuwe AWS-mogelijkheden te verkennen, sneller aan de slag te gaan, onbekende technologieën te leren, oplossingen te ontwerpen, problemen op te lossen, te upgraden en nog veel meer. Het is een expert in goed ontworpen AWS-patronen, best practices, documentatie en oplossingsimplementaties. Hier zijn enkele voorbeelden van wat u kunt doen met uw nieuwe AWS-expertassistent:

- Krijg heldere antwoorden en begeleiding over de mogelijkheden, services en oplossingen van AWS: Vraag Amazon Q om "Vertel me over Agents voor Amazon Bedrock", en Q geeft je een beschrijving van de functie plus links naar relevant materiaal. Je kunt Amazon Q ook vrijwel elke vraag stellen over hoe een AWS-service werkt (bijvoorbeeld: "Wat zijn de schaallimieten op een DynamoDB-tabel?", "Wat is Redshift Managed Storage?"), of hoe je een aantal oplossingen het beste kunt ontwerpen ( “Wat zijn de best practices voor het bouwen van event-driven architecturen?”). En Amazon Q zal beknopte antwoorden verzamelen en altijd zijn bronnen citeren (en ernaar linken).

- Kies de beste AWS-service voor uw gebruiksscenario en ga snel aan de slag: Vraag Amazon Q “Wat zijn de manieren om een webapp op AWS te bouwen? ' en het zal een lijst met potentiële services bieden, zoals AWS versterken, AWS Lambda en Amazon EC2 met de voordelen van elk. Van daaruit kunt u de opties beperken door Q te helpen uw vereisten, voorkeuren en beperkingen te begrijpen (bijvoorbeeld: “Welke van deze zou het beste zijn als ik containers wil gebruiken?” of “Moet ik een relationele of niet-relationele database gebruiken? ”). Sluit af met 'Hoe begin ik?' en Amazon Q zal enkele basisstappen schetsen en u wijzen op aanvullende bronnen.

- Optimaliseer uw computerbronnen: Amazon Q kan u helpen bij het selecteren van Amazon EC2-instanties. Als u vraagt: “Help me de juiste EC2-instantie te vinden om een videocoderingswerklast voor mijn gaming-app met de hoogste prestaties in te zetten”, krijgt u van Q een lijst met instantiefamilies met redenen voor elke suggestie. En u kunt een onbeperkt aantal vervolgvragen stellen om de beste keuze voor uw werklast te vinden.

- Krijg hulp bij het debuggen, testen en optimaliseren van uw code: Als je een fout tegenkomt tijdens het coderen in je IDE, kun je Amazon Q om hulp vragen door te zeggen: "Mijn code bevat een IO-fout, kun je een oplossing bieden?" en Q zal de code voor u genereren. Als de suggestie u bevalt, kunt u Amazon Q vragen de oplossing aan uw toepassing toe te voegen. Omdat Amazon Q zich in uw IDE bevindt, begrijpt het de code waaraan u werkt en weet het waar de oplossing moet worden ingevoegd. Amazon Q kan ook unit-tests maken (“Schrijf unit-tests voor de geselecteerde functie”) die het in uw code kan invoegen en die u kunt uitvoeren. Ten slotte kan Amazon Q u vertellen hoe u uw code kunt optimaliseren voor betere prestaties. Vraag Q om "Mijn geselecteerde DynamoDB-query te optimaliseren", en het zal zijn begrip van uw code gebruiken om een suggestie in natuurlijke taal te geven over wat te repareren, samen met de bijbehorende code die u met één klik kunt implementeren.

- Problemen diagnosticeren en oplossen: Als u problemen tegenkomt in de AWS Management Console, zoals EC2-machtigingsfouten of Amazon S3-configuratiefouten, kunt u eenvoudig op de knop 'Problemen oplossen met Amazon Q' drukken, waarna de console gebruik zal maken van zijn kennis van het fouttype en de service waar de fout zich bevindt om u suggesties voor een oplossing te geven. Je kunt Amazon Q zelfs vragen om problemen met je netwerk op te lossen (bijvoorbeeld: "Waarom kan ik geen verbinding maken met mijn EC2-instantie via SSH?") En Q zal je end-to-end-configuratie analyseren en een diagnose stellen (bijv.: "Deze instantie lijkt zich in een privé-subnet te bevinden, dus openbare toegankelijkheid moet mogelijk tot stand worden gebracht”).

- Ga in een mum van tijd aan de slag met een nieuwe codebasis: Wanneer je met Amazon Q chat in je IDE, combineert het zijn expertise in het bouwen van software met inzicht in je code: een krachtige combinatie! Als u voorheen een project van iemand anders overnam, of als u nieuw was in het team, moest u mogelijk urenlang handmatig de code en documentatie doornemen om te begrijpen hoe deze werkt en wat deze doet. Omdat Amazon Q de code in uw IDE begrijpt, kunt u Amazon Q eenvoudigweg vragen om de code uit te leggen ("Geef mij een beschrijving van wat deze applicatie doet en hoe deze werkt") en Q zal u details geven zoals welke services de code gebruikt en wat verschillende functies doen (Q zou bijvoorbeeld kunnen antwoorden met zoiets als: "Deze applicatie bouwt een basisondersteuningsticketsysteem met behulp van Python Flask en AWS Lambda" en gaat verder met het beschrijven van elk van de kernmogelijkheden, hoe deze worden geïmplementeerd, en nog veel meer).

- Wis uw functieachterstand sneller: Je kunt Amazon Q zelfs vragen om je te begeleiden en een groot deel van het end-to-end proces van het toevoegen van een functie aan je applicatie te automatiseren. Amazon CodeCatalyst, onze uniforme softwareontwikkelingsservice voor teams. Om dit te doen, wijst u Q gewoon een backlog-taak toe uit uw problemenlijst – net zoals u dat aan een teamgenoot zou doen – en Q genereert een stappenplan voor hoe het de functie gaat bouwen en implementeren. Zodra u het plan heeft goedgekeurd, zal Q de code schrijven en de voorgestelde wijzigingen aan u presenteren als codebeoordeling. U kunt (indien nodig) herbewerking aanvragen, goedkeuren en/of inzetten!

- Upgrade uw code in een fractie van de tijd: De meeste ontwikkelaars besteden eigenlijk maar een fractie van hun tijd aan het schrijven van nieuwe code en het bouwen van nieuwe applicaties. Ze besteden veel meer van hun cycli aan pijnlijke, slordige gebieden zoals onderhoud en upgrades. Neem taalversie-upgrades. Een groot aantal klanten blijft oudere versies van Java gebruiken omdat het maanden, zelfs jaren, en duizenden uren ontwikkelaarstijd zal kosten om te upgraden. Als u dit uitstelt, zijn er reële kosten en risico's verbonden: u loopt prestatieverbeteringen mis en bent kwetsbaar voor beveiligingsproblemen. We denken dat Amazon Q hier een gamechanger kan zijn, en zijn er enthousiast over Amazon Q-codetransformatie, een functie die veel van dit zware werk kan wegnemen en de tijd die nodig is om applicaties te upgraden, kan terugbrengen van dagen naar minuten. U opent gewoon de code die u wilt bijwerken in uw IDE en vraagt Amazon Q om uw code te “/transformeren”. Amazon Q analyseert de volledige broncode van de applicatie, genereert de code in de doeltaal en -versie en voert tests uit, zodat u de beveiligings- en prestatieverbeteringen van de nieuwste taalversies kunt realiseren. Onlangs heeft een heel klein team van Amazon-ontwikkelaars Amazon Q Code Transformation gebruikt om in slechts twee dagen 1,000 productieapplicaties te upgraden van Java 8 naar Java 17. De gemiddelde tijd per aanvraag bedroeg minder dan 10 minuten. Tegenwoordig voert Amazon Q Code Transformation Java-taalupgrades uit van Java 8 of Java 11 naar Java 17. Hierna (en binnenkort) komt de mogelijkheid om .NET Framework te transformeren naar platformonafhankelijk .NET (met nog meer transformaties die in de toekomst zullen volgen) .

Amazon Q is jouw bedrijfsexpert: U kunt Amazon Q verbinden met uw bedrijfsgegevens, informatie en systemen, zodat het alles kan synthetiseren en hulp op maat kan bieden om mensen te helpen problemen op te lossen, inhoud te genereren en acties te ondernemen die relevant zijn voor uw bedrijf. Amazon Q naar je bedrijf brengen is eenvoudig. Het heeft meer dan 40 ingebouwde connectoren voor populaire bedrijfssystemen zoals Amazon S3, Microsoft 365, Salesforce, ServiceNow, Slack, Atlassian, Gmail, Google Drive en Zendesk. Het kan ook verbinding maken met uw interne intranet, wiki's en boeken uitvoeren, en met de Amazon Q SDK kunt u een verbinding opbouwen met welke interne applicatie u maar wilt. Richt Amazon Q op deze opslagplaatsen en het zal uw bedrijf een boost geven, waarbij de semantische informatie die uw bedrijf uniek maakt, wordt vastgelegd en begrepen. Vervolgens krijgt u uw eigen vriendelijke en eenvoudige Amazon Q-webapplicatie, zodat werknemers in uw bedrijf kunnen communiceren met de gespreksinterface. Amazon Q maakt ook verbinding met je identiteitsprovider om inzicht te krijgen in de rol van een gebruiker en in welke systemen hij of zij toegang heeft, zodat gebruikers gedetailleerde, genuanceerde vragen kunnen stellen en op maat gemaakte resultaten kunnen krijgen die alleen informatie bevatten waartoe ze geautoriseerd zijn. Amazon Q genereert antwoorden en inzichten die accuraat en trouw zijn aan het materiaal en de kennis die u eraan verstrekt, en u kunt gevoelige onderwerpen beperken, trefwoorden blokkeren of ongepaste vragen en antwoorden filteren. Hier volgen enkele voorbeelden van wat u kunt doen met de nieuwe deskundige assistent van uw bedrijf:

- Ontvang scherpe, superrelevante antwoorden op basis van uw bedrijfsgegevens en informatie: Werknemers kunnen Amazon Q vragen naar alles waar ze voorheen in allerlei bronnen naar moesten zoeken. Vraag “Wat zijn de nieuwste richtlijnen voor het gebruik van logo’s?”, of “Hoe vraag ik een bedrijfscreditcard aan?”, en Amazon Q zal alle relevante inhoud die het vindt samenvatten en terugkomen met snelle antwoorden plus links naar de relevante bronnen (bijvoorbeeld merkportals en logo-opslagplaatsen, T&E-beleid van bedrijven en kaartaanvragen).

- Stroomlijn de dagelijkse communicatie: Vraag het maar, en Amazon Q kan inhoud genereren (“Maak een blogpost en drie koppen op sociale media waarin het product wordt aangekondigd dat in deze documentatie wordt beschreven”), en maak samenvattingen (“Schrijf een samenvatting van het transcript van onze vergadering met een lijst met opsommingstekens van actiepunten” ), zorgen voor e-mailupdates (“Stel een e-mail op waarin onze trainingsprogramma’s voor het derde kwartaal voor klanten in India worden belicht”) en helpen bij het structureren van vergaderingen (“Maak een vergaderagenda om te praten over het nieuwste klanttevredenheidsrapport”).

- Volledige taken: Amazon Q kan helpen bepaalde taken uit te voeren, waardoor werknemers minder tijd besteden aan repetitief werk, zoals het indienen van tickets. Vraag Amazon Q om “de feedback van klanten over het nieuwe prijsaanbod in Slack samen te vatten” en vraag Q vervolgens om die informatie te gebruiken en een ticket in Jira te openen om het marketingteam op de hoogte te houden. U kunt Q vragen om “Dit gesprekstranscript samen te vatten” en vervolgens “Een nieuwe case voor klant A te openen in Salesforce.” Amazon Q ondersteunt andere populaire werkautomatiseringstools zoals Zendesk en Service Now.

Amazon Q staat in Amazon QuickSight: met Amazon Q in QuickSight, de business intelligence-dienst van AWS, kunnen gebruikers hun dashboards vragen stellen als “Waarom is het aantal bestellingen vorige maand toegenomen?” en krijg visualisaties en uitleg van de factoren die de stijging hebben beïnvloed. En analisten kunnen Amazon Q gebruiken om de tijd die ze nodig hebben om dashboards te bouwen, terug te brengen van dagen naar minuten, met een eenvoudige prompt als ‘Toon mij de verkopen per regio per maand als een gestapeld staafdiagram.’ Q komt meteen terug met dat diagram, en je kunt het eenvoudig toevoegen aan een dashboard of verder chatten met Q om de visualisatie te verfijnen (bijvoorbeeld 'Verander het staafdiagram in een Sankey-diagram' of 'Laat landen zien in plaats van regio's'). Amazon Q in QuickSight maakt het ook eenvoudiger om bestaande dashboards te gebruiken om zakelijke belanghebbenden te informeren, belangrijke inzichten te destilleren en de besluitvorming te vereenvoudigen met behulp van dataverhalen. Gebruikers kunnen Amazon Q bijvoorbeeld vragen om “een verhaal op te bouwen over hoe het bedrijf de afgelopen maand is veranderd voor een bedrijfsbeoordeling met senior leiderschap”, en binnen enkele seconden levert Amazon Q een datagestuurd verhaal dat visueel aantrekkelijk is en volledig aanpasbaar. Deze verhalen kunnen veilig door de hele organisatie worden gedeeld om belanghebbenden op één lijn te brengen en betere beslissingen te nemen.

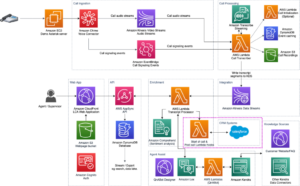

Amazon Q zit in Amazon Connect: In Amazon Connect, onze contactcenterservice, helpt Amazon Q uw klantenservicemedewerkers een betere klantenservice te bieden. Amazon Q maakt gebruik van de kennisopslagplaatsen die uw agenten normaal gesproken gebruiken om informatie voor klanten te verkrijgen, en vervolgens kunnen agenten rechtstreeks in Connect met Amazon Q chatten om antwoorden te krijgen waarmee ze sneller op klantverzoeken kunnen reageren zonder zelf door de documentatie te hoeven zoeken. En hoewel chatten met Amazon Q voor supersnelle antwoorden geweldig is, bestaat er in de klantenservice niet zoiets als te snel. Daarom Amazon QIn Connect verandert een live klantgesprek met een agent in een prompt en geeft de agent automatisch mogelijke antwoorden, voorgestelde acties en links naar bronnen. Amazon Q kan bijvoorbeeld detecteren dat een klant contact opneemt met een autoverhuurbedrijf om zijn reservering te wijzigen, een reactie genereren zodat de agent snel kan communiceren hoe het wijzigingskostenbeleid van het bedrijf van toepassing is, en de agent door de stappen leiden die hij nodig heeft om de reservering bij te werken. reservering.

Amazon Q zit in AWS Supply Chain (binnenkort beschikbaar): In AWS Supply Chain, onze service voor supply chain-inzichten, helpt Amazon Q vraag- en aanbodplanners, voorraadbeheerders en handelspartners hun supply chain te optimaliseren door potentiële stock- of overstockrisico's samen te vatten en te benadrukken, en scenario's te visualiseren om het probleem op te lossen. Gebruikers kunnen Amazon Q ‘wat’, ‘waarom’ en ‘wat als’ vragen stellen over hun supply chain-gegevens en chatten door middel van complexe scenario’s en de afwegingen tussen verschillende supply chain-beslissingen. Een klant kan bijvoorbeeld vragen: "Wat veroorzaakt de vertraging in mijn zendingen en hoe kan ik de zaken versnellen?" waarop Amazon Q zou kunnen antwoorden: “90% van uw bestellingen vindt plaats aan de oostkust, en een grote storm in het zuidoosten veroorzaakt een vertraging van 24 uur. Als u naar de haven van New York verzendt in plaats van naar Miami, versnelt u de leveringen en verlaagt u de kosten met 50%.”

Onze klanten adopteren generatieve AI snel: ze trainen baanbrekende modellen op AWS, ze ontwikkelen generatieve AI-applicaties in recordsnelheid met behulp van Amazon Bedrock, en ze implementeren baanbrekende applicaties in hun organisaties, zoals Amazon Q. Met onze nieuwste aankondigingen, AWS biedt klanten nog meer prestaties, keuze en innovatie naar elke laag van de stapel. De gecombineerde impact van alle mogelijkheden die we bij re:Invent leveren, markeert een belangrijke mijlpaal in de richting van het bereiken van een opwindend en betekenisvol doel: we maken generatieve AI toegankelijk voor klanten van elke omvang en met technische vaardigheden, zodat ze opnieuw kunnen beginnen met het opnieuw uitvinden en transformeren van wat is mogelijk.

Resources

Over de auteur

Swami Sivasubramaniaan is Vice President Data en Machine Learning bij AWS. In deze rol houdt Swami toezicht op alle AWS Database-, Analytics- en AI & Machine Learning-services. De missie van zijn team is om organisaties te helpen hun data aan het werk te zetten met een complete, end-to-end data-oplossing om op te slaan, toegang te krijgen, te analyseren, te visualiseren en te voorspellen.

Swami Sivasubramaniaan is Vice President Data en Machine Learning bij AWS. In deze rol houdt Swami toezicht op alle AWS Database-, Analytics- en AI & Machine Learning-services. De missie van zijn team is om organisaties te helpen hun data aan het werk te zetten met een complete, end-to-end data-oplossing om op te slaan, toegang te krijgen, te analyseren, te visualiseren en te voorspellen.

- Door SEO aangedreven content en PR-distributie. Word vandaag nog versterkt.

- PlatoData.Network Verticale generatieve AI. Versterk jezelf. Toegang hier.

- PlatoAiStream. Web3-intelligentie. Kennis versterkt. Toegang hier.

- PlatoESG. carbon, CleanTech, Energie, Milieu, Zonne, Afvalbeheer. Toegang hier.

- Plato Gezondheid. Intelligentie op het gebied van biotech en klinische proeven. Toegang hier.

- Bron: https://aws.amazon.com/blogs/machine-learning/welcome-to-a-new-era-of-building-in-the-cloud-with-generative-ai-on-aws/

- : heeft

- :is

- :niet

- :waar

- $UP

- 000

- 1

- 10

- 100

- 11

- 12

- 17

- 200

- 2019

- 2024

- 25

- 30

- 35%

- 40

- 50

- 500

- 7

- 8

- 9

- a

- capaciteiten

- vermogen

- in staat

- Over

- boven

- versnellen

- versneld

- versnellers

- Accenture

- toegang

- de toegankelijkheid

- beschikbaar

- Accounting

- nauwkeurigheid

- accuraat

- verwerven

- over

- Actie

- acties

- actief

- werkelijk

- aanpassen

- toevoegen

- toegevoegd

- toe te voegen

- toevoeging

- Extra

- Daarnaast

- toevoegingen

- Voegt

- Adidas

- adobe

- De goedkeuring van

- vergevorderd

- oprukkende

- Voordeel

- voordelen

- ADVERTISING

- advies

- Na

- tegen

- agenda

- Agent

- agenten

- aggregaat

- geleden

- AI

- AI en machine learning

- AI chatbot

- ai onderzoek

- AI-powered

- richten

- Alles

- toelaten

- toestaat

- langs

- al

- ook

- altijd

- Amazone

- Amazon Code Whisperer

- Amazon EC2

- Amazon OpenSearch-service

- Amazon QuickSight

- Amazon Sage Maker

- Amazon Web Services

- bedragen

- hoeveelheden

- an

- analyse

- analist

- analisten

- analytics

- analyseren

- analyseert

- en

- aankondigen

- Mededelingen

- Het aankondigen

- anomalieën

- beantwoorden

- antwoorden

- antropisch

- elke

- iedereen

- iets

- api

- APIs

- gebruiken

- komt naar voren

- Aanvraag

- toepassingen

- Solliciteer

- waarderen

- nadering

- goedkeuren

- goedgekeurd

- apps

- April

- ZIJN

- GEBIED

- gebieden

- bediscussieerbaar

- rond

- AS

- vragen

- Hulp

- Assistent

- assistenten

- geassocieerd

- vennoten

- At

- vergroten

- aangevuld

- augments

- Aurora

- bevoegd

- automatiseren

- automaten

- Automatisch

- webmaster.

- Automatisering

- automotive

- beschikbaarheid

- Beschikbaar

- gemiddelde

- vermijd

- weg

- AWS

- AWS Inferentie

- AWS Lambda

- AWS-beheerconsole

- terug

- Bankieren

- bars

- barrières

- baseren

- gebaseerde

- basis-

- BE

- omdat

- wordt

- geweest

- begon

- geloofd wie en wat je bent

- betekent

- BEST

- 'best practices'

- Betere

- tussen

- Groot

- Miljard

- miljarden

- Blok

- Blokken

- Blog

- Boeing

- Bolt

- boeken

- Booking.com

- Boeken

- zowel

- Onder

- grenzen

- merk

- Breken

- breaks

- brengen

- Bringing

- bouw

- Gebouw

- bouwt

- bebouwd

- ingebouwd

- bedrijfsdeskundigen

- business intelligence

- ondernemingen

- maar

- by

- Bellen

- Call center

- CAN

- Kan krijgen

- mogelijkheden

- bekwaamheid

- in staat

- Inhoud

- Het vastleggen

- auto

- carbon

- koolstofemissies

- kaart

- voorzichtig

- geval

- gevallen

- categorieën

- veroorzakend

- Centreren

- zeker

- zeker

- keten

- uitdagen

- uitdagingen

- verandering

- veranderd

- Wisselaar

- Wijzigingen

- veranderende

- kenmerken

- tabel

- Grafieken

- chatrooms

- Chatbot

- chatbots

- chatten

- controle

- spaander

- chips

- keuze

- Kies

- het kiezen van

- uitgekozen

- vorderingen

- klassen

- Schoonmaak

- duidelijk

- Klik

- Cloud

- cloud infrastructuur

- TROS

- clustering

- Kust

- code

- codebasis

- Code review

- codering

- samenwerken

- samenwerking

- COM

- combinatie van

- combineren

- gecombineerde

- combines

- hoe

- komt

- komst

- Binnenkort Beschikbaar

- communiceren

- Communicatie

- Bedrijven

- afstand

- Bedrijf

- vergeleken

- dwingende

- compleet

- compleet

- complex

- ingewikkeldheid

- uitgebreid

- Berekenen

- concepten

- Configuratie

- configureren

- vermoeden

- Verbinden

- gekoppeld blijven

- versterken

- Connectiviteit

- verbindt

- consequent

- troosten

- beperkingen

- Consumenten

- consumptie

- contact

- contactcentrum

- containers

- content

- Inhoud genereren

- verband

- contextual

- voortzetten

- voortgezet

- blijft

- voortgezette

- onder controle te houden

- controles

- Gesprek

- spraakzaam

- conversaties

- auteursrecht

- copywriting

- Kern

- Kosten

- kostenefficient

- Kosten

- landen

- Stuurman

- en je merk te creëren

- aangemaakt

- creativiteit

- scheppers

- Credits

- creditkaart

- Misdrijf

- CRM

- klant

- klantervaring

- Klanttevredenheid

- Klantenservice

- Klanten

- aanpasbare

- maatwerk

- aan te passen

- aangepaste

- Snijden

- cycli

- dagelijks

- dashboards

- dashboards

- gegevens

- Data voorbereiding

- data Privacy

- Gegevensprivacy en beveiliging

- gegevenssets

- Gegevensgestuurde

- Database

- databanken

- dag

- dagelijks

- dagen

- Besluitvorming

- beslissingen

- deep

- diepgaand leren

- diepere

- definities

- Mate

- vertraging

- leveren

- Leveringen

- het leveren van

- levert

- Vraag

- Democratiserend

- Afhankelijk

- implementeren

- ingezet

- het inzetten

- inzet

- diepte

- beschrijven

- beschreven

- beschrijving

- ontworpen

- gewenste

- gedetailleerd

- gegevens

- opsporen

- Bepalen

- DEUTSCH TELECOM

- Ontwikkelaar

- ontwikkelaars

- het ontwikkelen van

- Ontwikkeling

- diagnose

- Dialoog

- Dialoog

- DEED

- anders

- Verspreiding

- digitaal

- direct

- verdelen

- verdeeld

- gedistribueerde training

- verspreiden van

- do

- document

- documentatie

- documenten

- doet

- Nee

- doen

- gedaan

- Dont

- verdubbeling

- beneden

- rit

- twee

- duplicaten

- duur

- e

- e-commerce

- elk

- Vroeg

- gemakkelijker

- gemakkelijk

- oosten

- En het is heel gemakkelijk

- Economie

- editie

- effectief

- doeltreffendheid

- efficiënt

- inspanning

- beide

- anders

- e-mails

- emissies

- medewerkers

- machtigen

- empowering

- in staat stellen

- waardoor

- codering

- einde

- eind tot eind

- energie-niveau

- Energieverbruik

- ingenieur

- Engineering

- verhogen

- uitbreidingen

- verrijkende

- Enterprise

- enterprise-kwaliteit

- bedrijven

- Onstpanning

- Geheel

- envelop

- Tijdperk

- ERP

- fout

- fouten

- evaluaties

- Zelfs

- EVENTS

- OOIT

- Alle

- iedereen

- alles

- Evolutie

- ontwikkelen

- voorbeeld

- voorbeelden

- opgewonden

- opwindend

- uitvoeren

- uitvoerend

- bestaand

- expansieve

- verwachten

- bespoedigen

- duur

- ervaring

- ervaren

- Ervaringen

- expert

- expertise

- Verklaren

- Verken

- uitdrukkelijk

- stof

- Gezicht

- feit

- factoren

- tamelijk

- trouw

- Vallen

- vertrouwd

- gezinnen

- familie

- SNELLE

- sneller

- defect

- Kenmerk

- Voordelen

- honorarium

- feedback

- weinig

- Filing

- filter

- Tot slot

- financieel

- VIND DE PLEK DIE PERFECT VOOR JOU IS

- het vinden van

- vondsten

- einde

- afmaken

- Voornaam*

- Bepalen

- flexibel

- gericht

- volgen

- Voor

- Voor consumenten

- Naar voren

- gevonden

- Foundation

- vier

- fractie

- Achtergrond

- frameworks

- Gratis

- vaak

- vriendelijk

- oppompen van

- functies

- verder

- toekomst

- spel

- game-changer

- gaming

- Algemeen

- algemeen

- voortbrengen

- genereert

- het genereren van

- generatie

- generatief

- generatieve AI

- generator

- krijgen

- het krijgen van

- Geven

- Globaal

- wereldwijd digitaal

- Go

- doel

- gaan

- goed

- Kopen Google Reviews

- GPU

- GPU's

- groot

- Ground

- baanbrekende

- Groep

- Groeiend

- gegroeid

- leiding

- gids

- richtlijnen

- HAD

- handen

- Happening

- Hard

- Hardware

- schadelijk

- haat

- Hebben

- met

- Headlines

- gezondheidszorg

- zwaar

- zwaar tillen

- hulp

- het helpen van

- helpt

- hier

- Hoge

- hoger

- hoogst

- markeren

- zeer

- huren

- zijn

- Hosting

- HOURS

- Hoe

- How To

- Echter

- HTTPS

- Honderden

- i

- ID

- identiteiten

- Identiteit

- ids

- if

- beeld

- afbeeldingen

- Onmiddellijk

- Impact

- uitvoeren

- implementaties

- geïmplementeerd

- importeren

- belangrijk

- indrukwekkend

- verbeteren

- verbeterd

- verbeteringen

- in

- omvatten

- omvat

- Inclusief

- Laat uw omzet

- meer

- meer

- indicatoren

- individuen

- industrieën

- -industrie

- toonaangevende

- beïnvloed

- info

- informeren

- informatie

- Infrastructuur

- innoveren

- innoveren

- Innovatie

- innovaties

- innovatieve

- invoer

- ingangen

- inzicht

- inzichten

- instantie

- verkrijgen in plaats daarvan

- Instituut

- instructies

- verzekering

- integratie

- intellectueel

- intellectueel eigendom

- Intelligentie

- voornemens

- interactie

- interacties

- wisselwerking

- met elkaar verbonden

- Interface

- intern

- ingrijpen

- in

- voorstellen

- geïntroduceerd

- de invoering

- Uitgevonden

- inventaris

- Investeren

- onderzoekend

- investeren

- investering

- Investeringen

- betrokken zijn

- problemen

- IT

- HAAR

- Japanse

- jargon

- Java

- jpg

- voor slechts

- eentje maar

- Houden

- houden

- houdt

- sleutel

- Sleutelgebieden

- trefwoorden

- Pakket (SDK)

- blijven

- kennis

- weet

- Labs

- Gebrek

- taal

- Groot

- grootschalig

- grootste

- Achternaam*

- Afgelopen jaar

- Laat

- Wachttijd

- laatste

- gelanceerd

- lancering

- Advocaten

- lagen

- Legkippen

- Leadership

- leidend

- LEARN

- geleerd

- leren

- Juridisch

- minder

- Laten we

- Niveau

- Hefboomwerking

- hefbomen

- LexisNexis

- LG

- bibliotheken

- levenscyclus van uw product

- facelift

- als

- Waarschijnlijk

- beperkingen

- Beperkt

- grenzen

- lijnen

- LINK

- links

- Lijst

- leven

- Lives

- Lama

- LLM

- gelegen

- locaties

- logisch

- logo

- lang

- al lang bestaand

- lot

- liefde

- Laag

- te verlagen

- laagste

- machine

- machine learning

- gemaakt

- onderhouden

- Het handhaven

- onderhoud

- groot

- maken

- MERKEN

- maken

- beheerd

- management

- Managers

- handboek

- handwerk

- handmatig

- veel

- Marketing

- materiaal

- materieel

- maximaal

- Mei..

- me

- zinvolle

- middel

- Media

- Maak kennis met

- vergadering

- vergaderingen

- Meets

- Leden

- meer

- meta

- methode

- Miami

- Microsoft

- Midden

- macht

- mijlpaal

- minuten

- missen

- Missie

- ML

- model

- modellering

- modellen

- stuwkracht

- MongoDB

- monitors

- Maand

- maanden

- meer

- meest

- Meest populair

- bewegend

- MRI

- veel

- meervoudig

- Muziek

- Dan moet je

- my

- naam

- smal

- Nasdaq

- Naturel

- Nabij

- noodzakelijk

- Noodzaak

- nodig

- nodig

- netto

- netwerk

- netwerken

- New

- New York

- onlangs

- volgende

- Nitro

- geen

- nu

- aantal

- Nvidia

- of

- korting

- aanvallend

- bieden

- het aanbieden van

- Aanbod

- vaak

- ouder

- on

- eens

- EEN

- degenen

- online.

- online bankieren

- Slechts

- open

- besturen

- Operations

- Optimaliseer

- geoptimaliseerde

- optimaliseren

- Opties

- or

- orders

- organisatie

- organisaties

- origineel

- Overige

- Overig

- onze

- uit

- schets

- uitgang

- uitgangen

- over

- overvoeren

- overweldigend

- het te bezitten.

- Tempo

- Paketten

- pijnlijk

- paren

- parameter

- parameters

- deel

- partners

- onderdelen

- verleden

- patronen

- pauze

- Mensen

- voor

- Uitvoeren

- prestatie

- uitgevoerd

- presteert

- toestemming

- permissies

- persoon

- Personalisatie

- Verpersoonlijken

- Persoonlijk

- PGA Tour

- zinnen

- plaats

- plan

- Plato

- Plato gegevensintelligentie

- PlatoData

- plus

- punt

- beleidsmaatregelen door te lezen.

- Populair

- positief

- mogelijk

- Post

- potentieel

- energie

- aangedreven

- krachtige

- PRAKTISCH

- bijna

- praktijken

- nauwkeurig

- voorspellen

- Voorspellingen

- voorkeuren

- voorbereiding

- Voorbereiden

- presenteren

- president

- pers

- druk

- Voorbeschouwing

- die eerder

- prijs

- prijsstelling

- primair

- privacy

- Privacy en Beveiliging

- privaat

- prive informatie

- probleem

- problemen

- processen

- verwerking

- produceren

- Product

- productie

- productief

- produktiviteit

- professioneel

- professionals

- Programma's

- project

- prompts

- eigendom

- gepatenteerd

- beschermen

- bescherming

- zorgen voor

- leverancier

- providers

- biedt

- het verstrekken van

- publiek

- in het openbaar

- doeleinden

- Duwen

- voortvarend

- zetten

- Putting

- Python

- pytorch

- Q3

- kwantitatief

- vraag

- Contact

- Quick

- snel

- heel

- R & D

- reeks

- snel

- snel

- Tarieven

- RE

- lezing

- vast

- real-time

- realistisch

- realiseren

- realiseerde

- werkelijk

- oogsten

- redenen

- onlangs

- Aanbeveling

- aanbevelingen

- record

- verminderen

- Gereduceerd

- vermindering

- verfijnen

- regio

- uitgebracht

- relevante

- betrouwbaarheid

- stoffelijk overschot

- verwijderen

- het verwijderen van

- repareren

- herhalende

- vervanging

- antwoord

- verslag

- bewaarplaats

- te vragen

- verzoeken

- nodig

- Voorwaarden

- onderzoek

- Reservering

- Reserveren

- Resolutie

- resoneert

- Resources

- culturele wortels

- Reageren

- reageert

- antwoord

- reacties

- verantwoordelijk

- beperken

- begrensd

- resultaat

- Resultaten

- terugkerende

- beoordelen

- herzien

- rechts

- risico's

- Rol

- rollen

- Studio's

- wegen

- Regel

- lopen

- lopend

- startbaan

- concessies te doen

- veilig

- waarborgen

- veilig

- sagemaker

- verkoop

- verkoopsteam

- dezelfde

- tevredenheid

- Bespaar

- gezegde

- Scale

- scaling

- scenario's

- omvang

- krassen

- sdk

- naadloos

- Ontdek

- Tweede

- Tweede generatie

- seconden

- beveiligen

- vast

- veiligheid

- zien

- te zien

- gezien

- kiezen

- gekozen

- selectie

- verzending

- senior

- senior leiderschap

- gevoelig

- September

- Volgorde

- -Series

- Servers

- service

- Diensten

- reeks

- Sets

- verscheidene

- Delen

- gedeeld

- SHIP

- Bermuda's

- moet

- kant

- aanzienlijke

- Silicium

- evenzo

- Eenvoudig

- vereenvoudigen

- eenvoudigweg

- sinds

- ZES

- maten

- speling

- Klein

- So

- Social

- social media

- Software

- Software ontwikkelaars

- software development

- software ontwikkelingspakket

- oplossing

- Oplossingen

- OPLOSSEN

- sommige

- Iemand

- iets

- binnenkort

- geraffineerd

- bron

- broncode

- bronnen

- zuidoosten

- Tussenruimte

- Vonk

- specifiek

- toespraak

- snelheid

- besteden

- Stabiliteit

- stabiel

- stack

- gestapeld

- stakeholders

- gestart

- Start

- Startups

- state-of-the-art

- blijven

- Stap voor

- Stappen

- Still

- mediaopslag

- shop

- winkels

- Blog

- Storm

- Verhaal

- gestroomlijnd

- Versterken

- streng

- structuur

- Studie

- subnet

- wezenlijk

- dergelijk

- geschikt

- suite

- samenvatten

- OVERZICHT

- Super

- aanvullen

- leveranciers

- leveren

- Vraag en aanbod

- toeleveringsketen

- ondersteuning

- steunen

- zeker

- verrassend

- toezicht

- verdacht

- Duurzaamheid

- Stap over voor slechts

- synthetiseren

- system

- Systems

- tafel

- op maat gemaakt

- Nemen

- neemt

- het nemen

- Talk

- doelwit

- Taak

- taken

- team

- Leden van het team

- teams

- Technisch

- techniek

- technieken

- Technologies

- Technologie

- Technologie Innovatie

- vertellen

- vertellen

- tien

- tienen

- tensorflow

- terminologie

- proef

- Testen

- testen

- tekst

- neem contact

- dat

- De

- De toekomst

- de wereld

- hun

- Ze

- zich

- harte

- Er.

- Deze

- ze

- ding

- spullen

- denken

- Derde

- dit

- dit jaar

- die

- duizenden kosten

- drie

- Door

- overal

- doorvoer

- ticket

- tickets

- niet de tijd of

- keer

- Titan

- naar

- vandaag

- vandaag

- samen

- teken

- ook

- nam

- tools

- tools

- top

- onderwerpen

- Tour

- in de richting van

- in de richting van

- spoor

- track record

- Handel

- Trainen

- getraind

- Trainingen

- Transacties

- Afschrift

- Transformeren

- Transformatie

- transformaties

- transformeren

- reizen

- triljoenen

- reis

- echt

- Trust

- proberen

- proberen

- stemming

- wordt

- twee

- type dan:

- typisch

- die ten grondslag liggen

- begrijpen

- begrijpelijk

- begrip

- begrijpt

- onbekend

- unified

- unieke

- eenheid

- anders

- tot

- bijwerken

- updates

- upgrade

- upgrades

- us

- Gebruik

- .

- use case

- gebruikt

- Gebruiker

- gebruikers

- toepassingen

- gebruik

- waardevol

- variëteit

- divers

- versie

- versies

- Tegen

- zeer

- via

- vice

- Vice President

- Video

- Geweld

- virtueel

- visualisatie

- visualiseren

- visueel

- volumes

- Kwetsbaar

- willen

- Warner

- warner muziekgroep

- was

- Wave

- Manier..

- manieren

- we

- web

- web applicatie

- webservices

- websites

- week

- weken

- welkom

- GOED

- bekend

- waren

- Wat

- Wat is

- wanneer

- of

- welke

- en

- WIE

- Waarom

- breed

- Grote range

- bredere

- wil

- venster

- Met

- binnen

- zonder

- Mijn werk

- werkte

- workflows

- werkzaam

- Bedrijven

- wereld

- van het allerbeste niveau

- zorgen

- waard

- zou

- schrijven

- code schrijven

- het schrijven van

- jaar

- jaar

- york

- You

- Your

- Zendesk

- zephyrnet