I 2021 lanserte vi AWS-støtte proaktive tjenester som en del av AWS Enterprise Support plan. Siden introduksjonen har vi hjulpet hundrevis av kunder med å optimalisere arbeidsbelastningen, sette rekkverk og forbedre synligheten av maskinlæringsarbeidsbelastningens kostnader og bruk.

I denne serien med innlegg deler vi erfaringer om å optimalisere kostnader i Amazon SageMaker. i Del 1, viste vi hvordan du kommer i gang med å bruke AWS Cost Explorer for å identifisere kostnadsoptimeringsmuligheter i SageMaker. I dette innlegget fokuserer vi på SageMaker-inferensmiljøer: sanntidsslutning, batchtransformasjon, asynkron inferens og serverløs inferens.

SageMaker tilbyr flere slutningsalternativer som du kan velge mellom basert på arbeidsbelastningskravene dine:

- Slutning i sanntid for online, lav ventetid eller høye gjennomstrømningskrav

- Batchtransformasjon for offline, planlagt behandling og når du ikke trenger et vedvarende endepunkt

- Asynkron slutning for når du har store nyttelaster med lang behandlingstid og ønsker å sette forespørsler i kø

- Serverløs slutning for når du har periodiske eller uforutsigbare trafikkmønstre og tåler kaldstart

I de følgende avsnittene diskuterer vi hvert slutningsalternativ mer detaljert.

SageMaker sanntidsslutning

Når du oppretter et endepunkt, legger SageMaker ved en Amazon Elastic Block Store (Amazon EBS) lagringsvolum til Amazon Elastic Compute Cloud (Amazon EC2)-forekomst som er vert for endepunktet. Dette gjelder for alle forekomsttyper som ikke kommer med SSD-lagring. Fordi d*-forekomsttypene kommer med en NVMe SSD-lagring, kobler ikke SageMaker et EBS-lagringsvolum til disse ML-beregningsforekomstene. Referere til Lagringsvolumer for vertsforekomster for størrelsen på lagringsvolumene som SageMaker tilknytter for hver forekomsttype for et enkelt endepunkt og for et flermodellendepunkt.

Kostnaden for SageMaker sanntidsendepunkter er basert på forbrukt forekomsttime for hver forekomst mens endepunktet kjører, kostnaden for GB-måned med klargjort lagring (EBS-volum), samt GB-data som behandles inn og ut av endepunktforekomsten, som skissert i Amazon SageMaker-priser. I Cost Explorer kan du se endepunktkostnader i sanntid ved å bruke et filter på brukstypen. Navnene på disse brukstypene er strukturert som følger:

REGION-Host:instanceType(for eksempel,USE1-Host:ml.c5.9xlarge)REGION-Host:VolumeUsage.gp2(for eksempel,USE1-Host:VolumeUsage.gp2)REGION-Hst:Data-Bytes-Out(for eksempel,USE2-Hst:Data-Bytes-In)REGION-Hst:Data-Bytes-Out(for eksempel,USW2-Hst:Data-Bytes-Out)

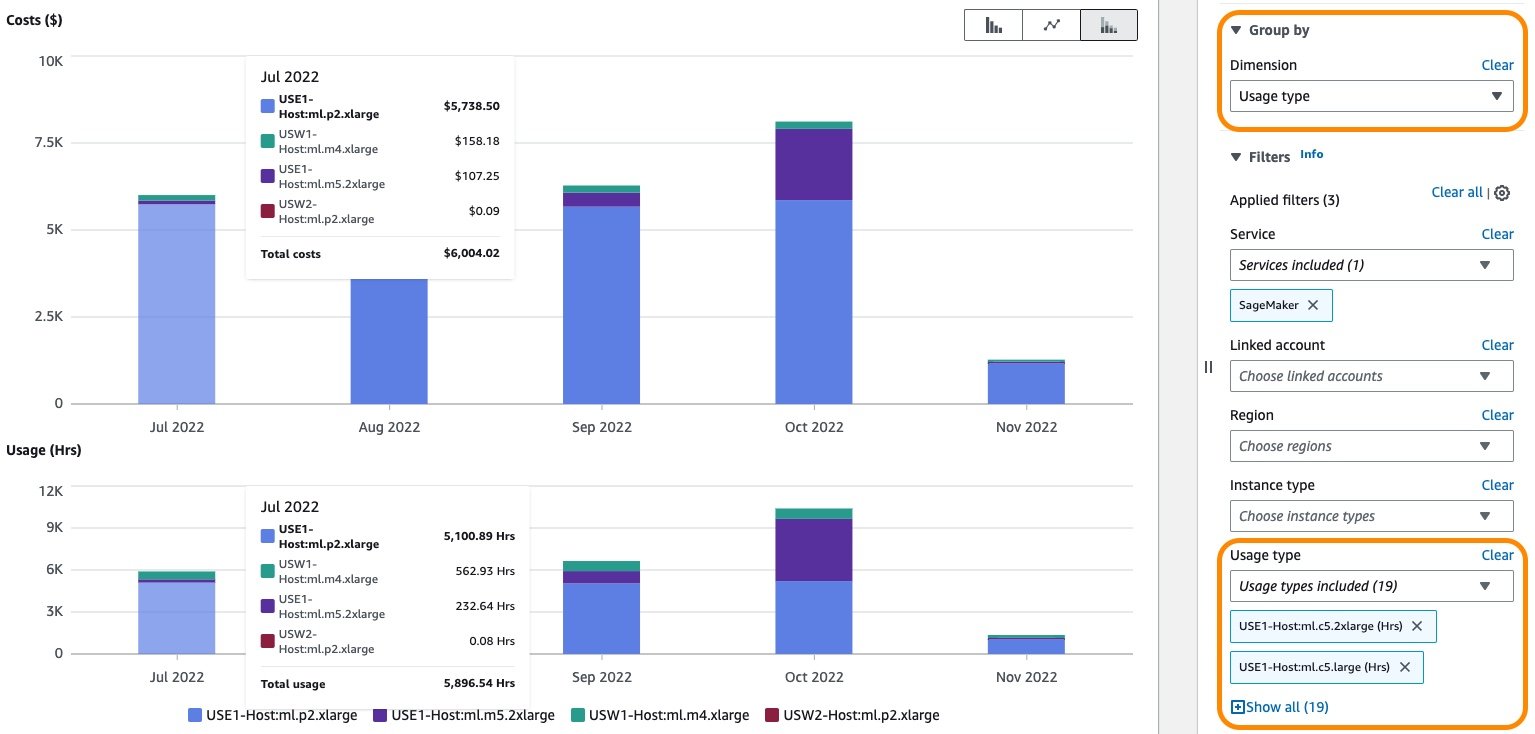

Som vist i følgende skjermbilde, filtrering etter brukstype Host: vil vise en liste over brukstyper for hosting i sanntid i en konto.

Du kan enten velge spesifikke brukstyper eller velge Velg Alle Og velg Påfør for å vise kostnadsfordelingen for SageMaker sanntids hostingbruk. For å se kostnads- og bruksfordelingen etter forekomsttimer, må du velge bort alle REGION-Host:VolumeUsage.gp2 brukstyper før du bruker filteret for brukstype. Du kan også bruke tilleggsfiltre som kontonummer, EC2-forekomsttype, kostnadsfordelingskode, region og mer. Følgende skjermbilde viser kostnads- og bruksdiagrammer for de valgte vertsbrukstypene.

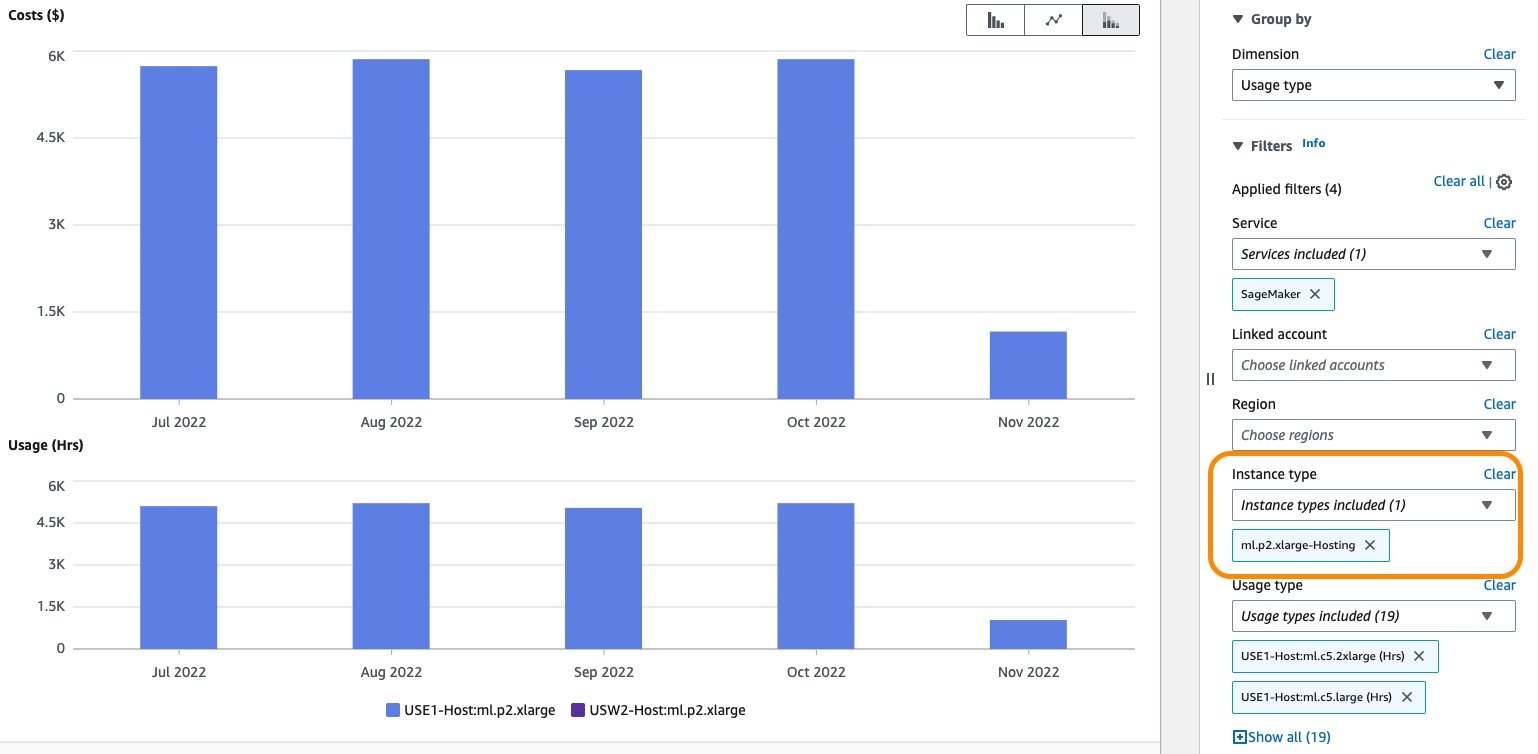

I tillegg kan du utforske kostnadene knyttet til en eller flere hosting-forekomster ved å bruke Forekomsttype filter. Følgende skjermbilde viser kostnads- og bruksfordeling for hostingforekomsten ml.p2.xlarge.

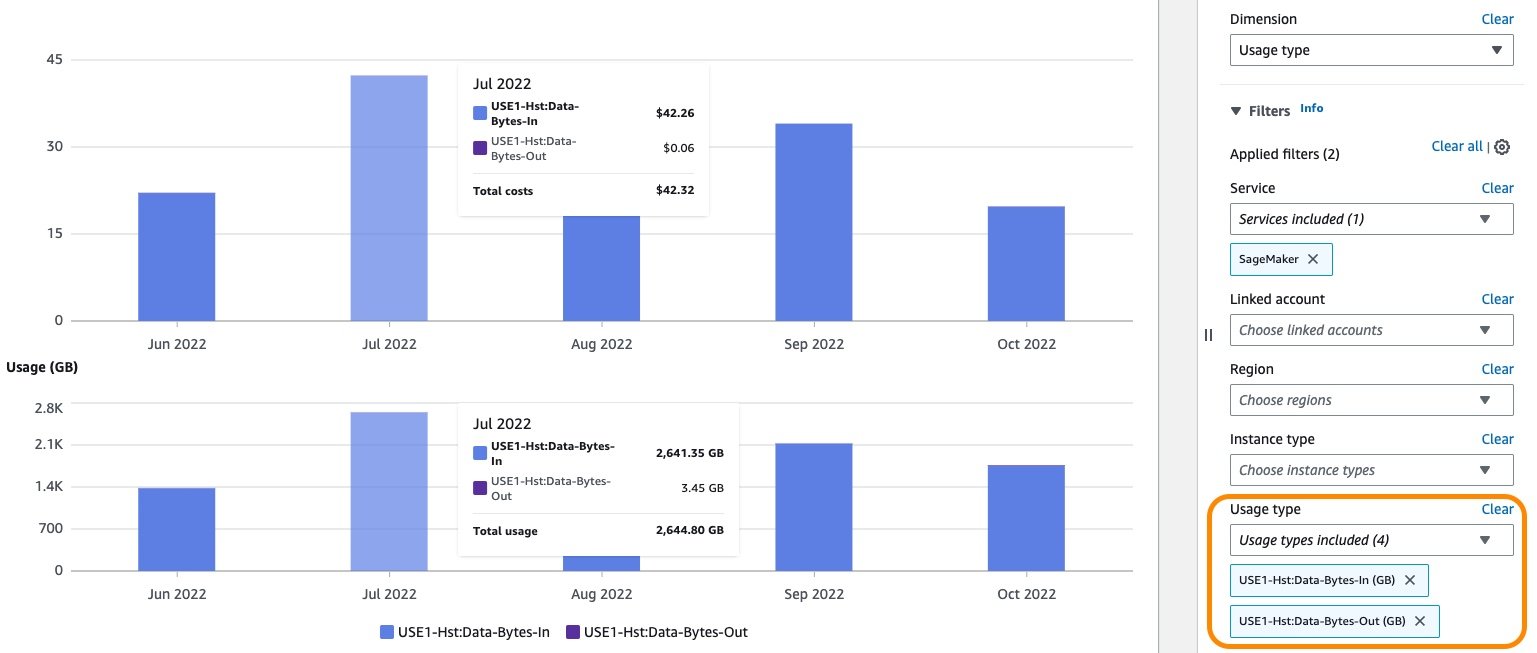

På samme måte kan kostnaden for GB-data som behandles inn og behandles ut, vises ved å velge de tilknyttede brukstypene som et brukt filter, som vist i følgende skjermbilde.

Etter at du har oppnådd ønskede resultater med filtre og grupperinger, kan du enten laste ned resultatene ved å velge Last ned som CSV eller lagre rapporten ved å velge Lagre til rapportbibliotek. For generell veiledning om bruk av Cost Explorer, se AWS Cost Explorers nye utseende og vanlige brukstilfeller.

Eventuelt kan du aktivere AWS kostnads- og bruksrapporter (AWS CUR) for å få innsikt i kostnads- og bruksdata for kontoene dine. AWS CUR inneholder AWS-forbruksdetaljer per time. Den er lagret i Amazon enkel lagringstjeneste (Amazon S3) i betalerkontoen, som konsoliderer data for alle de tilknyttede kontoene. Du kan kjøre søk for å analysere trender i bruken din og iverksette passende tiltak for å optimalisere kostnadene. Amazonas Athena er en serverløs spørringstjeneste som du kan bruke til å analysere dataene fra AWS CUR i Amazon S3 ved å bruke standard SQL. Mer informasjon og eksempelspørsmål finner du i AWS CUR spørringsbibliotek.

Du kan også mate AWS CUR-data inn Amazon QuickSight, hvor du kan skjære den i skiver og terninger slik du vil for rapportering eller visualiseringsformål. For instruksjoner, se Hvordan inntar og visualiserer jeg AWS Cost and Usage Report (CUR) i Amazon QuickSight.

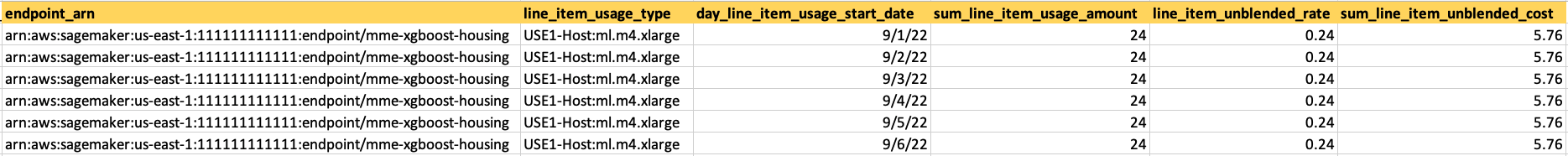

Du kan få informasjon på ressursnivå som endepunkt ARN, endepunktforekomsttyper, timepris for forekomster, daglige brukstimer og mer fra AWS CUR. Du kan også inkludere etiketter for kostnadsfordeling i søket for et ekstra detaljeringsnivå. Følgende eksempelspørring returnerer bruk av vertsressurs i sanntid for de siste 3 månedene for den gitte betalerkontoen:

Følgende skjermbilde viser resultatene oppnådd ved å kjøre spørringen med Athena. For mer informasjon, se Spørre kostnads- og bruksrapporter ved hjelp av Amazon Athena.

Resultatet av spørringen viser det endepunktet mme-xgboost-housing med ml.x4.xlarge-forekomsten rapporterer 24 timers kjøretid for flere påfølgende dager. Forekomstprisen er $0.24/time og den daglige kostnaden for å kjøre i 24 timer er $5.76.

AWS CUR-resultater kan hjelpe deg med å identifisere mønstre av endepunkter som kjører i påfølgende dager i hver av de tilknyttede kontoene, samt endepunkter med den høyeste månedlige kostnaden. Dette kan også hjelpe deg med å avgjøre om endepunktene i ikke-produksjonskontoer kan slettes for å spare kostnader.

Optimaliser kostnadene for endepunkter i sanntid

Fra et kostnadsstyringsperspektiv er det viktig å identifisere underutnyttede (eller overdimensjonerte) forekomster og bringe forekomststørrelsen og -antallet, om nødvendig, i tråd med arbeidsbelastningskravene. Vanlige systemberegninger som CPU/GPU-utnyttelse og minneutnyttelse skrives til Amazon CloudWatch for alle vertsinstanser. For endepunkter i sanntid gjør SageMaker flere ekstra beregninger tilgjengelige i CloudWatch. Noen av de ofte overvåkede beregningene inkluderer anropstall og invokasjons 4xx/5xx-feil. For en fullstendig liste over beregninger, se Overvåk Amazon SageMaker med Amazon CloudWatch.

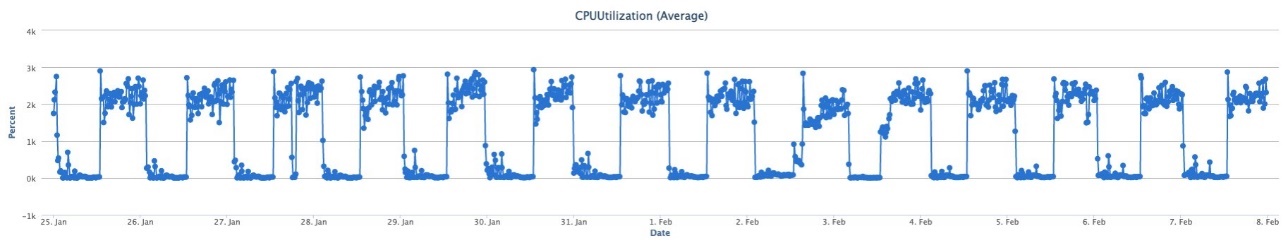

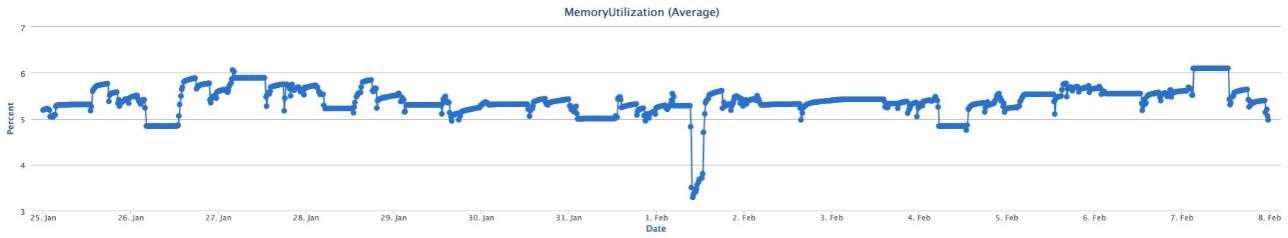

Metrikken CPUUtilization gir summen av hver enkelt CPU-kjernes utnyttelse. CPU-utnyttelsen for hvert kjerneområde er 0–100. For eksempel, hvis det er fire CPUer, CPUUtilization området er 0–400 %. Metrikken MemoryUtilization er prosentandelen av minnet som brukes av beholderne på en forekomst. Dette verdiområdet er 0–100 %. Følgende skjermbilde viser et eksempel på CloudWatch-beregninger CPUUtilization og MemoryUtilization for en endepunktforekomst ml.m4.10xlarge som kommer med 40 vCPUer og 160 GiB minne.

Disse metriske grafene viser maksimal CPU-utnyttelse på omtrent 3,000 %, som tilsvarer 30 vCPUer. Dette betyr at dette endepunktet ikke bruker mer enn 30 vCPUer av den totale kapasiteten på 40 vCPUer. Tilsvarende er minneutnyttelsen under 6 %. Ved å bruke denne informasjonen kan du muligens eksperimentere med en mindre forekomst som kan matche dette ressursbehovet. Videre har CPUUtilization metrikk viser et klassisk mønster av periodisk høy og lav CPU-etterspørsel, noe som gjør dette endepunktet til en god kandidat for automatisk skalering. Du kan starte med en mindre forekomst og skalere ut først etter hvert som databehovet endres. For informasjon, se Skala Amazon SageMaker-modeller automatisk.

SageMaker er flott for å teste nye modeller fordi du enkelt kan distribuere dem i et A/B-testmiljø ved å bruke produksjonsvarianter, og du betaler kun for det du bruker. Hver produksjonsvariant kjører på sin egen beregningsforekomst, og du belastes per forbrukt forekomsttime for hver forekomst mens varianten kjører.

SageMaker støtter også skyggevarianter, som har de samme komponentene som en produksjonsvariant og kjører på sin egen dataforekomst. Med skyggevarianter distribuerer SageMaker modellen automatisk i et testmiljø, ruter en kopi av slutningsforespørslene mottatt av produksjonsmodellen til testmodellen i sanntid, og samler inn ytelsesmålinger som latens og gjennomstrømning. Dette lar deg validere enhver ny kandidatkomponent i modellserveringsstakken din før du markedsfører den til produksjon.

Når du er ferdig med testene og ikke bruker endepunktet eller variantene mye lenger, bør du slette det for å spare kostnader. Fordi modellen er lagret i Amazon S3, kan du gjenskape den etter behov. Du kan automatisk oppdage disse endepunktene og iverksette korrigerende handlinger (som å slette dem) ved å bruke Amazon CloudWatch-hendelser og AWS Lambda funksjoner. For eksempel kan du bruke Invocations metrikk for å få det totale antallet forespørsler sendt til et modellendepunkt og deretter oppdage om endepunktene har vært inaktive de siste timene (uten påkallinger over en viss periode, for eksempel 24 timer).

Hvis du har flere underutnyttede endepunktforekomster, bør du vurdere vertsalternativer som f.eks flermodell-endepunkter (MME-er), endepunkter for flere beholdere (MCE), og serielle inferensrørledninger for å konsolidere bruken til færre endepunktforekomster.

For sanntids og asynkron inferensmodellimplementering kan du optimalisere kostnad og ytelse ved å distribuere modeller på SageMaker ved å bruke AWS Graviton. AWS Graviton er en familie av prosessorer designet av AWS som gir den beste prisytelsen og er mer energieffektive enn x86-motpartene. For veiledning om distribusjon av en ML-modell til AWS Graviton-baserte forekomster og detaljer om prisytelsesfordelen, se Kjør arbeidsbelastninger for maskinlæring på AWS Graviton-baserte forekomster med Amazon SageMaker. SageMaker støtter også AWS slutning akseleratorer gjennom ml.inf2 familie av forekomster for å distribuere ML-modeller for sanntids og asynkron inferens. Du kan bruke disse forekomstene på SageMaker for å oppnå høy ytelse til en lav kostnad for generativ kunstig intelligens (AI)-modeller, inkludert store språkmodeller (LLM) og synstransformatorer.

I tillegg kan du bruke Amazon SageMaker Inference Recommender for å kjøre belastningstester og evaluere fordelene med prisytelse ved å distribuere modellen din på disse forekomstene. For ytterligere veiledning om automatisk gjenkjenning av ledige SageMaker-endepunkter, samt forekomst av høyrestørrelse og automatisk skalering for SageMaker-endepunkter, se Sørg for effektive dataressurser på Amazon SageMaker.

SageMaker batch-transformasjon

Batch slutning, eller frakoblet slutning, er prosessen med å generere spådommer på en gruppe observasjoner. Offline spådommer er egnet for større datasett og i tilfeller der du har råd til å vente flere minutter eller timer på svar.

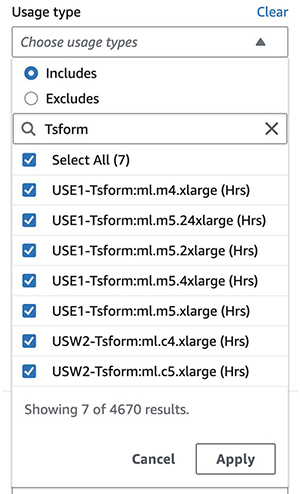

Kostnaden for SageMaker batchtransformasjon er basert på forbrukt forekomsttime for hver forekomst mens batchtransformeringsjobben kjører, som beskrevet i Amazon SageMaker-priser. I Cost Explorer kan du utforske batchtransformeringskostnader ved å bruke et filter på brukstypen. Navnet på denne brukstypen er strukturert som REGION-Tsform:instanceType (for eksempel, USE1-Tsform:ml.c5.9xlarge).

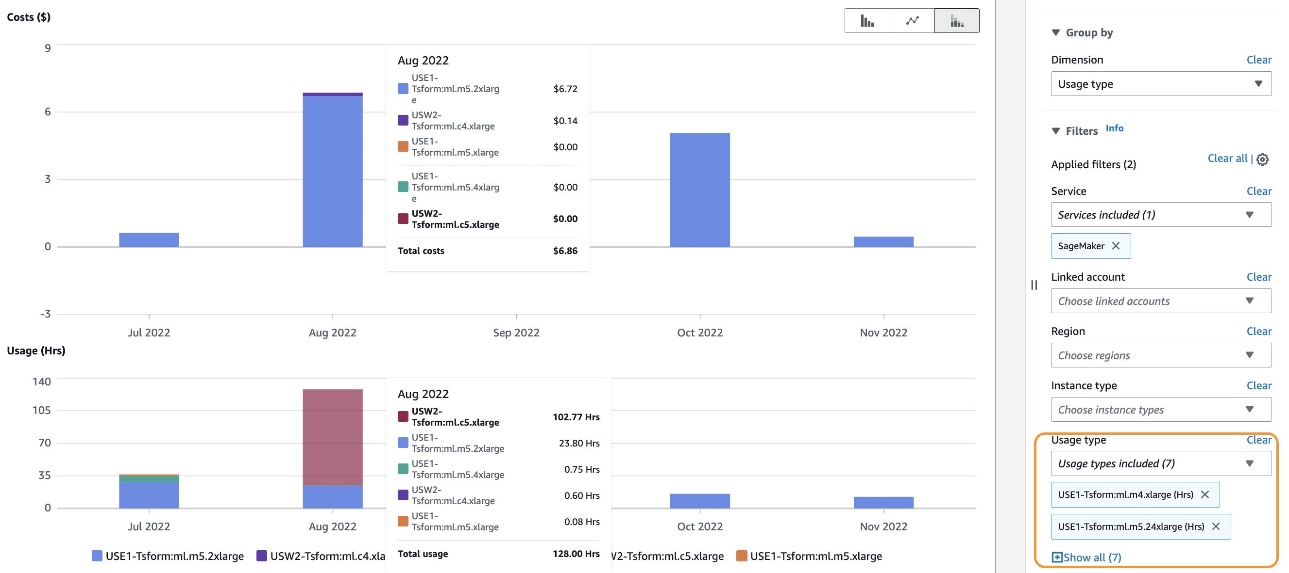

Som vist i følgende skjermbilde, filtrering etter brukstype Tsform: vil vise en liste over SageMaker batch transform brukstyper i en konto.

Du kan enten velge spesifikke brukstyper eller velge Velg Alle Og velg Påfør for å vise kostnadsoversikten over bruk av batchtransformasjonsforekomster for de valgte typene. Som nevnt tidligere kan du også bruke ekstra filtre. Følgende skjermbilde viser kostnads- og bruksdiagrammer for de valgte brukstypene for batchtransformasjon.

Optimaliser kostnadene for batchtransformasjon

SageMaker batchtransformasjon belaster deg bare for forekomstene som brukes mens jobbene dine kjører. Hvis dataene dine allerede er i Amazon S3, er det ingen kostnad for å lese inndata fra Amazon S3 og skrive utdata til Amazon S3. Alle utdataobjekter er forsøkt lastet opp til Amazon S3. Hvis alt lykkes, merkes batchtransformeringsjobben som fullført. Hvis ett eller flere objekter mislykkes, merkes batchtransformeringsjobben som mislykket.

Gebyrer for batch-transformeringsjobber gjelder i følgende scenarier:

- Jobben er vellykket

- Svikt pga

ClientErrorog modellbeholderen er SageMaker eller et SageMaker-administrert rammeverk - Svikt pga

AlgorithmErrororClientErrorog modellbeholderen er din egen tilpassede beholder (BYOC)

Følgende er noen av de beste fremgangsmåtene for å optimalisere en SageMaker batch-transformeringsjobb. Disse anbefalingene kan redusere den totale kjøretiden til batchtransformeringsjobben, og dermed redusere kostnadene:

- Sett Batchstrategi til

MultiRecordogSplitTypetilLinehvis du trenger batch-transformeringsjobben for å lage minibatcher fra inndatafilen. Hvis den ikke automatisk kan dele opp datasettet i minibatcher, kan du dele det inn i minibatcher ved å legge hver batch i en egen inngangsfil, plassert i datakildens S3-bøtte. - Kontroller at batchstørrelsen passer inn i minnet. SageMaker håndterer vanligvis dette automatisk; Men når du deler partier manuelt, må dette justeres basert på minnet.

- Batch-transformasjon partisjonerer S3-objektene i input etter nøkkel og tilordner disse objektene til instanser. Når du har flere filer, kan én forekomst behandle

input1.csv, og en annen instans kan behandleinput2.csv. Hvis du har én inndatafil, men initialiserer flere beregningsforekomster, behandler bare én forekomst inndatafilen og resten av forekomstene er inaktive. Sørg for at antall filer er lik eller større enn antall forekomster. - Hvis du har et stort antall små filer, kan det være fordelaktig å kombinere flere filer til et lite antall større filer for å redusere interaksjonstiden for Amazon S3.

- Hvis du bruker Opprett TransformJob API, kan du redusere tiden det tar å fullføre batch-transformeringsjobber ved å bruke optimale verdier for parametere som f.eks MaxPayloadInMB, MaxConcurrentTransformseller Batchstrategi:

MaxConcurrentTransformsangir det maksimale antallet parallelle forespørsler som kan sendes til hver forekomst i en transformasjonsjobb. Den ideelle verdien forMaxConcurrentTransformser lik antall vCPU-kjerner i en instans.MaxPayloadInMBer den maksimalt tillatte størrelsen på nyttelasten, i MB. Verdien iMaxPayloadInMBmå være større enn eller lik størrelsen på en enkelt post. For å estimere størrelsen på en post i MB, del størrelsen på datasettet med antall poster. For å sikre at postene passer innenfor den maksimale nyttelaststørrelsen, anbefaler vi å bruke en litt større verdi. Standardverdien er 6 MB.MaxPayloadInMBmå ikke være større enn 100 MB. Hvis du spesifiserer den valgfrieMaxConcurrentTransformsparameter, deretter verdien av (MaxConcurrentTransforms*MaxPayloadInMB) må heller ikke overstige 100 MB.- For tilfeller der nyttelasten kan være vilkårlig stor og overføres ved hjelp av HTTP chunked-koding, sett MaxPayloadInMB-verdien til 0. Denne funksjonen fungerer bare i støttede algoritmer. Foreløpig støtter ikke SageMaker innebygde algoritmer HTTP chunked-koding.

- Batch-inferensoppgaver er vanligvis gode kandidater for horisontal skalering. Hver arbeidstaker i en klynge kan operere på et annet delsett av data uten å måtte utveksle informasjon med andre arbeidere. AWS tilbyr flere lagrings- og beregningsalternativer som muliggjør horisontal skalering. Hvis en enkelt forekomst ikke er tilstrekkelig for å oppfylle ytelseskravene dine, bør du vurdere å bruke flere forekomster parallelt for å fordele arbeidsmengden. For viktige hensyn ved utforming av batch-transformeringsjobber, se Batch-inferens i skala med Amazon SageMaker.

- Overvåk kontinuerlig ytelsesmålingene til dine SageMaker batch-transformeringsjobber ved hjelp av CloudWatch. Se etter flaskehalser, for eksempel høy CPU- eller GPU-utnyttelse, minnebruk eller nettverksgjennomstrømning, for å finne ut om du trenger å justere forekomststørrelser eller konfigurasjoner.

- SageMaker bruker Amazon S3 flerdelt opplastings-API for å laste opp resultater fra en batch-transformeringsjobb til Amazon S3. Hvis det oppstår en feil, fjernes de opplastede resultatene fra Amazon S3. I noen tilfeller, for eksempel når et nettverksbrudd oppstår, kan en ufullstendig flerdelt opplasting forbli i Amazon S3. For å unngå lagringskostnader, anbefaler vi at du legger til S3 bøttepolitikk til S3-bøttelivssyklusreglene. Denne policyen sletter ufullstendige flerdelte opplastinger som kan være lagret i S3-bøtten. For mer informasjon, se Administrere lagringslivssyklusen din.

SageMaker asynkron inferens

Asynkron inferens er et godt valg for kostnadssensitive arbeidsbelastninger med stor nyttelast og burst-trafikk. Forespørsler kan ta opptil 1 time å behandle og har nyttelaststørrelser på opptil 1 GB, så det er mer egnet for arbeidsbelastninger som har avslappede latenskrav.

Påkalling av asynkrone endepunkter skiller seg fra sanntidsendepunkter. I stedet for å sende en forespørselsnyttelast synkront med forespørselen, laster du opp nyttelasten til Amazon S3 og sender en S3 URI som en del av forespørselen. Internt holder SageMaker en kø med disse forespørslene og behandler dem. Under opprettelse av endepunkt kan du eventuelt spesifisere en Amazon enkel varslingstjeneste (Amazon SNS) emne for å motta suksess- eller feilmeldinger. Når du mottar varselet om at slutningsforespørselen din har blitt behandlet, kan du få tilgang til resultatet i Amazon S3-utgangen.

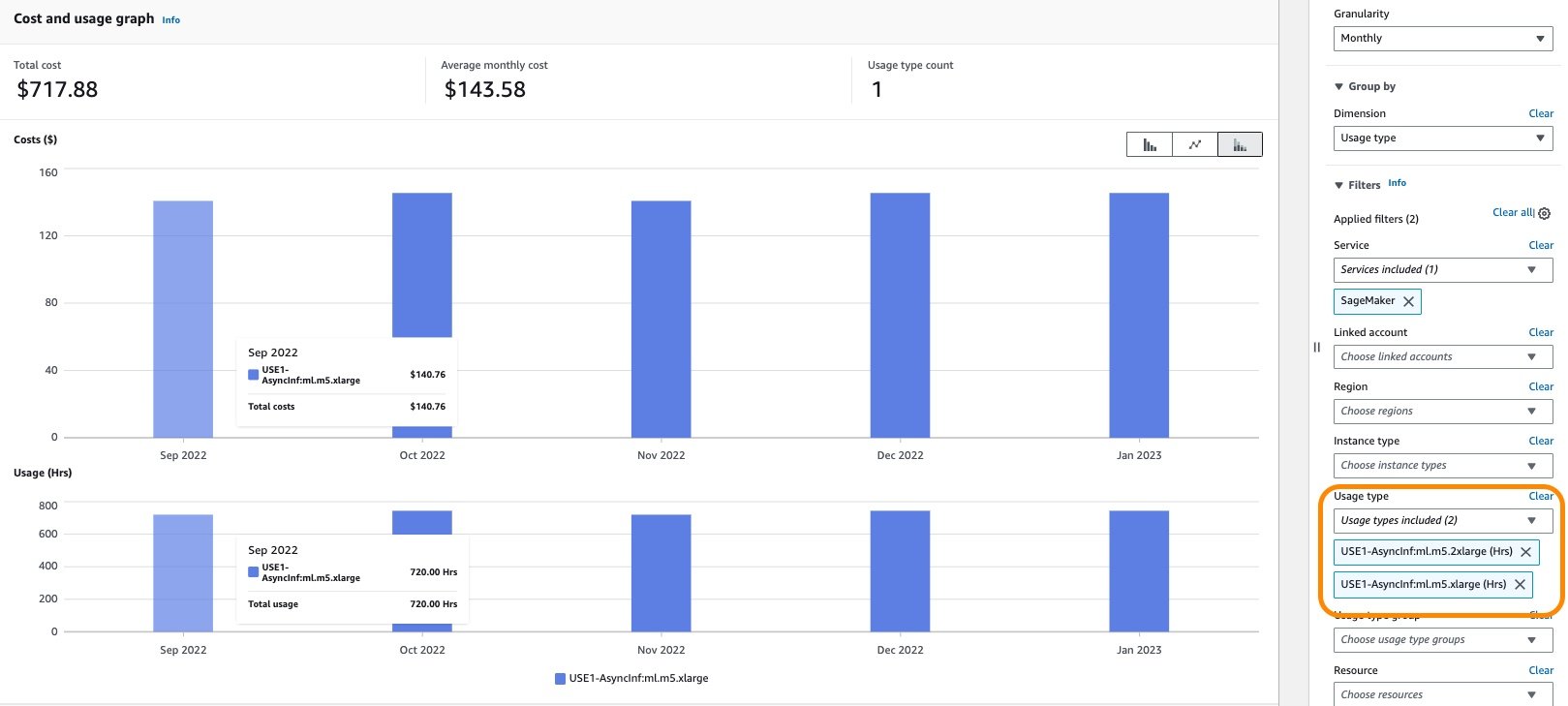

Kostnaden for asynkron slutning er basert på per forekomst-time forbrukt for hver forekomst mens endepunktet kjører, kostnaden for GB-måned med klargjort lagring, samt GB-data behandlet inn og ut av endepunktforekomsten, som skissert i Amazon SageMaker-priser. I Cost Explorer kan du filtrere asynkrone slutningskostnader ved å bruke et filter på brukstypen. Navnet på denne brukstypen er strukturert som REGION-AsyncInf:instanceType (for eksempel, USE1-AsyncInf:ml.c5.9xlarge). Merk at GB-volum og GB-data behandlet brukstyper er de samme som sanntidsendepunkter, som nevnt tidligere i dette innlegget.

Som vist i følgende skjermbilde, filtrering etter brukstype AsyncInf: i Cost Explorer viser en kostnadsfordeling etter asynkrone endepunktbrukstyper.

For å se kostnads- og bruksfordelingen etter forekomsttimer, må du velge bort alle REGION-Host:VolumeUsage.gp2 brukstyper før du bruker filteret for brukstype. Du kan også bruke ekstra filtre. Informasjon på ressursnivå som endepunkt ARN, endepunktforekomsttyper, timeforekomstpris og daglige brukstimer kan fås fra AWS CUR. Følgende er et eksempel på en AWS CUR-spørring for å oppnå asynkron vertsressursbruk for de siste 3 månedene:

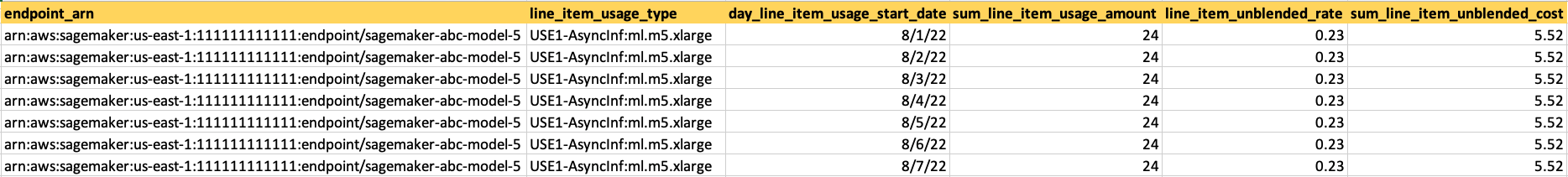

Følgende skjermbilde viser resultatene fra å kjøre AWS CUR-spørringen ved hjelp av Athena.

Resultatet av spørringen viser det endepunktet sagemaker-abc-model-5 med ml.m5.xlarge-forekomsten rapporterer 24 timers kjøretid for flere påfølgende dager. Forekomstprisen er $0.23/time og den daglige kostnaden for å kjøre i 24 timer er $5.52.

Som nevnt tidligere kan AWS CUR-resultater hjelpe deg med å identifisere mønstre for endepunkter som kjører i påfølgende dager, samt endepunkter med den høyeste månedlige kostnaden. Dette kan også hjelpe deg med å avgjøre om endepunktene i ikke-produksjonskontoer kan slettes for å spare kostnader.

Optimaliser kostnadene for asynkron slutning

Akkurat som sanntidsendepunktene, er kostnaden for asynkrone endepunkter basert på instanstypens bruk. Derfor er det viktig å identifisere underutnyttede forekomster og endre størrelsen på dem basert på arbeidsbelastningskravene. For å overvåke asynkrone endepunkter, lager SageMaker flere beregninger slik som ApproximateBacklogSize, HasBacklogWithoutCapacity, og mer tilgjengelig i CloudWatch. Disse beregningene kan vise forespørsler i køen for en forekomst og kan brukes til automatisk skalering av et endepunkt. SageMaker asynkron inferens inkluderer også beregninger på vertsnivå. For informasjon om verdier på vertsnivå, se SageMaker-jobber og endepunktmålinger. Disse beregningene kan vise ressursutnyttelse som kan hjelpe deg med å gi riktig størrelse på forekomsten.

SageMaker støtter automatisk skalering for asynkrone endepunkter. I motsetning til vertsbaserte endepunkter i sanntid, støtter asynkrone inferensendepunkter nedskalering av forekomster til null ved å sette minimumskapasiteten til null. For asynkrone endepunkter anbefaler SageMaker på det sterkeste at du oppretter en policykonfigurasjon for målsporingsskalering for en distribuert modell (variant). Du må definere skaleringspolicyen som skaleres på ApproximateBacklogPerInstance tilpasset beregning og angi MinCapacity verdi til null.

Asynkron inferens lar deg spare kostnader ved å automatisk skalere forekomsttellingen til null når det ikke er noen forespørsler å behandle, slik at du bare betaler når endepunktet ditt behandler forespørsler. Forespørsler som mottas når det er null forekomster, står i kø for behandling etter at endepunktet skaleres opp. Derfor, for brukstilfeller som tåler en kaldstartstraff på noen få minutter, kan du eventuelt skalere ned endepunktforekomsttellingen til null når det ikke er utestående forespørsler og skalere opp igjen når nye forespørsler kommer inn. Kaldstarttid avhenger av tiden det tar å starte et nytt endepunkt fra bunnen av. Dessuten, hvis selve modellen er stor, kan tiden være lengre. Hvis jobben din forventes å ta lengre tid enn 1-times behandlingstid, kan det være lurt å vurdere SageMaker batch-transformasjon.

I tillegg kan du også vurdere forespørselens køtid kombinert med behandlingstiden for å velge forekomsttype. For eksempel, hvis brukssaken din tåler timer med ventetid, kan du velge en mindre forekomst for å spare kostnader.

For ytterligere veiledning om instansretting og automatisk skalering for SageMaker-endepunkter, se Sørg for effektive dataressurser på Amazon SageMaker.

Serverløs slutning

Serverløs inferens lar deg distribuere ML-modeller for inferens uten å måtte konfigurere eller administrere den underliggende infrastrukturen. Basert på volumet av slutningsforespørsler modellen din mottar, vil SageMaker serverløs slutning automatisk klargjøre, skalere og slå av datakapasitet. Som et resultat betaler du kun for beregningstiden for å kjøre slutningskoden og mengden data som behandles, ikke for inaktiv tid. For serverløse endepunkter er ikke instansklargjøring nødvendig. Du må gi minnestørrelse og maksimal samtidighet. Fordi serverløse endepunkter leverer dataressurser på forespørsel, kan endepunktet ditt oppleve noen ekstra sekunders forsinkelse (kaldstart) for den første påkallingen etter en inaktiv periode. Du betaler for beregningskapasiteten som brukes til å behandle slutningsforespørsler, fakturert per millisekund, GB-måned med klargjort lagring og mengden data som behandles. Beregningskostnaden avhenger av minnekonfigurasjonen du velger.

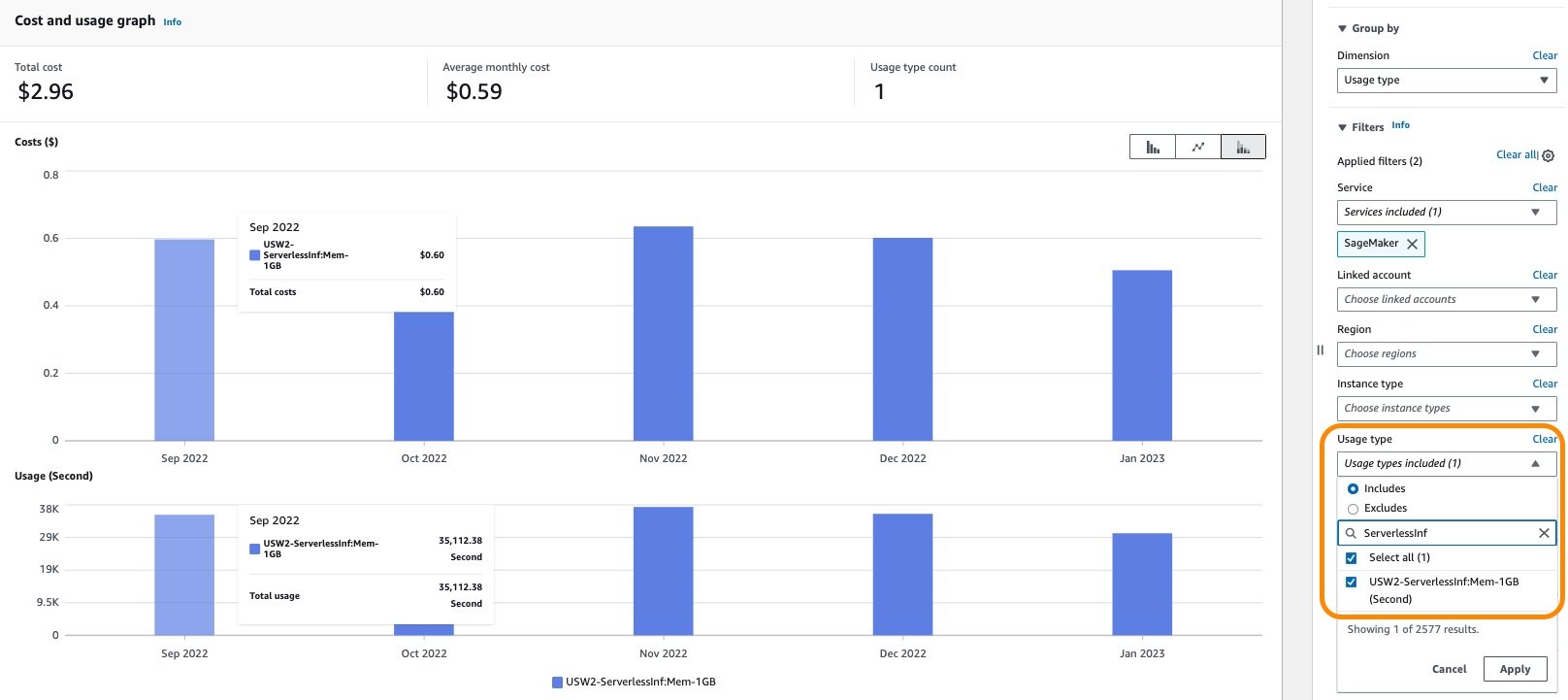

I Cost Explorer kan du filtrere serverløse endepunktkostnader ved å bruke et filter på brukstypen. Navnet på denne brukstypen er strukturert som REGION-ServerlessInf:Mem-MemorySize (for eksempel, USE2-ServerlessInf:Mem-4GB). Merk at GB-volum og GB-databehandlet brukstyper er de samme som sanntidsendepunkter.

Du kan se kostnadsoversikten ved å bruke tilleggsfiltre som kontonummer, forekomsttype, region og mer. Følgende skjermbilde viser kostnadsfordelingen ved å bruke filtre for brukstypen serverløs slutning.

Optimaliser kostnadene for serverløs slutning

Når du konfigurerer det serverløse endepunktet ditt, kan du spesifisere minnestørrelsen og maksimalt antall samtidige påkallinger. SageMaker serverløs inferens tildeler automatisk dataressurser proporsjonalt med minnet du velger. Hvis du velger en større minnestørrelse, har beholderen tilgang til flere vCPUer. Med serverløs slutning betaler du kun for beregningskapasiteten som brukes til å behandle slutningsforespørsler, fakturert per millisekund, og mengden data som behandles. Beregningskostnaden avhenger av minnekonfigurasjonen du velger. Minnestørrelsene du kan velge er 1024 MB, 2048 MB, 3072 MB, 4096 MB, 5120 MB og 6144 MB. Prisen øker med minnestørrelsen, som forklart i Amazon SageMaker-priser, så det er viktig å velge riktig minnestørrelse. Som en generell regel bør minnestørrelsen være minst like stor som modellstørrelsen din. Det er imidlertid en god praksis å referere til minneutnyttelse når du bestemmer endepunktminnestørrelsen, i tillegg til selve modellstørrelsen.

Generelle beste fremgangsmåter for å optimalisere SageMaker-slutningskostnadene

Optimalisering av hostingkostnader er ikke en engangshendelse. Det er en kontinuerlig prosess med å overvåke utplassert infrastruktur, bruksmønstre og ytelse, og også holde et godt øye med nye innovative løsninger som AWS lanserer som kan påvirke kostnadene. Vurder følgende beste fremgangsmåter:

- Velg en passende forekomsttype – SageMaker støtter flere instanstyper, hver med varierende kombinasjoner av CPU, GPU, minne og lagringskapasitet. Basert på modellens ressurskrav, velg en forekomsttype som gir de nødvendige ressursene uten overprovisionering. For informasjon om tilgjengelige SageMaker-forekomsttyper, deres spesifikasjoner og veiledning om valg av riktig forekomst, se Sørg for effektive dataressurser på Amazon SageMaker.

- Test med lokal modus – For å oppdage feil og feilsøke raskere, anbefales det å teste koden og beholderen (i tilfelle BYOC) i lokal modus før du kjører inferensarbeidsbelastningen på den eksterne SageMaker-forekomsten. Lokal modus er en fin måte å teste skriptene dine på før du kjører dem i et SageMaker-administrert vertsmiljø.

- Optimaliser modellene for å yte mer – Uoptimaliserte modeller kan føre til lengre kjøretider og bruke mer ressurser. Du kan velge å bruke flere eller større forekomster for å forbedre ytelsen; dette fører imidlertid til høyere kostnader. Ved å optimalisere modellene dine for å gi mer ytelse, kan du kanskje redusere kostnadene ved å bruke færre eller mindre forekomster samtidig som du beholder de samme eller bedre ytelsesegenskapene. Du kan bruke Amazon SageMaker Neo med SageMaker-slutning for å automatisk optimalisere modeller. For flere detaljer og eksempler, se Optimaliser modellytelsen ved å bruke Neo.

- Bruk koder og kostnadsstyringsverktøy – For å opprettholde innsyn i arbeidsbelastningene dine, anbefales det å bruke tagger så vel som AWS kostnadsstyringsverktøy som f.eks. AWS-budsjetterden AWS-faktureringskonsoll, og prognosefunksjonen til Cost Explorer. Du kan også utforske SageMaker spareplaner som en fleksibel prismodell. For mer informasjon om disse alternativene, se Del 1 av denne serien.

konklusjonen

I dette innlegget ga vi veiledning om kostnadsanalyse og beste praksis ved bruk av SageMaker slutningsalternativer. Ettersom maskinlæring etablerer seg som et kraftig verktøy på tvers av bransjer, må opplæring og kjøring av ML-modeller forbli kostnadseffektivt. SageMaker tilbyr et bredt og dypt funksjonssett for å forenkle hvert trinn i ML-pipelinen og gir kostnadsoptimaliseringsmuligheter uten å påvirke ytelsen eller smidigheten. Ta kontakt med AWS-teamet ditt for kostnadsveiledning om SageMaker-arbeidsbelastningene dine.

Om forfatterne

Deepali Rajale er senior AI/ML-spesialist hos AWS. Hun jobber med bedriftskunder som gir teknisk veiledning med beste praksis for distribusjon og vedlikehold av AI/ML-løsninger i AWS-økosystemet. Hun har jobbet med et bredt spekter av organisasjoner på ulike brukssaker for dyp læring som involverer NLP og datasyn. Hun brenner for å gi organisasjoner mulighet til å utnytte generativ AI for å forbedre brukeropplevelsen deres. På fritiden liker hun film, musikk og litteratur.

Deepali Rajale er senior AI/ML-spesialist hos AWS. Hun jobber med bedriftskunder som gir teknisk veiledning med beste praksis for distribusjon og vedlikehold av AI/ML-løsninger i AWS-økosystemet. Hun har jobbet med et bredt spekter av organisasjoner på ulike brukssaker for dyp læring som involverer NLP og datasyn. Hun brenner for å gi organisasjoner mulighet til å utnytte generativ AI for å forbedre brukeropplevelsen deres. På fritiden liker hun film, musikk og litteratur.

Uri Rosenberg er AI & ML Specialist Technical Manager for Europa, Midtøsten og Afrika. Basert fra Israel, jobber Uri for å gi bedriftskunder i stand til å designe, bygge og drive i stor skala på alt innen ML. På fritiden liker han å sykle, gå på fotturer og fjellklatring.

Uri Rosenberg er AI & ML Specialist Technical Manager for Europa, Midtøsten og Afrika. Basert fra Israel, jobber Uri for å gi bedriftskunder i stand til å designe, bygge og drive i stor skala på alt innen ML. På fritiden liker han å sykle, gå på fotturer og fjellklatring.

- SEO-drevet innhold og PR-distribusjon. Bli forsterket i dag.

- PlatoAiStream. Web3 Data Intelligence. Kunnskap forsterket. Tilgang her.

- Minting the Future med Adryenn Ashley. Tilgang her.

- Kjøp og selg aksjer i PRE-IPO-selskaper med PREIPO®. Tilgang her.

- kilde: https://aws.amazon.com/blogs/machine-learning/part-5-analyze-amazon-sagemaker-spend-and-determine-cost-optimization-opportunities-based-on-usage-part-5-hosting/

- : har

- :er

- :ikke

- :hvor

- $OPP

- 000

- 1

- 100

- 2021

- 24

- 30

- 40

- 500

- 7

- 8

- a

- I stand

- Om oss

- akseleratorer

- adgang

- Logg inn

- kontoer

- Oppnå

- oppnådd

- tvers

- Handling

- handlinger

- legge til

- tillegg

- Ytterligere

- afrika

- Etter

- AI

- AI / ML

- algoritmer

- Alle

- allokering

- tillater

- allerede

- også

- Amazon

- Amazon EC2

- Amazon SageMaker

- Amazon Web Services

- beløp

- an

- analyse

- analysere

- og

- En annen

- noen

- lenger

- api

- anvendt

- Påfør

- påføring

- hensiktsmessig

- ca

- ER

- kunstig

- kunstig intelligens

- Kunstig intelligens (AI)

- AS

- assosiert

- At

- feste

- forsøkt

- auto

- automatisk

- tilgjengelig

- unngå

- AWS

- tilbake

- basert

- BE

- fordi

- vært

- før du

- under

- gunstig

- nytte

- Fordeler

- BEST

- beste praksis

- Bedre

- Stor

- større

- fakturering

- Blokker

- Breakdown

- bringe

- bygge

- innebygd

- men

- by

- CAN

- kandidat

- kandidater

- kapasiteter

- Kapasitet

- saken

- saker

- viss

- Endringer

- egenskaper

- kostnad

- ladet

- avgifter

- valg

- Velg

- velge

- Classic

- klatring

- Cluster

- kode

- forkjølelse

- kombinasjoner

- kombinere

- kombinert

- Kom

- kommer

- Felles

- vanligvis

- fullføre

- komponent

- komponenter

- Beregn

- datamaskin

- Datamaskin syn

- samtidig

- Konfigurasjon

- påfølgende

- Vurder

- betraktninger

- konsolidere

- konsoliderer

- forbrukes

- forbruk

- Container

- Containere

- inneholder

- kontinuerlig

- Kjerne

- korrigere

- Kostnad

- Kostnadsstyring

- kostnadseffektiv

- Kostnader

- kunne

- skape

- skaperverket

- I dag

- skikk

- Kunder

- daglig

- dato

- datasett

- Dager

- bestemme

- Avgjør

- dyp

- dyp læring

- Misligholde

- Etterspørsel

- avhenger

- utplassere

- utplassert

- utplasserings

- distribusjon

- Distribueres

- utforming

- designet

- ønsket

- detalj

- detaljer

- Bestem

- forskjellig

- diskutere

- Vise

- skjermer

- distribuere

- do

- ikke

- gjort

- ikke

- dobbelt

- ned

- nedlasting

- to

- under

- hver enkelt

- Tidligere

- lett

- øst

- økosystem

- effektiv

- enten

- bemyndige

- myndiggjøring

- muliggjøre

- muliggjør

- Endpoint

- energi

- forbedre

- sikre

- Enterprise

- Miljø

- miljøer

- lik

- Tilsvarende

- feil

- feil

- etablerer

- anslag

- Europa

- evaluere

- Event

- eksempel

- stige

- utveksling

- forventet

- erfaring

- eksperiment

- forklarte

- utforske

- explorer

- omfattende

- ekstra

- øye

- tilrettelegging

- FAIL

- Mislyktes

- familie

- raskere

- Trekk

- Noen få

- færre

- filet

- Filer

- filtrere

- filtrering

- filtre

- Først

- passer

- fleksibel

- Fokus

- etter

- følger

- Til

- funnet

- fire

- fra

- fullt

- funksjoner

- Dess

- Gevinst

- general

- genererer

- generative

- Generativ AI

- få

- gitt

- god

- GPU

- grafer

- flott

- større

- Gruppe

- veiledning

- Håndterer

- Ha

- å ha

- he

- hjelpe

- hjulpet

- her

- Høy

- høyere

- høyest

- hans

- Horisontal

- vert

- Hosting

- hosting kostnader

- Vertskapet

- time

- TIMER

- Hvordan

- Hvordan

- Men

- HTML

- http

- HTTPS

- Hundrevis

- i

- ideell

- identifisere

- Idle

- if

- Påvirkning

- slag

- viktig

- forbedre

- in

- inkludere

- inkluderer

- Inkludert

- øker

- indikerer

- individuelt

- bransjer

- informasjon

- Infrastruktur

- innovative

- inngang

- innsikt

- f.eks

- instruksjoner

- Intelligens

- interaksjon

- internt

- inn

- Introduksjon

- involverer

- Israel

- IT

- DET ER

- selv

- Jobb

- Jobb

- jpg

- Keen

- holde

- nøkkel

- Språk

- stor

- større

- Siste

- Ventetid

- lansere

- lansert

- føre

- Fører

- lært

- læring

- minst

- Lessons

- Lessons Learned

- Nivå

- Leverage

- Livssyklus

- i likhet med

- linje

- knyttet

- Liste

- litteratur

- laste

- lokal

- plassering

- Lang

- lenger

- Se

- Lav

- lavere

- senking

- maskin

- maskinlæring

- vedlikeholde

- Vedlike

- opprettholder

- gjøre

- GJØR AT

- administrer

- fikk til

- ledelse

- styringsverktøy

- leder

- manuelt

- Kart

- merket

- Match

- maksimal

- Kan..

- midler

- Møt

- Minne

- nevnt

- metrisk

- Metrics

- Middle

- Midtøsten

- kunne

- minimum

- minutter

- ML

- Mote

- modell

- modeller

- Overvåke

- overvåket

- overvåking

- Måned

- månedlig

- måneder

- mer

- Filmer

- Multi-Model endepunkt

- flere

- musikk

- må

- navn

- navn

- nødvendig

- Trenger

- nødvendig

- behov

- nettverk

- NETTVERKSBRUTT

- Ny

- nlp

- Nei.

- varsling

- varslinger

- Antall

- gjenstander

- få

- innhentet

- of

- off

- Tilbud

- offline

- on

- ONE

- på nett

- bare

- betjene

- Muligheter

- optimal

- optimalisering

- Optimalisere

- optimalisere

- Alternativ

- alternativer

- or

- rekkefølge

- organisasjoner

- Annen

- ut

- brudd

- skissert

- produksjon

- enestående

- enn

- egen

- Parallel

- parameter

- parametere

- del

- passere

- Passerer

- lidenskapelig

- Past

- Mønster

- mønstre

- Betale

- prosent

- ytelse

- perioden

- periodisk

- perspektiv

- plukke

- rørledning

- fly

- planer

- plato

- Platon Data Intelligence

- PlatonData

- politikk

- muligens

- Post

- innlegg

- kraftig

- praksis

- praksis

- Spådommer

- pris

- prising

- prismodell

- Proaktiv

- prosess

- Bearbeidet

- Prosesser

- prosessering

- prosessorer

- Produksjon

- fremme

- gi

- forutsatt

- gir

- gi

- forsyning

- formål

- Sette

- spørsmål

- område

- Sats

- heller

- å nå

- Lesning

- ekte

- sanntids

- motta

- mottatt

- mottar

- anbefaler

- anbefalinger

- anbefales

- anbefaler

- rekord

- poster

- redusere

- region

- Utgivelser

- forbli

- fjernkontroll

- fjernet

- rapporterer

- Rapportering

- Rapporter

- anmode

- forespørsler

- påkrevd

- Krav

- ressurs

- Ressurser

- svar

- REST

- resultere

- Resultater

- avkastning

- ikke sant

- Rock

- Rull

- ruter

- Regel

- regler

- Kjør

- rennende

- sagemaker

- SageMaker Inference

- samme

- Spar

- Besparelser

- Skala

- vekter

- skalering

- scenarier

- planlagt

- skraper

- skript

- sekunder

- seksjoner

- se

- valgt

- velge

- senior

- sendt

- separat

- Serien

- server~~POS=TRUNC

- tjeneste

- Tjenester

- servering

- sett

- innstilling

- flere

- Shadow

- Del

- hun

- bør

- Vis

- viste

- vist

- Viser

- på samme måte

- Enkelt

- siden

- enkelt

- Størrelse

- størrelser

- Slice

- liten

- mindre

- So

- Solutions

- noen

- kilde

- spesialist

- spesifikk

- spesifikasjoner

- bruke

- splittet

- stable

- Standard

- Begynn

- startet

- Trinn

- lagring

- lagret

- sterk

- strukturert

- suksess

- vellykket

- vellykket

- slik

- tilstrekkelig

- egnet

- støtte

- støtte proaktiv

- Støttes

- Støtter

- system

- TAG

- Ta

- tar

- oppgaver

- lag

- Teknisk

- test

- Testing

- tester

- enn

- Det

- De

- deres

- Dem

- deretter

- Der.

- derved

- derfor

- Disse

- ting

- denne

- De

- Gjennom

- gjennomstrømning

- tid

- ganger

- til

- verktøy

- verktøy

- Tema

- Totalt

- trafikk

- Kurs

- Transform

- transformers

- Trender

- sant

- snur

- typen

- typer

- underliggende

- I motsetning til

- uforutsigbare

- lastet opp

- bruk

- bruke

- bruk sak

- brukt

- bruker

- ved hjelp av

- vanligvis

- utnytte

- VALIDERE

- verdi

- Verdier

- variant

- ulike

- Se

- synlighet

- syn

- visualisering

- volum

- volumer

- vente

- ønsker

- Vei..

- we

- web

- webtjenester

- VI VIL

- Hva

- når

- om

- hvilken

- mens

- bred

- Bred rekkevidde

- vil

- med

- innenfor

- uten

- arbeidet

- arbeidstaker

- arbeidere

- virker

- skriving

- skrevet

- Du

- Din

- zephyrnet

- null