Frøene til et maskinlæringsparadigmeskifte (ML) har eksistert i flere tiår, men med lett tilgjengelighet av skalerbar datakapasitet, en massiv spredning av data og den raske utviklingen av ML-teknologier, transformerer kunder på tvers av bransjer virksomhetene sine. Nylig har generative AI-applikasjoner som ChatGPT fanget utbredt oppmerksomhet og fantasi. Vi er virkelig ved et spennende vendepunkt i den utbredte bruken av ML, og vi tror de fleste kundeopplevelser og applikasjoner vil bli gjenoppfunnet med generativ AI.

AI og ML har vært et fokus for Amazon i over 20 år, og mange av egenskapene kundene bruker med Amazon er drevet av ML. Vår e-handelsanbefalingsmotor er drevet av ML; banene som optimaliserer robotplukkruter i våre oppfyllelsessentre er drevet av ML; og vår forsyningskjede, prognoser og kapasitetsplanlegging er informert av ML. Prime Air (våre droner) og datasynsteknologien i Amazon Go (vår fysiske detaljhandelsopplevelse som lar forbrukere velge varer fra en hylle og forlate butikken uten å måtte sjekke ut formelt) bruker dyp læring. Alexa, drevet av mer enn 30 forskjellige ML-systemer, hjelper kunder milliarder av ganger hver uke med å administrere smarte hjem, handle, få informasjon og underholdning og mer. Vi har tusenvis av ingeniører hos Amazon forpliktet til ML, og det er en stor del av arven vår, nåværende etos og fremtid.

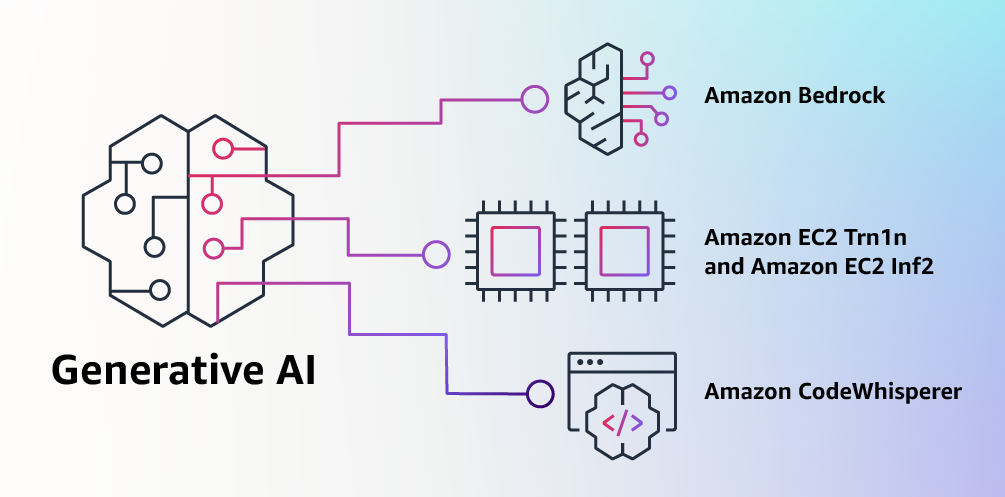

Hos AWS har vi spilt en nøkkelrolle i å demokratisere ML og gjøre det tilgjengelig for alle som ønsker å bruke det, inkludert mer enn 100,000 3 kunder i alle størrelser og bransjer. AWS har den bredeste og dypeste porteføljen av AI- og ML-tjenester på alle tre lag av stabelen. Vi har investert og innovert for å tilby den mest effektive, skalerbare infrastrukturen for kostnadseffektiv ML-opplæring og slutninger; utviklet Amazon SageMaker, som er den enkleste måten for alle utviklere å bygge, trene og distribuere modeller; og lanserte et bredt spekter av tjenester som lar kunder legge til AI-funksjoner som bildegjenkjenning, prognoser og intelligent søk til applikasjoner med et enkelt API-kall. Dette er grunnen til at kunder som Intuit, Thomson Reuters, AstraZeneca, Ferrari, Bundesliga, XNUMXM og BMW, samt tusenvis av startups og offentlige etater rundt om i verden, transformerer seg selv, sin industri og sine oppdrag med ML. Vi tar den samme demokratiserende tilnærmingen til generativ AI: vi jobber for å ta disse teknologiene ut av forsknings- og eksperimenteringsområdet og utvide deres tilgjengelighet langt utover en håndfull startups og store, velfinansierte teknologiselskaper. Derfor er jeg i dag glade for å kunngjøre flere nye innovasjoner som vil gjøre det enkelt og praktisk for kundene våre å bruke generativ AI i sine virksomheter.

Bygg med Generativ AI på AWS

Generative AI og fundamentmodeller

Generativ AI er en type AI som kan skape nytt innhold og ideer, inkludert samtaler, historier, bilder, videoer og musikk. Som all AI, er generativ AI drevet av ML-modeller – veldig store modeller som er forhåndstrent på enorme mengder data og ofte referert til som Foundation Models (FMs). Nylige fremskritt innen ML (spesifikt oppfinnelsen av den transformatorbaserte nevrale nettverksarkitekturen) har ført til fremveksten av modeller som inneholder milliarder av parametere eller variabler. For å gi en følelse av skalaendringen, var den største forhåndstrente modellen i 2019 330 millioner parametere. Nå er de største modellene mer enn 500B parametere – en 1,600 ganger økning i størrelse på bare noen få år. Dagens FM-er, som de store språkmodellene (LLM) GPT3.5 eller BLOOM, og tekst-til-bilde-modellen Stable Diffusion from Stability AI, kan utføre et bredt spekter av oppgaver som spenner over flere domener, som å skrive blogginnlegg, generere bilder, løse matematiske problemer, delta i dialog og svare på spørsmål basert på et dokument. Størrelsen og den generelle karakteren til FM-er gjør dem forskjellige fra tradisjonelle ML-modeller, som vanligvis utfører spesifikke oppgaver, som å analysere tekst for følelser, klassifisere bilder og forutsi trender.

FM-er kan utføre så mange flere oppgaver fordi de inneholder et så stort antall parametere som gjør dem i stand til å lære komplekse konsepter. Og gjennom sin eksponering før trening for data i internettskala i alle dens forskjellige former og myriade av mønstre, lærer FM-er å bruke kunnskapen sin innenfor et bredt spekter av sammenhenger. Selv om egenskapene og de resulterende mulighetene til en forhåndsopplært FM er fantastiske, blir kundene veldig begeistret fordi disse generelt kapable modellene også kan tilpasses til å utføre domenespesifikke funksjoner som skiller seg fra virksomheten deres, ved å bruke bare en liten brøkdel av dataene og beregning som kreves for å trene en modell fra bunnen av. De tilpassede FM-ene kan skape en unik kundeopplevelse, som legemliggjør selskapets stemme, stil og tjenester på tvers av et bredt spekter av forbrukerbransjer, som bank, reise og helsevesen. For eksempel kan et finansselskap som trenger å automatisk generere en daglig aktivitetsrapport for intern sirkulasjon ved å bruke alle relevante transaksjoner tilpasse modellen med proprietære data, som vil inkludere tidligere rapporter, slik at FM lærer hvordan disse rapportene skal leses og hva data ble brukt til å generere dem.

Potensialet til FM-er er utrolig spennende. Men vi er fortsatt i de aller første dagene. Mens ChatGPT har vært den første brede generative AI-opplevelsen som fanget kundenes oppmerksomhet, har de fleste som studerer generativ AI raskt innsett at flere selskaper har jobbet med FM-er i årevis, og det er flere forskjellige FM-er tilgjengelig – hver med unike styrker og kjennetegn. Som vi har sett gjennom årene med teknologier som beveger seg raskt, og i utviklingen av ML, endrer ting seg raskt. Vi forventer at nye arkitekturer vil oppstå i fremtiden, og dette mangfoldet av FM-er vil sette i gang en bølge av innovasjon. Vi ser allerede nye applikasjonsopplevelser som vi aldri har sett før. AWS-kunder har spurt oss hvordan de raskt kan dra nytte av det som er der ute i dag (og det som sannsynligvis kommer i morgen) og raskt begynne å bruke FM-er og generativ AI i sine virksomheter og organisasjoner for å drive nye nivåer av produktivitet og transformere tilbudene deres.

Lansering av Amazon Bedrock og Amazon Titan-modeller, den enkleste måten å bygge og skalere generative AI-applikasjoner med FM-er

Kunder har fortalt oss at det er noen få store ting som står i veien for dem i dag. For det første trenger de en enkel måte å finne og få tilgang til høyytende FM-er som gir enestående resultater og er best egnet for deres formål. For det andre ønsker kundene at integrering i applikasjoner skal være sømløs, uten å måtte administrere store klynger av infrastruktur eller pådra seg store kostnader. Til slutt ønsker kundene at det skal være enkelt å ta basis FM, og bygge differensierte apper ved å bruke sine egne data (litt data eller mye). Siden dataene kundene ønsker å bruke for tilpasning er utrolig verdifull IP, trenger de at den forblir fullstendig beskyttet, sikker og privat under den prosessen, og de vil ha kontroll over hvordan dataene deres deles og brukes.

Vi tok alle tilbakemeldingene fra kundene, og i dag er vi glade for å kunngjøre Amazonas grunnfjell, en ny tjeneste som gjør FM-er fra AI21 Labs, Anthropic, Stability AI og Amazon tilgjengelige via et API. Berggrunn er den enkleste måten for kunder å bygge og skalere generative AI-baserte applikasjoner ved å bruke FM-er, og demokratisere tilgangen for alle byggere. Bedrock vil tilby muligheten til å få tilgang til en rekke kraftige FM-er for tekst og bilder – inkludert Amazons Titan FM-er, som består av to nye LLM-er som vi også kunngjør i dag– gjennom en skalerbar, pålitelig og sikker AWS-administrert tjeneste. Med Bedrocks serverløse opplevelse kan kunder enkelt finne den riktige modellen for det de prøver å få gjort, komme raskt i gang, tilpasse FM-er privat med sine egne data, og enkelt integrere og distribuere dem i applikasjonene sine ved å bruke AWS-verktøyene og -funksjonene de er kjent med (inkludert integrasjoner med Amazon SageMaker ML-funksjoner som Experiments for å teste forskjellige modeller og Pipelines for å administrere FM-ene i stor skala) uten å måtte administrere noen infrastruktur.

Berggrunnskunder kan velge mellom noen av de mest banebrytende FM-ene som er tilgjengelige i dag. Dette inkluderer Jurassic-2-familien av flerspråklige LLM-er fra AI21 Labs, som følger instruksjoner for naturlig språk for å generere tekst på spansk, fransk, tysk, portugisisk, italiensk og nederlandsk. Claude, Anthropics LLM, kan utføre en lang rekke samtale- og tekstbehandlingsoppgaver og er basert på Anthropics omfattende forskning på trening av ærlige og ansvarlige AI-systemer. Bedrock gjør det også enkelt å få tilgang til Stability AIs pakke med tekst-til-bilde-fundamentmodeller, inkludert Stable Diffusion (den mest populære i sitt slag), som er i stand til å generere unike, realistiske bilder av høy kvalitet, kunst, logoer og design.

En av de viktigste egenskapene til Bedrock er hvor enkelt det er å tilpasse en modell. Kunder peker ganske enkelt Bedrock på noen få merkede eksempler i Amazon S3, og tjenesten kan finjustere modellen for en bestemt oppgave uten å måtte kommentere store datamengder (så få som 20 eksempler er nok). Se for deg en innholdsmarkedsføringssjef som jobber hos en ledende moteforhandler og trenger å utvikle ferske, målrettede annonse- og kampanjetekster for en kommende ny serie med håndvesker. For å gjøre dette gir de Bedrock noen få merkede eksempler på deres beste slagord fra tidligere kampanjer, sammen med tilhørende produktbeskrivelser, og Bedrock vil automatisk begynne å generere effektive sosiale medier, visningsannonser og netttekster for de nye håndveskene. Ingen av kundens data brukes til å trene de underliggende modellene, og siden all data er kryptert og ikke forlater en kundes Virtual Private Cloud (VPC), kan kundene stole på at deres data forblir private og konfidensielle.

Berggrunn er nå i begrenset forhåndsvisning, og kundene liker Coda er spente på hvor raskt utviklingsteamene deres har kommet i gang. Shishir Mehrotra, medgründer og administrerende direktør i Coda, sier: "Som en mangeårig fornøyd AWS-kunde er vi spent på hvordan Amazon Bedrock kan bringe kvalitet, skalerbarhet og ytelse til Coda AI. Siden alle våre data allerede er på AWS, er vi i stand til raskt å inkorporere generativ AI ved å bruke Bedrock, med all sikkerhet og personvern vi trenger for å beskytte dataene våre innebygd. Med over titusenvis av team som kjører på Coda, inkludert store team som Uber, New York Times og Square, er pålitelighet og skalerbarhet veldig viktig.»

Vi har forhåndsvist Amazons nye Titan FM-er med noen få kunder før vi gjør dem mer tilgjengelige i løpet av de kommende månedene. Vi vil først ha to Titan-modeller. Den første er en generativ LLM for oppgaver som oppsummering, tekstgenerering (for eksempel å lage et blogginnlegg), klassifisering, åpne spørsmål og svar og informasjonsutvinning. Den andre er en embeddings LLM som oversetter tekstinndata (ord, setninger eller muligens store tekstenheter) til numeriske representasjoner (kjent som embeddings) som inneholder den semantiske betydningen av teksten. Selv om denne LLM ikke vil generere tekst, er den nyttig for applikasjoner som personalisering og søk fordi modellen vil produsere mer relevante og kontekstuelle svar enn ordmatching ved å sammenligne innebygginger. Faktisk bruker Amazon.coms produktsøkefunksjon en lignende innbyggingsmodell blant annet for å hjelpe kundene med å finne produktene de leter etter. For å fortsette å støtte beste praksis for ansvarlig bruk av AI, er Titan FM-er bygget for å oppdage og fjerne skadelig innhold i dataene, avvise upassende innhold i brukerinndataene og filtrere modellenes utdata som inneholder upassende innhold (som hatytringer, banning og vold).

Bedrock gjør kraften til FM-er tilgjengelig for selskaper i alle størrelser, slik at de kan akselerere bruken av ML på tvers av organisasjonene og bygge sine egne generative AI-applikasjoner fordi det vil være enkelt for alle utviklere. Vi tror Bedrock vil være et enormt skritt fremover i å demokratisere FM-er, og våre partnere som Accenture, Deloitte, Infosys og slalom bygger praksis for å hjelpe bedrifter å gå raskere med generativ AI. Uavhengige programvareleverandører (ISVs) liker C3 AI og Pega er glade for å utnytte Bedrock for enkel tilgang til det store utvalget av FM-er med all den sikkerheten, personvernet og påliteligheten de forventer av AWS.

Kunngjør den generelle tilgjengeligheten av Amazon EC2 Trn1n-instanser drevet av AWS Trainium og Amazon EC2 Inf2-instanser drevet av AWS Inferentia2, den mest kostnadseffektive skyinfrastrukturen for generativ AI

Uansett hva kundene prøver å gjøre med FM-er – kjører dem, bygger dem, tilpasser dem – trenger de den mest effektive og kostnadseffektive infrastrukturen som er spesialbygd for ML. I løpet av de siste fem årene har AWS investert i vårt eget silisium for å presse rammen om ytelse og prisytelse for krevende arbeidsbelastninger som ML-trening og inferens, og våre AWS Trainium- og AWS Inferentia-brikker tilbyr den laveste kostnaden for treningsmodeller og løpende slutninger i skyen. Denne muligheten til å maksimere ytelsen og kontrollere kostnadene ved å velge den optimale ML-infrastrukturen er grunnen til at ledende AI-startups, som AI21 Labs, Anthropic, Cohere, Grammarly, Hugging Face, Runway og Stability AI kjører på AWS.

Trn1-forekomster, drevet av Trainium, kan gi opptil 50 % besparelser på treningskostnader sammenlignet med andre EC2-forekomster, og er optimalisert for å distribuere opplæring på tvers av flere servere koblet med 800 Gbps andregenerasjons Elastic Fabric Adapter (EFA) nettverk. Kunder kan distribuere Trn1-forekomster i UltraClusters som kan skalere opptil 30,000 6 Trainium-brikker (mer enn 1 eksaflops med beregning) plassert i samme AWS-tilgjengelighetssone med petabit-skalanettverk. Mange AWS-kunder, inkludert Helixon, Money Forward og Amazon Search-teamet, bruker Trn800-forekomster for å redusere tiden som kreves for å trene de største dyplæringsmodellene fra måneder til uker eller til og med dager, samtidig som kostnadene reduseres. XNUMX Gbps er mye båndbredde, men vi har fortsatt å innovere for å levere mer, og i dag kunngjør vi generell tilgjengelighet av nye, nettverksoptimerte Trn1n forekomster, som tilbyr 1600 Gbps nettverksbåndbredde og er designet for å levere 20 % høyere ytelse over Trn1 for store, nettverksintensive modeller.

I dag går mesteparten av tiden og pengene brukt på FM-er til å trene dem. Dette er fordi mange kunder så vidt begynner å distribuere FM-er i produksjon. Men i fremtiden, når FM-er blir distribuert i stor skala, vil de fleste kostnadene være forbundet med å kjøre modellene og gjøre slutninger. Mens du vanligvis trener en modell med jevne mellomrom, kan en produksjonsapplikasjon hele tiden generere spådommer, kjent som slutninger, og potensielt generere millioner per time. Og disse spådommene må skje i sanntid, noe som krever svært lav latens og høykapasitets nettverk. Alexa er et godt eksempel med millioner av forespørsler som kommer inn hvert minutt, som står for 40 % av alle beregningskostnader.

Fordi vi visste at mesteparten av de fremtidige ML-kostnadene ville komme fra å kjøre slutninger, prioriterte vi slutningsoptimalisert silisium da vi begynte å investere i nye brikker for noen år siden. I 2018 annonserte vi Inferentia, den første spesialbygde brikken for inferens. Hvert år hjelper Inferentia Amazon med å kjøre billioner av slutninger og har spart selskaper som Amazon for over hundre millioner dollar i kapitalutgifter allerede. Resultatene er imponerende, og vi ser mange muligheter til å fortsette å innovere ettersom arbeidsmengdene bare vil øke i størrelse og kompleksitet ettersom flere kunder integrerer generativ AI i applikasjonene sine.

Det er derfor vi kunngjør i dag generell tilgjengelighet av Inf2 forekomster drevet av AWS Inferentia2, som er optimalisert spesifikt for generative AI-applikasjoner i stor skala med modeller som inneholder hundrevis av milliarder av parametere. Inf2-forekomster leverer opptil 4 ganger høyere gjennomstrømning og opptil 10 ganger lavere ventetid sammenlignet med tidligere generasjons Inferentia-baserte forekomster. De har også ultra-høyhastighets tilkobling mellom akseleratorer for å støtte distribuert inferens i stor skala. Disse egenskapene gir opptil 40 % bedre slutningsprisytelse enn andre sammenlignbare Amazon EC2-forekomster og den laveste kostnaden for slutning i skyen. Kunder som Runway ser opptil 2 ganger høyere gjennomstrømning med Inf2 enn sammenlignbare Amazon EC2-forekomster for noen av modellene deres. Denne høyytelses- og rimelige slutningen vil gjøre det mulig for Runway å introdusere flere funksjoner, distribuere mer komplekse modeller og til slutt levere en bedre opplevelse for de millioner av skapere som bruker Runway.

Kunngjør den generelle tilgjengeligheten av Amazon CodeWhisperer, gratis for individuelle utviklere

Vi vet at det å bygge med de riktige FM-ene og kjøre Generative AI-applikasjoner i stor skala på den mest effektive skyinfrastrukturen vil være transformativt for kundene. Den nye bølgen av opplevelser vil også være transformerende for brukerne. Med generativ AI innebygd, vil brukere kunne ha mer naturlig og sømløs interaksjon med applikasjoner og systemer. Tenk på hvordan vi kan låse opp mobiltelefonene våre bare ved å se på dem, uten å måtte vite noe om de kraftige ML-modellene som gjør denne funksjonen mulig.

Et område der vi ser for oss at bruken av generativ AI vokser raskt, er i koding. Programvareutviklere bruker i dag en betydelig del av tiden sin på å skrive kode som er ganske enkel og udifferensiert. De bruker også mye tid på å holde tritt med et komplekst og stadig skiftende verktøy- og teknologilandskap. Alt dette gir utviklere mindre tid til å utvikle nye, innovative funksjoner og tjenester. Utviklere prøver å overvinne dette ved å kopiere og endre kodebiter fra nettet, noe som kan resultere i utilsiktet kopiering av kode som ikke fungerer, inneholder sikkerhetssårbarheter eller som ikke sporer bruk av åpen kildekode-programvare. Og til syvende og sist tar søk og kopiering fortsatt tid fra de gode tingene.

Generativ AI kan ta dette tunge løftet ut av ligningen ved å "skrive" mye av den udifferensierte koden, slik at utviklere kan bygge raskere samtidig som de frigjør dem til å fokusere på de mer kreative aspektene ved koding. Dette er grunnen til at vi i fjor annonserte forhåndsvisningen av Amazon Code Whisperer, en AI-kodefølge som bruker en FM under panseret for å radikalt forbedre utviklerens produktivitet ved å generere kodeforslag i sanntid basert på utvikleres kommentarer på naturlig språk og tidligere kode i deres Integrated Development Environment (IDE). Utviklere kan ganske enkelt be CodeWhisperer gjøre en oppgave, for eksempel "analysere en CSV-streng med sanger" og be den om å returnere en strukturert liste basert på verdier som artist, tittel og høyeste kartrangering. CodeWhisperer gir et produktivitetsløft ved å generere en hel funksjon som analyserer strengen og returnerer listen som spesifisert. Utviklerresponsen på forhåndsvisningen har vært overveldende positiv, og vi fortsetter å tro at det å hjelpe utviklere med kode kan ende opp med å bli en av de kraftigste bruksområdene for generativ AI vi vil se i årene som kommer. Under forhåndsvisningen kjørte vi en produktivitetsutfordring, og deltakere som brukte CodeWhisperer fullførte oppgaver 57 % raskere, i gjennomsnitt, og hadde 27 % større sannsynlighet for å fullføre dem vellykket enn de som ikke brukte CodeWhisperer. Dette er et stort sprang fremover i utviklerproduktivitet, og vi tror dette bare er begynnelsen.

I dag er vi glade for å kunngjøre generell tilgjengelighet av Amazon CodeWhisperer for Python, Java, JavaScript, TypeScript og C# – pluss ti nye språk, inkludert Go, Kotlin, Rust, PHP og SQL. CodeWhisperer kan nås fra IDEer som VS Code, IntelliJ IDEA, AWS Cloud9 og mange flere via AWS Toolkit IDE-utvidelsene. CodeWhisperer er også tilgjengelig i AWS Lambda-konsollen. I tillegg til å lære av milliarder av linjer med offentlig tilgjengelig kode, har CodeWhisperer blitt trent på Amazon-kode. Vi tror CodeWhisperer nå er den mest nøyaktige, raskeste og sikreste måten å generere kode for AWS-tjenester, inkludert Amazon EC2, AWS Lambda og Amazon S3.

Utviklere kommer ikke til å bli mer produktive hvis koden foreslått av deres generative AI-verktøy inneholder skjulte sikkerhetssårbarheter eller ikke klarer å håndtere åpen kildekode på en ansvarlig måte. CodeWhisperer er den eneste AI-kodingskompanjonen med innebygd sikkerhetsskanning (drevet av automatisert resonnement) for å finne og foreslå utbedring for vanskelige å oppdage sårbarheter, for eksempel de i topp ti Open Worldwide Application Security Project (OWASP), de som ikke oppfyller kryptobibliotekets beste praksis og andre. For å hjelpe utviklere med å kode ansvarlig, filtrerer CodeWhisperer ut kodeforslag som kan anses som partiske eller urettferdige, og CodeWhisperer er den eneste kodefølgen som kan filtrere og flagge kodeforslag som ligner åpen kildekode som kunder kanskje vil referere til eller lisensiere for bruk.

Vi vet at generativ AI kommer til å endre spillet for utviklere, og vi vil at det skal være nyttig for så mange som mulig. Dette er grunnen til at CodeWhisperer er gratis for alle individuelle brukere uten kvalifikasjoner eller tidsbegrensninger for å generere kode! Alle kan registrere seg for CodeWhisperer med bare en e-postkonto og bli mer produktive i løpet av minutter. Du trenger ikke engang å ha en AWS-konto. For bedriftsbrukere tilbyr vi et CodeWhisperer Professional Tier som inkluderer administrasjonsfunksjoner som enkel pålogging (SSO) med AWS Identity and Access Management (IAM) integrasjon, samt høyere grenser for sikkerhetsskanning.

Å bygge kraftige applikasjoner som CodeWhisperer er transformerende for utviklere og alle våre kunder. Vi har mye mer på gang, og vi er spente på hva du vil bygge med generativ AI på AWS. Vårt oppdrag er å gjøre det mulig for utviklere på alle ferdighetsnivåer og for organisasjoner av alle størrelser å innovere ved hjelp av generativ AI. Dette er bare begynnelsen på det vi tror vil være den neste bølgen av ML som gir deg nye muligheter.

Ressurser

Sjekk ut følgende ressurser for å lære mer om generativ AI på AWS og disse kunngjøringene:

Om forfatteren

Swami Sivasubramanian er visepresident for data og maskinlæring i AWS. I denne rollen fører Swami tilsyn med alle AWS-databaser, analysetjenester og AI- og maskinlæringstjenester. Teamets oppgave er å hjelpe organisasjoner med å sette dataene sine i arbeid med en komplett, ende-til-ende dataløsning for å lagre, få tilgang til, analysere og visualisere og forutsi.

Swami Sivasubramanian er visepresident for data og maskinlæring i AWS. I denne rollen fører Swami tilsyn med alle AWS-databaser, analysetjenester og AI- og maskinlæringstjenester. Teamets oppgave er å hjelpe organisasjoner med å sette dataene sine i arbeid med en komplett, ende-til-ende dataløsning for å lagre, få tilgang til, analysere og visualisere og forutsi.

- SEO-drevet innhold og PR-distribusjon. Bli forsterket i dag.

- Platoblokkkjede. Web3 Metaverse Intelligence. Kunnskap forsterket. Tilgang her.

- kilde: https://aws.amazon.com/blogs/machine-learning/announcing-new-tools-for-building-with-generative-ai-on-aws/

- :er

- $OPP

- 000

- 000 kunder

- 1

- 100

- 20 år

- 2018

- 2019

- 7

- a

- evne

- I stand

- Om oss

- akselerere

- akseleratorer

- Accenture

- adgang

- aksesseres

- tilgjengelig

- Logg inn

- kontoer

- nøyaktig

- tvers

- aktivitet

- Ad

- tillegg

- administrasjon

- Adopsjon

- forfremmelse

- fremskritt

- Fordel

- byråer

- AI

- AI og maskinlæring

- AIR

- Alexa

- Alle

- tillate

- allerede

- utrolig

- Amazon

- Amazon Code Whisperer

- Amazon EC2

- Amazon SageMaker

- blant

- beløp

- beløp

- analytics

- analysere

- analyserer

- og

- Kunngjøre

- annonsert

- Kunngjøringer

- Kunngjøring

- noen

- api

- Søknad

- applikasjonssikkerhet

- søknader

- Påfør

- tilnærming

- apps

- arkitektur

- ER

- AREA

- rundt

- Kunst

- artist

- AS

- aspekter

- assosiert

- At

- oppmerksomhet

- Automatisert

- automatisk

- tilgjengelighet

- tilgjengelig

- gjennomsnittlig

- AWS

- AWS Cloud9

- AWS-kunde

- AWS Identity and Access Management (IAM)

- AWS slutning

- AWS Lambda

- Båndbredde

- Banking

- basen

- basert

- BE

- fordi

- bli

- før du

- begynne

- Begynnelsen

- være

- tro

- BEST

- beste praksis

- Bedre

- mellom

- Beyond

- Stor

- milliarder

- Blogg

- Blogginnlegg

- Bloom

- BMW

- øke

- bringe

- bred

- bredt

- bygge

- utbyggere

- Bygning

- bygget

- innebygd

- virksomhet

- bedrifter

- by

- ring

- Kampanje

- Kampanjer

- CAN

- evner

- stand

- Kapasitet

- hovedstad

- Catch

- Sentre

- konsernsjef

- kjede

- utfordre

- endring

- egenskaper

- Figur

- ChatGPT

- sjekk

- chip

- chips

- Velg

- velge

- Sirkulasjon

- klassifisering

- Cloud

- sky infrastruktur

- Cloud9

- Med-grunnlegger

- kode

- Koding

- Kom

- kommer

- kommentarer

- forpliktet

- vanligvis

- Selskaper

- Selskapets

- sammenlign

- sammenlignet

- sammenligne

- fullføre

- Terminado

- helt

- komplekse

- kompleksitet

- Beregn

- datamaskin

- Datamaskin syn

- konsepter

- tilkoblet

- Tilkobling

- ansett

- Konsoll

- stadig

- forbruker

- Forbrukere

- inneholde

- inneholder

- innhold

- Content Marketing

- sammenhenger

- kontekstuelle

- fortsette

- fortsatte

- kontroll

- conversational

- samtaler

- kopiering

- Kostnad

- kostnadseffektiv

- Kostnader

- kunne

- skape

- Opprette

- Kreativ

- skaperne

- krypto

- Gjeldende

- kunde

- kundeopplevelse

- Kunder

- tilpasning

- tilpasse

- tilpasset

- skjærekant

- daglig

- dato

- Database

- Dager

- tiår

- dyp

- dyp læring

- dypeste

- leverer

- deloitte

- krevende

- Demokratisering

- utplassere

- utplassert

- designet

- design

- utvikle

- utviklet

- Utvikler

- utviklere

- Utvikling

- Dialog

- forskjellig

- differensiert

- kringkasting

- Vise

- distribuere

- distribueres

- Mangfold

- dokument

- ikke

- gjør

- dollar

- domener

- ikke

- stasjonen

- drevet

- Droner

- under

- Dutch

- e-handel

- hver enkelt

- Tidlig

- enkleste

- lett

- Effektiv

- emalje

- muliggjøre

- kryptert

- ende til ende

- engasjerende

- Motor

- Ingeniører

- nok

- bedrifter

- Entertainment

- Hele

- Miljø

- Ethos

- Selv

- stadig skiftende

- Hver

- evolusjon

- eksempel

- eksempler

- opphisset

- spennende

- forvente

- erfaring

- Erfaringer

- Eksponering

- utvide

- utvidelser

- omfattende

- stoff

- Face

- mislykkes

- kjent

- familie

- Mote

- FAST

- raskt bevegelige

- raskere

- raskeste

- Trekk

- Egenskaper

- tilbakemelding

- Ferrari

- Noen få

- filtrere

- filtre

- Endelig

- finansiell

- Finn

- finne

- Firm

- Først

- Fokus

- følge

- etter

- Til

- Formelt

- skjemaer

- Forward

- Fundament

- brøkdel

- Gratis

- Fransk

- fersk

- fra

- funksjon

- funksjoner

- framtid

- spill

- general

- generell

- generelt

- generere

- genererer

- generasjonen

- generative

- Generativ AI

- Tysk

- få

- giganten

- Gi

- Go

- Går

- skal

- god

- Regjeringen

- flott

- Økende

- håndfull

- håndtere

- skje

- lykkelig

- skadelig

- Ha

- å ha

- helsetjenester

- tung

- tung løfting

- hjelpe

- hjelpe

- hjelper

- arv

- skjult

- høy ytelse

- høytytende

- høykvalitets

- høyere

- høyest

- Hjem

- panser

- Hvordan

- Men

- HTTPS

- stort

- Hundrevis

- Tanken

- Ideer

- Identitet

- bilde

- Bildegjenkjenning

- bilder

- fantasi

- viktig

- imponerende

- forbedre

- in

- inkludere

- inkluderer

- Inkludert

- innlemme

- Øke

- utrolig

- uavhengig

- individuelt

- bransjer

- Bøyepunkt

- informasjon

- informasjonsutvinning

- informert

- Infosys

- Infrastruktur

- i utgangspunktet

- innovere

- nyskapende

- Innovasjon

- innovasjoner

- innovative

- inngang

- f.eks

- instruksjoner

- integrere

- integrert

- integrering

- integrasjoner

- Intelligent

- interaksjoner

- intern

- introdusere

- Intuit

- Oppfinnelse

- investert

- investere

- IP

- IT

- varer

- DET ER

- Java

- Javascript

- Hold

- nøkkel

- Type

- Vet

- kunnskap

- kjent

- Labs

- landskap

- Språk

- språk

- stor

- storskala

- største

- Siste

- I fjor

- Ventetid

- lansert

- lag

- ledende

- Hoppe

- LÆRE

- læring

- Permisjon

- Led

- Lar

- nivåer

- Leverage

- Bibliotek

- Tillatelse

- løfte

- i likhet med

- Sannsynlig

- Begrenset

- grenser

- linje

- linjer

- Liste

- lite

- LLM

- ligger

- ser

- Lot

- lave kostnader

- senking

- maskin

- maskinlæring

- gjøre

- GJØR AT

- Making

- administrer

- fikk til

- ledelse

- leder

- mange

- Marketing

- massive

- matchende

- math

- Maksimer

- Kan..

- betyr

- Media

- Møt

- kunne

- millioner

- millioner dollar

- millioner

- minutt

- minutter

- Oppdrag

- oppdrag

- ML

- Mobil

- mobiltelefoner

- modell

- modeller

- penger

- måneder

- mer

- mest

- Mest populær

- flere

- musikk

- Naturlig

- Natur

- Trenger

- trenger

- behov

- nettverk

- nettverk

- nevrale nettverket

- Ny

- New York

- New York Times

- neste

- Antall

- of

- tilby

- tilby

- tilbud

- on

- ONE

- åpen

- åpen kildekode

- Muligheter

- optimal

- Optimalisere

- optimalisert

- organisasjoner

- Annen

- andre

- enestående

- Overcome

- egen

- paradigmet

- parametere

- del

- deltakere

- Spesielt

- partnere

- Past

- mønstre

- Utfør

- ytelse

- utfører

- Tilpassing

- telefoner

- PHP

- setninger

- fysisk

- planlegging

- plato

- Platon Data Intelligence

- PlatonData

- spilt

- Point

- Populær

- portefølje

- Portugisisk

- positiv

- muligheter

- mulig

- Post

- innlegg

- potensiell

- potensielt

- makt

- powered

- kraftig

- Slå

- Praktisk

- praksis

- forutsi

- Spådommer

- president

- pen

- Forhåndsvisning

- pris

- Prime

- Før

- prioritert

- privatliv

- privat

- problemer

- prosess

- prosessering

- produsere

- Produkt

- Produksjon

- produktiv

- produktivitet

- Produkter

- Banning

- profesjonell

- prosjekt

- proprietær

- beskytte

- beskyttet

- gi

- gir

- offentlig

- formål

- Skyv

- sette

- Python

- Q & A

- kvalifikasjoner

- kvalitet

- spørsmål

- raskt

- radikalt

- område

- rask

- raskt

- Lese

- klar

- sanntids

- realistisk

- realisere

- riket

- nylig

- nylig

- anerkjennelse

- anbefalinger

- redusere

- referert

- relevant

- pålitelighet

- pålitelig

- forbli

- fjerne

- rapporterer

- Rapporter

- forespørsler

- påkrevd

- Krever

- forskning

- Ressurser

- svar

- ansvarlig

- resultere

- resulterende

- Resultater

- detaljhandel

- forhandler

- retur

- avkastning

- Reuters

- Rise

- Rolle

- ruter

- Kjør

- rennende

- rullebane

- Rust

- sagemaker

- samme

- Besparelser

- sier

- skalerbarhet

- skalerbar

- Skala

- skanning

- sømløs

- Søk

- søker

- Sekund

- sikre

- sikkerhet

- frø

- se

- utvalg

- forstand

- sentiment

- server~~POS=TRUNC

- Servere

- tjeneste

- Tjenester

- sett

- flere

- delt

- Hylle

- skift

- Shop

- bør

- undertegne

- signifikant

- Silicon

- lignende

- Enkelt

- ganske enkelt

- siden

- enkelt

- Størrelse

- størrelser

- ferdighet

- liten

- Smart

- So

- selskap

- sosiale medier

- Software

- Programvareutviklere

- løsning

- løse

- noen

- kilde

- kildekoden

- span

- Spansk

- spesifikk

- spesielt

- spesifisert

- tale

- bruke

- brukt

- kvadrat

- Stabilitet

- stabil

- stable

- Begynn

- startet

- Start

- startups

- opphold

- Trinn

- Still

- oppbevare

- Stories

- rett fram

- styrker

- String

- strukturert

- Studerer

- stil

- vellykket

- slik

- suite

- levere

- forsyningskjeden

- støtte

- Støtte

- Systemer

- Ta

- tar

- målrettet

- Oppgave

- oppgaver

- lag

- lag

- tech

- tech selskaper

- Technologies

- Teknologi

- ti

- test

- Det

- De

- Fremtiden

- The New York Times

- verden

- deres

- Dem

- seg

- Disse

- ting

- Thomson Reuters

- tusener

- tre

- Gjennom

- gjennomstrømning

- nivået

- tid

- ganger

- titan

- Tittel

- til

- i dag

- dagens

- i morgen

- verktøy

- verktøykasse

- verktøy

- topp

- Topp ti

- spor

- tradisjonelle

- Tog

- trent

- Kurs

- Transaksjoner

- Transform

- transformative

- transformere

- reiser

- Trender

- billioner

- Stol

- Loggfila

- typisk

- Uber

- Til syvende og sist

- etter

- underliggende

- unik

- lomper

- låse opp

- kommende

- us

- bruk

- bruke

- Bruker

- Brukere

- Verdifull

- Verdier

- variasjon

- ulike

- enorme

- leverandører

- av

- Vice President

- videoer

- vold

- virtuelle

- syn

- Voice

- volumer

- vs

- vs kode

- Sikkerhetsproblemer

- Wave

- Vei..

- web

- uke

- uker

- VI VIL

- Hva

- Hva er

- hvilken

- mens

- HVEM

- bred

- Bred rekkevidde

- utbredt

- vil

- med

- innenfor

- uten

- ord

- ord

- Arbeid

- arbeid

- virker

- verden

- verdensomspennende

- ville

- skriving

- år

- år

- Du

- zephyrnet