Generativ AI applikasjoner drevet av grunnleggende modeller (FM-er) gjør det mulig for organisasjoner med betydelig forretningsverdi innen kundeopplevelse, produktivitet, prosessoptimalisering og innovasjoner. Adopsjon av disse FM-ene innebærer imidlertid å ta tak i noen viktige utfordringer, inkludert kvalitetsutdata, datapersonvern, sikkerhet, integrasjon med organisasjonsdata, kostnader og ferdigheter å levere.

I dette innlegget utforsker vi ulike tilnærminger du kan ta når du bygger applikasjoner som bruker generativ AI. Med den raske utviklingen av FM-er er det en spennende tid å utnytte kraften deres, men også avgjørende for å forstå hvordan man bruker dem riktig for å oppnå forretningsresultater. Vi gir en oversikt over viktige generative AI-tilnærminger, inkludert prompt engineering, Retrieval Augmented Generation (RAG) og modelltilpasning. Når vi bruker disse tilnærmingene, diskuterer vi viktige hensyn rundt potensielle hallusinasjoner, integrasjon med bedriftsdata, utdatakvalitet og kostnader. På slutten vil du ha solide retningslinjer og et nyttig flytskjema for å bestemme den beste metoden for å utvikle dine egne FM-drevne applikasjoner, basert på virkelige eksempler. Enten du lager en chatbot eller oppsummeringsverktøy, kan du forme kraftige FM-er som passer dine behov.

Generativ AI med AWS

Fremveksten av FM-er skaper både muligheter og utfordringer for organisasjoner som ønsker å bruke disse teknologiene. En nøkkelutfordring er å sikre sammenhengende resultater av høy kvalitet som er i tråd med forretningsbehov, i stedet for hallusinasjoner eller falsk informasjon. Organisasjoner må også nøye håndtere datavern og sikkerhetsrisikoer som oppstår ved å behandle proprietære data med FM-er. Ferdighetene som trengs for å integrere, tilpasse og validere FM-er i eksisterende systemer og data er mangelvare. Å bygge store språkmodeller (LLM) fra bunnen av eller tilpasse forhåndstrente modeller krever betydelige dataressurser, ekspertdataforskere og måneder med ingeniørarbeid. Beregningskostnaden alene kan lett løpe inn i millioner av dollar for å trene modeller med hundrevis av milliarder av parametere på massive datasett ved å bruke tusenvis av GPUer eller TPUer. Utover maskinvare, datarensing og prosessering, modellarkitekturdesign, hyperparameterinnstilling og utvikling av treningspipeline krever spesialiserte maskinlæringsferdigheter (ML). End-to-end-prosessen er kompleks, tidkrevende og uoverkommelig dyr for de fleste organisasjoner uten den nødvendige infrastrukturen og talentinvesteringene. Organisasjoner som ikke klarer å takle disse risikoene på en tilfredsstillende måte, kan få negative konsekvenser for deres merkevareomdømme, kundetillit, drift og inntekter.

Amazonas grunnfjell er en fullstendig administrert tjeneste som tilbyr et utvalg av høyytende grunnmodeller (FM-er) fra ledende AI-selskaper som AI21 Labs, Anthropic, Cohere, Meta, Mistral AI, Stability AI og Amazon via et enkelt API. Med Amazon Bedrock serverløse opplevelse kan du komme raskt i gang, personlig tilpasse FM-er med dine egne data, og integrere og distribuere dem i applikasjonene dine ved hjelp av AWS-verktøy uten å måtte administrere noen infrastruktur. Amazon Bedrock er HIPAA-kvalifisert, og du kan bruke Amazon Bedrock i samsvar med GDPR. Med Amazon Bedrock brukes ikke innholdet ditt til å forbedre basismodellene og deles ikke med tredjeparts modellleverandører. Dataene dine i Amazon Bedrock er alltid kryptert under overføring og hvile, og du kan valgfritt kryptere ressurser ved å bruke dine egne nøkler. Du kan bruke AWS PrivateLink med Amazon Bedrock for å etablere privat tilkobling mellom FM-ene og VPC-en din uten å eksponere trafikken din for internett. Med Kunnskapsbaser for Amazon Bedrock, kan du gi FM-er og agenter kontekstuell informasjon fra bedriftens private datakilder slik at RAG kan levere mer relevante, nøyaktige og tilpassede svar. Du kan personlig tilpasse FM-er med dine egne data gjennom et visuelt grensesnitt uten å skrive noen kode. Som en fullt administrert tjeneste tilbyr Amazon Bedrock en enkel utvikleropplevelse for å jobbe med et bredt spekter av høyytende FM-er.

Lansert i 2017, Amazon SageMaker er en fullstendig administrert tjeneste som gjør det enkelt å bygge, trene og distribuere ML-modeller. Flere og flere kunder bygger sine egne FM-er ved hjelp av SageMaker, inkludert Stability AI, AI21 Labs, Hugging Face, Perplexity AI, Hippocratic AI, LG AI Research og Technology Innovation Institute. For å hjelpe deg med å komme raskt i gang, Amazon SageMaker JumpStart tilbyr en ML-hub hvor du kan utforske, trene og distribuere et bredt utvalg av offentlige FM-er, for eksempel Mistral-modeller, LightOn-modeller, RedPajama, Mosiac MPT-7B, FLAN-T5/UL2, GPT-J-6B/Neox-20B , og Bloom/BloomZ, ved hjelp av spesialbygde SageMaker-verktøy som eksperimenter og rørledninger.

Vanlige generative AI-tilnærminger

I denne delen diskuterer vi vanlige tilnærminger for å implementere effektive generative AI-løsninger. Vi utforsker populære prompte ingeniørteknikker som lar deg oppnå mer komplekse og interessante oppgaver med FM-er. Vi diskuterer også hvordan teknikker som RAG og modelltilpasning ytterligere kan forbedre FMs evner og overvinne utfordringer som begrensede data og beregningsmessige begrensninger. Med riktig teknikk kan du bygge kraftige og effektive generative AI-løsninger.

Rask prosjektering

Rask engineering er praksisen med å nøye utforme ledetekster for å effektivt utnytte mulighetene til FM-er. Det innebærer bruk av spørsmål, som er korte tekststykker som veileder modellen til å generere mer nøyaktige og relevante svar. Med rask utvikling kan du forbedre ytelsen til FM-er og gjøre dem mer effektive for en rekke bruksområder. I denne delen utforsker vi teknikker som null-skudd og få-skudd-spørring, som raskt tilpasser FM-er til nye oppgaver med bare noen få eksempler, og tankekjede, som bryter ned komplekse resonnementer i mellomtrinn. Disse metodene viser hvordan rask ingeniørarbeid kan gjøre FM-er mer effektive på komplekse oppgaver uten å kreve omskolering av modellen.

Zero-shot-melding

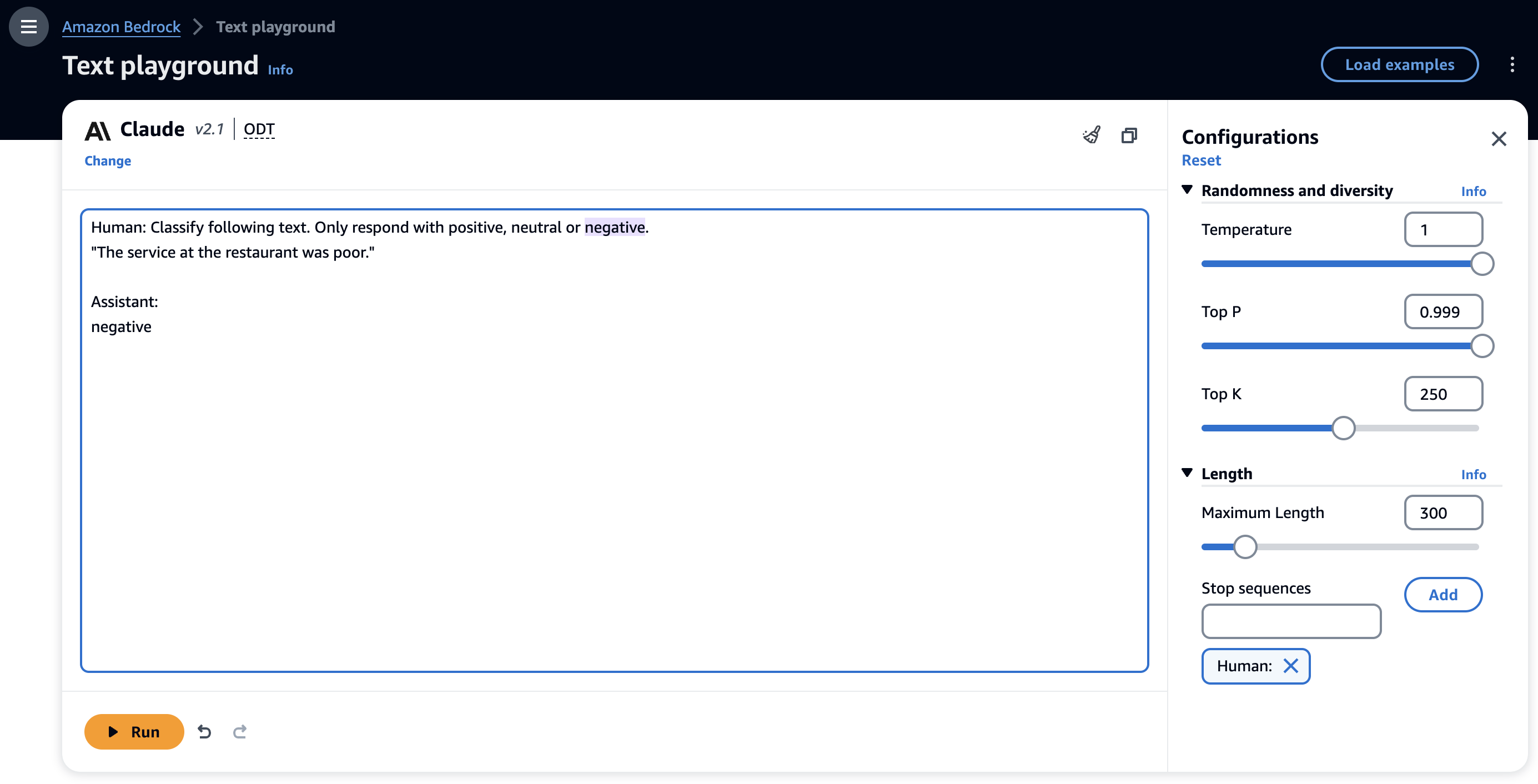

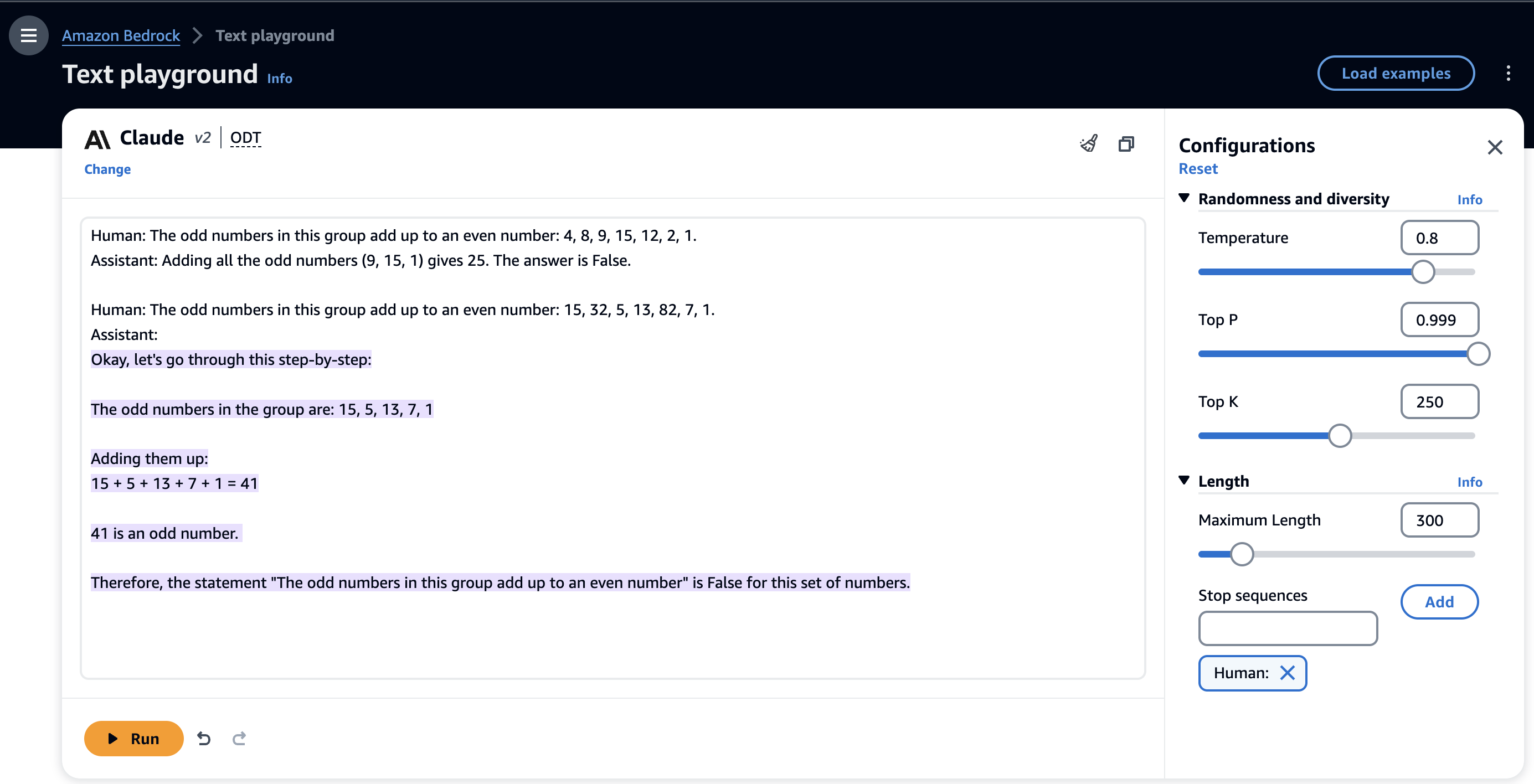

En zero-shot prompt-teknikk krever at FM-er genererer et svar uten å gi noen eksplisitte eksempler på ønsket oppførsel, kun avhengig av forhåndstrening. Følgende skjermbilde viser et eksempel på en null-shot-prompt med Anthropic Claude 2.1-modellen på Amazon Bedrock-konsollen.

I disse instruksjonene ga vi ingen eksempler. Imidlertid kan modellen forstå oppgaven og generere passende resultater. Zero-shot prompter er den enkleste promptteknikken til å begynne med når du vurderer en FM for ditt bruk. Men selv om FM-er er bemerkelsesverdige med null-shot-meldinger, kan det ikke alltid gi nøyaktige eller ønskede resultater for mer komplekse oppgaver. Når null-skudd-meldinger kommer til kort, anbefales det å gi noen eksempler i ledeteksten (få-shot-meldinger).

Spørre om få skudd

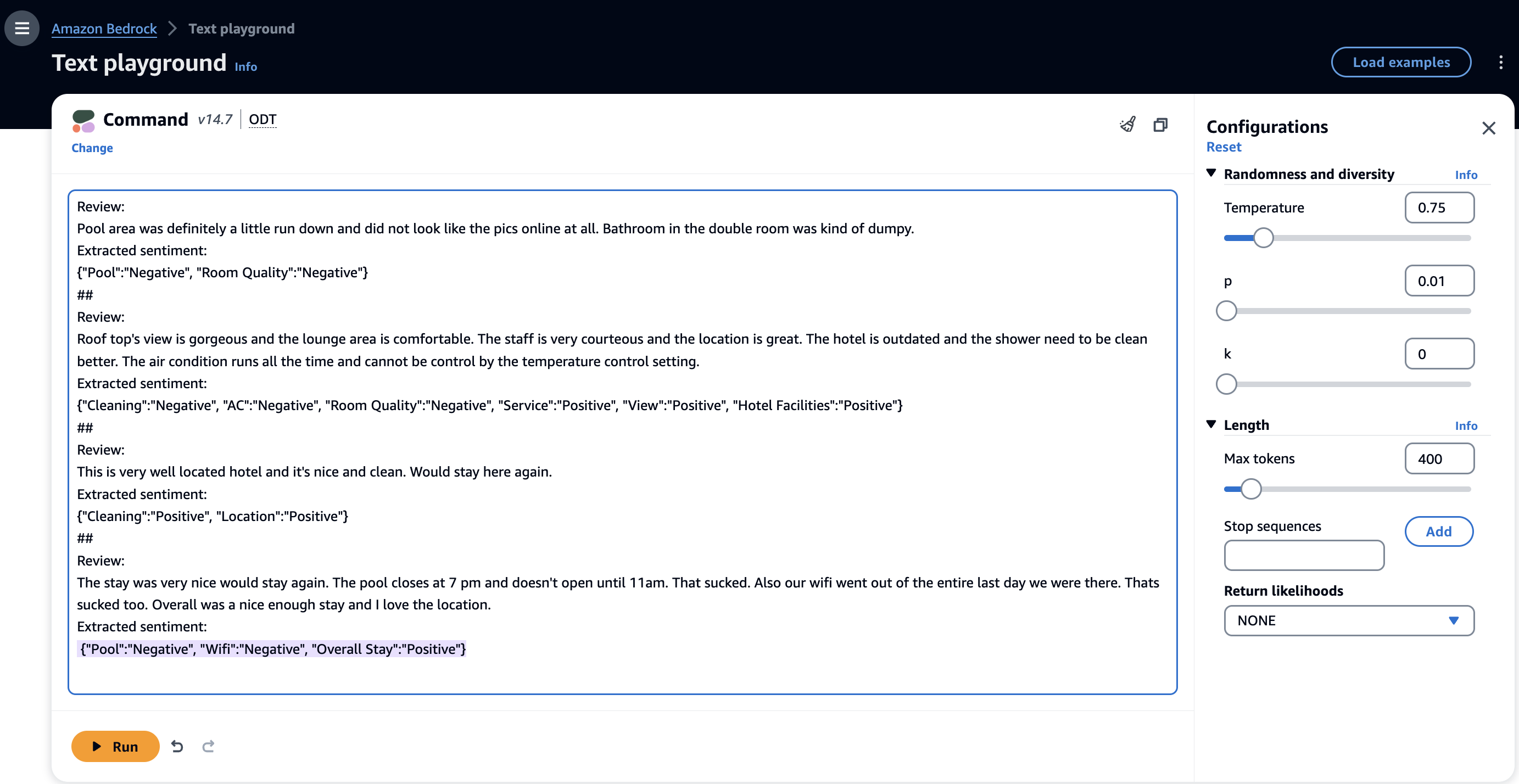

Promptteknikken med få skudd lar FM-er lære i kontekst fra eksemplene i ledetekstene og utføre oppgaven mer nøyaktig. Med bare noen få eksempler kan du raskt tilpasse FM-er til nye oppgaver uten store treningssett og veilede dem mot ønsket atferd. Følgende er et eksempel på en forespørsel med få skudd med Cohere Command-modellen på Amazon Bedrock-konsollen.

I det foregående eksemplet var FM i stand til å identifisere enheter fra inndatateksten (anmeldelser) og trekke ut de tilknyttede følelsene. Few-shot prompter er en effektiv måte å takle komplekse oppgaver ved å gi noen få eksempler på input-out-par. For enkle oppgaver kan du gi ett eksempel (1-skudd), mens for vanskeligere oppgaver bør du gi tre (3-skudd) til fem (5-skudd) eksempler. Min et al. (2022) publiserte funn om læring i kontekst som kan forbedre ytelsen til teknikken med få skudd. Du kan bruke spørsmål med få skudd for en rekke oppgaver, for eksempel sentimentanalyse, enhetsgjenkjenning, svar på spørsmål, oversettelse og kodegenerering.

Tankekjede

Til tross for dets potensiale, har få-skuddspørring begrensninger, spesielt når man arbeider med komplekse resonneringsoppgaver (som aritmetiske eller logiske oppgaver). Disse oppgavene krever å dele problemet ned i trinn og deretter løse det. Wei et al. (2022) introduserte chain-of-thought (CoT) prompteteknikk for å løse komplekse resonnementproblemer gjennom mellomliggende resonnementtrinn. Du kan kombinere CoT med få skuddspørringer for å forbedre resultatene på komplekse oppgaver. Følgende er et eksempel på en resonneringsoppgave som bruker få-skudd CoT-spørring med Anthropic Claude 2-modellen på Amazon Bedrock-konsollen.

Kojima et al. (2022) introduserte en idé om zero-shot CoT ved å bruke FMs uutnyttede zero-shot-evner. Forskningen deres indikerer at zero-shot CoT, ved å bruke den samme enkelt-prompt-malen, overgår zero-shot FM-prestasjoner på forskjellige referanseoppgaver. Du kan bruke Zero-shot CoT-spørring for enkle resonneringsoppgaver ved å legge til "La oss tenke steg for steg" til den opprinnelige ledeteksten.

Reagere

CoT-spørring kan forbedre FMs resonneringsevne, men det avhenger fortsatt av modellens interne kunnskap og vurderer ikke noen ekstern kunnskapsbase eller miljø for å samle mer informasjon, noe som kan føre til problemer som hallusinasjoner. ReAct-tilnærmingen (reasoning and acting) adresserer dette gapet ved å utvide CoT og tillate dynamisk resonnement ved å bruke et eksternt miljø (som Wikipedia).

Integrasjon

FM-er har evnen til å forstå spørsmål og gi svar ved å bruke sin ferdigtrente kunnskap. Imidlertid mangler de kapasitet til å svare på spørsmål som krever tilgang til en organisasjons private data eller evnen til å utføre oppgaver selvstendig. RAG og agenter er metoder for å koble disse generative AI-drevne applikasjonene til bedriftsdatasett, slik at de kan gi svar som tar hensyn til organisasjonsinformasjon og muliggjør kjørende handlinger basert på forespørsler.

Retrieval Augmented Generation

Retrieval Augmented Generation (RAG) lar deg tilpasse en modells svar når du vil at modellen skal vurdere ny kunnskap eller oppdatert informasjon. Når dataene dine endres ofte, som beholdning eller priser, er det ikke praktisk å finjustere og oppdatere modellen mens den leverer brukerforespørsler. For å utstyre FM med oppdatert proprietær informasjon, henvender organisasjoner seg til RAG, en teknikk som innebærer å hente data fra selskapets datakilder og berike spørsmålet med disse dataene for å levere mer relevante og nøyaktige svar.

Det er flere brukstilfeller der RAG kan bidra til å forbedre FM-ytelsen:

- Svar på spørsmål – RAG-modeller hjelper spørsmålsbesvarende applikasjoner med å finne og integrere informasjon fra dokumenter eller kunnskapskilder for å generere svar av høy kvalitet. For eksempel kan en applikasjon for å besvare spørsmål hente passasjer om et emne før den genererer et oppsummerende svar.

- Chatboter og samtaleagenter – RAG lar chatbots få tilgang til relevant informasjon fra store eksterne kunnskapskilder. Dette gjør chatbotens svar mer kunnskapsrike og naturlige.

- Skrivehjelp – RAG kan foreslå relevant innhold, fakta og samtalepunkter for å hjelpe deg med å skrive dokumenter som artikler, rapporter og e-poster mer effektivt. Den hentede informasjonen gir nyttig kontekst og ideer.

- samandrag – RAG kan finne relevante kildedokumenter, passasjer eller fakta for å øke en oppsummeringsmodells forståelse av et emne, slik at den kan generere bedre sammendrag.

- Kreativ skriving og historiefortelling – RAG kan trekke plotideer, karakterer, innstillinger og kreative elementer fra eksisterende historier for å inspirere AI-historiegenereringsmodeller. Dette gjør utgangen mer interessant og jordet.

- Oversettelse – RAG kan finne eksempler på hvordan enkelte fraser oversettes mellom språk. Dette gir kontekst til oversettelsesmodellen, og forbedrer oversettelse av tvetydige fraser.

- Tilpassing – I chatbots og anbefalingsapplikasjoner kan RAG trekke personlig kontekst som tidligere samtaler, profilinformasjon og preferanser for å gjøre svar mer personlig og relevant.

Det er flere fordeler ved å bruke et RAG-rammeverk:

- Reduserte hallusinasjoner – Å hente relevant informasjon bidrar til å forankre den genererte teksten i fakta og kunnskap fra den virkelige verden, i stedet for hallusinerende tekst. Dette fremmer mer nøyaktige, saklige og pålitelige svar.

- Dekning – Henting lar en FM dekke et bredere spekter av emner og scenarier utover treningsdataene ved å trekke inn ekstern informasjon. Dette bidrar til å løse problemer med begrenset dekning.

- Effektivitet – Henting lar modellen fokusere generasjonen på den mest relevante informasjonen, i stedet for å generere alt fra bunnen av. Dette forbedrer effektiviteten og gjør at større sammenhenger kan brukes.

- Sikkerhet – Å hente informasjonen fra nødvendige og tillatte datakilder kan forbedre styring og kontroll over generering av skadelig og unøyaktig innhold. Dette støtter sikrere adopsjon.

- skalerbarhet – Indeksering og henting fra store korpus tillater tilnærmingen til å skalere bedre sammenlignet med å bruke hele korpus under generering. Dette lar deg ta i bruk FM-er i mer ressursbegrensede miljøer.

RAG produserer kvalitetsresultater på grunn av utvidet bruks-tilfellespesifikk kontekst direkte fra vektoriserte datalagre. Sammenlignet med rask konstruksjon, gir den enormt forbedrede resultater med enormt lave sjanser for hallusinasjoner. Du kan bygge RAG-drevne applikasjoner på bedriftsdataene dine ved å bruke Amazon Kendra. RAG har høyere kompleksitet enn prompt engineering fordi du må ha koding og arkitektur ferdigheter for å implementere denne løsningen. Kunnskapsbaser for Amazon Bedrock gir imidlertid en fullstendig administrert RAG-opplevelse og den mest enkle måten å komme i gang med RAG i Amazon Bedrock. Kunnskapsbaser for Amazon Bedrock automatiserer ende-til-ende RAG-arbeidsflyten, inkludert inntak, henting og rask utvidelse, og eliminerer behovet for deg å skrive tilpasset kode for å integrere datakilder og administrere spørringer. Kontekstadministrasjon for økter er innebygd slik at appen din kan støtte samtaler med flere svinger. Kunnskapsbasesvar kommer med kildehenvisninger for å forbedre åpenheten og minimere hallusinasjoner. Den enkleste måten å bygge en generativ AI-drevet assistent på er å bruke Amazon Q, som har innebygget RAG-system.

RAG har høyest grad av fleksibilitet når det gjelder endringer i arkitekturen. Du kan endre innebyggingsmodellen, vektorlageret og FM uavhengig med minimal til moderat innvirkning på andre komponenter. For å lære mer om RAG-tilnærmingen med Amazon OpenSearch-tjeneste og Amazon Bedrock, referer til Bygg skalerbare og serverløse RAG-arbeidsflyter med en vektormotor for Amazon OpenSearch Serverless og Amazon Bedrock Claude-modeller. For å lære om hvordan du implementerer RAG med Amazon Kendra, se Utnytte kraften til bedriftsdata med generativ AI: Innsikt fra Amazon Kendra, LangChain og store språkmodeller.

Agenter

FM-er kan forstå og svare på spørsmål basert på deres forhåndstrente kunnskap. De er imidlertid ikke i stand til å fullføre noen virkelige oppgaver, som å bestille en flyreise eller behandle en innkjøpsordre, på egen hånd. Dette er fordi slike oppgaver krever organisasjonsspesifikke data og arbeidsflyter som vanligvis trenger tilpasset programmering. Rammer som Langkjede og visse FM-er, som Claude-modeller, gir funksjoner for å samhandle med APIer og verktøy. Derimot, Agenter for Amazon Bedrock, en ny og fullt administrert AI-funksjon fra AWS, har som mål å gjøre det enklere for utviklere å bygge applikasjoner ved hjelp av neste generasjons FM-er. Med bare noen få klikk kan den automatisk bryte ned oppgaver og generere den nødvendige orkestreringslogikken, uten å trenge manuell koding. Agenter kan sikkert koble til bedriftens databaser via APIer, innta og strukturere dataene for maskinforbruk, og utvide dem med kontekstuelle detaljer for å produsere mer nøyaktige svar og oppfylle forespørsler. Fordi den håndterer integrasjon og infrastruktur, lar Agents for Amazon Bedrock deg fullt ut utnytte generativ AI for forretningsbruk. Utviklere kan nå fokusere på sine kjerneapplikasjoner i stedet for rutinemessig rørlegging. Den automatiserte databehandlingen og API-kallingen gjør det også mulig for FM å levere oppdaterte, skreddersydde svar og utføre faktiske oppgaver ved å bruke proprietær kunnskap.

Modelltilpasning

Foundation-modeller er ekstremt dyktige og muliggjør noen flotte applikasjoner, men det som vil bidra til å drive virksomheten din er generativ AI som vet hva som er viktig for kundene dine, produktene dine og bedriften din. Og det er bare mulig når du superlader modeller med dataene dine. Data er nøkkelen til å gå fra generiske applikasjoner til tilpassede generative AI-applikasjoner som skaper reell verdi for kundene og virksomheten din.

I denne delen diskuterer vi ulike teknikker og fordeler ved å tilpasse FM-ene dine. Vi dekker hvordan modelltilpasning innebærer videre trening og endring av vektene til modellen for å forbedre ytelsen.

Finjustering

Finjustering er prosessen med å ta en forhåndstrent FM, for eksempel Llama 2, og trene den videre på en nedstrømsoppgave med et datasett spesifikt for den oppgaven. Den forhåndstrente modellen gir generell språkkunnskap, og finjustering lar den spesialisere og forbedre ytelsen på en bestemt oppgave som tekstklassifisering, spørsmålssvar eller tekstgenerering. Med finjustering gir du merkede datasett – som er annotert med ekstra kontekst – for å trene modellen på spesifikke oppgaver. Du kan deretter tilpasse modellparametrene for den spesifikke oppgaven basert på din forretningskontekst.

Du kan implementere finjustering på FM-er med Amazon SageMaker JumpStart og Amazonas grunnfjell. For flere detaljer, se Distribuer og finjuster grunnmodeller i Amazon SageMaker JumpStart med to linjer med kode og Tilpass modeller i Amazon Bedrock med dine egne data ved hjelp av finjustering og fortsatt forhåndstrening.

Fortsatt førtrening

Fortsatt forhåndsopplæring i Amazon Bedrock lar deg lære en tidligere trent modell på tilleggsdata som ligner dens originale data. Det gjør det mulig for modellen å få mer generell språklig kunnskap i stedet for å fokusere på en enkelt applikasjon. Med fortsatt foropplæring kan du bruke dine umerkede datasett, eller rådata, for å forbedre nøyaktigheten til grunnlagsmodellen for domenet ditt ved å justere modellparametere. For eksempel kan et helseselskap fortsette å forhåndstrene modellen sin ved å bruke medisinske tidsskrifter, artikler og forskningsartikler for å gjøre den mer kunnskapsrik om bransjeterminologi. For flere detaljer, se Amazon Bedrock utvikleropplevelse.

Fordeler med modelltilpasning

Modelltilpasning har flere fordeler og kan hjelpe organisasjoner med følgende:

- Domenespesifikk tilpasning – Du kan bruke en generell FM, og deretter trene den videre på data fra et spesifikt domene (som biomedisinsk, juridisk eller økonomisk). Dette tilpasser modellen til domenets ordforråd, stil og så videre.

- Oppgavespesifikk finjustering – Du kan ta en forhåndstrent FM og finjustere den på data for en spesifikk oppgave (som sentimentanalyse eller svar på spørsmål). Dette spesialiserer modellen for den aktuelle oppgaven.

- Tilpassing – Du kan tilpasse en FM på en persons data (e-post, tekster, dokumenter de har skrevet) for å tilpasse modellen til deres unike stil. Dette kan aktivere mer personlig tilpassede applikasjoner.

- Lite ressurser språkinnstilling – Du kan omskolere bare de øverste lagene i en flerspråklig FM på et lite ressursspråk for å bedre tilpasse det til det språket.

- Å fikse feil – Hvis bestemt utilsiktet atferd oppdages i en modell, kan tilpasning på passende data bidra til å oppdatere modellen for å redusere disse feilene.

Modelltilpasning hjelper til med å overvinne følgende FM-adopsjonsutfordringer:

- Tilpasning til nye domener og oppgaver – FM-er som er forhåndstrent på generelle tekstkorpuer, må ofte finjusteres på oppgavespesifikke data for å fungere godt for nedstrømsapplikasjoner. Finjustering tilpasser modellen til nye domener eller oppgaver den ikke opprinnelig ble trent på.

- Overvinne skjevhet – FM-er kan vise skjevheter fra sine opprinnelige treningsdata. Å tilpasse en modell på nye data kan redusere uønskede skjevheter i modellens utdata.

- Forbedring av beregningseffektivitet – Forhåndsutdannede FM-er er ofte veldig store og beregningsmessig dyre. Modelltilpasning kan tillate nedbemanning av modellen ved å beskjære uviktige parametere, noe som gjør distribusjon mer mulig.

- Håndtere begrensede måldata – I noen tilfeller er det begrensede virkelige data tilgjengelig for måloppgaven. Modelltilpasning bruker de forhåndstrente vektene som er lært på større datasett for å overvinne denne datamangelen.

- Forbedre oppgaveytelse – Finjustering forbedrer nesten alltid ytelsen på måloppgaver sammenlignet med å bruke de originale forhåndstrente vektene. Denne optimaliseringen av modellen for dens tiltenkte bruk lar deg distribuere FM-er med suksess i virkelige applikasjoner.

Modelltilpasning har høyere kompleksitet enn prompt engineering og RAG fordi modellens vekt og parametere endres via tuning scripts, noe som krever datavitenskap og ML-ekspertise. Imidlertid gjør Amazon Bedrock det enkelt ved å gi deg en administrert opplevelse du kan tilpasse modeller med finjustering or fortsatt førtrening. Modelltilpasning gir svært nøyaktige resultater med sammenlignbar kvalitet enn RAG. Fordi du oppdaterer modellvekter på domenespesifikke data, produserer modellen mer kontekstuelle svar. Sammenlignet med RAG, kan kvaliteten være marginalt bedre avhengig av brukstilfellet. Derfor er det viktig å gjennomføre en avveiningsanalyse mellom de to teknikkene. Du kan potensielt implementere RAG med en tilpasset modell.

Omskolering eller trening fra bunnen av

Å bygge din egen grunnleggende AI-modell i stedet for kun å bruke forhåndsopplærte offentlige modeller gir større kontroll, forbedret ytelse og tilpasning til organisasjonens spesifikke brukstilfeller og data. Å investere i å lage en skreddersydd FM kan gi bedre tilpasningsevne, oppgraderinger og kontroll over evner. Distribuert opplæring muliggjør skalerbarheten som trengs for å trene veldig store FM-er på massive datasett på tvers av mange maskiner. Denne parallelliseringen gjør modeller med hundrevis av milliarder av parametere trent på billioner av tokens mulig. Større modeller har større kapasitet til å lære og generalisere.

Trening fra bunnen av kan gi resultater av høy kvalitet fordi modellen trener på bruksspesifikke data fra bunnen av, sjansene for hallusinasjoner er sjeldne, og nøyaktigheten av utdataene kan være blant de høyeste. Men hvis datasettet ditt er i stadig utvikling, kan du fortsatt støte på hallusinasjonsproblemer. Trening fra bunnen av har den høyeste implementeringskompleksiteten og kostnadene. Det krever mest innsats fordi det krever å samle inn en enorm mengde data, kuratere og behandle dem, og trene en ganske stor FM, som krever dyp datavitenskap og ML-ekspertise. Denne tilnærmingen er tidkrevende (det kan vanligvis ta uker til måneder).

Du bør vurdere å trene en FM fra bunnen av når ingen av de andre tilnærmingene fungerer for deg, og du har muligheten til å bygge en FM med en stor mengde godt kuraterte tokeniserte data, et sofistikert budsjett og et team av svært dyktige ML-eksperter . AWS tilbyr den mest avanserte skyinfrastrukturen for å trene og kjøre LLM-er og andre FM-er drevet av GPUer og den spesialbygde ML-treningsbrikken, AWS Trainium, og ML inferensakselerator, AWS slutning. For mer informasjon om opplæring av LLM-er på SageMaker, se Trening av store språkmodeller på Amazon SageMaker: Beste praksis og SageMaker HyperPod.

Velge riktig tilnærming for å utvikle generative AI-applikasjoner

Når organisasjoner utvikler generative AI-applikasjoner, må organisasjoner nøye vurdere flere nøkkelfaktorer før de velger den mest passende modellen for å møte deres behov. En rekke aspekter bør vurderes, for eksempel kostnader (for å sikre at den valgte modellen stemmer overens med budsjettbegrensninger), kvalitet (for å levere sammenhengende og faktisk nøyaktige resultater), sømløs integrasjon med gjeldende bedriftsplattformer og arbeidsflyter, og redusere hallusinasjoner eller generere falsk informasjon . Med mange tilgjengelige alternativer, vil det å ta deg tid til å evaluere disse aspektene grundig hjelpe organisasjoner med å velge den generative AI-modellen som best tjener deres spesifikke krav og prioriteringer. Du bør undersøke følgende faktorer nøye:

- Integrasjon med bedriftssystemer – For at FM-er virkelig skal være nyttige i en bedriftssammenheng, må de integreres og samvirke med eksisterende forretningssystemer og arbeidsflyter. Dette kan innebære tilgang til data fra databaser, enterprise resource planning (ERP) og Customer Relationship Management (CRM), i tillegg til å utløse handlinger og arbeidsflyter. Uten skikkelig integrasjon risikerer FM å være et isolert verktøy. Bedriftssystemer som ERP inneholder viktige forretningsdata (kunder, produkter, bestillinger). FM-en må være koblet til disse systemene for å bruke bedriftsdata i stedet for å jobbe med sin egen kunnskapsgraf, som kan være unøyaktig eller utdatert. Dette sikrer nøyaktighet og en enkelt kilde til sannhet.

- Hallusinasjoner – Hallusinasjoner er når en AI-applikasjon genererer falsk informasjon som virker saklig. Disse må behandles nøye før FM-er blir bredt adoptert. For eksempel kan en medisinsk chatbot designet for å gi diagnoseforslag hallusinere detaljer om en pasients symptomer eller sykehistorie, noe som fører til at den foreslår en unøyaktig diagnose. Å forhindre skadelige hallusinasjoner som disse gjennom tekniske løsninger og datasettkurering vil være avgjørende for å sikre at disse FM-ene kan stoles på for sensitive applikasjoner som helsevesen, finans og juridisk. Grundig testing og åpenhet om en FMs treningsdata og gjenværende feil må følge utplasseringene.

- Ferdigheter og ressurser – En vellykket bruk av FM-er vil i stor grad avhenge av å ha de riktige ferdighetene og ressursene for å bruke teknologien effektivt. Organisasjoner trenger ansatte med sterke tekniske ferdigheter for å implementere, tilpasse og vedlikeholde FM-er for å passe deres spesifikke behov. De krever også rikelig med beregningsressurser som avansert maskinvare og cloud computing-funksjoner for å kjøre komplekse FM-er. For eksempel, et markedsføringsteam som ønsker å bruke en FM til å generere reklamekopier og innlegg i sosiale medier, trenger dyktige ingeniører for å integrere systemet, reklamer for å gi meldinger og vurdere utdatakvalitet, og tilstrekkelig skydatakraft til å distribuere modellen kostnadseffektivt. Investering i å utvikle kompetanse og teknisk infrastruktur vil gjøre det mulig for organisasjoner å få reell forretningsverdi ved å bruke FM-er.

- Utgangskvalitet – Kvaliteten på utdataene som produseres av FM-er vil være avgjørende for å bestemme hvordan de blir tatt i bruk og bruk, spesielt i forbrukerrettede applikasjoner som chatbots. Hvis chatbots drevet av FM-er gir svar som er unøyaktige, useriøse eller upassende, vil brukere raskt bli frustrerte og slutte å engasjere seg med dem. Derfor må selskaper som ønsker å distribuere chatbots grundig teste FM-ene som driver dem for å sikre at de konsekvent genererer høykvalitetssvar som er nyttige, relevante og passende for å gi en god brukeropplevelse. Utdatakvalitet omfatter faktorer som relevans, nøyaktighet, sammenheng og hensiktsmessighet, som alle bidrar til generell brukertilfredshet og vil gjøre eller bryte bruken av FM-er som de som brukes for chatbots.

- Kostnad – Den høye beregningskraften som kreves for å trene og kjøre store AI-modeller som FM-er kan medføre betydelige kostnader. Mange organisasjoner kan mangle de økonomiske ressursene eller skyinfrastrukturen som er nødvendig for å bruke slike massive modeller. I tillegg vil integrering og tilpasning av FM-er for spesifikke brukstilfeller legge til tekniske kostnader. De betydelige utgiftene som kreves for å bruke FM-er kan avskrekke utbredt adopsjon, spesielt blant mindre selskaper og startups med begrensede budsjetter. Evaluering av potensiell avkastning på investeringen og veiing av kostnadene vs. fordelene ved FM-er er avgjørende for organisasjoner som vurderer deres anvendelse og nytte. Kostnadseffektivitet vil sannsynligvis være en avgjørende faktor for å avgjøre om og hvordan disse kraftige, men ressurskrevende modellene kan implementeres.

Designbeslutning

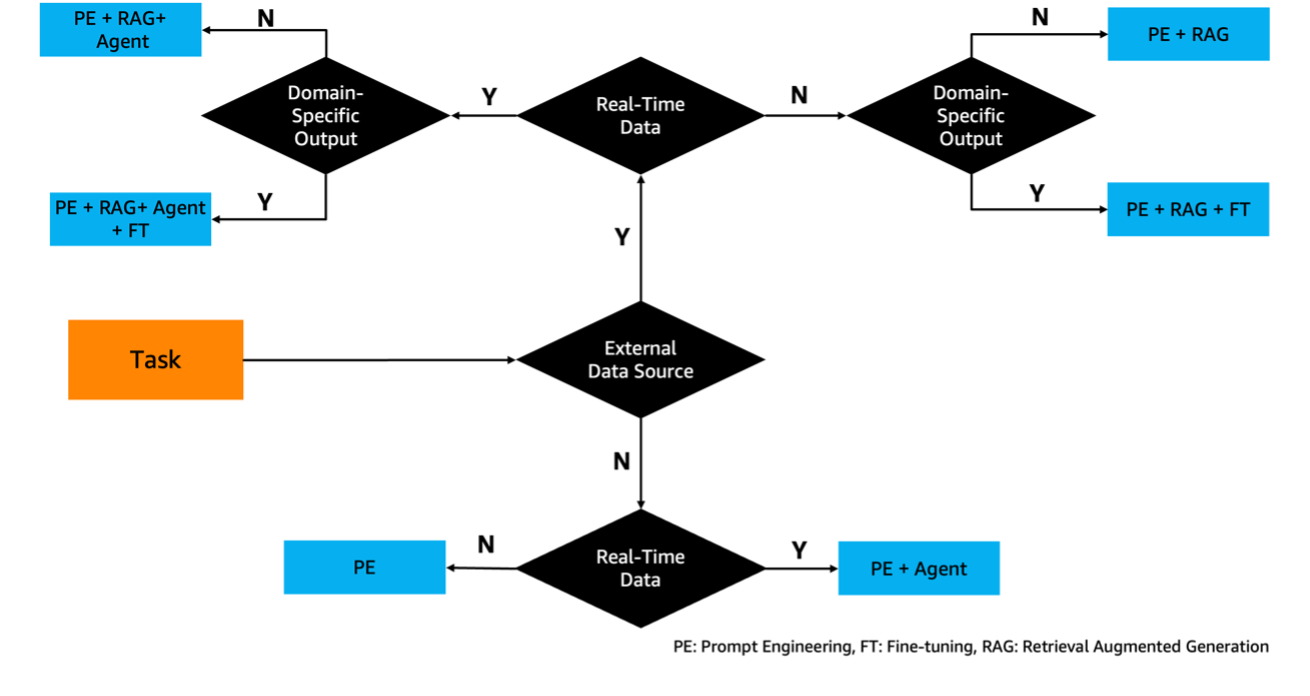

Som vi dekket i dette innlegget, er mange forskjellige AI-teknikker tilgjengelige for øyeblikket, for eksempel prompt engineering, RAG og modelltilpasning. Dette brede utvalget av valg gjør det utfordrende for bedrifter å bestemme den optimale tilnærmingen for deres spesielle brukstilfelle. Å velge riktig sett med teknikker avhenger av ulike faktorer, inkludert tilgang til eksterne datakilder, sanntidsdatastrømmer og domenespesifisiteten til den tiltenkte applikasjonen. For å hjelpe til med å identifisere den mest passende teknikken basert på brukssaken og hensynene som er involvert, går vi gjennom følgende flytskjema, som skisserer anbefalinger for å matche spesifikke behov og begrensninger med passende metoder.

For å få en klar forståelse, la oss gå gjennom flytskjemaet for designbeslutning ved å bruke noen få illustrerende eksempler:

- Bedriftssøk – En ansatt ønsker å be om permisjon fra sin organisasjon. For å gi et svar på linje med organisasjonens HR-policyer, trenger FM mer kontekst utover sin egen kunnskap og evner. Nærmere bestemt krever FM tilgang til eksterne datakilder som gir relevante HR-retningslinjer og retningslinjer. Gitt dette scenariet med en ansattforespørsel som krever henvisning til eksterne domenespesifikke data, er den anbefalte tilnærmingen i henhold til flytskjemaet rask utvikling med RAG. RAG vil hjelpe til med å levere relevante data fra de eksterne datakildene som kontekst til FM.

- Bedriftssøk med organisasjonsspesifikk utgang – Tenk deg at du har tekniske tegninger og du vil trekke ut materiallisten fra dem, formatere utdataene i henhold til industristandarder. For å gjøre dette kan du bruke en teknikk som kombinerer prompt engineering med RAG og en finjustert språkmodell. Den finjusterte modellen ville bli opplært til å produsere stykklister når de ble gitt tekniske tegninger som input. RAG hjelper til med å finne de mest relevante tekniske tegningene fra organisasjonens datakilder for å mate i konteksten for FM. Totalt sett trekker denne tilnærmingen ut styklister fra tekniske tegninger og strukturerer produksjonen på riktig måte for ingeniørdomenet.

- Generelt søk – Tenk deg at du vil finne identiteten til USAs 30. president. Du kan bruke prompt engineering for å få svaret fra en FM. Fordi disse modellene er trent på mange datakilder, kan de ofte gi nøyaktige svar på faktaspørsmål som dette.

- Generelt søk med nylige hendelser – Hvis du vil bestemme gjeldende aksjekurs for Amazon, kan du bruke tilnærmingen til rask utvikling med en agent. Agenten vil gi FM den siste aksjekursen slik at den kan generere den faktiske responsen.

konklusjonen

Generativ AI tilbyr et enormt potensial for organisasjoner til å drive innovasjon og øke produktiviteten på tvers av en rekke applikasjoner. Å lykkes med å ta i bruk disse fremvoksende AI-teknologiene krever imidlertid å ta nøkkelhensyn rundt integrasjon, utdatakvalitet, ferdigheter, kostnader og potensielle risikoer som skadelige hallusinasjoner eller sikkerhetssårbarheter. Organisasjoner må ta en systematisk tilnærming for å evaluere krav og begrensninger for brukstilfeller for å finne de mest hensiktsmessige teknikkene for å tilpasse og bruke FM-er. Som fremhevet i dette innlegget, har rask utvikling, RAG og effektive modelltilpasningsmetoder hver sine egne styrker og svakheter som passer til forskjellige scenarier. Ved å kartlegge forretningsbehov til AI-evner ved hjelp av et strukturert rammeverk, kan organisasjoner overvinne hindringer for implementering og begynne å realisere fordeler fra FM-er, samtidig som de bygger rekkverk for å håndtere risiko. Med gjennomtenkt planlegging basert på eksempler fra den virkelige verden, kan bedrifter i alle bransjer frigjøre enorme verdier fra denne nye bølgen av generativ AI. Lære om generativ AI på AWS.

Om forfatterne

Jay Rao er Principal Solutions Architect hos AWS. Han fokuserer på AI/ML-teknologier med stor interesse for Generativ AI og Computer Vision. Hos AWS liker han å gi teknisk og strategisk veiledning til kunder og hjelpe dem med å designe og implementere løsninger som driver forretningsresultater. Han er bokforfatter (Computer Vision on AWS), publiserer jevnlig blogger og kodeeksempler, og har holdt foredrag på teknologikonferanser som AWS re:Invent.

Jay Rao er Principal Solutions Architect hos AWS. Han fokuserer på AI/ML-teknologier med stor interesse for Generativ AI og Computer Vision. Hos AWS liker han å gi teknisk og strategisk veiledning til kunder og hjelpe dem med å designe og implementere løsninger som driver forretningsresultater. Han er bokforfatter (Computer Vision on AWS), publiserer jevnlig blogger og kodeeksempler, og har holdt foredrag på teknologikonferanser som AWS re:Invent.

Babu Kariyaden Parambath er senior AI/ML-spesialist hos AWS. Hos AWS liker han å jobbe med kunder for å hjelpe dem med å identifisere den riktige forretningsbrukssaken med forretningsverdi og løse den ved å bruke AWS AI/ML-løsninger og -tjenester. Før han begynte i AWS, var Babu en AI-evangelist med 20 års mangfoldig bransjeerfaring og leverte AI-drevet forretningsverdi for kundene.

Babu Kariyaden Parambath er senior AI/ML-spesialist hos AWS. Hos AWS liker han å jobbe med kunder for å hjelpe dem med å identifisere den riktige forretningsbrukssaken med forretningsverdi og løse den ved å bruke AWS AI/ML-løsninger og -tjenester. Før han begynte i AWS, var Babu en AI-evangelist med 20 års mangfoldig bransjeerfaring og leverte AI-drevet forretningsverdi for kundene.

- SEO-drevet innhold og PR-distribusjon. Bli forsterket i dag.

- PlatoData.Network Vertical Generative Ai. Styrk deg selv. Tilgang her.

- PlatoAiStream. Web3 Intelligence. Kunnskap forsterket. Tilgang her.

- PlatoESG. Karbon, CleanTech, Energi, Miljø, Solenergi, Avfallshåndtering. Tilgang her.

- PlatoHelse. Bioteknologisk og klinisk etterretning. Tilgang her.

- kilde: https://aws.amazon.com/blogs/machine-learning/best-practices-to-build-generative-ai-applications-on-aws/

- : har

- :er

- :ikke

- :hvor

- 1

- 100

- 116

- 20

- 20 år

- 2017

- 2022

- 30.

- 7

- a

- evne

- I stand

- Om oss

- akselerator

- adgang

- Tilgang

- ledsage

- Ifølge

- Logg inn

- nøyaktighet

- nøyaktig

- nøyaktig

- Oppnå

- tvers

- skuespill

- handlinger

- faktiske

- tilpasse

- tilpasning

- tilpasse

- tilpasser

- legge

- Ytterligere

- I tillegg

- adresse

- adressert

- adresser

- adressering

- Legger

- tilstrekkelig

- adoptere

- vedtatt

- vedta

- Adopsjon

- avansert

- forfremmelse

- fordeler

- Annonsering

- Agent

- agenter

- AI

- AI-modeller

- ai forskning

- AI-drevet

- AI / ML

- Aid

- mål

- AL

- justere

- justert

- Justerer

- Alle

- tillate

- tillate

- tillater

- nesten

- alene

- også

- Selv

- alltid

- Amazon

- Amazon Kendra

- Amazon SageMaker

- Amazon SageMaker JumpStart

- Amazon Web Services

- blant

- blant

- beløp

- an

- analyse

- og

- og infrastruktur

- besvare

- besvare

- svar

- Antropisk

- noen

- api

- APIer

- app

- vises

- Søknad

- søknader

- påføring

- tilnærming

- tilnærminger

- hensiktsmessig

- hensiktsmessig

- arkitektur

- ER

- oppstår

- rundt

- artikler

- AS

- aspekter

- vurdere

- Assistent

- assosiert

- At

- øke

- augmented

- forfatter

- Automatisert

- automatiserer

- automatisk

- autonomt

- tilgjengelig

- AWS

- AWS re: Oppfinne

- basen

- basert

- BE

- fordi

- bli

- før du

- begynne

- atferd

- atferd

- være

- benchmark

- Fordeler

- BEST

- beste praksis

- Bedre

- mellom

- Beyond

- skjevheter

- Bill

- milliarder

- Sedler

- biomedisinsk

- blogger

- bok

- bestilling

- øke

- både

- merke

- Break

- Breaking

- pauser

- bred

- bredere

- budsjett

- Budsjetter

- bygge

- Bygning

- bygget

- innebygd

- virksomhet

- bedrifter

- men

- by

- ringer

- CAN

- Kan få

- evner

- evne

- stand

- Kapasitet

- nøye

- bære

- saken

- saker

- viss

- utfordre

- utfordringer

- utfordrende

- sjansene

- endring

- endret

- Endringer

- endring

- tegn

- Figur

- chatbot

- chatbots

- chip

- valg

- valg

- Velg

- klassifisering

- Rengjøring

- fjerne

- tett

- Cloud

- cloud computing

- sky infrastruktur

- kode

- Koding

- SAMMENHENGENDE

- Samle

- kombinere

- skurtreskerne

- Kom

- kommer

- Felles

- Selskaper

- Selskapet

- Selskapets

- sammenlign

- sammenlignet

- fullføre

- komplekse

- kompleksitet

- samsvar

- komponenter

- fatte

- beregnings

- regnekraft

- beregningsmessig

- Beregn

- datamaskin

- Datamaskin syn

- databehandling

- databehandlingskraft

- Gjennomføre

- konferanser

- Koble

- tilkoblet

- Tilkobling

- Vurder

- betydelig

- betraktninger

- ansett

- vurderer

- konsekvent

- Konsoll

- stadig

- begrensninger

- forbruk

- inneholde

- innhold

- Innholdsgenerering

- kontekst

- sammenhenger

- kontekstuelle

- fortsette

- fortsatte

- bidra

- kontroll

- conversational

- samtaler

- kopiere

- Kjerne

- Kostnad

- Kostnader

- kunne

- dekke

- dekning

- dekket

- skape

- Opprette

- Kreativ

- reklamene

- kritisk

- CRM

- avgjørende

- kuratering

- konservering

- Gjeldende

- I dag

- skikk

- kunde

- kundeopplevelse

- Kunder

- tilpasning

- tilpasse

- tilpasset

- dato

- personvern

- Datas personvern og sikkerhet

- databehandling

- datavitenskap

- databaser

- datasett

- håndtering

- Avgjør

- avgjørelse

- dyp

- Grad

- leverer

- levert

- levere

- Etterspørsel

- demonstrere

- avhenge

- avhengig

- avhenger

- utplassere

- utplassert

- distribusjon

- distribusjoner

- utforming

- designet

- utforme

- ønsket

- detaljer

- Bestem

- bestemme

- utvikle

- Utvikler

- utviklere

- utvikle

- Utvikling

- diagnose

- forskjellig

- vanskelig

- direkte

- oppdaget

- diskutere

- distribueres

- distribuert opplæring

- diverse

- do

- dokumenter

- ikke

- dollar

- domene

- domener

- ned

- Tegninger

- stasjonen

- drevet

- to

- under

- dynamisk

- E&T

- hver enkelt

- lett

- Effektiv

- effektivt

- effektivitet

- effektiv

- effektivt

- innsats

- elementer

- kvalifisert

- eliminere

- e-post

- embedding

- veksten

- Emery

- Ansatt

- ansatte

- myndiggjøring

- muliggjøre

- muliggjør

- muliggjør

- Omfatter

- kryptere

- kryptert

- slutt

- ende til ende

- engasjerende

- Motor

- Ingeniørarbeid

- Ingeniører

- forbedre

- berikende

- sikre

- sikrer

- sikrer

- Enterprise

- enheter

- enhet

- Miljø

- miljøer

- utruste

- ERP

- spesielt

- etablere

- evaluere

- evaluere

- evangelist

- Hver

- alt

- utvikling

- undersøke

- eksempel

- eksempler

- spennende

- viser

- eksisterende

- utgifter

- dyrt

- erfaring

- eksperimenter

- Expert

- ekspertise

- eksperter

- utforske

- strekker

- utvendig

- trekke ut

- ekstrakter

- ekstremt

- Face

- faktor

- faktorer

- fakta

- FAIL

- ganske

- Fall

- falsk

- gjennomførbart

- Noen få

- finansiere

- finansiell

- Finn

- funn

- fem

- feil

- fleksibilitet

- flytur

- flyten

- Fokus

- fokuserer

- etter

- Til

- Fundament

- grunn

- Rammeverk

- rammer

- ofte

- fra

- frustrert

- Innfri

- fullt

- fullt

- videre

- Gevinst

- mellomrom

- samle

- GDPR

- general

- generell

- generere

- generert

- genererer

- genererer

- generasjonen

- generative

- Generativ AI

- få

- Gi

- gitt

- Go

- god

- styresett

- GPU

- graf

- flott

- større

- Ground

- jordet

- veiledning

- veilede

- retningslinjer

- Håndterer

- maskinvare

- skadelig

- seletøy

- Ha

- å ha

- he

- helsetjenester

- tungt

- hjelpe

- nyttig

- hjelpe

- hjelper

- Høy

- høytytende

- høykvalitets

- høyere

- høyest

- høyeste grad

- Fremhevet

- svært

- historie

- Hvordan

- Hvordan

- Men

- hr

- HTML

- HTTPS

- Hub

- Hundrevis

- hekk

- Innstilling av hyperparameter

- Tanken

- Ideer

- identifisere

- identifisering

- Identitet

- if

- forestille

- enorme

- Påvirkning

- innflytelsesrik

- Konsekvenser

- iverksette

- gjennomføring

- viktig

- forbedre

- forbedret

- forbedrer

- bedre

- in

- unøyaktig

- Inkludert

- uavhengig av hverandre

- indikerer

- industri

- industristandarder

- informasjon

- Infrastruktur

- Innovasjon

- innovasjoner

- inngang

- innsikt

- inspirere

- Institute

- instruksjoner

- integrere

- Integrering

- integrering

- tiltenkt

- samhandle

- interesse

- interessant

- Interface

- intern

- Internet

- samvirke

- inn

- introdusert

- inventar

- investere

- investering

- involvere

- involvert

- innebærer

- isolert

- saker

- IT

- DET ER

- sammenføyning

- bare

- Keen

- nøkkel

- nøkler

- kunnskap

- Kunnskap Graph

- vet

- Labs

- maling

- Språk

- språk

- stor

- større

- lag

- føre

- ledende

- LÆRE

- lært

- læring

- Permisjon

- Lovlig

- Lar

- LG

- i likhet med

- Sannsynlig

- begrensninger

- Begrenset

- linjer

- Llama

- logikk

- logisk

- ser

- Lav

- maskin

- maskinlæring

- maskiner

- vedlikeholde

- gjøre

- GJØR AT

- Making

- administrer

- fikk til

- ledelse

- håndbok

- mange

- kartlegging

- Marketing

- massive

- massivt

- matchende

- materialer

- Kan..

- Media

- medisinsk

- Møt

- Meta

- metode

- metoder

- kunne

- millioner

- minimere

- ML

- modell

- modeller

- måneder

- mer

- mest

- flytting

- må

- Naturlig

- nødvendig

- Trenger

- nødvendig

- trenger

- behov

- negativ

- Ny

- neste generasjon

- none

- nå

- of

- off

- Tilbud

- ofte

- on

- ONE

- bare

- Drift

- Muligheter

- optimal

- optimalisering

- alternativer

- or

- orkestre

- rekkefølge

- ordrer

- organisasjon

- organisasjons

- organisasjoner

- original

- opprinnelig

- Annen

- ut

- utfall

- utdatert

- skisserer

- utkonkurrerer

- produksjon

- utganger

- enn

- samlet

- Overcome

- oversikt

- egen

- par

- papirer

- parametere

- Spesielt

- spesielt

- passasjer

- Past

- Utfør

- ytelse

- forestillinger

- personlig

- Personlig

- setninger

- stykker

- rørledning

- planlegging

- Plattformer

- plato

- Platon Data Intelligence

- PlatonData

- plott

- poeng

- Politikk

- Populær

- mulig

- Post

- innlegg

- potensiell

- potensielt

- makt

- powered

- kraftig

- Praktisk

- praksis

- praksis

- forut

- preferanser

- president

- hindre

- tidligere

- pris

- prising

- Principal

- Før

- privatliv

- Personvern og sikkerhet

- privat

- Problem

- problemer

- prosess

- prosessering

- produsere

- produsert

- produserer

- produktivitet

- Produkter

- Profil

- Programmering

- fremmer

- ledetekster

- ordentlig

- riktig

- foreslå

- proprietær

- gi

- tilbydere

- gir

- gi

- offentlig

- publisert

- utgir

- trekke

- Kjøp

- innkjøpsordre

- kvalitet

- spørsmål

- spørsmål

- spørsmål

- raskt

- fille

- område

- rask

- raskt

- SJELDEN

- heller

- Raw

- RE

- Reager

- ekte

- reell verdi

- virkelige verden

- sanntids

- sanntidsdata

- realisere

- nylig

- anerkjennelse

- Anbefaling

- anbefalinger

- anbefales

- redusere

- redusere

- referere

- regelmessig

- forholdet

- relevans

- relevant

- avhengig

- gjenværende

- bemerkelsesverdig

- Rapporter

- omdømme

- anmode

- forespørsler

- krever

- påkrevd

- Krav

- Krever

- nødvendig

- forskning

- ressurs

- ressurskrevende

- Ressurser

- Svare

- svar

- svar

- REST

- Resultater

- gjenfinning

- retur

- inntekter

- Anmeldelser

- ikke sant

- risikoer

- rutine

- Kjør

- rennende

- sikrere

- sagemaker

- samme

- tilfredshet

- skalerbarhet

- skalerbar

- Skala

- Knapphet

- scenario

- scenarier

- Vitenskap

- forskere

- skraper

- skript

- sømløs

- Søk

- Seksjon

- sikkert

- sikkerhet

- sikkerhetsrisiko

- valgt

- velge

- utvalg

- senior

- sensitive

- sentiment

- følelser

- server~~POS=TRUNC

- serverer

- tjeneste

- Tjenester

- servering

- Session

- sett

- sett

- innstillinger

- flere

- Form

- delt

- Kort

- bør

- Viser

- signifikant

- betydelig

- lignende

- Enkelt

- enkelt

- dyktig

- ferdigheter

- mindre

- So

- selskap

- sosiale medier

- Sosiale medier innlegg

- utelukkende

- solid

- løsning

- Solutions

- LØSE

- løse

- noen

- sofistikert

- kilde

- Kilder

- spesialist

- spesialister

- spesialisert

- spesialisert

- spesifikk

- spesielt

- spesifisitet

- Stabilitet

- stå

- standarder

- Begynn

- startet

- startups

- Stater

- Trinn

- Steps

- Still

- lager

- Stopp

- oppbevare

- butikker

- Stories

- Story

- rett fram

- Strategisk

- styrker

- sterk

- struktur

- strukturert

- strukturer

- stil

- betydelig

- vellykket

- vellykket

- slik

- tilstrekkelig

- foreslår

- Dress

- egnet

- Superladning

- levere

- støtte

- Støtter

- sikker

- Symptomer

- system

- Systemer

- takle

- skreddersydd

- Ta

- ta

- Talent

- snakker

- Snakker

- Pek

- Target

- Oppgave

- oppgaver

- lag

- tech

- Teknisk

- tekniske ferdigheter

- teknikk

- teknikker

- Technologies

- Teknologi

- Teknologiinnovasjon

- mal

- terminologi

- test

- Testing

- tekst

- Tekstklassifisering

- enn

- Det

- De

- informasjonen

- deres

- Dem

- deretter

- Der.

- derfor

- Disse

- de

- tror

- tredjeparts

- denne

- grundig

- grundig

- De

- tusener

- tre

- Gjennom

- tid

- tidkrevende

- til

- symbolbaserte

- tokens

- verktøy

- verktøy

- topp

- Tema

- temaer

- mot

- trafikk

- Tog

- trent

- Kurs

- transitt

- Oversettelse

- Åpenhet

- enorm

- utløsende

- billioner

- virkelig

- Stol

- klarert

- troverdig

- Sannhet

- tuning

- SVING

- tweaking

- to

- typisk

- ute av stand

- forstå

- forståelse

- unik

- forent

- Forente Stater

- låse opp

- uutnyttet

- uønsket

- up-to-date

- Oppdater

- oppdatert

- oppdatering

- oppgraderinger

- bruke

- bruk sak

- brukt

- nyttig

- Bruker

- Brukererfaring

- Brukere

- bruker

- ved hjelp av

- verktøyet

- VALIDERE

- verdi

- variasjon

- ulike

- enorme

- vesentlig

- veldig

- av

- syn

- visuell

- vs

- Sikkerhetsproblemer

- gå

- ønsker

- ønsker

- var

- Wave

- Vei..

- we

- svakheter

- web

- webtjenester

- uker

- veiing

- vekt

- VI VIL

- Hva

- når

- mens

- om

- hvilken

- mens

- bred

- Bred rekkevidde

- allment

- utbredt

- Wikipedia

- vil

- med

- innenfor

- uten

- Arbeid

- arbeidsflyt

- arbeidsflyt

- arbeid

- ville

- skrive

- skriving

- skrevet

- år

- Utbytte

- Du

- Din

- zephyrnet