I mange bransjer er det viktig å trekke ut tilpassede enheter fra dokumenter i tide. Dette kan være utfordrende. Forsikringskrav, for eksempel, inneholder ofte dusinvis av viktige attributter (som datoer, navn, steder og rapporter) spredt over lange og tette dokumenter. Manuell skanning og uttrekking av slik informasjon kan være utsatt for feil og tidkrevende. Regelbasert programvare kan hjelpe, men er til syvende og sist for stiv til å tilpasses de mange forskjellige dokumenttyper og oppsett.

For å hjelpe med å automatisere og fremskynde denne prosessen, kan du bruke Amazon Comprehend å oppdage tilpassede enheter raskt og nøyaktig ved å bruke maskinlæring (ML). Denne tilnærmingen er fleksibel og nøyaktig, fordi systemet kan tilpasse seg nye dokumenter ved å bruke det det har lært tidligere. Inntil nylig kunne imidlertid denne funksjonen bare brukes på vanlige tekstdokumenter, noe som betydde at posisjonsinformasjon gikk tapt ved konvertering av dokumentene fra deres opprinnelige format. For å ta tak i dette, var det nylig annonsert at Amazon Comprehend kan trekke ut egendefinerte enheter i PDF-er, bilder og Word-filformater.

I dette innlegget går vi gjennom et konkret eksempel fra forsikringsbransjen på hvordan du kan bygge en tilpasset gjenkjenner ved å bruke PDF-kommentarer.

Løsningsoversikt

Vi går gjennom følgende trinn på høyt nivå:

- Lag PDF-kommentarer.

- Bruk PDF-kommentarene til å trene opp en tilpasset modell ved hjelp av Python API.

- Skaff evalueringsberegninger fra den trente modellen.

- Utfør slutninger om et usett dokument.

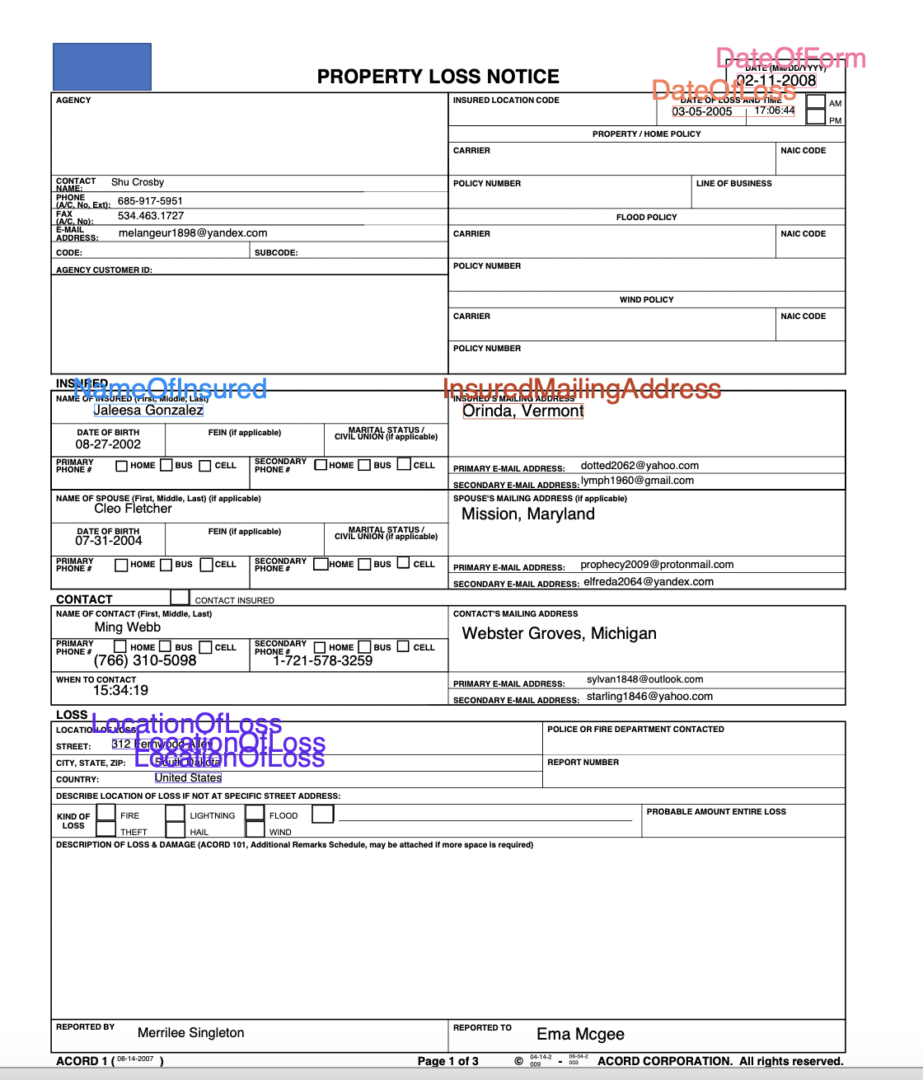

På slutten av dette innlegget ønsker vi å kunne sende et rå PDF-dokument til vår opplærte modell, og få det til å skrive ut en strukturert fil med informasjon om våre interesseetiketter. Spesielt trener vi modellen vår til å oppdage følgende fem enheter som vi valgte på grunn av deres relevans for forsikringskrav: DateOfForm, DateOfLoss, NameOfInsured, LocationOfLossog InsuredMailingAddress. Etter å ha lest den strukturerte utgangen, kan vi visualisere etikettinformasjonen direkte på PDF-dokumentet, som i bildet nedenfor.

Dette innlegget er ledsaget av en Jupyter-notisbok som inneholder de samme trinnene. Følg gjerne med mens du kjører trinnene i den bærbare. Merk at du må sette opp Amazon SageMaker miljø for å la Amazon Comprehend lese fra Amazon enkel lagringstjeneste (Amazon S3) som beskrevet øverst på notisboken.

Lag PDF-kommentarer

For å lage merknader for PDF-dokumenter kan du bruke Amazon SageMaker Ground Truth, en fullstendig administrert datamerkingstjeneste som gjør det enkelt å bygge svært nøyaktige opplæringsdatasett for ML.

For denne opplæringen har vi allerede kommentert PDF-ene i deres opprinnelige form (uten å konvertere til ren tekst) ved å bruke Ground Truth. Ground Truth-jobben genererer tre veier vi trenger for å trene vår tilpassede Amazon Comprehend-modell:

- Kilder – Banen til inndata-PDF-ene.

- Merknader – Banen til JSON-kommentarfilene som inneholder den merkede enhetsinformasjonen.

- Manifest – Filen som peker til plasseringen av merknadene og kilde-PDF-ene. Denne filen brukes til å lage en opplæringsjobb for Amazon Comprehend tilpasset enhetsgjenkjenning og trene en tilpasset modell.

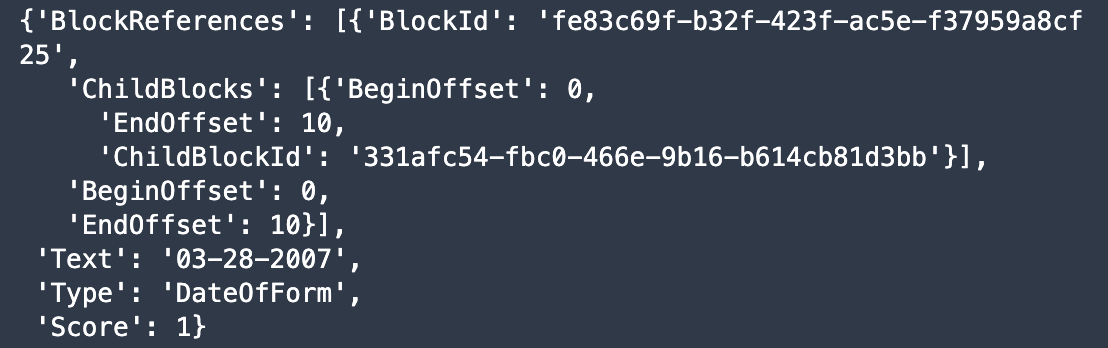

Følgende skjermbilde viser en eksempelkommentar.

Den tilpassede Ground Truth-jobben genererer en PDF-kommentar som fanger opp blokknivåinformasjon om enheten. Slik informasjon på blokknivå gir de nøyaktige posisjonskoordinatene til enheten (med barneblokkene som representerer hvert ord i enhetsblokken). Dette er forskjellig fra en standard Ground Truth-jobb der dataene i PDF-en er flatet ut til tekstformat og bare forskyvningsinformasjon – men ikke presis koordinatinformasjon – fanges opp under merknad. Den rike posisjonsinformasjonen vi får med dette tilpassede merknadsparadigmet gjør at vi kan trene opp en mer nøyaktig modell.

Manifestet som genereres fra denne typen jobb kalles et utvidet manifest, i motsetning til en CSV som brukes til standardkommentarer. For mer informasjon, se Merknader.

Bruk PDF-kommentarene til å trene opp en tilpasset modell ved hjelp av Python API

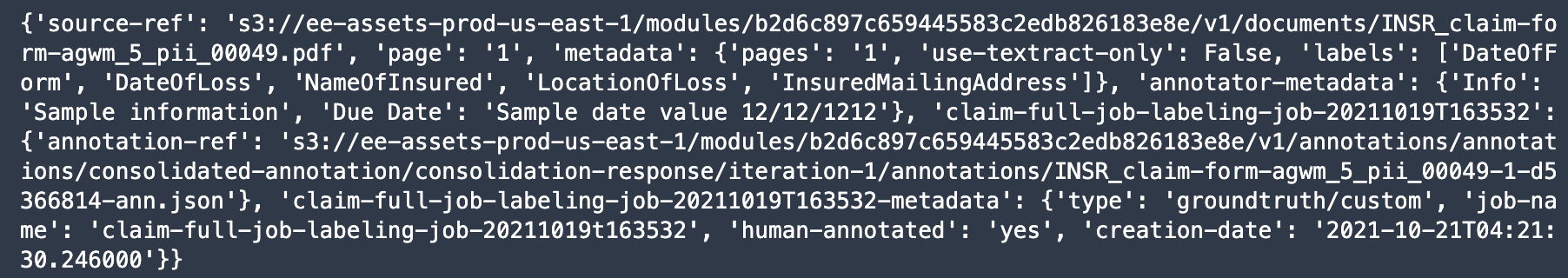

En utvidet manifestfil må formateres i JSON Lines-format. I JSON Lines-format er hver linje i filen et komplett JSON-objekt etterfulgt av en nylinjeseparator.

Følgende kode er en oppføring i denne utvidede manifestfilen.

Noen få ting å merke seg:

- Fem merketyper er knyttet til denne jobben:

DateOfForm,DateOfLoss,NameOfInsured,LocationOfLossogInsuredMailingAddress. - Manifestfilen refererer til både kilde-PDF-plasseringen og merknadsplasseringen.

- Metadata om annoteringsjobben (som opprettelsesdato) blir fanget opp.

Use-textract-onlyer satt tilFalse, som betyr at merknadsverktøyet bestemmer om PDFPlumber skal brukes (for en innebygd PDF) eller amazontekst (for en skannet PDF). Hvis satt tiltrue, Amazon Textract brukes i begge tilfeller (som er dyrere, men potensielt mer nøyaktig).

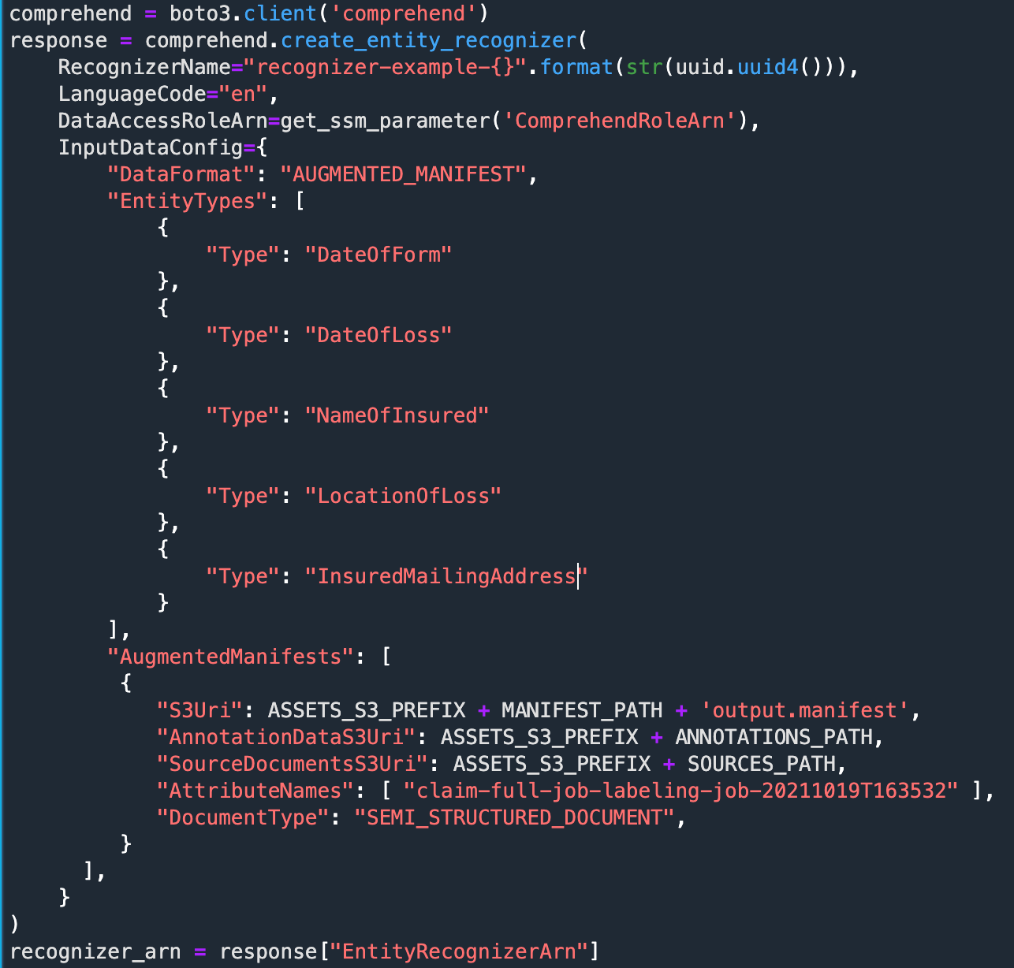

Nå kan vi trene gjenkjenneren, som vist i følgende eksempelkode.

Vi oppretter en gjenkjenner for å gjenkjenne alle fem typene enheter. Vi kunne ha brukt en undergruppe av disse enhetene hvis vi ønsket det. Du kan bruke opptil 25 enheter.

For detaljer om hver parameter, se create_entity_recognizer.

Avhengig av størrelsen på treningssettet kan treningstiden variere. For dette datasettet tar opplæringen omtrent 1 time. For å overvåke statusen til treningsjobben kan du bruke describe_entity_recognizer API.

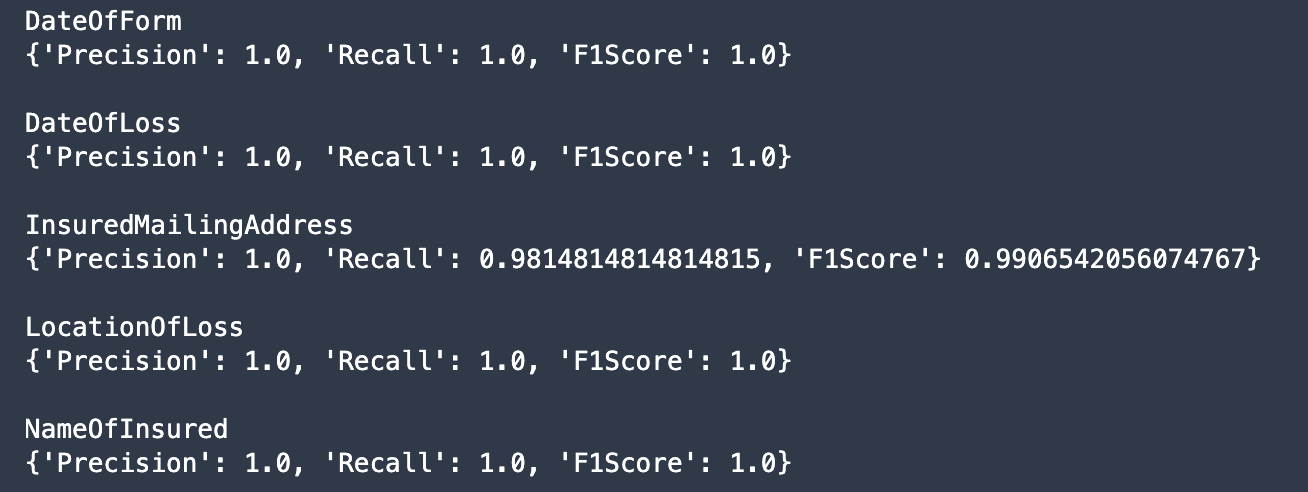

Skaff evalueringsberegninger fra den trente modellen

Amazon Comprehend gir modellytelsesmålinger for en trenet modell, som indikerer hvor godt den trente modellen forventes å gi spådommer ved å bruke lignende input. Vi kan få både globale presisjons- og tilbakekallingsmålinger så vel som per-enhetsmålinger. En nøyaktig modell har høy presisjon og høy tilbakekalling. Høy presisjon betyr at modellen vanligvis er riktig når den indikerer en bestemt etikett; høy tilbakekalling betyr at modellen fant de fleste etikettene. F1 er en sammensatt metrikk (harmonisk gjennomsnitt) av disse målene, og er derfor høy når begge komponentene er høye. For en detaljert beskrivelse av beregningene, se Spesifikasjoner for tilpasset enhet anerkjennelse.

Når du leverer dokumentene til treningsjobben, deler Amazon Comprehend dem automatisk opp i et tog- og testsett. Når modellen har nådd TRAINED status, kan du bruke describe_entity_recognizer API igjen for å få tak i evalueringsberegningene på testsettet.

Følgende er et eksempel på globale beregninger.

Følgende er et eksempel på beregninger per enhet.

De høye skårene indikerer at modellen har lært godt hvordan man oppdager disse enhetene.

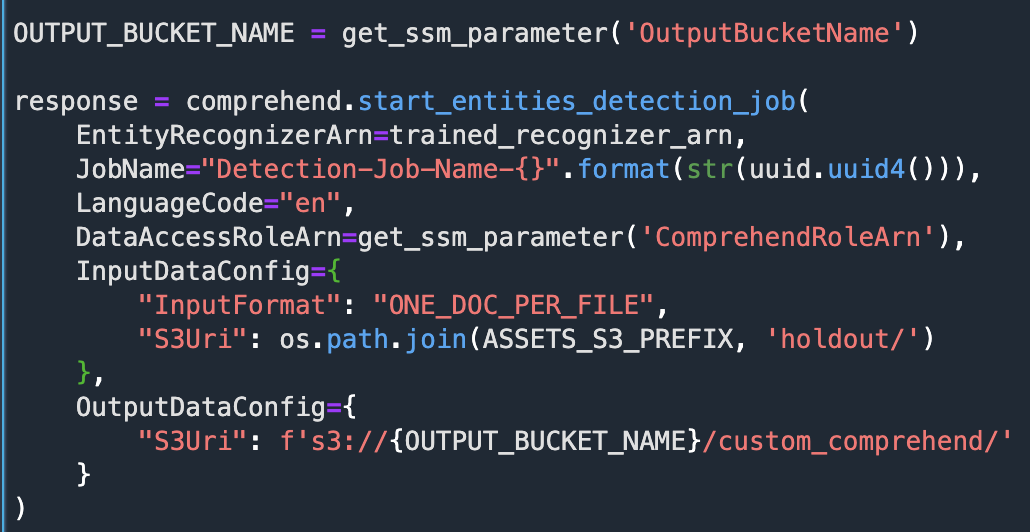

Utfør slutninger om et usett dokument

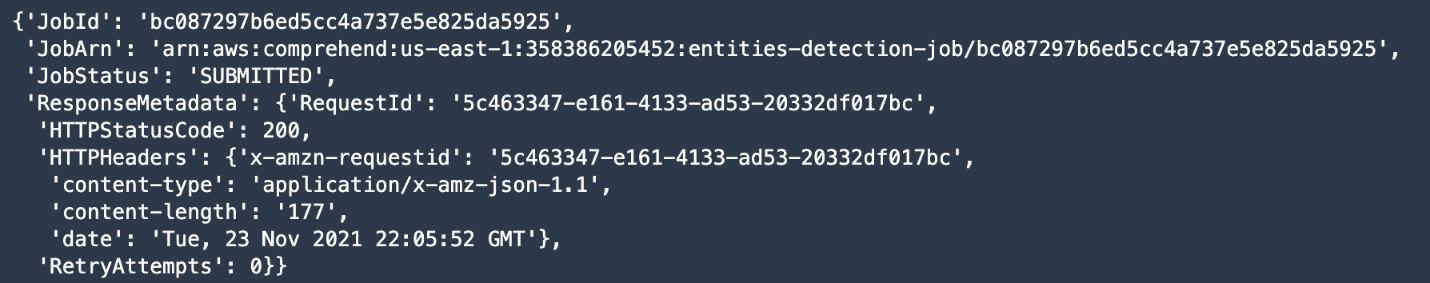

La oss trekke slutninger med vår opplærte modell på et dokument som ikke var en del av opplæringsprosedyren. Vi kan bruke denne asynkrone APIen for standard eller tilpasset NER. Hvis du bruker det for tilpasset NER (som i dette innlegget), må vi passere ARN for den trente modellen.

Vi kan vurdere den innsendte jobben ved å skrive ut svaret.

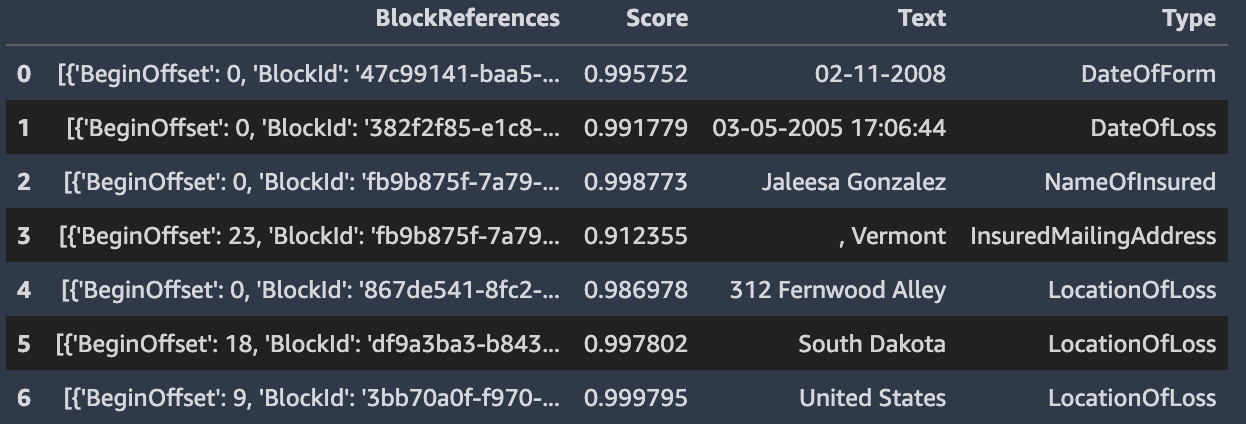

Vi kan formatere utdataene fra deteksjonsjobben med Pandas til en tabell. De Score verdi indikerer konfidensnivået modellen har om enheten.

Til slutt kan vi overlegge spådommene på de usynlige dokumentene, som gir resultatet som vist øverst i dette innlegget.

konklusjonen

I dette innlegget så du hvordan du trekker ut egendefinerte enheter i deres opprinnelige PDF-format ved å bruke Amazon Comprehend. Som neste trinn bør du vurdere å dykke dypere:

- Tren din egen gjenkjenner ved å bruke den medfølgende notatboken her.. Husk å slette eventuelle ressurser når du er ferdig for å unngå fremtidige kostnader.

- Sett opp din egen tilpassede merknadsjobb for å samle inn PDF-merknader for dine interesser. For mer informasjon, se Egendefinert dokumentanmerkning for å trekke ut navngitte enheter i dokumenter ved hjelp av Amazon Comprehend.

- Tren en tilpasset NER-modell på Amazon Comprehend-konsollen. For mer informasjon, se Trekk ut egendefinerte enheter fra dokumenter i deres opprinnelige format med Amazon Comprehend.

Om forfatterne

Joshua Levy er Senior Applied Scientist i Amazon Machine Learning Solutions-lab, hvor han hjelper kunder med å designe og bygge AI/ML-løsninger for å løse viktige forretningsproblemer.

Joshua Levy er Senior Applied Scientist i Amazon Machine Learning Solutions-lab, hvor han hjelper kunder med å designe og bygge AI/ML-løsninger for å løse viktige forretningsproblemer.

Andrew Ang er en maskinlæringsingeniør i Amazon Machine Learning Solutions Lab, hvor han hjelper kunder fra et mangfold av bransjer med å identifisere og bygge AI/ML-løsninger for å løse deres mest presserende forretningsproblemer. Utenom jobben liker han å se reise- og matvlogger.

Andrew Ang er en maskinlæringsingeniør i Amazon Machine Learning Solutions Lab, hvor han hjelper kunder fra et mangfold av bransjer med å identifisere og bygge AI/ML-løsninger for å løse deres mest presserende forretningsproblemer. Utenom jobben liker han å se reise- og matvlogger.

Alex Chirayath er en programvareingeniør i Amazon Machine Learning Solutions Lab med fokus på å bygge bruksbaserte løsninger som viser kunder hvordan de kan låse opp kraften til AWS AI/ML-tjenester for å løse virkelige forretningsproblemer.

Alex Chirayath er en programvareingeniør i Amazon Machine Learning Solutions Lab med fokus på å bygge bruksbaserte løsninger som viser kunder hvordan de kan låse opp kraften til AWS AI/ML-tjenester for å løse virkelige forretningsproblemer.

Jennifer Zhu er en Applied Scientist fra Amazon AI Machine Learning Solutions Lab. Hun jobber med AWSs kunder som bygger AI/ML-løsninger for deres høyprioriterte forretningsbehov.

Jennifer Zhu er en Applied Scientist fra Amazon AI Machine Learning Solutions Lab. Hun jobber med AWSs kunder som bygger AI/ML-løsninger for deres høyprioriterte forretningsbehov.

Niharika Jayanthi er en grensesnittingeniør i Amazon Machine Learning Solutions Lab – Human in the Loop-teamet. Hun hjelper til med å lage brukeropplevelsesløsninger for Amazon SageMaker Ground Truth-kunder.

Niharika Jayanthi er en grensesnittingeniør i Amazon Machine Learning Solutions Lab – Human in the Loop-teamet. Hun hjelper til med å lage brukeropplevelsesløsninger for Amazon SageMaker Ground Truth-kunder.

Boris Aronchik er leder i Amazon AI Machine Learning Solutions Lab hvor han leder et team av ML-forskere og ingeniører for å hjelpe AWS-kunder med å realisere forretningsmål ved å utnytte AI/ML-løsninger.

Boris Aronchik er leder i Amazon AI Machine Learning Solutions Lab hvor han leder et team av ML-forskere og ingeniører for å hjelpe AWS-kunder med å realisere forretningsmål ved å utnytte AI/ML-løsninger.

- Myntsmart. Europas beste Bitcoin og Crypto Exchange.

- Platoblokkkjede. Web3 Metaverse Intelligence. Kunnskap forsterket. FRI TILGANG.

- CryptoHawk. Altcoin Radar. Gratis prøveperiode.

- Kilde: https://aws.amazon.com/blogs/machine-learning/build-a-custom-entity-recognizer-for-pdf-documents-using-amazon-comprehend/

- "

- &

- 100

- Om oss

- nøyaktig

- tvers

- adresse

- AI

- Alle

- allerede

- Amazon

- api

- tilnærming

- ca

- attributter

- augmented

- automatisere

- AWS

- Blokker

- bygge

- Bygning

- virksomhet

- utfordrende

- avgifter

- barn

- krav

- kode

- samle

- selvtillit

- Konsoll

- inneholder

- koordinere

- kunne

- skaperverket

- kritisk

- skikk

- Kunder

- dato

- datoer

- dypere

- utforming

- Gjenkjenning

- direkte

- dokumenter

- ingeniør

- Ingeniører

- enheter

- Miljø

- eksempel

- forventet

- erfaring

- fleksibel

- følge

- etter

- mat

- skjema

- format

- funnet

- Gratis

- framtid

- Global

- Mål

- hjelpe

- hjelper

- Høy

- svært

- Hvordan

- Hvordan

- HTTPS

- menneskelig

- identifisere

- bilde

- viktig

- bransjer

- industri

- informasjon

- inngang

- forsikring

- interesse

- IT

- Jobb

- nøkkel

- lab

- merking

- etiketter

- Fører

- lært

- læring

- Nivå

- utnytte

- linje

- plassering

- steder

- maskin

- maskinlæring

- GJØR AT

- fikk til

- leder

- måte

- manuelt

- betyr

- Metrics

- ML

- modell

- Overvåke

- mer

- mest

- navn

- bærbare

- offset

- egen

- paradigmet

- ytelse

- makt

- Spådommer

- problemer

- prosess

- gi

- gir

- raskt

- Raw

- Lesning

- virkelige verden

- realisere

- gjenkjenne

- Rapporter

- Ressurser

- svar

- anmeldelse

- Kjør

- rennende

- skanning

- Forsker

- forskere

- tjeneste

- Tjenester

- sett

- lignende

- Enkelt

- Størrelse

- Software

- Software Engineer

- Solutions

- LØSE

- fart

- Standard

- status

- lagring

- strukturert

- innsendt

- system

- lag

- test

- Kilden

- Gjennom

- tid

- tidkrevende

- verktøy

- topp

- Kurs

- reiser

- låse opp

- us

- bruke

- vanligvis

- verdi

- Hva

- om

- mens

- innenfor

- uten

- Arbeid

- virker

- verden