I dette innlegget viser vi hvordan du konfigurerer en ny OAuth-basert autentiseringsfunksjon for bruk Snowflake in Amazon SageMaker Data Wrangler. Snowflake er en skydataplattform som leverer dataløsninger for datavarehus til datavitenskap. Snowflake er en AWS-partner med flere AWS-akkrediteringer, inkludert AWS-kompetanse innen maskinlæring (ML), detaljhandel og data og analyser.

Data Wrangler forenkler dataforberedelsen og funksjonsutviklingsprosessen, og reduserer tiden det tar fra uker til minutter ved å tilby et enkelt visuelt grensesnitt for dataforskere for å velge og rense data, lage funksjoner og automatisere dataforberedelse i ML-arbeidsflyter uten å skrive noen kode. Du kan importere data fra flere datakilder, som f.eks Amazon enkel lagringstjeneste (Amazon S3), Amazonas Athena, Amazon RedShift, Amazon EMR, og Snowflake. Med denne nye funksjonen kan du bruke din egen identitetsleverandør (IdP) som f.eks Okta, azureadeller Ping Federate for å koble til Snowflake via Data Wrangler.

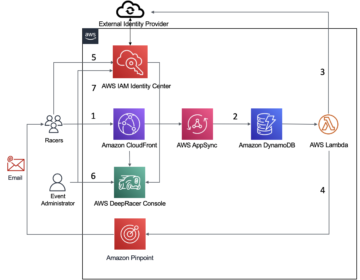

Løsningsoversikt

I de følgende delene gir vi trinn for en administrator for å sette opp IdP, Snowflake og Studio. Vi beskriver også trinnene som dataforskere kan ta for å konfigurere dataflyten, analysere datakvaliteten og legge til datatransformasjoner. Til slutt viser vi hvordan du eksporterer dataflyten og trener en modell ved hjelp av SageMaker autopilot.

Forutsetninger

For dette gjennomgangen bør du ha følgende forutsetninger:

- For admin:

- En Snowflake-bruker med tillatelser til å lage lagringsintegrasjoner og sikkerhetsintegrasjoner i Snowflake.

- En AWS-konto med tillatelser til å opprette AWS identitets- og tilgangsadministrasjon (IAM) retningslinjer og roller.

- Tilgang og tillatelser til å konfigurere IDP for å registrere Data Wrangler-applikasjonen og sette opp autorisasjonsserveren eller API.

- For dataforsker:

Administratoroppsett

I stedet for å la brukerne dine skrive inn Snowflake-legitimasjonen direkte i Data Wrangler, kan du få dem til å bruke en IdP for å få tilgang til Snowflake.

Følgende trinn er involvert for å aktivere Data Wrangler OAuth-tilgang til Snowflake:

- Konfigurer IdP.

- Konfigurer Snowflake.

- Konfigurer SageMaker Studio.

Konfigurer IdP

For å sette opp din IdP, må du registrere Data Wrangler-applikasjonen og sette opp autorisasjonsserveren eller API-en.

Registrer Data Wrangler-applikasjonen i IdP

Se følgende dokumentasjon for IdP-ene som Data Wrangler støtter:

Bruk dokumentasjonen fra din IdP for å registrere Data Wrangler-applikasjonen din. Informasjonen og prosedyrene i denne delen hjelper deg å forstå hvordan du bruker dokumentasjonen fra din IdP på riktig måte.

Spesifikke tilpasninger i tillegg til trinnene i de respektive veiledningene er kalt opp i underavsnittene.

- Velg konfigurasjonen som starter prosessen med å registrere Data Wrangler som en applikasjon.

- Gi brukerne i IdP tilgang til Data Wrangler.

- Aktiver OAuth-klientautentisering ved å lagre klientlegitimasjonen som en Secrets Manager-hemmelighet.

- Angi en omdirigerings-URL med følgende format:

https://domain-ID.studio.AWS Region.sagemaker.aws/jupyter/default/lab.

Du spesifiserer SageMaker-domene-IDen og AWS-regionen som du bruker til å kjøre Data Wrangler. Du må registrere en URL for hvert domene og hver region der du kjører Data Wrangler. Brukere fra et domene og en region som ikke har omdirigerings-URLer konfigurert for dem, vil ikke kunne autentisere seg med IdP for å få tilgang til Snowflake-tilkoblingen.

- Sørg for at autorisasjonskoden og oppdateringstokentildelingstypene er tillatt for Data Wrangler-applikasjonen din.

Sett opp autorisasjonsserveren eller API-en i IdP

Innenfor din IdP må du sette opp en autorisasjonsserver eller et applikasjonsprogrammeringsgrensesnitt (API). For hver bruker sender autorisasjonsserveren eller API-en tokens til Data Wrangler med Snowflake som publikum.

Snowflake bruker konseptet med roller som er forskjellige fra IAM-roller som brukes i AWS. Du må konfigurere IdP til å bruke ENHVER rolle for å bruke standardrollen knyttet til Snowflake-kontoen. For eksempel hvis en bruker har systems administrator som standardrolle i deres Snowflake-profil, bruker tilkoblingen fra Data Wrangler til Snowflake systems administrator som rollen.

Bruk følgende prosedyre for å konfigurere autorisasjonsserveren eller API-en i din IdP:

- Fra din IdP, start prosessen med å sette opp serveren eller API.

- Konfigurer autorisasjonsserveren til å bruke autorisasjonskoden og oppdater token-tildelingstyper.

- Spesifiser levetiden til tilgangstokenet.

- Angi tidsavbrudd for oppdateringstoken for tomgang.

Tidsavbruddet for inaktivitet er tiden da oppdateringstokenet utløper hvis det ikke brukes. Hvis du planlegger jobber i Data Wrangler, anbefaler vi å gjøre tidsavbruddstiden for inaktivt lengre enn frekvensen til behandlingsjobben. Ellers kan noen behandlingsjobber mislykkes fordi oppdateringstokenet utløp før de kunne kjøre. Når oppdateringstokenet utløper, må brukeren autentisere seg på nytt ved å få tilgang til tilkoblingen de har opprettet til Snowflake gjennom Data Wrangler.

Merk at Data Wrangler ikke støtter roterende oppdateringstokener. Bruk av roterende oppdateringstokener kan føre til tilgangsfeil eller at brukere må logge på ofte.

Hvis oppdateringstokenet utløper, må brukerne autentisere seg på nytt ved å få tilgang til tilkoblingen de har opprettet til Snowflake gjennom Data Wrangler.

- Spesifiser

session:role-anysom det nye omfanget.

For Azure AD må du også spesifisere en unik identifikator for omfanget.

Etter at du har konfigurert OAuth-leverandøren, gir du Data Wrangler informasjonen den trenger for å koble til leverandøren. Du kan bruke dokumentasjonen fra din IdP for å få verdier for følgende felt:

- Token URL – URL-en til tokenet som IdP sender til Data Wrangler

- Autorisasjons-URL – URL-en til autorisasjonsserveren til IdP

- kunde-ID – ID-en til IdP

- Klienthemmelighet – Hemmeligheten som bare autorisasjonsserveren eller API-en gjenkjenner

- OAuth-omfang – Dette er kun for Azure AD

Konfigurer Snowflake

For å konfigurere Snowflake, fullfør instruksjonene i Importer data fra Snowflake.

Bruk Snowflake-dokumentasjonen for din IdP for å sette opp en ekstern OAuth-integrasjon i Snowflake. Se forrige avsnitt Registrer Data Wrangler-applikasjonen i IdP for mer informasjon om hvordan du setter opp en ekstern OAuth-integrasjon.

Når du setter opp sikkerhetsintegrasjonen i Snowflake, sørg for at du aktiverer external_oauth_any_role_mode.

Konfigurer SageMaker Studio

Du lagrer feltene og verdiene i en Secrets Manager-hemmelighet og legger den til i Studio Lifecycle Configuration som du bruker for Data Wrangler. En livssykluskonfigurasjon er et shell-skript som automatisk laster inn legitimasjonen som er lagret i hemmeligheten når brukeren logger på Studio. For informasjon om å lage hemmeligheter, se Flytt hardkodede hemmeligheter til AWS Secrets Manager. For informasjon om bruk av livssykluskonfigurasjoner i Studio, se Bruk livssykluskonfigurasjoner med Amazon SageMaker Studio.

Lag en hemmelighet for Snowflake-legitimasjonen

For å lage hemmeligheten din for Snowflake-legitimasjon, fullfør følgende trinn:

- Velg på Secrets Manager-konsollen Lagre en ny hemmelighet.

- Til Hemmelig type, plukke ut Annen type hemmelighet.

- Spesifiser detaljene i hemmeligheten din som nøkkelverdipar.

Nøkkelnavn krever små bokstaver på grunn av følsomhet for store og små bokstaver. Data Wrangler gir en advarsel hvis du taster inn noen av disse feil. Skriv inn de hemmelige verdiene som nøkkel-verdi-par Nøkkel/verdi hvis du vil, eller bruk klartekst alternativet.

Følgende er formatet til hemmeligheten som brukes for Okta. Hvis du bruker Azure AD, må du legge til datasource_oauth_scope feltet.

- Oppdater de foregående verdiene med ditt valg av IdP og informasjon samlet etter søknadsregistrering.

- Velg neste.

- Til Hemmelig navn, legg til prefikset

AmazonSageMaker(for eksempel er hemmeligheten vårAmazonSageMaker-DataWranglerSnowflakeCreds). - på Tags delen, legg til en tagg med nøkkelen

SageMakerog verditrue. - Velg neste.

- Resten av feltene er valgfrie; velge neste til du har muligheten til å velge Butikk for å lagre hemmeligheten.

Etter at du har lagret hemmeligheten, kommer du tilbake til Secrets Manager-konsollen.

- Velg hemmeligheten du nettopp opprettet, og hent deretter den hemmelige ARN.

- Lagre dette i ditt foretrukne tekstredigeringsprogram for senere bruk når du oppretter Data Wrangler-datakilden.

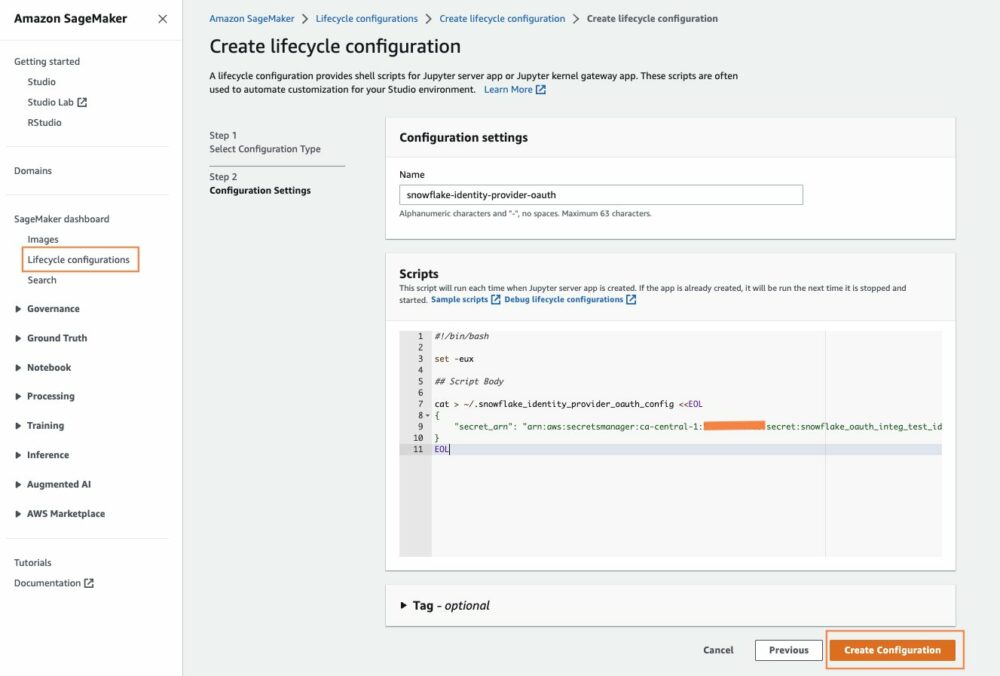

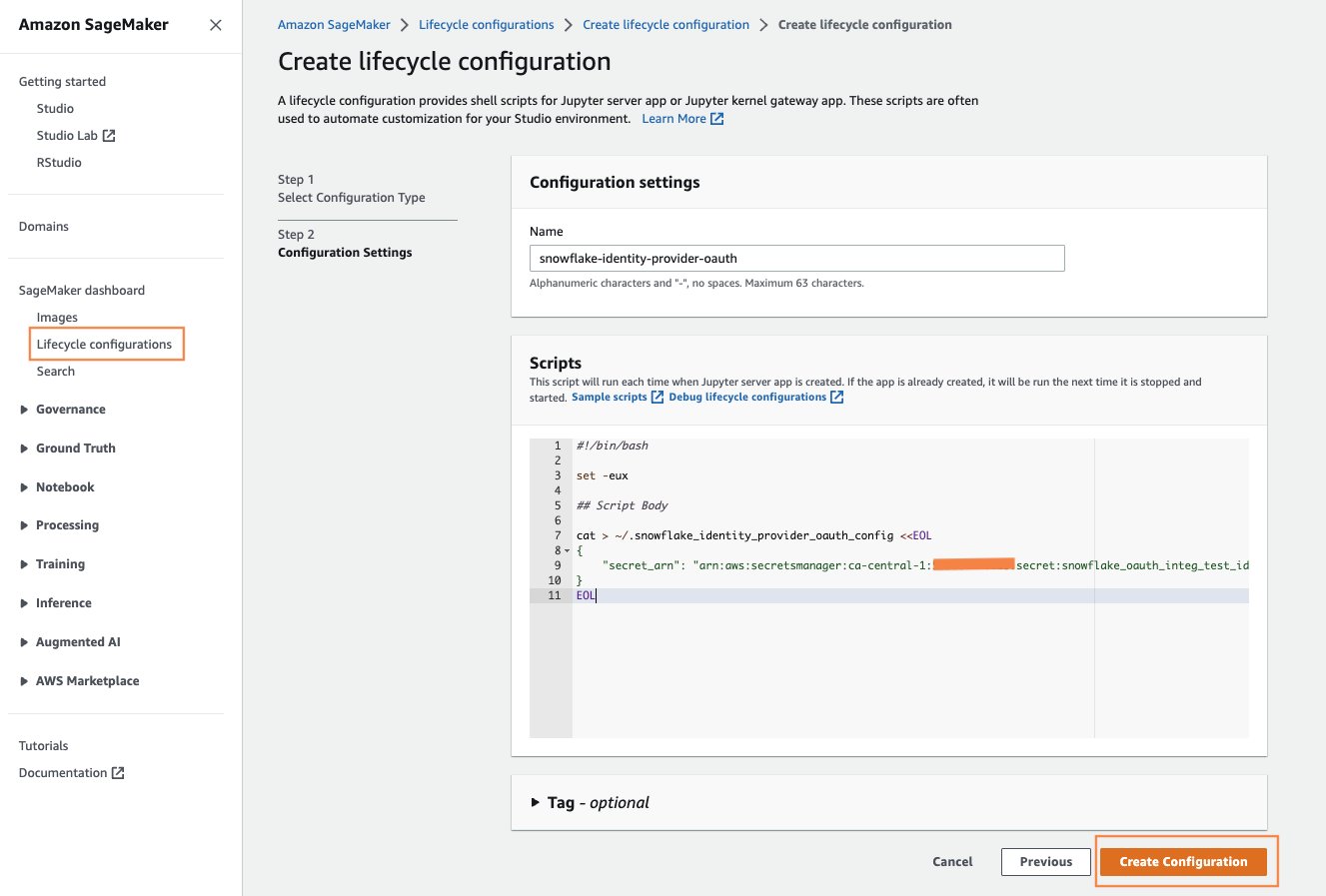

Opprett en Studio-livssykluskonfigurasjon

For å opprette en livssykluskonfigurasjon i Studio, fullfør følgende trinn:

- Velg på SageMaker-konsollen Livssykluskonfigurasjoner i navigasjonsruten.

- Velg Opprett konfigurasjon.

- Velg Jupyter server app.

- Opprett en ny livssykluskonfigurasjon eller legg til en eksisterende med følgende innhold:

Konfigurasjonen lager en fil med navnet ".snowflake_identity_provider_oauth_config", som inneholder hemmeligheten i brukerens hjemmemappe.

- Velg Opprett konfigurasjon.

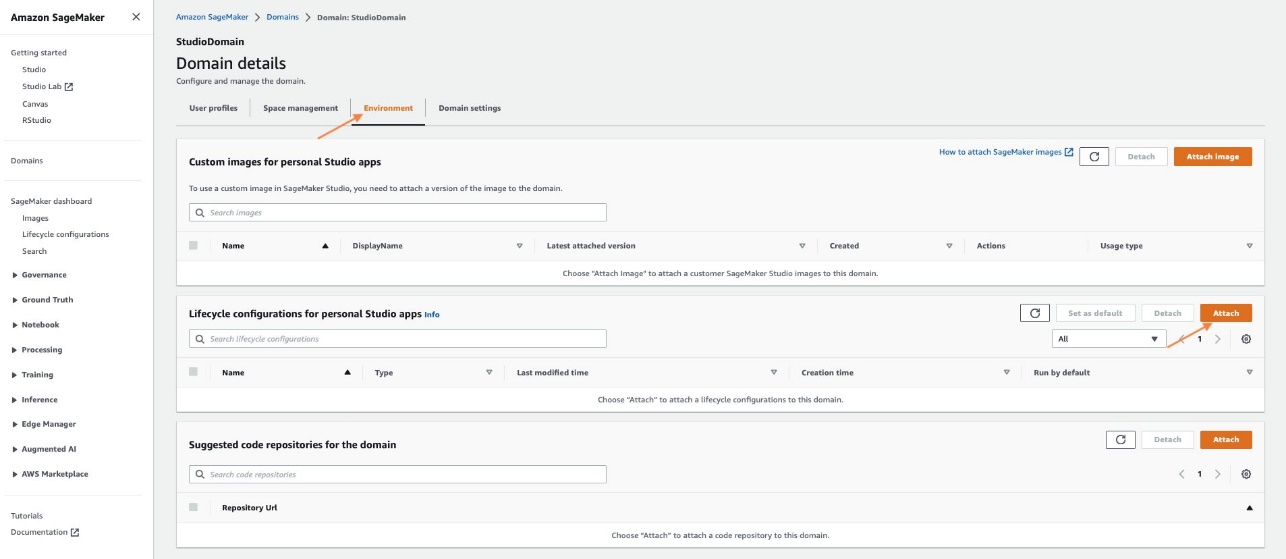

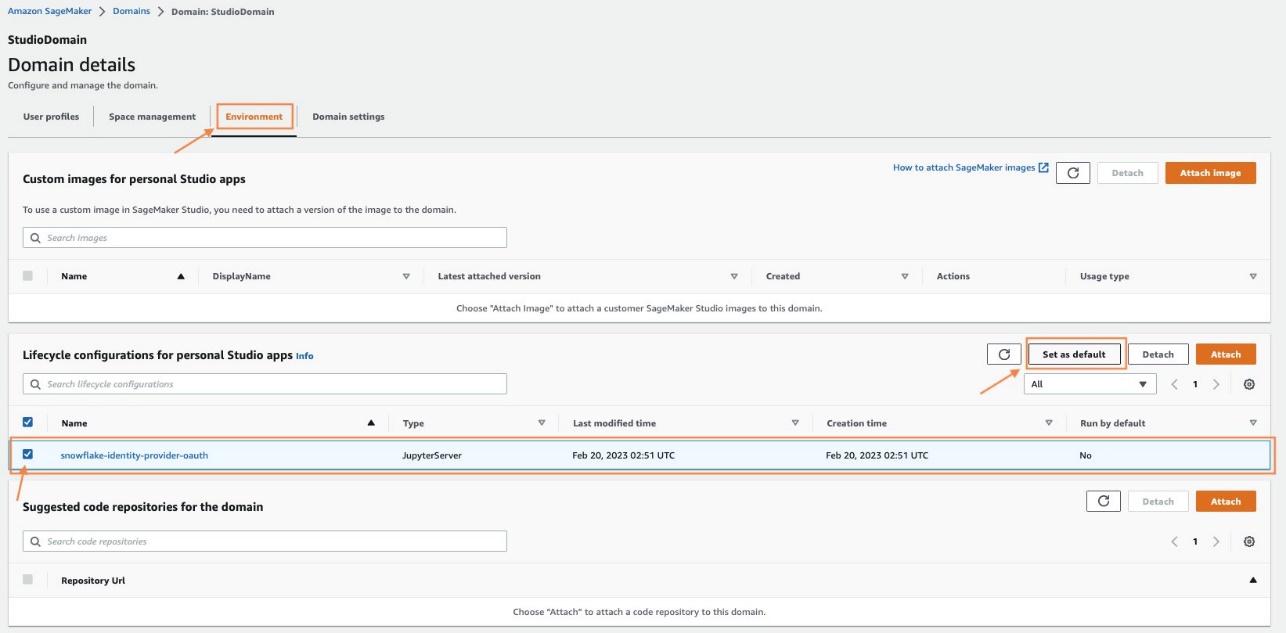

Angi standard livssykluskonfigurasjon

Fullfør følgende trinn for å angi livssykluskonfigurasjonen du nettopp opprettet som standard:

- Velg på SageMaker-konsollen Domener i navigasjonsruten.

- Velg Studio-domenet du vil bruke for dette eksemplet.

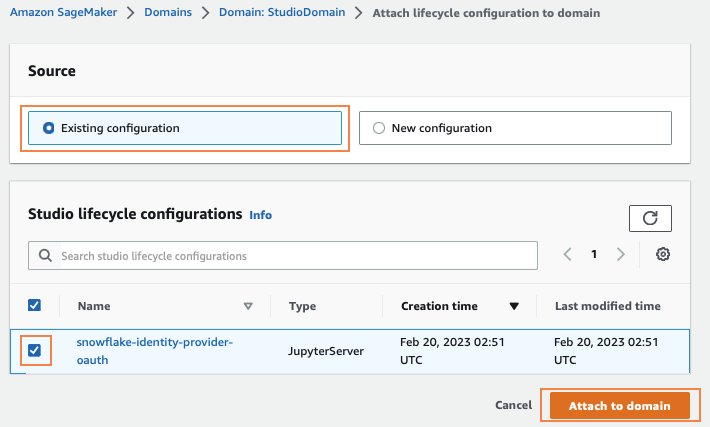

- På Miljø fanen, i Livssykluskonfigurasjoner for personlige Studio-apper delen velger Fest.

- Til kilde, plukke ut Eksisterende konfigurasjon.

- Velg konfigurasjonen du nettopp har laget, og velg deretter Fest til domene.

- Velg den nye konfigurasjonen og velg Angi som standard, velg deretter Angi som standard igjen i popup-meldingen.

De nye innstillingene dine skal nå være synlige under Livssykluskonfigurasjoner for personlige Studio-apper som standard.

- Slå av Studio-appen og start på nytt for at endringene skal tre i kraft.

Erfaring fra dataforsker

I denne delen dekker vi hvordan dataforskere kan koble til Snowflake som en datakilde i Data Wrangler og forberede data for ML.

Opprett en ny dataflyt

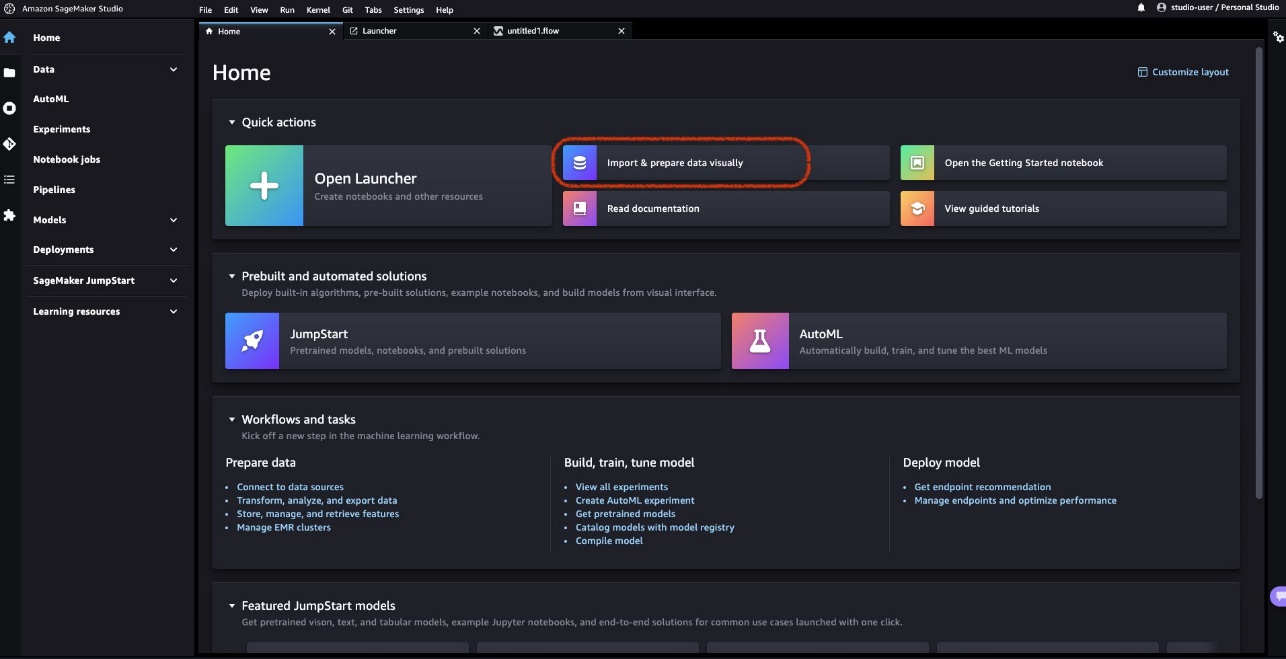

Gjør følgende for å opprette dataflyten:

- Velg på SageMaker-konsollen Amazon SageMaker Studio i navigasjonsruten.

- Velg Åpne Studio.

- På studioet Hjemprodukt side, velg Importer og klargjør data visuelt. Alternativt på filet rullegardinmeny, velg Ny, velg deretter SageMaker Data Wrangler Flow.

Det kan ta noen minutter å opprette en ny flyt.

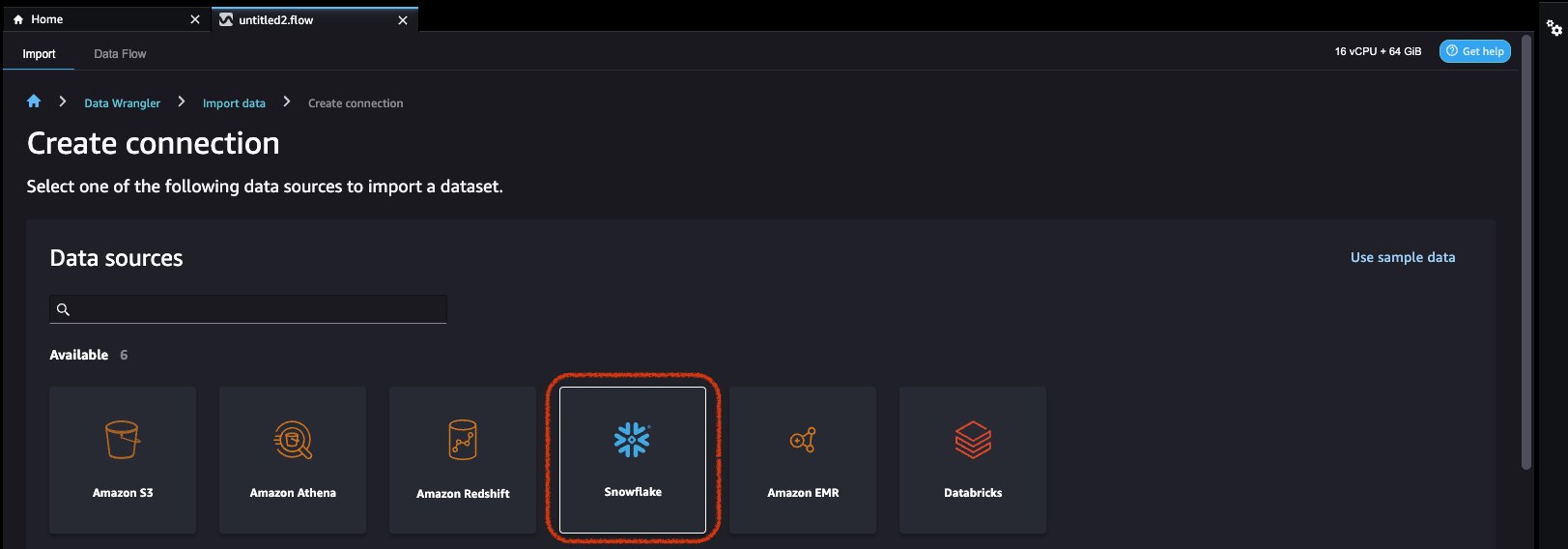

- På Import datoer side, velg Opprett forbindelse.

- Velg Snowflake fra listen over datakilder.

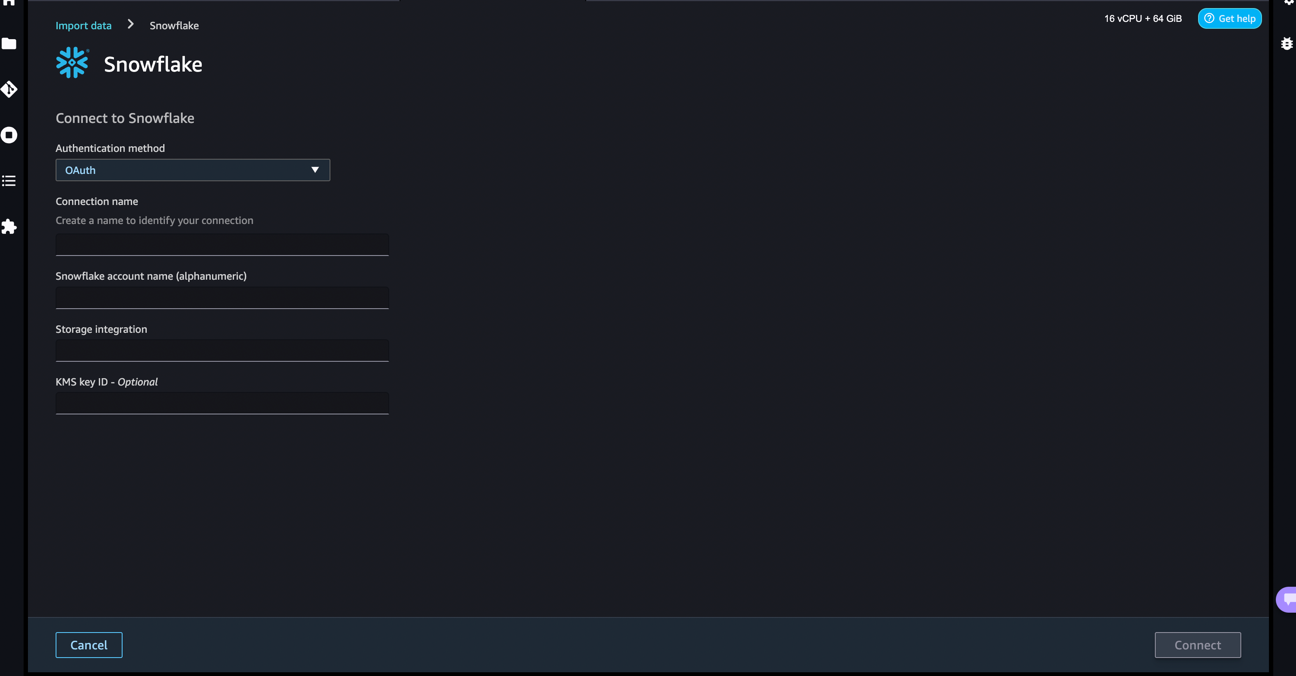

- Til Autentiseringsmetode, velg OAuth.

Hvis du ikke ser OAuth, kontroller de foregående trinnene for livssykluskonfigurasjon.

- Skriv inn detaljer for Snowflake kontonavn og Lagringsintegrasjon.

- Skriv inn et tilkoblingsnavn og velg Koble.

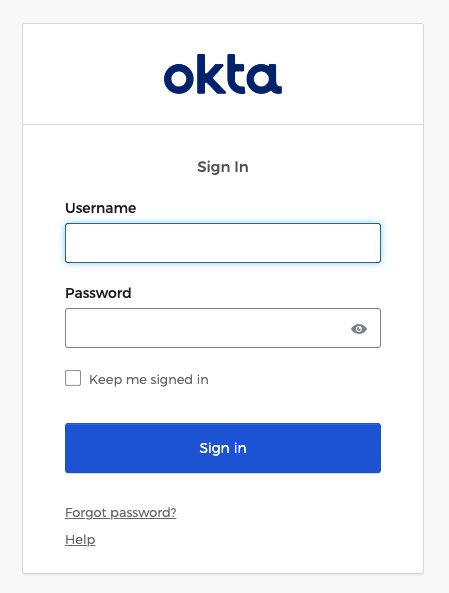

Du blir omdirigert til en IdP-autentiseringsside. For dette eksempelet bruker vi Okta.

- Skriv inn brukernavn og passord, og velg Logg inn.

Etter at autentiseringen er vellykket, blir du omdirigert til Studio-dataflytsiden.

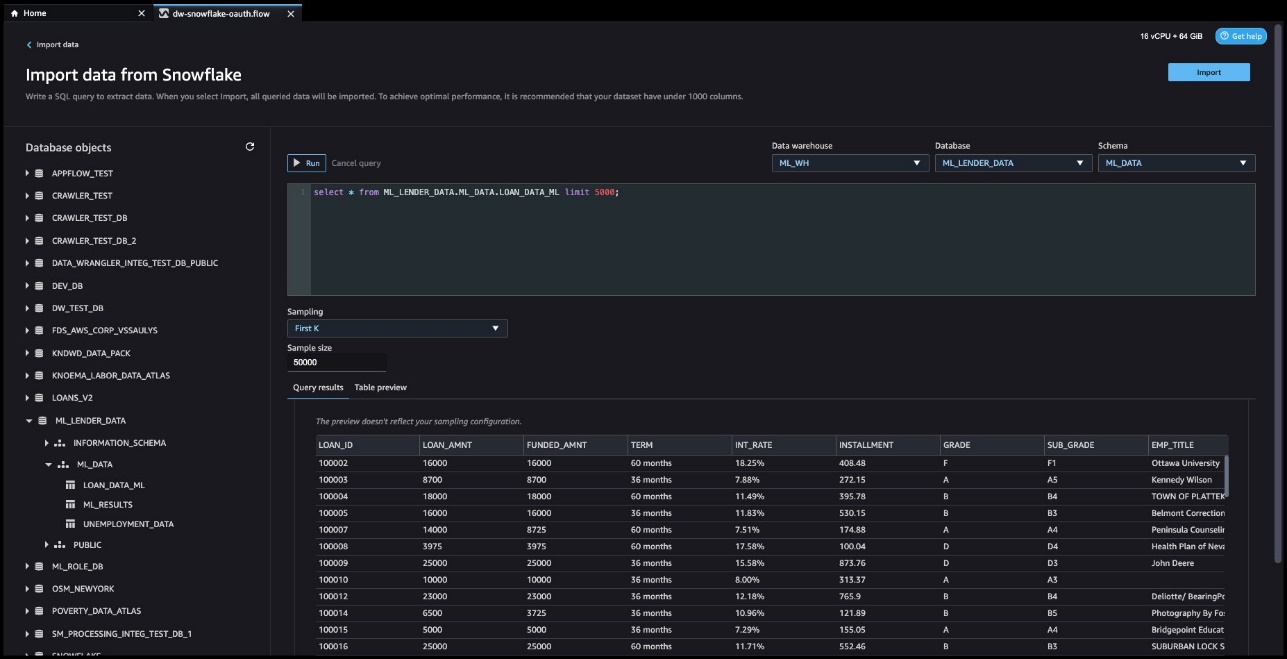

- På Importer data fra Snowflake side, bla gjennom databaseobjektene eller kjør en spørring etter måldataene.

- I spørreeditoren skriver du inn et søk og forhåndsviser resultatene.

I følgende eksempel laster vi Lånedata og hente alle kolonner fra 5,000 rader.

- Velg Import.

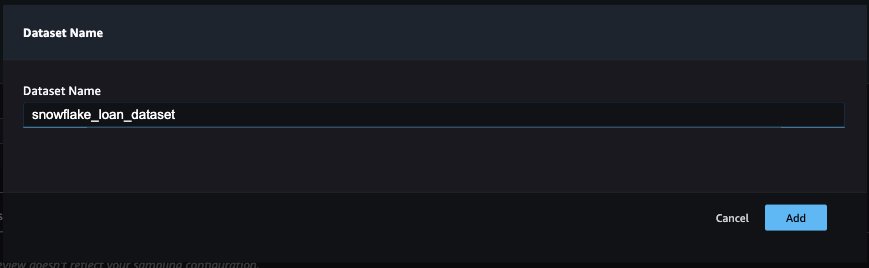

- Skriv inn et datasettnavn (for dette innlegget bruker vi

snowflake_loan_dataset) og velg Legg til.

Du blir omdirigert til Forbered side, hvor du kan legge til transformasjoner og analyser til dataene.

Data Wrangler gjør det enkelt å innta data og utføre dataklargjøringsoppgaver som utforskende dataanalyse, funksjonsvalg og funksjonsutvikling. Vi har bare dekket noen få av funksjonene til Data Wrangler i dette innlegget om dataforberedelse; du kan bruke Data Wrangler for mer avansert dataanalyse som funksjonsviktighet, mållekkasje og modellforklaring ved hjelp av et enkelt og intuitivt brukergrensesnitt.

Analyser datakvaliteten

Bruke Rapport om datakvalitet og innsikt for å utføre en analyse av dataene du har importert til Data Wrangler. Data Wrangler oppretter rapporten fra prøvedataene.

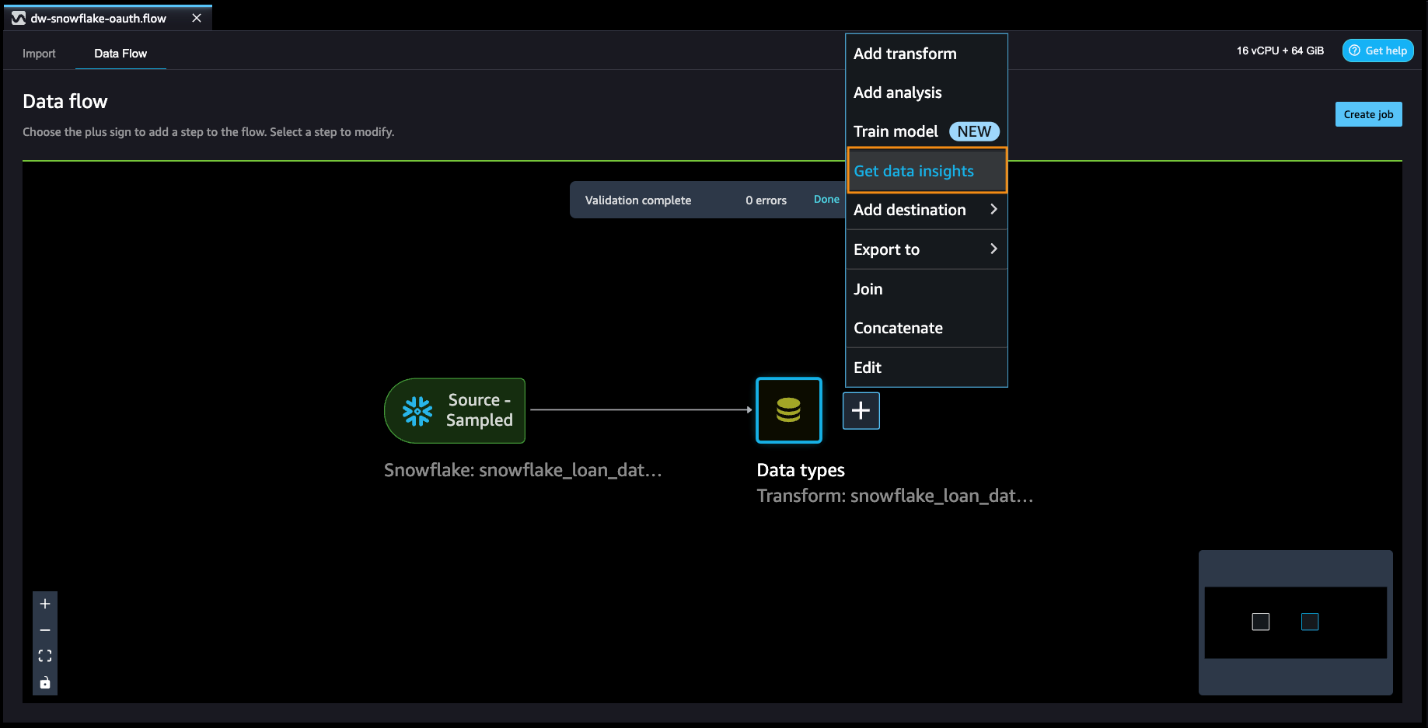

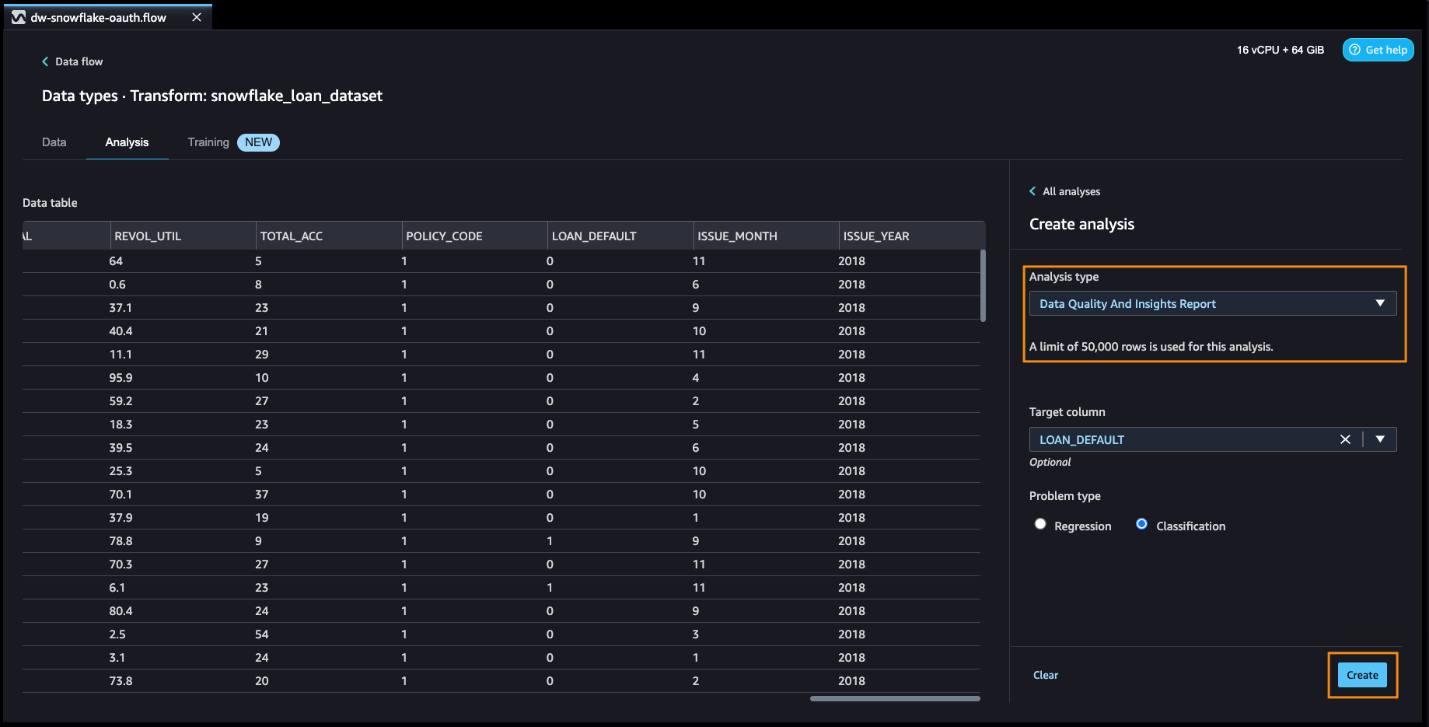

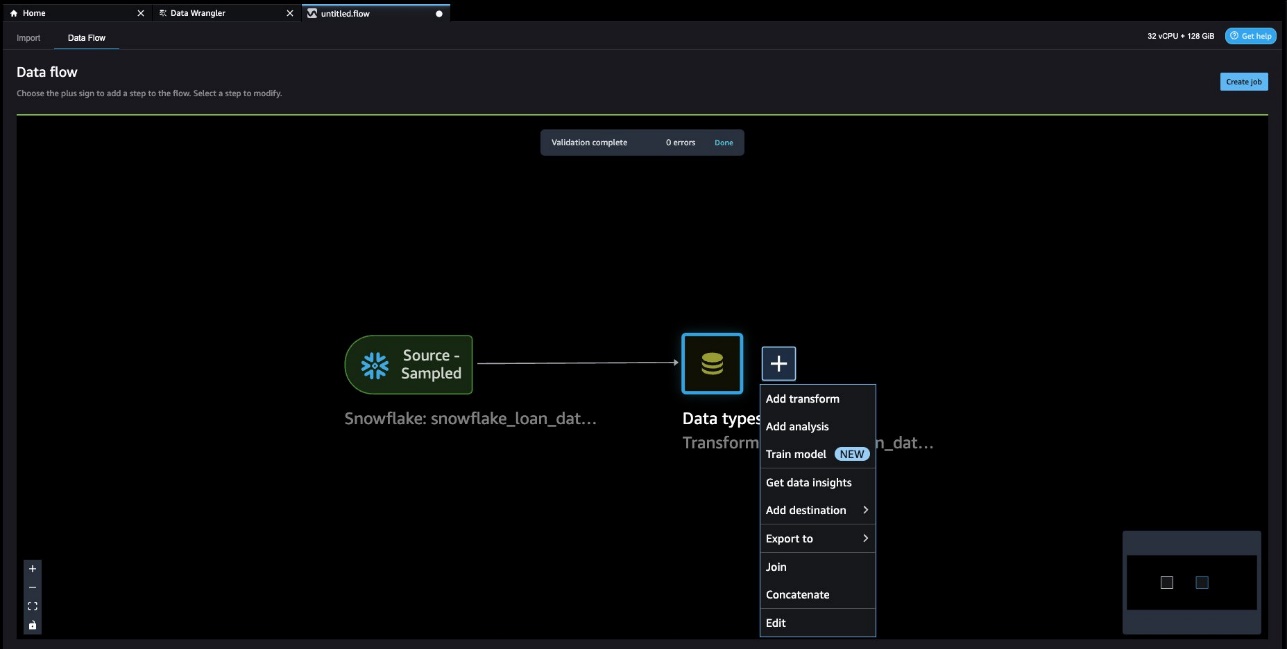

- På Data Wrangler-flytsiden velger du plusstegnet ved siden av Datatyper, velg deretter Få datainnsikt.

- Velg Rapport om datakvalitet og innsikt forum Analysetype.

- Til Målkolonne, velg målkolonnen.

- Til Problemtype, plukke ut Klassifisering.

- Velg Opprett.

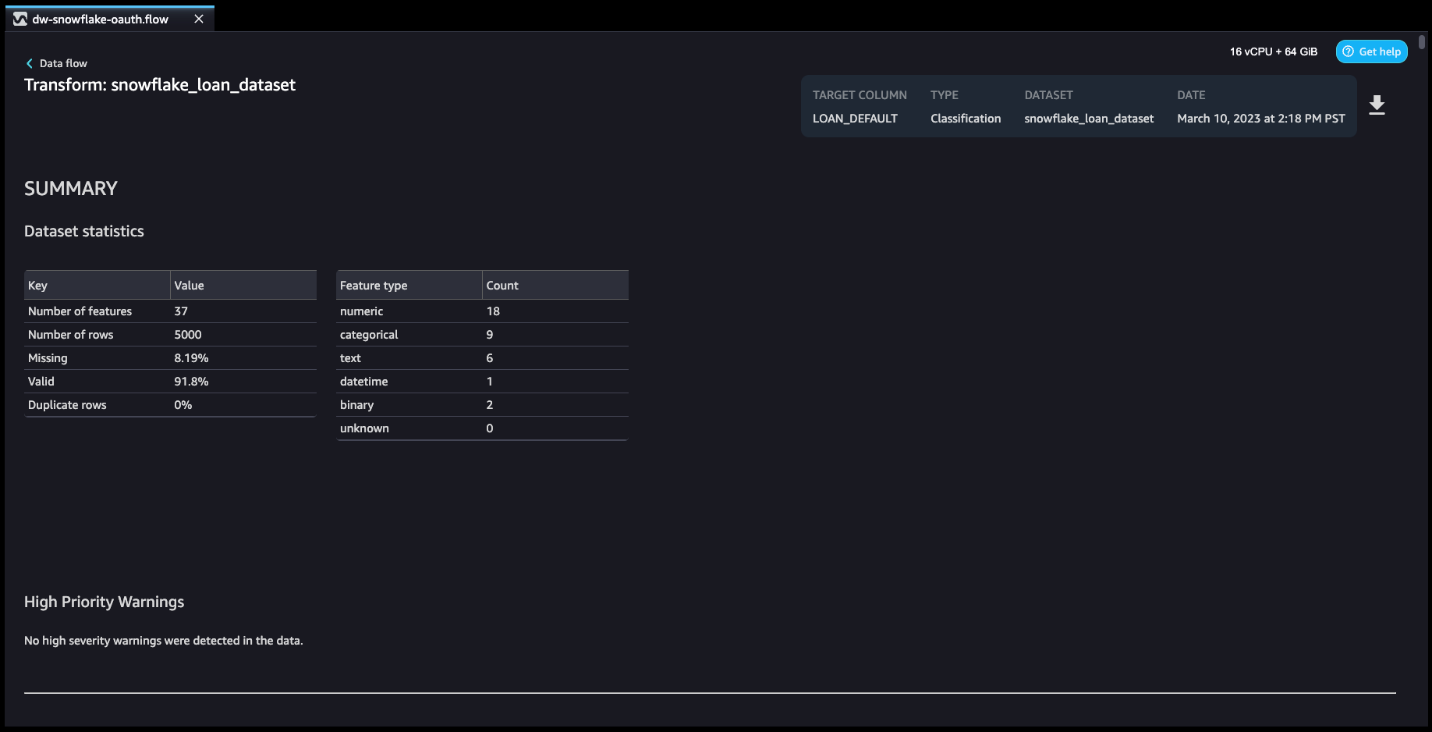

Innsiktsrapporten har en kort oppsummering av dataene, som inkluderer generell informasjon som manglende verdier, ugyldige verdier, funksjonstyper, avvikantall og mer. Du kan enten laste ned rapporten eller se den på nettet.

Legg til transformasjoner i dataene

Data Wrangler har over 300 innebygde transformasjoner. I denne delen bruker vi noen av disse transformasjonene for å forberede datasettet for en ML-modell.

- På Data Wrangler-flytsiden velger du plusstegnet, og deretter velger du Legg til transform.

Hvis du følger trinnene i innlegget, sendes du automatisk hit etter at du har lagt til datasettet.

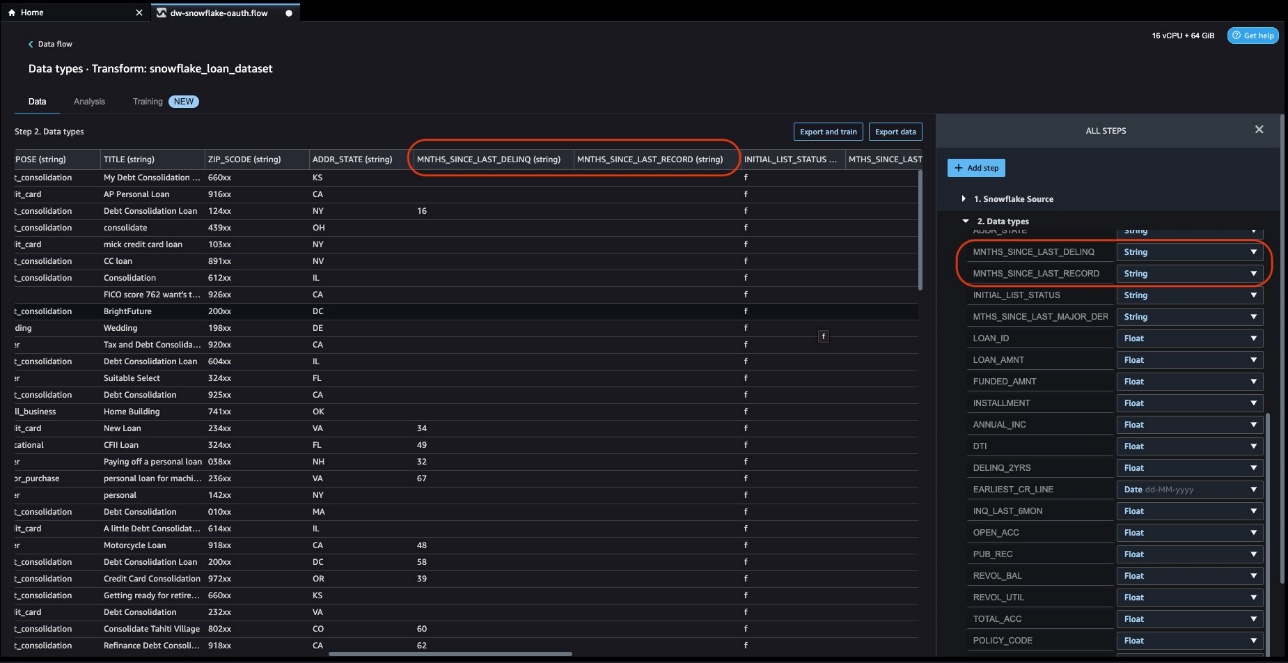

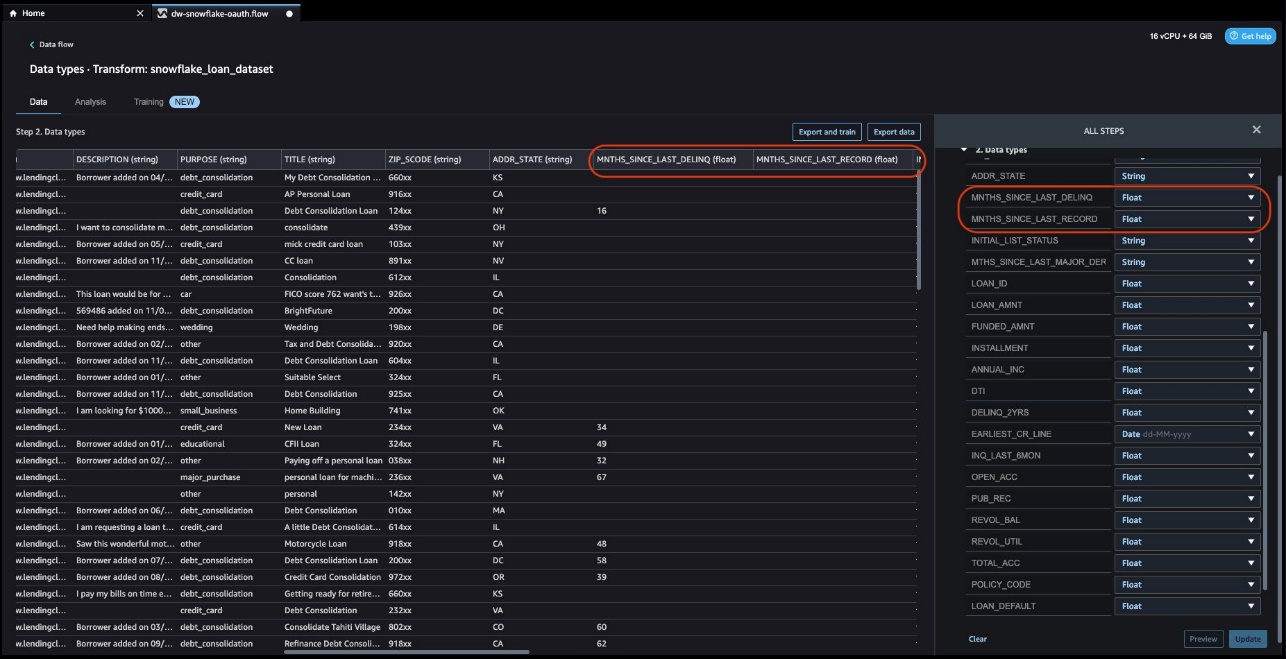

- Bekreft og endre datatypen til kolonnene.

Ser vi gjennom kolonnene, identifiserer vi det MNTHS_SINCE_LAST_DELINQ og MNTHS_SINCE_LAST_RECORD bør mest sannsynlig representeres som en talltype i stedet for streng.

- Etter å ha tatt i bruk endringene og lagt til trinnet, kan du bekrefte at kolonnedatatypen er endret til flytende.

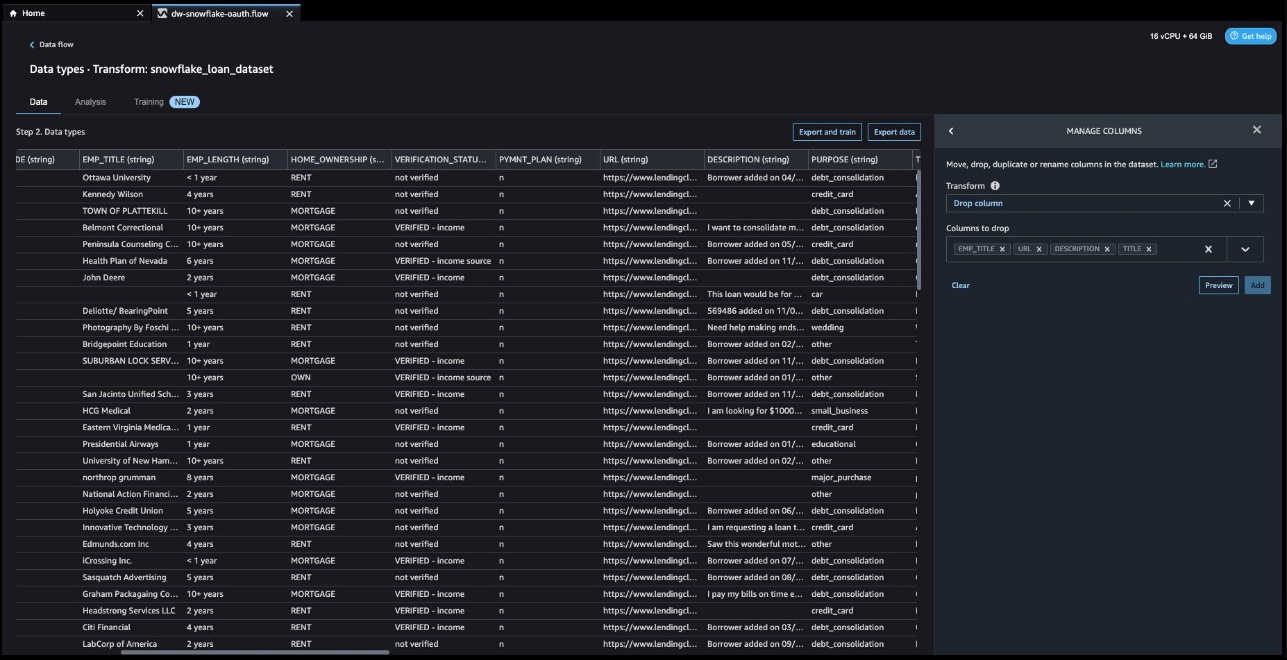

Når vi ser gjennom dataene, kan vi se at feltene EMP_TITLE, URL, DESCRIPTIONog TITLE vil sannsynligvis ikke gi verdi til modellen vår i vårt bruksområde, så vi kan droppe dem.

- Velg Legg til trinn, velg deretter Administrer kolonner.

- Til Transform, velg Slipp kolonne.

- Til Kolonne å slippe, spesifiser

EMP_TITLE,URL,DESCRIPTIONogTITLE. - Velg Forhåndsvisning og Legg til.

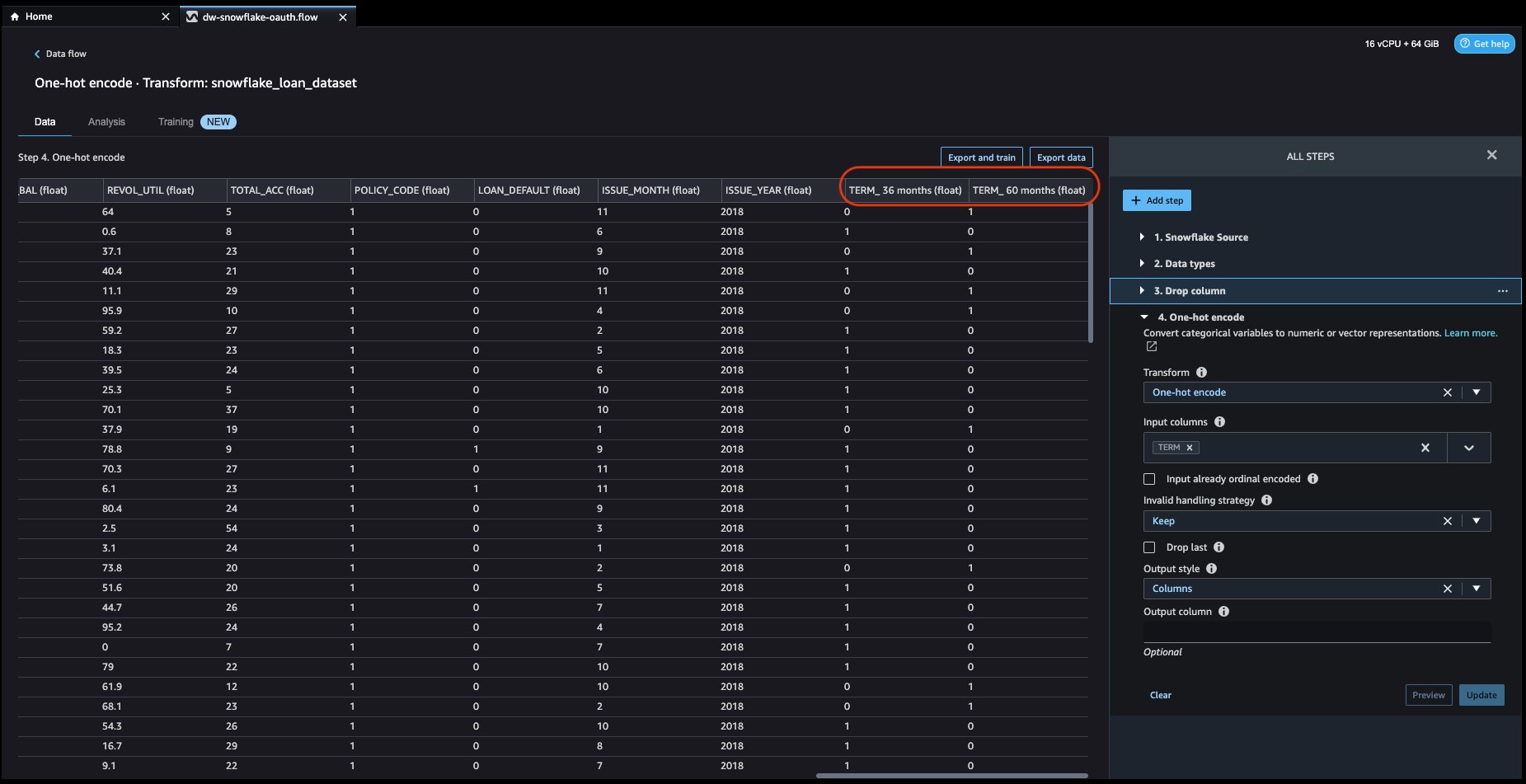

Deretter vil vi se etter kategoriske data i datasettet vårt. Data Wrangler har en innebygd funksjonalitet for å kode kategoriske data ved hjelp av både ordinær og en-hot-koding. Ser vi på datasettet vårt, kan vi se at TERM, HOME_OWNERSHIPog PURPOSE kolonner ser alle ut til å være kategoriske.

- Legg til et nytt trinn og velg Kode kategorisk.

- Til Transform, velg En-varm koding.

- Til Inndatakolonne, velg

TERM. - Til Utgangsstil, velg kolonner.

- La alle andre innstillinger være standard, og velg deretter Forhåndsvisning og Legg til.

De HOME_OWNERSHIP kolonne har fire mulige verdier: RENT, MORTGAGE, OWN, og annen.

- Gjenta de foregående trinnene for å bruke en én-varm-kodingsmetode på disse verdiene.

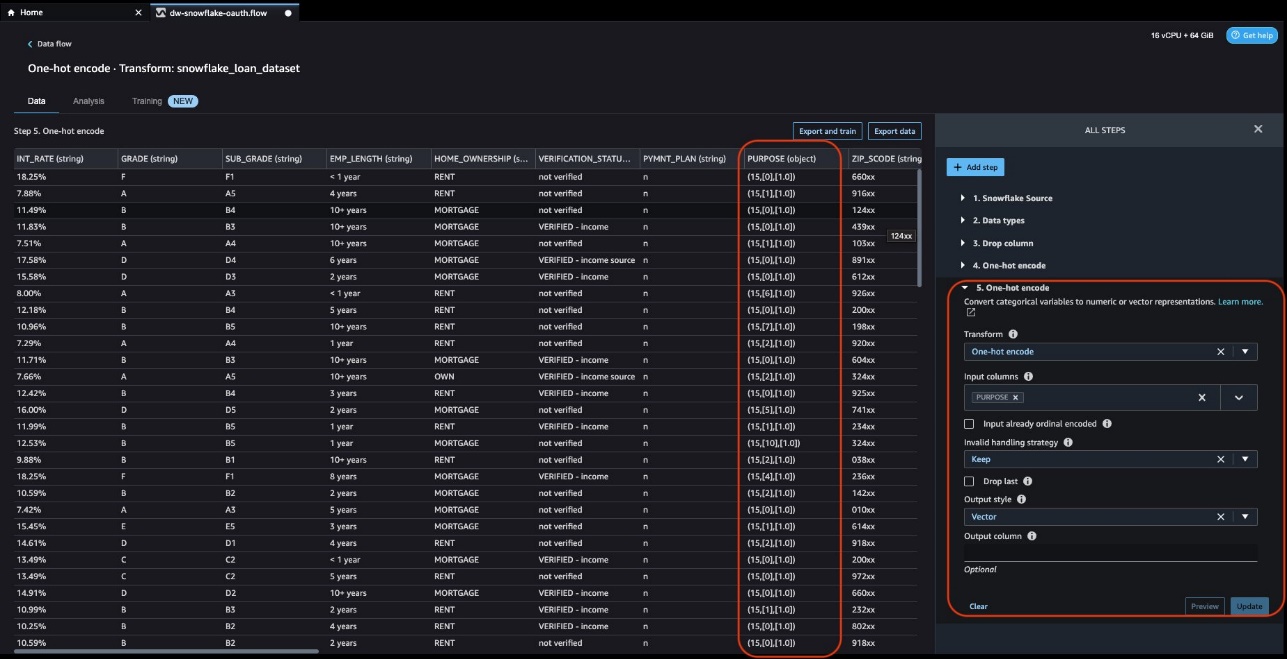

Til slutt, PURPOSE kolonnen har flere mulige verdier. For disse dataene bruker vi også en one-hot-kodingstilnærming, men vi setter utdata til en vektor i stedet for kolonner.

- Til Transform, velg En-varm koding.

- Til Inndatakolonne, velg

PURPOSE. - Til Utgangsstil, velg vektor.

- Til Utdatakolonne, vi kaller denne kolonnen

PURPOSE_VCTR.

Dette beholder originalen PURPOSE kolonne, hvis vi bestemmer oss for å bruke den senere.

- La alle andre innstillinger være standard, og velg deretter Forhåndsvisning og Legg til.

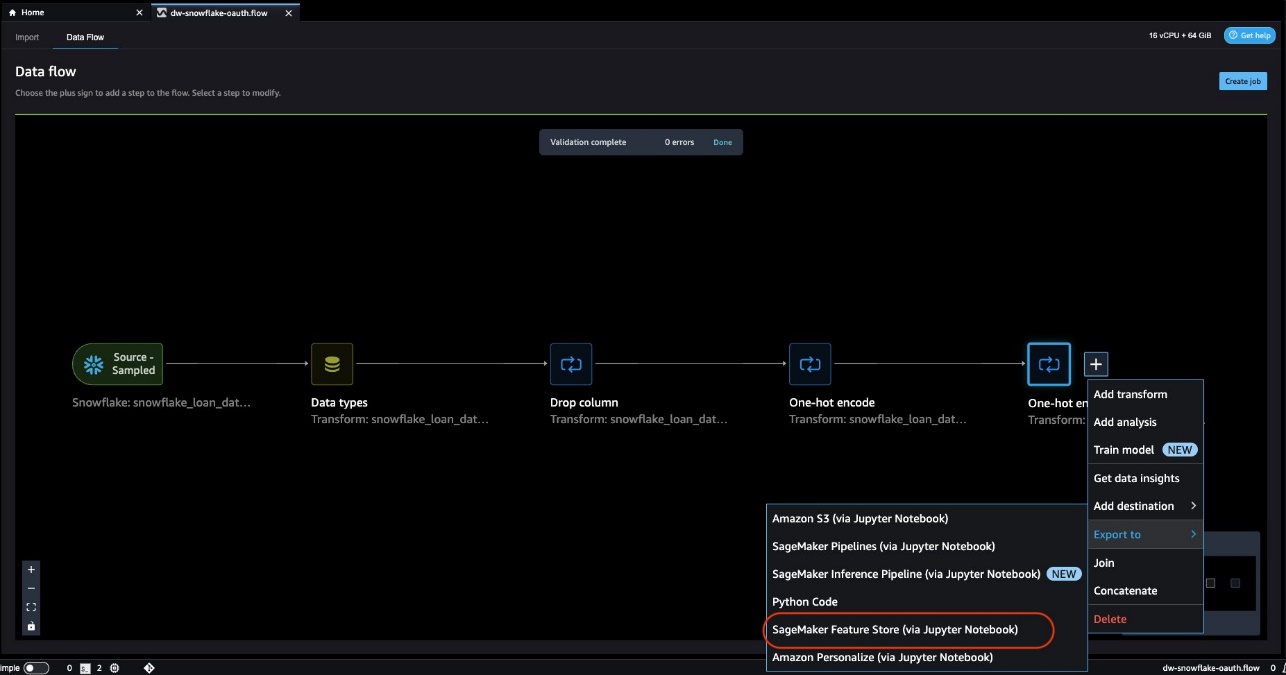

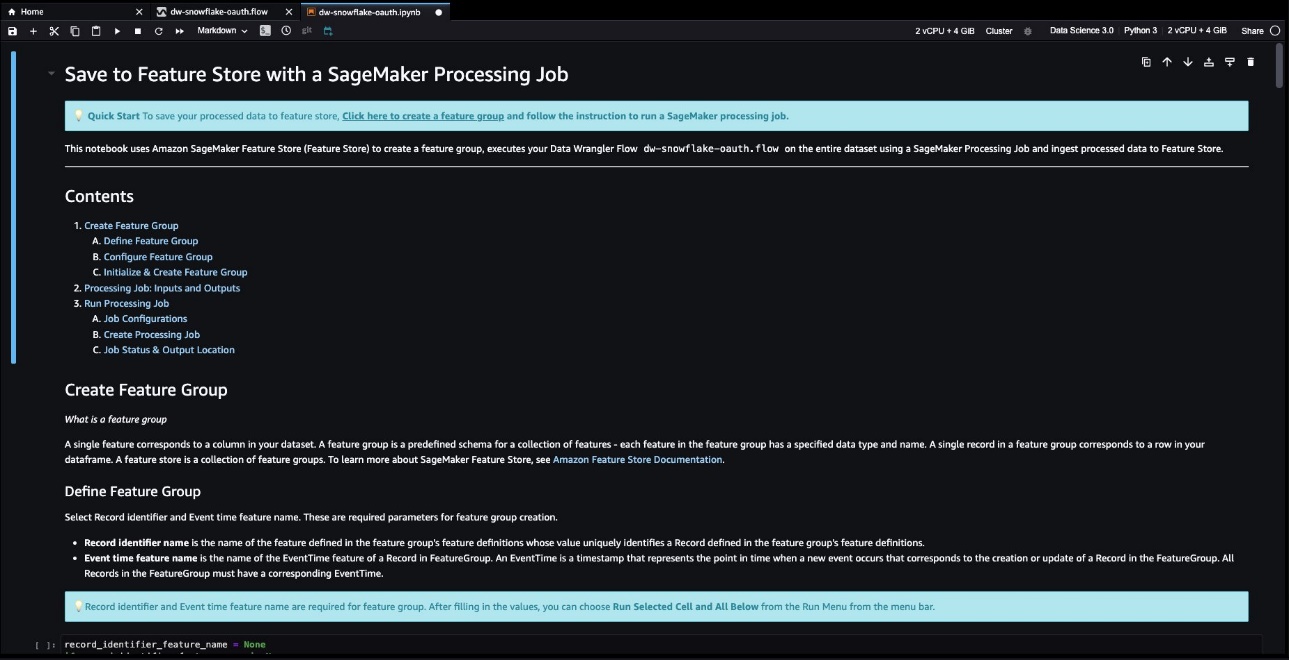

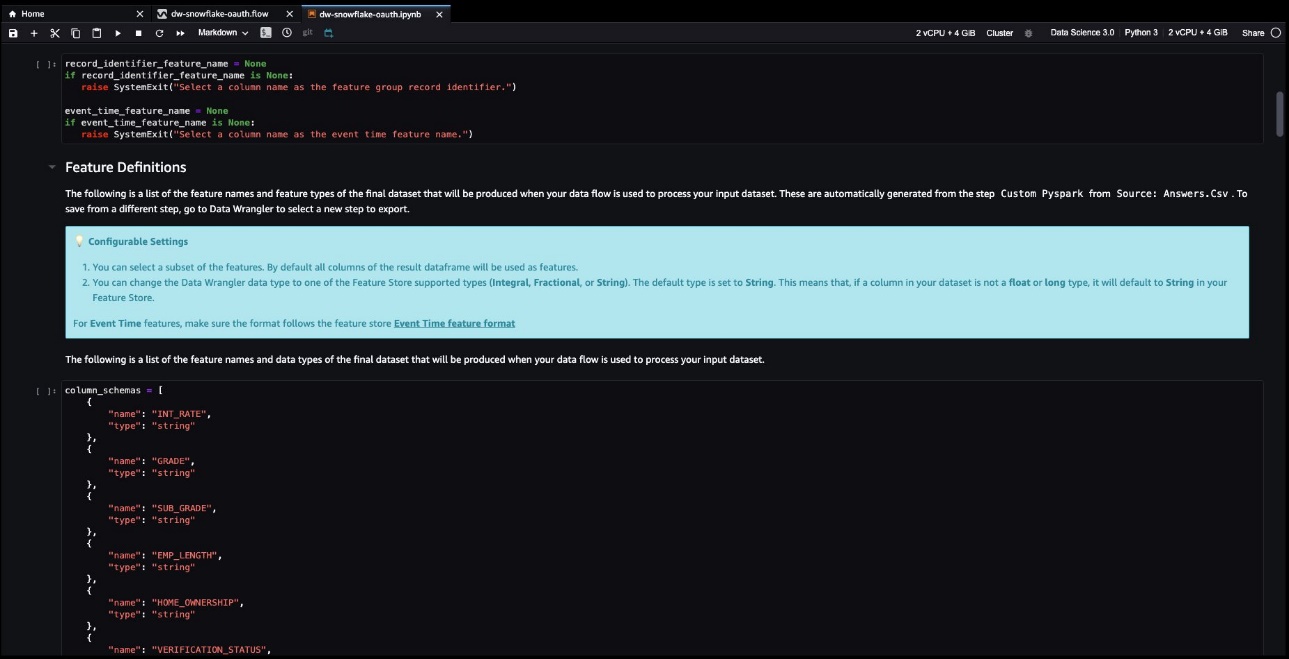

Eksporter datastrømmen

Til slutt eksporterer vi hele denne datastrømmen til en funksjonsbutikk med en SageMaker Processing-jobb, som lager en Jupyter-notisbok med koden forhåndsutfylt.

- På dataflytsiden velger du plusstegnet og Eksport til.

- Velg hvor du vil eksportere. For vår brukssituasjon velger vi SageMaker Feature Store.

Den eksporterte notatboken er nå klar til å kjøre.

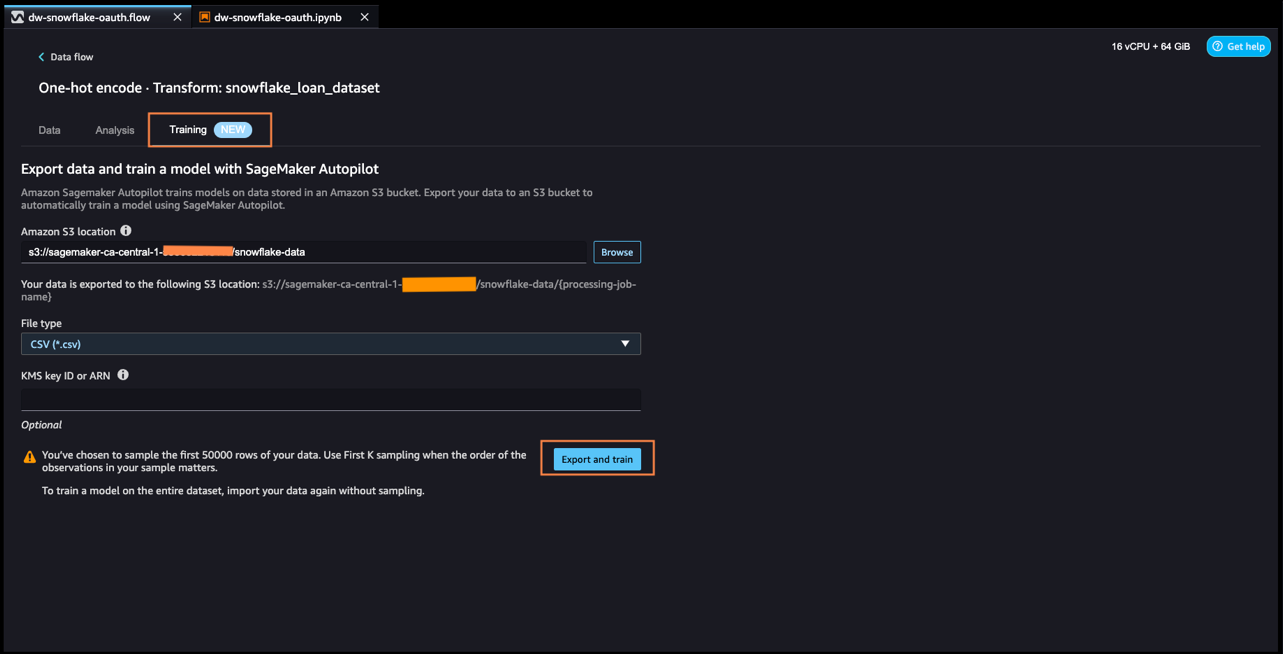

Eksporter data og tren en modell med autopilot

Nå kan vi trene modellen vha Amazon SageMaker Autopilot.

- På dataflytsiden velger du Kurs fanen.

- Til Amazon S3 plassering, skriv inn et sted for dataene som skal lagres.

- Velg Eksporter og trener.

- Angi innstillingene i Mål og funksjoner, Treningsmetode, Implementering og forhåndsinnstillingerog Gjennomgå og opprett seksjoner.

- Velg Lag eksperiment for å finne den beste modellen for problemet ditt.

Rydd opp

Hvis arbeidet ditt med Data Wrangler er fullført, slå av Data Wrangler-forekomsten for å unngå å pådra seg ekstra avgifter.

konklusjonen

I dette innlegget demonstrerte vi tilkobling Data Wrangler til Snowflake ved hjelp av OAuth, transformere og analysere et datasett, og til slutt eksportere det til dataflyten slik at det kan brukes i en Jupyter-notatbok. Mest bemerkelsesverdig laget vi en pipeline for dataforberedelse uten å måtte skrive noen kode i det hele tatt.

For å komme i gang med Data Wrangler, se Forbered ML-data med Amazon SageMaker Data Wrangler.

Om forfatterne

Ajjay Govindaram er Senior Solutions Architect hos AWS. Han jobber med strategiske kunder som bruker AI/ML for å løse komplekse forretningsproblemer. Hans erfaring ligger i å gi teknisk veiledning samt designassistanse for beskjedne til storskala AI/ML-applikasjoner. Kunnskapen hans spenner fra applikasjonsarkitektur til big data, analyser og maskinlæring. Han liker å lytte til musikk mens han hviler, opplever utendørs og tilbringe tid med sine kjære.

Ajjay Govindaram er Senior Solutions Architect hos AWS. Han jobber med strategiske kunder som bruker AI/ML for å løse komplekse forretningsproblemer. Hans erfaring ligger i å gi teknisk veiledning samt designassistanse for beskjedne til storskala AI/ML-applikasjoner. Kunnskapen hans spenner fra applikasjonsarkitektur til big data, analyser og maskinlæring. Han liker å lytte til musikk mens han hviler, opplever utendørs og tilbringe tid med sine kjære.

Bosco Albuquerque er en Sr. Partner Solutions Architect hos AWS og har over 20 års erfaring i å jobbe med database- og analyseprodukter fra bedriftsdatabaseleverandører og skyleverandører. Han har hjulpet store teknologiselskaper med å designe dataanalyseløsninger og har ledet ingeniørteam med å designe og implementere dataanalyseplattformer og dataprodukter.

Bosco Albuquerque er en Sr. Partner Solutions Architect hos AWS og har over 20 års erfaring i å jobbe med database- og analyseprodukter fra bedriftsdatabaseleverandører og skyleverandører. Han har hjulpet store teknologiselskaper med å designe dataanalyseløsninger og har ledet ingeniørteam med å designe og implementere dataanalyseplattformer og dataprodukter.

Matt Marzillo er Sr. Partner Sales Engineer hos Snowflake. Han har 10 års erfaring innen datavitenskap og maskinlæringsroller både i rådgivning og med bransjeorganisasjoner. Matt har erfaring med å utvikle og distribuere AI- og ML-modeller på tvers av mange forskjellige organisasjoner innen områder som markedsføring, salg, drift, klinisk og finans, samt rådgivning i konsulentroller.

Matt Marzillo er Sr. Partner Sales Engineer hos Snowflake. Han har 10 års erfaring innen datavitenskap og maskinlæringsroller både i rådgivning og med bransjeorganisasjoner. Matt har erfaring med å utvikle og distribuere AI- og ML-modeller på tvers av mange forskjellige organisasjoner innen områder som markedsføring, salg, drift, klinisk og finans, samt rådgivning i konsulentroller.

Huong Nguyen er produktleder for Amazon SageMaker Data Wrangler hos AWS. Hun har 15 års erfaring med å lage kundebesatte og datadrevne produkter for både bedrifts- og forbrukerrom. På fritiden liker hun lydbøker, hagearbeid, fotturer og tilbringe tid med familie og venner.

Huong Nguyen er produktleder for Amazon SageMaker Data Wrangler hos AWS. Hun har 15 års erfaring med å lage kundebesatte og datadrevne produkter for både bedrifts- og forbrukerrom. På fritiden liker hun lydbøker, hagearbeid, fotturer og tilbringe tid med familie og venner.

- SEO-drevet innhold og PR-distribusjon. Bli forsterket i dag.

- Platoblokkkjede. Web3 Metaverse Intelligence. Kunnskap forsterket. Tilgang her.

- kilde: https://aws.amazon.com/blogs/machine-learning/access-snowflake-data-using-oauth-based-authentication-in-amazon-sagemaker-data-wrangler/

- :er

- $OPP

- 000

- 10

- 100

- 15 år

- 20 år

- 7

- 8

- 9

- a

- I stand

- Om oss

- adgang

- Tilgang til data

- Tilgang

- Logg inn

- tvers

- Ad

- tillegg

- Ytterligere

- admin

- avansere

- avansert

- rådgivning

- Etter

- AI

- AI / ML

- Alle

- Amazon

- Amazon SageMaker

- Amazon SageMaker Data Wrangler

- analyser

- analyse

- analytics

- analysere

- analyserer

- og

- En annen

- api

- app

- vises

- Søknad

- Påfør

- påføring

- tilnærming

- apps

- arkitektur

- ER

- områder

- AS

- Assistanse

- assosiert

- At

- feste

- publikum

- lyd

- godkjenne

- Autentisering

- autorisasjon

- automatisere

- automatisk

- AWS

- Azure

- BE

- fordi

- før du

- begynne

- BEST

- Stor

- Store data

- kroppen

- bøker

- innebygd

- virksomhet

- by

- ring

- som heter

- CAN

- evner

- saken

- CAT

- Endringer

- valg

- Velg

- kunde

- Klinisk

- Cloud

- kode

- Kolonne

- kolonner

- Selskaper

- fullføre

- komplekse

- konsept

- Konfigurasjon

- Koble

- Tilkobling

- tilkobling

- Konsoll

- konsulent

- forbruker

- innhold

- kunne

- dekke

- dekket

- skape

- opprettet

- skaper

- Opprette

- Credentials

- Kunder

- dato

- dataanalyse

- Data Analytics

- Dataplattform

- Dataklargjøring

- datavitenskap

- dataforsker

- data-drevet

- Database

- bestemme

- Misligholde

- demonstrert

- utplasserings

- distribusjoner

- utforming

- utforme

- detalj

- detaljer

- utvikle

- forskjellig

- retning

- direkte

- distinkt

- dokumentasjon

- ikke

- domene

- ikke

- ned

- nedlasting

- Drop

- hver enkelt

- redaktør

- effekt

- enten

- muliggjøre

- ingeniør

- Ingeniørarbeid

- Enter

- Enterprise

- Miljø

- eksempel

- eksisterende

- erfaring

- opplever

- Utforskende dataanalyse

- eksportere

- utvendig

- FAIL

- familie

- Trekk

- Egenskaper

- avgifter

- Noen få

- felt

- Felt

- filet

- Endelig

- finansiere

- Finn

- Flyte

- flyten

- etter

- Til

- format

- Frekvens

- ofte

- venner

- fra

- funksjonalitet

- general

- få

- gir

- innvilge

- større

- Guider

- Ha

- å ha

- hjelpe

- hjulpet

- her.

- Hjemprodukt

- Hvordan

- Hvordan

- HTML

- http

- HTTPS

- ID

- identifikator

- identifisere

- Identitet

- Idle

- implementere

- importere

- betydning

- in

- inkluderer

- Inkludert

- feil

- industri

- informasjon

- inngang

- innsikt

- innsikt

- instruksjoner

- integrering

- integrasjoner

- Interface

- intuitiv

- involvert

- IT

- Jobb

- Jobb

- jpg

- nøkkel

- kunnskap

- stor

- storskala

- leder

- læring

- Led

- ligger

- Livssyklus

- livstid

- i likhet med

- Sannsynlig

- Liste

- Lytting

- laste

- laster

- plassering

- Se

- ser

- elsket

- maskin

- maskinlæring

- laget

- gjøre

- GJØR AT

- Making

- leder

- mange

- Marketing

- melding

- kunne

- minutter

- mangler

- ML

- modell

- modeller

- modifisere

- mer

- mest

- flere

- musikk

- navn

- navn

- Natur

- Navigasjon

- Trenger

- trenger

- behov

- Ny

- neste

- spesielt

- bærbare

- Antall

- oauth

- gjenstander

- of

- OKTA

- on

- ONE

- på nett

- Drift

- Alternativ

- organisasjoner

- original

- Annen

- ellers

- utendørs

- produksjon

- egen

- side

- par

- brød

- partner

- Passord

- Utfør

- tillatelser

- personlig

- rørledning

- plattform

- Plattformer

- plato

- Platon Data Intelligence

- PlatonData

- i tillegg til

- Politikk

- pop-up

- mulig

- Post

- trekkes

- Forbered

- forutsetninger

- Forhåndsvisning

- forrige

- Problem

- problemer

- prosedyrer

- prosess

- prosessering

- Produkt

- Produkter

- Profil

- Programmering

- riktig

- gi

- forutsatt

- leverandør

- tilbydere

- gir

- gi

- kvalitet

- heller

- klar

- anbefaler

- omdirigere

- redusere

- region

- registrere

- registrering

- Registrering

- relansering

- rapporterer

- representert

- krever

- de

- REST

- resultere

- Resultater

- detaljhandel

- Rolle

- roller

- Kjør

- rennende

- sagemaker

- salg

- planlegging

- Vitenskap

- Forsker

- forskere

- omfang

- Secret

- Seksjon

- seksjoner

- sikkerhet

- utvalg

- senior

- Følsomhet

- sett

- innstilling

- innstillinger

- flere

- Shell

- bør

- Vis

- undertegne

- Enkelt

- enkelt

- So

- Solutions

- LØSE

- noen

- kilde

- Kilder

- mellomrom

- utgifter

- startet

- starter

- Trinn

- Steps

- lagring

- oppbevare

- lagret

- lagring

- Strategisk

- String

- studio

- vellykket

- slik

- SAMMENDRAG

- støtte

- Støtter

- TAG

- Ta

- tar

- Target

- målrettet

- oppgaver

- lag

- Teknisk

- Teknologi

- teknologiselskaper

- Det

- De

- informasjonen

- deres

- Dem

- Disse

- Gjennom

- tid

- til

- token

- tokens

- Tog

- Transform

- transformasjoner

- transformere

- typer

- etter

- forstå

- unik

- Oppdater

- URL

- bruke

- bruk sak

- Bruker

- Brukergrensesnitt

- Brukere

- verdi

- Verdier

- leverandører

- verifisere

- av

- Se

- synlig

- walkthrough

- advarsel

- uker

- VI VIL

- hvilken

- mens

- HVEM

- hele

- vil

- med

- innenfor

- uten

- Arbeid

- arbeidsflyt

- arbeid

- virker

- skrive

- skriving

- år

- Du

- Din

- zephyrnet