Kunder i alle størrelser og bransjer innoverer på AWS ved å tilføre maskinlæring (ML) i produktene og tjenestene deres. Nylig utvikling innen generative AI-modeller har ytterligere fremskyndet behovet for ML-adopsjon på tvers av bransjer. Implementering av sikkerhet, datapersonvern og styringskontroller er imidlertid fortsatt sentrale utfordringer som kunder står overfor når de implementerer ML-arbeidsmengder i stor skala. Å takle disse utfordringene bygger rammeverket og grunnlaget for å redusere risiko og ansvarlig bruk av ML-drevne produkter. Selv om generativ AI kan trenge ytterligere kontroller på plass, for eksempel å fjerne toksisitet og forhindre jailbreaking og hallusinasjoner, deler den de samme grunnleggende komponentene for sikkerhet og styring som tradisjonell ML.

Vi hører fra kunder at de krever spesialkunnskap og investering på opptil 12 måneder for å bygge ut sine tilpassede Amazon SageMaker ML-plattformimplementering for å sikre skalerbare, pålitelige, sikre og styrte ML-miljøer for deres bransjer (LOB) eller ML-team. Hvis du mangler et rammeverk for å styre ML-livssyklusen i stor skala, kan du støte på utfordringer som ressursisolering på teamnivå, skalering av eksperimenteringsressurser, operasjonalisering av ML-arbeidsflyter, skalering av modellstyring og administrasjon av sikkerhet og overholdelse av ML-arbeidsbelastninger.

Styrende ML-livssyklus i stor skala er et rammeverk for å hjelpe deg med å bygge en ML-plattform med innebygde sikkerhets- og styringskontroller basert på bransjebestemmelser og bedriftsstandarder. Dette rammeverket adresserer utfordringer ved å gi preskriptiv veiledning gjennom en modulær rammetilnærming som utvider en AWS kontrolltårn multi-account AWS-miljø og tilnærmingen diskutert i innlegget Sette opp sikre, godt styrte maskinlæringsmiljøer på AWS.

Den gir foreskrivende veiledning for følgende ML-plattformfunksjoner:

- Grunnlag for flere kontoer, sikkerhet og nettverk – Denne funksjonen bruker AWS Control Tower og godt utformede prinsipper for å sette opp og drifte flerkontomiljø, sikkerhet og nettverkstjenester.

- Data- og styringsstiftelser – Denne funksjonen bruker en datanettingsarkitektur for å sette opp og drifte datainnsjøen, sentralt funksjonslager og datastyringsfundamenter for å muliggjøre finmasket datatilgang.

- ML-plattform delt og styringstjenester – Denne funksjonen gjør det mulig å sette opp og betjene vanlige tjenester som CI/CD, AWS servicekatalog for leveringsmiljøer, og et sentralt modellregister for modellpromotering og avstamning.

- ML teammiljøer – Denne funksjonen gjør det mulig å sette opp og drifte miljøer for ML-team for modellutvikling, testing og distribusjon av deres brukstilfeller for å bygge inn sikkerhets- og styringskontroller.

- ML-plattform observerbarhet – Denne funksjonen hjelper med feilsøking og identifisering av grunnårsaken til problemer i ML-modeller gjennom sentralisering av logger og verktøy for visualisering av logganalyse. Den gir også veiledning for å generere kostnads- og bruksrapporter for ML-brukstilfeller.

Selv om dette rammeverket kan gi fordeler for alle kunder, er det mest fordelaktig for store, modne, regulerte eller globale bedriftskunder som ønsker å skalere sine ML-strategier i en kontrollert, kompatibel og koordinert tilnærming på tvers av organisasjonen. Det bidrar til å muliggjøre ML-adopsjon samtidig som det reduserer risikoer. Dette rammeverket er nyttig for følgende kunder:

- Store bedriftskunder som har mange LOBer eller avdelinger som er interessert i å bruke ML. Dette rammeverket lar forskjellige team bygge og distribuere ML-modeller uavhengig samtidig som de gir sentral styring.

- Enterprise-kunder med moderat til høy modenhet i ML. De har allerede distribuert noen innledende ML-modeller og ser etter å skalere ML-innsatsen. Dette rammeverket kan bidra til å akselerere ML-adopsjon på tvers av organisasjonen. Disse selskapene anerkjenner også behovet for styring for å administrere ting som tilgangskontroll, databruk, modellytelse og urettferdig skjevhet.

- Selskaper i regulerte bransjer som finansielle tjenester, helsevesen, kjemi og privat sektor. Disse selskapene trenger sterk styring og hørbarhet for alle ML-modeller som brukes i deres forretningsprosesser. Å ta i bruk dette rammeverket kan bidra til å lette etterlevelsen, samtidig som det gir mulighet for lokal modellutvikling.

- Globale organisasjoner som trenger å balansere sentralisert og lokal kontroll. Dette rammeverkets fødererte tilnærming lar det sentrale plattformingeniørteamet sette noen retningslinjer og standarder på høyt nivå, men gir også LOB-team fleksibilitet til å tilpasse seg basert på lokale behov.

I den første delen av denne serien går vi gjennom referansearkitekturen for å sette opp ML-plattformen. I et senere innlegg vil vi gi preskriptiv veiledning for hvordan du implementerer de ulike modulene i referansearkitekturen i din organisasjon.

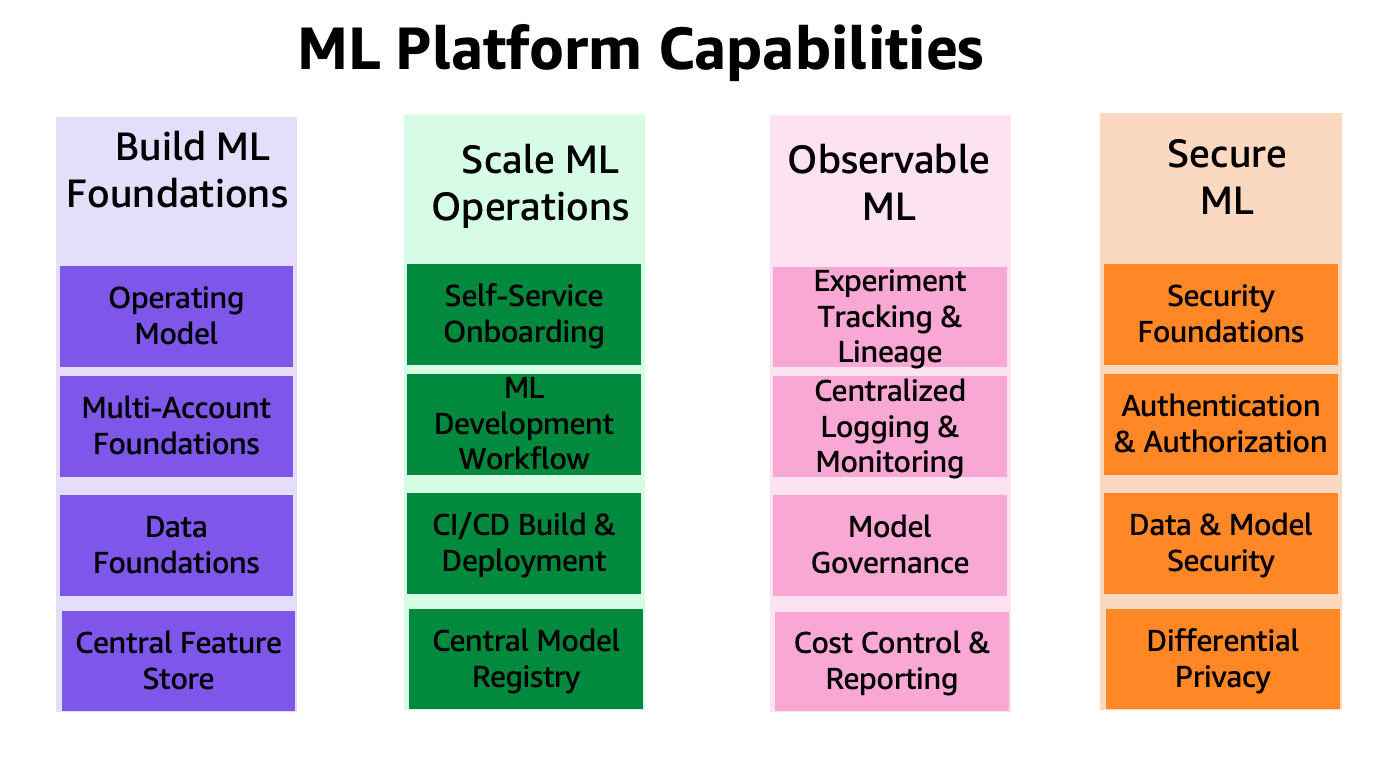

Mulighetene til ML-plattformen er gruppert i fire kategorier, som vist i følgende figur. Disse egenskapene danner grunnlaget for referansearkitekturen diskutert senere i dette innlegget:

- Bygg ML-fundamenter

- Skaler ML-operasjoner

- Observerbar ML

- Sikker ML

Løsningsoversikt

Rammeverket for å styre ML-livssyklus i skala-rammeverket gjør det mulig for organisasjoner å bygge inn sikkerhets- og styringskontroller gjennom hele ML-livssyklusen, som igjen hjelper organisasjoner med å redusere risiko og akselerere infusjon av ML i produktene og tjenestene deres. Rammeverket hjelper til med å optimalisere oppsettet og styringen av sikre, skalerbare og pålitelige ML-miljøer som kan skaleres for å støtte et økende antall modeller og prosjekter. Rammeverket muliggjør følgende funksjoner:

- Konto- og infrastrukturklargjøring med organisasjonspolicy-kompatible infrastrukturressurser

- Selvbetjent distribusjon av datavitenskapelige miljøer og ende-til-ende ML-operasjoner (MLOps) maler for ML-brukstilfeller

- Isolering av ressurser på LOB-nivå eller teamnivå for overholdelse av sikkerhet og personvern

- Styrt tilgang til produksjonsgradsdata for eksperimentering og produksjonsklare arbeidsflyter

- Ledelse og styring for kodelagre, kodepipelines, distribuerte modeller og datafunksjoner

- Et modellregister og funksjonslager (lokale og sentrale komponenter) for å forbedre styringen

- Sikkerhets- og styringskontroller for ende-til-ende modellutvikling og distribusjonsprosessen

I denne delen gir vi en oversikt over foreskrivende veiledning for å hjelpe deg med å bygge denne ML-plattformen på AWS med innebygde sikkerhets- og styringskontroller.

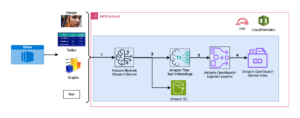

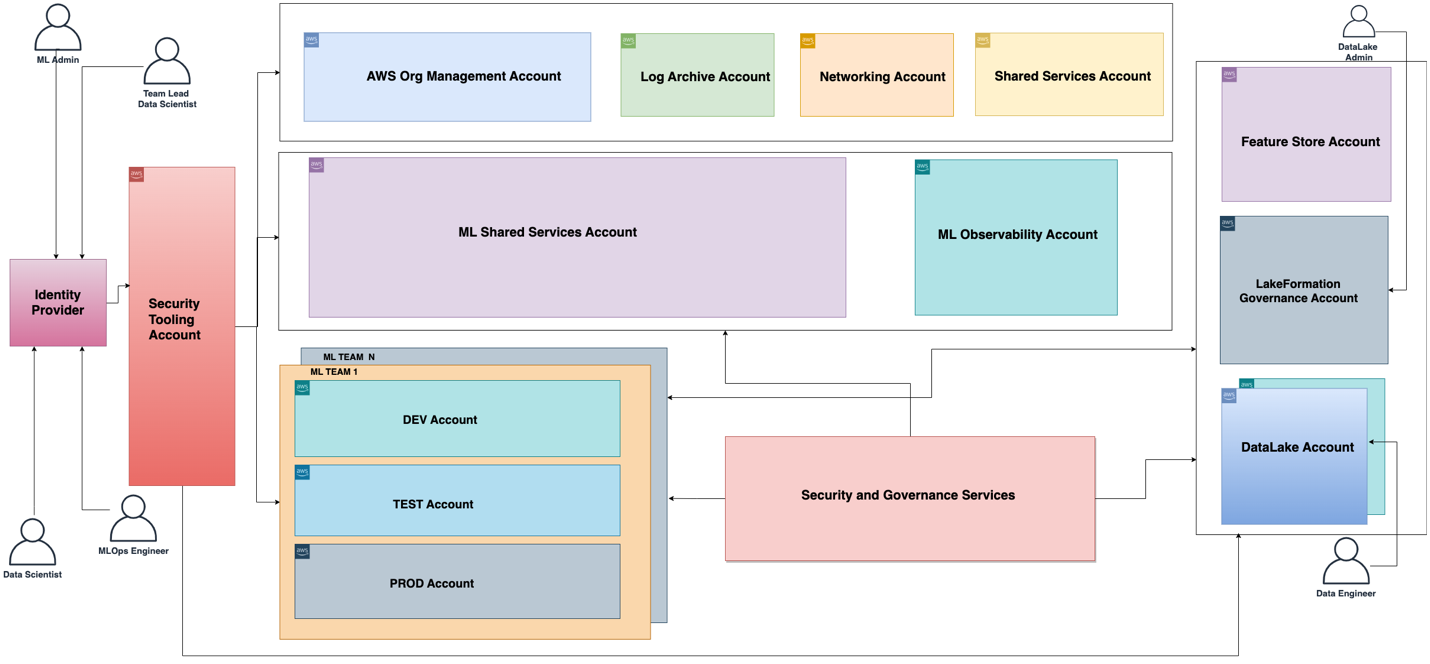

Den funksjonelle arkitekturen knyttet til ML-plattformen er vist i følgende diagram. Arkitekturen kartlegger de forskjellige egenskapene til ML-plattformen til AWS-kontoer.

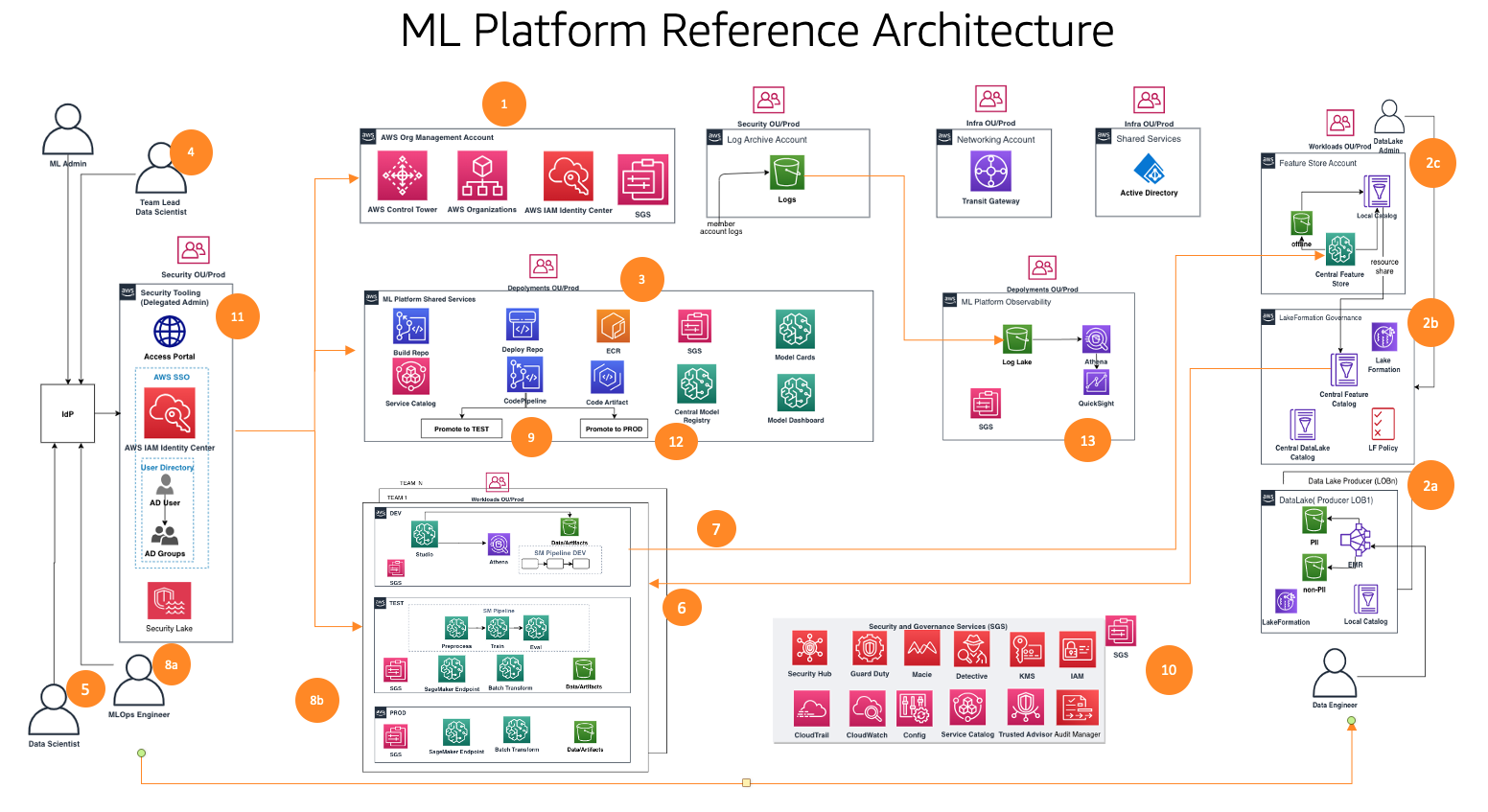

Den funksjonelle arkitekturen med ulike muligheter implementeres ved hjelp av en rekke AWS-tjenester, bl.a AWS organisasjoner, SageMaker, AWS DevOps-tjenester og en datainnsjø. Referansearkitekturen for ML-plattformen med ulike AWS-tjenester er vist i følgende diagram.

Dette rammeverket vurderer flere personas og tjenester for å styre ML-livssyklusen i stor skala. Vi anbefaler følgende trinn for å organisere teamene og tjenestene dine:

- Ved å bruke AWS Control Tower og automatiseringsverktøy setter skyadministratoren din opp multikontofundamenter som organisasjoner og AWS IAM Identity Center (etterfølger til AWS Single Sign-On) og sikkerhets- og styringstjenester som f.eks AWS nøkkelstyringstjeneste (AWS KMS) og tjenestekatalog. I tillegg setter administratoren opp en rekke organisasjonsenheter (OUer) og innledende kontoer for å støtte ML- og analysearbeidsflytene dine.

- Datainnsjø-administratorer setter opp datainnsjøen og datakatalogen din, og setter opp det sentrale funksjonslageret i samarbeid med ML-plattformadministratoren.

- ML-plattformens admin tilbyr ML-delte tjenester som f.eks AWS CodeCommit, AWS CodePipeline, Amazon Elastic Container Registry (Amazon ECR), et sentralt modellregister, SageMaker modellkort, SageMaker Model Dashboard, og Service Catalog-produkter for ML-team.

- ML-teamet leder forbund via IAM Identity Center, bruker Service Catalog-produkter og sørger for ressurser i ML-teamets utviklingsmiljø.

- Dataforskere fra ML-team på tvers av ulike forretningsenheter går inn i teamets utviklingsmiljø for å bygge modellpipeline.

- Dataforskere søker og henter funksjoner fra den sentrale funksjonsbutikkkatalogen, bygger modeller gjennom eksperimenter og velger den beste modellen for promotering.

- Dataforskere lager og deler nye funksjoner i den sentrale funksjonsbutikkkatalogen for gjenbruk.

- En ML-ingeniør distribuerer modellpipelinen inn i ML-teamets testmiljø ved å bruke en CI/CD-prosess for delte tjenester.

- Etter interessentvalidering distribueres ML-modellen til teamets produksjonsmiljø.

- Sikkerhets- og styringskontroller er innebygd i hvert lag av denne arkitekturen ved å bruke tjenester som AWS Security Hub, Amazon Guard Duty, Amazon Macie, Og mer.

- Sikkerhetskontroller administreres sentralt fra sikkerhetsverktøykontoen ved hjelp av Security Hub.

- ML-plattformstyringsfunksjoner som SageMaker Model Cards og SageMaker Model Dashboard administreres sentralt fra styringstjenestekontoen.

- Amazon CloudWatch og AWS CloudTrail logger fra hver medlemskonto gjøres tilgjengelig sentralt fra en observasjonskonto ved å bruke AWS native-tjenester.

Deretter dykker vi dypt inn i modulene til referansearkitekturen for dette rammeverket.

Referansearkitekturmoduler

Referansearkitekturen består av åtte moduler, hver utformet for å løse et spesifikt sett med problemer. Til sammen tar disse modulene for seg styring på tvers av ulike dimensjoner, som infrastruktur, data, modell og kostnader. Hver modul tilbyr et distinkt sett med funksjoner og samvirker med andre moduler for å gi en integrert ende-til-ende ML-plattform med innebygde sikkerhets- og styringskontroller. I denne delen presenterer vi en kort oppsummering av hver moduls muligheter.

Stiftelser for flere kontoer

Denne modulen hjelper skyadministratorer med å bygge en AWS Control Tower landingssone som et grunnleggende rammeverk. Dette inkluderer å bygge en flerkontostruktur, autentisering og autorisasjon via IAM Identity Center, en nettverkshub-og-eiker-design, sentraliserte loggingstjenester og nye AWS-medlemskontoer med standardiserte sikkerhets- og styringsgrunnlag.

I tillegg gir denne modulen beste praksisveiledning om OU- og kontostrukturer som er passende for å støtte ML- og analysearbeidsflytene dine. Skyadministratorer vil forstå formålet med de nødvendige kontoene og OU-ene, hvordan de skal distribueres, og viktige sikkerhets- og samsvarstjenester de bør bruke for å sentralt styre ML- og analysearbeidsbelastningene deres.

Et rammeverk for salg av nye kontoer er også dekket, som bruker automatisering for å baseline nye kontoer når de blir klargjort. Ved å sette opp en automatisert kontoklargjøringsprosess, kan skyadministratorer gi ML- og analyseteam kontoene de trenger for å utføre arbeidet sitt raskere, uten å ofre på et sterkt grunnlag for styring.

Datainnsjøfundamenter

Denne modulen hjelper datainnsjø-administratorer med å sette opp en datainnsjø for å innta data, kuratere datasett og bruke AWS Lake formasjon styringsmodell for å administrere finmasket datatilgang på tvers av kontoer og brukere ved hjelp av en sentralisert datakatalog, datatilgangspolicyer og tag-baserte tilgangskontroller. Du kan starte i det små med én konto for grunnlaget for dataplattformen din for et proof of concept eller noen få små arbeidsbelastninger. For middels til stor skala produksjonsarbeidsimplementering anbefaler vi å ta i bruk en flerkontostrategi. I en slik setting kan LOB-er påta seg rollen som dataprodusenter og dataforbrukere ved å bruke forskjellige AWS-kontoer, og datainnsjøstyringen drives fra en sentral delt AWS-konto. Dataprodusenten samler inn, behandler og lagrer data fra deres datadomene, i tillegg til å overvåke og sikre kvaliteten på datamidlene. Dataforbrukere bruker dataene fra dataprodusenten etter at den sentraliserte katalogen deler dem ved hjelp av Lake Formation. Den sentraliserte katalogen lagrer og administrerer den delte datakatalogen for dataprodusentkontoene.

ML-plattformtjenester

Denne modulen hjelper ML-plattformingeniørteamet med å sette opp delte tjenester som brukes av datavitenskapsteamene på teamkontoene deres. Tjenestene inkluderer en tjenestekatalogportefølje med produkter for SageMaker-domene utplassering, SageMaker domene brukerprofil distribusjon, datavitenskapelige modellmaler for modellbygging og utrulling. Denne modulen har funksjoner for et sentralisert modellregister, modellkort, modelldashbord og CI/CD-pipelines som brukes til å orkestrere og automatisere modellutvikling og distribusjonsarbeidsflyter.

I tillegg beskriver denne modulen hvordan man implementerer kontrollene og styringen som kreves for å aktivere personbaserte selvbetjeningsfunksjoner, slik at datavitenskapsteam uavhengig kan distribuere sin nødvendige skyinfrastruktur og ML-maler.

ML brukscaseutvikling

Denne modulen hjelper LOB-er og dataforskere med å få tilgang til teamets SageMaker-domene i et utviklingsmiljø og instansiere en modellbyggingsmal for å utvikle modellene deres. I denne modulen jobber dataforskere med en utviklerkontoforekomst av malen for å samhandle med dataene som er tilgjengelige på den sentraliserte datainnsjøen, gjenbruke og dele funksjoner fra en sentral funksjonsbutikk, lage og kjøre ML-eksperimenter, bygge og teste ML-arbeidsflytene deres, og registrere modellene deres til et modellregister for utviklere i deres utviklingsmiljøer.

Funksjoner som eksperimentsporing, modellforklaringsrapporter, data- og modellbiasovervåking og modellregister er også implementert i malene, noe som muliggjør rask tilpasning av løsningene til dataforskernes utviklede modeller.

ML operasjoner

Denne modulen hjelper LOB-er og ML-ingeniører med å jobbe med deres utviklerforekomster av modellimplementeringsmalen. Etter at kandidatmodellen er registrert og godkjent, setter de opp CI/CD-pipelines og kjører ML-arbeidsflyter i teamets testmiljø, som registrerer modellen i det sentrale modellregisteret som kjører i en plattformdelte tjenester-konto. Når en modell er godkjent i det sentrale modellregisteret, utløser dette en CI/CD-pipeline for å distribuere modellen i teamets produksjonsmiljø.

Sentralisert funksjonsbutikk

Etter at de første modellene er distribuert til produksjon og flere brukstilfeller begynner å dele funksjoner opprettet fra de samme dataene, blir et funksjonslager avgjørende for å sikre samarbeid på tvers av brukstilfeller og redusere duplikatarbeid. Denne modulen hjelper ML-plattformingeniørteamet med å sette opp en sentralisert funksjonsbutikk for å gi lagring og styring for ML-funksjoner opprettet av ML-brukstilfellene, og muliggjør gjenbruk av funksjoner på tvers av prosjekter.

Logging og observerbarhet

Denne modulen hjelper LOB-er og ML-utøvere å få innsyn i tilstanden til ML-arbeidsbelastninger på tvers av ML-miljøer gjennom sentralisering av loggaktivitet som CloudTrail, CloudWatch, VPC-flytlogger og ML-arbeidsbelastningslogger. Team kan filtrere, spørre og visualisere logger for analyse, noe som også kan bidra til å forbedre sikkerheten.

Kostnad og rapportering

Denne modulen hjelper ulike interessenter (skyadministrator, plattformadministrator, skyforretningskontor) med å generere rapporter og dashbord for å bryte ned kostnader på ML-bruker-, ML-team- og ML-produktnivåer, og spore bruk som antall brukere, forekomsttyper og endepunkter.

Kunder har bedt oss om å gi veiledning om hvor mange kontoer som skal opprettes og hvordan de skal struktureres. I neste avsnitt gir vi veiledning om den kontostrukturen som referanse som du kan endre for å passe dine behov i henhold til krav til bedriftsstyring.

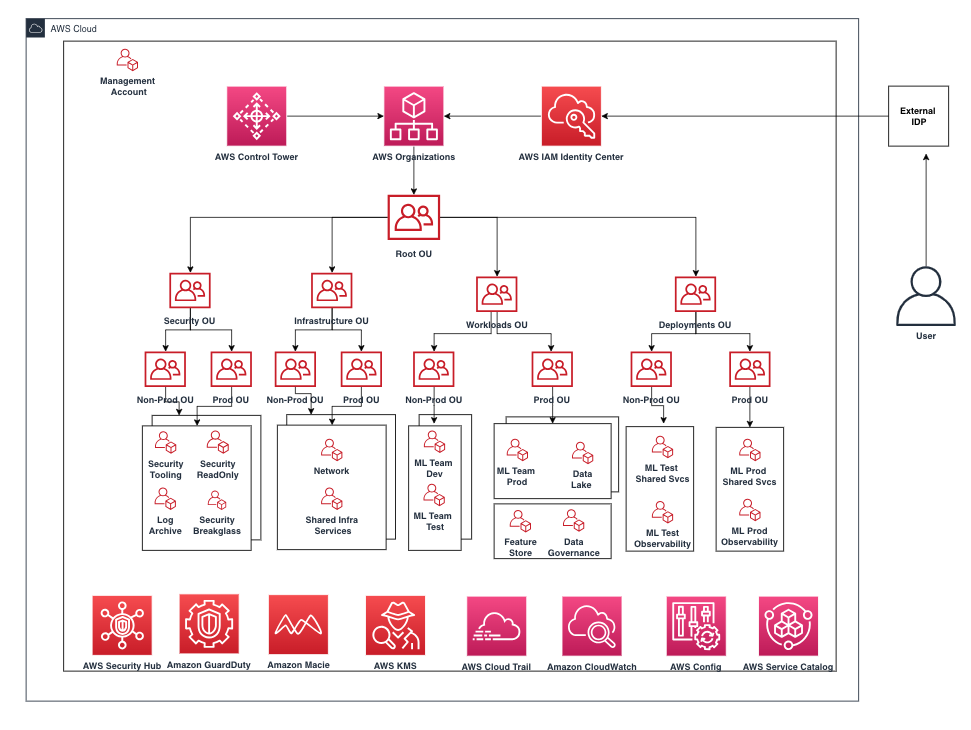

I denne delen diskuterer vi anbefalingen vår for organisering av kontostrukturen din. Vi deler en grunnleggende referansekontostruktur; Vi anbefaler imidlertid at ML- og dataadministratorer jobber tett med skyadministratoren for å tilpasse denne kontostrukturen basert på organisasjonskontrollene deres.

Vi anbefaler å organisere kontoer etter OU for sikkerhet, infrastruktur, arbeidsbelastninger og distribusjoner. Videre, innenfor hver OU, organiser etter ikke-produksjons- og produksjons-OU fordi kontoene og arbeidsbelastningene som er distribuert under dem har forskjellige kontroller. Deretter diskuterer vi kort disse OU-ene.

Sikkerhet OU

Kontoene i denne OU administreres av organisasjonens skyadministrator eller sikkerhetsteam for å overvåke, identifisere, beskytte, oppdage og svare på sikkerhetshendelser.

Infrastruktur OU

Kontoene i denne OU administreres av organisasjonens skyadministrator eller nettverksteam for å administrere delte ressurser og nettverk på bedriftsnivå.

Vi anbefaler å ha følgende kontoer under infrastrukturorganisasjonen:

- Network – Sett opp en sentralisert nettverksinfrastruktur som f.eks AWS Transit Gateway

- Delte tjenester – Sett opp sentraliserte AD-tjenester og VPC-endepunkter

Arbeidsbelastning OU

Kontoene i denne OU administreres av organisasjonens plattformteamadministratorer. Hvis du trenger ulike kontroller implementert for hvert plattformteam, kan du bygge andre nivåer av OU for det formålet, for eksempel en ML arbeidsbelastnings OU, data arbeidsbelastning OU, og så videre.

Vi anbefaler følgende kontoer under arbeidsbelastningsorganisasjonen:

- ML-utvikler-, test- og produktkontoer på teamnivå – Sett opp dette basert på kravene til arbeidsbelastningsisolering

- Data lake kontoer – Del kontoer etter datadomenet ditt

- Sentral datastyringskonto – Sentraliser retningslinjene for datatilgang

- Sentral funksjonsbutikkkonto – Sentraliser funksjoner for deling på tvers av team

Implementerings-OU

Kontoene i denne OU administreres av organisasjonens plattformteamadministratorer for distribusjon av arbeidsbelastninger og observerbarhet.

Vi anbefaler følgende kontoer under implementerings-OU fordi ML-plattformteamet kan sette opp forskjellige sett med kontroller på dette OU-nivået for å administrere og styre distribusjoner:

- ML delte tjenester står for test og prod – Vertsplattform delte tjenester CI/CD og modellregister

- ML observerbarhet står for test og prod – Vert for CloudWatch-logger, CloudTrail-logger og andre logger etter behov

Deretter diskuterer vi kort organisasjonskontroller som må vurderes for å bygge inn i medlemskontoer for å overvåke infrastrukturressursene.

AWS miljøkontroller

En kontroll er en regel på høyt nivå som gir løpende styring for ditt generelle AWS-miljø. Det er uttrykt i klart språk. I dette rammeverket bruker vi AWS Control Tower til å implementere følgende kontroller som hjelper deg med å styre ressursene dine og overvåke samsvar på tvers av grupper av AWS-kontoer:

- Forebyggende kontroller – En forebyggende kontroll sikrer at kontoene dine opprettholder samsvar fordi den ikke tillater handlinger som fører til brudd på retningslinjene og implementeres ved hjelp av en Service Control Policy (SCP). Du kan for eksempel angi en forebyggende kontroll som sikrer at CloudTrail ikke slettes eller stoppes i AWS-kontoer eller regioner.

- Detektiv kontroller – En detektivkontroll oppdager manglende overholdelse av ressurser i kontoene dine, for eksempel brudd på retningslinjene, gir varsler gjennom dashbordet og implementeres ved å bruke AWS-konfig regler. Du kan for eksempel opprette en detektivkontroll for å oppdage om offentlig lesetilgang er aktivert for Amazon enkel lagringstjeneste (Amazon S3)-bøtter i loggarkivets delte konto.

- Proaktive kontroller – En proaktiv kontroll skanner ressursene dine før de klargjøres og sørger for at ressursene er kompatible med den kontrollen og implementeres ved hjelp av AWS skyformasjon kroker. Ressurser som ikke er kompatible, blir ikke klargjort. Du kan for eksempel angi en proaktiv kontroll som kontrollerer at direkte internettilgang ikke er tillatt for en SageMaker-notebook-forekomst.

Interaksjoner mellom ML-plattformtjenester, ML-brukstilfeller og ML-operasjoner

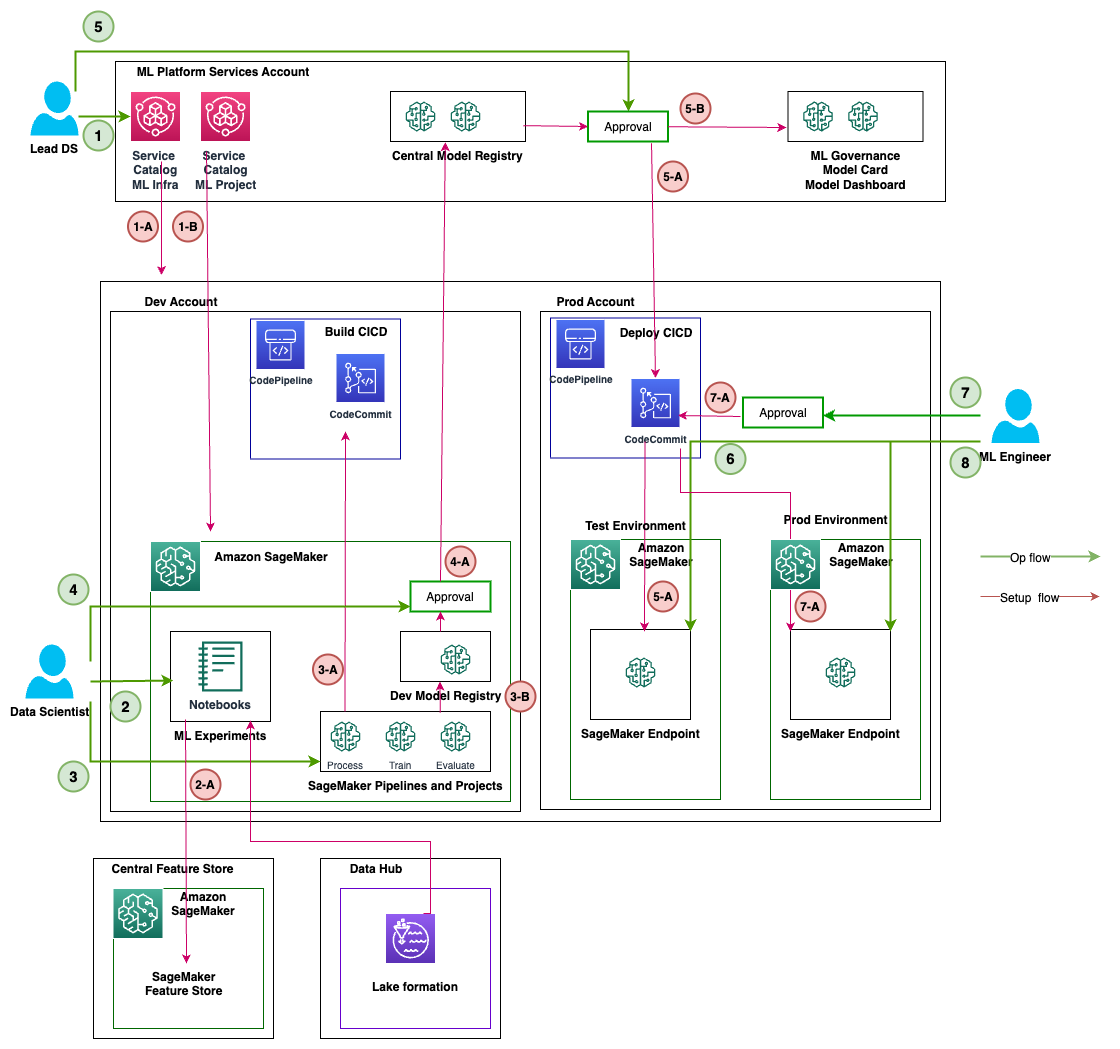

Ulike personas, som sjefen for datavitenskap (ledende dataforsker), dataforsker og ML-ingeniør, driver modulene 2–6 som vist i følgende diagram for ulike stadier av ML-plattformtjenester, ML-brukscaseutvikling og ML-operasjoner sammen med data lake-fundamenter og den sentrale funksjonsbutikken.

Følgende tabell oppsummerer operasjonsflytaktiviteten og oppsettflyttrinnene for forskjellige personas. Når en persona starter en ML-aktivitet som en del av operasjonsflyten, kjører tjenestene som nevnt i trinnene for oppsettflyt.

| Persona | Ops Flow-aktivitet – Antall | Ops Flow Activity – Beskrivelse | Setup Flow Step – Number | Setup Flow Step – Beskrivelse |

| Lead Data Science eller ML Team Lead |

1 |

Bruker Service Catalog i ML-plattformtjenestekontoen og implementerer følgende:

|

1-A |

|

|

1-B |

|

|||

| Dataforsker |

2 |

Gjennomfører og sporer ML-eksperimenter i SageMaker-notatbøker |

2-A |

|

|

3 |

Automatiserer vellykkede ML-eksperimenter med SageMaker-prosjekter og pipelines |

3-A |

|

|

|

3-B |

Etter at SageMaker-rørledningene er kjørt, lagrer du modellen i det lokale (dev) modellregisteret | |||

| Lead Data Scientist eller ML Team Lead |

4 |

Godkjenner modellen i det lokale (dev) modellregisteret |

4-A |

Modellmetadata og modellpakke skriver fra det lokale (dev) modellregisteret til det sentrale modellregisteret |

|

5 |

Godkjenner modellen i sentralt modellregister |

5-A |

Starter distribusjons-CI/CD-prosessen for å lage SageMaker-endepunkter i testmiljøet | |

|

5-B |

Skriver modellinformasjonen og metadataene til ML-styringsmodulen (modellkort, modelldashbord) i ML-plattformtjenestekontoen fra den lokale (dev)-kontoen | |||

| ML-ingeniør |

6 |

Tester og overvåker SageMaker-endepunktet i testmiljøet etter CI/CD | . | |

|

7 |

Godkjenner distribusjon for SageMaker-endepunkter i prod-miljøet |

7-A |

Starter distribusjons-CI/CD-prosessen for å lage SageMaker-endepunkter i prod-miljøet | |

|

8 |

Tester og overvåker SageMaker-endepunktet i testmiljøet etter CI/CD | . | ||

Personas og interaksjoner med ulike moduler av ML-plattformen

Hver modul henvender seg til bestemte målpersonas innenfor spesifikke divisjoner som bruker modulen oftest, og gir dem primær tilgang. Sekundærtilgang tillates da til andre divisjoner som krever sporadisk bruk av modulene. Modulene er skreddersydd for behovene til bestemte jobbroller eller personas for å optimalisere funksjonaliteten.

Vi diskuterer følgende lag:

- Sentral skyteknikk – Dette teamet opererer på bedriftsskynivå på tvers av alle arbeidsbelastninger for å sette opp vanlige skyinfrastrukturtjenester, for eksempel oppsett av nettverk på bedriftsnivå, identitet, tillatelser og kontoadministrasjon

- Dataplattformteknikk – Dette teamet administrerer datainnsjøer, datainnsamling, datakurering og datastyring

- ML-plattformteknikk – Dette teamet opererer på ML-plattformnivå på tvers av LOB-er for å tilby delte ML-infrastrukturtjenester som ML-infrastrukturforsyning, eksperimentsporing, modellstyring, distribusjon og observerbarhet

Tabellen nedenfor viser hvilke divisjoner som har primær og sekundær tilgang for hver modul i henhold til modulens målpersonas.

| Modulnummer | Moduler | Primær tilgang | Sekundær tilgang | Målpersonas | Antall kontoer |

|

1 |

Stiftelser for flere kontoer | Sentral skyteknikk | Individuelle LOB-er |

|

Few |

|

2 |

Datainnsjøfundamenter | Sentral sky- eller dataplattformteknikk | Individuelle LOB-er |

|

multiple |

|

3 |

ML-plattformtjenester | Sentral sky- eller ML-plattformutvikling | Individuelle LOB-er |

|

En |

|

4 |

ML brukscaseutvikling | Individuelle LOB-er | Sentral sky- eller ML-plattformutvikling |

|

multiple |

|

5 |

ML operasjoner | Sentral sky eller ML engineering | Individuelle LOB-er |

|

multiple |

|

6 |

Sentralisert funksjonsbutikk | Sentral sky eller datateknikk | Individuelle LOB-er |

|

En |

|

7 |

Logging og observerbarhet | Sentral skyteknikk | Individuelle LOB-er |

|

En |

|

8 |

Kostnad og rapportering | Individuelle LOB-er | Sentral plattformteknikk |

|

En |

konklusjonen

I dette innlegget introduserte vi et rammeverk for å styre ML-livssyklusen i stor skala som hjelper deg med å implementere godt utformede ML-arbeidsbelastninger som innebygger sikkerhet og styringskontroller. Vi diskuterte hvordan dette rammeverket tar en helhetlig tilnærming for å bygge en ML-plattform med tanke på datastyring, modellstyring og kontroller på bedriftsnivå. Vi oppfordrer deg til å eksperimentere med rammeverket og konseptene introdusert i dette innlegget og dele tilbakemeldingene dine.

Om forfatterne

Ram Vittal er en rektor ML Solutions Architect ved AWS. Han har over 3 tiår med erfaring med å bygge og bygge distribuerte, hybride og skyapplikasjoner. Han brenner for å bygge sikre, skalerbare, pålitelige AI/ML og big data-løsninger for å hjelpe bedriftskunder med deres skyadopsjon og optimaliseringsreise for å forbedre forretningsresultatene deres. På fritiden kjører han motorsykkel og går med sin tre år gamle sheep-a-doodle!

Ram Vittal er en rektor ML Solutions Architect ved AWS. Han har over 3 tiår med erfaring med å bygge og bygge distribuerte, hybride og skyapplikasjoner. Han brenner for å bygge sikre, skalerbare, pålitelige AI/ML og big data-løsninger for å hjelpe bedriftskunder med deres skyadopsjon og optimaliseringsreise for å forbedre forretningsresultatene deres. På fritiden kjører han motorsykkel og går med sin tre år gamle sheep-a-doodle!

Sovik Kumar Nath er en AI/ML løsningsarkitekt med AWS. Han har lang erfaring med å designe ende-til-ende maskinlæring og forretningsanalyseløsninger innen finans, drift, markedsføring, helsevesen, supply chain management og IoT. Sovik har publisert artikler og har patent på ML-modellovervåking. Han har doble mastergrader fra University of South Florida, University of Fribourg, Sveits, og en bachelorgrad fra Indian Institute of Technology, Kharagpur. Utenom jobben liker Sovik å reise, ta ferge og se på film.

Sovik Kumar Nath er en AI/ML løsningsarkitekt med AWS. Han har lang erfaring med å designe ende-til-ende maskinlæring og forretningsanalyseløsninger innen finans, drift, markedsføring, helsevesen, supply chain management og IoT. Sovik har publisert artikler og har patent på ML-modellovervåking. Han har doble mastergrader fra University of South Florida, University of Fribourg, Sveits, og en bachelorgrad fra Indian Institute of Technology, Kharagpur. Utenom jobben liker Sovik å reise, ta ferge og se på film.

Maira Ladeira Tanke er senior dataspesialist hos AWS. Som teknisk leder hjelper hun kunder med å akselerere oppnåelsen av forretningsverdi gjennom fremvoksende teknologi og innovative løsninger. Maira har vært hos AWS siden januar 2020. Før det jobbet hun som dataforsker i flere bransjer med fokus på å oppnå forretningsverdi fra data. På fritiden liker Maira å reise og tilbringe tid med familien et varmt sted.

Maira Ladeira Tanke er senior dataspesialist hos AWS. Som teknisk leder hjelper hun kunder med å akselerere oppnåelsen av forretningsverdi gjennom fremvoksende teknologi og innovative løsninger. Maira har vært hos AWS siden januar 2020. Før det jobbet hun som dataforsker i flere bransjer med fokus på å oppnå forretningsverdi fra data. På fritiden liker Maira å reise og tilbringe tid med familien et varmt sted.

Ryan Lempka er Senior Solutions Architect hos Amazon Web Services, hvor han hjelper kundene sine med å jobbe bakover fra forretningsmålene for å utvikle løsninger på AWS. Han har dyp erfaring innen forretningsstrategi, IT-systemadministrasjon og datavitenskap. Ryan er dedikert til å være en livslang lærende, og liker å utfordre seg selv hver dag for å lære noe nytt.

Ryan Lempka er Senior Solutions Architect hos Amazon Web Services, hvor han hjelper kundene sine med å jobbe bakover fra forretningsmålene for å utvikle løsninger på AWS. Han har dyp erfaring innen forretningsstrategi, IT-systemadministrasjon og datavitenskap. Ryan er dedikert til å være en livslang lærende, og liker å utfordre seg selv hver dag for å lære noe nytt.

Sriharsh Adari er Senior Solutions Architect hos Amazon Web Services (AWS), hvor han hjelper kunder med å jobbe bakover fra forretningsresultater for å utvikle innovative løsninger på AWS. Gjennom årene har han hjulpet flere kunder med transformasjoner av dataplattformer på tvers av bransjevertikaler. Hans kjernekompetanse inkluderer teknologistrategi, dataanalyse og datavitenskap. På fritiden liker han å spille sport, se på TV-serier og spille Tabla.

Sriharsh Adari er Senior Solutions Architect hos Amazon Web Services (AWS), hvor han hjelper kunder med å jobbe bakover fra forretningsresultater for å utvikle innovative løsninger på AWS. Gjennom årene har han hjulpet flere kunder med transformasjoner av dataplattformer på tvers av bransjevertikaler. Hans kjernekompetanse inkluderer teknologistrategi, dataanalyse og datavitenskap. På fritiden liker han å spille sport, se på TV-serier og spille Tabla.

- SEO-drevet innhold og PR-distribusjon. Bli forsterket i dag.

- PlatoData.Network Vertical Generative Ai. Styrk deg selv. Tilgang her.

- PlatoAiStream. Web3 Intelligence. Kunnskap forsterket. Tilgang her.

- PlatoESG. Karbon, CleanTech, Energi, Miljø, Solenergi, Avfallshåndtering. Tilgang her.

- PlatoHelse. Bioteknologisk og klinisk etterretning. Tilgang her.

- kilde: https://aws.amazon.com/blogs/machine-learning/governing-the-ml-lifecycle-at-scale-part-1-a-framework-for-architecting-ml-workloads-using-amazon-sagemaker/

- : har

- :er

- :ikke

- :hvor

- $OPP

- 1

- 10

- 100

- 12

- 12 måneder

- 2020

- 28

- 7

- 8

- 971

- a

- Om oss

- akselerere

- adgang

- tilgjengelig

- Ifølge

- Logg inn

- kontoer

- prestasjon

- oppnå

- tvers

- handlinger

- aktivitet

- Ad

- tilpasse

- tilpasning

- tillegg

- Ytterligere

- adresse

- adresser

- adressering

- admin

- administratorer

- vedta

- Adopsjon

- Etter

- AI

- AI-modeller

- AI / ML

- Varsler

- Alle

- tillatt

- tillate

- tillater

- langs

- allerede

- også

- Selv

- Amazon

- Amazon SageMaker

- Amazon Web Services

- Amazon Web Services (AWS)

- an

- analyse

- analytics

- og

- og infrastruktur

- noen

- søknader

- tilnærming

- hensiktsmessig

- godkjent

- arkitektur

- Arkiv

- ER

- AREA

- artikler

- AS

- Eiendeler

- assosiert

- anta

- At

- Autentisering

- autorisasjon

- automatisere

- Automatisert

- Automatisering

- tilgjengelig

- AWS

- Balansere

- basert

- Baseline

- BE

- fordi

- blir

- vært

- før du

- være

- gunstig

- Fordeler

- BEST

- beste praksis

- mellom

- Bias

- Stor

- Store data

- Break

- kort

- bygge

- Bygning

- bygger

- virksomhet

- forretningsstrategi

- men

- by

- CAN

- kandidat

- evner

- kort

- Kort

- saken

- saker

- katalog

- kategorier

- henvender seg

- Årsak

- sentrum

- sentral

- sentralisering

- sentralisert

- kjede

- utfordringer

- utfordrende

- Sjekker

- kjemi

- tett

- Cloud

- skyadopsjon

- sky infrastruktur

- kode

- samarbeid

- samling

- samlet sett

- Felles

- Selskaper

- samsvar

- kompatibel

- komponenter

- består

- konsept

- konsepter

- ansett

- vurderer

- anser

- forbruke

- Forbrukere

- Container

- kontroll

- Kontrolltårn

- kontrolleres

- kontroller

- koordinert

- Kjerne

- Kostnad

- Kostnader

- dekket

- skape

- opprettet

- konservering

- Kunder

- tilpasse

- tilpasset

- dashbord

- oversikter

- dato

- data tilgang

- Data Analytics

- Data Lake

- Dataplattform

- personvern

- datavitenskap

- dataforsker

- datasett

- dag

- tiår

- dedikert

- dyp

- Grad

- avdelinger

- utplassere

- utplassert

- utplasserings

- distribusjon

- distribusjoner

- Distribueres

- utforming

- designet

- utforme

- detaljer

- dev

- utvikle

- utviklet

- Utvikling

- utviklingen

- forskjellig

- dimensjoner

- direkte

- diskutere

- diskutert

- distinkt

- distribueres

- dykk

- domene

- dobbelt

- ned

- hver enkelt

- innsats

- embed

- innebygd

- embedding

- Emery

- Emerging Technology

- muliggjøre

- aktivert

- muliggjør

- muliggjør

- oppmuntre

- ende til ende

- Endpoint

- ingeniør

- Ingeniørarbeid

- Ingeniører

- forbedre

- sikre

- sikrer

- sikrer

- Enterprise

- bedriftsnivå

- bedrifter

- Miljø

- miljøer

- avgjørende

- evaluere

- hendelser

- Hver

- hver dag

- eksempel

- erfaring

- eksperiment

- eksperimenter

- ekspertise

- uttrykte

- strekker

- omfattende

- Omfattende erfaring

- møtt

- legge til rette

- familie

- Trekk

- Egenskaper

- tilbakemelding

- Noen få

- Figur

- filtrere

- finansiere

- finansiell

- finansielle tjenester

- Først

- fleksibilitet

- florida

- flyten

- fokusering

- etter

- Til

- skjema

- formasjon

- Fundament

- Foundations

- fire

- Rammeverk

- Gratis

- fra

- funksjon

- funksjonelle

- funksjonalitet

- funksjonalitet

- funksjoner

- videre

- Dess

- Gevinst

- generere

- genererer

- generative

- Generativ AI

- gir

- Global

- styresett

- styringsmodell

- styringsmodul

- styrt

- styrende

- innvilgelse

- Gruppens

- veiledning

- Ha

- å ha

- he

- hode

- helsetjenester

- høre

- hjelpe

- hjulpet

- hjelper

- her

- Høy

- høyt nivå

- hans

- holder

- helhetlig

- kroker

- Vertskapet

- Hvordan

- Hvordan

- Men

- HTML

- http

- HTTPS

- Hub

- Hybrid

- identifisering

- Identitet

- if

- iverksette

- gjennomføring

- implementert

- implementere

- forbedre

- bedre

- in

- inkludere

- inkluderer

- Inkludert

- økende

- uavhengig av hverandre

- indisk

- bransjer

- industri

- informasjon

- Infrastruktur

- innledende

- Starter

- nyskapende

- innovative

- f.eks

- Institute

- integrert

- samhandle

- interaksjoner

- interessert

- Internet

- Internettilgang

- inn

- introdusert

- investering

- IOT

- isolasjon

- IT

- Januar

- Jobb

- reise

- jpg

- nøkkel

- kunnskap

- Kumar

- maling

- innsjø

- innsjøer

- landing

- Språk

- stor

- seinere

- lag

- føre

- LÆRE

- læring

- Nivå

- nivåer

- Livssyklus

- i likhet med

- avstamning

- linjer

- lokal

- logg

- logging

- ser

- maskin

- maskinlæring

- laget

- vedlikeholde

- GJØR AT

- administrer

- fikk til

- ledelse

- forvalter

- administrerende

- mange

- Kart

- Marketing

- moden

- modenhet

- Kan..

- medlem

- nevnt

- mesh

- metadata

- formildende

- dempe risiko

- ML

- MLOps

- modell

- modeller

- modifisere

- modulære

- Moduler

- Moduler

- Overvåke

- overvåking

- skjermer

- måneder

- mer

- mest

- motorsykkel

- Filmer

- flere

- innfødt

- Trenger

- behov

- Nest

- nettverk

- nettverk

- nettverk

- Ny

- Nye funksjoner

- neste

- bærbare

- Antall

- mål

- sporadisk

- of

- Tilbud

- Office

- ofte

- Gammel

- on

- gang

- ONE

- pågående

- betjene

- operert

- opererer

- drift

- Drift

- optimalisering

- Optimalisere

- or

- organisasjon

- organisasjoner

- organisering

- Annen

- vår

- ut

- utfall

- utenfor

- enn

- samlet

- oversikt

- pakke

- del

- Spesielt

- lidenskapelig

- patent

- Utfør

- ytelse

- tillatelser

- rørledning

- Sted

- Plain

- plattform

- plato

- Platon Data Intelligence

- PlatonData

- spiller

- Politikk

- politikk

- portefølje

- Post

- praksis

- praksis

- presentere

- hindre

- primære

- Principal

- Før

- privatliv

- privat

- privat sektor

- Proaktiv

- problemer

- prosess

- Prosesser

- produsent

- Produsentene

- Produkt

- Produksjon

- Produkter

- prosjekter

- forfremmelse

- bevis

- proof of concept

- beskytte

- gi

- gir

- gi

- offentlig

- publisert

- formål

- kvalitet

- raskt

- rask

- Lese

- nylig

- gjenkjenne

- anbefaler

- Anbefaling

- redusere

- referanse

- regioner

- registrere

- registrert

- registre

- registret

- regulert

- regulerte næringer

- pålitelig

- fjerne

- Rapporter

- krever

- påkrevd

- Krav

- ressurs

- Ressurser

- svare

- ansvarlig

- gjenbruk

- rides

- Risiko

- risikoer

- Rolle

- roller

- root

- Regel

- regler

- Kjør

- rennende

- Ryan

- ofre

- sagemaker

- SageMaker-rørledninger

- samme

- skalerbar

- Skala

- skalering

- Vitenskap

- Forsker

- forskere

- Søk

- sekundær

- Seksjon

- sektor

- sikre

- sikkerhet

- sikkerhetshendelser

- Selvbetjening

- senior

- Serien

- tjeneste

- Tjenester

- sett

- sett

- innstilling

- oppsett

- Del

- delt

- Aksjer

- deling

- hun

- Kort

- bør

- vist

- Viser

- Enkelt

- siden

- enkelt

- Størrelse

- liten

- So

- løsning

- Solutions

- LØSE

- noen

- noe

- Sør

- Sør-Florida

- spesialist

- spesialisert

- spesifikk

- utgifter

- Sports

- stadier

- interessent

- interessenter

- standarder

- Begynn

- Tilstand

- Trinn

- Steps

- Still

- stoppet

- lagring

- oppbevare

- butikker

- strategier

- Strategi

- sterk

- struktur

- strukturer

- studio

- vellykket

- slik

- Dress

- SAMMENDRAG

- levere

- forsyningskjeden

- leverandørkrav

- støtte

- Støtte

- sikker

- sveits

- Systemer

- bord

- skreddersydd

- tar

- ta

- Target

- lag

- lag

- Teknisk

- Teknologi

- Teknologistrategi

- mal

- maler

- test

- Testing

- Det

- De

- Staten

- deres

- Dem

- deretter

- Disse

- de

- ting

- denne

- De

- Gjennom

- hele

- tid

- til

- verktøy

- mot

- Tårn

- spor

- Sporing

- tradisjonelle

- Tog

- transformasjoner

- transitt

- Traveling

- SVING

- tv

- typer

- etter

- forstå

- urettferdig

- lomper

- universitet

- us

- bruk

- bruke

- bruk sak

- brukt

- Bruker

- Brukere

- bruker

- ved hjelp av

- bruke

- validering

- verdi

- variasjon

- ulike

- vertikaler

- av

- Brudd

- synlighet

- visualisering

- visualisere

- gå

- ønsker

- varm

- se

- we

- web

- webtjenester

- VI VIL

- når

- om

- hvilken

- mens

- vil

- med

- innenfor

- uten

- Arbeid

- arbeidet

- arbeidsflyt

- arbeid

- år

- Du

- Din

- zephyrnet