Store språkmodeller (LLMs) med sin brede kunnskap, kan generere menneskelignende tekst om nesten alle emner. Imidlertid begrenser opplæringen deres på massive datasett også deres nytte for spesialiserte oppgaver. Uten fortsatt læring forblir disse modellene uvitende om nye data og trender som dukker opp etter deres første opplæring. Videre kan kostnadene for å lære opp nye LLM-er vise seg uoverkommelige for mange bedriftsinnstillinger. Det er imidlertid mulig å kryssreferanser et modellsvar med det originale spesialiserte innholdet, og dermed unngå behovet for å trene opp en ny LLM-modell ved å bruke Retrieval-Augmented Generation (RAG).

RAG styrker LLM-er ved å gi dem muligheten til å hente og innlemme ekstern kunnskap. I stedet for å stole utelukkende på deres forhåndstrente kunnskap, lar RAG modeller trekke data fra dokumenter, databaser og mer. Modellen integrerer deretter denne eksterne informasjonen på en dyktig måte i den genererte teksten. Ved å skaffe kontekstrelevante data kan modellen gi informerte, oppdaterte svar skreddersydd for brukssaken din. Kunnskapsforøgelsen reduserer også sannsynligheten for hallusinasjoner og unøyaktig eller useriøs tekst. Med RAG blir grunnmodeller tilpasningsdyktige eksperter som utvikler seg etter hvert som kunnskapsbasen din vokser.

I dag er vi glade for å avsløre tre generative AI-demoer, lisensiert under MIT-0 lisens:

- Amazon Kendra med grunnleggende LLM – Bruker de dype søkefunksjonene til Amazon Kendra kombinert med den omfattende kunnskapen om LLM-er. Denne integrasjonen gir presise og kontekstbevisste svar på komplekse spørsmål ved å trekke fra en rekke forskjellige kilder.

- Innebyggingsmodell med grunnleggende LLM – Slår sammen kraften til innebygginger – en teknikk for å fange opp semantiske betydninger av ord og uttrykk – med den enorme kunnskapsbasen til LLM-er. Denne synergien muliggjør mer nøyaktig emnemodellering, innholdsanbefaling og semantiske søkefunksjoner.

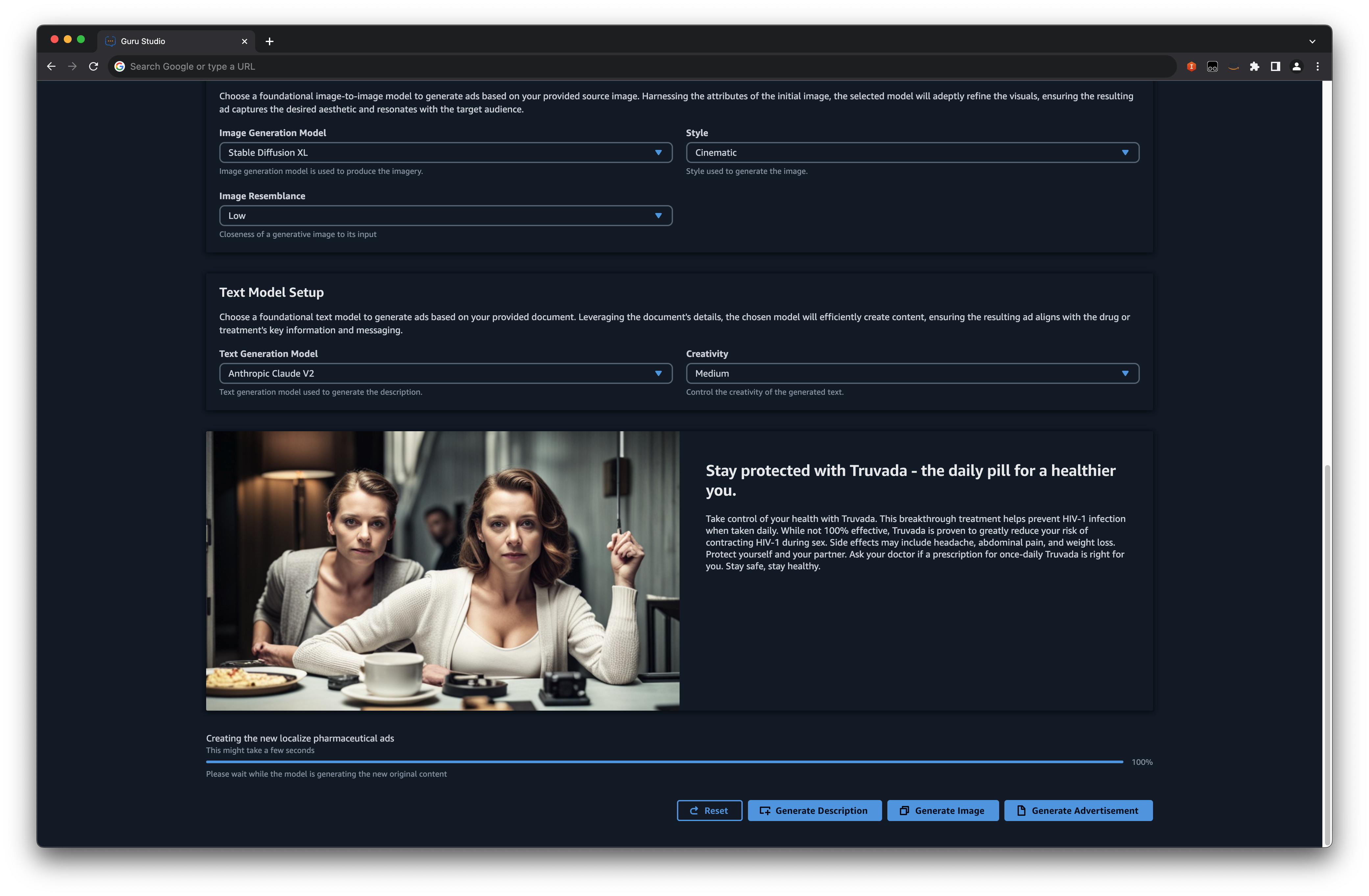

- Foundation Models Pharma Ad Generator – En spesialisert applikasjon skreddersydd for den farmasøytiske industrien. Ved å utnytte de generative egenskapene til grunnleggende modeller, skaper dette verktøyet overbevisende og kompatible farmasøytiske annonser, og sikrer at innholdet overholder industristandarder og forskrifter.

Disse demoene kan implementeres sømløst i AWS-kontoen din, og gir grunnleggende innsikt og veiledning om bruk av AWS-tjenester for å lage en toppmoderne LLM-generativ AI-spørsmål og svar-bot og innholdsgenerering.

I dette innlegget utforsker vi hvordan RAG kombinert med Amazon Kendra eller egendefinerte innebygginger kan overvinne disse utfordringene og gi raffinerte svar på spørringer på naturlig språk.

Løsningsoversikt

Ved å ta i bruk denne løsningen kan du oppnå følgende fordeler:

- Forbedret informasjonstilgang – RAG lar modeller hente inn informasjon fra enorme eksterne kilder, noe som kan være spesielt nyttig når kunnskapen til den forhåndstrente modellen er utdatert eller ufullstendig.

- skalerbarhet – I stedet for å trene en modell på alle tilgjengelige data, lar RAG modellene hente relevant informasjon på farten. Dette betyr at etter hvert som nye data blir tilgjengelige, kan de legges til gjenfinningsdatabasen uten å trene om hele modellen.

- Minneeffektivitet – LLM-er krever betydelig minne for å lagre parametere. Med RAG kan modellen være mindre fordi den ikke trenger å huske alle detaljer; den kan hente dem når det trengs.

- Dynamisk kunnskapsoppdatering – I motsetning til konvensjonelle modeller med et satt kunnskapsendepunkt, kan RAGs eksterne database gjennomgå regelmessige oppdateringer, noe som gir modellen tilgang til oppdatert informasjon. Innhentingsfunksjonen kan finjusteres for forskjellige oppgaver. For eksempel kan en medisinsk diagnostisk oppgave hente data fra medisinske tidsskrifter, og sikre at modellen får ekspert og relevant innsikt.

- Skjevhetsdemping – Evnen til å trekke fra en godt kuratert database gir potensialet til å minimere skjevheter ved å sikre balanserte og upartiske eksterne kilder.

Før du dykker inn i integreringen av Amazon Kendra med grunnleggende LLM-er, er det avgjørende å utstyre deg selv med de nødvendige verktøyene og systemkravene. Å ha det riktige oppsettet på plass er det første skrittet mot en sømløs distribusjon av demoene.

Forutsetninger

Du må ha følgende forutsetninger:

Selv om det er mulig å sette opp og distribuere infrastrukturen som er beskrevet i denne opplæringen fra din lokale datamaskin, AWS Cloud9 tilbyr et praktisk alternativ. Forhåndsutstyrt med verktøy som AWS CLI, AWS CDK og Docker, kan AWS Cloud9 fungere som din distribusjonsarbeidsstasjon. For å bruke denne tjenesten, ganske enkelt sette opp miljøet via AWS Cloud9-konsoll.

Med forutsetningene ute av veien, la oss dykke ned i funksjonene og egenskapene til Amazon Kendra med grunnleggende LLM-er.

Amazon Kendra med grunnleggende LLM

Amazon Kendra er en avansert bedriftssøketjeneste forbedret av maskinlæring (ML) som gir ferdige semantiske søkefunksjoner. Ved å bruke naturlig språkbehandling (NLP), forstår Amazon Kendra både innholdet i dokumenter og den underliggende intensjonen til brukerforespørsler, og posisjonerer det som et innholdsgjenfinningsverktøy for RAG-baserte løsninger. Ved å bruke søkeinnholdet med høy nøyaktighet fra Kendra som en RAG-nyttelast, kan du få bedre LLM-svar. Bruken av Amazon Kendra i denne løsningen muliggjør også personlig søk ved å filtrere svar i henhold til tilgangstillatelsene for sluttbrukerinnhold.

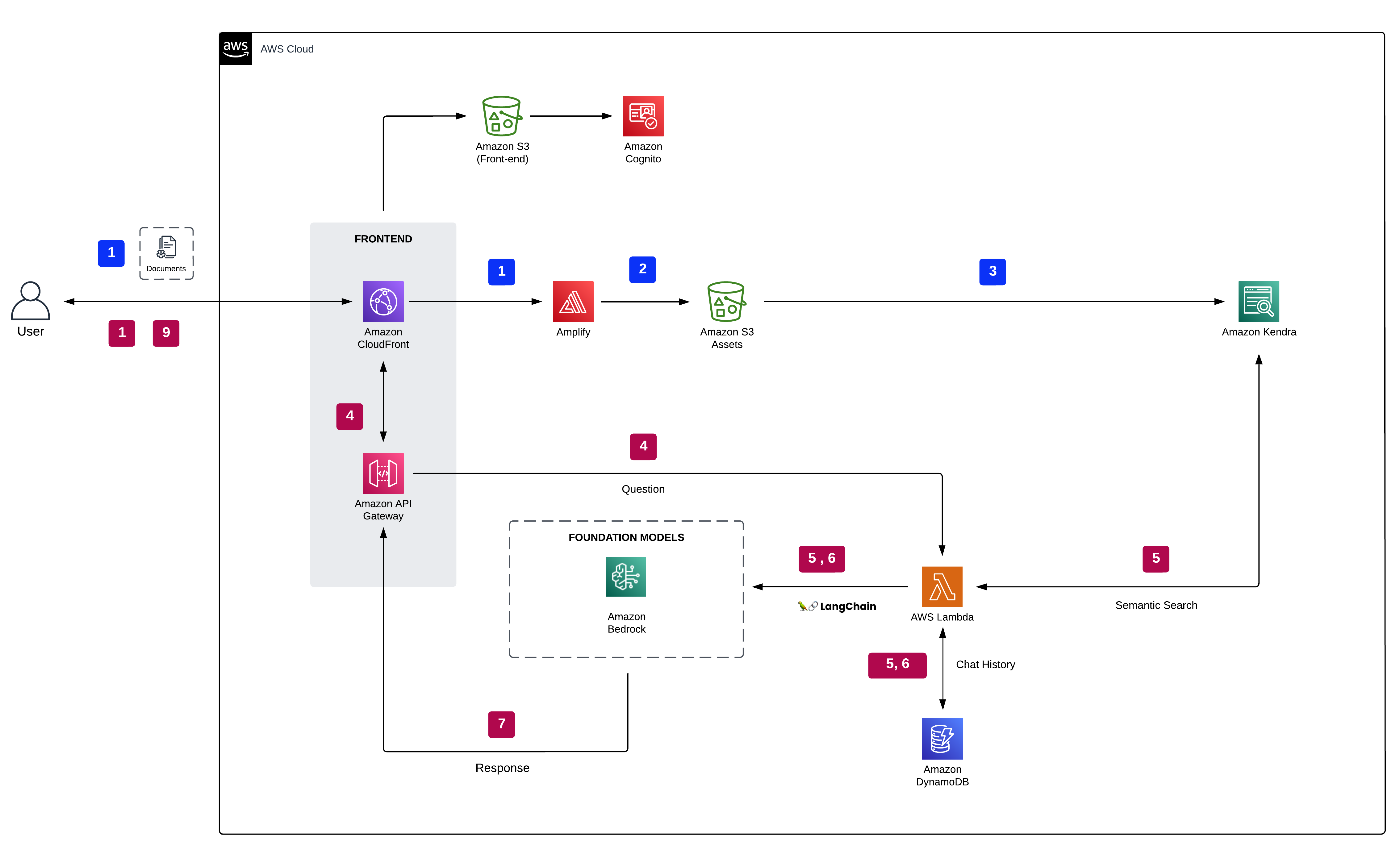

Følgende diagram viser arkitekturen til en generativ AI-applikasjon som bruker RAG-tilnærmingen.

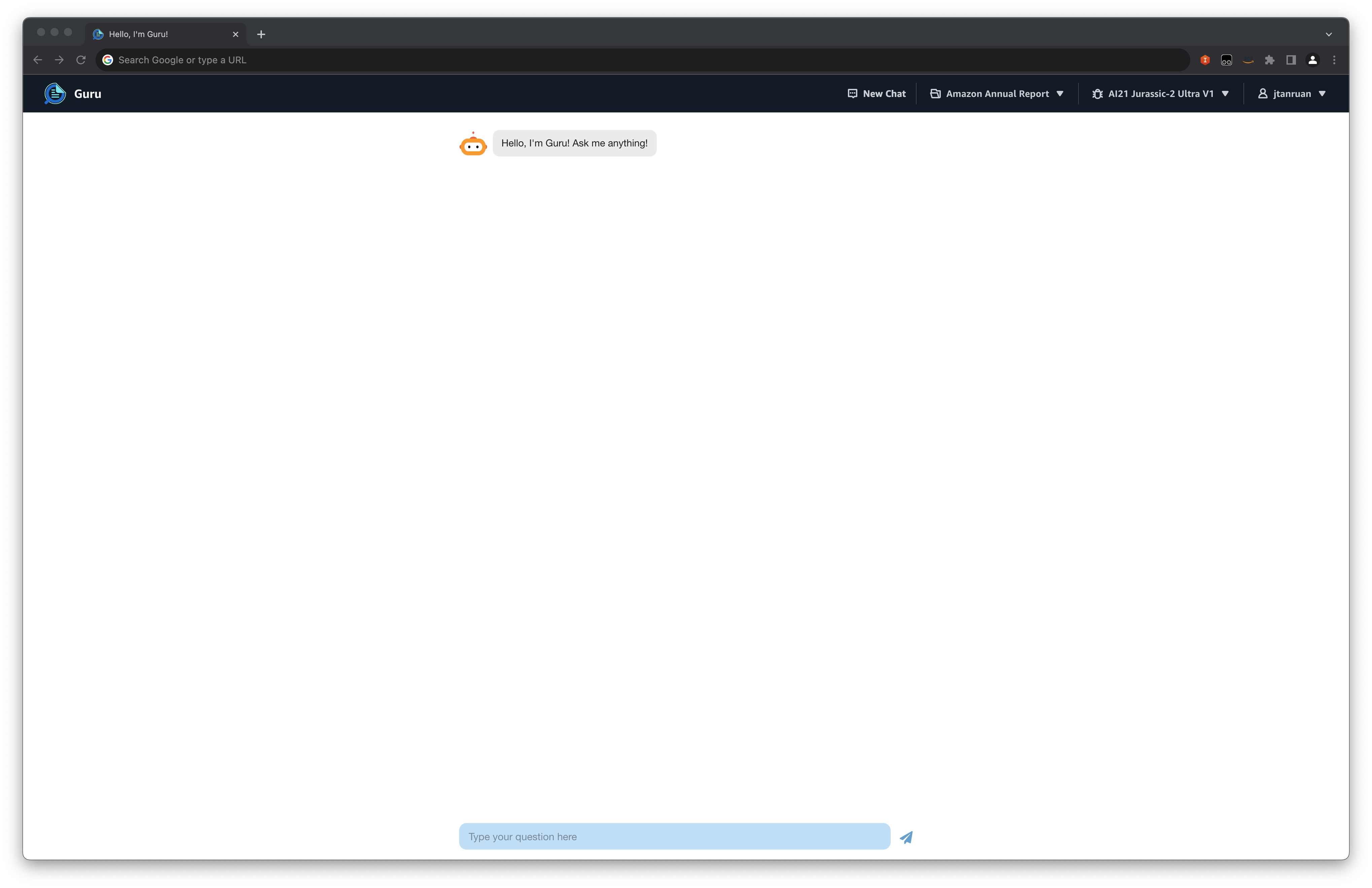

Dokumenter behandles og indekseres av Amazon Kendra gjennom Amazon Simple Storage Service (Amazon S3) kontakt. Kundeforespørsler og kontekstuelle data fra Amazon Kendra rettes til en Amazonas grunnfjell grunnmodell. Demoen lar deg velge mellom Amazons Titan, AI21s Jurassic og Anthropics Claude-modeller støttet av Amazon Bedrock. Samtaleloggen er lagret i Amazon DynamoDB, og tilbyr ekstra kontekst for LLM for å generere svar.

Vi har gitt denne demoen i GitHub repo. Se distribusjonsinstruksjonene i readme-filen for å distribuere den til AWS-kontoen din.

Følgende trinn skisserer prosessen når en bruker samhandler med den generative AI-appen:

- Brukeren logger på nettappen som er autentisert av Amazon Cognito.

- Brukeren laster opp ett eller flere dokumenter til Amazon S3.

- Brukeren kjører en Amazon Kendra-synkroniseringsjobb for å innta S3-dokumenter i Amazon Kendra-indeksen.

- Brukerens spørsmål rutes gjennom en sikker WebSocket API som er vert for Amazon API-gateway støttet av en AWS Lambda funksjon.

- Lambda-funksjonen, aktivert av Langkjede rammeverk – et allsidig verktøy designet for å lage applikasjoner drevet av AI-språkmodeller – kobles til Amazon Bedrock-endepunktet for å omformulere brukerens spørsmål basert på chat-historikk. Etter omformulering blir spørsmålet videresendt til Amazon Kendra ved hjelp av Retrieve API. Som svar viser Amazon Kendra-indeksen søkeresultater, og gir utdrag fra relevante dokumenter hentet fra bedriftens inntatte data.

- Brukerens spørsmål sammen med dataene hentet fra indeksen sendes som en kontekst i LLM-ledeteksten. Svaret fra LLM lagres som chattehistorikk i DynamoDB.

- Til slutt sendes svaret fra LLM tilbake til brukeren.

Arbeidsflyt for dokumentindeksering

Følgende er fremgangsmåten for behandling og indeksering av dokumenter:

- Brukere sender inn dokumenter via brukergrensesnittet (UI).

- Dokumenter overføres til en S3-bøtte ved hjelp av AWS forsterke API.

- Amazon Kendra indekserer nye dokumenter i S3-bøtten gjennom Amazon Kendra S3-kontakten.

Fordeler

Følgende liste fremhever fordelene med denne løsningen:

- Henting på bedriftsnivå – Amazon Kendra er designet for bedriftssøk, noe som gjør det egnet for organisasjoner med store mengder strukturerte og ustrukturerte data.

- Semantisk forståelse – ML-mulighetene til Amazon Kendra sikrer at gjenfinning er basert på dyp semantisk forståelse og ikke bare søkeordtreff.

- skalerbarhet – Amazon Kendra kan håndtere store datakilder og gir raske og relevante søkeresultater.

- fleksibilitet – Grunnmodellen kan generere svar basert på et bredt spekter av sammenhenger, og sikre at systemet forblir allsidig.

- Integrasjonsevner – Amazon Kendra kan integreres med ulike AWS-tjenester og datakilder, noe som gjør det tilpasset ulike organisasjonsbehov.

Innebyggingsmodell med grunnleggende LLM

An embedding er en numerisk vektor som representerer kjerneessensen i forskjellige datatyper, inkludert tekst, bilder, lyd og dokumenter. Denne representasjonen fanger ikke bare dataens iboende betydning, men tilpasser den også for et bredt spekter av praktiske bruksområder. Innebyggingsmodeller, en gren av ML, transformerer komplekse data, som ord eller setninger, til kontinuerlige vektorrom. Disse vektorene griper iboende de semantiske forbindelsene mellom data, og muliggjør dypere og mer innsiktsfulle sammenligninger.

RAG kombinerer sømløst styrken til grunnleggende modeller, som transformatorer, med presisjonen til innebygging for å sile gjennom enorme databaser for relevant informasjon. Ved mottak av en forespørsel bruker systemet innebygginger for å identifisere og trekke ut relevante deler fra en omfattende datamengde. Grunnmodellen formulerer deretter en kontekstuelt presis respons basert på denne uthentede informasjonen. Denne perfekte synergien mellom datainnhenting og responsgenerering gjør at systemet kan gi grundige svar, og trekker fra den enorme kunnskapen som er lagret i omfattende databaser.

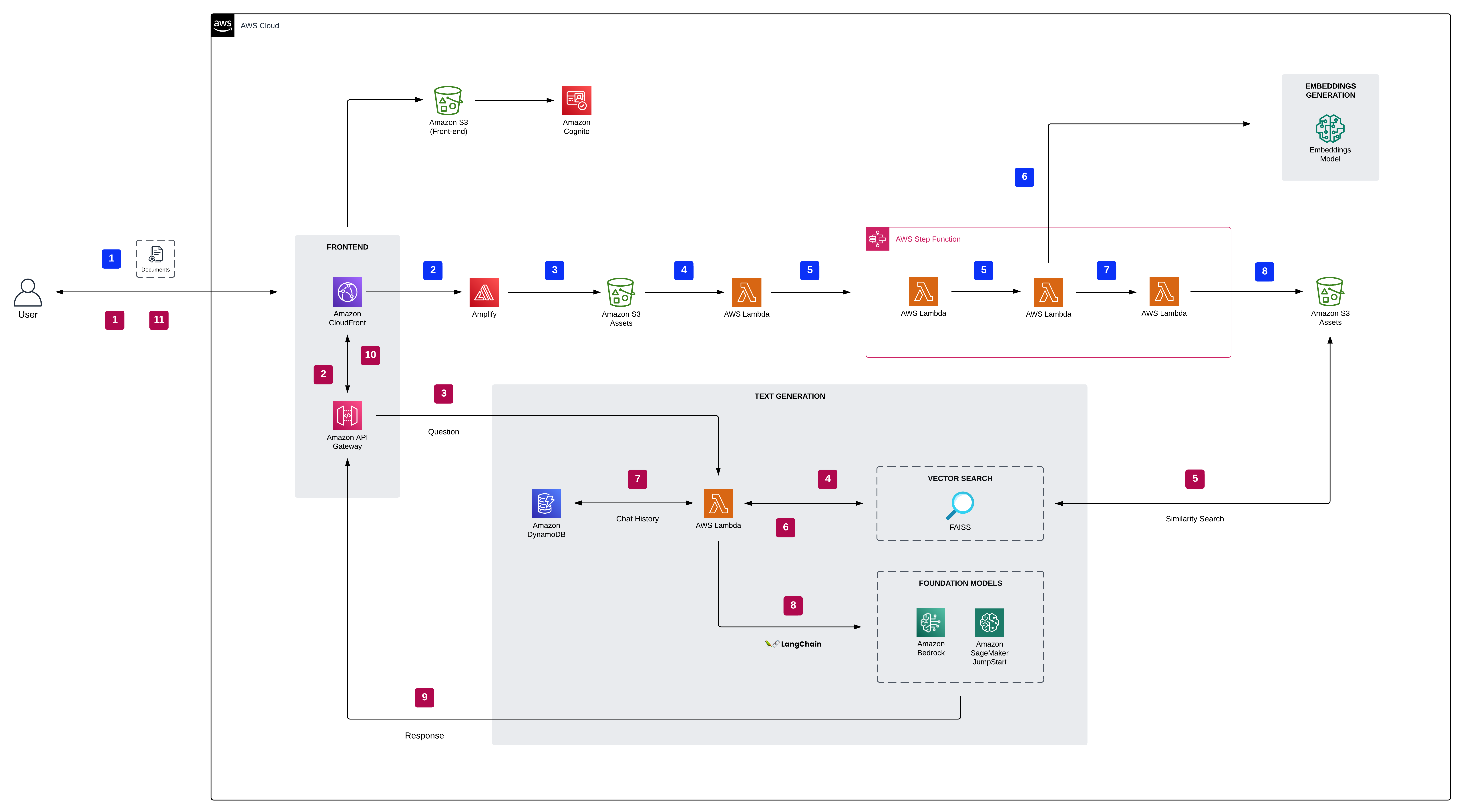

I det arkitektoniske oppsettet, basert på deres UI-valg, blir brukere guidet til enten Amazonas grunnfjell eller Amazon SageMaker JumpStart grunnmodeller. Dokumenter gjennomgår behandling, og vektorinnbygginger produseres av embeddingsmodellen. Disse innebyggingene blir deretter indeksert ved hjelp av FAISS for å muliggjøre effektivt semantisk søk. Samtalehistorier er bevart i DynamoDB, og beriker konteksten for LLM for å lage svar.

Følgende diagram illustrerer løsningsarkitekturen og arbeidsflyten.

Vi har gitt denne demoen i GitHub repo. Se distribusjonsinstruksjonene i readme-filen for å distribuere den til AWS-kontoen din.

Innstøpingsmodell

Ansvaret til innbyggingsmodellen er som følger:

- Denne modellen er ansvarlig for å konvertere tekst (som dokumenter eller passasjer) til tette vektorrepresentasjoner, ofte kjent som innebygginger.

- Disse innebyggingene fanger opp den semantiske betydningen av teksten, og muliggjør effektive og semantisk meningsfulle sammenligninger mellom ulike tekststykker.

- Innebyggingsmodellen kan trenes på samme enorme korpus som den grunnleggende modellen eller kan spesialiseres for spesifikke domener.

Arbeidsflyt for spørsmål og svar

Følgende trinn beskriver arbeidsflyten for spørsmålssvar over dokumenter:

- Brukeren logger på nettappen som er autentisert av Amazon Cognito.

- Brukeren laster opp ett eller flere dokumenter til Amazon S3.

- Ved dokumentoverføring utløser et S3-hendelsesvarsel en Lambda-funksjon, som deretter kaller SageMaker-innbyggingsmodellens endepunkt for å generere innbygginger for det nye dokumentet. Embeddings-modellen konverterer spørsmålet til en tett vektorrepresentasjon (embedding). Den resulterende vektorfilen er trygt lagret i S3-bøtten.

- FAISS-retrieveren sammenligner denne innbyggingen av spørsmålet med innbyggingen av alle dokumenter eller passasjer i databasen for å finne de mest relevante passasjene.

- Passasjene, sammen med brukerens spørsmål, er gitt som kontekst til den grunnleggende modellen. Lambda-funksjonen bruker LangChain-biblioteket og kobler til Amazon Bedrock eller SageMaker JumpStart-endepunktet med en kontekstfylt spørring.

- Svaret fra LLM lagres i DynamoDB sammen med brukerens spørring, tidsstempelet, en unik identifikator og andre vilkårlige identifikatorer for elementet, for eksempel spørsmålskategori. Lagring av spørsmål og svar som diskrete elementer gjør at Lambda-funksjonen enkelt kan gjenskape en brukers samtalehistorikk basert på tidspunktet da spørsmål ble stilt.

- Til slutt sendes svaret tilbake til brukeren via en HTTPs-forespørsel gjennom API Gateway WebSocket API-integrasjonssvaret.

Fordeler

Følgende liste beskriver fordelene med denne løsningen:

- Semantisk forståelse – Innebyggingsmodellen sikrer at retrieveren velger passasjer basert på dyp semantisk forståelse, ikke bare søkeordtreff.

- skalerbarhet – Innebygginger muliggjør effektive likhetssammenligninger, noe som gjør det mulig å søke gjennom enorme databaser med dokumenter raskt.

- fleksibilitet – Grunnmodellen kan generere svar basert på et bredt spekter av sammenhenger, og sikre at systemet forblir allsidig.

- Domenetilpasning – Innebyggingsmodellen kan trenes eller finjusteres for spesifikke domener, slik at systemet kan tilpasses ulike bruksområder.

Foundation Models Pharma Ad Generator

I dagens fartsfylte farmasøytiske industri er effektiv og lokalisert annonsering mer avgjørende enn noen gang. Det er her en innovativ løsning kommer inn i bildet, som bruker kraften til generativ AI til å lage lokaliserte farmaannonser fra kildebilder og PDF-er. Utover å bare øke hastigheten på annonsegenereringsprosessen, strømlinjeformer denne tilnærmingen den medisinske juridiske gjennomgangen (MLR). MLR er en streng gjennomgangsmekanisme der medisinske, juridiske og regulatoriske team omhyggelig evaluerer reklamemateriell for å garantere nøyaktighet, vitenskapelig støtte og samsvar med forskrifter. Tradisjonelle metoder for innholdsoppretting kan være tungvinte, og krever ofte manuelle justeringer og omfattende gjennomganger for å sikre samsvar med regional samsvar og relevans. Men med bruken av generativ kunstig intelligens, kan vi nå automatisere utformingen av annonser som virkelig gir gjenklang med lokalt publikum, samtidig som vi opprettholder strenge standarder og retningslinjer.

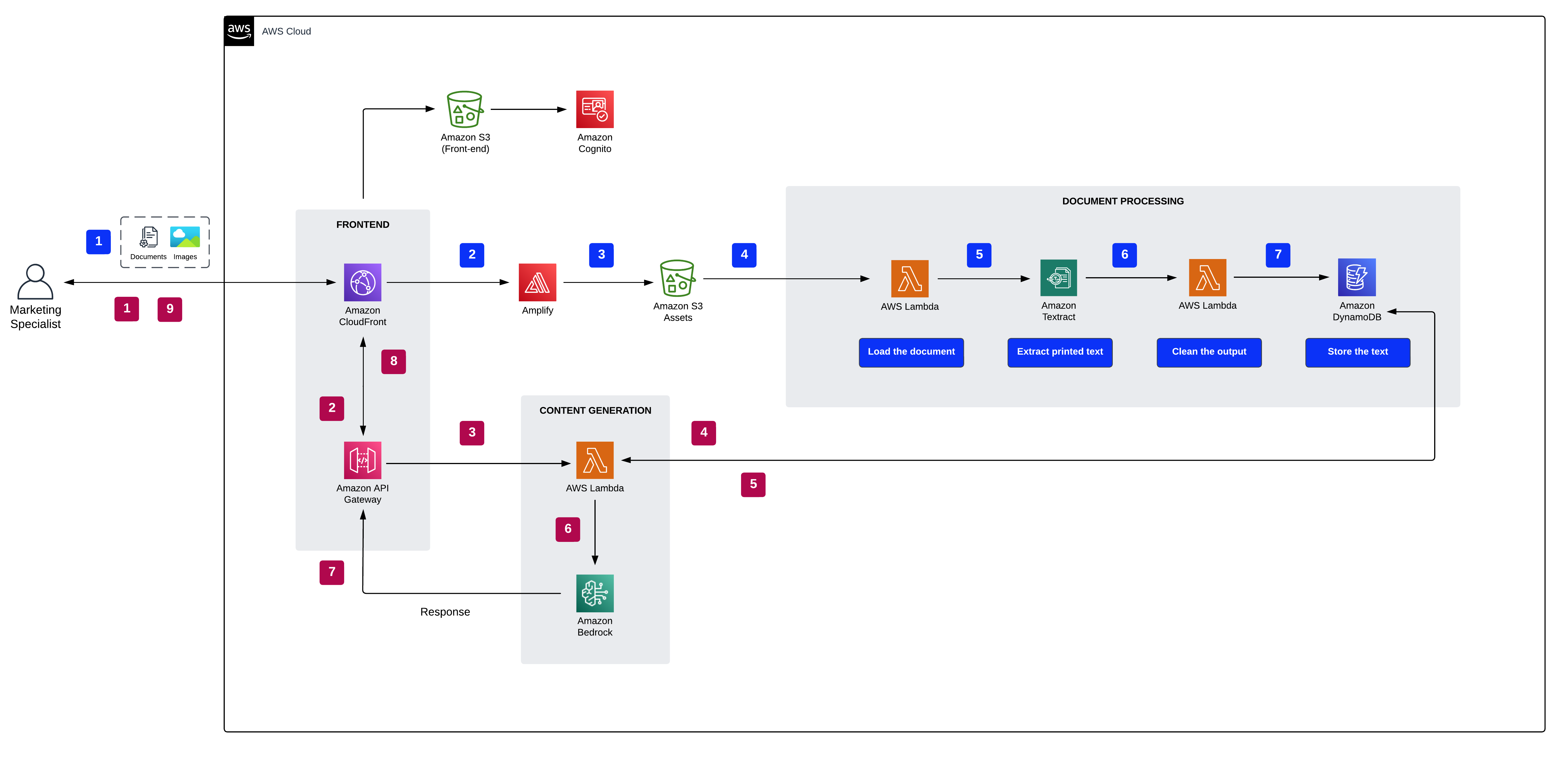

Følgende diagram illustrerer løsningsarkitekturen.

I den arkitektoniske layouten, basert på deres valgte modell og annonseinnstillinger, blir brukerne sømløst guidet til Amazon Bedrock-fundamentmodellene. Denne strømlinjeformede tilnærmingen sikrer at nye annonser genereres nøyaktig i henhold til ønsket konfigurasjon. Som en del av prosessen håndteres dokumenter effektivt av amazontekst, med den resulterende teksten trygt lagret i DynamoDB. En iøynefallende funksjon er den modulære designen for bilde- og tekstgenerering, som gir deg fleksibiliteten til uavhengig å regenerere enhver komponent etter behov.

Vi har gitt denne demoen i GitHub repo. Se distribusjonsinstruksjonene i readme-filen for å distribuere den til AWS-kontoen din.

Arbeidsflyt for innholdsgenerering

Følgende trinn skisserer prosessen for innholdsgenerering:

- Brukeren velger dokument, kildebilde, annonseplassering, språk og bildestil.

- Sikker tilgang til nettapplikasjonen er sikret gjennom Amazon Cognito-autentisering.

- Nettapplikasjonens grensesnitt er vert via Amplify.

- En WebSocket API, administrert av API Gateway, letter brukerforespørsler. Disse forespørslene er autentisert gjennom AWS identitets- og tilgangsadministrasjon (JEG ER).

- Integrasjon med Amazon Bedrock inkluderer følgende trinn:

- En Lambda-funksjon bruker LangChain-biblioteket for å koble til Amazon Bedrock-endepunktet ved hjelp av en kontekstrik spørring.

- Grunnleggende tekst-til-tekst-modellen lager en kontekstuelt passende annonse basert på den gitte konteksten og innstillingene.

- Grunnmodellen tekst-til-bilde skaper et skreddersydd bilde, påvirket av kildebildet, valgt stil og plassering.

- Brukeren mottar svaret gjennom en HTTPS-forespørsel via den integrerte API Gateway WebSocket API.

Arbeidsflyt for dokument- og bildebehandling

Følgende er fremgangsmåten for behandling av dokumenter og bilder:

- Brukeren laster opp eiendeler via det angitte brukergrensesnittet.

- Amplify API overfører dokumentene til en S3-bøtte.

- Etter at eiendelen er overført til Amazon S3, skjer en av følgende handlinger:

- Hvis det er et dokument, bruker en Lambda-funksjon Amazon Textract til å behandle og trekke ut tekst for annonsegenerering.

- Hvis det er et bilde, konverterer Lambda-funksjonen det til base64-format, egnet for Stable Diffusion-modellen for å lage et nytt bilde fra kilden.

- Den utpakkede teksten eller base64-bildestrengen er sikkert lagret i DynamoDB.

Fordeler

Følgende liste beskriver fordelene med denne løsningen:

- Effektivitet – Bruken av generativ AI akselererer annonsegenereringsprosessen betydelig, og eliminerer behovet for manuelle justeringer.

- Overholdelse av samsvar – Løsningen sikrer at genererte annonser overholder spesifikke veiledninger og forskrifter, for eksempel FDAs retningslinjer for markedsføring.

- Kostnadseffektiv – Ved å automatisere opprettelsen av skreddersydde annonser kan bedrifter redusere kostnadene knyttet til annonseproduksjon og revisjoner betydelig.

- Strømlinjeformet MLR-prosess – Løsningen forenkler MLR-prosessen, reduserer friksjonspunkter og sikrer jevnere vurderinger.

- Lokalisert resonans – Generativ AI produserer annonser som resonerer med lokalt publikum, og sikrer relevans og effekt i forskjellige regioner.

- Standardisering – Løsningen opprettholder nødvendige standarder og retningslinjer, og sikrer konsistens på tvers av alle genererte annonser.

- skalerbarhet – Den AI-drevne tilnærmingen kan håndtere enorme databaser med kildebilder og PDF-er, noe som gjør det mulig for storskala annonsegenerering.

- Redusert manuell inngripen – Automatiseringen reduserer behovet for menneskelig inngripen, minimerer feil og sikrer konsistens.

Du kan distribuere infrastrukturen i denne opplæringen fra din lokale datamaskin, eller du kan bruke AWS Cloud9 som din distribusjonsarbeidsstasjon. AWS Cloud9 kommer forhåndslastet med AWS CLI, AWS CDK og Docker. Hvis du velger AWS Cloud9, skape miljøet fra AWS Cloud9-konsoll.

Rydd opp

For å unngå unødvendige kostnader, ryd opp i all infrastrukturen som er opprettet via AWS CloudFormation-konsollen eller ved å kjøre følgende kommando på arbeidsstasjonen:

Husk i tillegg å stoppe eventuelle SageMaker-endepunkter du initierte via SageMaker-konsollen. Husk at sletting av en Amazon Kendra-indeks fjerner ikke originaldokumentene fra lagringen din.

konklusjonen

Generativ kunstig intelligens, illustrert av LLM-er, varsler et paradigmeskifte i hvordan vi får tilgang til og genererer informasjon. Selv om disse modellene er kraftige, er de ofte begrenset av treningsdataene deres. RAG adresserer denne utfordringen, og sikrer at den enorme kunnskapen innenfor disse modellene konsekvent er tilført relevant, aktuell innsikt.

Våre RAG-baserte demoer gir et konkret bevis på dette. De viser frem den sømløse synergien mellom Amazon Kendra, vektorinnbygginger og LLM-er, og skaper et system der informasjonen ikke bare er omfattende, men også nøyaktig og tidsriktig. Når du dykker ned i disse demoene, vil du utforske transformasjonspotensialet ved å slå sammen ferdigtrent kunnskap med de dynamiske egenskapene til RAG, noe som resulterer i resultater som både er pålitelige og skreddersydd for bedriftsinnhold.

Selv om generativ AI drevet av LLM-er åpner for en ny måte å få informasjonsinnsikt på, må denne innsikten være pålitelig og begrenset til bedriftsinnhold ved å bruke RAG-tilnærmingen. Disse RAG-baserte demoene gjør at du kan bli utstyrt med innsikt som er nøyaktig og oppdatert. Kvaliteten på denne innsikten er avhengig av semantisk relevans, som aktiveres ved å bruke Amazon Kendra og vektorinnbygging.

Hvis du er klar til å utforske og utnytte kraften til generativ AI ytterligere, her er de neste trinnene dine:

- Engasjer deg med demoene våre – Den praktiske erfaringen er uvurderlig. Utforsk funksjonene, forstå integrasjonene og gjør deg kjent med grensesnittet.

- Utdype kunnskapen din – Dra nytte av ressursene som er tilgjengelige. AWS tilbyr grundig dokumentasjon, veiledninger og fellesskapsstøtte for å hjelpe deg med AI-reisen.

- Sett i gang et pilotprosjekt – Vurder å starte med en småskala implementering av generativ AI i bedriften din. Dette vil gi innsikt i systemets praktiske og tilpasningsdyktighet innenfor din spesifikke kontekst.

For mer informasjon om generative AI-applikasjoner på AWS, se følgende:

Husk at landskapet til AI er i stadig utvikling. Hold deg oppdatert, vær nysgjerrig og vær alltid klar til å tilpasse og innovere.

Om forfatterne

Jin Tan Ruan er en Prototyping-utvikler i AWS Industries Prototyping and Customer Engineering (PACE)-teamet, som spesialiserer seg på NLP og generativ AI. Med bakgrunn fra programvareutvikling og ni AWS-sertifiseringer, bringer Jin med seg et vell av erfaring for å hjelpe AWS-kunder med å materialisere deres AI/ML og generative AI-visjoner ved å bruke AWS-plattformen. Han har en mastergrad i informatikk og programvareteknikk fra University of Syracuse. Utenom jobben liker Jin å spille videospill og fordype seg i den spennende verdenen av skrekkfilmer.

Jin Tan Ruan er en Prototyping-utvikler i AWS Industries Prototyping and Customer Engineering (PACE)-teamet, som spesialiserer seg på NLP og generativ AI. Med bakgrunn fra programvareutvikling og ni AWS-sertifiseringer, bringer Jin med seg et vell av erfaring for å hjelpe AWS-kunder med å materialisere deres AI/ML og generative AI-visjoner ved å bruke AWS-plattformen. Han har en mastergrad i informatikk og programvareteknikk fra University of Syracuse. Utenom jobben liker Jin å spille videospill og fordype seg i den spennende verdenen av skrekkfilmer.

Aravind Kodandaramaiah er en Senior Prototyping full stack-løsningsbygger i AWS Industries Prototyping and Customer Engineering (PACE) team. Han fokuserer på å hjelpe AWS-kunder med å gjøre innovative ideer til løsninger med målbare og hyggelige resultater. Han er lidenskapelig opptatt av en rekke emner, inkludert skysikkerhet, DevOps og AI/ML, og kan vanligvis bli funnet å fikse med disse teknologiene.

Aravind Kodandaramaiah er en Senior Prototyping full stack-løsningsbygger i AWS Industries Prototyping and Customer Engineering (PACE) team. Han fokuserer på å hjelpe AWS-kunder med å gjøre innovative ideer til løsninger med målbare og hyggelige resultater. Han er lidenskapelig opptatt av en rekke emner, inkludert skysikkerhet, DevOps og AI/ML, og kan vanligvis bli funnet å fikse med disse teknologiene.

Arjun Shakdher er en utvikler på AWS Industries Prototyping-teamet (PACE) som brenner for å blande teknologi inn i livets stoff. Med en mastergrad fra Purdue University, dreier Arjuns nåværende rolle rundt arkitektur og bygging av banebrytende prototyper som spenner over en rekke domener, og for tiden fremtredende med AI/ML og IoT. Når du ikke er fordypet i kode og digitale landskap, vil du finne Arjun hengi seg til kaffens verden, utforske den intrikate mekanikken til uret eller nyter bilkunsten.

Arjun Shakdher er en utvikler på AWS Industries Prototyping-teamet (PACE) som brenner for å blande teknologi inn i livets stoff. Med en mastergrad fra Purdue University, dreier Arjuns nåværende rolle rundt arkitektur og bygging av banebrytende prototyper som spenner over en rekke domener, og for tiden fremtredende med AI/ML og IoT. Når du ikke er fordypet i kode og digitale landskap, vil du finne Arjun hengi seg til kaffens verden, utforske den intrikate mekanikken til uret eller nyter bilkunsten.

- SEO-drevet innhold og PR-distribusjon. Bli forsterket i dag.

- PlatoData.Network Vertical Generative Ai. Styrk deg selv. Tilgang her.

- PlatoAiStream. Web3 Intelligence. Kunnskap forsterket. Tilgang her.

- PlatoESG. Karbon, CleanTech, Energi, Miljø, Solenergi, Avfallshåndtering. Tilgang her.

- PlatoHelse. Bioteknologisk og klinisk etterretning. Tilgang her.

- kilde: https://aws.amazon.com/blogs/machine-learning/harnessing-the-power-of-enterprise-data-with-generative-ai-insights-from-amazon-kendra-langchain-and-large-language-models/

- :er

- :ikke

- :hvor

- $OPP

- 100

- 150

- 7

- a

- evne

- Om oss

- akselererer

- adgang

- Ifølge

- Logg inn

- nøyaktighet

- nøyaktig

- tvers

- handlinger

- Ad

- tilpasse

- tilpasser

- la til

- adresser

- overholde

- justeringer

- vedta

- annonser

- avansert

- Fordel

- fordeler

- advent

- Annonsering

- Etter

- AI

- AI / ML

- Aid

- innretting

- Alle

- tillate

- tillate

- tillater

- nesten

- langs

- også

- alternativ

- alltid

- Amazon

- Amazon Cognito

- Amazon Kendra

- amazontekst

- Amazon Web Services

- beløp

- forsterke

- an

- og

- besvare

- svar

- noen

- api

- app

- Søknad

- søknader

- tilnærming

- hensiktsmessig

- arkitektonisk

- arkitektur

- ER

- rundt

- Array

- artisteri

- AS

- eiendel

- Eiendeler

- bistå

- assosiert

- publikum

- lyd

- autentisert

- Autentisering

- automatisere

- Automatisere

- Automatisering

- tilgjengelig

- unngå

- unngå

- AWS

- AWS Cloud9

- AWS skyformasjon

- tilbake

- Backed

- bakgrunn

- backing

- basen

- basert

- BE

- fordi

- bli

- blir

- Fordeler

- Bedre

- mellom

- Beyond

- skjevheter

- blending

- kroppen

- Bot

- både

- Branch

- Bringer

- bred

- bygger

- Bygning

- men

- by

- Samtaler

- CAN

- Kan få

- evner

- fangst

- fanger

- saken

- Kategori

- sertifiseringer

- utfordre

- utfordringer

- Velg

- valgt ut

- ren

- Cloud

- Cloud Security

- Cloud9

- kode

- Kaffe

- kombinert

- skurtreskerne

- kommer

- vanligvis

- samfunnet

- Selskaper

- sammenligninger

- komplekse

- samsvar

- kompatibel

- komponent

- forstår

- datamaskin

- informatikk

- Konfigurasjon

- Koble

- Tilkoblinger

- forbinder

- Vurder

- konsekvent

- Konsoll

- stadig

- innhold

- Innholdsgenerering

- innholdsskaping

- kontekst

- sammenhenger

- kontekstuelle

- fortsatte

- kontinuerlig

- Praktisk

- konvensjonell

- Samtale

- konvertering

- Kjerne

- Kostnad

- Kostnader

- lage

- skape

- opprettet

- skaper

- Opprette

- skaperverket

- avgjørende

- tungvint

- nysgjerrig

- Gjeldende

- skikk

- kunde

- Kunder

- skjærekant

- dato

- Database

- databaser

- datasett

- Dato

- dyp

- dypere

- Grad

- herlig

- demo

- Demonstrasjoner

- avhengig

- utplassere

- utplassert

- utplasserings

- distribusjon

- beskrive

- utforming

- designet

- ønsket

- ødelegge

- detaljert

- detaljer

- Utvikler

- Utvikling

- diagnostisk

- forskjellig

- kringkasting

- digitalt

- regissert

- skjermer

- distinkt

- dykk

- diverse

- dykking

- Docker

- dokument

- dokumentasjon

- dokumenter

- ikke

- domener

- tegne

- tegning

- drevet

- dynamisk

- lett

- effektivitet

- effektiv

- effektivt

- enten

- eliminere

- embedding

- dukke

- anvender

- empowered

- bemyndiger

- muliggjøre

- aktivert

- muliggjør

- muliggjør

- slutt

- Endpoint

- Ingeniørarbeid

- forbedret

- berikende

- sikre

- sikres

- sikrer

- sikrer

- Enterprise

- Hele

- utstyrt

- feil

- spesielt

- essens

- evaluere

- Event

- NOEN GANG

- utvikle seg

- utvikling

- eksempel

- opphisset

- ekspansiv

- erfaring

- Expert

- eksperter

- utforske

- Utforske

- omfattende

- utvendig

- trekke ut

- stoff

- forenkler

- lest

- Fartsfylt

- FB

- gjennomførbart

- Trekk

- Egenskaper

- Featuring

- filet

- filtrering

- Finn

- Først

- fleksibilitet

- fokuserer

- etter

- følger

- Til

- format

- funnet

- Fundament

- friksjon

- fra

- foran

- Front end

- fullt

- Full stabel

- funksjon

- funksjonalitet

- videre

- Dess

- Gevinst

- få

- Games

- gateway

- generere

- generert

- generasjonen

- generative

- Generativ AI

- generator

- få

- gitt

- Giving

- innvilgelse

- gripe

- Vokser

- garantere

- veiledning

- guidet

- retningslinjer

- håndtere

- hands-on

- seletøy

- Utnyttelse

- Ha

- å ha

- he

- hjelpe

- bebuder

- her.

- striper

- selv

- historier

- historie

- holder

- holder

- horror

- vert

- Hvordan

- Men

- HTML

- http

- HTTPS

- menneskelig

- Ideer

- identifikator

- identifikatorer

- identifisere

- Identitet

- if

- illustrerer

- bilde

- bilder

- nedsenket

- Påvirkning

- gjennomføring

- in

- dyptgående

- unøyaktig

- inkluderer

- Inkludert

- innlemme

- uavhengig av hverandre

- indeks

- indeksert

- indekser

- bransjer

- industri

- industristandarder

- påvirket

- informasjon

- informert

- Infrastruktur

- iboende

- innledende

- initiert

- innovere

- innovative

- innsiktsfull

- innsikt

- i stedet

- instruksjoner

- integrert

- Integrerer

- integrering

- integrasjoner

- hensikt

- interaktiv

- Interface

- intervensjon

- inn

- egenverdi

- uvurderlig

- IOT

- IT

- varer

- DET ER

- Jobb

- reise

- jpg

- bare

- kunnskap

- kjent

- landskap

- Språk

- stor

- storskala

- Layout

- læring

- Lovlig

- Lar

- Bibliotek

- Licensed

- Life

- i likhet med

- sannsynligheten

- Begrenset

- grenser

- Liste

- LLM

- lokal

- plassering

- maskin

- maskinlæring

- opprettholder

- Making

- fikk til

- håndbok

- mange

- Marketing

- massive

- mestere

- fyrstikker

- materialer

- betyr

- meningsfylt

- betydninger

- midler

- mekanikk

- mekanisme

- medisinsk

- Minne

- bare

- fusjoner

- sammenslåing

- metoder

- omhyggelig

- minimere

- skadebegrensning

- ML

- modell

- modellering

- modeller

- modulære

- mer

- mest

- Filmer

- må

- Naturlig

- Natural Language Processing

- nødvendig

- Trenger

- nødvendig

- trenger

- behov

- Ny

- neste

- ni

- nlp

- varsling

- nå

- of

- tilby

- Tilbud

- ofte

- on

- ONE

- bare

- åpner

- or

- organisasjons

- organisasjoner

- original

- Annen

- vår

- ut

- utfall

- omriss

- utganger

- utenfor

- enn

- Overcome

- Fred

- paradigmet

- parametere

- del

- lidenskapelig

- perfekt

- tillatelser

- Personlig

- Farma

- Pharmaceutical

- setninger

- stykker

- pilot

- pilotprosjekt

- Sted

- plassering

- plattform

- plato

- Platon Data Intelligence

- PlatonData

- Spille

- spiller

- poeng

- posisjonering

- mulig

- Post

- potensiell

- makt

- powered

- kraftig

- Praktisk

- presis

- nettopp

- Precision

- preferanser

- forutsetninger

- i dag

- prosedyren

- prosess

- Bearbeidet

- prosessering

- produsert

- produserer

- Produksjon

- prosjekt

- reklame

- prototyper

- prototyping

- Bevis

- gi

- forutsatt

- gir

- gi

- kvalitet

- spørsmål

- spørsmål

- spørsmål

- Rask

- raskt

- område

- klar

- realms

- mottar

- mottak

- Anbefaling

- redusere

- reduserer

- redusere

- referere

- raffinert

- regional

- regioner

- regelmessig

- forskrifter

- regulatorer

- Overholdelse av regelverk

- relevans

- relevant

- avhengig

- forbli

- forblir

- husker

- fjerne

- omformulering

- representasjon

- representerer

- anmode

- forespørsler

- krever

- påkrevd

- Krav

- resonator

- Ressurser

- svar

- svar

- ansvar

- ansvarlig

- resulterende

- resulterende

- Resultater

- anmeldelse

- Anmeldelser

- revisjoner

- dreier seg

- ikke sant

- streng

- Rolle

- rennende

- går

- sagemaker

- samme

- lagret

- Vitenskap

- vitenskapelig

- sømløs

- sømløst

- Søk

- seksjoner

- sikre

- sikkert

- sikkerhet

- valgt

- utvalg

- senior

- sendt

- tjeneste

- Tjenester

- sett

- innstillinger

- oppsett

- skift

- presentere

- Viser

- Sikte

- signifikant

- betydelig

- Enkelt

- ganske enkelt

- mindre

- jevnere

- Software

- programvareutvikling

- software engineering

- utelukkende

- løsning

- Solutions

- kilde

- hentet

- Kilder

- Sourcing

- mellomrom

- span

- spesialisert

- spesialisert

- spesifikk

- spesifisert

- stabil

- stable

- standarder

- Start

- state-of-the-art

- opphold

- Trinn

- Steps

- Stopp

- lagring

- oppbevare

- lagret

- lagring

- strømlinjeformet

- styrker

- String

- strengere

- strukturert

- stil

- send

- slik

- egnet

- støtte

- Støttes

- synergi

- system

- skreddersydd

- Ta

- tar

- håndgripelig

- Oppgave

- oppgaver

- lag

- lag

- teknikk

- Technologies

- Teknologi

- testament

- tekst

- enn

- Det

- De

- Landskapet

- Kilden

- verden

- deres

- Dem

- deretter

- derved

- Disse

- de

- denne

- tre

- spennende

- Gjennom

- tid

- rettidig

- tidsstempel

- titan

- til

- dagens

- verktøy

- verktøy

- Tema

- temaer

- mot

- tradisjonelle

- Tog

- trent

- Kurs

- overføre

- overføres

- overføringer

- Transform

- transformativ

- transformers

- Trender

- virkelig

- troverdig

- SVING

- tutorial

- tutorials

- typer

- ui

- gjennomgå

- underliggende

- forstå

- forståelse

- unik

- universitet

- I motsetning til

- unødvendig

- avdekke

- up-to-date

- Oppdater

- oppdatert

- oppdateringer

- opprettholdelse

- upon

- bruke

- bruk sak

- Bruker

- Brukergrensesnitt

- Brukere

- bruker

- ved hjelp av

- vanligvis

- bruker

- utnytte

- ulike

- enorme

- allsidig

- av

- video

- videospill

- visjoner

- Vei..

- we

- Rikdom

- web

- Webapplikasjon

- webtjenester

- nettstikkontakt

- var

- når

- hvilken

- mens

- HVEM

- bred

- Bred rekkevidde

- vil

- med

- innenfor

- uten

- ord

- Arbeid

- arbeidsflyt

- arbeidsstasjon

- verden

- Du

- Din

- deg selv

- zephyrnet