Dette innlegget er skrevet sammen med Kostia Kofman og Jenny Tokar fra Booking.com.

Som en global leder innen reisebransjen på nett, Booking.com søker alltid innovative måter å forbedre sine tjenester og gi kundene skreddersydde og sømløse opplevelser. Rangeringsteamet hos Booking.com spiller en sentral rolle for å sikre at søke- og anbefalingsalgoritmene er optimalisert for å levere de beste resultatene for brukerne sine.

Ved å dele interne ressurser med andre interne team, møtte Ranking Team Machine learning (ML)-forskere ofte lange ventetider for å få tilgang til ressurser for modelltrening og eksperimentering – noe som utfordret deres evne til raskt å eksperimentere og innovere. Ranking-teamet erkjente behovet for en modernisert ML-infrastruktur, og la ut på en reise for å bruke kraften til Amazon SageMaker å bygge, trene og distribuere ML-modeller i stor skala.

Booking.com samarbeidet med AWS profesjonelle tjenester å bygge en løsning for å akselerere tiden-til-markedet for forbedrede ML-modeller gjennom følgende forbedringer:

- Reduserte ventetider for ressurser til trening og eksperimentering

- Integrasjon av essensielle ML-funksjoner som hyperparameterinnstilling

- En redusert utviklingssyklus for ML-modeller

Reduserte ventetider ville bety at teamet raskt kunne iterere og eksperimentere med modeller, og få innsikt i et mye raskere tempo. Bruk av SageMaker on-demand tilgjengelige forekomster tillot en tidoblet ventetid. Essensielle ML-funksjoner som hyperparameterinnstilling og modellforklaring manglet i lokalene. Teamets moderniseringsreise introduserte disse funksjonene gjennom Amazon SageMaker Automatisk modellinnstilling og Amazon SageMaker Clarify. Til slutt var teamets ambisjon å motta umiddelbar tilbakemelding på hver endring som ble gjort i koden, redusere tilbakemeldingssløyfen fra minutter til et øyeblikk, og dermed redusere utviklingssyklusen for ML-modeller.

I dette innlegget fordyper vi oss i reisen som ble gjennomført av rangeringsteamet på Booking.com da de utnyttet mulighetene til SageMaker for å modernisere rammeverket for ML-eksperimentering. Ved å gjøre det overvant de ikke bare sine eksisterende utfordringer, men forbedret også søkeopplevelsen, noe som til slutt kom millioner av reisende over hele verden til gode.

Tilnærming til modernisering

Ranking-teamet består av flere ML-forskere som hver trenger å utvikle og teste sin egen modell offline. Når en modell anses som vellykket i henhold til offline-evalueringen, kan den flyttes til produksjons A/B-testing. Hvis den viser online forbedring, kan den distribueres til alle brukerne.

Målet med dette prosjektet var å skape et brukervennlig miljø for ML-forskere for enkelt å kunne kjøre tilpassbare Amazon SageMaker Model Building Pipelines å teste hypotesene sine uten å måtte kode lange og kompliserte moduler.

En av flere utfordringer var å tilpasse den eksisterende rørledningsløsningen på stedet for bruk på AWS. Løsningen innebar to nøkkelkomponenter:

- Endring og utvidelse av eksisterende kode – Den første delen av løsningen vår innebar modifikasjon og utvidelse av vår eksisterende kode for å gjøre den kompatibel med AWS-infrastruktur. Dette var avgjørende for å sikre en jevn overgang fra lokalt til skybasert prosessering.

- Utvikling av klientpakke – Det ble utviklet en klientpakke som fungerer som en innpakning rundt SageMaker APIer og den tidligere eksisterende koden. Denne pakken kombinerer de to, og gjør det mulig for ML-forskere å enkelt konfigurere og distribuere ML-rørledninger uten koding.

SageMaker-rørledningskonfigurasjon

Tilpassbarhet er nøkkelen til modellbyggingspipeline, og den ble oppnådd gjennom config.ini, en omfattende konfigurasjonsfil. Denne filen fungerer som kontrollsenter for alle inndata og atferd i rørledningen.

Tilgjengelige konfigurasjoner innvendig config.ini inkluderer:

- Pipeline detaljer – Utøveren kan definere rørledningens navn, spesifisere hvilke trinn som skal kjøres, bestemme hvor utdata skal lagres i Amazon enkel lagringstjeneste (Amazon S3), og velg hvilke datasett som skal brukes

- AWS-kontodetaljer – Du kan bestemme hvilken region rørledningen skal gå i og hvilken rolle som skal brukes

- Trinnspesifikk konfigurasjon – For hvert trinn i pipelinen kan du spesifisere detaljer som antall og type forekomster som skal brukes, sammen med relevante parametere

Følgende kode viser et eksempel på en konfigurasjonsfil:

config.ini er en versjonskontrollert fil administrert av Git, som representerer den minimale konfigurasjonen som kreves for en vellykket treningspipelinekjøring. Under utviklingen kan lokale konfigurasjonsfiler som ikke er versjonskontrollerte brukes. Disse lokale konfigurasjonsfilene trenger bare å inneholde innstillinger som er relevante for en spesifikk kjøring, og introduserer fleksibilitet uten kompleksitet. Klienten for opprettelse av rørledninger er utformet for å håndtere flere konfigurasjonsfiler, der den siste har forrang over tidligere innstillinger.

SageMaker pipeline trinn

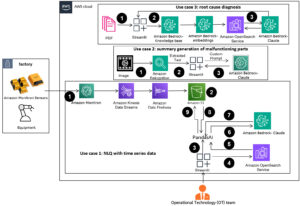

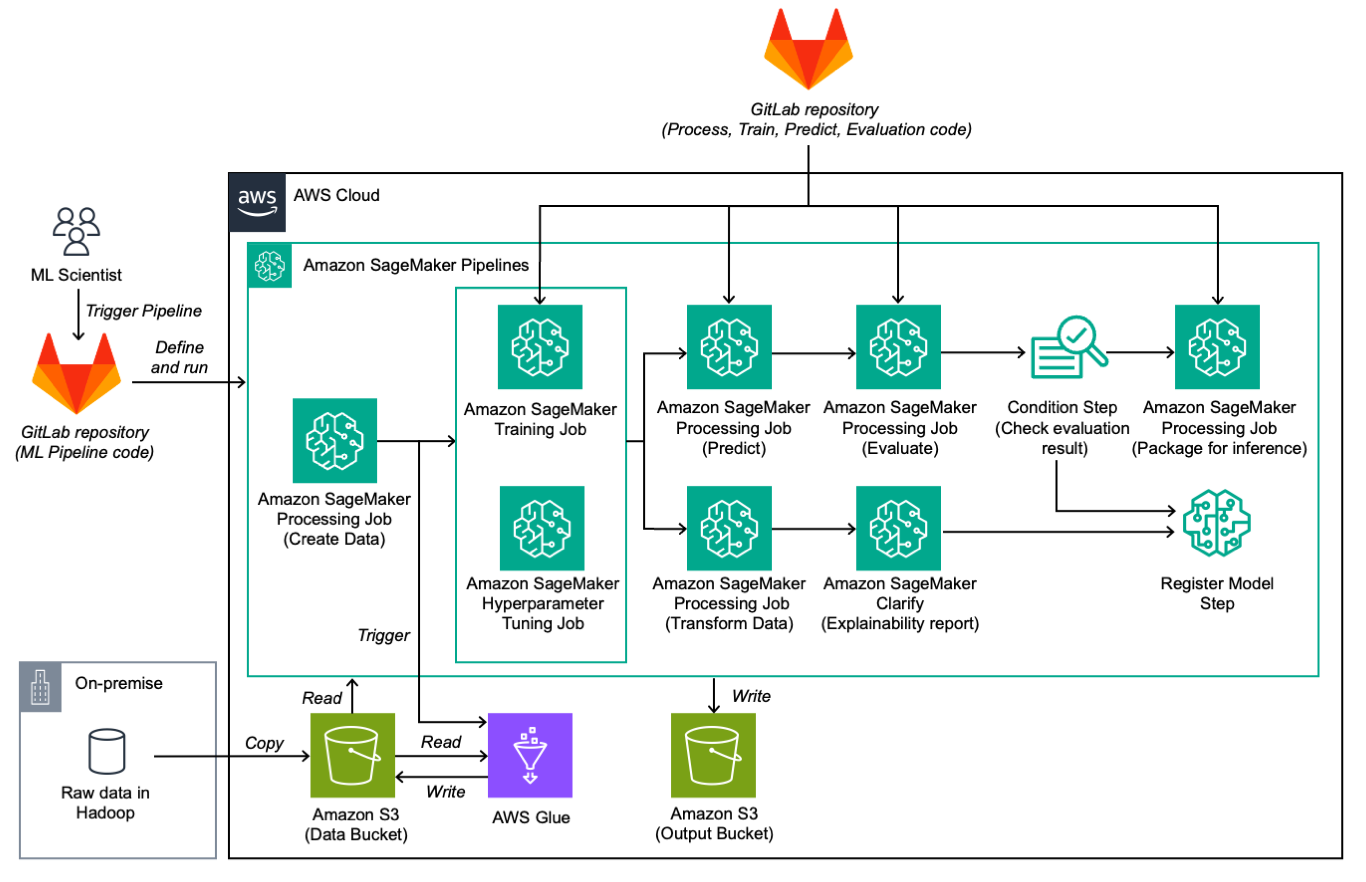

Rørledningen er delt inn i følgende trinn:

- Tren og test dataforberedelse – Terabyte med rådata kopieres til en S3-bøtte, behandlet ved hjelp av AWS Lim jobber for Spark-behandling, noe som resulterer i data strukturert og formatert for kompatibilitet.

- Tog – Opplæringstrinnet bruker TensorFlow-estimatoren for SageMaker-treningsjobber. Trening skjer på en distribuert måte ved hjelp av Horovod, og den resulterende modellartefakten lagres i Amazon S3. For justering av hyperparameter kan en jobb med hyperparameteroptimalisering (HPO) startes, og velge den beste modellen basert på målverdien.

- forutsi – I dette trinnet bruker en SageMaker Processing-jobb den lagrede modellartefakten til å lage spådommer. Denne prosessen går parallelt på tilgjengelige maskiner, og prediksjonsresultatene lagres i Amazon S3.

- Evaluere – En PySpark-behandlingsjobb evaluerer modellen ved hjelp av et tilpasset Spark-skript. Evalueringsrapporten lagres deretter i Amazon S3.

- Betingelse – Etter evaluering tas en beslutning om modellens kvalitet. Denne avgjørelsen er basert på en tilstandsberegning definert i konfigurasjonsfilen. Dersom evalueringen er positiv, registreres modellen som godkjent; ellers blir den registrert som avvist. I begge tilfeller blir evaluerings- og forklaringsrapporten, hvis den er generert, registrert i modellregisteret.

- Pakkemodell for slutning – Ved å bruke en behandlingsjobb, hvis evalueringsresultatene er positive, pakkes modellen, lagres i Amazon S3 og gjøres klar for opplasting til den interne ML-portalen.

- Forklar – SageMaker Clarify genererer en forklaringsrapport.

To distinkte depoter brukes. Det første depotet inneholder definisjonen og byggekoden for ML-rørledningen, og det andre depotet inneholder koden som kjører i hvert trinn, for eksempel prosessering, opplæring, prediksjon og evaluering. Denne dual-repository-tilnærmingen gir mulighet for større modularitet, og gjør det mulig for vitenskaps- og ingeniørteam å iterere uavhengig på ML-kode og ML-rørledningskomponenter.

Følgende diagram illustrerer arbeidsflyten.

Automatisk modellinnstilling

Trening av ML-modeller krever en iterativ tilnærming av flere treningseksperimenter for å bygge en robust og effektiv sluttmodell for forretningsbruk. ML-forskerne må velge riktig modelltype, bygge de riktige input-datasettene og justere settet med hyperparametre som kontrollerer modelllæringsprosessen under trening.

Valget av passende verdier for hyperparametre for modelltreningsprosessen kan påvirke den endelige ytelsen til modellen betydelig. Det er imidlertid ingen unik eller definert måte å finne ut hvilke verdier som er passende for et spesifikt brukstilfelle. Mesteparten av tiden vil ML-forskere måtte kjøre flere treningsjobber med litt forskjellige sett med hyperparametere, observere modelltreningsberegningene og deretter prøve å velge mer lovende verdier for neste iterasjon. Denne prosessen med å justere modellytelsen er også kjent som hyperparameteroptimalisering (HPO), og kan til tider kreve hundrevis av eksperimenter.

Rangeringsteamet pleide å utføre HPO manuelt i sitt lokale miljø fordi de bare kunne starte et svært begrenset antall opplæringsjobber parallelt. Derfor måtte de kjøre HPO sekvensielt, teste og velge forskjellige kombinasjoner av hyperparameterverdier manuelt, og regelmessig overvåke fremdriften. Dette forlenget modellutviklingen og innstillingsprosessen og begrenset det totale antallet HPO-eksperimenter som kunne kjøres i løpet av en mulig tid.

Med overgangen til AWS kunne Ranking-teamet bruke funksjonen for automatisk modellinnstilling (AMT) til SageMaker. AMT gjør det mulig for Ranking ML-forskere å automatisk starte hundrevis av treningsjobber innenfor hyperparameterområder av interesse for å finne den beste versjonen av den endelige modellen i henhold til den valgte metrikken. Rangeringsteamet kan nå velge mellom fire forskjellige automatiske innstillingsstrategier for valg av hyperparameter:

- Rutenettsøk – AMT vil forvente at alle hyperparametere er kategoriske verdier, og den vil starte treningsjobber for hver distinkte kategoriske kombinasjon, og utforske hele hyperparameterrommet.

- Tilfeldig søk – AMT vil tilfeldig velge kombinasjoner av hyperparameterverdier innenfor angitte områder. Fordi det ikke er noen avhengighet mellom ulike treningsjobber og parameterverdivalg, kan flere parallelle treningsjobber lanseres med denne metoden, noe som fremskynder den optimale parametervalgsprosessen.

- Bayesian optimalisering – AMT bruker Bayesiansk optimaliseringsimplementering for å gjette det beste settet med hyperparameterverdier, og behandler det som et regresjonsproblem. Den vil vurdere tidligere testede hyperparameterkombinasjoner og dens innvirkning på modelltreningsjobbene med det nye parametervalget, og optimalisere for smartere parametervalg med færre eksperimenter, men det vil også starte treningsjobber bare sekvensielt for alltid å kunne lære av tidligere opplæring.

- Hyperbånd – AMT vil bruke mellom- og sluttresultater av treningsjobbene den kjører for å dynamisk omfordele ressurser til treningsjobber med hyperparameterkonfigurasjoner som viser mer lovende resultater samtidig som de automatisk stopper de som underpresterer.

AMT på SageMaker gjorde det mulig for Ranking-teamet å redusere tiden brukt på hyperparameterinnstillingsprosessen for modellutviklingen deres ved å gjøre det mulig for dem for første gang å kjøre flere parallelle eksperimenter, bruke automatiske innstillingsstrategier og utføre tosifrede treningsjobbkjøringer innen dager, noe som ikke var gjennomførbart i lokalene.

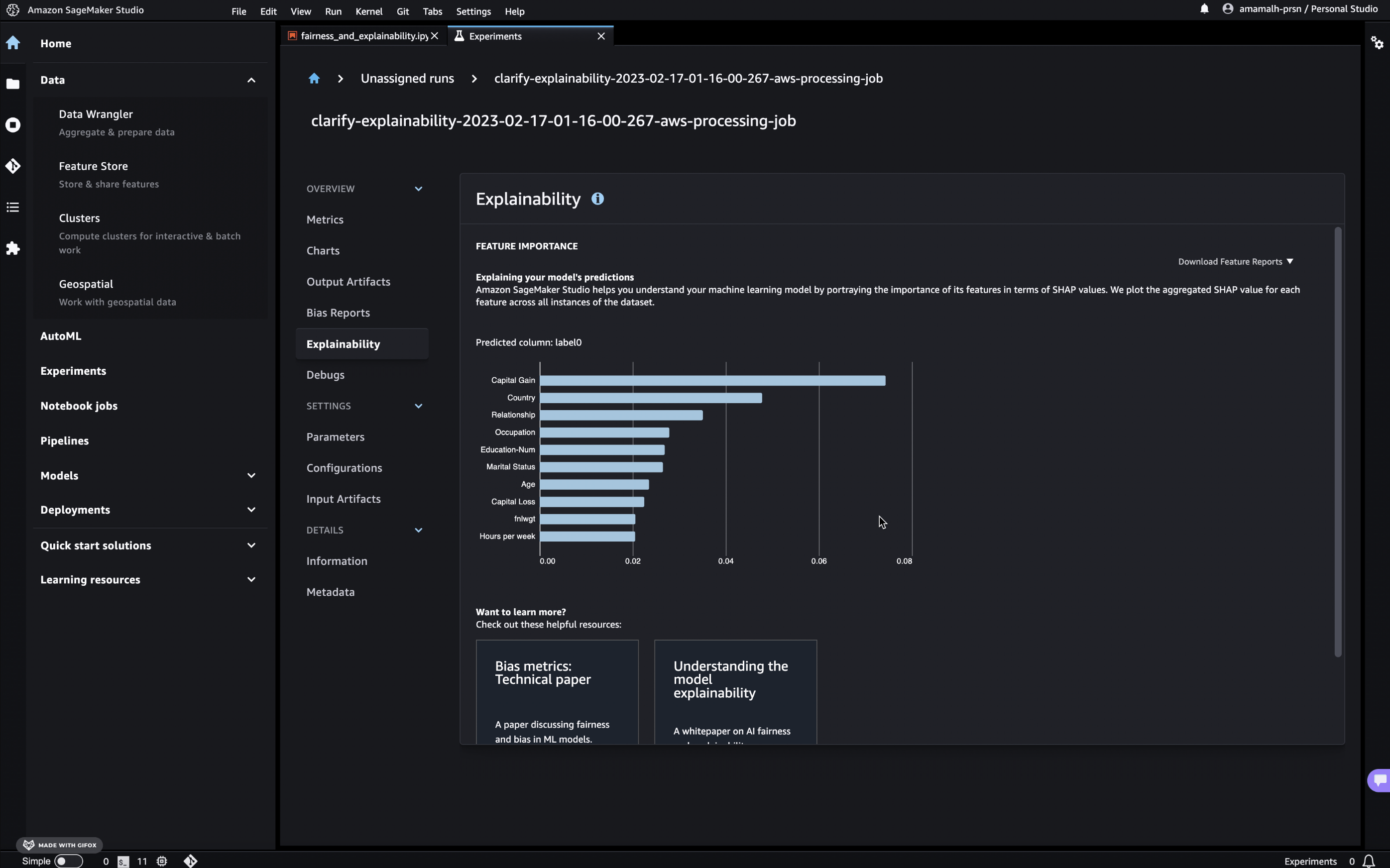

Modellforklaring med SageMaker Clarify

Modellforklaring gjør det mulig for ML-utøvere å forstå naturen og oppførselen til ML-modellene deres ved å gi verdifull innsikt for funksjonsutvikling og valgbeslutninger, som igjen forbedrer kvaliteten på modellprediksjonene. Rangeringsteamet ønsket å evaluere deres forklarbarhetsinnsikt på to måter: forstå hvordan funksjonsinndata påvirker modellutdata på tvers av hele datasettet deres (global tolkbarhet), og også være i stand til å oppdage inputfunksjonspåvirkning for en spesifikk modellprediksjon på et datapunkt av interesse ( lokal tolkning). Med disse dataene kan Ranking ML-forskere ta informerte beslutninger om hvordan de kan forbedre modellytelsen ytterligere og redegjøre for de utfordrende prediksjonsresultatene som modellen av og til vil gi.

SageMaker Clarify lar deg generere modellforklaringsrapporter ved hjelp av Shapley Additive forklaringer (SHAP) når du trener modellene dine på SageMaker, og støtter både global og lokal modelltolkbarhet. I tillegg til modellforklaringsrapporter, støtter SageMaker Clarify kjøring av analyser for skjevhetsmålinger før trening, skjevhetsmålinger etter trening og partielle avhengighetsplott. Jobben vil bli kjørt som en SageMaker Processing-jobb i AWS-kontoen og den integreres direkte med SageMaker-rørledningene.

Den globale tolkningsrapporten vil automatisk genereres i jobbutdataene og vises i Amazon SageMaker Studio miljø som en del av treningsforsøket. Hvis denne modellen deretter registreres i SageMaker modellregister, vil rapporten i tillegg bli knyttet til modellartefakten. Ved å bruke begge disse alternativene kunne Ranking-teamet enkelt spore forskjellige modellversjoner og deres atferdsendringer.

For å utforske inndatafunksjonens innvirkning på en enkelt prediksjon (lokale tolkningsverdier), aktivert rangeringsteamet parameteren save_local_shap_values i SageMaker Clarify-jobbene og var i stand til å laste dem fra S3-bøtten for videre analyser i Jupyter-notatbøkene i SageMaker Studio.

De foregående bildene viser et eksempel på hvordan en modellforklarbarhet vil se ut for en vilkårlig ML-modell.

Treningsoptimalisering

Fremveksten av dyp læring (DL) har ført til at ML har blitt stadig mer avhengig av beregningskraft og enorme mengder data. ML-utøvere møter ofte hindringen med å effektivt bruke ressurser når de trener disse komplekse modellene. Når du kjører trening på store dataklynger, oppstår det ulike utfordringer med å optimalisere ressursutnyttelsen, inkludert problemer som I/O-flaskehalser, kjernelanseringsforsinkelser, minnebegrensninger og underutnyttede ressurser. Hvis konfigurasjonen av treningsjobben ikke er finjustert for effektivitet, kan disse hindringene resultere i suboptimal maskinvarebruk, forlenget treningsvarighet eller til og med ufullstendige treningsløp. Disse faktorene øker prosjektkostnadene og forsinker tidslinjer.

Profilering av CPU- og GPU-bruk hjelper til med å forstå disse ineffektivitetene, bestemme maskinvareressursforbruket (tid og minne) til de ulike TensorFlow-operasjonene i modellen din, løse ytelsesflaskehalser og, til slutt, få modellen til å kjøre raskere.

Rangeringsteamet brukte rammeprofileringsfunksjonen til Amazon SageMaker Debugger (nå avviklet til fordel for Amazon SageMaker Profiler) for å optimalisere disse treningsjobbene. Dette lar deg spore alle aktiviteter på CPUer og GPUer, for eksempel CPU- og GPU-bruk, kjernekjøringer på GPUer, kjernelanseringer på CPUer, synkroniseringsoperasjoner, minneoperasjoner på tvers av GPUer, latenser mellom kjernelanseringer og tilsvarende kjøringer, og dataoverføring mellom CPUer og GPUer.

Rangeringsteamet brukte også TensorFlow Profiler funksjon av TensorBoard, som ytterligere bidro til å profilere TensorFlow-modellopplæringen. SageMaker er nå videre integrert med TensorBoard og bringer visualiseringsverktøyene til TensorBoard til SageMaker, integrert med SageMaker-trening og domener. TensorBoard lar deg utføre modellfeilsøkingsoppgaver ved å bruke TensorBoard-visualiseringspluginene.

Ved hjelp av disse to verktøyene optimaliserte Ranking-teamet deres TensorFlow-modell og var i stand til å identifisere flaskehalser og redusere den gjennomsnittlige treningstiden fra 350 millisekunder til 140 millisekunder på CPU og fra 170 millisekunder til 70 millisekunder på GPU, hastigheter på 60 % og 59 %, henholdsvis.

Forretningsresultater

Migrasjonsarbeidet sentrerte seg rundt å forbedre tilgjengelighet, skalerbarhet og elastisitet, som samlet brakte ML-miljøet mot et nytt nivå av operasjonell fortreffelighet, eksemplifisert ved økt modelltreningsfrekvens og reduserte feil, optimaliserte treningstider og avanserte ML-evner.

Modelltreningsfrekvens og feil

Antallet månedlige modellopplæringsjobber femdoblet seg, noe som førte til betydelig hyppigere modelloptimaliseringer. Videre førte det nye ML-miljøet til en reduksjon i feilprosenten for rørledninger, og falt fra omtrent 50 % til 20 %. Den mislykkede jobbbehandlingstiden gikk drastisk ned, fra over en time i gjennomsnitt til ubetydelige 5 sekunder. Dette har kraftig økt driftseffektiviteten og redusert ressurssvinn.

Optimalisert treningstid

Migreringen førte med seg effektivitetsøkninger gjennom SageMaker-basert GPU-trening. Dette skiftet reduserte modelltreningstiden til en femtedel av den forrige varigheten. Tidligere brukte opplæringsprosessene for dyplæringsmodeller rundt 60 timer på CPU; dette ble strømlinjeformet til omtrent 12 timer på GPU. Denne forbedringen sparer ikke bare tid, men fremskynder også utviklingssyklusen, og muliggjør raskere iterasjoner og modellforbedringer.

Avanserte ML-funksjoner

Sentralt for suksessen til migreringen er bruken av SageMaker-funksjonssettet, som omfatter hyperparameterinnstilling og modellforklaring. Videre tillot migreringen sømløs eksperimentsporing ved hjelp av Amazon SageMaker-eksperimenter, som muliggjør mer innsiktsfull og produktiv eksperimentering.

Det viktigste er at det nye ML-eksperimenteringsmiljøet støttet den vellykkede utviklingen av en ny modell som nå er i produksjon. Denne modellen er dyp læring snarere enn trebasert og har introdusert merkbare forbedringer i ytelsen til nettmodeller.

konklusjonen

Dette innlegget ga en oversikt over AWS Professional Services og Booking.com-samarbeidet som resulterte i implementeringen av et skalerbart ML-rammeverk og reduserte tiden-til-markedet for ML-modeller til rangeringsteamet deres.

Rangeringsteamet på Booking.com lærte at migrering til skyen og SageMaker har vist seg fordelaktig, og at tilpasning av maskinlæringsoperasjoner (MLOps) gjør det mulig for ML-ingeniørene og forskerne å fokusere på håndverket og øke utviklingshastigheten. Teamet deler læringen og arbeidet som er gjort med hele ML-fellesskapet på Booking.com, gjennom samtaler og dedikerte økter med ML-utøvere hvor de deler koden og evnene. Vi håper dette innlegget kan tjene som en annen måte å dele kunnskapen på.

AWS Professional Services er klar til å hjelpe teamet ditt med å utvikle skalerbar og produksjonsklar ML i AWS. For mer informasjon, se AWS profesjonelle tjenester eller ta kontakt med din kontoadministrator for å ta kontakt.

Om forfatterne

Laurens van der Maas er maskinlæringsingeniør hos AWS Professional Services. Han jobber tett med kunder som bygger sine maskinlæringsløsninger på AWS, spesialiserer seg på distribuert opplæring, eksperimentering og ansvarlig AI, og brenner for hvordan maskinlæring endrer verden slik vi kjenner den.

Laurens van der Maas er maskinlæringsingeniør hos AWS Professional Services. Han jobber tett med kunder som bygger sine maskinlæringsløsninger på AWS, spesialiserer seg på distribuert opplæring, eksperimentering og ansvarlig AI, og brenner for hvordan maskinlæring endrer verden slik vi kjenner den.

Daniel Zagyva er dataforsker ved AWS Professional Services. Han spesialiserer seg på å utvikle skalerbare maskinlæringsløsninger i produksjonsgrad for AWS-kunder. Hans erfaring strekker seg over forskjellige områder, inkludert naturlig språkbehandling, generativ AI og maskinlæringsoperasjoner.

Daniel Zagyva er dataforsker ved AWS Professional Services. Han spesialiserer seg på å utvikle skalerbare maskinlæringsløsninger i produksjonsgrad for AWS-kunder. Hans erfaring strekker seg over forskjellige områder, inkludert naturlig språkbehandling, generativ AI og maskinlæringsoperasjoner.

Kostia Kofman er en Senior Machine Learning Manager hos Booking.com, som leder Search Ranking ML-teamet, og fører tilsyn med Booking.coms mest omfattende ML-system. Med ekspertise innen personalisering og rangering, trives han med å utnytte banebrytende teknologi for å forbedre kundeopplevelsene.

Kostia Kofman er en Senior Machine Learning Manager hos Booking.com, som leder Search Ranking ML-teamet, og fører tilsyn med Booking.coms mest omfattende ML-system. Med ekspertise innen personalisering og rangering, trives han med å utnytte banebrytende teknologi for å forbedre kundeopplevelsene.

Jenny Tokar er senior maskinlæringsingeniør ved Booking.coms søkerangeringsteam. Hun spesialiserer seg på å utvikle ende-til-ende ML-rørledninger preget av effektivitet, pålitelighet, skalerbarhet og innovasjon. Jennys ekspertise gjør teamet hennes i stand til å lage banebrytende rangeringsmodeller som betjener millioner av brukere hver dag.

Jenny Tokar er senior maskinlæringsingeniør ved Booking.coms søkerangeringsteam. Hun spesialiserer seg på å utvikle ende-til-ende ML-rørledninger preget av effektivitet, pålitelighet, skalerbarhet og innovasjon. Jennys ekspertise gjør teamet hennes i stand til å lage banebrytende rangeringsmodeller som betjener millioner av brukere hver dag.

Aleksandra Dokic er senior dataforsker ved AWS Professional Services. Hun liker å støtte kunder med å bygge innovative AI/ML-løsninger på AWS, og hun er begeistret for forretningstransformasjoner gjennom kraften til data.

Aleksandra Dokic er senior dataforsker ved AWS Professional Services. Hun liker å støtte kunder med å bygge innovative AI/ML-løsninger på AWS, og hun er begeistret for forretningstransformasjoner gjennom kraften til data.

Luba Protsiva er Engagement Manager hos AWS Professional Services. Hun spesialiserer seg på å levere data- og GenAI/ML-løsninger som gjør det mulig for AWS-kunder å maksimere forretningsverdien og akselerere innovasjonshastigheten.

Luba Protsiva er Engagement Manager hos AWS Professional Services. Hun spesialiserer seg på å levere data- og GenAI/ML-løsninger som gjør det mulig for AWS-kunder å maksimere forretningsverdien og akselerere innovasjonshastigheten.

- SEO-drevet innhold og PR-distribusjon. Bli forsterket i dag.

- PlatoData.Network Vertical Generative Ai. Styrk deg selv. Tilgang her.

- PlatoAiStream. Web3 Intelligence. Kunnskap forsterket. Tilgang her.

- PlatoESG. Karbon, CleanTech, Energi, Miljø, Solenergi, Avfallshåndtering. Tilgang her.

- PlatoHelse. Bioteknologisk og klinisk etterretning. Tilgang her.

- kilde: https://aws.amazon.com/blogs/machine-learning/how-booking-com-modernized-its-ml-experimentation-framework-with-amazon-sagemaker/

- : har

- :er

- :ikke

- :hvor

- $OPP

- 1

- 100

- 12

- 130

- 140

- 16

- 350

- 60

- 7

- 70

- a

- evne

- I stand

- Om oss

- akselerere

- adgang

- Ifølge

- Logg inn

- oppnådd

- tvers

- Aktiviteter

- handlinger

- tilpasse

- tillegg

- I tillegg

- avansert

- påvirke

- Etter

- AI

- AI / ML

- algoritmer

- Alle

- tillatt

- tillater

- langs

- også

- alltid

- Amazon

- Amazon SageMaker

- Amazon Web Services

- beløp

- beløp

- an

- analyser

- og

- En annen

- APIer

- tilnærming

- hensiktsmessig

- godkjent

- ca

- vilkårlig

- ER

- områder

- oppstår

- rundt

- AS

- aspirasjon

- At

- Automatisk

- automatisk

- tilgjengelighet

- tilgjengelig

- gjennomsnittlig

- AWS

- AWS profesjonelle tjenester

- tilbake

- basert

- Bayesiansk

- BE

- fordi

- bli

- atferd

- atferds

- atferd

- gunstig

- nytte

- BEST

- mellom

- Bias

- bestilling

- Booking.com

- både

- flaskehalser

- Bringer

- brakte

- bygge

- Bygning

- virksomhet

- men

- by

- CAN

- evner

- saken

- saker

- sentrum

- sentrert

- utfordringer

- utfordrende

- endring

- Endringer

- endring

- karakterisert

- Velg

- valgt ut

- kunde

- tett

- Cloud

- kode

- Koding

- samarbeidet

- samarbeid

- samlet sett

- COM

- kombinasjon

- kombinasjoner

- skurtreskerne

- vanligvis

- samfunnet

- kompatibilitet

- kompatibel

- komplekse

- kompleksitet

- komplisert

- komponenter

- beregnings

- regnekraft

- Beregn

- tilstand

- Konfigurasjon

- Vurder

- består

- begrensninger

- forbrukes

- forbruk

- inneholde

- inneholder

- kontroll

- korrigere

- Tilsvarende

- Kostnader

- kunne

- lage

- skape

- skaperverket

- avgjørende

- skikk

- kunde

- Kunder

- tilpasses

- skjærekant

- banebrytende teknologi

- syklus

- dato

- Dataklargjøring

- dataforsker

- datasett

- dag

- Dager

- bestemme

- avgjørelse

- avgjørelser

- redusert

- dedikert

- anses

- dyp

- dyp læring

- definere

- definert

- definisjon

- forsinkelse

- forsinkelser

- leverer

- levere

- dybden

- avhengighet

- Avhengighet

- utplassere

- utplassert

- foreldet

- designet

- detaljer

- Bestem

- utvikle

- utviklet

- utvikle

- Utvikling

- diagram

- forskjellig

- direkte

- oppdage

- vises

- distinkt

- distribueres

- distribuert opplæring

- Divided

- gjør

- domener

- gjort

- drastisk

- slippe

- varighet

- under

- dynamisk

- hver enkelt

- lett

- effektivitet

- effektivt

- innsats

- begitt seg ut

- bemyndiger

- muliggjøre

- aktivert

- muliggjør

- muliggjør

- altomfattende

- ende til ende

- engasjement

- ingeniør

- Ingeniørarbeid

- Ingeniører

- forbedre

- styrke

- sikrer

- Hele

- Miljø

- epoker

- avgjørende

- evaluere

- evaluering

- Selv

- Hver

- hver dag

- eksempel

- Excellence

- opphisset

- eksemplifisert

- eksisterende

- forvente

- fremskynder

- erfaring

- Erfaringer

- eksperiment

- eksperimenter

- ekspertise

- Forklar

- utforske

- Utforske

- strekker

- strekker

- forlengelse

- omfattende

- Face

- møtt

- faktorer

- Mislyktes

- Failure

- feil

- falsk

- raskere

- favorisere

- gjennomførbart

- Trekk

- Egenskaper

- tilbakemelding

- færre

- filet

- Filer

- slutt~~POS=TRUNC

- Endelig

- Finn

- Først

- første gang

- fleksibilitet

- Fokus

- etter

- Til

- fire

- Rammeverk

- Frekvens

- hyppig

- fra

- videre

- Dess

- få

- generere

- generert

- genererer

- generative

- Generativ AI

- få

- gå

- Global

- mål

- GPU

- GPU

- større

- gjette

- HAD

- håndtere

- maskinvare

- utnyttet

- Ha

- he

- hjelpe

- hjulpet

- hjelper

- her

- hans

- håp

- time

- TIMER

- Hvordan

- Hvordan

- Men

- HTML

- http

- HTTPS

- Hundrevis

- hinder

- Optimalisering av hyperparameter

- Innstilling av hyperparameter

- identifisere

- if

- illustrerer

- bilder

- umiddelbar

- Påvirkning

- gjennomføring

- viktigere

- forbedre

- forbedret

- forbedring

- forbedringer

- forbedrer

- in

- inkludere

- Inkludert

- Øke

- økt

- øker

- stadig

- uavhengig av hverandre

- industri

- ineffektivitet

- påvirke

- informasjon

- informert

- Infrastruktur

- initiert

- innovere

- Innovasjon

- innovative

- inngang

- innganger

- innsiden

- innsiktsfull

- innsikt

- instant

- integrert

- Integrerer

- interesse

- intern

- inn

- introdusert

- innføre

- involvert

- saker

- IT

- køyring

- gjentakelser

- DET ER

- Jobb

- Jobb

- reise

- jpg

- nøkkel

- Vet

- kunnskap

- kjent

- mangler

- Språk

- stor

- siste

- lansere

- lansert

- lanseringer

- leder

- ledende

- LÆRE

- lært

- læring

- Led

- Nivå

- utnytte

- i likhet med

- Begrenset

- knyttet

- laste

- lokal

- Lang

- Se

- ser ut som

- maskin

- maskinlæring

- maskiner

- laget

- gjøre

- fikk til

- leder

- måte

- manuelt

- Maksimer

- bety

- Minne

- metode

- metrisk

- Metrics

- Migrere

- migrasjon

- millioner

- millisekunder

- minimal

- minutter

- ML

- MLOps

- modell

- modeller

- modern

- Moduler

- Overvåke

- månedlig

- mer

- mest

- flytte

- flyttet

- mye

- flere

- navn

- Naturlig

- Natural Language Processing

- Natur

- Trenger

- Ny

- neste

- Nei.

- nå

- Antall

- Målet

- observere

- hindringer

- of

- offline

- ofte

- on

- På etterspørsel

- ONE

- på nett

- bare

- operasjonell

- Drift

- optimal

- optimalisering

- optimaliseringer

- Optimalisere

- optimalisert

- optimalisere

- alternativer

- or

- Annen

- ellers

- vår

- ut

- produksjon

- utganger

- enn

- samlet

- overser

- oversikt

- egen

- Fred

- pakke

- pakket

- Parallel

- parameter

- del

- lidenskapelig

- Utfør

- ytelse

- utfører

- Tilpassing

- rørledning

- sentral

- plato

- Platon Data Intelligence

- PlatonData

- spiller

- plugins

- Point

- Portal

- positiv

- Post

- makt

- praksis

- forut

- forutsi

- prediksjon

- Spådommer

- forberedelse

- forrige

- tidligere

- Problem

- prosess

- Bearbeidet

- Prosesser

- prosessering

- Produksjon

- produktiv

- profesjonell

- Profil

- profilering

- Progress

- prosjekt

- lovende

- beviste

- gi

- forutsatt

- gi

- kvalitet

- raskt

- serier

- Ranking

- raskt

- Sats

- heller

- Raw

- å nå

- klar

- motta

- gjenkjenne

- Anbefaling

- registrert

- redusere

- Redusert

- redusere

- reduksjon

- om

- region

- registrere

- registrert

- registret

- regelmessig

- Avvist..

- relevant

- pålitelighet

- rapporterer

- Rapporter

- Repository

- representerer

- krever

- påkrevd

- Krever

- løse

- ressurs

- Ressurser

- henholdsvis

- ansvarlig

- resultere

- resulterende

- Resultater

- Rise

- robust

- Rolle

- Kjør

- rennende

- går

- sagemaker

- SageMaker-rørledninger

- skalerbarhet

- skalerbar

- Skala

- Vitenskap

- Forsker

- forskere

- script

- sømløs

- Søk

- Sekund

- sekunder

- se

- søker

- velg

- velge

- utvalg

- senior

- betjene

- serverer

- Tjenester

- sesjoner

- sett

- sett

- innstillinger

- flere

- Del

- deling

- hun

- skift

- bør

- Vis

- Viser

- betydelig

- Enkelt

- enkelt

- litt annerledes

- smartere

- glatter

- So

- løsning

- Solutions

- noe

- Rom

- Spark

- spesialisert

- spesifikk

- fart

- brukt

- Trinn

- Steps

- stoppe

- lagring

- lagret

- strategier

- strømlinjeformet

- sterk

- strukturert

- studio

- suboptimal

- suksess

- vellykket

- vellykket

- slik

- Støttes

- Støtte

- Støtter

- synk.

- system

- skreddersydd

- ta

- Snakker

- oppgaver

- lag

- lag

- Teknologi

- tensorflow

- test

- testet

- Testing

- enn

- Det

- De

- verden

- deres

- Dem

- deretter

- Der.

- derved

- derfor

- Disse

- de

- denne

- De

- trives

- Gjennom

- tid

- tidslinjer

- ganger

- til

- verktøy

- berøre

- mot

- spor

- Sporing

- Tog

- Kurs

- treninger

- overføre

- transformasjoner

- overgang

- reiser

- reiseindustri

- reisende

- behandling

- sant

- prøve

- tuning

- SVING

- to

- typen

- Til syvende og sist

- forstå

- unik

- bruk

- bruke

- bruk sak

- brukt

- brukervennlig

- Brukere

- bruker

- ved hjelp av

- benyttes

- Verdifull

- verdi

- Verdier

- ulike

- enorme

- Hastighet

- versjon

- versjoner

- veldig

- visualisering

- vente

- ønsket

- var

- Vei..

- måter

- we

- web

- webtjenester

- var

- når

- hvilken

- mens

- HVEM

- vil

- med

- innenfor

- uten

- Arbeid

- arbeidsflyt

- virker

- verden

- verdensomspennende

- ville

- Du

- Din

- zephyrnet