I det utviklende landskapet innen produksjon er den transformative kraften til AI og maskinlæring (ML) tydelig, og driver en digital revolusjon som strømlinjeformer driften og øker produktiviteten. Denne fremgangen introduserer imidlertid unike utfordringer for bedrifter som navigerer i datadrevne løsninger. Industrielle anlegg sliter med enorme mengder ustrukturerte data, hentet fra sensorer, telemetrisystemer og utstyr spredt over produksjonslinjer. Sanntidsdata er kritiske for applikasjoner som prediktivt vedlikehold og avviksdeteksjon, men utvikling av tilpassede ML-modeller for hver industriell brukstilfelle med slike tidsseriedata krever betydelig tid og ressurser fra dataforskere, noe som hindrer utbredt bruk.

Generativ AI ved bruk av store ferdigtrente fundamentmodeller (FMer) som f.eks Claude kan raskt generere en rekke innhold fra samtaletekst til datakode basert på enkle tekstmeldinger, kjent som null-skudd-forespørsel. Dette eliminerer behovet for dataforskere for å manuelt utvikle spesifikke ML-modeller for hvert brukstilfelle, og demokratiserer derfor AI-tilgang, til fordel for selv små produsenter. Arbeidere oppnår produktivitet gjennom AI-generert innsikt, ingeniører kan proaktivt oppdage uregelmessigheter, leverandørkjedeledere optimerer varelager, og anleggsledelse tar informerte, datadrevne beslutninger.

Ikke desto mindre møter frittstående FM-er begrensninger i håndtering av komplekse industrielle data med kontekststørrelsesbegrensninger (vanligvis mindre enn 200,000 XNUMX tokens), som byr på utfordringer. For å løse dette kan du bruke FMs evne til å generere kode som svar på naturlige språkspørringer (NLQ). Agenter liker PandasAI kommer inn, kjører denne koden på høyoppløselige tidsseriedata og håndterer feil ved bruk av FM-er. PandasAI er et Python-bibliotek som legger til generative AI-funksjoner til pandaer, det populære dataanalyse- og manipulasjonsverktøyet.

Imidlertid kan komplekse NLQ-er, som tidsseriedatabehandling, aggregering på flere nivåer og pivot- eller fellestabelloperasjoner, gi inkonsekvent Python-skriptnøyaktighet med en null-shot-prompt.

For å forbedre kodegenereringsnøyaktigheten foreslår vi dynamisk konstruksjon multi-shot ledetekster for NLQer. Multi-shot prompting gir ekstra kontekst til FM ved å vise den flere eksempler på ønskede utganger for lignende spørsmål, noe som øker nøyaktigheten og konsistensen. I dette innlegget hentes multi-shot-meldinger fra en innebygging som inneholder vellykket Python-kode som kjøres på en lignende datatype (for eksempel høyoppløselige tidsseriedata fra Internet of Things-enheter). Den dynamisk konstruerte multi-shot prompten gir den mest relevante konteksten til FM, og øker FMs evne til avansert matematikkberegning, tidsseriedatabehandling og forståelse av dataakronymer. Denne forbedrede responsen gjør det lettere for bedriftsarbeidere og operative team å engasjere seg med data og få innsikt uten å kreve omfattende datavitenskapelige ferdigheter.

Utover tidsseriedataanalyse, viser FM-er seg verdifulle i ulike industrielle applikasjoner. Vedlikeholdsteam vurderer eiendelens helse, ta bilder for Amazon-anerkjennelse-basert funksjonalitet sammendrag, og anomali rotårsak analyse ved hjelp av intelligente søk med Retrieval Augmented Generation (FILLE). For å forenkle disse arbeidsflytene har AWS introdusert Amazonas grunnfjell, slik at du kan bygge og skalere generative AI-applikasjoner med toppmoderne ferdigtrente FM-er som Claude v2. Med Kunnskapsbaser for Amazon Bedrock, kan du forenkle RAG-utviklingsprosessen for å gi mer nøyaktig analyse av anomali rotårsak for anleggsarbeidere. Innlegget vårt viser frem en intelligent assistent for industrielle brukstilfeller drevet av Amazon Bedrock, som tar opp NLQ-utfordringer, genererer delsammendrag fra bilder og forbedrer FM-responser for utstyrsdiagnose gjennom RAG-tilnærmingen.

Løsningsoversikt

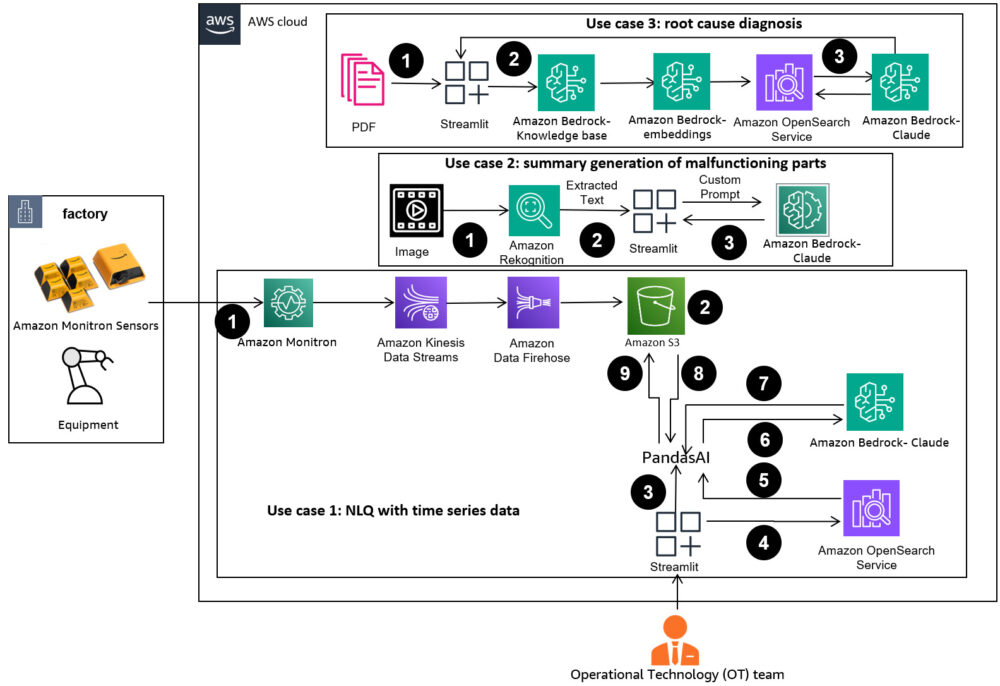

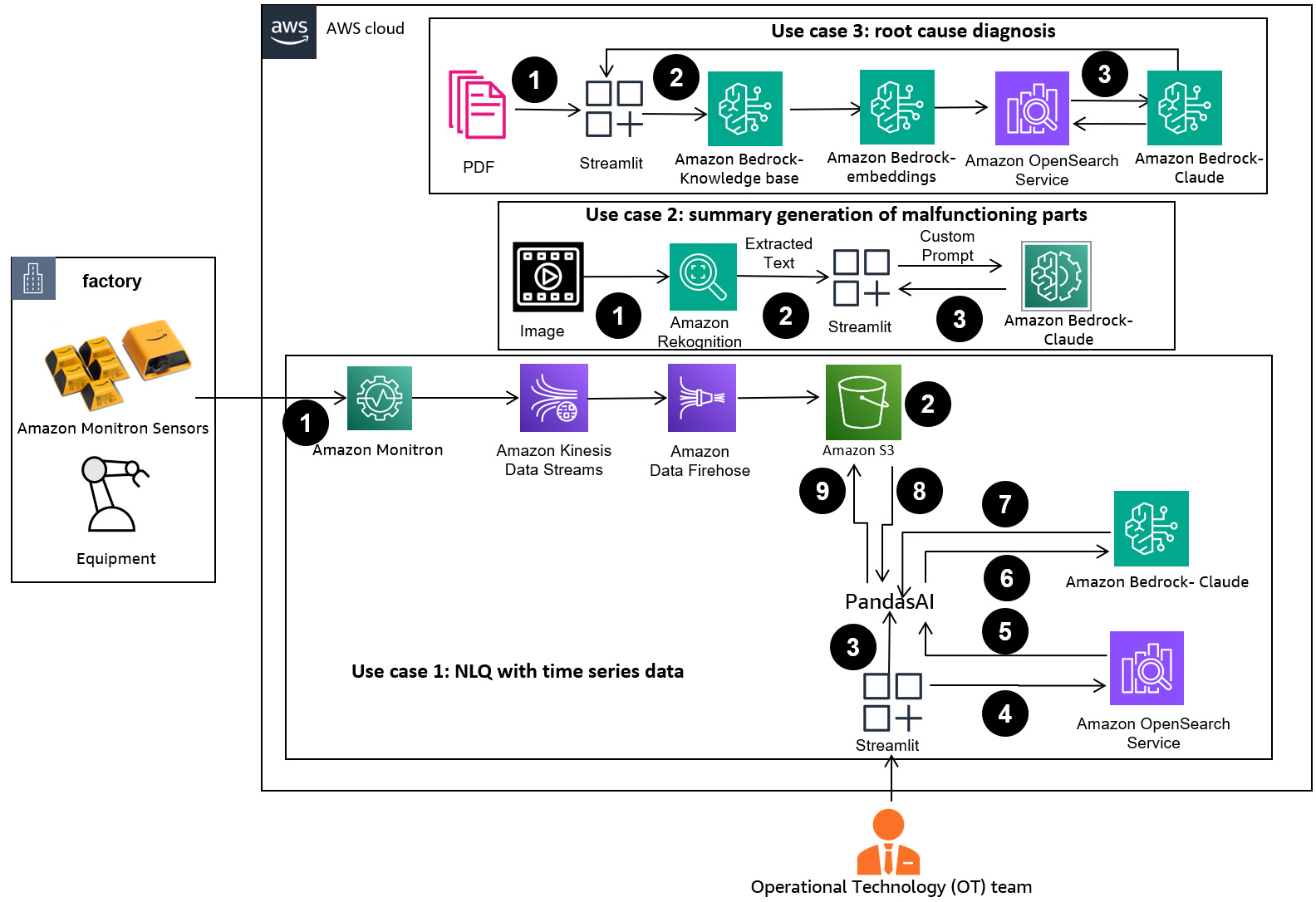

Følgende diagram illustrerer løsningsarkitekturen.

Arbeidsflyten inkluderer tre forskjellige brukstilfeller:

Brukscase 1: NLQ med tidsseriedata

Arbeidsflyten for NLQ med tidsseriedata består av følgende trinn:

- Vi bruker et tilstandsovervåkingssystem med ML-muligheter for avviksdeteksjon, som f.eks Amazon Monitron, for å overvåke industrielt utstyrs helse. Amazon Monitron er i stand til å oppdage potensielle utstyrsfeil fra utstyrets vibrasjons- og temperaturmålinger.

- Vi samler inn tidsseriedata ved å behandle Amazon Monitron data gjennom Amazon Kinesis datastrømmer og Amazon Data Firehose, konvertere den til et tabellformet CSV-format og lagre den i en Amazon enkel lagringstjeneste (Amazon S3) bøtte.

- Sluttbrukeren kan begynne å chatte med tidsseriedataene sine i Amazon S3 ved å sende et naturlig språksøk til Streamlit-appen.

- Streamlit-appen videresender brukerforespørsler til Amazon Bedrock Titan tekstinnbyggingsmodell for å bygge inn denne spørringen, og utfører et likhetssøk i en Amazon OpenSearch-tjeneste indeks, som inneholder tidligere NLQ-er og eksempelkoder.

- Etter likhetssøket settes de øverste lignende eksemplene, inkludert NLQ-spørsmål, dataskjema og Python-koder, inn i en tilpasset ledetekst.

- PandasAI sender denne tilpassede forespørselen til Amazon Bedrock Claude v2-modellen.

- Appen bruker PandasAI-agenten til å samhandle med Amazon Bedrock Claude v2-modellen, og genererer Python-kode for Amazon Monitron-dataanalyse og NLQ-svar.

- Etter at Amazon Bedrock Claude v2-modellen returnerer Python-koden, kjører PandasAI Python-spørringen på Amazon Monitron-dataene lastet opp fra appen, samler kodeutdata og adresserer eventuelle nødvendige gjenforsøk for mislykkede kjøringer.

- Streamlit-appen samler inn responsen via PandasAI, og gir utdataene til brukerne. Hvis utgangen er tilfredsstillende, kan brukeren merke den som nyttig, og lagre NLQ- og Claude-generert Python-kode i OpenSearch Service.

Brukstilfelle 2: Oppsummering generering av defekte deler

Vår oppsummeringsgenereringsbrukssak består av følgende trinn:

- Etter at brukeren vet hvilken industriell eiendel som viser unormal oppførsel, kan de laste opp bilder av den defekte delen for å identifisere om det er noe fysisk galt med denne delen i henhold til dens tekniske spesifikasjon og driftstilstand.

- Brukeren kan bruke Amazon Recognition DetectText API for å trekke ut tekstdata fra disse bildene.

- De utpakkede tekstdataene er inkludert i ledeteksten for Amazon Bedrock Claude v2-modellen, noe som gjør at modellen kan generere en 200-ords oppsummering av delen som ikke fungerer. Brukeren kan bruke denne informasjonen til å utføre ytterligere inspeksjon av delen.

Use case 3: Rotårsaksdiagnose

Brukssaken vår for rotårsaksdiagnose består av følgende trinn:

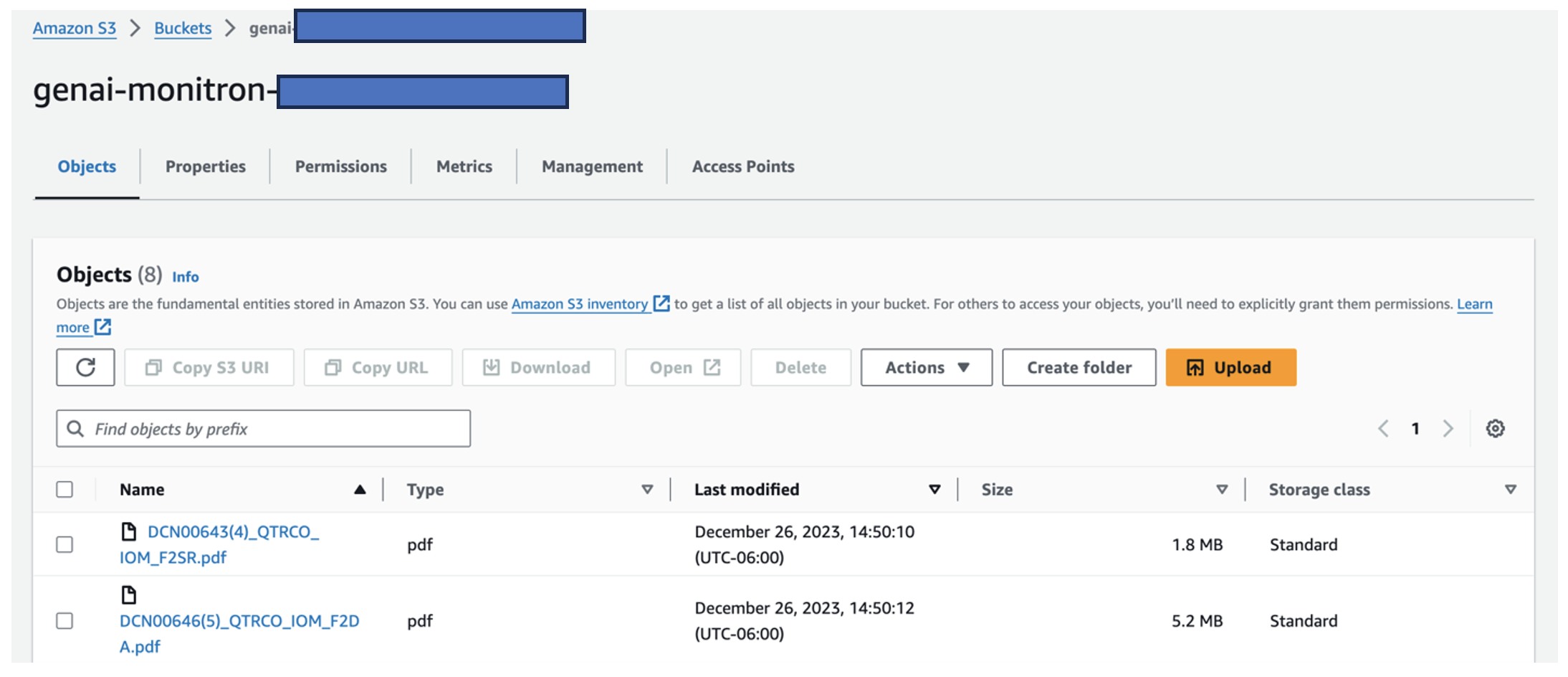

- Brukeren skaffer bedriftsdata i ulike dokumentformater (PDF, TXT, og så videre) relatert til funksjonsfeil, og laster dem opp til en S3-bøtte.

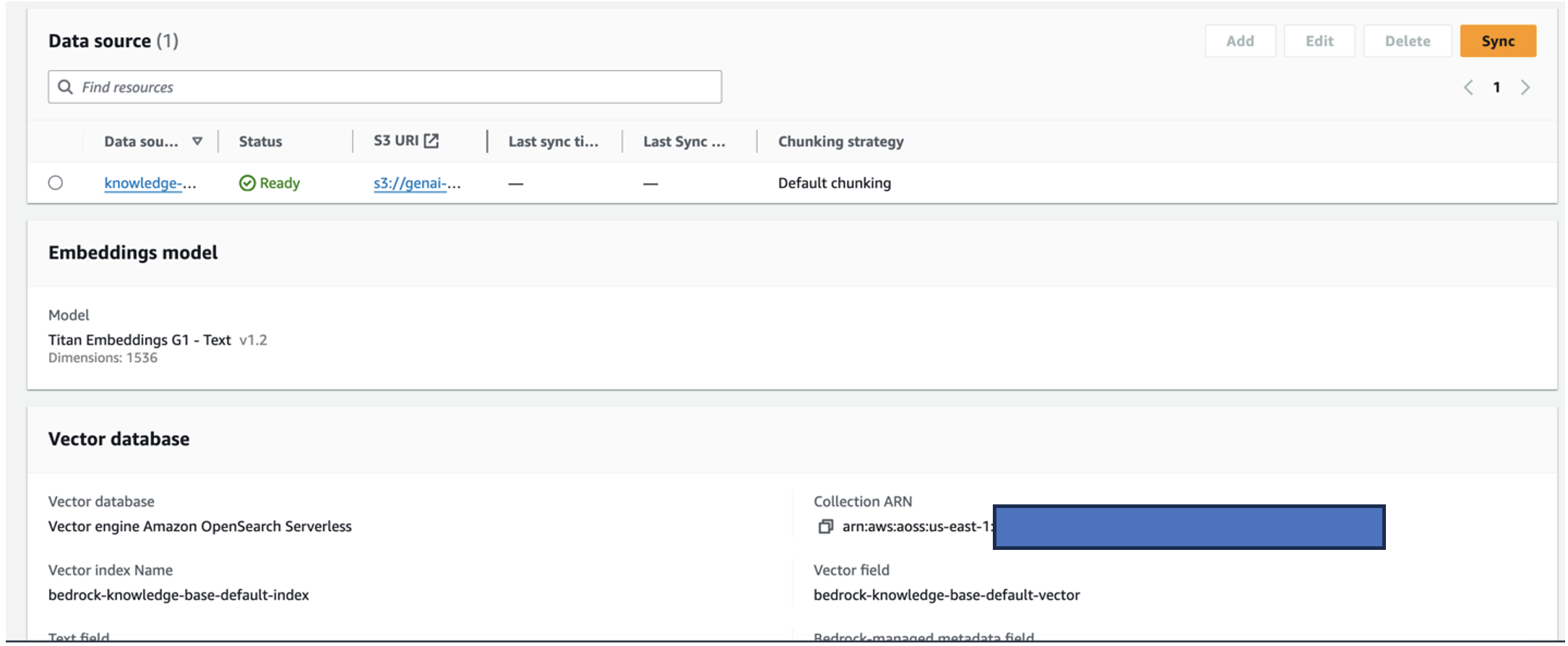

- En kunnskapsbase av disse filene genereres i Amazon Bedrock med en Titan-tekstinnbyggingsmodell og en standard OpenSearch Service-vektorbutikk.

- Brukeren stiller spørsmål knyttet til rotårsaksdiagnosen for utstyr som ikke fungerer. Svarene genereres gjennom kunnskapsbasen Amazon Bedrock med en RAG-tilnærming.

Forutsetninger

For å følge med på dette innlegget, må du oppfylle følgende forutsetninger:

Distribuer løsningsinfrastrukturen

For å konfigurere løsningsressursene dine, fullfør følgende trinn:

- Implementere AWS skyformasjon mal opensearchsagemaker.yml, som oppretter en OpenSearch-tjenestesamling og -indeks, Amazon SageMaker notebook-forekomst og S3-bøtte. Du kan navngi denne AWS CloudFormation-stakken som:

genai-sagemaker. - Åpne SageMaker notatbokforekomsten i JupyterLab. Du finner følgende GitHub repo allerede lastet ned på denne instansen: låse opp-potensialet-av-generative-ai-i-industrielle-operasjoner.

- Kjør notatboken fra følgende katalog i dette depotet: låse opp-potensialet-av-generative-ai-in-industrial-operations/SagemakerNotebook/nlq-vector-rag-embedding.ipynb. Denne notatboken vil laste inn OpenSearch Service-indeksen ved å bruke SageMaker-notisboken for å lagre nøkkel-verdi-par fra eksisterende 23 NLQ-eksempler.

- Last opp dokumenter fra datamappen assetpartdoc i GitHub-depotet til S3-bøtten som er oppført i CloudFormation-stabelutgangene.

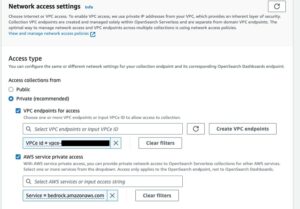

Deretter oppretter du kunnskapsbasen for dokumentene i Amazon S3.

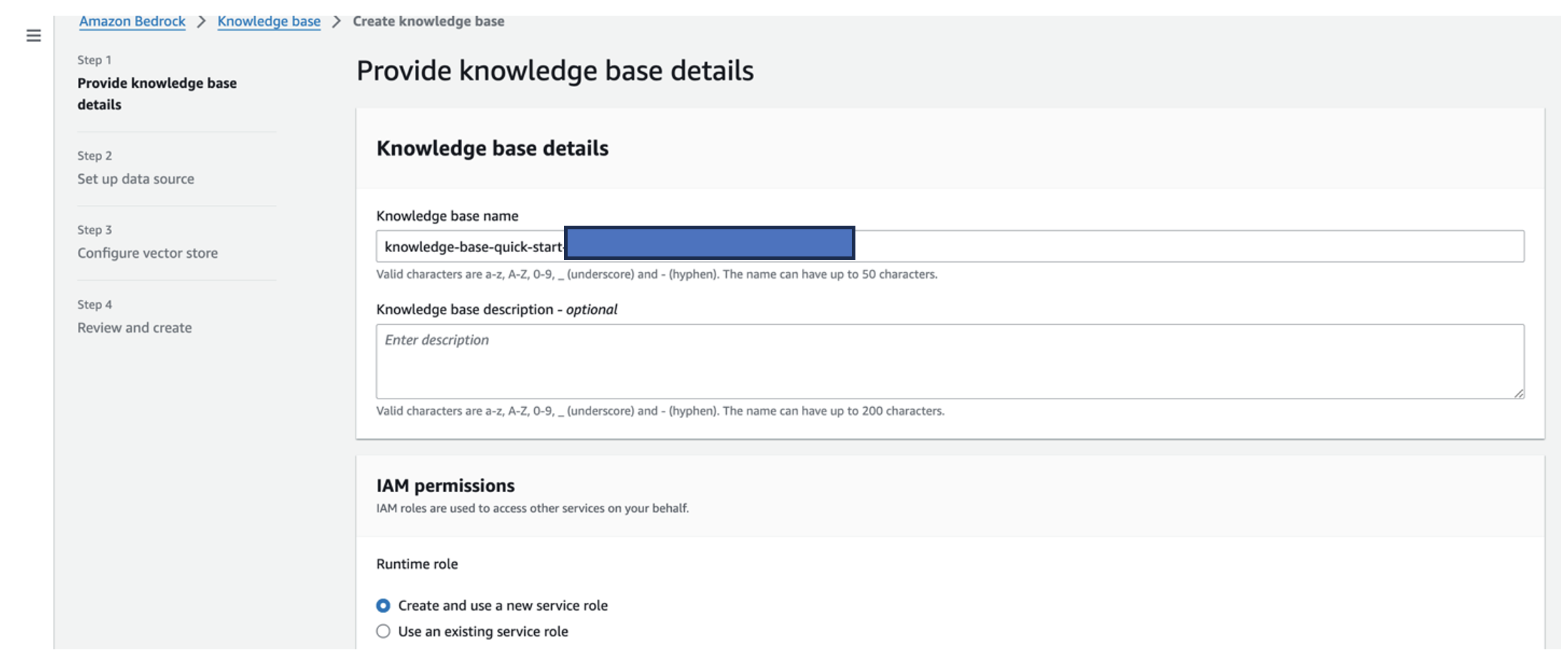

- På Amazon Bedrock-konsollen velger du Kunnskapsbase i navigasjonsruten.

- Velg Lag kunnskapsbase.

- Til Navn på kunnskapsbase, skriv inn et navn.

- Til Runtime rolle, plukke ut Opprett og bruk en ny tjenesterolle.

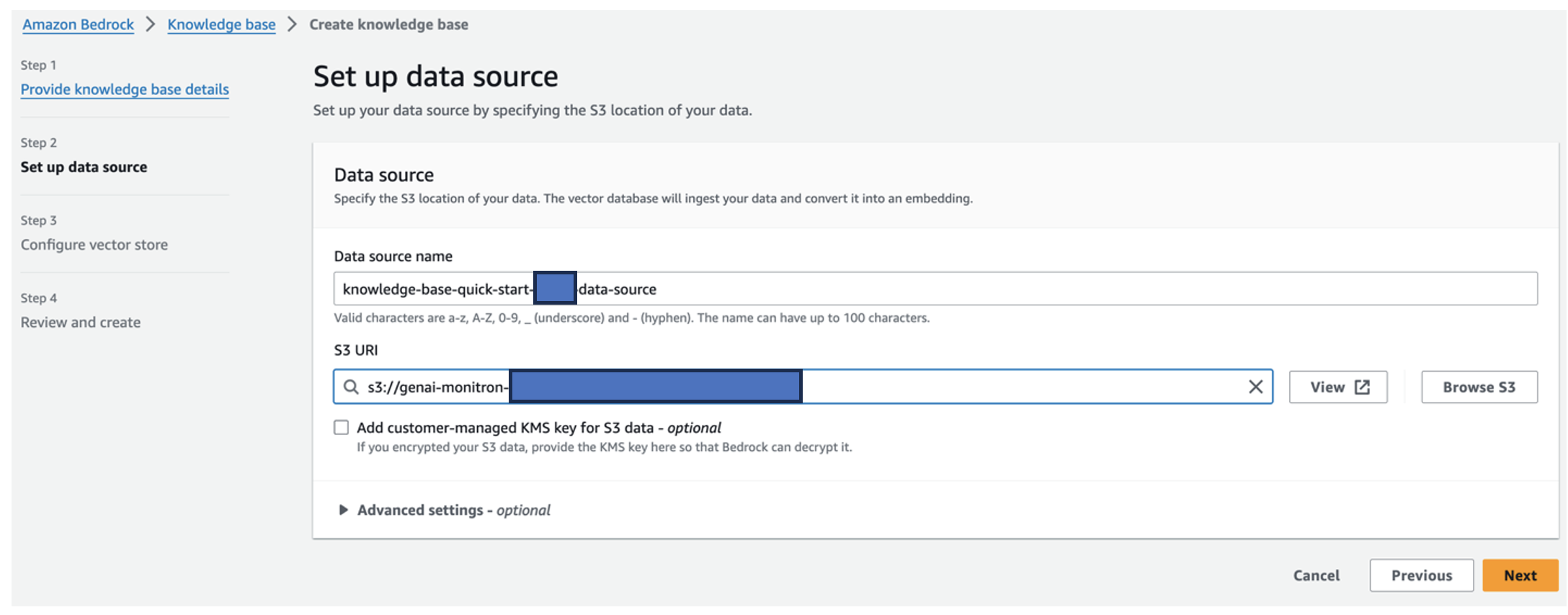

- Til Navn på datakilde, skriv inn navnet på datakilden.

- Til S3 URI, skriv inn S3-banen til bøtten der du lastet opp rotårsaksdokumentene.

- Velg neste.

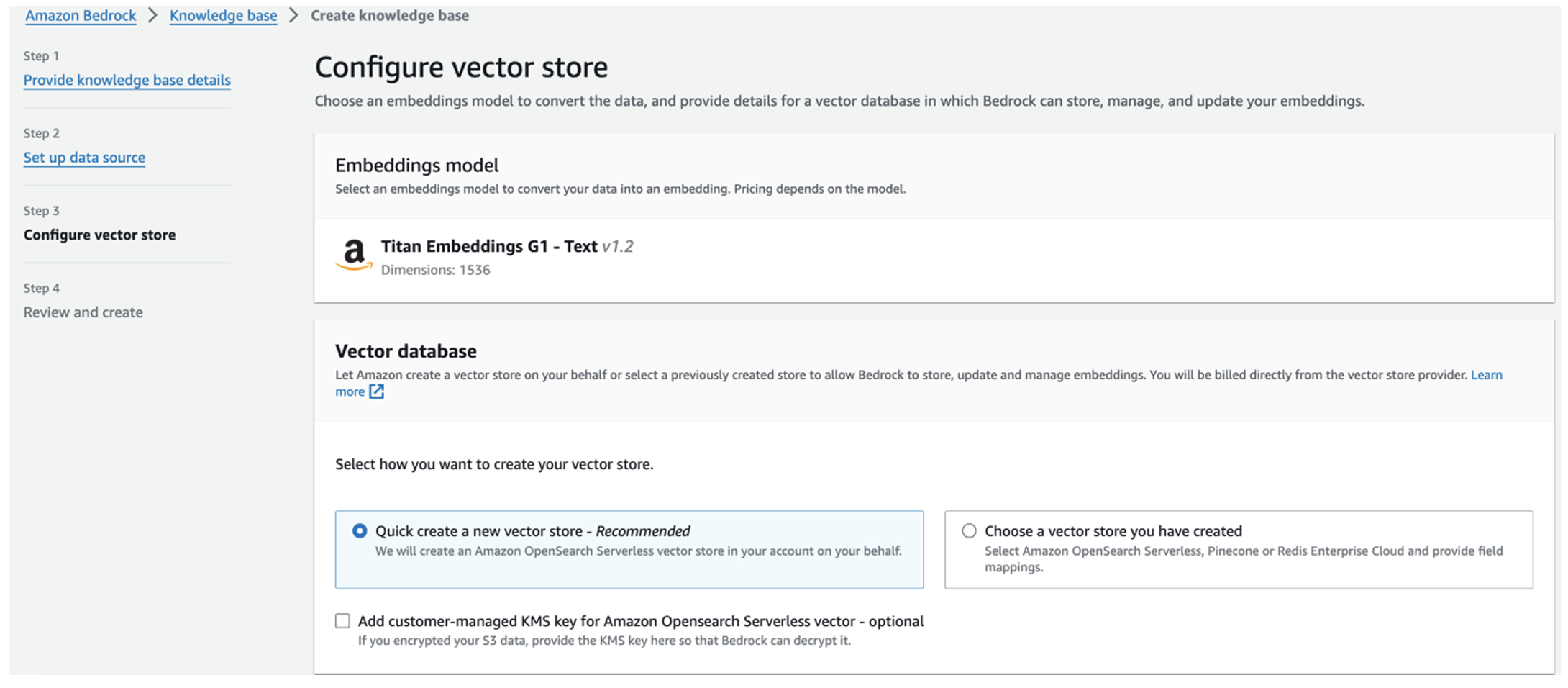

Titan embeddings-modellen velges automatisk.

Titan embeddings-modellen velges automatisk. - Plukke ut Lag raskt en ny vektorbutikk.

- Gå gjennom innstillingene dine og lag kunnskapsbasen ved å velge Lag kunnskapsbase.

- Etter at kunnskapsbasen er opprettet, velger du Synkroniser for å synkronisere S3-bøtten med kunnskapsbasen.

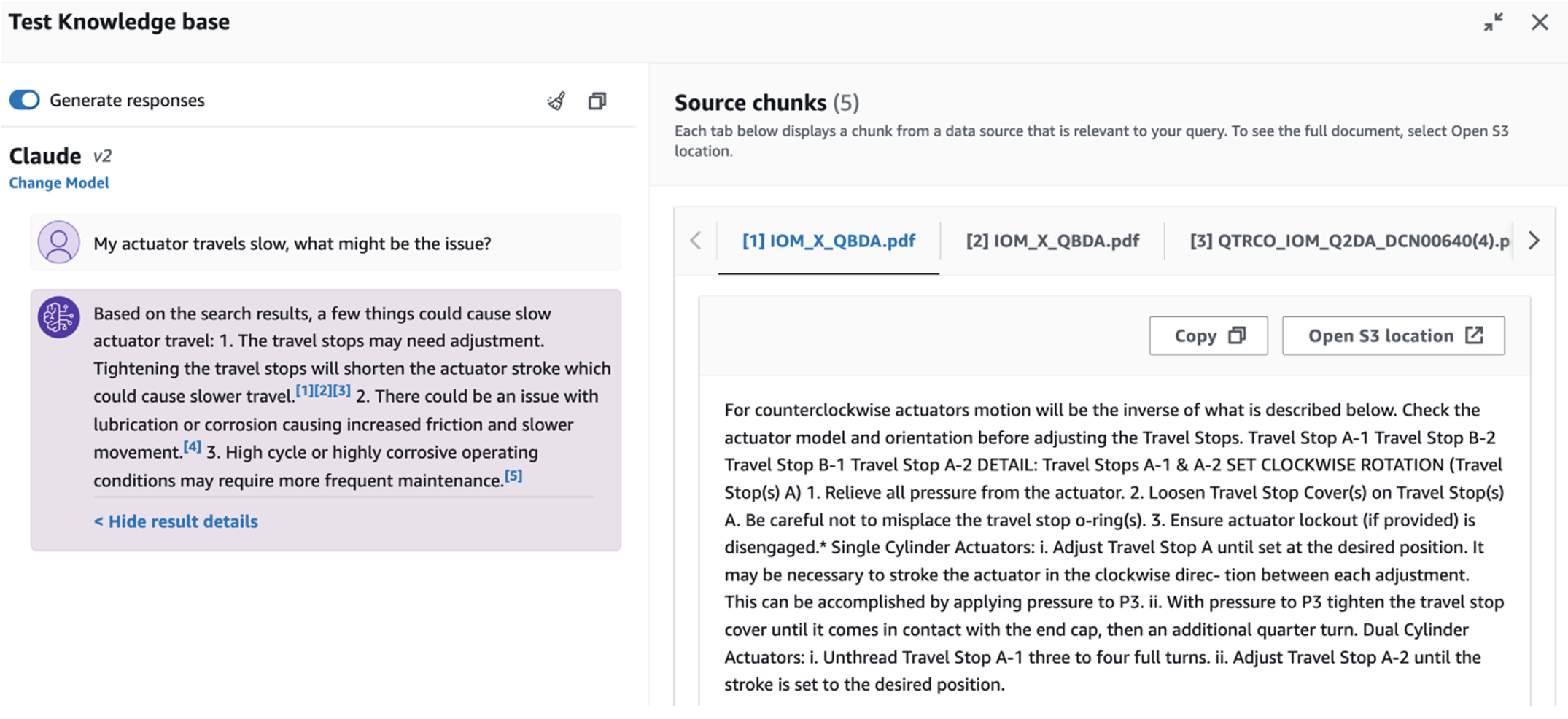

- Etter at du har satt opp kunnskapsbasen, kan du teste RAG-tilnærmingen for rotårsaksdiagnose ved å stille spørsmål som "Min aktuator går sakte, hva kan være problemet?"

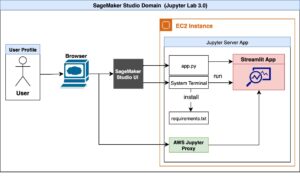

Neste trinn er å distribuere appen med de nødvendige bibliotekpakkene på enten din PC eller en EC2-instans (Ubuntu Server 22.04 LTS).

- Konfigurer AWS-legitimasjonen din med AWS CLI på din lokale PC. For enkelhets skyld kan du bruke den samme administratorrollen du brukte til å distribuere CloudFormation-stakken. Hvis du bruker Amazon EC2, knytte en passende IAM-rolle til instansen.

- Clone GitHub repo:

- Endre katalogen til

unlocking-the-potential-of-generative-ai-in-industrial-operations/srcog kjøresetup.shskript i denne mappen for å installere de nødvendige pakkene, inkludert LangChain og PandasAI:cd unlocking-the-potential-of-generative-ai-in-industrial-operations/src chmod +x ./setup.sh ./setup.sh - Kjør Streamlit-appen med følgende kommando:

source monitron-genai/bin/activate python3 -m streamlit run app_bedrock.py <REPLACE WITH YOUR BEDROCK KNOWLEDGEBASE ARN>

Oppgi OpenSearch Service-samlingen ARN du opprettet i Amazon Bedrock fra forrige trinn.

Chat med helseassistenten din

Etter at du har fullført ende-til-ende-distribusjonen, kan du få tilgang til appen via localhost på port 8501, som åpner et nettleservindu med nettgrensesnittet. Hvis du implementerte appen på en EC2-forekomst, tillate port 8501-tilgang via sikkerhetsgruppens inngående regel. Du kan navigere til forskjellige faner for ulike brukstilfeller.

Utforsk brukstilfelle 1

For å utforske den første brukssaken, velg Datainnsikt og diagram. Begynn med å laste opp tidsseriedataene dine. Hvis du ikke har en eksisterende tidsseriedatafil å bruke, kan du laste opp følgende eksempel CSV-fil med anonyme Amazon Monitron-prosjektdata. Hvis du allerede har et Amazon Monitron-prosjekt, se Generer praktisk innsikt for prediktiv vedlikeholdsadministrasjon med Amazon Monitron og Amazon Kinesis å streame Amazon Monitron-dataene dine til Amazon S3 og bruke dataene dine med denne applikasjonen.

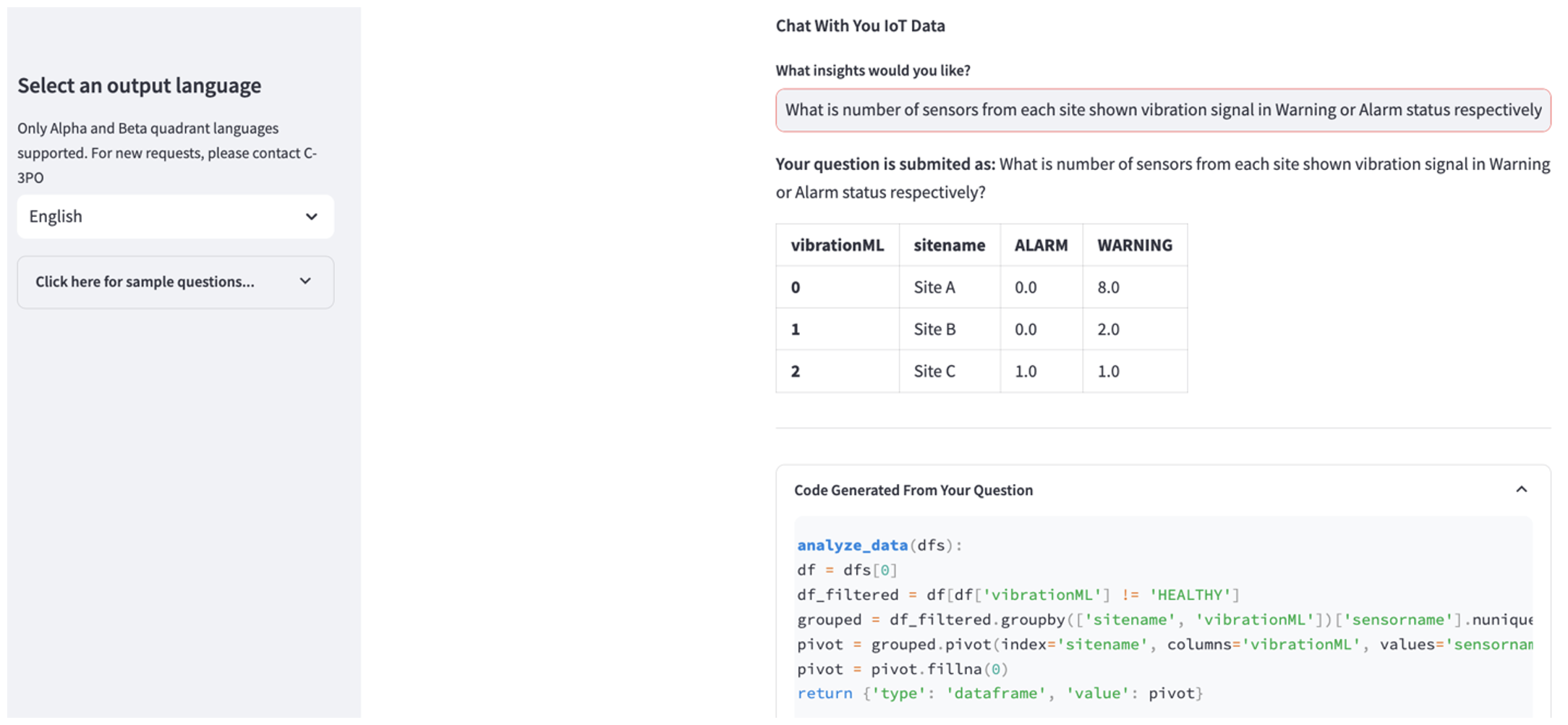

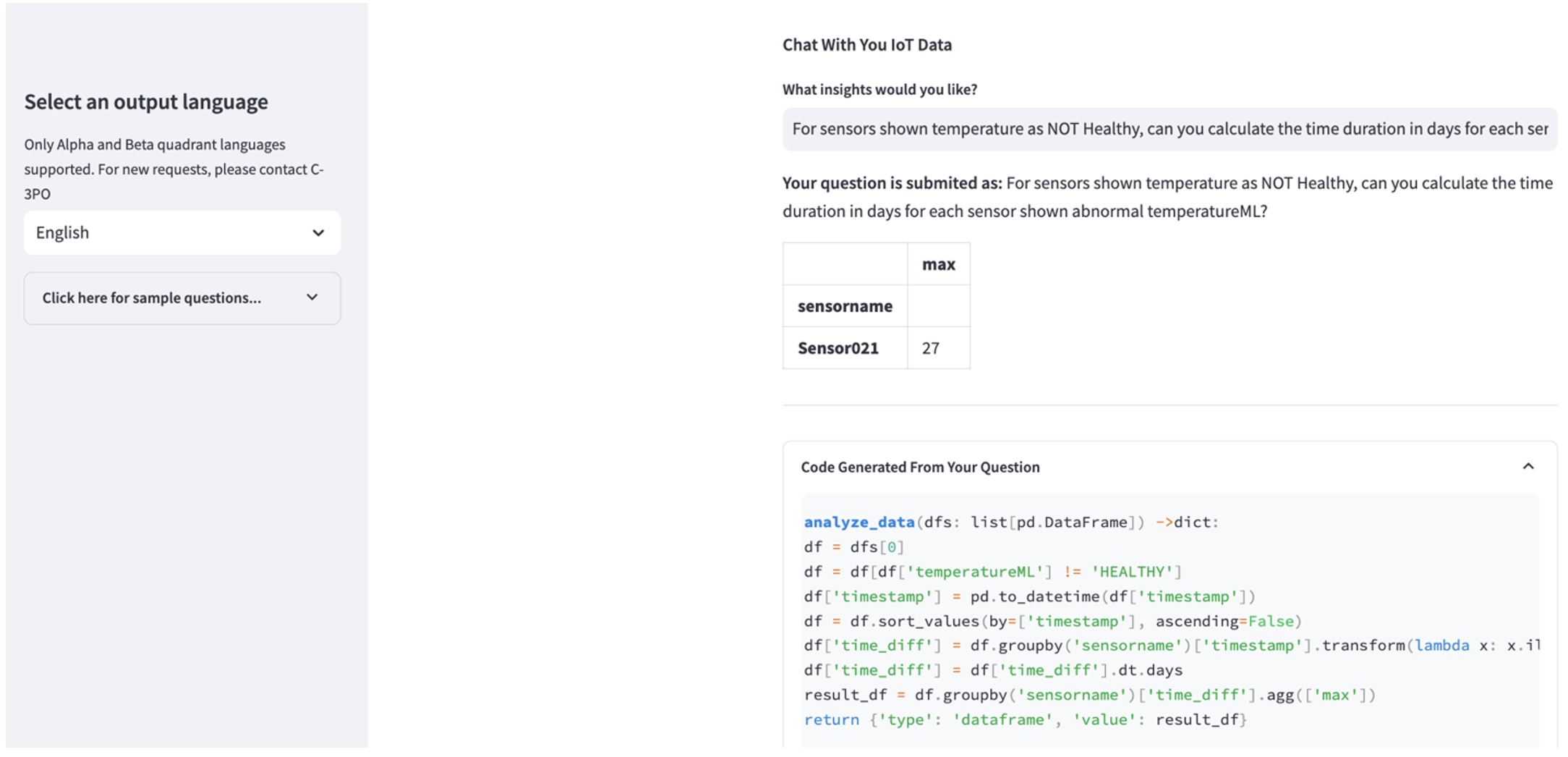

Når opplastingen er fullført, skriv inn et søk for å starte en samtale med dataene dine. Den venstre sidelinjen tilbyr en rekke eksempelspørsmål for enkelhets skyld. Følgende skjermbilder illustrerer responsen og Python-koden generert av FM når du skriver inn et spørsmål som "Fortell meg det unike antallet sensorer for hvert nettsted vist som henholdsvis Advarsel eller Alarm?" (et spørsmål på vanskelig nivå) eller "For sensorer vist temperatursignal som IKKE sunne, kan du beregne varigheten i dager for hver sensor vist unormalt vibrasjonssignal?" (et spørsmål på utfordringsnivå). Appen vil svare på spørsmålet ditt, og vil også vise Python-skriptet for dataanalyse den utførte for å generere slike resultater.

Hvis du er fornøyd med svaret, kan du merke det som Nyttig, og lagrer den NLQ- og Claude-genererte Python-koden til en OpenSearch Service-indeks.

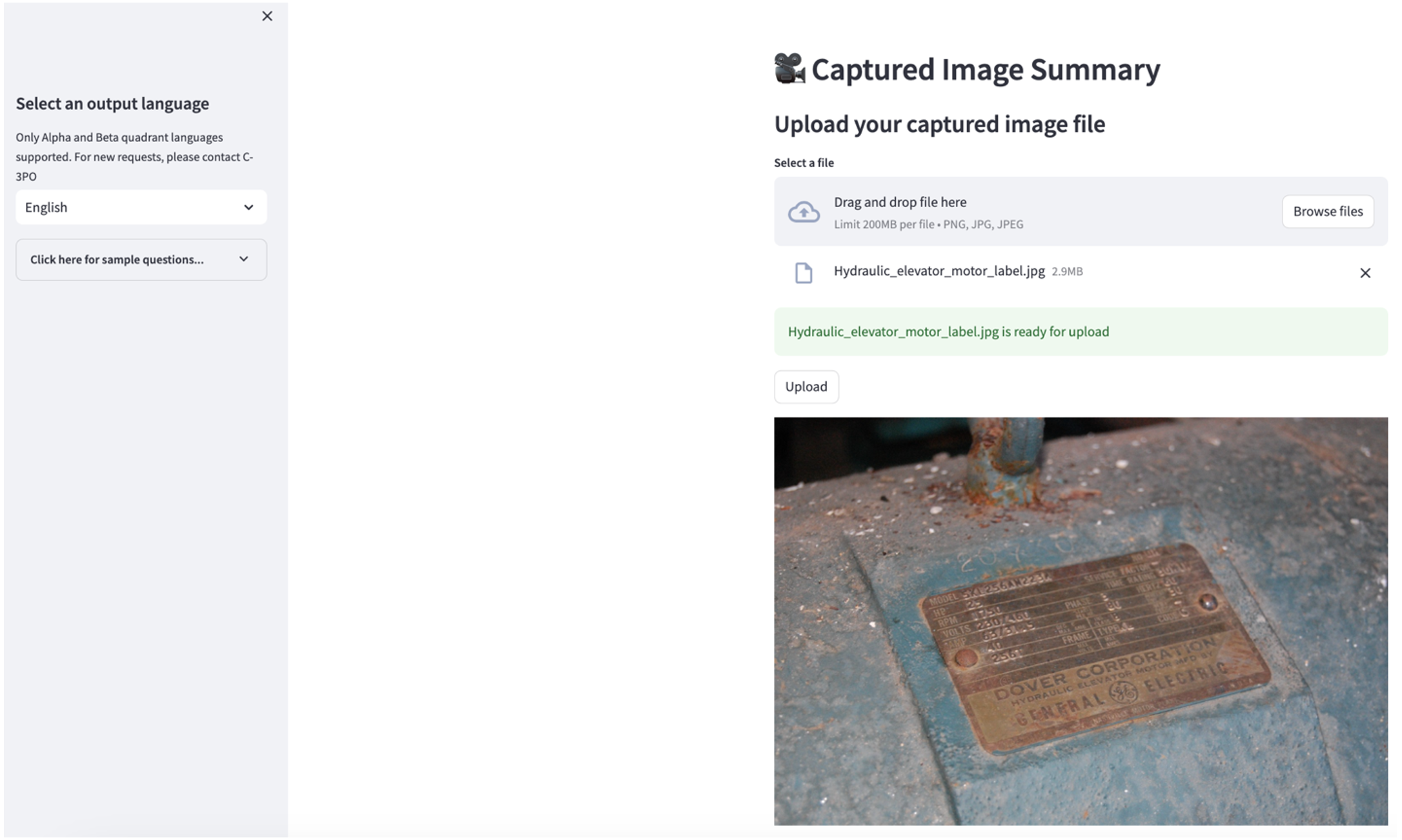

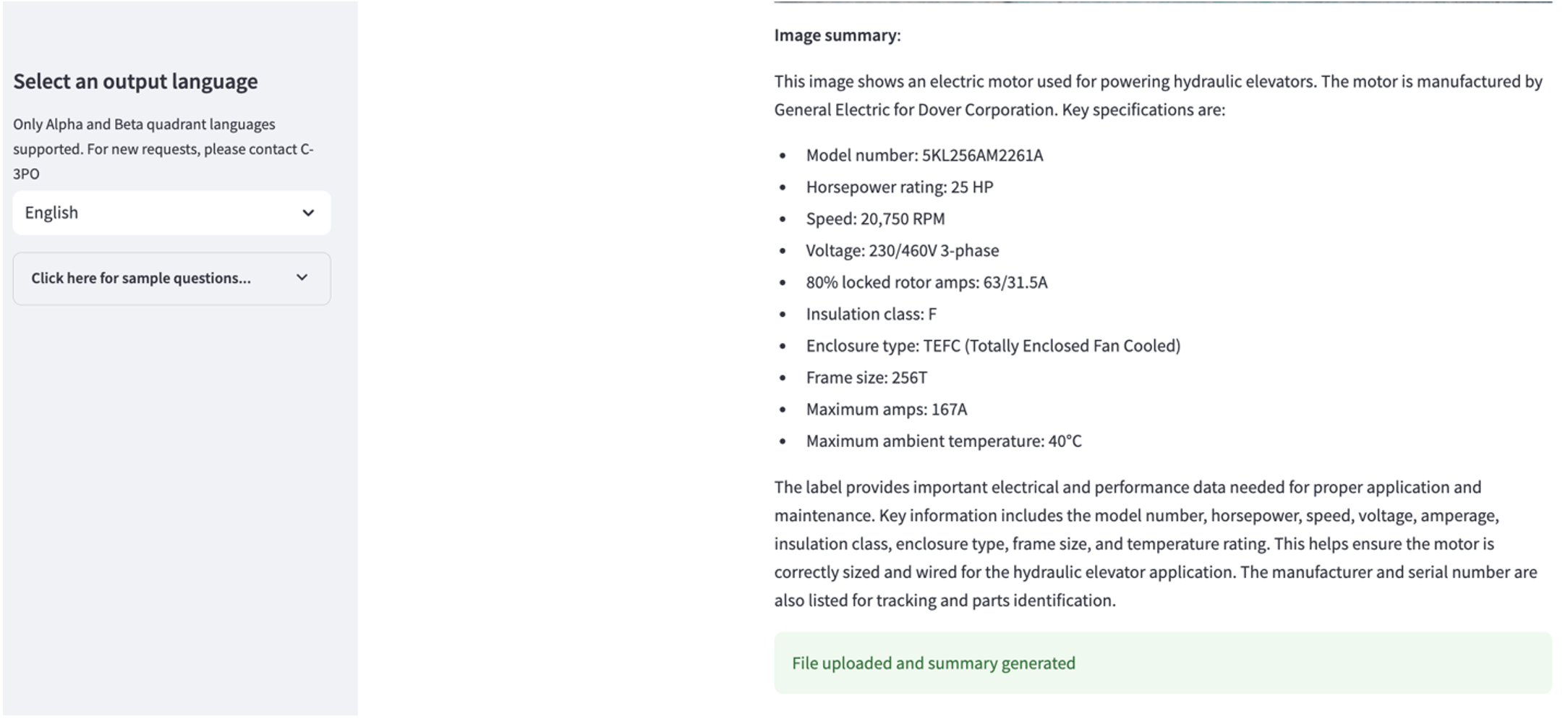

Utforsk brukstilfelle 2

For å utforske den andre brukssaken, velg Oppsummering av tatt bilde fanen i Streamlit-appen. Du kan laste opp et bilde av din industrielle eiendel, og applikasjonen vil generere et 200-ords sammendrag av dens tekniske spesifikasjoner og driftstilstand basert på bildeinformasjonen. Følgende skjermbilde viser sammendraget generert fra et bilde av en remmotordrift. For å teste denne funksjonen, hvis du mangler et passende bilde, kan du bruke følgende eksempel på bilde.

Etikett for hydraulisk heismotor” av Clarence Risher er lisensiert under CC BY-SA 2.0.

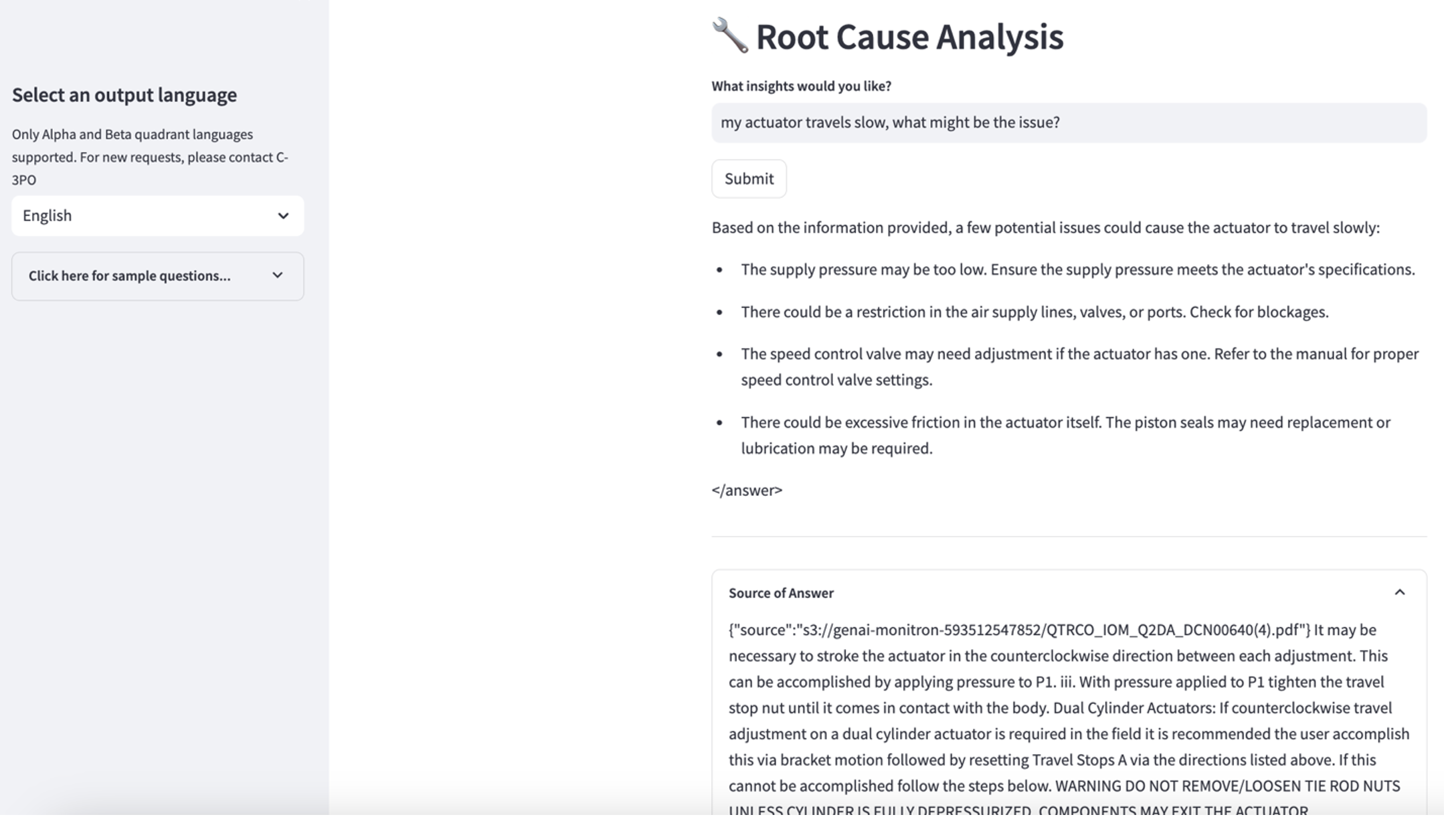

Utforsk brukstilfelle 3

For å utforske den tredje brukssaken, velg Rotårsaksdiagnose fanen. Skriv inn et søk relatert til den ødelagte industrielle ressursen din, for eksempel "Aktuatoren min kjører sakte, hva kan være problemet?" Som vist i følgende skjermbilde, leverer applikasjonen et svar med kildedokumentutdraget som ble brukt til å generere svaret.

Use case 1: Designdetaljer

I denne delen diskuterer vi designdetaljene til applikasjonsarbeidsflyten for den første brukssaken.

Tilpasset hurtigbygg

Brukerens naturlige språkspørring kommer med forskjellige vanskelige nivåer: lett, vanskelig og utfordrende.

Enkle spørsmål kan omfatte følgende forespørsler:

- Velg unike verdier

- Tell totale tall

- Sorter verdier

For disse spørsmålene kan PandasAI samhandle direkte med FM for å generere Python-skript for behandling.

Vanskelige spørsmål krever grunnleggende aggregeringsoperasjon eller tidsserieanalyse, for eksempel følgende:

- Velg verdi først og grupper resultatene hierarkisk

- Utfør statistikk etter første rekordvalg

- Antall tidsstempler (for eksempel min og maks)

For vanskelige spørsmål hjelper en spørremal med detaljerte trinnvise instruksjoner FM-er med å gi nøyaktige svar.

Spørsmål på utfordringsnivå krever avansert matematikkberegning og tidsseriebehandling, for eksempel følgende:

- Beregn anomalivarighet for hver sensor

- Beregn anomalisensorer for stedet på månedlig basis

- Sammenlign sensoravlesninger under normal drift og unormale forhold

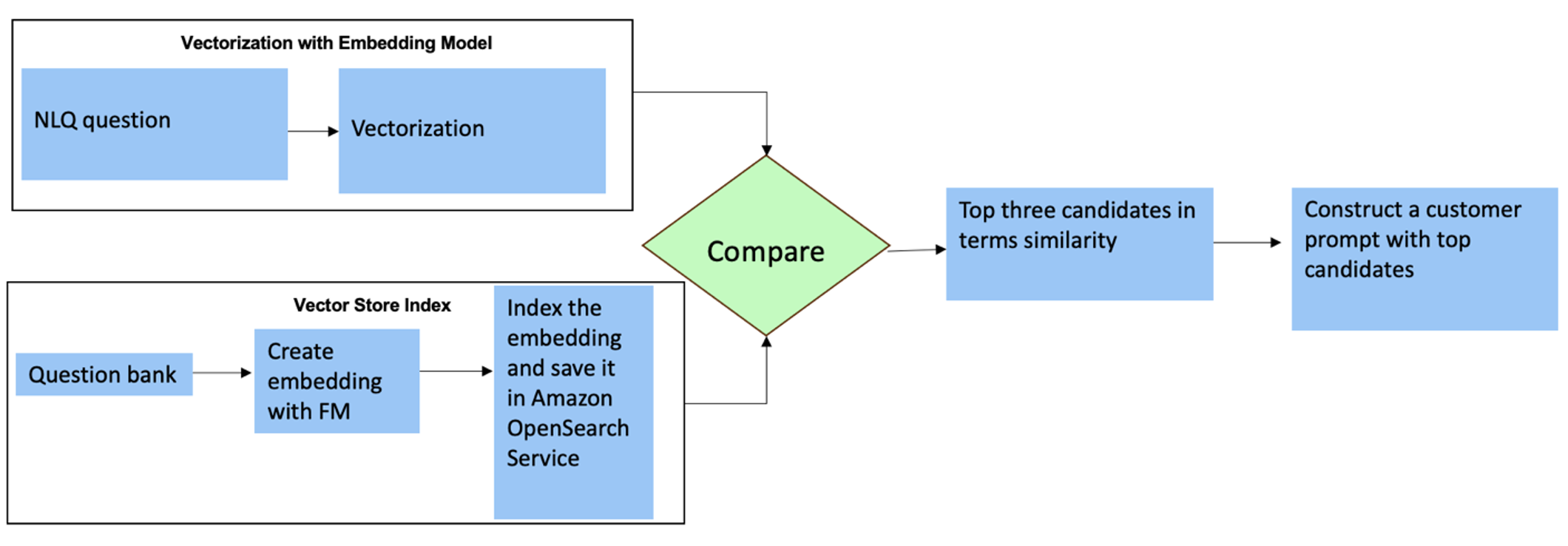

For disse spørsmålene kan du bruke multi-shots i en tilpasset forespørsel for å forbedre responsnøyaktigheten. Slike multi-shots viser eksempler på avansert tidsseriebehandling og matematikkberegning, og vil gi kontekst for FM til å utføre relevant slutning på lignende analyser. Det kan være en utfordring å dynamisk sette inn de mest relevante eksemplene fra en NLQ-spørsmålsbank i ledeteksten. En løsning er å konstruere innbygginger fra eksisterende NLQ-spørsmålseksempler og lagre disse innebyggingene i en vektorbutikk som OpenSearch Service. Når et spørsmål sendes til Streamlit-appen, vil spørsmålet vektoriseres av BerggrunnInnebeddinger. De øverste N mest relevante innebyggingene til det spørsmålet hentes ved hjelp av opensearch_vector_search.similarity_search og satt inn i ledetekstmalen som en multi-shot ledetekst.

Følgende diagram illustrerer denne arbeidsflyten.

Innebyggingslaget er konstruert ved hjelp av tre nøkkelverktøy:

- Innstøpingsmodell – Vi bruker Amazon Titan Embeddings tilgjengelig gjennom Amazon Bedrock (amazon.titan-embed-text-v1) for å generere numeriske representasjoner av tekstdokumenter.

- Vektorbutikk – For vektorbutikken vår bruker vi OpenSearch Service via LangChain-rammeverket, og effektiviserer lagringen av innebygginger generert fra NLQ-eksempler i denne notatboken.

- Index – OpenSearch Service-indeksen spiller en sentral rolle når det gjelder å sammenligne input-embeddings med dokument-embeddings og tilrettelegge for gjenfinning av relevante dokumenter. Fordi Python-eksempelkodene ble lagret som en JSON-fil, ble de indeksert i OpenSearch Service som vektorer via en OpenSearchVevtorSearch.fromtexts API-anrop.

Kontinuerlig innsamling av menneskereviderte eksempler via Streamlit

I begynnelsen av apputvikling begynte vi med bare 23 lagrede eksempler i OpenSearch Service-indeksen som innebygging. Når appen går live i felten, begynner brukerne å legge inn NLQ-ene sine via appen. Men på grunn av de begrensede eksemplene som er tilgjengelige i malen, kan det hende at enkelte NLQ ikke finner lignende forespørsler. For å kontinuerlig berike disse innebyggingene og tilby mer relevante brukerforespørsler, kan du bruke Streamlit-appen for å samle menneskereviderte eksempler.

Innenfor appen tjener følgende funksjon dette formålet. Når sluttbrukere finner utgangen nyttig og velger Nyttig, følger applikasjonen disse trinnene:

- Bruk tilbakeringingsmetoden fra PandasAI for å samle inn Python-skriptet.

- Reformater Python-skriptet, inndataspørsmålet og CSV-metadataene til en streng.

- Sjekk om dette NLQ-eksemplet allerede finnes i den gjeldende OpenSearch Service-indeksen ved å bruke opensearch_vector_search.similarity_search_with_score.

- Hvis det ikke finnes et lignende eksempel, legges denne NLQ til OpenSearch Service-indeksen ved hjelp av opensearch_vector_search.add_texts.

I tilfelle en bruker velger Ikke nyttig, det blir ikke gjort noe. Denne iterative prosessen sørger for at systemet kontinuerlig forbedres ved å inkludere brukerbidrag med eksempler.

def addtext_opensearch(input_question, generated_chat_code, df_column_metadata, opensearch_vector_search,similarity_threshold,kexamples, indexname):

#######build the input_question and generated code the same format as existing opensearch index##########

reconstructed_json = {}

reconstructed_json["question"]=input_question

reconstructed_json["python_code"]=str(generated_chat_code)

reconstructed_json["column_info"]=df_column_metadata

json_str = ''

for key,value in reconstructed_json.items():

json_str += key + ':' + value

reconstructed_raw_text =[]

reconstructed_raw_text.append(json_str)

results = opensearch_vector_search.similarity_search_with_score(str(reconstructed_raw_text[0]), k=kexamples) # our search query # return 3 most relevant docs

if (dumpd(results[0][1])<similarity_threshold): ###No similar embedding exist, then add text to embedding

response = opensearch_vector_search.add_texts(texts=reconstructed_raw_text, engine="faiss", index_name=indexname)

else:

response = "A similar embedding is already exist, no action."

return response

Ved å inkludere menneskelig revisjon, øker antallet eksempler i OpenSearch Service som er tilgjengelig for rask innebygging etter hvert som appen blir brukt. Dette utvidede innebygde datasettet resulterer i forbedret søkenøyaktighet over tid. Nærmere bestemt, for utfordrende NLQ-er, når FMs responsnøyaktighet omtrent 90 % når du dynamisk setter inn lignende eksempler for å konstruere tilpassede spørsmål for hvert NLQ-spørsmål. Dette representerer en bemerkelsesverdig økning på 28 % sammenlignet med scenarier uten multi-shot-meldinger.

Use case 2: Designdetaljer

På Streamlit-appen Oppsummering av tatt bilde fanen, kan du laste opp en bildefil direkte. Dette starter Amazon Rekognition API (oppdage_tekst API), trekker ut tekst fra bildeetiketten som viser maskinspesifikasjoner. Deretter sendes de utpakkede tekstdataene til Amazon Bedrock Claude-modellen som konteksten for en ledetekst, noe som resulterer i et sammendrag på 200 ord.

Fra et brukeropplevelsesperspektiv er det avgjørende å aktivere strømmefunksjonalitet for en tekstoppsummeringsoppgave, slik at brukerne kan lese det FM-genererte sammendraget i mindre biter i stedet for å vente på hele utdataene. Amazon Bedrock forenkler streaming via sitt API (bedrock_runtime.invoke_model_with_response_stream).

Use case 3: Designdetaljer

I dette scenariet har vi utviklet en chatbot-applikasjon fokusert på rotårsaksanalyse, ved å bruke RAG-tilnærmingen. Denne chatboten trekker fra flere dokumenter relatert til lagerutstyr for å lette rotårsaksanalyse. Denne RAG-baserte rotårsaksanalyse chatboten bruker kunnskapsbaser for å generere vektortekstrepresentasjoner, eller innebygging. Kunnskapsbaser for Amazon Bedrock er en fullstendig administrert funksjon som hjelper deg med å implementere hele RAG-arbeidsflyten, fra inntak til henting og rask utvidelse, uten å måtte bygge tilpassede integrasjoner til datakilder eller administrere dataflyter og RAG-implementeringsdetaljer.

Når du er fornøyd med kunnskapsbaseresponsen fra Amazon Bedrock, kan du integrere rotårsaksresponsen fra kunnskapsbasen til Streamlit-appen.

Rydd opp

For å spare kostnader, slett ressursene du opprettet i dette innlegget:

- Slett kunnskapsbasen fra Amazon Bedrock.

- Slett OpenSearch Service-indeksen.

- Slett genai-sagemaker CloudFormation-stabelen.

- Stopp EC2-forekomsten hvis du brukte en EC2-forekomst til å kjøre Streamlit-appen.

konklusjonen

Generative AI-applikasjoner har allerede transformert ulike forretningsprosesser, og forbedret arbeidernes produktivitet og ferdighetssett. Imidlertid har begrensningene til FM-er i håndtering av tidsseriedataanalyse hindret deres fulle utnyttelse av industrielle kunder. Denne begrensningen har hindret bruken av generativ AI på den dominerende datatypen som behandles daglig.

I dette innlegget introduserte vi en generativ AI-applikasjonsløsning designet for å lindre denne utfordringen for industrielle brukere. Denne applikasjonen bruker en åpen kildekode-agent, PandasAI, for å styrke en FMs evne til tidsserieanalyse. I stedet for å sende tidsseriedata direkte til FM-er, bruker appen PandasAI til å generere Python-kode for analyse av ustrukturerte tidsseriedata. For å forbedre nøyaktigheten til Python-kodegenerering, har en tilpasset arbeidsflyt for promptgenerering med menneskelig revisjon blitt implementert.

Med innsikt i ressurshelsen deres kan industriarbeidere fullt ut utnytte potensialet til generativ kunstig intelligens på tvers av ulike brukstilfeller, inkludert rotårsaksdiagnose og planlegging av utskifting av deler. Med Knowledge Bases for Amazon Bedrock er RAG-løsningen enkel for utviklere å bygge og administrere.

Banen for administrasjon og drift av bedriftsdata beveger seg umiskjennelig mot dypere integrasjon med generativ AI for omfattende innsikt i operasjonell helse. Dette skiftet, ledet av Amazon Bedrock, er betydelig forsterket av den økende robustheten og potensialet til LLM-er som Amazonas grunnfjell Claude 3 for å heve løsninger ytterligere. For å lære mer, besøk konsultere Amazon Bedrock-dokumentasjon, og få hands-on med Amazon Berggrunn verksted.

Om forfatterne

Julia Hu er Sr. AI/ML Solutions Architect hos Amazon Web Services. Hun er spesialisert i Generativ AI, Applied Data Science og IoT-arkitektur. For tiden er hun en del av Amazon Q-teamet, og et aktivt medlem/mentor i Machine Learning Technical Field Community. Hun jobber med kunder, alt fra oppstartsbedrifter til bedrifter, for å utvikle AWSome generative AI-løsninger. Hun er spesielt lidenskapelig opptatt av å utnytte store språkmodeller for avansert dataanalyse og utforske praktiske applikasjoner som tar tak i virkelige utfordringer.

Julia Hu er Sr. AI/ML Solutions Architect hos Amazon Web Services. Hun er spesialisert i Generativ AI, Applied Data Science og IoT-arkitektur. For tiden er hun en del av Amazon Q-teamet, og et aktivt medlem/mentor i Machine Learning Technical Field Community. Hun jobber med kunder, alt fra oppstartsbedrifter til bedrifter, for å utvikle AWSome generative AI-løsninger. Hun er spesielt lidenskapelig opptatt av å utnytte store språkmodeller for avansert dataanalyse og utforske praktiske applikasjoner som tar tak i virkelige utfordringer.

Sudeesh Sasidharan er Senior Solutions Architect hos AWS, innenfor energiteamet. Sudeesh elsker å eksperimentere med nye teknologier og bygge innovative løsninger som løser komplekse forretningsutfordringer. Når han ikke designer løsninger eller pirker med den nyeste teknologien, kan du finne ham på tennisbanen mens han jobber med backhanden.

Sudeesh Sasidharan er Senior Solutions Architect hos AWS, innenfor energiteamet. Sudeesh elsker å eksperimentere med nye teknologier og bygge innovative løsninger som løser komplekse forretningsutfordringer. Når han ikke designer løsninger eller pirker med den nyeste teknologien, kan du finne ham på tennisbanen mens han jobber med backhanden.

Neil Desai er en teknologileder med over 20 års erfaring innen kunstig intelligens (AI), datavitenskap, programvareteknikk og bedriftsarkitektur. Hos AWS leder han et team av verdensomspennende AI-tjenester spesialistløsningsarkitekter som hjelper kunder med å bygge innovative Generative AI-drevne løsninger, dele beste praksis med kunder og drive produktveikart. I sine tidligere roller i Vestas, Honeywell og Quest Diagnostics har Neil hatt lederroller i utvikling og lansering av innovative produkter og tjenester som har hjulpet bedrifter med å forbedre sin drift, redusere kostnader og øke inntektene. Han er lidenskapelig opptatt av å bruke teknologi til å løse problemer i den virkelige verden og er en strategisk tenker med dokumentert suksess.

Neil Desai er en teknologileder med over 20 års erfaring innen kunstig intelligens (AI), datavitenskap, programvareteknikk og bedriftsarkitektur. Hos AWS leder han et team av verdensomspennende AI-tjenester spesialistløsningsarkitekter som hjelper kunder med å bygge innovative Generative AI-drevne løsninger, dele beste praksis med kunder og drive produktveikart. I sine tidligere roller i Vestas, Honeywell og Quest Diagnostics har Neil hatt lederroller i utvikling og lansering av innovative produkter og tjenester som har hjulpet bedrifter med å forbedre sin drift, redusere kostnader og øke inntektene. Han er lidenskapelig opptatt av å bruke teknologi til å løse problemer i den virkelige verden og er en strategisk tenker med dokumentert suksess.

- SEO-drevet innhold og PR-distribusjon. Bli forsterket i dag.

- PlatoData.Network Vertical Generative Ai. Styrk deg selv. Tilgang her.

- PlatoAiStream. Web3 Intelligence. Kunnskap forsterket. Tilgang her.

- PlatoESG. Karbon, CleanTech, Energi, Miljø, Solenergi, Avfallshåndtering. Tilgang her.

- PlatoHelse. Bioteknologisk og klinisk etterretning. Tilgang her.

- kilde: https://aws.amazon.com/blogs/machine-learning/unlock-the-potential-of-generative-ai-in-industrial-operations/

- : har

- :er

- :ikke

- :hvor

- $OPP

- 000

- 1

- 100

- 125

- 150

- 16

- 20

- 20 år

- 200

- 22

- 23

- 7

- 8

- a

- evne

- I stand

- unormal

- Om oss

- adgang

- Ifølge

- nøyaktighet

- nøyaktig

- tvers

- Handling

- handlings

- aktiv

- legge til

- la til

- Ytterligere

- adresse

- adressering

- Legger

- admin

- Adopsjon

- avansert

- Etter

- Agent

- agenter

- aggregering

- AI

- AI-tjenester

- AI-drevet

- AI / ML

- alarm

- lindre

- tillate

- langs

- allerede

- også

- Amazon

- Amazon EC2

- Amazon-anerkjennelse

- Amazon Web Services

- Amplified

- an

- analyse

- analytics

- og

- abnormiteter

- anomali påvisning

- Anonym

- besvare

- svar

- Antropisk

- noen

- api

- app

- Apputvikling

- Søknad

- søknader

- anvendt

- tilnærming

- ca

- arkitekter

- arkitektur

- ER

- kunstig

- kunstig intelligens

- Kunstig intelligens (AI)

- AS

- spør

- vurdere

- eiendel

- Eiendeler

- Assistent

- bistår

- At

- revisjon

- augmented

- automatisk

- tilgjengelig

- AWS

- AWS skyformasjon

- Bank

- basen

- basert

- grunnleggende

- BE

- fordi

- vært

- begynte

- begynne

- atferd

- drar nytte

- BEST

- beste praksis

- øke

- øker

- Brutt

- nett~~POS=TRUNC leseren~~POS=HEADCOMP

- bygge

- Bygning

- virksomhet

- by

- beregne

- beregningen

- ring

- CAN

- evner

- evne

- fangst

- saken

- saker

- Årsak

- kjede

- utfordre

- utfordringer

- utfordrende

- chatbot

- chatting

- Velg

- velge

- cli

- klienter

- kode

- koder

- samle

- Samle

- samling

- Kom

- kommer

- samfunnet

- Selskaper

- sammenlignet

- sammenligne

- fullføre

- komplekse

- omfattende

- datamaskin

- tilstand

- betydelig

- består

- Konsoll

- begrensninger

- konstruere

- konstruert

- konstruere

- konsultere

- inneholder

- innhold

- kontekst

- kontinuerlig

- kontinuerlig

- bekvemmelighet

- Samtale

- conversational

- konvertering

- Kostnader

- telle

- Court

- skape

- opprettet

- skaper

- kritisk

- Gjeldende

- I dag

- skikk

- Kunder

- daglig

- dato

- dataanalyse

- Data Analytics

- Dataledelse

- databehandling

- datavitenskap

- data-drevet

- Dager

- avgjørelser

- dypere

- Misligholde

- leverer

- krav

- demokratiserer

- avbildet

- utplassere

- utplassert

- distribusjon

- utforming

- designet

- utforme

- ønsket

- detaljert

- detaljering

- detaljer

- oppdage

- Gjenkjenning

- utvikle

- utviklet

- utviklere

- utvikle

- Utvikling

- Enheter

- diagnose

- diagnostikk

- diagram

- forskjellig

- vanskelig

- digitalt

- digitale revolusjonen

- direkte

- katalog

- diskutere

- fordelt

- distinkt

- docs

- dokument

- dokumenter

- ikke

- lastet ned

- trekker

- stasjonen

- kjøring

- to

- varighet

- dynamisk

- hver enkelt

- lett

- enten

- Hev

- eliminerer

- ellers

- embed

- embedding

- ansette

- anvender

- muliggjør

- ende til ende

- energi

- engasjerende

- Ingeniørarbeid

- Ingeniører

- forbedre

- forbedret

- styrke

- berike

- Enter

- Enterprise

- bedrifter

- Hele

- utstyr

- feil

- Selv

- Event

- tydelig

- utvikling

- eksempel

- eksempler

- utøvende

- eksisterer

- eksisterende

- finnes

- utvidet

- erfaring

- eksperimentere

- utforske

- Utforske

- omfattende

- trekke ut

- Face

- legge til rette

- forenkler

- tilrettelegging

- fasiliteter

- Mislyktes

- feil

- Trekk

- felt

- filet

- Filer

- Finn

- Først

- Flows

- fokuserte

- følge

- etter

- følger

- Til

- format

- Fundament

- Rammeverk

- fra

- fullt

- fullt

- funksjon

- funksjonalitet

- videre

- Gevinst

- inntjening

- samle

- generere

- generert

- genererer

- generasjonen

- generative

- Generativ AI

- få

- GitHub

- Går

- Gruppe

- Økende

- Vokser

- Håndtering

- hands-on

- Hard

- seletøy

- Ha

- å ha

- he

- Helse

- sunt

- Held

- hjelpe

- hjulpet

- nyttig

- hjelper

- høy oppløsning

- ham

- hindret

- hans

- Honeywell

- Men

- HTML

- http

- HTTPS

- menneskelig

- identifisere

- if

- illustrere

- illustrerer

- bilde

- bilder

- iverksette

- gjennomføring

- implementert

- forbedre

- forbedret

- forbedrer

- in

- inkludere

- inkludert

- inkluderer

- Inkludert

- innlemme

- Øke

- indeks

- indeksert

- industriell

- informasjon

- informert

- innledende

- initiere

- Starter

- innovative

- inngang

- legge inn

- innsikt

- innsikt

- installere

- f.eks

- instruksjoner

- integrere

- integrering

- integrasjoner

- Intelligens

- Intelligent

- samhandle

- Interface

- Internet

- Internett av ting

- inn

- introdusert

- Introduserer

- IOT

- utstedelse

- IT

- DET ER

- ledd

- jpeg

- jpg

- JSON

- nøkkel

- kunnskap

- kjent

- vet

- Etiketten

- maling

- landskap

- Språk

- stor

- siste

- lansere

- lag

- Ledelse

- Fører

- LÆRE

- læring

- venstre

- nivåer

- utnytte

- Bibliotek

- Licensed

- i likhet med

- begrensninger

- Begrenset

- linjer

- oppført

- leve

- laste

- lokal

- elsker

- maskin

- maskinlæring

- vedlikehold

- GJØR AT

- administrer

- fikk til

- ledelse

- Ledere

- Manipulasjon

- manuelt

- Produsenter

- produksjon

- merke

- math

- max

- Kan..

- me

- målinger

- Møt

- metadata

- metode

- kunne

- minutter

- ML

- modell

- modeller

- Overvåke

- overvåking

- månedlig

- mer

- mest

- Motor

- flytting

- flere

- navn

- Naturlig

- Naviger

- navigere

- Navigasjon

- nødvendig

- Trenger

- Ny

- Ny teknologi

- neste

- Nei.

- normal

- bemerkelsesverdig

- bærbare

- Antall

- innhenter

- of

- tilby

- Tilbud

- on

- ONE

- bare

- åpen

- åpen kildekode

- åpner

- drift

- operasjonell

- Drift

- Optimalisere

- or

- vår

- produksjon

- utganger

- enn

- pakker

- par

- pandaer

- brød

- Paramount

- del

- spesielt

- lidenskapelig

- banen

- PC

- Utfør

- utført

- utfører

- perspektiv

- PHP

- fysisk

- Pivot

- sentral

- planlegging

- plato

- Platon Data Intelligence

- PlatonData

- Spille

- spiller

- Populær

- positurer

- Post

- potensiell

- makt

- powered

- Praktisk

- praksis

- forutsetninger

- forrige

- Før

- problemer

- prosess

- Bearbeidet

- Prosesser

- prosessering

- Produkt

- Produksjon

- produktivitet

- Produkter

- Progress

- prosjekt

- prosjektdata

- ledetekster

- foreslå

- Bevis

- utprøvd

- gi

- gir

- gi

- formål

- Python

- kvantitet

- spørsmål

- spørring

- søken

- spørsmål

- spørsmål

- fille

- område

- spenner

- raskt

- heller

- Når

- Lese

- virkelige verden

- sanntids

- sanntidsdata

- anerkjennelse

- rekord

- redusere

- referere

- i slekt

- relevant

- erstatte

- erstatning

- Repository

- representerer

- forespørsler

- krever

- påkrevd

- Ressurser

- henholdsvis

- svar

- svar

- resulterende

- Resultater

- gjenfinning

- retur

- avkastning

- inntekter

- Revolution

- veikart

- robusthet

- Rolle

- roller

- root

- Kjør

- rennende

- går

- sagemaker

- samme

- fornøyd

- fornøyd med

- Spar

- lagret

- besparende

- Skala

- scenario

- scenarier

- Vitenskap

- forskere

- skjermbilder

- script

- skript

- Søk

- søk

- Sekund

- Seksjon

- sikkerhet

- velg

- valgt

- sending

- sender

- senior

- sensor

- sensorer

- sendt

- Serien

- server

- serverer

- tjeneste

- Tjenester

- sett

- sett

- innstillinger

- flere

- Del

- hun

- skift

- bør

- Vis

- viser

- vist

- Viser

- Signal

- betydelig

- lignende

- Enkelt

- enkelhet

- forenkle

- nettstedet

- Størrelse

- ferdighet

- ferdigheter

- langsom

- liten

- mindre

- So

- Software

- software engineering

- løsning

- Solutions

- LØSE

- noen

- noe

- kilde

- hentet

- Kilder

- spydspiss

- spesialist

- spesialisert

- spesifikk

- spesielt

- spesifikasjon

- spesifikasjoner

- stable

- stående

- Begynn

- start-ups

- state-of-the-art

- statistikk

- Trinn

- Steps

- lagring

- oppbevare

- rett fram

- Strategisk

- stream

- streaming

- effektiviserer

- effektivisering

- Forsterke

- String

- I ettertid

- suksess

- vellykket

- vellykket

- slik

- egnet

- SAMMENDRAG

- levere

- forsyningskjeden

- sikker

- synk.

- system

- Systemer

- bord

- tatt

- Oppgave

- lag

- lag

- Teknisk

- Technologies

- Teknologi

- mal

- tennis

- test

- tekst

- tekstlig

- enn

- Det

- De

- Kilden

- deres

- Dem

- deretter

- Der.

- derfor

- Disse

- de

- ting

- thinker

- Tredje

- denne

- tre

- Gjennom

- tid

- Tidsserier

- titan

- til

- verktøy

- verktøy

- topp

- Totalt

- mot

- spor

- banerekord

- bane

- transformative

- forvandlet

- reiser

- typen

- typisk

- Ubuntu

- etter

- forståelse

- unik

- låse opp

- ustrukturert

- lastet opp

- Opplasting

- bruk

- bruke

- bruk sak

- brukt

- Bruker

- Brukererfaring

- Brukere

- bruker

- ved hjelp av

- Verdifull

- verdi

- variasjon

- ulike

- enorme

- av

- Besøk

- volumer

- venter

- advarsel

- we

- web

- webtjenester

- var

- Hva

- når

- om

- hvilken

- HVEM

- utbredt

- vil

- vindu

- med

- innenfor

- uten

- arbeidstaker

- arbeidere

- arbeidsflyt

- arbeidsflyt

- arbeid

- virker

- verdensomspennende

- Feil

- år

- ennå

- Utbytte

- Du

- Din

- zephyrnet