Kunder står overfor økende sikkerhetstrusler og sårbarheter på tvers av infrastruktur og applikasjonsressurser etter hvert som deres digitale fotavtrykk har utvidet seg og forretningseffekten av disse digitale eiendelene har vokst. En vanlig cybersikkerhetsutfordring har vært todelt:

- Konsumere logger fra digitale ressurser som kommer i forskjellige formater og skjemaer og automatisere analysen av trusselfunn basert på disse loggene.

- Enten logger kommer fra Amazon Web Services (AWS), andre skyleverandører, lokale eller edge-enheter, må kundene sentralisere og standardisere sikkerhetsdata.

Videre må analysene for å identifisere sikkerhetstrusler være i stand til å skaleres og utvikles for å møte et skiftende landskap av trusselaktører, sikkerhetsvektorer og digitale eiendeler.

En ny tilnærming for å løse dette komplekse sikkerhetsanalysescenarioet kombinerer inntak og lagring av sikkerhetsdata ved hjelp av Amazon Security Lake og analysere sikkerhetsdataene med maskinlæring (ML) ved hjelp av Amazon SageMaker. Amazon Security Lake er en spesialbygd tjeneste som automatisk sentraliserer en organisasjons sikkerhetsdata fra sky- og lokale kilder til en spesialbygd datainnsjø som er lagret i AWS-kontoen din. Amazon Security Lake automatiserer sentral administrasjon av sikkerhetsdata, normaliserer logger fra integrerte AWS-tjenester og tredjepartstjenester og administrerer livssyklusen til data med tilpassbar oppbevaring og automatiserer også lagringsnivå. Amazon Security Lake inntar loggfiler i Åpne Cybersecurity Schema Framework (OCSF)-format, med støtte for partnere som Cisco Security, CrowdStrike, Palo Alto Networks og OCSF-logger fra ressurser utenfor ditt AWS-miljø. Dette enhetlige skjemaet effektiviserer nedstrømsforbruk og analyser fordi dataene følger et standardisert skjema og nye kilder kan legges til med minimale endringer i datapipeline. Etter at sikkerhetsloggdataene er lagret i Amazon Security Lake, blir spørsmålet hvordan de skal analyseres. En effektiv tilnærming til å analysere sikkerhetsloggdataene er å bruke ML; spesifikt anomalideteksjon, som undersøker aktivitets- og trafikkdata og sammenligner dem med en grunnlinje. Grunnlinjen definerer hvilken aktivitet som er statistisk normal for det miljøet. Anomalideteksjon skalerer utover en individuell hendelsesignatur, og den kan utvikle seg med periodisk omskolering; Trafikk klassifisert som unormal eller unormal kan deretter iverksettes med prioritert fokus og haster. Amazon SageMaker er en fullstendig administrert tjeneste som gjør det mulig for kunder å forberede data og bygge, trene og distribuere ML-modeller for enhver brukssituasjon med fullstendig administrert infrastruktur, verktøy og arbeidsflyter, inkludert tilbud uten kode for forretningsanalytikere. SageMaker støtter to innebygde anomalideteksjonsalgoritmer: IP-innsikt og Tilfeldig kuttet skog. Du kan også bruke SageMaker til å lage din egen tilpassede modell for avvikdeteksjon ved hjelp av algoritmer hentet fra flere ML-rammeverk.

I dette innlegget lærer du hvordan du forbereder data hentet fra Amazon Security Lake, og deretter trener og distribuerer en ML-modell ved hjelp av en IP Insights-algoritme i SageMaker. Denne modellen identifiserer unormal nettverkstrafikk eller atferd som deretter kan komponeres som en del av en større ende-til-ende sikkerhetsløsning. En slik løsning kan påkalle en multi-faktor autentisering (MFA) sjekk om en bruker logger på fra en uvanlig server eller på et uvanlig tidspunkt, varsle personalet hvis det er en mistenkelig nettverksskanning som kommer fra nye IP-adresser, varsle administratorer hvis uvanlig nettverk protokoller eller porter brukes, eller berike IP-innsiktsklassifiseringsresultatet med andre datakilder som f.eks. Amazon Guard Duty og IP-omdømmepoeng for å rangere trusselfunn.

Løsningsoversikt

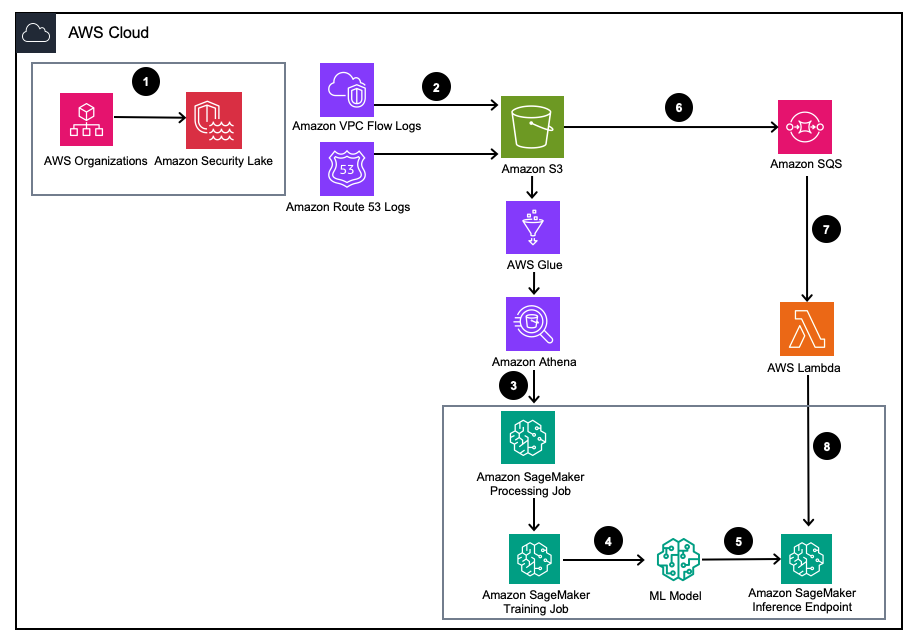

Figur 1 – Løsningsarkitektur

- Aktiver Amazon Security Lake med AWS organisasjoner for AWS-kontoer, AWS-regioner og eksterne IT-miljøer.

- Sett opp Security Lake-kilder fra Amazon Virtual Private Cloud (Amazon VPC) Flowlogger og Amazon Route53 DNS-logger til Amazon Security Lake S3-bøtten.

- Behandle Amazon Security Lake-loggdata ved å bruke en SageMaker Processing-jobb for å konstruere funksjoner. Bruk Amazonas Athena å spørre strukturerte OCSF-loggdata fra Amazon Simple Storage Service (Amazon S3) gjennom AWS Lim tabeller administrert av AWS LakeFormation.

- Tren en SageMaker ML-modell ved å bruke en SageMaker Training-jobb som bruker de behandlede Amazon Security Lake-loggene.

- Distribuer den trente ML-modellen til et SageMaker-slutningsendepunkt.

- Lagre nye sikkerhetslogger i en S3-bøtte og legg hendelser i kø Amazon Simple Queue Service (Amazon SQS).

- Abonner på en AWS Lambda funksjon til SQS-køen.

- Påkall SageMaker-inferensendepunktet ved å bruke en Lambda-funksjon for å klassifisere sikkerhetslogger som anomalier i sanntid.

Forutsetninger

For å distribuere løsningen må du først fullføre følgende forutsetninger:

- Aktiver Amazon Security Lake innen organisasjonen din eller en enkelt konto med både VPC Flow Logs og Route 53 resolver logger aktivert.

- Kontroller at AWS Identity and Access Management (IAM) rolle brukt av SageMaker som behandler jobber og notatbøker har fått en IAM-policy inkludert Tillatelse til tilgang til Amazon Security Lake-abonnentsøk for den administrerte Amazon Security Lake-databasen og tabeller administrert av AWS Lake Formation. Denne behandlingsjobben bør kjøres fra en analyse- eller sikkerhetsverktøykonto for å forbli kompatibel AWS Security Reference Architecture (AWS SRA).

- Sørg for at IAM-rollen som brukes av Lambda-funksjonen har fått en IAM-policy inkludert Datatilgangstillatelse for Amazon Security Lake-abonnenter.

Distribuere løsningen

For å sette opp miljøet, fullfør følgende trinn:

- Start en SageMaker Studio eller SageMaker Jupyter notatbok med en

ml.m5.largeforekomst. OBS: Forekomststørrelsen er avhengig av datasettene du bruker. - Klon GitHub Repository.

- Åpne notatboken

01_ipinsights/01-01.amazon-securitylake-sagemaker-ipinsights.ipy. - Implementere gitt IAM-policy og tilsvarende IAM-tillitspolicy for din SageMaker Studio Notebook-forekomst for å få tilgang til alle nødvendige data i S3, Lake Formation og Athena.

Denne bloggen går gjennom den relevante delen av koden i notatboken etter at den er distribuert i miljøet ditt.

Installer avhengighetene og importer det nødvendige biblioteket

Bruk følgende kode for å installere avhengigheter, importere de nødvendige bibliotekene og lage SageMaker S3-bøtten som trengs for databehandling og modellopplæring. Et av de nødvendige bibliotekene, awswrangler, er en AWS SDK for pandas dataramme som brukes til å spørre de relevante tabellene i AWS Glue Data Catalog og lagre resultatene lokalt i en dataramme.

Spørr Amazon Security Lake VPC-flytloggtabellen

Denne delen av koden bruker AWS SDK for pandaer for å spørre etter AWS Glue-tabellen relatert til VPC Flow Logs. Som nevnt i forutsetningene, administreres Amazon Security Lake-tabeller av AWS Lake formasjon, så alle nødvendige tillatelser må gis til rollen som brukes av SageMaker-notisboken. Denne spørringen vil trekke flere dager med VPC-flytloggtrafikk. Datasettet som ble brukt under utviklingen av denne bloggen var lite. Avhengig av omfanget av bruksområdet ditt, bør du være klar over grensene for AWS SDK for pandaer. Når du vurderer terabyte-skala, bør du vurdere AWS SDK for panda-støtte for Modin.

Når du viser datarammen, vil du se en utdata fra en enkelt kolonne med vanlige felt som kan finnes i Nettverksaktivitet (4001) klasse av OCSF.

Normaliser Amazon Security Lake VPC-flytloggdataene til det nødvendige opplæringsformatet for IP Insights.

IP Insights-algoritmen krever at treningsdataene er i CSV-format og inneholder to kolonner. Den første kolonnen må være en ugjennomsiktig streng som tilsvarer en enhets unike identifikator. Den andre kolonnen må være IPv4-adressen til enhetens tilgangshendelse i desimalpunktnotasjon. I eksempeldatasettet for denne bloggen er den unike identifikatoren forekomst-ID-ene til EC2-forekomster knyttet til instance_id verdi innenfor dataframe. IPv4-adressen vil bli avledet fra src_endpoint. Basert på måten Amazon Athena-spørringen ble opprettet på, er de importerte dataene allerede i riktig format for opplæring av en IP Insights-modell, så ingen ekstra funksjonsutvikling er nødvendig. Hvis du endrer spørringen på en annen måte, må du kanskje inkorporere ekstra funksjonsteknikk.

Spørr og normaliser Amazon Security Lake Route 53-resolver-loggtabellen

Akkurat som du gjorde ovenfor, kjører neste trinn i den bærbare datamaskinen en lignende spørring mot Amazon Security Lake Route 53-oppløsningstabellen. Siden du skal bruke alle OCSF-kompatible data i denne notatboken, forblir alle funksjonsingeniøroppgaver de samme for Route 53-resolverlogger som de var for VPC Flow Logs. Du kombinerer deretter de to datarammene til en enkelt dataramme som brukes til trening. Siden Amazon Athena-spørringen laster dataene lokalt i riktig format, er ingen ytterligere funksjonsutvikling nødvendig.

Få IP Insights treningsbilde og tren modellen med OCSF-dataene

I denne neste delen av notatboken trener du en ML-modell basert på IP Insights-algoritmen og bruker den konsoliderte dataframe av OCSF fra forskjellige typer logger. Du finner en liste over IP Insights-hyperparmetrene her.. I eksemplet nedenfor valgte vi hyperparametere som ga den best ytelse modellen, for eksempel 5 for epoch og 128 for vector_dim. Siden opplæringsdatasettet for utvalget vårt var relativt lite, brukte vi en ml.m5.large forekomst. Hyperparametre og treningskonfigurasjoner som forekomstantall og forekomsttype bør velges basert på objektive beregninger og treningsdatastørrelsen. En funksjon som du kan bruke i Amazon SageMaker for å finne den beste versjonen av modellen din, er Amazon SageMaker automatisk modellinnstilling som søker etter den beste modellen på tvers av en rekke hyperparameterverdier.

Distribuer den trente modellen og test med gyldig og unormal trafikk

Etter at modellen har blitt opplært, distribuerer du modellen til et SageMaker-endepunkt og sender en serie unike identifikatorer og IPv4-adressekombinasjoner for å teste modellen din. Denne delen av koden forutsetter at du har testdata lagret i S3-bøtten din. Testdataene er en .csv-fil, der den første kolonnen er forekomst-ID-er og den andre kolonnen er IP-er. Det anbefales å teste gyldige og ugyldige data for å se resultatene av modellen. Følgende kode distribuerer endepunktet ditt.

Nå som endepunktet ditt er distribuert, kan du nå sende inn slutningsforespørsler for å identifisere om trafikk er potensielt unormal. Nedenfor er et eksempel på hvordan de formaterte dataene dine skal se ut. I dette tilfellet er den første kolonneidentifikatoren en forekomst-ID, og den andre kolonnen er en tilknyttet IP-adresse som vist i følgende:

Etter at du har dataene dine i CSV-format, kan du sende inn dataene for slutning ved å bruke koden ved å lese .csv-filen fra en S3-bøtte.:

Utdataene for en IP Insights-modell gir et mål på hvor statistisk forventet en IP-adresse og nettressurs er. Området for denne adressen og ressursen er imidlertid ubegrenset, så det er vurderinger om hvordan du vil finne ut om en kombinasjon av forekomst-ID og IP-adresse skal anses som unormal.

I det foregående eksempelet ble fire forskjellige identifikator- og IP-kombinasjoner sendt til modellen. De to første kombinasjonene var gyldige forekomst-ID- og IP-adressekombinasjoner som forventes basert på opplæringssettet. Den tredje kombinasjonen har den riktige unike identifikatoren, men en annen IP-adresse innenfor samme subnett. Modellen bør fastslå at det er en beskjeden anomali, da innbyggingen er litt forskjellig fra treningsdataene. Den fjerde kombinasjonen har en gyldig unik identifikator, men en IP-adresse til et ikke-eksisterende subnett i en hvilken som helst VPC i miljøet.

OBS: Normale og unormale trafikkdata vil endres basert på din spesifikke brukssituasjon, for eksempel: hvis du ønsker å overvåke ekstern og intern trafikk, trenger du en unik identifikator som er justert til hver IP-adresse og et skjema for å generere de eksterne identifikatorene.

For å finne ut hva terskelen din bør være for å finne ut om trafikken er unormal, kan du gjøre med kjent normal og unormal trafikk. Trinnene skissert i denne eksempelnotisboken er som følger:

- Konstruer et testsett for å representere normal trafikk.

- Legg til unormal trafikk i datasettet.

- Plott fordelingen av

dot_productskårer for modellen på normal trafikk og unormal trafikk. - Velg en terskelverdi som skiller den normale delmengden fra den unormale delmengden. Denne verdien er basert på din falske positive toleranse

Sett opp kontinuerlig overvåking av ny VPC-flytloggtrafikk.

For å demonstrere hvordan denne nye ML-modellen kan brukes med Amazon Security Lake på en proaktiv måte, vil vi konfigurere en Lambda-funksjon som skal aktiveres på hver PutObject hendelse i Amazon Security Lake administrerte bøtte, nærmere bestemt VPC-flytloggdataene. Innenfor Amazon Security Lake er det konseptet med en abonnent, som bruker logger og hendelser fra Amazon Security Lake. Lambdafunksjonen som reagerer på nye hendelser må gis et datatilgangsabonnement. Abonnenter med datatilgang blir varslet om nye Amazon S3-objekter for en kilde når objektene skrives til Security Lake-bøtten. Abonnenter kan få direkte tilgang til S3-objektene og motta varsler om nye objekter gjennom et abonnementsendepunkt eller ved å polle en Amazon SQS-kø.

- Åpne Security Lake-konsoll.

- Velg i navigasjonsruten abonnenter.

- På Abonnenter-siden velger du Opprett abonnent.

- For abonnentdetaljer, skriv inn

inferencelambdaforum Abonnentnavn og en valgfri Beskrivelse. - De Region settes automatisk som din valgte AWS-region og kan ikke endres.

- Til Logg og hendelseskilder, velg Spesifikke logg- og hendelseskilder Og velg VPC Flow Logger og Route 53 logger

- Til Datatilgangsmetode, velg S3.

- Til Abonnentlegitimasjon, oppgi AWS-konto-ID-en for kontoen der Lambda-funksjonen skal ligge og en brukerspesifisert ekstern ID.

OBS: Hvis du gjør dette lokalt i en konto, trenger du ikke å ha en ekstern ID. - Velg Opprett.

Lag Lambda-funksjonen

For å opprette og distribuere Lambda-funksjonen kan du enten fullføre følgende trinn eller distribuere den forhåndsbygde SAM-malen 01_ipinsights/01.02-ipcheck.yaml i GitHub-repoen. SAM-malen krever at du oppgir SQS ARN og SageMaker-endepunktnavnet.

- Velg Lambda-konsollen Opprett funksjon.

- Velg Forfatter fra bunnen av.

- Til Funksjonsnavn, Tast inn

ipcheck. - Til Runtime, velg Python 3.10.

- Til arkitektur, plukke ut x86_64.

- Til Utførelsesrolle, plukke ut Opprett en ny rolle med Lambda-tillatelser.

- Etter at du har opprettet funksjonen, skriv inn innholdet i ipcheck.py fil fra GitHub-repoen.

- Velg i navigasjonsruten Miljøvariabler.

- Velg Rediger.

- Velg Legg til miljøvariabel.

- For den nye miljøvariabelen, skriv inn

ENDPOINT_NAMEog for verdi skriv inn endepunktet ARN som ble utgitt under distribusjon av SageMaker-endepunktet. - Plukke ut Spar.

- Velg Distribuer.

- Velg i navigasjonsruten Konfigurasjon.

- Plukke ut triggere.

- Plukke ut Legg til trigger.

- Under Velg en kilde, velg SQS.

- Under SQS-kø, skriv inn ARN for hoved-SQS-køen opprettet av Security Lake.

- Velg avmerkingsboksen for Aktiver trigger.

- Plukke ut Legg til.

Valider Lambda-funn

- Åpne Amazon CloudWatch-konsoll.

- Velg i venstre sidepanel Logggrupper.

- Skriv inn ipcheck i søkefeltet, og velg deretter logggruppen med navnet

/aws/lambda/ipcheck. - Velg den nyeste loggstrømmen under Loggstrømmer.

- I loggene bør du se resultater som ser ut som følgende for hver nye Amazon Security Lake-logg:

{'predictions': [{'dot_product': 0.018832731992006302}, {'dot_product': 0.018832731992006302}]}

Denne Lambda-funksjonen analyserer kontinuerlig nettverkstrafikken som inntas av Amazon Security Lake. Dette lar deg bygge mekanismer for å varsle sikkerhetsteamene dine når en spesifisert terskel brytes, noe som kan indikere unormal trafikk i miljøet ditt.

Opprydding

Når du er ferdig med å eksperimentere med denne løsningen og for å unngå belastninger på kontoen din, kan du rydde opp i ressursene dine ved å slette S3-bøtten, SageMaker-endepunktet, slå av datamaskinen som er koblet til SageMaker Jupyter-notebooken, slette Lambda-funksjonen og deaktivere Amazon Security Lake på kontoen din.

konklusjonen

I dette innlegget lærte du hvordan du forbereder nettverkstrafikkdata hentet fra Amazon Security Lake for maskinlæring, og deretter trente og implementerte du en ML-modell ved å bruke IP Insights-algoritmen i Amazon SageMaker. Alle trinnene som er skissert i Jupyter-notisboken kan replikeres i en ende-til-ende ML-pipeline. Du implementerte også en AWS Lambda-funksjon som konsumerte nye Amazon Security Lake-logger og sendte inn konklusjoner basert på den trente anomalideteksjonsmodellen. ML-modellsvarene mottatt av AWS Lambda kan proaktivt varsle sikkerhetsteam om unormal trafikk når visse terskler er oppfylt. Kontinuerlig forbedring av modellen kan aktiveres ved å inkludere sikkerhetsteamet ditt i løkkevurderingene for å merke om trafikk identifisert som unormal var en falsk positiv eller ikke. Dette kan deretter legges til treningssettet ditt og også legges til ditt normal trafikkdatasett når en empirisk terskel skal bestemmes. Denne modellen kan identifisere potensielt unormal nettverkstrafikk eller atferd der den kan inkluderes som en del av en større sikkerhetsløsning for å starte en MFA-sjekk hvis en bruker logger på fra en uvanlig server eller på et uvanlig tidspunkt, varsle personalet hvis det er en mistenkelig nettverksskanning som kommer fra nye IP-adresser, eller kombiner IP-innsikten med andre kilder som Amazon Guard Duty for å rangere trusselfunn. Denne modellen kan inkludere egendefinerte loggkilder som Azure Flow-logger eller lokale logger ved å legge til egendefinerte kilder til Amazon Security Lake-distribusjonen.

I del 2 av denne blogginnleggsserien vil du lære hvordan du bygger en anomalideteksjonsmodell ved hjelp av Tilfeldig kuttet skog algoritme trent med flere Amazon Security Lake-kilder som integrerer nettverks- og vertssikkerhetsloggdata og bruker sikkerhetsavviksklassifiseringen som en del av en automatisert, omfattende sikkerhetsovervåkingsløsning.

Om forfatterne

Joe Morotti er en løsningsarkitekt hos Amazon Web Services (AWS), og hjelper Enterprise-kunder over hele Midtvesten i USA. Han har hatt et bredt spekter av tekniske roller og liker å vise kundens kunst av det mulige. På fritiden liker han å tilbringe kvalitetstid med familien på å utforske nye steder og overanalysere idrettslagets prestasjoner

Joe Morotti er en løsningsarkitekt hos Amazon Web Services (AWS), og hjelper Enterprise-kunder over hele Midtvesten i USA. Han har hatt et bredt spekter av tekniske roller og liker å vise kundens kunst av det mulige. På fritiden liker han å tilbringe kvalitetstid med familien på å utforske nye steder og overanalysere idrettslagets prestasjoner

Bishr Tabbaa er løsningsarkitekt hos Amazon Web Services. Bishr spesialiserer seg på å hjelpe kunder med applikasjoner for maskinlæring, sikkerhet og observerbarhet. Utenom jobben liker han å spille tennis, lage mat og tilbringe tid med familien.

Bishr Tabbaa er løsningsarkitekt hos Amazon Web Services. Bishr spesialiserer seg på å hjelpe kunder med applikasjoner for maskinlæring, sikkerhet og observerbarhet. Utenom jobben liker han å spille tennis, lage mat og tilbringe tid med familien.

Sriharsh Adari er Senior Solutions Architect hos Amazon Web Services (AWS), hvor han hjelper kunder med å jobbe bakover fra forretningsresultater for å utvikle innovative løsninger på AWS. Gjennom årene har han hjulpet flere kunder med transformasjoner av dataplattformer på tvers av industrivertikaler. Hans kjernekompetanse inkluderer teknologistrategi, dataanalyse og datavitenskap. På fritiden liker han å spille tennis, se på TV-serier og spille Tabla.

Sriharsh Adari er Senior Solutions Architect hos Amazon Web Services (AWS), hvor han hjelper kunder med å jobbe bakover fra forretningsresultater for å utvikle innovative løsninger på AWS. Gjennom årene har han hjulpet flere kunder med transformasjoner av dataplattformer på tvers av industrivertikaler. Hans kjernekompetanse inkluderer teknologistrategi, dataanalyse og datavitenskap. På fritiden liker han å spille tennis, se på TV-serier og spille Tabla.

- SEO-drevet innhold og PR-distribusjon. Bli forsterket i dag.

- PlatoData.Network Vertical Generative Ai. Styrk deg selv. Tilgang her.

- PlatoAiStream. Web3 Intelligence. Kunnskap forsterket. Tilgang her.

- PlatoESG. Karbon, CleanTech, Energi, Miljø, Solenergi, Avfallshåndtering. Tilgang her.

- PlatoHelse. Bioteknologisk og klinisk etterretning. Tilgang her.

- kilde: https://aws.amazon.com/blogs/machine-learning/identify-cybersecurity-anomalies-in-your-amazon-security-lake-data-using-amazon-sagemaker/

- : har

- :er

- :ikke

- :hvor

- $OPP

- 01

- 1

- 10

- 100

- 12

- 125

- 15%

- 17

- 20000

- 25

- 32

- 7

- 9

- a

- ovenfor

- adgang

- Logg inn

- kontoer

- tvers

- aktivitet

- aktører

- la til

- legge

- Ytterligere

- adresse

- adresser

- administratorer

- Etter

- mot

- Varsle

- algoritme

- algoritmer

- justert

- Alle

- tillater

- allerede

- også

- Amazon

- Amazonas Athena

- Amazon SageMaker

- Amazon Web Services

- Amazon Web Services (AWS)

- an

- analyse

- analytikere

- analytics

- analysere

- analyser

- analyserer

- og

- abnormiteter

- anomali påvisning

- En annen

- noen

- Søknad

- søknader

- Påfør

- tilnærming

- arkitektur

- ER

- AREA

- Kunst

- AS

- Eiendeler

- assosiert

- antar

- At

- Autentisering

- Automatisert

- automatiserer

- automatisk

- Automatisere

- unngå

- klar

- AWS

- AWS Lim

- AWS Lake formasjon

- AWS Lambda

- Azure

- Bar

- basert

- Baseline

- BE

- fordi

- blir

- vært

- atferd

- være

- under

- BEST

- Beyond

- Blogg

- både

- bygge

- innebygd

- virksomhet

- men

- by

- CAN

- evne

- stand

- saken

- katalog

- sentral

- sentralisere

- viss

- utfordre

- endring

- Endringer

- endring

- avgifter

- sjekk

- Velg

- valgt ut

- Cisco

- klasse

- klassifisering

- klassifisert

- Klassifisere

- ren

- Cloud

- kode

- Kolonne

- kolonner

- kombinasjon

- kombinasjoner

- kombinere

- skurtreskerne

- Kom

- kommer

- Felles

- fullføre

- komplekse

- kompatibel

- komponert

- omfattende

- Beregn

- konsept

- Vurder

- betraktninger

- ansett

- vurderer

- Konsoll

- forbrukes

- forbruk

- inneholde

- innhold

- kontinuerlig

- kontinuerlig

- Kjerne

- korrigere

- tilsvarer

- kunne

- skape

- opprettet

- I dag

- skikk

- Kunder

- tilpasses

- Kutt

- Cybersecurity

- dato

- data tilgang

- Data Analytics

- Data Lake

- Dataplattform

- databehandling

- datavitenskap

- Database

- datasett

- Dager

- definerer

- demonstrere

- avhengig

- avhengig

- avhengig

- utplassere

- utplassert

- distribusjon

- Distribueres

- Avledet

- detaljer

- Gjenkjenning

- Bestem

- bestemme

- utvikle

- Utvikling

- Enheter

- gJORDE

- forskjellig

- digitalt

- Digitale eiendeler

- direkte

- distribusjon

- dns

- doesn

- gjør

- Don

- gjort

- ikke

- ned

- under

- e

- hver enkelt

- Edge

- Effektiv

- enten

- ellers

- embedding

- aktivert

- muliggjør

- ende til ende

- Endpoint

- ingeniør

- Ingeniørarbeid

- nyte

- berike

- Enter

- Enterprise

- Miljø

- miljøer

- epoke

- feil

- Event

- hendelser

- utvikle seg

- utvikling

- undersøker

- eksempel

- Unntatt

- finnes

- utvidet

- forventet

- ekspertise

- Utforske

- utvendig

- møtt

- falsk

- familie

- Trekk

- Egenskaper

- Felt

- filet

- Filer

- Finn

- funn

- Først

- flyten

- Fokus

- etter

- følger

- Fotspor

- Til

- format

- formasjon

- funnet

- fire

- Fjerde

- RAMME

- rammer

- Gratis

- fra

- fullt

- funksjon

- videre

- generere

- GitHub

- innvilget

- Gruppe

- voksen

- Guard

- Ha

- he

- Held

- hjulpet

- hjelpe

- hjelper

- hans

- vert

- Hvordan

- Hvordan

- Men

- HTML

- HTTPS

- ID

- identifisert

- identifikator

- identifikatorer

- identifiserer

- identifisere

- identifisering

- Identitet

- ids

- if

- bilde

- Påvirkning

- implementert

- importere

- forbedring

- in

- inkludere

- inkludert

- Inkludert

- innlemme

- økende

- indikerer

- individuelt

- industri

- Infrastruktur

- initiere

- innovative

- innsikt

- installere

- f.eks

- integrere

- integrert

- intern

- inn

- påkalt

- IP

- IP-adresse

- IP-adresser

- IT

- Jobb

- Jobb

- jpg

- JSON

- kjent

- Etiketten

- innsjø

- landskap

- stor

- større

- LÆRE

- lært

- læring

- venstre

- bibliotekene

- Livssyklus

- i likhet med

- grenser

- Liste

- laster

- lokalt

- logg

- Se

- ser ut som

- maskin

- maskinlæring

- Hoved

- fikk til

- ledelse

- forvalter

- måte

- Kan..

- måle

- mekanismer

- Møt

- nevnt

- møtte

- Metrics

- MFA

- Vesten

- minimal

- mangler

- ML

- modell

- modeller

- beskjeden

- modifisert

- modifisere

- Overvåke

- overvåking

- mest

- flere

- må

- navn

- Navigasjon

- nødvendig

- Trenger

- nødvendig

- nettverk

- nettverkstrafikk

- nettverk

- Ny

- neste

- Nei.

- ikke-eksisterende

- normal

- bærbare

- varslinger

- roman

- nå

- Målet

- gjenstander

- of

- tilbud

- on

- ONE

- på nett

- ugjennomsiktig

- or

- organisasjon

- OS

- Annen

- vår

- utfall

- uteligger

- skissert

- produksjon

- utenfor

- enn

- egen

- side

- Palo Alto

- pandaer

- brød

- del

- partnere

- utfører

- periodisk

- tillatelse

- tillatelser

- rørledning

- steder

- plattform

- plato

- Platon Data Intelligence

- PlatonData

- spiller

- politikk

- del

- porter

- positiv

- mulig

- Post

- potensielt

- forut

- Spådommer

- Predictor

- Forbered

- forutsetninger

- prioritert

- privat

- Proaktiv

- Bearbeidet

- prosessering

- ordentlig

- protokoller

- gi

- tilbydere

- gir

- kvalitet

- spørsmål

- heve

- område

- rangerer

- Lesning

- ekte

- sanntids

- motta

- mottatt

- nylig

- anbefales

- referanse

- region

- regioner

- i slekt

- relativt

- relevant

- forbli

- replikert

- representere

- omdømme

- forespørsler

- påkrevd

- Krever

- ressurs

- Ressurser

- svar

- svar

- resultere

- Resultater

- oppbevaring

- Anmeldelser

- Rolle

- roller

- Rute

- Kjør

- går

- sagemaker

- SageMaker Inference

- Sam

- samme

- Eksempel på datasett

- lagret

- Skala

- vekter

- skalering

- skanne

- scenario

- ordningen

- Vitenskap

- Resultat

- SDK

- Søk

- søk

- Sekund

- sikkerhet

- Sikkerhetstrusler

- se

- velg

- valgt

- send

- senior

- Serien

- server

- tjeneste

- Tjenester

- Session

- sett

- bør

- vist

- Viser

- nedleggelse

- side

- signatur

- signering

- lignende

- Enkelt

- siden

- enkelt

- Størrelse

- litt annerledes

- liten

- So

- løsning

- Solutions

- LØSE

- kilde

- hentet

- Kilder

- spesialisert

- spesifikk

- spesielt

- spesifisert

- utgifter

- Sports

- Staff

- Trinn

- Steps

- lagring

- oppbevare

- lagret

- Strategi

- stream

- effektiviserer

- String

- strukturert

- studio

- send

- innsendt

- subnett

- abonnent

- abonnenter

- abonnement

- slik

- støtte

- Støtter

- mistenkelig

- bord

- oppgaver

- lag

- lag

- Teknisk

- Teknologi

- Teknologistrategi

- mal

- tennis

- test

- Det

- De

- deres

- deretter

- Der.

- de

- Tredje

- tredjeparts

- denne

- De

- trussel

- trusselaktører

- trusler

- terskel

- Gjennom

- tid

- til

- verktøy

- trafikk

- Tog

- trent

- Kurs

- transformasjoner

- Stol

- prøve

- tv

- to

- to gangers

- typen

- typer

- etter

- enhetlig

- unik

- upon

- hastverk

- us

- bruke

- bruk sak

- brukt

- Bruker

- bruker

- ved hjelp av

- bruke

- benyttes

- gyldig

- verdi

- Verdier

- variabel

- versjon

- vertikaler

- Se

- krenket

- virtuelle

- Sikkerhetsproblemer

- vandringer

- ønsker

- var

- Vei..

- we

- web

- webtjenester

- var

- Hva

- når

- om

- hvilken

- bred

- Bred rekkevidde

- vil

- med

- innenfor

- Arbeid

- arbeidsflyt

- ville

- skrevet

- år

- Du

- Din

- zephyrnet