Med den raske bruken av generative AI-applikasjoner, er det behov for at disse applikasjonene reagerer i tide for å redusere den opplevde latensen med høyere gjennomstrømning. Fundamentmodeller (FM-er) er ofte forhåndstrent på store datakorpora med parametere som varierer i skala fra millioner til milliarder og utover. Store språkmodeller (LLM) er en type FM som genererer tekst som en respons på brukerens slutning. Å trekke slutninger om disse modellene med varierende konfigurasjoner av slutningsparametere kan føre til inkonsistente ventetider. Inkonsekvensen kan skyldes det varierende antallet responstokens du forventer fra modellen eller typen akselerator modellen er utplassert på.

I begge tilfeller, i stedet for å vente på det fullstendige svaret, kan du bruke tilnærmingen med responsstrømming for slutningene dine, som sender tilbake biter av informasjon så snart de er generert. Dette skaper en interaktiv opplevelse ved at du kan se delvise svar strømmet i sanntid i stedet for en forsinket full respons.

Med den offisielle kunngjøringen at Amazon SageMaker sanntidsslutning støtter nå responsstrømming, kan du nå kontinuerlig streame slutningssvar tilbake til klienten når du bruker Amazon SageMaker sanntidsslutning med responsstrømming. Denne løsningen vil hjelpe deg med å bygge interaktive opplevelser for ulike generative AI-applikasjoner som chatbots, virtuelle assistenter og musikkgeneratorer. Dette innlegget viser deg hvordan du kan realisere raskere responstider i form av Time to First Byte (TTFB) og redusere den generelle oppfattede latensen mens du trekker ut Llama 2-modeller.

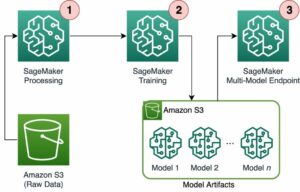

For å implementere løsningen bruker vi SageMaker, en fullt administrert tjeneste for å forberede data og bygge, trene og distribuere maskinlæringsmodeller (ML) for alle bruksområder med fullstendig administrert infrastruktur, verktøy og arbeidsflyter. For mer informasjon om de ulike distribusjonsalternativene SageMaker tilbyr, se Vanlige spørsmål om Amazon SageMaker Model Hosting. La oss forstå hvordan vi kan løse forsinkelsesproblemene ved å bruke sanntidsslutning med responsstrømming.

Løsningsoversikt

Fordi vi ønsker å adressere de nevnte ventetidene knyttet til sanntidsslutning med LLM-er, la oss først forstå hvordan vi kan bruke støtte for responsstrømming for sanntidsslutninger for Llama 2. Imidlertid kan enhver LLM dra nytte av støtte for responsstrømming med reell -tidsslutning.

Llama 2 er en samling av forhåndstrente og finjusterte generative tekstmodeller som varierer i skala fra 7 milliarder til 70 milliarder parametere. Llama 2-modeller er autoregressive modeller med kun dekoderarkitektur. Når de er utstyrt med en ledetekst og slutningsparametere, er Llama 2-modeller i stand til å generere tekstsvar. Disse modellene kan brukes til oversettelse, oppsummering, svar på spørsmål og chat.

For dette innlegget distribuerer vi Llama 2 Chat-modellen meta-llama/Llama-2-13b-chat-hf på SageMaker for sanntidsslutning med responsstrømming.

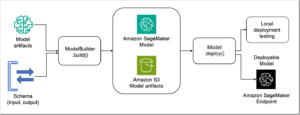

Når det gjelder å distribuere modeller på SageMaker-endepunkter, kan du beholde modellene ved å bruke spesialiserte AWS Deep Learning Container (DLC)-bilder tilgjengelig for populære åpen kildekode-biblioteker. Llama 2-modeller er tekstgenereringsmodeller; du kan bruke enten Hugging Face LLM-slutningsbeholdere på SageMaker drevet av Hugging Face Tekstgenerasjonsslutning (TGI) eller AWS DLCer for Stor modellslutning (LMI).

I dette innlegget distribuerer vi Llama 2 13B Chat-modellen ved å bruke DLC-er på SageMaker Hosting for sanntidsslutninger drevet av G5-instanser. G5-forekomster er en høyytelses GPU-baserte forekomster for grafikkintensive applikasjoner og ML-inferens. Du kan også bruke støttede forekomsttyper p4d, p3, g5 og g4dn med passende endringer i henhold til forekomstkonfigurasjonen.

Forutsetninger

For å implementere denne løsningen, bør du ha følgende:

- En AWS-konto med en AWS identitets- og tilgangsadministrasjon (IAM) rolle med tillatelser til å administrere ressurser opprettet som en del av løsningen.

- Hvis dette er første gang du jobber med Amazon SageMaker Studio, må du først opprette en SageMaker-domene.

- En Hugging Face-konto. Meld deg på med e-posten din hvis du ikke allerede har en konto.

- For sømløs tilgang til modellene som er tilgjengelige på Hugging Face, spesielt gatede modeller som Llama, for finjustering og slutningsformål, bør du ha en Hugging Face-konto for å få et lesetilgangstoken. Etter at du har registrert deg for Hugging Face-kontoen din, Logg inn å besøke https://huggingface.co/settings/tokens for å opprette et lesetilgangstoken.

- Tilgang til Llama 2 ved å bruke samme e-post-ID som du brukte til å registrere deg for Hugging Face.

- Llama 2-modellene tilgjengelig via Hugging Face er portmodeller. Bruken av Llama-modellen er underlagt Meta-lisensen. For å laste ned modellvekter og tokenizer, be om tilgang til Llama og godta lisensen deres.

- Etter at du har fått tilgang (vanligvis i løpet av et par dager), vil du motta en e-postbekreftelse. For dette eksempelet bruker vi modellen

Llama-2-13b-chat-hf, men du bør kunne få tilgang til andre varianter også.

Tilnærming 1: Hugging Face TGI

I denne delen viser vi deg hvordan du distribuerer meta-llama/Llama-2-13b-chat-hf modell til et SageMaker-endepunkt i sanntid med responsstrømming ved hjelp av Hugging Face TGI. Tabellen nedenfor viser spesifikasjonene for denne distribusjonen.

| Spesifikasjon | Verdi |

| Container | Hugging Face TGI |

| Modellnavn | meta-llama/Llama-2-13b-chat-hf |

| ML-forekomst | ml.g5.12xlarge |

| slutning | Sanntid med responsstrømming |

Distribuer modellen

Først henter du basisbildet for LLM som skal distribueres. Du bygger deretter modellen på basisbildet. Til slutt distribuerer du modellen til ML-instansen for SageMaker Hosting for sanntidsslutning.

La oss se hvordan du oppnår distribusjonen programmatisk. For korthets skyld er bare koden som hjelper med distribusjonstrinnene som diskuteres i denne delen. Den fullstendige kildekoden for distribusjon er tilgjengelig i notatboken llama-2-hf-tgi/llama-2-13b-chat-hf/1-deploy-llama-2-13b-chat-hf-tgi-sagemaker.ipynb.

Hent den nyeste Hugging Face LLM DLC drevet av TGI via forhåndsbygd SageMaker DLC-er. Du bruker dette bildet til å distribuere meta-llama/Llama-2-13b-chat-hf modell på SageMaker. Se følgende kode:

Definer miljøet for modellen med konfigurasjonsparametrene definert som følger:

Erstatt <YOUR_HUGGING_FACE_READ_ACCESS_TOKEN> for konfigurasjonsparameteren HUGGING_FACE_HUB_TOKEN med verdien av tokenet hentet fra Hugging Face-profilen din som beskrevet i forutsetningsdelen av dette innlegget. I konfigurasjonen definerer du antall GPUer som brukes per replika av en modell som 4 for SM_NUM_GPUS. Deretter kan du distribuere meta-llama/Llama-2-13b-chat-hf modell på en ml.g5.12xlarge forekomst som kommer med 4 GPUer.

Nå kan du bygge forekomsten av HuggingFaceModel med den nevnte miljøkonfigurasjonen:

Til slutt, distribuer modellen ved å gi argumenter til distribusjonsmetoden som er tilgjengelig på modellen med ulike parameterverdier som f.eks endpoint_name, initial_instance_countog instance_type:

Utfør slutning

Hugging Face TGI DLC kommer med muligheten til å streame svar uten noen tilpasninger eller kodeendringer i modellen. Du kan bruke invoke_endpoint_with_response_stream hvis du bruker Boto3 eller InvokeEndpointWithResponseStream når du programmerer med SageMaker Python SDK.

De InvokeEndpointWithResponseStream API av SageMaker lar utviklere streame svar tilbake fra SageMaker-modeller, noe som kan bidra til å forbedre kundetilfredsheten ved å redusere den oppfattede ventetiden. Dette er spesielt viktig for applikasjoner bygget med generative AI-modeller, der umiddelbar behandling er viktigere enn å vente på hele svaret.

For dette eksemplet bruker vi Boto3 for å utlede modellen og bruker SageMaker API invoke_endpoint_with_response_stream som følger:

Argumentet CustomAttributes er satt til verdien accept_eula=false. De accept_eula parameteren må settes til true for å oppnå responsen fra Llama 2-modellene. Etter den vellykkede påkallingen bruker invoke_endpoint_with_response_stream, vil metoden returnere en responsstrøm av byte.

Følgende diagram illustrerer denne arbeidsflyten.

Du trenger en iterator som går over strømmen av byte og analyserer dem til lesbar tekst. De LineIterator implementering finner du på llama-2-hf-tgi/llama-2-13b-chat-hf/utils/LineIterator.py. Nå er du klar til å forberede forespørselen og instruksjonene for å bruke dem som nyttelast mens du slutter modellen.

Forbered en forespørsel og instruksjoner

I dette trinnet forbereder du ledeteksten og instruksjonene for din LLM. For å spørre Llama 2, bør du ha følgende spørsmålsmal:

Du bygger ledetekstmalen som er programmatisk definert i metoden build_llama2_prompt, som stemmer overens med den nevnte ledetekstmalen. Du definerer deretter instruksjonene i henhold til brukstilfellet. I dette tilfellet ber vi modellen om å generere en e-post for en markedsføringskampanje som dekkes i get_instructions metode. Koden for disse metodene er i llama-2-hf-tgi/llama-2-13b-chat-hf/2-sagemaker-realtime-inference-llama-2-13b-chat-hf-tgi-streaming-response.ipynb notisbok. Bygg instruksjonen kombinert med oppgaven som skal utføres som beskrevet i user_ask_1 som følger:

Vi sender instruksjonene for å bygge ledeteksten i henhold til ledetekstmalen generert av build_llama2_prompt.

Vi klubber slutningsparametrene sammen med ledeteksten med nøkkelen stream med verdien True for å danne en endelig nyttelast. Send nyttelasten til get_realtime_response_stream, som vil bli brukt til å påkalle et endepunkt med responsstrømming:

Den genererte teksten fra LLM vil bli streamet til utgangen som vist i følgende animasjon.

Tilnærming 2: LMI med DJL-servering

I denne delen viser vi hvordan du distribuerer meta-llama/Llama-2-13b-chat-hf modell til et SageMaker-endepunkt i sanntid med responsstrømming ved hjelp av LMI med DJL-servering. Tabellen nedenfor viser spesifikasjonene for denne distribusjonen.

| Spesifikasjon | Verdi |

| Container | LMI-beholderbilde med DJL-servering |

| Modellnavn | meta-llama/Llama-2-13b-chat-hf |

| ML-forekomst | ml.g5.12xlarge |

| slutning | Sanntid med responsstrømming |

Først laster du ned modellen og lagrer den i Amazon enkel lagringstjeneste (Amazon S3). Du spesifiserer deretter S3 URI som indikerer S3-prefikset til modellen i serving.properties fil. Deretter henter du basisbildet for LLM som skal distribueres. Du bygger deretter modellen på basisbildet. Til slutt distribuerer du modellen til ML-instansen for SageMaker Hosting for sanntidsslutning.

La oss se hvordan du oppnår de nevnte distribusjonstrinnene programmatisk. For korthets skyld er bare koden som hjelper med distribusjonstrinnene som er beskrevet i denne delen. Den fullstendige kildekoden for denne distribusjonen er tilgjengelig i notatboken llama-2-lmi/llama-2-13b-chat/1-deploy-llama-2-13b-chat-lmi-response-streaming.ipynb.

Last ned modellbildet fra Hugging Face og last opp modellartefakter på Amazon S3

Med de nevnte forutsetningene, last ned modellen på SageMaker-notebook-forekomsten og last den deretter opp til S3-bøtten for videre distribusjon:

Merk at selv om du ikke oppgir et gyldig tilgangstoken, vil modellen lastes ned. Men når du distribuerer en slik modell, vil ikke modellserveringen lykkes. Derfor anbefales det å bytte ut <YOUR_HUGGING_FACE_READ_ACCESS_TOKEN> for argumentasjonen token med verdien av tokenet hentet fra Hugging Face-profilen din som beskrevet i forutsetningene. For dette innlegget spesifiserer vi den offisielle modellens navn for Llama 2 som identifisert på Hugging Face med verdien meta-llama/Llama-2-13b-chat-hf. Den ukomprimerte modellen vil bli lastet ned til local_model_path som et resultat av å kjøre den nevnte koden.

Last opp filene til Amazon S3 og få URI, som senere vil bli brukt i serving.properties.

Du skal pakke inn meta-llama/Llama-2-13b-chat-hf modell på LMI-beholderbildet med DJL-servering ved å bruke konfigurasjonen spesifisert via serving.properties. Deretter distribuerer du modellen sammen med modellartefakter pakket på beholderbildet på SageMaker ML-forekomsten ml.g5.12xlarge. Du bruker deretter denne ML-forekomsten for SageMaker Hosting for sanntidsslutning.

Forbered modellartefakter for DJL-servering

Forbered modellartefakter ved å lage en serving.properties konfigurasjonsfil:

Vi bruker følgende innstillinger i denne konfigurasjonsfilen:

- motor – Dette spesifiserer kjøretidsmotoren som DJL skal bruke. De mulige verdiene inkluderer

Python,DeepSpeed,FasterTransformerogMPI. I dette tilfellet setter vi det tilMPI. Model Parallelization and Inference (MPI) gjør det lettere å partisjonere modellen på tvers av alle tilgjengelige GPUer og akselererer derfor inferens. - option.entryPoint – Dette alternativet spesifiserer hvilken behandler som tilbys av DJL Serving du ønsker å bruke. De mulige verdiene er

djl_python.huggingface,djl_python.deepspeedogdjl_python.stable-diffusion. Vi brukerdjl_python.huggingfacefor Hugging Face Accelerate. - option.tensor_parallel_degree – Dette alternativet spesifiserer antall tensorparallelle partisjoner som utføres på modellen. Du kan angi antall GPU-enheter som Accelerate trenger for å partisjonere modellen. Denne parameteren kontrollerer også antall arbeidere per modell som vil bli startet opp når DJL-servering kjører. For eksempel, hvis vi har en 4 GPU-maskin og vi lager fire partisjoner, vil vi ha én arbeider per modell for å betjene forespørslene.

- option.low_cpu_mem_usage – Dette reduserer CPU-minnebruken når du laster inn modeller. Vi anbefaler at du setter dette til

TRUE. - option.rolling_batch – Dette muliggjør batching på iterasjonsnivå ved å bruke en av de støttede strategiene. Verdier inkluderer

auto,scheduleroglmi-dist. Vi brukerlmi-distfor å slå på kontinuerlig batching for Llama 2. - option.max_rolling_batch_size – Dette begrenser antall samtidige forespørsler i den kontinuerlige batchen. Verdien er standard til 32.

- option.model_id – Du bør bytte ut

{{model_id}}med modell-ID-en til en forhåndstrent modell som er vert inne i en modelllager på Hugging Face eller S3-bane til modellartefakter.

Du finner flere konfigurasjonsalternativer i Konfigurasjoner og innstillinger.

Fordi DJL Serving forventer at modellartefaktene skal pakkes og formateres i en .tar-fil, kjører du følgende kodebit for å komprimere og laste opp .tar-filen til Amazon S3:

Hent det siste LMI-beholderbildet med DJL Serving

Deretter bruker du DLC-ene som er tilgjengelige med SageMaker for LMI for å distribuere modellen. Hent SageMaker-bilde-URI for djl-deepspeed beholder programmatisk ved å bruke følgende kode:

Du kan bruke det nevnte bildet til å distribuere meta-llama/Llama-2-13b-chat-hf modell på SageMaker. Nå kan du fortsette å lage modellen.

Lag modellen

Du kan lage modellen hvis container er bygget ved å bruke inference_image_uri og modellserveringskoden som er plassert ved S3 URI angitt av s3_code_artifact:

Nå kan du lage modellkonfigurasjonen med alle detaljene for endepunktkonfigurasjonen.

Lag modellkonfigurasjonen

Bruk følgende kode for å lage en modellkonfigurasjon for modellen identifisert av model_name:

Modellkonfigurasjonen er definert for ProductionVariants parameter InstanceType for ML-forekomsten ml.g5.12xlarge. Du gir også ModelName ved å bruke samme navn som du brukte til å lage modellen i det tidligere trinnet, og dermed etablere en relasjon mellom modellen og endepunktkonfigurasjonen.

Nå som du har definert modellen og modellkonfigurasjonen, kan du opprette SageMaker-endepunktet.

Opprett SageMaker-endepunktet

Opprett endepunktet for å distribuere modellen ved å bruke følgende kodebit:

Du kan se fremdriften for distribusjonen ved å bruke følgende kodebit:

Etter at distribusjonen er vellykket, vil endepunktstatusen være InService. Nå som endepunktet er klart, la oss utføre slutninger med responsstrømming.

Sanntidsslutning med responsstrømming

Som vi dekket i den tidligere tilnærmingen for Hugging Face TGI, kan du bruke samme metode get_realtime_response_stream å påkalle svarstrømming fra SageMaker-endepunktet. Koden for slutning ved bruk av LMI-tilnærmingen er i llama-2-lmi/llama-2-13b-chat/2-inference-llama-2-13b-chat-lmi-response-streaming.ipynb notisbok. De LineIterator implementeringen ligger i llama-2-lmi/utils/LineIterator.py. Merk at LineIterator for Llama 2 Chat-modellen som er distribuert på LMI-beholderen er forskjellig fra LineIterator referert i Hugging Face TGI-delen. De LineIterator løkker over bytestrømmen fra Llama 2 Chat-modeller inferert med LMI-beholderen med djl-deepspeed versjon 0.25.0. Følgende hjelpefunksjon vil analysere svarstrømmen mottatt fra slutningsforespørselen gjort via invoke_endpoint_with_response_stream API:

Den foregående metoden skriver ut datastrømmen som leses av LineIterator i et menneskelest format.

La oss undersøke hvordan du forbereder forespørselen og instruksjonene for å bruke dem som nyttelast mens vi trekker ut modellen.

Fordi du slutter den samme modellen i både Hugging Face TGI og LMI, er prosessen med å forberede forespørselen og instruksjonene den samme. Derfor kan du bruke metodene get_instructions og build_llama2_prompt for å konkludere.

De get_instructions metoden returnerer instruksjonene. Bygg instruksjonene kombinert med oppgaven som skal utføres som beskrevet i user_ask_2 som følger:

Send instruksjonene for å bygge ledeteksten i henhold til ledetekstmalen generert av build_llama2_prompt:

Vi klubber slutningsparametrene sammen med ledeteksten for å danne en endelig nyttelast. Deretter sender du nyttelasten til get_realtime_response_stream, som brukes til å påkalle et endepunkt med responsstrømming:

Den genererte teksten fra LLM vil bli streamet til utgangen som vist i følgende animasjon.

Rydd opp

For å unngå unødvendige kostnader, bruk AWS-administrasjonskonsoll for å slette endepunktene og tilhørende ressurser som ble opprettet mens du kjørte tilnærmingene nevnt i innlegget. For begge distribusjonstilnærmingene, utfør følgende oppryddingsrutine:

Erstatt <SageMaker_Real-time_Endpoint_Name> for variabel endpoint_name med det faktiske endepunktet.

For den andre tilnærmingen lagret vi modell- og kodeartefakter på Amazon S3. Du kan rydde opp i S3-bøtten ved å bruke følgende kode:

konklusjonen

I dette innlegget diskuterte vi hvordan et varierende antall responstokens eller et annet sett med slutningsparametere kan påvirke latensene knyttet til LLM-er. Vi viste hvordan vi kan løse problemet ved hjelp av responsstrømming. Vi identifiserte deretter to tilnærminger for å distribuere og utlede Llama 2 Chat-modeller ved å bruke AWS DLC-er – LMI og Hugging Face TGI.

Du bør nå forstå viktigheten av strømmerespons og hvordan det kan redusere opplevd ventetid. Streamingrespons kan forbedre brukeropplevelsen, noe som ellers ville fått deg til å vente til LLM bygger hele responsen. I tillegg forbedrer bruk av Llama 2 Chat-modeller med responsstrømming brukeropplevelsen og gjør kundene fornøyde.

Du kan referere til de offisielle aws-eksemplene amazon-sagemaker-llama2-respons-streaming-oppskrifter som dekker distribusjon for andre Llama 2-modellvarianter.

Referanser

Om forfatterne

Pavan Kumar Rao Navule er løsningsarkitekt hos Amazon Web Services. Han jobber med ISV-er i India for å hjelpe dem med å innovere på AWS. Han er en publisert forfatter for boken "Kom i gang med V-programmering." Han forfulgte en Executive M.Tech i datavitenskap fra Indian Institute of Technology (IIT), Hyderabad. Han tok også en Executive MBA i IT-spesialisering fra Indian School of Business Management and Administration, og har en B.Tech i elektronikk og kommunikasjonsteknikk fra Vaagdevi Institute of Technology and Science. Pavan er en AWS Certified Solutions Architect Professional og har andre sertifiseringer som AWS Certified Machine Learning Specialty, Microsoft Certified Professional (MCP) og Microsoft Certified Technology Specialist (MCTS). Han er også en åpen kildekode-entusiast. På fritiden elsker han å lytte til de store magiske stemmene til Sia og Rihanna.

Pavan Kumar Rao Navule er løsningsarkitekt hos Amazon Web Services. Han jobber med ISV-er i India for å hjelpe dem med å innovere på AWS. Han er en publisert forfatter for boken "Kom i gang med V-programmering." Han forfulgte en Executive M.Tech i datavitenskap fra Indian Institute of Technology (IIT), Hyderabad. Han tok også en Executive MBA i IT-spesialisering fra Indian School of Business Management and Administration, og har en B.Tech i elektronikk og kommunikasjonsteknikk fra Vaagdevi Institute of Technology and Science. Pavan er en AWS Certified Solutions Architect Professional og har andre sertifiseringer som AWS Certified Machine Learning Specialty, Microsoft Certified Professional (MCP) og Microsoft Certified Technology Specialist (MCTS). Han er også en åpen kildekode-entusiast. På fritiden elsker han å lytte til de store magiske stemmene til Sia og Rihanna.

Sudhanshu hater er ledende AI/ML-spesialist med AWS og jobber med klienter for å gi dem råd om deres MLOps og generative AI-reise. I sin forrige rolle før Amazon, konseptualiserte, skapte og ledet han team for å bygge bakkebaserte åpen kildekode-baserte AI og gamification-plattformer, og vellykket kommersialiserte det med over 100 kunder. Sudhanshu tilegner seg et par patenter, har skrevet to bøker og flere artikler og blogger, og har presentert sine synspunkter i ulike tekniske fora. Han har vært en tankeleder og foredragsholder, og har vært i bransjen i nesten 25 år. Han har jobbet med Fortune 1000-kunder over hele verden og sist med digitale innfødte kunder i India.

Sudhanshu hater er ledende AI/ML-spesialist med AWS og jobber med klienter for å gi dem råd om deres MLOps og generative AI-reise. I sin forrige rolle før Amazon, konseptualiserte, skapte og ledet han team for å bygge bakkebaserte åpen kildekode-baserte AI og gamification-plattformer, og vellykket kommersialiserte det med over 100 kunder. Sudhanshu tilegner seg et par patenter, har skrevet to bøker og flere artikler og blogger, og har presentert sine synspunkter i ulike tekniske fora. Han har vært en tankeleder og foredragsholder, og har vært i bransjen i nesten 25 år. Han har jobbet med Fortune 1000-kunder over hele verden og sist med digitale innfødte kunder i India.

- SEO-drevet innhold og PR-distribusjon. Bli forsterket i dag.

- PlatoData.Network Vertical Generative Ai. Styrk deg selv. Tilgang her.

- PlatoAiStream. Web3 Intelligence. Kunnskap forsterket. Tilgang her.

- PlatoESG. Karbon, CleanTech, Energi, Miljø, Solenergi, Avfallshåndtering. Tilgang her.

- PlatoHelse. Bioteknologisk og klinisk etterretning. Tilgang her.

- kilde: https://aws.amazon.com/blogs/machine-learning/inference-llama-2-models-with-real-time-response-streaming-using-amazon-sagemaker/

- : har

- :er

- :hvor

- $OPP

- 1

- 10

- 100

- 11

- 12

- 14

- 15%

- 150

- 16

- 19

- 1.

- 25

- 32

- 385

- 50

- 7

- 70

- 8

- 9

- a

- evne

- I stand

- Om oss

- akselerere

- akselererer

- akselerator

- Aksepterer

- adgang

- Logg inn

- Oppnå

- tvers

- Handling

- faktiske

- I tillegg

- adresse

- administrasjon

- adoptere

- Adopsjon

- Fordel

- råde

- påvirke

- Etter

- AI

- AI-modeller

- AI / ML

- alice

- Justerer

- Alle

- tillate

- tillater

- langs

- allerede

- også

- Amazon

- Amazon SageMaker

- Amazon Web Services

- an

- og

- animasjon

- annonsert

- Kunngjøring

- noen

- api

- søknader

- tilnærming

- tilnærminger

- hensiktsmessig

- arkitektonisk

- arkitektur

- ER

- argument

- argumenter

- AS

- assistenter

- assosiert

- At

- forfatter

- tilgjengelig

- unngå

- AWS

- tilbake

- basen

- batching

- BE

- fordi

- vært

- før du

- mellom

- Beyond

- Milliarder

- milliarder

- BIN

- blogger

- kroppen

- bok

- bøker

- både

- bygge

- bygger

- bygget

- virksomhet

- men

- by

- ring

- Kampanje

- CAN

- stand

- saken

- sertifiseringer

- Sertifisert

- Endringer

- avgifter

- chatte

- chatbots

- ren

- kunde

- klienter

- klubb

- kode

- samling

- COM

- kombinert

- kommer

- Kommunikasjon

- samtidig

- Konfigurasjon

- bekreftelse

- Container

- Containere

- kontinuerlig

- kontinuerlig

- kontroller

- kunne

- Par

- kupong

- dekket

- Dekker

- skape

- opprettet

- skaper

- Opprette

- kreditt

- kunde

- Kundetilfredshet

- Kunder

- dato

- datavitenskap

- Dager

- dyp

- dyp læring

- mislighold

- definere

- definert

- Forsinket

- demonstrere

- utplassere

- utplassert

- utplasserings

- distribusjon

- detaljert

- detaljer

- utviklere

- Enheter

- forskjellig

- digitalt

- diskutert

- ikke

- nedlasting

- under

- Tidligere

- enten

- Elektronikk

- emalje

- muliggjør

- Endpoint

- Motor

- Ingeniørarbeid

- entusiast

- Hele

- Miljø

- spesielt

- etablere

- Selv

- eksempel

- utøvende

- venter

- forventer

- erfaring

- Erfaringer

- utforske

- Face

- forenkler

- falsk

- raskere

- filet

- Filer

- slutt~~POS=TRUNC

- Endelig

- Først

- første gang

- etter

- følger

- Til

- skjema

- format

- Fortune

- fora

- funnet

- Fundament

- fire

- Gratis

- fra

- fullt

- fullt

- funksjon

- videre

- gamification

- inngjerdet

- generere

- generert

- genererer

- generasjonen

- generative

- Generativ AI

- generatorer

- få

- gif

- globus

- Go

- styrt

- GPU

- GPU

- innvilget

- flott

- lykkelig

- hater

- Ha

- he

- hjelpe

- hjelper

- høy ytelse

- høyere

- hans

- holder

- vert

- Hosting

- Hvordan

- Hvordan

- Men

- HTML

- http

- HTTPS

- Klem ansikt

- lesbar

- ID

- identifisert

- Identitet

- if

- illustrerer

- bilde

- bilder

- umiddelbar

- iverksette

- gjennomføring

- importere

- betydning

- viktig

- forbedre

- forbedrer

- in

- inkludere

- Inkludert

- india

- indisk

- indikert

- industri

- informasjon

- Infrastruktur

- innovere

- inngang

- innganger

- innsiden

- f.eks

- i stedet

- Institute

- instruksjoner

- interaktiv

- Internet

- saker

- IT

- DET ER

- reise

- JSON

- nøkkel

- Kumar

- Språk

- stor

- Ventetid

- problemer med ventetid

- seinere

- siste

- lansere

- føre

- leder

- læring

- Led

- Lengde

- bibliotekene

- Tillatelse

- i likhet med

- grenser

- linje

- lytte

- Llama

- LLM

- lasting

- ligger

- elsker

- maskin

- maskinlæring

- laget

- gjøre

- GJØR AT

- administrer

- fikk til

- ledelse

- Marketing

- max

- Kan..

- MCP

- Minne

- nevnt

- Meta

- metode

- metoder

- Microsoft

- millioner

- ML

- MLOps

- modell

- modeller

- måneder

- mer

- mest

- musikk

- må

- navn

- oppkalt

- innfødt

- nesten

- Trenger

- behov

- Ny

- neste

- note

- bærbare

- nå

- Antall

- gjenstander

- observere

- få

- innhentet

- of

- tilbudt

- offisiell

- ofte

- on

- ONE

- bare

- åpen

- åpen kildekode

- Alternativ

- alternativer

- or

- Annen

- ellers

- skisserer

- produksjon

- enn

- samlet

- pakket

- emballasje

- papirer

- Parallel

- parameter

- parametere

- del

- passere

- Patenter

- banen

- for

- oppfattet

- Utfør

- utført

- tillatelser

- Plattformer

- plato

- Platon Data Intelligence

- PlatonData

- poeng

- Populær

- mulig

- Post

- powered

- forut

- Forbered

- forbereder

- forutsetninger

- presentert

- forrige

- Principal

- utskrifter

- Problem

- fortsette

- prosess

- Bearbeidet

- prosessering

- Produkt

- produktlansering

- profesjonell

- Profil

- Programmering

- Progress

- egenskaper

- gi

- forutsatt

- gir

- gi

- publisert

- formål

- Python

- pytorch

- spørsmål

- spenner

- rask

- heller

- Lese

- klar

- ekte

- sanntids

- realisere

- motta

- mottatt

- nylig

- anbefaler

- anbefales

- redusere

- reduserer

- redusere

- referere

- forhold

- erstatte

- svare

- Repository

- anmode

- forespørsler

- Ressurser

- Svare

- svar

- svar

- resultere

- retur

- avkastning

- Rolle

- rutine

- Kjør

- rennende

- går

- runtime

- sagemaker

- samme

- tilfredshet

- Skala

- Skole

- Vitenskap

- SDK

- sømløs

- Sekund

- Seksjon

- se

- send

- sender

- betjene

- tjeneste

- Tjenester

- servering

- sett

- innstillinger

- flere

- Kort

- bør

- Vis

- viste

- vist

- Viser

- undertegne

- Enkelt

- Snapshot

- tekstutdrag

- løsning

- Solutions

- snart

- kilde

- kildekoden

- Høyttaler

- spesialist

- spesialisert

- Spesialitet

- spesifikasjoner

- spesifisert

- startet

- status

- Trinn

- Steps

- Stopp

- lagring

- oppbevare

- lagret

- strategier

- stream

- streames

- streaming

- streaming tjeneste

- lykkes

- vellykket

- vellykket

- slik

- støtte

- Støttes

- Støtter

- bord

- Ta

- Oppgave

- lag

- tech

- Teknisk

- Teknologi

- mal

- tekst

- enn

- Det

- De

- deres

- Dem

- deretter

- Der.

- derved

- derfor

- Disse

- de

- denne

- selv om?

- trodde

- gjennomstrømning

- tid

- ganger

- til

- token

- tokens

- verktøy

- Tog

- Oversettelse

- sant

- Turning

- to

- typen

- typer

- typisk

- forstå

- unødvendig

- til

- bruk

- bruke

- bruk sak

- brukt

- Bruker

- Brukererfaring

- ved hjelp av

- gyldig

- verdi

- Verdier

- variabel

- ulike

- Varierende

- enorme

- versjon

- av

- Se

- virtuelle

- Besøk

- STemmer

- vente

- venter

- ønsker

- we

- web

- webtjenester

- VI VIL

- var

- når

- hvilken

- mens

- hele

- hvem sin

- vil

- med

- innenfor

- uten

- arbeidet

- arbeidstaker

- arbeidere

- arbeidsflyt

- arbeidsflyt

- arbeid

- virker

- ville

- skrive

- skrevet

- år

- Du

- Din

- zephyrnet