I dag er vi glade for å kunngjøre at Mistral 7B-fundamentmodellene, utviklet av Mistral AI, er tilgjengelige for kunder gjennom Amazon SageMaker JumpStart å distribuere med ett klikk for å kjøre inferens. Med 7 milliarder parametere kan Mistral 7B enkelt tilpasses og raskt implementeres. Du kan prøve ut denne modellen med SageMaker JumpStart, en maskinlæringshub (ML) som gir tilgang til algoritmer og modeller slik at du raskt kan komme i gang med ML. I dette innlegget går vi gjennom hvordan du oppdager og distribuerer Mistral 7B-modellen.

Hva er Mistral 7B

Mistral 7B er en grunnmodell utviklet av Mistral AI, og støtter engelsk tekst- og kodegenereringsevne. Den støtter en rekke brukstilfeller, for eksempel tekstoppsummering, klassifisering, tekstfullføring og kodefullføring. For å demonstrere modellens enkle tilpasningsmuligheter har Mistral AI også gitt ut en Mistral 7B Instruct-modell for chat-brukstilfeller, finjustert ved hjelp av en rekke offentlig tilgjengelige samtaledatasett.

Mistral 7B er en transformatormodell og bruker oppmerksomhet med gruppert spørring og oppmerksomhet i skyvevinduer for å oppnå raskere inferens (lav latens) og håndtere lengre sekvenser. Group Query Attention er en arkitektur som kombinerer multi-spørring og multi-head oppmerksomhet for å oppnå utskriftskvalitet nær multi-head oppmerksomhet og sammenlignbar hastighet med multi-query oppmerksomhet. Skyvevindu oppmerksomhet bruker de stablede lagene i en transformator for å delta i fortiden utover vindusstørrelsen for å øke kontekstlengden. Mistral 7B har en kontekstlengde på 8,000 token, viser lav latenstid og høy gjennomstrømning, og har sterk ytelse sammenlignet med større modellalternativer, og gir lave minnekrav ved en 7B modellstørrelse. Modellen er gjort tilgjengelig under tillatelsen Apache 2.0 lisens, for bruk uten begrensninger.

Hva er SageMaker JumpStart

Med SageMaker JumpStart kan ML-utøvere velge fra en voksende liste over foundationmodeller med best ytelse. ML-utøvere kan distribuere grunnmodeller til dedikerte Amazon SageMaker forekomster i et nettverksisolert miljø, og tilpasse modeller ved hjelp av SageMaker for modellopplæring og distribusjon.

Du kan nå oppdage og distribuere Mistral 7B med noen få klikk inn Amazon SageMaker Studio eller programmatisk gjennom SageMaker Python SDK, slik at du kan utlede modellytelse og MLOps-kontroller med SageMaker-funksjoner som f.eks. Amazon SageMaker-rørledninger, Amazon SageMaker Debugger, eller containerlogger. Modellen er distribuert i et AWS-sikkert miljø og under dine VPC-kontroller, noe som bidrar til å sikre datasikkerhet.

Oppdag modeller

Du kan få tilgang til Mistral 7B-fundamentmodeller gjennom SageMaker JumpStart i SageMaker Studio UI og SageMaker Python SDK. I denne delen går vi gjennom hvordan du oppdager modellene i SageMaker Studio.

SageMaker Studio er et integrert utviklingsmiljø (IDE) som gir et enkelt nettbasert visuelt grensesnitt der du kan få tilgang til spesialbygde verktøy for å utføre alle ML-utviklingstrinn, fra å forberede data til å bygge, trene og distribuere ML-modellene dine. For mer informasjon om hvordan du kommer i gang og konfigurerer SageMaker Studio, se Amazon SageMaker Studio.

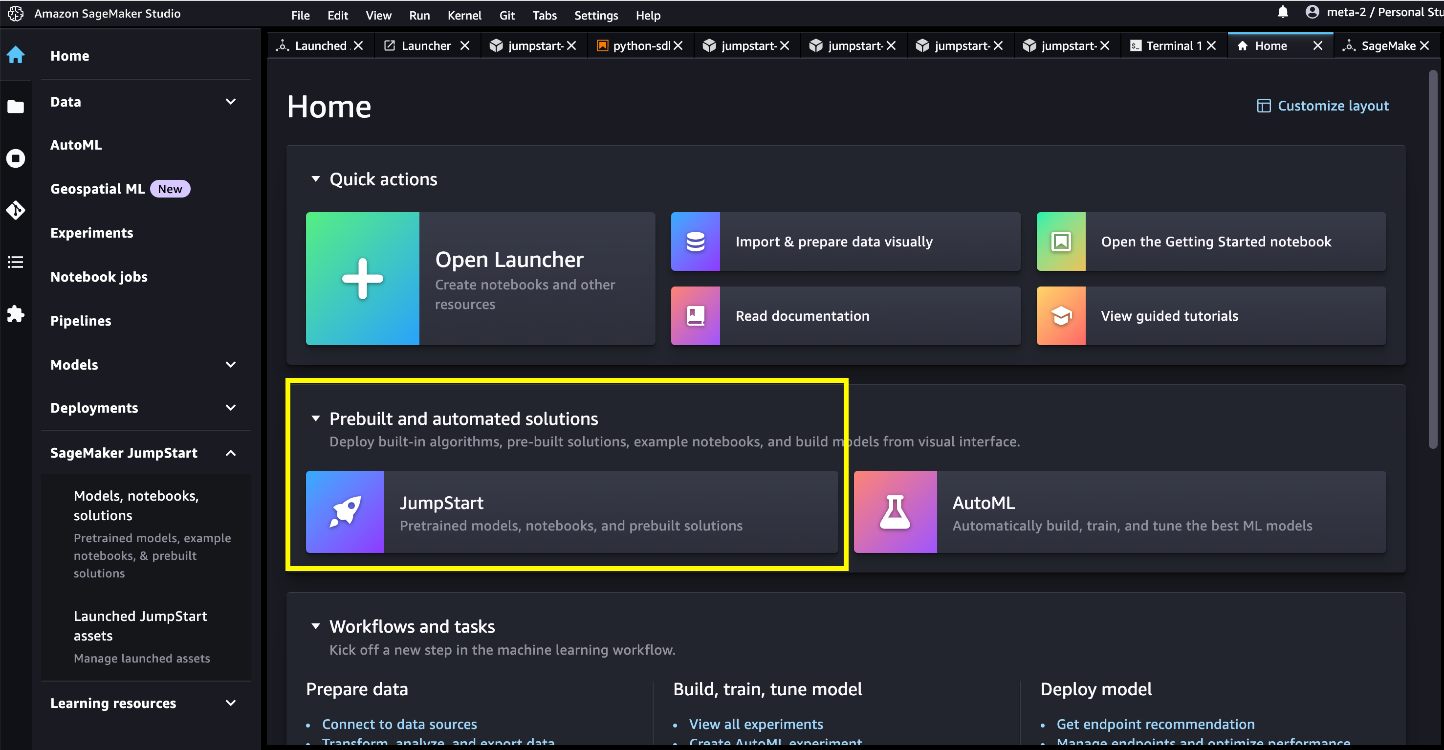

I SageMaker Studio kan du få tilgang til SageMaker JumpStart, som inneholder ferdigtrente modeller, bærbare datamaskiner og forhåndsbygde løsninger, under Forhåndsbygde og automatiserte løsninger.

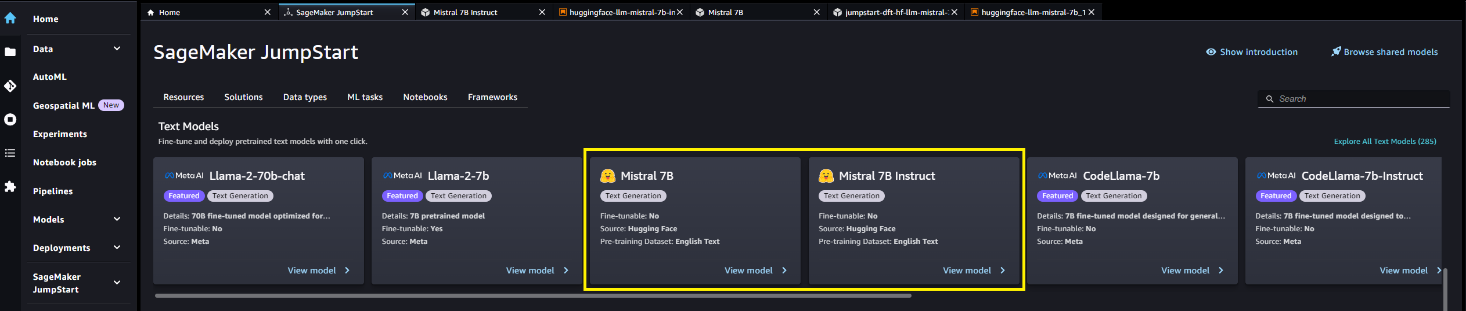

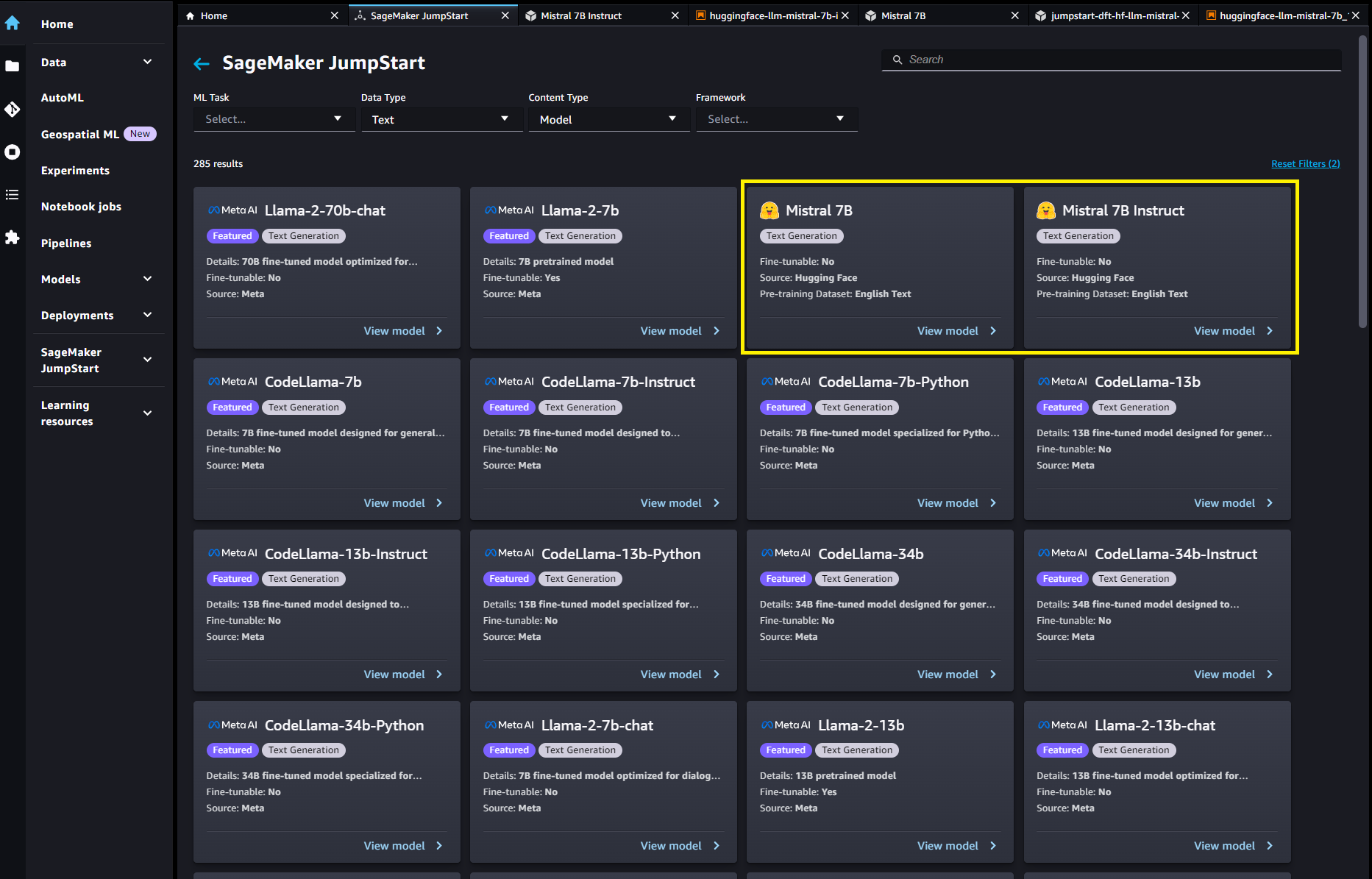

Fra SageMaker JumpStart-landingssiden kan du søke etter løsninger, modeller, notatbøker og andre ressurser. Du finner Mistral 7B i Grunnmodeller: Tekstgenerering karusell.

Du kan også finne andre modellvarianter ved å velge Utforsk alle tekstmodeller eller søker etter «Mistral».

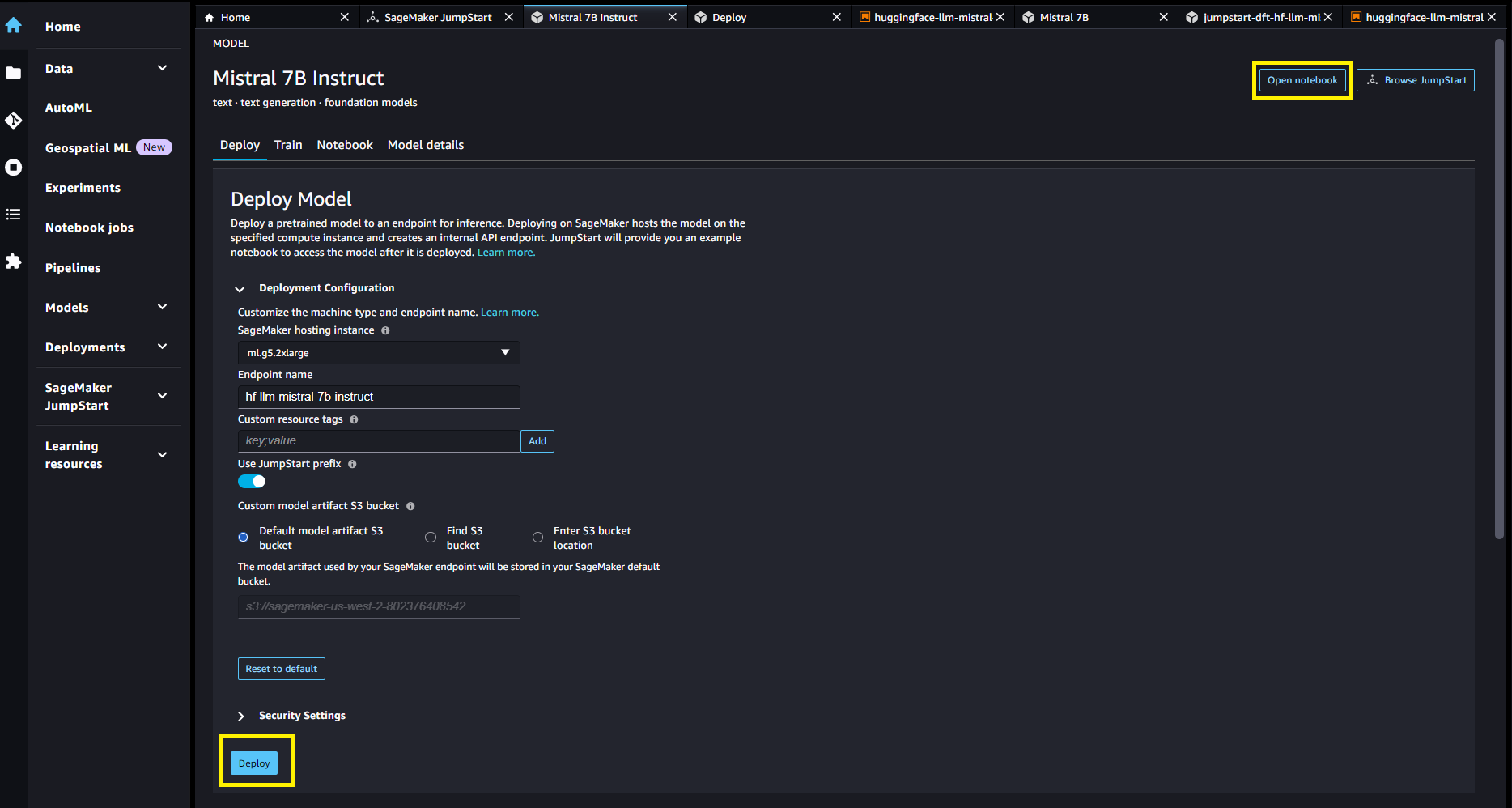

Du kan velge modellkortet for å se detaljer om modellen, for eksempel lisens, data som brukes til å trene, og hvordan du bruker den. Du finner også to knapper, Distribuer og Åpne notatboken, som vil hjelpe deg å bruke modellen (følgende skjermbilde viser Distribuer alternativ).

Implementere modeller

Implementeringen starter når du velger det Distribuer. Alternativt kan du distribuere gjennom eksempelnotisboken som dukker opp når du velger Åpne notatboken. Eksempelnotisboken gir ende-til-ende veiledning om hvordan du kan distribuere modellen for slutninger og rydde opp i ressurser.

For å distribuere ved hjelp av en bærbar PC, starter vi med å velge Mistral 7B-modellen, spesifisert av model_id. Du kan distribuere hvilken som helst av de valgte modellene på SageMaker med følgende kode:

Dette distribuerer modellen på SageMaker med standardkonfigurasjoner, inkludert standard forekomsttype (ml.g5.2xlarge) og standard VPC-konfigurasjoner. Du kan endre disse konfigurasjonene ved å angi ikke-standardverdier i JumpStartModel. Etter at det er distribuert, kan du kjøre slutninger mot det distribuerte endepunktet gjennom SageMaker-prediktoren:

Optimalisering av distribusjonskonfigurasjonen

Mistral-modeller bruker Text Generation Inference (TGI versjon 1.1) modellservering. Når du distribuerer modeller med TGI deep learning container (DLC), kan du konfigurere en rekke lanseringsargumenter via miljøvariabler når du distribuerer endepunktet ditt. For å støtte kontekstlengden på 8,000 tokener til Mistral 7B-modeller, har SageMaker JumpStart konfigurert noen av disse parameterne som standard: vi angir MAX_INPUT_LENGTH og MAX_TOTAL_TOKENS til henholdsvis 8191 og 8192. Du kan se hele listen ved å inspisere modellobjektet ditt:

Som standard klemmer ikke SageMaker JumpStart samtidige brukere via miljøvariabelen MAX_CONCURRENT_REQUESTS mindre enn TGI-standardverdien på 128. Årsaken er fordi noen brukere kan ha typiske arbeidsbelastninger med små nyttelastkontekstlengder og ønsker høy samtidighet. Merk at SageMaker TGI DLC støtter flere samtidige brukere gjennom rullende batch. Når du distribuerer endepunktet for applikasjonen din, kan du vurdere om du bør klemme MAX_TOTAL_TOKENS or MAX_CONCURRENT_REQUESTS før distribusjon for å gi best mulig ytelse for arbeidsmengden din:

Her viser vi hvordan modellytelsen kan variere for din typiske endepunktarbeidsbelastning. I de følgende tabellene kan du observere at små spørringer (128 inputord og 128 output tokens) er ganske effektive under et stort antall samtidige brukere, og når token-gjennomstrømning i størrelsesorden 1,000 tokens per sekund. Imidlertid, ettersom antall inngangsord øker til 512 inngangsord, metter endepunktet sin batchkapasitet – antallet samtidige forespørsler som tillates behandlet samtidig – noe som resulterer i et gjennomstrømningsplatå og betydelige latensdegraderinger som starter rundt 16 samtidige brukere. Til slutt, når du spør etter endepunktet med store inndatakontekster (for eksempel 6,400 ord) samtidig av flere samtidige brukere, oppstår dette gjennomstrømningsplatået relativt raskt, til det punktet hvor SageMaker-kontoen din vil begynne å møte 60-sekunders tidsavbruddsgrenser for dine overbelastede forespørsler .

| . | gjennomstrømning (tokens/s) | ||||||||||

| samtidige brukere | 1 | 2 | 4 | 8 | 16 | 32 | 64 | 128 | |||

| modell | instanstype | input ord | utdata-tokens | . | |||||||

| mistral-7b-instruks | ml.g5.2xlarge | 128 | 128 | 30 | 54 | 89 | 166 | 287 | 499 | 793 | 1030 |

| 512 | 128 | 29 | 50 | 80 | 140 | 210 | 315 | 383 | 458 | ||

| 6400 | 128 | 17 | 25 | 30 | 35 | - | - | - | - | ||

| . | p50-forsinkelse (ms/token) | ||||||||||

| samtidige brukere | 1 | 2 | 4 | 8 | 16 | 32 | 64 | 128 | |||

| modell | instanstype | input ord | utdata-tokens | . | |||||||

| mistral-7b-instruks | ml.g5.2xlarge | 128 | 128 | 32 | 33 | 34 | 36 | 41 | 46 | 59 | 88 |

| 512 | 128 | 34 | 36 | 39 | 43 | 54 | 71 | 112 | 213 | ||

| 6400 | 128 | 57 | 71 | 98 | 154 | - | - | - | - | ||

Inferens- og eksempeloppfordringer

Mistral 7B

Du kan samhandle med en base Mistral 7B-modell som en hvilken som helst standard tekstgenereringsmodell, der modellen behandler en inngangssekvens og sender ut forutsagte neste ord i sekvensen. Følgende er et enkelt eksempel med multi-shot læring, der modellen er utstyrt med flere eksempler og den siste eksempelresponsen genereres med kontekstuell kunnskap om disse tidligere eksemplene:

Mistral 7B instruerer

Den instruksjonstilpassede versjonen av Mistral godtar formaterte instruksjoner der samtaleroller må starte med en brukerforespørsel og veksle mellom bruker og assistent. En enkel brukerforespørsel kan se slik ut:

En forespørsel om flere svinger vil se slik ut:

Dette mønsteret gjentas uansett hvor mange svinger det er i samtalen.

I de følgende avsnittene utforsker vi noen eksempler ved bruk av Mistral 7B Instruct-modellen.

Kunnskapsinnhenting

Følgende er et eksempel på kunnskapsinnhenting:

Svar på spørsmål i stor kontekst

For å demonstrere hvordan du bruker denne modellen for å støtte store inndatakontekstlengder, inneholder følgende eksempel en passasje med tittelen "Rats" av Robert Sullivan (referanse), fra MCAS Grade 10 English Language Arts Reading Comprehension-testen inn i input-prompt-instruksjonen og stiller modellen et rettet spørsmål om teksten:

Matematikk og resonnement

Mistral-modellene rapporterer også styrker i matematikk-nøyaktighet. Mistral kan gi forståelse som følgende matematiske logikk:

Koding

Følgende er et eksempel på en kodeord:

Rydd opp

Når du er ferdig med å kjøre notatboken, sørg for å slette alle ressursene du opprettet i prosessen slik at faktureringen stoppes. Bruk følgende kode:

konklusjonen

I dette innlegget viste vi deg hvordan du kommer i gang med Mistral 7B i SageMaker Studio og distribuerer modellen for slutning. Fordi grunnmodeller er forhåndsopplært, kan de bidra til å redusere opplærings- og infrastrukturkostnadene og muliggjøre tilpasning for ditt bruksområde. Besøk Amazon SageMaker JumpStart nå for å komme i gang.

Ressurser

Om forfatterne

Dr. Kyle Ulrich er en Applied Scientist med Amazon SageMaker JumpStart-teamet. Hans forskningsinteresser inkluderer skalerbare maskinlæringsalgoritmer, datasyn, tidsserier, Bayesianske ikke-parametriske og Gaussiske prosesser. Hans doktorgrad er fra Duke University og han har publisert artikler i NeurIPS, Cell og Neuron.

Dr. Kyle Ulrich er en Applied Scientist med Amazon SageMaker JumpStart-teamet. Hans forskningsinteresser inkluderer skalerbare maskinlæringsalgoritmer, datasyn, tidsserier, Bayesianske ikke-parametriske og Gaussiske prosesser. Hans doktorgrad er fra Duke University og han har publisert artikler i NeurIPS, Cell og Neuron.

Dr. Ashish Khetan er en Senior Applied Scientist med Amazon SageMaker JumpStart og hjelper til med å utvikle maskinlæringsalgoritmer. Han fikk sin doktorgrad fra University of Illinois Urbana-Champaign. Han er en aktiv forsker innen maskinlæring og statistisk inferens, og har publisert mange artikler på NeurIPS, ICML, ICLR, JMLR, ACL og EMNLP-konferanser.

Dr. Ashish Khetan er en Senior Applied Scientist med Amazon SageMaker JumpStart og hjelper til med å utvikle maskinlæringsalgoritmer. Han fikk sin doktorgrad fra University of Illinois Urbana-Champaign. Han er en aktiv forsker innen maskinlæring og statistisk inferens, og har publisert mange artikler på NeurIPS, ICML, ICLR, JMLR, ACL og EMNLP-konferanser.

Vivek Singh er produktsjef hos Amazon SageMaker JumpStart. Han fokuserer på å gjøre det mulig for kunder å ta med SageMaker JumpStart for å forenkle og akselerere deres ML-reise for å bygge generative AI-applikasjoner.

Vivek Singh er produktsjef hos Amazon SageMaker JumpStart. Han fokuserer på å gjøre det mulig for kunder å ta med SageMaker JumpStart for å forenkle og akselerere deres ML-reise for å bygge generative AI-applikasjoner.

Roy Allela er senior AI/ML spesialistløsningsarkitekt ved AWS med base i München, Tyskland. Roy hjelper AWS-kunder – fra små startups til store bedrifter – med å trene og distribuere store språkmodeller effektivt på AWS. Roy er lidenskapelig opptatt av problemer med beregningsoptimalisering og forbedring av ytelsen til AI-arbeidsbelastninger.

Roy Allela er senior AI/ML spesialistløsningsarkitekt ved AWS med base i München, Tyskland. Roy hjelper AWS-kunder – fra små startups til store bedrifter – med å trene og distribuere store språkmodeller effektivt på AWS. Roy er lidenskapelig opptatt av problemer med beregningsoptimalisering og forbedring av ytelsen til AI-arbeidsbelastninger.

- SEO-drevet innhold og PR-distribusjon. Bli forsterket i dag.

- PlatoData.Network Vertical Generative Ai. Styrk deg selv. Tilgang her.

- PlatoAiStream. Web3 Intelligence. Kunnskap forsterket. Tilgang her.

- PlatoESG. Karbon, CleanTech, Energi, Miljø, Solenergi, Avfallshåndtering. Tilgang her.

- PlatoHelse. Bioteknologisk og klinisk etterretning. Tilgang her.

- kilde: https://aws.amazon.com/blogs/machine-learning/mistral-7b-foundation-models-from-mistral-ai-are-now-available-in-amazon-sagemaker-jumpstart/

- : har

- :er

- :ikke

- :hvor

- $OPP

- 000

- 1

- 10

- 100

- 12

- 14

- 150

- 16

- 25

- 26%

- 30

- 400

- 50

- 7

- 8

- 9

- a

- evner

- Om oss

- akselerere

- godtar

- adgang

- Ifølge

- Logg inn

- nøyaktighet

- Oppnå

- aktiv

- tillegg

- Voksen

- Etter

- mot

- alder

- AI

- AI / ML

- algoritmer

- Alle

- tillatt

- nesten

- langs

- sammen

- også

- alternativer

- alltid

- Amazon

- Amazon SageMaker

- Amazon SageMaker JumpStart

- Amazon Web Services

- america

- beløp

- beløp

- an

- og

- og infrastruktur

- Angeles

- Kunngjøre

- En annen

- besvare

- noen

- noen

- hvor som helst

- hverandre

- Leilighetene

- Søknad

- søknader

- anvendt

- ca

- arkitektur

- ER

- rundt

- Artikkel

- Arts

- AS

- Assistent

- assosiert

- At

- forsøk

- delta

- oppmerksomhet

- tiltrakk

- attraktiv

- forfatter

- Automatisert

- tilgjengelig

- gjennomsnittlig

- klar

- borte

- AWS

- tilbake

- poser

- basen

- basert

- bash

- batterier

- batteri

- Bayesiansk

- BE

- fordi

- vært

- før du

- bak

- være

- under

- BEST

- mellom

- Beyond

- Bill

- fakturering

- Milliarder

- Svart

- boarding

- Bolt

- bok

- både

- kjøpt

- pauser

- BRO

- Brooklyn

- brun

- bygge

- Bygning

- men

- Kjøpe

- by

- som heter

- kom

- CAN

- bil

- kort

- karusellen

- saken

- saker

- forårsaket

- viss

- endring

- kanaler

- Velg

- velge

- Byer

- City

- klemme

- klassifisering

- klikk

- klatre

- Lukke

- Coast

- kyst

- kode

- Koding

- Kollapse

- skurtreskerne

- Kom

- Felles

- sammenlign

- sammenlignet

- ferdigstillelse

- beregnings

- datamaskin

- Datamaskin syn

- samtidig

- konferanser

- konfigurert

- forvirret

- Vurder

- Container

- inneholder

- kontekst

- sammenhenger

- kontekstuelle

- kontroll

- kontroller

- Samtale

- Kobber

- hjørner

- Kostnad

- Kostnader

- land

- dekke

- dekket

- skape

- opprettet

- Gjeldende

- Kunder

- tilpasning

- tilpasse

- tilpasset

- mørk

- dato

- datasikkerhet

- datasett

- dag

- Dager

- dedikert

- dyp

- dyp læring

- Deer

- Misligholde

- demonstrere

- demonstrerer

- utplassere

- utplassert

- utplasserings

- distribusjon

- Distribueres

- depresjon

- detaljer

- utvikle

- utviklet

- Utvikling

- gJORDE

- avvike

- forskjellig

- DIG

- regissert

- kataloger

- skitt

- oppdage

- forstyrrelser

- do

- doe

- ikke

- dollar

- gjort

- ikke

- ned

- to

- Duke

- duke universitetet

- hver enkelt

- jord

- lett

- lett

- spise

- effektivt

- enten

- nødsituasjon

- understreke

- muliggjøre

- muliggjør

- støte på

- ende til ende

- Endpoint

- England

- Engelsk

- sikre

- Enter

- Hele

- Miljø

- utstyrt

- spesielt

- anslag

- Selv

- Hver

- overalt

- eksempel

- eksempler

- utmerket

- opphisset

- Eksklusiv

- Utgang

- Expert

- Forklar

- utforske

- forlengelse

- øyne

- Faktisk

- raskere

- Egenskaper

- fôring

- Feet

- Noen få

- Figur

- Filer

- slutt~~POS=TRUNC

- Endelig

- Finn

- Først

- fokuserer

- etter

- mat

- Fot

- Til

- skog

- funnet

- Fundament

- fire

- fra

- foran

- fullt

- fikk

- GAS

- generert

- generasjonen

- generative

- Generativ AI

- Tyskland

- få

- Go

- fikk

- klasse

- grå

- Gruppe

- Grow

- Økende

- Vokser

- veiledning

- HAD

- håndtere

- Ha

- he

- hode

- hjelpe

- hjelpe

- hjelper

- derav

- heri

- Høy

- hans

- Hole

- Holes

- hus

- Hvordan

- Hvordan

- Men

- HTML

- HTTPS

- Hub

- menneskelig

- hundre

- i

- ICE

- iskrem

- ideell

- if

- Illinois

- importere

- bedre

- in

- inkludere

- Inkludert

- Øke

- øker

- Infrastruktur

- inngang

- innganger

- f.eks

- instruksjoner

- integrert

- samhandle

- interesser

- Interface

- inn

- isolert

- IT

- DET ER

- kjever

- reise

- jpg

- kids

- Drepe

- Type

- kunnskap

- kjent

- Kyle

- laboratorium

- innsjøer

- landing

- Språk

- stor

- større

- Siste

- Ventetid

- lag

- føre

- ledende

- lekke

- Lekkasjer

- LÆRE

- læring

- Lengde

- la

- Tillatelse

- lett

- lett

- Lyn

- i likhet med

- Sannsynlig

- BEGRENSE

- grenser

- foret

- LINK

- Liste

- lite

- leve

- Bor

- ll

- logikk

- Lang

- lenger

- Se

- ser ut som

- den

- Los Angeles

- Lav

- lavere

- maskin

- maskinlæring

- laget

- gjøre

- GJØR AT

- leder

- håndbok

- mange

- Mass

- math

- matematikk

- Kan..

- Minne

- nevnt

- kunne

- millioner

- mindre

- minutt

- ML

- MLOps

- modell

- modeller

- Moderne

- modifisert

- penger

- Måned

- mer

- mest

- mye

- flere

- musikk

- må

- my

- navn

- navn

- smal

- Naturlig

- Nær

- negativ

- Nest

- hekkende

- nettverk

- nettverk

- Nøytral

- Ny

- New York

- New York City

- Aviser

- neste

- natt

- Nei.

- none

- nese

- bærbare

- nå

- Antall

- objekt

- observere

- of

- ofte

- Gammel

- on

- Ombord

- gang

- ONE

- bare

- videre til

- åpner

- optimalisering

- Alternativ

- or

- rekkefølge

- opprinnelse

- Annen

- ellers

- ut

- produksjon

- utganger

- enn

- side

- betalt

- palm

- papirer

- parametere

- del

- passasje

- lidenskapelig

- Past

- Mønster

- PAWS

- Ansatte

- for

- oppfattet

- prosent

- Utfør

- ytelse

- phd

- telefon

- plukket

- steder

- Hvordan få de til å trives

- plast

- plato

- Platon Data Intelligence

- PlatonData

- Point

- giften

- dårlig

- positiv

- Post

- pund

- spådd

- Predictor

- forbereder

- press

- forrige

- Før

- problemer

- prosess

- Bearbeidet

- Prosesser

- Produkt

- Produktsjef

- gi

- forutsatt

- gir

- gi

- offentlig

- publisert

- rent

- formål

- presset

- sette

- Python

- kvalitet

- spørsmål

- spørsmål

- raskt

- ganske

- skinner

- ROTTE

- Sats

- nå

- Lesning

- grunnen til

- referere

- relativt

- utgitt

- rapporterer

- Rapporter

- forespørsler

- Krav

- forskning

- forsker

- Ressurser

- henholdsvis

- svar

- restauranter

- restriksjoner

- Retreat

- ikke sant

- ROBERT

- Rolle

- roller

- rullende

- roy

- Kjør

- rennende

- s

- trygt

- Sikkerhet

- sagemaker

- så

- skalerbar

- Forsker

- forskere

- SDK

- Søk

- søker

- Sekund

- Seksjon

- seksjoner

- sikre

- sikkerhet

- synes

- valgt

- velge

- senior

- forstand

- sentiment

- Sequence

- Serien

- Tjenester

- servering

- sett

- syv

- flere

- skarpe

- skinner

- Shopping

- bør

- Vis

- viste

- Viser

- side

- signifikant

- Enkelt

- forenkle

- samtidig

- siden

- enkelt

- sitte

- Sittende

- Størrelse

- Skin

- liten

- mindre

- Snap

- So

- Soft

- utelukkende

- Solutions

- noen

- noen ganger

- Southern

- Rom

- spesialist

- spesifisert

- fart

- spre

- vår

- kvadrat

- firkanter

- Klemme

- stablet

- Standard

- Begynn

- startet

- Start

- starter

- startups

- uttalte

- Stater

- Stasjoner

- statistisk

- opphold

- Steps

- Still

- stoppet

- butikker

- bekker

- gate

- styrker

- sterk

- sterkere

- struktur

- studier

- studio

- Studer

- emne

- slik

- Sullivan

- levere

- støtte

- Støtte

- Støtter

- sikker

- overleve

- system

- smak

- lag

- vilkår

- test

- tekst

- enn

- Det

- De

- Vesten

- verden

- deres

- Dem

- seg

- deretter

- Der.

- derfor

- Disse

- de

- tror

- denne

- De

- selv om?

- tusen

- tusener

- tre

- Gjennom

- gjennomstrømning

- tid

- Tidsserier

- tittelen

- til

- token

- tokens

- verktøy

- Totalt

- byen

- Tog

- Kurs

- Togene

- transformator

- feller

- reiser

- Trær

- prøve

- tunnel

- snur

- tweet

- to

- typen

- typisk

- typisk

- ui

- etter

- universitet

- ukjent

- bruke

- bruk sak

- brukt

- Bruker

- Brukere

- bruker

- ved hjelp av

- verktøyet

- verdi

- Verdier

- variabel

- variasjon

- ulike

- Ve

- kjøretøy

- Kjøretøy

- versjon

- veldig

- av

- video

- Se

- syn

- Besøk

- venter

- gå

- ønsker

- var

- Avfall

- Vann

- Vei..

- måter

- we

- web

- webtjenester

- Web-basert

- VI VIL

- var

- Vest

- Hva

- Hva er

- når

- om

- hvilken

- mens

- hvit

- bred

- bredde

- Wild

- vil

- vindu

- med

- innenfor

- uten

- ord

- arbeidere

- verden

- ville

- år

- york

- Du

- Din

- zephyrnet