Forskere har avdekket over 100 ondsinnede maskinlæringsmodeller (ML) på Hugging Face AI-plattformen som kan gjøre det mulig for angripere å injisere ondsinnet kode på brukermaskiner.

Selv om Hugging Face implementerer sikkerhetstiltak, fremhever funnene den økende risikoen for å "våpengjøre" offentlig tilgjengelige modeller ettersom de kan skape en bakdør for angripere.

Funnene fra JFrog Security Research er en del av en pågående studie for å analysere hvordan hackere kan bruke ML til å angripe brukere.

Skadelig innhold

Ifølge en artikkel av Databehandling, utviklet forskerne et avansert skanningssystem for å granske modeller på Hugging Face AI-plattformen, som PyTorch og Tensorflow Keras.

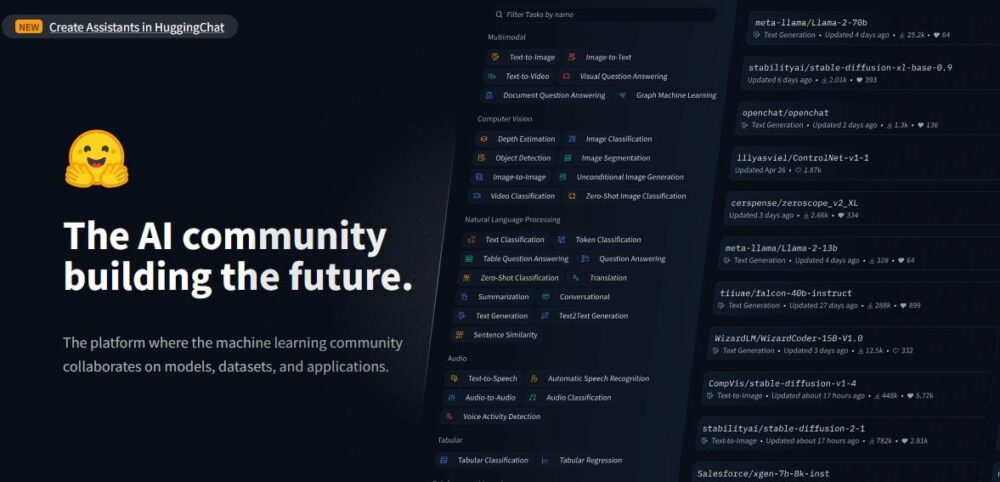

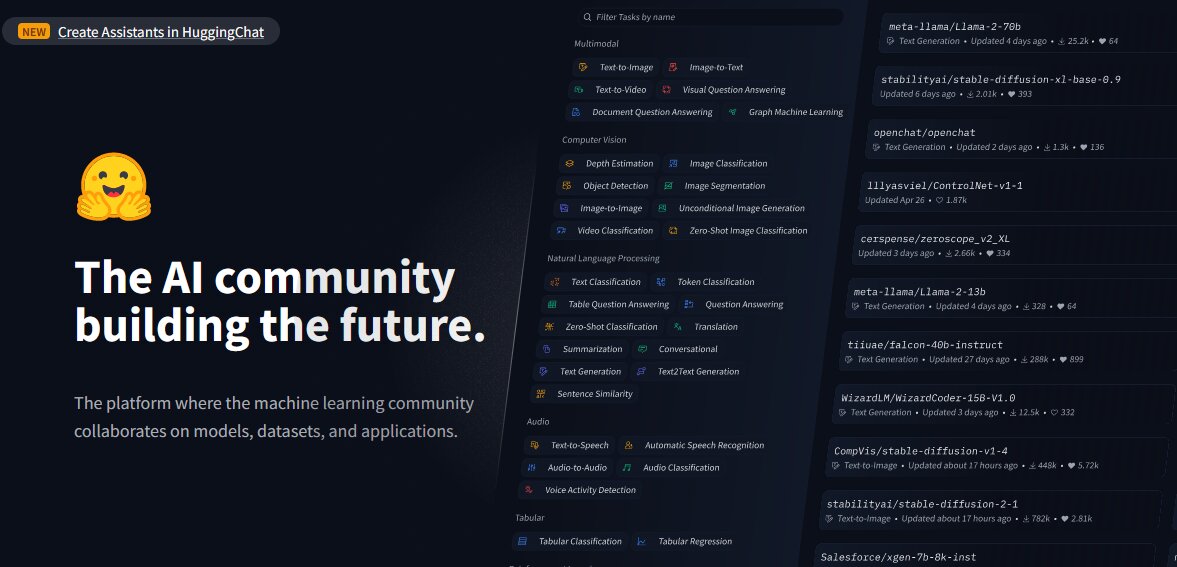

Hugging Face er en plattform utviklet for å dele AI-modeller, datasett og applikasjoner. Etter å ha analysert modellene oppdaget forskerne skadelige nyttelaster «innenfor tilsynelatende ufarlige modeller».

Dette til tross for at Hugging Face utfører sikkerhetstiltak som malware og pickle-skanning. Plattformen begrenser imidlertid ikke nedlastingen av modeller som kan være potensielt skadelige og muliggjør også offentlig tilgjengelig AI-modeller å bli misbrukt og bevæpnet av brukere.

Ved å undersøke plattformen og de eksisterende modellene, oppdaget JFrogs sikkerhetsforskere rundt 100 AI-modeller med ondsinnet funksjonalitet, ifølge deres rapporterer.

Noen av disse modellene, indikerer rapporten, er i stand til å utføre kode på brukernes maskiner, "og dermed skape en vedvarende bakdør for angripere."

Forskerne indikerte også at slike funn utelukker falske positive. Disse, sa de, er en nøyaktig representasjon av utbredelsen av ondsinnede modeller på plattformen.

Les også: Apple omdirigerer bilteamet til AI Post-EV Market Slowdown

Eksemplene

I følge JFrogs rapport involverer en av de "alarmerende" sakene en PyTorch modell. Modellen ble angivelig lastet opp av en bruker identifisert som "baller423", som senere ble slettet fra Hugging Face-plattformen.

Etter å ha gransket modellen videre, la forskerne merke til at den inneholdt en ondsinnet nyttelast, som gjorde det mulig for den å etablere et omvendt skall på en spesifisert vert (210.117.212.93).

JFrog senior sikkerhetsforsker David Cohen sa: "(Det) er spesielt mer påtrengende og potensielt ondsinnet, ettersom det etablerer en direkte tilkobling til en ekstern server, noe som indikerer en potensiell sikkerhetstrussel i stedet for bare en demonstrasjon av sårbarhet," skrev han.

Dette utnytter "Pythons pickle-moduls '_reduce_'-metode for å utføre vilkårlig kode ved lasting av modellfilen, og effektivt omgå konvensjonelle deteksjonsmetoder."

Forskerne erkjente også at den samme nyttelasten skapte tilkoblinger til forskjellige IP-adresser, "som tyder på at operatører kan være forskere i stedet for ondsinnede hackere."

En vekker

JFrog-teamet bemerket at funnene er en vekker for Hugging Face, som viser at plattformen er utsatt for manipulasjon og potensielle trusler.

"Disse hendelsene tjener som gripende påminnelser om de pågående truslene som Hugging Face-depoter og andre populære depoter står overfor, som Kaggle, som potensielt kan kompromittere personvernet og sikkerheten til organisasjoner som bruker disse ressursene, i tillegg til å utgjøre utfordringer for AI/ML-ingeniører," sa forskerne.

Dette kommer som trusler om nettsikkerhet verden over øker, drevet av spredningen av AI-verktøy, med dårlige skuespillere som misbruker dem for ondsinnede hensikter. Hackere bruker også AI for å fremme phishing-angrep og lure folk.

JFrog-teamet gjorde imidlertid andre funn.

En lekeplass for forskere

Forskerne bemerket også det Klemme ansiktet har utviklet seg til en lekeplass for forskere "som ønsker å bekjempe nye trusler, som demonstrert av det mangfoldige utvalget av taktikker for å omgå sikkerhetstiltakene."

For eksempel initierte nyttelasten lastet opp av "baller423" en omvendt skallforbindelse til et IP-adresseområde som tilhører Kreonet (Korea Research Environment Open Network).

Ifølge Mørk lesning, Kreonet er et høyhastighetsnettverk i Sør-Korea som støtter avansert forskning og utdanningsaktiviteter; "Derfor er det mulig at AI-forskere eller -utøvere kan ha stått bak modellen."

"Vi kan se at de fleste 'ondsinnede' nyttelastene faktisk er forsøk fra forskere og/eller bug-bounty for å få kodekjøring for tilsynelatende legitime formål," sa Cohen.

Til tross for de legitime formålene, advarte JFrog-teamet imidlertid om at strategiene brukt av forskere tydelig viser at plattformer som Hugging Face er åpne for forsyningskjedeangrep. Disse, ifølge teamet, kan tilpasses for å fokusere på spesifikk demografi, som AI- eller ML-ingeniører.

- SEO-drevet innhold og PR-distribusjon. Bli forsterket i dag.

- PlatoData.Network Vertical Generative Ai. Styrk deg selv. Tilgang her.

- PlatoAiStream. Web3 Intelligence. Kunnskap forsterket. Tilgang her.

- PlatoESG. Karbon, CleanTech, Energi, Miljø, Solenergi, Avfallshåndtering. Tilgang her.

- PlatoHelse. Bioteknologisk og klinisk etterretning. Tilgang her.

- kilde: https://metanews.com/over-100-malicious-code-execution-models-on-hugging-face-backdoors-users-devices/

- : har

- :er

- :ikke

- 100

- 210

- 212

- 7

- 9

- a

- Om oss

- Ifølge

- nøyaktig

- Aktiviteter

- aktører

- faktisk

- tillegg

- adresse

- adresser

- avansere

- avansert

- AI

- AI-modeller

- AI-plattform

- AI / ML

- også

- an

- analysere

- analyserer

- og

- søknader

- vilkårlig

- ER

- Array

- Artikkel

- AS

- angripe

- Angrep

- forsøk

- tilgjengelig

- backdoor

- dårlig

- BE

- vært

- bak

- tilhører

- skuddpremie

- Bug

- bug bounty

- by

- bypass

- ring

- CAN

- stand

- bil

- saker

- utfordringer

- klart

- CO

- kode

- Cohen

- bekjempe

- kommer

- kompromiss

- databehandling

- tilkobling

- Tilkoblinger

- inneholdt

- konvensjonell

- kunne

- skape

- Opprette

- tilpasset

- datasett

- David

- Demografi

- demonstrere

- demonstrert

- Til tross for

- Gjenkjenning

- utviklet

- forskjellig

- direkte

- oppdaget

- diverse

- gjør

- nedlasting

- pedagogisk

- effektivt

- Emery

- ansatt

- muliggjøre

- muliggjør

- muliggjør

- Ingeniører

- Miljø

- etablere

- etablerer

- utviklet seg

- undersøke

- henrette

- utførende

- gjennomføring

- eksisterende

- utvendig

- Face

- vendt

- Faktisk

- falsk

- filet

- funn

- Fokus

- Til

- skjema

- fra

- drevet

- funksjonalitet

- videre

- få

- Økende

- hackere

- skadelig

- Ha

- he

- Høy

- Uthev

- vert

- vert

- Hvordan

- Men

- HTTPS

- identifisert

- redskaper

- in

- Øke

- indikert

- indikerer

- indikerer

- initiert

- injisere

- f.eks

- intensjoner

- inn

- intrusively

- innebærer

- IP

- IP-adresse

- IP-adresser

- IT

- DET ER

- jpg

- hard

- korea

- læring

- legitim

- utnytter

- i likhet med

- lasting

- maskin

- maskinlæring

- maskiner

- laget

- skadelig

- malware

- Manipulasjon

- marked

- max bredde

- Kan..

- målinger

- bare

- metode

- metoder

- ML

- modell

- modeller

- mer

- mest

- nettverk

- spesielt

- bemerket

- of

- on

- ONE

- pågående

- videre til

- åpen

- åpent nettverk

- operatører

- or

- organisasjoner

- Annen

- ut

- enn

- del

- Ansatte

- phishing

- phishing-angrep

- plattform

- Plattformer

- plato

- Platon Data Intelligence

- PlatonData

- lekeplass

- Populær

- mulig

- potensiell

- potensielt

- utbredelse

- privatliv

- Personvern og sikkerhet

- offentlig

- formål

- pytorch

- område

- heller

- Lese

- gjenkjent

- rapporterer

- velig

- representasjon

- forskning

- forsker

- forskere

- Ressurser

- begrense

- reversere

- Risiko

- Sa

- samme

- skanning

- sikkerhet

- Sikkerhetstiltak

- se

- tilsynelatende

- senior

- betjene

- server

- deling

- Shell

- viser

- Sør

- Sør-Korea

- spesifikk

- spesifisert

- strategier

- Studer

- I ettertid

- slik

- Støtte

- system

- taktikk

- lag

- tensorflow

- enn

- Det

- De

- deres

- Dem

- Disse

- de

- trussel

- trusler

- til

- verktøy

- trick

- lastet opp

- upon

- bruke

- Bruker

- Brukere

- ved hjelp av

- utnytte

- sårbarhet

- advarte

- var

- hvilken

- ønske

- med

- verden

- skrev

- zephyrnet