Å lage skalerbare og effektive pipelines for maskinlæring (ML) er avgjørende for å strømlinjeforme utvikling, distribusjon og administrasjon av ML-modeller. I dette innlegget presenterer vi et rammeverk for å automatisere opprettelsen av en rettet asyklisk graf (DAG) for Amazon SageMaker-rørledninger basert på enkle konfigurasjonsfiler. De rammekode og eksempler presentert her dekker bare modelltreningsrørledninger, men kan også lett utvides til batch-inferensrørledninger.

Dette dynamiske rammeverket bruker konfigurasjonsfiler til å orkestrere forbehandlings-, opplærings-, evaluerings- og registreringstrinn for både enkeltmodell- og multimodellbrukstilfeller basert på brukerdefinerte Python-skript, infrastrukturbehov (inkludert Amazon Virtual Private Cloud (Amazon VPC) undernett og sikkerhetsgrupper, AWS identitets- og tilgangsadministrasjon (IAM) roller, AWS nøkkelstyringstjeneste (AWS KMS)-nøkler, containerregister og forekomsttyper), input og output Amazon enkel lagringstjeneste (Amazon S3) stier og ressurskoder. Konfigurasjonsfiler (YAML og JSON) lar ML-utøvere spesifisere udifferensiert kode for orkestrering av treningspipelines ved å bruke deklarativ syntaks. Dette gjør det mulig for dataforskere å raskt bygge og iterere på ML-modeller, og gir ML-ingeniører mulighet til å kjøre gjennom kontinuerlig integrasjon og kontinuerlig levering (CI/CD) ML-rørledninger raskere, noe som reduserer tiden til produksjon for modeller.

Løsningsoversikt

Den foreslåtte rammekoden starter med å lese konfigurasjonsfilene. Deretter oppretter den dynamisk en SageMaker Pipelines DAG basert på trinnene som er deklarert i konfigurasjonsfilene og interaksjonene og avhengighetene mellom trinnene. Dette orkestreringsrammeverket imøtekommer både enkeltmodeller og flermodeller, og gir en jevn flyt av data og prosesser. Følgende er de viktigste fordelene med denne løsningen:

- Automatisering – Hele ML-arbeidsflyten, fra dataforbehandling til modellregister, er orkestrert uten manuell intervensjon. Dette reduserer tiden og innsatsen som kreves for modelleksperimentering og operasjonalisering.

- reproduserbarhet – Med en forhåndsdefinert konfigurasjonsfil kan dataforskere og ML-ingeniører reprodusere hele arbeidsflyten, og oppnå konsistente resultater på tvers av flere kjøringer og miljøer.

- skalerbarhet - Amazon SageMaker brukes gjennom hele pipelinen, og gjør det mulig for ML-utøvere å behandle store datasett og trene komplekse modeller uten infrastrukturproblemer.

- fleksibilitet – Rammeverket er fleksibelt og kan romme et bredt spekter av ML-brukstilfeller, ML-rammeverk (som XGBoost og TensorFlow), flermodelltrening og flertrinnsopplæring. Hvert trinn i opplærings-DAG kan tilpasses via konfigurasjonsfilen.

- Modellstyring - Det Amazon SageMaker modellregister integrering gjør det mulig å spore modellversjoner, og derfor fremme dem til produksjon med tillit.

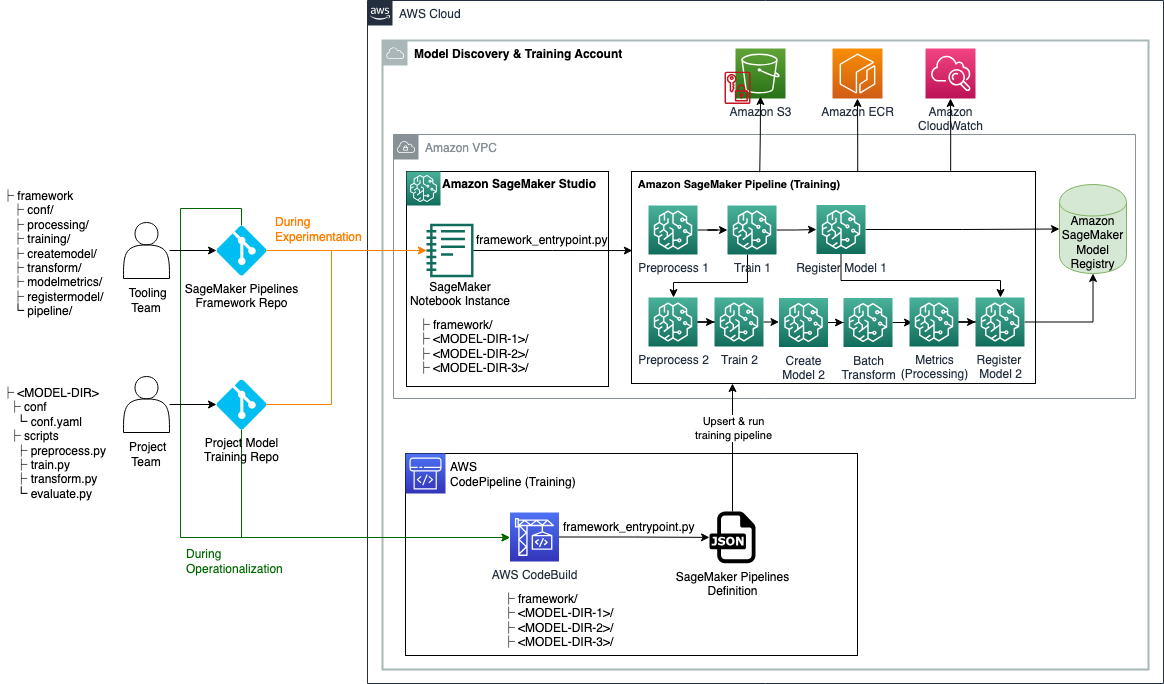

Følgende arkitekturdiagram viser hvordan du kan bruke det foreslåtte rammeverket under både eksperimentering og operasjonalisering av ML-modeller. Under eksperimentering kan du klone rammekodelageret som er gitt i dette innlegget og dine prosjektspesifikke kildekodelagre til Amazon SageMaker Studio, og angi det virtuelle miljøet ditt (detaljert senere i dette innlegget). Du kan deretter iterere på forhåndsbehandling, opplæring og evalueringsskript, samt konfigurasjonsvalg. For å opprette og kjøre en SageMaker Pipelines trenings-DAG, kan du ringe rammeverkets inngangspunkt, som vil lese alle konfigurasjonsfilene, opprette de nødvendige trinnene og orkestrere dem basert på den angitte trinnrekkefølgen og avhengighetene.

Under operasjonaliseringen kloner CI-rørledningen rammekodelageret og prosjektspesifikke treningsrepositorier til et AWS CodeBuild jobb, der rammeverkets inngangspunktskript kalles for å opprette eller oppdatere SageMaker Pipelines-trenings-DAG, og deretter kjøre den.

Depotstruktur

De GitHub repository inneholder følgende kataloger og filer:

- /framework/conf/ – Denne katalogen inneholder en konfigurasjonsfil som brukes til å angi vanlige variabler på tvers av alle modelleringsenheter som undernett, sikkerhetsgrupper og IAM-rolle under kjøring. En modelleringsenhet er en sekvens på opptil seks trinn for å trene en ML-modell.

- /framework/createmodel/ – Denne katalogen inneholder et Python-skript som lager en SageMaker modell objekt basert på modellartefakter fra en SageMaker Pipelines treningstrinn. Modellobjektet brukes senere i en SageMaker batch-transformasjon jobb for å evaluere modellytelse på et testsett.

- /framework/modelmetrics/ – Denne katalogen inneholder et Python-skript som lager en Amazon SageMaker-prosessering jobb for å generere en modellberegning JSON-rapport for en opplært modell basert på resultatene av en SageMaker batch-transformeringsjobb utført på testdata.

- /framework/pipeline/ – Denne katalogen inneholder Python-skript som bruker Python-klasser definert i andre rammeverkskataloger for å opprette eller oppdatere en SageMaker Pipelines DAG basert på de spesifiserte konfigurasjonene. Model_unit.py-skriptet brukes av pipeline_service.py for å lage en eller flere modelleringsenheter. Hver modelleringsenhet er en sekvens på opptil seks trinn for opplæring av en ML-modell: prosess, tren, lag modell, transformasjon, metrikk og registermodell. Konfigurasjoner for hver modelleringsenhet bør spesifiseres i modellens respektive depot. Pipeline_service.py setter også avhengigheter mellom SageMaker Pipelines-trinn (hvordan trinn innenfor og på tvers av modelleringsenheter sekvenseres eller kjedes) basert på sagemakerPipeline-delen, som bør defineres i konfigurasjonsfilen til en av modellrepositoriene (ankermodellen). Dette lar deg overstyre standardavhengigheter utledet av SageMaker Pipelines. Vi diskuterer konfigurasjonsfilstrukturen senere i dette innlegget.

- /rammeverk/behandling/ – Denne katalogen inneholder et Python-skript som oppretter en SageMaker Processing-jobb basert på det angitte Docker-bildet og inngangspunktskriptet.

- /framework/registermodel/ – Denne katalogen inneholder et Python-skript for registrering av en trent modell sammen med dens beregnede beregninger i SageMaker Model Registry.

- /rammeverk/trening/ – Denne katalogen inneholder et Python-skript som oppretter en SageMaker-treningsjobb.

- /framework/transform/ – Denne katalogen inneholder et Python-skript som lager en SageMaker batch-transformeringsjobb. I sammenheng med modelltrening brukes dette til å beregne ytelsesmetrikken til en trent modell på testdata.

- /ramme/verktøy/ – Denne katalogen inneholder verktøyskript for lesing og sammenføyning av konfigurasjonsfiler, samt logging.

- /framework_entrypoint.py – Denne filen er inngangspunktet til rammekoden. Den kaller en funksjon definert i /framework/pipeline/-katalogen for å opprette eller oppdatere en SageMaker Pipelines DAG og kjøre den.

- /eksempler/ – Denne katalogen inneholder flere eksempler på hvordan du kan bruke dette automatiseringsrammeverket til å lage enkle og komplekse opplærings-DAGer.

- /env.env – Denne filen lar deg angi vanlige variabler som subnett, sikkerhetsgrupper og IAM-rolle som miljøvariabler.

- /requirements.txt – Denne filen spesifiserer Python-biblioteker som kreves for rammekoden.

Forutsetninger

Du bør ha følgende forutsetninger før du distribuerer denne løsningen:

- En AWS-konto

- SageMaker Studio

- En SageMaker-rolle med Amazon S3 lese/skrive og AWS KMS kryptering/dekryptering tillatelser

- En S3-bøtte for lagring av data, skript og modellartefakter

- Eventuelt AWS kommandolinjegrensesnitt (AWS CLI)

- Python3 (Python 3.7 eller høyere) og følgende Python-pakker:

- boto3

- sagemaker

- PyYAML

- Ytterligere Python-pakker brukt i dine egendefinerte skript

Distribuere løsningen

Fullfør følgende trinn for å distribuere løsningen:

- Organiser modelltreningslageret ditt i henhold til følgende struktur:

- Klon rammekoden og modellkildekoden fra Git-repositoriene:

-

- Clone

dynamic-sagemaker-pipelines-frameworkrepo inn i en treningskatalog. I den følgende koden antar vi at treningskatalogen kallesaws-train: - Klon modellkildekoden under samme katalog. For trening med flere modeller, gjenta dette trinnet for så mange modeller du trenger for å trene.

- Clone

For opplæring i én modell bør katalogen din se slik ut:

For trening med flere modeller bør katalogen din se slik ut:

- Sett opp følgende miljøvariabler. Stjerner indikerer miljøvariabler som kreves; resten er valgfritt.

| Miljøvariabel | Beskrivelse |

SMP_ACCOUNTID* |

AWS-konto der SageMaker-rørledningen kjøres |

SMP_REGION* |

AWS-regionen der SageMaker-rørledningen kjøres |

SMP_S3BUCKETNAME* |

Navn på S3-bøtte |

SMP_ROLE* |

SageMaker rolle |

SMP_MODEL_CONFIGPATH* |

Relativ bane for konfigurasjonsfiler med én eller flere modeller |

SMP_SUBNETS |

Subnett-ID-er for SageMaker-nettverkskonfigurasjon |

SMP_SECURITYGROUPS |

Sikkerhetsgruppe-IDer for SageMaker-nettverkskonfigurasjon |

For brukstilfeller med én modell, SMP_MODEL_CONFIGPATH vil være <MODEL-DIR>/conf/conf.yaml. For brukstilfeller med flere modeller, SMP_MODEL_CONFIGPATH vil være */conf/conf.yaml, som lar deg finne alle conf.yaml filer ved hjelp av Pythons glob-modul og kombiner dem for å danne en global konfigurasjonsfil. Under eksperimentering (lokal testing) kan du spesifisere miljøvariabler inne i filen env.env og deretter eksportere dem ved å kjøre følgende kommando i terminalen:

Merk at verdiene til miljøvariabler i env.env skal plasseres innenfor anførselstegn (f.eks. SMP_REGION="us-east-1"). Under operasjonalisering bør disse miljøvariablene angis av CI-rørledningen.

- Opprett og aktiver et virtuelt miljø ved å kjøre følgende kommandoer:

- Installer de nødvendige Python-pakkene ved å kjøre følgende kommando:

- Rediger modelltreningen din

conf.yamlfiler. Vi diskuterer konfigurasjonsfilstrukturen i neste avsnitt. - Fra terminalen ringer du rammeverkets inngangspunkt for å opprette eller oppdatere og kjøre SageMaker Pipeline Training DAG:

- Se og feilsøk SageMaker Pipelines som kjører på Rørledninger fanen i SageMaker Studio UI.

Konfigurasjonsfilstruktur

Det er to typer konfigurasjonsfiler i den foreslåtte løsningen: rammekonfigurasjon og modellkonfigurasjon. I denne delen beskriver vi hver enkelt i detalj.

Rammekonfigurasjon

De /framework/conf/conf.yaml fil setter variablene som er felles for alle modelleringsenheter. Dette inkluderer SMP_S3BUCKETNAME, SMP_ROLE, SMP_MODEL_CONFIGPATH, SMP_SUBNETS, SMP_SECURITYGROUPSog SMP_MODELNAME. Se trinn 3 i distribusjonsinstruksjonene for beskrivelser av disse variablene og hvordan du setter dem via miljøvariabler.

Modellkonfigurasjon

For hver modell i prosjektet må vi spesifisere følgende i <MODEL-DIR>/conf/conf.yaml fil (stjerner indikerer nødvendige deler; resten er valgfrie):

- /conf/modeller* – I denne delen kan du konfigurere en eller flere modelleringsenheter. Når rammekoden kjøres, vil den automatisk lese alle konfigurasjonsfilene under kjøretiden og legge dem til konfigurasjonstreet. Teoretisk kan du spesifisere alle modelleringsenheter i samme

conf.yamlfil, men det anbefales å spesifisere hver modelleringsenhetskonfigurasjon i dens respektive katalog eller Git-depot for å minimere feil. Enhetene er som følger:- {modell navn}* – Navnet på modellen.

- kildekatalog* - En vanlig

source_dirbane som skal brukes for alle trinn i modelleringsenheten. - forprosess – Denne delen spesifiserer forbehandlingsparametere.

- tog* – Denne delen spesifiserer treningsjobbparametere.

- forvandle* – Denne delen spesifiserer SageMaker Transform jobbparametere for å lage spådommer på testdataene.

- evaluere – Denne delen spesifiserer SageMaker Processing jobbparametere for å generere en modellberegning JSON-rapport for den trente modellen.

- register* – Denne delen spesifiserer parametere for registrering av den trente modellen i SageMaker Model Registry.

- /conf/sagemakerPipeline* – Denne delen definerer SageMaker Pipelines-flyten, inkludert avhengigheter mellom trinn. For enkeltmodellbruk er denne delen definert på slutten av konfigurasjonsfilen. For brukstilfeller med flere modeller,

sagemakerPipelineseksjonen trenger bare å være definert i konfigurasjonsfilen til en av modellene (en hvilken som helst av modellene). Vi omtaler denne modellen som ankermodell. Parametrene er som følger:- pipelineName* – Navnet på SageMaker-rørledningen.

- modeller* – Nestet liste over modelleringsenheter:

- {modell navn}* – Modellidentifikator, som skal samsvare med en {modellnavn}-identifikator i /conf/modeller-delen.

- trinn* -

- trinnnavn* – Trinnnavnet skal vises i SageMaker Pipelines DAG.

- trinn_klasse* – (Union[Processing, Training, CreateModel, Transform, Metrics, RegisterModel])

- trinn_type* – Denne parameteren er kun nødvendig for forbehandlingstrinn, for hvilke den skal settes til forbehandling. Dette er nødvendig for å skille mellom forprosesser og evalueringstrinn, som begge har en

step_classav behandling. - enable_cache – ([Union[True, False]]). Dette indikerer om du skal aktivere SageMaker Pipelines caching for dette trinnet.

- chain_input_source_step – ([liste[trinn_navn]]). Du kan bruke dette til å angi kanalutgangene for et annet trinn som inngang til dette trinnet.

- chain_input_additional_prefix – Dette er kun tillatt for trinn i transformasjonen

step_class, og kan brukes sammen medchain_input_source_stepparameter for å finne filen som skal brukes som input til transformeringstrinnet.

- trinn* -

- {modell navn}* – Modellidentifikator, som skal samsvare med en {modellnavn}-identifikator i /conf/modeller-delen.

- avhengig – Denne delen spesifiserer rekkefølgen som SageMaker Pipelines-trinnene skal kjøres i. Vi har tilpasset Apache Airflow-notasjonen for denne delen (f.eks.

{step_name} >> {step_name}). Hvis denne delen er tom, vil eksplisitte avhengigheter spesifisert avchain_input_source_stepparameter eller implisitte avhengigheter definerer SageMaker Pipelines DAG-flyten.

Merk at vi anbefaler å ha ett treningstrinn per modelleringsenhet. Hvis flere opplæringstrinn er definert for en modelleringsenhet, tar de påfølgende trinnene implisitt det siste opplæringstrinnet for å lage modellobjektet, beregne beregninger og registrere modellen. Hvis du trenger å trene flere modeller, anbefales det å lage flere modelleringsenheter.

Eksempler

I denne delen viser vi tre eksempler på ML-modelltrenings-DAGer opprettet ved hjelp av det presenterte rammeverket.

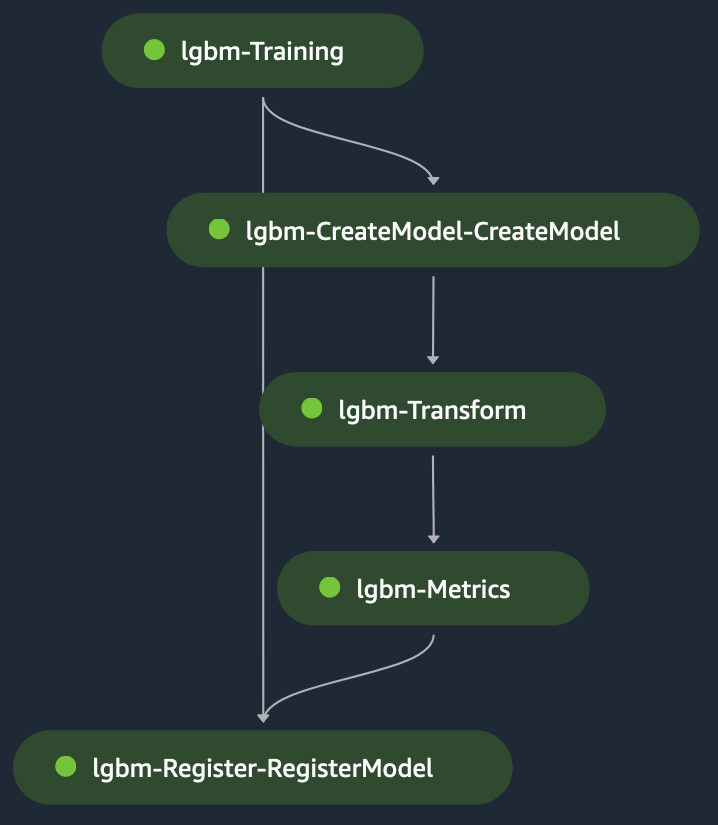

Enkeltmodelltrening: LightGBM

Dette er et enkeltmodelleksempel for et brukstilfelle for klassifisering der vi bruker LightGBM i skriptmodus på SageMaker. De datasett består av kategoriske og numeriske variabler for å forutsi den binære etiketten Revenue (for å forutsi om subjektet foretar et kjøp eller ikke). De forbehandling av skript brukes til å modellere dataene for trening og testing og deretter sette den i en S3-bøtte. S3-banene blir deretter gitt til treningstrinn i konfigurasjonsfilen.

Når treningstrinnet går, laster SageMaker filen på containeren kl /opt/ml/input/data/{channelName}/, tilgjengelig via miljøvariabelen SM_CHANNEL_{channelName} på beholderen (channelName= 'tog' eller 'test').De treningsmanus gjør følgende:

- Last inn filene lokalt fra lokale containerbaner ved å bruke NumPy last modul.

- Angi hyperparametre for treningsalgoritmen.

- Lagre den trente modellen på den lokale containerbanen

/opt/ml/model/.

SageMaker tar innholdet under /opt/ml/model/ for å lage en tarball som brukes til å distribuere modellen til SageMaker for hosting.

Transformeringstrinnet tar som input det trinnvise testfil som input og den trente modellen for å lage spådommer på den trente modellen. Utgangen fra transformeringstrinnet er Lenket til metrikktrinnet for å evaluere modellen mot bakken sannhet, som er eksplisitt levert til metrikktrinnet. Til slutt blir utdataene fra metrikktrinnet implisitt lenket til registertrinnet for å registrere modellen i SageMaker Model Registry med informasjon om modellens ytelse produsert i metrikktrinnet. Følgende figur viser en visuell representasjon av trenings-DAG. Du kan referere til skriptene og konfigurasjonsfilen for dette eksemplet i GitHub repo.

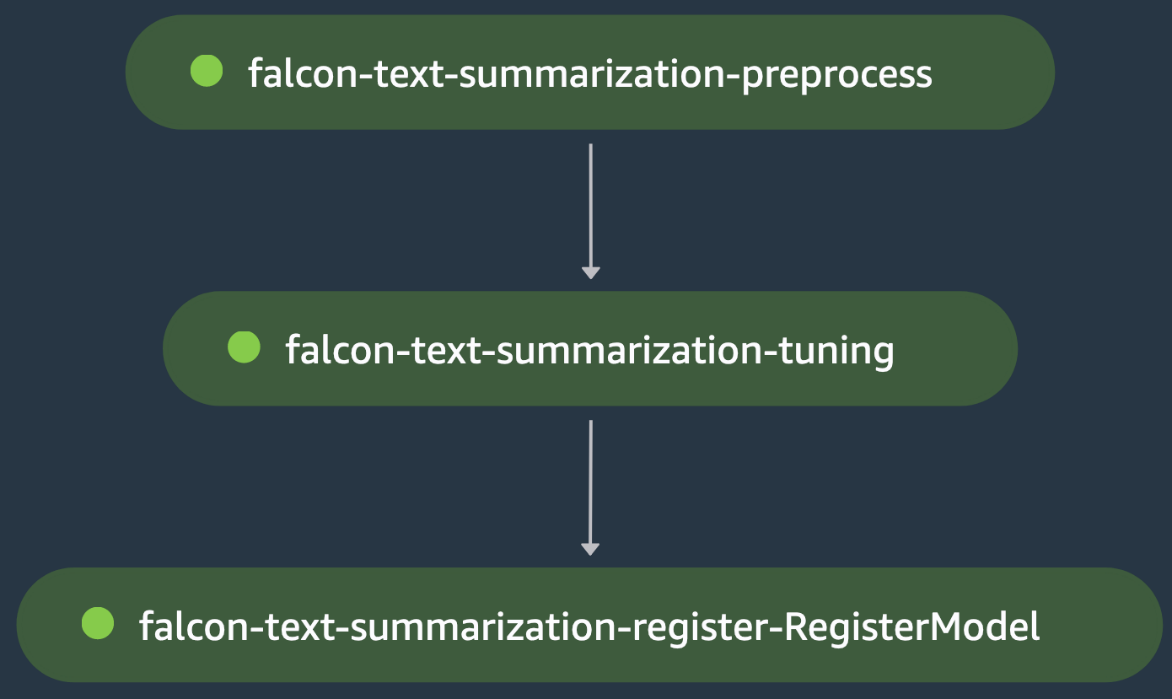

Single-modell trening: LLM finjustering

Dette er nok et enkelt-modell treningseksempel, der vi orkestrerer finjustering av en Falcon-40B storspråklig modell (LLM) fra Hugging Face Hub for en tekstoppsummering. De forbehandling av skript laster inn samsum datasett fra Hugging Face, laster tokenizeren for modellen, og behandler tog-/testdatadelingene for å finjustere modellen på disse domenedataene i falcon-text-summarization-preprocess-trinnet.

Resultatet er Lenket til falk-tekst-oppsummering-tuning-trinnet, der treningsmanus laster inn Falcon-40B LLM fra Hugging Face Hub og starter akselerert finjustering vha. LoRA på toget splittet. Modellen vurderes i samme trinn etter finjustering, som portvakter evalueringstapet for å mislykkes med falk-tekst-oppsummering-tuning-trinnet, noe som fører til at SageMaker-rørledningen stopper før den er i stand til å registrere den finjusterte modellen. Ellers kjører falk-tekst-oppsummerings-tuning-trinnet vellykket, og modellen blir registrert i SageMaker Model Registry. Følgende figur viser en visuell representasjon av LLM-finjusterings-DAG. Skriptene og konfigurasjonsfilen for dette eksemplet er tilgjengelig i GitHub repo.

Multi-modell trening

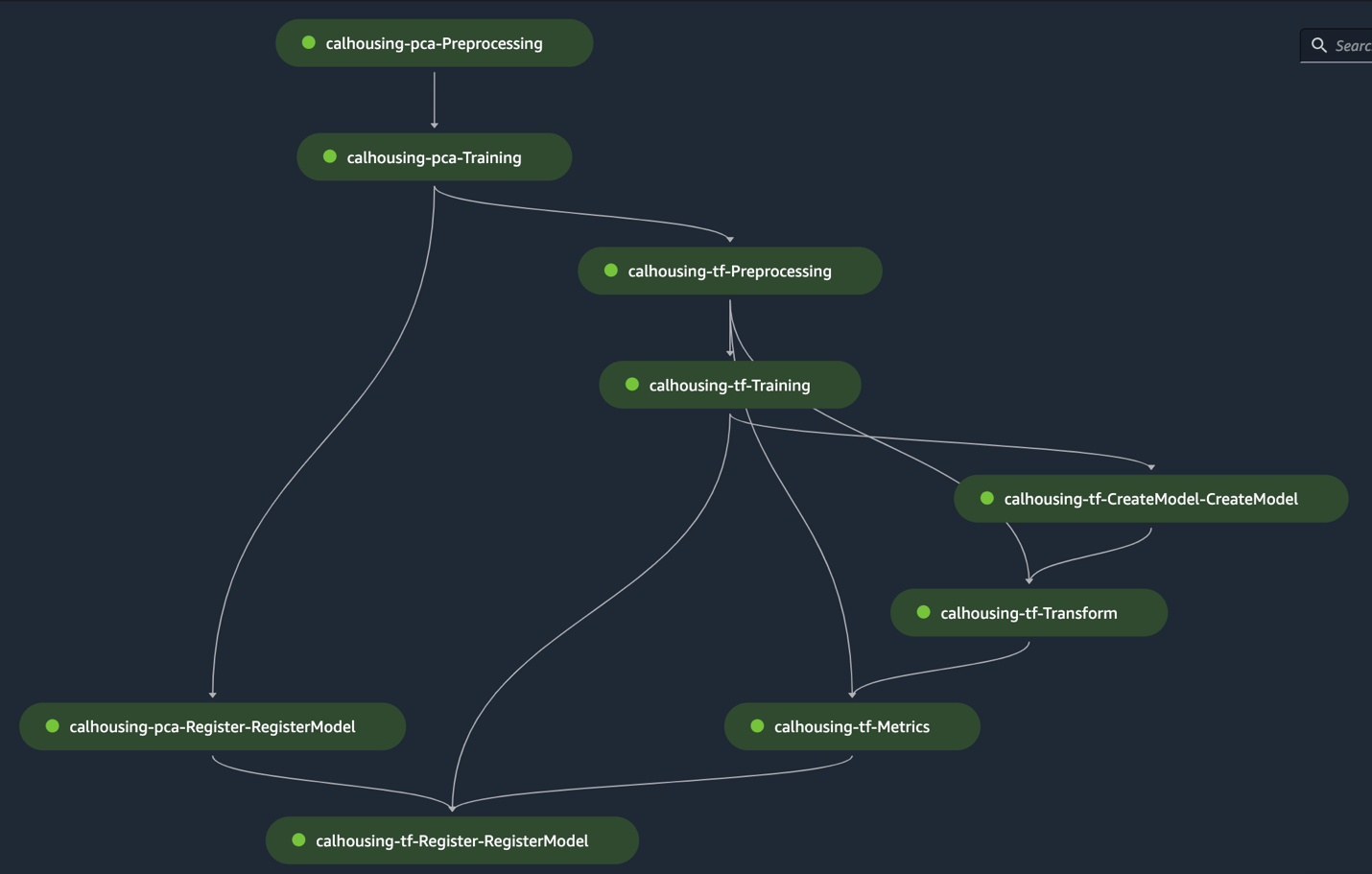

Dette er et multi-modell treningseksempel der en hovedkomponentanalyse (PCA) modell er trent for dimensjonalitetsreduksjon, og en TensorFlow Multilayer Perceptron modell er trent for California Boligpris prediksjon. TensorFlow-modellens forbehandlingstrinn bruker en opplært PCA-modell for å redusere dimensjonaliteten til treningsdataene. Vi legger til en avhengighet i konfigurasjonen for å sikre at TensorFlow-modellen er registrert etter PCA-modellregistrering. Følgende figur viser en visuell representasjon av flermodelltrenings-DAG-eksemplet. Skriptene og konfigurasjonsfilene for dette eksemplet er tilgjengelige i GitHub repo.

Rydd opp

Fullfør følgende trinn for å rydde opp i ressursene dine:

- Bruk AWS CLI for å liste og fjerne eventuelle gjenværende rørledninger som er opprettet av Python-skriptene.

- Eventuelt kan du slette andre AWS-ressurser, for eksempel S3-bøtten eller IAM-rollen som er opprettet utenfor SageMaker Pipelines.

konklusjonen

I dette innlegget presenterte vi et rammeverk for å automatisere SageMaker Pipelines DAG-oppretting basert på konfigurasjonsfiler. Det foreslåtte rammeverket tilbyr en fremtidsrettet løsning på utfordringen med å orkestrere komplekse ML-arbeidsmengder. Ved å bruke en konfigurasjonsfil gir SageMaker Pipelines fleksibiliteten til å bygge orkestrering med minimalt med kode, slik at du kan strømlinjeforme prosessen med å lage og administrere både enkeltmodell- og multimodellpipelines. Denne tilnærmingen sparer ikke bare tid og ressurser, men fremmer også MLOs beste praksis, og bidrar til den generelle suksessen til ML-initiativer. For mer informasjon om implementeringsdetaljer, se gjennom GitHub repo.

Om forfatterne

Luis Felipe Yepez Barrios, er en maskinlæringsingeniør med AWS Professional Services, fokusert på skalerbare distribuerte systemer og automatiseringsverktøy for å fremskynde vitenskapelig innovasjon innen maskinlæring (ML). Videre bistår han bedriftskunder med å optimalisere deres maskinlæringsløsninger gjennom AWS-tjenester.

Luis Felipe Yepez Barrios, er en maskinlæringsingeniør med AWS Professional Services, fokusert på skalerbare distribuerte systemer og automatiseringsverktøy for å fremskynde vitenskapelig innovasjon innen maskinlæring (ML). Videre bistår han bedriftskunder med å optimalisere deres maskinlæringsløsninger gjennom AWS-tjenester.

Jinzhao Feng, er en maskinlæringsingeniør ved AWS Professional Services. Han fokuserer på å bygge og implementere storskala Generative AI og klassiske ML-rørledningsløsninger. Han er spesialisert i FMOps, LLMOps og distribuert opplæring.

Jinzhao Feng, er en maskinlæringsingeniør ved AWS Professional Services. Han fokuserer på å bygge og implementere storskala Generative AI og klassiske ML-rørledningsløsninger. Han er spesialisert i FMOps, LLMOps og distribuert opplæring.

Harde Asnani, er en maskinlæringsingeniør ved AWS. Hans bakgrunn er i Applied Data Science med fokus på operasjonalisering av maskinlæringsarbeidsmengder i skyen i stor skala.

Harde Asnani, er en maskinlæringsingeniør ved AWS. Hans bakgrunn er i Applied Data Science med fokus på operasjonalisering av maskinlæringsarbeidsmengder i skyen i stor skala.

Hasan Shojaei, er en Sr. Data Scientist med AWS Professional Services, hvor han hjelper kunder på tvers av ulike bransjer med å løse sine forretningsutfordringer gjennom bruk av big data, maskinlæring og skyteknologier. Før denne rollen ledet Hasan flere initiativ for å utvikle nye fysikkbaserte og datadrevne modelleringsteknikker for topp energiselskaper. Utenom jobben er Hasan lidenskapelig opptatt av bøker, fotturer, fotografering og historie.

Hasan Shojaei, er en Sr. Data Scientist med AWS Professional Services, hvor han hjelper kunder på tvers av ulike bransjer med å løse sine forretningsutfordringer gjennom bruk av big data, maskinlæring og skyteknologier. Før denne rollen ledet Hasan flere initiativ for å utvikle nye fysikkbaserte og datadrevne modelleringsteknikker for topp energiselskaper. Utenom jobben er Hasan lidenskapelig opptatt av bøker, fotturer, fotografering og historie.

Alec Jenab, er en maskinlæringsingeniør som spesialiserer seg på å utvikle og operasjonalisere maskinlæringsløsninger i stor skala for bedriftskunder. Alec brenner for å bringe innovative løsninger til markedet, spesielt på områder der maskinlæring kan forbedre sluttbrukeropplevelsen på en meningsfylt måte. Utenom jobben liker han å spille basketball, stå på snowboard og oppdage skjulte perler i San Francisco.

Alec Jenab, er en maskinlæringsingeniør som spesialiserer seg på å utvikle og operasjonalisere maskinlæringsløsninger i stor skala for bedriftskunder. Alec brenner for å bringe innovative løsninger til markedet, spesielt på områder der maskinlæring kan forbedre sluttbrukeropplevelsen på en meningsfylt måte. Utenom jobben liker han å spille basketball, stå på snowboard og oppdage skjulte perler i San Francisco.

- SEO-drevet innhold og PR-distribusjon. Bli forsterket i dag.

- PlatoData.Network Vertical Generative Ai. Styrk deg selv. Tilgang her.

- PlatoAiStream. Web3 Intelligence. Kunnskap forsterket. Tilgang her.

- PlatoESG. Karbon, CleanTech, Energi, Miljø, Solenergi, Avfallshåndtering. Tilgang her.

- PlatoHelse. Bioteknologisk og klinisk etterretning. Tilgang her.

- kilde: https://aws.amazon.com/blogs/machine-learning/automate-amazon-sagemaker-pipelines-dag-creation/

- :er

- :ikke

- :hvor

- $OPP

- 120

- 160

- 7

- 8

- 9

- a

- I stand

- Om oss

- akselerert

- adgang

- tilgjengelig

- imøtekomme

- Ifølge

- Logg inn

- oppnå

- tvers

- aktivere

- asyklisk

- legge til

- Etter

- mot

- AI

- algoritme

- Alle

- tillate

- tillatt

- tillater

- langs

- også

- Amazon

- Amazon SageMaker

- Amazon SageMaker-rørledninger

- Amazon Web Services

- blant

- an

- analyse

- Anchor

- og

- En annen

- noen

- Apache

- anvendt

- tilnærming

- arkitektur

- ER

- områder

- AS

- bistår

- anta

- At

- automatisere

- automatisk

- Automatisere

- Automatisering

- tilgjengelig

- AWS

- AWS profesjonelle tjenester

- bakgrunn

- basert

- basketball

- BE

- før du

- Fordeler

- BEST

- beste praksis

- Stor

- Store data

- bøker

- både

- Bringe

- bygge

- virksomhet

- men

- by

- beregne

- beregnet

- ring

- som heter

- Samtaler

- CAN

- saken

- saker

- henvender seg

- årsaker

- Lenket

- utfordre

- utfordringer

- Kanal

- valg

- klasser

- klassifisering

- ren

- cli

- klienter

- Cloud

- kode

- kombinere

- Felles

- Selskaper

- komplekse

- komponent

- bekymringer

- selvtillit

- Konfigurasjon

- sammen

- konsistent

- består

- Container

- Containere

- inneholder

- innhold

- kontekst

- kontinuerlig

- medvirkende

- dekke

- skape

- opprettet

- skaper

- Opprette

- skaperverket

- avgjørende

- skikk

- Kunder

- tilpasset

- DAG

- dato

- datavitenskap

- dataforsker

- data-drevet

- datasett

- erklærte

- Misligholde

- definere

- definert

- definerer

- levering

- demonstrere

- avhengig

- Avhengighet

- utplassere

- utplasserings

- distribusjon

- beskrive

- detalj

- detaljert

- detaljer

- utvikle

- utvikle

- Utvikling

- diagram

- forskjellig

- regissert

- kataloger

- katalog

- oppdage

- diskutere

- vises

- skille

- distribueres

- distribuerte systemer

- distribuert opplæring

- Docker

- gjør

- domene

- under

- dynamisk

- dynamisk

- hver enkelt

- effektiv

- innsats

- bemyndiger

- muliggjøre

- muliggjør

- muliggjør

- slutt

- energi

- ingeniør

- Ingeniører

- sikre

- Enterprise

- Hele

- entry

- Miljø

- miljøer

- feil

- spesielt

- evaluere

- evaluert

- evaluere

- evaluering

- Hver

- eksempel

- eksempler

- fremskynde

- erfaring

- eksplisitt

- eksportere

- utvidet

- Face

- FAIL

- falsk

- raskere

- felt

- Figur

- filet

- Filer

- Endelig

- Finn

- fleksibilitet

- fleksibel

- flyten

- Fokus

- fokuserte

- fokuserer

- etter

- følger

- Til

- skjema

- fremtidsrettet

- Rammeverk

- rammer

- Francisco

- fra

- funksjon

- Dess

- genererer

- generative

- Generativ AI

- gå

- Global

- styresett

- graf

- større

- Gruppe

- Gruppens

- Ha

- å ha

- he

- hjelper

- her.

- skjult

- hans

- historie

- Hosting

- bolig

- Hvordan

- Hvordan

- HTML

- http

- HTTPS

- Hub

- identifikator

- Identitet

- ids

- if

- bilde

- gjennomføring

- implementere

- forbedre

- in

- I andre

- inkluderer

- Inkludert

- indikerer

- indikerer

- bransjer

- utledet

- informasjon

- Infrastruktur

- initiativer

- Innovasjon

- innovative

- inngang

- innsiden

- installere

- f.eks

- instruksjoner

- integrering

- interaksjoner

- intervensjon

- inn

- IT

- DET ER

- Jobb

- sammenføyning

- jpg

- JSON

- nøkkel

- nøkler

- Etiketten

- Språk

- stor

- Siste

- seinere

- læring

- Led

- venstre

- bibliotekene

- i likhet med

- linje

- Liste

- LLM

- laste

- laster

- lokal

- lokalt

- logging

- Se

- ser ut som

- tap

- maskin

- maskinlæring

- gjøre

- GJØR AT

- Making

- ledelse

- administrerende

- håndbok

- mange

- marked

- Match

- metrisk

- Metrics

- minimal

- minimere

- ML

- MLOps

- Mote

- modell

- modellering

- modeller

- Moduler

- mer

- flere

- navn

- nødvendig

- Trenger

- nødvendig

- behov

- nettverk

- neste

- Nei.

- roman

- objekt

- of

- Tilbud

- on

- ONE

- bare

- optimalisere

- or

- orkestrert

- orkestrere

- orkestre

- Annen

- ellers

- produksjon

- utganger

- utenfor

- samlet

- overstyring

- pakker

- parameter

- parametere

- lidenskapelig

- banen

- baner

- for

- ytelse

- utført

- fotografering

- rørledning

- plato

- Platon Data Intelligence

- PlatonData

- spiller

- Point

- Post

- praksis

- forhåndsdefinert

- forutsi

- Spådommer

- forutsetninger

- presentere

- presentert

- pris

- Principal

- Før

- privat

- prosess

- Prosesser

- prosessering

- produsert

- Produksjon

- profesjonell

- prosjekt

- fremmer

- fremme

- foreslått

- forutsatt

- gir

- Kjøp

- Python

- raskt

- område

- Lese

- lett

- Lesning

- anbefaler

- anbefales

- redusere

- reduserer

- reduksjon

- referere

- region

- registrere

- registrert

- registrering

- Registrering

- registret

- gjenværende

- gjenta

- rapporterer

- Repository

- representasjon

- påkrevd

- Krav

- ressurs

- Ressurser

- de

- REST

- Resultater

- inntekter

- anmeldelse

- Rolle

- roller

- Kjør

- rennende

- går

- runtime

- sagemaker

- SageMaker-rørledninger

- samme

- San

- San Fransisco

- skalerbar

- Skala

- Vitenskap

- vitenskapelig

- Forsker

- forskere

- script

- skript

- Seksjon

- seksjoner

- sikkerhet

- Sequence

- Tjenester

- sett

- sett

- flere

- bør

- Viser

- Enkelt

- SIX

- glatter

- So

- løsning

- Solutions

- LØSE

- kilde

- kildekoden

- spesialisert

- spesialisert

- spesifisert

- splittet

- spagaten

- starter

- Trinn

- Steps

- Stopp

- lagring

- lagring

- effektivisere

- effektivisering

- struktur

- studio

- emne

- subnett

- senere

- suksess

- vellykket

- slik

- medfølgende

- syntaks

- Systemer

- Ta

- tar

- teknikker

- Technologies

- tensorflow

- terminal

- test

- Testing

- tekst

- Det

- De

- Registeret

- deres

- Dem

- deretter

- derfor

- Disse

- denne

- tre

- Gjennom

- hele

- tid

- til

- topp

- Sporing

- Tog

- trent

- Kurs

- Transform

- Treet

- sant

- to

- typer

- ui

- etter

- enhet

- lomper

- Oppdater

- bruke

- bruk sak

- brukt

- Bruker

- Brukererfaring

- bruker

- ved hjelp av

- verktøyet

- Verdier

- variabel

- versjoner

- av

- virtuelle

- visuell

- we

- web

- webtjenester

- VI VIL

- når

- om

- hvilken

- HVEM

- bred

- Bred rekkevidde

- vil

- med

- innenfor

- uten

- Arbeid

- arbeidsflyt

- Xgboost

- yaml

- Du

- Din

- zephyrnet