Ettersom teknologier for kunstig intelligens (AI) og maskinlæring (ML) har blitt mainstream, har mange bedrifter lykkes med å bygge kritiske forretningsapplikasjoner drevet av ML-modeller i stor skala i produksjon. Men siden disse ML-modellene tar kritiske forretningsbeslutninger for virksomheten, er det viktig for bedrifter å legge til riktige rekkverk gjennom hele ML-livssyklusen. Guardrails sikrer at sikkerheten, personvernet og kvaliteten på koden, konfigurasjonen og data- og modellkonfigurasjonen som brukes i modellens livssyklus, er versjonert og bevart.

Implementering av disse rekkverkene blir vanskeligere for bedrifter fordi ML-prosessene og aktivitetene i bedrifter blir mer komplekse på grunn av inkluderingen av dypt involverte prosesser som krever bidrag fra flere interessenter og personas. I tillegg til dataingeniører og dataforskere, har det vært inkludering av operasjonelle prosesser for å automatisere og effektivisere ML-livssyklusen. I tillegg trenger bølgen av forretningsinteressenter og i noen tilfeller juridiske og samsvarsgjennomganger evner for å legge til åpenhet for administrasjon av tilgangskontroll, aktivitetssporing og rapportering gjennom hele ML-livssyklusen.

Rammeverket som gir systematisk synlighet i utvikling, validering og bruk av ML-modeller kalles ML-styring. Under AWS re:Invent 2022, AWS introduserte nye ML-styringsverktøy forum Amazon SageMaker som forenkler tilgangskontrollen og forbedrer åpenheten over ML-prosjektene dine. Et av verktøyene som er tilgjengelige som en del av ML-styringen er Amazon SageMaker modellkort, som har evnen til å skape en enkelt kilde til sannhet for modellinformasjon ved å sentralisere og standardisere dokumentasjon gjennom hele modellens livssyklus.

SageMaker modellkort lar deg standardisere hvordan modeller dokumenteres, og dermed oppnå synlighet i livssyklusen til en modell, fra design, bygging, opplæring og evaluering. Modellkort er ment å være en enkelt kilde til sannhet for forretningsmessige og tekniske metadata om modellen som pålitelig kan brukes til revisjons- og dokumentasjonsformål. De gir et faktaark over modellen som er viktig for modellstyring.

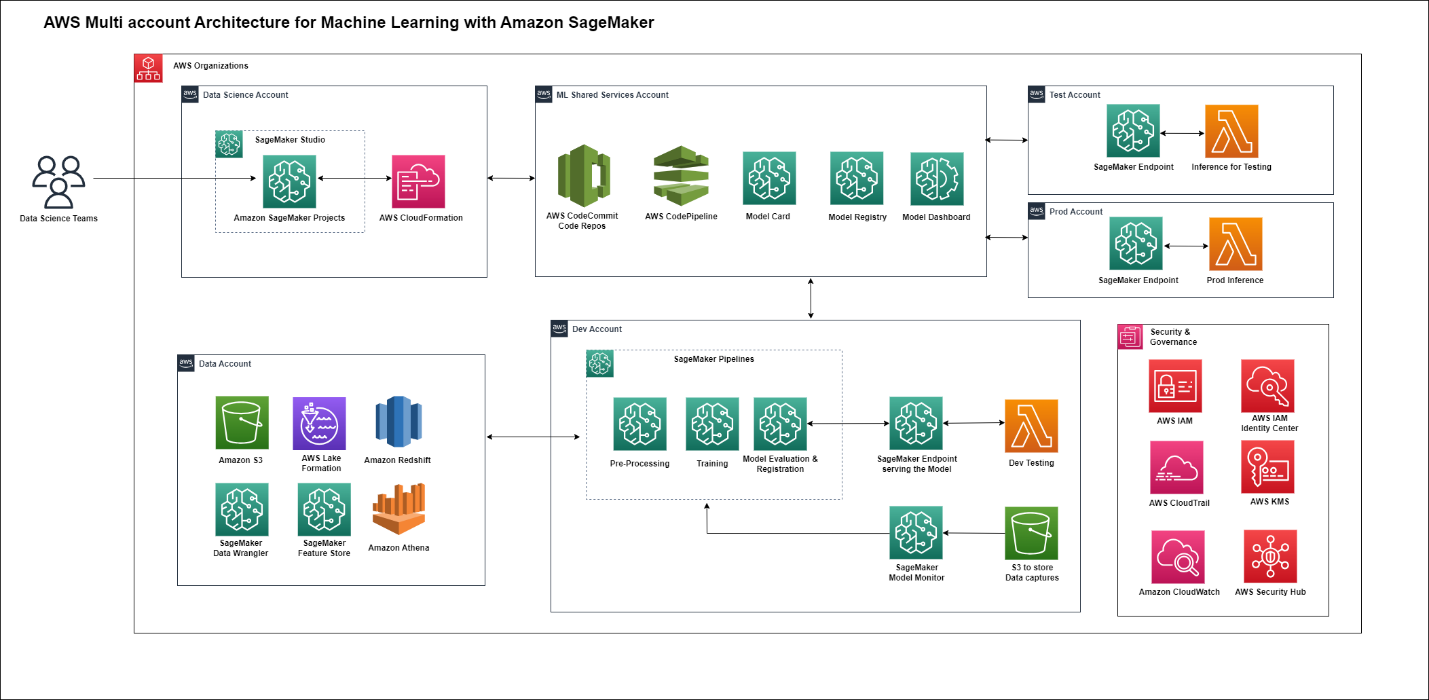

Når du skalerer modellene, prosjektene og teamene dine, anbefaler vi som beste praksis at du tar i bruk en flerkontostrategi som gir prosjekt- og teamisolasjon for utvikling og distribusjon av ML-modeller. For mer informasjon om å forbedre styringen av ML-modellene dine, se Forbedre styringen av maskinlæringsmodellene dine med Amazon SageMaker.

Arkitekturoversikt

Arkitekturen er implementert som følger:

- Data Science Account – Dataforskere utfører sine eksperimenter i SageMaker Studio og bygge et MLOps-oppsett for å distribuere modeller til iscenesettelse/produksjonsmiljøer ved hjelp av SageMaker-prosjekter.

- ML Shared Services-konto – MLO-ene som er satt opp fra Data Science-kontoen vil utløse kontinuerlig integrasjon og kontinuerlig levering (CI/CD)-pipelines ved å bruke AWS CodeCommit og AWS CodePipeline.

- Utviklerkonto – CI/CD-pipelines vil ytterligere utløse ML-pipelines i denne kontoen som dekker dataforbehandling, modellopplæring og etterbehandling som modellevaluering og registrering. Utdata fra disse rørledningene vil distribuere modellen i SageMaker-endepunkter skal konsumeres for slutningsformål. Avhengig av styringskravene dine, kan Data Science & Dev-kontoer slås sammen til én enkelt AWS-konto.

- Datakonto – ML-rørledningene som kjører i utviklerkontoen vil hente dataene fra denne kontoen.

- Test- og produksjonskontoer – CI/CD-rørledningene vil fortsette distribusjonen etter utviklerkontoen for å sette opp SageMaker-endepunktkonfigurasjon i disse kontoene.

- Sikkerhet og styring – Tjenester som AWS Identity and Access Management (IAM), AWS IAM Identity Center, AWS CloudTrail, AWS Key Management Service (AWS KMS), Amazon CloudWatch og AWS Security Hub vil bli brukt på tvers av disse kontoene som en del av sikkerhet og styresett.

Følgende diagram illustrerer denne arkitekturen.

For mer informasjon om innstilling av skalerbar multikonto ML-arkitektur, se MLOps-stiftelse for bedrifter med Amazon SageMaker.

Kundene våre trenger muligheten til å dele modellkort på tvers av kontoer for å forbedre synligheten og styringen av modellene deres gjennom informasjon som deles i modellkortet. Nå, med deling av modellkort på tvers av kontoer, kan kundene dra nytte av fordelene med flerkontostrategi samtidig som de har tilgang til de tilgjengelige modellkortene i organisasjonen, slik at de kan akselerere samarbeid og sikre styring.

I dette innlegget viser vi hvordan du setter opp og får tilgang til modellkort på tvers av Model Development Lifecycle (MDLC)-kontoer ved å bruke den nye funksjonen for deling på tvers av kontoer på modellkortet. Først vil vi beskrive et scenario og arkitektur for å sette opp funksjonen for deling på tvers av kontoer på modellkortet, og deretter dykke dypt ned i hver komponent av hvordan du setter opp og får tilgang til delte modellkort på tvers av kontoer for å forbedre synlighet og modellstyring.

Løsningsoversikt

Når du bygger ML-modeller, anbefaler vi å sette opp en flerkontoarkitektur for å gi arbeidsbelastningsisolering som forbedrer sikkerhet, pålitelighet og skalerbarhet. For dette innlegget vil vi anta å bygge og distribuere en modell for Customer Churn-brukstilfelle. Arkitekturdiagrammet som følger viser en av de anbefalte tilnærmingene – sentralisert modellkort – for å administrere et modellkort i en maskinlæringsmodell-utviklingslivssyklus (MDLC)-arkitektur med flere kontoer. Du kan imidlertid også bruke en annen tilnærming, et nav-og-eiker-modellkort. I dette innlegget vil vi kun fokusere på en sentralisert modellkort-tilnærming, men de samme prinsippene kan utvides til en hub-and-spoke-tilnærming. Hovedforskjellen er at hver spoke-konto vil opprettholde sin egen versjon av modellkort, og den vil ha prosesser for å samle og kopiere til en sentralisert konto.

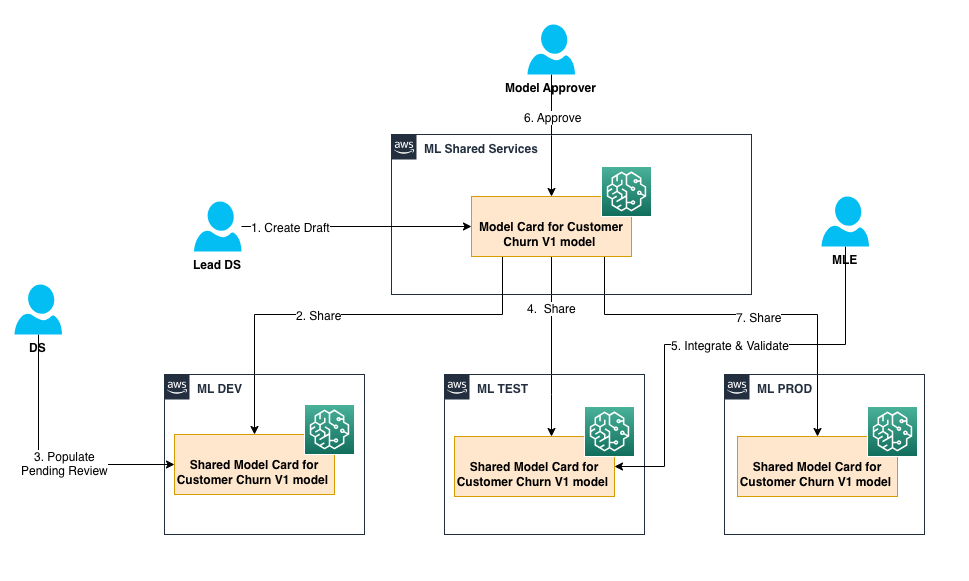

Følgende diagram illustrerer denne arkitekturen.

Arkitekturen er implementert som følger:

- Lead Data Scientist blir varslet om å løse Customer Churn-brukssaken ved å bruke ML, og de starter ML-prosjektet ved å lage et modellkort for Customer Churn V1-modellen i utkaststatus i ML Shared Services-kontoen

- Gjennom automatisering deles det modellkortet med ML Dev Account

- Data Scientist bygger modellen og begynner å fylle ut informasjon via APIer i modellkortet basert på eksperimenteringsresultatene deres, og modellkortets status er satt til Venter på gjennomgang

- Gjennom automatisering deles det modellkortet med ML-testkontoen

- ML Engineer (MLE) kjører integrasjons- og valideringstester i ML Testkonto og modellen i sentralregisteret er merket Venter på godkjenning

- Modellgodkjenner gjennomgår modellresultatene med støttedokumentasjonen i det sentrale modellkortet og godkjenner modellkortet for produksjonsdistribusjon.

- Gjennom automatisering deles det modellkortet med ML Prod-kontoen i skrivebeskyttet modus.

Forutsetninger

Før du begynner, må du kontrollere at du har følgende forutsetninger:

- To AWS-kontoer.

- I begge AWS-kontoene har en IAM-forbundsrolle med administratortilgang til å gjøre følgende:

- Opprett, rediger, vis og slett modellkort i Amazon SageMaker.

- Opprett, rediger, vis og slett ressursandel i AWS RAM.

For mer informasjon, se Eksempel på IAM-policyer for AWS RAM.

Sette opp modellkortdeling

Kontoen der modellkortene opprettes er modellkortkontoen. Brukere i modellkortkontoen deler dem med de delte kontoene der de kan oppdateres. Brukere i modellkortkontoen kan dele modellkortene sine gjennom AWS Resource Access Manager (AWS RAM). AWS RAM hjelper deg med å dele ressurser på tvers av AWS-kontoer.

I den følgende delen viser vi hvordan du deler modellkort.

Først oppretter du et modellkort for en Customer Churn-brukstilfelle som tidligere beskrevet. På Amazon SageMaker-konsollen utvider du Governance-delen og velger Modellkort.

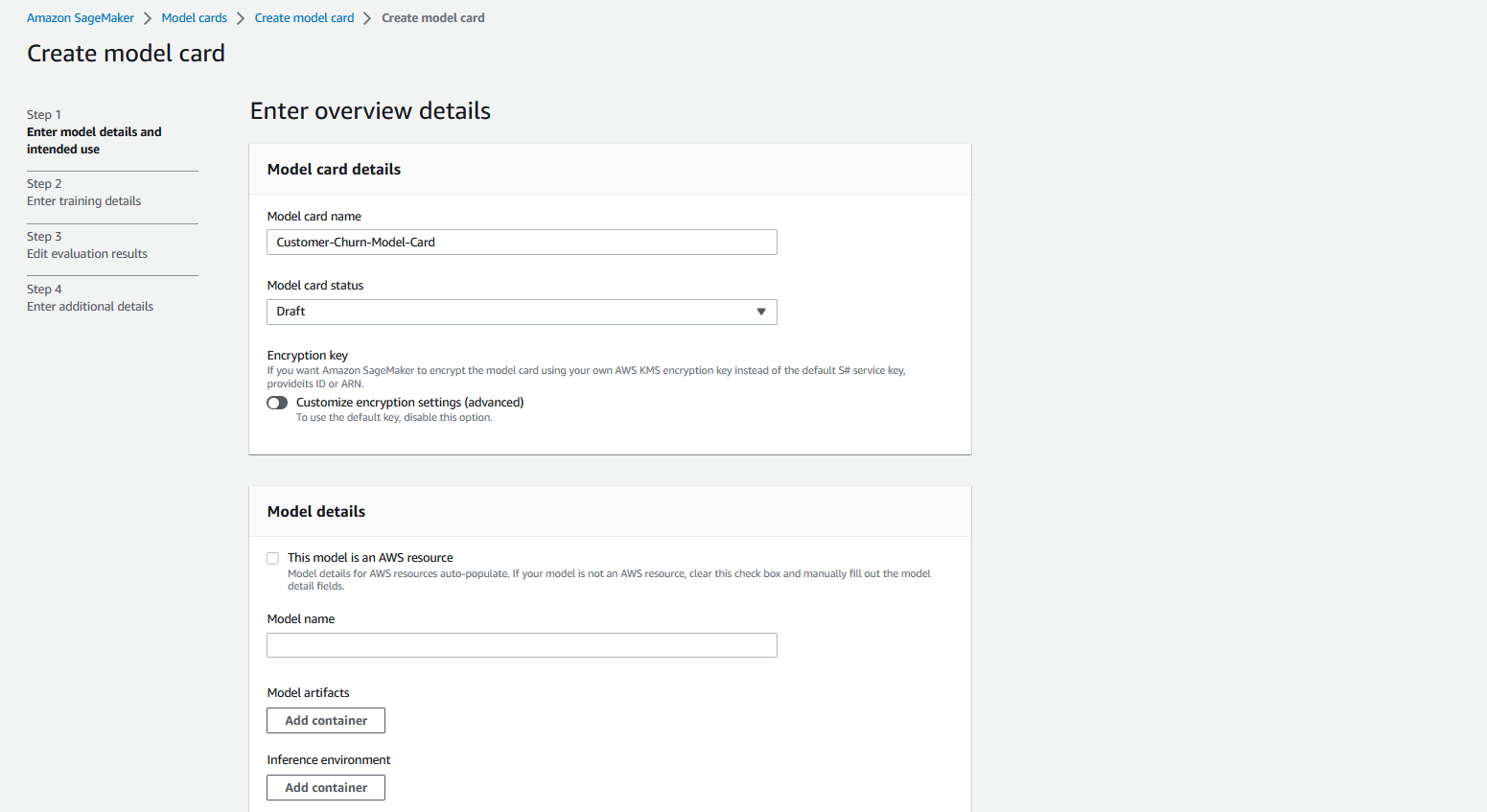

Vi lager modellkortet i utkast status med navnet Kunde-Churn-Model-Card. For mer informasjon, se Lag et modellkort. I denne demonstrasjonen kan du la resten av feltene stå tomme og lage modellkortet.

Alternativt kan du bruke følgende AWS CLI-kommando for å lage modellkortet:

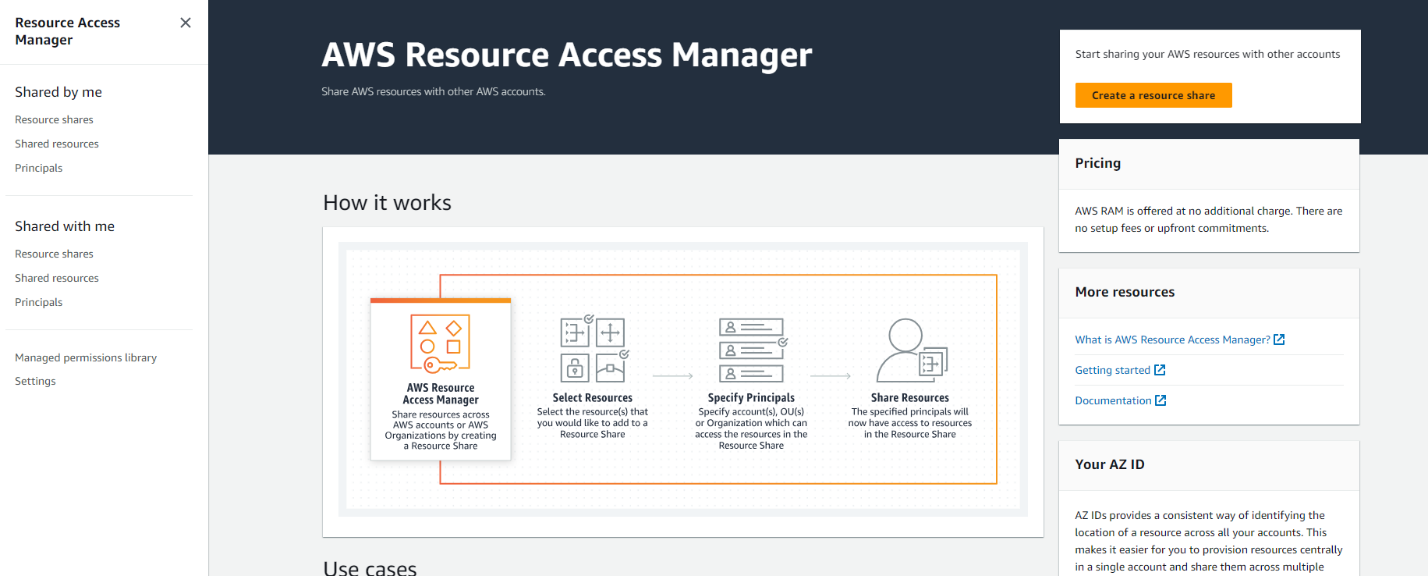

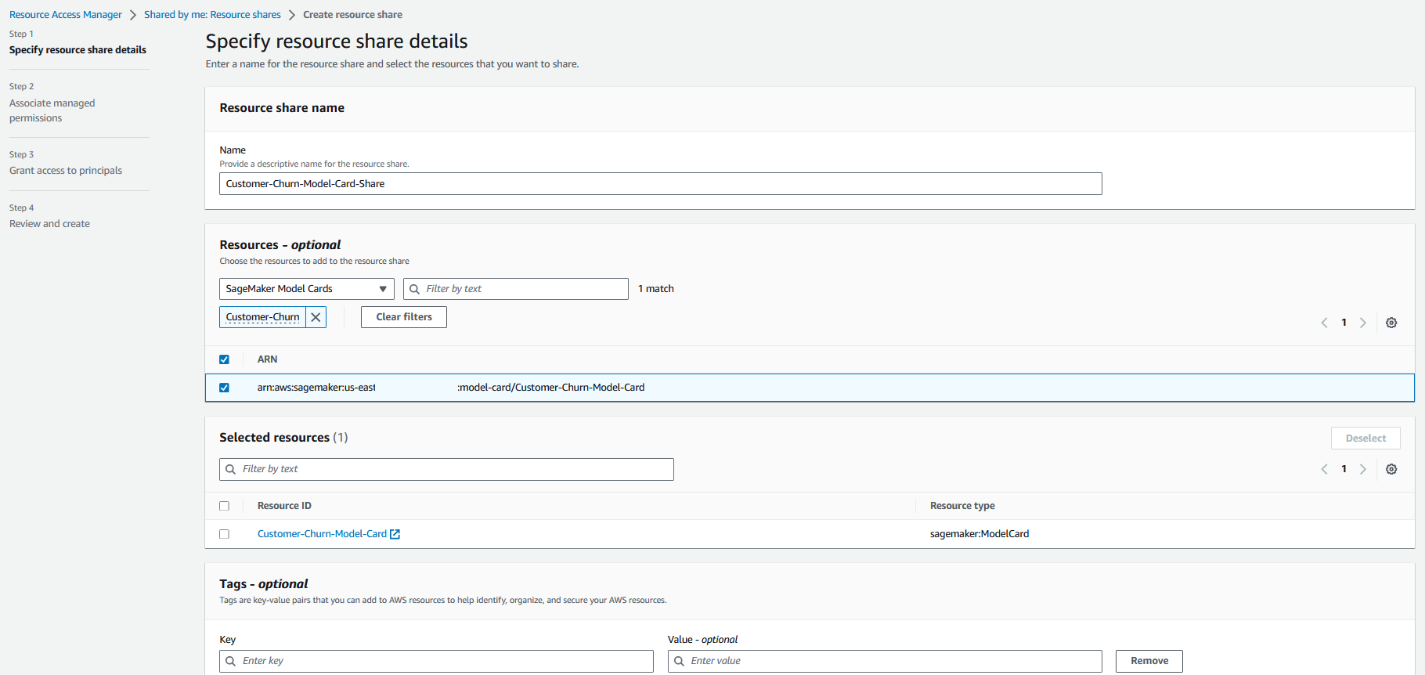

Opprett nå delingen på tvers av kontoer ved å bruke AWS RAM. I AWS RAM-konsollen velger du Opprett en ressursandel.

Skriv inn et navn for ressursandelen, for eksempel "Customer-Churn-Model-Card-Share". I ressursene – valgfritt seksjon, velg ressurstypen som SageMaker modellkort. Modellkortet vi laget i forrige trinn vil vises i oppføringen.

Velg den modellen, og den vil vises i delen Valgte ressurser. Velg den ressursen igjen som vist i de følgende trinnene og velg neste.

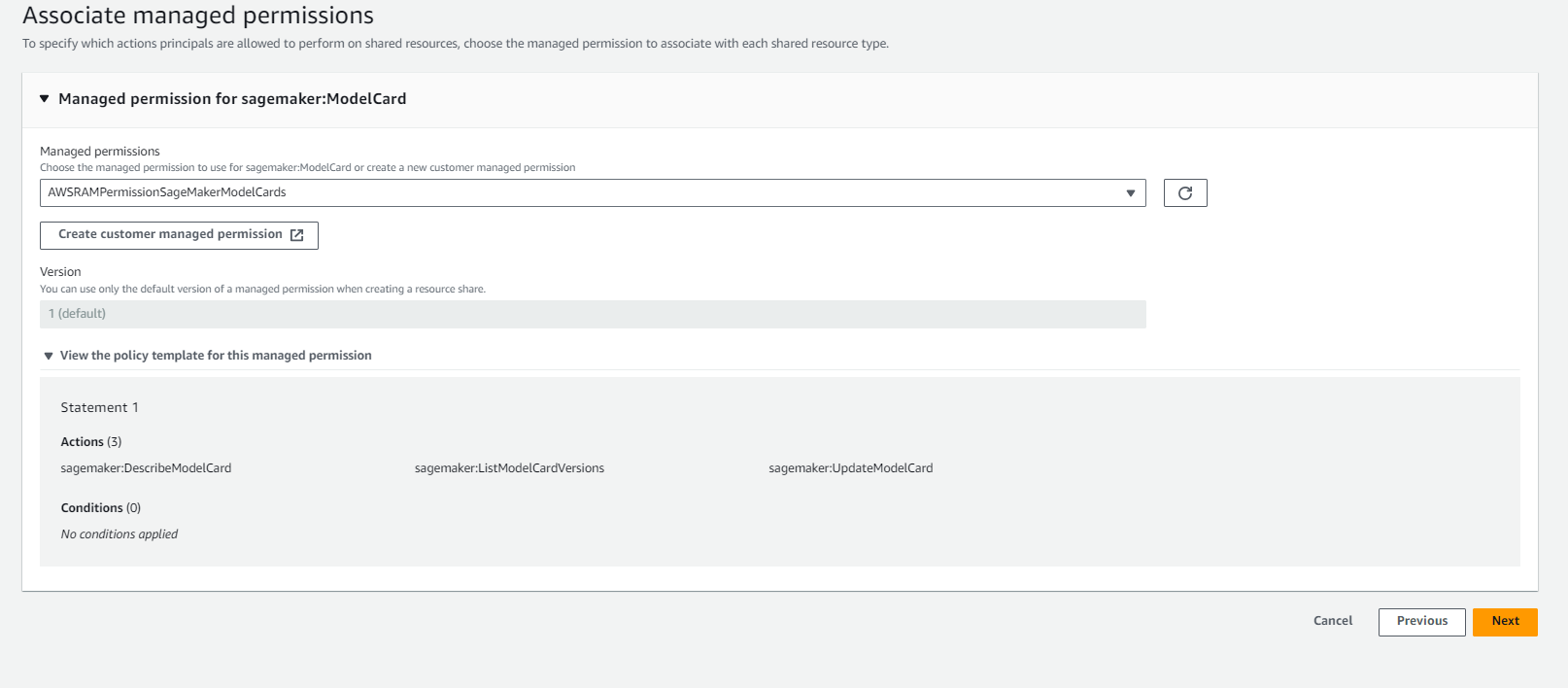

På neste side kan du velge administrerte tillatelser. Du kan opprette egendefinerte tillatelser eller bruke standardalternativet "AWSRAMPermissionSageMakerModelCards”Og velg neste. For mer informasjon, se Administrere tillatelser i AWS RAM.

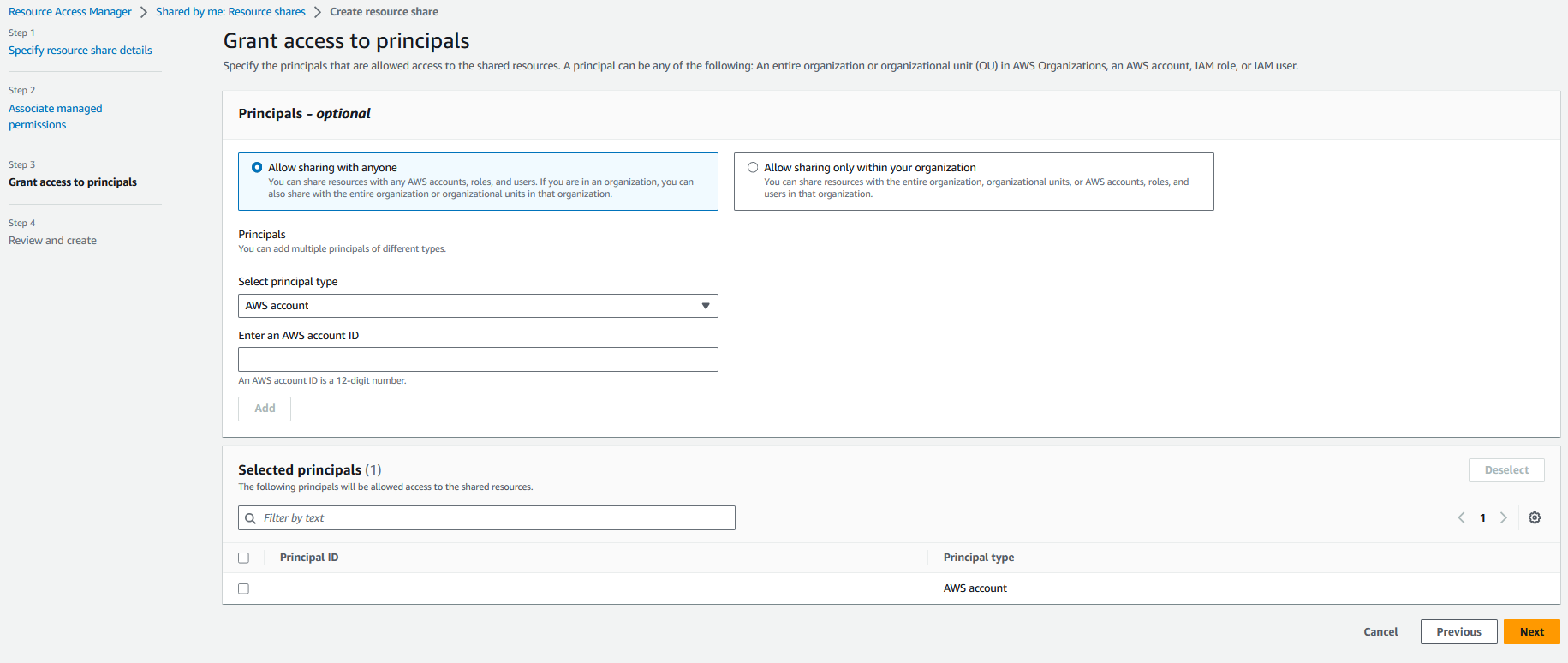

På neste side kan du velge Rektorer. Under Velg hovedtype velger du AWS-konto og skriv inn ID-en til kontoen til delingen av modellkortet. Plukke ut Legg til og fortsett til neste side.

Se gjennom informasjonen på den siste siden og velg "Opprett ressursdeling". Alternativt kan du bruke følgende AWS CLI kommando for å opprette en ressursdeling:

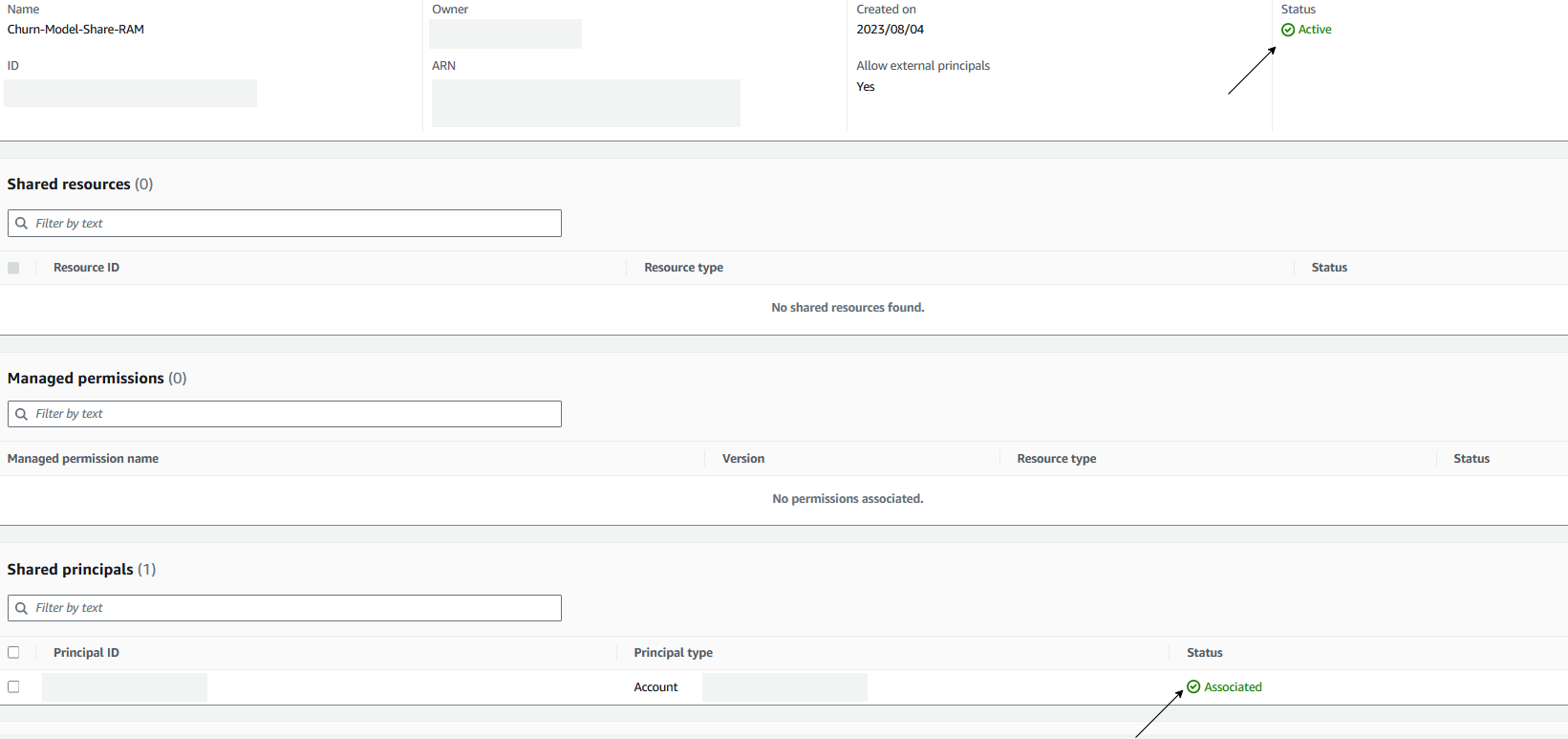

På AWS RAM-konsollen ser du attributtene til ressursandelen. Sørg for at delte ressurser, administrerte tillatelser og delte rektorer er i "AssociatedStatus.

Etter at du har brukt AWS RAM til å opprette en ressursressurs, kan prinsiplene som er spesifisert i ressursandelen gis tilgang til delingens ressurser.

- Hvis du slår på AWS RAM-deling med AWS-organisasjoner, og rektorene du deler med er i samme organisasjon som delingskontoen, kan disse rektorene få tilgang så snart kontoadministratoren deres gir dem tillatelser.

- Hvis du ikke slår på AWS RAM-deling med organisasjoner, kan du fortsatt dele ressurser med individuelle AWS-kontoer som er i organisasjonen din. Administratoren i forbrukskontoen mottar en invitasjon til å bli med i ressursdelingen, og de må godta invitasjonen før prinsipale som er spesifisert i ressursdelingen, kan få tilgang til de delte ressursene.

- Du kan også dele med kontoer utenfor organisasjonen din hvis ressurstypen støtter det. Administratoren i forbrukskontoen mottar en invitasjon til å bli med i ressursdelingen, og de må godta invitasjonen før prinsipale som er spesifisert i ressursdelingen, kan få tilgang til de delte ressursene.

For mer informasjon om AWS RAM, se Vilkår og konsepter for AWS RAM.

Tilgang til delte modellkort

Nå kan vi logge inn på den delte AWS-kontoen for å få tilgang til modellkortet. Sørg for at du får tilgang til AWS-konsollen ved å bruke IAM-tillatelser (IAM-rolle) som gir tilgang til AWS RAM.

Med AWS RAM kan du se ressursdelingene du har blitt lagt til, de delte ressursene du har tilgang til og AWS-kontoene som har delt ressurser med deg. Du kan også forlate en ressursdeling når du ikke lenger trenger tilgang til dens delte ressurser.

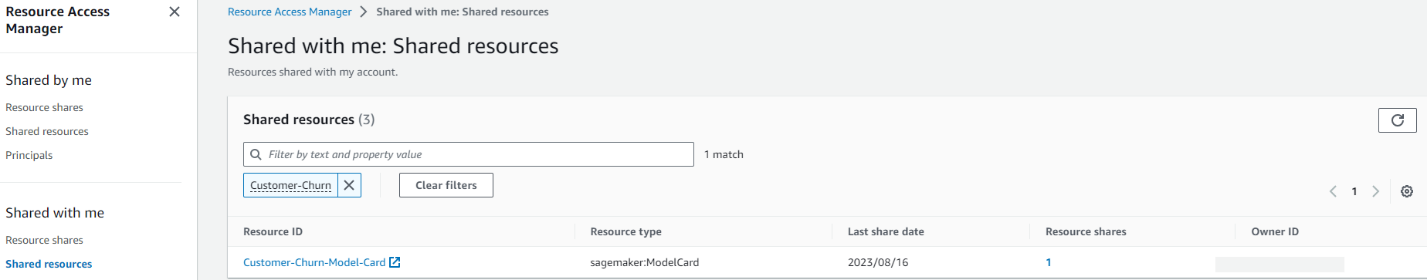

For å se modellkortet i den delte AWS-kontoen:

- Naviger til Delt med meg: Delte ressurser side i AWS RAM-konsollen.

- Sørg for at du opererer i samme AWS-region der delingen ble opprettet.

- Modellen som deles fra modellkontoen vil være tilgjengelig i oppføringen. Hvis det er en lang liste med ressurser, kan du bruke et filter for å finne spesifikke delte ressurser. Du kan bruke flere filtre for å begrense søket.

- Følgende informasjon er tilgjengelig:

- Ressurs-ID – IDen til ressursen. Dette er navnet på modellkortet som vi opprettet tidligere i modellkortkontoen.

- Ressurs type – Type ressurs.

- Siste delingsdato – Datoen da ressursen ble delt med deg.

- Ressursandeler – Antall ressursandeler som ressursen er inkludert i. Velg verdien for å se ressursandelene.

- Eier-ID – IDen til rektor som eier ressursen.

Du kan også få tilgang til modellkortet ved å bruke AWS CLI-alternativet. For AWS IAM-policyen konfigurert med riktig legitimasjon, sørg for at du har tillatelser til å opprette, redigere og slette modellkort i Amazon SageMaker. For mer informasjon, se Konfigurer AWS CLI.

Du kan bruke følgende AWS IAM-tillatelsespolicy som mal:

Du kan kjøre følgende AWS CLI-kommando for å få tilgang til detaljene for det delte modellkortet.

Nå kan du gjøre endringer på dette modellkortet fra denne kontoen.

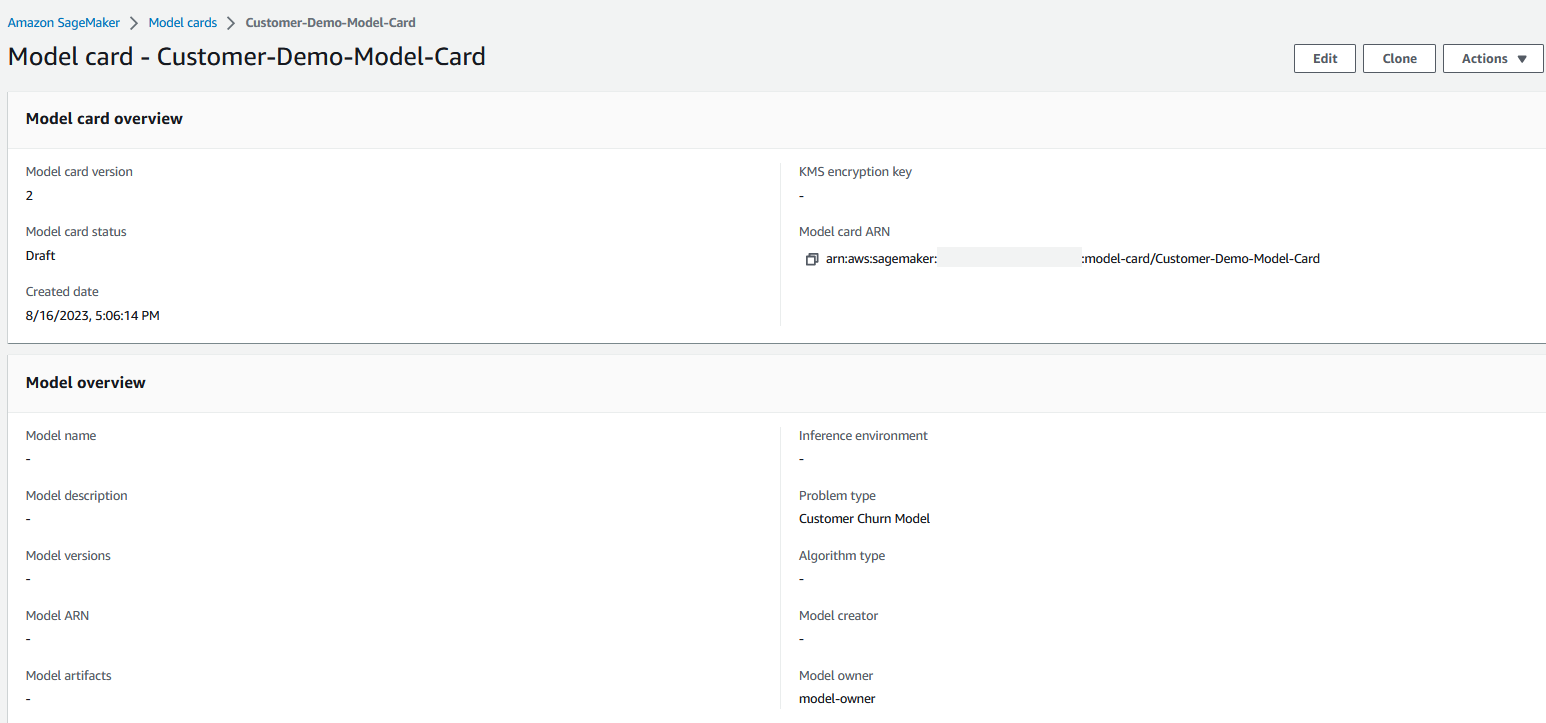

Etter at du har gjort endringer, går du tilbake til modellkortkontoen for å se endringene vi har gjort i denne delte kontoen.

Problemtypen har blitt oppdatert til "Customer Churn Model” som vi hadde gitt som en del av AWS CLI-kommandoinngangen.

Rydd opp

Du kan nå slette modellkortet du opprettet. Sørg for at du sletter AWS RAM-ressursdelingen som du opprettet for å dele modellkortet.

konklusjonen

I dette innlegget ga vi en oversikt over flerkontoarkitektur for å skalere og styre ML-arbeidsbelastningene dine sikkert og pålitelig. Vi diskuterte arkitekturmønstrene for å sette opp modellkortdeling og illustrerte hvordan sentraliserte modellkortdelingsmønstre fungerer. Til slutt setter vi opp modellkortdeling på tvers av flere kontoer for å forbedre synlighet og styring i din modellutviklingslivssyklus. Vi oppfordrer deg til å prøve den nye funksjonen for deling av modellkort og gi oss tilbakemelding.

Om forfatterne

Vishal Naik er senior løsningsarkitekt hos Amazon Web Services (AWS). Han er en byggmester som liker å hjelpe kunder med å oppfylle forretningsbehovene deres og løse komplekse utfordringer med AWS-løsninger og beste praksis. Hans kjernefokus inkluderer maskinlæring, DevOps og containere. På fritiden elsker Vishal å lage kortfilmer om tidsreiser og alternative universtemaer.

Vishal Naik er senior løsningsarkitekt hos Amazon Web Services (AWS). Han er en byggmester som liker å hjelpe kunder med å oppfylle forretningsbehovene deres og løse komplekse utfordringer med AWS-løsninger og beste praksis. Hans kjernefokus inkluderer maskinlæring, DevOps og containere. På fritiden elsker Vishal å lage kortfilmer om tidsreiser og alternative universtemaer.

Ram Vittal er en rektor ML Solutions Architect ved AWS. Han har over 20 års erfaring med å bygge og bygge distribuerte, hybride og skyapplikasjoner. Han brenner for å bygge sikre og skalerbare AI/ML- og big data-løsninger for å hjelpe bedriftskunder med deres skyadopsjon og optimaliseringsreise for å forbedre forretningsresultatene deres. På fritiden kjører han motorsykkel og går med sin 2 år gamle sheep-a-doodle!

Ram Vittal er en rektor ML Solutions Architect ved AWS. Han har over 20 års erfaring med å bygge og bygge distribuerte, hybride og skyapplikasjoner. Han brenner for å bygge sikre og skalerbare AI/ML- og big data-løsninger for å hjelpe bedriftskunder med deres skyadopsjon og optimaliseringsreise for å forbedre forretningsresultatene deres. På fritiden kjører han motorsykkel og går med sin 2 år gamle sheep-a-doodle!

- SEO-drevet innhold og PR-distribusjon. Bli forsterket i dag.

- PlatoData.Network Vertical Generative Ai. Styrk deg selv. Tilgang her.

- PlatoAiStream. Web3 Intelligence. Kunnskap forsterket. Tilgang her.

- PlatoESG. Bil / elbiler, Karbon, CleanTech, Energi, Miljø, Solenergi, Avfallshåndtering. Tilgang her.

- PlatoHelse. Bioteknologisk og klinisk etterretning. Tilgang her.

- ChartPrime. Hev handelsspillet ditt med ChartPrime. Tilgang her.

- BlockOffsets. Modernisering av eierskap for miljøkompensasjon. Tilgang her.

- kilde: https://aws.amazon.com/blogs/machine-learning/use-amazon-sagemaker-model-cards-sharing-to-improve-model-governance/

- : har

- :er

- :hvor

- $OPP

- 10

- 100

- 20

- 20 år

- 2022

- 361

- 7

- 700

- 9

- a

- Om oss

- akselerere

- Aksepterer

- adgang

- tilgjengelighet

- Tilgang

- utrette

- Logg inn

- kontoer

- oppnå

- tvers

- Handling

- Aktiviteter

- aktivitet

- legge til

- la til

- tillegg

- I tillegg

- adoptere

- Adopsjon

- Etter

- en gang til

- aggregat

- AI

- AI / ML

- tillate

- også

- Amazon

- Amazon SageMaker

- Amazon Web Services

- Amazon Web Services (AWS)

- an

- og

- En annen

- APIer

- vises

- søknader

- Påfør

- tilnærming

- tilnærminger

- arkitektur

- ER

- AREA

- kunstig

- kunstig intelligens

- Kunstig intelligens (AI)

- AS

- anta

- At

- attributter

- revisjon

- automatisere

- Automatisering

- tilgjengelig

- AWS

- AWS Identity and Access Management (IAM)

- AWS re: Oppfinne

- tilbake

- basert

- BE

- fordi

- bli

- bli

- vært

- før du

- Fordeler

- BEST

- beste praksis

- Stor

- Store data

- både

- bygge

- bygger

- Bygning

- bygger

- virksomhet

- Business Applications

- men

- by

- som heter

- CAN

- evner

- evne

- kort

- Kort

- saken

- saker

- sentrum

- sentral

- sentralisert

- utfordringer

- Endringer

- Velg

- Cloud

- skyadopsjon

- kode

- samarbeid

- komplekse

- samsvar

- komponent

- konsepter

- Gjennomføre

- Konfigurasjon

- konfigurert

- Konsoll

- forbrukes

- Containere

- fortsette

- kontinuerlig

- bidragene

- kontroll

- Kjerne

- korrigere

- dekker

- skape

- opprettet

- skaperverket

- Credentials

- kritisk

- skikk

- kunde

- Kunder

- dato

- datavitenskap

- dataforsker

- Dato

- avgjørelser

- dyp

- Misligholde

- levering

- avhengig

- utplassere

- utplasserings

- distribusjon

- beskrive

- beskrevet

- utforme

- detaljer

- dev

- Utvikling

- forskjell

- diskutert

- distribueres

- dykk

- do

- dokumentasjon

- ikke

- Utkast

- to

- under

- hver enkelt

- Tidligere

- effekt

- muliggjøre

- oppmuntre

- Endpoint

- ingeniør

- Ingeniører

- Forbedrer

- nyte

- sikre

- Enter

- Enterprise

- bedrifter

- miljøer

- evaluering

- eksempel

- Expand

- erfaring

- eksperimenter

- Faktisk

- Trekk

- Føderasjon

- tilbakemelding

- Felt

- filmer

- filtrere

- filtre

- Endelig

- Finn

- Først

- Fokus

- etter

- følger

- Til

- Fundament

- Rammeverk

- fra

- videre

- få

- få

- gir

- Go

- styresett

- styrende

- innvilget

- tilskudd

- HAD

- hardere

- Ha

- å ha

- he

- hjelpe

- hjelpe

- hjelper

- hans

- Hvordan

- Hvordan

- Men

- HTML

- HTTPS

- Hub

- Hybrid

- ID

- Identitet

- if

- illustrerer

- implementert

- viktig

- forbedre

- bedre

- in

- inkludert

- inkluderer

- inkludering

- individuelt

- informasjon

- inngang

- integrering

- Intelligens

- tiltenkt

- inn

- introdusert

- invitasjon

- involvert

- isolasjon

- IT

- DET ER

- bli medlem

- reise

- jpg

- nøkkel

- Vet

- Siste

- læring

- Permisjon

- Lovlig

- la

- Livssyklus

- i likhet med

- Liste

- oppføring

- logg

- Lang

- lenger

- elsker

- maskin

- maskinlæring

- laget

- Hoved

- Mainstream

- vedlikeholde

- gjøre

- Making

- fikk til

- ledelse

- leder

- administrerende

- mange

- merket

- me

- metadata

- ML

- MLOps

- Mote

- modell

- modeller

- mer

- motorsykkel

- multi

- flere

- må

- navn

- smal

- Trenger

- behov

- Ny

- neste

- Nei.

- nå

- Antall

- of

- on

- ONE

- bare

- drift

- operasjonell

- optimalisering

- Alternativ

- or

- organisasjon

- organisasjoner

- ut

- utfall

- produksjon

- utenfor

- enn

- oversikt

- egen

- eier

- side

- del

- lidenskapelig

- mønstre

- påvente

- tillatelser

- plato

- Platon Data Intelligence

- PlatonData

- Politikk

- politikk

- Post

- powered

- praksis

- praksis

- forutsetninger

- forrige

- tidligere

- Principal

- rektorer

- prinsipper

- privatliv

- Problem

- Prosesser

- prosessering

- Produksjon

- prosjekt

- prosjekter

- ordentlig

- gi

- forutsatt

- gir

- formål

- kvalitet

- RAM

- RE

- Skrivebeskyttet modus

- motta

- mottar

- anbefaler

- anbefales

- referere

- region

- Registrering

- registret

- pålitelighet

- rest

- Rapportering

- krever

- Krav

- ressurs

- Ressurser

- Resultater

- anmeldelse

- Anmeldelser

- Rolle

- Kjør

- rennende

- går

- sagemaker

- samme

- skalerbarhet

- skalerbar

- Skala

- skalering

- scenario

- Vitenskap

- Forsker

- forskere

- Søk

- Seksjon

- sikre

- sikkert

- sikkerhet

- se

- valgt

- tjeneste

- Tjenester

- sett

- innstilling

- oppsett

- Del

- delt

- Aksjer

- deling

- ark

- Kort

- Vis

- vist

- Viser

- siden

- enkelt

- So

- Solutions

- LØSE

- noen

- snart

- kilde

- spesifikk

- spesifisert

- interessenter

- standardisere

- Begynn

- startet

- starter

- Uttalelse

- status

- Trinn

- Steps

- Still

- Strategi

- effektivisere

- vellykket

- Støtte

- Støtter

- sikker

- bølge

- lag

- lag

- Teknisk

- Technologies

- mal

- test

- tester

- Det

- De

- informasjonen

- deres

- Dem

- temaer

- deretter

- Der.

- derved

- Disse

- de

- denne

- De

- Gjennom

- hele

- tid

- tidsreiser

- til

- verktøy

- Sporing

- Kurs

- Åpenhet

- reiser

- utløse

- Sannhet

- prøve

- SVING

- typen

- etter

- Universe

- oppdatert

- us

- bruk

- bruke

- bruk sak

- brukt

- Brukere

- ved hjelp av

- v1

- validering

- verdi

- versjon

- av

- Se

- vishal

- synlighet

- var

- we

- web

- webtjenester

- når

- hvilken

- mens

- HVEM

- vil

- med

- innenfor

- Arbeid

- år

- Du

- Din

- zephyrnet