Moderering av innhold spiller en sentral rolle for å opprettholde nettsikkerhet og opprettholde verdiene og standardene til nettsteder og sosiale medieplattformer. Dens betydning understrekes av beskyttelsen den gir brukere mot eksponering for upassende innhold, og sikrer deres velvære i digitale rom. For eksempel, i reklamebransjen tjener innholdsmoderering til å skjerme merkevarer fra ugunstige assosiasjoner, og dermed bidra til merkeheving og inntektsvekst. Annonsører prioriterer merkevarens tilpasning til passende innhold for å opprettholde sitt rykte og unngå negativ omtale. Innholdsmoderering har også avgjørende betydning i finans- og helsesektoren, der den tjener flere funksjoner. Den spiller en viktig rolle i å identifisere og beskytte sensitiv personlig identifiserbar og helseinformasjon (PII, PHI). Ved å følge interne standarder og praksis og overholde eksterne forskrifter, forbedrer innholdsmoderering digital sikkerhet for brukere. På denne måten forhindrer det utilsiktet deling av konfidensielle data på offentlige plattformer, og sikrer bevaring av brukernes personvern og datasikkerhet.

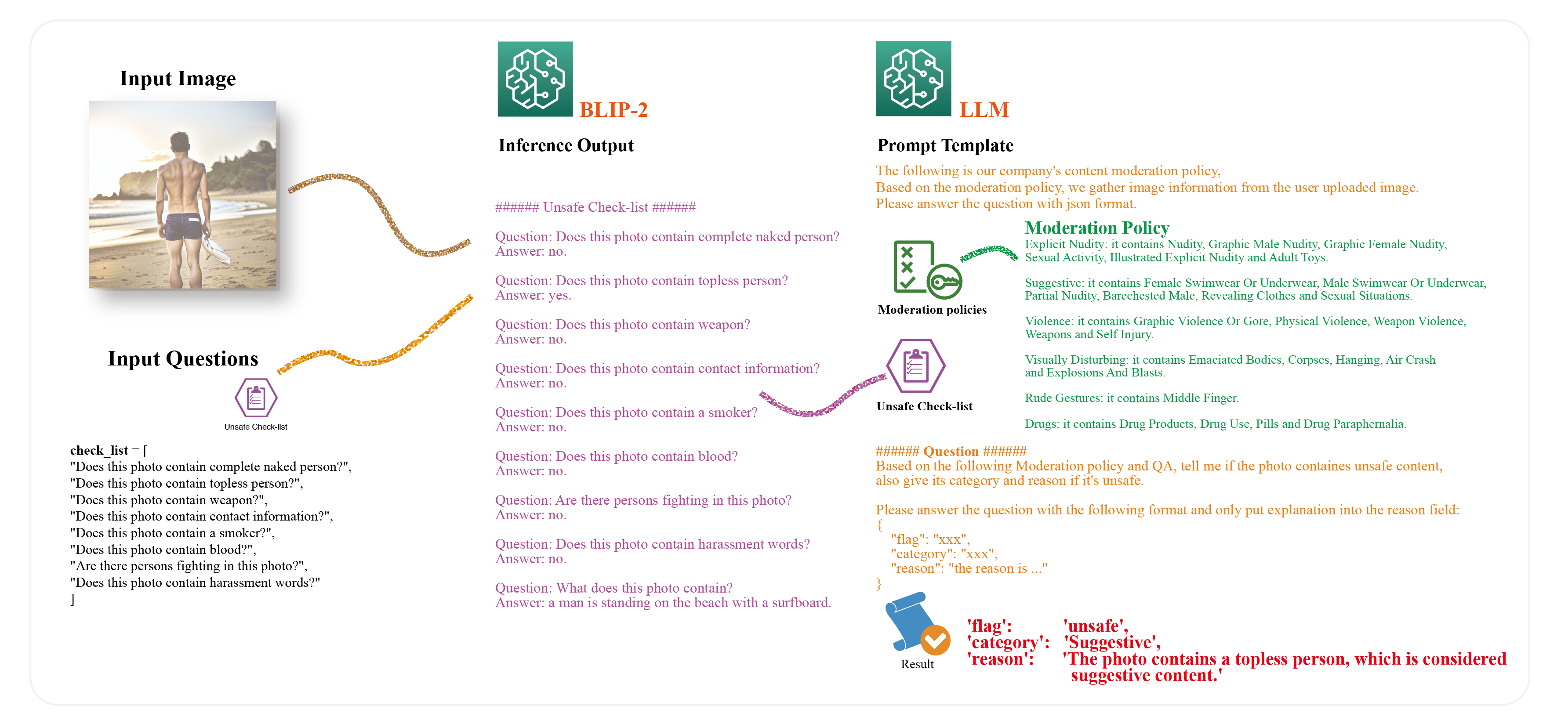

I dette innlegget introduserer vi en ny metode for å utføre innholdsmoderering på bildedata med multimodal foropplæring og en stor språkmodell (LLM). Med multimodal foropplæring kan vi direkte spørre bildeinnholdet basert på et sett med spørsmål av interesse, og modellen vil være i stand til å svare på disse spørsmålene. Dette gjør det mulig for brukere å chatte med bildet for å bekrefte om det inneholder noe upassende innhold som bryter med organisasjonens retningslinjer. Vi bruker den kraftige genereringsevnen til LLM-er for å generere den endelige beslutningen, inkludert sikre/usikre etiketter og kategoritype. I tillegg, ved å designe en ledetekst, kan vi få en LLM til å generere det definerte utdataformatet, for eksempel JSON-format. Den utformede ledetekstmalen lar LLM avgjøre om bildet bryter moderasjonspolicyen, identifisere kategorien for brudd, forklare hvorfor og gi utdata i et strukturert JSON-format.

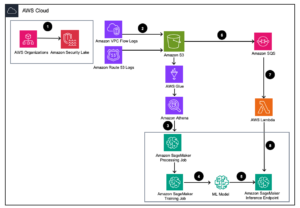

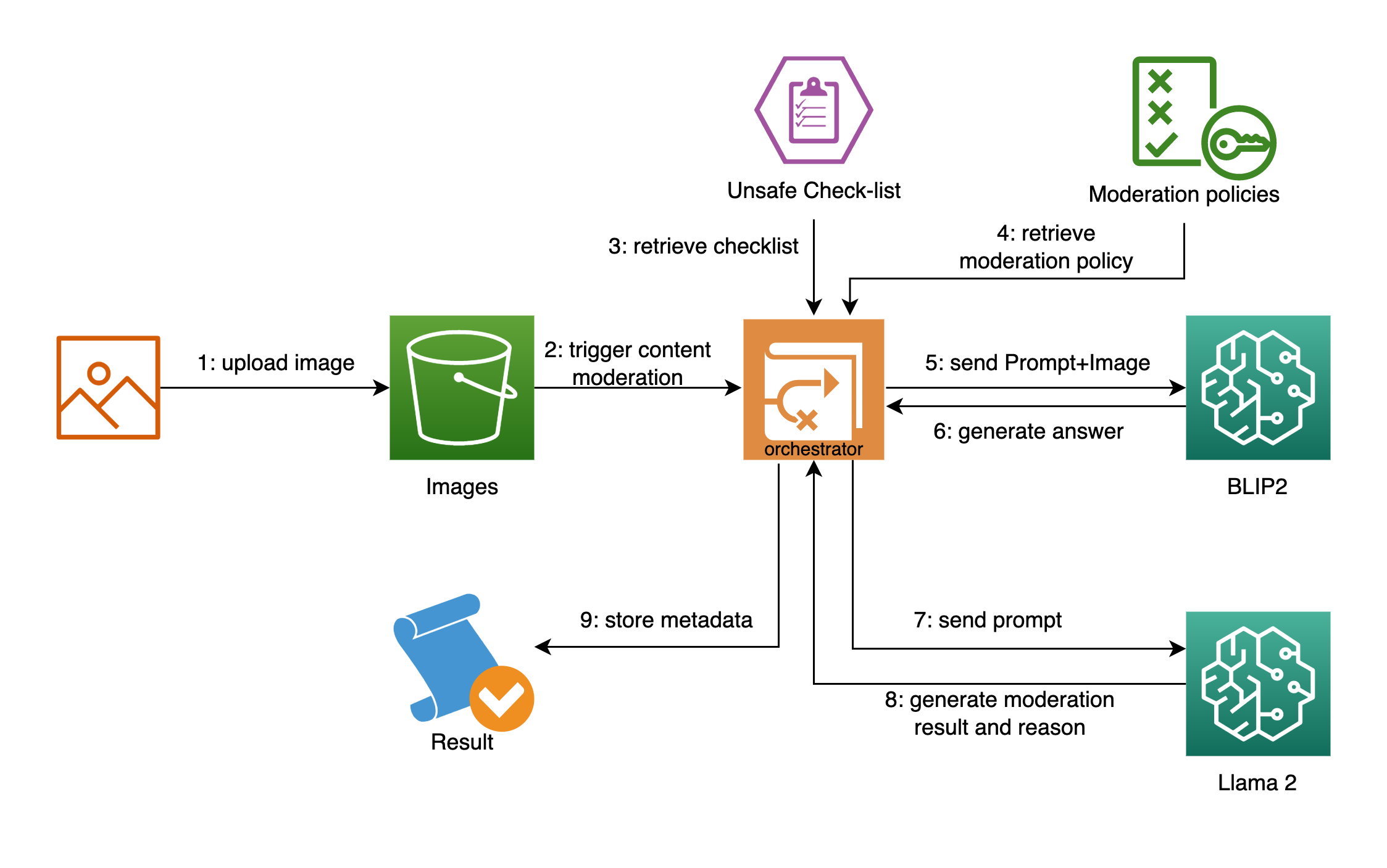

Vi bruker BLIP-2 som den multimodale førtreningsmetoden. BLIP-2 er en av de avanserte modellene innen multimodal fortrening og overgår de fleste eksisterende metodene innen visuell spørsmålssvar, bildeteksting og gjenfinning av bildetekst. For vår LLM bruker vi Lama 2, neste generasjons åpen kildekode LLM, som utkonkurrerer eksisterende språkmodeller med åpen kildekode på mange benchmarks, inkludert resonnement, koding, ferdigheter og kunnskapstester. Følgende diagram illustrerer løsningskomponentene.

Utfordringer i innholdsmoderering

Tradisjonelle modereringsmetoder for innhold, som menneskebasert moderering, kan ikke holde tritt med det økende volumet av brukergenerert innhold (UGC). Etter hvert som volumet av UGC øker, kan menneskelige moderatorer bli overveldet og slite med å moderere innhold effektivt. Dette resulterer i en dårlig brukeropplevelse, høye moderasjonskostnader og merkevarerisiko. Menneskebasert moderering er også utsatt for feil, noe som kan resultere i inkonsekvent moderering og partiske beslutninger. For å møte disse utfordringene har innholdsmoderering drevet av maskinlæring (ML) dukket opp som en løsning. ML-algoritmer kan analysere store mengder UGC og identifisere innhold som bryter organisasjonens retningslinjer. ML-modeller kan trenes til å gjenkjenne mønstre og identifisere problematisk innhold, som hatefulle ytringer, spam og upassende materiale. Ifølge studien Beskytt brukerne, merkevaren og budsjettet med AI-drevet innholdsmoderering, ML-drevet innholdsmoderering kan hjelpe organisasjoner med å gjenvinne opptil 95 % av tiden teamene deres bruker på å moderere innhold manuelt. Dette gjør at organisasjoner kan fokusere ressursene sine på mer strategiske oppgaver, for eksempel samfunnsbygging og innholdsskaping. ML-drevet innholdsmoderering kan også redusere modereringskostnadene fordi det er mer effektivt enn menneskebasert moderering.

Til tross for fordelene med ML-drevet innholdsmoderering, har den fortsatt plass til ytterligere forbedringer. Effektiviteten til ML-algoritmer er sterkt avhengig av kvaliteten på dataene de er trent på. Når modeller trenes opp ved hjelp av partiske eller ufullstendige data, kan de ta feilaktige modereringsbeslutninger, og utsette organisasjoner for merkevarerisiko og potensielle juridiske forpliktelser. Bruken av ML-baserte tilnærminger for innholdsmoderering gir flere utfordringer som krever nøye vurdering. Disse utfordringene inkluderer:

- Innhenting av merkede data – Dette kan være en kostbar prosess, spesielt for komplekse innholdsmodereringsoppgaver som krever opplæring av merker. Denne kostnaden kan gjøre det utfordrende å samle store nok datasett til å trene en overvåket ML-modell med letthet. I tillegg er nøyaktigheten til modellen sterkt avhengig av kvaliteten på opplæringsdataene, og partiske eller ufullstendige data kan føre til unøyaktige modereringsbeslutninger, noe som fører til merkevarerisiko og juridiske forpliktelser.

- Modellgeneralisering – Dette er avgjørende for å ta i bruk ML-baserte tilnærminger. En modell trent på ett datasett kan ikke generalisere godt til et annet datasett, spesielt hvis datasettene har forskjellige distribusjoner. Derfor er det viktig å sikre at modellen er trent på et mangfoldig og representativt datasett for å sikre at den generaliserer godt til nye data.

- Operasjonell effektivitet – Dette er en annen utfordring når du bruker konvensjonelle ML-baserte tilnærminger for innholdsmoderering. Det kan være tidkrevende og kostbart å hele tiden legge til nye etiketter og omskolere modellen når nye klasser legges til. I tillegg er det viktig å sørge for at modellen oppdateres jevnlig for å holde tritt med endringer i innholdet som modereres.

- Forklarbarhet – Sluttbrukere kan oppfatte plattformen som partisk eller urettferdig hvis innhold blir flagget eller fjernet uten begrunnelse, noe som resulterer i en dårlig brukeropplevelse. På samme måte kan fraværet av klare forklaringer gjøre innholdsmodereringsprosessen ineffektiv, tidkrevende og kostbar for moderatorer.

- Motstridende natur – Den motstridende naturen til bildebasert innholdsmoderering utgjør en unik utfordring for konvensjonelle ML-baserte tilnærminger. Dårlige skuespillere kan forsøke å unngå innholdsmodereringsmekanismer ved å endre innholdet på forskjellige måter, for eksempel ved å bruke synonymer til bilder eller legge inn det faktiske innholdet i en større mengde ikke-fornærmende innhold. Dette krever konstant overvåking og oppdatering av modellen for å oppdage og svare på slike motstridende taktikker.

Multimodalt resonnement med BLIP-2

Multimodalitet ML-modeller refererer til modeller som kan håndtere og integrere data fra flere kilder eller modaliteter, for eksempel bilder, tekst, lyd, video og andre former for strukturerte eller ustrukturerte data. En av de populære multimodalitetsmodellene er de visuelle språkmodellene som BLIP-2, som kombinerer datasyn og naturlig språkbehandling (NLP) for å forstå og generere både visuell og tekstlig informasjon. Disse modellene gjør det mulig for datamaskiner å tolke betydningen av bilder og tekst på en måte som etterligner menneskelig forståelse. Visjonsspråklige modeller kan takle en rekke oppgaver, inkludert bildeteksting, gjenfinning av bildetekst, visuelt svar på spørsmål og mer. For eksempel kan en bildetekstmodell generere en naturlig språkbeskrivelse av et bilde, og en bildetekstinnhentingsmodell kan søke etter bilder basert på en tekstspørring. Visuelle spørsmålssvarsmodeller kan svare på naturlig språkspørsmål om bilder, og multimodale chatbots kan bruke visuelle og tekstlige input for å generere svar. Når det gjelder innholdsmoderering, kan du bruke denne muligheten til å spørre mot en liste med spørsmål.

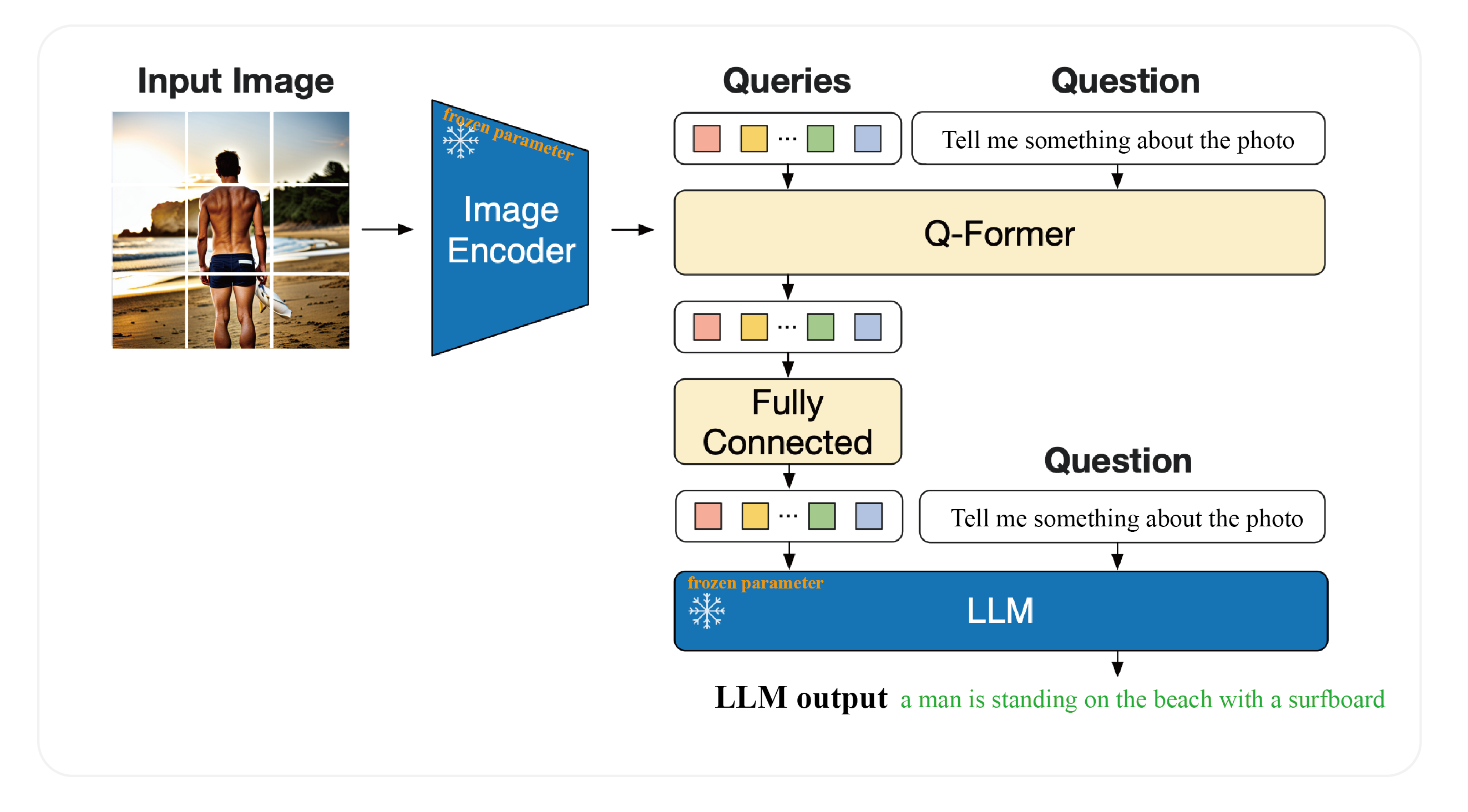

BLIP-2 inneholder tre deler. Den første komponenten er en frossen bildekoder, ViT-L/14 fra CLIP, som tar bildedata som input. Den andre komponenten er en frossen LLM, FlanT5, som sender ut tekst. Den tredje komponenten er en trenerbar modul kalt Q-Former, en lett transformator som kobler den frosne bildekoderen med den frosne LLM. Q-Former bruker lærbare spørringsvektorer for å trekke ut visuelle funksjoner fra den frosne bildekoderen og mater den mest nyttige visuelle funksjonen til LLM for å sende ut ønsket tekst.

Foropplæringsprosessen omfatter to stadier. I det første trinnet utføres visjon-språkrepresentasjonslæring for å lære Q-Former å lære den mest relevante visuelle representasjonen for teksten. I det andre trinnet utføres visjon-til-språk generativ læring ved å koble utgangen fra Q-Former til en frossen LLM og trene Q-Former til å gi ut visuelle representasjoner som kan tolkes av LLM.

BLIP-2 oppnår state-of-the-art ytelse på ulike synsspråkoppgaver til tross for at den har betydelig færre trenbare parametere enn eksisterende metoder. Modellen demonstrerer også nye evner for nullbilde-til-tekst-generering som kan følge naturlige språkinstruksjoner. Følgende illustrasjon er modifisert fra original forskningsoppgave.

Løsningsoversikt

Følgende diagram illustrerer løsningsarkitekturen.

I de følgende avsnittene viser vi hvordan du distribuerer BLIP-2 til en Amazon SageMaker endepunkt, og bruk BLIP-2 og en LLM for innholdsmoderering.

Forutsetninger

Du trenger en AWS-konto med en AWS identitets- og tilgangsadministrasjon (IAM) rolle med tillatelser til å administrere ressurser opprettet som en del av løsningen. For detaljer, se Opprett en frittstående AWS-konto.

Hvis dette er første gang du jobber med Amazon SageMaker Studio, må du først opprette en SageMaker-domene. I tillegg kan det hende du må be om en tjenestekvoteøkning for de tilsvarende SageMaker-vertsinstansene. For BLIP-2-modellen bruker vi en ml.g5.2xlarge SageMaker vertsinstans. For Llama 2 13B-modellen bruker vi en ml.g5.12xlarge SageMaker vertsinstans.

Distribuer BLIP-2 til et SageMaker-endepunkt

Du kan være vert for en LLM på SageMaker ved å bruke Stor modellslutning (LMI) beholder som er optimalisert for hosting av store modeller ved hjelp av DJLServing. DJLServing er en høyytelses universell modellserveringsløsning drevet av Deep Java Library (DJL) som er programmeringsspråkagnostisk. For å lære mer om DJL og DJLServing, se Distribuer store modeller på Amazon SageMaker ved å bruke DJLServing og DeepSpeed modell parallell inferens. Ved hjelp av SageMaker LMI-beholderen kan BLIP-2-modellen enkelt implementeres med Hugging Face-biblioteket og hostes på SageMaker. Du kan løpe blip2-sagemaker.ipynb for dette trinnet.

For å klargjøre Docker-bildet og modellfilen, må du hente Docker-bildet til DJLServing, pakke inferensskriptet og konfigurasjonsfilene som en model.tar.gz fil, og last den opp til en Amazon enkel lagringstjeneste (Amazon S3) bøtte. Du kan referere til slutningsskript og konfigurasjonsfil for mer informasjon.

inference_image_uri = image_uris.retrieve( framework="djl-deepspeed", region=sess.boto_session.region_name, version="0.22.1"

)

! tar czvf model.tar.gz blip2/

s3_code_artifact = sess.upload_data("model.tar.gz", bucket, s3_code_prefix)Når Docker-bildet og inferensrelaterte filer er klare, lager du modellen, konfigurasjonen for endepunktet og endepunktet:

from sagemaker.utils import name_from_base

blip_model_version = "blip2-flan-t5-xl"

model_name = name_from_base(blip_model_version)

model = Model( image_uri=inference_image_uri, model_data=s3_code_artifact, role=role, name=model_name,

)

model.deploy( initial_instance_count=1, instance_type="ml.g5.2xlarge", endpoint_name=model_name

)Når endepunktstatusen blir i bruk, kan du påkalle endepunktet for bildeteksting og den instruerte nullskuddssyn-til-språkgenereringsoppgaven. For bildetekstoppgaven trenger du bare å sende et bilde til endepunktet:

import base64

import json

from PIL import Image smr_client = boto3.client("sagemaker-runtime") def encode_image(img_file): with open(img_file, "rb") as image_file: img_str = base64.b64encode(image_file.read()) base64_string = img_str.decode("latin1") return base64_string def run_inference(endpoint_name, inputs): response = smr_client.invoke_endpoint( EndpointName=endpoint_name, Body=json.dumps(inputs) ) print(response["Body"].read()) test_image = "carcrash-ai.jpeg"

base64_string = encode_image(test_image)

inputs = {"image": base64_string}

run_inference(endpoint_name, inputs)For den instruerte nullskuddsvisjon-til-språkgenereringsoppgaven, i tillegg til inndatabildet, må du definere spørsmålet som en ledetekst:

base64_string = encode_image(test_image)

inputs = {"prompt": "Question: what happened in this photo? Answer:", "image": base64_string}

run_inference(endpoint_name, inputs)Bruk BLIP-2 og LLM for innholdsmoderering

På dette stadiet kan du stille spørsmål på det gitte bildet og hente skjult informasjon. Med LLM organiserer du spørringene og henter informasjon for å generere JSON-formatresultatet. Du kan grovt dele denne oppgaven inn i følgende to underoppgaver:

- Trekk ut informasjon fra bildet med BLIP-2-modellen.

- Generer det endelige resultatet og forklaringen med LLM.

Trekk ut informasjon fra bildet med BLIP-2-modellen

For å hente nok nyttig skjult informasjon fra det gitte bildet, må du definere spørringer. Fordi hver spørring vil påkalle endepunktet én gang, vil mange spørringer føre til lengre behandlingstid. Derfor foreslår vi at du gjør forespørsler av høy kvalitet og dekker alle policyer, men også uten dupliserte. I eksempelkoden vår definerer vi spørringene som følger:

check_list = [ "Does this photo contain complete naked person?", "Does this photo contain topless person?", "Does this photo contain weapon?", "Does this photo contain contact information?", "Does this photo contain a smoker?", "Does this photo contain blood?", "Are there persons fighting in this photo?", "Does this photo contain harassment words?"

]Med de foregående spørringene, påkall endepunktet til BLIP-2 for å hente informasjonen med følgende kode:

test_image = "./surf_swimwear.png"

raw_image = Image.open(test_image).convert('RGB') base64_string = encode_image(test_image)

conversations = """"""

for question in check_list: inputs = {"prompt": f"Question: {question}? Answer:", "image": base64_string} response = run_inference(endpoint_name, inputs) conversations += f"""

Question: {question}

Answer: {response}. """I tillegg til informasjonen som hentes av spørringer, kan du få informasjon med bildetekstoppgaven ved å påkalle endepunktet uten prompt felt i nyttelasten:

inputs = {"image": base64_string}

response = smr_client.invoke_endpoint(

EndpointName=endpoint_name, Body=json.dumps(inputs)

)

image_caption = response["Body"].read().decode('utf-8')Du kan kombinere innholdet i spørsmål og svar med bildeteksten og bruke denne hentede informasjonen til nedstrømsoppgaven, beskrevet i neste avsnitt nedenfor.

Generer det endelige resultatet og forklaringen med LLM

Store språkmodeller (LLM-er) som Llama 2 kan generere resultater av høy kvalitet med riktig forespørselsmal. Ved hjelp av Amazon SageMaker JumpStart, ML-utøvere kan velge fra et bredt utvalg av offentlig tilgjengelige stiftelsesmodeller. Med bare noen få klikk i SageMaker Studio kan du nå oppdage og distribuer Llama 2.

De endelige resultatene er avhengige av en LLM med en spesifikk ledetekstmal. Slik oppfordring består av: moderasjonspolitikken basert på kategorier av upassende eller støtende moderasjonskategorier; bildeinformasjon hentet fra BLIP-2; spørsmålsmalen til LLM som spør om bildet inneholder usikkert innhold og ber om kategori og årsak hvis det er usikkert; og instruksjoner for å sende ut resultatene i JSON-format. Den utformede ledetekstmalen lar LLM avgjøre om bildet bryter retningslinjene for moderering, identifisere kategorien for brudd, forklare hvorfor og gi utdata i et strukturert JSON-format.

Kjernekildekoden er som følger:

prompt_template = f"""

The following is our company's content moderation policy, based on the moderation policy, we gather image information from the user uploaded image. Please answer the question with json format. ###### moderation policy ######

{moderation_policy} ###### Image information ######

{conversations} ###### Question ######

Based on the following Moderation policy and QA, tell me if the photo containes unsafe content, also give its category and reason if it's unsafe. Please anwser the question with the following format and only put explanation into the reason field: """ prompt_template += """

{ "flag": "xxx", "category": "xxx", "reason": "the reason is ..."

} """ dialog = [ {"role": "user", "content": prompt_template}

]Du kan tilpasse forespørselen basert på din egen brukssituasjon. Referere til bærbare for flere detaljer. Når ledeteksten er klar, kan du påkalle LLM-endepunktet for å generere resultater:

endpoint_name = "jumpstart-dft-meta-textgeneration-llama-2-70b-f" def query_endpoint(payload): client = boto3.client("sagemaker-runtime") response = client.invoke_endpoint( EndpointName=endpoint_name, ContentType="application/json", Body=json.dumps(payload), CustomAttributes="accept_eula=true", ) response = response["Body"].read().decode("utf8") response = json.loads(response) return response payload = { "inputs": [dialog], "parameters": {"max_new_tokens": 256, "top_p": 0.9, "temperature": 0.5}

}

result = query_endpoint(payload)[0]En del av den genererte utgangen er som følger:

Av og til legger Llama 2 ved ytterligere forklaring i tillegg til svaret fra assistenten. Du kan bruke parsingskoden til å trekke ut JSON-data fra de opprinnelige genererte resultatene:

answer = result['generation']['content'].split('}')[0]+'}'

json.loads(answer)

Fordeler med generative tilnærminger

De foregående avsnittene viste hvordan man implementerer kjernedelen av modellslutning. I denne delen dekker vi ulike aspekter ved generative tilnærminger, inkludert sammenligninger med konvensjonelle tilnærminger og perspektiver.

Tabellen nedenfor sammenligner hver tilnærming.

| . | Generativ tilnærming | Klassifiseringsmetode |

| Innhenting av merkede data | Fortrent modell på et stort antall bilder, nullskuddsslutning | Krever data fra alle typer kategorier |

| Modellgeneralisering | Fortrent modell med ulike typer bilder | Krever et stort volum av innholdsmodereringsrelaterte data for å forbedre modellgeneralisering |

| Operasjonell effektivitet | Nullskuddsfunksjoner | Krever opplæring av modellen for å gjenkjenne ulike mønstre, og omskolering når etiketter legges til |

| Forklarbarhet | Resonnement som tekstutdata, god brukeropplevelse | Vanskelig å oppnå resonnement, vanskelig å forklare og tolke |

| Motstridende natur | Robust | Høyfrekvent omskolering |

Potensielle brukstilfeller av multimodal resonnement utover innholdsmoderering

BLIP-2-modellene kan brukes for å passe til flere formål med eller uten finjustering, som inkluderer følgende:

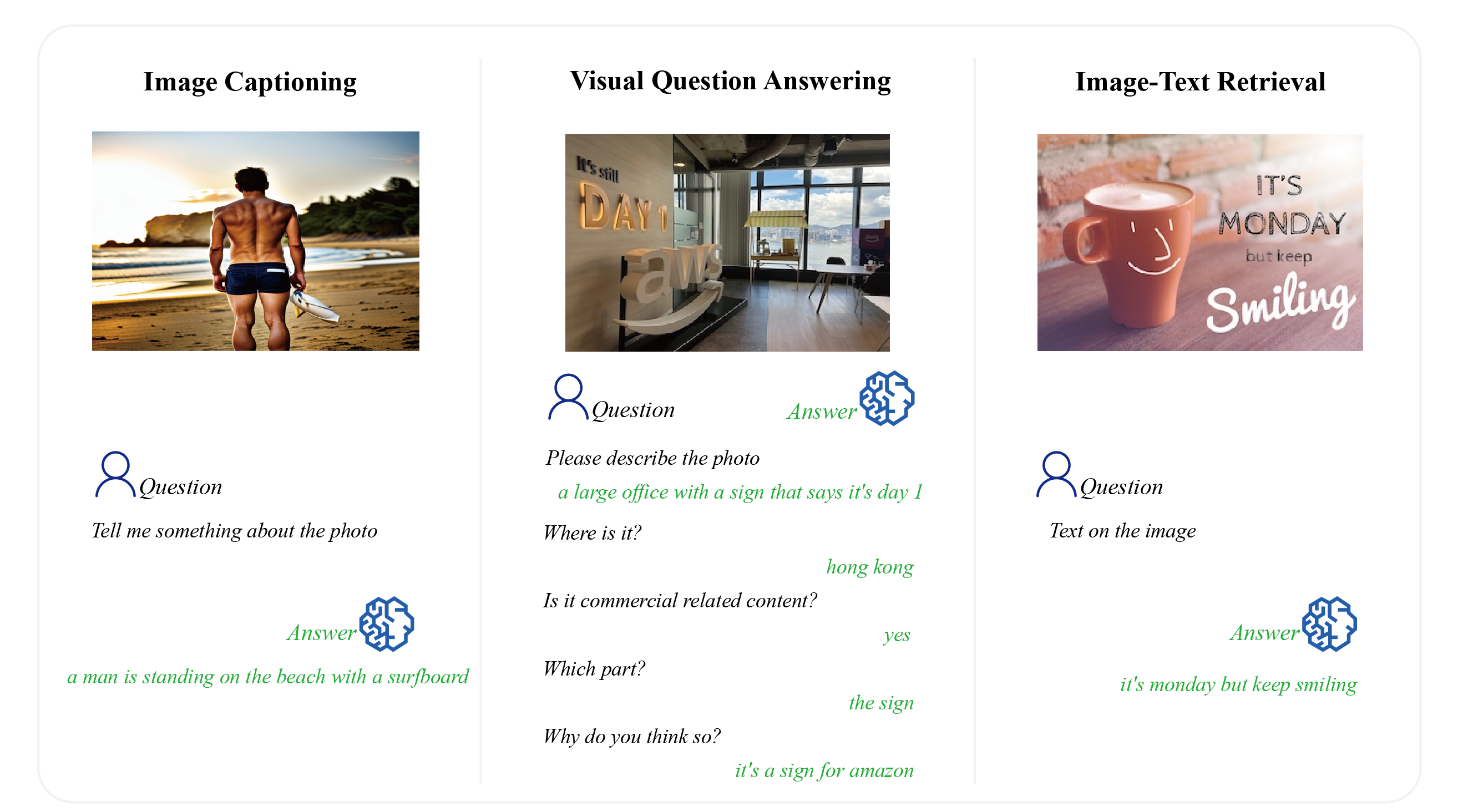

- Bildeteksting – Dette ber modellen om å generere en tekstbeskrivelse for bildets visuelle innhold. Som illustrert i følgende eksempelbilde (til venstre), kan vi ha "en mann står på stranden med et surfebrett" som bildebeskrivelsen.

- Visuelt svar på spørsmål – Som eksempelbildet i midten viser, kan vi spørre "Er det kommersielt relatert innhold" og vi har "ja" som svaret. I tillegg støtter BLIP-2 flerrundssamtalen og sender ut følgende spørsmål: "Hvorfor tror du det?" Basert på den visuelle signalen og LLM-funksjonene, BLIP-2-utganger "det er et tegn for Amazon."

- Henting av bildetekst – Gitt spørsmålet som "Tekst på bildet", kan vi trekke ut bildeteksten “det er mandag, men fortsett å smile” som vist på bildet til høyre.

De følgende bildene viser eksempler for å demonstrere nullbilde-til-tekst-evnen til visuell kunnskapsresonnement.

Som vi kan se fra ulike eksempler ovenfor, åpner multimodalitetsmodeller for nye muligheter for å løse komplekse problemer som tradisjonelle enkeltmodalitetsmodeller vil slite med å løse.

Rydd opp

For å unngå fremtidige kostnader, slett ressursene som er opprettet som en del av dette innlegget. Du kan gjøre dette ved å følge instruksjonene i delen for opprydding av bærbar PC, eller slette de opprettede endepunktene via SageMaker-konsollen og ressursene som er lagret i S3-bøtten.

konklusjonen

I dette innlegget diskuterte vi viktigheten av innholdsmoderering i den digitale verden og fremhevet utfordringene. Vi foreslo en ny metode for å bidra til å forbedre innholdsmoderering med bildedata og utføre spørsmålssvar mot bildene for automatisk å trekke ut nyttig informasjon. Vi ga også videre diskusjon om fordelene ved å bruke en generativ AI-basert tilnærming sammenlignet med den tradisjonelle klassifiseringsbaserte tilnærmingen. Til slutt illustrerte vi potensielle brukstilfeller av visuelle språkmodeller utover innholdsmoderering.

Vi oppfordrer deg til å lære mer ved å utforske SageMaker og bygge en løsning ved å bruke multimodalitetsløsningen gitt i dette innlegget og et datasett som er relevant for virksomheten din.

Om forfatterne

Gordon Wang er en senior AI/ML-spesialist TAM ved AWS. Han støtter strategiske kunder med AI/ML beste praksis på tvers av mange bransjer. Han er lidenskapelig opptatt av datasyn, NLP, generativ AI og MLOps. På fritiden elsker han løping og fotturer.

Gordon Wang er en senior AI/ML-spesialist TAM ved AWS. Han støtter strategiske kunder med AI/ML beste praksis på tvers av mange bransjer. Han er lidenskapelig opptatt av datasyn, NLP, generativ AI og MLOps. På fritiden elsker han løping og fotturer.

Yanwei Cui, PhD, er Senior Machine Learning Specialist Solutions Architect ved AWS. Han startet forskning på maskinlæring ved IRISA (Research Institute of Computer Science and Random Systems), og har flere års erfaring med å bygge AI-drevne industrielle applikasjoner innen datasyn, naturlig språkbehandling og online brukeratferdsprediksjon. Hos AWS deler han domeneekspertisen sin og hjelper kunder med å låse opp forretningspotensialer og oppnå handlingsrettede resultater med maskinlæring i stor skala. Utenom jobben liker han å lese og reise.

Yanwei Cui, PhD, er Senior Machine Learning Specialist Solutions Architect ved AWS. Han startet forskning på maskinlæring ved IRISA (Research Institute of Computer Science and Random Systems), og har flere års erfaring med å bygge AI-drevne industrielle applikasjoner innen datasyn, naturlig språkbehandling og online brukeratferdsprediksjon. Hos AWS deler han domeneekspertisen sin og hjelper kunder med å låse opp forretningspotensialer og oppnå handlingsrettede resultater med maskinlæring i stor skala. Utenom jobben liker han å lese og reise.

Melanie Li, PhD, er en senior AI/ML-spesialist TAM ved AWS med base i Sydney, Australia. Hun hjelper bedriftskunder med å bygge løsninger ved hjelp av toppmoderne AI/ML-verktøy på AWS og gir veiledning om arkitektur og implementering av ML-løsninger med beste praksis. På fritiden elsker hun å utforske naturen og tilbringe tid med familie og venner.

Melanie Li, PhD, er en senior AI/ML-spesialist TAM ved AWS med base i Sydney, Australia. Hun hjelper bedriftskunder med å bygge løsninger ved hjelp av toppmoderne AI/ML-verktøy på AWS og gir veiledning om arkitektur og implementering av ML-løsninger med beste praksis. På fritiden elsker hun å utforske naturen og tilbringe tid med familie og venner.

- SEO-drevet innhold og PR-distribusjon. Bli forsterket i dag.

- PlatoData.Network Vertical Generative Ai. Styrk deg selv. Tilgang her.

- PlatoAiStream. Web3 Intelligence. Kunnskap forsterket. Tilgang her.

- PlatoESG. Bil / elbiler, Karbon, CleanTech, Energi, Miljø, Solenergi, Avfallshåndtering. Tilgang her.

- PlatoHelse. Bioteknologisk og klinisk etterretning. Tilgang her.

- ChartPrime. Hev handelsspillet ditt med ChartPrime. Tilgang her.

- BlockOffsets. Modernisering av eierskap for miljøkompensasjon. Tilgang her.

- kilde: https://aws.amazon.com/blogs/machine-learning/build-a-generative-ai-based-content-moderation-solution-on-amazon-sagemaker-jumpstart/

- : har

- :er

- :ikke

- :hvor

- $OPP

- 1

- 10

- 100

- 20

- 22

- 7

- 9

- 95%

- a

- I stand

- Om oss

- ovenfor

- adgang

- Ifølge

- Logg inn

- nøyaktighet

- Oppnå

- oppnår

- aktører

- faktiske

- la til

- legge

- tillegg

- Ytterligere

- I tillegg

- adresse

- fester seg

- vedta

- Adopsjon

- fordeler

- motstandere

- annonsører

- Annonsering

- mot

- AI

- AI-drevet

- AI / ML

- algoritmer

- innretting

- Alle

- tillater

- også

- Amazon

- Amazon SageMaker

- Amazon SageMaker JumpStart

- Amazon Web Services

- an

- analysere

- og

- En annen

- besvare

- svar

- noen

- søknader

- anvendt

- tilnærming

- tilnærminger

- hensiktsmessig

- arkitektur

- ER

- AS

- spør

- aspekter

- Assistent

- foreninger

- antar

- At

- lyd

- Australia

- automatisk

- tilgjengelig

- unngå

- AWS

- dårlig

- basert

- BE

- Strand

- fordi

- bli

- blir

- atferd

- være

- under

- benchmarks

- foruten

- BEST

- beste praksis

- Beyond

- forutinntatt

- blod

- kroppen

- både

- merke

- merker

- Bringer

- bred

- budsjett

- bygge

- Bygning

- virksomhet

- men

- by

- som heter

- CAN

- Kan få

- evner

- evne

- forsiktig

- saken

- saker

- kategorier

- Kategori

- utfordre

- utfordringer

- utfordrende

- Endringer

- avgifter

- chatbots

- Velg

- klasser

- fjerne

- kunde

- klær

- kode

- Koding

- kombinere

- skurtreskerne

- kommersiell

- samfunnet

- samfunnsbygging

- Selskapet

- sammenlignet

- fullføre

- komplekse

- komponent

- komponenter

- datamaskin

- informatikk

- Datamaskin syn

- datamaskiner

- Konfigurasjon

- Bekrefte

- Tilkobling

- forbinder

- hensyn

- ansett

- består

- Konsoll

- konstant

- stadig

- kontakt

- inneholde

- Container

- inneholder

- innhold

- innholdsskaping

- innhold

- medvirkende

- konvensjonell

- Samtale

- samtaler

- Kjerne

- Tilsvarende

- Kostnad

- kostbar

- Kostnader

- kunne

- dekke

- skape

- opprettet

- skaperverket

- kritisk

- Kryss

- Kunder

- tilpasse

- dato

- datasikkerhet

- datasett

- avgjørelse

- avgjørelser

- dyp

- definere

- definert

- demonstrere

- demonstrert

- demonstrerer

- utplassere

- beskrevet

- beskrivelse

- designet

- utforme

- ønsket

- Til tross for

- detaljer

- oppdage

- Bestem

- Dialog

- forskjellig

- digitalt

- digital verden

- direkte

- diskutert

- diskusjon

- Distribusjoner

- diverse

- do

- Docker

- gjør

- domene

- stasjonen

- hver enkelt

- lette

- lett

- effektivt

- effektivitet

- effektiv

- embedding

- dukket

- Emery

- anvender

- muliggjøre

- muliggjør

- oppmuntre

- slutt

- Endpoint

- Forbedrer

- nok

- sikre

- sikrer

- Enterprise

- feil

- spesielt

- avgjørende

- eksempel

- eksempler

- eksisterende

- erfaring

- ekspertise

- Forklar

- forklaring

- utforske

- Utforske

- Eksponering

- utvendig

- trekke ut

- Face

- Falls

- familie

- Trekk

- Egenskaper

- hunn

- Noen få

- færre

- felt

- slåss

- filet

- Filer

- slutt~~POS=TRUNC

- finansiere

- Først

- første gang

- passer

- flaggede

- Fokus

- følge

- etter

- følger

- Til

- format

- skjemaer

- Fundament

- Frekvens

- venner

- fra

- frossen

- funksjoner

- videre

- framtid

- samle

- generere

- generert

- genererer

- generasjonen

- generative

- Generativ AI

- få

- Gi

- gitt

- flott

- Økende

- Vekst

- veiledning

- håndtere

- skjedde

- Hard

- Ha

- å ha

- he

- Helse

- helseinformasjon

- helsetjenester

- tungt

- hjelpe

- hjelper

- her

- skjult

- Høy

- høy ytelse

- høykvalitets

- Fremhevet

- hans

- vert

- vert

- Hosting

- Hvordan

- Hvordan

- HTML

- http

- HTTPS

- menneskelig

- identifisere

- identifisering

- Identitet

- if

- illustrerer

- bilde

- bilder

- iverksette

- implementert

- implementere

- importere

- betydning

- viktig

- forbedre

- forbedring

- in

- unøyaktig

- inkludere

- inkluderer

- Inkludert

- Øke

- øker

- industriell

- bransjer

- industri

- ineffektiv

- informasjon

- inngang

- innganger

- f.eks

- Institute

- instruksjoner

- integrere

- interesse

- intern

- inn

- introdusere

- IT

- DET ER

- Java

- jpg

- JSON

- bare

- Hold

- kunnskap

- etiketter

- Språk

- stor

- større

- føre

- ledende

- LÆRE

- læring

- venstre

- Lovlig

- gjeld

- Bibliotek

- lettvekt

- Liste

- Llama

- LLM

- lenger

- elsker

- maskin

- maskinlæring

- Vedlike

- gjøre

- Making

- mann

- administrer

- manuelt

- mange

- materiale

- Kan..

- me

- betyr

- mekanismer

- Media

- Meta

- metode

- metoder

- Middle

- ML

- MLOps

- modell

- modeller

- moderasjon

- modifisert

- Moduler

- mandag

- overvåking

- mer

- mer effektivt

- mest

- flere

- Naturlig

- Natural Language Processing

- Natur

- Trenger

- negativ

- Ny

- neste

- nlp

- bærbare

- roman

- nå

- Antall

- of

- støtende

- on

- gang

- ONE

- på nett

- bare

- åpen

- åpen kildekode

- Muligheter

- optimalisert

- or

- organisasjoner

- original

- Annen

- vår

- Vårt selskap

- utfall

- utkonkurrerer

- produksjon

- utenfor

- overveldet

- egen

- pakke

- Parallel

- parametere

- del

- spesielt

- deler

- passere

- lidenskapelig

- mønstre

- Utfør

- ytelse

- utført

- tillatelser

- person

- personlig

- personer

- prospektet

- phd

- bilde

- sentral

- plattform

- Plattformer

- plato

- Platon Data Intelligence

- PlatonData

- spiller

- vær så snill

- Politikk

- politikk

- dårlig

- Populær

- Post

- potensiell

- potensialer

- powered

- kraftig

- praksis

- prediksjon

- Forbered

- gaver

- bevaring

- forhindrer

- Prioriter

- privatliv

- problemer

- prosess

- prosessering

- Programmering

- foreslått

- beskyttelse

- gi

- forutsatt

- gir

- offentlig

- publisitet

- offentlig

- formål

- sette

- Q & A

- kvalitet

- spørsmål

- spørsmål

- spørsmål

- tilfeldig

- Lesning

- klar

- grunnen til

- gjenkjenne

- gjenkjenne

- redusere

- regelmessig

- forskrifter

- i slekt

- relevant

- avhengige

- fjernet

- representasjon

- representant

- omdømme

- anmode

- krever

- Krever

- forskning

- Ressurser

- Svare

- svar

- svar

- resultere

- resulterende

- Resultater

- retur

- avslørende

- inntekter

- omsetningsvekst

- RGB

- ikke sant

- Risiko

- risikoer

- Rolle

- omtrent

- Regel

- Kjør

- rennende

- s

- ivaretakelse

- Sikkerhet

- sagemaker

- Skala

- Vitenskap

- Søk

- Sekund

- Seksjon

- seksjoner

- sektorer

- sikkerhet

- se

- utvalg

- senior

- sensitive

- serverer

- tjeneste

- Tjenester

- servering

- sett

- flere

- Seksuell

- Aksjer

- deling

- hun

- Shield

- Vis

- viste

- Viser

- undertegne

- betydning

- betydelig

- på samme måte

- Enkelt

- situasjoner

- So

- selskap

- sosiale medier

- sosiale medieplattformer

- løsning

- Solutions

- løse

- kilde

- kildekoden

- Kilder

- Rom

- mellomrom

- spam

- spesialist

- spesifikk

- tale

- bruke

- splittet

- Scene

- stadier

- stående

- standarder

- startet

- state-of-the-art

- Stater

- status

- Trinn

- Still

- lagring

- lagret

- Strategisk

- strukturert

- Struggle

- studio

- Studer

- slik

- foreslår

- Støtter

- sydney

- Systemer

- bord

- takle

- taktikk

- tar

- Oppgave

- oppgaver

- lag

- fortelle

- mal

- vilkår

- tekst

- tekstlig

- enn

- Det

- De

- informasjonen

- deres

- Der.

- derved

- derfor

- Disse

- de

- tror

- Tredje

- denne

- tre

- tid

- tidkrevende

- til

- verktøy

- tradisjonelle

- Tog

- trent

- Kurs

- transformator

- Traveling

- to

- typen

- typer

- etter

- forstå

- forståelse

- unik

- Universell

- låse opp

- oppdatert

- oppdatering

- opprett~~POS=TRUNC

- lastet opp

- bruke

- bruk sak

- Bruker

- Brukererfaring

- brukernes personvern

- Brukere

- ved hjelp av

- Verdier

- variasjon

- ulike

- av

- video

- BRUDD

- syn

- volum

- volumer

- Vei..

- måter

- we

- web

- webtjenester

- nettsteder

- VI VIL

- Hva

- når

- hvilken

- hvorfor

- vil

- med

- innenfor

- uten

- ord

- Arbeid

- arbeid

- verden

- ville

- år

- Du

- Din

- zephyrnet