Etter hvert som vi går dypere inn i den digitale æra, har utviklingen av multimodalitetsmodeller vært avgjørende for å forbedre maskinforståelsen. Disse modellene behandler og genererer innhold på tvers av ulike dataformer, som tekst og bilder. En nøkkelfunksjon ved disse modellene er deres bilde-til-tekst-funksjoner, som har vist bemerkelsesverdige ferdigheter i oppgaver som bildeteksting og visuell besvarelse av spørsmål.

Ved å oversette bilder til tekst, låser vi opp og utnytter mengden av informasjon som finnes i visuelle data. For eksempel, i e-handel kan bilde-til-tekst automatisere produktkategorisering basert på bilder, noe som øker søkeeffektiviteten og nøyaktigheten. På samme måte kan det hjelpe til med å generere automatiske bildebeskrivelser, gi informasjon som kanskje ikke er inkludert i produkttitler eller beskrivelser, og dermed forbedre brukeropplevelsen.

I dette innlegget gir vi en oversikt over populære multimodalitetsmodeller. Vi viser også hvordan du distribuerer disse forhåndstrente modellene på Amazon SageMaker. Videre diskuterer vi de forskjellige bruksområdene til disse modellene, og fokuserer spesielt på flere scenarier i den virkelige verden, for eksempel null-shot-tag og attribusjonsgenerering for e-handel og automatisk promptgenerering fra bilder.

Bakgrunn for multimodalitetsmodeller

Maskinlæringsmodeller (ML) har oppnådd betydelige fremskritt innen felt som naturlig språkbehandling (NLP) og datasyn, der modeller kan vise menneskelignende ytelse ved å analysere og generere innhold fra én enkelt datakilde. Nylig har det vært økende oppmerksomhet i utviklingen av multimodalitetsmodeller, som er i stand til å behandle og generere innhold på tvers av ulike modaliteter. Disse modellene, som sammensmelting av syn og språknettverk, har fått fremtredende plass på grunn av deres evne til å integrere informasjon fra ulike kilder og modaliteter, og dermed forbedre deres forståelses- og uttrykksevne.

I denne delen gir vi en oversikt over to populære multimodalitetsmodeller: CLIP (Kontrasterende språk-bilde-foropplæring) og BLIP (Bootstrapping Language-Image Pre-training).

CLIP modell

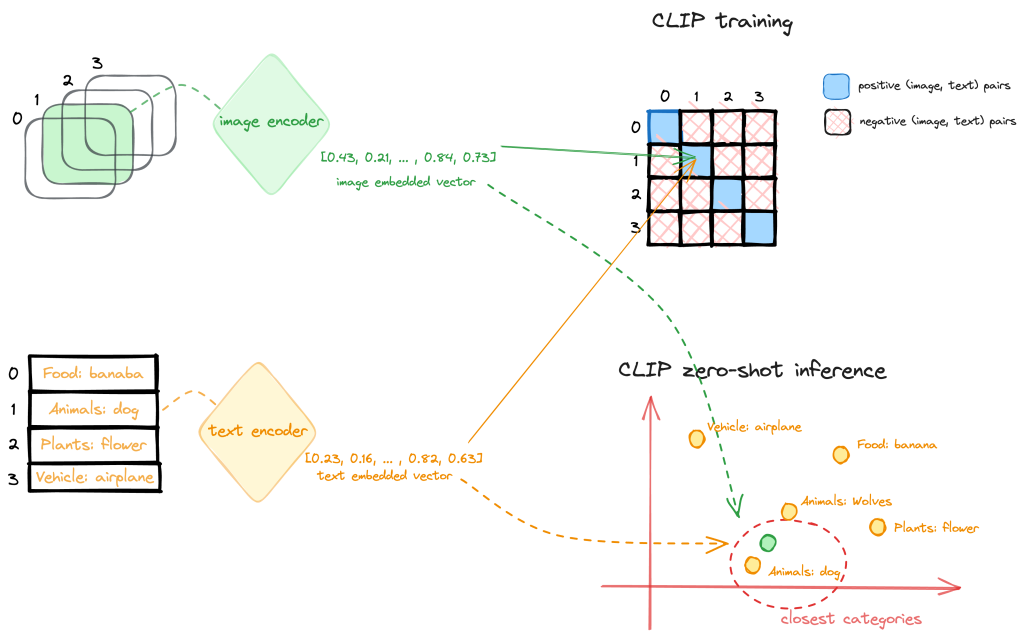

CLIP er en multimodal visjons- og språkmodell, som kan brukes for bilde-tekstlikhet og for nullbildeklassifisering. CLIP er trent på et datasett med 400 millioner bilde-tekst-par samlet fra en rekke offentlig tilgjengelige kilder på internett. Modellarkitekturen består av en bildekoder og en tekstkoder, som vist i følgende diagram.

Under trening mates et bilde og tilsvarende tekstbit gjennom koderne for å få en bildetrekkvektor og teksttrekkvektor. Målet er å få bilde- og tekstfunksjonene for et matchet par til å ha høy cosinuslikhet, mens funksjoner for ikke-matchede par har lav likhet. Dette gjøres gjennom et kontrastivt tap. Denne kontrastive foropplæringen resulterer i kodere som kartlegger bilder og tekst til et felles innebyggingsrom hvor semantikk er justert.

Koderne kan deretter brukes til nullskuddsoverføringslæring for nedstrømsoppgaver. Ved slutningstidspunkt behandler den forhåndstrente koderen for bilde og tekst sine respektive input og transformerer den til en høydimensjonal vektorrepresentasjon, eller en embedding. Innebyggingen av bildet og teksten sammenlignes deretter for å bestemme likheten deres, for eksempel kosinuslikhet. Tekstmeldingen (bildeklasser, kategorier eller koder) hvis innebygging er mest lik (for eksempel har den minste avstanden) til bildeinnbyggingen anses som den mest relevante, og bildet klassifiseres deretter.

BLIP modell

En annen populær multimodalitetsmodell er BLIP. Den introduserer en ny modellarkitektur som er i stand til å tilpasse seg forskjellige synsspråkoppgaver og bruker en unik oppstartsteknikk for datasett for å lære av støyende nettdata. BLIP-arkitekturen inkluderer en bildekoder og tekstkoder: den bildejordede tekstkoderen injiserer visuell informasjon i transformatorblokken til tekstkoderen, og den bildejordede tekstdekoderen inkorporerer visuell informasjon i transformatordekoderblokken. Med denne arkitekturen demonstrerer BLIP enestående ytelse på tvers av et spekter av visjonsspråklige oppgaver som involverer sammensmelting av visuell og språklig informasjon, fra bildebasert søk og innholdsgenerering til interaktive visuelle dialogsystemer. I et tidligere innlegg foreslo vi en innholdsmodereringsløsning basert på BLIP-modellen som adresserte flere utfordringer ved å bruke datasyn unimodale ML-tilnærminger.

Brukstilfelle 1: Nullbilde-tag eller attributtgenerering for en netthandelsplattform

E-handelsplattformer fungerer som dynamiske markedsplasser som vrimler av ideer, produkter og tjenester. Med millioner av produkter oppført, utgjør effektiv sortering og kategorisering en betydelig utfordring. Det er her kraften til automatisk merking og generering av attributter kommer til sin rett. Ved å utnytte avanserte teknologier som ML og NLP, kan disse automatiserte prosessene revolusjonere driften av e-handelsplattformer.

En av hovedfordelene med automatisk merking eller generering av attributter ligger i dens evne til å forbedre søkbarheten. Produkter merket nøyaktig kan bli funnet av kunder raskt og effektivt. For eksempel, hvis en kunde søker etter en «t-skjorte med rund hals i bomull med en logo foran», gjør automatisk merking og generering av attributter det mulig for søkemotoren å finne produkter som ikke bare samsvarer med den bredere «t-skjorte»-kategorien, men også de spesifikke egenskapene til "bomull" og "crew neck". Denne nøyaktige matchingen kan legge til rette for en mer personlig handleopplevelse og øke kundetilfredsheten. Dessuten kan autogenererte tagger eller attributter betydelig forbedre produktanbefalingsalgoritmer. Med en dyp forståelse av produktegenskaper kan systemet foreslå mer relevante produkter til kunder, og dermed øke sannsynligheten for kjøp og øke kundetilfredsheten.

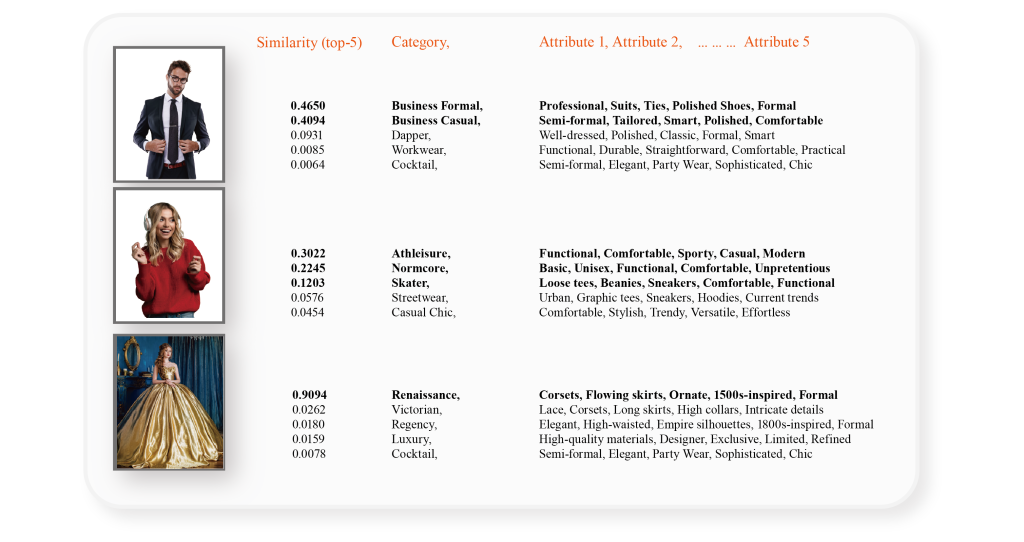

CLIP tilbyr en lovende løsning for å automatisere prosessen med generering av tagger eller attributter. Den tar et produktbilde og en liste over beskrivelser eller tagger som input, genererer en vektorrepresentasjon, eller innebygging, for hver tag. Disse innebyggingene eksisterer i et høydimensjonalt rom, med deres relative avstander og retninger som gjenspeiler de semantiske relasjonene mellom inngangene. CLIP er forhåndsopplært i en stor skala av bilde-tekst-par for å innkapsle disse meningsfulle innebyggingene. Hvis en kode eller et attributt beskriver et bilde nøyaktig, bør innebyggingene deres være relativt nærme i dette området. For å generere tilsvarende tagger eller attributter, kan en liste over potensielle tagger legges inn i tekstdelen av CLIP-modellen, og de resulterende innbyggingene lagres. Ideelt sett bør denne listen være uttømmende og dekke alle potensielle kategorier og attributter som er relevante for produktene på e-handelsplattformen. Følgende figur viser noen eksempler.

For å distribuere CLIP-modellen på SageMaker, kan du følge notatboken i det følgende GitHub repo. Vi bruker den forhåndsbygde SageMaker store modellinferens (LMI) containere å distribuere modellen. LMI-beholderne bruker DJL-servering å tjene din modell for slutning. For å lære mer om hosting av store modeller på SageMaker, se Distribuer store modeller på Amazon SageMaker ved å bruke DJLServing og DeepSpeed modell parallell inferens og Distribuer store modeller med høy ytelse ved å bruke FasterTransformer på Amazon SageMaker.

I dette eksemplet gir vi filene serving.properties, model.pyog requirements.txt å forberede modellartefakter og lagre dem i en tarball-fil.

serving.propertieser konfigurasjonsfilen som kan brukes til å indikere til DJL Serving hvilke modellparallelliserings- og inferensoptimaliseringsbiblioteker du ønsker å bruke. Avhengig av ditt behov, kan du angi riktig konfigurasjon. For mer informasjon om konfigurasjonsalternativene og en uttømmende liste, se Konfigurasjoner og innstillinger.model.pyer skriptet som håndterer eventuelle forespørsler om visning.requirements.txter tekstfilen som inneholder eventuelle ekstra pip-hjul som skal installeres.

Hvis du vil laste ned modellen fra Klemme ansiktet direkte, kan du stille inn option.model_id parameter i serving.properties fil som modell-ID for en forhåndsopplært modell som er vert inne i et modelllager på huggingface.co. Beholderen bruker denne modell-ID-en til å laste ned den tilsvarende modellen under distribusjonstiden. Hvis du stiller inn model_id til en Amazon enkel lagringstjeneste (Amazon S3) URL, vil DJL laste ned modellartefakter fra Amazon S3 og bytte ut model_id til den faktiske plasseringen av modellartefaktene. I skriptet ditt kan du peke på denne verdien for å laste den forhåndstrente modellen. I vårt eksempel bruker vi det siste alternativet, fordi LMI-beholderen bruker s5cmd å laste ned data fra Amazon S3, noe som reduserer hastigheten betraktelig ved lasting av modeller under utrulling. Se følgende kode:

på modell.py skript, laster vi modellbanen ved å bruke modell-ID-en som er oppgitt i egenskapsfilen:

Etter at modellartefaktene er forberedt og lastet opp til Amazon S3, kan du distribuere CLIP-modellen til SageMaker-hosting med noen få linjer med kode:

Når endepunktet er i bruk, kan du påkalle endepunktet med et inndatabilde og en liste over etiketter som inndatamelding for å generere etikettsannsynlighetene:

Brukstilfelle 2: Automatisk promptgenerering fra bilder

En innovativ applikasjon som bruker multimodalitetsmodellene er å generere informative spørsmål fra et bilde. I generativ AI, en teksten refererer til input til en språkmodell eller annen generativ modell for å instruere den om hvilken type innhold eller respons som ønskes. Spørringen er i hovedsak et utgangspunkt eller et sett med instruksjoner som veileder modellens generasjonsprosess. Det kan ha form av en setning, et spørsmål, en deltekst eller et hvilket som helst input som formidler konteksten eller ønsket utgang til modellen. Valget av en godt utformet ledetekst er avgjørende for å generere bilder av høy kvalitet med presisjon og relevans. Rask prosjektering er prosessen med å optimalisere eller lage et tekstinndata for å oppnå ønskede svar fra en språkmodell, ofte med formulering, format eller kontekstjusteringer.

Rask utvikling for bildegenerering byr på flere utfordringer, inkludert følgende:

- Definere visuelle konsepter nøyaktig – Å beskrive visuelle konsepter med ord kan noen ganger være upresist eller tvetydig, noe som gjør det vanskelig å formidle det nøyaktige bildet som ønskes. Å fange intrikate detaljer eller komplekse scener gjennom tekstlige spørsmål er kanskje ikke enkelt.

- Spesifisere ønskede stiler effektivt – Å kommunisere spesifikke stilistiske preferanser, som stemning, fargepalett eller kunstnerisk stil, kan være utfordrende gjennom tekst alene. Å oversette abstrakte estetiske konsepter til konkrete instruksjoner for modellen kan være vanskelig.

- Balanser kompleksitet for å forhindre overbelastning av modellen – Forseggjorte spørsmål kan forvirre modellen eller føre til overbelastning av den med informasjon, noe som påvirker den genererte utgangen. Å finne den rette balansen mellom å gi tilstrekkelig veiledning og unngå overveldende kompleksitet er avgjørende.

Derfor er det tidkrevende å lage effektive meldinger for bildegenerering, noe som krever iterativ eksperimentering og raffinering for å finne den rette balansen mellom presisjon og kreativitet, noe som gjør det til en ressurskrevende oppgave som i stor grad er avhengig av menneskelig ekspertise.

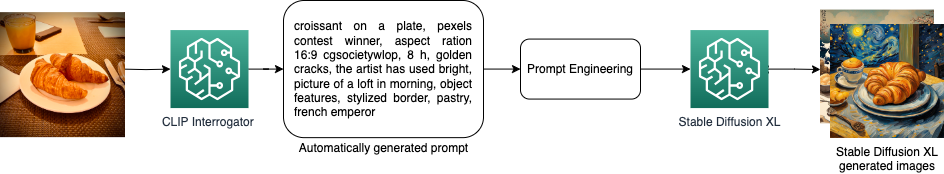

De CLIP Interrogator er et automatisk ledetekstverktøy for bilder som kombinerer CLIP og BLIP for å optimalisere tekstmeldinger for å matche et gitt bilde. Du kan bruke de resulterende ledetekstene med tekst-til-bilde-modeller som Stabil diffusjon å lage kul kunst. Forespørslene laget av CLIP Interrogator tilbyr en omfattende beskrivelse av bildet, og dekker ikke bare dets grunnleggende elementer, men også den kunstneriske stilen, den potensielle inspirasjonen bak bildet, mediet der bildet kunne vært eller kunne blitt brukt, og mer. Du kan enkelt distribuere CLIP Interrogator-løsningen på SageMaker for å strømlinjeforme distribusjonsprosessen, og dra nytte av skalerbarheten, kostnadseffektiviteten og den robuste sikkerheten som tilbys av den fullstendig administrerte tjenesten. Følgende diagram viser flytlogikken til denne løsningen.

Du kan bruke følgende bærbare å distribuere CLIP Interrogator-løsningen på SageMaker. Tilsvarende, for hosting av CLIP-modeller, bruker vi SageMaker LMI-beholderen for å være vert for løsningen på SageMaker ved å bruke DJL-servering. I dette eksemplet ga vi en ekstra inndatafil med modellartefakter som spesifiserer modellene som er distribuert til SageMaker-endepunktet. Du kan velge forskjellige CLIP- eller BLIP-modeller ved å sende bildetekstmodellnavnet og klippmodellnavnet gjennom model_name.json fil opprettet med følgende kode:

Inferensmanuset model.py inneholder en håndtaksfunksjon som DJL Serving vil kjøre forespørselen din ved å påkalle denne funksjonen. For å forberede dette inngangspunktskriptet tok vi i bruk koden fra originalen clip_interrogator.py fil og endret den til å fungere med DJL Servering på SageMaker-hosting. En oppdatering er lasting av BLIP-modellen. BLIP- og CLIP-modellene lastes inn via load_caption_model() og load_clip_model() funksjon under initialiseringen av Interrogator-objektet. For å laste BLIP-modellen lastet vi først ned modellartefaktene fra Hugging Face og lastet dem opp til Amazon S3 som målverdien for model_id i egenskapsfilen. Dette er fordi BLIP-modellen kan være en stor fil, for eksempel blip2-opt-2.7b modell, som er mer enn 15 GB i størrelse. Nedlasting av modellen fra Hugging Face under modelldistribusjon vil kreve mer tid for å lage endepunkt. Derfor peker vi på model_id til Amazon S3-plasseringen til BLIP2-modellen og last inn modellen fra modellbanen spesifisert i egenskapsfilen. Merk at under distribusjon vil modellbanen byttes til den lokale containerbanen der modellartefaktene ble lastet ned til av DJL Serving fra Amazon S3-lokasjonen. Se følgende kode:

Fordi CLIP-modellen ikke er særlig stor i størrelse, bruker vi open_clip å laste modellen direkte fra Hugging Face, som er den samme som originalen clip_interrogator gjennomføring:

Vi bruker lignende kode for å distribuere CLIP Interrogator-løsningen til et SageMaker-endepunkt og påkaller endepunktet med et inngangsbilde for å få ledetekstene som kan brukes til å generere lignende bilder.

La oss ta følgende bilde som et eksempel. Ved å bruke det utplasserte CLIP Interrogator-endepunktet på SageMaker, genererer det følgende tekstbeskrivelse: croissant on a plate, pexels contest winner, aspect ratio 16:9, cgsocietywlop, 8 h, golden cracks, the artist has used bright, picture of a loft in morning, object features, stylized border, pastry, french emperor.

Vi kan videre kombinere CLIP Interrogator-løsningen med stabil diffusjon og raske ingeniørteknikker – en helt ny dimensjon av kreative muligheter dukker opp. Denne integrasjonen lar oss ikke bare beskrive bilder med tekst, men også manipulere og generere ulike variasjoner av originalbildene. Stabil diffusjon sikrer kontrollert bildesyntese ved iterativt å avgrense det genererte resultatet, og strategisk prompt konstruksjon leder generasjonsprosessen mot ønskede resultater.

på andre del av notatboken, beskriver vi trinnene for å bruke prompt engineering for å restyle bilder med Stable Diffusion-modellen (Stabil diffusjon XL 1.0). Vi bruker Stabilitet AI SDK å distribuere denne modellen fra SageMaker JumpStart etter å ha abonnert på denne modellen på AWS markedsplass. Fordi dette er en nyere og bedre versjon for bildegenerering levert av Stabilitet AI, kan vi få bilder av høy kvalitet basert på det originale inngangsbildet. I tillegg, hvis vi prefikser den foregående beskrivelsen og legger til en ekstra melding som nevner en kjent kunstner og et av hans verk, får vi fantastiske resultater med restyling. Følgende bilde bruker ledeteksten: This scene is a Van Gogh painting with The Starry Night style, croissant on a plate, pexels contest winner, aspect ratio 16:9, cgsocietywlop, 8 h, golden cracks, the artist has used bright, picture of a loft in morning, object features, stylized border, pastry, french emperor.

Følgende bilde bruker ledeteksten: This scene is a Hokusai painting with The Great Wave off Kanagawa style, croissant on a plate, pexels contest winner, aspect ratio 16:9, cgsocietywlop, 8 h, golden cracks, the artist has used bright, picture of a loft in morning, object features, stylized border, pastry, french emperor.

konklusjonen

Fremveksten av multimodalitetsmodeller, som CLIP og BLIP, og deres applikasjoner forvandler raskt landskapet av bilde-til-tekst-konvertering. De bygger bro over gapet mellom visuell og semantisk informasjon, og gir oss verktøyene for å frigjøre det enorme potensialet til visuelle data og utnytte det på måter som tidligere var utenkelige.

I dette innlegget illustrerte vi ulike anvendelser av multimodalitetsmodellene. Disse spenner fra å forbedre effektiviteten og nøyaktigheten til søk i e-handelsplattformer gjennom automatisk merking og kategorisering til generering av meldinger for tekst-til-bilde-modeller som Stable Diffusion. Disse applikasjonene åpner nye horisonter for å lage unikt og engasjerende innhold. Vi oppfordrer deg til å lære mer ved å utforske de ulike multimodalitetsmodellene på SageMaker og bygge en løsning som er innovativ for virksomheten din.

Om forfatterne

Yanwei Cui, PhD, er Senior Machine Learning Specialist Solutions Architect ved AWS. Han startet forskning på maskinlæring ved IRISA (Research Institute of Computer Science and Random Systems), og har flere års erfaring med å bygge AI-drevne industrielle applikasjoner innen datasyn, naturlig språkbehandling og online brukeratferdsprediksjon. Hos AWS deler han domeneekspertisen sin og hjelper kunder med å låse opp forretningspotensialer og oppnå handlingsrettede resultater med maskinlæring i stor skala. Utenom jobben liker han å lese og reise.

Yanwei Cui, PhD, er Senior Machine Learning Specialist Solutions Architect ved AWS. Han startet forskning på maskinlæring ved IRISA (Research Institute of Computer Science and Random Systems), og har flere års erfaring med å bygge AI-drevne industrielle applikasjoner innen datasyn, naturlig språkbehandling og online brukeratferdsprediksjon. Hos AWS deler han domeneekspertisen sin og hjelper kunder med å låse opp forretningspotensialer og oppnå handlingsrettede resultater med maskinlæring i stor skala. Utenom jobben liker han å lese og reise.

Raghu Ramesha er senior ML Solutions Architect med Amazon SageMaker Service-teamet. Han fokuserer på å hjelpe kunder med å bygge, distribuere og migrere ML-produksjonsarbeidsmengder til SageMaker i stor skala. Han spesialiserer seg på maskinlæring, AI og datasynsdomener, og har en mastergrad i informatikk fra UT Dallas. På fritiden liker han å reise og fotografere.

Raghu Ramesha er senior ML Solutions Architect med Amazon SageMaker Service-teamet. Han fokuserer på å hjelpe kunder med å bygge, distribuere og migrere ML-produksjonsarbeidsmengder til SageMaker i stor skala. Han spesialiserer seg på maskinlæring, AI og datasynsdomener, og har en mastergrad i informatikk fra UT Dallas. På fritiden liker han å reise og fotografere.

Sam Edwards, er en skyingeniør (AI/ML) ved AWS Sydney, spesialisert i maskinlæring og Amazon SageMaker. Han brenner for å hjelpe kunder med å løse problemer knyttet til arbeidsflyter for maskinlæring og skape nye løsninger for dem. Utenom jobben liker han å spille racketsport og reise.

Sam Edwards, er en skyingeniør (AI/ML) ved AWS Sydney, spesialisert i maskinlæring og Amazon SageMaker. Han brenner for å hjelpe kunder med å løse problemer knyttet til arbeidsflyter for maskinlæring og skape nye løsninger for dem. Utenom jobben liker han å spille racketsport og reise.

Melanie Li, PhD, er en senior AI/ML-spesialist TAM ved AWS med base i Sydney, Australia. Hun hjelper bedriftskunder med å bygge løsninger ved hjelp av toppmoderne AI/ML-verktøy på AWS og gir veiledning om arkitektur og implementering av ML-løsninger med beste praksis. På fritiden elsker hun å utforske naturen og tilbringe tid med familie og venner.

Melanie Li, PhD, er en senior AI/ML-spesialist TAM ved AWS med base i Sydney, Australia. Hun hjelper bedriftskunder med å bygge løsninger ved hjelp av toppmoderne AI/ML-verktøy på AWS og gir veiledning om arkitektur og implementering av ML-løsninger med beste praksis. På fritiden elsker hun å utforske naturen og tilbringe tid med familie og venner.

Gordon Wang er en senior AI/ML-spesialist TAM ved AWS. Han støtter strategiske kunder med AI/ML beste praksis på tvers av mange bransjer. Han er lidenskapelig opptatt av datasyn, NLP, generativ AI og MLOps. På fritiden elsker han løping og fotturer.

Gordon Wang er en senior AI/ML-spesialist TAM ved AWS. Han støtter strategiske kunder med AI/ML beste praksis på tvers av mange bransjer. Han er lidenskapelig opptatt av datasyn, NLP, generativ AI og MLOps. På fritiden elsker han løping og fotturer.

Dhawal Patel er en hovedmaskinlæringsarkitekt ved AWS. Han har jobbet med organisasjoner som spenner fra store bedrifter til mellomstore startups med problemer knyttet til distribuert databehandling og kunstig intelligens. Han fokuserer på dyp læring inkludert NLP- og Computer Vision-domener. Han hjelper kundene med å oppnå høy ytelse modellslutning på SageMaker.

Dhawal Patel er en hovedmaskinlæringsarkitekt ved AWS. Han har jobbet med organisasjoner som spenner fra store bedrifter til mellomstore startups med problemer knyttet til distribuert databehandling og kunstig intelligens. Han fokuserer på dyp læring inkludert NLP- og Computer Vision-domener. Han hjelper kundene med å oppnå høy ytelse modellslutning på SageMaker.

- SEO-drevet innhold og PR-distribusjon. Bli forsterket i dag.

- PlatoData.Network Vertical Generative Ai. Styrk deg selv. Tilgang her.

- PlatoAiStream. Web3 Intelligence. Kunnskap forsterket. Tilgang her.

- PlatoESG. Karbon, CleanTech, Energi, Miljø, Solenergi, Avfallshåndtering. Tilgang her.

- PlatoHelse. Bioteknologisk og klinisk etterretning. Tilgang her.

- kilde: https://aws.amazon.com/blogs/machine-learning/build-an-image-to-text-generative-ai-application-using-multimodality-models-on-amazon-sagemaker/

- : har

- :er

- :ikke

- :hvor

- 1

- 10

- 100

- 12

- 15%

- 16

- 400

- 7

- 8

- 9

- 97

- a

- evne

- Om oss

- ABSTRACT

- tilsvar

- nøyaktighet

- nøyaktig

- Oppnå

- oppnådd

- tvers

- faktiske

- legge til

- Ytterligere

- I tillegg

- adressert

- justeringer

- vedtatt

- avansert

- fremskritt

- Fordel

- påvirker

- Etter

- AI

- AI-drevet

- AI / ML

- algoritmer

- justert

- Alle

- tillater

- alene

- også

- utrolig

- Amazon

- Amazon SageMaker

- Amazon Web Services

- an

- analyserer

- og

- noen

- Søknad

- søknader

- tilnærminger

- hensiktsmessig

- arkitektur

- ER

- Kunst

- kunstig

- kunstig intelligens

- artist

- kunstnerisk

- AS

- aspektet

- bistå

- At

- oppmerksomhet

- attributter

- Australia

- automatisere

- Automatisert

- Automatisk

- Automatisere

- tilgjengelig

- unngå

- AWS

- Balansere

- basert

- BE

- fordi

- vært

- atferd

- bak

- Fordeler

- BEST

- beste praksis

- Bedre

- mellom

- Beyond

- Stor

- Blokker

- kroppen

- øke

- grensen

- bridging

- Bright

- bredere

- bygge

- Bygning

- virksomhet

- men

- by

- CAN

- Kan få

- evner

- stand

- fange

- saken

- CAT

- kategorier

- Kategori

- Katter

- utfordre

- utfordringer

- utfordrende

- valg

- Velg

- klasser

- klassifisering

- klassifisert

- Lukke

- Cloud

- kode

- farge

- kombinere

- skurtreskerne

- kommer

- Felles

- kommunisere

- sammenlignet

- komplekse

- kompleksitet

- omfattende

- datamaskin

- informatikk

- Datamaskin syn

- databehandling

- konsepter

- Konfigurasjon

- ansett

- består

- inneholdt

- Container

- Containere

- inneholder

- innhold

- Innholdsgenerering

- kontekst

- kontrolleres

- Konvertering

- Kul

- Tilsvarende

- kunne

- dekker

- skape

- opprettet

- Opprette

- skaperverket

- Kreativ

- kreativitet

- kritisk

- Kryss

- kunde

- Kundetilfredshet

- Kunder

- Dallas

- dato

- dyp

- dyp læring

- dypere

- Grad

- dybden

- demonstrere

- demonstrerer

- avhengig

- utplassere

- utplassert

- distribusjon

- beskrive

- beskrivelse

- ønsket

- detalj

- detaljer

- Bestem

- Utvikling

- enhet

- Dialog

- forskjellig

- vanskelig

- kringkasting

- digitalt

- Dimensjon

- direkte

- diskutere

- avstand

- distribueres

- distribuert databehandling

- diverse

- domene

- domener

- gjort

- nedlasting

- stasjonen

- to

- under

- dynamisk

- hver enkelt

- lett

- e-handel

- Effektiv

- effektivitet

- effektivt

- Utdype

- elementer

- ellers

- embedding

- veksten

- framgår

- anvender

- muliggjøre

- oppmuntre

- Endpoint

- engasjerende

- Motor

- ingeniør

- Ingeniørarbeid

- forbedre

- styrke

- sikrer

- Enterprise

- bedrifter

- entry

- Era

- avgjørende

- hovedsak

- eksempel

- eksempler

- viser

- eksisterer

- erfaring

- ekspertise

- utforske

- Utforske

- uttrykk

- Face

- legge til rette

- familie

- Trekk

- Egenskaper

- Fed

- Noen få

- Felt

- Figur

- filet

- Filer

- Først

- flyten

- fokuserer

- fokusering

- følge

- etter

- Til

- skjema

- format

- skjemaer

- funnet

- Gratis

- Fransk

- venner

- fra

- foran

- fullt

- funksjon

- fundamental

- videre

- Dess

- fusjon

- fikk

- mellomrom

- generere

- generert

- genererer

- genererer

- generasjonen

- generative

- Generativ AI

- få

- gitt

- mål

- Gyllen

- flott

- veiledning

- Guider

- håndtere

- Håndterer

- seletøy

- Utnyttelse

- Ha

- he

- tungt

- hjelpe

- hjelper

- her

- Høy

- høykvalitets

- hans

- holder

- Horizons

- vert

- vert

- Hosting

- Hvordan

- Hvordan

- HTML

- http

- HTTPS

- menneskelig

- ID

- ideelt sett

- Ideer

- if

- bilde

- Bildeklassifisering

- bilder

- gjennomføring

- implementere

- importere

- forbedre

- bedre

- in

- inkludert

- inkluderer

- Inkludert

- økende

- indikerer

- industriell

- bransjer

- informasjon

- informative

- innovative

- inngang

- innganger

- innsiden

- inspirasjon

- installere

- f.eks

- Institute

- instruksjoner

- integrere

- integrering

- Intelligens

- interaktiv

- Internet

- inn

- Introduserer

- involvere

- involverer

- saker

- IT

- DET ER

- jpg

- JSON

- nøkkel

- kjent

- Etiketten

- etiketter

- landskap

- Språk

- stor

- Store bedrifter

- føre

- LÆRE

- læring

- Li

- bibliotekene

- ligger

- i likhet med

- sannsynligheten

- linjer

- Liste

- oppført

- laste

- lasting

- lokal

- plassering

- logikk

- logo

- tap

- elsker

- Lav

- maskin

- maskinlæring

- gjøre

- Making

- fikk til

- mange

- kart

- markeds

- mestere

- Match

- matchet

- matchende

- meningsfylt

- medium

- bare

- kunne

- migrere

- millioner

- millioner

- ML

- MLOps

- modell

- modeller

- moderasjon

- modifisert

- mer

- Videre

- Morgen

- mest

- flere

- navn

- Naturlig

- Natural Language Processing

- Natur

- Trenger

- nettverk

- Ny

- nye horisonter

- natt

- nlp

- none

- bærbare

- roman

- objekt

- of

- off

- tilby

- Tilbud

- ofte

- on

- ONE

- på nett

- bare

- åpen

- Drift

- optimalisering

- Optimalisere

- optimalisere

- Alternativ

- alternativer

- or

- organisasjoner

- original

- OS

- Annen

- vår

- utfall

- produksjon

- utenfor

- enestående

- oversikt

- overveldende

- egen

- maleri

- par

- par

- paletten

- Parallel

- parameter

- del

- spesielt

- Passerer

- lidenskapelig

- banen

- ytelse

- Personlig

- phd

- bilde

- fotografering

- bilde

- sentral

- plattform

- Plattformer

- plato

- Platon Data Intelligence

- PlatonData

- spiller

- støpsel

- Point

- Populær

- positurer

- muligheter

- Post

- potensiell

- potensialer

- makt

- praksis

- presis

- Precision

- prediksjon

- preferanser

- Forbered

- forberedt

- forebygge

- forrige

- tidligere

- Principal

- problemer

- prosess

- Prosesser

- prosessering

- Produkt

- Produksjon

- Produkter

- fremtredende

- lovende

- egenskaper

- eiendom

- foreslått

- gi

- forutsatt

- gir

- gi

- offentlig

- kjøp

- spørsmål

- tilfeldig

- område

- spenner

- raskt

- ratio

- Lesning

- virkelige verden

- nylig

- Anbefaling

- reduserer

- referere

- refererer

- raffinering

- reflekterende

- region

- i slekt

- Relasjoner

- slektning

- relativt

- relevans

- relevant

- bemerkelsesverdig

- Repository

- representasjon

- anmode

- forespørsler

- krever

- Krever

- forskning

- ressurskrevende

- de

- svar

- svar

- resulterende

- Resultater

- retur

- Revolusjonere

- ikke sant

- robust

- Kjør

- rennende

- sagemaker

- samme

- tilfredshet

- skalerbarhet

- Skala

- scenarier

- scene

- Scener

- Vitenskap

- script

- Søk

- søkemotor

- søker

- Seksjon

- sikkerhet

- se

- SELV

- semantikk

- senior

- dømme

- betjene

- tjeneste

- Tjenester

- servering

- sett

- flere

- Aksjer

- hun

- Shopping

- bør

- vist

- Viser

- signifikant

- betydelig

- lignende

- på samme måte

- Enkelt

- enkelt

- Størrelse

- tekstutdrag

- løsning

- Solutions

- LØSE

- noen

- noen ganger

- kilde

- Kilder

- Rom

- spesialist

- spesialisert

- spesialisert

- spesifikk

- spesifisert

- Spectrum

- fart

- bruke

- Sports

- stabil

- stjernehimmel

- startet

- Start

- startups

- state-of-the-art

- Steps

- lagring

- oppbevare

- lagret

- rett fram

- Strategisk

- effektivisere

- streik

- stil

- i det vesentlige

- slik

- tilstrekkelig

- foreslår

- Støtter

- swap

- raskt

- sydney

- system

- Systemer

- TAG

- Ta

- tar

- Target

- Oppgave

- oppgaver

- lag

- teknikk

- Technologies

- mal

- tekst

- tekstlig

- enn

- Det

- De

- Landskapet

- deres

- Dem

- deretter

- Der.

- derved

- derfor

- Disse

- de

- denne

- Gjennom

- tid

- titler

- til

- verktøy

- verktøy

- mot

- trent

- Kurs

- overføre

- transformator

- transformere

- transforme

- Traveling

- to

- typen

- forståelse

- utenkelig

- unik

- låse opp

- Oppdater

- lastet opp

- URL

- us

- bruke

- brukt

- Bruker

- Brukererfaring

- bruker

- ved hjelp av

- verdi

- variasjon

- ulike

- enorme

- versjon

- veldig

- av

- syn

- W

- ønsker

- Wave

- måter

- we

- Rikdom

- web

- webtjenester

- var

- Hva

- når

- hvilken

- mens

- hele

- hvem sin

- vil

- Vinner

- med

- ordlyden

- ord

- Arbeid

- arbeidet

- arbeidsflyt

- virker

- ville

- år

- Du

- Din

- zephyrnet