I 2021, den farmasøytisk industri genererte 550 milliarder dollar i amerikanske inntekter. Farmasøytiske selskaper selger en rekke forskjellige, ofte nye, legemidler på markedet, der noen ganger utilsiktede, men alvorlige bivirkninger kan oppstå.

Disse hendelsene kan rapporteres hvor som helst, fra sykehus eller hjemme, og må overvåkes ansvarlig og effektivt. Tradisjonell manuell behandling av uønskede hendelser gjøres utfordrende av den økende mengden helsedata og kostnader. Totalt anslås 384 milliarder dollar som kostnaden for legemiddelovervåkingsaktiviteter for den generelle helsesektoren innen 2022. For å støtte overordnede legemiddelovervåkingsaktiviteter ønsker våre farmasøytiske kunder å bruke kraften til maskinlæring (ML) for å automatisere deteksjon av uønskede hendelser fra ulike datakilder , slik som feeder for sosiale medier, telefonsamtaler, e-poster og håndskrevne notater, og utløser passende handlinger.

I dette innlegget viser vi hvordan du utvikler en ML-drevet løsning ved hjelp av Amazon SageMaker for å oppdage uønskede hendelser ved å bruke det offentlig tilgjengelige bivirkningsdatasettet på Hugging Face. I denne løsningen finjusterer vi en rekke modeller på Hugging Face som er forhåndstrent på medisinske data, og bruker BioBERT-modellen, som ble forhåndstrent på Pubmed datasett og yter best av de som er prøvd.

Vi implementerte løsningen ved å bruke AWS skyutviklingssett (AWS CDK). Vi dekker imidlertid ikke detaljene ved å bygge løsningen i dette innlegget. For mer informasjon om implementeringen av denne løsningen, se Bygg et system for å fange opp uønskede hendelser i sanntid ved å bruke Amazon SageMaker og Amazon QuickSight.

Dette innlegget går inn i flere nøkkelområder, og gir en omfattende utforskning av følgende emner:

- Datautfordringene AWS Professional Services møter

- Landskapet og anvendelsen av store språkmodeller (LLM):

- Transformers, BERT og GPT

- Klemme ansiktet

- Den finjusterte LLM-løsningen og dens komponenter:

- Dataforberedelse

- Modelltrening

Datautfordring

Dataskjevhet er ofte et problem når man kommer opp med klassifiseringsoppgaver. Du vil ideelt sett ha et balansert datasett, og denne brukstilfellet er intet unntak.

Vi tar opp denne skjevheten med generativ AI modeller (Falcon-7B og Falcon-40B), som ble bedt om å generere hendelsesprøver basert på fem eksempler fra treningssettet for å øke det semantiske mangfoldet og øke utvalgsstørrelsen på merkede uønskede hendelser. Det er en fordel for oss å bruke Falcon-modellene her fordi, i motsetning til noen LLM-er på Hugging Face, gir Falcon deg treningsdatasettet de bruker, slik at du kan være sikker på at ingen av testsettets eksempler er inneholdt i Falcon-treningssettet og unngå data forurensning.

Den andre datautfordringen for helsekunder er HIPAA-overholdelseskrav. Kryptering i hvile og under transport må innlemmes i løsningen for å oppfylle disse kravene.

Transformers, BERT og GPT

Transformatorarkitekturen er en nevrale nettverksarkitektur som brukes til naturlig språkbehandling (NLP) oppgaver. Det ble først introdusert i avisen “Oppmerksomhet er alt du trenger” av Vaswani et al. (2017). Transformatorarkitekturen er basert på oppmerksomhetsmekanismen, som lar modellen lære langdistanseavhengigheter mellom ord. Transformatorer, som lagt ut i det originale papiret, består av to hovedkomponenter: koderen og dekoderen. Koderen tar inngangssekvensen som inngang og produserer en sekvens av skjulte tilstander. Dekoderen tar deretter disse skjulte tilstandene som input og produserer utgangssekvensen. Oppmerksomhetsmekanismen brukes både i koderen og dekoderen. Oppmerksomhetsmekanismen lar modellen ta hensyn til spesifikke ord i inngangssekvensen når den genererer utdatasekvensen. Dette gjør at modellen kan lære langsiktige avhengigheter mellom ord, noe som er avgjørende for mange NLP-oppgaver, for eksempel maskinoversettelse og tekstoppsummering.

En av de mer populære og nyttige av transformatorarkitekturene, Bidirectional Encoder Representations from Transformers (BERT), er en språkrepresentasjonsmodell som var introdusert i 2018. BERT trenes på sekvenser der noen av ordene i en setning er maskert, og den må fylle ut disse ordene med hensyn til både ordene før og etter de maskerte ordene. BERT kan finjusteres for en rekke NLP-oppgaver, inkludert svar på spørsmål, naturlig språkslutning og sentimentanalyse.

Den andre populære transformatorarkitekturen som har tatt verden med storm er Generative Pre-trained Transformer (GPT). Den første GPT-modellen var introdusert i 2018 av OpenAI. Det fungerer ved å være opplært til å forutsi det neste ordet i en rekkefølge, bare oppmerksom på konteksten før ordet. GPT-modeller er trent på et massivt datasett med tekst og kode, og de kan finjusteres for en rekke NLP-oppgaver, inkludert tekstgenerering, spørsmålssvar og oppsummering.

Generelt er BERT bedre på oppgaver som krever dypere forståelse av konteksten til ord, mens GPT er bedre egnet for oppgaver som krever generering av tekst.

Klemme ansiktet

Hugging Face er et kunstig intelligensselskap som spesialiserer seg på NLP. Det gir en plattform med verktøy og ressurser som gjør det mulig for utviklere å bygge, trene og distribuere ML-modeller fokusert på NLP-oppgaver. Et av nøkkeltilbudene til Hugging Face er biblioteket, transformers, som inkluderer ferdigtrente modeller som kan finjusteres for ulike språkoppgaver som tekstklassifisering, oversettelse, oppsummering og spørsmålssvar.

Hugging Face integreres sømløst med SageMaker, som er en fullstendig administrert tjeneste som gjør det mulig for utviklere og dataforskere å bygge, trene og distribuere ML-modeller i stor skala. Denne synergien kommer brukerne til gode ved å tilby en robust og skalerbar infrastruktur for å håndtere NLP-oppgaver med de toppmoderne modellene som Hugging Face tilbyr, kombinert med de kraftige og fleksible ML-tjenestene fra AWS. Du kan også få tilgang til Hugging Face-modeller direkte fra Amazon SageMaker JumpStart, noe som gjør det praktisk å starte med forhåndsbygde løsninger.

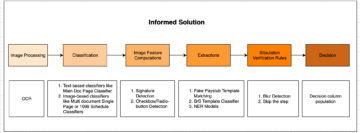

Løsningsoversikt

Vi brukte Hugging Face Transformers-biblioteket til å finjustere transformatormodeller på SageMaker for oppgaven med klassifisering av uønskede hendelser. Opplæringsjobben er bygget ved hjelp av SageMaker PyTorch-estimatoren. SageMaker JumpStart har også noen komplementære integrasjoner med Hugging Face som gjør det enkelt å implementere. I denne delen beskriver vi de viktigste trinnene involvert i dataforberedelse og modelltrening.

Dataforberedelse

Vi brukte bivirkningsdataene (ade_corpus_v2) i Hugging Face-datasettet med en 80/20 trenings-/testdeling. Den nødvendige datastrukturen for vår modellopplæring og slutning har to kolonner:

- Én kolonne for tekstinnhold som modellinndata.

- Enda en kolonne for etikettklassen. Vi har to mulige klasser for en tekst:

Not_AEogAdverse_Event.

Modelltrening og eksperimentering

For å effektivt utforske plassen til mulige Hugging Face-modeller for å finjustere våre kombinerte data om uønskede hendelser, konstruerte vi en SageMaker hyperparameter optimization (HPO) jobb og ga inn forskjellige Hugging Face-modeller som en hyperparameter, sammen med andre viktige hyperparametre som treningssatsstørrelse, sekvenslengde, modeller og læringshastighet. Opplæringsjobbene brukte en ml.p3dn.24xlarge instans og tok i gjennomsnitt 30 minutter per jobb med den instanstypen. Treningsberegninger ble fanget selv om Amazon SageMaker-eksperimenter verktøy, og hver treningsjobb gikk gjennom 10 epoker.

Vi spesifiserer følgende i koden vår:

- Treningsbatchstørrelse – Antall prøver som behandles sammen før modellvektene oppdateres

- Sekvenslengde – Maksimal lengde på inngangssekvensen som BERT kan behandle

- Læringsfrekvens – Hvor raskt modellen oppdaterer vektene sine under trening

- Modeller – Klemende ansikt forhåndstrene modeller

Resultater

Modellen som presterte best i vårt brukstilfelle var monologg/biobert_v1.1_pubmed modell vert på Hugging Face, som er en versjon av BERT-arkitekturen som er forhåndsopplært på Pubmed-datasettet, som består av 19,717 XNUMX vitenskapelige publikasjoner. Foropplæring av BERT på dette datasettet gir denne modellen ekstra ekspertise når det gjelder å identifisere kontekst rundt medisinsk relaterte vitenskapelige termer. Dette øker modellens ytelse for deteksjonsoppgaven for uønskede hendelser fordi den har blitt forhåndsopplært på medisinsk spesifikk syntaks som ofte vises i datasettet vårt.

Tabellen nedenfor oppsummerer våre evalueringsberegninger.

| Modell | Precision | Husker | F1 |

| Base BERT | 0.87 | 0.95 | 0.91 |

| BioBert | 0.89 | 0.95 | 0.92 |

| BioBERT med HPO | 0.89 | 0.96 | 0.929 |

| BioBERT med HPO og syntetisk generert bivirkning | 0.90 | 0.96 | 0.933 |

Selv om dette er relativt små og inkrementelle forbedringer i forhold til basis BERT-modellen, viser dette likevel noen levedyktige strategier for å forbedre modellytelsen gjennom disse metodene. Syntetisk datagenerering med Falcon ser ut til å holde mye løfte og potensial for ytelsesforbedringer, spesielt ettersom disse generative AI-modellene blir bedre over tid.

Rydd opp

For å unngå fremtidige kostnader, slett eventuelle ressurser som er opprettet som modellen og modellendepunktene du opprettet med følgende kode:

konklusjonen

Mange farmasøytiske selskaper i dag ønsker å automatisere prosessen med å identifisere uønskede hendelser fra deres kundeinteraksjoner på en systematisk måte for å bidra til å forbedre kundenes sikkerhet og resultater. Som vi viste i dette innlegget, klassifiserer den finjusterte LLM BioBERT med syntetisk genererte uønskede hendelser lagt til dataene uønskede hendelser med høye F1-score og kan brukes til å bygge en HIPAA-kompatibel løsning for våre kunder.

Som alltid tar AWS gjerne tilbakemeldinger fra deg. Legg igjen dine tanker og spørsmål i kommentarfeltet.

Om forfatterne

Zack Peterson er dataforsker i AWS Professional Services. Han har vært hands on å levere maskinlæringsløsninger til kunder i mange år og har en mastergrad i økonomi.

Zack Peterson er dataforsker i AWS Professional Services. Han har vært hands on å levere maskinlæringsløsninger til kunder i mange år og har en mastergrad i økonomi.

Dr. Adewale Akinfaderin er senior dataforsker i helsevesen og biovitenskap ved AWS. Hans ekspertise er i reproduserbare og ende-til-ende AI/ML-metoder, praktiske implementeringer og å hjelpe globale helsekunder med å formulere og utvikle skalerbare løsninger på tverrfaglige problemer. Han har to hovedgrader i fysikk og en doktorgrad i ingeniørfag.

Dr. Adewale Akinfaderin er senior dataforsker i helsevesen og biovitenskap ved AWS. Hans ekspertise er i reproduserbare og ende-til-ende AI/ML-metoder, praktiske implementeringer og å hjelpe globale helsekunder med å formulere og utvikle skalerbare løsninger på tverrfaglige problemer. Han har to hovedgrader i fysikk og en doktorgrad i ingeniørfag.

Ekta Walia Bhullar, PhD, er senior AI/ML-konsulent med forretningsenheten AWS Healthcare and Life Sciences (HCLS) Professional Services. Hun har lang erfaring med anvendelse av AI/ML innen helsevesenet, spesielt innen radiologi. Utenom jobben, når hun ikke diskuterer AI i radiologi, liker hun å løpe og gå tur.

Ekta Walia Bhullar, PhD, er senior AI/ML-konsulent med forretningsenheten AWS Healthcare and Life Sciences (HCLS) Professional Services. Hun har lang erfaring med anvendelse av AI/ML innen helsevesenet, spesielt innen radiologi. Utenom jobben, når hun ikke diskuterer AI i radiologi, liker hun å løpe og gå tur.

Han mann er en Senior Data Science & Machine Learning Manager med AWS Professional Services basert i San Diego, CA. Han har en doktorgrad i ingeniørfag fra Northwestern University og har flere års erfaring som ledelseskonsulent med rådgivning til kunder innen produksjon, finansielle tjenester og energi. I dag jobber han lidenskapelig med nøkkelkunder fra en rekke industrivertikaler for å utvikle og implementere ML og generative AI-løsninger på AWS.

Han mann er en Senior Data Science & Machine Learning Manager med AWS Professional Services basert i San Diego, CA. Han har en doktorgrad i ingeniørfag fra Northwestern University og har flere års erfaring som ledelseskonsulent med rådgivning til kunder innen produksjon, finansielle tjenester og energi. I dag jobber han lidenskapelig med nøkkelkunder fra en rekke industrivertikaler for å utvikle og implementere ML og generative AI-løsninger på AWS.

- SEO-drevet innhold og PR-distribusjon. Bli forsterket i dag.

- PlatoData.Network Vertical Generative Ai. Styrk deg selv. Tilgang her.

- PlatoAiStream. Web3 Intelligence. Kunnskap forsterket. Tilgang her.

- PlatoESG. Karbon, CleanTech, Energi, Miljø, Solenergi, Avfallshåndtering. Tilgang her.

- PlatoHelse. Bioteknologisk og klinisk etterretning. Tilgang her.

- kilde: https://aws.amazon.com/blogs/machine-learning/deploy-large-language-models-for-a-healthtech-use-case-on-amazon-sagemaker/

- : har

- :er

- :ikke

- :hvor

- $OPP

- 1

- 10

- 100

- 16

- 19

- 2017

- 2018

- 2021

- 2022

- 30

- 32

- 7

- a

- adgang

- Logg inn

- ACM

- handlinger

- Aktiviteter

- la til

- adresse

- fordelaktige

- uheldig

- rådgivning

- Etter

- AI

- AI-modeller

- AI / ML

- AL

- Alle

- tillater

- langs

- også

- alltid

- Amazon

- Amazon SageMaker

- Amazon Web Services

- beløp

- an

- analyse

- og

- besvare

- noen

- hvor som helst

- Søknad

- hensiktsmessig

- arkitektur

- arkitekturer

- ER

- områder

- rundt

- kunstig

- kunstig intelligens

- AS

- At

- delta

- oppmerksomhet

- automatisere

- tilgjengelig

- gjennomsnittlig

- unngå

- klar

- AWS

- AWS profesjonelle tjenester

- balanserte

- basen

- basert

- BE

- fordi

- vært

- før du

- være

- Fordeler

- BEST

- Bedre

- mellom

- toveis

- Milliarder

- øker

- både

- grenser

- bygge

- Bygning

- bygget

- virksomhet

- men

- by

- CA

- Samtaler

- CAN

- fanget

- saken

- utfordre

- utfordringer

- utfordrende

- avgifter

- klasse

- klasser

- klassifisering

- klienter

- Cloud

- kode

- Kolonne

- kolonner

- kombinert

- kommer

- kommer

- kommentarer

- Selskaper

- Selskapet

- utfyllende

- samsvar

- komponenter

- omfattende

- består

- konstruert

- konsulent

- inneholdt

- innhold

- kontekst

- Praktisk

- Kostnad

- Kostnader

- dekke

- skape

- opprettet

- kunde

- Kunder

- dato

- Dataklargjøring

- datavitenskap

- dataforsker

- Data struktur

- dypere

- definere

- Grad

- levere

- dykker

- demonstrerer

- avhengig

- utplassere

- beskrive

- Gjenkjenning

- utvikle

- utviklere

- Utvikling

- Diego

- forskjellig

- direkte

- diskutere

- Mangfold

- domene

- ikke

- medikament

- Narkotika

- under

- E&T

- hver enkelt

- Økonomi

- effektivt

- e-post

- muliggjøre

- muliggjør

- kryptering

- ende til ende

- energi

- Ingeniørarbeid

- epoker

- spesielt

- avgjørende

- evaluering

- Event

- hendelser

- eksempler

- unntak

- erfaring

- ekspertise

- leting

- utforske

- omfattende

- Omfattende erfaring

- ekstra

- f1

- Face

- tilbakemelding

- fyll

- finansiell

- finansielle tjenester

- Først

- fem

- fleksibel

- fokuserte

- etter

- Til

- fra

- fullt

- framtid

- general

- generere

- generert

- genererer

- generasjonen

- generative

- Generativ AI

- få

- gir

- Global

- oppgradere

- håndtere

- hender

- Ha

- he

- Helse

- helsetjenester

- helsevesenet

- HealthTech

- hjelpe

- hjelpe

- her.

- skjult

- Høy

- Fottur

- hans

- hold

- Hjemprodukt

- sykehus

- vert

- Hvordan

- Hvordan

- Men

- HTTPS

- Optimalisering av hyperparameter

- ideelt sett

- identifisering

- iverksette

- gjennomføring

- implementeringer

- implementert

- importere

- viktig

- forbedre

- forbedringer

- in

- inkluderer

- Inkludert

- Incorporated

- Øke

- økende

- inkrementell

- industri

- informasjon

- Infrastruktur

- inngang

- f.eks

- Integrerer

- integrasjoner

- Intelligens

- interaksjoner

- inn

- introdusert

- involvert

- IT

- DET ER

- Jobb

- Jobb

- jpg

- nøkkel

- Nøkkelområder

- Etiketten

- laid

- landskap

- Språk

- stor

- LÆRE

- læring

- Permisjon

- Lengde

- Bibliotek

- Life

- Life Sciences

- i likhet med

- liker

- LLM

- Lot

- maskin

- maskinlæring

- laget

- Hoved

- større

- GJØR AT

- Making

- mann

- fikk til

- ledelse

- leder

- håndbok

- produksjon

- mange

- marked

- massive

- mestere

- Maksimer

- maksimal

- mekanisme

- Media

- medisinsk

- medisinske data

- Møt

- metoder

- Metrics

- minutter

- ML

- modell

- modeller

- overvåket

- mer

- må

- navn

- Naturlig

- Natural Language Processing

- nettverk

- nevrale

- nevrale nettverket

- likevel

- neste

- nlp

- Nei.

- none

- Merknader

- roman

- Antall

- forekomme

- of

- tilbud

- Tilbud

- ofte

- on

- ONE

- bare

- optimalisering

- or

- rekkefølge

- original

- Annen

- vår

- ut

- utfall

- produksjon

- utenfor

- enn

- samlet

- ordnet

- Papir

- bestått

- for

- ytelse

- utført

- utfører

- Pharmaceutical

- phd

- telefon

- telefonsamtaler

- Fysikk

- plattform

- plato

- Platon Data Intelligence

- PlatonData

- vær så snill

- Populær

- mulig

- Post

- potensiell

- makt

- kraftig

- Praktisk

- forutsi

- forberedelse

- Problem

- problemer

- prosess

- Bearbeidet

- prosessering

- produserer

- profesjonell

- anslått

- løfte

- gir

- gi

- publikasjoner

- offentlig

- pytorch

- spørsmål

- spørsmål

- raskt

- område

- Sats

- reaksjon

- sanntids

- referere

- regex

- i slekt

- relativt

- rapportert

- representasjon

- krever

- påkrevd

- Krav

- Ressurser

- ansvarlig

- REST

- robust

- Kjør

- Sikkerhet

- sagemaker

- sample

- San

- San Diego

- skalerbar

- Skala

- Vitenskap

- VITENSKAPER

- vitenskapelig

- Forsker

- forskere

- sømløst

- Seksjon

- synes

- selger

- semantisk

- senior

- dømme

- sentiment

- Sequence

- alvorlig

- tjeneste

- Tjenester

- sett

- flere

- hun

- Vis

- viste

- Viser

- Størrelse

- skjev

- liten

- So

- selskap

- sosiale medier

- løsning

- Solutions

- noen

- noen ganger

- Kilder

- Rom

- spesialisert

- spesifikk

- detaljer

- splittet

- Begynn

- state-of-the-art

- Stater

- Steps

- Storm

- rett fram

- strategier

- struktur

- slik

- støtte

- sikker

- synergi

- syntaks

- syntetisk

- syntetiske data

- syntetisk

- system

- bord

- tatt

- tar

- ta

- Oppgave

- oppgaver

- vilkår

- test

- tekst

- Tekstklassifisering

- Det

- De

- verden

- deres

- deretter

- Disse

- de

- denne

- De

- selv om?

- Gjennom

- tid

- til

- i dag

- sammen

- tok

- verktøy

- verktøy

- temaer

- tradisjonelle

- Tog

- trent

- Kurs

- transformator

- transformers

- transitt

- Oversettelse

- prøvd

- utløse

- to

- typen

- forståelse

- enhet

- universitet

- I motsetning til

- oppdateringer

- us

- bruke

- bruk sak

- brukt

- nyttig

- Brukere

- ved hjelp av

- variasjon

- ulike

- versjon

- vertikaler

- levedyktig

- ønsker

- var

- Vei..

- we

- web

- webtjenester

- Ønsker velkommen

- var

- når

- mens

- hvilken

- med

- innenfor

- ord

- ord

- Arbeid

- arbeid

- virker

- verden

- ville

- år

- Du

- Din

- zephyrnet