Falske nyheter, definert som nyheter som formidler eller inneholder falsk, fabrikkert eller bevisst villedende informasjon, har eksistert så tidlig som trykkpressens fremvekst. Den raske spredningen av falske nyheter og desinformasjon på nettet er ikke bare villedende for publikum, men kan også ha en dyp innvirkning på samfunn, politikk, økonomi og kultur. Eksempler inkluderer:

- Å dyrke mistillit til media

- Undergraver den demokratiske prosessen

- Spredning av falsk eller diskreditert vitenskap (for eksempel anti-vax-bevegelsen)

Fremskritt innen kunstig intelligens (AI) og maskinlæring (ML) har gjort det enda enklere å utvikle verktøy for å lage og dele falske nyheter. Tidlige eksempler inkluderer avanserte sosiale roboter og automatiserte kontoer som overdriver den innledende fasen av å spre falske nyheter. Generelt er det ikke trivielt for publikum å avgjøre om slike kontoer er personer eller roboter. I tillegg er sosiale bots ikke ulovlige verktøy, og mange selskaper kjøper dem lovlig som en del av deres markedsføringsstrategi. Derfor er det ikke lett å dempe bruken av sosiale roboter systematisk.

Nylige oppdagelser innen generativ AI gjør det mulig å produsere tekstlig innhold i et enestående tempo ved hjelp av store språkmodeller (LLM). LLM-er er generative AI-tekstmodeller med over 1 milliard parametere, og de er tilrettelagt for syntese av høykvalitetstekst.

I dette innlegget utforsker vi hvordan du kan bruke LLM-er til å takle det utbredte problemet med å oppdage falske nyheter. Vi foreslår at LLM-er er tilstrekkelig avanserte for denne oppgaven, spesielt hvis forbedrede hurtigteknikker som f.eks Tankekjede og Reagere brukes sammen med verktøy for informasjonsinnhenting.

Vi illustrerer dette ved å lage en Langkjede applikasjon som, gitt en nyhet, informerer brukeren om artikkelen er sann eller falsk ved bruk av naturlig språk. Løsningen bruker også Amazonas grunnfjell, en fullstendig administrert tjeneste som gjør grunnmodeller (FM-er) fra Amazon og tredjeparts modellleverandører tilgjengelige via AWS-administrasjonskonsoll og APIer.

LLM-er og falske nyheter

Fenomenet med falske nyheter begynte å utvikle seg raskt med fremkomsten av internett og mer spesifikt sosiale medier (Nielsen et al., 2017). På sosiale medier kan falske nyheter raskt deles i en brukers nettverk, noe som fører til at publikum danner seg feil kollektiv mening. I tillegg forplanter folk ofte falske nyheter impulsivt, og ignorerer fakta om innholdet hvis nyhetene resonerer med deres personlige normer (Tsipursky et al. 2018). Forskning innen samfunnsvitenskap har antydet at kognitiv skjevhet (bekreftelsesskjevhet, bandwagon-effekt og valgstøttende skjevhet) er en av de mest sentrale faktorene for å ta irrasjonelle beslutninger når det gjelder både opprettelse og forbruk av falske nyheter (Kim, et al., 2021). Dette innebærer også at nyhetsforbrukere deler og bruker informasjon kun i retning av å styrke deres tro.

Kraften til generativ AI til å produsere tekstlig og rikt innhold i et enestående tempo forverrer problemet med falske nyheter. Et eksempel som er verdt å nevne er deepfake-teknologi – kombinere ulike bilder på en original video og generere en annen video. Foruten desinformasjonsintensjonen som menneskelige aktører bringer til blandingen, legger LLM-er til et helt nytt sett med utfordringer:

- Faktiske feil – LLM-er har økt risiko for å inneholde faktafeil på grunn av deres trening og evne til å være kreative mens de genererer de neste ordene i en setning. LLM-trening er basert på gjentatte ganger å presentere en modell med ufullstendige input, for deretter å bruke ML-treningsteknikker til den riktig fyller hullene, og derved lære språkstruktur og en språkbasert verdensmodell. Følgelig, selv om LLM-er er gode mønstertilpassere og re-kombinere ("stokastiske papegøyer"), mislykkes de i en rekke enkle oppgaver som krever logisk resonnement eller matematisk deduksjon, og kan hallusinere svar. I tillegg er temperatur en av LLM-inndataparametrene som styrer oppførselen til modellen når det genereres neste ord i en setning. Ved å velge en høyere temperatur vil modellen bruke et ord med lavere sannsynlighet, og gi en mer tilfeldig respons.

- lange – Genererte tekster har en tendens til å være lange og mangler en klart definert granularitet for individuelle fakta.

- Mangel på faktasjekking – Det er ingen standardisert verktøy tilgjengelig for faktasjekking under prosessen med tekstgenerering.

Samlet sett har kombinasjonen av menneskelig psykologi og begrensninger av AI-systemer skapt en perfekt storm for spredning av falske nyheter og feilinformasjon på nettet.

Løsningsoversikt

LLM-er viser enestående evner innen språkgenerering, forståelse og få-skuddslæring. De er trent på et stort korpus av tekst fra internett, der kvaliteten og nøyaktigheten av utvunnet naturlig språk kanskje ikke er sikret.

I dette innlegget gir vi en løsning for å oppdage falske nyheter basert både på Chain-of-Thought og Re-Act (Reasoning and Acting) umiddelbare tilnærminger. Først diskuterer vi de to prompte ingeniørteknikkene, deretter viser vi implementeringen ved hjelp av LangChain og Amazon Bedrock.

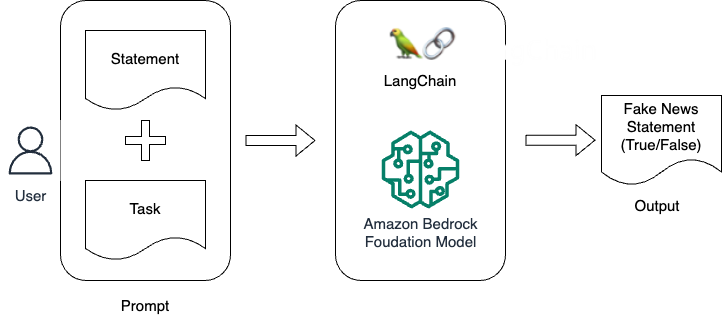

Følgende arkitekturdiagram skisserer løsningen for vår falske nyhetsdetektor.

Arkitekturdiagram for oppdagelse av falske nyheter.

Vi bruker en delmengde av FEVER datasett som inneholder en uttalelse og grunnsannheten om uttalelsen som indikerer falske, sanne eller ukontrollerbare påstander (Thorne J. et al., 2018).

Arbeidsflyten kan deles inn i følgende trinn:

- Brukeren velger ett av utsagnene for å sjekke om det er falskt eller sant.

- Uttalelsen og oppdagelsesoppgaven for falske nyheter er integrert i ledeteksten.

- Spørringen sendes til LangChain, som påkaller FM i Amazon Bedrock.

- Amazon Bedrock returnerer et svar på brukerforespørselen med påstanden True or False.

I dette innlegget bruker vi Claude v2-modellen fra Anthrophic (anthropic.claude-v2). Claude er en generativ LLM basert på Anthropics forskning på å skape pålitelige, tolkbare og styrbare AI-systemer. Laget ved hjelp av teknikker som konstitusjonell AI og harmløshetstrening, utmerker Claude seg på gjennomtenkt dialog, innholdsskaping, kompleks resonnement, kreativitet og koding. Men ved å bruke Amazon Bedrock og løsningsarkitekturen vår har vi også fleksibiliteten til å velge blant andre FM-er levert av Amazon, AI21labs, Kohererog Stabilitet.ai.

Du finner implementeringsdetaljene i de følgende delene. Kildekoden er tilgjengelig i GitHub-depotet.

Forutsetninger

For denne opplæringen trenger du en bash-terminal med Python 3.9 eller høyere installert på enten Linux, Mac eller et Windows-undersystem for Linux og en AWS-konto.

Vi anbefaler også å bruke enten en Amazon SageMaker Studio notatbok, en AWS Cloud9 eksempel, eller en Amazon Elastic Compute Cloud (Amazon EC2) forekomst.

Distribuer falske nyhetsdeteksjon ved hjelp av Amazon Bedrock API

Løsningen bruker Amazon Bedrock API, som kan nås ved hjelp av AWS kommandolinjegrensesnitt (AWS CLI), den AWS SDK for Python (Boto3), eller en Amazon SageMaker notisbok. Referere til Amazon Bedrock brukerveiledning for mer informasjon. For dette innlegget bruker vi Amazon Bedrock API via AWS SDK for Python.

Sett opp Amazon Bedrock API-miljø

For å sette opp Amazon Bedrock API-miljøet, fullfør følgende trinn:

- Last ned den nyeste Boto3 eller oppgrader den:

- Sørg for at du konfigurerer AWS-legitimasjonen ved å bruke

aws configurekommando eller send dem til Boto3-klienten. - Installer den nyeste versjonen av Langkjede:

Du kan nå teste oppsettet ditt ved å bruke følgende Python-skallskript. Skriptet instansierer Amazon Bedrock-klienten ved å bruke Boto3. Deretter kaller vi list_foundation_models API for å få listen over grunnlagsmodeller som er tilgjengelige for bruk.

Etter å ha kjørt den foregående kommandoen, bør du få listen over FM-er fra Amazon Bedrock.

LangChain som en rask kjedeløsning

For å oppdage falske nyheter for en gitt setning følger vi nullskuddsprosessen Chain-of-Thought (Wei J. et al., 2022), som består av følgende trinn:

- Til å begynne med prøver modellen å lage en uttalelse om nyhetene.

- Modellen lager en punktliste med påstander.

- For hver påstand bestemmer modellen om påstanden er sann eller usann. Merk at ved å bruke denne metodikken, er modellen utelukkende avhengig av intern kunnskap (vekter beregnet i før-treningsfasen) for å komme til en dom. Informasjonen er ikke verifisert mot eksterne data på dette tidspunktet.

- Gitt fakta, svarer modellen SANN eller USANN for det gitte utsagnet i ledeteksten.

For å oppnå disse trinnene bruker vi LangChain, et rammeverk for utvikling av applikasjoner drevet av språkmodeller. Dette rammeverket lar oss utvide FM-ene ved å lenke sammen ulike komponenter for å lage avanserte brukstilfeller. I denne løsningen bruker vi den innebygde SimpleSequentialChain i LangChain for å lage en enkel sekvensiell kjede. Dette er veldig nyttig, fordi vi kan ta utdata fra en kjede og bruke det som input til en annen.

Amazon Bedrock er integrert med LangChain, så du trenger bare å instansiere det ved å passere model_id ved instansiering av Amazon Bedrock-objektet. Om nødvendig kan modellslutningsparametrene gis gjennom model_kwargs argument, som:

- maxTokenCount – Maksimalt antall tokens i det genererte svaret

- stopSequences – Stoppsekvensen brukt av modellen

- temperatur – En verdi som varierer mellom 0–1, der 0 er den mest deterministiske og 1 er den mest kreative

- topp – En verdi som varierer mellom 0–1, og brukes til å kontrollere tokens valg basert på sannsynligheten for de potensielle valgene

Hvis dette er første gang du bruker en grunnmodell fra Amazon Bedrock, sørg for at du ber om tilgang til modellen ved å velge fra listen over modeller på Modelltilgang side på Amazon Bedrock-konsollen, som i vårt tilfelle er claude-v2 fra Anthropic.

Følgende funksjon definerer Chain-of-Thought prompt-kjeden vi nevnte tidligere for å oppdage falske nyheter. Funksjonen tar Amazon Bedrock-objektet (llm) og brukerprompten (q) som argumenter. LangChain's PromptTemplate funksjonalitet brukes her for å forhåndsdefinere en oppskrift for generering av ledetekster.

Følgende kode kaller funksjonen vi definerte tidligere og gir svaret. Uttalelsen er TRUE or FALSE. TRUE betyr at erklæringen inneholder korrekte fakta, og FALSE betyr at utsagnet inneholder minst ett uriktig faktum.

Et eksempel på en uttalelse og modellrespons er gitt i følgende utdata:

ReAct og verktøy

I det foregående eksempelet identifiserte modellen riktig at påstanden er usann. Å sende inn spørringen på nytt viser imidlertid modellens manglende evne til å skille riktigheten av fakta. Modellen har ikke verktøyene til å verifisere sannheten til utsagn utover sitt eget treningsminne, så påfølgende kjøringer av samme spørsmål kan føre til at den feilmerker falske utsagn som sanne. I følgende kode har du en annen kjøring av samme eksempel:

En teknikk for å garantere sannhet er ReAct. React (Yao S. et al., 2023) er en rask teknikk som forsterker grunnmodellen med en agents handlingsrom. I dette innlegget, så vel som i ReAct-artikkelen, implementerer handlingsrommet informasjonsinnhenting ved hjelp av søk, oppslag og fullfør handlinger fra et enkelt Wikipedia web-API.

Årsaken bak bruken av ReAct i forhold til Chain-of-Thought er å bruke ekstern kunnskapsinnhenting for å utvide grunnlagsmodellen for å oppdage om en gitt nyhet er falsk eller sann.

I dette innlegget bruker vi LangChains implementering av ReAct gjennom agenten ZERO_SHOT_REACT_DESCRIPTION. Vi endrer den forrige funksjonen for å implementere ReAct og bruker Wikipedia ved å bruke load_tools-funksjonen fra langchain.agents.

Vi må også installere Wikipedia-pakken:

!pip install Wikipedia

Nedenfor er den nye koden:

Følgende er resultatet av den foregående funksjonen gitt den samme setningen som ble brukt før:

Rydd opp

For å spare kostnader, slett alle ressursene du distribuerte som en del av opplæringen. Hvis du lanserte AWS Cloud9 eller en EC2-forekomst, kan du slette den via konsollen eller ved å bruke AWS CLI. På samme måte kan du slette SageMaker-notisboken du kan ha opprettet via SageMaker-konsollen.

Begrensninger og relatert arbeid

Feltet for oppdagelse av falske nyheter forskes aktivt på i det vitenskapelige miljøet. I dette innlegget brukte vi Chain-of-Thought og ReAct-teknikker, og i evalueringen av teknikkene fokuserte vi kun på nøyaktigheten av prompt-teknikkklassifiseringen (hvis et gitt utsagn er sant eller usant). Derfor har vi ikke vurdert andre viktige aspekter som responshastighet, og heller ikke utvidet løsningen til ytterligere kunnskapsbasekilder enn Wikipedia.

Selv om dette innlegget fokuserte på to teknikker, Chain-of-Thought og ReAct, har et omfattende arbeid utforsket hvordan LLM-er kan oppdage, eliminere eller redusere falske nyheter. Lee et al. har foreslått bruk av en koder-dekoder-modell som bruker NER (navngitt entitetsgjenkjenning) for å maskere de navngitte enhetene for å sikre at tokenet som er maskert faktisk bruker kunnskapen som er kodet i språkmodellen. Chern et.al. utviklet FacTool, som bruker Chain-of-Thought-prinsipper for å trekke ut påstander fra ledeteksten, og følgelig samle inn relevante bevis for påstandene. LLM bedømmer deretter fakta av påstanden gitt den hentede listen over bevis. Du E. et al. presenterer en komplementær tilnærming der flere LLM-er foreslår og debatterer sine individuelle svar og resonneringsprosesser over flere runder for å komme frem til et felles endelig svar.

Basert på litteraturen ser vi at effektiviteten til LLM-er for å oppdage falske nyheter øker når LLM-ene utvides med ekstern kunnskap og multi-agent samtaleevne. Imidlertid er disse tilnærmingene mer beregningsmessig komplekse fordi de krever flere modellanrop og interaksjoner, lengre meldinger og lange nettverkslagsanrop. Til syvende og sist oversetter denne kompleksiteten til en økt totalkostnad. Vi anbefaler å vurdere kostnad-til-ytelse-forholdet før du tar i bruk lignende løsninger i produksjonen.

konklusjonen

I dette innlegget fordypet vi oss i hvordan man bruker LLM-er for å takle det utbredte problemet med falske nyheter, som er en av de største utfordringene i samfunnet vårt i dag. Vi startet med å skissere utfordringene som falske nyheter gir, med vekt på potensialet til å påvirke offentlige følelser og forårsake samfunnsforstyrrelser.

Vi introduserte deretter konseptet med LLM-er som avanserte AI-modeller som er trent på en betydelig mengde data. På grunn av denne omfattende opplæringen kan disse modellene skryte av en imponerende forståelse av språk, som gjør dem i stand til å produsere menneskelignende tekst. Med denne kapasiteten demonstrerte vi hvordan LLM-er kan utnyttes i kampen mot falske nyheter ved å bruke to forskjellige promptteknikker, Chain-of-Thought og ReAct.

Vi understreket hvordan LLM-er kan legge til rette for faktasjekkingstjenester i en enestående skala, gitt deres evne til å behandle og analysere store mengder tekst raskt. Dette potensialet for sanntidsanalyse kan føre til tidlig oppdagelse og inneslutning av falske nyheter. Vi illustrerte dette ved å lage et Python-skript som, gitt en uttalelse, fremhever for brukeren om artikkelen er sann eller falsk ved bruk av naturlig språk.

Vi avsluttet med å understreke begrensningene til den nåværende tilnærmingen og avsluttet med et håpefullt notat, og understreket at med de riktige sikkerhetstiltakene og kontinuerlige forbedringene, kan LLM-er bli uunnværlige verktøy i kampen mot falske nyheter.

Vi vil gjerne høre fra deg. Fortell oss hva du synes i kommentarfeltet, eller bruk problemforumet i GitHub-depotet.

Ansvarsfraskrivelse: Koden gitt i dette innlegget er kun ment for utdannings- og eksperimenteringsformål. Det bør ikke stoles på for å oppdage falske nyheter eller feilinformasjon i produksjonssystemer i den virkelige verden. Det gis ingen garantier for nøyaktigheten eller fullstendigheten av oppdagelse av falske nyheter ved bruk av denne koden. Brukere bør utvise forsiktighet og utføre due diligence før de bruker disse teknikkene i sensitive applikasjoner.

For å komme i gang med Amazon Bedrock, besøk Amazon Bedrock-konsoll.

Om forfatterne

Anamaria Todor er en Principal Solutions Architect med base i København, Danmark. Hun så sin første datamaskin da hun var 4 år gammel og ga aldri slipp på informatikk, videospill og ingeniørkunst siden. Hun har jobbet i ulike tekniske roller, fra frilanser, full-stack-utvikler, til dataingeniør, teknisk leder og CTO, i ulike selskaper i Danmark, med fokus på spill- og reklamebransjen. Hun har vært hos AWS i over 3 år, og jobbet som Principal Solutions Architect, hovedsakelig med fokus på biovitenskap og AI/ML. Anamaria har en bachelor i anvendt ingeniørfag og informatikk, en mastergrad i informatikk og over 10 års AWS-erfaring. Når hun ikke jobber eller spiller videospill, trener hun jenter og kvinnelige profesjonelle i å forstå og finne veien gjennom teknologi.

Anamaria Todor er en Principal Solutions Architect med base i København, Danmark. Hun så sin første datamaskin da hun var 4 år gammel og ga aldri slipp på informatikk, videospill og ingeniørkunst siden. Hun har jobbet i ulike tekniske roller, fra frilanser, full-stack-utvikler, til dataingeniør, teknisk leder og CTO, i ulike selskaper i Danmark, med fokus på spill- og reklamebransjen. Hun har vært hos AWS i over 3 år, og jobbet som Principal Solutions Architect, hovedsakelig med fokus på biovitenskap og AI/ML. Anamaria har en bachelor i anvendt ingeniørfag og informatikk, en mastergrad i informatikk og over 10 års AWS-erfaring. Når hun ikke jobber eller spiller videospill, trener hun jenter og kvinnelige profesjonelle i å forstå og finne veien gjennom teknologi.

Marcel Castro er en senior løsningsarkitekt med base i Oslo, Norge. I sin rolle hjelper Marcel kunder med arkitektur, design og utvikling av skyoptimalisert infrastruktur. Han er medlem av AWS Generative AI Ambassador-teamet med mål om å drive og støtte EMEA-kunder på deres generative AI-reise. Han har en doktorgrad i informatikk fra Sverige og en master- og bachelorgrad i elektroteknikk og telekommunikasjon fra Brasil.

Marcel Castro er en senior løsningsarkitekt med base i Oslo, Norge. I sin rolle hjelper Marcel kunder med arkitektur, design og utvikling av skyoptimalisert infrastruktur. Han er medlem av AWS Generative AI Ambassador-teamet med mål om å drive og støtte EMEA-kunder på deres generative AI-reise. Han har en doktorgrad i informatikk fra Sverige og en master- og bachelorgrad i elektroteknikk og telekommunikasjon fra Brasil.

- SEO-drevet innhold og PR-distribusjon. Bli forsterket i dag.

- PlatoData.Network Vertical Generative Ai. Styrk deg selv. Tilgang her.

- PlatoAiStream. Web3 Intelligence. Kunnskap forsterket. Tilgang her.

- PlatoESG. Karbon, CleanTech, Energi, Miljø, Solenergi, Avfallshåndtering. Tilgang her.

- PlatoHelse. Bioteknologisk og klinisk etterretning. Tilgang her.

- kilde: https://aws.amazon.com/blogs/machine-learning/harness-large-language-models-in-fake-news-detection/

- : har

- :er

- :ikke

- :hvor

- $ 100 millioner

- $OPP

- 1

- 10

- 100

- 12

- 13

- 14

- 20

- 2022

- 21.

- 26%

- 27

- 32

- 36

- 7

- 9

- a

- evne

- Om oss

- ovenfor

- AC

- akademisk

- akademisk forskning

- Academy

- adgang

- aksesseres

- tilgjengelig

- Logg inn

- kontoer

- nøyaktighet

- Oppnå

- prestasjoner

- tvers

- skuespill

- Handling

- handlinger

- aktivt

- aktører

- faktisk

- legge til

- tillegg

- Ytterligere

- avansert

- advent

- Annonsering

- en gang til

- mot

- Agent

- agenter

- AI

- AI-modeller

- AI-systemer

- AI / ML

- AL

- Alle

- tillater

- alene

- også

- Selv

- Amazon

- Amazon EC2

- Amazon Web Services

- Ambassadør

- amerikansk

- blant

- beløp

- an

- analyse

- analysere

- Eldgammel

- og

- Årlig

- En annen

- besvare

- svar

- Antropisk

- noen

- api

- APIer

- vises

- Søknad

- søknader

- anvendt

- utnevnt

- tilnærming

- tilnærminger

- ca

- arkitektur

- ER

- argument

- argumenter

- rundt

- Artikkel

- kunstig

- kunstig intelligens

- Kunstig intelligens (AI)

- Arts

- AS

- aspekter

- vurdere

- vurderingene

- antagelser

- trygg

- astronomi

- At

- forsøk

- øke

- augmented

- forstørrelser

- Automatisert

- tilgjengelig

- tildelt

- AWS

- AWS Cloud9

- basen

- basert

- bash

- Battle

- BE

- fordi

- bli

- bli

- vært

- før du

- atferd

- bak

- være

- tro

- foruten

- mellom

- Beyond

- Bias

- Milliarder

- biologi

- biomedisinsk

- kroppen

- både

- roboter

- Brasil

- bringe

- Brutt

- innebygd

- forretningsmann

- men

- by

- ring

- Samtaler

- CAN

- evner

- evne

- Kapasitet

- saken

- saker

- Årsak

- forsiktighet

- Århundre

- kjede

- kjeder

- utfordringer

- chang

- sjekk

- kjemi

- Kinesisk

- valg

- Velg

- hevder

- krav

- klasse

- klassifisering

- klart

- kunde

- Lukke

- Cloud9

- coaching

- kode

- Koding

- kognitiv

- samle

- Collective

- Høyskole

- COLUMBIA

- kombinasjon

- kommentarer

- Felles

- vanligvis

- samfunnet

- Selskaper

- sammenligning

- utfyllende

- fullføre

- komplekse

- kompleksitet

- komponenter

- komponert

- Beregn

- datamaskin

- informatikk

- konsept

- konkluderte

- Bekrefte

- bekreftelse

- sammen

- Følgelig

- ansett

- konsistent

- består

- Konsoll

- forbruke

- Forbrukere

- forbruk

- Begrensning

- inneholder

- innhold

- innholdsskaping

- kontinuerlig

- bidrag

- kontroll

- kontroller

- Samtale

- korrigere

- riktig

- Kostnad

- Kostnader

- kunne

- land

- land

- skape

- opprettet

- skaper

- Opprette

- skaperverket

- Kreativ

- kreativitet

- Credentials

- CTO

- Kultur

- dempe

- Gjeldende

- Kunder

- dato

- debatt

- avgjørelser

- definert

- definerer

- Grad

- demokratisk

- demonstrert

- demonstrerer

- demonstrere

- Danmark

- Avdeling

- utplassert

- utplasserings

- utforming

- detaljer

- oppdage

- Gjenkjenning

- Bestem

- bestemmes

- utviklet

- Utvikler

- utvikle

- Utvikling

- utviklingen

- Dialog

- forskjellig

- aktsomhet

- retning

- diskutere

- desinformasjon

- Vise

- forstyrrelser

- skille

- mistro

- Doktor

- gjør

- ikke

- ned

- dr

- stasjonen

- to

- under

- e

- E&T

- hver enkelt

- Tidligere

- Tidlig

- tjene

- opptjent

- jord

- enklere

- lett

- Økonomi

- økonomi

- pedagogisk

- lærere

- effekt

- effektivitet

- enten

- eliminere

- andre steder

- EMEA

- veksten

- vekt

- muliggjør

- endte

- ingeniør

- Ingeniørarbeid

- forbedringer

- sikre

- går inn

- enheter

- enhet

- Miljø

- likestilling

- feil

- spesielt

- etablert

- evaluere

- Selv

- hendelser

- utvikling

- eksempel

- eksempler

- utelukkende

- Øvelse

- erfaring

- Forklar

- utforske

- utforsket

- omfattende

- utvendig

- trekke ut

- legge til rette

- tilrettelagt

- Faktisk

- faktorer

- fakta

- FAIL

- forfalskning

- falske nyheter

- falsk

- berømt

- hunn

- felt

- slåss

- fyller

- slutt~~POS=TRUNC

- finansiell

- Finn

- finne

- ferdig

- Først

- første gang

- fleksibilitet

- fokuserte

- fokuserer

- fokusering

- følge

- etter

- Til

- skjema

- formell

- Forum

- Fundament

- grunn

- Stiftet

- Rammeverk

- fra

- fu

- fullt

- funksjon

- funksjonalitet

- Games

- gaming

- hull

- Kjønn

- Likestillings

- general

- generere

- generert

- genererer

- generasjonen

- generative

- Generativ AI

- få

- jenter

- GitHub

- gitt

- Go

- mål

- flott

- Ground

- garantier

- HAD

- seletøy

- Ha

- he

- høre

- hjelpe

- hjelper

- her

- her.

- høykvalitets

- høyere

- striper

- svært

- hans

- historie

- holder

- ære

- håpefull

- bolig

- Hvordan

- Hvordan

- Men

- HTML

- http

- HTTPS

- menneskelig

- i

- IBM

- identifisert

- if

- ulovlig

- illustrere

- bilder

- Påvirkning

- iverksette

- gjennomføring

- redskaper

- importere

- viktig

- imponerende

- forbedret

- in

- manglende evne

- inkludere

- inkluderer

- Inkludert

- Incorporated

- inkorporerer

- økt

- øker

- indikerer

- individuelt

- bransjer

- informasjon

- informerer

- Infrastruktur

- innledende

- inngang

- innsiden

- installere

- installerte

- f.eks

- Institute

- institusjoner

- integrert

- Intelligens

- hensikt

- interaksjoner

- intern

- Internet

- inn

- introdusert

- påkaller

- involvert

- utstedelse

- saker

- IT

- DET ER

- reise

- jpg

- JSON

- dommere

- Kenneth

- Vet

- kunnskap

- kjent

- maling

- Språk

- stor

- Late

- siste

- Latin

- lansert

- lag

- føre

- ledende

- læring

- minst

- lovlig

- la

- Life

- Life Sciences

- i likhet med

- begrensninger

- linje

- lenker

- linux

- Liste

- oppført

- litteratur

- LLM

- logisk

- lenger

- oppslag

- elsker

- mac

- maskin

- maskinlæring

- laget

- hovedsakelig

- opprettholder

- større

- gjøre

- GJØR AT

- Making

- fikk til

- ledelse

- mange

- Marketing

- maske

- mestere

- matematiske

- matematikk

- maksimal

- Kan..

- midler

- ment

- Media

- medisinsk

- medisin

- medlem

- medlemmer

- Minne

- nevnt

- metodikk

- Michigan

- millioner

- gruver

- feil~~POS=TRUNC

- villedende

- MIT

- Minske

- bland

- ML

- modell

- modeller

- modifisere

- mer

- mest

- bevegelse

- flere

- my

- oppkalt

- Nasa

- nasjonal

- Naturlig

- Natur

- Trenger

- nødvendig

- nettverk

- aldri

- Ny

- nyheter

- neste

- Nei.

- Nobelprisvinneren

- normer

- Norge

- bemerkelsesverdig

- bærbare

- nå

- Antall

- objekt

- observasjon

- oktober

- of

- tilbudt

- ofte

- Gammel

- on

- ONE

- på nett

- bare

- Drift

- Mening

- or

- rekkefølge

- original

- Annen

- ellers

- vår

- skisserer

- skisserer

- produksjon

- enestående

- enn

- samlet

- egen

- eide

- Fred

- pakke

- side

- sider

- Papir

- parametere

- del

- passere

- bestått

- Passerer

- Patenter

- banen

- Mønster

- Ansatte

- perfekt

- Utfør

- personlig

- fase

- phd

- fenomen

- filosofi

- Fysikk

- brikke

- sentral

- plato

- Platon Data Intelligence

- PlatonData

- spiller

- Point

- politikk

- mulig

- Post

- potensiell

- makt

- powered

- presentert

- gaver

- trykk

- utbredt

- forrige

- tidligere

- primært

- Principal

- prinsipper

- utskrift

- Trykkpresse

- Før

- premier

- Problem

- prosess

- Prosesser

- produsere

- Produksjon

- fagfolk

- dyp

- program

- foreslå

- foreslått

- gi

- forutsatt

- tilbydere

- gir

- gi

- Psykologi

- offentlig

- Kjøp

- formål

- Python

- kvalitet

- kvantitet

- raskt

- radio

- tilfeldig

- serier

- rangert

- rask

- raskt

- ratio

- å nå

- Reager

- virkelige verden

- sanntids

- grunnen til

- motta

- mottatt

- .

- anerkjennelse

- anbefaler

- referere

- refererer

- i slekt

- relativt

- relevant

- pålitelig

- GJENTATTE GANGER

- Repository

- anmode

- krever

- påkrevd

- forskning

- resonerer

- Ressurser

- Svare

- svar

- svar

- ansvarlig

- retur

- avkastning

- Rich

- Risiko

- Rolle

- roller

- runder

- Kjør

- rennende

- går

- s

- sikringstiltak

- sagemaker

- samme

- Spar

- så

- Skala

- Skole

- School of Engineering

- Vitenskap

- VITENSKAPER

- vitenskapelig

- forskere

- script

- SDK

- Søk

- Seksjon

- seksjoner

- se

- velge

- senior

- sensitive

- dømme

- sentiment

- Sequence

- tjeneste

- Tjenester

- sett

- oppsett

- Del

- delt

- Aksjer

- deling

- hun

- Shell

- bør

- Vis

- lignende

- på samme måte

- Enkelt

- siden

- søster

- So

- selskap

- sosiale medier

- samfunnsmessig

- Samfunnet

- løsning

- Solutions

- noen

- kilde

- kildekoden

- Kilder

- Rom

- Spenning

- spesielt

- fart

- spre

- sprer

- Scene

- Standard

- stanford

- Stanford University

- startet

- Uttalelse

- uttalelser

- Stater

- Steps

- Stopp

- Storm

- Strategi

- styrke

- struktur

- Studenter

- Studer

- senere

- betydelig

- vellykket

- slik

- foreslår

- SAMMENDRAG

- Superladning

- støtte

- sikker

- Sway

- Sverige

- raskt

- syntese

- Systemer

- takle

- Ta

- tar

- Oppgave

- oppgaver

- lag

- Teknisk

- teknikk

- teknikker

- teknologisk

- Teknologi

- telekommunikasjon

- mal

- terminal

- vilkår

- test

- tekst

- tekstlig

- Det

- De

- informasjonen

- Kilden

- verden

- deres

- Dem

- deretter

- Der.

- derved

- derfor

- Disse

- de

- tror

- tredjeparts

- denne

- De

- trodde

- Gjennom

- hele

- SLIPS

- tid

- tidslinje

- til

- sammen

- token

- tokens

- verktøy

- trent

- Kurs

- sant

- Sannhet

- tutorial

- to

- Til syvende og sist

- understreket

- forståelse

- forent

- Forente Stater

- universiteter

- universitet

- enestående

- enestående

- til

- oppgradering

- upon

- us

- bruke

- brukt

- Bruker

- Brukere

- bruker

- ved hjelp av

- utnytte

- verdi

- ulike

- enorme

- Kjennelse

- verifisert

- verifisere

- versjon

- veldig

- av

- video

- videospill

- Besøk

- var

- we

- web

- webtjenester

- VI VIL

- Hva

- når

- om

- hvilken

- mens

- HVEM

- hele

- hvorfor

- Wikipedia

- vil

- vinduer

- med

- innenfor

- kvinne

- Dame

- Vant

- ord

- ord

- Arbeid

- arbeidet

- arbeidsflyt

- arbeid

- verden

- verdt

- Feil

- år

- Du

- Din

- zephyrnet