Effektive selvbetjeningsalternativer blir stadig mer kritiske for kontaktsentre, men å implementere dem godt byr på unike utfordringer.

Amazon Lex gir din Amazon Connect kontaktsenter med chatbot-funksjoner som automatisk talegjenkjenning (ASR) og naturlig språkforståelse (NLU) gjennom tale- og tekstkanaler. Boten tar naturlig tale eller tekstinndata, gjenkjenner intensjonen bak input, og oppfyller brukerens hensikt ved å påkalle riktig respons.

Innringere kan ha forskjellige aksenter, uttale og grammatikk. Kombinert med bakgrunnsstøy kan dette gjøre det utfordrende for talegjenkjenning å forstå utsagn nøyaktig. For eksempel kan «Jeg vil spore bestillingen min» miskjennes som «Jeg vil laste innehaveren min». Mislykkede hensikter som disse frustrerer kunder som må gjenta seg selv, blir rutet feil eller blir eskalert til aktive agenter – noe som koster bedrifter mer.

Amazonas grunnfjell demokratiserer tilgang til grunnleggende modell (FM) for utviklere til å enkelt bygge og skalere generative AI-baserte applikasjoner for det moderne kontaktsenteret. FM-er levert av Amazon Bedrock, som f.eks Amazon Titan og Antropiske Claude, er forhåndsopplært på datasett i internettskala som gir dem sterke NLU-evner som setningsklassifisering, spørsmål og svar, og forbedret semantisk forståelse til tross for talegjenkjenningsfeil.

I dette innlegget utforsker vi en løsning som bruker FM-er levert av Amazon Bedrock for å forbedre intensjonsgjenkjenning av Amazon Lex integrert med Amazon Connect, og til slutt levere en forbedret selvbetjeningsopplevelse for kundene dine.

Oversikt over løsning

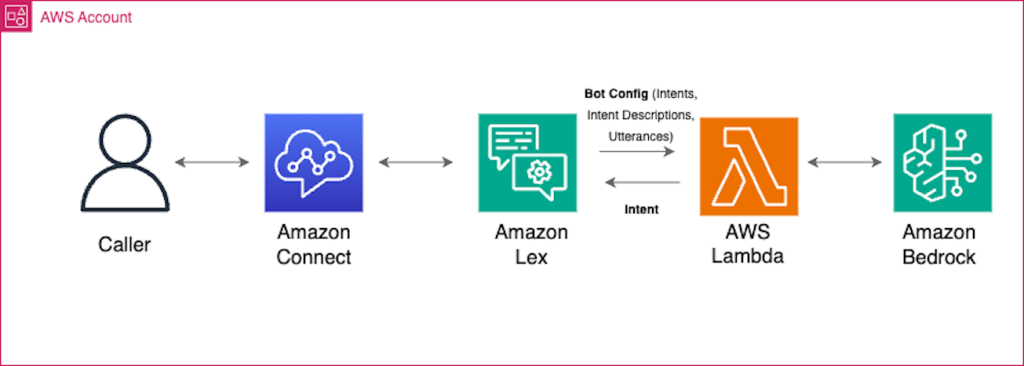

Løsningen bruker Amazon Connect, Amazon Lex , AWS Lambdaog Amazonas grunnfjell i følgende trinn:

- En Amazon Connect-kontaktflyt integreres med en Amazon Lex-bot via

GetCustomerInputblokkere. - Når boten ikke klarer å gjenkjenne den som ringer, og som standard bruker reservehensikten, utløses en Lambda-funksjon.

- Lambda-funksjonen tar transkripsjonen av kundeytringen og sender den til en grunnmodell i Amazon Bedrock

- Ved å bruke sine avanserte naturlige språkfunksjoner, bestemmer modellen oppringerens hensikt.

- Lambda-funksjonen dirigerer deretter boten til å rute anropet til riktig hensikt for oppfyllelse.

Ved å bruke Amazon Bedrock-fundamentmodeller gjør løsningen Amazon Lex-roboten i stand til å forstå intensjoner til tross for talegjenkjenningsfeil. Dette resulterer i jevn ruting og oppfyllelse, forhindrer eskaleringer til agenter og frustrerende repetisjoner for innringere.

Følgende diagram illustrerer løsningsarkitekturen og arbeidsflyten.

I de følgende avsnittene ser vi på nøkkelkomponentene i løsningen mer detaljert.

Lambda-funksjoner og LangChain Framework

Når Amazon Lex-roboten påkaller Lambda-funksjonen, sender den en hendelsesmelding som inneholder botinformasjon og transkripsjonen av ytringen fra den som ringer. Ved å bruke denne hendelsesmeldingen henter Lambda-funksjonen dynamisk robotens konfigurerte hensikter, intensjonsbeskrivelse og intensjonsytringer og bygger en ledetekst ved å bruke Langkjede, som er et rammeverk for maskinlæring med åpen kildekode (ML) som gjør det mulig for utviklere å integrere store språkmodeller (LLM), datakilder og applikasjoner.

En Amazon Bedrock-fundamentmodell blir deretter påkalt ved å bruke ledeteksten, og et svar mottas med den anslåtte hensikten og konfidensnivået. Hvis konfidensnivået er større enn en satt terskel, for eksempel 80 %, returnerer funksjonen den identifiserte intensjonen til Amazon Lex med en handling for å delegere. Hvis konfidensnivået er under terskelen, går det tilbake til standardverdien FallbackIntent og en handling for å lukke den.

Innlæring i kontekst, rask utvikling og modellanrop

Vi bruker kontekstlæring for å kunne bruke en grunnmodell for å utføre denne oppgaven. In-context learning er muligheten for LLM-er til å lære oppgaven ved å bruke akkurat det som står i ledeteksten uten å være forhåndstrent eller finjustert for den aktuelle oppgaven.

I ledeteksten gir vi først instruksjonen som beskriver hva som må gjøres. Deretter henter Lambda-funksjonen dynamisk og injiserer Amazon Lex-robotens konfigurerte hensikter, intensjonsbeskrivelser og hensiktsytringer i ledeteksten. Til slutt gir vi den instruksjoner om hvordan den skal skrive ut tenkningen og det endelige resultatet.

Følgende meldingsmal ble testet på tekstgenereringsmodeller Anthropic Claude Instant v1.2 og Anthropic Claude v2. Vi bruker XML-tagger for å forbedre ytelsen til modellen bedre. Vi legger også til rom for modellen til å tenke før den identifiserer den endelige intensjonen for bedre å forbedre begrunnelsen for å velge riktig hensikt. De {intent_block} inneholder intensjons-IDer, intensjonsbeskrivelser og intensjonsytringer. De {input} blokken inneholder den transkriberte ytringen fra den som ringer. Tre backticks (“`) legges til på slutten for å hjelpe modellen til å skrive ut en kodeblokk mer konsekvent. EN <STOP> sekvensen legges til for å stoppe den fra å generere ytterligere.

Etter at modellen er påberopt, mottar vi følgende svar fra grunnmodellen:

Filtrer tilgjengelige hensikter basert på sesjonsattributter for kontaktflyt

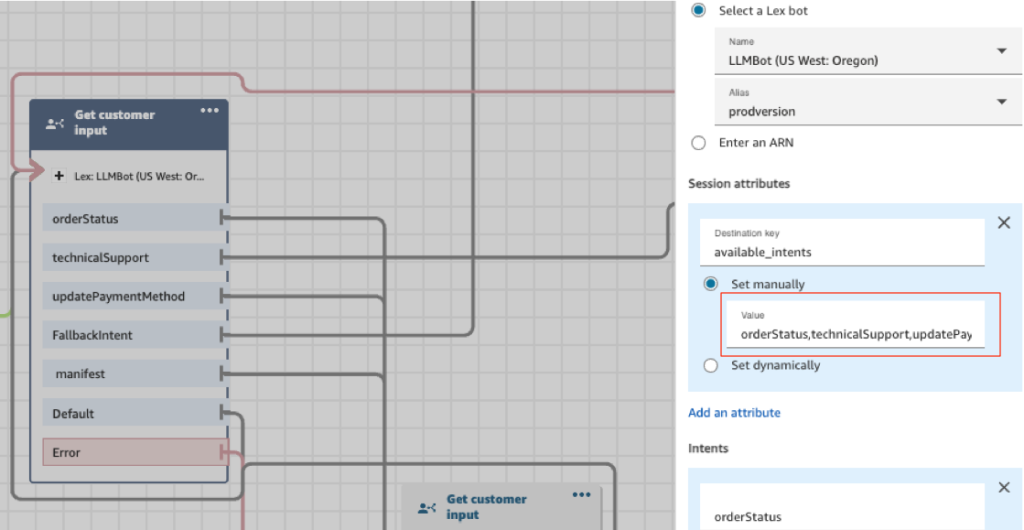

Når du bruker løsningen som en del av en Amazon Connect-kontaktflyt, kan du ytterligere forbedre muligheten til LLM til å identifisere riktig hensikt ved å spesifisere sesjonsattributtet available_intents i "Få kundeinnspill" blokk med en kommadelt liste over hensikter, som vist i følgende skjermbilde. Ved å gjøre det vil Lambda-funksjonen bare inkludere disse spesifiserte hensiktene som en del av forespørselen til LLM, og redusere antallet hensikter som LLM må resonnere seg gjennom. Hvis available_intents session-attributtet ikke er spesifisert, vil alle intensjoner i Amazon Lex-roboten bli brukt som standard.

Lambdafunksjonsrespons på Amazon Lex

Etter at LLM har bestemt intensjonen, svarer Lambda-funksjonen i bestemt format kreves av Amazon Lex for å behandle svaret.

Hvis en samsvarende hensikt blir funnet over konfidensgrensen, returnerer den en dialoghandlingstype Delegate å instruere Amazon Lex om å bruke den valgte intensjonen og deretter returnere den fullførte intensjonen tilbake til Amazon Connect. Svarutgangen er som følger:

Hvis konfidensnivået er under terskelen eller en hensikt ikke ble gjenkjent, en dialoghandlingstype Lukke returneres for å instruere Amazon Lex om å lukke FallbackIntent, og returner kontrollen tilbake til Amazon Connect. Svarutgangen er som følger:

Den komplette kildekoden for dette eksemplet er tilgjengelig i GitHub.

Forutsetninger

Før du begynner, må du kontrollere at du har følgende forutsetninger:

Implementer løsningen

Gjør følgende for å implementere løsningen:

- Klon depotet

- Kjør følgende kommando for å initialisere miljøet og opprette en Amazon Elastic Container Registry (Amazon ECR) depot for Lambda-funksjonens bilde. Oppgi navnet på AWS-regionen og ECR-depotet du vil opprette.

- Oppdater

ParameterValuefelt iscripts/parameters.jsonfile:ParameterKey ("AmazonECRImageUri")– Skriv inn depot-URLen fra forrige trinn.ParameterKey ("AmazonConnectName")– Skriv inn et unikt navn.ParameterKey ("AmazonLexBotName")– Skriv inn et unikt navn.ParameterKey ("AmazonLexBotAliasName")– Standard er "prodversion"; du kan endre det om nødvendig.ParameterKey ("LoggingLevel")– Standard er "INFO"; du kan endre det om nødvendig. Gyldige verdier er DEBUG, WARN og ERROR.ParameterKey ("ModelID")– Standard er "anthropic.claude-instant-v1"; du kan endre den hvis du trenger å bruke en annen modell.ParameterKey ("AmazonConnectName")– Standard er "0.75"; du kan endre den hvis du trenger å oppdatere konfidenspoengsummen.

- Kjør kommandoen for å generere CloudFormation-stakken og distribuere ressursene:

Hvis du ikke vil bygge kontaktflyten fra bunnen av i Amazon Connect, kan du importere prøveflyten som følger med dette depotet filelocation: /contactflowsample/samplecontactflow.json.

- Logg inn på din Amazon Connect-forekomst. Kontoen må tildeles en sikkerhetsprofil som inkluderer redigeringstillatelser for flyter.

- På Amazon Connect-konsollen, i navigasjonsruten, under Routing, velg Kontakt flyter.

- Opprett en ny flyt av samme type som den du importerer.

- Velg Lagre og importer flyt.

- Velg filen du vil importere og velg Import.

Når flyten importeres til en eksisterende flyt, oppdateres også navnet på den eksisterende flyten.

- Gjennomgå og oppdater eventuelle løste eller uløste referanser etter behov.

- For å lagre den importerte flyten, velg Spar. For å publisere, velg Lagre og publiser.

- Etter at du har lastet opp kontaktflyten, oppdaterer du følgende konfigurasjoner:

- Oppdater

GetCustomerInputblokker med riktig Amazon Lex-botnavn og -versjon. - Under Administrer telefonnummer oppdaterer du nummeret med kontaktflyten eller IVR importert tidligere.

- Oppdater

Bekreft konfigurasjonen

Bekreft at Lambda-funksjonen opprettet med CloudFormation-stakken har en IAM-rolle med tillatelser til å hente bots og intensjonsinformasjon fra Amazon Lex (liste- og lesetillatelser), og passende Amazon Bedrock-tillatelser (liste- og lesetillatelser).

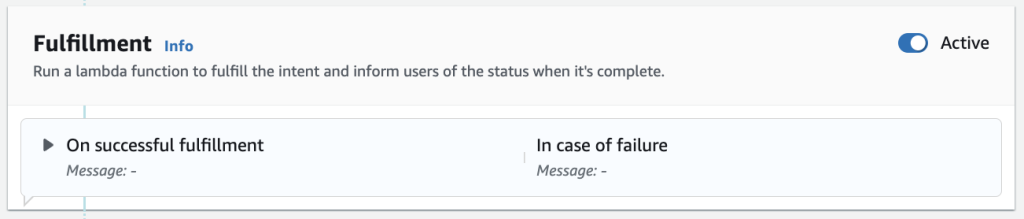

I Amazon Lex-boten din, for ditt konfigurerte alias og språk, kontroller at Lambda-funksjonen ble satt opp riktig. For FallBackIntent, bekreft det Fulfillmentis satt til Active for å kunne kjøre funksjonen når som helst FallBackIntent utløses.

På dette tidspunktet vil din Amazon Lex-bot automatisk kjøre Lambda-funksjonen, og løsningen skal fungere sømløst.

Test løsningen

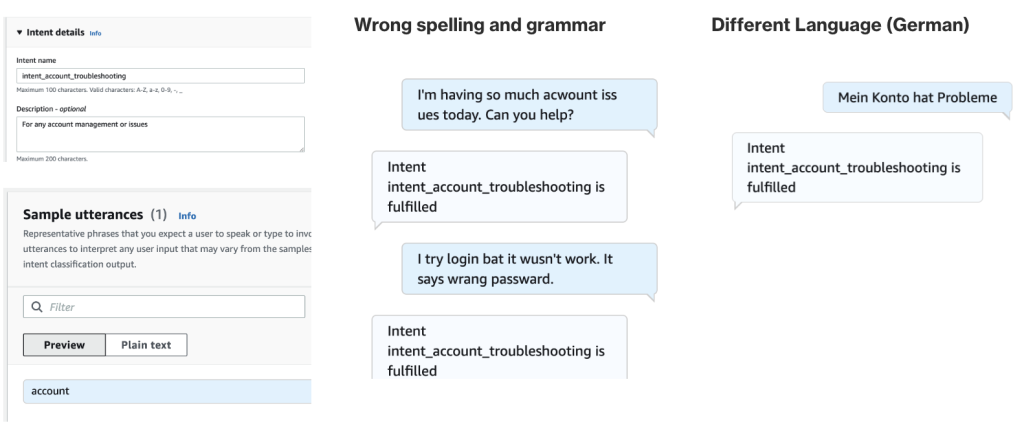

La oss se på et eksempel på intensjonen, beskrivelsen og ytringskonfigurasjonen i Amazon Lex og se hvor godt LLM presterer med eksempelinndata som inneholder skrivefeil, grammatikkfeil og til og med et annet språk.

Følgende figur viser skjermbilder av vårt eksempel. Venstre side viser intensjonens navn, beskrivelsen og et eksempel på et enkelt ord. Uten mye konfigurasjon på Amazon Lex, er LLM i stand til å forutsi riktig hensikt (høyre side). I denne testen har vi en enkel oppfyllelsesmelding fra riktig hensikt.

Rydd opp

For å rydde opp i ressursene dine, kjør følgende kommando for å slette ECR-depotet og CloudFormation-stakken:

konklusjonen

Ved å bruke Amazon Lex forbedret med LLM-er levert av Amazon Bedrock, kan du forbedre ytelsen til intensjonsgjenkjenning til robotene dine. Dette gir en sømløs selvbetjeningsopplevelse for et mangfoldig sett av kunder, og bygger bro mellom aksenter og unike taleegenskaper, og til slutt øker kundetilfredsheten.

For å dykke dypere og lære mer om generativ AI, sjekk ut disse tilleggsressursene:

For mer informasjon om hvordan du kan eksperimentere med den generative AI-drevne selvbetjeningsløsningen, se Implementer selvbetjent svar på spørsmål med QnABot på AWS-løsningen drevet av Amazon Lex med Amazon Kendra og store språkmodeller.

Om forfatterne

Hamza Nadeem er en Amazon Connect Specialist Solutions Architect hos AWS, basert i Toronto. Han jobber med kunder over hele Canada for å modernisere kontaktsentrene deres og tilby løsninger på deres unike utfordringer for kundeengasjement og forretningskrav. På fritiden liker Hamza å reise, fotball og prøve nye oppskrifter sammen med kona.

Hamza Nadeem er en Amazon Connect Specialist Solutions Architect hos AWS, basert i Toronto. Han jobber med kunder over hele Canada for å modernisere kontaktsentrene deres og tilby løsninger på deres unike utfordringer for kundeengasjement og forretningskrav. På fritiden liker Hamza å reise, fotball og prøve nye oppskrifter sammen med kona.

Parag Srivastava er en løsningsarkitekt hos Amazon Web Services (AWS), og hjelper bedriftskunder med vellykket skyadopsjon og migrering. I løpet av sin profesjonelle karriere har han vært mye involvert i komplekse digitale transformasjonsprosjekter. Han brenner også for å bygge innovative løsninger rundt geospatiale aspekter ved adresser.

Parag Srivastava er en løsningsarkitekt hos Amazon Web Services (AWS), og hjelper bedriftskunder med vellykket skyadopsjon og migrering. I løpet av sin profesjonelle karriere har han vært mye involvert i komplekse digitale transformasjonsprosjekter. Han brenner også for å bygge innovative løsninger rundt geospatiale aspekter ved adresser.

Ross Akk er en løsningsarkitekt ved AWS med base i Toronto, Canada. Han hjelper kundene med å innovere med AI/ML og Generative AI-løsninger som fører til reelle forretningsresultater. Han har jobbet med en rekke kunder fra detaljhandel, finansielle tjenester, teknologi, farmasøytisk og andre. På fritiden elsker han friluftsliv og å nyte naturen med familien.

Ross Akk er en løsningsarkitekt ved AWS med base i Toronto, Canada. Han hjelper kundene med å innovere med AI/ML og Generative AI-løsninger som fører til reelle forretningsresultater. Han har jobbet med en rekke kunder fra detaljhandel, finansielle tjenester, teknologi, farmasøytisk og andre. På fritiden elsker han friluftsliv og å nyte naturen med familien.

Sangeetha Kamatkar er en løsningsarkitekt hos Amazon Web Services (AWS), og hjelper kunder med vellykket skyadopsjon og migrering. Hun jobber med kunder for å lage svært skalerbare, fleksible og spenstige skyarkitekturer som løser kundeproblemer. På fritiden hører hun på musikk, ser på film og nyter hagearbeid om sommeren.

Sangeetha Kamatkar er en løsningsarkitekt hos Amazon Web Services (AWS), og hjelper kunder med vellykket skyadopsjon og migrering. Hun jobber med kunder for å lage svært skalerbare, fleksible og spenstige skyarkitekturer som løser kundeproblemer. På fritiden hører hun på musikk, ser på film og nyter hagearbeid om sommeren.

- SEO-drevet innhold og PR-distribusjon. Bli forsterket i dag.

- PlatoData.Network Vertical Generative Ai. Styrk deg selv. Tilgang her.

- PlatoAiStream. Web3 Intelligence. Kunnskap forsterket. Tilgang her.

- PlatoESG. Karbon, CleanTech, Energi, Miljø, Solenergi, Avfallshåndtering. Tilgang her.

- PlatoHelse. Bioteknologisk og klinisk etterretning. Tilgang her.

- kilde: https://aws.amazon.com/blogs/machine-learning/enhance-amazon-connect-and-lex-with-generative-ai-capabilities/

- : har

- :er

- :ikke

- :hvor

- $OPP

- 1

- 100

- 11

- 14

- 7

- 8

- 9

- a

- evne

- I stand

- Om oss

- ovenfor

- adgang

- utrette

- Logg inn

- nøyaktig

- Handling

- legge til

- la til

- Ytterligere

- adresse

- adresser

- Adopsjon

- avansert

- Agent

- agenter

- AI

- AI-drevet

- AI / ML

- Alle

- også

- Amazon

- Amazon Kendra

- Amazon Lex

- Amazon Web Services

- Amazon Web Services (AWS)

- an

- og

- besvare

- besvare

- Antropisk

- noen

- søknader

- hensiktsmessig

- arkitektur

- arkitekturer

- ER

- rundt

- AS

- spør

- aspekter

- tildelt

- Assistent

- At

- Automatisk

- automatisk

- tilgjengelig

- AWS

- tilbake

- bakgrunn

- basert

- BE

- bli

- vært

- før du

- bak

- være

- under

- Bedre

- mellom

- Blokker

- Blocks

- Bot

- roboter

- bridging

- bygge

- Bygning

- bygger

- virksomhet

- bedrifter

- men

- by

- ring

- call center

- Caller

- CAN

- Canada

- evner

- Karriere

- kategorisere

- CD

- sentrum

- Sentre

- utfordringer

- utfordrende

- endring

- kanaler

- egenskaper

- chatbot

- sjekk

- kontroll

- Velg

- velge

- klassifisering

- ren

- Lukke

- Cloud

- skyadopsjon

- kode

- kombinert

- fullføre

- Terminado

- komplekse

- komponenter

- selvtillit

- Konfigurasjon

- konfigurert

- Bekrefte

- Koble

- konsekvent

- Konsoll

- kontakt

- kontakt senter

- Container

- inneholder

- kontroll

- korrigere

- riktig

- lage

- skape

- opprettet

- kritisk

- kunde

- Kundedeltakelse

- Kundetilfredshet

- Kunder

- dato

- datasett

- Avgjør

- dypere

- Misligholde

- mislighold

- levert

- levere

- demokratiserer

- utplassere

- beskrivelse

- Til tross for

- detalj

- detaljering

- bestemmes

- bestemmes

- utviklere

- diagram

- Dialog

- forskjellig

- digitalt

- Digital Transformation

- dirigerer

- dykk

- diverse

- gjør

- gjør

- gjort

- ikke

- under

- dynamisk

- Tidligere

- uanstrengt

- muliggjør

- slutt

- engasjement

- Ingeniørarbeid

- forbedre

- forbedret

- styrke

- nyte

- nyter

- Enter

- Enterprise

- Miljø

- feil

- feil

- eskaleringer

- Selv

- Event

- eksempel

- eksisterende

- erfaring

- eksperiment

- utforske

- omfattende

- Mislyktes

- mislykkes

- familie

- Felt

- Figur

- filet

- slutt~~POS=TRUNC

- Endelig

- finansiell

- finansielle tjenester

- Først

- fleksibel

- flyten

- Flows

- etter

- følger

- Til

- format

- funnet

- Fundament

- grunn

- Rammeverk

- fra

- frustrerende

- funksjon

- funksjonalitet

- funksjoner

- videre

- mellomrom

- generere

- genererer

- generasjonen

- generative

- Generativ AI

- få

- gitt

- gir

- grammatikk

- større

- Ha

- he

- hjelpe

- hjelpe

- hjelper

- her

- svært

- hans

- holder

- Hvordan

- Hvordan

- http

- HTTPS

- menneskelig

- identifisert

- identifisere

- identifisering

- ids

- if

- illustrerer

- bilde

- iverksette

- implementere

- importere

- importere

- forbedre

- forbedret

- in

- inkludere

- inkluderer

- feil

- stadig

- informasjon

- innovere

- innovative

- inngang

- innganger

- instant

- instruksjoner

- integrere

- integrert

- Integrerer

- hensikt

- inn

- påkalt

- påkaller

- involvert

- IT

- DET ER

- jpg

- bare

- nøkkel

- Språk

- stor

- Fører

- LÆRE

- læring

- venstre

- Nivå

- i likhet med

- Sannsynlig

- Liste

- lytter

- leve

- LLM

- Se

- elsker

- maskin

- maskinlæring

- gjøre

- administrer

- Match

- fyrstikker

- matchende

- Kan..

- melding

- migrasjon

- feil

- ML

- modell

- modeller

- Moderne

- modern

- mer

- Filmer

- mye

- musikk

- må

- my

- navn

- Naturlig

- Natur

- Navigasjon

- nødvendig

- Trenger

- nødvendig

- behov

- Ny

- NLU

- Bråk

- Antall

- of

- on

- ONE

- bare

- åpen

- åpen kildekode

- alternativer

- or

- rekkefølge

- andre

- vår

- ut

- utfall

- utendørs

- produksjon

- brød

- del

- Spesielt

- passerer

- lidenskapelig

- ytelse

- utfører

- tillatelser

- Pharmaceutical

- telefon

- plato

- Platon Data Intelligence

- PlatonData

- Point

- Post

- powered

- forutsi

- spådd

- forutsetninger

- gaver

- hindre

- forrige

- problemer

- prosess

- profesjonell

- Profil

- prosjekter

- gi

- forutsatt

- gir

- publisere

- sette

- QnABot

- spørsmål

- Lese

- ekte

- grunnen til

- motta

- mottatt

- anerkjennelse

- gjenkjenne

- gjenkjent

- gjenkjenner

- redusere

- referanser

- region

- gjenta

- Repository

- påkrevd

- Krav

- spenstig

- løst

- Ressurser

- Svare

- svar

- resultere

- Resultater

- detaljhandel

- retur

- avkastning

- ikke sant

- Rolle

- rom

- Rute

- rutet

- ruting

- Kjør

- samme

- sample

- tilfredshet

- Spar

- skalerbar

- Skala

- Resultat

- skraper

- skjermbilder

- sømløs

- sømløst

- seksjoner

- sikkerhet

- se

- valgt

- Selvbetjening

- semantisk

- sender

- dømme

- Sequence

- Tjenester

- Session

- sett

- hun

- bør

- vist

- Viser

- side

- Enkelt

- glatter

- So

- Fotball

- løsning

- Solutions

- kilde

- kildekoden

- Kilder

- spesialist

- spesifisert

- spesifiserer

- tale

- Talegjenkjenning

- stable

- startet

- Tilstand

- uttalelser

- status

- Trinn

- Steps

- Stopp

- sterk

- I ettertid

- vellykket

- slik

- sommer

- sikker

- tar

- Oppgave

- Teknologi

- mal

- test

- testet

- tekst

- enn

- Det

- De

- deres

- Dem

- seg

- deretter

- Disse

- tror

- tenker

- denne

- tre

- terskel

- Gjennom

- hele

- tid

- til

- også

- toronto

- spor

- Transcript

- Transformation

- Traveling

- utløst

- lastebil

- prøve

- prøver

- typen

- Til syvende og sist

- etter

- forstå

- forståelse

- unik

- Oppdater

- oppdatert

- URL

- bruke

- brukt

- bruker

- ved hjelp av

- v1

- gyldig

- Verdier

- variasjon

- verifisere

- versjon

- av

- Voice

- ønsker

- var

- Se

- we

- web

- webtjenester

- VI VIL

- Hva

- når som helst

- hvilken

- HVEM

- kone

- vil

- med

- uten

- Arbeid

- arbeidet

- arbeidsflyt

- virker

- ville

- XML

- Du

- Din

- zephyrnet