Et individs helse er et utrolig personlig emne, og det å gå til legen kan være en skremmende og stressende opplevelse. Dette gjelder spesielt for personer som er en del av grupper som det medisinske systemet historisk har sviktet. Disse strukturelle problemstillingene i helsevesenet har gjennomsyret algoritmene som i økende grad blir brukt i diagnostisering og behandling av pasienter. CCC organiserte et panel, "Health Equity: How Can Algorithms and Data Mitigate, Not Exacerbate, Harms?" som tok for seg disse problemene. Paneldeltakerne var Dr. Amaka Eneanya (Fresenius Medical Care), Dr. Mona Singh (Princeton University), Dr. Melanie Moses (University of New Mexico), og Dr. Katie Siek (Indiana University).

Et individs helse er et utrolig personlig emne, og det å gå til legen kan være en skremmende og stressende opplevelse. Dette gjelder spesielt for personer som er en del av grupper som det medisinske systemet historisk har sviktet. Disse strukturelle problemstillingene i helsevesenet har gjennomsyret algoritmene som i økende grad blir brukt i diagnostisering og behandling av pasienter. CCC organiserte et panel, "Health Equity: How Can Algorithms and Data Mitigate, Not Exacerbate, Harms?" som tok for seg disse problemene. Paneldeltakerne var Dr. Amaka Eneanya (Fresenius Medical Care), Dr. Mona Singh (Princeton University), Dr. Melanie Moses (University of New Mexico), og Dr. Katie Siek (Indiana University).

Dr. Eneanya begynte panelet med å diskutere hvordan en ligning systematisk undervurderte nyresykdomse i svarte amerikanere i flere tiår. Hun forklarte at i USA blir alle pasienter som har nyresykdom registrert i et register. Forekomsten av sykdommen har økt generelt de siste tiårene, og for svarte individer har den en tendens til å være enda mer utbredt og alvorlig.

Dr. Eneanya skisserte disse rasemessige/etniske forskjellene i risikofaktorer og utfall for kronisk nyresykdom (Eneanya ND et al. Natur Rev Neph. 2021, USAs nyredatasystem.):

- Forekomsten av diabetes er høyest blant svarte individer sammenlignet med andre rasegrupper

- Svarte og latinamerikanske individer diagnostiseres i yngre alder sammenlignet med hvite individer

- Svarte individer har betydelig høyere forekomst av hypertensjon sammenlignet med hvite individer

- Hypertensjonskontroll er mindre blant svarte og latinamerikanske individer sammenlignet med hvite individer

- Svarte individer har mindre sannsynlighet for å motta nefrologisk behandling før de starter dialyse sammenlignet med andre rasegrupper

- Risiko for å utvikle nyresvikt som krever dialyse eller nyretransplantasjon

- 4 ganger høyere hos svarte versus hvite individer

- 1.3 ganger høyere hos latinamerikanske versus hvite individer

- Svarte individer har mindre sannsynlighet for å få nyretransplantasjon sammenlignet med andre rasegrupper

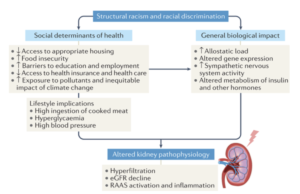

Strukturell rasisme bidrar til dårlige helseutfall fra nyre-relaterte sykdommer, utdypet Dr. Eneanya (Eneanya ND et al. Natur Rev Neph. 2021.):

Hvilke livsstilsvaner du har råd til – for eksempel hva du spiser, og biologiske påvirkninger som stress av rasisme og diskriminering fører alle til metabolske endringer i kroppen, som kan føre til nedsatt nyrefunksjon.

Dr. Eneanya peker på et eksempel på hvordan en algoritme som for tiden brukes av klinikere har konsekvenser i den virkelige verden. eGFR-ligningen er en algoritme som brukes til å bestemme hvor sterk en pasients nyrefunksjon er. En høyere eGFR representerer bedre nyrefunksjon. En pasients eGFR-nivå avgjør om de er kvalifisert for visse behandlinger, og kanskje mest avgjørende, en nyretransplantasjon. Algoritmen viser imidlertid at en svart og ikke-svart person som er av samme alder, kjønn og har samme kreatininmål (en blodprøve som måler nyrefunksjonen), har forskjellige eGFR-nivåer. Algoritmen beregner at en svart person har en høyere eGFR, antatt overlegen nyrefunksjon, enn den ikke-svarte personen. Dette begrenser behandlingen de er kvalifisert for, og betyr at de må bli sykere for å få den hjelpen de burde ha krav på.

Dr. Eneanya forklarte historien til algoritmen som avslører hvorfor den beregner på denne feilorienterte måten: en studie fra 1999 tilskrev høyere serumkreatinin til svarte individer på grunn av den feilaktige antagelsen om at de hadde høyere muskelmasse. Studien utviklet den første eGFR-ligningen brukt i USA og inkorporerte en "Black race" multiplikasjonsfaktor som forårsaker høyere eGFR blant svarte individer. Bruken av eGFR er problematisk fordi klinikere blir overlatt til å dømme noens rase basert på utseende eller medisinske journaler (som kan ha rase oppført som en antakelse fra en tidligere kliniker). Det er heller ikke en forskjell for blandet raseindivider, eller en metode for å klassifisere dem.

Dr. Eneanya var forfatter på en artikkel som endret hvordan eGFR beregnes i helsevesenet ved å gå inn for en ligning som ikke tar rase inn i estimeringen (Inker LA, Eneanya ND, et al. NEJM 2021, Delgado C, et al. JASN 2021). Dr. Eneanya og hennes kolleger vendte tilbake til den opprinnelige studien fra 1999 og fjernet rase fra ligningen og gjenopprettet den med andre input. I dag bruker ⅓ av sykehus og klinikker i USA den nye ligningen, og United Network for Organ Sharing (UNOS) begrenset særlig alle transplantasjonssentre fra å bruke den rasebaserte ligningen i juni 2022. De tok det ett skritt videre i januar 2023 og erklærte at alle amerikanske transplantasjonssentre er pålagt å gjennomgå alle svarte pasienter på nyretransplantasjonsventelisten og endre ventelistetiden hvis den ble påvirket av den rasebaserte eGFR-ligningen. Dr. Eneanya spesifiserte at mens UNOS er en del av den føderale regjeringen, var ikke regjeringen direkte involvert i beslutningen om å forby bruken av den rasebaserte ligningen.

Bortsett fra universell bruk av den nye eGFR-ligningen, hadde Dr. Eneanya noen flere fremtidige tilnærminger som hun ser på som nøkkelen til rettferdig tilgang til behandling av nyresykdom:

- Utvikle retningslinjer og prosesser for å forbedre tilgangen til forebyggende behandling for kroniske nyresykdommer

- Utvikle retningslinjer for å øke tilgangen til nyretransplantasjon

- Undersøk miljøeffekter (f.eks. stress, diskriminering) på nyrefunksjon og sykdomsprogresjon

- Åpenhet i å diskutere nyrefunksjonsbestemmelse med pasienter (inkludert begrensninger av eGFR-ligninger)

Dr. Eneanya utdypet at å erte stereotypier om svart rase koker ned til å eliminere feilslutninger og falske nyheter som ikke har noe vitenskapelig grunnlag. For eksempel endres læreplaner for medisinsk skole for å vise at det ikke er noe antropologisk grunnlag for at det er mer muskelmasse i ett løp fremfor et annet. Media har også gjort en god jobb med å dele denne ødelagte myten, og Dr. Eneanya konsulterte til og med en Grey's Anatomy-episode som fremhevet de ødeleggende virkningene av eGFR-ligningen for svarte pasienter som trenger en nyretransplantasjon.

Dr. Singh fortsatte samtalen om helseforskjeller ved å forklare at i USA har svarte individer høyere kreftdødelighet sammenlignet med hvite individer. Dette faktum eksemplifiserer at det er mange utfordringer som medisinske fagfolk og dataforskere må møte, det er også mange muligheter til å utvikle metoder som ikke utvider eksisterende forskjeller.

Dr. Singh forklarte først kreftens biologi: «Kreft er en sykdom der våre egne celler får mutasjoner som lar dem vokse ukontrollert. Så hvis vi ønsker å forstå den molekylære grunnen til kreft i et hvilket som helst individ, kan vi se på genomene til hans eller hennes kreftceller og hans eller hennes ikke-kreftceller, og sekvens. Når vi har sekvensert normale celler og kreftceller, kan vi sammenligne genomene, og avdekke hvilke mutasjoner vi har ervervet i kreftceller, og dette kan gi oss et hint om hvilke endringer som kan være de som er relevante for den enkeltes kreft. Dette er nøyaktig hva som har blitt gjort de siste 15 årene, der svulstene til titusenvis av individer er blitt sekvensert og mutasjoner i dem identifisert.»

Stort sett alle kjenner noen som har blitt diagnostisert med kreft, og det finnes ingen universell kur. Dr. Singh diskuterte imidlertid løftet om presisjonsonkologi, der en forsker sekvenserer en pasients svulst, identifiserer deres DNA-mutasjoner og utfører beregningsmessige analyser for å bestemme hvilke endringer som kan målrettes mot. Immunterapi er en tilnærming for å utnytte noens eget immunsystem for å målrette svulstene deres. En lovende immunterapi er å designe vaksiner som er tilpasset hver enkelt person, og disse vaksinene fremkaller en immunrespons på svulstene deres.

Dr. Singh forklarer måten dette fungerer på er at hvert av immunsystemene våre har 6 forskjellige kopier av de klassiske major histocompatibility complex (MHC) klasse I gener. Det er over 13,000 XNUMX forskjellige MHC-varianter av disse genene, så hver person har et annet sett med MHC-gener. Noen mutasjoner i kreftceller resulterer i "fremmede" proteiner, og noen av disse kan bindes av et individs MHC-er. Disse kompleksene av MHC bundet med et fragment av kreft-avledet protein gjenkjennes av immunceller og kan aktivere en immunrespons. Dette er svært personlig ettersom hver enkelts svulst kan ha forskjellige mutasjoner og hvert individ har forskjellige MHC-er. Forskere bruker maskinlæring for å forutsi hvilke MHC-varianter som binder hvilke peptider, noe som forhåpentligvis vil fremme effekten av immunterapi og til slutt føre til utforming av personlige neoantigenvaksiner.

Variasjonen av MHC-gener varierer enormt over hele kloden, utdyper Dr. Singh. De fleste MHC-alleler har ingen bindingsdata knyttet til dem, og de som har data om bindingen deres er partiske til fordel for noen rasegrupper. Det er viktig når du tester et datasett å ikke bare fokusere på den generelle ytelsen, men også å vurdere underpopulasjoner av data slik at alle har lik tilgang til de potensielle fordelene med denne forskningen.

Treningssettet må analyseres for skjevhet før det brukes. Videre kan metoder for å estimere ytelse på usett data avsløre skjevhet i dataene det ble trent på. Å samle inn data på en objektiv måte er avgjørende for å begrense muligheten for skjevhet senere i bruken av algoritmen. Områder for fremtidig arbeid med dette emnet fokuserer på alternative opplæringsprosedyrer og algoritmiske strategier for målrettet datainnsamling. Totalt sett er det avgjørende å prioritere utviklingen av rettferdige presisjonsmedisinske tilnærminger slik at terapier og forskning nedstrøms er rettferdig.

Dr. Moses snakket deretter, og hun kontekstualiserte hvordan eGFR- og MHC-peptidbindingsalgoritmene passer inn i et større økosystem av hvordan medisinske algoritmer påvirker sosiale utfall. Hun forklarer at forskere bruker algoritmer og AI for å forutsi utfall vi bryr oss om fra proxyer som enkelt kan måles, og disse proxyene kan være unøyaktige. For å gjøre medisinske algoritmer enda mer kompliserte, samhandler de konstant med hverandre på uforutsigbare måter, så det fulle omfanget av algoritmer for diagnostisering av en pasient er vanligvis uklart. Derfor er det avgjørende å bruke algoritmer med forsiktighet, spesielt fordi når algoritmene feiler kan de være mest skadelige for de mest sårbare.

Å finne ut hvem en algoritme påvirker og hvorfor er en viktig del av medisinsk rettferdighet. Dr. Moses tar et skritt tilbake og definerer egenkapital. Den vanlige grafikken brukes til å skille rettferdighet fra likestilling, med individer med 3 forskjellige høyder som sliter med å se en baseballkamp og forskjellige måter å støtte dem på, er feil selv i det tredje bildet som fjerner barrieren fordi det antyder at det er noe iboende til personen som hvorfor de trenger støtten i stedet for sosiale grunner som kan ha forårsaket ulikheten i utgangspunktet.

Dr. Moses viste en alternativ grafikk for å definere hvordan rettferdighet ser ut i et samfunn med systemisk urettferdighet (Copyright 2020 av Nicolás E. Barceló og Sonya Shadravan (kunstner: Aria Ghalili)):

Denne grafikken avslører at ikke alle kan dra nytte av bare at barrieren fjernes, men det er dypt forankrede problemer som må håndteres for å oppnå egenkapital.

Dataforskere bør alltid ha denne viktige konteksten i bakhodet, hevder Dr. Moses. Det er ofte vanskelig å identifisere forutsetningene som var til stede i opprettelsen av algoritmer, selv med de mest enkle algoritmene. Det er også lett å bruke en statistisk korrelasjon for å forutsi et utfall og anta at korrelasjon er lik årsakssammenheng, men det er en feilslutning.

Dr. Moses fortsetter med å gi konkrete eksempler på urettferdige algoritmer som er i bruk i samfunnet i dag på andre domener. For eksempel algoritmer i strafferettssystemet som erstatter pengekausjon for varetektsfengsling. Hensikten er at prosessen skal være en datadrevet, objektiv metode for å arrestere de som er en fare eller høyrisiko for ikke å møte til rettssak. Algoritmene har imidlertid mange mangler både når det gjelder algoritmens evne til å lage rettferdige og nøyaktige spådommer og skjevhetene til systemet algoritmen er en del av, inkludert skjev inndata og skjev tolkning av utdata. Et annet eksempel på hvordan rasemessig skjevhet opprettholdes i strafferettssystemet av algoritmer, er programvare for ansiktsgjenkjenning. Mens ansiktsgjenkjenning har vist seg å være minst nøyaktig når det gjelder å identifisere mørkere kvinnelige ansikter, er det svarte mannlige ansikter som oftest har blitt feilidentifisert av disse algoritmene som fører til falske arrestasjoner. Dette viser hvordan skjevheter som mest påvirker én gruppe (svarte kvinner) når det gjelder nøyaktig klassifisering, kan ha størst innvirkning på en annen gruppe (svarte menn) på grunn av skjevheter i strafferettssystemet

Algoritmer kan forverre menneskelig skjevhet, og kan også avvises hvis de ikke forsterker dommen du ville ha gjort uten å konsultere algoritmen. Dette gjelder også for partiske algoritmer i medisin. For eksempel er pulsoksymetre mindre nøyaktige til å oppdage oksygennivåer i mørkere hud, noe som kan resultere i underdiagnostisering av luftveissykdommer som alvorlig COVID. Å bruke mengden penger brukt på helsetjenester som en proxy for hvor sunn noen er er et annet urettferdig mål. Eksemplene Dr. Eneanya og Dr. Singh beskrev, eGFR nedsatt nyresvikt hos afroamerikanere, og genomiske datasett som overrepresenterer europeiske aner, er andre fremtredende eksempler på partiske algoritmer i medisin som har farlige nedstrømskonsekvenser for de berørte menneskene. eGFR-ligningen ble brukt til å identifisere fanger som var syke nok til å bli løslatt fra fengselet under COVID, noe som resulterte i at en afroamerikansk mann ble nektet løslatelse fordi nyrefunksjonen hans ble overvurdert.

Tilbakemelding kan forbedre algoritmer, eller forverre skadene deres. Algoritmer er ikke enveiskjørt, da de tar sikte på å forutsi atferd fra data og ett års prediksjon påvirker neste års data. Algoritmer bør ta sikte på å redusere skjevheter over tid; for eksempel bør kausjonshøringer hjelpe tiltalte å møte opp for rettssak i stedet for å forutsi feil; Politiet bør ta sikte på å redusere både kriminalitet og falske arrestasjoner. Algoritmer som brukes på tvers av domener bør aldri festes i stein fordi det vil være tilbakemeldinger mellom mennesker, algoritmer og sosial kontekst.

Dr. Moses foreslo også flere veier fremover: fjern skjevheter fra datasett, stille spørsmål ved antakelser, reversere (ikke forsterke) systemiske skjevheter, evaluere med et mangfold av perspektiver, kreve transparente og forklarbare algoritmer, og bruk gradvise, adaptive distribusjoner. Den vanlige oppfatningen er at algoritmer på en eller annen måte fjerner skjevheter, men i virkeligheten kodifiserer de ofte skjevheter, og vi må være på vakt mot algoritmer og deres utfall.

Den siste delen av panelet var en spørsmål og svar. Moderator Dr. Siek startet økten med å spørre, "hvordan kan ikke algoritmer og data forverre skader?"

- Dr. Eneanya: Hvis en forsker slutter med rase når han leter etter differensiatorer i en algoritme, er det lat og vitenskapelig ugyldig. Genetisk sett ser mennesker mer like ut mellom raser enn innenfor. Det er viktigere å tenke på biologiske egenskaper som faktisk påvirker et menneskelig system som nyrer. For eksempel, når de tester pulsoksymeteret, burde forskere ha konsultert en hudlege for å teste og validere pulsoksymetre basert på forskjellige hudtoner – i stedet for å bruke én type enhet for personer med forskjellige hudtoner.

- Dr. Moses: Vi bør bruke den samme tilnærmingen til å validere algoritmer etter at de har blitt tatt i bruk. Å anerkjenne rase som en sosial konstruksjon gjør det mulig å legge merke til raseblinde studier har innvirkning. Det er viktig å se etter skille mellom grupper for å identifisere potensielle forskjeller som algoritmen forsterker. Må du vurdere om algoritmen minimerer problemer, eller gjør den bedre?

- Dr. Singh: Rase skal aldri brukes som input, men det kan brukes til å evaluere utdata for skjevhet. Hvis vi ikke tenkte på rase, ville vi ikke engang kunne si at det er helseforskjeller. Å samle genomiske data og kategorisere etter aner er også en mangelfull metodikk. Vi må sørge for å vurdere om metoder fungerer godt på tvers av populasjoner.

- Dr. Eneanya: Når vi diversifiserer en studiepopulasjon, må vi gå bort fra bare å bringe inn grupper av hvite eller svarte mennesker. Vi må se på flere forskjeller innenfor disse gruppene som faktorer som sosial status, kjønn, seksualitet osv. Vi må se på helheten og ikke bare mangfoldsdatasett basert på rase.

- Dr. Moses: Algoritmer er akkurat den typen verktøy som bør hjelpe oss å gjøre det, det er mange potensielle databehandlingsstrategier som kan hjelpe.

- Dr. Singh: Jeg er enig i at algoritmer spiller en stor rolle her, så hvordan prioriterer vi datainnsamling? Vi må tenke nøye gjennom hvordan vi gjør det.

Et publikumsmedlem spurte da: "Gitt det store hastverket med å utvikle algoritmer basert på gjeldende datasett med skjevheter, er det måter å motvirke skjevheter i algoritmen utover å bli kvitt skjevheter i datasettet?"

- Dr. Singh: Det er vanskelig å overvinne skjevheter i et datasett; det er et aktivt forskningsområde. Det er lett å over- eller underprøve data. Det er forskjellige måter å trene ML-modeller på hvor det overordnede målet (typisk en funksjon du prøver å minimere, vanligvis ved å bruke hele datasettet) er hvordan optimalisering skal se ut.

- Dr. Eneanya: Mange medisinske algoritmer blir sett på som trenger å inkludere rase for å være mer presis. Men folk må kritisk undersøke hvorfor rase blir introdusert i utgangspunktet? Å fjerne rase som en variabel endrer kanskje ikke ytelsen til algoritmen så mye som du kanskje tror. Betyr det noe (klinisk) når resultatene endres med bare en liten bit etter å ha fjernet en variabel som rase?

- Dr. Singh: Det betyr spesielt ingenting når treningssettet ditt og settet du bruker det på er veldig forskjellige.

Dr. Siek stilte paneldeltakerne med et annet spørsmål: "Hvis vi kunne gjøre dette om igjen, hva ville vi gjort annerledes?"

- Dr. Eneanya: Å slutte med rase når man vurderer årsaker til forskjeller i helseutfall burde ikke ha skjedd. For eksempel med kreatininnivåer, bør vi tenke på hva annet som kan påvirke kreatinin? Vi trenger bedre datasett, noe som krever å bygge tillit i lokalsamfunn. Dette kan se ut som å forbedre mangfoldet av forsøkspopulasjoner, evaluere hvordan studiepersonalet ditt ser ut, osv. National Institute of Health-stipend krever i økende grad samfunnsbaserte partnere og helseequity-spesialister som en del av forskerteamet. Vi må endre de gamle settene, men må også bygge bedre sett i fremtiden. Vi kan bare gjøre så mye med å prøve å rekonfigurere det som er der ute.

- Dr. Moses: Utover hva vi kunne gjøre hvis vi startet på nytt, liker jeg å tenke på algoritmer som speil av samfunnet. De er opplært av alle på internett. Ved å bruke det som input til neste algoritmenivå, kan vi bestemme hvor skjevhetene er, hvorfor de er der, og hva den fremtidige innvirkningen er. Vi må spørre hvordan vi bruker disse kvantitative verktøyene for å finne ut hvordan vi kan fikse disse situasjonene i stedet for å forverre dem.

- Dr. Singh: Mange genomer som er samlet inn representerer ikke befolkningen som helhet. Vi må starte med involvering fra ulike sett av mennesker.

Det siste spørsmålet fra publikum var: «Inntil vi kommer til et punkt hvor vi har et fullstendig genomisk bilde av alle mennesker, vil det være entusiasme for å bruke ML og algoritmer. Hva er virkelige ting på fagfellevurderingsnivå som vi kan gjøre nå, slik at vi ikke trenger å fikse dem om 30 år?»

- Dr. Eneanya: Perfekt er det godes fiende. Vi må gjøre så godt vi kan. Vi kan identifisere skjevheter, og deretter gjøre så godt vi kan fremover. Det finnes barrierer som ikke har noe med kliniske algoritmer å gjøre. Bare det å fikse eGFR-algoritmen ved å bli kvitt rase vil ikke løse nyresykdomsforskjeller. Det må gjøres mye arbeid med multivariable aspekter ved undertrykkelse.

- Dr. Moses: Arbeidet du [Dr. Eneanya] har gjort for å rekonstruere algoritmen for alle er nøyaktig hvordan man skal gå videre. Vi må fikse systemet. Bruker også det faktum at det måtte fikses; det var lett å se skjevheten skrevet inn i ligningen. Nyreligningen fungerer som et speil for et samfunn som tillot rase å bli kodet på en måte som ugunstigstilte afroamerikanere i flere tiår. Forspenningen i den ligningen var eksplisitt og bevisst. Det vil være mye vanskeligere å identifisere skjevheter i mer komplekse algoritmer i fremtiden.

Følg med for nok en AAAS 2023 CCC-sponset paneloppsummering!

- SEO-drevet innhold og PR-distribusjon. Bli forsterket i dag.

- Platoblokkkjede. Web3 Metaverse Intelligence. Kunnskap forsterket. Tilgang her.

- kilde: https://feeds.feedblitz.com/~/733934357/0/cccblog~Health-Equity-How-Can-Algorithms-and-Data-Mitigate-Not-Exacerbate-Harms-AAAS-Panel-Recap/

- :er

- $OPP

- 000

- 1

- 1999

- 2020

- 2021

- 2022

- 2023

- 7

- a

- evne

- I stand

- Om oss

- adgang

- nøyaktig

- Oppnå

- erverve

- ervervet

- tvers

- aktiv

- faktisk

- Ytterligere

- Legger

- Adopsjon

- avansere

- talsmann

- påvirke

- Afrikansk

- Etter

- Ages

- AI

- AL

- algoritme

- algoritmisk

- algoritmer

- Alle

- tillater

- alternativ

- alltid

- amerikansk

- Amerikanerne

- blant

- beløp

- analyse

- anatomi

- og

- En annen

- vises

- anvendt

- tilnærming

- tilnærminger

- ER

- AREA

- områder

- argumenterer

- område

- arrestasjoner

- Artikkel

- artist

- AS

- aspekter

- assosiert

- forutsetningen

- At

- publikum

- forfatter

- tilbake

- kausjon

- Ban

- barriere

- barrierer

- baseball

- basert

- basis

- BE

- fordi

- begynte

- være

- nytte

- Fordeler

- BEST

- Bedre

- mellom

- Beyond

- Bias

- binde

- bindende

- biologi

- Bit

- Svart

- blod

- kroppen

- Bound

- Bringe

- bygge

- Bygning

- by

- beregnet

- beregner

- CAN

- Kreft

- Kreftceller

- hvilken

- nøye

- kategorisering

- forårsaket

- årsaker

- ccc

- Celler

- Sentre

- viss

- utfordringer

- endring

- Endringer

- endring

- egenskaper

- klasse

- klassifisering

- Klassifisere

- Klinisk

- klinikere

- kollegaer

- Samle

- samling

- kommer

- Felles

- Communities

- Fellesskapsbasert

- sammenligne

- sammenlignet

- fullføre

- komplekse

- komplisert

- databehandling

- Konsekvenser

- Vurder

- stadig

- konstruere

- konsulent

- kontekst

- fortsatte

- fortsetter

- kontroll

- Samtale

- copyright

- Korrelasjon

- kunne

- Covid

- skaperverket

- Crime

- Criminal

- avgjørende

- avgjørende

- kur

- Gjeldende

- I dag

- FARE

- Dangerous

- dato

- datasett

- datasett

- datasett

- tiår

- avgjørelse

- redusere

- dyp

- tiltalte

- definerer

- Etterspørsel

- demonstrerer

- distribusjoner

- beskrevet

- utforming

- fengsling

- besluttsomhet

- Bestem

- bestemmes

- ødeleggende

- utvikle

- utviklet

- utvikle

- Utvikling

- enhet

- Diabetes

- forskjeller

- forskjellig

- differensiere

- vanskelig

- direkte

- nedsatte

- diskutert

- diskutere

- sykdom

- sykdommer

- diverse

- Mangfold

- dna

- Doktor

- ikke

- domener

- ikke

- ned

- drevet

- under

- e

- hver enkelt

- lett

- spise

- økosystem

- effekter

- utdypet

- kvalifisert

- eliminere

- nok

- kom inn

- entusiasme

- miljømessige

- likestilling

- Er lik

- ligninger

- egenkapital

- spesielt

- avgjørende

- anslag

- etc

- europeisk

- evaluere

- evaluere

- Selv

- alle

- nøyaktig

- eksempel

- eksempler

- eksemplifiserer

- eksisterende

- erfaring

- forklarte

- forklare

- forklarer

- Face

- ansikter

- ansikts

- ansiktsgjenkjenning

- faktorer

- FAIL

- Mislyktes

- Failure

- rettferdig

- forfalskning

- falske nyheter

- favorisere

- Federal

- Føderal regjering

- tilbakemelding

- hunn

- Noen få

- Figur

- slutt~~POS=TRUNC

- Først

- passer

- Fix

- fikset

- feil

- Fokus

- fokusering

- Til

- Forward

- fra

- fullt

- funksjon

- videre

- Dess

- framtid

- spill

- Kjønn

- få

- få

- Gi

- Giving

- globus

- mål

- skal

- god

- Godt jobbet

- Regjeringen

- gradvis

- tilskudd

- Grafisk

- størst

- Gruppe

- Gruppens

- Grow

- skjedde

- Hard

- skadelig

- skader

- seletøy

- Ha

- Helse

- helsetilskudd

- helsetjenester

- sunt

- høyder

- hjelpe

- her.

- høy risiko

- høyere

- høyest

- Fremhevet

- svært

- historisk

- historie

- forhåpentligvis

- sykehus

- Hvordan

- Hvordan

- Men

- HTTPS

- stort

- menneskelig

- Mennesker

- Hypertensjon

- i

- identifisert

- identifiserer

- identifisere

- identifisering

- bilde

- Immunsystem

- immunterapi

- Påvirkning

- påvirket

- Konsekvenser

- svekkelse

- viktig

- forbedre

- bedre

- in

- I andre

- unøyaktig

- inkludere

- Inkludert

- Incorporated

- Øke

- økt

- stadig

- utrolig

- individuelt

- individer

- iboende

- inngang

- f.eks

- Institute

- hensikt

- samhandler

- Internet

- skremmende

- introdusert

- involvert

- engasjement

- saker

- IT

- Januar

- Jobb

- dømme

- Justice

- Hold

- nøkkel

- nyre

- stor

- større

- føre

- ledende

- læring

- Rester

- Nivå

- nivåer

- livsstil

- i likhet med

- Sannsynlig

- BEGRENSE

- begrensninger

- grenser

- oppført

- Se

- ser ut som

- ser

- UTSEENDE

- Lot

- maskin

- maskinlæring

- laget

- større

- gjøre

- Making

- mann

- måte

- mange

- Mass

- max bredde

- midler

- måle

- målinger

- Media

- medisinsk

- medisinsk behandling

- medisin

- medlem

- Herre

- metode

- metodikk

- metoder

- Mexico

- kunne

- tankene

- minimere

- speil

- Minske

- blandet

- ML

- modeller

- modifisere

- molekyl~~POS=TRUNC

- Monetære

- penger

- mer

- mest

- flytte

- gå fremover

- flytting

- nasjonal

- Natur

- Trenger

- trenger

- behov

- nettverk

- Ny

- nyheter

- neste

- normal

- spesielt

- of

- ofte

- Gammel

- on

- ONE

- Muligheter

- Opportunity

- optimalisering

- rekkefølge

- Organisert

- original

- Annen

- Utfallet

- skissert

- samlet

- Overcome

- egen

- Oksygen

- panel

- del

- partnere

- Past

- pasient

- pasienter

- likemann

- Ansatte

- persepsjon

- perfekt

- ytelse

- utfører

- kanskje

- person

- personlig

- Personlig

- prospektet

- bilde

- Sted

- plato

- Platon Data Intelligence

- PlatonData

- Spille

- Point

- Politikk

- politi

- dårlig

- befolkningen

- populasjoner

- potensiell

- presis

- nettopp

- Precision

- forutsi

- prediksjon

- Spådommer

- presentere

- utbredt

- forrige

- Før

- Prioriter

- fengsel

- fanger

- problemer

- prosedyrer

- prosess

- Prosesser

- fagfolk

- fremtredende

- løfte

- lovende

- foreslått

- Protein

- Proteiner

- proxy

- puls

- sette

- Q & A

- kvantitativ

- spørsmål

- Race

- Raseforspenning

- rasisme

- priser

- heller

- ekte

- virkelige verden

- Reality

- grunner

- oppsummering

- motta

- nylig

- anerkjennelse

- gjenkjent

- poster

- redusere

- registret

- forsterke

- slipp

- utgitt

- relevant

- fjerne

- fjernet

- fjerne

- erstatte

- representere

- representerer

- påkrevd

- Krever

- forskning

- forsker

- forskere

- svar

- startes på nytt

- begrenset

- resultere

- Resultater

- avsløre

- avslører

- reversere

- anmeldelse

- Kvitt

- Risiko

- risikofaktorer

- Rolle

- jag

- samme

- Skole

- vitenskapelig

- Forsker

- forskere

- Sees

- Sequence

- Serum

- serverer

- Session

- sett

- sett

- alvorlig

- deling

- bør

- Vis

- vist

- Viser

- betydelig

- lignende

- situasjoner

- Skin

- So

- selskap

- Samfunnet

- Software

- LØSE

- noen

- Noen

- noe

- spesialister

- spesifisert

- brukt

- Staff

- Begynn

- Start

- Stater

- statistisk

- status

- Trinn

- STONE

- stoppe

- rett fram

- strategier

- gate

- stresset

- sterk

- strukturell

- Sliter

- studier

- Studer

- emne

- slik

- foreslår

- overlegen

- støtte

- system

- systemisk

- Systemer

- Ta

- tar

- Target

- målrettet

- lag

- vilkår

- test

- Testing

- Det

- De

- Fremtiden

- deres

- Dem

- derfor

- Disse

- ting

- tusener

- tid

- til

- i dag

- også

- verktøy

- Tema

- Tog

- trent

- Kurs

- gjennomsiktig

- behandling

- prøve

- sant

- Stol

- typer

- typisk

- Til syvende og sist

- avdekke

- etter

- underbygg

- forstå

- forent

- Forente Stater

- Universell

- universitet

- uforutsigbare

- us

- bruk

- bruke

- vanligvis

- VALIDERE

- variasjon

- Versus

- Sårbar

- Vei..

- måter

- VI VIL

- Hva

- Hva er

- hvilken

- mens

- hvit

- HVEM

- hele

- vil

- med

- innenfor

- uten

- Dame

- Arbeid

- virker

- ville

- skrevet

- år

- Du

- Younger

- Din

- zephyrnet