Vi introduserte nylig en ny funksjon i Amazon SageMaker Python SDK som lar dataforskere kjøre maskinlæringskoden (ML) skrevet i deres foretrukne integrerte utviklermiljø (IDE) og bærbare datamaskiner sammen med tilhørende kjøretidsavhengigheter som Amazon SageMaker opplæringsjobber med minimale kodeendringer i eksperimentet gjort lokalt. Dataforskere utfører vanligvis flere iterasjoner av eksperimentering i databehandlings- og treningsmodeller mens de jobber med ethvert ML-problem. De ønsker å kjøre denne ML-koden og utføre eksperimenteringen med brukervennlighet og minimal kodeendring. Amazon SageMaker modellopplæring hjelper dataforskere med å kjøre fullt administrerte opplæringsjobber i stor skala på AWS sin datainfrastruktur. SageMaker Training hjelper også dataforskere med avanserte verktøy som f.eks Amazon SageMaker Debugger og Profiler for å feilsøke og analysere deres storskala treningsjobber.

For kunder med små budsjetter, små team og stramme tidslinjer, gjør hvert eneste nye konsept og kodelinje skrevet om for å kjøre på SageMaker dem mindre produktive i forhold til kjerneoppgavene sine, nemlig databehandling og opplæring av ML-modeller. De ønsker å skrive kode én gang innenfor rammen av deres valg og kunne flytte sømløst fra kjørende kode i bærbare eller bærbare datamaskiner til å kjøre kode i skala ved hjelp av SageMaker-funksjoner.

Med denne nye funksjonen til SageMaker Python SDK, kan dataforskere sette inn ML-koden sin til SageMaker Training-plattformen på noen få minutter. Du trenger bare å legge til en enkelt kodelinje i ML-koden din, og SageMaker forstår koden din på en intelligent måte sammen med datasettene og arbeidsmiljøoppsettet og kjører den som en SageMaker Training-jobb. Du kan deretter dra nytte av nøkkelfunksjonene til SageMaker Training-plattformen, som muligheten til å skalere jobber enkelt, og andre tilknyttede verktøy som Debugger og Profiler. I denne utgivelsen kan du kjøre din lokale maskinlæring (ML) Python-kode som en enkelt-node Amazon SageMaker-treningsjobb eller flere parallelle jobber. Distribuerte treningsjobber (på tvers av flere noder) støttes ikke av eksterne funksjoner.

I dette innlegget viser vi deg hvordan du bruker denne nye muligheten til å kjøre lokal ML-kode som en SageMaker Training-jobb.

Løsningsoversikt

Du kan nå kjøre ML-koden skrevet i IDE-en eller notatboken din som en SageMaker Training-jobb ved å kommentere funksjonen, som fungerer som et inngangspunkt til brukerens kodebase, med en enkel dekorator. Ved påkalling tar denne funksjonen automatisk et øyeblikksbilde av alle tilknyttede variabler, funksjoner, pakker, miljøvariabler og andre kjøretidskrav fra ML-koden din, serialiserer dem og sender dem inn som en SageMaker Training-jobb. Den integreres med den nylig annonserte SageMaker Python SDK-funksjon for å angi standardverdier for parametere. Denne funksjonen forenkler SageMaker-konstruksjonene som du trenger å lære for å kunne kjøre kode ved hjelp av SageMaker Training. Dataforskere kan skrive, feilsøke og iterere koden deres i hvilken som helst foretrukket IDE (som f.eks. Amazon SageMaker Studio, bærbare datamaskiner, VS-kode eller PyCharm). Når du er klar, kan du kommentere Python-funksjonen din med @remote dekoratør og kjøre den som en SageMaker-jobb i stor skala.

Denne funksjonen tar kjente åpen kildekode Python-objekter som argumenter og utganger. Videre trenger du ikke å forstå containerlivssyklusadministrasjon og kan ganske enkelt kjøre arbeidsbelastningene dine på tvers av forskjellige datakontekster (som en lokal IDE, Studio eller opplæringsjobber) med minimale konfigurasjonskostnader. For å kjøre en hvilken som helst lokal kode som en SageMaker Training-jobb, utleder denne funksjonen konfigurasjonene som kreves for å kjøre jobber, for eksempel AWS identitets- og tilgangsadministrasjon (IAM) rolle, krypteringsnøkkel og nettverkskonfigurasjon, fra Studio- eller IDE-innstillingene (som kan være standardinnstillingene) og sender dem til plattformen som standard. Du har fleksibiliteten til å tilpasse kjøretiden din i SageMaker-administrerte infrastruktur ved å bruke den utledede konfigurasjonen eller overstyre dem på SDK-nivå ved å sende dem som argumenter til dekoratøren.

Denne nye funksjonen til SageMaker Python SDK transformerer ML-koden din i et eksisterende arbeidsområdemiljø og all tilhørende databehandlingskode og datasett til en SageMaker Training-jobb. Denne funksjonen ser etter ML-kode pakket inn i en @remote decorator og oversetter den automatisk til en jobb som kjører i enten Studio eller en lokal IDE som PyCharm.

I de følgende delene går vi gjennom funksjonene til denne nye funksjonen og hvordan du starter python-funksjoner som SageMaker Training-jobber.

Forutsetninger

For å bruke denne nye SageMaker Python SDK-funksjonen og kjøre koden knyttet til dette innlegget, trenger du følgende forutsetninger:

- En AWS-konto som vil inneholde alle AWS-ressursene dine

- En IAM-rolle for å få tilgang til SageMaker

- Tilgang til Studio eller en SageMaker notebook-forekomst eller en IDE som PyCharm

Bruk SDK fra Studio og SageMaker notatbøker

Du kan bruke denne funksjonen fra Studio ved å starte en notatbok og pakke inn koden med en @remote dekoratør inne i notatboken. Du må først importere fjernfunksjonen ved å bruke følgende kode:

from sagemaker.remote_function import remoteNår du bruker dekorasjonsfunksjonen, vil denne funksjonen automatisk tolke funksjonen til koden din og kjøre den som en SageMaker Training-jobb.

Du kan også bruke denne funksjonen fra en SageMaker-notebook-forekomst. Du må først starte en notatbokforekomst, åpne Jupyter eller Jupyter Lab på den og starte en notatbok. Importer deretter fjernfunksjonen som vist i den foregående koden og pakk inn koden med @remote dekoratør. Vi inkluderer et eksempel på hvordan du bruker dekorasjonsfunksjonen og de tilhørende innstillingene senere i dette innlegget.

Bruk SDK fra ditt lokale miljø

Du kan også bruke denne funksjonen fra din lokale IDE. Som forutsetning må du ha AWS kommandolinjegrensesnitt (AWS CLI), SageMaker Python SDK, og AWS SDK for Python (Boto3) installert i ditt lokale miljø. Du må importere disse bibliotekene i koden din, angi SageMaker-økten, spesifisere innstillinger og dekorere funksjonen din med @remote dekoratør. I følgende eksempelkode kjører vi en enkel delefunksjon som en SageMaker Training-jobb:

import boto3

import sagemaker

from sagemaker.remote_function import remote sm_session = sagemaker.Session(boto_session=boto3.session.Session(region_name="us-west-2"))

settings = dict(

sagemaker_session=sm_session,

role=<IAM_ROLE_NAME>

instance_type="ml.m5.xlarge",

)

@remote(**settings)

def divide(x, y):

return x / y

if __name__ == "__main__":

print(divide(2, 3.0))Vi kan bruke en lignende metodikk for å kjøre avanserte funksjoner som opplæringsjobber, som vist i neste avsnitt.

Start Python-funksjoner som SageMaker-jobber

Den nye SageMaker Python SDK-funksjonen lar deg kjøre Python-funksjoner som SageMaker Training kontaktinformasjon management. Enhver Python-kode, ML-treningskode utviklet av dataforskere ved å bruke deres foretrukne lokale IDE-er (PyCharm, VS-kode), SageMaker-notatbøker eller Studio-notatbøker kan lanseres som en administrert SageMaker-jobb.

I ML-arbeidsbelastninger som bruker denne funksjonen, serialiseres tilknyttede datasett, avhengigheter og arbeidsområdemiljø ved hjelp av ML-koden og kjøres som en SageMaker-jobb synkront og asynkront.

Du kan legge til en @remote dekoratorkommentarer til enhver Python-kode, inkludert en lokal ML-behandlings- eller opplæringsfunksjon for å starte den som en administrert SageMaker Training-jobb, og dermed dra nytte av skalaen, ytelsen og kostnadsfordelene til SageMaker. Dette kan oppnås med minimale kodeendringer ved å legge til en dekorator til Python-funksjonskoden. Påkalling til den dekorerte funksjonen kjøres synkront, og funksjonskjøringen venter til SageMaker-jobben er fullført.

I det følgende eksempelet bruker vi @remote decorator for å starte SageMaker-jobber i dekorasjonsmodus ved å bruke en ml.m5.large-instans. SageMaker bruker opplæringsjobber for å lansere denne funksjonen som en administrert jobb.

from sagemaker.remote_function import remote

from numpy as np @remote(instance_type="ml.m5.large")

def matrix_multiply(a, b): return np.matmul(a, b) a = np.array([[1, 0], [0, 1]])

b = np.array([1, 2]) assert matrix_multiply(a, b) == np.array([1,2])Du kan også bruke dekorasjonsmodus for å starte SageMaker-jobber, Python-pakker og avhengigheter. Du kan inkludere miljøvariabler som VPC, subnett og sikkerhetsgrupper for å starte SageMaker opplæringsjobber i environment.yml fil. Dette lar ML-ingeniører og -administratorer konfigurere disse miljøvariablene slik at dataforskere kan fokusere på ML-modellbygging og iterere raskere. Se følgende kode:

from sagemaker.remote_function import remote @remote(instance_type="ml.g4dn.xlarge",dependencies = "./environment.yml")

def train_hf_model(

train_input_path,test_input_path,s3_output_path = None,

*,epochs = 1, train_batch_size = 32, eval_batch_size = 64,

warmup_steps = 500,learning_rate = 5e-5

):

model_name = "distilbert-base-uncased"

model = AutoModelForSequenceClassification.from_pretrained(model_name)

... <TRUCNATED>

return os.path.join(s3_output_path, model_dir), eval_resultDu kan bruke RemoteExecutor for å starte Python-funksjoner som SageMaker jobber asynkront. Eksekutøren poller SageMaker Training-jobber asynkront for å oppdatere statusen til jobben. De RemoteExecutor klasse er en implementering av concurrent.futures.Executor, som brukes til å sende inn SageMaker Training-jobber asynkront. Se følgende kode:

from sagemaker.remote_function import RemoteExecutor def train_hf_model(

train_input_path,test_input_path,s3_output_path = None,

*,epochs = 1, train_batch_size = 32, eval_batch_size = 64,

warmup_steps = 500,learning_rate = 5e-5

):

model_name = "distilbert-base-uncased"

model = AutoModelForSequenceClassification.from_pretrained(model_name)

...<TRUNCATED>

return os.path.join(s3_output_path, model_dir), eval_result with RemoteExecutor(instance_type="ml.g4dn.xlarge", dependencies = './requirements.txt') as e:

future = e.submit(train_hf_model, train_input_path,test_input_path,s3_output_path,

epochs, train_batch_size, eval_batch_size,warmup_steps,learning_rate)Tilpass kjøretidsmiljøet

Dekorasjonsmodus og RemoteExecutor lar deg definere og tilpasse kjøretidsmiljøene for SageMaker-jobben. Kjøretidsavhengighetene, inkludert Python-pakker og miljøvariabler for SageMaker-jobber, kan spesifiseres for å tilpasse kjøretiden. For å kjøre lokal Python-kode som SageMaker-administrerte jobber, må Python-pakken og avhengigheter gjøres tilgjengelig for SageMaker. ML-ingeniører eller datavitenskapsadministratorer kan konfigurere nettverks- og sikkerhetskonfigurasjoner som VPC, subnett og sikkerhetsgrupper for SageMaker-jobber, slik at dataforskere kan bruke disse sentralstyrte konfigurasjonene mens de starter SageMaker-jobber. Du kan bruke enten a requirements.txt fil eller en Conda environment.yaml filen.

Når avhengigheter er definert med requirements.txt, vil pakkene installeres ved hjelp av pip i jobbkjøringen. Hvis bildet som brukes for å kjøre jobben kommer med Conda-miljøer, vil pakker bli installert i Conda-miljøet som er erklært å bruke for jobber. Følgende kode viser et eksempel requirements.txt file:

datasets

transformers

torch

scikit-learn

s3fs==0.4.2

sagemaker>=2.148.0Du kan passere din Conda environment.yaml fil for å lage Conda-miljøet du vil at koden skal kjøre i under treningsjobben. Hvis bildet som brukes for å kjøre jobben erklærer et Conda-miljø å kjøre koden under, vil vi oppdatere det deklarerte Conda-miljøet med den gitte spesifikasjonen. Følgende kode er et eksempel på en Conda environment.yaml file:

name: sagemaker_example

channels: - conda-forge

dependencies: - python=3.10 - pandas - pip: - sagemakerAlternativt kan du stille inn dependencies=”auto_capture” å la SageMaker Python SDK fange opp de installerte avhengighetene i det aktive Conda-miljøet. Du må ha et aktivt Conda-miljø for auto_capture å jobbe. Merk at det er forutsetninger for auto_capture å jobbe; vi anbefaler at du sender inn dine avhengigheter som en requirement.txt or Conda environment.yml fil som beskrevet i forrige avsnitt.

For mer informasjon, se Kjør din lokale kode som en SageMaker Training-jobb.

Konfigurasjoner for SageMaker-jobber

Infrastrukturrelaterte innstillinger kan overføres til en konfigurasjonsfil som administratorbrukere kan hjelpe med å sette opp. Du trenger bare å sette den opp én gang. Infrastrukturinnstillinger dekker nettverkskonfigurasjonen, IAM-roller, Amazon enkel lagringstjeneste (Amazon S3) mappe for inndata, utdata og tagger. Referere til Konfigurering og bruk av standardinnstillinger med SageMaker Python SDK for mer informasjon.

SchemaVersion: '1.0'

SageMaker:

PythonSDK:

Modules:

RemoteFunction:

Dependencies: path/to/requirements.txt

EnvironmentVariables: {"EnvVarKey": "EnvVarValue"}

ImageUri: 366666666666.dkr.ecr.us-west-2.amazonaws.com/my-image:latest

InstanceType: ml.m5.large

RoleArn: arn:aws:iam::366666666666:role/MyRole

S3KmsKeyId: somekmskeyid

S3RootUri: s3://my-bucket/my-project

SecurityGroupIds:

- sg123

Subnets:

- subnet-1234

Tags:

- {"Key": "someTagKey", "Value": "someTagValue"}

VolumeKmsKeyId: somekmskeyidGjennomføring

Dyplæringsmodeller som PyTorch eller TensorFlow kan også kjøres i Studio ved å kjøre koden som en treningsjobb i den bærbare datamaskinen. For å vise frem denne muligheten i Studio, kan du klone denne repoen inn i Studio og kjøre notatboken som ligger i GitHub oppbevaringssted.

Dette eksemplet demonstrerer et ende-til-ende-bruk av binær tekstklassifisering. Vi bruker Hugging Face-transformatorene og datasettbiblioteket for å finjustere en forhåndstrent transformator på binær tekstklassifisering. Spesielt vil den forhåndstrente modellen bli finjustert ved hjelp av IMDb datasett.

Når du kloner depotet, bør du finne følgende filer:

- config.yaml – De fleste dekorasjonsargumentene kan overføres til konfigurasjonsfilen for å skille ut de infrastrukturrelaterte innstillingene fra kodebasen

- huggingface.ipynb – Denne inneholder koden for å trene en forhåndstrent HuggingFace-modell, som vil bli finjustert ved hjelp av IMDB-datasettet

- krav.txt – Denne filen inneholder alle avhengighetene for å kjøre funksjonen som skal brukes i denne notatboken for å kjøre koden og kjøre opplæringen eksternt i en GPU-instans som en treningsjobb

Når du åpner den bærbare datamaskinen, blir du bedt om å sette opp notatbokmiljøet. Du kan velge Data Science 3.0-bildet med Python 3-kjernen og ml.m5.large som hurtigstartforekomsttype for å kjøre notebook-koden. Denne instanstypen er betydelig raskere når det gjelder å spinne opp et miljø.

Opplæringsjobben vil bli kjørt i en ml.g4dn.xlarge-forekomst som definert i config.yaml file:

SchemaVersion: '1.0'

SageMaker:

PythonSDK:

Modules:

RemoteFunction:

# role arn is not required if in SageMaker Notebook instance or SageMaker Studio

# Uncomment the following line and replace with the right execution role if in a local IDE

# RoleArn: <IAM_ROLE_ARN>

InstanceType: ml.g4dn.xlarge

Dependencies: ./requirements.txtDe requirements.txt filavhengigheter for å kjøre funksjonen for å trene Hugging Face-modellen inkluderer følgende:

datasets

transformers

torch

scikit-learn

# lock s3fs to this specific version as more recent ones introduce dependency on aiobotocore, which is not compatible with botocore

s3fs==0.4.2

sagemaker>=2.148.0,<3Hugging Face-notisboken viser hvordan du kjører treningen eksternt via @remote funksjon, som kjøres synkront. Derfor vil funksjonen som kjøres for opplæring av modellen vente til SageMaker Training-jobben er fullført. Opplæringen kjøres eksternt med en GPU-forekomst der forekomsttypen er definert i den foregående konfigurasjonsfilen.

Etter at du har kjørt opplæringsjobben, kan du kjøre resten av cellene i notatboken for å inspisere evalueringsverdiene og klassifisere teksten på vår opplærte modell.

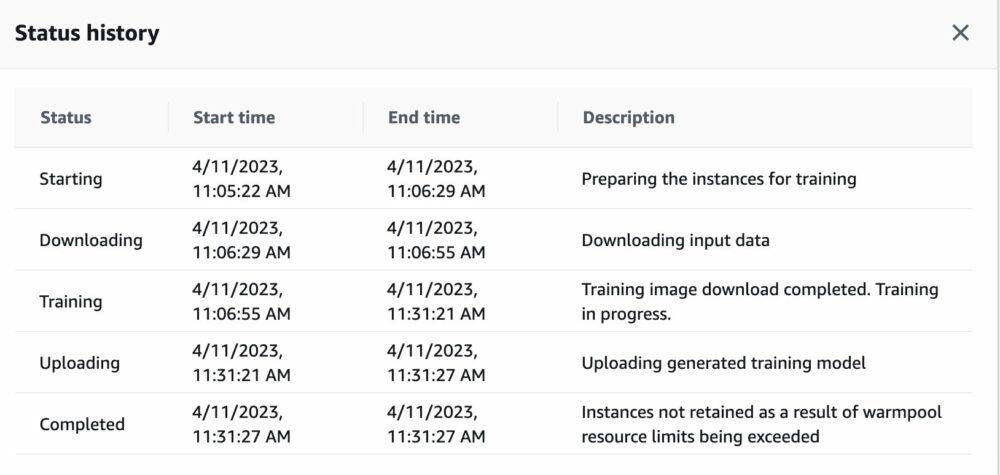

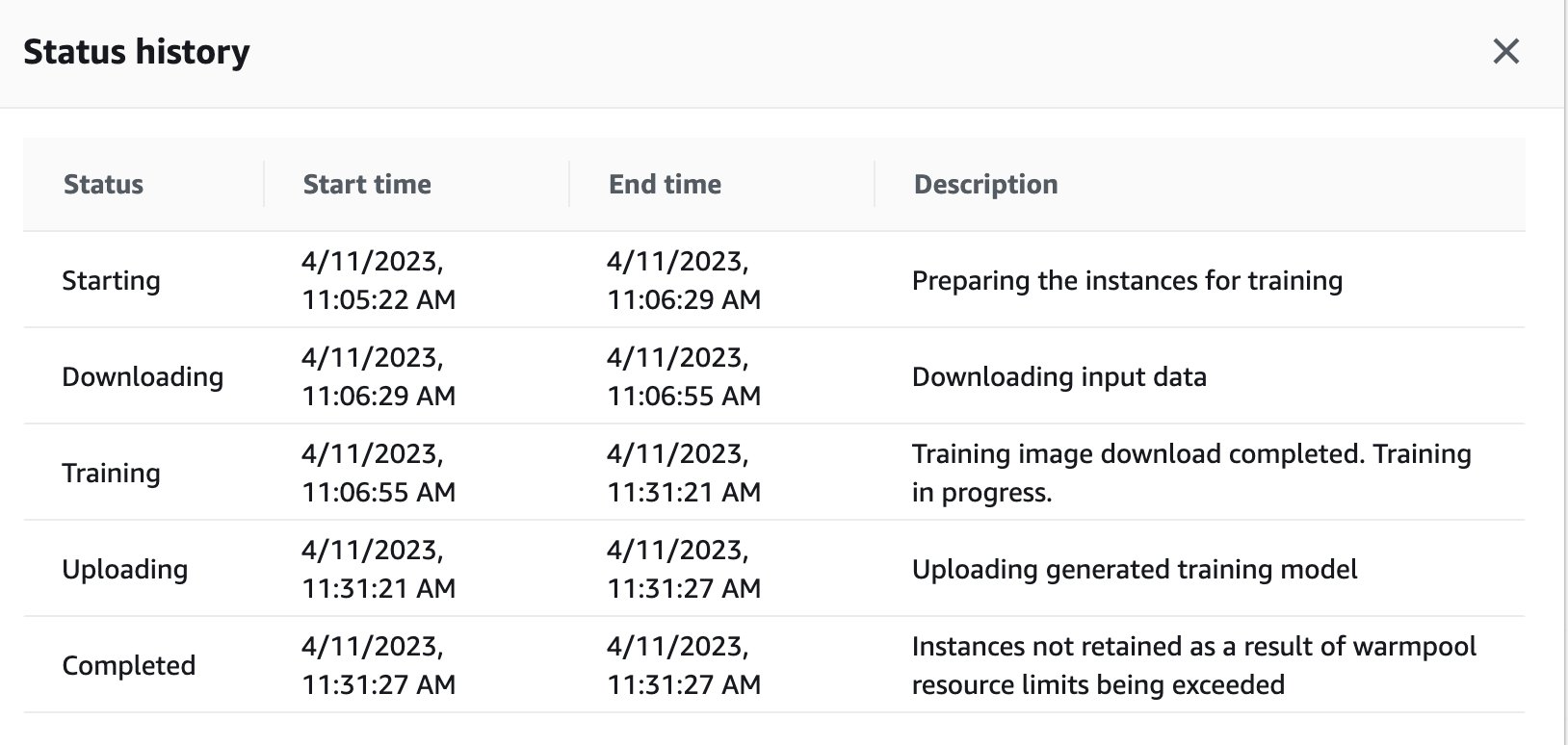

Du kan også se treningsjobbstatusen som ble eksternt utløst i GPU-forekomsten på SageMaker-dashbordet ved å navigere tilbake til SageMaker-konsollen.

Så snart treningsjobben er fullført, fortsetter den å kjøre instruksjonene i notatboken for evaluering og klassifisering. Lignende jobber kan trenes og kjøres via fjernutførelsesfunksjonen innebygd i Studio-notatbøker for å utføre kjøringene asynkront.

Integrasjon med SageMaker-eksperimenter inne i en @remote-funksjon

Du kan sende eksperimentnavnet, kjørenavnet og andre parametere til fjernfunksjonen din for å lage en SageMaker-eksperimentkjøring. Følgende kodeeksempel importerer eksperimentnavnet, navnet på kjøringen og parameterne som skal logges for hver kjøring:

from sagemaker.remote_function import remote

from sagemaker.experiments.run import Run

# Define your remote function

@remote

def train(value_1, value_2, exp_name, run_name):

...

...

#Creates the experiment

with Run( experiment_name=exp_name, run_name=run_name, sagemaker_session=sagemaker_session

) as run:

...

...

#Define values for the parameters to log

run.log_parameter("param_1", value_1)

run.log_parameter("param_2", value_2)

...

...

#Define metrics to log

run.log_metric("metric_a", 0.5)

run.log_metric("metric_b", 0.1) # Invoke your remote function

train(1.0, 2.0, "my-exp-name", "my-run-name") I det foregående eksempelet, parameterne p1 og p2 logges over tid inne i en treningssløyfe. Vanlige parametere kan inkludere batchstørrelse eller epoker. I eksemplet, beregningene A og B logges for en løpetur over tid inne i en treningsløkke. Vanlige beregninger kan inkludere nøyaktighet eller tap. For mer informasjon, se Lag et Amazon SageMaker-eksperiment.

konklusjonen

I dette innlegget introduserte vi en ny SageMaker Python SDK-funksjon som gjør det mulig for dataforskere å kjøre ML-koden deres i deres foretrukne IDE som SageMaker Training-jobber. Vi diskuterte forutsetningene for å bruke denne funksjonen sammen med funksjonene. Vi viste også hvordan du bruker denne funksjonen i Studio, SageMaker notebook-forekomster og din lokale IDE. I tillegg ga vi eksempelkodeeksempler for å demonstrere hvordan du bruker denne muligheten. Som et neste trinn anbefaler vi å prøve denne funksjonen i IDE eller SageMaker ved å følge kodeeksempler referert til i dette innlegget.

Om forfatterne

Dipankar Patro er en programvareutviklingsingeniør hos AWS SageMaker, og innoverer og bygger MLOps-løsninger for å hjelpe kunder med å ta i bruk AI/ML-løsninger i stor skala. Han har en MS i informatikk og interesseområdene hans er datasikkerhet, distribuerte systemer og AI/ML.

Dipankar Patro er en programvareutviklingsingeniør hos AWS SageMaker, og innoverer og bygger MLOps-løsninger for å hjelpe kunder med å ta i bruk AI/ML-løsninger i stor skala. Han har en MS i informatikk og interesseområdene hans er datasikkerhet, distribuerte systemer og AI/ML.

Farooq Sabir er senior spesialistløsningsarkitekt for kunstig intelligens og maskinlæring ved AWS. Han har PhD- og MS-grader i elektroteknikk fra University of Texas i Austin og en MS i informatikk fra Georgia Institute of Technology. Han har over 15 års arbeidserfaring og liker også å undervise og veilede studenter. Hos AWS hjelper han kunder med å formulere og løse forretningsproblemer innen datavitenskap, maskinlæring, datasyn, kunstig intelligens, numerisk optimalisering og relaterte domener. Basert i Dallas, Texas, elsker han og familien å reise og dra på lange bilturer.

Farooq Sabir er senior spesialistløsningsarkitekt for kunstig intelligens og maskinlæring ved AWS. Han har PhD- og MS-grader i elektroteknikk fra University of Texas i Austin og en MS i informatikk fra Georgia Institute of Technology. Han har over 15 års arbeidserfaring og liker også å undervise og veilede studenter. Hos AWS hjelper han kunder med å formulere og løse forretningsproblemer innen datavitenskap, maskinlæring, datasyn, kunstig intelligens, numerisk optimalisering og relaterte domener. Basert i Dallas, Texas, elsker han og familien å reise og dra på lange bilturer.

Manoj Ravi er senior produktsjef for Amazon SageMaker. Han brenner for å bygge neste generasjons AI-produkter og jobber med programvare og verktøy for å gjøre storskala maskinlæring enklere for kundene. Han har en MBA fra Haas School of Business og en mastergrad i Information Systems Management fra Carnegie Mellon University. På fritiden liker Manoj å spille tennis og drive med landskapsfotografering.

Manoj Ravi er senior produktsjef for Amazon SageMaker. Han brenner for å bygge neste generasjons AI-produkter og jobber med programvare og verktøy for å gjøre storskala maskinlæring enklere for kundene. Han har en MBA fra Haas School of Business og en mastergrad i Information Systems Management fra Carnegie Mellon University. På fritiden liker Manoj å spille tennis og drive med landskapsfotografering.

Shikhar Kwatra er en AI/ML-spesialistløsningsarkitekt hos Amazon Web Services, og jobber med en ledende global systemintegrator. Han har fått tittelen en av de yngste indiske mesteroppfinnerne med over 500 patenter innen AI/ML og IoT-domenene. Shikhar hjelper til med å bygge, bygge og vedlikeholde kostnadseffektive, skalerbare skymiljøer for organisasjonen, og støtter GSI-partneren i å bygge strategiske industriløsninger på AWS. Shikhar liker å spille gitar, komponere musikk og praktisere mindfulness på fritiden.

Shikhar Kwatra er en AI/ML-spesialistløsningsarkitekt hos Amazon Web Services, og jobber med en ledende global systemintegrator. Han har fått tittelen en av de yngste indiske mesteroppfinnerne med over 500 patenter innen AI/ML og IoT-domenene. Shikhar hjelper til med å bygge, bygge og vedlikeholde kostnadseffektive, skalerbare skymiljøer for organisasjonen, og støtter GSI-partneren i å bygge strategiske industriløsninger på AWS. Shikhar liker å spille gitar, komponere musikk og praktisere mindfulness på fritiden.

Vikram Elango er en Sr. AI/ML Specialist Solutions Architect ved AWS, basert i Virginia, USA. Han er for tiden fokusert på generativ AI, LLM-er, prompt engineering, optimalisering av store modellslutninger og skalering av ML på tvers av bedrifter. Vikram hjelper finans- og forsikringsbransjens kunder med design og tankeledelse med å bygge og distribuere maskinlæringsapplikasjoner i stor skala. På fritiden liker han å reise, fotturer, lage mat og camping.

Vikram Elango er en Sr. AI/ML Specialist Solutions Architect ved AWS, basert i Virginia, USA. Han er for tiden fokusert på generativ AI, LLM-er, prompt engineering, optimalisering av store modellslutninger og skalering av ML på tvers av bedrifter. Vikram hjelper finans- og forsikringsbransjens kunder med design og tankeledelse med å bygge og distribuere maskinlæringsapplikasjoner i stor skala. På fritiden liker han å reise, fotturer, lage mat og camping.

- SEO-drevet innhold og PR-distribusjon. Bli forsterket i dag.

- PlatoAiStream. Web3 Data Intelligence. Kunnskap forsterket. Tilgang her.

- Minting the Future med Adryenn Ashley. Tilgang her.

- kilde: https://aws.amazon.com/blogs/machine-learning/run-your-local-machine-learning-code-as-amazon-sagemaker-training-jobs-with-minimal-code-changes/

- : har

- :er

- :ikke

- $OPP

- 1

- 10

- 100

- 15 år

- 500

- 7

- a

- evne

- I stand

- Om oss

- adgang

- Logg inn

- nøyaktighet

- oppnådd

- tvers

- aktiv

- handlinger

- legge til

- legge

- tillegg

- admin

- administratorer

- adoptere

- avansert

- Fordel

- AI

- AI / ML

- hjelpemidler

- Alle

- tillater

- langs

- også

- Amazon

- Amazon SageMaker

- Amazon Web Services

- an

- analysere

- og

- annonsert

- noen

- søknader

- ER

- områder

- argumenter

- kunstig

- kunstig intelligens

- Kunstig intelligens og maskinlæring

- AS

- assosiert

- At

- austin

- automatisk

- tilgjengelig

- AWS

- tilbake

- basen

- basert

- BE

- Fordeler

- Budsjetter

- bygge

- Bygning

- virksomhet

- by

- CAN

- evner

- fangst

- Carnegie Mellon

- bære

- saken

- Celler

- endring

- Endringer

- kanaler

- valg

- klasse

- klassifisering

- Klassifisere

- Cloud

- kode

- kodebase

- Høyskole

- kommer

- Felles

- kompatibel

- fullføre

- Beregn

- datamaskin

- informatikk

- Datasikkerhet

- Datamaskin syn

- konsept

- Konfigurasjon

- Konsoll

- inneholde

- Container

- inneholder

- sammenhenger

- fortsetter

- Kjerne

- Kostnad

- kunne

- dekke

- skape

- I dag

- Kunder

- tilpasse

- Dallas

- dashbord

- dato

- databehandling

- datavitenskap

- datasett

- erklærer

- Misligholde

- mislighold

- definert

- demonstrere

- demonstrerer

- Avhengighet

- utplassere

- beskrevet

- utforming

- detaljer

- utviklet

- Utvikler

- Utvikling

- forskjellig

- diskutert

- distribueres

- distribuerte systemer

- distribuert opplæring

- domener

- gjort

- ikke

- under

- e

- hver enkelt

- opptjent

- brukervennlighet

- enklere

- lett

- enten

- innebygd

- muliggjør

- kryptering

- ende til ende

- ingeniør

- Ingeniørarbeid

- Ingeniører

- bedrifter

- entry

- Miljø

- miljøer

- epoke

- epoker

- evaluering

- Hver

- eksempel

- eksempler

- gjennomføring

- eksisterende

- erfaring

- eksperiment

- Face

- kjent

- familie

- FAST

- raskere

- Trekk

- Egenskaper

- Noen få

- filet

- Filer

- finansiell

- Først

- fleksibilitet

- Fokus

- fokuserte

- etter

- Til

- Rammeverk

- fra

- fullt

- funksjon

- funksjoner

- Dess

- framtid

- Futures

- generative

- Generativ AI

- Georgia

- gitt

- Global

- Go

- GPU

- Gruppens

- Ha

- he

- hjelpe

- hjelper

- hans

- holder

- Hvordan

- Hvordan

- HTML

- http

- HTTPS

- Klem ansikt

- Identitet

- if

- bilde

- gjennomføring

- importere

- import

- in

- inkludere

- Inkludert

- indisk

- industri

- informasjon

- Informasjonssystemer

- Infrastruktur

- nyskapende

- inngang

- installerte

- f.eks

- Institute

- instruksjoner

- forsikring

- integrert

- Integrerer

- Intelligens

- interesse

- inn

- introdusere

- introdusert

- oppfinnere

- IOT

- IT

- gjentakelser

- DET ER

- Jobb

- Jobb

- jpg

- bare

- nøkkel

- lab

- landskap

- bærbare datamaskiner

- stor

- storskala

- siste

- lansere

- lansert

- lansere

- Ledelse

- ledende

- LÆRE

- læring

- la

- Lar

- bibliotekene

- Bibliotek

- Livssyklus

- i likhet med

- liker

- linje

- lokal

- lokalt

- ligger

- logg

- logget

- Lang

- UTSEENDE

- tap

- elsker

- maskin

- maskinlæring

- laget

- Vedlike

- gjøre

- GJØR AT

- fikk til

- ledelse

- leder

- Master

- Kan..

- Mellon

- metodikk

- Metrics

- Mindfulness

- minimal

- minutter

- ML

- MLOps

- Mote

- modell

- modeller

- Moduler

- mer

- mest

- flytte

- MS

- flere

- musikk

- navn

- nemlig

- navigere

- Trenger

- nødvendig

- nettverk

- nettverk

- Ny

- neste

- noder

- bærbare

- nå

- følelsesløs

- gjenstander

- of

- on

- Ombord

- gang

- ONE

- bare

- åpen

- åpen kildekode

- optimalisering

- or

- rekkefølge

- organisasjon

- OS

- Annen

- vår

- ut

- produksjon

- enn

- overstyring

- pakke

- pakker

- pandaer

- Parallel

- parametere

- Spesielt

- partner

- passere

- passerer

- Passerer

- lidenskapelig

- Patenter

- banen

- ytelse

- fotografering

- plattform

- plato

- Platon Data Intelligence

- PlatonData

- spiller

- Point

- Post

- trekkes

- forutsetninger

- forrige

- Problem

- problemer

- prosessering

- Produkt

- Produktsjef

- produktiv

- Produkter

- forutsatt

- Python

- pytorch

- klar

- nylig

- nylig

- anbefaler

- i slekt

- slipp

- fjernkontroll

- erstatte

- Repository

- påkrevd

- Krav

- REST

- retur

- vei

- Rolle

- roller

- Kjør

- rennende

- sagemaker

- skalerbar

- Skala

- skalering

- Skole

- Vitenskap

- forskere

- scikit lære

- SDK

- sømløst

- Seksjon

- seksjoner

- sikkerhet

- se

- senior

- separat

- Tjenester

- Session

- sett

- innstilling

- innstillinger

- oppsett

- flere

- bør

- Vis

- presentere

- vist

- Viser

- betydelig

- lignende

- Enkelt

- ganske enkelt

- enkelt

- Størrelse

- liten

- Snapshot

- So

- Software

- programvareutvikling

- Solutions

- LØSE

- spesialist

- spesifikk

- spesifikasjon

- spesifisert

- Begynn

- Start

- status

- Trinn

- lagring

- Strategisk

- Studenter

- studio

- send

- subnett

- slik

- Støttes

- Støtter

- system

- Systemer

- Ta

- tar

- ta

- oppgaver

- lag

- Teknologi

- tensorflow

- texas

- Tekstklassifisering

- Det

- De

- deres

- Dem

- deretter

- Der.

- derved

- derfor

- Disse

- de

- denne

- trodde

- tenkte ledelse

- Gjennom

- tid

- Tittel

- til

- verktøy

- lommelykt

- mot

- Tog

- trent

- Kurs

- transformers

- reiser

- Traveling

- utløst

- typen

- typisk

- etter

- forstå

- universitet

- Oppdater

- us

- bruke

- bruk sak

- brukt

- Brukere

- ved hjelp av

- verdi

- Verdier

- versjon

- av

- Se

- Virginia

- syn

- vs

- vs kode

- vente

- ønsker

- we

- web

- webtjenester

- når

- hvilken

- mens

- vil

- med

- innenfor

- Arbeid

- arbeid

- virker

- ville

- vikle

- Innpakket

- skrive

- skriv kode

- skrevet

- X

- år

- Du

- Yngste

- Din

- zephyrnet