Overhørt på en Meta GenAI-sosial:

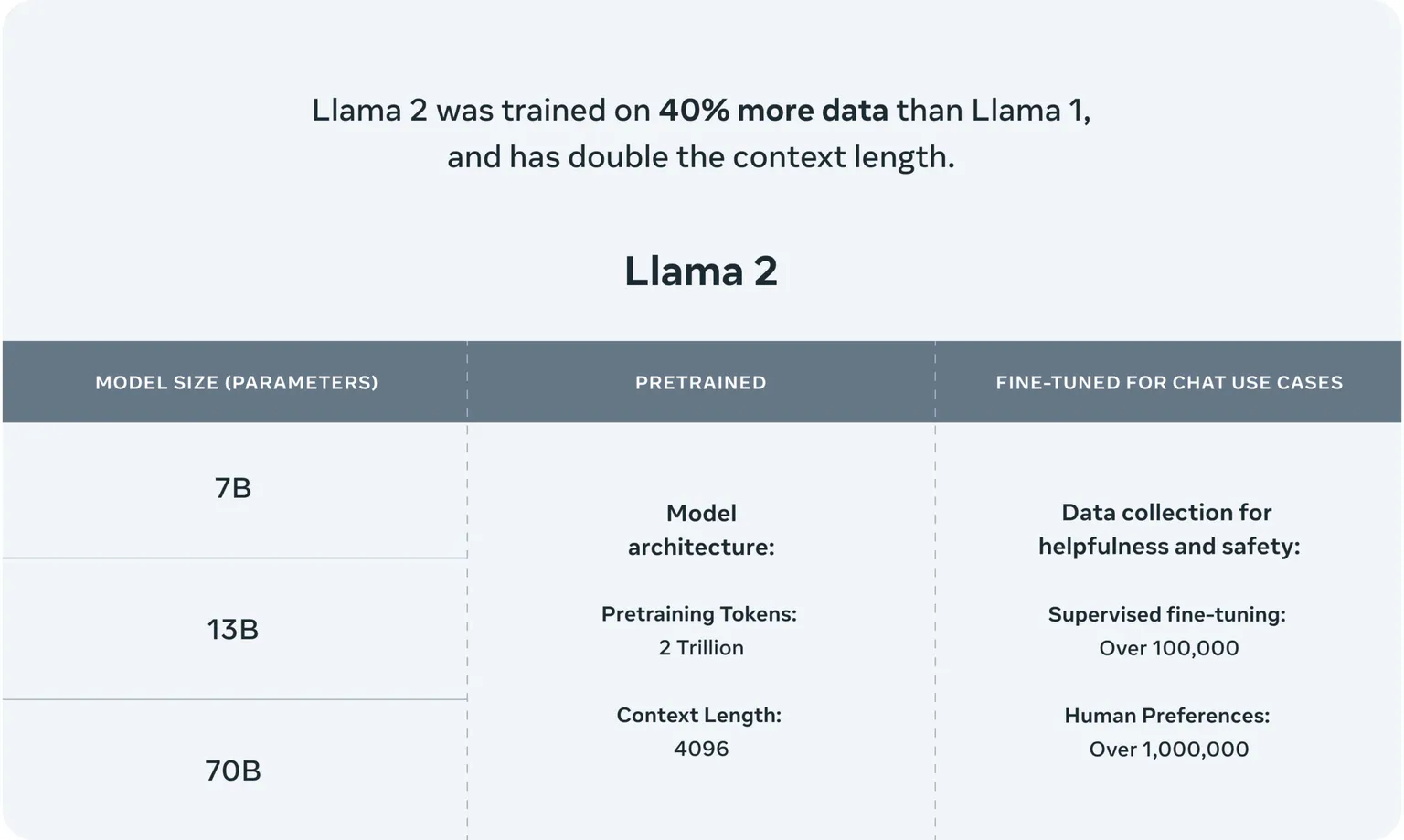

"Vi har beregning for å trene Llama 3 og 4. Planen er at Llama-3 skal være like god som GPT-4."

"Wow, hvis Llama-3 er like god som GPT-4, vil dere fortsatt ha åpen kildekode?"

"Ja, vi vil. Beklager justering folk."

— jason (@agikoala) August 25, 2023

Hold deg oppdatert på kryptonyheter, få daglige oppdateringer i innboksen din.

- SEO-drevet innhold og PR-distribusjon. Bli forsterket i dag.

- PlatoData.Network Vertical Generative Ai. Styrk deg selv. Tilgang her.

- PlatoAiStream. Web3 Intelligence. Kunnskap forsterket. Tilgang her.

- PlatoESG. Karbon, CleanTech, Energi, Miljø, Solenergi, Avfallshåndtering. Tilgang her.

- PlatoHelse. Bioteknologisk og klinisk etterretning. Tilgang her.

- kilde: https://decrypt.co/205436/llama-3-release-date-rumored-meta-ai-challenger

- : har

- :er

- :ikke

- $OPP

- 1

- 10

- 13

- 15%

- 16

- 2022

- 2023

- 2024

- 25

- 32

- 7

- 70

- a

- evne

- Om oss

- Absolute

- Ifølge

- tvers

- forfremmelse

- AI

- innretting

- Alle

- også

- alltid

- an

- analyse

- og

- En annen

- forventning

- hva som helst

- arkitektur

- ER

- Array

- kunstig

- kunstig intelligens

- AS

- At

- tilgjengelig

- tilbake

- bakgrunn

- BE

- vært

- bak

- være

- antatt

- mellom

- Stor

- Milliarder

- Bit

- Blokker

- Blocks

- skryte

- både

- Bygning

- Bunch

- men

- by

- evner

- sentrum

- chatbots

- fjerne

- engasjement

- samfunnet

- Selskapet

- konkurrere

- konkurranse

- kompleksitet

- omfattende

- beregnings

- regnekraft

- Beregn

- datamaskin

- BEKREFTET

- forbruker

- Forbrukerprodukter

- sammenhenger

- fortsatte

- kontroll

- Samtale

- Bedriftens

- korrelerer

- kunne

- kritisk

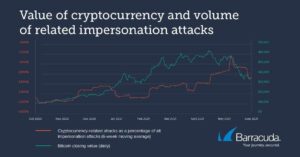

- krypto

- Crypto Nyheter

- sykluser

- daglig

- mørk

- dato

- Datasenter

- dekryptere

- definere

- dybde

- Utvikling

- Dominere

- Don

- under

- hver enkelt

- ivrig

- Tidlig

- Edge

- Enterprise

- etablert

- nøyaktig

- Excellence

- Kjøreglede

- omfattende

- utvendig

- Noen få

- Først

- passer

- fokuserte

- etter

- Til

- videre

- fora

- Fundament

- vennlig

- fra

- framtid

- Gambit

- tannhjul

- girer opp

- generere

- generative

- få

- gigantene

- skal

- god

- grunnarbeid

- Halvparten

- maskinvare

- Ha

- he

- historisk

- holder

- Hvordan

- HTTPS

- i

- if

- in

- industri

- informasjon

- innsikt

- Intelligens

- intensjoner

- intern

- kryss

- Intervju

- inn

- Investeringer

- IT

- køyring

- DET ER

- Januar

- Juli

- Vet

- landskap

- Språk

- stor

- i stor grad

- seinere

- lansere

- lansert

- venstre

- nivåer

- lett

- i likhet med

- Sannsynlig

- Llama

- truende

- gjøre

- GJØR AT

- mange

- merke

- Mark Zuckerberg

- markedsplass

- bety

- Meta

- modell

- modeller

- mer

- mest

- bevegelse

- flytte

- navn

- FORTELLING

- Naviger

- Trenger

- nevrale

- Ny

- nyheter

- neste

- nå

- Antall

- Nvidia

- of

- tilby

- offisielt

- ofte

- on

- ONE

- bare

- åpen

- åpen kildekode

- OpenAI

- or

- Annen

- produksjon

- enn

- håndgripelig

- parametere

- Partnerskap

- mønstre

- Ansatte

- personlig

- personlig informasjon

- stykker

- Tonehøyde

- fly

- plato

- Platon Data Intelligence

- PlatonData

- plausibel

- podcast

- potensiell

- makt

- kraftig

- kraftstasjon

- krefter

- prioritet

- prosess

- Produkter

- foreslått

- sette

- kvalitet

- spørsmål

- Race

- RE

- nå

- klar

- nylig

- nylig

- Rød

- slektning

- slipp

- utgitt

- forblir

- påkrevd

- forsker

- responsive

- ikke sant

- robust

- Rykter

- s

- trygge

- Sa

- så

- scene

- Forsker

- søker

- sikkerhet

- forstand

- betjene

- servert

- Tjenester

- innstilling

- formet

- delt

- skur

- presentere

- innhyllet

- undertegne

- Skilt

- So

- selskap

- noen

- raffinement

- kilde

- Rom

- spekulasjon

- Scene

- innsatser

- stå

- Start

- Still

- Strategisk

- suksess

- Dress

- lag

- tech

- tekst

- Det

- De

- Fremtiden

- Der.

- Disse

- denne

- tid

- tidslinje

- ganger

- titan

- til

- sammen

- topp

- Tog

- trent

- Kurs

- Trillion

- Sannhet

- underbygger

- forstå

- til

- oppdateringer

- Bruker

- Varierende

- versjoner

- we

- VI VIL

- Hva

- når

- mens

- virvelvind

- bred

- vil

- med

- arbeid

- virker

- ville

- wow

- Du

- Din

- zephyrnet

- Zuckerberg