Dette innlegget ble skrevet i samarbeid med Bhajandeep Singh og Ajay Vishwakarma fra Wipros AWS AI/ML Practice.

Mange organisasjoner har brukt en kombinasjon av lokale og åpen kildekode datavitenskapsløsninger for å lage og administrere modeller for maskinlæring (ML).

Datavitenskap og DevOps-team kan møte utfordringer med å administrere disse isolerte verktøystablene og systemene. Å integrere flere verktøystabler for å bygge en kompakt løsning kan innebære å bygge tilpassede koblinger eller arbeidsflyter. Å administrere forskjellige avhengigheter basert på gjeldende versjon av hver stabel og opprettholde disse avhengighetene med utgivelsen av nye oppdateringer av hver stabel kompliserer løsningen. Dette øker kostnadene for vedlikehold av infrastruktur og hemmer produktiviteten.

Kunstig intelligens (AI) og maskinlæring (ML) tilbud fra Amazon Web Services (AWS), sammen med integrerte overvåkings- og varslingstjenester, hjelper organisasjoner med å oppnå det nødvendige nivået av automatisering, skalerbarhet og modellkvalitet til en optimal kostnad. AWS hjelper også datavitenskap og DevOps-team med å samarbeide og effektivisere den generelle livssyklusprosessen for modellen.

AWS-porteføljen av ML-tjenester inkluderer et robust sett med tjenester som du kan bruke til å akselerere utviklingen, opplæringen og distribusjonen av maskinlæringsapplikasjoner. Suiten med tjenester kan brukes til å støtte hele modellens livssyklus, inkludert overvåking og omskolering av ML-modeller.

I dette innlegget diskuterer vi modellutvikling og MLOps-rammeverkimplementering for en av Wipros kunder som bruker Amazon SageMaker og andre AWS-tjenester.

Wipro er en AWS Premier Tier Services Partner og Managed Service Provider (MSP). Det er AI/ML-løsninger drive forbedret operasjonell effektivitet, produktivitet og kundeopplevelse for mange av deres bedriftskunder.

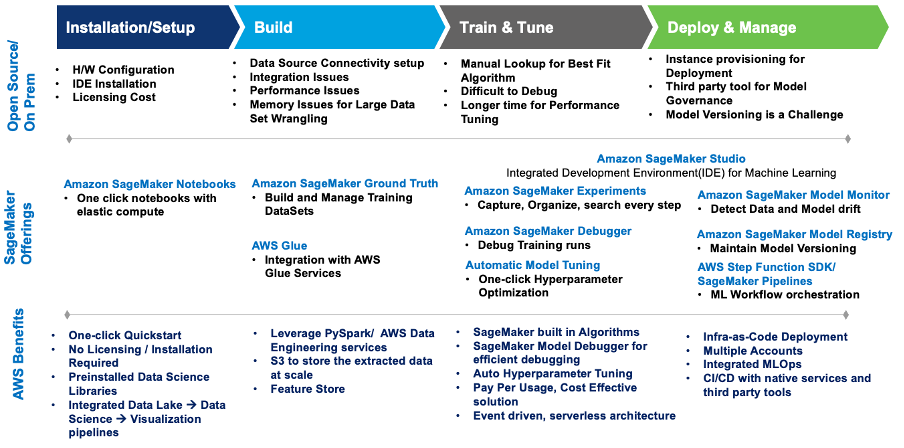

Aktuelle utfordringer

La oss først forstå noen av utfordringene kundens datavitenskap og DevOps-team møtte med sitt nåværende oppsett. Vi kan deretter undersøke hvordan de integrerte SageMaker AI/ML-tilbudene hjalp til med å løse disse utfordringene.

- Samarbeid – Dataforskere jobbet på hver sin lokale Jupyter-notatbok for å lage og trene ML-modeller. De manglet en effektiv metode for å dele og samarbeide med andre dataforskere.

- Skalerbarhet – Trening og omopplæring av ML-modeller tok mer og mer tid ettersom modellene ble mer komplekse mens den tildelte infrastrukturkapasiteten forble statisk.

- MLOps – Modellovervåking og pågående styring var ikke tett integrert og automatisert med ML-modellene. Det er avhengigheter og kompleksiteter med å integrere tredjepartsverktøy i MLOps-pipelinen.

- Gjenbrukbarhet – Uten gjenbrukbare MLOps-rammeverk, må hver modell utvikles og styres separat, noe som øker den totale innsatsen og forsinker modellens operasjonalisering.

Dette diagrammet oppsummerer utfordringene og hvordan Wipros implementering på SageMaker adresserte dem med innebygde SageMaker-tjenester og tilbud.

Figur 1 – SageMaker-tilbud for ML arbeidsbelastningsmigrering

Wipro definerte en arkitektur som adresserer utfordringene på en kostnadsoptimalisert og helautomatisert måte.

Følgende er brukssaken og modellen som ble brukt for å bygge løsningen:

- Bruk tilfelle: Prisprediksjon basert på bruktbildatasettet

- Problemtype: Regresjon

- Modeller brukt: XGBoost og Linear Learner (SageMaker innebygde algoritmer)

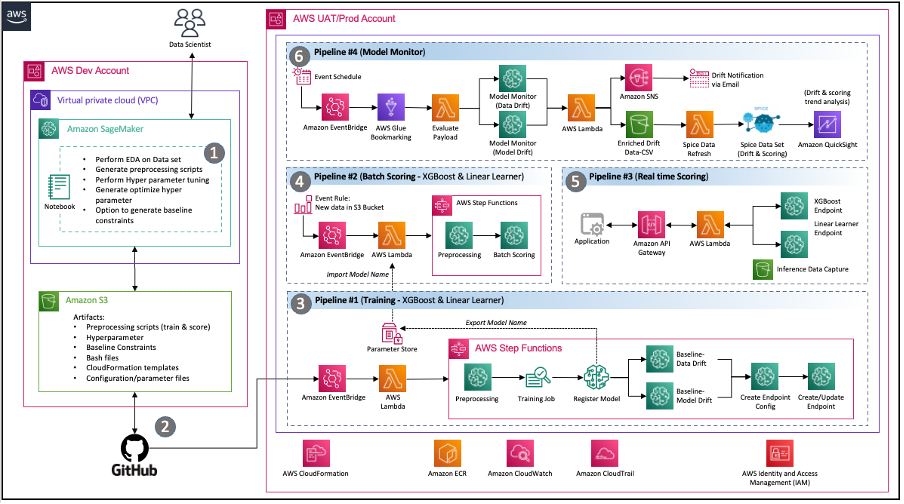

Løsningsarkitektur

Wipro-konsulenter gjennomførte en dypdykk oppdagelsesworkshop med kundens datavitenskap, DevOps og dataingeniørteam for å forstå det nåværende miljøet så vel som deres krav og forventninger til en moderne løsning på AWS. Ved slutten av konsulentoppdraget hadde teamet implementert følgende arkitektur som effektivt adresserte kjernekravene til kundeteamet, inkludert:

Kodedeling – SageMaker notatbøker gjør det mulig for dataforskere å eksperimentere og dele kode med andre teammedlemmer. Wipro akselererte ytterligere sin ML-modellreise ved å implementere Wipros kodeakseleratorer og kodebiter for å fremskynde funksjonsutvikling, modellopplæring, modelldistribusjon og pipelineoppretting.

Kontinuerlig integrasjon og kontinuerlig levering (CI/CD) pipeline – Ved å bruke kundens GitHub-lager aktivert kodeversjon og automatiserte skript for å starte pipeline-distribusjon hver gang nye versjoner av koden er forpliktet.

MLOps – Arkitekturen implementerer en SageMaker-modellovervåkingspipeline for kontinuerlig modellkvalitetsstyring ved å validere data og modelldrift som kreves av den definerte tidsplanen. Hver gang drift oppdages, startes en hendelse for å varsle de respektive lagene om å iverksette tiltak eller starte modellomopplæring.

Hendelsesdrevet arkitektur – Rørledningene for modellopplæring, modelldistribusjon og modellovervåking er godt integrert ved bruk Amazon EventBridge, en serverløs hendelsesbuss. Når definerte hendelser oppstår, kan EventBridge påkalle en pipeline for å kjøre som svar. Dette gir et løst koblet sett med rørledninger som kan kjøres etter behov som respons på miljøet.

Figur 2 – Hendelsesdrevet MLOps-arkitektur med SageMaker

Løsningskomponenter

Denne delen beskriver de ulike løsningskomponentene i arkitekturen.

Eksperimenter notatbøker

- Formål: Kundens datavitenskapsteam ønsket å eksperimentere med ulike datasett og flere modeller for å komme opp med de optimale funksjonene, ved å bruke disse som ytterligere input til den automatiserte pipeline.

- Løsning: Wipro laget SageMaker-eksperimentnotatbøker med kodebiter for hvert gjenbrukbare trinn, for eksempel lesing og skriving av data, modellfunksjonsteknikk, modelltrening og justering av hyperparameter. Funksjonsingeniøroppgaver kan også forberedes i Data Wrangler, men klienten ba spesifikt om SageMaker-behandlingsjobber og AWS trinnfunksjoner fordi de var mer komfortable med å bruke disse teknologiene. Vi brukte AWS step function data science SDK for å lage en trinnfunksjon – for flyttesting – direkte fra den bærbare forekomsten for å muliggjøre veldefinerte innganger for rørledningene. Dette har hjulpet dataforskerteamet til å lage og teste rørledninger i et mye raskere tempo.

Automatisert treningspipeline

- Formål: For å aktivere en automatisert trenings- og omtreningspipeline med konfigurerbare parametere som forekomsttype, hyperparametere og en Amazon Simple Storage Service (Amazon S3) bøtte plassering. Rørledningen bør også lanseres av data-push-hendelsen til S3.

- Løsning: Wipro implementerte en gjenbrukbar treningspipeline ved å bruke Step Functions SDK, SageMaker-behandling, treningsjobber, en SageMaker-modellmonitorbeholder for grunnlinjegenerering, AWS Lambda, og EventBridge-tjenester. Ved å bruke AWS-hendelsesdrevet arkitektur, konfigureres rørledningen til å starte automatisk basert på en ny datahendelse som skyves til den tilordnede S3-bøtten. Varsler er konfigurert til å sendes til de definerte e-postadressene. På et høyt nivå ser treningsflyten ut som følgende diagram:

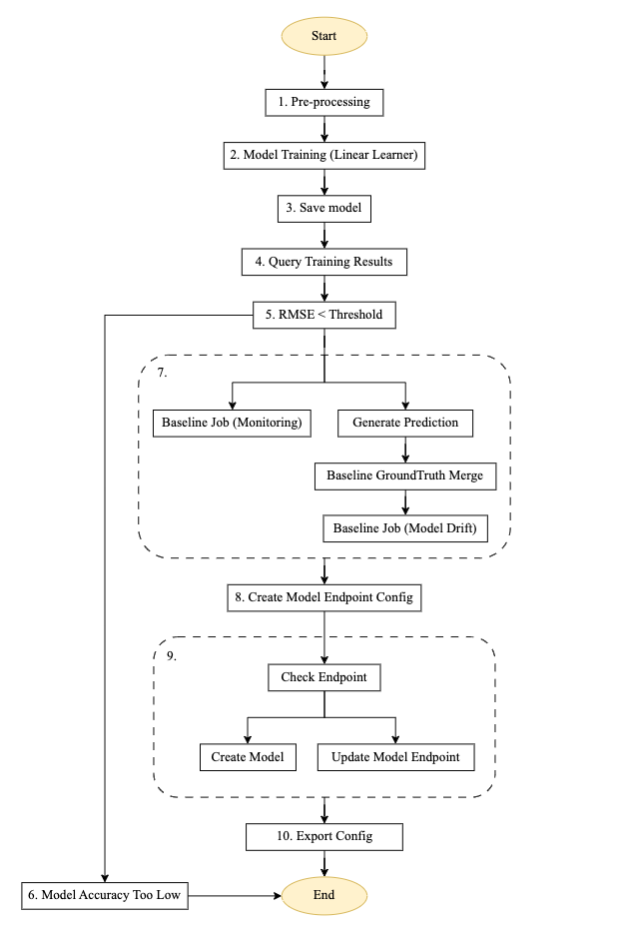

Figur 3 – Treningsrørledningsstegmaskin.

Flytbeskrivelse for den automatiserte treningspipelinen

Diagrammet ovenfor er en automatisert treningspipeline bygget ved hjelp av Step Functions, Lambda og SageMaker. Det er en gjenbrukbar pipeline for å sette opp automatisert modelltrening, generere spådommer, lage en baseline for modellovervåking og dataovervåking, og opprette og oppdatere et endepunkt basert på tidligere modellterskelverdi.

- Pre-prosessering: Dette trinnet tar data fra et Amazon S3-sted som input og bruker SageMaker SKLearn-beholderen til å utføre nødvendige funksjonsutviklings- og dataforbehandlingsoppgaver, for eksempel tog-, test- og valideringsdeling.

- Modelltrening: Ved å bruke SageMaker SDK kjører dette trinnet treningskode med det respektive modellbildet og trener datasett fra forhåndsbehandlingsskript mens de genererer de trente modellartefaktene.

- Lagre modell: Dette trinnet lager en modell fra de trente modellartefaktene. Modellnavnet lagres for referanse i en annen pipeline ved hjelp av AWS Systems Manager Parameter Store.

- Spørre treningsresultater: Dette trinnet kaller Lambda-funksjonen for å hente beregningene for den fullførte treningsjobben fra det tidligere modelltreningstrinnet.

- RMSE-terskel: Dette trinnet verifiserer den trente modellberegningen (RMSE) mot en definert terskel for å avgjøre om du skal fortsette mot endepunktdistribusjon eller avvise denne modellen.

- Modellnøyaktighet for lav: På dette trinnet kontrolleres modellens nøyaktighet mot den forrige beste modellen. Hvis modellen mislykkes ved metrisk validering, sendes meldingen av en Lambda-funksjon til målemnet registrert i Amazon Simple Notification Service (Amazon SNS). Hvis denne kontrollen mislykkes, avsluttes flyten fordi den nye trente modellen ikke nådde den definerte terskelen.

- Grunnlinjejobbdataavvik: Hvis den trente modellen består valideringstrinnene, genereres grunnlinjestatistikk for denne trente modellversjonen for å aktivere overvåking, og de parallelle grentrinnene kjøres for å generere grunnlinjen for modellkvalitetskontrollen.

- Opprett modellendepunktkonfigurasjon: Dette trinnet oppretter endepunktkonfigurasjon for den evaluerte modellen i forrige trinn med en aktivere datafangst konfigurasjon.

- Sjekk endepunkt: Dette trinnet sjekker om endepunktet eksisterer eller må opprettes. Basert på utdataene, er neste trinn å opprette eller oppdatere endepunktet.

- Eksporter konfigurasjon: Dette trinnet eksporterer parameterens modellnavn, endepunktnavn og endepunktkonfigurasjon til AWS systemansvarlig Parameterlager.

Varsler og varsler er konfigurert til å sendes til den konfigurerte SNS-emne-e-posten ved feil eller suksess med endring av tilstandsmaskinstatus. Den samme rørledningskonfigurasjonen gjenbrukes for XGBoost-modellen.

Automatisert batch scoring pipeline

- Formål: Start batch-scoring så snart scoring-input batchdata er tilgjengelig på den respektive Amazon S3-lokasjonen. Batch-scoringen bør bruke den siste registrerte modellen for å gjøre scoringen.

- Løsning: Wipro implementerte en gjenbrukbar scoringspipeline ved å bruke Step Functions SDK, SageMaker batch-transformasjonsjobber, Lambda og EventBridge. Rørledningen utløses automatisk basert på tilgjengeligheten av nye scoringsbatchdata til den respektive S3-lokasjonen.

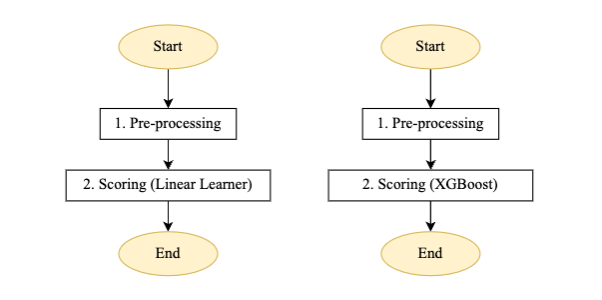

Figur 4 – Scoringspipeline-trinnmaskin for lineær elev og XGBoost-modell

Flytbeskrivelse for den automatiske batch scoring pipeline:

- Pre-prosessering: Inndata for dette trinnet er en datafil fra den respektive S3-plasseringen, og utfører den nødvendige forhåndsbehandlingen før SageMaker-batchtransformasjonsjobben kalles.

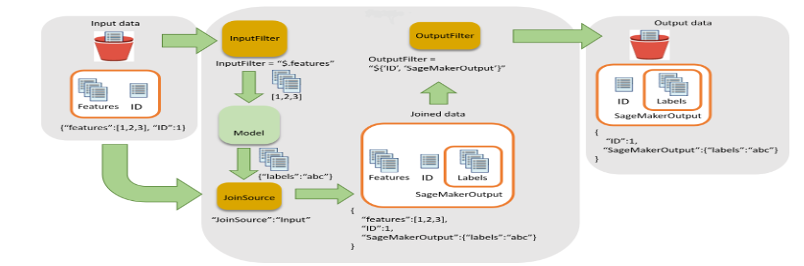

- Scoring: Dette trinnet kjører batch-transformasjonsjobben for å generere slutninger, kaller den nyeste versjonen av den registrerte modellen og lagrer poengsummen i en S3-bøtte. Wipro har brukt inngangsfilteret og sammenføyningsfunksjonaliteten til SageMaker batch transformation API. Det bidro til å berike poengdataene for bedre beslutningstaking.

Figur 5 – Inngangsfilter og sammenføyningsstrøm for batchtransformasjon

- I dette trinnet lanseres tilstandsmaskinrørledningen av en ny datafil i S3-bøtten.

Varslingen er konfigurert til å sendes til den konfigurerte SNS-emne-e-posten ved feil/suksess med endringen av tilstandsmaskinens status.

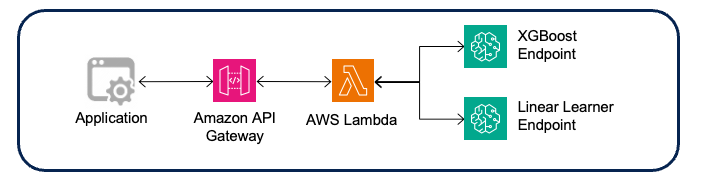

Sanntids slutningspipeline

- Formål: For å aktivere sanntidsslutninger fra begge modellenes (Linear Learner og XGBoost) endepunkter og få den maksimale predikerte verdien (eller ved å bruke en hvilken som helst annen tilpasset logikk som kan skrives som en Lambda-funksjon) som skal returneres til applikasjonen.

- Løsning: Wipro-teamet har implementert gjenbrukbar arkitektur ved hjelp av Amazon API-gateway, Lambda og SageMaker endepunkt som vist i figur 6:

Figur 6 – Sanntids inferensrørledning

Flytbeskrivelse for sanntidsslutningsrørledningen vist i figur 6:

- Nyttelasten sendes fra applikasjonen til Amazon API Gateway, som ruter den til den respektive Lambda-funksjonen.

- En Lambda-funksjon (med et integrert SageMaker-tilpasset lag) utfører den nødvendige forhåndsbehandlingen, JSON- eller CSV-nyttelastformatering, og påkaller de respektive endepunktene.

- Svaret returneres til Lambda og sendes tilbake til applikasjonen gjennom API Gateway.

Kunden brukte denne rørledningen for små og mellomstore modeller, som inkluderte bruk av ulike typer åpen kildekode-algoritmer. En av de viktigste fordelene med SageMaker er at ulike typer algoritmer kan bringes inn i SageMaker og distribueres ved hjelp av en BYOC-teknikk (bring your own container). BYOC innebærer containerisering av algoritmen og registrering av bildet Amazon Elastic Container Registry (Amazon ECR), og deretter bruke det samme bildet for å lage en beholder for å gjøre trening og slutninger.

Skalering er et av de største problemene i maskinlæringssyklusen. SageMaker kommer med de nødvendige verktøyene for å skalere en modell under inferens. I den foregående arkitekturen må brukerne aktivere automatisk skalering av SageMaker, som til slutt håndterer arbeidsbelastningen. For å aktivere automatisk skalering må brukere oppgi en policy for automatisk skalering som ber om gjennomstrømming per forekomst og maksimum og minimum forekomster. Innenfor policyen som er på plass, håndterer SageMaker automatisk arbeidsbelastningen for sanntidsendepunkter og bytter mellom forekomster ved behov.

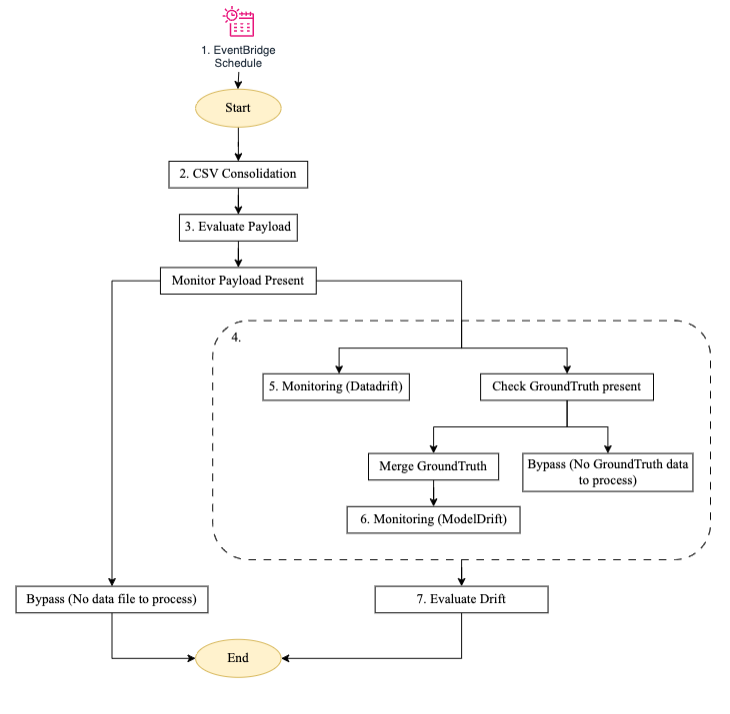

Tilpasset modell monitor pipeline

- Formål: Kundeteamet ønsket å ha automatisert modellovervåking for å fange opp både datadrift og modelldrift. Wipro-teamet brukte SageMaker-modellovervåking for å muliggjøre både datadrift og modelldrift med en gjenbrukbar pipeline for sanntidsslutninger og batchtransformasjon. Merk at under utviklingen av denne løsningen ga ikke SageMaker-modellovervåkingen mulighet for å oppdage data eller modelldrift for batchtransformasjon. Vi har implementert tilpasninger for å bruke modellovervåkingsbeholderen for batchtransformasjonsnyttelasten.

- Løsning: Wipro-teamet implementerte en gjenbrukbar modellovervåkingspipeline for sanntids- og batchslutningsnyttelaster ved å bruke AWS Lim for å fange opp den inkrementelle nyttelasten og starte modellovervåkingsjobben i henhold til den definerte tidsplanen.

Figur 7 – Modell monitor-trinnmaskin

Flytbeskrivelse for den tilpassede modellens monitorrørledning:

Rørledningen kjører i henhold til den definerte tidsplanen konfigurert gjennom EventBridge.

- CSV-konsolidering – Den bruker AWS Glue-bokmerkefunksjonen for å oppdage tilstedeværelsen av inkrementell nyttelast i den definerte S3-bøtten med sanntidsdatafangst og -respons og batchdatarespons. Den samler deretter disse dataene for videre behandling.

- Vurder nyttelast – Hvis det er inkrementelle data eller nyttelast tilstede for den gjeldende kjøringen, påkaller den overvåkingsgrenen. Ellers omgår den uten behandling og avslutter jobben.

- Etterbehandling – Overvåkingsgrenen er designet for å ha to parallelle undergrener – en for datadrift og en annen for modelldrift.

- Overvåking (datadrift) – Datadriftsgrenen kjører når det er en nyttelast tilstede. Den bruker de siste trente modellens grunnlinjebegrensninger og statistikkfiler generert gjennom opplæringspipelinen for datafunksjonene og kjører modellovervåkingsjobben.

- Overvåking (modelldrift) – Modelldriftsgrenen kjører bare når bakkesannhetsdata er levert, sammen med inferensnyttelasten. Den bruker opplærte modellgrunnlinjebegrensninger og statistikkfiler generert gjennom opplæringspipelinen for modellkvalitetsfunksjonene og kjører modellovervåkingsjobben.

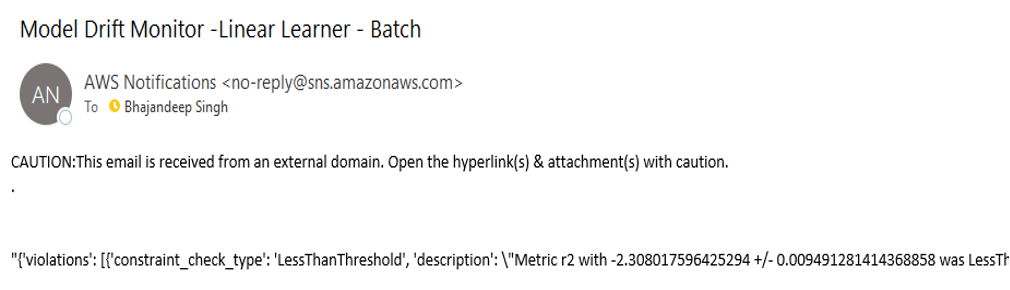

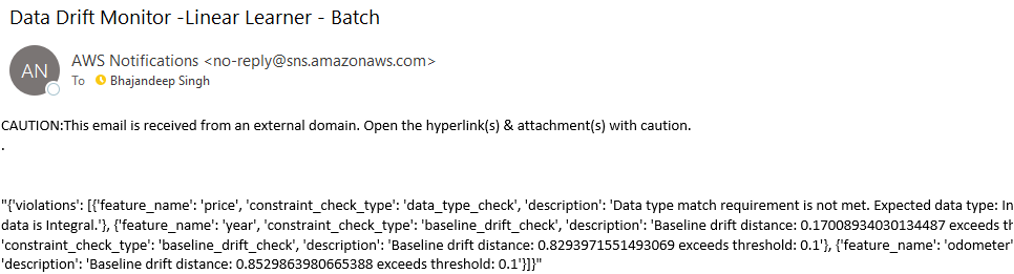

- Vurder drift – Utfallet av både data- og modelldrift er en begrensningsbruddfil som evalueres av evaluate drift Lambda-funksjonen som sender varsling til de respektive Amazon SNS-emnene med detaljer om driften. Driftsdata berikes ytterligere med tillegg av attributter for rapporteringsformål. Driftsvarslings-e-postene vil se ut som eksemplene i figur 8.

Figur 8 – Melding om data- og modelldrift

Figur 9 – Melding om data- og modelldrift

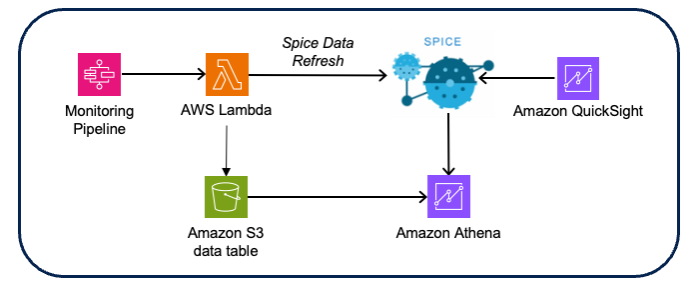

Innsikt med Amazon QuickSight-visualisering:

- Formål: Kunden ønsket å ha innsikt om dataene og modelldriften, relatere driftdataene til de respektive modellovervåkingsjobbene og finne ut slutningsdatatrendene for å forstå arten av interferensdatatrendene.

- Løsning: Wipro-teamet beriket driftdataene ved å koble inndata med driftresultatet, noe som muliggjør triage fra drift til overvåking og respektive scoringsdata. Visualiseringer og dashbord ble laget ved hjelp av Amazon QuickSight med Amazonas Athena som datakilde (ved hjelp av Amazon S3 CSV-scoring og driftdata).

Figur 10 – Modellovervåking visualiseringsarkitektur

Designhensyn:

- Bruk QuickSight-krydderdatasettet for bedre ytelse i minnet.

- Bruk QuickSight refresh dataset APIer for å automatisere krydderdataoppdateringen.

- Implementer gruppebasert sikkerhet for dashbord og analysetilgangskontroll.

- På tvers av kontoer, automatiser distribusjon ved å bruke eksport- og importdatasett, datakilde- og analyse-API-kall levert av QuickSight.

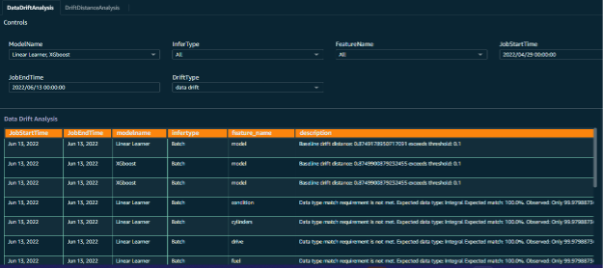

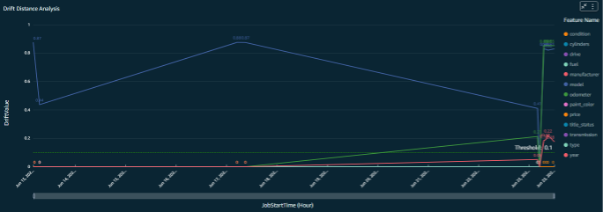

Modellovervåkingsdashbord:

For å muliggjøre et effektivt resultat og meningsfull innsikt i modellovervåkingsjobbene, ble det laget tilpassede dashboards for modellovervåkingsdataene. Inndatapunktene kombineres parallelt med slutningsforespørselsdata, jobbdata og overvåkingsutdata for å lage en visualisering av trender avslørt av modellovervåkingen.

Dette har virkelig hjulpet kundeteamet med å visualisere aspektene ved ulike datafunksjoner sammen med det forutsagte resultatet av hver gruppe slutningsforespørsler.

Figur 11 – Modellmonitor-dashbord med valgmeldinger

Figur 12 – Modellmonitor avdriftsanalyse

konklusjonen

Implementeringen forklart i dette innlegget gjorde det mulig for Wipro å effektivt migrere sine lokale modeller til AWS og bygge et skalerbart, automatisert modellutviklingsrammeverk.

Bruken av gjenbrukbare rammeverkskomponenter gir datavitenskapsteamet mulighet til å effektivt pakke arbeidet som distribuerbare AWS Step Functions JSON-komponenter. Samtidig brukte og forbedret DevOps-teamene den automatiserte CI/CD-pipelinen for å lette sømløs promotering og omskolering av modeller i høyere miljøer.

Modellovervåkingskomponenten har aktivert kontinuerlig overvåking av modellytelsen, og brukere mottar varsler og varsler hver gang data eller modelldrift oppdages.

Kundens team bruker dette MLOps-rammeverket for å migrere eller utvikle flere modeller og øke deres SageMaker-adopsjon.

Ved å utnytte den omfattende pakken med SageMaker-tjenester i forbindelse med vår omhyggelig utformede arkitektur, kan kundene sømløst integrere flere modeller, noe som reduserer distribusjonstiden betydelig og reduserer kompleksiteten forbundet med kodedeling. Arkitekturen vår forenkler dessuten vedlikehold av kodeversjon, og sikrer en strømlinjeformet utviklingsprosess.

Denne arkitekturen håndterer hele maskinlæringssyklusen, og omfatter automatisert modellopplæring, sanntids- og batchslutninger, proaktiv modellovervåking og driftanalyse. Denne ende-til-ende-løsningen gir kundene mulighet til å oppnå optimal modellytelse samtidig som den opprettholder strenge overvåkings- og analysefunksjoner for å sikre kontinuerlig nøyaktighet og pålitelighet.

For å lage denne arkitekturen, begynn med å lage viktige ressurser som Amazon Virtual Private Cloud (Amazon VPC), SageMaker bærbare PC-er og Lambda-funksjoner. Sørg for å sette opp riktig AWS Identity and Access Management (IAM) retningslinjer for disse ressursene.

Deretter fokuserer du på å bygge komponentene i arkitekturen – for eksempel opplæring og forbehandling av skript – i SageMaker Studio eller Jupyter Notebook. Dette trinnet innebærer å utvikle nødvendig kode og konfigurasjoner for å aktivere de ønskede funksjonene.

Etter at arkitekturens komponenter er definert, kan du fortsette med å bygge Lambda-funksjonene for å generere slutninger eller utføre etterbehandlingstrinn på dataene.

Til slutt bruker du trinnfunksjoner for å koble sammen komponentene og etablere en jevn arbeidsflyt som koordinerer kjøringen av hvert trinn.

Om forfatterne

Stephen Randolph er Senior Partner Solutions Architect hos Amazon Web Services (AWS). Han muliggjør og støtter Global Systems Integrator (GSI)-partnere med den nyeste AWS-teknologien når de utvikler industriløsninger for å løse forretningsutfordringer. Stephen er spesielt lidenskapelig opptatt av sikkerhet og generativ AI, og hjelper kunder og partnere med å bygge sikre, effektive og innovative løsninger på AWS.

Stephen Randolph er Senior Partner Solutions Architect hos Amazon Web Services (AWS). Han muliggjør og støtter Global Systems Integrator (GSI)-partnere med den nyeste AWS-teknologien når de utvikler industriløsninger for å løse forretningsutfordringer. Stephen er spesielt lidenskapelig opptatt av sikkerhet og generativ AI, og hjelper kunder og partnere med å bygge sikre, effektive og innovative løsninger på AWS.

Bhajandeep Singh har fungert som AWS AI/ML Center of Excellence Head hos Wipro Technologies, og ledet kundeengasjementer for å levere dataanalyse og AI-løsninger. Han har AWS AI/ML Specialty-sertifisering og forfatter tekniske blogger om AI/ML-tjenester og løsninger. Med erfaring med å lede AWS AI/ML-løsninger på tvers av bransjer, har Bhajandeep gjort det mulig for kunder å maksimere verdien av AWS AI/ML-tjenester gjennom sin ekspertise og lederskap.

Bhajandeep Singh har fungert som AWS AI/ML Center of Excellence Head hos Wipro Technologies, og ledet kundeengasjementer for å levere dataanalyse og AI-løsninger. Han har AWS AI/ML Specialty-sertifisering og forfatter tekniske blogger om AI/ML-tjenester og løsninger. Med erfaring med å lede AWS AI/ML-løsninger på tvers av bransjer, har Bhajandeep gjort det mulig for kunder å maksimere verdien av AWS AI/ML-tjenester gjennom sin ekspertise og lederskap.

Ajay Vishwakarma er en ML-ingeniør for AWS-fløyen til Wipros AI-løsningspraksis. Han har god erfaring med å bygge BYOM-løsning for tilpasset algoritme i SageMaker, ende-til-ende ETL-pipeline-distribusjon, bygge chatbots ved hjelp av Lex, Cross-account QuickSight-ressursdeling og bygge CloudFormation-maler for distribusjoner. Han liker å utforske AWS og tar ethvert kundeproblem som en utfordring for å utforske mer og gi løsninger på dem.

Ajay Vishwakarma er en ML-ingeniør for AWS-fløyen til Wipros AI-løsningspraksis. Han har god erfaring med å bygge BYOM-løsning for tilpasset algoritme i SageMaker, ende-til-ende ETL-pipeline-distribusjon, bygge chatbots ved hjelp av Lex, Cross-account QuickSight-ressursdeling og bygge CloudFormation-maler for distribusjoner. Han liker å utforske AWS og tar ethvert kundeproblem som en utfordring for å utforske mer og gi løsninger på dem.

- SEO-drevet innhold og PR-distribusjon. Bli forsterket i dag.

- PlatoData.Network Vertical Generative Ai. Styrk deg selv. Tilgang her.

- PlatoAiStream. Web3 Intelligence. Kunnskap forsterket. Tilgang her.

- PlatoESG. Karbon, CleanTech, Energi, Miljø, Solenergi, Avfallshåndtering. Tilgang her.

- PlatoHelse. Bioteknologisk og klinisk etterretning. Tilgang her.

- kilde: https://aws.amazon.com/blogs/machine-learning/modernizing-data-science-lifecycle-management-with-aws-and-wipro/

- : har

- :er

- $OPP

- 1

- 10

- 100

- 11

- 12

- 212

- 300

- 32

- 7

- 8

- 804

- 9

- a

- Om oss

- ovenfor

- akselerere

- akselerert

- akseleratorer

- adgang

- Ifølge

- Logg inn

- kontoer

- nøyaktighet

- Oppnå

- tvers

- Handling

- tillegg

- adressert

- adresser

- Legger

- Adopsjon

- mot

- aggregater

- AI

- AI / ML

- Varsler

- algoritme

- algoritmer

- allokert

- langs

- også

- Amazon

- Amazon API-gateway

- Amazon QuickSight

- Amazon Web Services

- Amazon Web Services (AWS)

- Amazon.com

- an

- analyse

- analytics

- og

- En annen

- noen

- api

- APIer

- Søknad

- søknader

- hensiktsmessig

- arkitektur

- ER

- AS

- aspekter

- assosiert

- At

- attributter

- forfattere

- auto

- automatisere

- Automatisert

- automatisk

- Automatisering

- tilgjengelighet

- tilgjengelig

- AWS

- AWS Lim

- AWS trinnfunksjoner

- tilbake

- basert

- Baseline

- BE

- ble

- fordi

- vært

- før du

- begynne

- være

- Fordeler

- BEST

- Bedre

- mellom

- Biggest

- blogger

- både

- Branch

- bringe

- brakte

- bygge

- Bygning

- bygget

- innebygd

- buss

- virksomhet

- men

- by

- ringer

- Samtaler

- CAN

- evner

- Kapasitet

- fangst

- bil

- saken

- sentrum

- Center of Excellence

- sertifisering

- utfordre

- utfordringer

- endring

- chatbots

- sjekk

- sjekket

- Sjekker

- kunde

- klienter

- Cloud

- kode

- Kodedeling

- samarbeide

- samarbeider

- samarbeid

- COM

- kombinasjon

- kombinert

- Kom

- kommer

- komfortabel

- forpliktet

- kompakt

- fullføre

- Terminado

- komplekse

- kompleksiteten

- komponent

- komponenter

- omfattende

- gjennomført

- Konfigurasjon

- konfigurert

- sammen

- Koble

- Tilkobling

- betraktninger

- begrensninger

- konsulenter

- konsulent

- Container

- kontinuerlig

- kontroll

- Kjerne

- Kostnad

- skape

- opprettet

- skaper

- Opprette

- skaperverket

- Kryss

- Gjeldende

- skikk

- kunde

- kundeopplevelse

- Kunder

- syklus

- dashbord

- oversikter

- dato

- Data Analytics

- datapunkter

- datavitenskap

- dataforsker

- datasett

- bestemme

- avgjørelse

- Beslutningstaking

- definert

- forsinkelser

- leverer

- levering

- avhengig

- utplassert

- distribusjon

- distribusjoner

- beskriver

- beskrivelse

- designet

- ønsket

- detaljer

- oppdage

- oppdaget

- utvikle

- utviklet

- utvikle

- Utvikling

- forskjellig

- Funnet

- diskutere

- do

- gjør

- stasjonen

- drevet

- under

- hver enkelt

- Tidligere

- Effektiv

- effektivt

- effektivitet

- effektiv

- innsats

- emalje

- e-post

- bemyndiger

- muliggjøre

- aktivert

- muliggjør

- altomfattende

- slutt

- ende til ende

- Endpoint

- engasjement

- engasjementer

- ingeniør

- Ingeniørarbeid

- forbedret

- berike

- anriket

- sikre

- sikrer

- Enterprise

- Hele

- Miljø

- miljøer

- spesielt

- avgjørende

- etablere

- evaluere

- evaluert

- Event

- hendelser

- etter hvert

- Hver

- undersøke

- eksempler

- Excellence

- finnes

- utganger

- forventninger

- fremskynde

- erfaring

- eksperiment

- ekspertise

- forklarte

- utforske

- Utforske

- eksportere

- eksporten

- Face

- møtt

- legge til rette

- mislykkes

- Failure

- raskere

- Trekk

- Egenskaper

- Noen få

- Figur

- filet

- Filer

- filtrere

- Finn

- Først

- flyten

- Fokus

- etter

- Til

- Rammeverk

- rammer

- fra

- fullt

- funksjon

- funksjonalitet

- funksjonalitet

- funksjoner

- videre

- gateway

- generere

- generert

- genererer

- generasjonen

- generative

- Generativ AI

- få

- GitHub

- Global

- god

- styresett

- styrt

- Ground

- HAD

- Håndterer

- Utnyttelse

- Ha

- he

- hode

- hjelpe

- hjulpet

- hjelpe

- hjelper

- Høy

- høyere

- hans

- holder

- Hvordan

- HTML

- HTTPS

- Innstilling av hyperparameter

- Identitet

- if

- bilde

- gjennomføring

- implementert

- implementere

- redskaper

- importere

- in

- inkludert

- inkluderer

- Inkludert

- Øke

- øker

- inkrementell

- bransjer

- industri

- Infrastruktur

- initiere

- innovative

- inngang

- innganger

- innsikt

- f.eks

- integrert

- Integrering

- integrering

- Intelligens

- Forstyrrelser

- inn

- påkaller

- involvere

- isolert

- saker

- IT

- Jobb

- Jobb

- bli medlem

- reise

- JSON

- nøkkel

- siste

- lansere

- lansert

- lag

- Ledelse

- ledende

- lærer

- læring

- Nivå

- Livssyklus

- i likhet med

- liker

- lokal

- plassering

- logikk

- Se

- UTSEENDE

- Lav

- maskin

- maskinlæring

- Vedlike

- vedlikehold

- gjøre

- Making

- administrer

- fikk til

- ledelse

- leder

- administrerende

- mange

- Maksimer

- maksimal

- Kan..

- meningsfylt

- medium

- Møt

- medlemmer

- metode

- omhyggelig

- metrisk

- Metrics

- kunne

- migrere

- migrasjon

- minimum

- formildende

- ML

- MLOps

- modell

- modeller

- Moderne

- modernisering

- Overvåke

- overvåking

- mer

- Videre

- mye

- flere

- må

- navn

- Natur

- nødvendig

- Trenger

- nødvendig

- behov

- Ny

- neste

- note

- bærbare

- varsling

- varslinger

- of

- tilbud

- on

- Ombord

- ONE

- pågående

- bare

- åpen

- åpen kildekode

- operasjonell

- optimal

- or

- organisasjoner

- Annen

- ellers

- vår

- ut

- Utfallet

- produksjon

- samlet

- egen

- Fred

- pakke

- Parallel

- parameter

- parametere

- partner

- partnere

- passerer

- lidenskapelig

- for

- Utfør

- ytelse

- utfører

- rørledning

- Sted

- plato

- Platon Data Intelligence

- PlatonData

- poeng

- Politikk

- politikk

- portefølje

- Post

- praksis

- forut

- spådd

- prediksjon

- Spådommer

- premier

- forberedt

- tilstedeværelse

- presentere

- forrige

- pris

- Pris prediksjon

- privat

- Proaktiv

- Problem

- fortsette

- prosess

- prosessering

- produktivitet

- forfremmelse

- ledetekster

- gi

- forutsatt

- leverandør

- gir

- forsyning

- formål

- Skyv

- presset

- kvalitet

- Lesning

- sanntids

- sanntidsdata

- virkelig

- motta

- redusere

- referanse

- registrert

- registrering

- registret

- slipp

- pålitelighet

- forble

- Rapportering

- Repository

- anmode

- forespørsler

- påkrevd

- Krav

- ressurs

- Ressurser

- de

- svar

- resultere

- Resultater

- gjenbruk

- Avslørt

- streng

- robust

- ruter

- Kjør

- rennende

- går

- sagemaker

- samme

- skalerbarhet

- skalerbar

- Skala

- skalering

- planlegge

- Vitenskap

- Forsker

- forskere

- scoring

- skript

- SDK

- sømløs

- sømløst

- Seksjon

- sikre

- sikkerhet

- utvalg

- sender

- senior

- sendt

- servert

- server~~POS=TRUNC

- tjeneste

- Tjenesteyter

- Tjenester

- sett

- innstilling

- oppsett

- Del

- deling

- bør

- vist

- betydelig

- lignende

- Enkelt

- forenkler

- samtidig

- liten

- glatter

- løsning

- Solutions

- LØSE

- snart

- kilde

- Spesialitet

- spesielt

- krydder

- splittet

- stable

- Stabler

- Tilstand

- statisk

- statistikk

- stats

- status

- Trinn

- Stephen

- Steps

- lagring

- oppbevare

- lagret

- lagring

- strømlinjeformet

- effektiviserer

- studio

- suksess

- slik

- suite

- medfølgende

- støtte

- Støtter

- sikker

- Systemer

- Ta

- tar

- ta

- Target

- oppgaver

- lag

- Lag medlemmer

- lag

- Teknisk

- teknikk

- Technologies

- Teknologi

- maler

- test

- Det

- De

- Staten

- deres

- Dem

- deretter

- Der.

- Disse

- de

- tredjeparts

- denne

- De

- terskel

- Gjennom

- gjennomstrømning

- nivået

- tett

- tid

- til

- også

- verktøy

- verktøy

- Tema

- temaer

- mot

- Tog

- trent

- Kurs

- Togene

- Transformation

- transformasjoner

- Trender

- utløst

- Sannhet

- tuning

- to

- typen

- typer

- forstå

- Oppdater

- oppdateringer

- oppdatering

- bruke

- bruk sak

- brukt

- Brukere

- bruker

- ved hjelp av

- VALIDERE

- validere

- validering

- verdi

- ulike

- versjon

- versjoner

- BRUDD

- virtuelle

- visualisering

- visualisere

- ønsket

- var

- Vei..

- we

- web

- webtjenester

- VI VIL

- veldefinerte

- var

- når

- når som helst

- om

- hvilken

- mens

- vil

- fløy

- med

- innenfor

- uten

- Arbeid

- arbeidet

- arbeidsflyt

- arbeidsflyt

- verksted

- skriving

- skrevet

- Xgboost

- Du

- Din

- zephyrnet