Verden av kunstig intelligens (AI) og maskinlæring (ML) har vært vitne til et paradigmeskifte med fremveksten av generative AI-modeller som kan lage menneskelignende tekst, bilder, kode og lyd. Sammenlignet med klassiske ML-modeller er generative AI-modeller betydelig større og mer komplekse. Deres økende kompleksitet kommer imidlertid også med høye kostnader for slutninger og et økende behov for kraftige dataressurser. De høye kostnadene ved slutninger for generative AI-modeller kan være en adgangsbarriere for bedrifter og forskere med begrensede ressurser, noe som nødvendiggjør behovet for mer effektive og kostnadseffektive løsninger. Videre involverer flertallet av generative AI-brukstilfeller menneskelig interaksjon eller virkelige scenarier, noe som krever maskinvare som kan levere ytelse med lav latens. AWS har innovert med spesialbygde brikker for å møte det økende behovet for kraftig, effektiv og kostnadseffektiv datamaskinvare.

I dag er vi glade for å kunngjøre det Amazon SageMaker støtter AWS Inferentia2 (ml.inf2) og AWS Trainium (ml.trn1) baserte SageMaker-instanser for å være vertskap for generative AI-modeller for sanntids og asynkron slutning. ml.inf2-forekomster er tilgjengelige for modelldistribusjon på SageMaker i østlige USA (Ohio) og ml.trn1-forekomster i østlige USA (N. Virginia).

Du kan bruke disse forekomstene på SageMaker for å oppnå høy ytelse til en lav kostnad for generative AI-modeller, inkludert store språkmodeller (LLM), stabil diffusjon og synstransformatorer. I tillegg kan du bruke Amazon SageMaker Inference Recommender for å hjelpe deg med å kjøre belastningstester og evaluere pris-ytelsesfordelene ved å distribuere modellen din på disse forekomstene.

Du kan bruke ml.inf2- og ml.trn1-forekomster til å kjøre ML-applikasjonene dine på SageMaker for tekstoppsummering, kodegenerering, video- og bildegenerering, talegjenkjenning, personalisering, svindeldeteksjon og mer. Du kan enkelt komme i gang ved å spesifisere ml.trn1- eller ml.inf2-forekomster når du konfigurerer SageMaker-endepunktet. Du kan bruke ml.trn1 og ml.inf2-kompatible AWS Deep Learning Containers (DLC) for PyTorch, TensorFlow, Hugging Face og large model inference (LMI) for å enkelt komme i gang. For hele listen med versjoner, se Tilgjengelige bilder av Deep Learning Containers.

I dette innlegget viser vi prosessen med å distribuere en stor språkmodell på AWS Inferentia2 ved å bruke SageMaker, uten å kreve noen ekstra koding, ved å dra nytte av LMI-beholderen. Vi bruker GPT4ALL-J, en finjustert GPT-J 7B-modell som gir interaksjon i chatbot-stil.

Oversikt over ml.trn1- og ml.inf2-forekomster

ml.trn1-forekomster drives av Trainium-akseleratoren, som er spesialbygd hovedsakelig for høyytelses dyplæringstrening av generative AI-modeller, inkludert LLM-er. Imidlertid støtter disse forekomstene også slutningsarbeidsbelastninger for modeller som er enda større enn det som passer inn i Inf2. Den største forekomststørrelsen, trn1.32xlarge forekomster, har 16 Trainium akseleratorer med 512 GB akseleratorminne i en enkelt forekomst som leverer opptil 3.4 petaflops FP16/BF16-datakraft. 16 Trainium-akseleratorer er koblet til ultra-høyhastighets NeuronLinkv2 for strømlinjeformet kollektiv kommunikasjon.

ml.Inf2-forekomster drives av AWS Inferentia2 akselerator, en spesialbygd akselerator for slutninger. Den leverer tre ganger høyere dataytelse, opptil fire ganger høyere gjennomstrømning og opptil 10 ganger lavere ventetid sammenlignet med førstegenerasjons AWS Inferentia. Den største forekomststørrelsen, Inf2.48xlarge, har 12 AWS Inferentia2-akseleratorer med 384 GB akseleratorminne i en enkelt forekomst for en kombinert regnekraft på 2.3 petaflops for BF16/FP16. Den lar deg distribuere opptil en modell med 175 milliarder parametere i en enkelt forekomst. Inf2 er den eneste inferensoptimaliserte forekomsten som tilbyr denne sammenkoblingen, en funksjon som kun er tilgjengelig i dyrere treningstilfeller. For ultrastore modeller som ikke passer inn i en enkelt akselerator, flyter data direkte mellom akseleratorer med NeuronLink, og omgår CPU-en fullstendig. Med NeuronLink støtter Inf2 raskere distribuert inferens og forbedrer gjennomstrømning og latens.

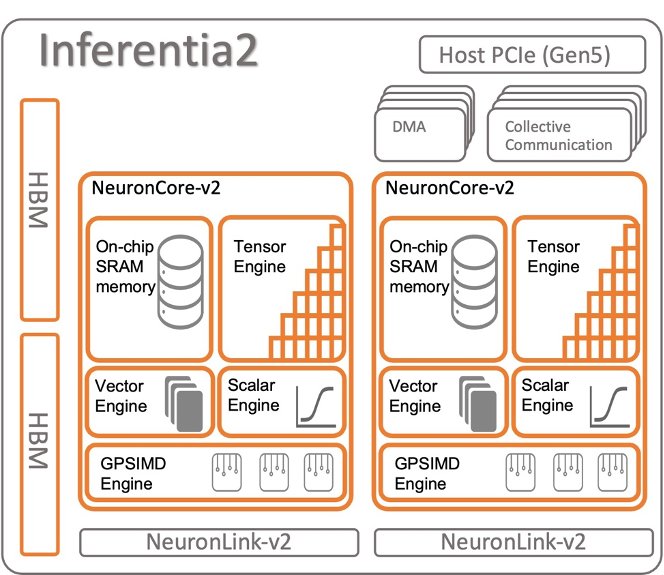

Både AWS Inferentia2 og Trainium akseleratorer har to NeuronCores-v2, 32 GB HBM-minnestabler og dedikerte motorer for kollektiv databehandling, som automatisk optimaliserer kjøretiden ved å overlappe beregning og kommunikasjon når du gjør multi-akselerator-slutninger. For flere detaljer om arkitekturen, se Trainium og Inferentia enheter.

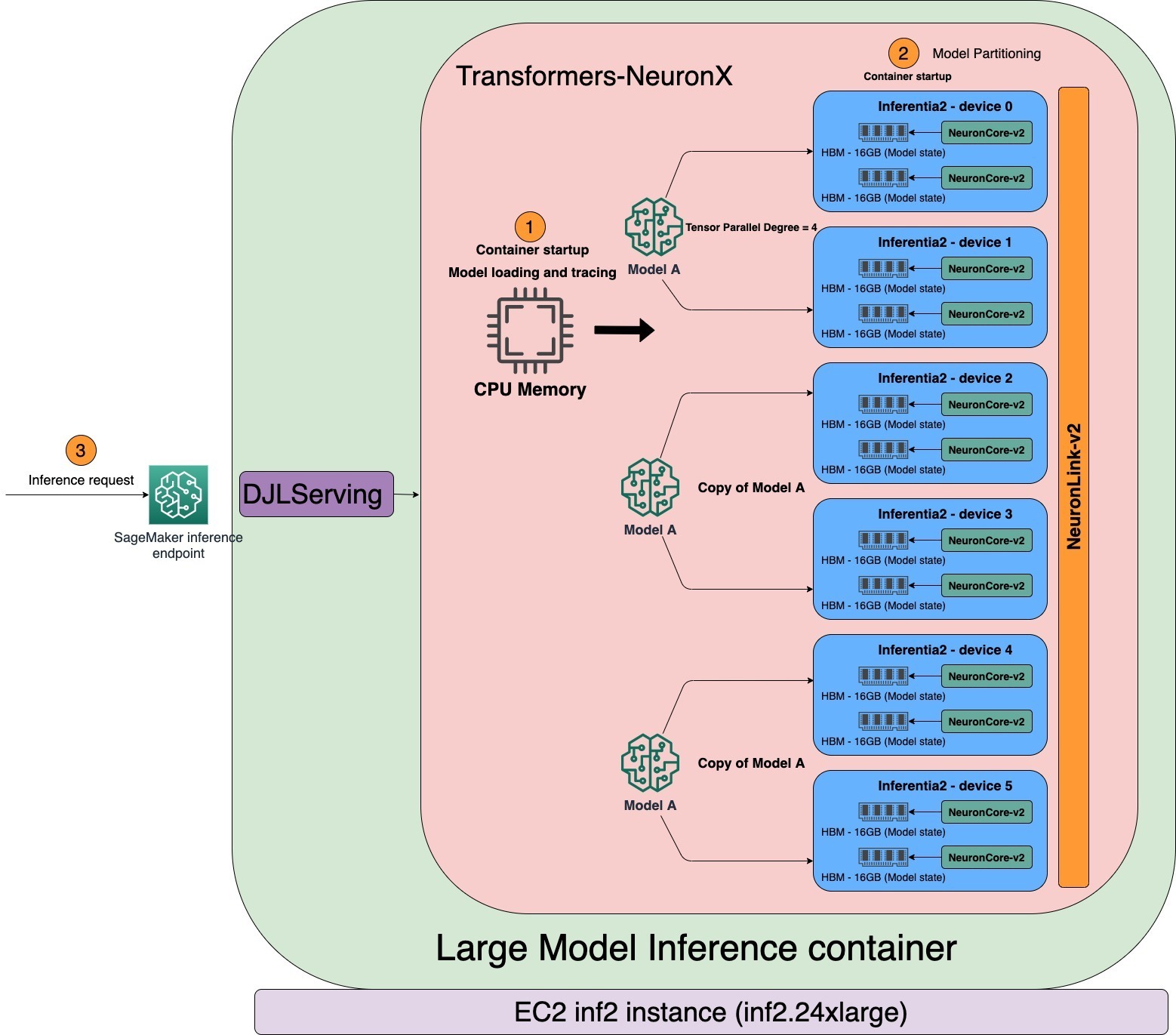

Følgende diagram viser en eksempelarkitektur som bruker AWS Inferentia2.

AWS Neuron SDK

AWS nevron er SDK-en som brukes til å kjøre arbeidsbelastninger for dyp læring på AWS Inferentia- og Trainium-baserte forekomster. AWS Neuron inkluderer en kompilator for dyp læring, kjøretid og verktøy som er integrert i TensorFlow og PyTorch. Med Neuron kan du utvikle, profilere og distribuere høyytelses ML-arbeidsbelastninger på ml.trn1 og ml.inf2.

De Nevron kompilator aksepterer ML-modeller i ulike formater (TensorFlow, PyTorch, XLA HLO) og optimerer dem for å kjøre på Neuron-enheter. Neuron-kompilatoren påkalles innenfor ML-rammeverket, der ML-modeller sendes til kompilatoren av Neuron-rammeverk-plugin. Den resulterende kompilatorartefakten kalles en NEFF-fil (Neuron Executable File Format) som igjen lastes av Neuron-kjøretiden til Neuron-enheten.

De Neuron kjøretid består av kjernedriver- og C/C++-biblioteker, som gir APIer for tilgang til AWS Inferentia- og Trainium Neuron-enheter. Neuron ML-rammeverk-pluginene for TensorFlow og PyTorch bruker Neuron-kjøretiden til å laste og kjøre modeller på NeuronCores. Neuron runtime laster kompilerte dyplæringsmodeller (NEFF) til Neuron-enhetene og er optimert for høy gjennomstrømning og lav latenstid.

Vert NLP-modeller som bruker SageMaker ml.inf2-forekomster

Før vi dykker dypt inn i å servere LLM med transformatorer-neuronx, som er et åpen kildekode-bibliotek for å skjære modellens store vektmatriser på flere NeuronCores, la oss kort gå gjennom den typiske distribusjonsflyten for en modell som kan passe inn på den enkelt NeuronCore.

Sjekk liste over støttede modeller for å sikre at modellen støttes på AWS Inferentia2. Deretter må modellen forhåndskompileres av Neuron Compiler. Du kan bruke en SageMaker notatbok eller en Amazon Elastic Compute Cloud (Amazon EC2) forekomst for å kompilere modellen. Du kan bruke SageMaker Python SDK til å distribuere modeller ved å bruke populære dyplæringsrammeverk som PyTorch, som vist i følgende kode. Du kan distribuere modellen din til SageMaker-vertstjenester og få et endepunkt som kan brukes til slutninger. Disse endepunktene er fullstendig administrert og støtter automatisk skalering.

Referere til Utviklerflyter for mer informasjon om typiske utviklingsflyter av Inf2 på SageMaker med eksempelskript.

Vert LLM-er som bruker SageMaker ml.inf2-forekomster

Store språkmodeller med milliarder av parametere er ofte for store til å passe på en enkelt akselerator. Dette nødvendiggjør bruk av modellparallelle teknikker for hosting av LLM-er på tvers av flere akseleratorer. Et annet avgjørende krav for å være vert for LLM-er er implementeringen av en modellserveringsløsning med høy ytelse. Denne løsningen skal effektivt laste modellen, administrere partisjonering og sømløst betjene forespørsler via HTTP-endepunkter.

SageMaker inkluderer spesialiserte dyplæringsbeholdere (DLC), biblioteker og verktøy for modellparallellisme og stor modellslutning. For ressurser for å komme i gang med LMI på SageMaker, se Modellparallellisme og stor modellslutning. SageMaker vedlikeholder DLC-er med populære åpen kildekode-biblioteker for hosting av store modeller som GPT, T5, OPT, BLOOM og Stable Diffusion på AWS-infrastruktur. Disse spesialiserte DLC-ene blir referert til som SageMaker LMI-beholdere.

SageMaker LMI containere bruk DJLServing, en modellserver som er integrert med transformers-neuronx-biblioteket for å støtte tensorparallellisme på tvers av NeuronCores. For å lære mer om hvordan DJLServing fungerer, se Distribuer store modeller på Amazon SageMaker ved å bruke DJLServing og DeepSpeed modell parallell inferens. DJL-modellserveren og transformers-neuronx-biblioteket fungerer som kjernekomponenter i beholderen, som også inkluderer Neuron SDK. Dette oppsettet letter lasting av modeller på AWS Inferentia2-akseleratorer, parallelliserer modellen på tvers av flere NeuronCores, og muliggjør servering via HTTP-endepunkter.

LMI-beholderen støtter lasting av modeller fra en Amazon enkel lagringstjeneste (Amazon S3) bøtte eller Hugging Face Hub. Standard handlerskript laster modellen, kompilerer og konverterer den til et Neuron-optimalisert format, og laster den. For å bruke LMI-beholderen til å være vert for LLM-er, har vi to alternativer:

- En ingen kode (foretrukket) – Dette er den enkleste måten å distribuere en LLM ved å bruke en LMI-beholder. I denne metoden kan du bruke den medfølgende standardbehandler og bare send inn modellnavnet og parametrene som kreves

serving.propertiesfil for å laste og være vert for modellen. For å bruke standardbehandleren gir vientryPointparameter somdjl_python.transformers-neuronx. - Ta med eget manus – I denne tilnærmingen har du muligheten til å lage din egen model.py-fil, som inneholder koden som er nødvendig for å laste og betjene modellen. Denne filen fungerer som et mellomledd mellom

DJLServingAPIer ogtransformers-neuronxAPIer. For å tilpasse modellen lasteprosessen, kan du giserving.propertiesmed konfigurerbare parametere. For en omfattende liste over tilgjengelige konfigurerbare parametere, se Alle DJL-konfigurasjonsalternativer. Her er et eksempel på en modell.py filen.

Kjøretidsarkitektur

De tensor_parallel_degree egenskapsverdi bestemmer fordelingen av tensorparallelle moduler over flere NeuronCores. For eksempel har inf2.24xlarge seks AWS Inferentia2-akseleratorer. Hver AWS Inferentia2-akselerator har to NeuronCores. Hver NeuronCore har et dedikert minne med høy båndbredde (HBM) på 16 GB som lagrer parallelle tensormoduler. Med en tensorparallellgrad på 4 vil LMI tildele tre modellkopier av samme modell, som hver bruker fire NeuronCores. Som vist i følgende diagram, når LMI-beholderen starter, vil modellen lastes inn og spores først i CPU-adresserbart minne. Når sporingen er fullført, blir modellen partisjonert over NeuronCores basert på tensorparallellgraden.

LMI bruker DJLServing som sin modellserveringsstabel. Etter at beholderens helsesjekk er bestått i SageMaker, er beholderen klar til å betjene slutningsforespørselen. DJLServing lanserer flere Python-prosesser tilsvarende TOTAL NUMBER OF NEURON CORES/TENSOR_PARALLEL_DEGREE. Hver Python-prosess inneholder tråder i C++ tilsvarende TENSOR_PARALLEL_DEGREE. Hver C++-tråd holder ett skår av modellen på en NeuronCore.

Mange utøvere (Python-prosessen) har en tendens til å kjøre inferens sekvensielt når serveren påkalles med flere uavhengige forespørsler. Selv om det er enklere å sette opp, er det vanligvis ikke den beste praksisen å bruke akseleratorens datakraft. For å løse dette tilbyr DJLServing de innebygde optimaliseringene av dynamisk batching for å kombinere disse uavhengige slutningsforespørslene på serversiden for å danne en større batch dynamisk for å øke gjennomstrømningen. Alle forespørslene når først den dynamiske batcheren før de går inn i de faktiske jobbkøene for å vente på konklusjon. Du kan angi dine foretrukne batchstørrelser for dynamisk batching ved å bruke batch_size innstillinger i serving.properties. Du kan også konfigurere max_batch_delay for å spesifisere maksimal forsinkelsestid i batcheren for å vente på andre forespørsler om å bli med i batchen basert på dine latenskrav. Gjennomstrømningen avhenger også av antall modellkopier og Python-prosessgruppene som er lansert i beholderen. Som vist i det følgende diagrammet, med tensorparallellgraden satt til 4, starter LMI-beholderen tre Python-prosessgrupper, som hver inneholder hele kopien av modellen. Dette lar deg øke batchstørrelsen og få høyere gjennomstrømning.

SageMaker notatbok for distribusjon av LLM-er

I denne delen gir vi en trinnvis gjennomgang av distribusjon av GPT4All-J, en modell med 6 milliarder parametere som er 24 GB i FP32. GPT4All-J er en populær chatbot som har blitt trent på et stort utvalg av interaksjonsinnhold som ordproblemer, dialogbokser, kode, dikt, sanger og historier. GPT4all-J er en finjustert GPT-J-modell som genererer svar som ligner på menneskelig interaksjon.

Den komplette notatboken for dette eksemplet er gitt på GitHub. Vi kan bruke SageMaker Python SDK for å distribuere modellen til en Inf2-instans. Vi bruker det oppgitte standardbehandler for å laste modellen. Med dette trenger vi bare å gi en porsjoner.egenskaper fil. Denne filen har de nødvendige konfigurasjonene for at DJL-modellserveren skal laste ned og være vert for modellen. Vi kan spesifisere navnet på Hugging Face-modellen ved å bruke model_id parameter for å laste ned modellen direkte fra Hugging Face-repoen. Alternativt kan du laste ned modellen fra Amazon S3 ved å tilby s3url parameter. De entryPoint parameteren er konfigurert til å peke til biblioteket for å laste modellen. For mer informasjon om djl_python.fastertransformer, referere til GitHub-kode.

De tensor_parallel_degree egenskapsverdi bestemmer fordelingen av tensorparallelle moduler på tvers av flere enheter. For eksempel, med 12 NeuronCores og en tensor parallellgrad på 4, vil LMI tildele tre modelleksemplarer, som hver bruker fire NeuronCores. Du kan også definere presisjonstypen ved å bruke egenskapen dtype. n_position parameter definerer summen av maks inngangs- og utgangssekvenslengde for modellen. Se følgende kode:

Konstruer tarball inneholder serving.properties og last den opp til en S3-bøtte. Selv om standardbehandleren brukes i dette eksemplet, kan du utvikle en model.py fil for å tilpasse laste- og serveringsprosessen. Hvis det er noen pakker som trenger installasjon, inkluderer du dem i requirements.txt fil. Se følgende kode:

Hent DJL-beholderbildet og lag SageMaker-modellen:

Deretter oppretter vi SageMaker-endepunktet med modellkonfigurasjonen definert tidligere. Beholderen laster ned modellen til /tmp plass fordi SageMaker kartlegger /tmp til Amazon Elastic Block Store (Amazon EBS). Vi må legge til en volume_size parameter for å sikre /tmp katalogen har nok plass til å laste ned og kompilere modellen. Vi setter container_startup_health_check_timeout til 3,600 sekunder for å sikre at helsesjekken starter etter at modellen er klar. Vi bruker ml.inf2.8xlarge-forekomsten. Se følgende kode:

Etter at SageMaker-endepunktet er opprettet, kan vi lage sanntidsprediksjoner mot SageMaker-endepunkter ved å bruke Predictor gjenstand:

Rydd opp

Slett endepunktene for å spare kostnader etter at du har fullført testene:

konklusjonen

I dette innlegget viste vi frem den nylig lanserte muligheten til SageMaker, som nå støtter ml.inf2- og ml.trn1-forekomster for hosting av generative AI-modeller. Vi demonstrerte hvordan du distribuerer GPT4ALL-J, en generativ AI-modell, på AWS Inferentia2 ved å bruke SageMaker og LMI-beholderen, uten å skrive noen kode. Vi viste også frem hvordan du kan bruke DJLServing og transformers-neuronx for å laste en modell, partisjonere den og tjene.

Inf2-forekomster gir den mest kostnadseffektive måten å kjøre generative AI-modeller på AWS. For ytelsesdetaljer, se Inf2 ytelse.

Sjekk ut GitHub repo for en eksempelnotisbok. Prøv det og gi oss beskjed hvis du har spørsmål!

Om forfatterne

Vivek Gangasani er Senior Machine Learning Solutions Architect hos Amazon Web Services. Han jobber med Machine Learning Startups for å bygge og distribuere AI/ML-applikasjoner på AWS. Han er for tiden fokusert på å levere løsninger for MLOps, ML Inference og lavkode ML. Han har jobbet med prosjekter innen forskjellige domener, inkludert Natural Language Processing og Computer Vision.

Vivek Gangasani er Senior Machine Learning Solutions Architect hos Amazon Web Services. Han jobber med Machine Learning Startups for å bygge og distribuere AI/ML-applikasjoner på AWS. Han er for tiden fokusert på å levere løsninger for MLOps, ML Inference og lavkode ML. Han har jobbet med prosjekter innen forskjellige domener, inkludert Natural Language Processing og Computer Vision.

Hiroshi Tokoyo er løsningsarkitekt ved AWS Annapurna Labs. Basert i Japan begynte han i Annapurna Labs allerede før oppkjøpet av AWS og har konsekvent hjulpet kunder med Annapurna Labs-teknologi. Hans nylige fokus er på maskinlæringsløsninger basert på spesialbygd silisium, AWS Inferentia og Trainium.

Hiroshi Tokoyo er løsningsarkitekt ved AWS Annapurna Labs. Basert i Japan begynte han i Annapurna Labs allerede før oppkjøpet av AWS og har konsekvent hjulpet kunder med Annapurna Labs-teknologi. Hans nylige fokus er på maskinlæringsløsninger basert på spesialbygd silisium, AWS Inferentia og Trainium.

Dhawal Patel er en hovedmaskinlæringsarkitekt ved AWS. Han har jobbet med organisasjoner som spenner fra store bedrifter til mellomstore startups med problemer knyttet til distribuert databehandling og kunstig intelligens. Han fokuserer på dyp læring inkludert NLP- og Computer Vision-domener. Han hjelper kundene med å oppnå høy ytelse modellslutning på SageMaker.

Dhawal Patel er en hovedmaskinlæringsarkitekt ved AWS. Han har jobbet med organisasjoner som spenner fra store bedrifter til mellomstore startups med problemer knyttet til distribuert databehandling og kunstig intelligens. Han fokuserer på dyp læring inkludert NLP- og Computer Vision-domener. Han hjelper kundene med å oppnå høy ytelse modellslutning på SageMaker.

Qing Lan er en programvareutviklingsingeniør i AWS. Han har jobbet med flere utfordrende produkter i Amazon, inkludert høyytelses ML-slutningsløsninger og høyytelses loggingssystem. Qings team lanserte den første milliardparametermodellen i Amazon Advertising med svært lav ventetid. Qing har inngående kunnskap om infrastrukturoptimalisering og Deep Learning-akselerasjon.

Qing Lan er en programvareutviklingsingeniør i AWS. Han har jobbet med flere utfordrende produkter i Amazon, inkludert høyytelses ML-slutningsløsninger og høyytelses loggingssystem. Qings team lanserte den første milliardparametermodellen i Amazon Advertising med svært lav ventetid. Qing har inngående kunnskap om infrastrukturoptimalisering og Deep Learning-akselerasjon.

Qingwei Li er maskinlæringsspesialist hos Amazon Web Services. Han fikk sin doktorgrad. i Operations Research etter at han brøt sin rådgivers forskningsbevilgningskonto og ikke klarte å levere Nobelprisen han lovet. For tiden hjelper han kunder i finans- og forsikringsbransjen med å bygge maskinlæringsløsninger på AWS. På fritiden liker han å lese og undervise.

Qingwei Li er maskinlæringsspesialist hos Amazon Web Services. Han fikk sin doktorgrad. i Operations Research etter at han brøt sin rådgivers forskningsbevilgningskonto og ikke klarte å levere Nobelprisen han lovet. For tiden hjelper han kunder i finans- og forsikringsbransjen med å bygge maskinlæringsløsninger på AWS. På fritiden liker han å lese og undervise.

Alan Tan er en senior produktsjef med SageMaker som leder innsatsen for store modellslutninger. Han brenner for å bruke maskinlæring på området Analytics. Utenom jobben liker han å være ute.

Alan Tan er en senior produktsjef med SageMaker som leder innsatsen for store modellslutninger. Han brenner for å bruke maskinlæring på området Analytics. Utenom jobben liker han å være ute.

Varun Syal er en programvareutviklingsingeniør med AWS Sagemaker som jobber med kritiske kundevendte funksjoner for ML Inference-plattformen. Han brenner for å jobbe i distribuerte systemer og AI-området. På fritiden liker han lesing og hagearbeid.

Varun Syal er en programvareutviklingsingeniør med AWS Sagemaker som jobber med kritiske kundevendte funksjoner for ML Inference-plattformen. Han brenner for å jobbe i distribuerte systemer og AI-området. På fritiden liker han lesing og hagearbeid.

- SEO-drevet innhold og PR-distribusjon. Bli forsterket i dag.

- PlatoAiStream. Web3 Data Intelligence. Kunnskap forsterket. Tilgang her.

- Minting the Future med Adryenn Ashley. Tilgang her.

- Kjøp og selg aksjer i PRE-IPO-selskaper med PREIPO®. Tilgang her.

- kilde: https://aws.amazon.com/blogs/machine-learning/achieve-high-performance-with-lowest-cost-for-generative-ai-inference-using-aws-inferentia2-and-aws-trainium-on-amazon-sagemaker/

- : har

- :er

- :ikke

- :hvor

- $OPP

- 10

- 100

- 12

- 13

- 14

- 15%

- 22

- 24

- 7

- 8

- 9

- a

- Om oss

- akselerator

- akseleratorer

- godtar

- adgang

- Logg inn

- Oppnå

- oppkjøp

- tvers

- handlinger

- legge til

- tillegg

- adresse

- adresser

- Fordel

- Annonsering

- Etter

- mot

- AI

- ai brukstilfeller

- AI / ML

- Alle

- tillater

- også

- Selv

- Amazon

- Amazon EC2

- Amazon SageMaker

- Amazon Web Services

- an

- analytics

- og

- Kunngjøre

- En annen

- noen

- APIer

- søknader

- påføring

- tilnærming

- arkitektur

- ER

- AREA

- kunstig

- kunstig intelligens

- Kunstig intelligens (AI)

- AS

- At

- lyd

- auto

- automatisk

- tilgjengelig

- AWS

- AWS slutning

- ball

- Båndbredde

- barriere

- basert

- BE

- fordi

- vært

- før du

- Fordeler

- BEST

- mellom

- Stor

- større

- milliarder

- Blokker

- Blogg

- Bloom

- kort

- Broke

- bygge

- bygget

- innebygd

- bedrifter

- by

- C + +

- som heter

- CAN

- saker

- utfordrende

- chatbot

- sjekk

- chips

- kode

- Koding

- Collective

- kombinere

- kombinert

- kommer

- Kommunikasjon

- kommunikasjon

- sammenlignet

- kompatibel

- fullføre

- helt

- komplekse

- kompleksitet

- komponenter

- omfattende

- beregningen

- Beregn

- datamaskin

- Datamaskin syn

- databehandling

- Konfigurasjon

- tilkoblet

- Container

- Containere

- inneholder

- innhold

- Kjerne

- Kostnad

- kostnadseffektiv

- Kostnader

- skape

- opprettet

- kritisk

- avgjørende

- I dag

- kunde

- Kunder

- tilpasse

- dato

- dedikert

- dyp

- dyp læring

- Misligholde

- definert

- definerer

- Grad

- forsinkelse

- leverer

- levere

- leverer

- demonstrert

- avhenger

- utplassere

- utplasserings

- distribusjon

- detaljer

- Gjenkjenning

- bestemmes

- utvikle

- Utvikling

- enhet

- Enheter

- forskjellig

- kringkasting

- direkte

- distribueres

- distribuert databehandling

- distribuerte systemer

- distribusjon

- gjør

- domener

- ikke

- nedlasting

- nedlastinger

- sjåfør

- dynamisk

- dynamisk

- hver enkelt

- Tidligere

- enklere

- enkleste

- lett

- øst

- effektiv

- effektivt

- innsats

- muliggjør

- slutt

- Endpoint

- ingeniør

- Motorer

- nok

- sikre

- går inn

- bedrifter

- entry

- Tilsvarende

- evaluere

- Selv

- eksempel

- opphisset

- dyrt

- ekstra

- Face

- forenkler

- vendt

- Mislyktes

- raskere

- Trekk

- Egenskaper

- filet

- finansiell

- økonomiske tjenester

- ferdig

- Først

- passer

- flyten

- Flows

- Fokus

- fokuserte

- fokuserer

- etter

- Til

- skjema

- format

- fire

- Rammeverk

- rammer

- svindel

- svindeloppdagelse

- fra

- fullt

- fullt

- Dess

- genererer

- generasjonen

- generative

- Generativ AI

- få

- Go

- innvilge

- Gruppens

- Økende

- maskinvare

- Ha

- he

- Helse

- hjelpe

- hjulpet

- hjelper

- her.

- Høy

- høy ytelse

- høyere

- hans

- holder

- holder

- vert

- Hosting

- hostingtjenester

- hus

- Hvordan

- Hvordan

- Men

- HTML

- http

- HTTPS

- Hub

- menneskelig

- if

- bilde

- bilder

- gjennomføring

- importere

- in

- dyptgående

- inkludere

- inkluderer

- Inkludert

- Øke

- økende

- uavhengig

- industri

- Infrastruktur

- nyskapende

- inngang

- innganger

- installasjon

- f.eks

- forsikring

- integrert

- Intelligens

- interaksjon

- interaksjoner

- mellommann

- inn

- påkalt

- involvere

- IT

- DET ER

- Japan

- Jobb

- bli medlem

- ble med

- jpg

- JSON

- bare

- Vet

- kunnskap

- Labs

- Språk

- stor

- Store bedrifter

- større

- største

- Ventetid

- lansert

- lanseringer

- ledende

- LÆRE

- læring

- Lengde

- la

- bibliotekene

- Bibliotek

- i likhet med

- liker

- Begrenset

- Liste

- LLM

- laste

- lasting

- laster

- logging

- Lav

- lavere

- lavest

- maskin

- maskinlæring

- hovedsakelig

- opprettholder

- Flertall

- gjøre

- administrer

- fikk til

- leder

- Kart

- max

- maksimal

- Minne

- metode

- ML

- MLOps

- modell

- modeller

- Moduler

- mer

- mer effektivt

- mest

- flere

- navn

- Naturlig

- Natural Language Processing

- nødvendig

- Trenger

- behov

- Ny

- New York

- neste

- nlp

- Nobel pris

- bærbare

- nå

- Antall

- objekt

- of

- tilby

- Tilbud

- ofte

- Ohio

- on

- ONE

- bare

- åpen kildekode

- Drift

- optimalisering

- Optimalisere

- optimalisert

- Optimaliserer

- Alternativ

- alternativer

- or

- organisasjoner

- Annen

- vår

- ut

- utendørs

- produksjon

- utenfor

- egen

- pakker

- paradigmet

- Parallel

- parameter

- parametere

- passere

- passerer

- lidenskapelig

- ytelse

- Tilpassing

- plattform

- plato

- Platon Data Intelligence

- PlatonData

- plugg inn

- plugins

- Point

- Populær

- Post

- makt

- powered

- kraftig

- praksis

- Precision

- Spådommer

- Predictor

- trekkes

- Principal

- premie

- problemer

- prosess

- Prosesser

- prosessering

- Produkt

- Produktsjef

- Produkter

- Profil

- prosjekter

- lovet

- egenskaper

- eiendom

- gi

- forutsatt

- gir

- gi

- formål

- Python

- pytorch

- spenner

- å nå

- Lesning

- klar

- virkelige verden

- sanntids

- mottatt

- nylig

- anerkjennelse

- referert

- i slekt

- anmode

- forespørsler

- påkrevd

- behov

- Krav

- forskning

- forskere

- Ressurser

- svar

- resulterende

- Rise

- Kjør

- sagemaker

- SageMaker Inference

- samme

- Spar

- skalering

- scenarier

- skript

- SDK

- sømløst

- sekunder

- Seksjon

- se

- senior

- Sequence

- betjene

- tjeneste

- Tjenester

- servering

- sett

- innstillinger

- oppsett

- flere

- skift

- bør

- Vis

- showcased

- vist

- Viser

- side

- betydelig

- Silicon

- lignende

- Enkelt

- enkelt

- SIX

- Størrelse

- størrelser

- So

- Software

- programvareutvikling

- løsning

- Solutions

- Rom

- spesialist

- spesialisert

- tale

- Talegjenkjenning

- stabil

- stable

- Stabler

- Begynn

- startet

- starter

- startups

- lagring

- Stories

- lagring

- strømlinjeformet

- stil

- vellykket

- slik

- støtte

- Støttes

- Støtter

- system

- Systemer

- ta

- Undervisning

- lag

- teknikker

- Teknologi

- tensorflow

- tester

- enn

- Det

- De

- Området

- deres

- Dem

- Der.

- Disse

- denne

- tre

- Gjennom

- gjennomstrømning

- tid

- ganger

- til

- også

- verktøy

- Sporing

- trent

- Kurs

- transformers

- SVING

- to

- typen

- typisk

- lastet opp

- us

- bruke

- brukt

- ved hjelp av

- vanligvis

- bruke

- utnytte

- verdi

- variasjon

- ulike

- enorme

- veldig

- av

- video

- Virginia

- syn

- vente

- walkthrough

- Vei..

- we

- web

- webtjenester

- vekt

- Hva

- når

- hvilken

- vil

- med

- innenfor

- uten

- vitne

- ord

- Arbeid

- arbeidet

- arbeid

- virker

- verden

- skrive

- skriving

- york

- Du

- Din

- zephyrnet