Amazon SageMaker gir et bredt utvalg av maskinlæringsinfrastruktur (ML) og modelldistribusjonsalternativer for å hjelpe deg med å møte dine ML-slutningsbehov. Det er en fullstendig administrert tjeneste og integreres med MLOps-verktøy slik at du kan arbeide for å skalere modelldistribusjonen din, redusere slutningskostnader, administrere modeller mer effektivt i produksjon og redusere driftsbyrden. SageMaker gir flere slutningsalternativer slik at du kan velge det alternativet som passer best for din arbeidsmengde.

Nye generasjoner av CPUer tilbyr en betydelig ytelsesforbedring i ML-inferens på grunn av spesialiserte innebygde instruksjoner. I dette innlegget fokuserer vi på hvordan du kan dra nytte av AWS Graviton3-basert Amazon Elastic Compute Cloud (EC2) C7g-forekomster for å redusere slutningskostnadene med opptil 50 % i forhold til sammenlignbare EC2-forekomster sanntidsslutning på Amazon SageMaker. Vi viser hvordan du kan evaluere slutningsytelsen og bytte ML-arbeidsbelastningene dine til AWS Graviton-forekomster med bare noen få trinn.

For å dekke det populære og brede spekteret av kundeapplikasjoner, diskuterer vi i dette innlegget slutningsytelsen til PyTorch, TensorFlow, XGBoost og scikit-learn-rammeverk. Vi dekker datasyn (CV), naturlig språkbehandling (NLP), klassifisering og rangeringsscenarier for modeller og ml.c6g, ml.c7g, ml.c5 og ml.c6i SageMaker-forekomster for benchmarking.

Benchmarking resultater

AWS målte opptil 50 % kostnadsbesparelser for PyTorch, TensorFlow, XGBoost og scikit-learn-modellslutning med AWS Graviton3-baserte EC2 C7g-forekomster i forhold til sammenlignbare EC2-forekomster på Amazon SageMaker. Samtidig reduseres også slutningstiden.

Til sammenligning brukte vi fire forskjellige forekomsttyper:

Alle fire forekomstene har 16 vCPUer og 32 GiB minne.

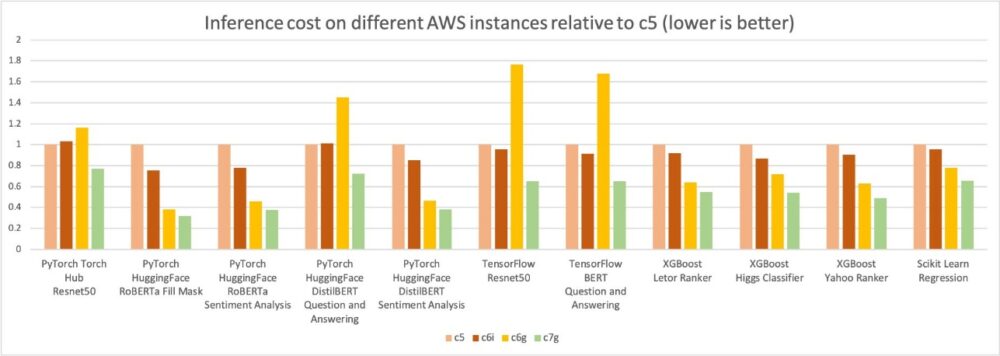

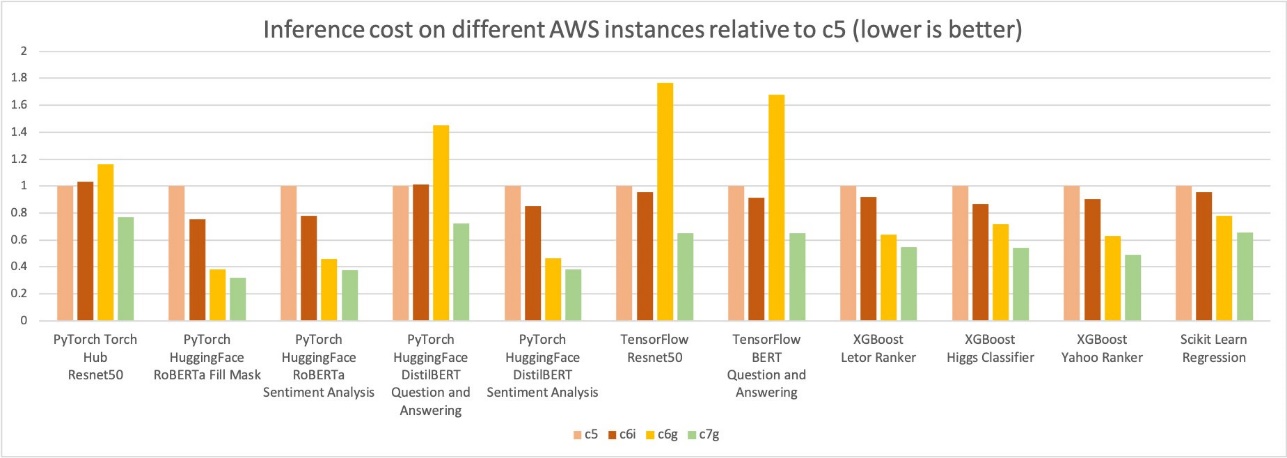

I den følgende grafen målte vi kostnaden per million inferens for de fire instanstypene. Vi normaliserte kostnaden per million slutningsresultater videre til en c5.4xlarge forekomst, som måles som 1 på Y-aksen til diagrammet. Du kan se at for XGBoost-modellene er kostnaden per million slutninger for c7g.4xlarge (AWS Graviton3) omtrent 50 % av c5.4xlarge og 40 % av c6i.4xlarge; for PyTorch NLP-modellene er kostnadsbesparelsen på ca. 30–50 % sammenlignet med c5 og c6i.4xlarge forekomster. For andre modeller og rammeverk målte vi minst 30 % kostnadsbesparelser sammenlignet med c5 og c6i.4xlarge forekomster.

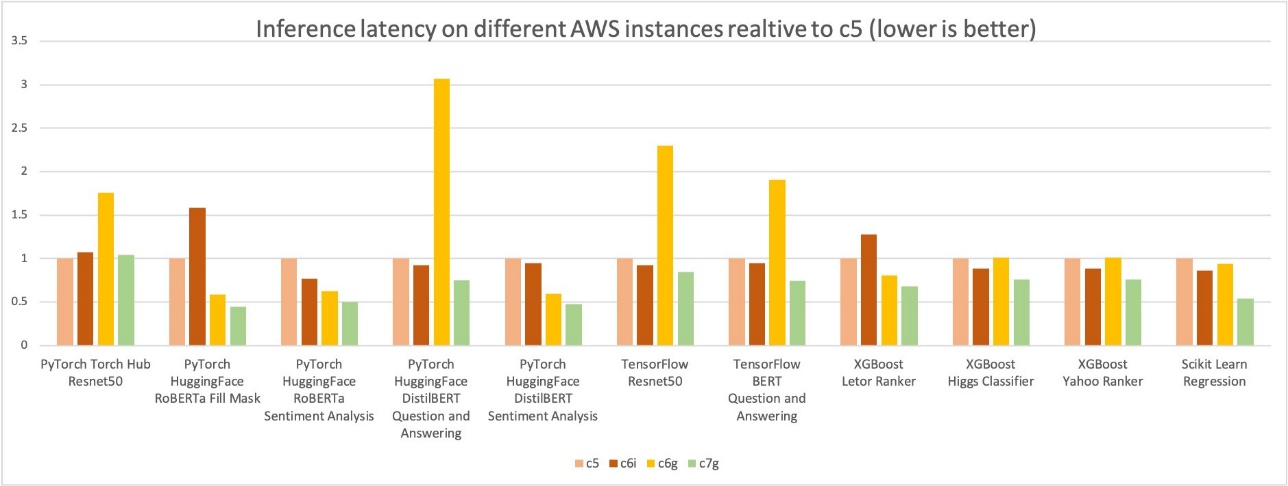

I likhet med den foregående slutningskostnadssammenligningsgrafen, viser følgende graf modell p90-latens for de samme fire forekomsttypene. Vi normaliserte latensresultatene videre til c5.4xlarge-forekomsten, som måles som 1 i Y-aksen til diagrammet. C7g.4xlarge (AWS Graviton3) modellinferenslatens er opptil 50 % bedre enn latensene målt på c5.4xlarge og c6i.4xlarge.

Migrer til AWS Graviton-forekomster

For å distribuere modellene dine til AWS Graviton-forekomster, kan du enten bruke AWS Deep Learning-beholdere (DLC-er) eller ta med egne containere som er kompatible med ARMv8.2-arkitekturen.

Migreringen (eller ny distribusjon) av modellene dine til AWS Graviton-forekomster er enkel fordi AWS tilbyr ikke bare containere for å være vert for modeller med PyTorch, TensorFlow, scikit-learn og XGBoost, men modellene er også arkitektonisk agnostiske. Du kan også ta med dine egne biblioteker, men vær sikker på at containeren din er bygget med et miljø som støtter ARMv8.2-arkitekturen. For mer informasjon, se Bygg din egen algoritmebeholder.

Du må fullføre tre trinn for å distribuere modellen din:

- Lag en SageMaker-modell. Dette vil blant annet inneholde informasjon om modellfilplasseringen, beholderen som skal brukes for distribusjonen og plasseringen av slutningsskriptet. (Hvis du allerede har en eksisterende modell distribuert i en beregningsoptimalisert slutningsforekomst, kan du hoppe over dette trinnet.)

- Opprett en endepunktkonfigurasjon. Denne vil inneholde informasjon om hvilken type instans du ønsker for endepunktet (for eksempel ml.c7g.xlarge for AWS Graviton3), navnet på modellen du opprettet i forrige trinn, og antall instanser per endepunkt.

- Start endepunktet med endepunktkonfigurasjonen opprettet i forrige trinn.

For detaljerte instruksjoner, se Kjør arbeidsbelastninger for maskinlæring på AWS Graviton-baserte forekomster med Amazon SageMaker

Benchmarking metodikk

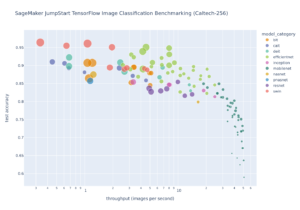

Vi brukte Amazon SageMaker Inference Recommender for å automatisere ytelsesbenchmarking på tvers av forskjellige instanser. Denne tjenesten sammenligner ytelsen til ML-modellen din når det gjelder ventetid og kostnader på ulike forekomster og anbefaler forekomsten og konfigurasjonen som gir best ytelse til lavest kostnad. Vi har samlet de nevnte ytelsesdataene ved hjelp av Inference Recommender. For flere detaljer, se GitHub repo.

Du kan også bruke det prøve notatbok å kjøre benchmarks og reprodusere resultatene. Vi brukte følgende modeller for benchmarking:

konklusjonen

AWS målte opptil 50 % kostnadsbesparelser for PyTorch, TensorFlow, XGBoost og scikit-learn-modellslutning med AWS Graviton3-baserte EC2 C7g-forekomster i forhold til sammenlignbare EC2-forekomster på Amazon SageMaker. Du kan migrere dine eksisterende inferensbrukstilfeller eller distribuere nye ML-modeller på AWS Graviton ved å følge trinnene i dette innlegget. Du kan også referere til AWS Graviton teknisk veiledning, som gir listen over optimaliserte biblioteker og beste fremgangsmåter som vil hjelpe deg å oppnå kostnadsfordeler med AWS Graviton-forekomster på tvers av ulike arbeidsbelastninger.

Hvis du finner brukstilfeller der lignende ytelsesgevinster ikke er observert på AWS Graviton, vennligst kontakt oss. Vi vil fortsette å legge til flere ytelsesforbedringer for å gjøre AWS Graviton til den mest kostnadseffektive og effektive prosessoren for generell bruk for ML-slutninger.

Om forfatterne

Sunita Nadampalli er Software Development Manager hos AWS. Hun leder Graviton-programvareytelsesoptimaliseringer for maskinlæring, HPC og multimediearbeidsbelastninger. Hun brenner for åpen kildekode-utvikling og å levere kostnadseffektive programvareløsninger med Arm SoCs.

Sunita Nadampalli er Software Development Manager hos AWS. Hun leder Graviton-programvareytelsesoptimaliseringer for maskinlæring, HPC og multimediearbeidsbelastninger. Hun brenner for åpen kildekode-utvikling og å levere kostnadseffektive programvareløsninger med Arm SoCs.

Jaymin Desai er en programvareutviklingsingeniør med Amazon SageMaker Inference-teamet. Han er lidenskapelig opptatt av å bringe AI til massene og forbedre brukervennligheten til toppmoderne AI-ressurser ved å produktisere dem til funksjoner og tjenester. På fritiden liker han å utforske musikk og reise.

Jaymin Desai er en programvareutviklingsingeniør med Amazon SageMaker Inference-teamet. Han er lidenskapelig opptatt av å bringe AI til massene og forbedre brukervennligheten til toppmoderne AI-ressurser ved å produktisere dem til funksjoner og tjenester. På fritiden liker han å utforske musikk og reise.

Mike Schneider er en systemutvikler, basert i Phoenix AZ. Han er medlem av Deep Learning-beholdere, og støtter forskjellige Framework-beholderbilder, for å inkludere Graviton Inference. Han er dedikert til infrastruktureffektivitet og stabilitet.

Mike Schneider er en systemutvikler, basert i Phoenix AZ. Han er medlem av Deep Learning-beholdere, og støtter forskjellige Framework-beholderbilder, for å inkludere Graviton Inference. Han er dedikert til infrastruktureffektivitet og stabilitet.

Mohan Gandhi er senior programvareingeniør hos AWS. Han har vært hos AWS de siste 10 årene og har jobbet med ulike AWS-tjenester som EMR, EFA og RDS. For tiden er han fokusert på å forbedre SageMaker Inference Experience. På fritiden liker han fotturer og maraton.

Mohan Gandhi er senior programvareingeniør hos AWS. Han har vært hos AWS de siste 10 årene og har jobbet med ulike AWS-tjenester som EMR, EFA og RDS. For tiden er han fokusert på å forbedre SageMaker Inference Experience. På fritiden liker han fotturer og maraton.

Qingwei Li er maskinlæringsspesialist hos Amazon Web Services. Han mottok sin doktorgrad. i operasjonsforskning etter at han brøt rådgiverens forskningsstipendkonto og ikke klarte å levere Nobelprisen han lovet. For tiden hjelper han kunder i finansiell tjenesteyting og forsikringsbransje med å bygge maskinlæringsløsninger på AWS. På fritiden liker han lesing og undervisning.

Qingwei Li er maskinlæringsspesialist hos Amazon Web Services. Han mottok sin doktorgrad. i operasjonsforskning etter at han brøt rådgiverens forskningsstipendkonto og ikke klarte å levere Nobelprisen han lovet. For tiden hjelper han kunder i finansiell tjenesteyting og forsikringsbransje med å bygge maskinlæringsløsninger på AWS. På fritiden liker han lesing og undervisning.

Wayne Toh er spesialistløsningsarkitekt for Graviton ved AWS. Han fokuserer på å hjelpe kunder med å ta i bruk ARM-arkitektur for store containerarbeidsmengder. Før han begynte i AWS, jobbet Wayne for flere store programvareleverandører, inkludert IBM og Red Hat.

Wayne Toh er spesialistløsningsarkitekt for Graviton ved AWS. Han fokuserer på å hjelpe kunder med å ta i bruk ARM-arkitektur for store containerarbeidsmengder. Før han begynte i AWS, jobbet Wayne for flere store programvareleverandører, inkludert IBM og Red Hat.

Lauren Mullennex er en løsningsarkitekt basert i Denver, CO. Hun jobber med kunder for å hjelpe dem med å arkitekte løsninger på AWS. På fritiden liker hun å gå tur og lage mat fra Hawaii.

Lauren Mullennex er en løsningsarkitekt basert i Denver, CO. Hun jobber med kunder for å hjelpe dem med å arkitekte løsninger på AWS. På fritiden liker hun å gå tur og lage mat fra Hawaii.

- SEO-drevet innhold og PR-distribusjon. Bli forsterket i dag.

- PlatoAiStream. Web3 Data Intelligence. Kunnskap forsterket. Tilgang her.

- Minting the Future med Adryenn Ashley. Tilgang her.

- Kjøp og selg aksjer i PRE-IPO-selskaper med PREIPO®. Tilgang her.

- kilde: https://aws.amazon.com/blogs/machine-learning/reduce-amazon-sagemaker-inference-cost-with-aws-graviton/

- : har

- :er

- :ikke

- :hvor

- $OPP

- 1

- 10

- 100

- 7

- 98

- a

- Om oss

- Logg inn

- Oppnå

- tvers

- legge til

- adoptere

- Fordel

- Etter

- AI

- algoritme

- allerede

- også

- Amazon

- Amazon SageMaker

- Amazon Web Services

- blant

- an

- og

- søknader

- arkitektur

- ER

- ARM

- AS

- Eiendeler

- At

- automatisere

- AWS

- basert

- BE

- fordi

- vært

- referansemåling

- benchmarks

- Fordeler

- BEST

- beste praksis

- Bedre

- bringe

- bred

- Broke

- bygge

- bygget

- innebygd

- byrde

- men

- by

- CAN

- saker

- Figur

- klassifisering

- Cloud

- CO

- sammenlign

- sammenlignet

- sammenligning

- kompatibel

- fullføre

- Beregn

- datamaskin

- Datamaskin syn

- Konfigurasjon

- inneholde

- Container

- Containere

- fortsette

- Kostnad

- kostnadsbesparelser

- kostnadseffektiv

- Kostnader

- dekke

- opprettet

- I dag

- kunde

- Kunder

- dato

- dedikert

- dyp

- dyp læring

- leverer

- levere

- Denver

- utplassere

- utplassert

- distribusjon

- detaljert

- detaljer

- Utvikler

- Utvikling

- forskjellig

- diskutere

- gjør

- to

- effektivt

- effektivitet

- effektiv

- enten

- Endpoint

- ingeniør

- Miljø

- evaluere

- eksempel

- eksisterende

- erfaring

- Utforske

- Mislyktes

- Egenskaper

- Noen få

- filet

- finansiell

- økonomiske tjenester

- Finn

- Fokus

- fokuserte

- fokuserer

- etter

- Til

- fire

- Rammeverk

- rammer

- Gratis

- videre

- inntjening

- generell

- generasjoner

- gir

- innvilge

- graf

- hatt

- Ha

- he

- hjelpe

- hjelpe

- hjelper

- her

- hans

- vert

- Hvordan

- hpc

- HTML

- HTTPS

- IBM

- if

- bilder

- forbedring

- forbedringer

- bedre

- in

- inkludere

- Inkludert

- industri

- informasjon

- Infrastruktur

- f.eks

- instruksjoner

- forsikring

- Integrerer

- inn

- sammenføyning

- jpg

- bare

- Språk

- stor

- Siste

- Ventetid

- Fører

- læring

- minst

- bibliotekene

- i likhet med

- liker

- Liste

- plassering

- lavest

- maskin

- maskinlæring

- gjøre

- administrer

- leder

- massene

- Møt

- medlem

- Minne

- migrere

- migrasjon

- millioner

- ML

- MLOps

- modell

- modeller

- mer

- mest

- multimedia

- flere

- musikk

- navn

- Naturlig

- Natural Language Processing

- Trenger

- behov

- Ny

- nlp

- Nobel pris

- Antall

- of

- tilby

- on

- bare

- åpen kildekode

- operasjonell

- Drift

- optimalisert

- Alternativ

- alternativer

- or

- rekkefølge

- Annen

- ut

- egen

- parametere

- lidenskapelig

- ytelse

- phoenix

- plukke

- plato

- Platon Data Intelligence

- PlatonData

- vær så snill

- Populær

- Post

- praksis

- forrige

- Før

- premie

- prosessering

- prosessor

- Produksjon

- lovet

- gi

- forutsatt

- gir

- pytorch

- område

- Ranking

- å nå

- Lesning

- mottatt

- anbefaler

- Rød

- Red Hat

- redusere

- Redusert

- forskning

- Resultater

- Kjør

- sagemaker

- SageMaker Inference

- samme

- Besparelser

- Skala

- scenarier

- scikit lære

- se

- utvalg

- senior

- tjeneste

- Tjenester

- flere

- hun

- Vis

- Viser

- signifikant

- lignende

- So

- Software

- programvareutvikling

- Software Engineer

- Solutions

- spesialist

- spesialisert

- Stabilitet

- state-of-the-art

- Trinn

- Steps

- rett fram

- Støtte

- Støtter

- Bytte om

- Systemer

- Ta

- ta

- Undervisning

- lag

- Teknisk

- tensorflow

- vilkår

- enn

- Det

- De

- informasjonen

- Dem

- denne

- tre

- tid

- til

- verktøy

- Traveling

- typen

- typer

- us

- brukervennlighet

- bruke

- brukt

- ved hjelp av

- ulike

- leverandører

- syn

- ønsker

- we

- web

- webtjenester

- VI VIL

- hvilken

- vil

- med

- Arbeid

- arbeidet

- virker

- Xgboost

- år

- Du

- Din

- zephyrnet