En video lagt ut av en Vision Pro-utvikler ser ut til å vise de nåværende nivåene for håndsporing og okklusjonsytelse som Apples nye hodesett er i stand til.

Apple Vision Pro, forventes lansert i løpet av de neste månedene, vil bruke håndsporing som primær inndatametode. Mens interaksjoner på systemnivå kombinerer håndsporing med øyesporing for en "se og trykk"-modalitet, kan utviklere også bygge applikasjoner som lar brukere samhandle direkte med applikasjoner ved å bruke hendene.

Håndsporing på Vision Pro kan deles inn i to forskjellige funksjoner: "håndsporing" og "håndokklusjon".

Håndsporing er den estimerte 3D-modellen av hånden, dens ledd og posisjonen til fingertuppene. Denne modellen brukes til å bestemme når objekter blir berørt, grepet og interagert med.

Håndokklusjon handler om hvordan systemet overlegger den virkelige hånden din på virtuelt innhold. I stedet for å tegne en 3D-modell av en virtuell hånd inn i scenen, kutter Vision Pro ut bildet av de ekte hendene dine for å vise dem i scenen i stedet. Å gjøre det legger til et nytt lag av realisme til det virtuelle innholdet fordi du kan se dine egne, unike hender.

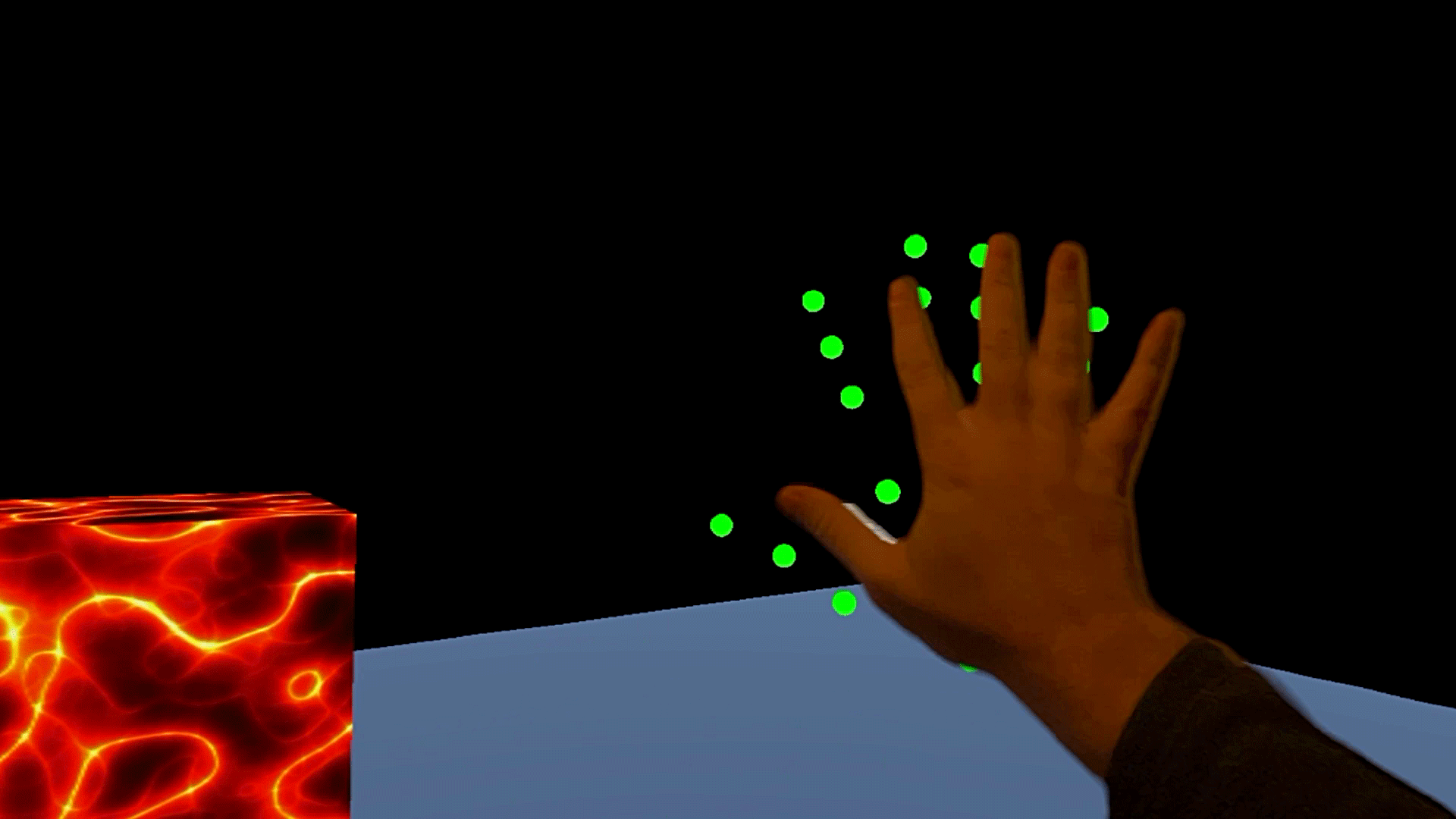

En utviklerbygning for Vision Pro ved bruk av Unity la ut en video som gir et tydelig blikk på både håndsporing og okklusjon.

I videoen over viser de virkelige hendene okklusjonssystemet i aksjon, mens de grønne prikkene viser den estimerte 3D-posisjonen til hånden.

Vi kan se at håndokklusjon er veldig bra, men ikke perfekt; når du er helt omgitt av virtuelt innhold og beveger deg raskt, kan du se noen klipp rundt kantene på hånden.

I mellomtiden ligger den faktiske håndsporingsposisjonen lenger bak håndokklusjonen, et sted rundt 100–200 ms bak. Vi kan imidlertid ikke helt bestemme den sanne latensen til Vision Pros håndsporing, fordi vi bare har en visning av okklusjonssporingshendene å sammenligne den med (som selv vil ha en viss latens med hensyn til de virkelige hendene).

I denne sammenhengen kommer videoen fra en Unity-utviklersamtale som sa at deres tidlige eksperimenter med Vision Pro viste svært høy håndsporingsforsinkelse, tilsynelatende sammenlignet med de nyeste Quest-håndsporingsmulighetene. Andre Unity-utviklere var enige om at de så lignende latens på sine egne Vision Pro-enheter.

Den aktuelle videoen er imidlertid en håndsporingsintegrasjon inne i en Unity-app, noe som betyr at håndsporingsytelsen og latensen kan ha flere faktorer knyttet til Unity som ikke er til stede når du bruker Apples førsteparts Vision Pro-utviklingsverktøy. Og med tanke på at headsettet ikke er lansert ennå og disse verktøyene fortsatt er under utvikling, kan vi se ytterligere forbedringer når headsettet faktisk når butikkene.

- SEO-drevet innhold og PR-distribusjon. Bli forsterket i dag.

- PlatoData.Network Vertical Generative Ai. Styrk deg selv. Tilgang her.

- PlatoAiStream. Web3 Intelligence. Kunnskap forsterket. Tilgang her.

- PlatoESG. Karbon, CleanTech, Energi, Miljø, Solenergi, Avfallshåndtering. Tilgang her.

- PlatoHelse. Bioteknologisk og klinisk etterretning. Tilgang her.

- kilde: https://www.roadtovr.com/apple-vision-pro-unity-hand-tracking-occlusion/

- :er

- :ikke

- 3d

- a

- ovenfor

- Handling

- faktiske

- faktisk

- Ytterligere

- Legger

- avtalte

- tillate

- også

- og

- En annen

- app

- vises

- eple

- søknader

- ER

- rundt

- AS

- At

- BE

- fordi

- bak

- både

- Brutt

- bygge

- Bygning

- men

- by

- CAN

- evner

- stand

- fjerne

- kombinere

- kommer

- sammenligne

- sammenligning

- vurderer

- innhold

- kontekst

- Samtale

- Gjeldende

- kutt

- Tilbud

- Bestem

- Utvikler

- utviklere

- Utvikling

- utviklingsverktøy

- Enheter

- direkte

- distinkt

- gjør

- tegning

- Tidlig

- fullstendig

- anslått

- eksperimenter

- faktorer

- Noen få

- tuppene

- Til

- fra

- videre

- gir

- Glimpse

- god

- Grønn

- hånd

- hender

- Ha

- Headset

- Høy

- Hvordan

- Men

- HTTPS

- bilde

- forbedringer

- in

- inngang

- innsiden

- i stedet

- integrering

- samhandle

- interaksjoner

- inn

- IT

- DET ER

- Ventetid

- siste

- lansere

- lansert

- lag

- nivåer

- Se

- Kan..

- midler

- metode

- modell

- flytting

- Ny

- nytt hodesett

- neste

- gjenstander

- of

- Tilbud

- on

- bare

- videre til

- Annen

- ut

- egen

- perfekt

- ytelse

- plato

- Platon Data Intelligence

- PlatonData

- posisjon

- postet

- presentere

- primære

- pro

- søken

- quest håndsporing

- spørsmål

- raskt

- ganske

- heller

- Når

- ekte

- realisme

- betrakte

- sier

- scene

- se

- se

- Vis

- viste

- lignende

- So

- noen

- et sted

- Still

- butikker

- omgitt

- system

- enn

- Det

- De

- deres

- Dem

- seg

- Disse

- de

- denne

- tid

- til

- verktøy

- berørt

- sant

- to

- unik

- enhet

- bruke

- brukt

- Brukere

- ved hjelp av

- veldig

- video

- Se

- virtuelle

- syn

- we

- var

- når

- hvilken

- mens

- vil

- med

- ennå

- Du

- Din

- zephyrnet