Amazon Sage Maker zapewnia szeroki wybór infrastruktury uczenia maszynowego (ML) i opcji wdrażania modeli, aby pomóc spełnić Twoje potrzeby wnioskowania ML. Jest to w pełni zarządzana usługa, która integruje się z narzędziami MLOps, dzięki czemu możesz skalować wdrożenie modelu, zmniejszać koszty wnioskowania, wydajniej zarządzać modelami w produkcji i zmniejszać obciążenia operacyjne. SageMaker zapewnia wiele opcje wnioskowania dzięki czemu możesz wybrać opcję, która najlepiej pasuje do Twojego obciążenia pracą.

Nowe generacje procesorów oferują znaczną poprawę wydajności wnioskowania ML dzięki wyspecjalizowanym wbudowanym instrukcjom. W tym poście skupimy się na tym, jak możesz skorzystać z Grawiton AWS3oparta na Amazon Elastic Compute Cloud (EC2) Instancje C7g aby pomóc zredukować koszty wnioskowania nawet o 50% w porównaniu z porównywalnymi instancjami EC2 dla wnioskowanie w czasie rzeczywistym na Amazon SageMaker. Pokazujemy, jak można ocenić wydajność wnioskowania i przełączyć obciążenia ML na instancje AWS Graviton w zaledwie kilku krokach.

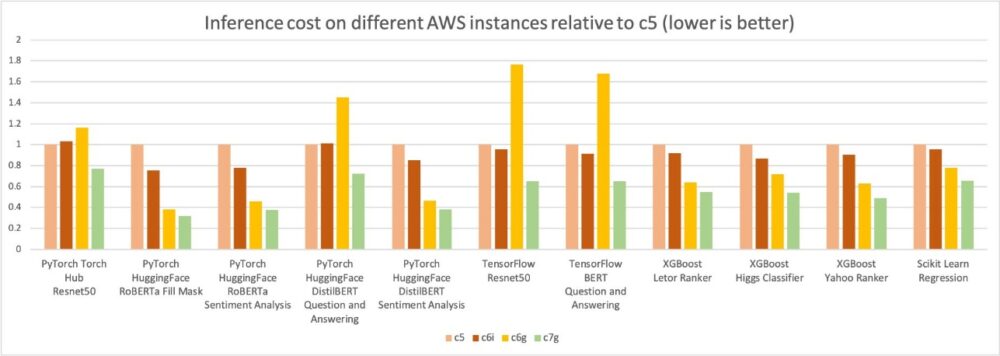

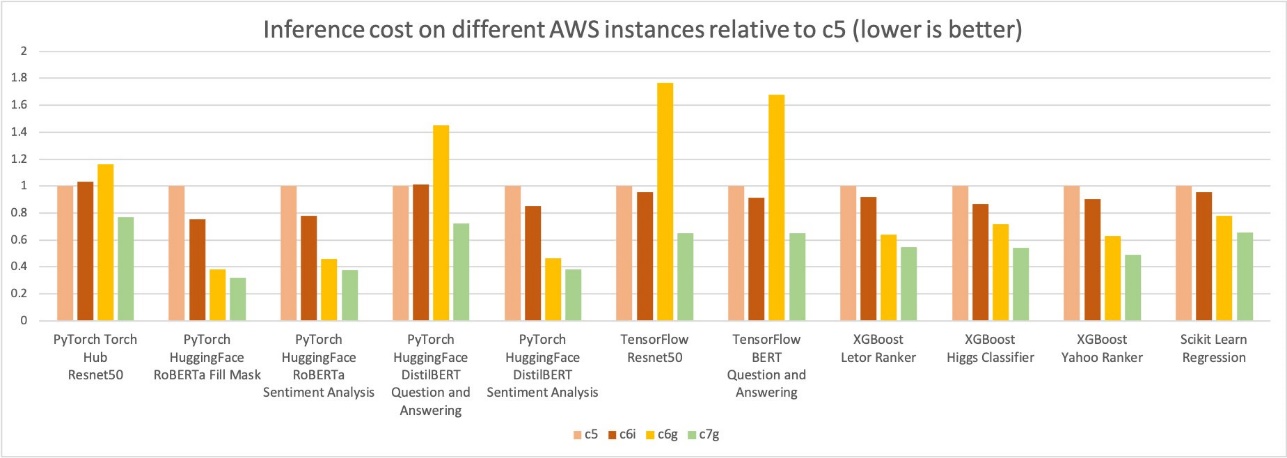

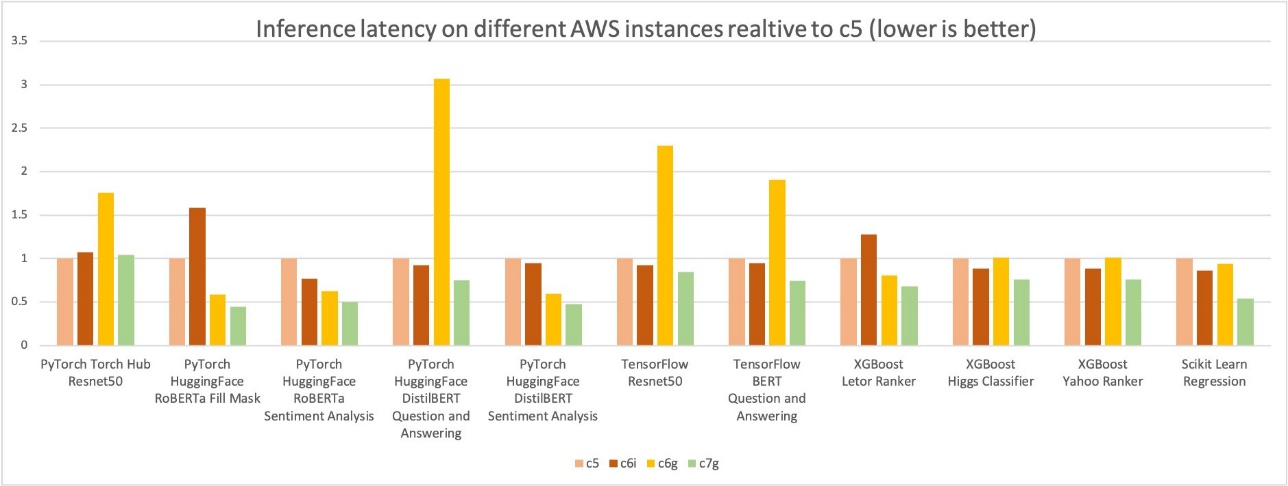

Aby objąć popularny i szeroki zakres aplikacji klienckich, w tym poście omawiamy wydajność wnioskowania platform PyTorch, TensorFlow, XGBoost i scikit-learn. Obejmujemy scenariusze widzenia komputerowego (CV), przetwarzania języka naturalnego (NLP), klasyfikacji i rankingu dla modeli oraz instancji ml.c6g, ml.c7g, ml.c5 i ml.c6i SageMaker do testów porównawczych.

Wyniki analizy porównawczej

AWS zmierzył do 50% oszczędności kosztów dla wnioskowania o modelach PyTorch, TensorFlow, XGBoost i scikit-learn z instancjami EC3 C2g opartymi na AWS Graviton7 w porównaniu z porównywalnymi instancjami EC2 na Amazon SageMaker. Jednocześnie zmniejsza się również opóźnienie wnioskowania.

Dla porównania użyliśmy czterech różnych typów instancji:

Wszystkie cztery instancje mają 16 procesorów wirtualnych i 32 GiB pamięci.

Na poniższym wykresie zmierzyliśmy wnioskowanie o koszcie na milion dla czterech typów instancji. Następnie znormalizowaliśmy koszt na milion wyników wnioskowania do wystąpienia c5.4xlarge, które jest mierzone jako 1 na osi Y wykresu. Jak widać, dla modeli XGBoost wnioskowanie o koszcie na milion dla c7g.4xlarge (AWS Graviton3) wynosi około 50% c5.4xlarge i 40% c6i.4xlarge; w przypadku modeli PyTorch NLP oszczędności kosztów wynoszą około 30–50% w porównaniu z instancjami c5 i c6i.4xlarge. W przypadku innych modeli i platform zmierzyliśmy co najmniej 30% oszczędności kosztów w porównaniu z instancjami c5 i c6i.4xlarge.

Podobnie jak w przypadku poprzedniego wykresu porównania kosztów wnioskowania, poniższy wykres przedstawia opóźnienie modelu p90 dla tych samych czterech typów wystąpień. Następnie znormalizowaliśmy wyniki opóźnienia do instancji c5.4xlarge, która jest mierzona jako 1 na osi Y wykresu. Opóźnienie wnioskowania modelu c7g.4xlarge (AWS Graviton3) jest do 50% lepsze niż opóźnienia zmierzone na c5.4xlarge i c6i.4xlarge.

Migruj do instancji AWS Graviton

Aby wdrożyć swoje modele w instancjach AWS Graviton, możesz użyć Kontenery AWS Deep Learning (DLC) lub przynieść własne pojemniki które są kompatybilne z architekturą ARMv8.2.

Migracja (lub nowe wdrożenie) twoich modeli do instancji AWS Graviton jest prosta, ponieważ AWS nie tylko zapewnia kontenery do hostowania modeli z PyTorch, TensorFlow, scikit-learn i XGBoost, ale modele są również niezależne od architektury. Możesz także przynieść własne biblioteki, ale upewnij się, że Twój kontener jest zbudowany w środowisku obsługującym architekturę ARMv8.2. Aby uzyskać więcej informacji, zobacz Budowanie własnego kontenera algorytmów.

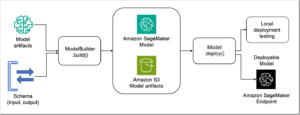

Aby wdrożyć model, musisz wykonać trzy kroki:

- Utwórz model SageMaker. Będzie to zawierało między innymi informacje o lokalizacji pliku modelu, kontenerze, który zostanie użyty do wdrożenia oraz lokalizacji skryptu wnioskowania. (Jeśli masz już wdrożony istniejący model w wystąpieniu wnioskowania zoptymalizowanym pod kątem obliczeń, możesz pominąć ten krok).

- Utwórz konfigurację punktu końcowego. Będzie to zawierało informacje o typie instancji dla punktu końcowego (na przykład ml.c7g.xlarge dla AWS Graviton3), nazwę modelu utworzonego w poprzednim kroku oraz liczbę instancji na punkt końcowy.

- Uruchom punkt końcowy z konfiguracją punktu końcowego utworzoną w poprzednim kroku.

Aby uzyskać szczegółowe instrukcje, zobacz Uruchamiaj obciążenia wnioskowania uczenia maszynowego w instancjach opartych na AWS Graviton za pomocą Amazon SageMaker

Metodologia benchmarkingu

Użyliśmy Polecający wnioskowanie Amazon SageMaker do automatyzacji testów porównawczych wydajności w różnych instancjach. Ta usługa porównuje wydajność Twojego modelu ML pod względem opóźnień i kosztów w różnych instancjach oraz zaleca instancję i konfigurację, która zapewnia najlepszą wydajność przy najniższych kosztach. Zebraliśmy wyżej wymienione dane dotyczące wydajności za pomocą narzędzia Rekomendujący wnioskowanie. Aby uzyskać więcej informacji, zapoznaj się z GitHub repo.

Możesz użyć przykładowy notatnik przeprowadzać testy porównawcze i odtwarzać wyniki. Do analizy porównawczej wykorzystaliśmy następujące modele:

Wnioski

AWS zmierzył do 50% oszczędności kosztów dla wnioskowania o modelach PyTorch, TensorFlow, XGBoost i scikit-learn z instancjami EC3 C2g opartymi na AWS Graviton7 w porównaniu z porównywalnymi instancjami EC2 na Amazon SageMaker. Możesz przeprowadzić migrację istniejących przypadków użycia wnioskowania lub wdrożyć nowe modele ML w AWS Graviton, wykonując czynności opisane w tym poście. Możesz również odnieść się do Przewodnik techniczny AWS Graviton, która zawiera listę zoptymalizowanych bibliotek i najlepszych praktyk, które pomogą Ci osiągnąć korzyści kosztowe z instancjami AWS Graviton przy różnych obciążeniach.

Jeśli znajdziesz przypadki użycia, w których podobny wzrost wydajności nie jest obserwowany w AWS Graviton, skontaktuj się z nami. Będziemy nadal dodawać więcej ulepszeń wydajności, aby uczynić AWS Graviton najbardziej opłacalnym i wydajnym procesorem ogólnego przeznaczenia do wnioskowania ML.

O autorach

Sunita Nadampalli jest Software Development Managerem w AWS. Prowadzi optymalizację wydajności oprogramowania Graviton pod kątem uczenia maszynowego, HPC i obciążeń multimedialnych. Jest pasjonatką rozwoju open source i dostarczania opłacalnych rozwiązań programowych z ARM SoC.

Sunita Nadampalli jest Software Development Managerem w AWS. Prowadzi optymalizację wydajności oprogramowania Graviton pod kątem uczenia maszynowego, HPC i obciążeń multimedialnych. Jest pasjonatką rozwoju open source i dostarczania opłacalnych rozwiązań programowych z ARM SoC.

Jaymina Desai jest inżynierem ds. rozwoju oprogramowania w zespole Amazon SageMaker Inference. Pasjonuje go upowszechnianie sztucznej inteligencji i zwiększanie użyteczności najnowocześniejszych zasobów sztucznej inteligencji poprzez przekształcanie ich w funkcje i usługi. W wolnym czasie lubi odkrywać muzykę i podróżować.

Jaymina Desai jest inżynierem ds. rozwoju oprogramowania w zespole Amazon SageMaker Inference. Pasjonuje go upowszechnianie sztucznej inteligencji i zwiększanie użyteczności najnowocześniejszych zasobów sztucznej inteligencji poprzez przekształcanie ich w funkcje i usługi. W wolnym czasie lubi odkrywać muzykę i podróżować.

Mike'a Schneidera jest programistą systemów z siedzibą w Phoenix AZ. Jest członkiem kontenerów Deep Learning, obsługujących różne obrazy kontenerów Framework, w tym Graviton Inference. Zajmuje się wydajnością i stabilnością infrastruktury.

Mike'a Schneidera jest programistą systemów z siedzibą w Phoenix AZ. Jest członkiem kontenerów Deep Learning, obsługujących różne obrazy kontenerów Framework, w tym Graviton Inference. Zajmuje się wydajnością i stabilnością infrastruktury.

Mohana Gandhiego jest starszym inżynierem oprogramowania w AWS. Jest związany z AWS od 10 lat i pracował nad różnymi usługami AWS, takimi jak EMR, EFA i RDS. Obecnie koncentruje się na ulepszaniu SageMaker Inference Experience. W wolnym czasie lubi spacery i maratony.

Mohana Gandhiego jest starszym inżynierem oprogramowania w AWS. Jest związany z AWS od 10 lat i pracował nad różnymi usługami AWS, takimi jak EMR, EFA i RDS. Obecnie koncentruje się na ulepszaniu SageMaker Inference Experience. W wolnym czasie lubi spacery i maratony.

Qingwei Li jest specjalistą ds. uczenia maszynowego w Amazon Web Services. Otrzymał stopień doktora. w badaniach operacyjnych po tym, jak złamał konto grantu naukowego swojego doradcy i nie przekazał obiecanej nagrody Nobla. Obecnie pomaga klientom z branży usług finansowych i ubezpieczeniowych budować rozwiązania machine learning na platformie AWS. W wolnym czasie lubi czytać i uczyć.

Qingwei Li jest specjalistą ds. uczenia maszynowego w Amazon Web Services. Otrzymał stopień doktora. w badaniach operacyjnych po tym, jak złamał konto grantu naukowego swojego doradcy i nie przekazał obiecanej nagrody Nobla. Obecnie pomaga klientom z branży usług finansowych i ubezpieczeniowych budować rozwiązania machine learning na platformie AWS. W wolnym czasie lubi czytać i uczyć.

Wayne’a Toha jest Specjalistycznym Architektem Rozwiązań dla Graviton w AWS. Koncentruje się na pomaganiu klientom we wdrażaniu architektury ARM do obsługi kontenerów na dużą skalę. Przed dołączeniem do AWS Wayne pracował dla kilku dużych dostawców oprogramowania, w tym IBM i Red Hat.

Wayne’a Toha jest Specjalistycznym Architektem Rozwiązań dla Graviton w AWS. Koncentruje się na pomaganiu klientom we wdrażaniu architektury ARM do obsługi kontenerów na dużą skalę. Przed dołączeniem do AWS Wayne pracował dla kilku dużych dostawców oprogramowania, w tym IBM i Red Hat.

Lauren Mullennex jest architektem rozwiązań z siedzibą w Denver w stanie Kolorado. Pracuje z klientami, pomagając im w projektowaniu rozwiązań w AWS. W wolnym czasie lubi chodzić po górach i gotować kuchnię hawajską.

Lauren Mullennex jest architektem rozwiązań z siedzibą w Denver w stanie Kolorado. Pracuje z klientami, pomagając im w projektowaniu rozwiązań w AWS. W wolnym czasie lubi chodzić po górach i gotować kuchnię hawajską.

- Dystrybucja treści i PR oparta na SEO. Uzyskaj wzmocnienie już dziś.

- PlatoAiStream. Analiza danych Web3. Wiedza wzmocniona. Dostęp tutaj.

- Wybijanie przyszłości w Adryenn Ashley. Dostęp tutaj.

- Kupuj i sprzedawaj akcje spółek PRE-IPO z PREIPO®. Dostęp tutaj.

- Źródło: https://aws.amazon.com/blogs/machine-learning/reduce-amazon-sagemaker-inference-cost-with-aws-graviton/

- :ma

- :Jest

- :nie

- :Gdzie

- $W GÓRĘ

- 1

- 10

- 100

- 7

- 98

- a

- O nas

- Konto

- Osiągać

- w poprzek

- Dodaj

- przyjąć

- Korzyść

- Po

- AI

- algorytm

- już

- również

- Amazonka

- Amazon Sage Maker

- Amazon Web Services

- wśród

- an

- i

- aplikacje

- architektura

- SĄ

- ARM

- AS

- Aktywa

- At

- zautomatyzować

- AWS

- na podstawie

- BE

- bo

- być

- Benchmarkingu

- Benchmarki

- Korzyści

- BEST

- Najlepsze praktyki

- Ulepsz Swój

- przynieść

- szeroki

- Zepsuł się

- budować

- wybudowany

- wbudowany

- ciężar

- ale

- by

- CAN

- Etui

- Wykres

- klasyfikacja

- Chmura

- CO

- porównywalny

- w porównaniu

- porównanie

- zgodny

- kompletny

- obliczać

- komputer

- Wizja komputerowa

- systemu

- zawierać

- Pojemnik

- Pojemniki

- kontynuować

- Koszty:

- oszczędności

- opłacalne

- Koszty:

- pokrywa

- stworzony

- Obecnie

- klient

- Klientów

- dane

- dedykowane

- głęboko

- głęboka nauka

- dostarczyć

- dostarczanie

- Denver

- rozwijać

- wdrażane

- Wdrożenie

- szczegółowe

- detale

- Deweloper

- oprogramowania

- różne

- dyskutować

- robi

- z powodu

- faktycznie

- efektywność

- wydajny

- bądź

- Punkt końcowy

- inżynier

- Środowisko

- oceniać

- przykład

- Przede wszystkim system został opracowany

- doświadczenie

- Exploring

- Failed

- Korzyści

- kilka

- filet

- budżetowy

- usługi finansowe

- Znajdź

- Skupiać

- koncentruje

- koncentruje

- następujący

- W razie zamówieenia projektu

- cztery

- Framework

- Ramy

- Darmowy

- dalej

- Zyski

- ogólny cel

- Pokoleń

- daje

- przyznać

- wykres

- kapelusz

- Have

- he

- pomoc

- pomoc

- pomaga

- jej

- jego

- gospodarz

- W jaki sposób

- HPC

- HTML

- HTTPS

- IBM

- if

- zdjęcia

- poprawa

- ulepszenia

- poprawy

- in

- zawierać

- Włącznie z

- przemysł

- Informacja

- Infrastruktura

- przykład

- instrukcje

- ubezpieczenie

- Integruje się

- najnowszych

- łączący

- jpg

- właśnie

- język

- duży

- Nazwisko

- Utajenie

- Wyprowadzenia

- nauka

- najmniej

- biblioteki

- lubić

- lubi

- Lista

- lokalizacja

- najniższy

- maszyna

- uczenie maszynowe

- robić

- zarządzanie

- kierownik

- Masy

- Poznaj nasz

- członek

- Pamięć

- migrować

- migracja

- milion

- ML

- MLOps

- model

- modele

- jeszcze

- większość

- multimedialny

- wielokrotność

- Muzyka

- Nazwa

- Naturalny

- Przetwarzanie języka naturalnego

- Potrzebować

- wymagania

- Nowości

- nlp

- nagroda Nobla

- numer

- of

- oferta

- on

- tylko

- open source

- operacyjny

- operacje

- zoptymalizowane

- Option

- Opcje

- or

- zamówienie

- Inne

- na zewnątrz

- własny

- parametry

- namiętny

- jest gwarancją najlepszej jakości, które mogą dostarczyć Ci Twoje monitory,

- feniks

- wybierać

- plato

- Analiza danych Platona

- PlatoDane

- Proszę

- Popularny

- Post

- praktyki

- poprzedni

- Wcześniejszy

- nagroda

- przetwarzanie

- Procesor

- Produkcja

- obiecał

- zapewniać

- pod warunkiem,

- zapewnia

- płomień

- zasięg

- Ranking

- dosięgnąć

- Czytający

- Odebrane

- zaleca

- Czerwony

- Red Hat

- zmniejszyć

- Zredukowany

- Badania naukowe

- Efekt

- run

- sagemaker

- Wnioskowanie SageMakera

- taki sam

- Oszczędności

- Skala

- scenariusze

- nauka-scikit

- widzieć

- wybór

- senior

- usługa

- Usługi

- kilka

- ona

- pokazać

- Targi

- znaczący

- podobny

- So

- Tworzenie

- rozwoju oprogramowania

- Software Engineer

- Rozwiązania

- specjalista

- wyspecjalizowanym

- Stabilność

- state-of-the-art

- Ewolucja krok po kroku

- Cel

- bezpośredni

- Wspierający

- podpory

- Przełącznik

- systemy

- Brać

- biorąc

- Nauczanie

- zespół

- Techniczny

- tensorflow

- REGULAMIN

- niż

- że

- Połączenia

- Informacje

- Im

- to

- trzy

- czas

- do

- narzędzia

- Podróżowanie

- rodzaj

- typy

- us

- użyteczność

- posługiwać się

- używany

- za pomocą

- różnorodny

- sprzedawców

- wizja

- chcieć

- we

- sieć

- usługi internetowe

- DOBRZE

- który

- będzie

- w

- Praca

- pracował

- działa

- XGBoost

- lat

- You

- Twój

- zefirnet